- 30 Iunie, 2014

- Vasilis Vryniotis

- . Fara comentarii

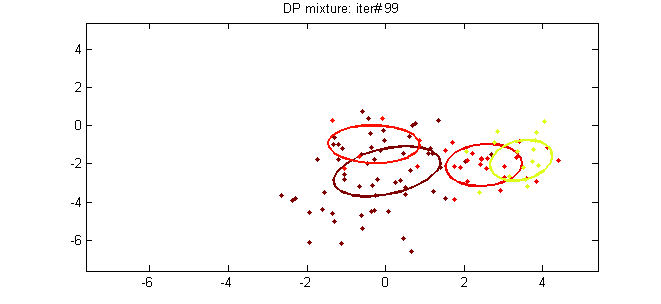

Acest articol este a cincea parte a tutorialului despre Clustering cu DPMM. În postările anterioare am acoperit în detaliu fundalul teoretic al metodei și am descris reprezentările ei matematice mu și modalitățile de construire a acesteia. În acest post vom încerca să legăm teoria cu practica prin introducerea a două modele DPMM: Modelul de amestec normal multivariat Dirichlet, care poate fi utilizat pentru a grupa datele gaussiene și Modelul de amestec Dirichlet-Multinomial, care este utilizat pentru a cluster documente.

Actualizare: Datumbox Machine Learning Framework este acum open-source și gratuit Descarca. Consultați pachetul com.datumbox.framework.machinelearning.clustering pentru a vedea implementarea modelelor Dirichlet Process Mixture în Java.

1. Modelul de amestec normal multivariat Dirichlet

Primul model de amestec al procesului Dirichlet pe care îl vom examina este Modelul de amestec normal multivariat Dirichlet, care poate fi utilizat pentru a realiza gruparea pe seturi de date continue. Modelul de amestec este definit după cum urmează:

![]()

![]()

![]()

Ecuația 1: Modelul de amestec normal multivariat Dirichlet

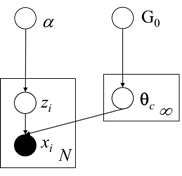

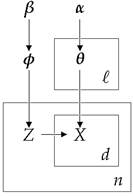

După cum putem vedea mai sus, modelul particular presupune că distribuția generativă este distribuția gaussiană multinomială și utilizează procesul restaurantului chinezesc ca anterior pentru atribuirea clusterului. Mai mult, pentru distribuția de bază G0 folosește anterior Normal-Inverse-Wishart care este conjugat anterior de distribuție normală multivariată cu medie necunoscută și matrice de covarianță. Mai jos vă prezentăm Modelul Grafic al modelului de amestec:

Figura 1: Modelul grafic al modelului de amestec normal multivariat Dirichlet

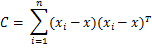

După cum am discutat mai devreme, pentru a putea estima alocările clusterului, vom folosi Eșantionare Gibbs prăbușită care necesită selectarea anterioare conjugate adecvate. Mai mult, va trebui să actualizăm parametrii dați ulterior priorul şi dovezile. Mai jos vedem Estimări MAP a parametrilor pentru unul dintre clustere:

![]()

![]()

![]()

![]()

![]()

Ecuația 2: estimări MAP pentru parametrii clusterului

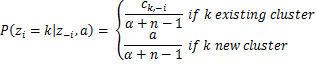

Unde d este dimensionalitatea datelor noastre și ![]() este media eșantionului. Mai mult, avem mai mulți hiperparametri ai Normal-Inverse-Wishart, cum ar fi μ0 care este media inițială, κ0 este fracția medie care funcționează ca parametru de netezire, ν0 este gradele de libertate care sunt setate la numărul de dimensiuni și Ψ0 este produsul abaterii perechi care este setat la matricea de identitate dxd înmulțit cu o constantă. De acum înainte toți hiperparametrii anteriori ai lui G0 va fi notat cu λ pentru a simplifica notația. În cele din urmă, având toate cele de mai sus, putem estima probabilitățile cerute de Collapsed Gibbs Sampler. Probabilitatea ca observația i să aparțină clusterului k având în vedere atribuirile clusterului, setul de date și toți hiperparametrii α și λ ai DP și G0 este prezentat mai jos:

este media eșantionului. Mai mult, avem mai mulți hiperparametri ai Normal-Inverse-Wishart, cum ar fi μ0 care este media inițială, κ0 este fracția medie care funcționează ca parametru de netezire, ν0 este gradele de libertate care sunt setate la numărul de dimensiuni și Ψ0 este produsul abaterii perechi care este setat la matricea de identitate dxd înmulțit cu o constantă. De acum înainte toți hiperparametrii anteriori ai lui G0 va fi notat cu λ pentru a simplifica notația. În cele din urmă, având toate cele de mai sus, putem estima probabilitățile cerute de Collapsed Gibbs Sampler. Probabilitatea ca observația i să aparțină clusterului k având în vedere atribuirile clusterului, setul de date și toți hiperparametrii α și λ ai DP și G0 este prezentat mai jos:

![]()

![]()

Ecuația 3: Probabilități utilizate de Gibbs Sampler pentru MNMM

Unde zi este atribuirea clusterului observației xi, X1: n este setul de date complet, z-i este setul de atribuiri de cluster fără cea a ith observație, x-i este setul complet de date, excluzând ith observație, ck, -i este numărul total de observații atribuite clusterului k excluzând ith observare în timp ce ![]() și

și ![]() sunt media și matricea de covarianță a clusterului k excluzând ith observare.

sunt media și matricea de covarianță a clusterului k excluzând ith observare.

2. Modelul de amestec Dirichlet-Multinomial

Modelul Dirichlet-Multinomial Mixture este utilizat pentru a efectua analiza cluster a documentelor. Modelul particular are o ierarhie ceva mai complicată, deoarece modelează subiectele/categoriile documentelor, probabilitățile de cuvinte din cadrul fiecărui subiect, atribuirile de cluster și distribuția generativă a documentelor. Obiectivul său este de a efectua învățare nesupravegheată și de a grupa o listă de documente prin alocarea lor în grupuri. Modelul de amestec este definit după cum urmează:

![]()

![]()

![]()

![]()

Ecuația 4: Dirichlet-Multinomial Mixture Model

Unde φ modelează probabilitățile subiectului, zi este un selector de subiecte, θk sunt probabilitățile cuvântului din fiecare grup și xi, j reprezintă cuvintele documentului. Ar trebui să reținem că această tehnică folosește cadru sac-de-cuvinte care reprezintă documentele ca o colecție neordonată de cuvinte, fără a ține seama de gramatică și ordinea cuvintelor. Această reprezentare simplificată este utilizată în mod obișnuit în procesarea limbajului natural și regăsirea informațiilor. Mai jos vă prezentăm Modelul Grafic al modelului de amestec:

Figura 2: Modelul grafic al modelului de amestec Dirichlet-Multinomial

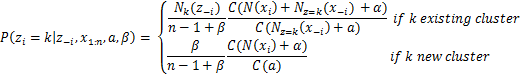

Modelul anume folosește Multinomial Distribuție discretă pentru distribuția generativă și distribuțiile Dirichlet pentru priori. ℓ este dimensiunea clusterelor noastre active, n numărul total de documente, β controlează numărul așteptat a priori de clustere, în timp ce α controlează numărul de cuvinte atribuite fiecărui grup. Pentru a estima probabilitățile cerute de Sampler Gibbs prăbușit noi folosim următoarea ecuație:

![]()

Ecuația 5: Probabilități utilizate de Gibbs Sampler pentru DMMM

Unde Γ este funcția gamma, zi este atribuirea cluster a documentului xi, X1: n este setul de date complet, z-i este setul de atribuiri de cluster fără cea a ith document, x-i este setul complet de date, excluzând ith document, Nk(z-i) este numărul de observații atribuite clusterului k excluzând ith document, Nz=k(x-i) este un vector cu sumele numărurilor pentru fiecare cuvânt pentru toate documentele alocate grupului k excluzând ith document și N(xi) este vectorul rar cu numărul fiecărui cuvânt din documentul xi. În cele din urmă, după cum putem vedea mai sus, folosind colapsed Gibbs Sampler cu restaurantul chinezesc, procesează θjk variabila care stochează probabilitatea cuvântului j în subiectul k poate fi integrată.

- AI

- ai art

- ai art generator

- ai robot

- inteligență artificială

- certificare de inteligență artificială

- robot cu inteligență artificială

- roboți cu inteligență artificială

- software de inteligență artificială

- blockchain

- conferință blockchain ai

- coingenius

- inteligența artificială conversațională

- criptoconferință ai

- dall-e

- Datumbox

- învățare profundă

- google ai

- masina de învățare

- Învățare automată și statistici

- Plato

- platoul ai

- Informații despre date Platon

- Jocul lui Platon

- PlatoData

- platogaming

- scara ai

- sintaxă

- zephyrnet