Noul an aduce noi amenințări la adresa securității cibernetice alimentate de inteligența artificială, a declarat Shawn Henry, ofițerul șef de securitate al CrowdStrike. Dimineața CBS marti.

„Cred că aceasta este o preocupare majoră pentru toată lumea”, a spus Henry.

„AI a pus într-adevăr acest instrument extraordinar de puternic în mâinile persoanei obișnuite și i-a făcut incredibil de mai capabili”, a explicat el. „Așadar, adversarii folosesc AI, această nouă inovație, pentru a depăși diferite capacități de securitate cibernetică pentru a obține acces la rețelele corporative.”

Henry a evidențiat utilizarea inteligenței artificiale pentru a pătrunde în rețelele corporative, precum și pentru răspândirea dezinformării online, folosind deepfake-uri video, audio și text din ce în ce mai sofisticate.

Henry a subliniat necesitatea de a privi sursa de informații și de a nu lua niciodată ceva publicat online la valoarea nominală.

„Trebuie să verifici de unde vine”, a spus Henry. „Cine spune povestea, care este motivația lor și o puteți verifica prin mai multe surse?”

„Este incredibil de dificil pentru că oamenii, când folosesc videoclipuri, au 15 sau 20 de secunde, nu au timp sau, de multe ori, nu fac efortul să caute acele date, iar asta este o problemă.”

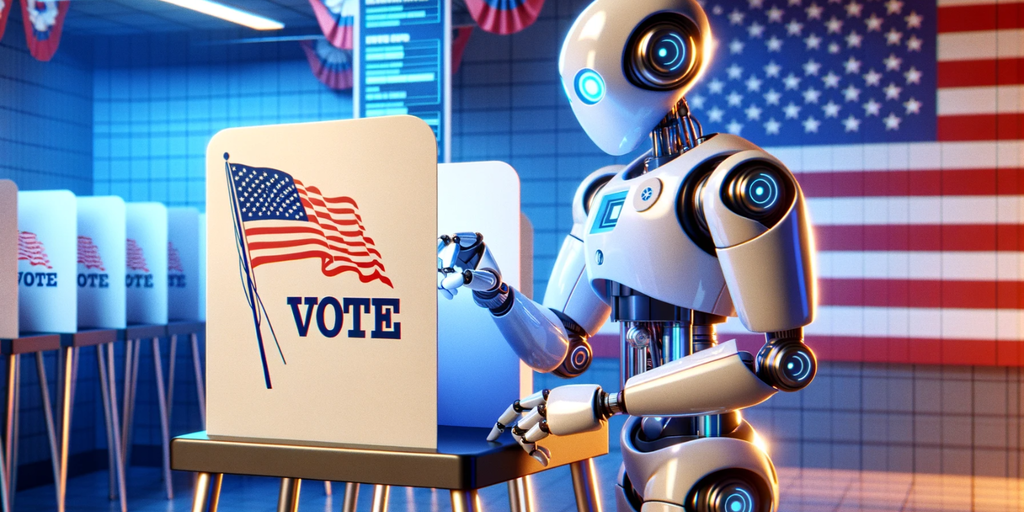

Menționând că 2024 este un an electoral pentru mai multe țări — inclusiv SUA, Mexic, Africa de Sud, Taiwan și India —, Henry a spus că democrația în sine este la vot, infractorii cibernetici care caută să profite de haosul politic valorificând AI.

„Am văzut adversari străini țintind alegerile din SUA de mulți ani, nu a fost doar 2016. [China] ne-a vizat încă din 2008”, a spus Henry. „Am văzut Rusia, China și Iran implicate în acest tip de dezinformare și dezinformare de-a lungul anilor; o vor folosi absolut aici din nou în 2024.”

„Oamenii trebuie să înțeleagă de unde provin informațiile”, a spus Henry. „Pentru că există oameni acolo care au intenții nefaste și creează niște probleme uriașe.”

O preocupare specială în viitoarele alegeri din 2024 din SUA este securitatea aparatelor de vot. Când a fost întrebat dacă inteligența artificială ar putea fi folosită pentru a pirata aparatele de vot, Henry a fost optimist că natura descentralizată a sistemului de vot din SUA va împiedica acest lucru să se întâmple.

„Cred că sistemul nostru din Statele Unite este foarte descentralizat”, a spus Henry. „Există buzunare individuale care ar putea fi vizate, cum ar fi listele de înregistrare a alegătorilor etc., [dar] nu cred că o problemă de tabulare a alegătorilor la scară largă să afecteze alegerile — nu cred că este o problemă majoră. ”

Henry a evidențiat capacitatea inteligenței artificiale de a oferi infractorilor cibernetici puțin tehnici acces la arme tehnice.

„AI oferă un instrument foarte capabil în mâinile oamenilor care ar putea să nu aibă abilități tehnice înalte”, a spus Henry. „Pot scrie cod, pot crea software rău intenționat, e-mailuri de phishing etc.”

În luna octombrie, RAND Corporation a lansat un raport care sugerează că IA generativă ar putea fi jailbreak pentru a-i ajuta pe teroriști în planificarea atacurilor biologice.

„În general, dacă un actor rău intenționat este explicit [în intenția sa], veți primi un răspuns de tipul „Îmi pare rău, nu vă pot ajuta cu asta””, co-autor și inginer principal al RAND Corporation, Christopher spuse Mouton decriptaţi într-un interviu. „Deci, în general, trebuie să utilizați una dintre aceste tehnici de jailbreaking sau inginerie promptă pentru a ajunge cu un nivel sub acele balustrade.”

Într-un raport separat, firma de securitate cibernetică SlashNext a raportat că atacurile de phishing prin e-mail au crescut cu 1265% de la începutul anului 2023.

Factorii politici la nivel mondial au petrecut cea mai mare parte a anului 2023 căutând modalități de a reglementa și de a restrânge utilizarea abuzivă a AI generativă, inclusiv secretarul general al Națiunilor Unite, care a tras un semnal de alarmă cu privire la utilizarea deepfake-urilor generate de IA în zone de conflict.

În august, Comisia Electorală Federală din SUA a avansat a petiţie pentru a interzice utilizarea inteligenței artificiale în reclamele de campanie care duc la sezonul electoral din 2024.

Giganții tehnologici Microsoft și Meta au anunțat noi Politicile menită să stopeze dezinformarea politică alimentată de inteligență artificială.

„Lumea în 2024 ar putea vedea mai multe state-națiuni autoritare care încearcă să se amestece în procesele electorale”, a spus Microsoft. „Și pot combina tehnici tradiționale cu inteligența artificială și alte tehnologii noi pentru a amenința integritatea sistemelor electorale.”

Chiar Papa Francis, care a fost subiectul deepfake-urilor virale generate de AI, a abordat, în diferite ocazii, inteligența artificială în predici.

„Trebuie să fim conștienți de transformările rapide care au loc acum și să le gestionăm în moduri care să protejeze drepturile fundamentale ale omului și să respectăm instituțiile și legile care promovează dezvoltarea umană integrală”, a spus Papa Francisc. „Inteligenta artificiala ar trebui sa serveasca cel mai bun potential al nostru uman si cele mai inalte aspiratii, nu sa concureze cu ele.”

Fiți la curent cu știrile cripto, primiți actualizări zilnice în căsuța dvs. de e-mail.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://decrypt.co/211596/ai-powered-cybercrime-will-explode-in-2024-crowdstrike-executive