Chatbot-urile moderne pot servi ca agenți digitali, oferind o nouă cale de a oferi servicii și asistență pentru clienți 24/7 în multe industrii. Popularitatea lor provine din capacitatea de a răspunde la întrebările clienților în timp real și de a gestiona mai multe interogări simultan în diferite limbi. Chatboții oferă, de asemenea, informații valoroase bazate pe date despre comportamentul clienților, în timp ce se scalează fără efort pe măsură ce baza de utilizatori crește; prin urmare, ele prezintă o soluție rentabilă pentru atragerea clienților. Chatboții folosesc capabilitățile avansate de limbaj natural ale modelelor de limbaj mari (LLM) pentru a răspunde întrebărilor clienților. Ei pot înțelege limbajul conversațional și pot răspunde natural. Cu toate acestea, chatboții care răspund doar la întrebări de bază au o utilitate limitată. Pentru a deveni consilieri de încredere, chatboții trebuie să ofere răspunsuri atent și personalizate.

O modalitate de a permite mai multe conversații contextuale este conectarea chatbot-ului la bazele de cunoștințe interne și sistemele de informații. Integrarea datelor companiei proprietare din bazele de cunoștințe interne le permite chatboților să-și contextualizeze răspunsurile la nevoile și interesele individuale ale fiecărui utilizator. De exemplu, un chatbot ar putea sugera produse care se potrivesc cu preferințele unui cumpărător și cu achizițiile anterioare, să explice detalii într-un limbaj adaptat nivelului de expertiză al utilizatorului sau să ofere asistență pentru cont prin accesarea înregistrărilor specifice ale clientului. Capacitatea de a încorpora în mod inteligent informații, de a înțelege limbajul natural și de a oferi răspunsuri personalizate într-un flux conversațional permite chatboților să ofere valoare reală pentru afaceri în diverse cazuri de utilizare.

Modelul arhitectural popular al Recuperare Augmented Generation (RAG) este adesea folosit pentru a crește contextul de interogare și răspunsurile utilizatorului. RAG combină capacitățile LLM-urilor cu fundamentarea în fapte și cunoștințele din lumea reală care provin din preluarea textelor și pasajelor relevante din corpus de date. Aceste texte preluate sunt apoi folosite pentru a informa și a lega rezultatul, reducând halucinațiile și îmbunătățind relevanța.

În această postare, ilustrăm îmbunătățirea contextuală a unui chatbot prin utilizarea Baze de cunoștințe pentru Amazon Bedrock, un serviciu fără server complet gestionat. Bazele de cunoștințe pentru integrarea Amazon Bedrock permit chatbot-ului nostru să ofere răspunsuri mai relevante și personalizate, conectând interogările utilizatorilor la punctele de date legate de informații. Intern, Amazon Bedrock folosește înglobări stocate într-o bază de date vectorială pentru a crește contextul de interogare a utilizatorului în timpul execuției și pentru a activa o soluție de arhitectură RAG gestionată. Noi folosim Scrisori Amazon către acționari set de date pentru a dezvolta această soluție.

Recuperare Augmented Generation

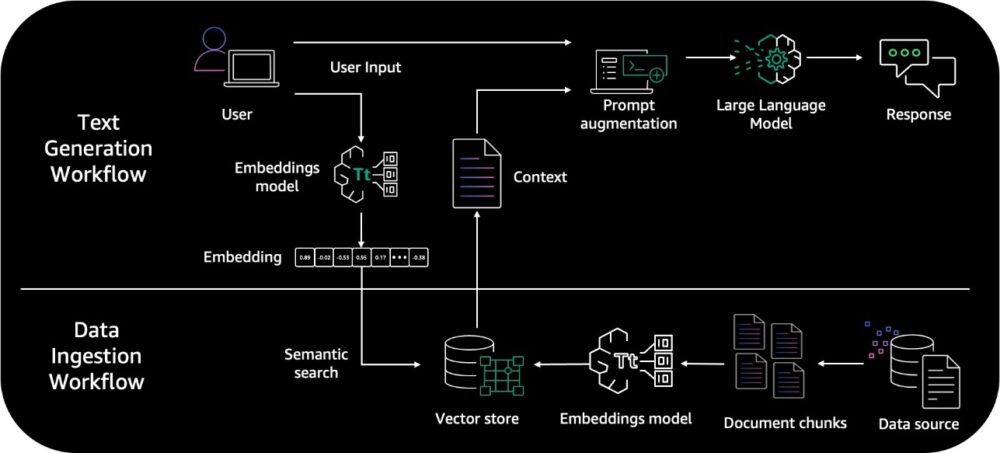

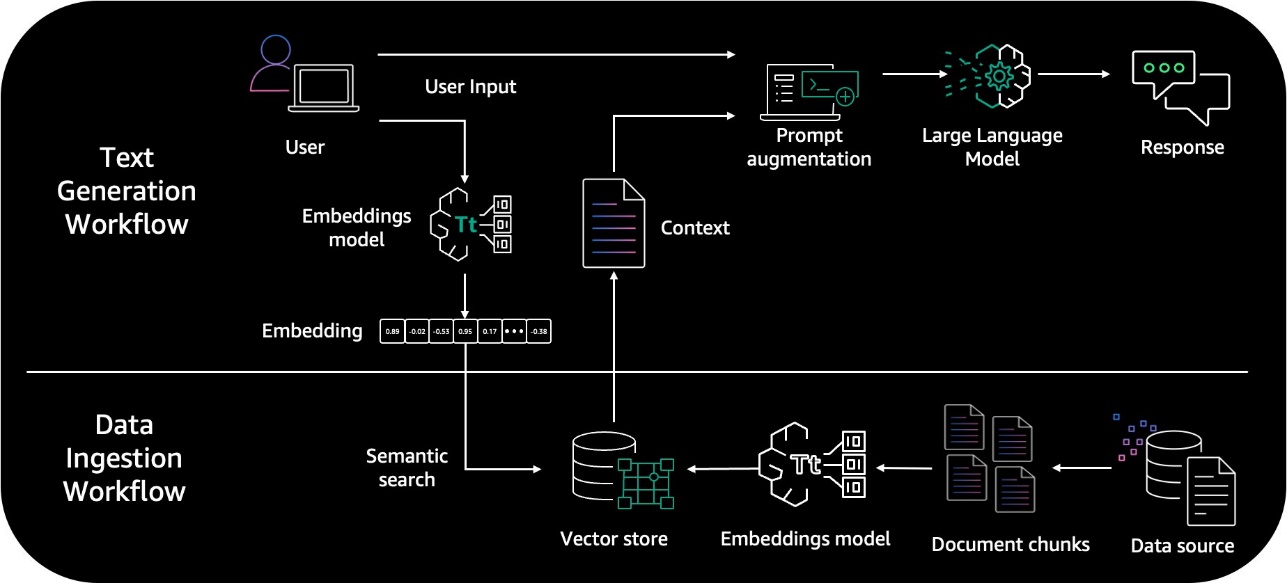

RAG este o abordare a generării limbajului natural care încorporează regăsirea informațiilor în procesul de generare. Arhitectura RAG implică două fluxuri de lucru cheie: preprocesarea datelor prin asimilare și generarea de text folosind context îmbunătățit.

Fluxul de lucru de asimilare a datelor utilizează LLM-uri pentru a crea vectori de încorporare care reprezintă semnificația semantică a textelor. Înglobările sunt create pentru documente și întrebări ale utilizatorilor. Înglobările documentelor sunt împărțite în bucăți și stocate ca indecși într-o bază de date vectorială. Fluxul de lucru de generare de text preia apoi vectorul de încorporare al unei întrebări și îl folosește pentru a prelua cele mai asemănătoare bucăți de document pe baza similarității vectorului. Acesta mărește solicitările cu aceste fragmente relevante pentru a genera un răspuns folosind LLM. Pentru mai multe detalii, consultați Introducere pentru recuperarea generației, înglobărilor și bazelor de date cu vectori crescute secțiune în Previzualizare – Conectați modelele de fundație la sursele de date ale companiei dvs. cu agenți pentru Amazon Bedrock.

Următoarea diagramă ilustrează arhitectura RAG de nivel înalt.

Deși arhitectura RAG are multe avantaje, ea implică mai multe componente, inclusiv o bază de date, mecanism de recuperare, prompt și model generativ. Gestionarea acestor părți interdependente poate introduce complexități în dezvoltarea și implementarea sistemului. Integrarea recuperării și generării necesită, de asemenea, efort de inginerie suplimentară și resurse de calcul. Unele biblioteci open source oferă wrapper-uri pentru a reduce această suprasarcină; cu toate acestea, modificările aduse bibliotecilor pot introduce erori și pot adăuga supraîncărcare suplimentară pentru versiunea. Chiar și cu bibliotecile open source, este necesar un efort semnificativ pentru a scrie cod, a determina dimensiunea optimă a fragmentelor, a genera încorporare și multe altele. Numai această instalare poate dura săptămâni, în funcție de volumul de date.

Prin urmare, o soluție gestionată care se ocupă de aceste sarcini nediferențiate ar putea eficientiza și accelera procesul de implementare și gestionare a aplicațiilor RAG.

Baze de cunoștințe pentru Amazon Bedrock

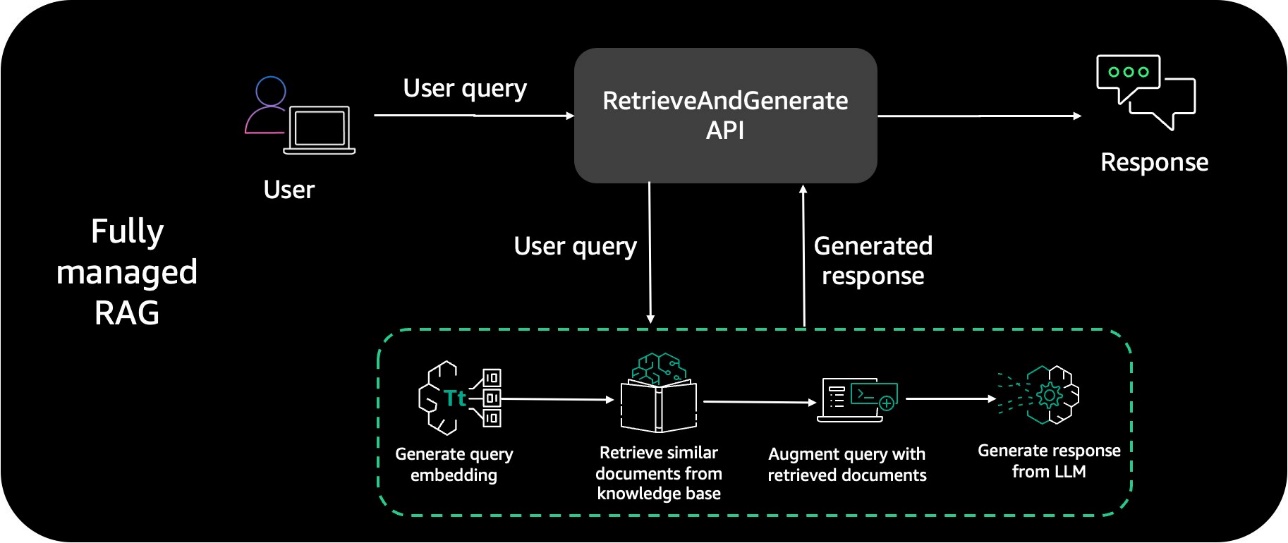

Baze de cunoștințe pentru Amazon Bedrock este o opțiune fără server pentru a construi sisteme AI conversaționale puternice folosind RAG. Oferă fluxuri de lucru complet gestionate de asimilare a datelor și de generare de text.

Pentru asimilarea datelor, se ocupă automat de crearea, stocarea, gestionarea și actualizarea înglobărilor de text ale datelor documentului în baza de date vectorială. Împarte documentele în bucăți gestionabile pentru o recuperare eficientă. Bucățile sunt apoi convertite în înglobări și scrise într-un index vectorial, permițându-vă în același timp să vedeți documentele sursă atunci când răspundeți la o întrebare.

Pentru generarea de text, Amazon Bedrock oferă RetrieveAndGenerate API pentru a crea înglobări ale interogărilor utilizatorilor și preia fragmente relevante din baza de date vectorială pentru a genera răspunsuri precise. De asemenea, acceptă atribuirea sursei și memoria pe termen scurt necesare pentru aplicațiile RAG.

Acest lucru vă permite să vă concentrați asupra aplicațiilor dvs. de afaceri de bază și elimină sarcinile grele nediferențiate.

Prezentare generală a soluțiilor

Soluția prezentată în această postare folosește un chatbot creat folosind un Iluminat în flux aplicație și include următoarele servicii AWS:

Următoarea diagramă este un model comun de arhitectură a soluției pe care îl puteți utiliza pentru a integra orice aplicație chatbot în bazele de cunoștințe pentru Amazon Bedrock.

Această arhitectură include următorii pași:

- Un utilizator interacționează cu interfața Streamlit chatbot și trimite o interogare în limbaj natural

- Aceasta declanșează o funcție Lambda, care invocă bazele de cunoștințe

RetrieveAndGenerateAPI. Pe plan intern, bazele de cunoștințe utilizează un Amazon Titan model de încorporare și convertește interogarea utilizatorului într-un vector și găsește bucăți care sunt similare din punct de vedere semantic cu interogarea utilizatorului. Promptul utilizatorului este apoi mărit cu fragmentele care sunt preluate din baza de cunoștințe. Promptul alături de contextul suplimentar este apoi trimis la un LLM pentru generarea răspunsului. În această soluție, folosim Claude antropic Instant ca LLM pentru a genera răspunsuri utilizatorilor folosind context suplimentar. Rețineți că această soluție este acceptată în regiunile în care se află Anthropic Claude pe Amazon Bedrock disponibil. - Un răspuns relevant din punct de vedere contextual este trimis înapoi aplicației chatbot și utilizatorului.

Cerințe preliminare

Utilizatorii Amazon Bedrock trebuie să solicite acces la modelele de fundație înainte ca acestea să fie disponibile pentru utilizare. Aceasta este o acțiune unică și durează mai puțin de un minut. Pentru această soluție, va trebui să activați accesul la modelul Titan Embeddings G1 – Text și Claude Instant – v1.2 în Amazon Bedrock. Pentru mai multe informații, consultați Acces model.

Clonați repo GitHub

Soluția prezentată în această postare este disponibilă în cele ce urmează GitHub repo. Trebuie să clonați depozitul GitHub pe mașina dvs. locală. Deschideți o fereastră de terminal și executați următoarea comandă. Rețineți că aceasta este o singură comandă git clone.

Încărcați setul de date de cunoștințe pe Amazon S3

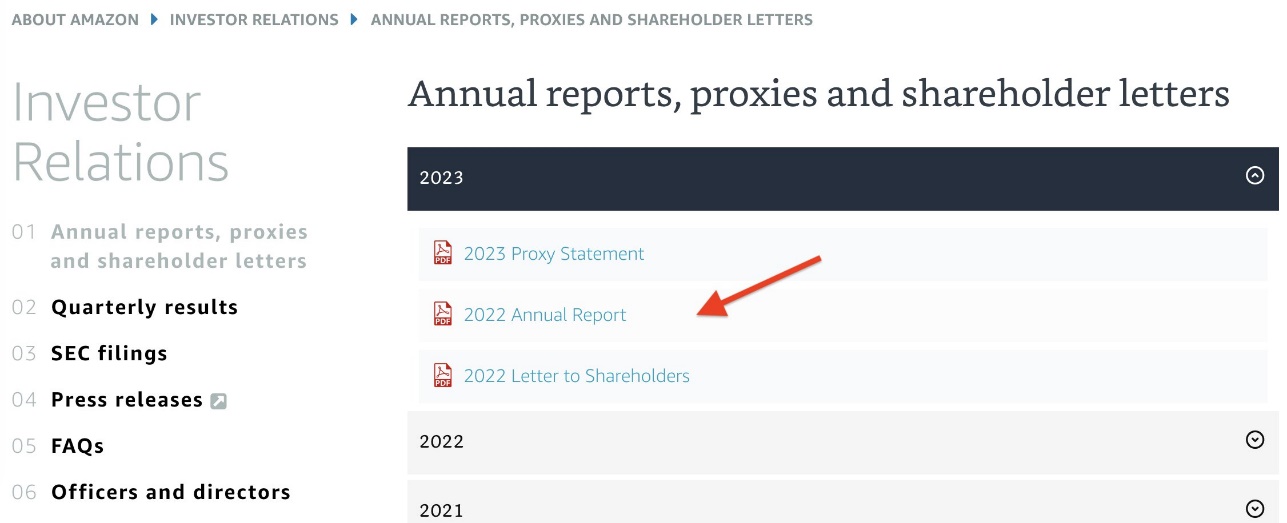

Descărcăm setul de date pentru baza noastră de cunoștințe și îl încărcăm într-o găleată S3. Acest set de date va alimenta și alimenta baza de cunoștințe. Parcurgeți următorii pași:

- Navigați către Rapoarte anuale, împuterniciri și scrisori ale acționarilor depozit de date și descărcați ultimii ani de scrisori ale acționarilor Amazon.

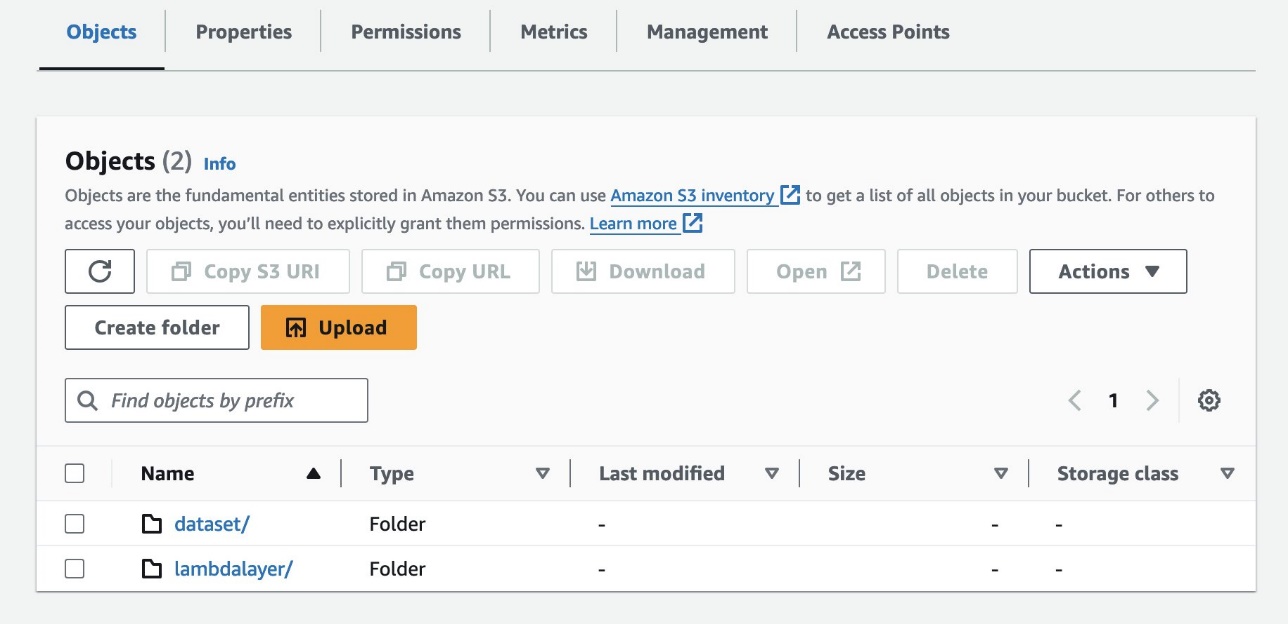

- În consola Amazon S3, alegeți Cupă în panoul de navigare.

- Alege Creați găleată.

- Denumiți găleata

knowledgebase-<your-awsaccount-number>. - Lăsați toate celelalte setări ale găleții ca implicite și alegeți Crea.

- Navigați către

knowledgebase-<your-awsaccount-number>găleată. - Alege Creați un dosar și denumește-l set de date.

- Lăsați toate celelalte setări ale folderului ca implicite și alegeți Crea.

- Navigați înapoi la găleată acasă și alegeți Creați un dosar pentru a crea un folder nou și a-l denumi

lambdalayer. - Lăsați toate celelalte setări ca implicite și alegeți Crea.

- Navigați către

datasetdosar. - Încărcați fișierele setului de date rapoartele anuale, împuternicirile și scrisorile acționarilor pe care le-ați descărcat mai devreme în acest grup și alegeți Încărcați.

- Navigați către

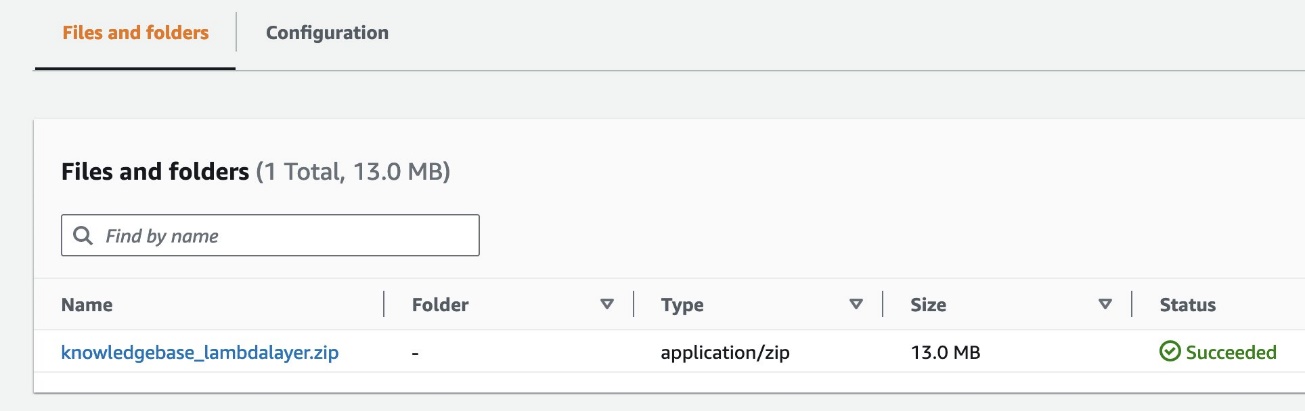

lambdalayerdosar. - Încărcați

knowledgebase-lambdalayer.zipfișier disponibil sub/lambda/layerfolderul din depozitul GitHub pe care l-ați clonat mai devreme și alegeți Încărcați. Veți folosi acest cod de strat Lambda mai târziu pentru a crea funcția Lambda.

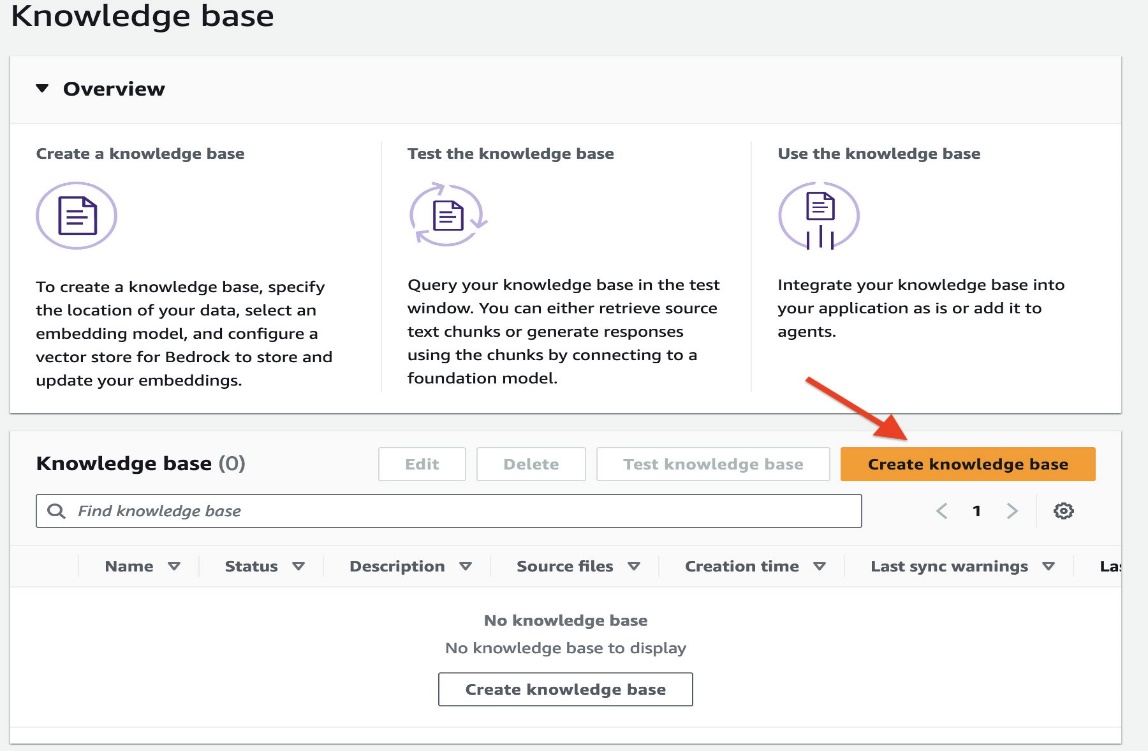

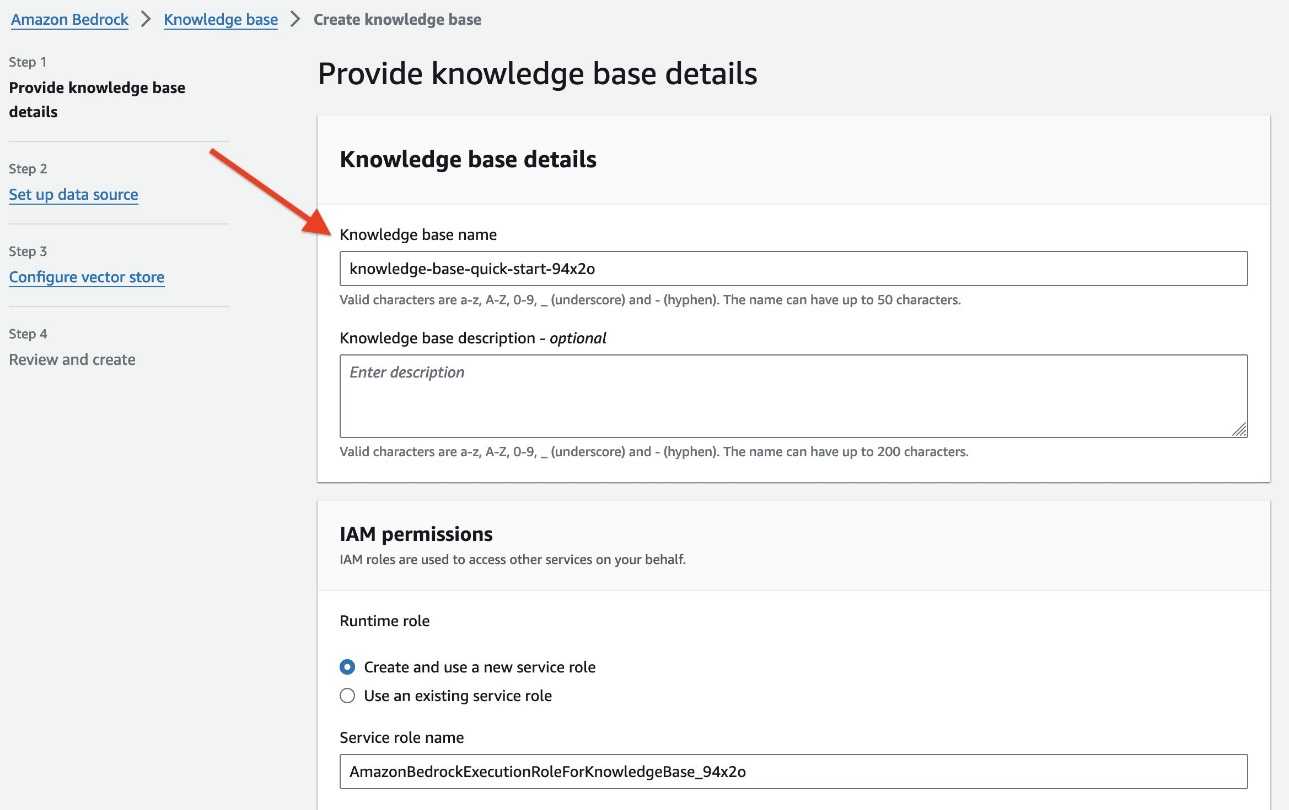

Creați o bază de cunoștințe

În acest pas, creăm o bază de cunoștințe utilizând setul de date privind scrisorile pentru acționari Amazon pe care l-am încărcat în compartimentul nostru S3 la pasul anterior.

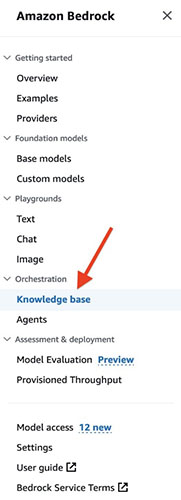

- Pe consola Amazon Bedrock, sub Orchestrarea în panoul de navigare, alegeți Bază de cunoștințe.

- Alege Creați o bază de cunoștințe.

- În Detalii baza de cunoștințe secțiune, introduceți un nume și o descriere opțională.

- În Permisiuni IAM secțiune, selectați Creați și utilizați un nou rol de serviciu și introduceți un nume pentru rol.

- Adăugați etichete după cum este necesar.

- Alege Pagina Următoare →.

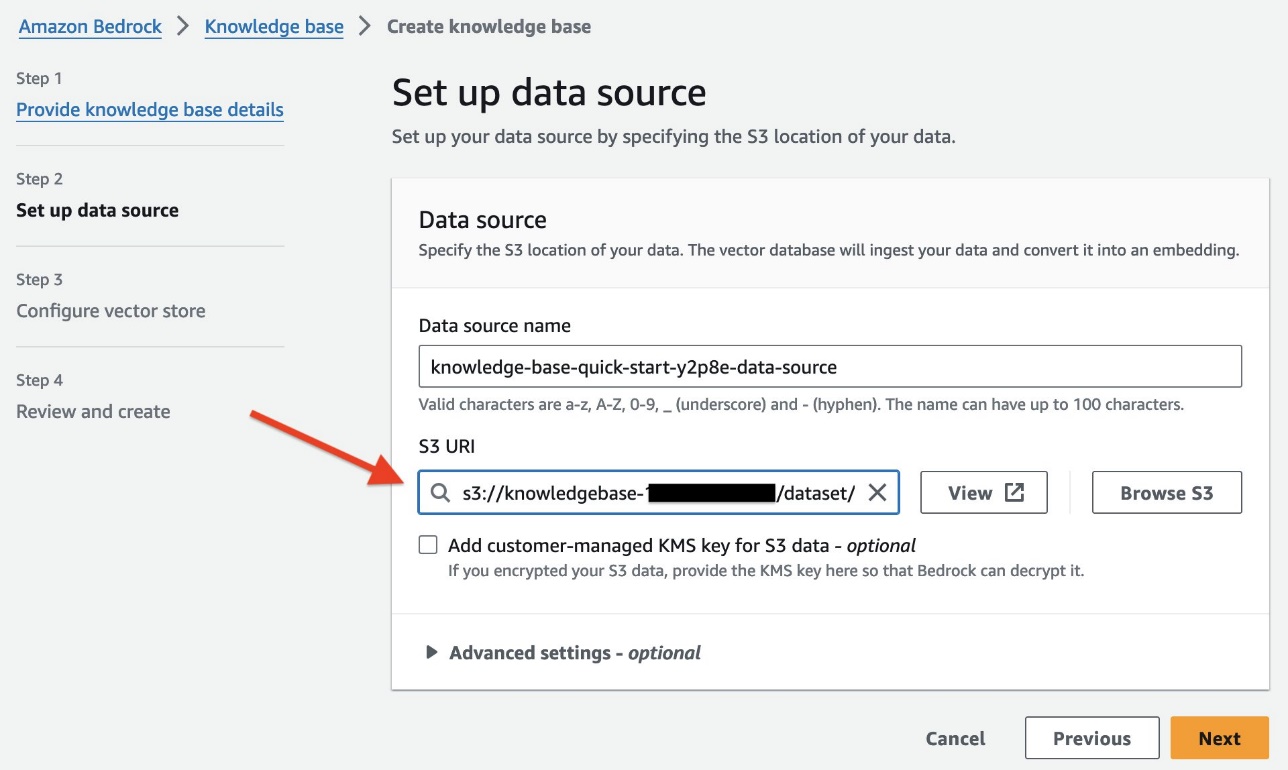

- Părăsi Numele sursei de date ca nume implicit.

- Pentru S3 URI, alege Răsfoiți S3 pentru a alege găleata S3

knowledgebase-<your-account-number>/dataset/.Trebuie să indicați spre găleată și folderul setului de date pe care le-ați creat la pașii anteriori. - În setările avansate secțiunea, lăsați valorile implicite (dacă doriți, puteți modifica strategia de împărțire implicită și puteți specifica dimensiunea și suprapunerea în procente a bucăților).

- Alege Pagina Următoare →.

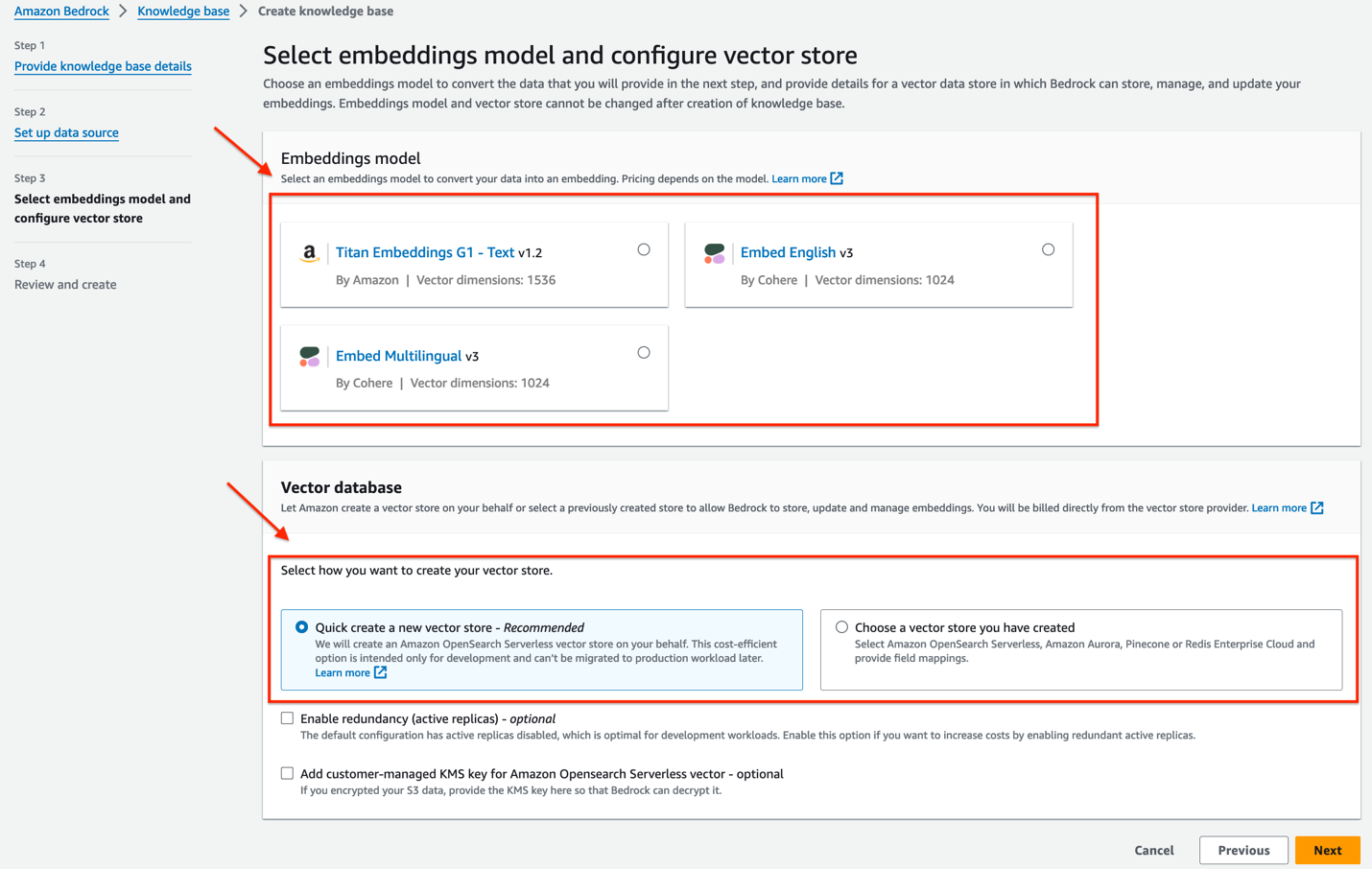

- Pentru Model de înglobare, Selectați Titan Embedding G1 – Text.

- Pentru Baza de date vectorială, puteți selecta fie Creați rapid un nou magazin de vectori or Alegeți un magazin de vectori pe care l-ați creat. Rețineți că, pentru a utiliza magazinul de vectori la alegere, trebuie să aveți un magazin de vectori preconfigurat pentru a fi utilizat. În prezent, acceptăm patru tipuri de motoare vectoriale: motorul vectorial pentru Amazon OpenSearch Serverless, Amazon Aurora, Pinecone și Redis Enterprise Cloud. Pentru această postare, selectăm Creare rapidă a unui nou magazin de vectori, care în mod implicit creează un nou magazin de vectori OpenSearch Serverless în contul dvs.

- Alege Pagina Următoare →.

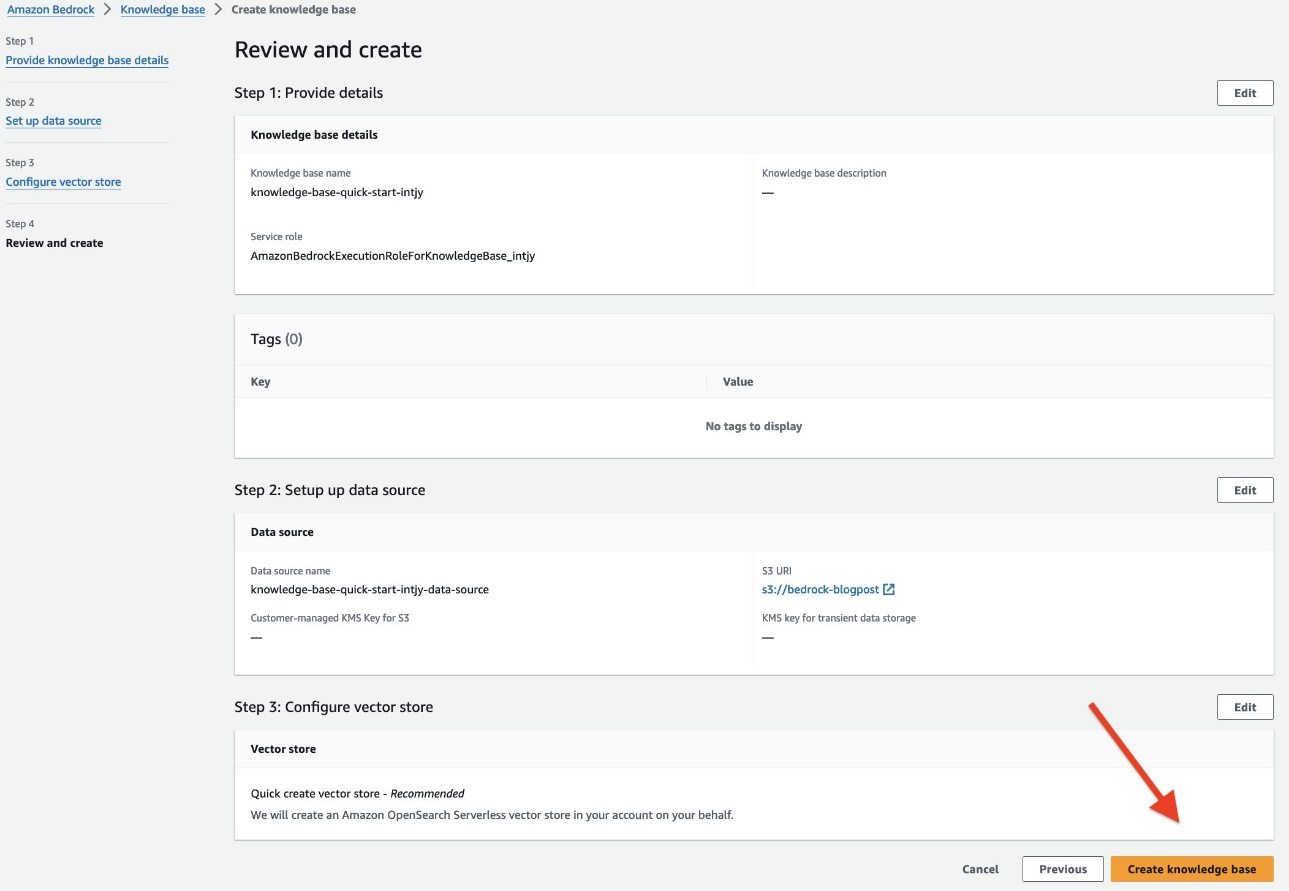

- Pe Examinați și creați pagina, examinați toate informațiile sau alegeți Pagina Anterioară pentru a modifica orice opțiuni.

- Alege Creați o bază de cunoștințe.

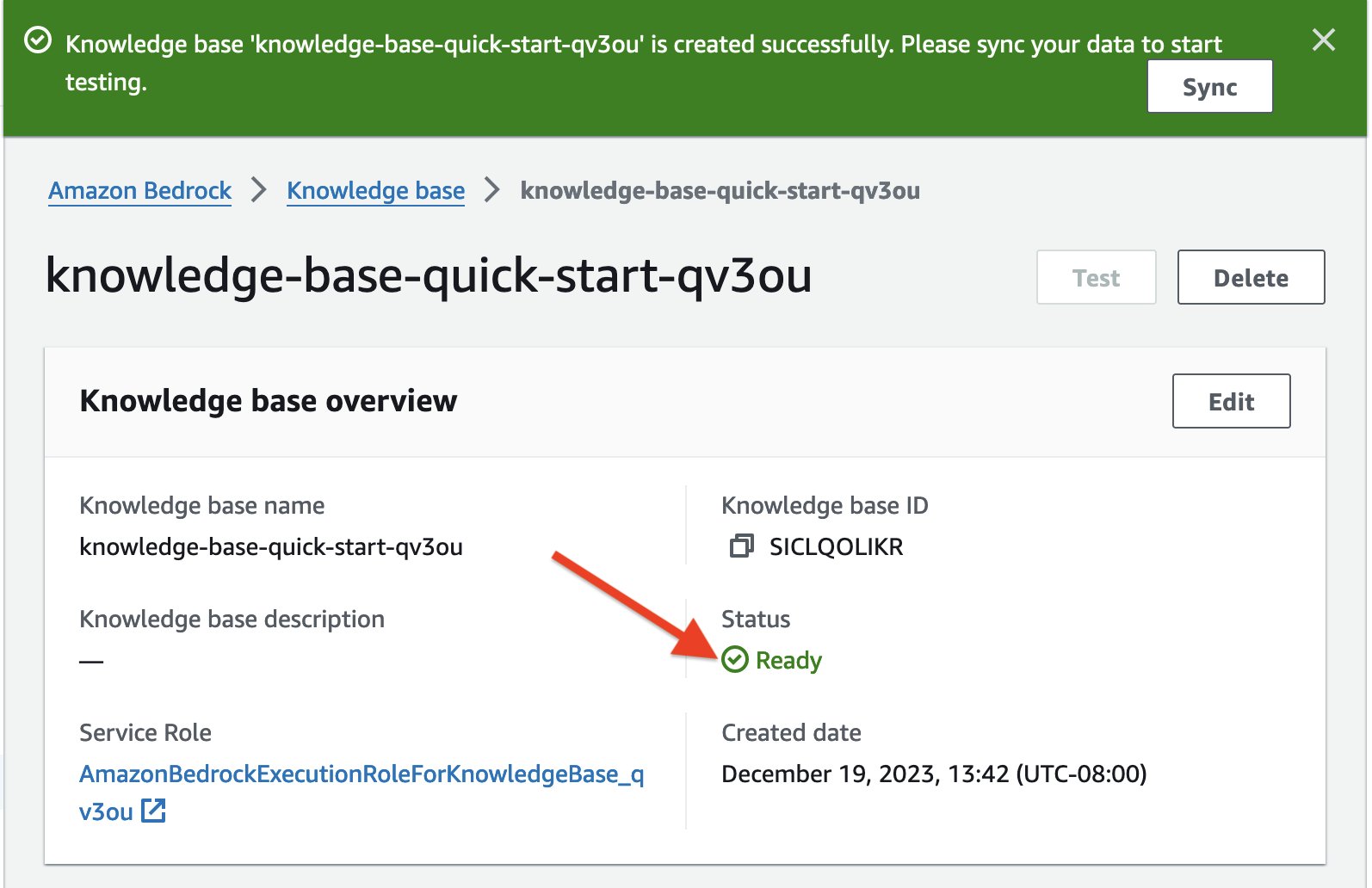

Rețineți că procesul de creare a bazei de cunoștințe începe și starea este În curs. Va dura câteva minute pentru a crea magazinul de vectori și baza de cunoștințe. Nu vă îndepărtați de pagină, altfel crearea va eșua.

Rețineți că procesul de creare a bazei de cunoștințe începe și starea este În curs. Va dura câteva minute pentru a crea magazinul de vectori și baza de cunoștințe. Nu vă îndepărtați de pagină, altfel crearea va eșua. - Când starea bazei de cunoștințe este în

Readystare, notați ID-ul bazei de cunoștințe. Îl veți folosi în următorii pași pentru a configura funcția Lambda.

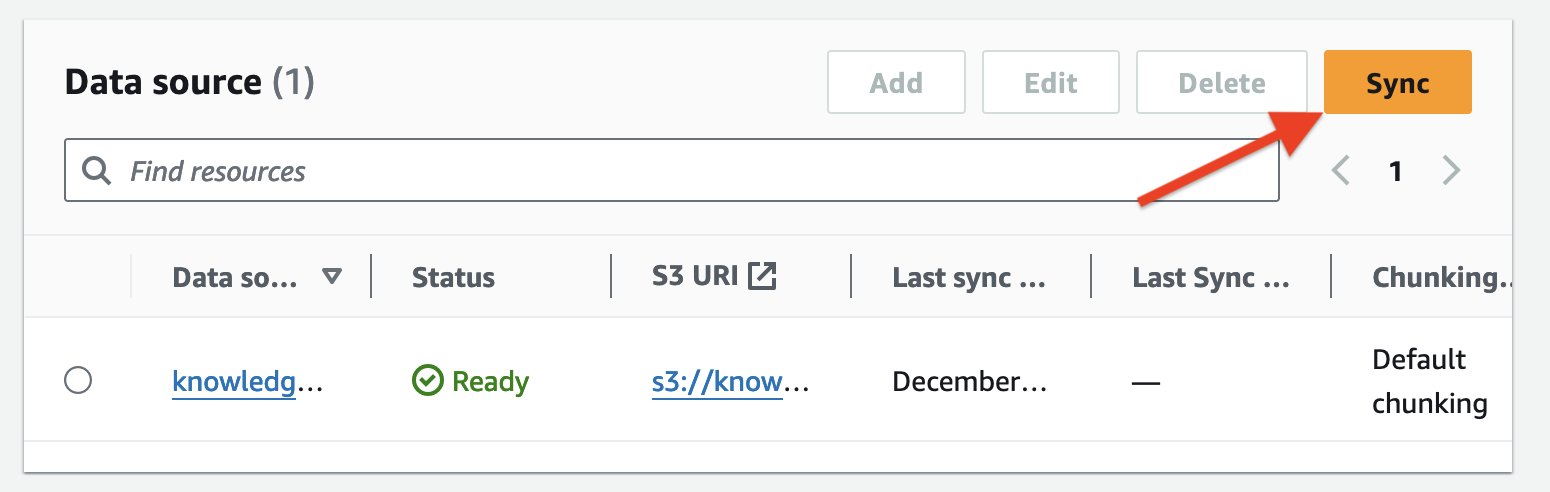

- Acum că baza de cunoștințe este gata, trebuie să sincronizăm cu ea datele scrisorilor acționarilor noștri Amazon. În Sursă de date secțiunea din pagina de detalii a bazei de cunoștințe, alegeți Sincronizați pentru a declanșa procesul de asimilare a datelor din compartimentul S3 către baza de cunoștințe.

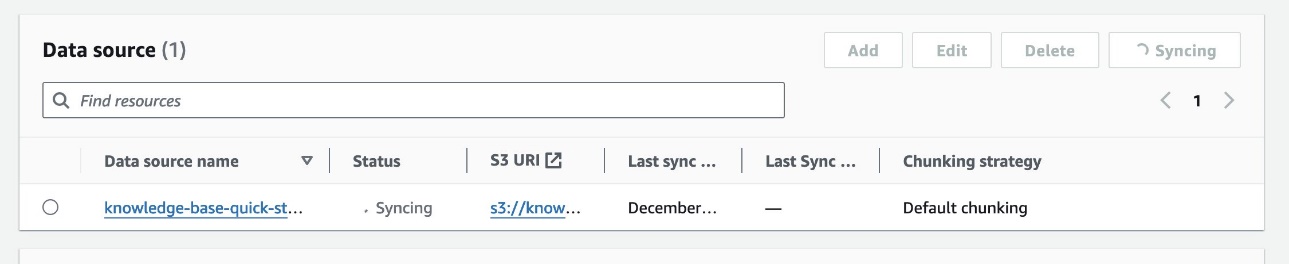

Acest proces de sincronizare împarte fișierele de document în bucăți mai mici din dimensiunea bucăților specificate mai devreme, generează înglobări vectoriale folosind modelul de încorporare a textului selectat și le stochează în depozitul de vectori gestionat de bazele de cunoștințe pentru Amazon Bedrock.

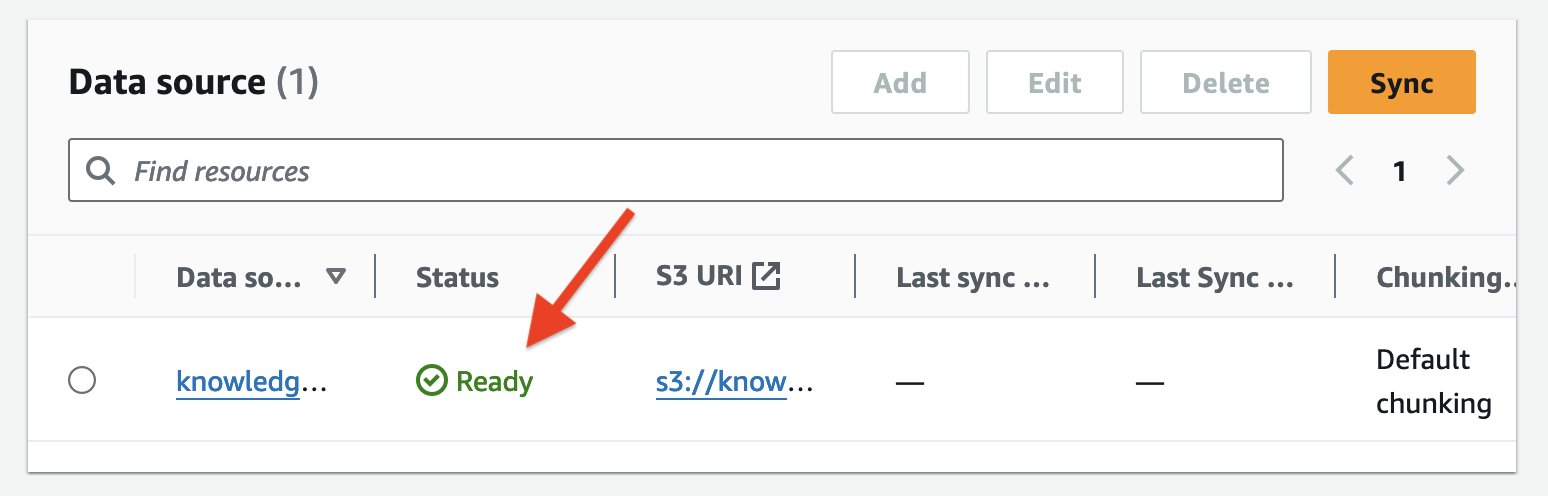

Când sincronizarea setului de date este completă, starea sursei de date se va schimba în Ready stat. Rețineți că, dacă adăugați orice documente suplimentare în folderul de date S3, trebuie să resincronizați baza de cunoștințe.

Felicitări, baza ta de cunoștințe este gata.

Rețineți că puteți utiliza, de asemenea, baze de cunoștințe pentru API-urile de serviciu Amazon Bedrock și Interfața liniei de comandă AWS (AWS CLI) pentru a crea în mod programatic o bază de cunoștințe. Va trebui să rulați diferite secțiuni ale notebook-ului Jupyter furnizate sub /notebook folderul din depozitul GitHub.

Creați o funcție Lambda

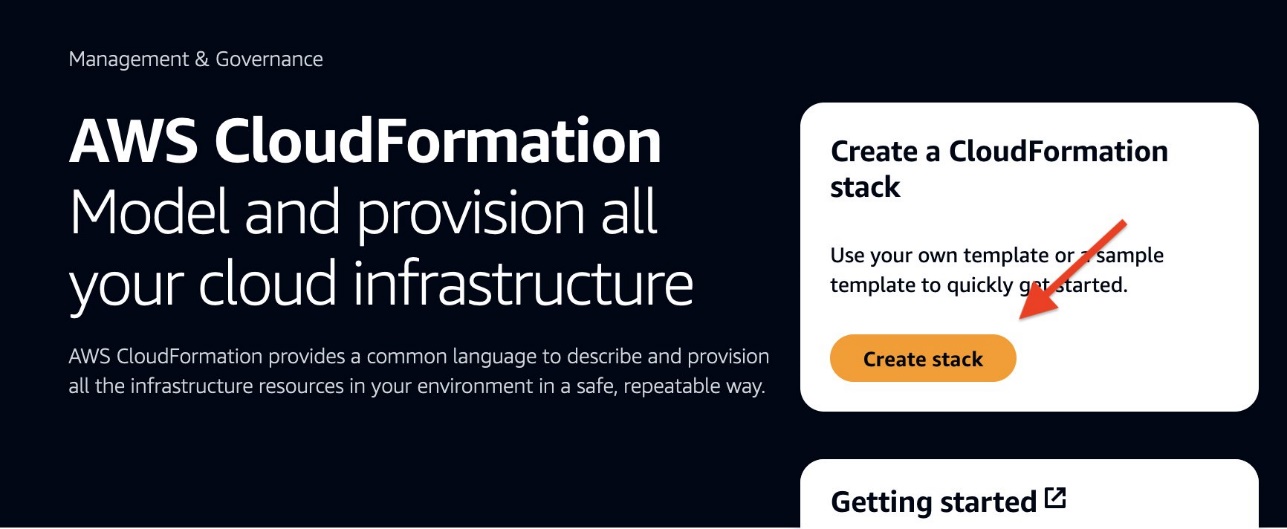

Această funcție Lambda este implementată folosind un Formarea AWS Cloud șablon disponibil în depozitul GitHub sub /cfn pliant. Șablonul necesită doi parametri: numele compartimentului S3 și ID-ul bazei de cunoștințe.

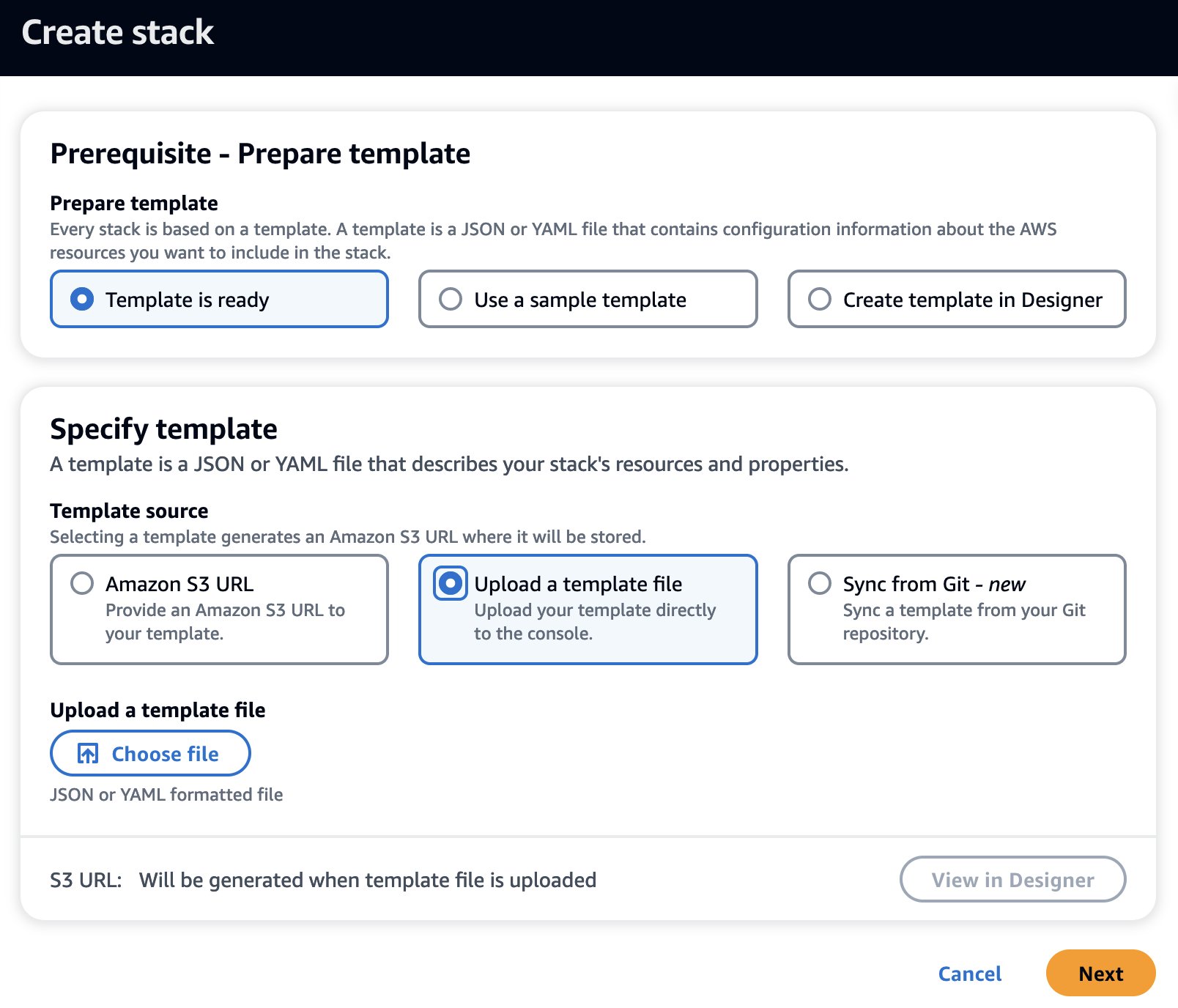

- Pe pagina de pornire a serviciului AWS CloudFormation, alegeți Creați stivă pentru a crea o stivă nouă.

- Selectați Șablonul este gata pentru Pregătiți șablonul.

- Selectați Încărcați fișierul șablon pentru Sursa șablonului.

- Alege Alegeți fișierul, navigați la depozitul GitHub pe care l-ați clonat mai devreme și alegeți fișierul .yaml sub

/cfndosar. - Alege Pagina Următoare →.

- Pentru Numele stivei, introduceți un nume.

- În parametrii secțiunea, introduceți ID-ul bazei de cunoștințe și numele compartimentului S3 pe care le-ați notat mai devreme.

- Alege Pagina Următoare →.

- Lăsați toate opțiunile implicite așa cum sunt, alegeți Pagina Următoare →și alegeți Trimite mesaj.

- Verificați dacă șablonul CloudFormation a rulat cu succes și că nu există erori.

Felicitări, ați creat cu succes o funcție Lambda, roluri asociate și politici.

Testați aplicația contextuală chatbot

Pentru a testa aplicația dvs. de chatbot, parcurgeți următorii pași:

- Deschideți un nou terminal sau o fereastră de linie de comandă pe mașina dvs.

- Rulați următoarea comandă pentru a instala SDK AWS pentru Python (Boto3). Boto3 simplifică integrarea unei aplicații, biblioteci sau script Python cu serviciile AWS.

- Rulați următoarea comandă pentru a instala și a configura un mediu de dezvoltare Python local pentru a rula aplicația Streamlit:

- Navigați către

/streamlitfolderul din folderul depozitului GitHub pe care l-ați clonat mai devreme. - Rulați următoarea comandă pentru a instanția aplicația chatbot:

Aceasta ar trebui să deschidă o aplicație de chat bazată pe web alimentată de Streamlit în browserul dvs. web implicit.

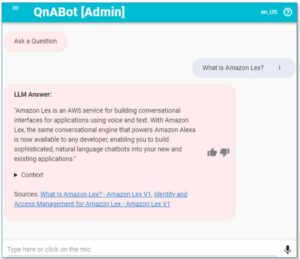

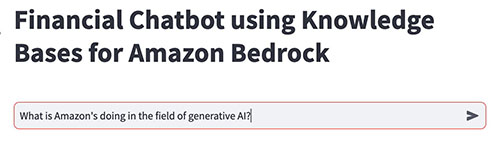

- Utilizați această aplicație chatbot Streamlit pentru a posta întrebări în limbaj natural pentru a începe conversațiile bazate pe baze de cunoștințe pentru Amazon Bedrock.

Când trimiteți o solicitare, aplicația Streamlit declanșează funcția Lambda, care invocă bazele de cunoștințe RetrieveAndGenerate API pentru a căuta și a genera răspunsuri.

Următorul tabel include câteva exemple de întrebări și răspunsuri aferente bazei de cunoștințe. Încercați câteva dintre aceste întrebări folosind prompturi.

| Întrebări | răspunsuri |

| Ce face Amazon în domeniul AI generativ? | Amazon a lucrat la propriile modele de limbaj mari (LLM) pentru AI generativă și crede că va transforma și îmbunătăți experiența fiecărui client. Ei plănuiesc să continue să investească substanțial în aceste modele în toate experiențele lor de consumatori, vânzători, mărci și creatori. |

| Care este veniturile AWS de la an la an în 2022? | Veniturile AWS au crescut cu 29% de la an la an în 2022, la o bază de venituri de 62 de miliarde de dolari. |

| De câte zile le-a cerut Amazon angajaților să vină la muncă la birou? | Amazon le-a cerut angajaților corporativi să se întoarcă la birou cel puțin trei zile pe săptămână începând din mai 2022. |

| Cu ce procent au crescut veniturile AWS de la an la an în 2022? | AWS a avut un venit de 29% de la an la an („YoY”) în 2022. |

| În comparație cu procesoarele Graviton2, ce îmbunătățire a performanței au oferit cipurile Graviton3 conform pasajului? | În 2022, AWS și-a livrat cipurile Graviton3, oferind performanțe cu 25% mai bune decât procesoarele Graviton2. |

| Care a fost primul cip de inferență lansat de AWS conform pasajului? | AWS a lansat primele cipuri de inferență („Inferentia”) în 2019 și au economisit companii precum Amazon peste o sută de milioane de dolari în cheltuieli de capital. |

| Conform contextului, în ce an au crescut veniturile anuale ale Amazon de la 245 de miliarde de dolari la 434 de miliarde de dolari? | Veniturile anuale ale Amazon au crescut de la 245 de miliarde de dolari în 2019 la 434 de miliarde de dolari în 2022. |

| Spune-mi din nou care au fost veniturile în 2019? | Veniturile Amazon în 2019 au fost de 245 de miliarde de dolari. |

| și 2021? | Veniturile Amazon în 2021 au fost de 469.8 miliarde de dolari, o creștere cu 22% față de 2020. |

| Și, amintește-mi din nou când a fost lansat primul cip de inferență? | Primul cip de inferență al Amazon a fost Inferentia, care a fost lansat în 2019. |

În timpul primului apel la funcția Lambda, RetrieveAndGenerate API returnează a sessionId, care este apoi transmis de aplicația Streamlit împreună cu solicitarea ulterioară a utilizatorului ca intrare în API-ul RetrieveAndGenerate pentru a continua conversația în aceeași sesiune. The RetrieveAndGenerate API gestionează memoria pe termen scurt și folosește istoricul de chat atâta timp cât același sessionId este transmis ca intrare în apelurile succesive.

Felicitări, ați creat și testat cu succes o aplicație chatbot folosind baze de cunoștințe pentru Amazon Bedrock.

A curăța

Eșecul de a șterge resurse precum compartimentul S3, colecția OpenSearch Serverless și baza de cunoștințe va suporta taxe. Pentru a curăța aceste resurse, ștergeți stiva CloudFormation, ștergeți compartimentul S3 (inclusiv orice foldere de documente și fișiere stocate în acel compartiment), ștergeți colecția OpenSearch Serverless, ștergeți baza de cunoștințe și ștergeți toate rolurile, politicile și permisiunile pe care le aveți. creat mai devreme.

Concluzie

În această postare, am oferit o prezentare generală a chatbot-urilor contextuale și am explicat de ce sunt importanți. Am descris complexitățile implicate în fluxurile de lucru pentru absorbția de date și generarea de text pentru o arhitectură RAG. Apoi am prezentat modul în care bazele de cunoștințe pentru Amazon Bedrock creează un sistem RAG fără server complet gestionat, inclusiv un magazin de vectori. În cele din urmă, am furnizat o arhitectură a soluției și un exemplu de cod în a GitHub repo pentru a prelua și genera răspunsuri contextuale pentru o aplicație chatbot folosind o bază de cunoștințe.

Explicând valoarea chatbot-urilor contextuale, provocările sistemelor RAG și modul în care bazele de cunoștințe pentru Amazon Bedrock abordează aceste provocări, această postare și-a propus să arate modul în care Amazon Bedrock vă permite să construiți aplicații AI conversaționale sofisticate cu un efort minim.

Pentru mai multe informaţii, consultaţi Ghid pentru dezvoltatori Amazon Bedrock și API-urile bazei de cunoștințe.

Despre Autori

Manish Chugh este arhitect principal de soluții la AWS cu sediul în San Francisco, CA. El este specializat în învățarea automată și AI generativă. Lucrează cu organizații, de la întreprinderi mari până la startup-uri în stadiu incipient, cu privire la probleme legate de învățarea automată. Rolul său implică să ajute aceste organizații să creeze sarcini de lucru scalabile, sigure și rentabile pe AWS. Prezintă în mod regulat la conferințe AWS și la alte evenimente partenere. În afara serviciului, îi place să facă drumeții pe traseele din East Bay, să meargă cu bicicleta rutieră și să urmărească (și să joace) cricket.

Manish Chugh este arhitect principal de soluții la AWS cu sediul în San Francisco, CA. El este specializat în învățarea automată și AI generativă. Lucrează cu organizații, de la întreprinderi mari până la startup-uri în stadiu incipient, cu privire la probleme legate de învățarea automată. Rolul său implică să ajute aceste organizații să creeze sarcini de lucru scalabile, sigure și rentabile pe AWS. Prezintă în mod regulat la conferințe AWS și la alte evenimente partenere. În afara serviciului, îi place să facă drumeții pe traseele din East Bay, să meargă cu bicicleta rutieră și să urmărească (și să joace) cricket.

Mani Khanuja este Tehnic Lead – Generative AI Specialists, autoarea cărții Applied Machine Learning and High Performance Computing on AWS și membru al Consiliului de Administrație pentru Women in Manufacturing Education Foundation Board. Ea conduce proiecte de învățare automată în diverse domenii, cum ar fi viziunea computerizată, procesarea limbajului natural și AI generativă. Vorbește la conferințe interne și externe, cum ar fi AWS re:Invent, Women in Manufacturing West, webinarii YouTube și GHC 23. În timpul liber, îi place să facă alergări lungi de-a lungul plajei.

Mani Khanuja este Tehnic Lead – Generative AI Specialists, autoarea cărții Applied Machine Learning and High Performance Computing on AWS și membru al Consiliului de Administrație pentru Women in Manufacturing Education Foundation Board. Ea conduce proiecte de învățare automată în diverse domenii, cum ar fi viziunea computerizată, procesarea limbajului natural și AI generativă. Vorbește la conferințe interne și externe, cum ar fi AWS re:Invent, Women in Manufacturing West, webinarii YouTube și GHC 23. În timpul liber, îi place să facă alergări lungi de-a lungul plajei.

Pallavi Nargund este arhitect principal de soluții la AWS. În rolul său de facilitator al tehnologiei cloud, ea lucrează cu clienții pentru a le înțelege obiectivele și provocările și pentru a oferi îndrumări prescriptive pentru a-și atinge obiectivul cu ofertele AWS. Este pasionată de femeile din tehnologie și este un membru principal al Women in AI/ML la Amazon. Ea vorbește la conferințe interne și externe, cum ar fi AWS re:Invent, AWS Summits și webinarii. În afara serviciului, îi place să facă voluntariat, grădinărit, ciclism și drumeții.

Pallavi Nargund este arhitect principal de soluții la AWS. În rolul său de facilitator al tehnologiei cloud, ea lucrează cu clienții pentru a le înțelege obiectivele și provocările și pentru a oferi îndrumări prescriptive pentru a-și atinge obiectivul cu ofertele AWS. Este pasionată de femeile din tehnologie și este un membru principal al Women in AI/ML la Amazon. Ea vorbește la conferințe interne și externe, cum ar fi AWS re:Invent, AWS Summits și webinarii. În afara serviciului, îi place să facă voluntariat, grădinărit, ciclism și drumeții.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :are

- :este

- :Unde

- $UP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- capacitate

- Despre Noi

- accelera

- acces

- accesarea

- Conform

- Cont

- precis

- Obține

- peste

- Acțiune

- adăuga

- Suplimentar

- adrese

- avansat

- Avantajele

- consilieri

- din nou

- agenţi

- AI

- Sisteme AI

- AI / ML

- vizează

- TOATE

- Permiterea

- permite

- singur

- de-a lungul

- pe langa

- de asemenea

- Amazon

- Amazon Web Services

- an

- și

- anual

- VENITURI ANUALE

- răspunde

- telefonic

- Antropică

- Orice

- api

- API-uri

- aplicaţia

- aplicație

- aplicatii

- aplicat

- abordare

- arhitectură

- SUNT

- AS

- At

- spori

- augmented

- măriri

- Auroră

- autor

- în mod automat

- disponibil

- Bulevard

- departe

- AWS

- Formarea AWS Cloud

- AWS re: Inventează

- înapoi

- de bază

- bazat

- de bază

- Golf

- Plajă

- deveni

- fost

- înainte

- Început

- începe

- comportament

- consideră că

- Mai bine

- Miliard

- bord

- Consiliu de Administratie

- carte

- marca

- browser-ul

- construi

- afaceri

- Aplicații pentru afaceri

- by

- CA

- apel

- apeluri

- CAN

- capacități

- capital

- cazuri

- CD

- provocări

- Schimbare

- Modificări

- taxe

- Chat

- chatbot

- chatbots

- Finalizeaza comanda

- cip

- Chips

- alegere

- Alege

- curat

- cli

- Cloud

- TEHNOLOGIA CLOUD

- cod

- colectare

- combină

- cum

- vine

- Comun

- Companii

- companie

- Completă

- complexități

- componente

- de calcul

- calculator

- Computer Vision

- tehnica de calcul

- conferințe

- Conectați

- Consoleze

- consumator

- context

- contextual

- contextualizează

- continua

- Conversație

- de conversaţie

- AI de conversație

- conversații

- convertit

- Nucleu

- Istoria

- cost-eficiente

- ar putea

- crea

- a creat

- creează

- Crearea

- creaţie

- creator

- crichet

- În prezent

- client

- comportamentul clienților

- experienta clientului

- Serviciu clienți

- clienţii care

- personalizate

- de date

- puncte de date

- Pe bază de date

- Baza de date

- Zi

- Mod implicit

- livra

- livrate

- livrarea

- În funcție

- dislocate

- desfășurarea

- descris

- descriere

- detalii

- Determina

- dezvolta

- Dezvoltator

- Dezvoltare

- diagramă

- FĂCUT

- diferit

- digital

- Directorii

- diferit

- document

- documente

- face

- de dolari

- domenii

- Dont

- jos

- Descarca

- fiecare

- Mai devreme

- stadiu timpuriu

- Est

- Educaţie

- eficient

- efort

- efort

- oricare

- Încorporarea

- de angajați

- permite

- facilitator

- permite

- captivant

- Motor

- Inginerie

- sporită

- consolidarea

- Intrați

- Afacere

- Companii

- Mediu inconjurator

- Erori

- Chiar

- evenimente

- Fiecare

- exemplu

- experienţă

- Experiențe

- expertiză

- Explica

- a explicat

- explicând

- extern

- fapte

- FAIL

- puțini

- camp

- Fișier

- Fişiere

- În cele din urmă

- descoperiri

- First

- debit

- Concentra

- următor

- Pentru

- Fundație

- patru

- Francisco

- Gratuit

- din

- complet

- funcţie

- g1

- genera

- generează

- generaţie

- generativ

- AI generativă

- merge

- GitHub

- Da

- Go

- Goluri

- a crescut

- Teren

- Crește

- creste

- îndrumare

- HAD

- manipula

- Mânere

- Avea

- he

- greu

- ridicare de greutati

- ajutor

- ei

- Înalt

- la nivel înalt

- lui

- istorie

- Acasă

- Cum

- Totuși

- HTML

- http

- HTTPS

- sută

- ID

- if

- ilustra

- ilustrează

- Punere în aplicare a

- important

- îmbunătăţi

- îmbunătățire

- îmbunătățirea

- in

- include

- Inclusiv

- incorpora

- încorporează

- Crește

- a crescut

- index

- indexurile

- individ

- industrii

- Informa

- informații

- Sisteme de informare

- intrare

- Cereri

- perspective

- instala

- clipă

- integra

- integrarea

- integrare

- interactiv

- interese

- interfaţă

- intern

- intern

- în

- introduce

- introdus

- investind

- invocă

- implicat

- implică

- IT

- jpg

- Cheie

- cunoştinţe

- limbă

- Limbă

- mare

- Întreprinderi mari

- Nume

- mai tarziu

- a lansat

- strat

- conduce

- Conduce

- învăţare

- cel mai puțin

- Părăsi

- mai puțin

- scrisoare

- Nivel

- biblioteci

- Bibliotecă

- ridicare

- ca

- îi place

- Limitat

- Linie

- legarea

- LLM

- local

- Lung

- maşină

- masina de învățare

- Principal

- FACE

- flexibil

- gestionate

- gestionează

- de conducere

- de fabricaţie

- multe

- Meci

- Mai..

- me

- sens

- mecanism

- membru

- Memorie

- pur și simplu

- milion

- un milion de dolari

- minim

- minut

- minute

- model

- Modele

- modifica

- mai mult

- cele mai multe

- multiplu

- nume

- Natural

- Procesarea limbajului natural

- Navigaţi

- Navigare

- Nevoie

- necesar

- nevoilor

- Nou

- următor

- Nu.

- Nici unul

- nota

- caiet

- notat

- obiectiv

- of

- oferi

- ofertele

- promoții

- Birou

- de multe ori

- on

- ONE

- deschide

- open-source

- optimă

- Opțiune

- Opţiuni

- or

- organizații

- Altele

- in caz contrar

- al nostru

- afară

- producție

- exterior

- peste

- deasupra

- Prezentare generală

- propriu

- pagină

- pâine

- parametrii

- partener

- piese

- trecere

- pasaje

- Trecut

- pasionat

- trecut

- Model

- procent

- performanță

- permisiuni

- Personalizat

- plan

- Plato

- Informații despre date Platon

- PlatoData

- joc

- Punct

- puncte

- Politicile

- Popular

- popularitate

- Post

- putere

- alimentat

- puternic

- preferinţele

- prezenta

- prezentat

- cadouri

- precedent

- Principal

- probleme

- proces

- prelucrare

- procesoare

- Produse

- Progres

- Proiecte

- solicitări

- proprietate

- furniza

- prevăzut

- furnizează

- furnizarea

- achiziții

- Piton

- interogări

- întrebare

- întrebare

- Întrebări

- Rapid

- cârpă

- variind

- RE

- gata

- real

- lumea reală

- în timp real

- înregistrări

- reduce

- reducerea

- trimite

- regiuni

- regulat

- legate de

- relevanţa

- Îndepărtează

- Rapoarte

- depozit

- reprezenta

- solicita

- necesar

- Necesită

- Resurse

- Răspunde

- răspuns

- răspunsuri

- regăsire

- Returnează

- venituri

- revizuiască

- drum

- Rol

- rolurile

- Alerga

- ruleaza

- Runtime

- acelaşi

- probă

- San

- San Francisco

- salvate

- scalabil

- scalare

- scenariu

- sdk

- Caută

- Secțiune

- secțiuni

- sigur

- vedea

- selecta

- selectate

- semantică

- trimis

- servi

- serverless

- serviciu

- Servicii

- sesiune

- set

- setări

- configurarea

- acționar

- Acționarii

- ea

- Pe termen scurt

- să

- prezenta

- semnificativ

- asemănător

- simultan

- singur

- Mărimea

- mai mici

- soluţie

- soluţii

- unele

- sofisticat

- Sursă

- Surse

- vorbeşte

- specialiști

- specializată

- specific

- specificată

- împărţi

- șpalturi

- stivui

- Începe

- Startup-urile

- Stat

- Stare

- tulpini

- Pas

- paşi

- stoca

- stocate

- magazine

- stocarea

- simplu

- Strategie

- simplifica

- prezenta

- ulterior

- substanţial

- Reușit

- astfel de

- sugera

- Summit-

- a sustine

- Suportat

- Sprijină

- sincronizare

- sistem

- sisteme

- tabel

- adaptate

- Lua

- ia

- sarcini

- tech

- Tehnologia

- șablon

- Terminal

- test

- testat

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- decât

- acea

- informațiile

- Sursa

- lor

- Lor

- apoi

- Acolo.

- prin urmare

- Acestea

- ei

- acest

- aceste

- trei

- Prin

- timp

- gigant

- la

- Transforma

- declanşa

- de încredere

- încerca

- Două

- Tipuri

- în

- înţelege

- actualizarea

- încărcat

- utilizare

- utilizat

- Utilizator

- utilizatorii

- utilizări

- folosind

- utilitate

- v1

- Valoros

- valoare

- Valori

- diverse

- viziune

- volum

- vrea

- a fost

- vizionarea

- Cale..

- we

- web

- browser web

- servicii web

- bazat pe web

- Webinare

- săptămână

- săptămâni

- Vest

- Ce

- cand

- care

- în timp ce

- de ce

- voi

- fereastră

- cu

- Femei

- femei în tehnologie

- Apartamente

- flux de lucru

- fluxuri de lucru

- de lucru

- fabrică

- scrie

- scrie cod

- scris

- yaml

- an

- ani

- Tu

- Ta

- youtube

- zephyrnet