Clienții se confruntă cu amenințări și vulnerabilități de securitate tot mai mari în cadrul infrastructurii și al resurselor de aplicații, pe măsură ce amprenta lor digitală s-a extins și impactul asupra afacerii acelor active digitale a crescut. O provocare comună în domeniul securității cibernetice a fost dublă:

- Consumarea jurnalelor din resurse digitale care vin în diferite formate și scheme și automatizarea analizei constatărilor amenințărilor pe baza acelor jurnale.

- Indiferent dacă jurnalele provin de la Amazon Web Services (AWS), de la alți furnizori de cloud, de la dispozitive locale sau de la margine, clienții trebuie să centralizeze și să standardizeze datele de securitate.

Mai mult, analiza pentru identificarea amenințărilor de securitate trebuie să fie capabilă să se extindă și să evolueze pentru a face față unui peisaj în schimbare de actori ai amenințărilor, vectori de securitate și active digitale.

O abordare nouă pentru a rezolva acest scenariu complex de analiză de securitate combină utilizarea și stocarea datelor de securitate Amazon Security Lake și analiza datelor de securitate cu ajutorul machine learning (ML). Amazon SageMaker. Amazon Security Lake este un serviciu special creat care centralizează automat datele de securitate ale unei organizații din surse cloud și locale într-un lac de date creat special, stocat în contul dvs. AWS. Amazon Security Lake automatizează gestionarea centrală a datelor de securitate, normalizează jurnalele de la serviciile integrate AWS și serviciile terță parte și gestionează ciclul de viață al datelor cu retenție personalizabilă și, de asemenea, automatizează gradarea stocării. Amazon Security Lake ingerează fișiere jurnal în fișierul Deschideți Cadrul Schemei de Securitate Cibernetică (OCSF), cu suport pentru parteneri precum Cisco Security, CrowdStrike, Palo Alto Networks și jurnalele OCSF din resurse din afara mediului dvs. AWS. Această schemă unificată eficientizează consumul și analiza în aval, deoarece datele urmează o schemă standardizată și pot fi adăugate surse noi cu modificări minime ale conductei de date. După ce datele din jurnalul de securitate sunt stocate în Amazon Security Lake, întrebarea devine cum să le analizăm. O abordare eficientă a analizei datelor din jurnalul de securitate este utilizarea ML; în special, detectarea anomaliilor, care examinează datele de activitate și trafic și le compară cu o linie de referință. Linia de bază definește ce activitate este statistic normală pentru acel mediu. Detectarea anomaliilor se extinde dincolo de semnătura unui eveniment individual și poate evolua cu reinstruire periodică; traficul clasificat ca anormal sau anormal poate fi apoi acționat cu prioritate și urgență. Amazon SageMaker este un serviciu complet gestionat care le permite clienților să pregătească date și să creeze, să antreneze și să implementeze modele ML pentru orice caz de utilizare cu infrastructură, instrumente și fluxuri de lucru complet gestionate, inclusiv oferte fără cod pentru analiștii de afaceri. SageMaker acceptă doi algoritmi de detectare a anomaliilor încorporați: Informații IP și Pădure tăiată aleatoriu. De asemenea, puteți utiliza SageMaker pentru a vă crea propriul model personalizat de detectare a valorii aberante folosind algoritmi provenite din mai multe cadre ML.

În această postare, învățați cum să pregătiți datele provenite din Amazon Security Lake, apoi să antrenați și să implementați un model ML folosind un algoritm IP Insights în SageMaker. Acest model identifică traficul sau comportamentul anormal al rețelei, care poate fi apoi compus ca parte a unei soluții de securitate end-to-end mai mari. O astfel de soluție ar putea invoca o verificare de autentificare multifactor (MFA) dacă un utilizator se conectează de pe un server neobișnuit sau la o oră neobișnuită, să notifice personalul dacă există o scanare suspectă a rețelei provenind de la noi adrese IP, să alerteze administratorii dacă o rețea neobișnuită sunt utilizate protocoale sau porturi sau îmbogățiți rezultatul clasificării informațiilor IP cu alte surse de date, cum ar fi Serviciul de gardă Amazon și scorurile reputației IP pentru a clasifica rezultatele amenințărilor.

Prezentare generală a soluțiilor

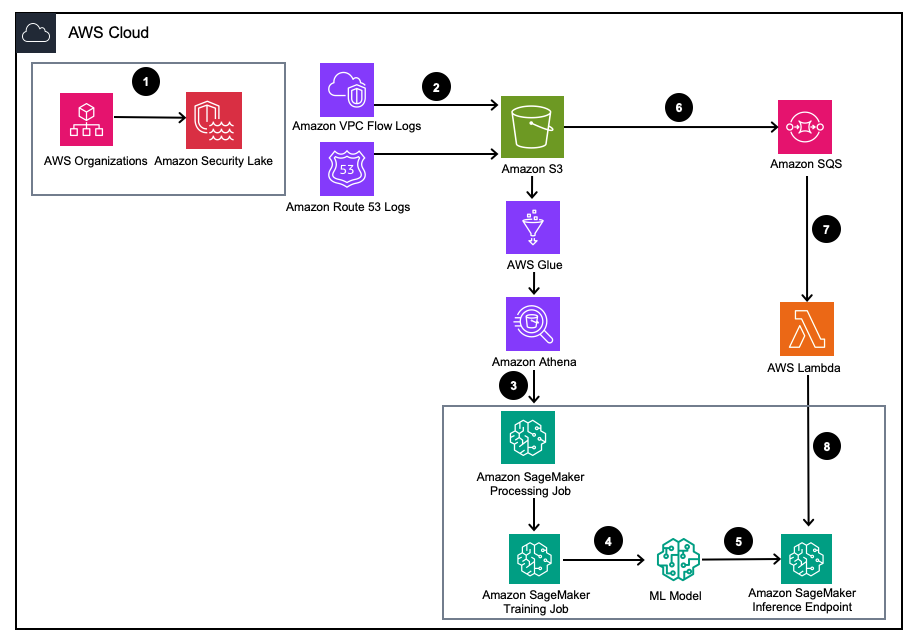

Figura 1 – Arhitectura soluției

- Activați Amazon Security Lake cu Organizații AWS pentru conturile AWS, regiunile AWS și mediile IT externe.

- Configurați sursele Security Lake de la Amazon Virtual Private Cloud (Amazon VPC) Jurnalele de flux și Ruta Amazonului 53 DNS se înregistrează în compartimentul Amazon Security Lake S3.

- Procesați datele din jurnalul Amazon Security Lake folosind o lucrare de procesare SageMaker pentru a proiecta funcțiile. Utilizare Amazon Atena pentru a interoga datele din jurnalul OCSF structurat Serviciul Amazon de stocare simplă (Amazon S3) prin AWS Adeziv tabele gestionate de AWS LakeFormation.

- Antrenați un model SageMaker ML utilizând un job SageMaker Training care consumă jurnalele procesate Amazon Security Lake.

- Implementați modelul ML antrenat la un punct final de inferență SageMaker.

- Stocați jurnalele de securitate noi într-o găleată S3 și puneți în coadă evenimentele Serviciul de coadă simplă Amazon (Amazon SQS).

- Abonați-vă un AWS Lambdas funcția la coada SQS.

- Invocați punctul final de inferență SageMaker folosind o funcție Lambda pentru a clasifica jurnalele de securitate ca anomalii în timp real.

Cerințe preliminare

Pentru a implementa soluția, trebuie mai întâi să îndepliniți următoarele cerințe preliminare:

- Activați Amazon Security Lake în cadrul organizației dvs. sau un singur cont cu jurnalele de soluționare VPC și jurnalele de soluționare Route 53 activate.

- Asigurați-vă că AWS Identity and Access Management (IAM) rol utilizat de SageMaker de procesare a joburilor și a notebook-urilor a primit o politică IAM, inclusiv Permisiunea de acces la interogarea abonaților Amazon Security Lake pentru baza de date gestionată Amazon Security lac și tabelele gestionate de AWS Lake Formation. Această lucrare de procesare ar trebui să fie executată dintr-un cont de instrumente de analiză sau de securitate pentru a rămâne în conformitate cu Arhitectura de referință de securitate AWS (AWS SRA).

- Asigurați-vă că rolul IAM utilizat de funcția Lambda a primit o politică IAM, inclusiv Permisiunea de acces la datele abonaților Amazon Security Lake.

Implementați soluția

Pentru a configura mediul, parcurgeți următorii pași:

- Lansați a SageMaker Studio sau SageMaker Jupyter notebook cu a

ml.m5.largeinstanță. Notă: Dimensiunea instanței depinde de seturile de date pe care le utilizați. - Clonează GitHub depozit.

- Deschide caietul

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Implementați a furnizat politica IAM și politica de încredere IAM corespunzătoare pentru ca instanța dumneavoastră SageMaker Studio Notebook să acceseze toate datele necesare în S3, Lake Formation și Athena.

Acest blog parcurge porțiunea relevantă de cod din blocnotes după ce este implementat în mediul dvs.

Instalați dependențele și importați biblioteca necesară

Utilizați următorul cod pentru a instala dependențe, importa bibliotecile necesare și creați compartimentul SageMaker S3 necesar pentru procesarea datelor și formarea modelului. Una dintre bibliotecile necesare, awswrangler, este un AWS SDK pentru cadrul de date panda care este utilizat pentru a interoga tabelele relevante din Catalogul de date AWS Glue și pentru a stoca rezultatele local într-un cadru de date.

Interogați tabelul de jurnal al fluxului VPC Amazon Security Lake

Această porțiune de cod utilizează SDK-ul AWS pentru panda pentru a interoga tabelul AWS Glue legat de jurnalele de flux VPC. După cum sa menționat în cerințele preliminare, tabelele Amazon Security Lake sunt gestionate de Formația lacului AWS, astfel încât toate permisiunile corespunzătoare trebuie acordate rolului utilizat de blocnotesul SageMaker. Această interogare va extrage mai multe zile de trafic de jurnal de flux VPC. Setul de date utilizat în timpul dezvoltării acestui blog a fost mic. În funcție de amploarea cazului dvs. de utilizare, ar trebui să fiți conștienți de limitele SDK-ului AWS pentru panda. Când luați în considerare scara de terabyte, ar trebui să luați în considerare AWS SDK pentru suportul Pandas pentru Modin.

Când vizualizați cadrul de date, veți vedea o ieșire dintr-o singură coloană cu câmpuri comune care pot fi găsite în Activitate în rețea (4001) clasa OCSF.

Normalizați datele din jurnalul fluxului Amazon Security Lake VPC în formatul de instruire necesar pentru IP Insights.

Algoritmul IP Insights necesită ca datele de antrenament să fie în format CSV și să conțină două coloane. Prima coloană trebuie să fie un șir opac care să corespundă identificatorului unic al unei entități. A doua coloană trebuie să fie adresa IPv4 a evenimentului de acces al entității în notație zecimală. În setul de date exemplu pentru acest blog, identificatorul unic este ID-urile de instanță ale instanțelor EC2 asociate instance_id valoare în cadrul dataframe. Adresa IPv4 va fi derivată din src_endpoint. Pe baza modului în care a fost creată interogarea Amazon Athena, datele importate sunt deja în formatul corect pentru antrenarea unui model IP Insights, deci nu este necesară nicio inginerie suplimentară a caracteristicilor. Dacă modificați interogarea într-un alt mod, poate fi necesar să încorporați inginerie de caracteristici suplimentare.

Interogați și normalizați tabelul de jurnal de rezolvare Amazon Security Lake Route 53

Așa cum ați făcut mai sus, următorul pas al notebook-ului rulează o interogare similară împotriva tabelului de soluționare Amazon Security Lake Route 53. Deoarece veți folosi toate datele compatibile cu OCSF în acest notebook, toate sarcinile de inginerie a caracteristicilor rămân aceleași pentru jurnalele de rezolvare Route 53 ca și pentru jurnalele de flux VPC. Apoi combinați cele două cadre de date într-un singur cadru de date care este utilizat pentru antrenament. Deoarece interogarea Amazon Athena încarcă datele local în formatul corect, nu este necesară nicio inginerie suplimentară a caracteristicilor.

Obțineți imaginea de instruire IP Insights și antrenați modelul cu datele OCSF

În această următoare porțiune a notebook-ului, antrenați un model ML bazat pe algoritmul IP Insights și utilizați dataframe de OCSF din diferite tipuri de jurnal. O listă a hiperparmetrilor IP Insights poate fi găsită aici. În exemplul de mai jos am selectat hiperparametrii care au generat cel mai performant model, de exemplu, 5 pentru epoch și 128 pentru vector_dim. Deoarece setul de date de antrenament pentru eșantionul nostru a fost relativ mic, am utilizat a ml.m5.large instanță. Hiperparametrii și configurațiile dvs. de antrenament, cum ar fi numărul de instanțe și tipul de instanță, ar trebui alese pe baza valorilor dvs. obiective și a dimensiunii datelor dvs. de antrenament. O capacitate pe care o puteți utiliza în Amazon SageMaker pentru a găsi cea mai bună versiune a modelului dvs. este Amazon SageMaker reglare automată a modelului care caută cel mai bun model într-o gamă de valori de hiperparametru.

Implementați modelul instruit și testați cu trafic valid și anormal

După ce modelul a fost instruit, implementați modelul într-un punct final SageMaker și trimiteți o serie de combinații de identificare unică și adrese IPv4 pentru a vă testa modelul. Această porțiune de cod presupune că aveți date de testare salvate în compartimentul S3. Datele de testare sunt un fișier .csv, unde prima coloană este ID-urile instanțelor, iar a doua coloană este IP-urile. Se recomandă testarea datelor valide și nevalide pentru a vedea rezultatele modelului. Următorul cod implementează punctul final.

Acum că punctul final este implementat, acum puteți trimite cereri de inferență pentru a identifica dacă traficul este potențial anormal. Mai jos este o mostră despre cum ar trebui să arate datele dvs. formatate. În acest caz, primul identificator de coloană este un ID de instanță, iar a doua coloană este o adresă IP asociată, după cum se arată în continuare:

După ce aveți datele în format CSV, puteți trimite datele pentru inferență utilizând codul citind fișierul .csv dintr-un compartiment S3.:

Rezultatul pentru un model IP Insights oferă o măsură a cât de așteptate din punct de vedere statistic sunt o adresă IP și o resursă online. Intervalul pentru această adresă și resursă este totuși nelimitat, așa că există considerații cu privire la modul în care ați determina dacă o combinație de ID de instanță și adresă IP ar trebui să fie considerată anormală.

În exemplul precedent, patru combinații diferite de identificare și IP au fost trimise modelului. Primele două combinații au fost combinații valide de ID de instanță și adresă IP, care sunt așteptate pe baza setului de antrenament. A treia combinație are identificatorul unic corect, dar o adresă IP diferită în cadrul aceleiași subrețea. Modelul ar trebui să determine că există o anomalie modestă, deoarece încorporarea este ușor diferită de datele de antrenament. A patra combinație are un identificator unic valid, dar o adresă IP a unei subrețele inexistente în orice VPC din mediu.

Notă: Datele de trafic normale și anormale se vor schimba în funcție de cazul dvs. de utilizare specific, de exemplu: dacă doriți să monitorizați traficul extern și intern, veți avea nevoie de un identificator unic aliniat fiecărei adrese IP și de o schemă pentru a genera identificatorii externi.

Pentru a determina care ar trebui să fie pragul dvs. pentru a determina dacă traficul este anormal, se poate face folosind trafic normal și anormal cunoscut. Pașii descriși în acest exemplu de caiet sunt după cum urmează:

- Construiți un set de testare care să reprezinte traficul normal.

- Adăugați trafic anormal în setul de date.

- Graficul distribuției

dot_productscoruri pentru modelul privind traficul normal și traficul anormal. - Selectați o valoare de prag care să distingă subsetul normal de subsetul anormal. Această valoare se bazează pe toleranța dvs. fals pozitivă

Configurați monitorizarea continuă a noului trafic de jurnal de flux VPC.

Pentru a demonstra modul în care acest nou model ML ar putea fi utilizat cu Amazon Security Lake într-o manieră proactivă, vom configura o funcție Lambda care să fie invocată pe fiecare PutObject eveniment din compartimentul gestionat Amazon Security Lake, în special datele din jurnalul fluxului VPC. În Amazon Security Lake există conceptul de abonat, care consumă jurnalele și evenimentele din Amazon Security Lake. Funcția Lambda care răspunde la evenimente noi trebuie să i se acorde un abonament de acces la date. Abonații de acces la date sunt notificați cu privire la noile obiecte Amazon S3 pentru o sursă, pe măsură ce obiectele sunt scrise în compartimentul Security Lake. Abonații pot accesa direct obiectele S3 și pot primi notificări cu privire la obiectele noi printr-un punct final de abonament sau interogând o coadă Amazon SQS.

- Deschideți Consola Security Lake.

- În panoul de navigare, selectați Abonați-vă.

- Pe pagina Abonați, alegeți Creați abonat.

- Pentru detaliile abonatului, intrați

inferencelambdapentru Numele abonatului și un opțional Descriere. - Regiune este setată automat ca Regiunea AWS selectată în prezent și nu poate fi modificată.

- Pentru Jurnal și surse de evenimente, alege Surse specifice de jurnal și evenimente Și alegeți Jurnalele de flux VPC și jurnalele Route 53

- Pentru Metoda de acces la date, alege S3.

- Pentru Acreditările abonatului, furnizați ID-ul contului dvs. AWS al contului în care va locui funcția Lambda și un utilizator specificat ID extern.

Notă: Dacă faceți acest lucru local într-un cont, nu trebuie să aveți un ID extern. - Alege Crea.

Creați funcția Lambda

Pentru a crea și implementa funcția Lambda, puteți fie să parcurgeți următorii pași, fie să implementați șablonul SAM predefinit 01_ipinsights/01.02-ipcheck.yaml în depozitul GitHub. Șablonul SAM necesită să furnizați ARN-ul SQS și numele punctului final SageMaker.

- În consola Lambda, alegeți Funcție Creare.

- Alege Autor de la zero.

- Pentru Numele funcției, introduce

ipcheck. - Pentru Runtime, alege Python 3.10.

- Pentru Arhitectură, Selectați x86_64.

- Pentru Rolul de execuție, Selectați Creați un rol nou cu permisiuni Lambda.

- După ce creați funcția, introduceți conținutul fișierului ipcheck.py fișier din depozitul GitHub.

- În panoul de navigare, alegeți variabile de mediu.

- Alege Editati.

- Alege Adăugați variabila de mediu.

- Pentru noua variabilă de mediu, introduceți

ENDPOINT_NAMEiar pentru valoare introduceți ARN-ul punctului final care a fost scos la ieșire în timpul implementării punctului final SageMaker. - Selectați Economisiți.

- Alege Lansa.

- În panoul de navigare, alegeți Configuraţie.

- Selectați Declanșările.

- Selectați Adăugați declanșatorul.

- În Selectați o sursă, alege SQS.

- În coada SQS, introduceți ARN-ul cozii SQS principale create de Security Lake.

- Bifați caseta de selectare pentru Activați declanșatorul.

- Selectați Adăuga.

Validați constatările Lambda

- Deschideți Consola Amazon CloudWatch.

- În panoul din stânga, selectați Grupuri de jurnal.

- În bara de căutare, introduceți ipcheck, apoi selectați grupul de jurnal cu numele

/aws/lambda/ipcheck. - Selectați cel mai recent flux de jurnal de sub Înregistrați fluxurile.

- În jurnale, ar trebui să vedeți rezultate care arată ca următoarele pentru fiecare jurnal nou Amazon Security Lake:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Această funcție Lambda analizează continuu traficul de rețea ingerat de Amazon Security Lake. Acest lucru vă permite să construiți mecanisme pentru a vă notifica echipele de securitate atunci când un anumit prag este încălcat, ceea ce ar indica un trafic anormal în mediul dumneavoastră.

A curăța

Când ați terminat de experimentat cu această soluție și pentru a evita taxele pentru contul dvs., curățați-vă resursele ștergând compartimentul S3, punctul final SageMaker, închideți calcularea atașată notebook-ului SageMaker Jupyter, ștergând funcția Lambda și dezactivând Amazon Security Lake în contul tău.

Concluzie

În această postare ați învățat cum să pregătiți datele de trafic de rețea provenite din Amazon Security Lake pentru învățarea automată, apoi ați antrenat și implementat un model ML folosind algoritmul IP Insights în Amazon SageMaker. Toți pașii descriși în blocnotesul Jupyter pot fi replicați într-o conductă ML de la capăt la capăt. De asemenea, ați implementat o funcție AWS Lambda care a consumat noi jurnale Amazon Security Lake și a trimis concluzii bazate pe modelul antrenat de detectare a anomaliilor. Răspunsurile modelului ML primite de AWS Lambda ar putea notifica în mod proactiv echipele de securitate despre trafic anormal atunci când sunt îndeplinite anumite praguri. Îmbunătățirea continuă a modelului poate fi activată prin includerea echipei de securitate în evaluările buclei pentru a eticheta dacă traficul identificat ca anormal a fost fals pozitiv sau nu. Acest lucru ar putea fi apoi adăugat la setul dvs. de antrenament și, de asemenea, adăugat la dvs normală. setul de date de trafic la determinarea unui prag empiric. Acest model poate identifica traficul de rețea potențial anormal sau comportamentul prin care poate fi inclus ca parte a unei soluții de securitate mai extinse pentru a iniția o verificare MFA dacă un utilizator se conectează de pe un server neobișnuit sau la o oră neobișnuită, alertează personalul dacă există o problemă suspectă. scanarea rețelei care provine de la noi adrese IP sau combinați scorul informațiilor IP cu alte surse, cum ar fi Amazon Guard Duty, pentru a clasifica rezultatele amenințărilor. Acest model poate include surse de jurnal personalizate, cum ar fi jurnalele de flux Azure sau jurnalele locale, adăugând surse personalizate la implementarea Amazon Security Lake.

În partea 2 a acestei serii de postări pe blog, veți învăța cum să construiți un model de detectare a anomaliilor folosind Pădure tăiată aleatoriu algoritm antrenat cu surse suplimentare Amazon Security Lake care integrează rețeaua și datele din jurnalul de securitate al gazdei și aplică clasificarea anomaliilor de securitate ca parte a unei soluții de monitorizare a securității automatizate și cuprinzătoare.

Despre autori

Joe Morotti este arhitect de soluții la Amazon Web Services (AWS), ajutând clienții Enterprise din Midwest SUA. El a ocupat o gamă largă de roluri tehnice și îi place să arate arta posibilului clienților. În timpul liber, îi place să petreacă timp de calitate cu familia, explorând locuri noi și supraanalizând performanța echipei sale sportive.

Joe Morotti este arhitect de soluții la Amazon Web Services (AWS), ajutând clienții Enterprise din Midwest SUA. El a ocupat o gamă largă de roluri tehnice și îi place să arate arta posibilului clienților. În timpul liber, îi place să petreacă timp de calitate cu familia, explorând locuri noi și supraanalizând performanța echipei sale sportive.

Bishr Tabbaa este un arhitect de soluții la Amazon Web Services. Bishr este specializată în a ajuta clienții cu aplicații de învățare automată, securitate și observabilitate. În afara serviciului, îi place să joace tenis, să gătească și să petreacă timpul cu familia.

Bishr Tabbaa este un arhitect de soluții la Amazon Web Services. Bishr este specializată în a ajuta clienții cu aplicații de învățare automată, securitate și observabilitate. În afara serviciului, îi place să joace tenis, să gătească și să petreacă timpul cu familia.

Sriharsh Adari este arhitect senior de soluții la Amazon Web Services (AWS), unde îi ajută pe clienți să lucreze înapoi de la rezultatele afacerii pentru a dezvolta soluții inovatoare pe AWS. De-a lungul anilor, el a ajutat mai mulți clienți cu privire la transformările platformei de date pe verticalele industriei. Domeniul său de bază de expertiză include strategia tehnologiei, analiza datelor și știința datelor. În timpul liber, îi place să joace tenis, să se uite la emisiuni TV și să joace Tabla.

Sriharsh Adari este arhitect senior de soluții la Amazon Web Services (AWS), unde îi ajută pe clienți să lucreze înapoi de la rezultatele afacerii pentru a dezvolta soluții inovatoare pe AWS. De-a lungul anilor, el a ajutat mai mulți clienți cu privire la transformările platformei de date pe verticalele industriei. Domeniul său de bază de expertiză include strategia tehnologiei, analiza datelor și știința datelor. În timpul liber, îi place să joace tenis, să se uite la emisiuni TV și să joace Tabla.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :are

- :este

- :nu

- :Unde

- $UP

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- mai sus

- acces

- Cont

- Conturi

- peste

- activitate

- actori

- adăugat

- adăugare

- Suplimentar

- adresa

- adrese

- administratori

- După

- împotriva

- Alerta

- Algoritmul

- algoritmi

- aliniat

- TOATE

- permite

- deja

- de asemenea

- Amazon

- Amazon Atena

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analiză

- analiști

- Google Analytics

- analiza

- analize

- analiza

- și

- anomalii

- detectarea anomaliilor

- O alta

- Orice

- aplicație

- aplicatii

- Aplică

- abordare

- arhitectură

- SUNT

- ZONĂ

- Artă

- AS

- Bunuri

- asociate

- presupune

- At

- Autentificare

- Automata

- automate

- în mod automat

- automatizarea

- evita

- conştient

- AWS

- AWS Adeziv

- Formația lacului AWS

- AWS Lambdas

- Azuriu

- bar

- bazat

- De bază

- BE

- deoarece

- devine

- fost

- comportament

- fiind

- de mai jos

- CEL MAI BUN

- Dincolo de

- Blog

- atât

- construi

- construit-in

- afaceri

- dar

- by

- CAN

- capacitate

- capabil

- caz

- catalog

- central

- centraliza

- sigur

- contesta

- Schimbare

- Modificări

- schimbarea

- taxe

- verifica

- Alege

- ales

- Cisco

- clasă

- clasificare

- clasificate

- Clasifica

- curat

- Cloud

- cod

- Coloană

- Coloane

- combinaţie

- combinaţii

- combina

- combină

- cum

- venire

- Comun

- Completă

- complex

- conforme

- compuse

- cuprinzător

- Calcula

- concept

- Lua în considerare

- Considerații

- luate în considerare

- luand in considerare

- Consoleze

- consumate

- consum

- conţine

- conținut

- continuu

- continuu

- Nucleu

- corecta

- corespunde

- ar putea

- crea

- a creat

- În prezent

- personalizat

- clienţii care

- personalizabil

- Tăiat

- Securitate cibernetică

- de date

- accesul la date

- Analiza datelor

- Lacul de date

- Platforma de date

- de prelucrare a datelor

- știința datelor

- Baza de date

- seturi de date

- Zi

- defineste

- demonstra

- dependențe

- Dependent/ă

- În funcție

- implementa

- dislocate

- desfășurarea

- implementează

- Derivat

- detalii

- Detectare

- Determina

- determinarea

- dezvolta

- Dezvoltare

- Dispozitive

- FĂCUT

- diferit

- digital

- Active digitale

- direct

- distribuire

- dns

- nu

- face

- don

- făcut

- Dont

- jos

- în timpul

- e

- fiecare

- Margine

- Eficace

- oricare

- altfel

- Încorporarea

- activat

- permite

- un capăt la altul

- Punct final

- inginer

- Inginerie

- se bucura

- îmbogăți

- Intrați

- Afacere

- Mediu inconjurator

- medii

- epocă

- eroare

- eveniment

- evenimente

- evolua

- evoluție

- Analizează

- exemplu

- Cu excepția

- există

- extins

- de aşteptat

- expertiză

- Explorarea

- extern

- cu care se confruntă

- fals

- familie

- Caracteristică

- DESCRIERE

- Domenii

- Fișier

- Fişiere

- Găsi

- constatările

- First

- debit

- Concentra

- următor

- urmează

- urmă

- Pentru

- format

- formare

- găsit

- patru

- Al patrulea

- FRAME

- cadre

- Gratuit

- din

- complet

- funcţie

- mai mult

- genera

- GitHub

- acordate

- grup

- crescut

- Pază

- Avea

- he

- Held

- a ajutat

- ajutor

- ajută

- lui

- gazdă

- Cum

- Cum Pentru a

- Totuși

- HTML

- HTTPS

- ID

- identificat

- identificator

- identificatorii

- identifică

- identifica

- identificarea

- Identitate

- ID-uri

- if

- imagine

- Impactul

- implementat

- import

- îmbunătățire

- in

- include

- inclus

- Inclusiv

- incorpora

- crescând

- indica

- individ

- industrie

- Infrastructură

- iniția

- inovatoare

- perspective

- instala

- instanță

- integra

- integrate

- intern

- în

- invocat

- IP

- Adresa IP

- Adresele IP

- IT

- Loc de munca

- Locuri de munca

- jpg

- JSON

- cunoscut

- Etichetă

- lac

- peisaj

- mare

- mai mare

- AFLAȚI

- învățat

- învăţare

- stânga

- biblioteci

- ciclu de viață

- ca

- Limitele

- Listă

- loturile

- la nivel local

- log

- Uite

- arată ca

- maşină

- masina de învățare

- Principal

- gestionate

- administrare

- gestionează

- manieră

- Mai..

- măsura

- mecanisme

- Întâlni

- menționat

- cu

- Metrici

- AMF

- midwest

- minim

- dispărut

- ML

- model

- Modele

- modest

- modificată

- modifica

- monitor

- Monitorizarea

- cele mai multe

- multiplu

- trebuie sa

- nume

- Navigare

- necesar

- Nevoie

- necesar

- reţea

- trafic de retea

- rețele

- Nou

- următor

- Nu.

- inexistent

- normală.

- caiet

- notificări

- roman

- acum

- obiectiv

- obiecte

- of

- ofertele

- on

- ONE

- on-line

- opac

- or

- organizație

- OS

- Altele

- al nostru

- rezultate

- anormal

- a subliniat

- producție

- exterior

- peste

- propriu

- pagină

- Palo Alto

- panda

- pâine

- parte

- parteneri

- efectuarea

- periodic

- permisiune

- permisiuni

- conducte

- Locuri

- platformă

- Plato

- Informații despre date Platon

- PlatoData

- joc

- Politica

- porţiune

- porturi

- pozitiv

- posibil

- Post

- potenţial

- precedent

- Predictii

- Predictor

- Pregăti

- premise

- prioritizate

- privat

- Proactivă

- Procesat

- prelucrare

- adecvat

- protocoale

- furniza

- furnizori

- furnizează

- calitate

- întrebare

- ridica

- gamă

- rank

- Citind

- real

- în timp real

- a primi

- primit

- recent

- recomandat

- referință

- regiune

- regiuni

- legate de

- relativ

- rămâne

- replicat

- reprezenta

- reputație

- cereri de

- necesar

- Necesită

- resursă

- Resurse

- răspuns

- răspunsuri

- rezultat

- REZULTATE

- retenţie

- Recenzii

- Rol

- rolurile

- Traseul

- Alerga

- ruleaza

- sagemaker

- SageMaker Inference

- Sam

- acelaşi

- Exemplu de set de date

- salvate

- Scară

- cântare

- scalare

- scanare

- scenariu

- schemă

- Ştiinţă

- scor

- sdk

- Caută

- Cautari

- Al doilea

- securitate

- Amenințări la adresa securității

- vedea

- selecta

- selectate

- trimite

- senior

- serie

- serverul

- serviciu

- Servicii

- sesiune

- set

- să

- indicat

- Emisiuni

- închide

- parte

- semnătură

- semnare

- asemănător

- simplu

- întrucât

- singur

- Mărimea

- ușor diferite

- mic

- So

- soluţie

- soluţii

- REZOLVAREA

- Sursă

- provenind

- Surse

- specializată

- specific

- specific

- specificată

- Cheltuire

- Sportul

- Personal

- Pas

- paşi

- depozitare

- stoca

- stocate

- Strategie

- curent

- raționalizează

- Şir

- structurat

- studio

- prezenta

- prezentat

- subrețea

- abonat

- abonați

- abonament

- astfel de

- a sustine

- Sprijină

- suspicios

- tabel

- sarcini

- echipă

- echipe

- Tehnic

- Tehnologia

- Strategia tehnologică

- șablon

- tenis

- test

- acea

- lor

- apoi

- Acolo.

- ei

- Al treilea

- terț

- acest

- aceste

- amenințare

- actori amenințători

- amenințări

- prag

- Prin

- timp

- la

- Unelte

- trafic

- Tren

- dresat

- Pregătire

- transformări

- Încredere

- încerca

- tv

- Două

- dublu

- tip

- Tipuri

- în

- unificat

- unic

- pe

- urgenţă

- us

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- utilizări

- folosind

- folosi

- utilizate

- valabil

- valoare

- Valori

- variabil

- versiune

- verticalele

- Vizualizare

- a încălcat

- Virtual

- Vulnerabilitățile

- plimbări

- vrea

- a fost

- Cale..

- we

- web

- servicii web

- au fost

- Ce

- cand

- dacă

- care

- larg

- Gamă largă

- voi

- cu

- în

- Apartamente

- fluxuri de lucru

- ar

- scris

- ani

- Tu

- Ta

- zephyrnet