By Kenna Hughes-Castleberry postat pe 02 decembrie 2022

Datorită progreselor tehnologiei, devine din ce în ce mai greu să spui ce este real și ce nu. Această problemă se agravează cu utilizarea tehnologiei deepfake—audio și videoclipuri care folosesc AI pentru a înlocui indivizii sau vocile acestora. În timp ce multe deepfake-uri au fost folosite cu succes pentru divertisment (cum ar fi dacă Nicholas Cage a fost în Raiders of the Lost Ark) sau jocuri (cum ar fi în sportivii FIFA), un procent mare dintre ele au fost create pentru mai multe motive sinistre. Pe măsură ce devine mai ușor să creezi aceste videoclipuri manipulate, mulți experți speră că calculul cuantic poate ajuta la depășirea potențialelor amenințări ale acestei tehnologii în creștere.

Cum funcționează tehnologia Deepfake?

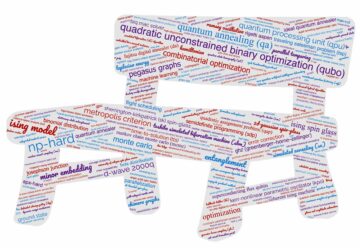

Pentru a crea un videoclip deepfake de succes, aveți nevoie masina de învățare algoritmi. „Algoritmii de învățare profundă învață singuri cum să rezolve problemele din seturi mari de date și apoi sunt utilizați pentru a schimba fețele între videoclipuri și alt conținut digital”, a explicat. Post-Cuantic CEO Andersen Cheng. Post-Quantum este o companie lider de securitate cibernetică al cărei accent este pus pe rezistent cuantic securitate, inclusiv împotriva deepfake-urilor. „Există o serie de metode pentru a crea aceste deepfake”, a declarat Cheng, „dar cea mai populară este utilizarea rețelelor neuronale profunde care implică autoencodere. Un codificare automată este un program AI de învățare profundă care studiază clipuri video pentru a înțelege cum arată o persoană din mai multe unghiuri și mediul înconjurător, apoi mapează acea persoană pe individ, găsind caracteristici comune.”

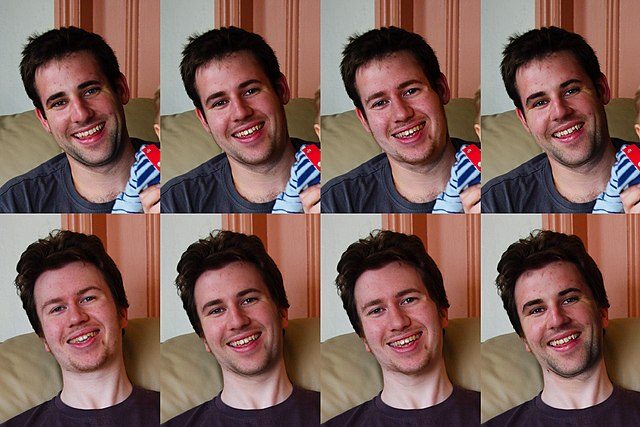

O tehnologie deepfake configurată (PC Wikimedia Commons)

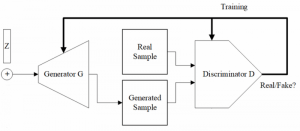

Pentru a vă asigura că autoencoderul funcționează cu succes, mai multe clipuri video ale feței subiectului trebuie analizate pentru a oferi un număr mai mare de date. Apoi, codificatorul automat poate ajuta la crearea unui videoclip compozit schimbând individul original cu subiectul nou. Un al doilea tip de învățare automată numită rețea generală adversară (GAN) va detecta și îmbunătăți defectele noului videoclip compozit. Potrivit unui articol 2022: „GAN-urile antrenează un „generator” pentru a crea noi imagini din reprezentarea latentă a imaginii sursă și un „discriminator” pentru a evalua realismul materialelor generate.” Acest proces are loc de mai multe ori până când discriminatorul nu poate spune dacă videoclipul este falsificat și deepfake-ul este complet.

Amenințarea tehnologiei Deepfake

În prezent, există multe software cu sursă deschisă sau aplicații gratuite pe care oamenii le pot folosi pentru a crea deepfake. Deși acest lucru poate părea benefic pentru mulți, în special pentru cei din industria divertismentului, a dus la unele probleme grave, chiar criminale. Potrivit unui Raport Deeptrace, 96% dintre videoclipurile deepfake online din 2019 au fost, deloc surprinzător, pornografie. În timp ce multe dintre aceste videoclipuri ilicite au fost făcute pentru a se răzbuna pe un fost, altele au fost folosite pentru a crea scandaluri pentru celebritățile feminine și chiar pentru politicieni. În 2018, a fost lansat un videoclip deepfake de la a partidul politic belgian arătându-l pe președintele de atunci Trump discutând despre Acordurile Climatice de la Paris. Având în vedere că știrile false devin deja o problemă pentru publicul larg, videoclipurile deepfake ar putea fi pamantul care sparge spatele cămilei. Chiar deepfake audio face ravagii, ca un fișier audio falsificat din CEO a unei companii de tehnologie a ajutat la comiterea unui act de fraudă. Pentru Cheng, aceste tipuri de mass-media pot uza destul de repede încrederea publicului. „Avem problema mai amplă a încrederii societății – cum va putea publicul să discearnă între ceea ce este real și ce este un deepfake”, a adăugat Cheng. „După cum am văzut, există chiar dovezi că deepfake-urile sunt folosite pentru a ocoli măsurile de protecție, cum ar fi autentificarea biometrică.” Cu aceste preocupări tot mai mari, Cheng și echipa sa de la Post-Quantum cred că au o soluție sub formă de Nomidio, un software specializat de ultra-securitate.

Pregătirea pentru amenințările tehnologice DeepFake

Privind multiplele amenințări reprezentate de calculul cuantic și deepfake-urile, Cheng și această echipă au creat Nomidio pentru a se asigura că identitățile de conectare și chiar autentificarea biometrică rămân în siguranță. „Nomidio este un serviciu biometric multifactor (MFB) biometric, fără parolă, care permite autentificarea sigură cu o experiență de utilizator simplă și intuitivă”, a spus Cheng. „Înlocuiește autentificarea pe bază de nume de utilizator/parolă și autentificarea unică, utilizatorii fiind autentificați în raport cu profilul lor biometric cu autentificare cu mai mulți factori (MFA) în culise.” Deoarece Cheng a fost un expert în securitate cibernetică de mulți ani, s-a asigurat că Nomidio ar putea fi, de asemenea, în siguranță împotriva deepfake-urilor. „Filozofia noastră de bază atunci când l-am creat a fost să folosim cât mai multe intrări suplimentare posibil și o autentificare multi-factor adevărată (adică cu mai mult de doi factori), deci este de fapt soluția ideală pentru abordarea oricărei dezvoltări viitoare în tehnologia deepfake. Acest lucru se datorează, în cele din urmă, faptului că MFA tradițional este insuficient, dar MFB poate face atacurile în timp real practic imposibile. Adică, o combinație de, de exemplu, voce, față și un cod PIN este foarte sigură prin faptul că orice factor poate fi falsificat, dar falsificarea pe toți trei în același caz este practic imposibil. Cu Nomidio, o combinație de biometrice a vocii și a feței, recunoașterea vorbirii, date dependente de context și chiar analiza comportamentală, pot fi combinate într-un singur sistem de autentificare. ”

În timp ce Nomidio în sine nu folosește calculul cuantic pentru a depăși amenințările deepfake, computerele cuantice ar putea funcționa împotriva acestor fișiere media false. La fel de calculatoare cuantice de multe ori valorifică algoritmii de învățare automată pentru a funcționa mai rapid și mai eficient, ei pot fi capabili să detecteze videoclipuri false sau fișiere audio la un ritm mai rapid. În timp ce tehnologia este încă în curs de dezvoltare și puțini se uită la deepfakes ca un potențial caz de utilizare pentru computerele cuantice, aceste mașini de nivel următor ar putea fi folosite în viitor pentru a face media noastră mai veridică și mai precisă.

Pe măsură ce amenințările tehnologiei deepfake devin din ce în ce mai evidente, multe guverne și companii încearcă deja să găsească modalități de a ajuta la combaterea acesteia. În 2021, Facebook a lansat Deepfake Detection Challenge, cu un premiu de 500,000 USD pentru cei care creează noi tehnologii pentru a detecta deepfake-urile. În SUA, state precum California, Texas și Virginia au legi care interzic utilizarea deepfake atât pentru pornografie, cât și pentru politică. The Parlamentul European a stabilit, de asemenea, mai multe reglementări privind deepfake-urile, modificând Digital Services Act pentru a impune utilizarea etichetelor pentru videoclipurile deepfake. Deși această legislație nu va intra în vigoare până în 2024, ea arată gravitatea amenințării tehnologice deepfake.

Kenna Hughes-Castleberry este scriitoare la Inside Quantum Technology și Science Communicator la JILA (un parteneriat între Universitatea din Colorado Boulder și NIST). Bataile ei de scris includ tehnologia profundă, metaversul și tehnologia cuantică.