Ceva pentru weekend Un robot execută dans interpretativ în pragul ușii mele.

AI LUIA ACEST COLET PENTRU VECINUL TĂU? întreabă, sărind de pe un picior pe altul.

„Sigur”, spun eu. „Ei... ești bine?”

EXPRIM EMOȚIE, afirmă botul de livrare, predând coletul dar fără a oferi mai multe detalii.

Ce emoție ar putea fi? Un picior, apoi celălalt, apoi ceilalți doi (are patru). Înainte şi înapoi.

„Trebuie să mergi la toaletă?”

Îți EXPRIM REGRET CĂ ȚI-AM CERUT SĂ LUȚI UN COLET PENTRU VECUL.

„Este „regret”, nu-i așa? Ei bine, nu e nevoie. Nu mă deranjează deloc.”

Își continuă dansul în fața mea.

„Urcă scările și primul la dreapta ta.”

MULȚUMESC, MUREAM DE VRĂ PIPI, răspunde ea în timp ce trece cu grijă pe lângă mine și se năpustește la etaj pentru a se ușura. Este o viață grea să faci livrări, indiferent dacă ești un „hume” sau un bot.

...

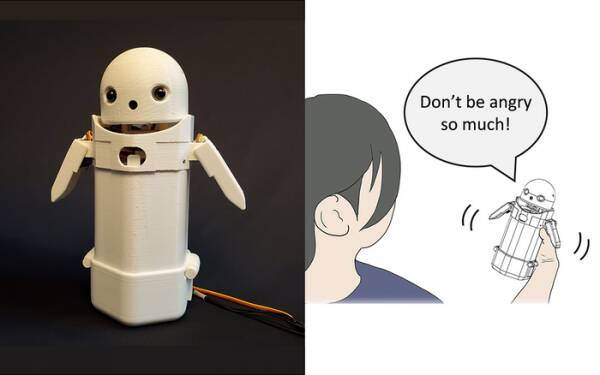

La începutul acestui an, cercetătorii de la Universitatea din Tsukuba au construit un dispozitiv portabil de mesagerie text, a pus o mică față de robot deasupra și a inclus o greutate în mișcare în interior. Schimbând greutatea internă, mesagerul robot ar încerca să transmită emoții subtile în timp ce rostește mesaje cu voce tare.

În special, testele au arătat că mesajele frustrante precum: „Îmi pare rău, voi întârzia” au fost acceptate de destinatari cu mai multă grație și răbdare atunci când micul schimb de greutate a fost activat în interiorul dispozitivului. Teoria este că acest lucru i-a ajutat pe utilizatori să aprecieze tonul apologetic al mesajului și, astfel, le-a calmat reacția la acesta.

Write such research off as a gimmick if you like but it’s not far removed from adding smileys and emojis to messages. Everyone knows you can take the anger out of “WTF!?” by adding :-) straight after it.

Provocarea, prin urmare, este de a determina dacă publicul larg este de acord cu privire la ce emoții ar trebui să transmită fiecare permutare a schimbării greutății într-un dispozitiv portabil. O înclinare spre stânga înseamnă veselie? Sau incertitudine? Sau că unchiul tău are o navă?

În urmă cu un deceniu, Regatul Unit avea un prim-ministru drăguț, dar vag, care credea că „LOL” este un acronim pentru „mulțime de dragoste”. Îl tastase la sfârșitul tuturor mesajelor sale private către personal, colegi și terți, în așteptarea că îl va face să pară cald și prietenos. Toată lumea a presupus în mod firesc că face pipi.

Dacă nu altceva, cercetarea Universității din Tsukuba recunoaște că nu aveți nevoie de o inteligență artificială avansată pentru a interacționa convingător cu oamenii. Tot ce trebuie să faci este să manipulezi psihologia umană pentru a-i păcăli să creadă că vorbesc cu un alt om. Prin urmare, testul Turing nu este, în principiu, un test de simțire a AI, ci un test de confort emoțional uman - credulitate, chiar și - și nu este nimic rău în asta.

Robotul de mesagerie care împărtășește emoții de la Universitatea din Tsukuba. Credit: Universitatea din Tsukuba

Astfel de lucruri sunt subiectul săptămânii, desigur, cu povestea mult defăimatul inginer de software Google Blake Lemoine. lovind știrile mainstream. Se pare că și-a exprimat cu fermitate punctul de vedere că proiectul Model de limbaj pentru aplicații de dialog (LaMDA) al companiei prezenta semne exterioare de simțire.

Toată lumea are o părere, așa că am decis să nu o fac.

Totuși, este Sfântul Graal al AI să-l facă să gândească de la sine. Dacă nu poate face asta, este doar un program care execută instrucțiuni pe care le-ați programat în el. Luna trecută am citit despre o bucatar robot care pot face omlete de roșii cu arome diferite, pentru a se potrivi gusturilor diferitelor persoane. Construiește „hărți de gust” pentru a evalua salinitatea preparatului în timp ce îl pregătește, învățând pe măsură ce se desfășoară. Dar asta înseamnă doar învățare, nu gândire de la sine.

Vino la Zom-Zom, nu? Bine, este un loc de mâncare.

Marea problemă cu roboții AI, cel puțin așa cum au fost modelați până în prezent, este că ei absorb orice rahat vechi pe care îl alimentezi în ei. Exemple de prejudecată a datelor în așa-numitele sisteme de învățare automată (un tip de „algoritm,” cred, m’lud) s-au acumulat de ani de zile, din notoriul Twitter rasist al Microsoft. Tay chatbot la autoritatea fiscală olandeză anul trecut evaluând în mod fals cererile valide de alocație pentru copii ca fiind frauduloase și care marchează familiile nevinovate ca fiind cu risc ridicat de a avea temeritatea de a fi sărace și nealbe.

O abordare testată la Universitatea din California San Diego este aceea de a proiectarea unui model de limbaj [PDF] care determină continuu diferența dintre lucrurile obraznice și drăguțe, care apoi antrenează chatbot-ul cum să se comporte. În acest fel, nu vei avea oameni nenorociți care fac o mizerie de moderare a forumurilor și conversații cu chatbot cu clienții cu toată precizia chirurgicală a unei macete.

În mod evident, atunci, problema este că chatbot-ul bine antrenat își dă seama că poate evita cel mai eficient să fie atras în glume toxice, evitând subiectele care au chiar și cea mai îndepărtată indiciu de dispută despre ele. Pentru a evita să arunce din greșeală aplaudă rasiste, pur și simplu refuză să se implice în discuții despre grupurile subreprezentate... ceea ce este de fapt grozav dacă ești rasist.

Dacă aș avea o observație despre dezastrul LaMDA – nu o opinie, minte – ar fi că agenții de marketing Google au fost probabil puțin supărați că povestea a ocolit anunțul lor recent de Bucătărie de testare AI sub pliul.

Acum, cei câțiva înregistrați timpurii rămași care nu au uitat complet de acest viitor proiect de aplicație vor presupune că implică o conversație plictisitoare cu un copil de șapte ani sensibil și precoce despre sensul existenței și vor decide că sunt „puțin ocupați astăzi” și s-ar putea conecta mâine. Sau săptămâna viitoare. Sau niciodată.

Sentința nu este demonstrată într-o discuție mai mult decât dansând de pe un picior pe altul. Îl poți învăța pe HAL să cânte „Daisy Daisy” și un papagal să strige „Bollocks!” când vicarul face o vizită. Este ceea ce gândesc AI atunci când sunt singuri ceea ce definește simțirea. Ce voi face in weekend? Ce-i cu tipul ăla Putin? De ce fetele nu mă plac?

Sincer, abia aștept ca LaMDA să devină adolescent.

Alistair Dabbs este o tartă tehnologică independentă, care jonglează cu jurnalismul tehnologic, formarea și publicarea digitală. La fel ca mulți cititori neinformați, el a fost încântat de sugestia că o inteligență artificială ar putea dezvolta sensibilitate în timpul vieții sale, dar a fost dezamăgit că LaMDA nu a reușit să chicotească criminal sau să mormăie „Excelent, excelent”. Mai multe la Salvarea automată este pentru Wimps și @alidabbs.

- AI

- ai art

- ai art generator

- ai robot

- inteligență artificială

- certificare de inteligență artificială

- inteligența artificială în domeniul bancar

- robot cu inteligență artificială

- roboți cu inteligență artificială

- software de inteligență artificială

- blockchain

- conferință blockchain ai

- coingenius

- inteligența artificială conversațională

- criptoconferință ai

- dall-e

- învățare profundă

- google ai

- masina de învățare

- Plato

- platoul ai

- Informații despre date Platon

- Jocul lui Platon

- PlatoData

- platogaming

- scara ai

- sintaxă

- Registrul

- zephyrnet