Construirea unei platforme de operațiuni de învățare automată (MLOps) în peisajul în evoluție rapidă al inteligenței artificiale (AI) și al învățării automate (ML) pentru organizații este esențială pentru a reduce fără probleme decalajul dintre experimentarea și implementarea științei datelor, îndeplinind în același timp cerințele privind performanța modelului. securitate și conformitate.

Pentru a îndeplini cerințele de reglementare și de conformitate, cerințele cheie la proiectarea unei astfel de platforme sunt:

- Derivarea datelor adresei

- Monitorizați performanța modelului

- Facilitează recalificarea automată a modelului

- Furnizați un proces pentru aprobarea modelului

- Păstrați modelele într-un mediu sigur

În această postare, arătăm cum să creați un cadru MLOps pentru a răspunde acestor nevoi folosind o combinație de servicii AWS și seturi de instrumente terțe. Soluția implică o configurare multi-mediu cu recalificare automată a modelului, inferență în loturi și monitorizare cu Monitor de model Amazon SageMaker, versiunea modelului cu Registrul de modele SageMaker, și o conductă CI/CD pentru a facilita promovarea codului ML și a conductelor în medii prin utilizarea Amazon SageMaker, Amazon EventBridge, Serviciul de notificare simplă Amazon (Amazon S3), HashiCorp Terraform, GitHub, și Jenkins CI/CD. Construim un model pentru a prezice severitatea (benignă sau malignă) a unei leziuni de masă mamografice antrenate cu Algoritmul XGBoost folosind cele disponibile publicului Masa de mamografie UCI set de date și implementați-l folosind cadrul MLOps. Instrucțiunile complete cu cod sunt disponibile în GitHub depozit.

Prezentare generală a soluțiilor

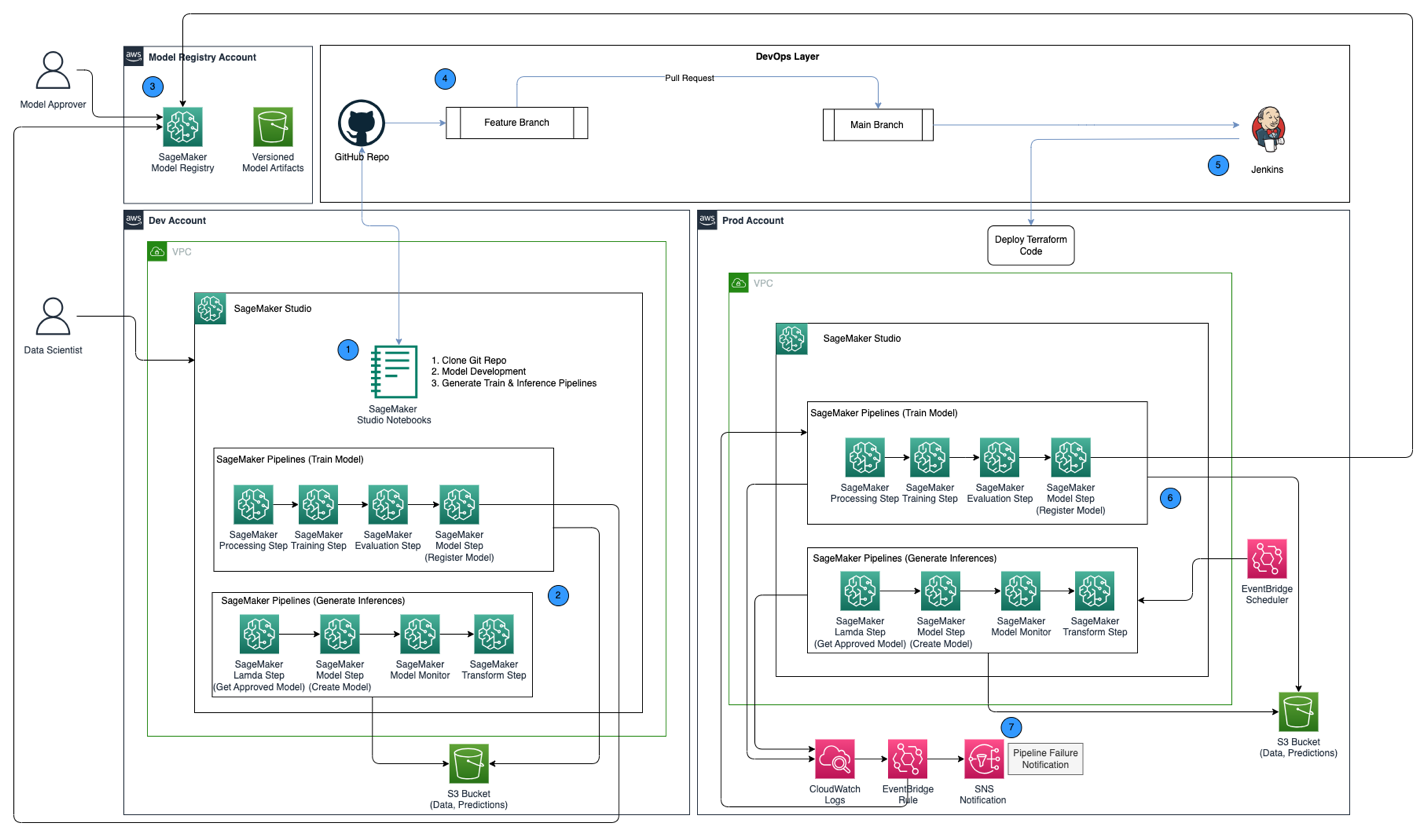

Următoarea diagramă de arhitectură prezintă o prezentare generală a cadrului MLOps cu următoarele componente cheie:

- Strategie cu mai multe conturi – Două medii diferite (dev și prod) sunt configurate în două conturi AWS diferite, urmând cele mai bune practici AWS Well-Architected, iar un al treilea cont este configurat în registrul central al modelului:

- Mediul de dezvoltare – Unde un Domeniul Amazon SageMaker Studio este configurat pentru a permite dezvoltarea modelului, antrenamentul modelului și testarea conductelor ML (antrenare și inferență), înainte ca un model să fie gata să fie promovat în medii superioare.

- Mediu produs – În cazul în care conductele ML de la dev sunt promovate ca prim pas și sunt programate și monitorizate în timp.

- Registrul central de modele - Registrul de modele Amazon SageMaker este configurat într-un cont AWS separat pentru a urmări versiunile de model generate în mediile de dezvoltare și producție.

- CI/CD și controlul sursei – Implementarea conductelor ML în medii este gestionată prin configurarea CI/CD cu Jenkins, împreună cu controlul versiunilor gestionat prin GitHub. Modificările codului îmbinate în mediul corespunzător git branch declanșează un flux de lucru CI/CD pentru a face modificările adecvate mediului țintă dat.

- Predicții pe loturi cu monitorizare model – Conducta de inferență construită cu Pipelines Amazon SageMaker rulează pe o bază programată pentru a genera predicții împreună cu monitorizarea modelului folosind SageMaker Model Monitor pentru a detecta deriva de date.

- Mecanism automat de recalificare – Conducta de antrenament construită cu SageMaker Pipelines este declanșată ori de câte ori este detectată o deriva de date în conducta de inferență. După ce este instruit, modelul este înregistrat în registrul central de modele pentru a fi aprobat de un autorizator de model. Când este aprobat, versiunea actualizată a modelului este utilizată pentru a genera predicții prin conducta de inferență.

- Infrastructura ca cod – Infrastructura ca cod (IaC), creată folosind HashiCorp Terraform, sprijină programarea conductei de inferență cu EventBridge, declanșarea conductei de tren pe baza unui Regula EventBridge și trimiterea de notificări folosind Serviciul de notificare simplă Amazon (Amazon SNS) Subiecte.

Fluxul de lucru MLOps include următorii pași:

- Accesați domeniul SageMaker Studio în contul de dezvoltare, clonați depozitul GitHub, parcurgeți procesul de dezvoltare a modelului folosind modelul de exemplu furnizat și generați conductele de tren și de inferență.

- Rulați conducta de tren în contul de dezvoltare, care generează artefactele modelului pentru versiunea modelului antrenat și înregistrează modelul în SageMaker Model Registry în contul central de registru model.

- Aprobați modelul în SageMaker Model Registry în contul central de registry model.

- Împingeți codul (conducte de tren și inferență și codul Terraform IaC pentru a crea programul EventBridge, regula EventBridge și subiectul SNS) într-o ramură de caracteristici a depozitului GitHub. Creați o cerere de extragere pentru a îmbina codul în ramura principală a depozitului GitHub.

- Declanșați conducta Jenkins CI/CD, care este configurată cu depozitul GitHub. Conducta CI/CD implementează codul în contul de produs pentru a crea conductele de tren și de inferență împreună cu codul Terraform pentru a furniza programul EventBridge, regula EventBridge și subiectul SNS.

- Conducta de inferență este programată să ruleze zilnic, în timp ce conducta de tren este configurată să ruleze ori de câte ori este detectată deriva de date din conducta de inferență.

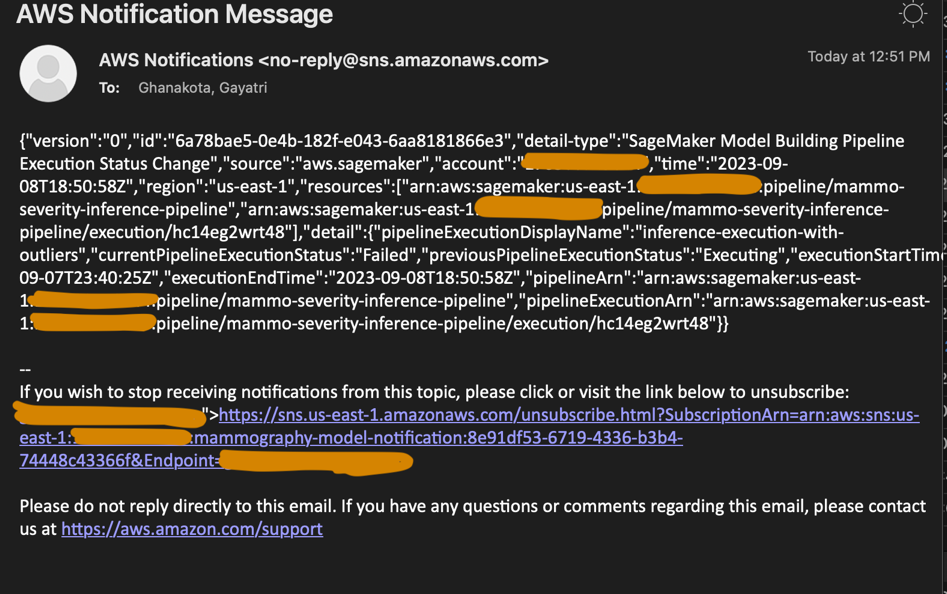

- Notificările sunt trimise prin subiectul SNS ori de câte ori există o defecțiune a trenului sau a conductei de inferență.

Cerințe preliminare

Pentru această soluție, ar trebui să aveți următoarele condiții preliminare:

- Trei conturi AWS (conturi de dezvoltare, produse și conturi de registru model central)

- Un domeniu SageMaker Studio configurat în fiecare dintre cele trei conturi AWS (consultați Integrat la Amazon SageMaker Studio sau urmăriți videoclipul Incorporați rapid la Amazon SageMaker Studio pentru instrucțiuni de configurare)

- Jenkins (folosim Jenkins 2.401.1) cu privilegii administrative instalate pe AWS

- Terraform versiunea 1.5.5 sau ulterioară instalată pe serverul Jenkins

Pentru această postare, lucrăm în us-east-1 Regiunea pentru a implementa soluția.

Furnizați cheile KMS în conturile de dezvoltare și producție

Primul nostru pas este să creăm AWS Service Management Service (AWS KMS) în conturile de dezvoltare și producție.

Creați o cheie KMS în contul de dezvoltare și acordați acces la contul prod

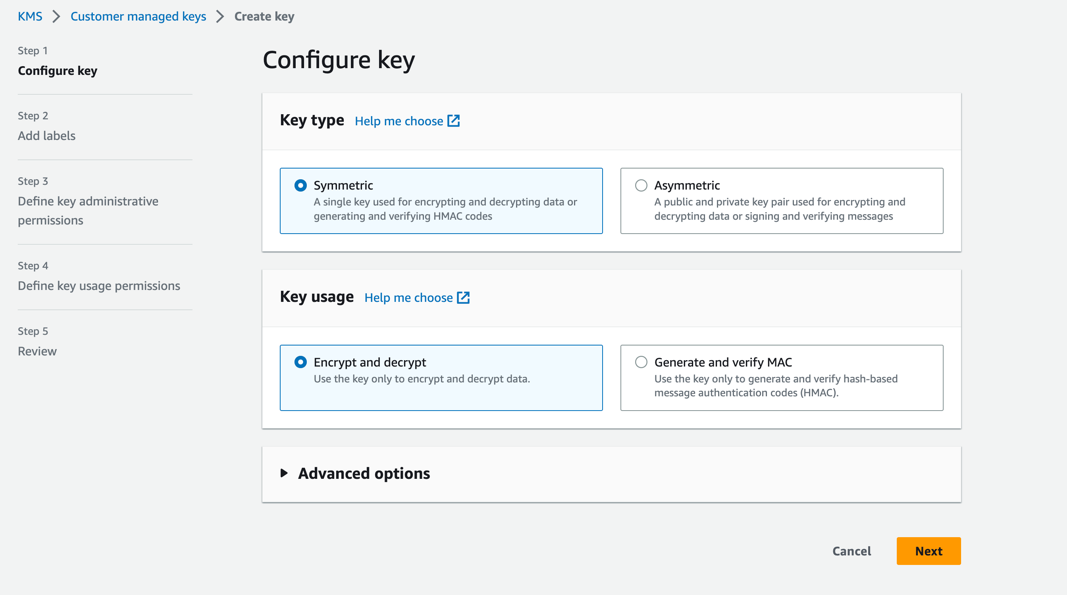

Parcurgeți următorii pași pentru a crea o cheie KMS în contul de dezvoltare:

- Pe consola AWS KMS, alegeți Chei gestionate de client în panoul de navigare.

- Alege Creați cheia.

- Pentru Tipul cheii, Selectați Simetric.

- Pentru Utilizarea cheii, Selectați Criptați și decriptați.

- Alege Pagina Următoare →.

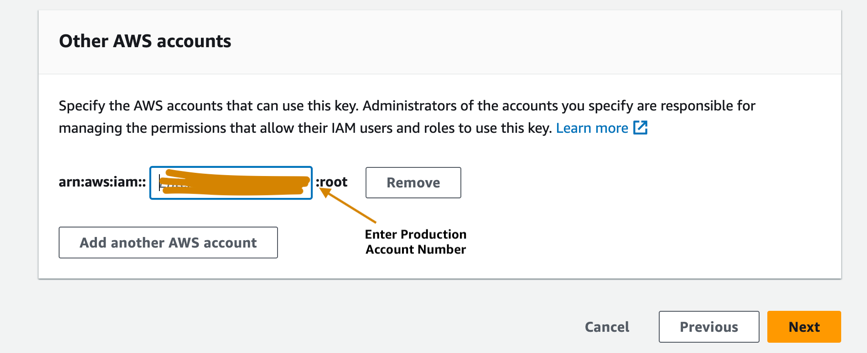

- Introduceți numărul contului de producție pentru a oferi contului de producție acces la cheia KMS furnizată în contul de dezvoltare. Acesta este un pas necesar deoarece prima dată când modelul este antrenat în contul de dezvoltare, artefactele modelului sunt criptate cu cheia KMS înainte de a fi scrise în compartimentul S3 în contul de registru central al modelului. Contul de producție are nevoie de acces la cheia KMS pentru a decripta artefactele modelului și pentru a rula conducta de inferență.

- Alege Pagina Următoare → și finalizați crearea cheii.

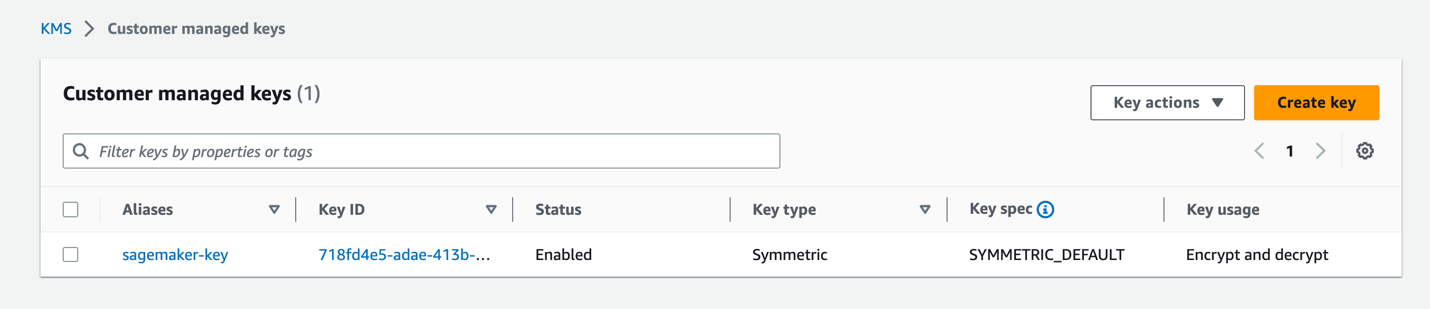

După ce cheia este furnizată, aceasta ar trebui să fie vizibilă pe consola AWS KMS.

Creați o cheie KMS în contul prod

Parcurgeți aceiași pași din secțiunea anterioară pentru a crea o cheie KMS gestionată de client în contul prod. Puteți sări peste pasul pentru a partaja cheia KMS către alt cont.

Configurați o găleată S3 de artefacte model în contul de registru central al modelului

Creați o găleată S3 la alegere cu șirul sagemaker în convenția de denumire ca parte a numelui compartimentului din contul de registru central al modelului și actualizați politica compartimentului pentru compartimentul S3 pentru a acorda permisiuni atât de la conturile de dezvoltare, cât și de la conturile de producție pentru a citi și scrie artefacte de model în compartimentul S3.

Următorul cod este politica compartimentului care trebuie actualizat în compartimentul S3:

Configurați roluri IAM în conturile dvs. AWS

Următorul pas este configurarea Gestionarea identității și accesului AWS (IAM) în conturile dvs. AWS cu permisiuni pentru AWS Lambdas, SageMaker și Jenkins.

Rol de execuție lambda

Configurarea Roluri de execuție lambda în conturile de dezvoltare și producție, care vor fi utilizate de funcția Lambda rulată ca parte a SageMaker Pipelines Pas Lambda. Acest pas va rula din conducta de inferență pentru a prelua cel mai recent model aprobat, folosindu-se de generat inferențe. Creați roluri IAM în conturile de dezvoltare și producție cu convenția de denumire arn:aws:iam::<account-id>:role/lambda-sagemaker-role și atașați următoarele politici IAM:

- Politica 1 – Creați o politică inline numită

cross-account-model-registry-access, care oferă acces la pachetul model configurat în registrul modelului din contul central: - Politica 2 – Atașați AmazonSageMakerFullAccess, care este un Politica gestionată de AWS care oferă acces deplin la SageMaker. De asemenea, oferă acces selectat la servicii conexe, cum ar fi Scalare automată a aplicației AWS, Amazon S3, Registrul Amazon de containere elastice (Amazon ECR) și Jurnalele Amazon CloudWatch.

- Politica 3 – Atașați AWSLambda_FullAccess, care este o politică gestionată de AWS care oferă acces deplin la Lambda, funcțiile consolei Lambda și alte servicii AWS conexe.

- Politica 4 – Utilizați următoarea politică de încredere IAM pentru rolul IAM:

Rol de execuție SageMaker

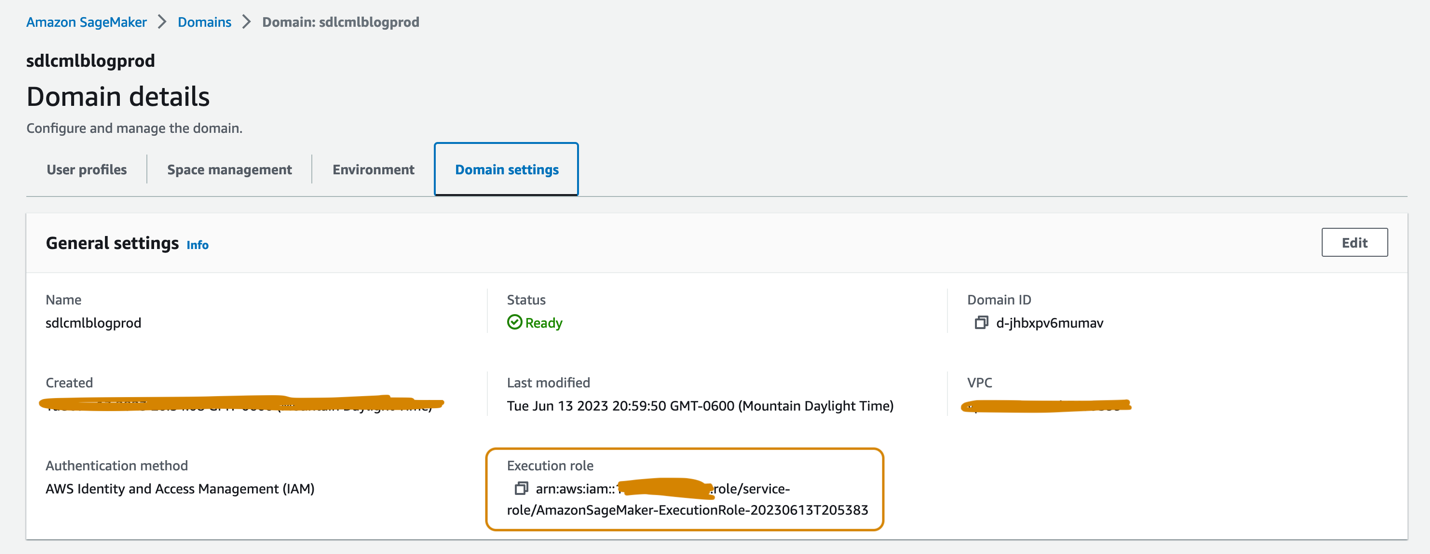

Domeniile SageMaker Studio configurate în conturile de dezvoltare și producție ar trebui să aibă fiecare asociat un rol de execuție, care poate fi găsit pe Setări de domeniu pe pagina de detalii a domeniului, așa cum se arată în următoarea captură de ecran. Acest rol este folosit pentru a rula joburi de instruire, procesare joburi și multe altele în domeniul SageMaker Studio.

Adăugați următoarele politici la rolul de execuție SageMaker în ambele conturi:

- Politica 1 – Creați o politică inline numită

cross-account-model-artifacts-s3-bucket-access, care oferă acces la bucket-ul S3 în contul central de registru al modelului, care stochează artefactele modelului: - Politica 2 – Creați o politică inline numită

cross-account-model-registry-access, care oferă acces la pachetul de model din registrul modelului din contul de registru central al modelului: - Politica 3 – Creați o politică inline numită

kms-key-access-policy, care oferă acces la cheia KMS creată la pasul anterior. Furnizați ID-ul contului în care este creată politica și ID-ul cheii KMS creat în acel cont. - Politica 4 – Atașați AmazonSageMakerFullAccess, care este un Politica gestionată de AWS care oferă acces deplin la SageMaker și acces selectat la serviciile conexe.

- Politica 5 – Atașați AWSLambda_FullAccess, care este o politică gestionată de AWS care oferă acces deplin la Lambda, funcțiile consolei Lambda și alte servicii AWS conexe.

- Politica 6 – Atașați CloudWatchEventsFullAccess, care este o politică gestionată de AWS care oferă acces deplin la CloudWatch Events.

- Politica 7 – Adăugați următoarea politică de încredere IAM pentru rolul IAM de execuție SageMaker:

- Politica 8 (specifică rolului de execuție SageMaker în contul de produs) – Creați o politică inline numită

cross-account-kms-key-access-policy, care oferă acces la cheia KMS creată în contul dev. Acest lucru este necesar pentru ca conducta de inferență să citească artefactele modelului stocate în contul de registru central al modelului, unde artefactele modelului sunt criptate folosind cheia KMS din contul dezvoltatorului, atunci când prima versiune a modelului este creată din contul dezvoltatorului.

Rolul Jenkins pentru mai multe conturi

Configurați un rol IAM numit cross-account-jenkins-role în contul prod, despre care Jenkins îl va presupune că va implementa conducte ML și infrastructura corespunzătoare în contul prod.

Adăugați următoarele politici IAM gestionate la rol:

CloudWatchFullAccessAmazonS3FullAccessAmazonSNSFullAccessAmazonSageMakerFullAccessAmazonEventBridgeFullAccessAWSLambda_FullAccess

Actualizați relația de încredere pe rol pentru a acorda permisiuni contului AWS care găzduiește serverul Jenkins:

Actualizați permisiunile pentru rolul IAM asociat cu serverul Jenkins

Presupunând că Jenkins a fost configurat pe AWS, actualizați rolul IAM asociat cu Jenkins pentru a adăuga următoarele politici, care vor oferi Jenkins acces pentru a implementa resursele în contul de produs:

- Politica 1 – Creați următoarea politică inline numită

assume-production-role-policy: - Politica 2 – Atașați

CloudWatchFullAccesspolitica IAM gestionată.

Configurați grupul de pachete de model în contul de registru central al modelului

Din domeniul SageMaker Studio din contul de registru central al modelului, creați un grup de pachete model numit mammo-severity-model-package folosind următorul fragment de cod (pe care îl puteți rula folosind un notebook Jupyter):

Configurați accesul la pachetul model pentru rolurile IAM din conturile de dezvoltare și producție

Furnizați acces la rolurile de execuție SageMaker create în conturile de dezvoltare și producție, astfel încât să puteți înregistra versiuni de model în pachetul de model mammo-severity-model-package în registrul central model din ambele conturi. Din domeniul SageMaker Studio din contul de registru central al modelului, rulați următorul cod într-un blocnotes Jupyter:

Configurați Jenkins

În această secțiune, configurăm Jenkins să creeze conductele ML și infrastructura Terraform corespunzătoare în contul prod prin conducta Jenkins CI/CD.

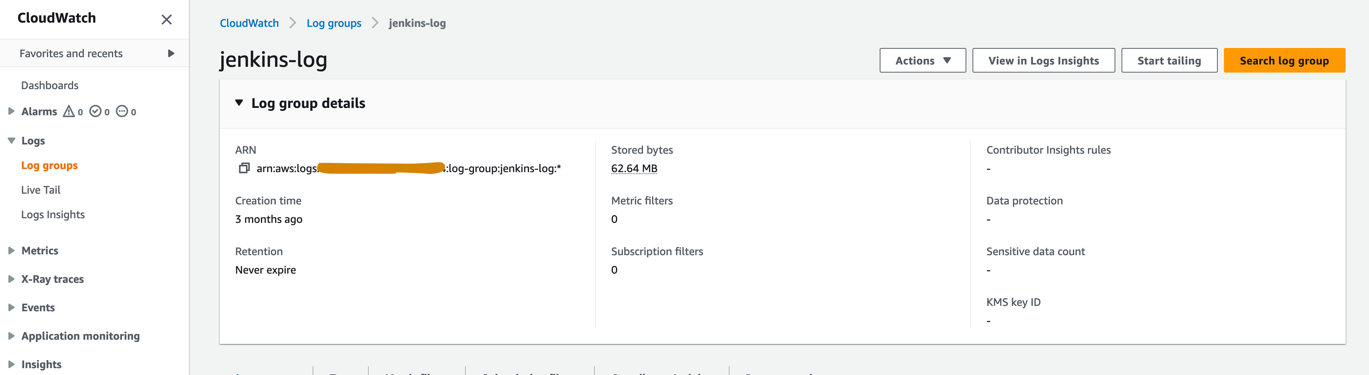

- Pe consola CloudWatch, creați un grup de jurnal numit

jenkins-logîn contul de prod către care Jenkins va împinge jurnalele din conducta CI/CD. Grupul de jurnal trebuie creat în aceeași regiune în care este configurat serverul Jenkins.

- Instalați următoarele pluginuri pe serverul tău Jenkins:

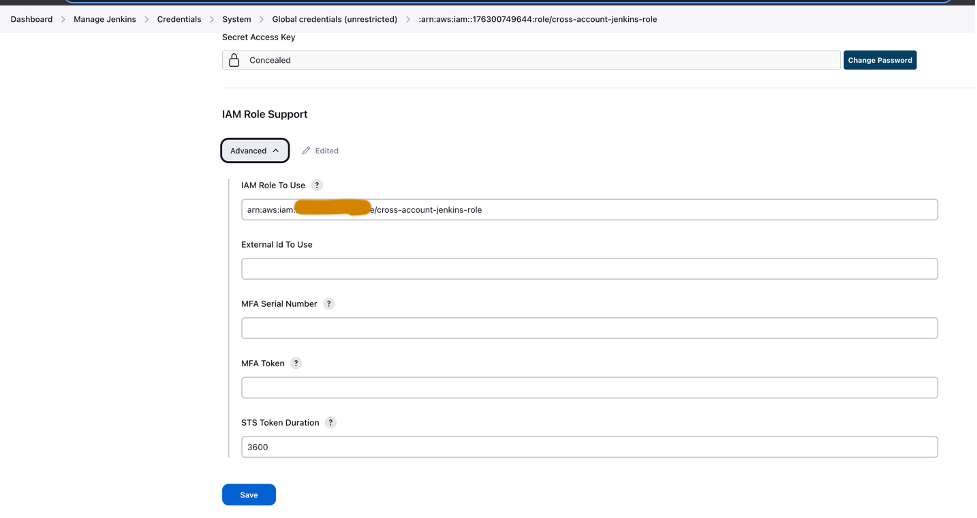

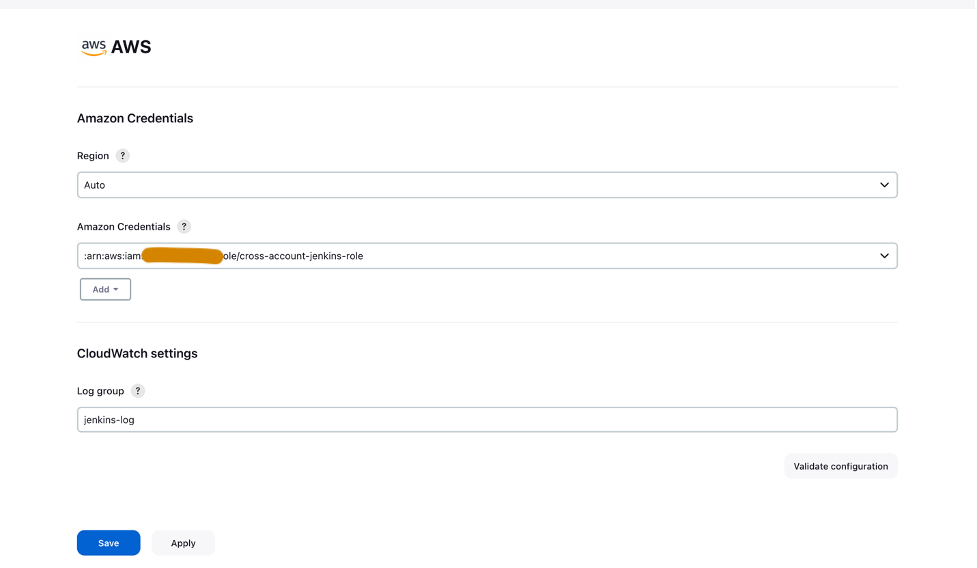

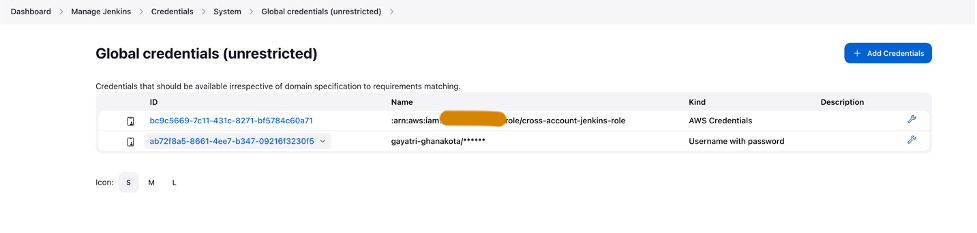

- Configurați acreditările AWS în Jenkins folosind rolul IAM pentru mai multe conturi (

cross-account-jenkins-role) furnizate în contul prod.

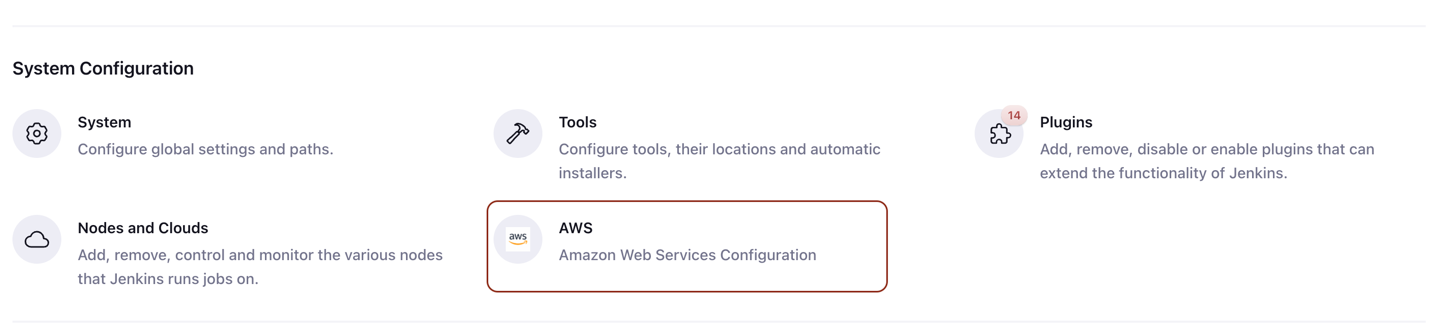

- Pentru Configurația de sistem, alege AWS.

- Furnizați acreditările și grupul de jurnal CloudWatch pe care le-ați creat mai devreme.

- Configurați acreditările GitHub în Jenkins.

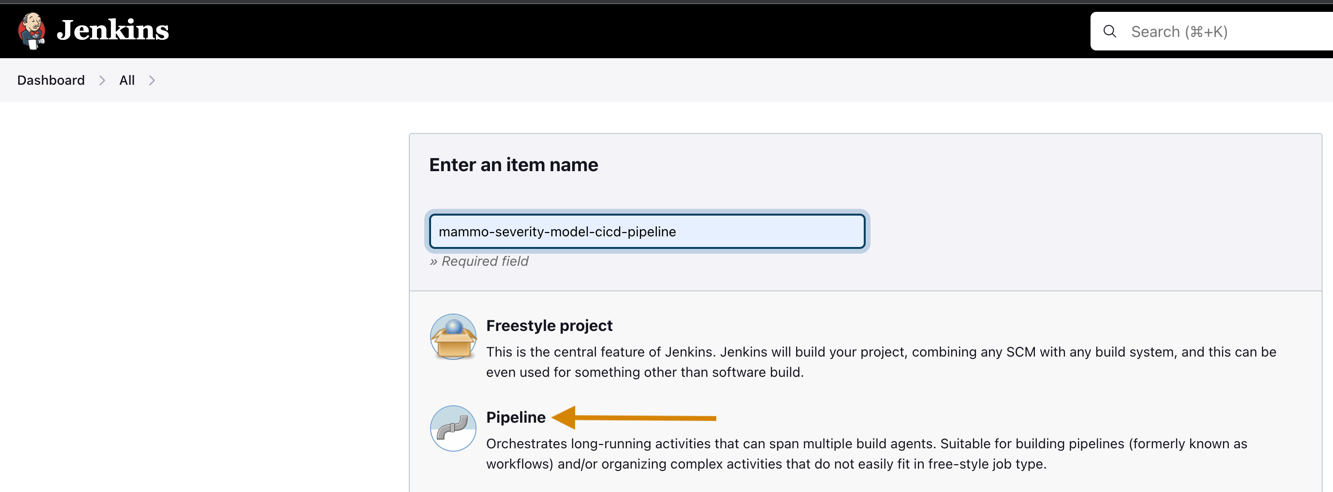

- Creați un nou proiect în Jenkins.

- Introduceți un nume de proiect și alegeți Conductă.

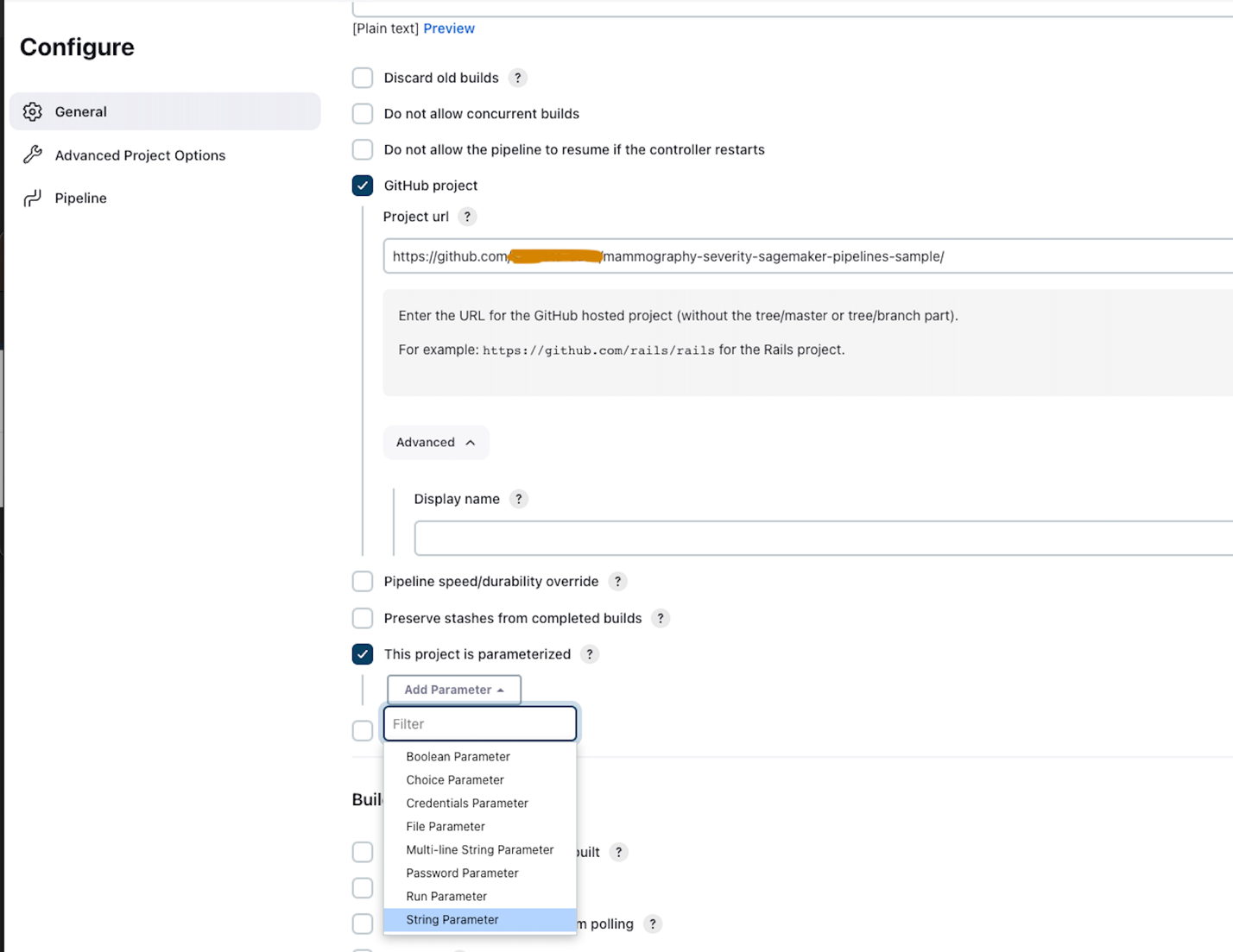

- Pe General , selectați Proiectul GitHub și intră în bifurcat GitHub depozit URL.

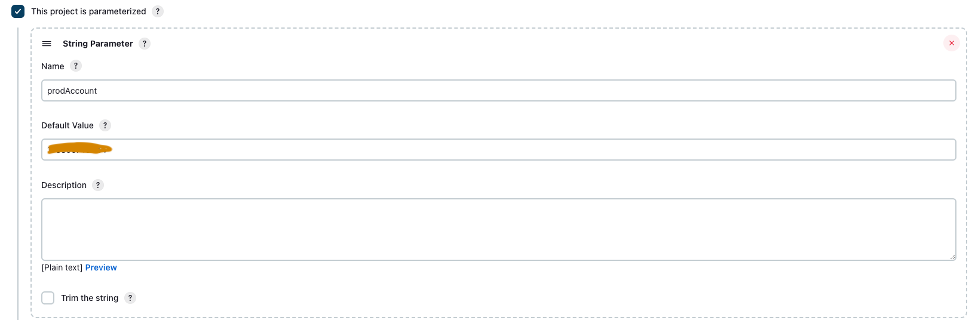

- Selectați Acest proiect este parametrizat.

- Pe Adăugați un parametru meniu, alegeți Parametru șir.

- Pentru Nume si Prenume, introduce

prodAccount. - Pentru Valoare implicită, introduceți ID-ul contului de produs.

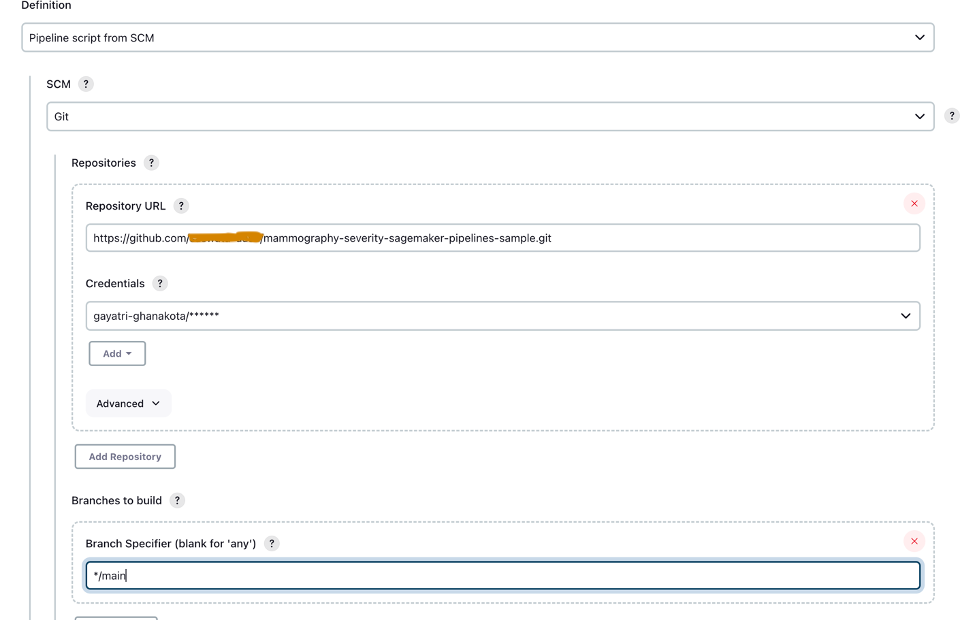

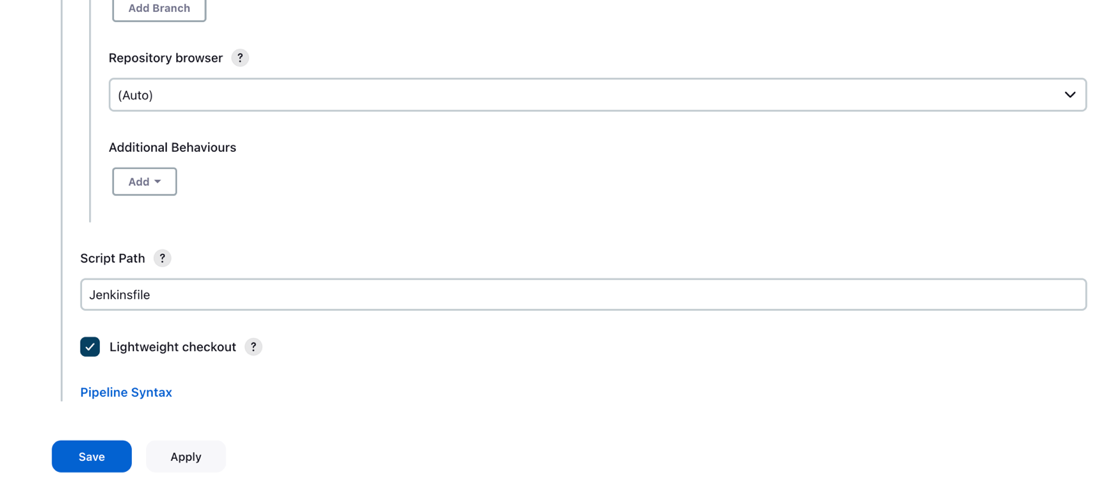

- În Opțiuni avansate de proiect, Pentru Definiție, Selectați Script pipeline de la SCM.

- Pentru CSM, alege merge.

- Pentru Adresa URL a depozitului, intrați în bifurcație GitHub depozit URL.

- Pentru scrisori de acreditare, introduceți acreditările GitHub salvate în Jenkins.

- Intrați

mainîn Ramuri de construit secțiunea, pe baza căreia va fi declanșată conducta CI/CD.

- Pentru Calea scriptului, introduce

Jenkinsfile. - Alege Economisiți.

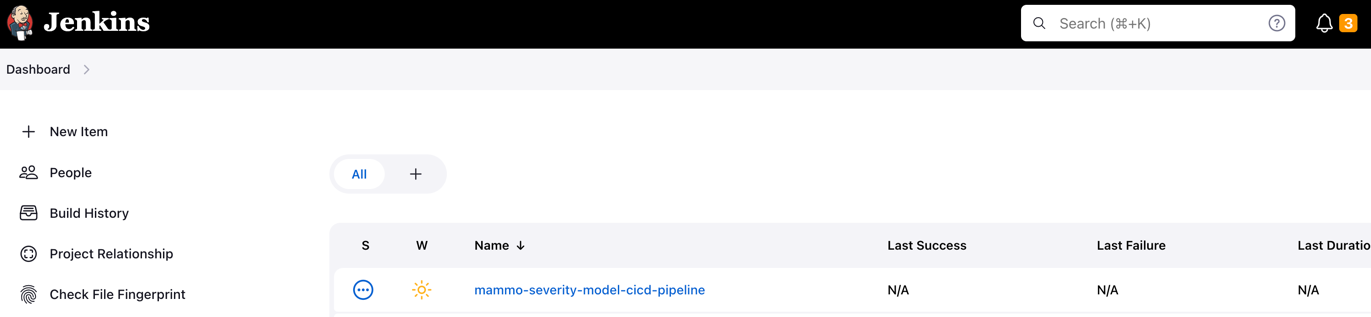

Conducta Jenkins ar trebui să fie creată și vizibilă pe tabloul de bord.

Furnizați găleți S3, colectați și pregătiți date

Parcurgeți următorii pași pentru a vă configura compartimentele și datele S3:

- Creați o găleată S3 la alegere cu șirul

sagemakerîn convenția de denumire ca parte a numelui compartimentului atât în conturile de dezvoltare, cât și în conturile de producție, pentru a stoca seturi de date și artefacte de model. - Configurați o găleată S3 pentru a menține starea Terraform în contul de produs.

- Descărcați și salvați documentul disponibil public Masa de mamografie UCI setul de date în compartimentul S3 pe care l-ați creat mai devreme în contul de dezvoltare.

- Bifurcați și clonați GitHub depozit în domeniul SageMaker Studio în contul de dezvoltare. Repo are următoarea structură de foldere:

- /environments – Script de configurare pentru mediul prod

- /mlps-infra – Cod pentru implementarea serviciilor AWS folosind codul Terraform

- /conducte – Cod pentru componentele conductei SageMaker

- Jenkinsfile – Script de implementat prin conducta Jenkins CI/CD

- setup.py – Este necesar să instalați modulele Python necesare și să creați comanda run-pipeline

- mamografie-modelare-severitate.ipynb – Vă permite să creați și să rulați fluxul de lucru ML

- Creați un folder numit date în folderul de depozit GitHub clonat și salvați o copie a fișierului disponibil public Masa de mamografie UCI set de date.

- Urmați caietul Jupyter

mammography-severity-modeling.ipynb. - Rulați următorul cod în blocnotes pentru a preprocesa setul de date și a-l încărca în compartimentul S3 din contul de dezvoltare:

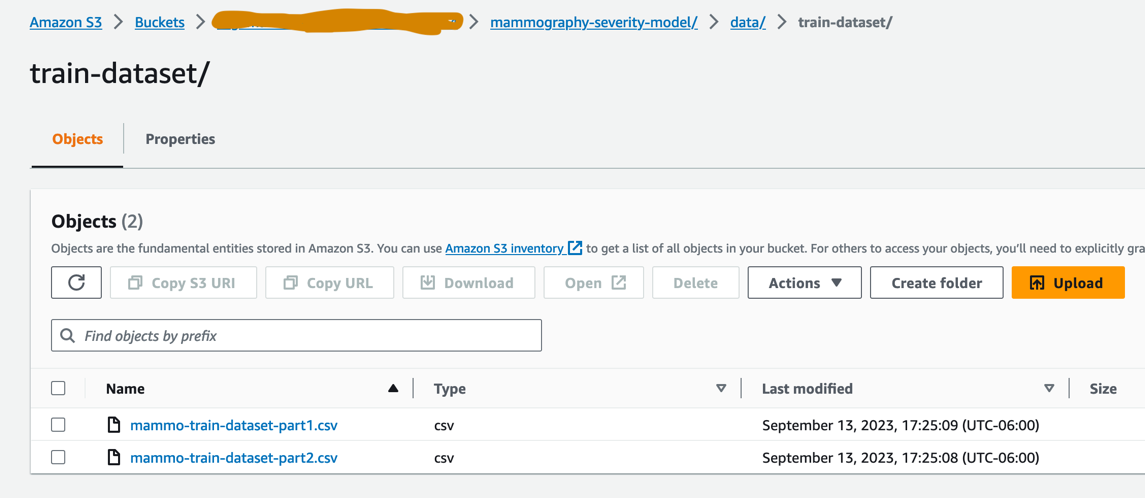

Codul va genera următoarele seturi de date:

-

- data/ mammo-train-dataset-part1.csv – Va fi folosit pentru a antrena prima versiune a modelului.

- data/ mammo-train-dataset-part2.csv – Va fi folosit pentru a antrena cea de-a doua versiune a modelului împreună cu setul de date mammo-train-dataset-part1.csv.

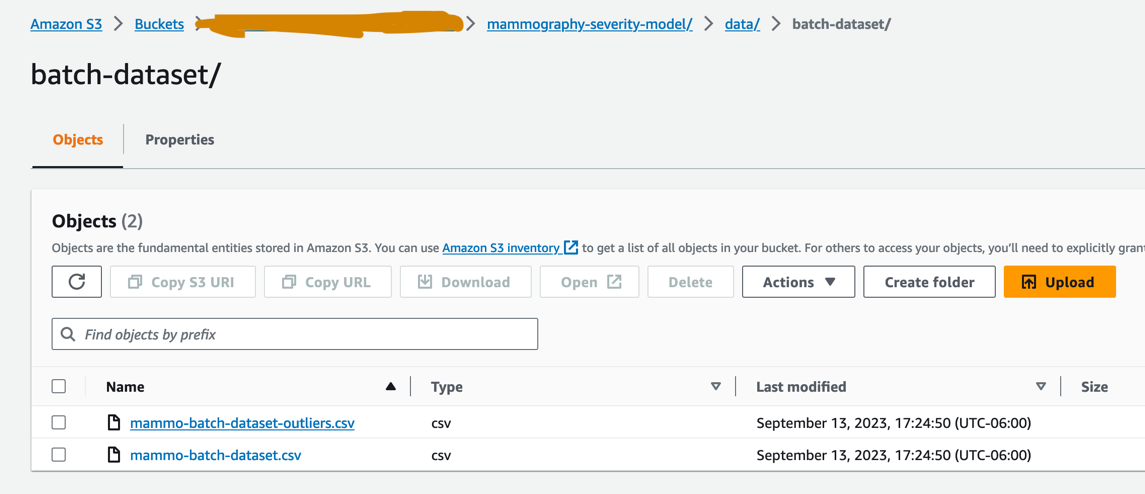

- data/mammo-batch-dataset.csv – Va fi folosit pentru a genera inferențe.

- data/mammo-batch-dataset-outliers.csv – Va introduce valori aberante în setul de date pentru a eșua conducta de inferență. Acest lucru ne va permite să testăm modelul pentru a declanșa reinstruirea automată a modelului.

- Încărcați setul de date

mammo-train-dataset-part1.csvsub prefixmammography-severity-model/train-datasetși încărcați seturile de datemammo-batch-dataset.csvșimammo-batch-dataset-outliers.csvla prefixmammography-severity-model/batch-datasetdin compartimentul S3 creat în contul de dezvoltare: - Încărcați seturile de date

mammo-train-dataset-part1.csvșimammo-train-dataset-part2.csvsub prefixmammography-severity-model/train-datasetîn găleata S3 creată în contul prod prin consola Amazon S3.

- Încărcați seturile de date

mammo-batch-dataset.csvșimammo-batch-dataset-outliers.csvla prefixmammography-severity-model/batch-dataseta găleții S3 în contul de prod.

Rulați conducta trenului

În <project-name>/pipelines/train, puteți vedea următoarele scripturi Python:

- scripts/raw_preprocess.py – Se integrează cu SageMaker Processing pentru ingineria caracteristicilor

- scripts/evaluate_model.py – Permite calcularea valorilor modelului, în acest caz

auc_score - train_pipeline.py – Conține codul pentru conducta de formare a modelului

Urmați pașii următori:

- Încărcați scripturile în Amazon S3:

- Obțineți instanța conductei de tren:

- Trimiteți conducta trenului și rulați-o:

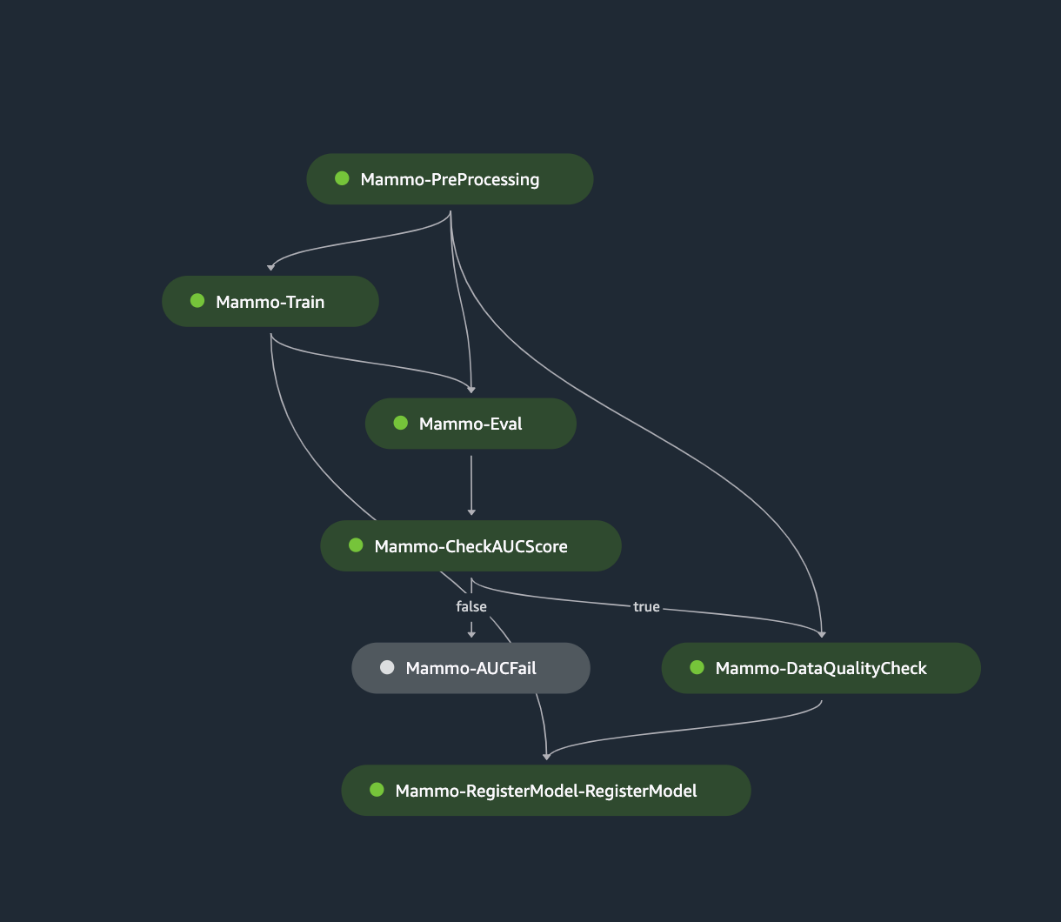

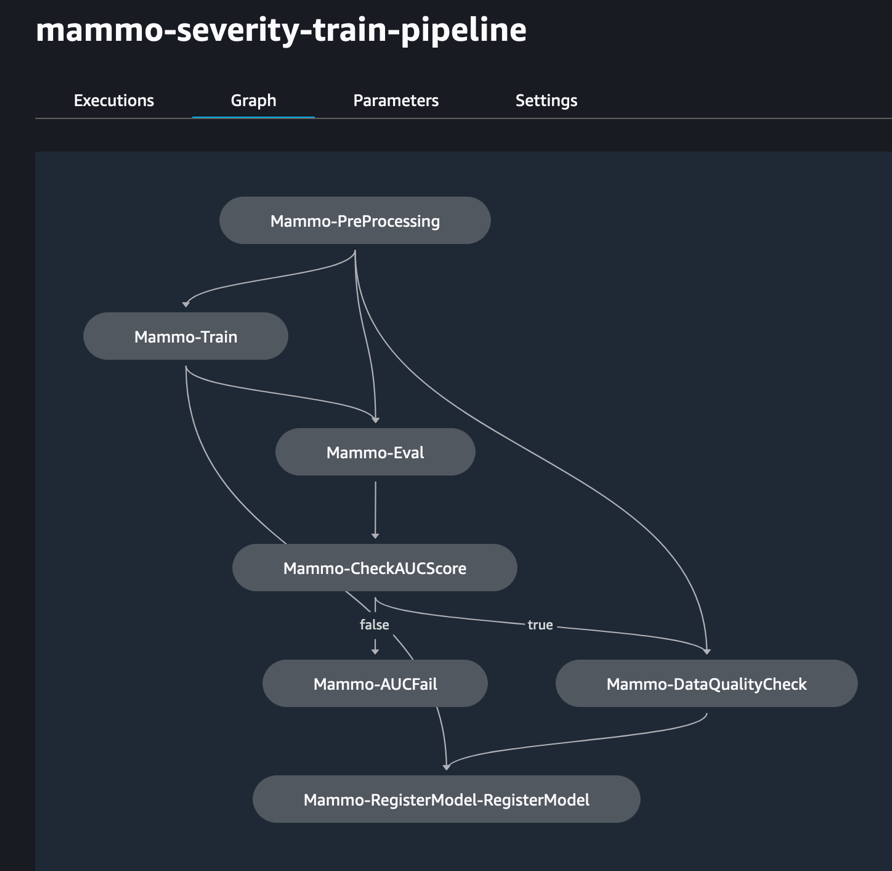

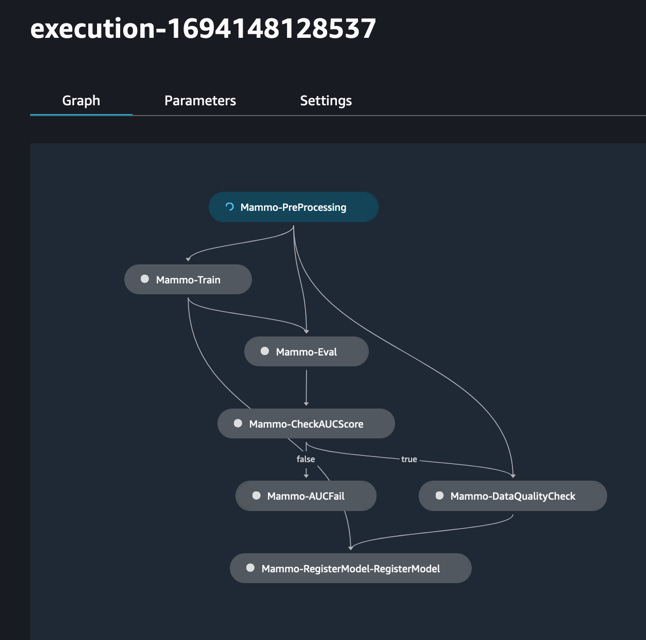

Figura următoare arată o rulare cu succes a conductei de antrenament. Ultimul pas în pipeline înregistrează modelul în contul central de registru al modelului.

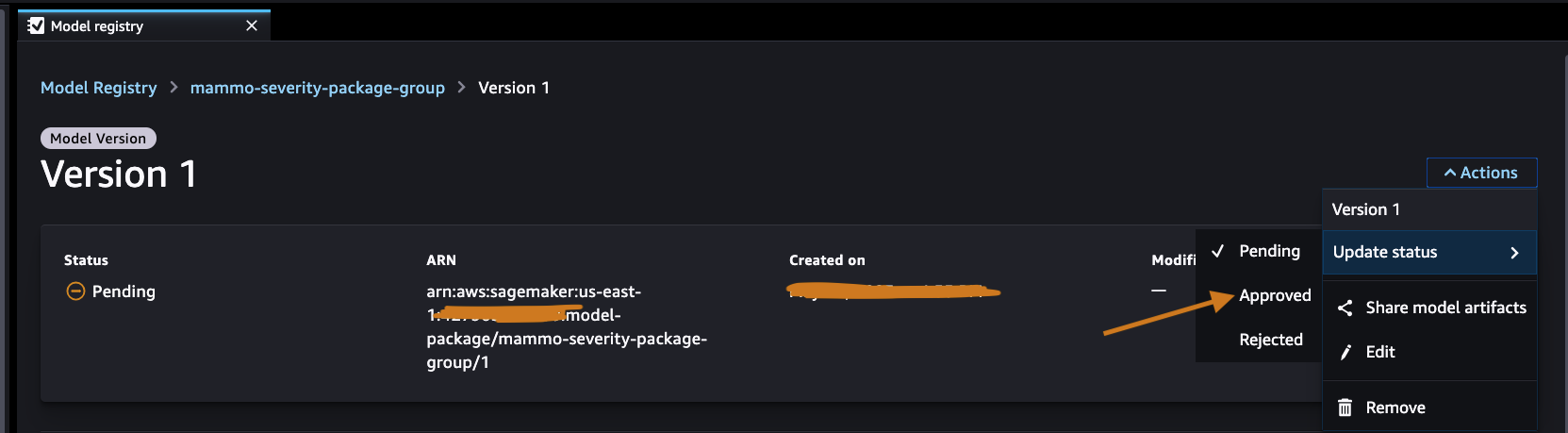

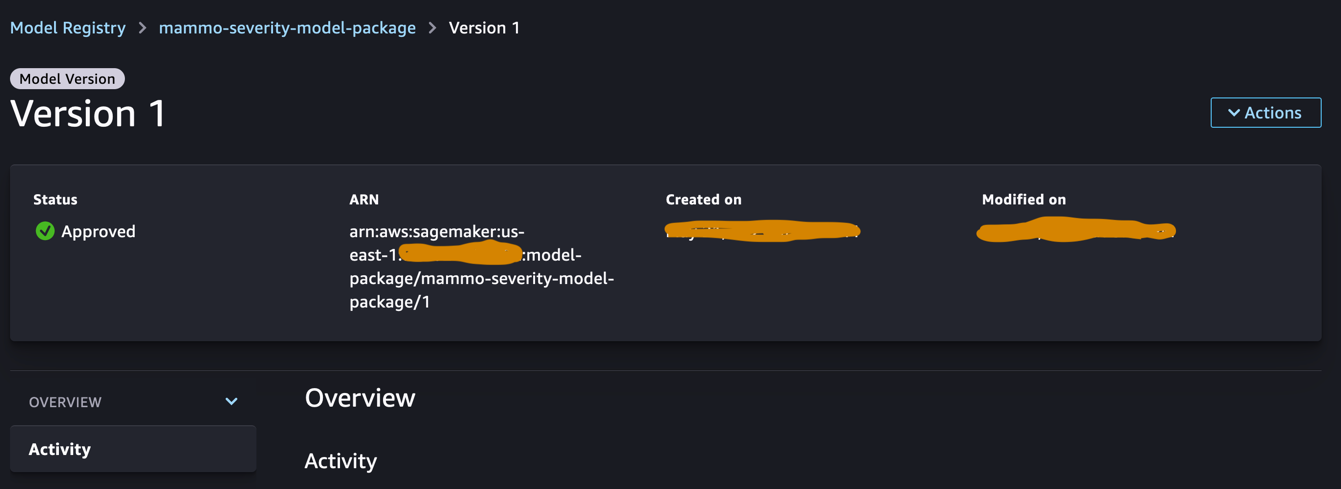

Aprobați modelul în registrul central de modele

Conectați-vă la contul central de registru de modele și accesați registrul de modele SageMaker din domeniul SageMaker Studio. Schimbați starea versiunii modelului la Aprobat.

Odată aprobat, starea trebuie schimbată pe versiunea modelului.

Rulați conducta de inferență (Opțional)

Acest pas nu este necesar, dar puteți rula în continuare conducta de inferență pentru a genera predicții în contul de dezvoltare.

În <project-name>/pipelines/inference, puteți vedea următoarele scripturi Python:

- scripts/lambda_helper.py – Extrage cea mai recentă versiune de model aprobată din contul de registru central al modelului utilizând un pas SageMaker Pipelines Lambda

- inference_pipeline.py – Conține codul pentru conducta de inferență a modelului

Urmați pașii următori:

- Încărcați scriptul în compartimentul S3:

- Obțineți instanța conductei de inferență utilizând setul de date lot normal:

- Trimiteți conducta de inferență și rulați-l:

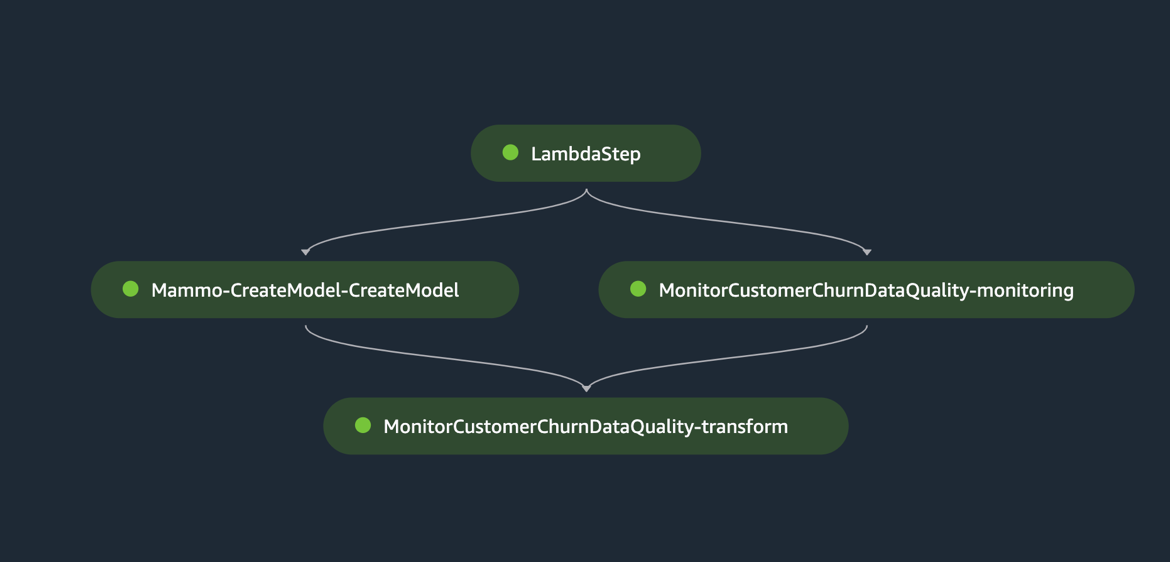

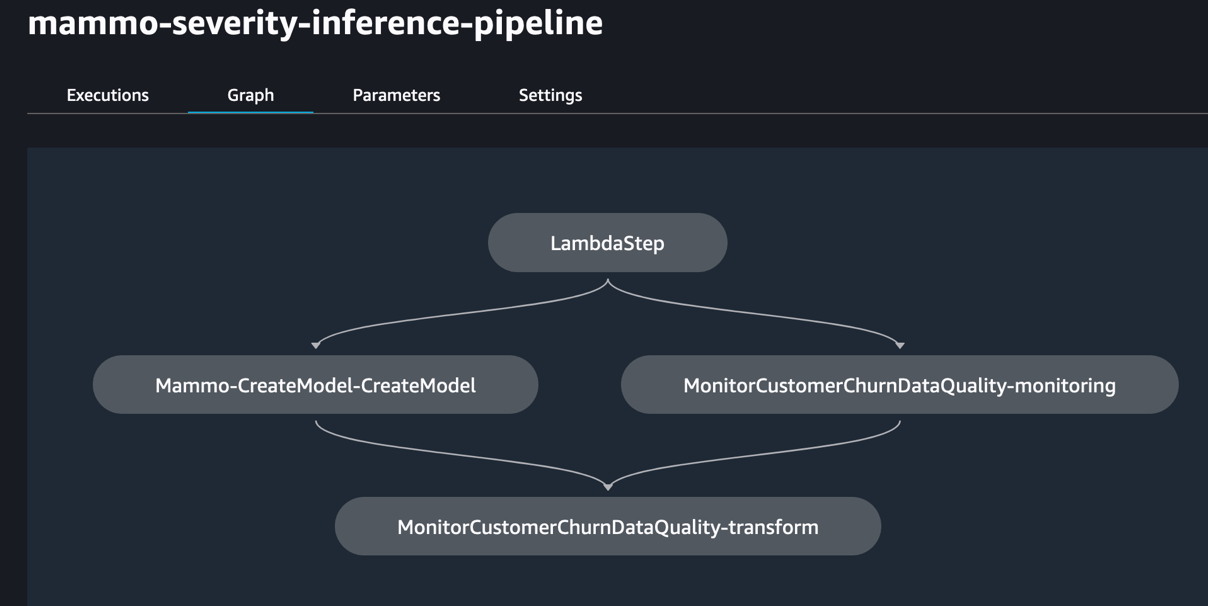

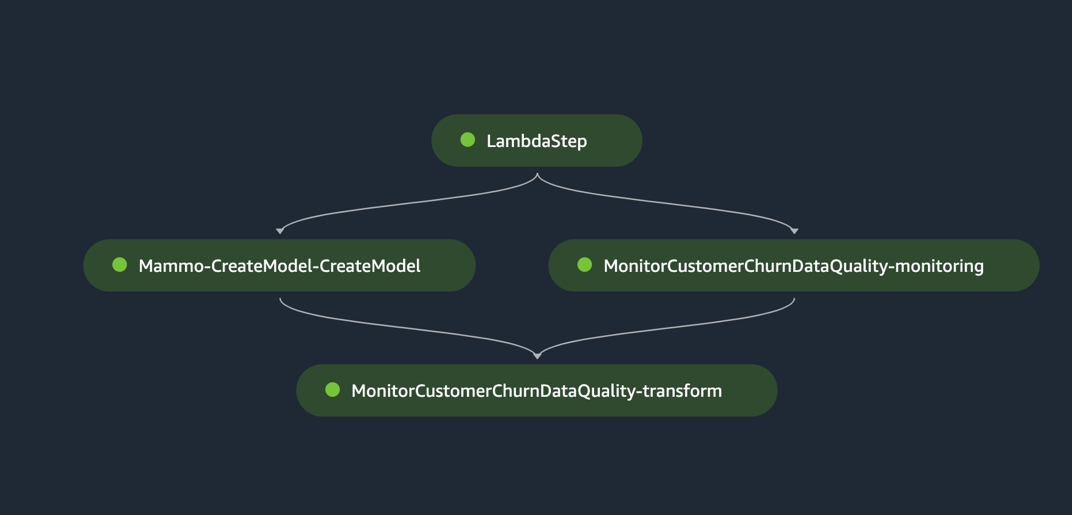

Figura următoare arată o rulare cu succes a conductei de inferență. Ultimul pas în conductă generează predicțiile și le stochează în bucket-ul S3. Folosim MonitorBatchTransformStep pentru a monitoriza intrările în jobul de transformare în lot. Dacă există valori aberante, conducta de inferență intră într-o stare eșuată.

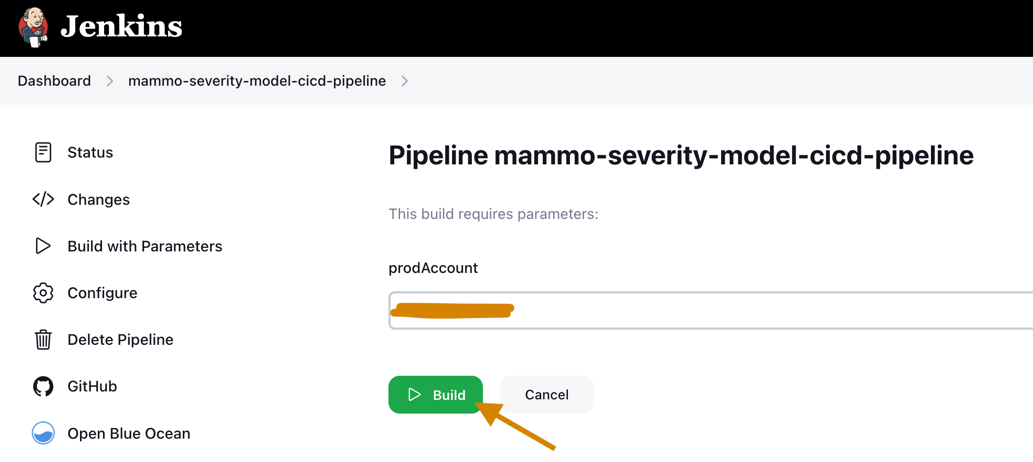

Rulați conducta Jenkins

environment/ folderul din depozitul GitHub conține scriptul de configurare pentru contul prod. Parcurgeți următorii pași pentru a declanșa conducta Jenkins:

- Actualizați scriptul de configurare

prod.tfvars.jsonpe baza resurselor create în pașii anteriori: - Odată actualizat, împingeți codul în depozitul GitHub bifurcat și îmbinați codul în ramura principală.

- Accesați interfața de utilizare Jenkins, alegeți Construiți cu parametri, și declanșează conducta CI/CD creată în pașii anteriori.

Când construirea este completă și reușită, vă puteți conecta la contul prod și puteți vedea conductele de tren și de inferență din domeniul SageMaker Studio.

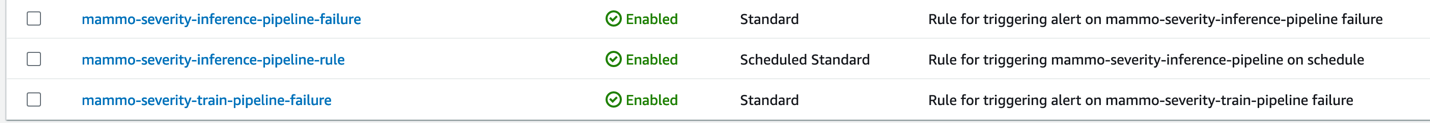

În plus, veți vedea trei reguli EventBridge pe consola EventBridge în contul de produs:

- Programați conducta de inferență

- Trimiteți o notificare de defecțiune pe conducta trenului

- Când conducta de inferență nu reușește să declanșeze conducta de tren, trimiteți o notificare

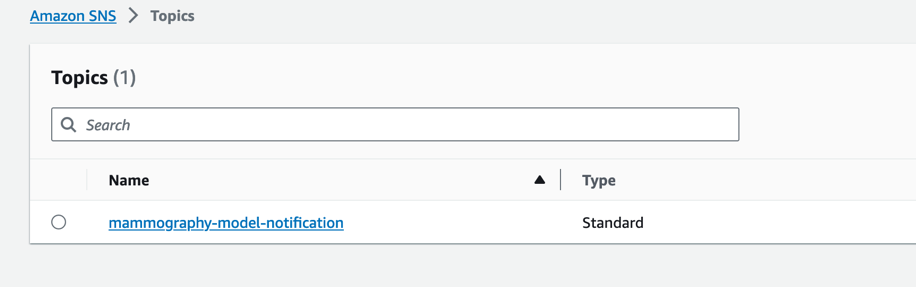

În cele din urmă, veți vedea un subiect de notificare SNS pe consola Amazon SNS care trimite notificări prin e-mail. Veți primi un e-mail care vă va cere să confirmați acceptarea acestor e-mailuri de notificare.

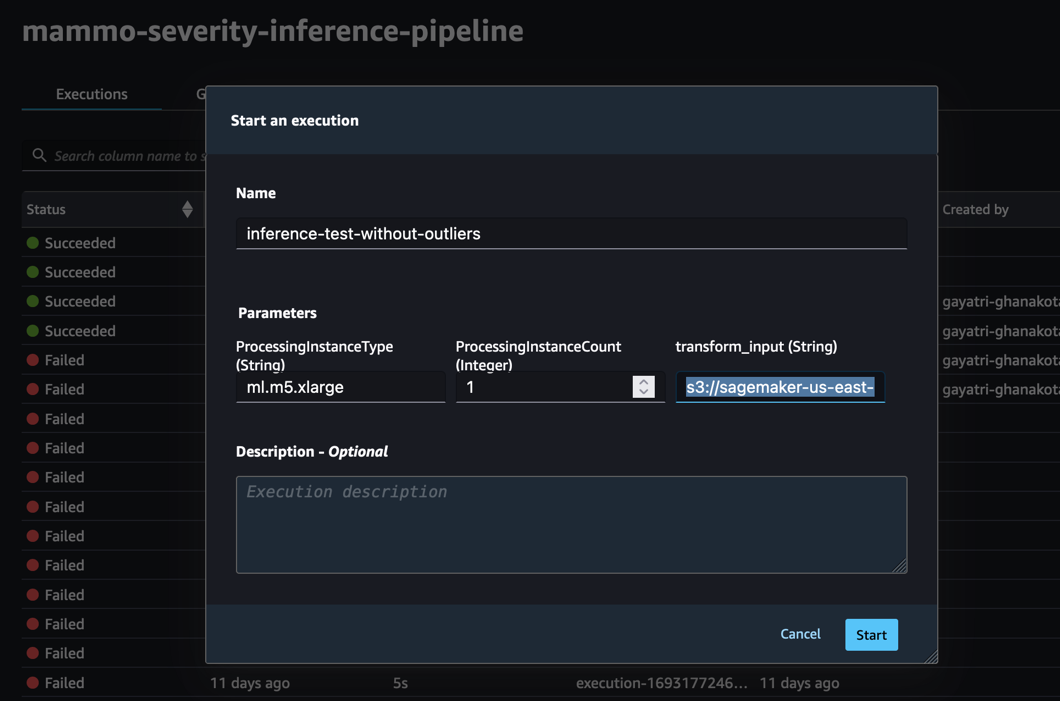

Testați conducta de inferență folosind un set de date lot fără valori aberante

Pentru a testa dacă conducta de inferență funcționează conform așteptărilor în contul de producție, ne putem conecta la contul de producție și de a declanșa conducta de inferență folosind setul de date lot fără valori aberante.

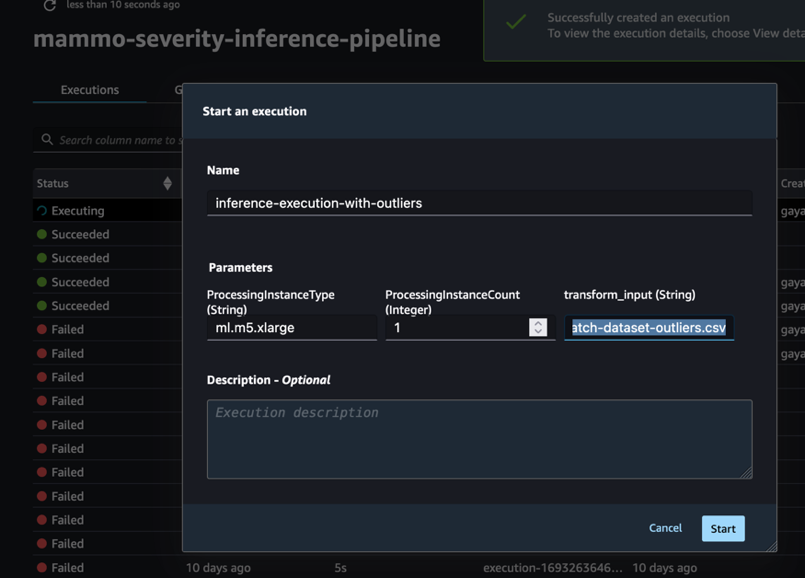

Rulați conducta prin consola SageMaker Pipelines în domeniul SageMaker Studio al contului de produs, unde transform_input va fi URI-ul S3 al setului de date fără valori aberante (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset.csv).

Conducta de inferență reușește și scrie predicțiile înapoi în compartimentul S3.

Testați conducta de inferență folosind un set de date lot cu valori aberante

Puteți rula conducta de inferență folosind setul de date lot cu valori aberante pentru a verifica dacă mecanismul de reinstruire automată funcționează conform așteptărilor.

Rulați conducta prin consola SageMaker Pipelines în domeniul SageMaker Studio al contului de produs, unde transform_input va fi URI-ul S3 al setului de date cu valori aberante (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset-outliers.csv).

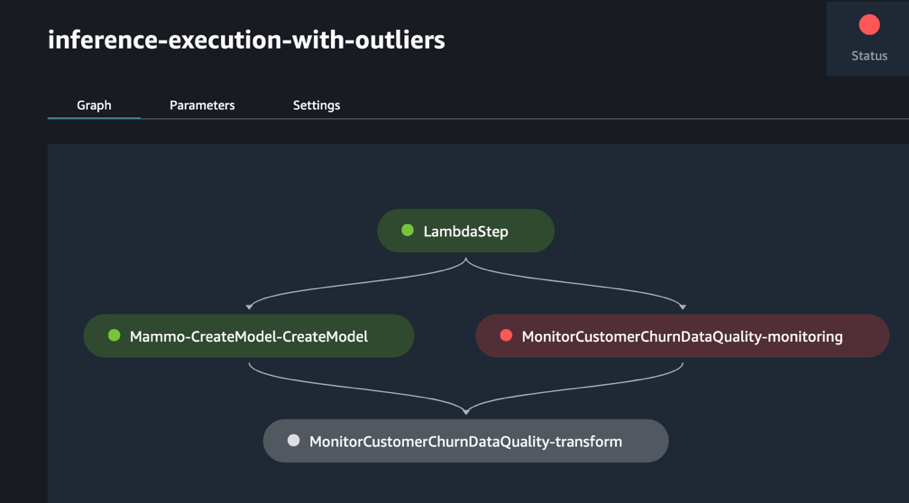

Conducta de inferență eșuează conform așteptărilor, ceea ce declanșează regula EventBridge, care la rândul său declanșează conducta trenului.

După câteva momente, ar trebui să vedeți o nouă rulare a conductei de tren pe consola SageMaker Pipelines, care preia cele două seturi diferite de date de tren (mammo-train-dataset-part1.csv și mammo-train-dataset-part2.csv) încărcat în găleata S3 pentru reantrenarea modelului.

Veți vedea, de asemenea, o notificare trimisă la e-mailul abonat la subiectul SNS.

Pentru a utiliza versiunea actualizată a modelului, conectați-vă la contul de registru central al modelului și aprobați versiunea modelului, care va fi preluată în timpul următoarei rulări a conductei de inferență declanșată prin regula EventBridge programată.

Deși conductele de tren și de inferență utilizează o adresă URL statică a setului de date, puteți transmite adresa URL a setului de date către conductele de tren și de inferență ca variabile dinamice pentru a utiliza seturi de date actualizate pentru a reanaliza modelul și a genera predicții într-un scenariu real.

A curăța

Pentru a evita costurile viitoare, parcurgeți următorii pași:

- Eliminați domeniul SageMaker Studio din toate conturile AWS.

- Ștergeți toate resursele create în afara SageMaker, inclusiv compartimentele S3, rolurile IAM, regulile EventBridge și subiectul SNS configurat prin Terraform în contul prod.

- Ștergeți conductele SageMaker create între conturi folosind Interfața liniei de comandă AWS (CLI AWS).

Concluzie

Organizațiile trebuie adesea să se alinieze cu seturile de instrumente la nivel de întreprindere pentru a permite colaborarea în diferite zone funcționale și echipe. Această colaborare asigură că platforma dvs. MLOps se poate adapta la nevoile de afaceri în evoluție și accelerează adoptarea ML între echipe. Această postare a explicat cum să creați un cadru MLOps într-o configurație multi-mediu pentru a permite reantrenarea automată a modelului, inferența în loturi și monitorizarea cu Amazon SageMaker Model Monitor, versiunea modelului cu SageMaker Model Registry și promovarea codului ML și a conductelor în medii cu un Conducta CI/CD. Am prezentat această soluție folosind o combinație de servicii AWS și seturi de instrumente terțe. Pentru instrucțiuni despre implementarea acestei soluții, consultați GitHub depozit. De asemenea, puteți extinde această soluție aducând propriile surse de date și cadre de modelare.

Despre Autori

Gayatri Ghanakota este inginer Sr. Machine Learning cu AWS Professional Services. Este pasionată de dezvoltarea, implementarea și explicarea soluțiilor AI/ML în diferite domenii. Înainte de acest rol, ea a condus mai multe inițiative ca cercetător de date și inginer ML cu firme globale de top din spațiul financiar și de retail. Ea deține o diplomă de master în Informatică specializată în Știința datelor de la Universitatea din Colorado, Boulder.

Gayatri Ghanakota este inginer Sr. Machine Learning cu AWS Professional Services. Este pasionată de dezvoltarea, implementarea și explicarea soluțiilor AI/ML în diferite domenii. Înainte de acest rol, ea a condus mai multe inițiative ca cercetător de date și inginer ML cu firme globale de top din spațiul financiar și de retail. Ea deține o diplomă de master în Informatică specializată în Știința datelor de la Universitatea din Colorado, Boulder.

Sunita Koppar este un arhitect Sr. Data Lake cu AWS Professional Services. Este pasionată de rezolvarea punctelor dureroase ale clienților care prelucrează date mari și oferă soluții scalabile pe termen lung. Înainte de acest rol, ea a dezvoltat produse în domeniile internet, telecomunicații și auto și a fost client AWS. Ea deține o diplomă de master în Știința datelor de la Universitatea din California, Riverside.

Sunita Koppar este un arhitect Sr. Data Lake cu AWS Professional Services. Este pasionată de rezolvarea punctelor dureroase ale clienților care prelucrează date mari și oferă soluții scalabile pe termen lung. Înainte de acest rol, ea a dezvoltat produse în domeniile internet, telecomunicații și auto și a fost client AWS. Ea deține o diplomă de master în Știința datelor de la Universitatea din California, Riverside.

Saswata Dash este consultant DevOps cu AWS Professional Services. Ea a lucrat cu clienți din domeniul sănătății și științele vieții, aviație și producție. Este pasionată de toate aspectele legate de automatizare și are o experiență cuprinzătoare în proiectarea și construirea de soluții pentru clienți la scară întreprindere în AWS. În afara serviciului, își urmărește pasiunea pentru fotografie și surprinderea răsăritului.

Saswata Dash este consultant DevOps cu AWS Professional Services. Ea a lucrat cu clienți din domeniul sănătății și științele vieții, aviație și producție. Este pasionată de toate aspectele legate de automatizare și are o experiență cuprinzătoare în proiectarea și construirea de soluții pentru clienți la scară întreprindere în AWS. În afara serviciului, își urmărește pasiunea pentru fotografie și surprinderea răsăritului.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/promote-pipelines-in-a-multi-environment-setup-using-amazon-sagemaker-model-registry-hashicorp-terraform-github-and-jenkins-ci-cd/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 16

- 17

- 19

- 23

- 27

- 31

- 320

- 7

- 8

- 9

- a

- Despre Noi

- Accelerează

- acceptare

- acces

- Cont

- Conturi

- peste

- Acțiune

- adapta

- adăuga

- adresa

- administrativ

- Adoptare

- După

- vârstă

- AI

- alinia

- TOATE

- permite

- permite

- de-a lungul

- de asemenea

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- și

- O alta

- Orice

- aplicație

- adecvat

- aproba

- aprobat

- arhitectură

- SUNT

- domenii

- în jurul

- artificial

- inteligență artificială

- Inteligența artificială (AI)

- AS

- solicitând

- asociate

- asuma

- atașa

- Auto

- Automata

- Automat

- Automatizare

- auto

- disponibil

- aviaţie

- evita

- AWS

- Client AWS

- Servicii profesionale AWS

- înapoi

- bazat

- bază

- BE

- deoarece

- fost

- înainte

- fiind

- CEL MAI BUN

- Cele mai bune practici

- între

- Mare

- Datele mari

- atât

- Branch firma

- punte

- Aducere

- construi

- Clădire

- construit

- afaceri

- dar

- by

- calcul

- California

- denumit

- CAN

- caz

- central

- Schimbare

- si-a schimbat hainele;

- Modificări

- taxe

- verifica

- alegere

- Alege

- cod

- colaborare

- colecta

- Colorado

- Coloană

- Coloane

- COM

- combinaţie

- Completă

- conformitate

- componente

- cuprinzător

- calculator

- Informatică

- condiție

- Configuraţie

- Confirma

- Consoleze

- consultant

- Recipient

- conține

- Control

- Convenție

- converti

- Corespunzător

- crea

- a creat

- Crearea

- scrisori de acreditare

- Trece

- client

- Soluții pentru clienți

- clienţii care

- zilnic

- tablou de bord

- de date

- Lacul de date

- știința datelor

- om de știință de date

- seturi de date

- decriptaţi

- Mod implicit

- Grad

- implementa

- Implementarea

- desfășurarea

- implementează

- proiect

- detalii

- detecta

- detectat

- dev

- dezvoltat

- în curs de dezvoltare

- Dezvoltare

- DICT

- diferit

- domeniu

- domenii

- în timpul

- dinamic

- fiecare

- Mai devreme

- efect

- oricare

- e-mailuri

- permite

- criptate

- inginer

- asigură

- Intrați

- Mediu inconjurator

- medii

- esenţial

- evenimente

- evoluție

- execuție

- de aşteptat

- experienţă

- a explicat

- explicând

- extinde

- facilita

- FAIL

- A eșuat

- eșuează

- Eșec

- Caracteristică

- DESCRIERE

- puțini

- Figura

- Fișier

- final

- financiar

- termina

- firme

- First

- prima dată

- următor

- Pentru

- găsit

- Cadru

- cadre

- din

- Îndeplini

- Complet

- funcţie

- funcțional

- viitor

- decalaj

- genera

- generată

- generează

- obține

- merge

- GitHub

- Da

- dat

- oferă

- Caritate

- Go

- Merge

- subvenții

- grup

- Avea

- de asistență medicală

- ei

- superior

- deține

- găzduire

- Cum

- Cum Pentru a

- HTML

- http

- HTTPS

- ID

- Identitate

- if

- Punere în aplicare a

- import

- in

- include

- Inclusiv

- index

- Infrastructură

- inițial

- inițiative

- intrări

- instala

- instalat

- instanță

- instrucțiuni

- integreaza

- Inteligență

- Internet

- în

- introduce

- IT

- Loc de munca

- Locuri de munca

- jpg

- JSON

- Cheie

- chei

- Etichetă

- lac

- peisaj

- mai tarziu

- Ultimele

- învăţare

- Led

- efectul de levier

- Viaţă

- Life Sciences

- Linie

- log

- pe termen lung

- maşină

- masina de învățare

- Principal

- menține

- face

- gestionate

- administrare

- de fabricaţie

- Margine

- Masa

- studii de masterat

- mecanism

- Reuniunea

- Meniu

- Îmbina

- Metrici

- dispărut

- ML

- MLOps

- model

- modelare

- Modele

- modifica

- Module

- Momente

- monitor

- monitorizate

- Monitorizarea

- mai mult

- multiplu

- nume

- Numit

- denumire

- Navigare

- Nevoie

- necesar

- nevoilor

- Nou

- următor

- normală.

- caiet

- notificare

- notificări

- număr

- NumPy

- of

- de multe ori

- on

- ONE

- Operațiuni

- or

- comandă

- organizații

- Altele

- afară

- exterior

- peste

- Prezentare generală

- propriu

- pachet

- pagină

- Durere

- panda

- pâine

- parte

- piese

- Trecut

- pasiune

- pasionat

- Model

- performanță

- permisiuni

- fotografie

- ales

- Alegerea

- conducte

- platformă

- Plato

- Informații despre date Platon

- PlatoData

- puncte

- Politicile

- Politica

- Post

- practicile

- prezice

- Predictii

- Pregăti

- premise

- precedent

- Principal

- anterior

- privilegii

- proces

- prelucrare

- producere

- Produse

- profesional

- proiect

- promova

- Promovat

- de promovare

- furniza

- prevăzut

- furnizează

- furnizarea

- dispoziţie

- public

- Trage

- Urmărește

- Împinge

- Piton

- repede

- repede

- Crud

- Citeste

- gata

- lumea reală

- regiune

- Inregistreaza-te

- înregistrată

- registre

- registru

- autoritățile de reglementare

- legate de

- relaţie

- scoate

- depozit

- solicita

- necesar

- Cerinţe

- resursă

- Resurse

- răspuns

- cu amănuntul

- reveni

- Riverside

- Rol

- rolurile

- rădăcină

- Regula

- norme

- Alerga

- ruleaza

- sagemaker

- Conducte SageMaker

- acelaşi

- Economisiți

- salvate

- scalabil

- scenariu

- programa

- programată

- programare

- Ştiinţă

- ȘTIINȚE

- Om de stiinta

- scenariu

- script-uri

- perfect

- Al doilea

- Secțiune

- sigur

- securitate

- vedea

- trimite

- trimitere

- trimite

- trimis

- distinct

- serverul

- serviciu

- Servicii

- set

- setări

- configurarea

- Modela

- Distribuie

- ea

- să

- Arăta

- a prezentat

- indicat

- Emisiuni

- simplu

- fragment

- So

- soluţie

- soluţii

- Rezolvarea

- Sursă

- Surse

- Spaţiu

- de specialitate

- specific

- împărţi

- Stat

- Declarație

- static

- Stare

- Pas

- paşi

- Încă

- stoca

- stocate

- magazine

- Şir

- structura

- studio

- de succes

- astfel de

- Sprijină

- Ţintă

- echipe

- telecom

- Terraform

- test

- Testarea

- acea

- Lor

- apoi

- Acolo.

- Acestea

- lucruri

- Al treilea

- terț

- acest

- trei

- Prin

- timp

- la

- seturi de instrumente

- top

- subiect

- urmări

- Tren

- dresat

- Pregătire

- Transforma

- declanşa

- a declanșat

- declanșând

- adevărat

- Încredere

- ÎNTORCĂ

- Două

- ui

- în

- universitate

- Universitatea din California

- Actualizează

- actualizat

- încărcat

- URL-ul

- us

- utilizare

- utilizat

- folosind

- utilitate

- Valori

- diverse

- versiune

- Versiunile

- de

- Video

- vizibil

- Ceas

- we

- web

- servicii web

- cand

- oricând

- întrucât

- care

- în timp ce

- voi

- cu

- în

- fără

- Apartamente

- a lucrat

- flux de lucru

- de lucru

- fabrică

- scrie

- scris

- Tu

- Ta

- youtube

- zephyrnet