- Ianuarie 20, 2014

- Vasilis Vryniotis

- . 5 comentarii

În clasificarea textului, selecția caracteristicilor este procesul de selectare a unui anumit subset al termenilor setului de antrenament și de utilizare numai a acestora în algoritmul de clasificare. Procesul de selecție a caracteristicilor are loc înainte de antrenamentul clasificatorului.

Actualizare: Datumbox Machine Learning Framework este acum open-source și gratuit Descarca. Consultați pachetul com.datumbox.framework.machinelearning.featureselection pentru a vedea implementarea metodelor Chi-pătrat și Mutual Information Feature Selection în Java.

Principalele avantaje ale utilizării algoritmilor de selecție a caracteristicilor sunt faptul că reduce dimensiunea datelor noastre, face antrenamentul mai rapid și poate îmbunătăți acuratețea prin eliminarea caracteristicilor zgomotoase. În consecință, selecția caracteristicilor ne poate ajuta să evităm supraadaptarea.

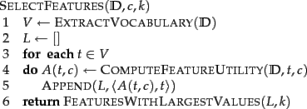

Algoritmul de selecție de bază pentru selectarea celor mai bune k caracteristici este prezentat mai jos (Manning și colab., 2008):

În secțiunile următoare prezentăm doi algoritmi diferiți de selecție a caracteristicilor: Informația reciprocă și Pătratul Chi.

Informații reciproce

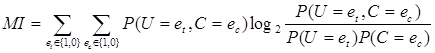

Una dintre cele mai comune metode de selecție a caracteristicilor este Informația reciprocă a termenului t din clasa c (Manning și colab., 2008). Aceasta măsoară câte informații contribuie prezența sau absența unui anumit termen la luarea deciziei corecte de clasificare pe c. Informația reciprocă poate fi calculată folosind următoarea formulă:

[1]

[1]

În calculele noastre, deoarece folosim estimările de probabilitate maximă ale probabilităților, putem folosi următoarea ecuație:

![]() [2]

[2]

Unde N este numărul total de documente, Ntcsunt numărul documentelor care au valorile et (apariția termenului t în document; acesta ia valoarea 1 sau 0) și ec(apariția documentului în clasa c; ia valoarea 1 sau 0) care este indicată prin două indice, ![]() și

și ![]() . În sfârșit, trebuie să remarcăm că toate variabilele menționate mai sus iau valori nenegative.

. În sfârșit, trebuie să remarcăm că toate variabilele menționate mai sus iau valori nenegative.

Piața Chi

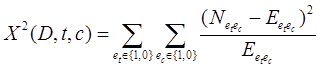

O altă metodă comună de selecție a caracteristicilor este Piața Chi. X2 testul este folosit în statistică, printre altele, pentru a testa independența a două evenimente. Mai precis, în selecția caracteristicilor, îl folosim pentru a testa dacă apariția unui anumit termen și apariția unei clase specifice sunt independente. Astfel, estimăm următoarea cantitate pentru fiecare termen și le clasificăm după punctajul lor:

[3]

[3]

Scoruri mari pe x2 indică faptul că ipoteza nulă (H0) de independență ar trebui respinsă și astfel că apariția termenului și a clasei sunt dependente. Dacă sunt dependenți, atunci selectăm caracteristica pentru clasificarea textului.

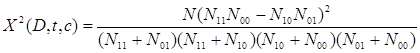

Formula de mai sus poate fi rescrisă după cum urmează:

[4]

[4]

Dacă folosim metoda Chi Square, ar trebui să selectăm doar un număr predefinit de caracteristici care au ax2 scorul testului mai mare de 10.83, ceea ce indică o semnificație statistică la nivelul 0.001.

Nu în ultimul rând, trebuie să remarcăm că, din punct de vedere statistic, selecția caracteristicii Chi Square este inexactă, datorită unui singur grad de libertate și corectare Yates ar trebui folosit în schimb (ceea ce va îngreuna atingerea semnificației statistice). Astfel, ar trebui să ne așteptăm ca din totalul caracteristicilor selectate, o mică parte dintre ele să fie independente de clasă). Prin urmare, ar trebui să ne așteptăm ca din totalul caracteristicilor selectate, o mică parte dintre ele să fie independente de clasă. Cu toate acestea ca Manning și colab. (2008) a arătat, aceste caracteristici zgomotoase nu afectează în mod serios precizia generală a clasificatorului nostru.

Eliminarea caracteristicilor zgomotoase/rare

O altă tehnică care ne poate ajuta să evităm supraadaptarea, să reducem consumul de memorie și să îmbunătățim viteza, este eliminarea tuturor termenilor rari din vocabular. De exemplu, se pot elimina toți termenii care au apărut o singură dată în toate categoriile. Eliminarea acelor termeni poate reduce utilizarea memoriei cu un factor semnificativ și poate îmbunătăți viteza analizei. În cele din urmă, nu ar trebui că această tehnică poate fi utilizată împreună cu algoritmii de selecție a caracteristicilor de mai sus.

Ți-a plăcut articolul? Vă rugăm să luați un minut pentru a-l împărtăși pe Twitter. 🙂

- AI

- ai art

- ai art generator

- ai robot

- inteligență artificială

- certificare de inteligență artificială

- robot cu inteligență artificială

- roboți cu inteligență artificială

- software de inteligență artificială

- blockchain

- conferință blockchain ai

- coingenius

- inteligența artificială conversațională

- criptoconferință ai

- dall-e

- Datumbox

- învățare profundă

- google ai

- masina de învățare

- Învățare automată și statistici

- Plato

- platoul ai

- Informații despre date Platon

- Jocul lui Platon

- PlatoData

- platogaming

- scara ai

- sintaxă

- zephyrnet