Предприятия стремятся быстро раскрыть потенциал генеративного искусственного интеллекта, предоставляя доступ к базовым моделям (FM) различным направлениям бизнеса (LOB). ИТ-команды отвечают за то, чтобы помочь бизнес-подразделениям внедрять инновации быстро и гибко, обеспечивая при этом централизованное управление и наблюдаемость. Например, им может потребоваться отслеживать использование FM в разных командах, затраты на возврат средств и обеспечивать видимость соответствующего центра затрат в LOB. Кроме того, им может потребоваться регулировать доступ к различным моделям для каждой команды. Например, если только определенные FM могут быть одобрены для использования.

Коренная порода Амазонки — это полностью управляемый сервис, который предлагает выбор высокопроизводительных базовых моделей от ведущих компаний в области ИИ, таких как AI21 Labs, Anthropic, Cohere, Meta, Stability AI и Amazon, через единый API, а также широкий набор возможностей для создания генеративного ИИ. приложения с безопасностью, конфиденциальностью и ответственным искусственным интеллектом. Поскольку Amazon Bedrock является бессерверным, вам не нужно управлять какой-либо инфраструктурой, и вы можете безопасно интегрировать и развернуть возможности генеративного искусственного интеллекта в своих приложениях, используя уже знакомые вам сервисы AWS.

Уровень программного обеспечения как услуги (SaaS) для базовых моделей может обеспечить простой и согласованный интерфейс для конечных пользователей, сохраняя при этом централизованное управление доступом и потреблением. Шлюзы API могут обеспечить слабую связь между потребителями модели и службой конечной точки модели, а также гибкость для адаптации к изменяющейся модели, архитектуре и методам вызова.

В этом посте мы покажем, как создать внутренний уровень SaaS для доступа к базовым моделям с помощью Amazon Bedrock в многоарендной (командной) архитектуре. Мы уделяем особое внимание отслеживанию использования и затрат для каждого арендатора, а также таким элементам управления, как регулирование использования для каждого арендатора. Мы описываем, как решение и планы использования Amazon Bedrock соотносятся с общей структурой пути SaaS. Код решения и Комплект для разработки облачных сервисов AWS (AWS CDK) шаблон доступен в Репозиторий GitHub.

Вызовы

Администратору платформы искусственного интеллекта необходимо предоставить стандартизированный и простой доступ к FM нескольким командам разработчиков.

Ниже приведены некоторые проблемы, связанные с обеспечением регулируемого доступа к базовым моделям:

- Отслеживание затрат и использования – Отслеживайте и проверяйте затраты отдельных арендаторов и использование базовых моделей, а также предоставляйте возмещение затрат конкретным центрам затрат.

- Контроль бюджета и использования – Управление квотами API, бюджетом и ограничениями на использование для разрешенного использования базовых моделей с определенной частотой для каждого арендатора.

- Контроль доступа и управление моделями – Определить элементы управления доступом для конкретных разрешенных моделей для каждого арендатора.

- Мультитенантный стандартизированный API – Обеспечить последовательный доступ к моделям фундамента с помощью OpenAPI стандартов

- Централизованное управление API – Обеспечить единый уровень для управления ключами API для доступа к моделям.

- Версии модели и обновления – Обрабатывать новые и обновленные версии моделей.

Обзор решения

В этом решении мы имеем в виду многоквартирные дома подход. А арендатор Здесь может варьироваться от отдельного пользователя до конкретного проекта, команды или даже целого отдела. Обсуждая этот подход, мы используем термин команда, потому что это самое распространенное. Мы используем ключи API для ограничения и мониторинга доступа к API для команд. Каждой команде присваивается API-ключ для доступа к FM. В организации могут быть использованы различные механизмы аутентификации и авторизации пользователей. Для простоты мы не включаем их в это решение. Вы также можете интегрировать существующих поставщиков удостоверений с этим решением.

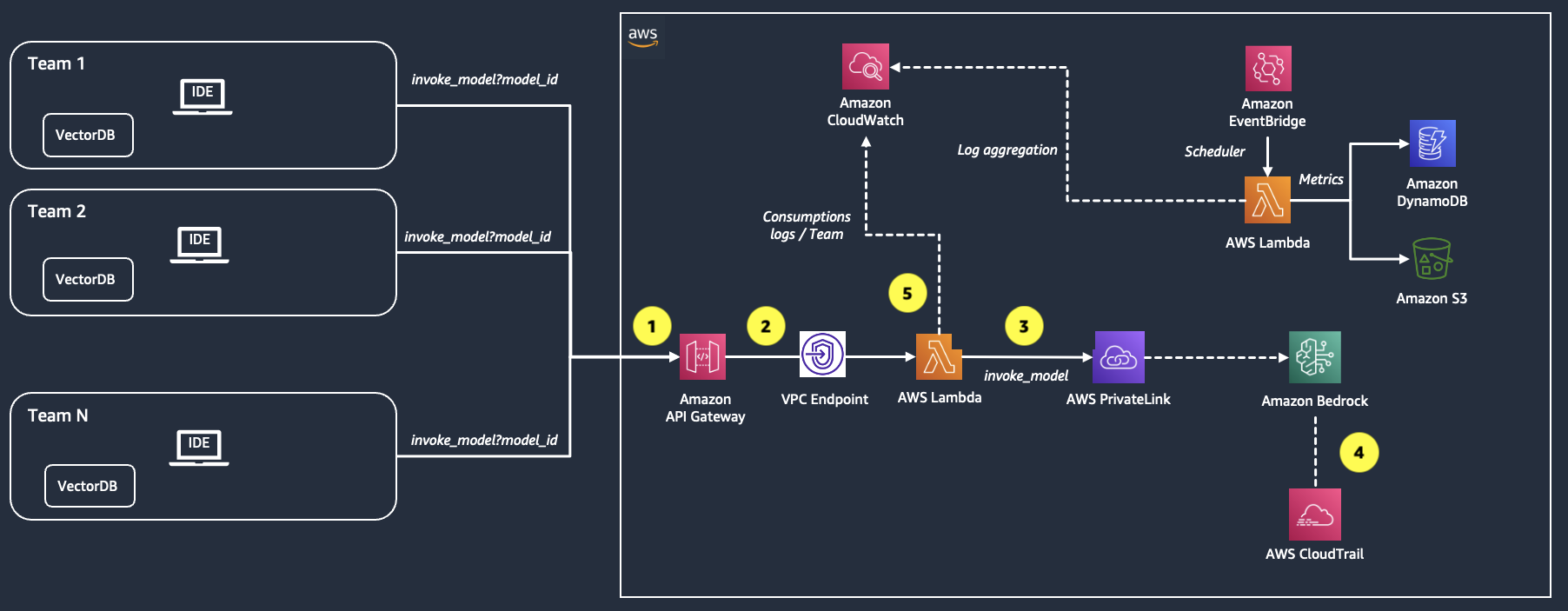

На следующей диаграмме обобщена архитектура решения и ключевые компоненты. Команды (арендаторы), закрепленные за отдельными центрами затрат, используют Amazon Bedrock FM через службу API. Чтобы отслеживать потребление и затраты на команду, решение регистрирует данные для каждого отдельного вызова, включая вызванную модель, количество токенов для моделей генерации текста и размеры изображения для мультимодальных моделей. Кроме того, он агрегирует вызовы каждой модели и затраты каждой команды.

![]()

Вы можете развернуть решение в своей учетной записи с помощью AWS CDK. AWS CDK — это среда разработки программного обеспечения с открытым исходным кодом, предназначенная для моделирования и предоставления ресурсов облачных приложений с использованием знакомых языков программирования. Код AWS CDK доступен в Репозиторий GitHub.

В следующих разделах мы более подробно обсудим ключевые компоненты решения.

Регистрация использования базовой модели каждой командой

Рабочий процесс регистрации использования FM каждой командой состоит из следующих шагов (нумерация которых указана на предыдущей диаграмме):

- Приложение группы отправляет POST-запрос на Шлюз API Amazon с моделью, которая будет вызываться в

model_idпараметр запроса и приглашение пользователя в теле запроса. - API-шлюз направляет запрос на AWS Lambda функции (

bedrock_invoke_model), который отвечает за регистрацию информации об использовании команды в Amazon CloudWatch и использование модели Amazon Bedrock. - Amazon Bedrock предоставляет конечную точку VPC на базе Приватная ссылка AWS. В этом решении функция Lambda отправляет запрос в Amazon Bedrock с помощью PrivateLink, чтобы установить частное соединение между VPC в вашей учетной записи и учетной записью службы Amazon Bedrock. Чтобы узнать больше о PrivateLink, см. Используйте AWS PrivateLink для настройки частного доступа к Amazon Bedrock..

- После призыва к Амазонской Коренной породе, Amazon CloudTrail генерирует Событие CloudTrail.

- Если вызов Amazon Bedrock успешен, функция Lambda регистрирует следующую информацию в зависимости от типа вызванной модели и возвращает сгенерированный ответ приложению:

- идентификатор команды – Уникальный идентификатор команды, отправившей запрос.

- идентификатор запроса – Уникальный идентификатор запроса.

- model_id – Идентификатор вызываемой модели.

- входные токены – Количество токенов, отправленных в модель как часть подсказки (для моделей генерации текста и встраивания).

- выходные токены – Максимальное количество токенов, которые будет сгенерировано моделью (для моделей генерации текста).

- высота – Высота запрошенного изображения (для мультимодальных моделей и моделей мультимодальных вложений).

- ширина – Ширина запрошенного изображения (только для мультимодальных моделей).

- шага – Запрошенные шаги (для моделей Stability AI).

Отслеживание затрат на команду

Другой поток объединяет информацию об использовании, затем ежедневно рассчитывает и сохраняет затраты по запросу на каждую команду. Имея отдельный поток, мы гарантируем, что отслеживание затрат не повлияет на задержку и пропускную способность потока вызова модели. Этапы рабочего процесса следующие:

- An Amazon EventBridge правило запускает лямбда-функцию (

bedrock_cost_tracking) повседневная. - Функция Lambda получает информацию об использовании CloudWatch за предыдущий день, рассчитывает соответствующие затраты и сохраняет данные, агрегированные по

team_idиmodel_idin Простой сервис хранения Amazon (Amazon S3) в формате CSV.

Для запроса и визуализации данных, хранящихся в Amazon S3, у вас есть различные варианты, в том числе S3 Выберитеи Amazon Athena и Amazon QuickSight.

Контроль использования для каждой команды

План использования определяет, кто может получить доступ к одному или нескольким развернутым API, и при необходимости устанавливает целевую частоту запросов, чтобы начать регулирование запросов. В плане используются ключи API для идентификации клиентов API, которые могут получить доступ к связанному API для каждого ключа. Вы можете использовать API-шлюз планы использования для регулирования запросов, которые превышают заранее определенные пороговые значения. Вы также можете использовать API ключи и ограничения квот, которые позволяют вам установить максимальное количество запросов на один ключ API, который каждой команде разрешено выдавать в течение определенного интервала времени. Это в дополнение к Квоты на услуги Amazon Bedrock которые назначаются только на уровне аккаунта.

Предпосылки

Прежде чем развертывать решение, убедитесь, что у вас есть следующее:

Разверните стек AWS CDK

Следуйте инструкциям в README файл репозитория GitHub для настройки и развертывания стека AWS CDK.

Стек развертывает следующие ресурсы:

- Частная сетевая среда (VPC, частные подсети, группа безопасности)

- Роль IAM для управления доступом к модели

- Лямбда-слои для необходимых модулей Python

- Лямбда-функция

invoke_model - Лямбда-функция

list_foundation_models - Лямбда-функция

cost_tracking - Rest API (API-шлюз)

- План использования API-шлюза

- Ключ API, связанный с планом использования

На борту новая команда

Чтобы предоставить доступ новым командам, вы можете использовать один и тот же ключ API для разных команд и отслеживать использование модели, предоставляя разные team_id для вызова API или создайте выделенные ключи API, используемые для доступа к ресурсам Amazon Bedrock, следуя инструкциям, приведенным в README.

Стек развертывает следующие ресурсы:

- План использования API-шлюза, связанный с ранее созданным REST API.

- Ключ API, связанный с планом использования для новой команды, с зарезервированными настройками регулирования и пакетной передачи для API.

Дополнительную информацию о регулировании шлюза API и пакетных конфигурациях см. Регулирование запросов API для повышения пропускной способности.

После развертывания стека вы увидите, что новый ключ API для team-2 также создается.

![]()

Настройка контроля доступа к модели

Администратор платформы может разрешить доступ к определенным моделям фундамента, отредактировав политику IAM, связанную с функцией Lambda. invoke_model,

Разрешения IAM определены в файле настройка/stack_constructs/iam.py, Смотрите следующий код:

Вызов службы

После развертывания решения вы можете вызвать службу непосредственно из своего кода. Следующее

это пример на Python для использования invoke_model API для генерации текста через POST-запрос:

Результат: Amazon Bedrock — это внутренняя технологическая платформа, разработанная Amazon для запуска и эксплуатации многих своих услуг и продуктов. Несколько ключевых моментов о Bedrock…

Ниже приведен еще один пример использования Python. invoke_model API для генерации вложений через POST-запрос:

model_id = "amazon.titan-embed-text-v1" #the model id for the Amazon Titan Embeddings Text model prompt = "What is Amazon Bedrock?" response = requests.post( f"{api_url}/invoke_model?model_id={model_id}", json={"inputs": prompt, "parameters": model_kwargs}, headers={ "x-api-key": api_key, #key for querying the API "team_id": team_id #unique tenant identifier, "embeddings": "true" #boolean value for the embeddings model }

) text = response.json()[0]["embedding"]

Выход: 0.91796875, 0.45117188, 0.52734375, -0.18652344, 0.06982422, 0.65234375, -0.13085938, 0.056884766, 0.092285156, 0.06982422, 1.03125, 0.8515625, 0.16308594, 0.079589844, -0.033935547, 0.796875, -0.15429688, -0.29882812, -0.25585938, 0.45703125, 0.044921875 0.34570312, XNUMX …

Доступ запрещен к моделям фундамента

Ниже приведен пример на Python для использования invoke_model API для генерации текста через POST-запрос с ответом об отказе в доступе:

«Traceback (последний вызов): n Файл ”/var/task/index.py», строка 213, в лямбда_handlern ответ = _invoke_text(bedrock_client, model_id, body, model_kwargs)n Файл ”/var/task/index.py », строка 146, в _invoke_textn поднять en File ”/var/task/index.py”, строка 131, в _invoke_textn response = bedrock_client.invoke_model(n File ”/opt/python/botocore/client.py”, строка 535, в _api_calln верните self._make_api_call(operation_name, kwargs)n File ”/opt/python/botocore/client.py”, строка 980, в _make_api_calln вызовите error_class(parsed_response, Operation_name)nbotocore.errorfactory.AccessDeniedException: Произошла ошибка (AccessDeniedException) при вызове операции InvokeModel: ваша учетная запись не авторизована для вызова этой операции API.n»

Пример расчета стоимости

При вызове моделей Amazon Bedrock с ценообразованием по требованию общая стоимость рассчитывается как сумма входных и выходных затрат. Входные затраты основаны на количестве входных токенов, отправленных в модель, а выходные затраты основаны на сгенерированных токенах. Цены указаны за 1,000 входных токенов и за 1,000 выходных токенов. Более подробную информацию и цены на конкретные модели см. Цены на Amazon Bedrock.

Давайте рассмотрим пример, когда две команды, команда 1 и команда 2, получают доступ к Amazon Bedrock с помощью решения, представленного в этом посте. Данные об использовании и расходах, сохраненные в Amazon S3 за один день, показаны в следующей таблице.

Колонны input_tokens и output_tokens хранить общее количество входных и выходных токенов при вызовах модели для каждой модели и для каждой команды соответственно за определенный день.

Колонны input_cost и output_cost сохраните соответствующие затраты на модель и на команду. Они рассчитываются по следующим формулам:

input_cost = input_token_count * model_pricing["input_cost"] / 1000output_cost = output_token_count * model_pricing["output_cost"] / 1000

| идентификатор команды | model_id | input_tokens | выходные_токены | вызовы | входная_стоимость | выходная_стоимость |

| Team1 | amazon.titan-tg1-large | 24000 | 2473 | 1000 | 0.0072 | 0.00099 |

| Team1 | антропный.claude-v2 | 2448 | 4800 | 24 | 0.02698 | 0.15686 |

| Team2 | amazon.titan-tg1-large | 35000 | 52500 | 350 | 0.0105 | 0.021 |

| Team2 | ai21.j2-большая инструкция | 4590 | 9000 | 45 | 0.05738 | 0.1125 |

| Team2 | антропный.claude-v2 | 1080 | 4400 | 20 | 0.0119 | 0.14379 |

Комплексное представление функциональной мультитенантной бессерверной среды SaaS

Давайте разберемся, как может выглядеть комплексная функциональная многопользовательская бессерверная среда SaaS. Ниже приведена эталонная схема архитектуры.

![]()

Эта диаграмма архитектуры представляет собой уменьшенную версию предыдущей диаграммы архитектуры, описанной ранее в статье, где предыдущая диаграмма архитектуры объясняет детали одного из упомянутых микросервисов (сервис базовой модели). На этой схеме показано, что помимо службы базовой модели вам необходимо иметь и другие компоненты на вашей мультитенантной платформе SaaS для реализации функциональной и масштабируемой платформы.

Давайте пройдемся по деталям архитектуры.

Заявки арендаторов

Приложения-клиенты — это интерфейсные приложения, которые взаимодействуют со средой. Здесь мы показываем доступ нескольких арендаторов из разных локальных сред или сред AWS. Интерфейсные приложения можно расширить, включив в них страницу регистрации для новых арендаторов и консоль администратора для администраторов уровня обслуживания SaaS. Если приложениям-клиентам требуется реализация пользовательской логики, требующей взаимодействия со средой SaaS, они могут реализовать спецификации микрослужбы адаптера приложения. Примером сценария может быть добавление пользовательской логики авторизации с соблюдением спецификаций авторизации среды SaaS.

Общие услуги

Ниже приведены общие службы:

- Услуги по управлению арендаторами и пользователями –Эти службы отвечают за регистрацию и управление арендаторами. Они предоставляют сквозную функциональность, отдельную от служб приложений и используемую всеми арендаторами.

- Модельный сервис Foundation – Диаграмма архитектуры решения, описанная в начале этого поста, представляет этот микросервис, где взаимодействие API-шлюза с функциями Lambda происходит в рамках этого микросервиса. Все арендаторы используют этот микросервис для вызова базовых моделей Anthropic, AI21, Cohere, Stability, Meta и Amazon, а также точно настроенных моделей. Он также собирает информацию, необходимую для отслеживания использования, в журналах CloudWatch.

- Сервис отслеживания затрат –Эта услуга отслеживает стоимость и использование для каждого арендатора. Этот микросервис запускается по расписанию, запрашивая журналы CloudWatch и выводя совокупные данные отслеживания использования и предполагаемые затраты в хранилище данных. Службу отслеживания затрат можно расширить для создания дополнительных отчетов и визуализации.

Служба адаптера приложений

Эта услуга представляет набор спецификаций и API-интерфейсов, которые арендатор может реализовать для интеграции своей пользовательской логики в среду SaaS. В зависимости от того, насколько необходима индивидуальная интеграция, этот компонент может быть необязательным для арендаторов.

Многопользовательское хранилище данных

Общие службы хранят свои данные в хранилище данных, которое может быть единым общим Amazon DynamoDB таблица с ключом разделения арендатора, который связывает элементы DynamoDB с отдельными арендаторами. Общий сервис отслеживания затрат выводит агрегированные данные об использовании и отслеживании затрат в Amazon S3. В зависимости от варианта использования также может существовать хранилище данных для конкретного приложения.

Мультитенантная среда SaaS может содержать гораздо больше компонентов. Для получения дополнительной информации см. Создание мультитенантного SaaS-решения с использованием бессерверных сервисов AWS.

Поддержка нескольких моделей развертывания

Платформы SaaS обычно описывают две модели развертывания: пул и изолированное хранилище. В модели пула все арендаторы получают доступ к FM из общей среды с общей инфраструктурой хранения и вычислений. В изолированной модели каждый арендатор имеет собственный набор выделенных ресурсов. О моделях изоляции можно прочитать в разделе Технический документ по стратегиям изоляции клиентов SaaS.

Предлагаемое решение может быть адаптировано для обеих моделей развертывания SaaS. При подходе пула в централизованной среде AWS размещаются API, хранилища и вычислительные ресурсы. В изолированном режиме каждая команда получает доступ к API, хранилищу и вычислительным ресурсам в выделенной среде AWS.

Решение также соответствует доступным планам потребления, предоставляемым Amazon Bedrock. AWS предоставляет на выбор два плана потребления для вывода:

- On-Demand – Этот режим позволяет использовать базовые модели с оплатой по мере использования без необходимости брать на себя какие-либо временные обязательства.

- Обеспеченная пропускная способность – Этот режим позволяет вам обеспечить достаточную пропускную способность для удовлетворения требований к производительности вашего приложения в обмен на временные обязательства.

Дополнительную информацию об этих опциях см. Цены на Amazon Bedrock.

Эталонное решение SaaS без сервера, описанное в этой статье, может применять планы потребления Amazon Bedrock для предоставления конечным пользователям базовых и премиальных вариантов многоуровневого обслуживания. Базовый вариант может включать потребление Amazon Bedrock пропускной способности по требованию или предоставленной пропускной способности, а также определенные ограничения на использование и бюджет. Ограничения арендаторов можно включить путем регулирования запросов на основе запросов, размеров токенов или распределения бюджета. Арендаторы уровня «Премиум» могут иметь собственные выделенные ресурсы с выделенной пропускной способностью Amazon Bedrock. Эти арендаторы обычно связаны с производственными рабочими нагрузками, требующими высокой пропускной способности и доступа с низкой задержкой к Amazon Bedrock FM.

Заключение

В этом посте мы обсудили, как создать внутреннюю SaaS-платформу для доступа к базовым моделям с помощью Amazon Bedrock в мультитенантной настройке с упором на отслеживание затрат и использования, а также регулирование ограничений для каждого арендатора. Дополнительные темы для изучения включают интеграцию существующих решений аутентификации и авторизации в организации, расширение уровня API за счет включения веб-сокетов для двунаправленного взаимодействия клиент-сервер, добавление фильтрации контента и других средств управления, разработку нескольких уровней развертывания, интеграцию других микросервисов в SaaS. архитектура и многое другое.

Полный код этого решения доступен в файле Репозиторий GitHub.

Дополнительную информацию о платформах на основе SaaS см. SaaS Journey Framework: создание нового SaaS-решения на AWS.

Об авторах

![]() Хасан Пунавала — старший специалист по архитектуре решений искусственного интеллекта и машинного обучения в AWS, работающий с клиентами в сфере здравоохранения и медико-биологических наук. Хасан помогает проектировать, развертывать и масштабировать приложения генеративного искусственного интеллекта и машинного обучения на AWS. У него более 15 лет совокупного опыта работы в области машинного обучения, разработки программного обеспечения и обработки данных в облаке. В свободное время Хасан любит исследовать природу и проводить время с друзьями и семьей.

Хасан Пунавала — старший специалист по архитектуре решений искусственного интеллекта и машинного обучения в AWS, работающий с клиентами в сфере здравоохранения и медико-биологических наук. Хасан помогает проектировать, развертывать и масштабировать приложения генеративного искусственного интеллекта и машинного обучения на AWS. У него более 15 лет совокупного опыта работы в области машинного обучения, разработки программного обеспечения и обработки данных в облаке. В свободное время Хасан любит исследовать природу и проводить время с друзьями и семьей.

![]() Анастасия Цевелека — старший специалист по архитектуре решений AI/ML в AWS. В рамках своей работы она помогает клиентам в регионе EMEA создавать базовые модели и создавать масштабируемые решения для генеративного искусственного интеллекта и машинного обучения с использованием сервисов AWS.

Анастасия Цевелека — старший специалист по архитектуре решений AI/ML в AWS. В рамках своей работы она помогает клиентам в регионе EMEA создавать базовые модели и создавать масштабируемые решения для генеративного искусственного интеллекта и машинного обучения с использованием сервисов AWS.

![]() Bruнет Пистоне — специалист по архитектуре решений в области генеративного искусственного интеллекта и машинного обучения в AWS, базирующийся в Милане. Он работает с крупными клиентами, помогая им глубоко понять их технические потребности и разрабатывать решения в области искусственного интеллекта и машинного обучения, которые максимально эффективно используют облако AWS и стек машинного обучения Amazon. Его опыт включает комплексное машинное обучение, индустриализацию машинного обучения и генеративный искусственный интеллект. Ему нравится проводить время со своими друзьями и исследовать новые места, а также путешествовать по новым направлениям.

Bruнет Пистоне — специалист по архитектуре решений в области генеративного искусственного интеллекта и машинного обучения в AWS, базирующийся в Милане. Он работает с крупными клиентами, помогая им глубоко понять их технические потребности и разрабатывать решения в области искусственного интеллекта и машинного обучения, которые максимально эффективно используют облако AWS и стек машинного обучения Amazon. Его опыт включает комплексное машинное обучение, индустриализацию машинного обучения и генеративный искусственный интеллект. Ему нравится проводить время со своими друзьями и исследовать новые места, а также путешествовать по новым направлениям.

![]() Викеш Пандей — архитектор решений генеративного искусственного интеллекта и машинного обучения, специализирующийся на финансовых услугах, где он помогает финансовым клиентам создавать и масштабировать платформы и решения генеративного искусственного интеллекта и машинного обучения, которые масштабируются до сотен и даже тысяч пользователей. В свободное время Викеш любит писать на различных блог-форумах и собирать вместе с ребенком лего.

Викеш Пандей — архитектор решений генеративного искусственного интеллекта и машинного обучения, специализирующийся на финансовых услугах, где он помогает финансовым клиентам создавать и масштабировать платформы и решения генеративного искусственного интеллекта и машинного обучения, которые масштабируются до сотен и даже тысяч пользователей. В свободное время Викеш любит писать на различных блог-форумах и собирать вместе с ребенком лего.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/build-an-internal-saas-service-with-cost-and-usage-tracking-for-foundation-models-on-amazon-bedrock/

- :имеет

- :является

- :нет

- :куда

- $UP

- 000

- 1

- 120

- 15 лет

- 15%

- 160

- 26%

- 500

- 7

- a

- О нас

- доступ

- доступа

- Учетная запись

- через

- приспосабливать

- добавить

- дополнение

- дополнительный

- Дополнительно

- Администратор

- администраторы

- принял

- сводные показатели

- AI

- AI модели

- Платформа AI

- AI / ML

- Все

- распределение

- позволять

- позволяет

- вдоль

- уже

- причислены

- Amazon

- Амазонское машинное обучение

- Amazon QuickSight

- Amazon Web Services

- an

- и

- Другой

- Антропный

- любой

- кроме

- API

- Доступ к API

- КЛЮЧИ API

- API

- Применение

- Приложения

- Применить

- подхода

- утвержденный

- архитектура

- архитектуры

- МЫ

- AS

- назначенный

- связанный

- ассоциированных

- At

- аудит

- Аутентификация

- разрешение

- уполномоченный

- доступен

- AWS

- основанный

- основной

- основа

- BE

- , так как:

- начало

- ЛУЧШЕЕ

- Лучшая

- между

- Блог

- тело

- изоферменты печени

- широкий

- бюджет

- строить

- Строительство

- бизнес

- by

- рассчитанный

- исчисляет

- призывают

- вызова

- CAN

- возможности

- захватить

- перехватывает

- случаев

- Центр

- Центры

- централизованная

- проблемы

- изменения

- выбор

- клиент

- клиентов

- облако

- код

- Колонки

- сочетании

- Общий

- Компании

- компонент

- компоненты

- Вычисление

- Конфигурация

- связи

- последовательный

- состоит

- Консоли

- потреблять

- Потребители

- потребление

- потребление

- содержание

- контроль

- управление

- контрольная

- Цена

- Расходы

- может

- Создайте

- создали

- изготовленный на заказ

- Клиенты

- ежедневно

- данным

- наука о данных

- хранение данных

- день

- преданный

- глубоко

- определять

- определенный

- отказано

- Кафедра

- в зависимости

- развертывание

- развернуть

- развертывание

- развертывает

- описывать

- описано

- Проект

- проектирование

- направления

- подробность

- подробнее

- развитый

- Развитие

- команды разработчиков

- диаграмма

- различный

- размеры

- непосредственно

- обсуждать

- обсуждается

- do

- не

- Dont

- каждый

- Ранее

- легко

- эффект

- или

- вложения

- в регионе EMEA

- включить

- включен

- конец

- впритык

- Конечная точка

- повышение

- обеспечивать

- Весь

- Окружающая среда

- средах

- ошибка

- установить

- Даже

- События

- пример

- превышать

- обмена

- существующий

- опыт

- опыта

- объяснены

- Объясняет

- Больше

- Исследование

- экспресс

- расширенная

- знакомый

- семья

- Файл

- фильтрация

- финансовый

- финансовые услуги

- припадки

- Трансформируемость

- поток

- Фокус

- после

- следующим образом

- Что касается

- формат

- форумы

- Год основания

- основополагающий

- Устои

- Рамки

- каркасы

- частота

- друзья

- от

- передний

- Внешний интерфейс

- полностью

- функция

- функциональная

- функциональность

- Функции

- далее

- шлюз

- шлюзы

- Общие

- генерируется

- генерирует

- поколение

- генеративный

- Генеративный ИИ

- получает

- GitHub

- данный

- Go

- управление

- регулируется

- группы

- обрабатывать

- Случай

- Есть

- имеющий

- he

- здравоохранение

- высота

- помощь

- помогает

- ее

- здесь

- High

- высокопроизводительный

- его

- хостов

- Как

- How To

- HTML

- HTTP

- HTTPS

- Сотни

- ID

- идентификатор

- определения

- Личность

- if

- изображение

- Влияние

- осуществлять

- в XNUMX году

- in

- включают

- В том числе

- individual

- Прогнозные

- информация

- Инфраструктура

- обновлять

- вход

- затраты

- инструкции

- интегрировать

- Интегрируя

- интеграции.

- взаимодействовать

- взаимодействие

- взаимодействие

- Интерфейс

- в нашей внутренней среде,

- в

- вызывается

- изоляция

- вопрос

- эмиссионный

- IT

- пункты

- ЕГО

- путешествие

- JPG

- Основные

- ключи

- Дитя

- Labs

- Языки

- большой

- Фамилия

- Задержка

- слой

- слоев

- ведущий

- УЧИТЬСЯ

- изучение

- уровень

- ЖИЗНЬЮ

- Медико-биологическая промышленность

- такое как

- нравится

- рамки

- линия

- линий

- Включенный в список

- локальным

- каротаж

- логика

- посмотреть

- выглядит как

- серия

- любит

- Низкий

- машина

- обучение с помощью машины

- Сохранение

- сделать

- управлять

- управляемого

- управление

- управления

- многих

- карта

- максимальный

- Май..

- механизмы

- Встречайте

- упомянутый

- Мета

- методы

- microservice

- microservices

- может быть

- MILAN

- ML

- режим

- модель

- Модели

- монитор

- БОЛЕЕ

- самых

- много

- с разными

- природа

- необходимо

- Необходимость

- необходимый

- потребности

- сетей

- Новые

- номер

- нумерованный

- произошло

- of

- Предложения

- on

- On-Demand

- ONE

- только

- открытый

- с открытым исходным кодом

- работать

- операция

- Опции

- or

- заказ

- организация

- Другое

- контур

- выходной

- выходы

- за

- собственный

- страница

- параметр

- параметры

- часть

- для

- производительность

- Разрешения

- Мест

- план

- Планы

- Платформа

- Платформы

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- политика

- бассейн

- После

- потенциал

- Питание

- предшествующий

- предопределенный

- Премиум

- разрабатывает

- предыдущий

- предварительно

- Цены

- цены

- политикой конфиденциальности.

- частная

- Производство

- Продукция

- Программирование

- языки программирования

- Проект

- предложило

- обеспечивать

- при условии

- поставщики

- приводит

- обеспечение

- обеспечение

- Питон

- запрос

- быстро

- повышение

- ассортимент

- Обменный курс

- Читать

- последний

- относиться

- ссылка

- зарегистрироваться

- регистрирующий

- Регистрация

- регламентировать

- соответствующие

- Отчеты

- хранилище

- представляет

- запросить

- Запросы

- требовать

- Требования

- зарезервированный

- Полезные ресурсы

- относительно

- те

- соответственно

- ответ

- ответственный

- ОТДЫХ

- ограничивать

- возвращают

- Возвращает

- Роли

- маршруты

- Правило

- Run

- работает

- SaaS

- то же

- сохраняются

- масштабируемые

- Шкала

- Весы

- Сценарии

- график

- Наука

- НАУКА

- сфера

- разделах

- безопасно

- безопасность

- посмотреть

- поиск

- SELF

- посылает

- старший

- послать

- отдельный

- сервер

- Serverless

- обслуживание

- Услуги

- набор

- Наборы

- установка

- Поделиться

- общие

- она

- показывать

- показанный

- просто

- простота

- одинарной

- Размеры

- Software

- программное обеспечение как услуга

- разработка программного обеспечения

- Решение

- Решения

- некоторые

- Источник

- специализация

- специалист

- конкретный

- конкретно

- спецификации

- указанный

- скорость

- тратить

- Расходы

- Стабильность

- стек

- Начало

- Шаги

- диск

- магазин

- хранить

- магазины

- стратегий

- подсеть

- успешный

- такие

- достаточный

- Убедитесь

- ТАБЛИЦЫ

- цель

- команда

- команды

- Технический

- Технологии

- шаблон

- арендатор

- срок

- текст

- который

- Ассоциация

- информация

- их

- Их

- сами

- тогда

- Там.

- Эти

- они

- вещи

- этой

- тысячи

- Через

- пропускная способность

- ярус

- время

- исполин

- в

- знак

- Лексемы

- Темы

- Всего

- трек

- Отслеживание

- треков

- правда

- два

- напишите

- типично

- понимать

- созданного

- отпереть

- обновление

- Применение

- использование

- прецедент

- используемый

- Информация о пользователе

- пользователей

- использования

- через

- v1

- ценностное

- различный

- версия

- версии

- с помощью

- Вид

- видимость

- визуализация

- визуализации

- we

- Web

- веб-сервисы

- Веб-сокеты

- ЧТО Ж

- Что

- Что такое

- когда

- который

- в то время как

- КТО

- ширина

- в

- без

- Работа

- рабочий

- работает

- работает

- бы

- записывать

- лет

- Ты

- ВАШЕ

- зефирнет