Создание масштабируемых и эффективных конвейеров машинного обучения (ML) имеет решающее значение для оптимизации разработки, развертывания и управления моделями ML. В этом посте мы представляем платформу для автоматизации создания ориентированного ациклического графа (DAG) для Конвейеры Amazon SageMaker на основе простых файлов конфигурации. код фреймворка и примеры представленные здесь охватывают только конвейеры обучения моделей, но могут быть легко расширены и на конвейеры пакетного вывода.

Эта динамическая платформа использует файлы конфигурации для организации этапов предварительной обработки, обучения, оценки и регистрации как для одно-, так и для многомодельных вариантов использования на основе определяемых пользователем сценариев Python, потребностей инфраструктуры (включая Виртуальное частное облако Amazon (Amazon VPC) подсети и группы безопасности, Управление идентификацией и доступом AWS (IAM) роли, Служба управления ключами AWS (AWS KMS), реестр контейнеров и типы экземпляров), ввод и вывод. Простой сервис хранения Amazon (Amazon S3) и теги ресурсов. Файлы конфигурации (YAML и JSON) позволяют специалистам по машинному обучению указывать недифференцированный код для организации конвейеров обучения с использованием декларативного синтаксиса. Это позволяет ученым, работающим с данными, быстро создавать модели машинного обучения и выполнять их итерации, а инженерам машинного обучения — быстрее запускать конвейеры машинного обучения непрерывной интеграции и непрерывной доставки (CI/CD), сокращая время создания моделей.

Обзор решения

Предлагаемый код платформы начинается с чтения файлов конфигурации. Затем он динамически создает группу обеспечения доступности баз данных SageMaker Pipelines на основе шагов, объявленных в файлах конфигурации, а также взаимодействий и зависимостей между шагами. Эта платформа оркестрации подходит как для одно-, так и для многомодельных вариантов использования и обеспечивает плавный поток данных и процессов. Ниже приведены основные преимущества этого решения:

- автоматизация – Весь рабочий процесс машинного обучения, от предварительной обработки данных до регистрации моделей, организован без ручного вмешательства. Это сокращает время и усилия, необходимые для экспериментирования и внедрения модели.

- Воспроизводимость – С помощью предопределенного файла конфигурации специалисты по обработке данных и инженеры по машинному обучению могут воспроизвести весь рабочий процесс, достигая согласованных результатов при различных запусках и средах.

- Масштабируемость – Создатель мудреца Амазонки используется на протяжении всего конвейера, что позволяет специалистам по машинному обучению обрабатывать большие наборы данных и обучать сложные модели без проблем с инфраструктурой.

- Трансформируемость – Платформа является гибкой и может вместить широкий спектр вариантов использования машинного обучения, фреймворков машинного обучения (таких как XGBoost и TensorFlow), многомодельного и многоэтапного обучения. Каждый шаг обучения DAG можно настроить с помощью файла конфигурации.

- Модель управления - Реестр моделей Amazon SageMaker интеграция позволяет отслеживать версии моделей и, следовательно, с уверенностью продвигать их в производство.

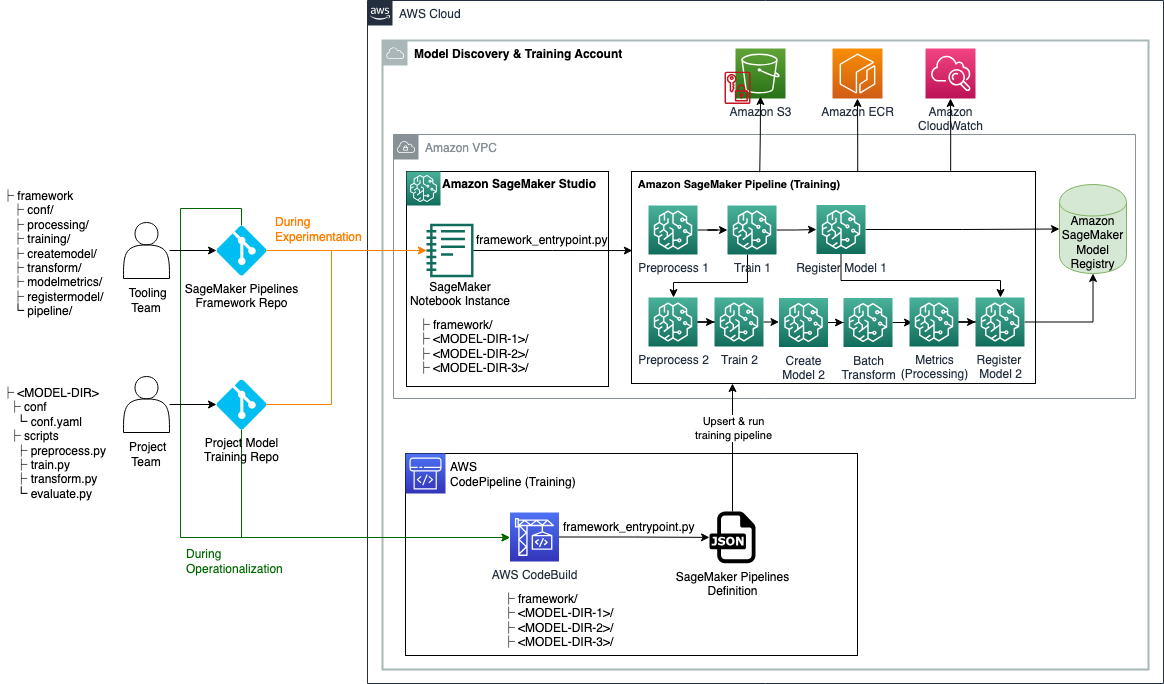

На следующей диаграмме архитектуры показано, как можно использовать предлагаемую структуру как во время экспериментов, так и при внедрении моделей машинного обучения. Во время экспериментов вы можете клонировать репозиторий кода платформы, представленный в этом посте, и репозитории исходного кода вашего проекта в Студия Amazon SageMakerи настройте свою виртуальную среду (подробно ниже в этом посте). Затем вы можете выполнить итерацию сценариев предварительной обработки, обучения и оценки, а также вариантов конфигурации. Чтобы создать и запустить обучающую группу обеспечения доступности баз данных SageMaker Pipelines, вы можете вызвать точку входа платформы, которая прочитает все файлы конфигурации, создаст необходимые шаги и организует их на основе указанного порядка шагов и зависимостей.

Во время ввода в эксплуатацию конвейер CI клонирует репозиторий кода платформы и репозитории обучения для конкретного проекта в Сборка кода AWS задание, в котором вызывается сценарий точки входа платформы для создания или обновления обучающей группы обеспечения доступности баз данных SageMaker Pipelines, а затем ее запуск.

Структура репозитория

Ассоциация Репозиторий GitHub содержит следующие каталоги и файлы:

- /framework/conf/ – Этот каталог содержит файл конфигурации, который используется для установки общих переменных для всех единиц моделирования, таких как подсети, группы безопасности и роль IAM, во время выполнения. Блок моделирования — это последовательность из шести шагов для обучения модели ML.

- /framework/createmodel/ – Этот каталог содержит скрипт Python, который создает Модель SageMaker объект на основе артефактов модели из Этап обучения SageMaker Pipelines. Объект модели позже используется в Пакетное преобразование SageMaker задание по оценке производительности модели на тестовом наборе.

- /framework/modelmetrics/ – Этот каталог содержит сценарий Python, который создает Обработка Amazon SageMaker задание по созданию отчета JSON с метриками модели для обученной модели на основе результатов задания пакетного преобразования SageMaker, выполненного на тестовых данных.

- /фреймворк/конвейер/ – Этот каталог содержит сценарии Python, которые используют классы Python, определенные в других каталогах платформы, для создания или обновления группы обеспечения доступности баз данных SageMaker Pipelines на основе указанных конфигураций. Сценарий model_unit.py используется конвейером_service.py для создания одного или нескольких модулей моделирования. Каждый блок моделирования представляет собой последовательность из шести шагов обучения модели ML: обработка, обучение, создание модели, преобразование, метрика и регистрация модели. Конфигурации для каждого модуля моделирования должны быть указаны в соответствующем репозитории модели. Pipeline_service.py также устанавливает зависимости между шагами SageMaker Pipelines (последовательность или цепочку шагов внутри и между модулями моделирования) на основе раздела sagemakerPipeline, который должен быть определен в файле конфигурации одного из репозиториев модели (модель привязки). Это позволяет переопределить зависимости по умолчанию, определяемые конвейерами SageMaker. Мы обсудим структуру файла конфигурации позже в этом посте.

- /фреймворк/обработка/ – Этот каталог содержит сценарий Python, который создает задание обработки SageMaker на основе указанного образа Docker и сценария точки входа.

- /framework/registermodel/ – Этот каталог содержит скрипт Python для регистрации обученной модели вместе с ее рассчитанными метриками в реестре моделей SageMaker.

- /фреймворк/обучение/ – Этот каталог содержит сценарий Python, который создает задание обучения SageMaker.

- /фреймворк/трансформировать/ – Этот каталог содержит сценарий Python, который создает задание пакетного преобразования SageMaker. В контексте обучения модели это используется для расчета показателя производительности обученной модели на тестовых данных.

- /фреймворк/утилиты/ – Этот каталог содержит служебные сценарии для чтения и объединения файлов конфигурации, а также для ведения журналов.

- /framework_entrypoint.py – Этот файл является точкой входа кода платформы. Он вызывает функцию, определенную в каталоге /framework/pipeline/, для создания или обновления группы обеспечения доступности баз данных SageMaker Pipelines и ее запуска.

- /Примеры/ – Этот каталог содержит несколько примеров того, как вы можете использовать эту платформу автоматизации для создания простых и сложных обучающих групп DAG.

- /env.env – Этот файл позволяет вам устанавливать общие переменные, такие как подсети, группы безопасности и роль IAM, в качестве переменных среды.

- /requirements.txt – В этом файле указаны библиотеки Python, необходимые для кода платформы.

Предпосылки

Перед развертыванием этого решения у вас должны быть следующие предварительные условия:

- Аккаунт AWS

- Студия SageMaker

- Роль SageMaker с разрешениями на чтение/запись Amazon S3 и шифрование/дешифрование AWS KMS.

- Корзина S3 для хранения данных, скриптов и артефактов модели.

- По желанию Интерфейс командной строки AWS (интерфейс командной строки АМС)

- Python3 (Python 3.7 или новее) и следующие пакеты Python:

- бото3

- sagemaker

- ПиЯМЛ

- Дополнительные пакеты Python, используемые в ваших собственных скриптах.

Разверните решение

Выполните следующие шаги для развертывания решения:

- Организуйте репозиторий обучения модели в соответствии со следующей структурой:

- Клонируйте код платформы и исходный код вашей модели из репозиториев Git:

-

- Клон

dynamic-sagemaker-pipelines-frameworkрепо в каталог обучения. В следующем коде мы предполагаем, что каталог обучения называетсяaws-train: - Клонируйте исходный код модели в тот же каталог. Для обучения с несколькими моделями повторите этот шаг для всех моделей, которые вам нужно обучить.

- Клон

Для обучения одной модели ваш каталог должен выглядеть следующим образом:

Для обучения с использованием нескольких моделей ваш каталог должен выглядеть следующим образом:

- Настройте следующие переменные среды. Звездочки обозначают необходимые переменные среды; остальные не являются обязательными.

| Переменная среды | Описание |

SMP_ACCOUNTID* |

Учетная запись AWS, в которой запущен конвейер SageMaker |

SMP_REGION* |

Регион AWS, в котором работает конвейер SageMaker |

SMP_S3BUCKETNAME* |

Имя корзины S3 |

SMP_ROLE* |

Роль SageMaker |

SMP_MODEL_CONFIGPATH* |

Относительный путь к файлам конфигурации одной модели или нескольких моделей. |

SMP_SUBNETS |

Идентификаторы подсети для конфигурации сети SageMaker |

SMP_SECURITYGROUPS |

Идентификаторы групп безопасности для сетевой конфигурации SageMaker |

Для случаев использования одной модели: SMP_MODEL_CONFIGPATH будет <MODEL-DIR>/conf/conf.yaml. Для случаев использования нескольких моделей: SMP_MODEL_CONFIGPATH будет */conf/conf.yaml, что позволяет найти все conf.yaml файлы с помощью модуля Python glob и объединить их в глобальный файл конфигурации. Во время экспериментов (локального тестирования) вы можете указать переменные среды внутри файла env.env, а затем экспортировать их, выполнив следующую команду в своем терминале:

Обратите внимание, что значения переменных среды в env.env следует помещать в кавычки (например, SMP_REGION="us-east-1"). Во время ввода в эксплуатацию эти переменные среды должны быть установлены конвейером CI.

- Создайте и активируйте виртуальную среду, выполнив следующие команды:

- Установите необходимые пакеты Python, выполнив следующую команду:

- Отредактируйте обучение модели

conf.yamlфайлы. Мы обсудим структуру файла конфигурации в следующем разделе. - Из терминала вызовите точку входа платформы, чтобы создать или обновить и запустить обучающую группу DAG SageMaker Pipeline:

- Просмотр и отладка конвейеров SageMaker, запущенных на Трубопроводы вкладка пользовательского интерфейса SageMaker Studio.

Структура файла конфигурации

В предлагаемом решении есть два типа файлов конфигурации: конфигурация платформы и конфигурация модели. В этом разделе мы подробно опишем каждый из них.

Конфигурация платформы

Ассоциация /framework/conf/conf.yaml файл устанавливает переменные, которые являются общими для всех модулей моделирования. Это включает SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPSи SMP_MODELNAME. Обратитесь к шагу 3 инструкций по развертыванию, чтобы получить описание этих переменных и способы их установки с помощью переменных среды.

Конфигурация модели

Для каждой модели в проекте нам необходимо указать следующее в <MODEL-DIR>/conf/conf.yaml файл (звездочками отмечены обязательные разделы, остальные необязательны):

- /conf/модели* – В этом разделе вы можете настроить один или несколько блоков моделирования. Когда код платформы запускается, он автоматически читает все файлы конфигурации во время выполнения и добавляет их в дерево конфигурации. Теоретически можно указать все единицы моделирования в одном

conf.yamlфайл, но рекомендуется указывать каждую конфигурацию модуля моделирования в соответствующем каталоге или репозитории Git, чтобы свести к минимуму ошибки. Единицы следующие:- {название модели}* – Название модели.

- исходный_каталог* - Общий

source_dirпуть, который будет использоваться для всех шагов в модуле моделирования. - предобработки – В этом разделе указаны параметры предварительной обработки.

- тренироваться* – В этом разделе указаны параметры задания обучения.

- трансформировать* – В этом разделе указаны параметры задания преобразования SageMaker для прогнозирования тестовых данных.

- оценивать – В этом разделе указаны параметры задания обработки SageMaker для создания отчета JSON с метриками модели для обученной модели.

- реестр* – В этом разделе указаны параметры для регистрации обученной модели в реестре моделей SageMaker.

- /conf/sagemakerPipeline* – В этом разделе определяется поток SageMaker Pipelines, включая зависимости между шагами. Для случаев использования одной модели этот раздел определяется в конце файла конфигурации. Для случаев использования нескольких моделей

sagemakerPipelineраздел необходимо определить только в файле конфигурации одной из моделей (любой из моделей). Мы называем эту модель модель якоря. Параметры следующие:- Имя конвейера* – Имя конвейера SageMaker.

- Модели* – Вложенный список единиц моделирования:

- {название модели}* – Идентификатор модели, который должен соответствовать идентификатору {model-name} в разделе /conf/models.

- шаги* –

- имя_шага* – Имя шага, которое будет отображаться в группе обеспечения доступности баз данных SageMaker Pipelines.

- шаг_класс* – (Объединение[Обработка, Обучение, CreateModel, Transform, Metrics, RegisterModel])

- тип_шага* – Этот параметр требуется только для шагов предварительной обработки, для которых он должен быть установлен на предварительную обработку. Это необходимо, чтобы различать этапы предварительной обработки и оценки, оба из которых имеют

step_classобработки. - Enable_cache – ([Союз[Истина, Ложь]]). Это указывает, следует ли включать Кэширование конвейеров SageMaker для этого шага.

- Chain_input_source_step – ([список[имя_шага]]). Вы можете использовать это, чтобы установить выходы каналов другого шага в качестве входных данных для этого шага.

- Chain_input_additional_prefix – Это разрешено только для шагов преобразования.

step_classи может использоваться совместно сchain_input_source_stepпараметр, определяющий файл, который следует использовать в качестве входных данных для шага преобразования.

- шаги* –

- {название модели}* – Идентификатор модели, который должен соответствовать идентификатору {model-name} в разделе /conf/models.

- Зависимости – В этом разделе указана последовательность выполнения шагов SageMaker Pipelines. Мы адаптировали нотацию Apache Airflow для этого раздела (например,

{step_name} >> {step_name}). Если этот раздел оставить пустым, явные зависимости, указанные вchain_input_source_stepпараметр или неявные зависимости определяют поток DAG SageMaker Pipelines.

Обратите внимание, что мы рекомендуем иметь один этап обучения на единицу моделирования. Если для модуля моделирования определено несколько шагов обучения, последующие шаги неявно берут последний шаг обучения для создания объекта модели, расчета показателей и регистрации модели. Если вам нужно обучить несколько моделей, рекомендуется создать несколько модулей моделирования.

Примеры

В этом разделе мы демонстрируем три примера групп DAG для обучения моделей ML, созданных с использованием представленной структуры.

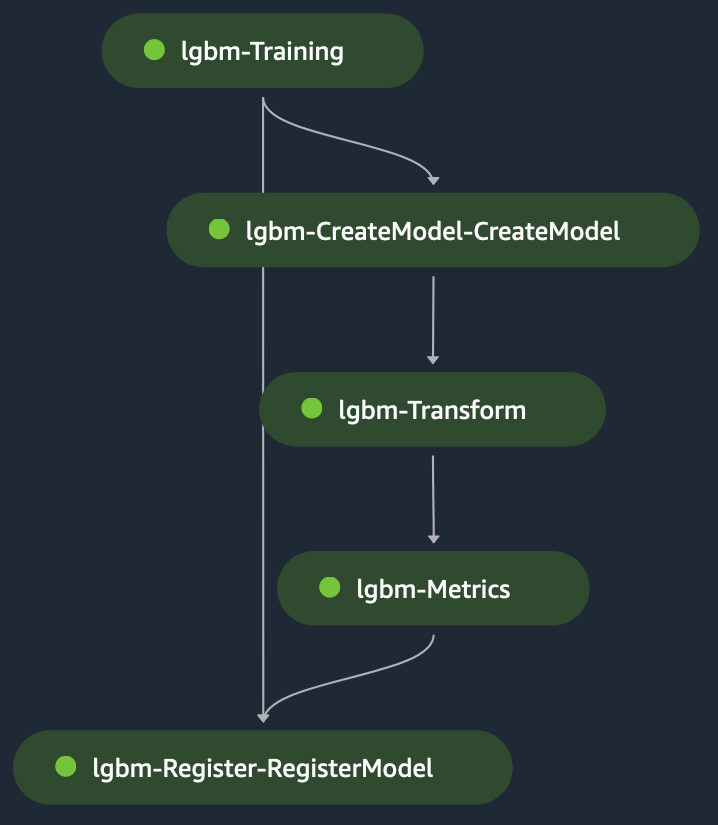

Обучение одной модели: LightGBM

Это пример одной модели для варианта использования классификации, где мы используем LightGBM в режиме сценария в SageMaker, Набор данных состоит из категориальных и числовых переменных для прогнозирования двоичной метки «Доход» (чтобы предсказать, совершит ли субъект покупку или нет). сценарий предварительной обработки используется для моделирования данных для обучения и тестирования, а затем поместите это в корзину S3. Затем пути S3 передаются тренировочный шаг в файле конфигурации.

При выполнении шага обучения SageMaker загружает файл в контейнер по адресу /opt/ml/input/data/{channelName}/, доступный через переменную среды SM_CHANNEL_{channelName} на контейнере (ChannelName = 'поезд' или 'тест') .Отель сценарий обучения делает следующее:

- Загрузите файлы локально из путей к локальным контейнерам, используя команду Загрузка NumPy модуль.

- Установите гиперпараметры для алгоритма обучения.

- Сохраните обученную модель по пути к локальному контейнеру.

/opt/ml/model/.

SageMaker использует содержимое каталога /opt/ml/model/ для создания архива, который используется для развертывания модели в SageMaker для размещения на хостинге.

Шаг преобразования принимает в качестве входных данных проиндексированный тестовый файл в качестве входных данных и обученная модель для прогнозирования на основе обученной модели. Результатом этапа преобразования является прикованный к шагу метрик, чтобы оценить модель по сравнению с основа истины, который явно передается на шаг метрик. Наконец, выходные данные шага метрик неявно связываются с шагом регистрации для регистрации модели в реестре моделей SageMaker с информацией о производительности модели, полученной на шаге метрик. На следующем рисунке показано визуальное представление обучающей группы обеспечения доступности баз данных. Вы можете обратиться к сценариям и файлу конфигурации для этого примера в разделе Репо GitHub.

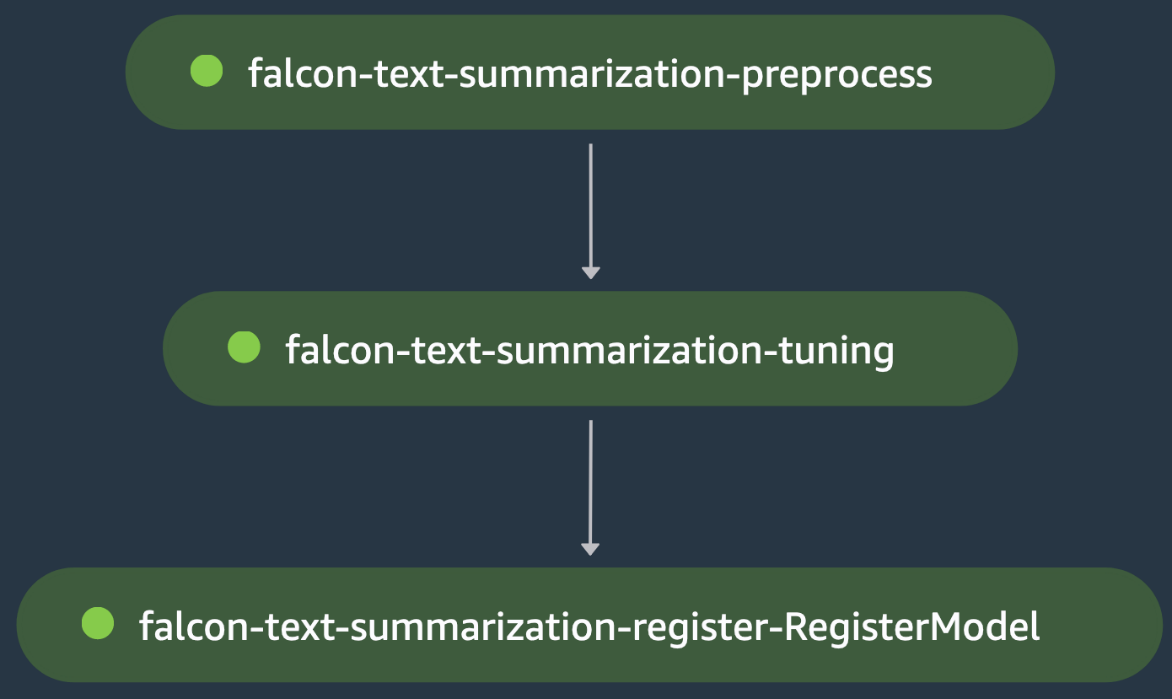

Обучение на одной модели: точная настройка LLM

Это еще один пример обучения одной модели, в котором мы организуем тонкую настройку модели большого языка (LLM) Falcon-40B из Hugging Face Hub для варианта использования резюмирования текста. сценарий предварительной обработки загружает самсум набор данных из Hugging Face, загружает токенизатор для модели и обрабатывает разделение данных обучения/тестирования для точной настройки модели на основе данных этого домена на этапе предварительной обработки falcon-text-summarization-preprocess.

На выходе прикованный к шагу настройки обобщения текста falcon, где сценарий обучения загружает LLM Falcon-40B из Hugging Face Hub и запускает ускоренную точную настройку с помощью ЛоРА в поезде раскололся. Модель оценивается на том же этапе после точной настройки, которая ворота потеря оценки из-за сбоя этапа настройки суммирования falcon-text, что приводит к остановке конвейера SageMaker до того, как он сможет зарегистрировать точно настроенную модель. В противном случае шаг настройки суммирования falcon-text выполняется успешно, и модель регистрируется в реестре моделей SageMaker. На следующем рисунке показано визуальное представление точной настройки DAG LLM. Сценарии и файл конфигурации для этого примера доступны в папке Репо GitHub.

Мультимодельное обучение

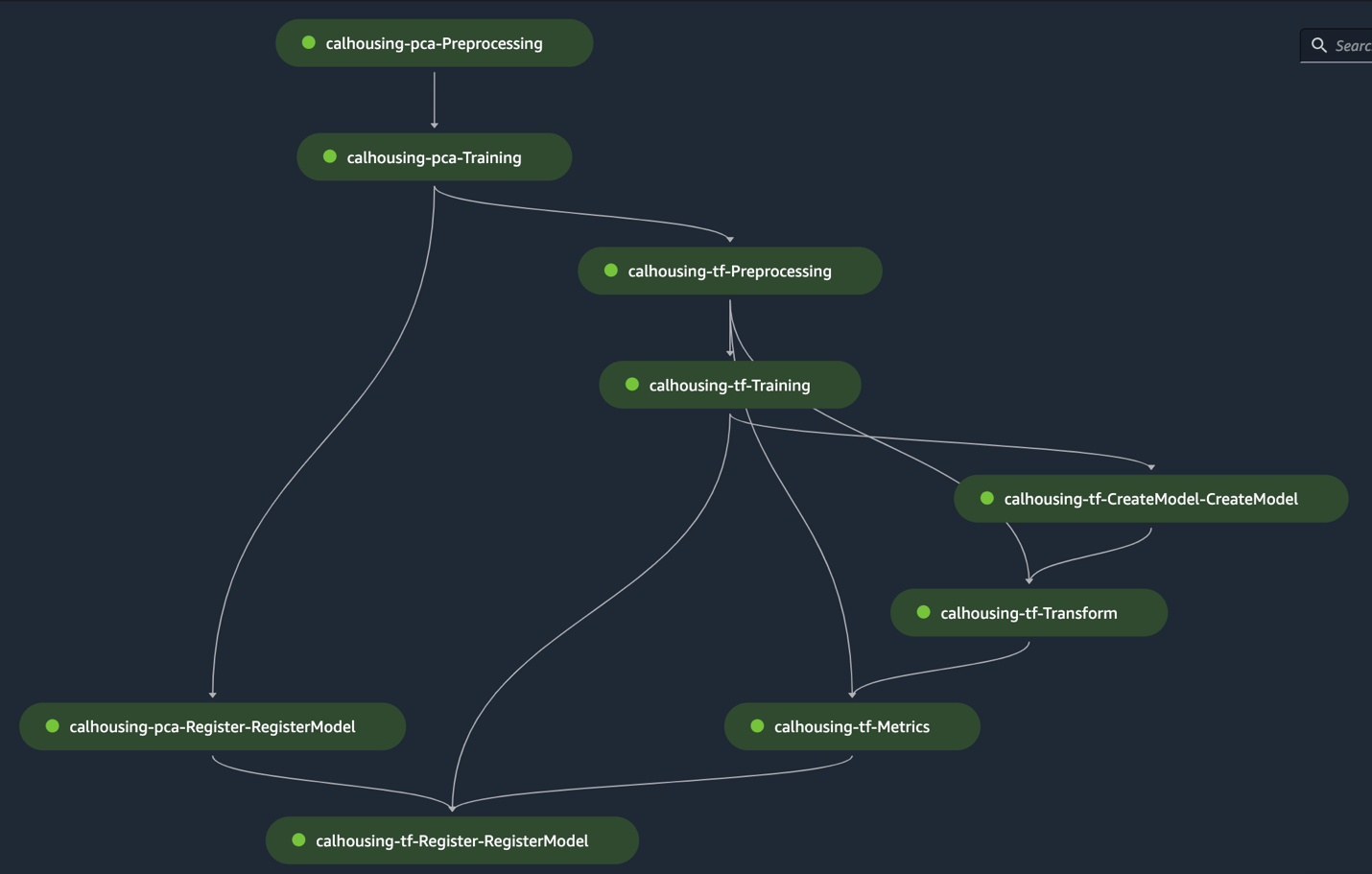

Это пример обучения с несколькими моделями, в котором модель анализа главных компонентов (PCA) обучается для уменьшения размерности, а модель многослойного персептрона TensorFlow обучается для Прогноз цен на жилье в Калифорнии. На этапе предварительной обработки модели TensorFlow используется обученная модель PCA для уменьшения размерности обучающих данных. Мы добавляем зависимость в конфигурацию, чтобы гарантировать регистрацию модели TensorFlow после регистрации модели PCA. На следующем рисунке показано визуальное представление примера многомодельного обучения DAG. Сценарии и файлы конфигурации для этого примера доступны в папке Репо GitHub.

Убирать

Выполните следующие шаги, чтобы очистить ресурсы:

- Используйте интерфейс командной строки AWS, чтобы список и удаление все оставшиеся конвейеры, созданные сценариями Python.

- При желании удалите другие ресурсы AWS, такие как сегмент S3 или роль IAM, созданные вне SageMaker Pipelines.

Заключение

В этом посте мы представили платформу для автоматизации создания DAG SageMaker Pipelines на основе файлов конфигурации. Предлагаемая структура предлагает перспективное решение проблемы организации сложных рабочих нагрузок машинного обучения. Используя файл конфигурации, SageMaker Pipelines обеспечивает гибкость создания оркестровки с минимальным количеством кода, что позволяет упростить процесс создания и управления как одномодельными, так и многомодельными конвейерами. Такой подход не только экономит время и ресурсы, но и продвигает лучшие практики MLOps, способствуя общему успеху инициатив ML. Дополнительные сведения о деталях реализации см. Репо GitHub.

Об авторах

Луис Фелипе Йепес Барриос— инженер по машинному обучению в компании AWS Professional Services, специализирующийся на масштабируемых распределенных системах и инструментах автоматизации для ускорения научных инноваций в области машинного обучения (ML). Кроме того, он помогает корпоративным клиентам оптимизировать их решения машинного обучения с помощью сервисов AWS.

Луис Фелипе Йепес Барриос— инженер по машинному обучению в компании AWS Professional Services, специализирующийся на масштабируемых распределенных системах и инструментах автоматизации для ускорения научных инноваций в области машинного обучения (ML). Кроме того, он помогает корпоративным клиентам оптимизировать их решения машинного обучения с помощью сервисов AWS.

Цзиньчжао Фэн— инженер по машинному обучению в AWS Professional Services. Он специализируется на разработке и внедрении крупномасштабных решений генеративного искусственного интеллекта и классических конвейерных решений машинного обучения. Он специализируется на FMOps, LLMOps и распределенном обучении.

Цзиньчжао Фэн— инженер по машинному обучению в AWS Professional Services. Он специализируется на разработке и внедрении крупномасштабных решений генеративного искусственного интеллекта и классических конвейерных решений машинного обучения. Он специализируется на FMOps, LLMOps и распределенном обучении.

Суровый Аснани, является инженером по машинному обучению в AWS. Его опыт работы в области прикладной науки о данных с упором на внедрение рабочих нагрузок машинного обучения в облаке в больших масштабах.

Суровый Аснани, является инженером по машинному обучению в AWS. Его опыт работы в области прикладной науки о данных с упором на внедрение рабочих нагрузок машинного обучения в облаке в больших масштабах.

Хасан Шоджаи— старший специалист по данным в AWS Professional Services, где он помогает клиентам из разных отраслей решать бизнес-задачи с помощью больших данных, машинного обучения и облачных технологий. До этой должности Хасан возглавлял множество инициатив по разработке новых методов моделирования на основе физики и данных для ведущих энергетических компаний. Помимо работы Хасан увлекается книгами, пешим туризмом, фотографией и историей.

Хасан Шоджаи— старший специалист по данным в AWS Professional Services, где он помогает клиентам из разных отраслей решать бизнес-задачи с помощью больших данных, машинного обучения и облачных технологий. До этой должности Хасан возглавлял множество инициатив по разработке новых методов моделирования на основе физики и данных для ведущих энергетических компаний. Помимо работы Хасан увлекается книгами, пешим туризмом, фотографией и историей.

Алек Дженаб— инженер по машинному обучению, который специализируется на разработке и внедрении решений машинного обучения в больших масштабах для корпоративных клиентов. Алек с энтузиазмом выводит на рынок инновационные решения, особенно в тех областях, где машинное обучение может значительно улучшить качество обслуживания конечных пользователей. Вне работы он любит играть в баскетбол, кататься на сноуборде и находить скрытые сокровища Сан-Франциско.

Алек Дженаб— инженер по машинному обучению, который специализируется на разработке и внедрении решений машинного обучения в больших масштабах для корпоративных клиентов. Алек с энтузиазмом выводит на рынок инновационные решения, особенно в тех областях, где машинное обучение может значительно улучшить качество обслуживания конечных пользователей. Вне работы он любит играть в баскетбол, кататься на сноуборде и находить скрытые сокровища Сан-Франциско.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :является

- :нет

- :куда

- $UP

- 120

- 160

- 7

- 8

- 9

- a

- в состоянии

- О нас

- ускоренный

- доступ

- доступной

- вмещать

- По

- Учетная запись

- достижение

- через

- активировать

- ациклический

- Добавить

- После

- против

- AI

- алгоритм

- Все

- позволять

- разрешено

- позволяет

- вдоль

- причислены

- Amazon

- Создатель мудреца Амазонки

- Конвейеры Amazon SageMaker

- Amazon Web Services

- среди

- an

- анализ

- Ведущий

- и

- Другой

- любой

- апаш

- прикладной

- подхода

- архитектура

- МЫ

- области

- AS

- помогает

- предполагать

- At

- автоматизировать

- автоматически

- Автоматизация

- автоматизация

- доступен

- AWS

- Профессиональные услуги AWS

- фон

- основанный

- Баскетбол

- BE

- до

- Преимущества

- ЛУЧШЕЕ

- лучшие практики

- большой

- Big Data

- Книги

- изоферменты печени

- Приведение

- строить

- бизнес

- но

- by

- вычислять

- рассчитанный

- призывают

- под названием

- Объявления

- CAN

- случаев

- случаев

- обслуживает

- Причины

- прикованный

- вызов

- проблемы

- Канал

- выбор

- классов

- классификация

- чистым

- кли

- клиентов

- облако

- код

- объединять

- Общий

- Компании

- комплекс

- компонент

- Обеспокоенность

- доверие

- Конфигурация

- связь

- последовательный

- состоит

- Container

- Контейнеры

- содержит

- содержание

- контекст

- (CIJ)

- содействие

- чехол для варгана

- Создайте

- создали

- создает

- Создающий

- создание

- решающее значение

- изготовленный на заказ

- Клиенты

- подгонянный

- DAG

- данным

- наука о данных

- ученый данных

- управляемых данными

- Наборы данных

- объявленный

- По умолчанию

- определять

- определенный

- Определяет

- поставка

- демонстрировать

- Зависимости

- Зависимость

- развертывание

- развертывание

- развертывание

- описывать

- подробность

- подробный

- подробнее

- развивать

- развивающийся

- Развитие

- диаграмма

- различный

- направленный

- каталоги

- каталог

- обнаружение

- обсуждать

- отображается

- выделить

- распределенный

- распределенные системы

- распределенное обучение

- Docker

- приносит

- домен

- в течение

- динамический

- динамично

- каждый

- эффективный

- усилие

- Наделяет

- включить

- позволяет

- позволяет

- конец

- энергетика

- инженер

- Инженеры

- обеспечивать

- Предприятие

- Весь

- запись

- Окружающая среда

- средах

- ошибки

- особенно

- оценивать

- оценивается

- оценки

- оценка

- Каждая

- пример

- Примеры

- ускорять

- опыт

- эксплицитно

- экспорт

- расширенная

- Face

- FAIL

- ложный

- быстрее

- поле

- фигура

- Файл

- Файлы

- в заключение

- Найдите

- Трансформируемость

- гибкого

- поток

- Фокус

- внимание

- фокусируется

- после

- следующим образом

- Что касается

- форма

- дальновидный

- Рамки

- каркасы

- Франциско

- от

- функция

- Более того

- порождающий

- генеративный

- Генеративный ИИ

- идти

- Глобальный

- управление

- график

- большой

- группы

- Группы

- Есть

- имеющий

- he

- помогает

- здесь

- Скрытый

- его

- история

- хостинг

- жилье

- Как

- How To

- HTML

- HTTP

- HTTPS

- хаб

- идентификатор

- Личность

- идентификаторы

- if

- изображение

- реализация

- Осуществляющий

- улучшать

- in

- В других

- включает в себя

- В том числе

- указывать

- указывает

- промышленности

- Прогнозные

- информация

- Инфраструктура

- инициативы

- Инновации

- инновационный

- вход

- внутри

- устанавливать

- пример

- инструкции

- интеграции.

- взаимодействие

- вмешательство

- в

- IT

- ЕГО

- работа

- присоединение

- JPG

- JSON

- Основные

- ключи

- этикетка

- язык

- большой

- Фамилия

- новее

- изучение

- привело

- оставил

- библиотеки

- такое как

- линия

- Список

- LLM

- загрузка

- грузы

- локальным

- в местном масштабе

- каротаж

- посмотреть

- выглядит как

- от

- машина

- обучение с помощью машины

- сделать

- ДЕЛАЕТ

- Создание

- управление

- управления

- руководство

- многих

- рынок

- Совпадение

- метрический

- Метрика

- минимальный

- минимизировать

- ML

- млн операций в секунду

- режим

- модель

- моделирование

- Модели

- Модули

- БОЛЕЕ

- с разными

- имя

- необходимо

- Необходимость

- необходимый

- потребности

- сетей

- следующий

- нет

- роман

- объект

- of

- Предложения

- on

- ONE

- только

- оптимизирующий

- or

- организовал

- Orchestrating

- оркестровка

- Другое

- в противном случае

- выходной

- выходы

- внешнюю

- общий

- переопределение

- пакеты

- параметр

- параметры

- страстный

- путь

- пути

- для

- производительность

- выполнены

- фотография

- трубопровод

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- игры

- Точка

- После

- практиками

- предопределенный

- предсказывать

- Predictions

- предпосылки

- представить

- представлены

- цена

- Основной

- Предварительный

- частная

- процесс

- Процессы

- обработка

- Произведенный

- Производство

- профессиональный

- Проект

- способствует

- Содействие

- предложило

- при условии

- приводит

- покупки

- Питон

- быстро

- ассортимент

- Читать

- легко

- Reading

- рекомендовать

- Управление по борьбе с наркотиками (DEA)

- уменьшить

- снижает

- снижение

- относиться

- область

- зарегистрироваться

- зарегистрированный

- регистрирующий

- Регистрация

- реестра

- осталось

- повторять

- отчету

- хранилище

- представление

- обязательный

- Требования

- ресурс

- Полезные ресурсы

- те

- ОТДЫХ

- Итоги

- доходы

- обзоре

- Роли

- роли

- Run

- Бег

- работает

- время выполнения

- sagemaker

- Конвейеры SageMaker

- то же

- Сан -

- Сан-Франциско

- масштабируемые

- Шкала

- Наука

- научный

- Ученый

- Ученые

- скрипт

- скрипты

- Раздел

- разделах

- безопасность

- Последовательность

- Услуги

- набор

- Наборы

- несколько

- должен

- Шоу

- просто

- ШЕСТЬ

- сгладить

- So

- Решение

- Решения

- РЕШАТЬ

- Источник

- исходный код

- специализированный

- специализируется

- указанный

- раскол

- расколы

- начинается

- Шаг

- Шаги

- Stop

- диск

- хранение

- упорядочить

- упорядочение

- Структура

- студия

- предмет

- подсеть

- последующее

- успех

- Успешно

- такие

- поставляется

- синтаксис

- системы

- взять

- принимает

- снижения вреда

- технологии

- tensorflow

- Терминал

- тестXNUMX

- Тестирование

- текст

- который

- Ассоциация

- Регистр

- их

- Их

- тогда

- следовательно

- Эти

- этой

- три

- Через

- по всему

- время

- в

- топ

- Отслеживание

- Train

- специалистов

- Обучение

- Transform

- дерево

- правда

- два

- Типы

- ui

- под

- Ед. изм

- единиц

- Обновление ПО

- использование

- прецедент

- используемый

- Информация о пользователе

- Пользовательский опыт

- использования

- через

- утилита

- Наши ценности

- переменная

- версии

- с помощью

- Виртуальный

- визуальный

- we

- Web

- веб-сервисы

- ЧТО Ж

- когда

- будь то

- который

- КТО

- широкий

- Широкий диапазон

- будете

- в

- без

- Работа

- рабочий

- XGBoost

- YAML

- Ты

- ВАШЕ

- зефирнет