Этот пост написан в соавторстве с Костей Кофманом и Дженни Токар из Booking.com.

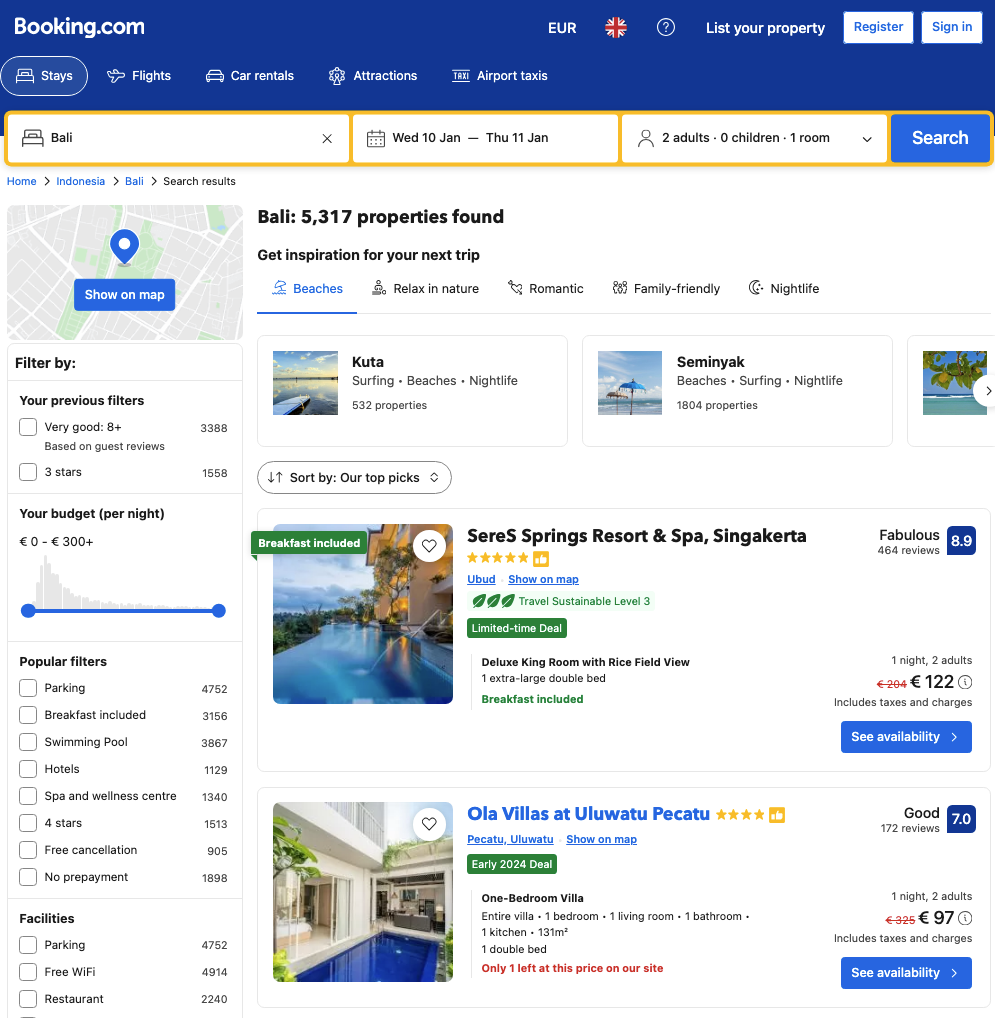

Являясь мировым лидером в индустрии онлайн-путешествий, Booking.com всегда ищет инновационные способы улучшения своих услуг и предоставления клиентам индивидуального и бесперебойного опыта. Команда по рейтингу Booking.com играет ключевую роль в оптимизации алгоритмов поиска и рекомендаций для достижения наилучших результатов для своих пользователей.

Совместно используя собственные ресурсы с другими внутренними командами, ученые из группы рейтингового машинного обучения (МО) часто сталкивались с длительным временем ожидания доступа к ресурсам для обучения моделей и экспериментов, что бросало вызов их способности быстро экспериментировать и внедрять инновации. Признавая необходимость модернизированной инфраструктуры машинного обучения, команда Ranking приступила к использованию возможностей Создатель мудреца Амазонки для создания, обучения и развертывания моделей машинного обучения в большом масштабе.

Booking.com сотрудничал с Профессиональные услуги AWS разработать решение для ускорения вывода на рынок улучшенных моделей машинного обучения за счет следующих улучшений:

- Сокращение времени ожидания ресурсов для обучения и экспериментирования.

- Интеграция основных возможностей машинного обучения, таких как настройка гиперпараметров.

- Сокращенный цикл разработки моделей ML

Сокращение времени ожидания будет означать, что команда сможет быстро выполнять итерации и экспериментировать с моделями, получая ценную информацию гораздо быстрее. Использование доступных экземпляров SageMaker по требованию позволило сократить время ожидания в десять раз. Основные возможности машинного обучения, такие как настройка гиперпараметров и объяснимость модели, отсутствовали локально. В ходе модернизации команда представила эти функции посредством Автоматическая настройка моделей Amazon SageMaker и Amazon SageMaker Уточнить. Наконец, целью команды было получать немедленную обратную связь по каждому изменению, внесенному в код, сокращая цикл обратной связи с минут до мгновения и тем самым сокращая цикл разработки моделей ML.

В этом посте мы подробно расскажем о путешествии, пройденном командой рейтинга Booking.com, когда они использовали возможности SageMaker для модернизации своей системы экспериментов с машинным обучением. Тем самым они не только преодолели существующие проблемы, но и улучшили качество поиска, что в конечном итоге принесло пользу миллионам путешественников по всему миру.

Подход к модернизации

Команда рейтинга состоит из нескольких ученых МО, каждому из которых необходимо разработать и протестировать свою собственную модель в автономном режиме. Если модель признана успешной по результатам автономной оценки, ее можно перенести на серийное A/B-тестирование. Если он покажет улучшение в режиме онлайн, его можно будет распространить на всех пользователей.

Целью этого проекта было создание удобной для пользователя среды, позволяющей ученым в области ML легко запускать настраиваемые Конвейеры построения моделей Amazon SageMaker проверять свои гипотезы без необходимости писать длинные и сложные модули.

Одной из нескольких стоящих задач была адаптация существующего локального конвейерного решения для использования на AWS. Решение включало два ключевых компонента:

- Модификация и расширение существующего кода – Первая часть нашего решения включала модификацию и расширение существующего кода, чтобы сделать его совместимым с инфраструктурой AWS. Это имело решающее значение для обеспечения плавного перехода от локальной обработки к облачной.

- Разработка клиентского пакета – Был разработан клиентский пакет, который действует как оболочка API SageMaker и ранее существовавшего кода. Этот пакет объединяет оба подхода, позволяя специалистам по машинному обучению легко настраивать и развертывать конвейеры машинного обучения без написания кода.

Конфигурация конвейера SageMaker

Возможность настройки является ключом к процессу построения моделей, и это было достигнуто за счет config.ini, обширный файл конфигурации. Этот файл служит центром управления всеми входными данными и поведением конвейера.

Доступные конфигурации внутри config.ini следующие:

- Детали трубопровода – Практик может определить имя конвейера, указать, какие шаги следует выполнять, определить, где результаты должны храниться. Простой сервис хранения Amazon (Amazon S3) и выберите, какие наборы данных использовать.

- Данные учетной записи AWS – Вы можете решить, в каком регионе должен работать конвейер и какую роль следует использовать.

- Индивидуальная конфигурация – Для каждого шага конвейера вы можете указать такие детали, как количество и тип используемых экземпляров, а также соответствующие параметры.

Следующий код показывает пример файла конфигурации:

config.ini — это файл с контролем версий, управляемый Git, представляющий минимальную конфигурацию, необходимую для успешного запуска конвейера обучения. Во время разработки можно использовать локальные файлы конфигурации, для которых не существует контроля версий. Эти локальные файлы конфигурации должны содержать только настройки, относящиеся к конкретному запуску, что обеспечивает гибкость без сложностей. Клиент создания конвейера предназначен для обработки нескольких файлов конфигурации, причем последний из них имеет приоритет над предыдущими настройками.

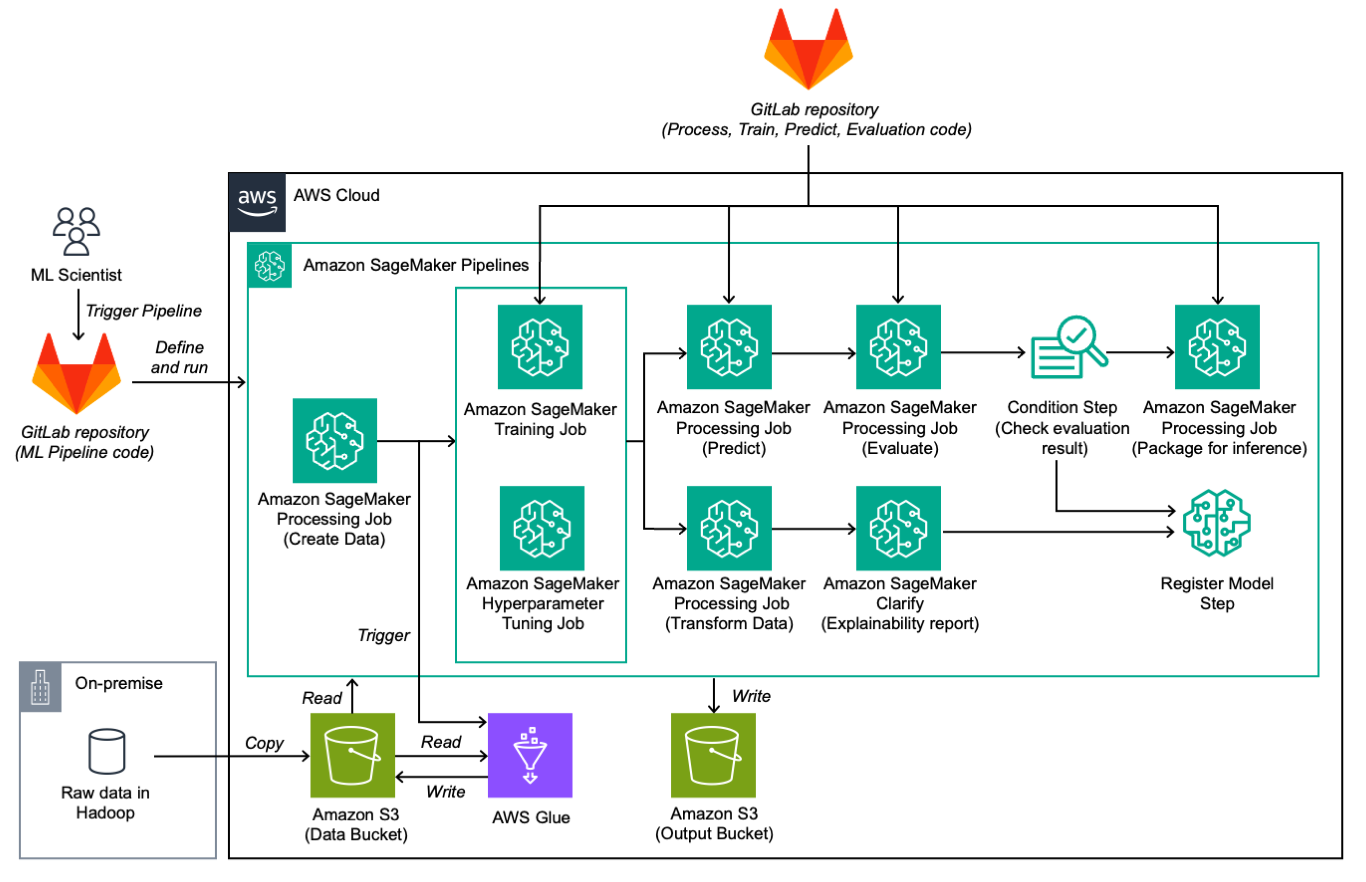

Этапы конвейера SageMaker

Трубопровод разделен на следующие этапы:

- Подготовка обучающих и тестовых данных – Терабайты необработанных данных копируются в корзину S3 и обрабатываются с помощью Клей AWS задания для обработки Spark, в результате чего данные структурируются и форматируются для совместимости.

- Train – На этапе обучения используется оценщик TensorFlow для заданий обучения SageMaker. Обучение происходит распределенным образом с использованием Horovod, а полученный артефакт модели сохраняется в Amazon S3. Для настройки гиперпараметров можно запустить задание по оптимизации гиперпараметров (HPO), выбирая лучшую модель на основе целевой метрики.

- прогнозировать – На этом этапе задание обработки SageMaker использует артефакт сохраненной модели для прогнозирования. Этот процесс выполняется параллельно на доступных машинах, а результаты прогнозирования сохраняются в Amazon S3.

- Оценивать – Задание обработки PySpark оценивает модель с помощью специального сценария Spark. Отчет об оценке затем сохраняется в Amazon S3.

- состояние – После оценки принимается решение о качестве модели. Это решение основано на метрике состояния, определенной в файле конфигурации. При положительной оценке модель регистрируется как одобренная; в противном случае оно регистрируется как отклоненное. В обоих случаях отчет об оценке и объяснительности, если он создан, записывается в реестр моделей.

- Модель пакета для вывода – При использовании задания обработки, если результаты оценки положительные, модель упаковывается, сохраняется в Amazon S3 и готовится к загрузке на внутренний портал ML.

- Объяснять – SageMaker Clarify создает отчет об объяснении.

Используются два разных репозитория. Первый репозиторий содержит определение и код сборки для конвейера машинного обучения, а второй репозиторий содержит код, который выполняется на каждом этапе, например обработке, обучении, прогнозировании и оценке. Такой подход с двумя репозиториями обеспечивает большую модульность и позволяет научным и инженерным группам независимо выполнять итерации над кодом ML и компонентами конвейера ML.

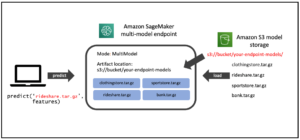

Следующая диаграмма иллюстрирует рабочий процесс решения.

Автоматическая настройка модели

Обучение моделей машинного обучения требует итеративного подхода, состоящего из нескольких обучающих экспериментов, для создания надежной и производительной конечной модели для использования в бизнесе. Ученые ML должны выбрать подходящий тип модели, построить правильные входные наборы данных и настроить набор гиперпараметров, которые управляют процессом обучения модели во время обучения.

Выбор подходящих значений гиперпараметров для процесса обучения модели может существенно повлиять на конечную производительность модели. Однако не существует уникального или определенного способа определить, какие значения подходят для конкретного варианта использования. Большую часть времени ученым МО придется запускать несколько заданий обучения с немного разными наборами гиперпараметров, наблюдать за показателями обучения модели, а затем пытаться выбрать более перспективные значения для следующей итерации. Этот процесс настройки производительности модели также известен как оптимизация гиперпараметров (HPO) и иногда может требовать сотен экспериментов.

Команда Ranking раньше выполняла HPO вручную в своей локальной среде, поскольку они могли параллельно запускать лишь очень ограниченное количество заданий по обучению. Поэтому им приходилось запускать HPO последовательно, тестировать и выбирать различные комбинации значений гиперпараметров вручную и регулярно отслеживать прогресс. Это продлило процесс разработки и настройки модели и ограничило общее количество экспериментов HPO, которые можно было провести в разумные сроки.

С переходом на AWS команда ранжирования получила возможность использовать функцию автоматической настройки модели (AMT) SageMaker. AMT позволяет ученым Ranking ML автоматически запускать сотни обучающих заданий в интересующих диапазонах гиперпараметров, чтобы найти наиболее эффективную версию окончательной модели в соответствии с выбранной метрикой. Команда ранжирования теперь может выбирать между четырьмя различными стратегиями автоматической настройки для выбора гиперпараметров:

- Поиск по сетке – AMT будет ожидать, что все гиперпараметры будут категориальными значениями, и запустит обучающие задания для каждой отдельной категориальной комбинации, исследуя все пространство гиперпараметров.

- Случайный поиск – AMT будет случайным образом выбирать комбинации значений гиперпараметров в пределах предоставленных диапазонов. Поскольку между различными заданиями обучения и выбором значений параметров нет зависимости, с помощью этого метода можно запускать несколько параллельных заданий обучения, что ускоряет процесс выбора оптимальных параметров.

- Байесовская оптимизация – AMT использует реализацию байесовской оптимизации, чтобы угадать лучший набор значений гиперпараметров, рассматривая это как задачу регрессии. Он будет учитывать ранее протестированные комбинации гиперпараметров и их влияние на задания по обучению модели с помощью нового выбора параметров, оптимизируя более разумный выбор параметров с меньшим количеством экспериментов, но также будет запускать задания по обучению только последовательно, чтобы всегда иметь возможность учиться на предыдущих тренировках.

- Гиперполоса – AMT будет использовать промежуточные и окончательные результаты выполняемых ею заданий обучения для динамического перераспределения ресурсов в пользу заданий обучения с конфигурациями гиперпараметров, которые показывают более многообещающие результаты, и автоматически останавливает те задания, которые неэффективны.

AMT на SageMaker позволил команде Ranking сократить время, затрачиваемое на процесс настройки гиперпараметров для разработки модели, впервые позволив им проводить несколько параллельных экспериментов, использовать стратегии автоматической настройки и выполнять двузначные обучающие задания в течение нескольких дней. то, что было невозможно в помещении.

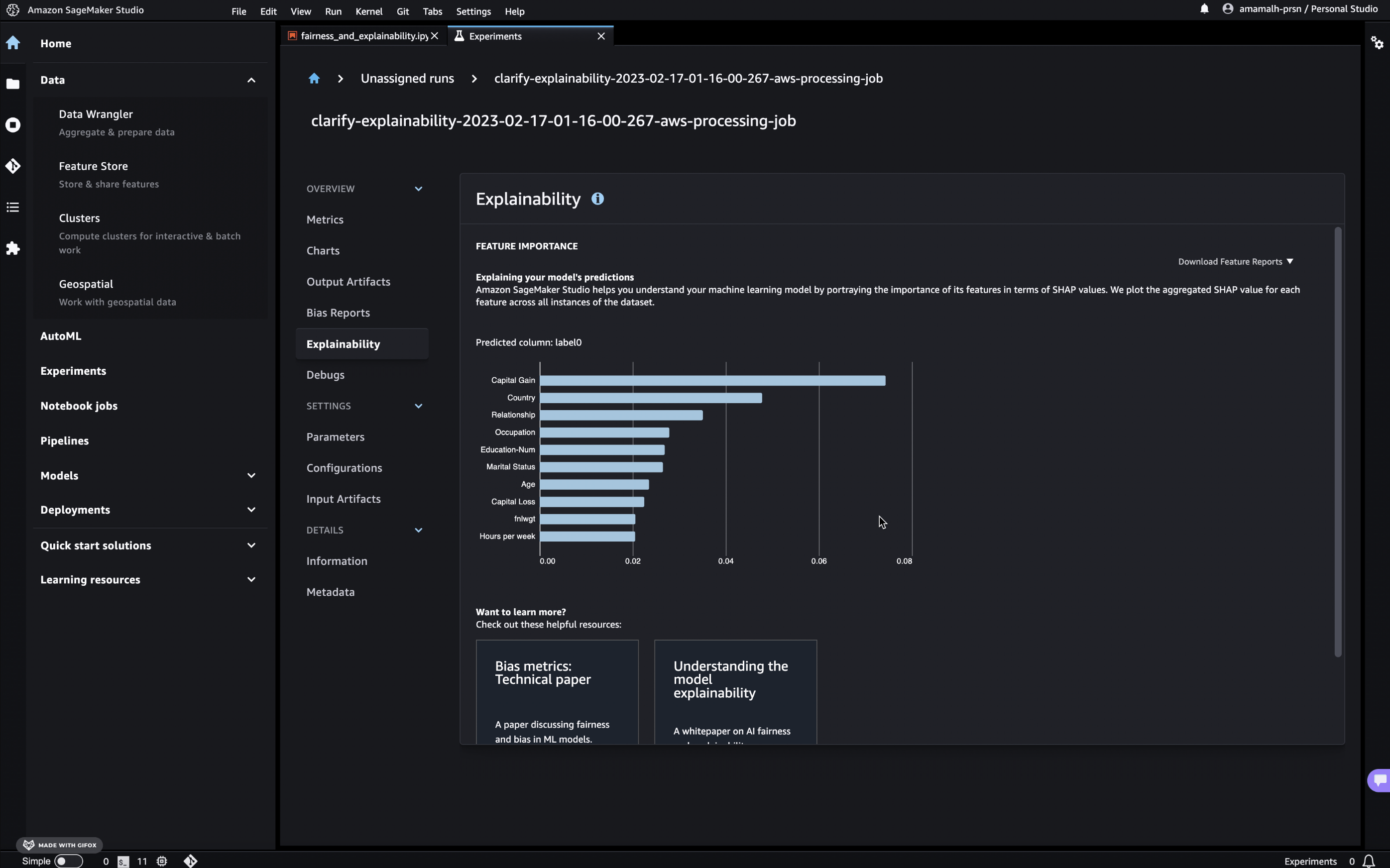

Объясняемость модели с помощью SageMaker Clarify

Объясняемость модели позволяет специалистам по машинному обучению понять природу и поведение своих моделей машинного обучения, предоставляя ценную информацию для разработки функций и принятия решений по выбору, что, в свою очередь, повышает качество прогнозов модели. Команда по ранжированию хотела оценить свои идеи объяснимости двумя способами: понять, как входные данные влияют на выходные данные модели по всему набору данных (глобальная интерпретируемость), а также иметь возможность обнаружить влияние входных функций на конкретный прогноз модели на интересующую точку данных ( локальная интерпретируемость). С помощью этих данных ученые Ranking ML могут принимать обоснованные решения о том, как еще улучшить производительность своей модели и учитывать сложные результаты прогнозирования, которые модель иногда дает.

SageMaker Clarify позволяет создавать отчеты о объяснимости модели, используя Пояснения к аддитивам Шепли (SHAP) при обучении ваших моделей в SageMaker, поддерживая интерпретируемость как глобальной, так и локальной модели. Помимо отчетов об объяснимости моделей, SageMaker Clarify поддерживает анализ показателей систематической ошибки до обучения, метрик систематической ошибки после обучения и графиков частичной зависимости. Задание будет запущено как задание обработки SageMaker в учетной записи AWS и напрямую интегрируется с конвейерами SageMaker.

Глобальный отчет о интерпретируемости будет автоматически создан в выходных данных задания и отображен в Студия Amazon SageMaker окружающей среды в рамках проведения обучающего эксперимента. Если эта модель затем будет зарегистрирована в реестре моделей SageMaker, отчет будет дополнительно связан с артефактом модели. Используя оба этих варианта, команда рейтинга смогла легко отследить различные версии модели и их изменения в поведении.

Чтобы изучить влияние входных характеристик на один прогноз (значения локальной интерпретируемости), команда ранжирования включила параметр save_local_shap_values в заданиях SageMaker Clarify и смог загрузить их из корзины S3 для дальнейшего анализа в блокнотах Jupyter в SageMaker Studio.

На предыдущих изображениях показан пример того, как будет выглядеть объяснимость модели для произвольной модели ML.

Оптимизация обучения

Рост глубокого обучения (ГО) привел к тому, что машинное обучение становится все более зависимым от вычислительных мощностей и огромных объемов данных. Специалисты по машинному обучению обычно сталкиваются с проблемой эффективного использования ресурсов при обучении этих сложных моделей. Когда вы запускаете обучение на больших вычислительных кластерах, при оптимизации использования ресурсов возникают различные проблемы, в том числе такие проблемы, как узкие места ввода-вывода, задержки запуска ядра, ограничения памяти и недостаточное использование ресурсов. Если конфигурация задания обучения не настроена на эффективность, эти препятствия могут привести к неоптимальному использованию оборудования, увеличению продолжительности обучения или даже неполным тренировочным запускам. Эти факторы увеличивают стоимость проекта и затягивают сроки.

Профилирование использования ЦП и ГП помогает понять эту неэффективность, определить потребление аппаратных ресурсов (времени и памяти) различными операциями TensorFlow в вашей модели, устранить узкие места в производительности и, в конечном итоге, ускорить работу модели.

Команда ранжирования использовала функцию профилирования платформы Amazon SageMaker Отладчик (сейчас устарело в пользу Профилировщик Amazon SageMaker), чтобы оптимизировать эти учебные задания. Это позволяет отслеживать все действия на процессорах и графических процессорах, такие как загрузка процессора и графического процессора, запуск ядра на графических процессорах, запуск ядра на процессорах, операции синхронизации, операции с памятью между графическими процессорами, задержки между запусками ядра и соответствующими запусками, а также передачу данных между процессорами. и графические процессоры.

Рейтинговая команда также использовала Профилировщик TensorFlow особенность Тензорборд, что дополнительно помогло профилировать обучение модели TensorFlow. SageMaker сейчас дополнительная интеграция с TensorBoard и переносит инструменты визуализации TensorBoard в SageMaker, интегрированные с обучением и доменами SageMaker. TensorBoard позволяет выполнять задачи отладки модели с помощью плагинов визуализации TensorBoard.

С помощью этих двух инструментов команда Ranking оптимизировала свою модель TensorFlow и смогла выявить узкие места и сократить среднее время этапа обучения с 350 миллисекунд до 140 миллисекунд на ЦП и со 170 миллисекунд до 70 миллисекунд на графическом процессоре, ускорение составило 60 %. и 59% соответственно.

Результаты бизнеса

Усилия по миграции были сосредоточены на повышении доступности, масштабируемости и эластичности, что в совокупности вывело среду машинного обучения на новый уровень эксплуатационного совершенства, примером чего является увеличение частоты обучения моделей и снижение количества сбоев, оптимизация времени обучения и расширенные возможности машинного обучения.

Частота и неудачи обучения модели

Количество ежемесячных заданий по обучению моделей увеличилось в пять раз, что привело к значительно более частой оптимизации моделей. Кроме того, новая среда машинного обучения привела к снижению частоты отказов при работе конвейера примерно с 50 % до 20 %. Время обработки неудачных заданий резко сократилось: в среднем с более часа до ничтожных 5 секунд. Это значительно повысило операционную эффективность и снизило потери ресурсов.

Оптимизированное время обучения

Миграция привела к повышению эффективности благодаря обучению графического процессора на базе SageMaker. Этот сдвиг сократил время обучения модели до пятой его предыдущей продолжительности. Раньше процессы обучения моделей глубокого обучения потребляли около 60 часов процессора; это время было сокращено примерно до 12 часов на графическом процессоре. Это улучшение не только экономит время, но и ускоряет цикл разработки, позволяя быстрее выполнять итерации и улучшать модели.

Расширенные возможности машинного обучения

Центральным фактором успеха миграции является использование набора функций SageMaker, включающего настройку гиперпараметров и объяснимость модели. Кроме того, миграция позволила беспрепятственно отслеживать эксперименты с помощью Эксперименты с Amazon SageMaker, что позволяет проводить более глубокие и продуктивные эксперименты.

Самое главное, новая среда экспериментов машинного обучения способствовала успешной разработке новой модели, которая сейчас находится в производстве. Эта модель представляет собой глубокое обучение, а не древовидную модель, и внесла заметные улучшения в производительность онлайн-модели.

Заключение

В этом посте представлен обзор сотрудничества AWS Professional Services и Booking.com, в результате которого была реализована масштабируемая платформа машинного обучения и успешно сокращено время вывода на рынок моделей машинного обучения их команды рейтинга.

Команда по рейтингу Booking.com узнала, что миграция в облако и SageMaker оказалась полезной и что адаптация методов машинного обучения (MLOps) позволяет инженерам и ученым по ML сосредоточиться на своем ремесле и увеличить скорость разработки. Команда делится знаниями и проделанной работой со всем сообществом ML на Booking.com посредством переговоров и специальных сессий с практиками ML, где они делятся кодом и возможностями. Мы надеемся, что этот пост послужит еще одним способом поделиться знаниями.

AWS Professional Services готова помочь вашей команде разработать масштабируемое и готовое к использованию машинное обучение в AWS. Для получения дополнительной информации см. Профессиональные услуги AWS или свяжитесь с вашим менеджером по работе с клиентами, чтобы связаться с вами.

Об авторах

Лоренс ван дер Маас — инженер по машинному обучению в AWS Professional Services. Он тесно сотрудничает с клиентами, создающими свои решения машинного обучения на AWS, специализируется на распределенном обучении, экспериментах и ответственном искусственном интеллекте, а также увлечен тем, как машинное обучение меняет мир, каким мы его знаем.

Лоренс ван дер Маас — инженер по машинному обучению в AWS Professional Services. Он тесно сотрудничает с клиентами, создающими свои решения машинного обучения на AWS, специализируется на распределенном обучении, экспериментах и ответственном искусственном интеллекте, а также увлечен тем, как машинное обучение меняет мир, каким мы его знаем.

Даниэль Загива является специалистом по данным в AWS Professional Services. Он специализируется на разработке масштабируемых решений машинного обучения промышленного уровня для клиентов AWS. Его опыт охватывает различные области, включая обработку естественного языка, генеративный искусственный интеллект и операции машинного обучения.

Даниэль Загива является специалистом по данным в AWS Professional Services. Он специализируется на разработке масштабируемых решений машинного обучения промышленного уровня для клиентов AWS. Его опыт охватывает различные области, включая обработку естественного языка, генеративный искусственный интеллект и операции машинного обучения.

Костя Кофман — старший менеджер по машинному обучению в Booking.com, возглавляет команду ML для поискового рейтинга и курирует самую обширную систему ML на Booking.com. Обладая опытом в области персонализации и ранжирования, он успешно использует передовые технологии для улучшения качества обслуживания клиентов.

Костя Кофман — старший менеджер по машинному обучению в Booking.com, возглавляет команду ML для поискового рейтинга и курирует самую обширную систему ML на Booking.com. Обладая опытом в области персонализации и ранжирования, он успешно использует передовые технологии для улучшения качества обслуживания клиентов.

Дженни Токар — старший инженер по машинному обучению в команде поискового рейтинга Booking.com. Она специализируется на разработке комплексных конвейеров машинного обучения, характеризующихся эффективностью, надежностью, масштабируемостью и инновациями. Опыт Дженни позволяет ее команде создавать передовые модели ранжирования, которые ежедневно обслуживают миллионы пользователей.

Дженни Токар — старший инженер по машинному обучению в команде поискового рейтинга Booking.com. Она специализируется на разработке комплексных конвейеров машинного обучения, характеризующихся эффективностью, надежностью, масштабируемостью и инновациями. Опыт Дженни позволяет ее команде создавать передовые модели ранжирования, которые ежедневно обслуживают миллионы пользователей.

Александра Докич — старший специалист по данным в AWS Professional Services. Ей нравится помогать клиентам создавать инновационные решения искусственного интеллекта и машинного обучения на AWS, и она воодушевлена трансформацией бизнеса с помощью возможностей данных.

Александра Докич — старший специалист по данным в AWS Professional Services. Ей нравится помогать клиентам создавать инновационные решения искусственного интеллекта и машинного обучения на AWS, и она воодушевлена трансформацией бизнеса с помощью возможностей данных.

Люба Процива является менеджером по взаимодействию в AWS Professional Services. Она специализируется на предоставлении решений для обработки данных и GenAI/ML, которые позволяют клиентам AWS максимизировать ценность своего бизнеса и ускорить внедрение инноваций.

Люба Процива является менеджером по взаимодействию в AWS Professional Services. Она специализируется на предоставлении решений для обработки данных и GenAI/ML, которые позволяют клиентам AWS максимизировать ценность своего бизнеса и ускорить внедрение инноваций.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- :имеет

- :является

- :нет

- :куда

- $UP

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- способность

- в состоянии

- О нас

- ускорять

- доступ

- По

- Учетная запись

- достигнутый

- через

- активно

- акты

- адаптация

- дополнение

- Дополнительно

- продвинутый

- влиять на

- После

- AI

- AI / ML

- алгоритмы

- Все

- разрешено

- позволяет

- вдоль

- причислены

- всегда

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- количество

- суммы

- an

- Анализ

- и

- Другой

- API

- подхода

- соответствующий

- утвержденный

- примерно

- произвольный

- МЫ

- области

- возникать

- около

- AS

- стремление

- At

- Автоматический

- автоматически

- свободных мест

- доступен

- в среднем

- AWS

- Профессиональные услуги AWS

- назад

- основанный

- байесовский

- BE

- , так как:

- становление

- поведение

- поведенческий

- поведения

- полезный

- пользу

- ЛУЧШЕЕ

- между

- смещение

- бронирование

- Booking.com

- изоферменты печени

- узкие

- Приносит

- принес

- строить

- Строительство

- бизнес

- но

- by

- CAN

- возможности

- случаев

- случаев

- Центр

- центр

- проблемы

- сложные

- изменение

- изменения

- изменения

- отличающийся

- Выберите

- выбранный

- клиент

- тесно

- облако

- код

- Кодирование

- сотрудничало

- сотрудничество

- коллективно

- COM

- сочетание

- комбинации

- комбинаты

- обычно

- сообщество

- совместимость

- совместим

- комплекс

- сложность

- сложный

- компоненты

- вычислительный

- вычислительная мощность

- Вычисление

- состояние

- Конфигурация

- Рассматривать

- состоит

- ограничения

- потребленный

- потребление

- содержать

- содержит

- контроль

- исправить

- соответствующий

- Расходы

- может

- выработать

- Создайте

- создание

- решающее значение

- изготовленный на заказ

- клиент

- Клиенты

- настраиваемый

- передовой

- передовые технологии

- цикл

- данным

- Подготовка данных

- ученый данных

- Наборы данных

- день

- Дней

- решать

- решение

- решения

- снизилась

- преданный

- считается

- глубоко

- глубокое обучение

- определять

- определенный

- определение

- задерживать

- задержки

- доставить

- доставки

- копаться

- зависимость

- Зависимость

- развертывание

- развернуть

- устарела

- предназначенный

- подробнее

- Определять

- развивать

- развитый

- развивающийся

- Развитие

- диаграмма

- различный

- непосредственно

- обнаружить

- отображается

- отчетливый

- распределенный

- распределенное обучение

- Разделенный

- дело

- доменов

- сделанный

- кардинально

- Опустившись

- продолжительность

- в течение

- динамично

- каждый

- легко

- затрат

- эффективно

- усилия

- приступили к

- Наделяет

- включить

- включен

- позволяет

- позволяет

- охватывая

- впритык

- обязательство

- инженер

- Проект и

- Инженеры

- повышать

- повышение

- обеспечение

- Весь

- Окружающая среда

- эпохи

- существенный

- оценивать

- оценка

- Даже

- Каждая

- каждый день

- пример

- Превосходство

- возбужденный

- в качестве примера

- существующий

- ожидать

- ускоряет

- опыт

- Впечатления

- эксперимент

- Эксперименты

- опыта

- Объяснять

- Больше

- Исследование

- простирающийся

- продолжается

- расширение

- обширный

- Face

- сталкиваются

- факторы

- Oшибка

- Ошибка

- сбои

- ложный

- быстрее

- в пользу

- выполнимый

- Особенность

- Особенности

- Обратная связь

- меньше

- Файл

- Файлы

- окончательный

- в заключение

- Найдите

- Во-первых,

- Впервые

- Трансформируемость

- Фокус

- после

- Что касается

- 4

- Рамки

- частота

- частое

- от

- далее

- Более того

- получение

- порождать

- генерируется

- генерирует

- генеративный

- Генеративный ИИ

- получить

- идти

- Глобальный

- цель

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- большой

- догадываться

- было

- обрабатывать

- Аппаратные средства

- запряженный

- Есть

- he

- помощь

- помог

- помогает

- ее

- его

- надежды

- час

- ЧАСЫ

- Как

- How To

- Однако

- HTML

- HTTP

- HTTPS

- Сотни

- препятствие

- Оптимизация гиперпараметра

- Настройка гиперпараметра

- определения

- if

- иллюстрирует

- изображений

- немедленная

- Влияние

- реализация

- важно

- улучшать

- улучшенный

- улучшение

- улучшение

- улучшается

- in

- включают

- В том числе

- Увеличение

- расширились

- Увеличивает

- все больше и больше

- самостоятельно

- промышленность

- неэффективность

- повлиять

- информация

- сообщил

- Инфраструктура

- начатый

- обновлять

- Инновации

- инновационный

- вход

- затраты

- внутри

- проницательный

- размышления

- мгновение

- интегрированный

- Интегрируется

- интерес

- в нашей внутренней среде,

- в

- выпустили

- введение

- вовлеченный

- вопросы

- IT

- итерация

- итерации

- ЕГО

- работа

- Джобс

- путешествие

- JPG

- Основные

- Знать

- знания

- известный

- недостающий

- язык

- большой

- последний

- запуск

- запустили

- запускает

- лидер

- ведущий

- УЧИТЬСЯ

- узнали

- изучение

- привело

- уровень

- Используя

- такое как

- Ограниченный

- связанный

- загрузка

- локальным

- Длинное

- посмотреть

- выглядит как

- машина

- обучение с помощью машины

- Продукция

- сделанный

- сделать

- управляемого

- менеджер

- способ

- вручную

- Максимизировать

- значить

- Память

- метод

- метрический

- Метрика

- мигрирующий

- миграция

- миллионы

- миллисекунды

- минимальный

- Минут

- ML

- млн операций в секунду

- модель

- Модели

- модернизировать

- Модули

- монитор

- ежемесячно

- БОЛЕЕ

- самых

- двигаться

- переехал

- много

- с разными

- имя

- натуральный

- Обработка естественного языка

- природа

- Необходимость

- Новые

- следующий

- нет

- сейчас

- номер

- цель

- наблюдать

- препятствиями

- of

- оффлайн

- .

- on

- On-Demand

- ONE

- онлайн

- только

- оперативный

- Операционный отдел

- оптимальный

- оптимизация

- оптимизации

- Оптимизировать

- оптимизированный

- оптимизирующий

- Опции

- or

- Другое

- в противном случае

- наши

- внешний

- выходной

- выходы

- за

- общий

- контроль

- обзор

- собственный

- Темп

- пакет

- в упаковке

- Параллельные

- параметр

- часть

- страстный

- Выполнять

- производительность

- выполнения

- воплощение

- трубопровод

- основной

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- играет

- плагины

- Точка

- Портал

- положительный

- После

- мощностью

- практиками

- предшествующий

- предсказывать

- прогноз

- Predictions

- подготовка

- предыдущий

- предварительно

- Проблема

- процесс

- Обработанный

- Процессы

- обработка

- Производство

- производительный

- профессиональный

- Профиль

- профилирование

- Прогресс

- Проект

- многообещающий

- доказанный

- обеспечивать

- при условии

- обеспечение

- быстро

- диапазоны

- Ранжирование

- быстро

- Обменный курс

- скорее

- Сырье

- достигать

- готовый

- Получать

- признавая

- Рекомендация

- записанный

- уменьшить

- Цена снижена

- снижение

- снижение

- по

- область

- зарегистрироваться

- зарегистрированный

- реестра

- регулярно

- Отклоненный..

- соответствующие

- надежность

- отчету

- Отчеты

- хранилище

- представляющий

- требовать

- обязательный

- требуется

- решение

- ресурс

- Полезные ресурсы

- соответственно

- ответственный

- результат

- в результате

- Итоги

- Рост

- надежный

- Роли

- Run

- Бег

- работает

- sagemaker

- Конвейеры SageMaker

- Масштабируемость

- масштабируемые

- Шкала

- Наука

- Ученый

- Ученые

- скрипт

- бесшовные

- Поиск

- Во-вторых

- секунды

- посмотреть

- поиск

- выберите

- выбор

- выбор

- старший

- служить

- служит

- Услуги

- сессиях

- набор

- Наборы

- настройки

- несколько

- Поделиться

- разделение

- она

- сдвиг

- должен

- показывать

- Шоу

- существенно

- просто

- одинарной

- немного отличается

- умнее

- сгладить

- So

- Решение

- Решения

- удалось

- Space

- Искриться

- специализируется

- конкретный

- скорость

- потраченный

- Шаг

- Шаги

- остановка

- диск

- хранить

- стратегий

- обтекаемый

- сильно

- структурированный

- студия

- неоптимальным

- успех

- успешный

- Успешно

- такие

- Поддержанный

- поддержки

- Поддержка

- синхронизации.

- система

- с учетом

- с

- переговоры

- задачи

- команда

- команды

- Технологии

- tensorflow

- тестXNUMX

- проверенный

- Тестирование

- чем

- который

- Ассоциация

- мир

- их

- Их

- тогда

- Там.

- тем самым

- следовательно

- Эти

- они

- этой

- те

- процветает

- Через

- время

- сроки

- раз

- в

- инструменты

- трогать

- к

- трек

- Отслеживание

- Train

- Обучение

- тренинги

- перевод

- преобразований

- переход

- путешествовать

- индустрии туризма

- путешественники

- лечения

- правда

- стараться

- настройка

- ОЧЕРЕДЬ

- два

- напишите

- В конечном счете

- понимать

- созданного

- Применение

- использование

- прецедент

- используемый

- удобно

- пользователей

- использования

- через

- использовать

- ценный

- ценностное

- Наши ценности

- различный

- Огромная

- Скорость

- версия

- версии

- очень

- визуализация

- ждать

- стремятся

- законопроект

- Путь..

- способы

- we

- Web

- веб-сервисы

- были

- когда

- который

- в то время как

- КТО

- будете

- в

- без

- Работа

- рабочий

- работает

- Мир

- по всему миру

- бы

- Ты

- ВАШЕ

- зефирнет