Это гостевой пост, написанный совместно с командой Meta PyTorch и являющийся продолжением Часть 1 этой серии, где мы демонстрируем производительность и простоту запуска PyTorch 2.0 на AWS.

Исследования машинного обучения (ML) доказали, что большие языковые модели (LLM), обученные на значительно больших наборах данных, приводят к повышению качества модели. За последние несколько лет размер моделей текущего поколения значительно увеличился, и для их эффективного и масштабного обучения требуются современные инструменты и инфраструктура. PyTorch Distributed Data Parallelism (DDP) помогает обрабатывать данные в масштабе простым и надежным способом, но требует, чтобы модель помещалась на одном графическом процессоре. Библиотека PyTorch Fully Sharded Data Parallel (FSDP) преодолевает этот барьер, позволяя сегментировать модели для обучения больших моделей с помощью исполнителей, работающих с параллельными данными.

Для обучения распределенной модели требуется кластер рабочих узлов, который можно масштабировать. Амазон Эластик Кубернетес Сервис (Amazon EKS) — это популярный сервис, совместимый с Kubernetes, который значительно упрощает процесс выполнения рабочих нагрузок AI/ML, делая его более управляемым и менее трудоемким.

В этом сообщении блога AWS сотрудничает с командой Meta PyTorch, чтобы обсудить, как использовать библиотеку PyTorch FSDP для достижения линейного масштабирования моделей глубокого обучения на AWS с помощью Amazon EKS и Контейнеры глубокого обучения AWS (Дополнения). Мы демонстрируем это посредством пошаговой реализации обучения моделей Llama7 13B, 70B и 2B с использованием Amazon EKS с 16 Эластичное вычислительное облако Amazon (Амазон EC2) p4de.24xlarge экземпляры (каждый с 8 графическими процессорами NVIDIA A100 Tensor Core и каждый графический процессор с 80 ГБ памяти HBM2e) или 16 EC2 p5.48xбольшой экземпляров (каждый из которых оснащен 8 графическими процессорами NVIDIA H100 с тензорными ядрами и каждый графический процессор с 80 ГБ памяти HBM3), обеспечивая почти линейное масштабирование пропускной способности и, в конечном итоге, сокращая время обучения.

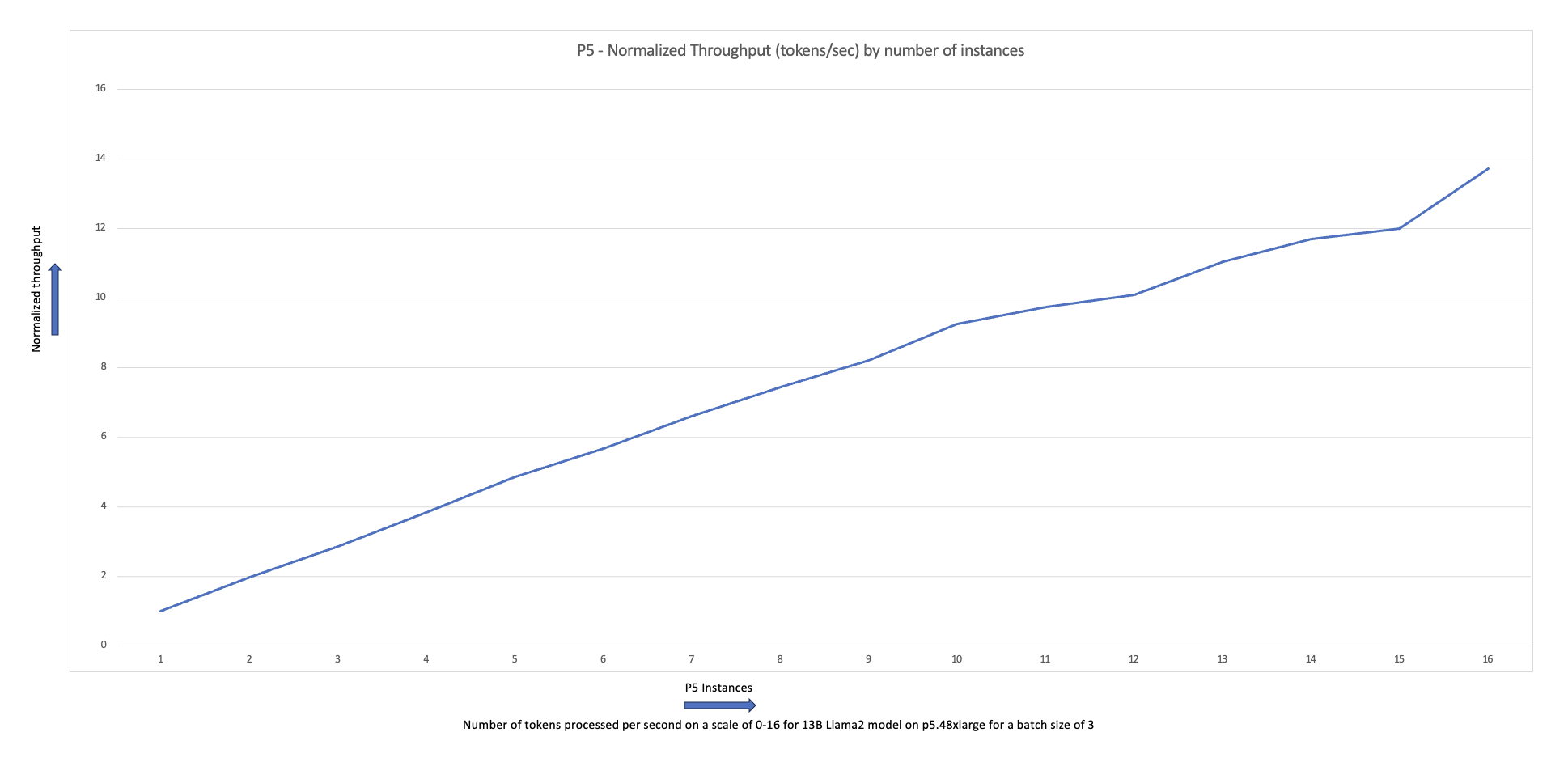

На следующей диаграмме масштабирования показано, что экземпляры p5.48xlarge обеспечивают эффективность масштабирования 87 % при точной настройке FSDP Llama2 в конфигурации кластера с 16 узлами.

Проблемы подготовки LLM

Компании все чаще используют LLM для решения ряда задач, включая виртуальных помощников, перевод, создание контента и компьютерное зрение, чтобы повысить эффективность и точность в различных приложениях.

Однако обучение или тонкая настройка этих больших моделей для индивидуального варианта использования требует большого объема данных и вычислительной мощности, что увеличивает общую инженерную сложность стека машинного обучения. Это также связано с ограниченностью памяти, доступной на одном графическом процессоре, что ограничивает размер модели, которую можно обучать, а также ограничивает размер пакета для каждого графического процессора, используемого во время обучения.

Для решения этой проблемы используются различные методы параллелизма моделей, такие как DeepSpeed Zero и PyTorch ФСДП были созданы, чтобы позволить вам преодолеть этот барьер ограниченной памяти графического процессора. Это достигается путем применения метода параллельного разделения данных, при котором каждый ускоритель содержит только срез (кусок данных). Осколок) реплики модели, а не всей реплики модели, что значительно сокращает объем памяти, занимаемой обучающим заданием.

В этом посте показано, как можно использовать PyTorch FSDP для точной настройки модели Llama2 с помощью Amazon EKS. Мы достигаем этого за счет масштабирования вычислительных мощностей и мощности графического процессора в соответствии с требованиями модели.

Обзор ФСДП

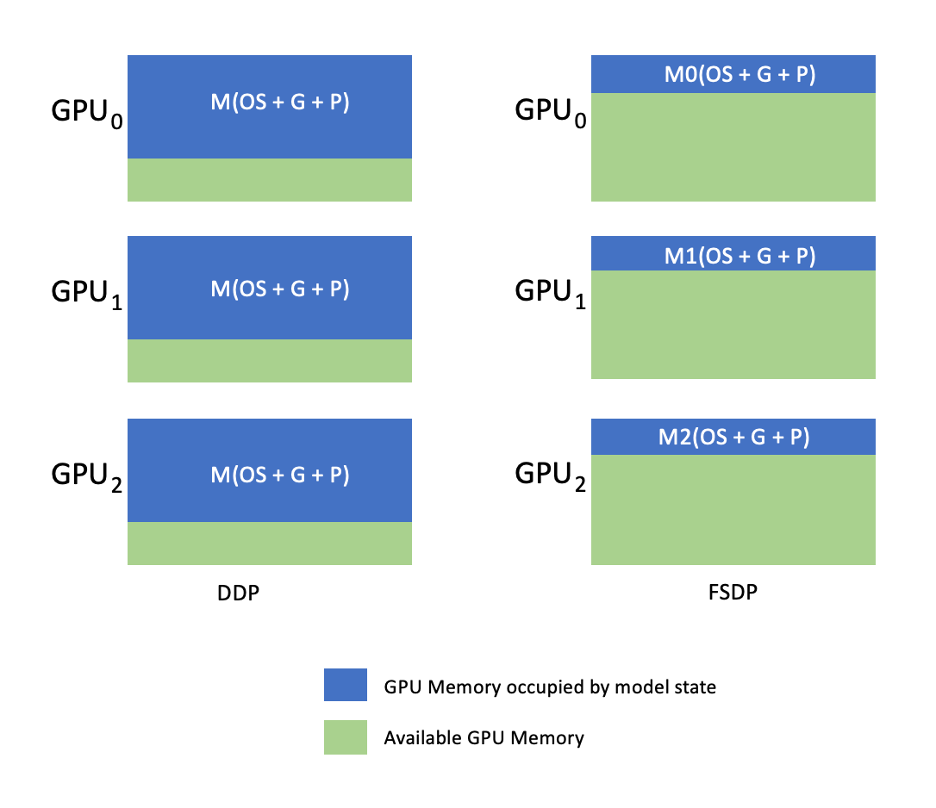

При обучении PyTorch DDP каждый графический процессор (называемый работник в контексте PyTorch) содержит полную копию модели, включая веса модели, градиенты и состояния оптимизатора. Каждый рабочий процесс обрабатывает пакет данных и в конце обратного прохода использует полностью сократить операция синхронизации градиентов между разными работниками.

Наличие копии модели на каждом графическом процессоре ограничивает размер модели, которую можно включить в рабочий процесс DDP. FSDP помогает преодолеть это ограничение за счет сегментирования параметров модели, состояний оптимизатора и градиентов между обработчиками параллельных данных, сохраняя при этом простоту параллелизма данных.

Это показано на следующей диаграмме, где в случае DDP каждый графический процессор хранит полную копию состояния модели, включая состояние оптимизатора (ОС), градиенты (G) и параметры (P): M(OS + G + П). В FSDP каждый графический процессор хранит только часть состояния модели, включая состояние оптимизатора (ОС), градиенты (G) и параметры (P): M (ОС+Г+П). Использование FSDP приводит к значительно меньшему использованию памяти графического процессора по сравнению с DDP для всех рабочих, что позволяет обучать очень большие модели или использовать пакеты большего размера для учебных заданий.

Однако это происходит за счет увеличения накладных расходов на связь, которые смягчаются за счет оптимизации FSDP, такой как перекрытие процессов связи и вычислений с такими функциями, как предварительная загрузка. Для получения более подробной информации см. Начало работы с полностью сегментированным параллелизмом данных (FSDP).

FSDP предлагает различные параметры, которые позволяют вам настроить производительность и эффективность ваших учебных заданий. Некоторые из ключевых особенностей и возможностей FSDP включают в себя:

- Политика упаковки трансформаторов

- Гибкая смешанная точность

- Контрольная точка активации

- Различные стратегии шардинга для разных скоростей сети и топологий кластера:

- FULL_SHARD – Параметры модели шарда, градиенты и состояния оптимизатора.

- ГИБРИД_ШАРД – Полный шард внутри узла DDP между узлами; поддерживает гибкую группу шардинга для полной копии модели (HSDP)

- SHARD_GRAD_OP – Шардирование только градиентов и состояний оптимизатора

- NO_SHARD – Аналогично ДДП

Дополнительную информацию о FSDP см. Эффективное крупномасштабное обучение с помощью Pytorch FSDP и AWS.

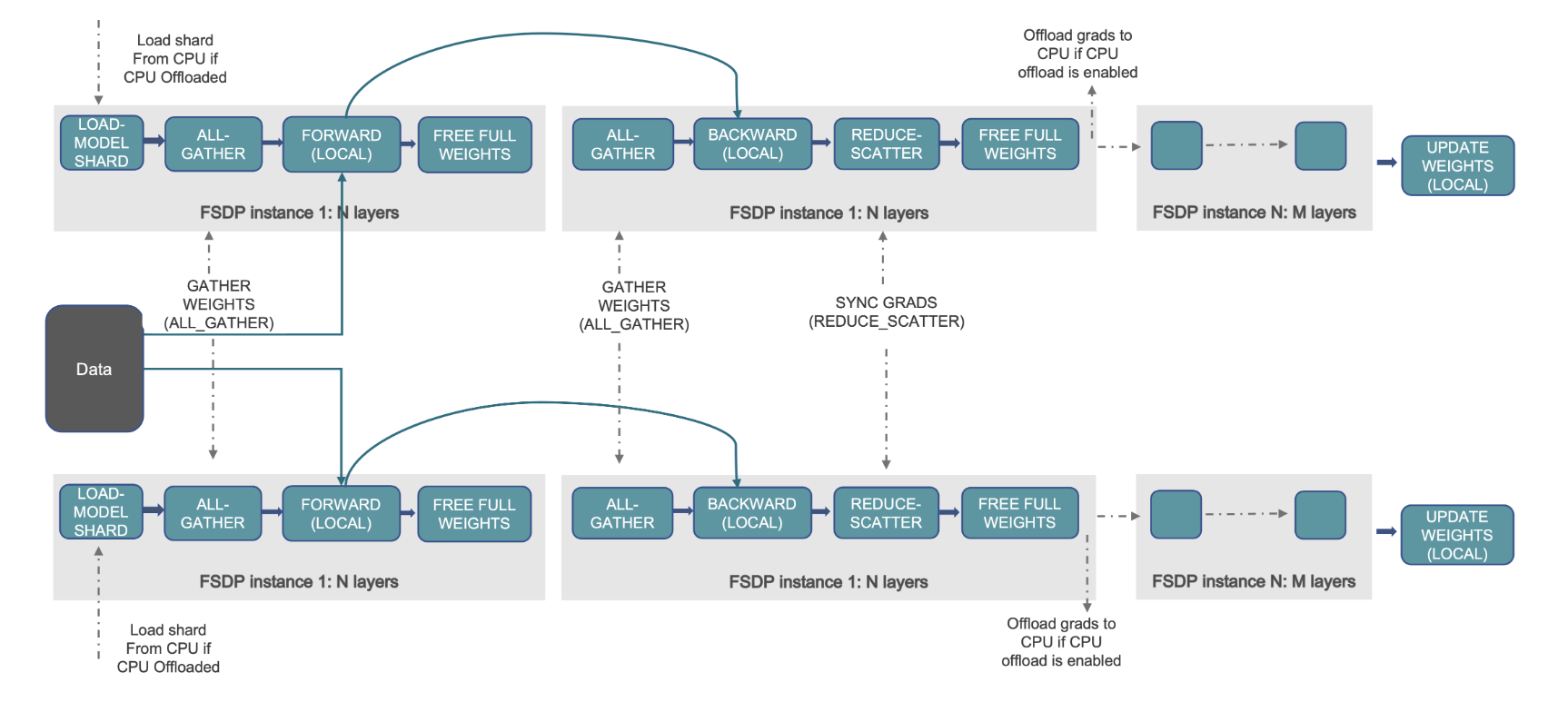

На следующем рисунке показано, как FSDP работает для двух параллельных процессов обработки данных.

Обзор решения

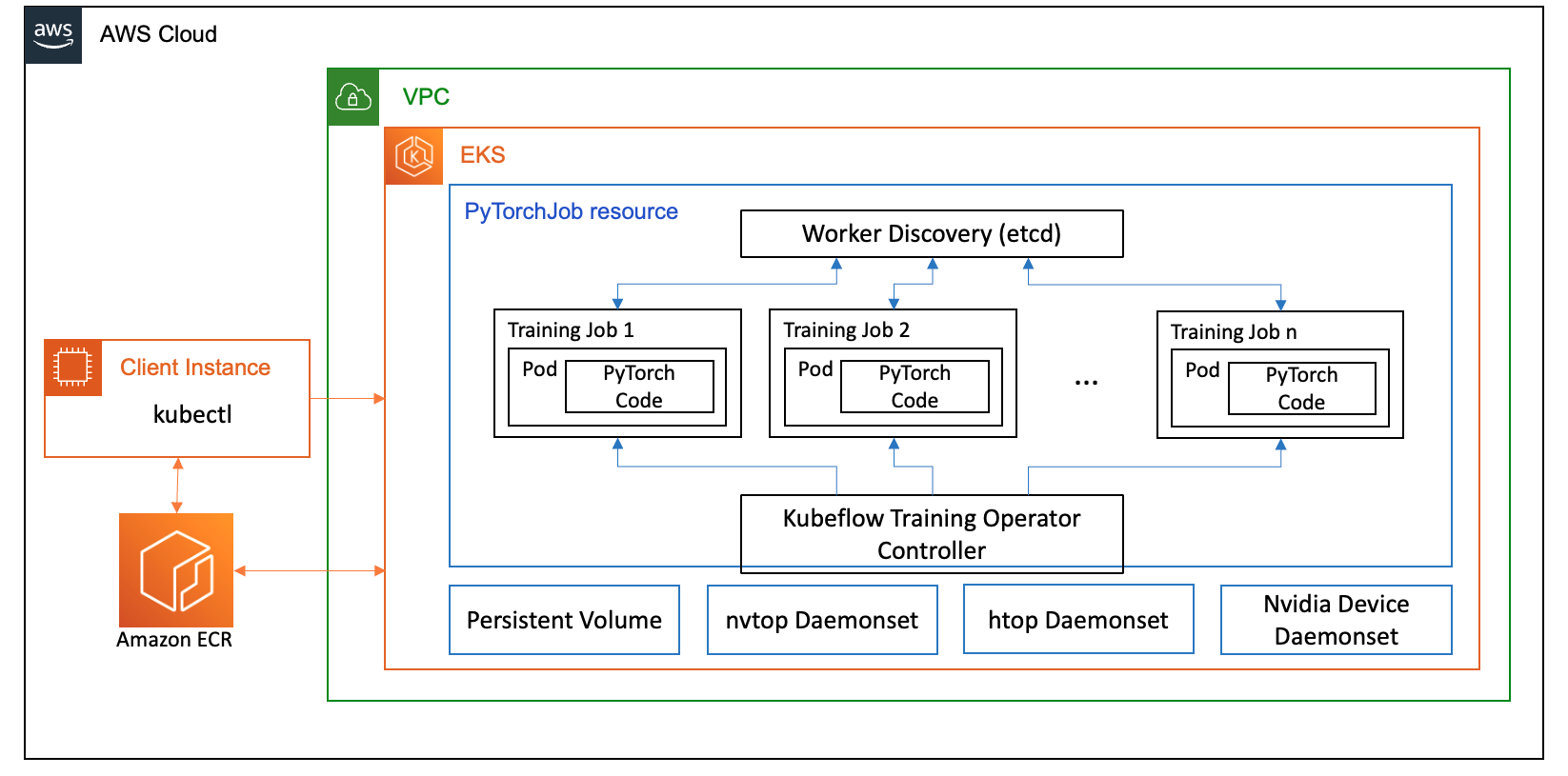

В этой статье мы настроили вычислительный кластер с помощью Amazon EKS — управляемого сервиса для запуска Kubernetes в облаке AWS и локальных центрах обработки данных. Многие клиенты используют Amazon EKS для запуска рабочих нагрузок искусственного интеллекта и машинного обучения на базе Kubernetes, пользуясь преимуществами его производительности, масштабируемости, надежности и доступности, а также его интеграцией с сетевыми службами, службами безопасности и другими сервисами AWS.

Для нашего варианта использования FSDP мы используем Оператор обучения Kubeflow на Amazon EKS — собственном проекте Kubernetes, который упрощает тонкую настройку и масштабируемое распределенное обучение для моделей машинного обучения. Он поддерживает различные платформы машинного обучения, включая PyTorch, который можно использовать для развертывания учебных заданий PyTorch и управления ими в любом масштабе.

Используя специальный ресурс PyTorchJob оператора обучения Kubeflow, мы запускаем задания обучения в Kubernetes с настраиваемым количеством рабочих реплик, что позволяет нам оптимизировать использование ресурсов.

Ниже приведены несколько компонентов обучающего оператора, которые играют роль в нашем сценарии использования точной настройки Llama2:

- Централизованный контроллер Kubernetes, который организует распределенные задания обучения для PyTorch.

- PyTorchJob — специальный ресурс Kubernetes для PyTorch, предоставляемый оператором обучения Kubeflow для определения и развертывания учебных заданий Llama2 в Kubernetes.

- etcd, который связан с реализацией механизма рандеву для координации распределенного обучения моделей PyTorch. Этот

etcdСервер как часть процесса рандеву облегчает координацию и синхронизацию участвующих работников во время распределенного обучения.

Следующая диаграмма иллюстрирует архитектуру решения.

Большая часть деталей будет абстрагирована сценариями автоматизации, которые мы используем для запуска примера Llama2.

В этом случае мы используем следующие ссылки на код:

Что такое Лама2?

Llama2 — это LLM, предварительно обученный на 2 триллионах токенов текста и кода. Это один из крупнейших и наиболее мощных LLM, доступных сегодня. Вы можете использовать Llama2 для решения различных задач, включая обработку естественного языка (NLP), генерацию текста и перевод. Для получения дополнительной информации см. Начало работы с Ламой.

Llama2 доступен в трех различных размерах модели:

- Лама2-70б – Это самая большая модель Llama2, с 70 миллиардами параметров. Это самая мощная модель Llama2, которую можно использовать для решения самых сложных задач.

- Лама2-13б – Это модель Llama2 среднего размера, с 13 миллиардами параметров. Это хороший баланс между производительностью и эффективностью, и его можно использовать для решения самых разных задач.

- Лама2-7б – Это самая маленькая модель Llama2, с 7 миллиардами параметров. Это наиболее эффективная модель Llama2, которую можно использовать для задач, не требующих высочайшего уровня производительности.

Этот пост позволит вам точно настроить все эти модели на Amazon EKS. Чтобы обеспечить простой и воспроизводимый процесс создания кластера EKS и выполнения на нем заданий FSDP, мы используем метод оу-до-экс проект. Этот пример также будет работать с уже существующим кластером EKS.

Сценарий прохождения доступен на GitHub для нестандартного опыта. В следующих разделах мы объясним этот сквозной процесс более подробно.

Предоставление инфраструктуры решения

Для экспериментов, описанных в этом посте, мы используем кластеры с узлами p4de (графический процессор A100) и p5 (графический процессор H100).

Кластер с узлами p4de.24xlarge

Для нашего кластера с узлами p4de мы используем следующее экс-gpu-p4de-odcr.yaml сценарий:

. эксктл и предыдущий манифест кластера, мы создаем кластер с узлами p4de:

Кластер с узлами p5.48xlarge

Шаблон terraform для кластера EKS с узлами P5 находится по следующему адресу. Репо GitHub.

Вы можете настроить кластер через переменные.tf файл, а затем создайте его через Terraform CLI:

Проверить доступность кластера можно, выполнив простую команду kubectl:

Кластер работоспособен, если выходные данные этой команды показывают ожидаемое количество узлов в состоянии готовности.

Предварительные условия развертывания

Чтобы запустить FSDP на Amazon EKS, мы используем команду PyTorchJob пользовательский ресурс. Это требует и т. д. и Оператор обучения Kubeflow в качестве предпосылок.

Разверните etcd с помощью следующего кода:

Разверните оператор обучения Kubeflow с помощью следующего кода:

Создайте и отправьте образ контейнера FSDP в Amazon ECR.

Используйте следующий код, чтобы создать образ контейнера FSDP и отправить его в Реестр Amazon Elastic Container (Амазон ЭКР):

Создайте манифест FSDP PyTorchJob.

Вставьте ваши Жетон «Обнимающее лицо» в следующем фрагменте перед его запуском:

Настройте свой PyTorchJob с помощью .env файл или непосредственно в переменных среды, как показано ниже:

Создайте манифест PyTorchJob, используя шаблон фсдп и генерировать.sh скрипт или создайте его напрямую, используя скрипт ниже:

Запустите PyTorchJob

Запустите PyTorchJob со следующим кодом:

Вы увидите указанное количество созданных рабочих модулей FDSP, и после получения образа они перейдут в состояние «Выполняется».

Чтобы увидеть статус PyTorchJob, используйте следующий код:

Чтобы остановить PyTorchJob, используйте следующий код:

После завершения задания его необходимо удалить перед началом нового запуска. Мы также заметили, что удалениеetcdpod и позволив ему перезапуститься перед запуском нового задания, помогает избежать RendezvousClosedError.

Масштабируйте кластер

Вы можете повторить предыдущие шаги по созданию и запуску заданий, изменяя количество и тип экземпляров рабочих узлов в кластере. Это позволяет создавать диаграммы масштабирования, подобные показанной ранее. В целом вы должны увидеть уменьшение объема памяти графического процессора, сокращение времени периода и увеличение пропускной способности при добавлении большего количества узлов в кластер. Предыдущая диаграмма была создана путем проведения нескольких экспериментов с использованием группы узлов p5 размером от 1 до 16 узлов.

Наблюдайте за учебной нагрузкой FSDP

Наблюдение за рабочими нагрузками генеративного искусственного интеллекта важно для обеспечения видимости выполняемых заданий, а также для помощи в максимальном использовании ваших вычислительных ресурсов. В этом посте мы используем для этой цели несколько собственных инструментов наблюдения Kubernetes и инструментов с открытым исходным кодом. Эти инструменты позволяют отслеживать ошибки, статистику и моделировать поведение, что делает наблюдаемость ИИ важнейшей частью любого варианта использования в бизнесе. В этом разделе мы показываем различные подходы к наблюдению за учебными заданиями FSDP.

Журналы рабочих модулей

На самом базовом уровне вам необходимо иметь возможность видеть журналы ваших тренировочных модулей. Это можно легко сделать с помощью собственных команд Kubernetes.

Сначала получите список модулей и найдите имя того, для которого вы хотите просмотреть журналы:

Затем просмотрите журналы выбранного модуля:

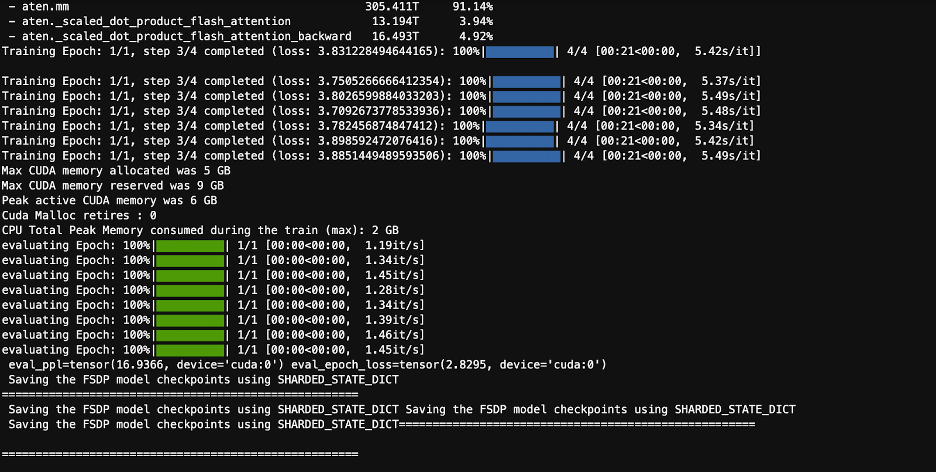

Только один журнал модуля работника (избранного лидера) будет отображать общую статистику работы. Имя избранного модуля-лидера доступно в начале журнала каждого рабочего модуля и идентифицируется ключом master_addr=.

Использование ЦП

Рабочие нагрузки распределенного обучения требуют ресурсов как ЦП, так и графического процессора. Чтобы оптимизировать эти рабочие нагрузки, важно понимать, как используются эти ресурсы. К счастью, доступно несколько замечательных утилит с открытым исходным кодом, которые помогают визуализировать загрузку процессора и графического процессора. Для просмотра загрузки процессора вы можете использоватьhtop. Если ваши рабочие модули содержат эту утилиту, вы можете использовать приведенную ниже команду, чтобы открыть оболочку в модуле, а затем запуститьhtop.

Альтернативно вы можете развернуть htopdaemonsetкак показано ниже Репо GitHub.

Ассоциацияdaemonsetзапустит облегченный модуль htop на каждом узле. Вы можете запустить любой из этих модулей и запуститьhtopкоманда:

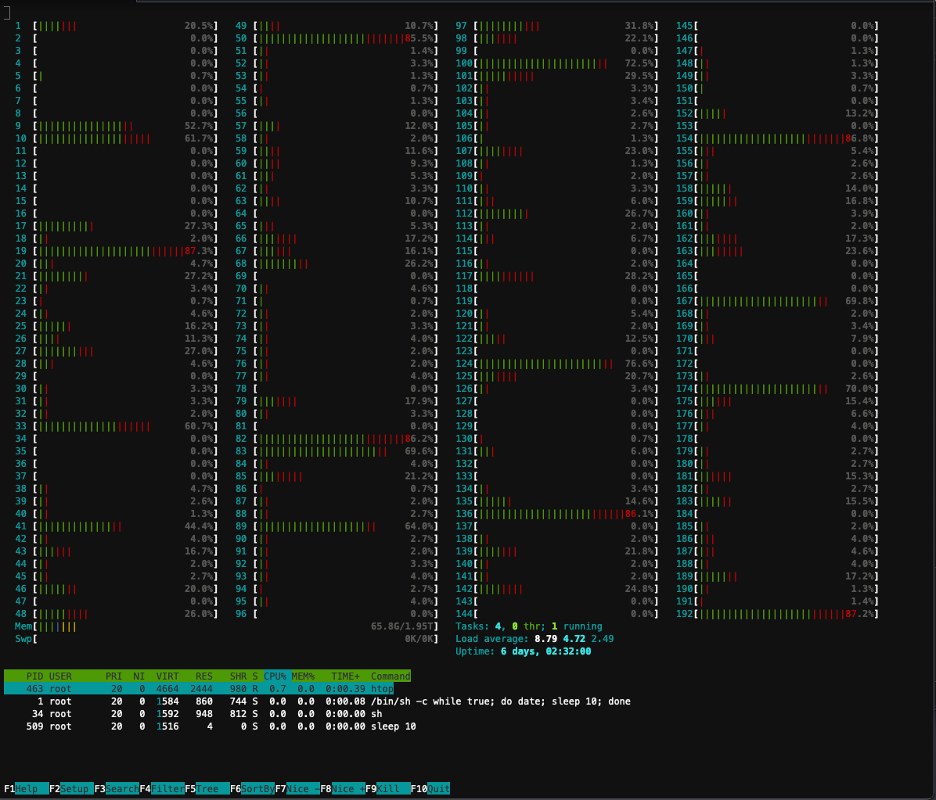

На следующем снимке экрана показана загрузка ЦП на одном из узлов кластера. В данном случае мы рассматриваем инстанс P5.48xlarge со 192 виртуальными ЦП. Ядра процессора простаивают, пока загружаются веса модели, и мы видим рост использования, пока веса модели загружаются в память графического процессора.

Использование графического процессора

Если же линия индикатораnvtopУтилита доступна в вашем модуле, вы можете запустить ее, используя ниже, а затем запуститьnvtop.

Альтернативно вы можете развернуть nvtopdaemonsetкак показано ниже Репо GitHub.

Это запуститnvtoppod на каждом узле. Вы можете запустить любой из этих модулей и запуститьnvtop:

На следующем снимке экрана показано использование графического процессора на одном из узлов обучающего кластера. В данном случае мы рассматриваем экземпляр P5.48xlarge с 8 графическими процессорами NVIDIA H100. Графические процессоры простаивают, пока загружаются веса модели, затем использование памяти графического процессора увеличивается по мере загрузки весов модели в графический процессор, а загрузка графического процессора резко возрастает до 100 % во время итераций обучения.

Панель управления Графана

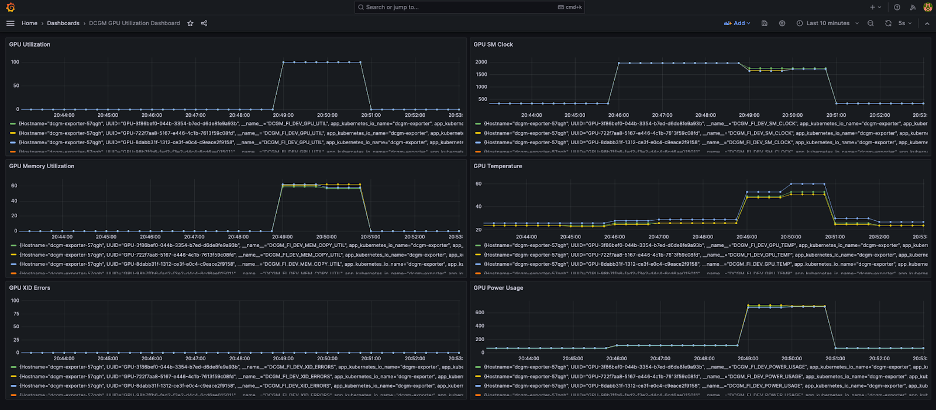

Теперь, когда вы понимаете, как ваша система работает на уровне модуля и узла, важно также взглянуть на метрики на уровне кластера. Совокупные показатели использования можно собирать с помощью NVIDIA DCGM Exporter и Prometheus и визуализировать в Grafana.

Пример развертывания Prometheus-Grafana доступен по следующему адресу. Репо GitHub.

Пример развертывания экспортера DCGM доступен по следующему адресу. Репо GitHub.

Простая панель управления Grafana показана на следующем снимке экрана. Он был построен путем выбора следующих показателей DCGM: DCGM_FI_DEV_GPU_UTIL, DCGM_FI_MEM_COPY_UTIL, DCGM_FI_DEV_XID_ERRORS, DCGM_FI_DEV_SM_CLOCK, DCGM_FI_DEV_GPU_TEMPи DCGM_FI_DEV_POWER_USAGE. Панель мониторинга можно импортировать в Prometheus из GitHub.

На следующей информационной панели показан один запуск однопериодного задания обучения Llama2 7b. Графики показывают, что по мере увеличения тактовой частоты потокового мультипроцессора (SM) также увеличивается энергопотребление и температура графических процессоров, а также коэффициент использования графического процессора и памяти. Вы также можете видеть, что ошибок XID не было и графические процессоры были исправны во время этого запуска.

С марта 2024 года возможность наблюдения за графическим процессором для EKS изначально поддерживается в CloudWatch Container Insights. Чтобы включить эту функцию, просто разверните надстройку CloudWatch Observability в своем кластере EKS. После этого вы сможете просматривать показатели уровня модуля, узла и кластера с помощью предварительно настроенных и настраиваемых информационных панелей в Container Insights.

Убирать

Если вы создали свой кластер, используя примеры, представленные в этом блоге, вы можете выполнить следующий код, чтобы удалить кластер и все связанные с ним ресурсы, включая VPC:

Для эксктла:

Для терраформирования:

Предстоящие функции

Ожидается, что FSDP будет включать функцию сегментирования по каждому параметру с целью дальнейшего улучшения использования памяти на каждый графический процессор. Кроме того, продолжающееся развитие поддержки FP8 направлено на повышение производительности FSDP на графических процессорах H100. Наконец, когда FSDP интегрирован сtorch.compile, мы надеемся увидеть дополнительные улучшения производительности и поддержку таких функций, как выборочная активация.

Заключение

В этом посте мы обсудили, как FSDP уменьшает объем памяти на каждом графическом процессоре, обеспечивая более эффективное обучение более крупных моделей и достигая почти линейного масштабирования пропускной способности. Мы продемонстрировали это посредством пошаговой реализации обучения модели Llama2 с помощью Amazon EKS на экземплярах P4de и P5 и использовали инструменты наблюдения, такие как kubectl, htop, nvtop и dcgm, для мониторинга журналов, а также загрузки ЦП и графического процессора.

Мы рекомендуем вам воспользоваться PyTorch FSDP для собственного обучения LLM. Начните с aws-do-fsdp.

Об авторах

Канвалджит Хурми — главный архитектор решений AI/ML в Amazon Web Services. Он работает с клиентами AWS, предоставляя рекомендации и техническую помощь, помогая им повысить ценность своих решений машинного обучения на AWS. Kanwaljit специализируется на помощи клиентам с контейнерными, распределенными вычислениями и приложениями глубокого обучения.

Канвалджит Хурми — главный архитектор решений AI/ML в Amazon Web Services. Он работает с клиентами AWS, предоставляя рекомендации и техническую помощь, помогая им повысить ценность своих решений машинного обучения на AWS. Kanwaljit специализируется на помощи клиентам с контейнерными, распределенными вычислениями и приложениями глубокого обучения.

Алекс Янкульский — главный архитектор решений в сфере самостоятельного машинного обучения в AWS. Он инженер по комплексному программному обеспечению и инфраструктуре, который любит выполнять глубокую практическую работу. В своей роли он занимается оказанием помощи клиентам в контейнеризации и оркестрации рабочих нагрузок машинного обучения и искусственного интеллекта в сервисах AWS на базе контейнеров. Он также является автором открытого исходного кода сделать структуру и капитан Docker, который любит применять контейнерные технологии для ускорения темпов инноваций и решения крупнейших мировых проблем.

Алекс Янкульский — главный архитектор решений в сфере самостоятельного машинного обучения в AWS. Он инженер по комплексному программному обеспечению и инфраструктуре, который любит выполнять глубокую практическую работу. В своей роли он занимается оказанием помощи клиентам в контейнеризации и оркестрации рабочих нагрузок машинного обучения и искусственного интеллекта в сервисах AWS на базе контейнеров. Он также является автором открытого исходного кода сделать структуру и капитан Docker, который любит применять контейнерные технологии для ускорения темпов инноваций и решения крупнейших мировых проблем.

Ана Симоэс — главный специалист по машинному обучению, ML Frameworks в AWS. Она поддерживает клиентов, развертывающих ИИ, машинное обучение и генеративный ИИ в больших масштабах в инфраструктуре высокопроизводительных вычислений в облаке. Ана специализируется на поддержке клиентов в достижении соотношения цены и качества для новых рабочих нагрузок и сценариев использования генеративного искусственного интеллекта и машинного обучения.

Ана Симоэс — главный специалист по машинному обучению, ML Frameworks в AWS. Она поддерживает клиентов, развертывающих ИИ, машинное обучение и генеративный ИИ в больших масштабах в инфраструктуре высокопроизводительных вычислений в облаке. Ана специализируется на поддержке клиентов в достижении соотношения цены и качества для новых рабочих нагрузок и сценариев использования генеративного искусственного интеллекта и машинного обучения.

Хамид Шоджаназери — инженер-партнер в PyTorch, работающий над оптимизацией высокопроизводительных моделей с открытым исходным кодом и распределенным обучением (ФСДП) и вывод. Он является соавтором рецепт ламы и вкладчик в ФакелСервировать. Его главный интерес — повысить экономическую эффективность, сделав ИИ более доступным для более широкого сообщества.

Хамид Шоджаназери — инженер-партнер в PyTorch, работающий над оптимизацией высокопроизводительных моделей с открытым исходным кодом и распределенным обучением (ФСДП) и вывод. Он является соавтором рецепт ламы и вкладчик в ФакелСервировать. Его главный интерес — повысить экономическую эффективность, сделав ИИ более доступным для более широкого сообщества.

Меньше Райта — инженер по искусственному интеллекту/партнеру в PyTorch. Он работает с ядрами Triton/CUDA (Ускорение Dequant с декомпозицией работы SplitK); страничные, потоковые и квантованные оптимизаторы; и распределенный PyTorch (PyTorch ФСДП).

Меньше Райта — инженер по искусственному интеллекту/партнеру в PyTorch. Он работает с ядрами Triton/CUDA (Ускорение Dequant с декомпозицией работы SplitK); страничные, потоковые и квантованные оптимизаторы; и распределенный PyTorch (PyTorch ФСДП).

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/scale-llms-with-pytorch-2-0-fsdp-on-amazon-eks-part-2/

- :имеет

- :является

- :куда

- ][п

- $UP

- 1

- 10

- 100

- 12

- 13

- 16

- 2024

- 28

- 500

- 7

- 70

- 8

- 80

- 800

- a

- в состоянии

- О нас

- рассеянный

- ускорять

- ускоритель

- доступной

- Учетная запись

- точность

- Достигать

- достижение

- через

- Активация

- Дополнительный

- добавленный

- дополнительный

- Дополнительно

- адрес

- Добавляет

- Принятие

- плюс

- После

- совокупный

- AI

- AI / ML

- помощь

- Стремясь

- Цель

- Все

- позволять

- позволяет

- причислены

- всегда

- Amazon

- Amazon EC2

- Amazon Web Services

- количество

- an

- Анна

- и

- и инфраструктура

- любой

- приложение

- Приложения

- Применить

- Применение

- подходы

- архитектура

- МЫ

- искусственный

- искусственный интеллект

- AS

- Помощь

- помощники

- связанный

- At

- автор

- автоматизация

- свободных мест

- доступен

- избежать

- AWS

- Баланс

- барьер

- колотить

- основной

- BE

- до

- начало

- поведение

- не являетесь

- ниже

- Лучшая

- между

- Крупнейшая

- миллиард

- Блог

- изоферменты печени

- брейки

- шире

- строить

- построенный

- бизнес

- но

- by

- CAN

- возможности

- Пропускная способность

- случаев

- случаев

- КПП

- Центры

- централизованная

- вызов

- проблемы

- График

- Графики

- кли

- Часы

- облако

- Кластер

- код

- сотрудничает

- выходит

- Связь

- сообщество

- сравненный

- полный

- сложность

- компоненты

- вычисление

- Вычисление

- компьютер

- Компьютерное зрение

- вычисление

- проведение

- Конфигурация

- содержать

- Container

- Контейнеры

- содержание

- контентного создание

- контекст

- продолжение

- участник

- контроллер

- координирующий

- координация

- копия

- Основные

- Цена

- Создайте

- создали

- Создающий

- создание

- решающее значение

- Текущий

- изготовленный на заказ

- Клиенты

- настраиваемый

- настроить

- приборная панель

- щитки

- данным

- центров обработки данных

- Наборы данных

- DDP

- глубоко

- глубокое обучение

- определять

- требующий

- демонстрировать

- убивают

- демонстрирует

- развертывание

- развертывание

- развертывание

- описывать

- описано

- подробность

- подробный

- подробнее

- Развитие

- диаграмма

- различный

- непосредственно

- обсуждать

- обсуждается

- распределенный

- распределенных вычислений

- распределенное обучение

- do

- Docker

- сделанный

- Dont

- скачать

- скачанный

- драматично

- рисовать

- два

- в течение

- каждый

- Ранее

- простота

- легко

- затрат

- эффективный

- эффективно

- избран

- охватывающий

- включить

- Enablement

- позволяет

- позволяет

- поощрять

- конец

- впритык

- инженер

- Проект и

- повышать

- Enter

- Весь

- Окружающая среда

- эпоха

- ошибки

- пример

- Примеры

- выполнять

- ожидаемый

- опыт

- Эксперименты

- Объяснять

- Face

- облегчает

- быстрее

- Особенность

- Особенности

- несколько

- фигура

- Файл

- в заключение

- соответствовать

- гибкого

- фокусируется

- после

- след

- Что касается

- К счастью

- каркасы

- от

- полный

- полностью

- функциональность

- далее

- Общие

- поколение

- генеративный

- Генеративный ИИ

- получить

- GitHub

- хорошо

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- градиенты

- Графики

- большой

- значительно

- группы

- GUEST

- Guest Post

- руководство

- практический

- he

- здоровый

- помощь

- помощь

- помогает

- высокая производительность

- наивысший

- его

- имеет

- надежды

- Как

- How To

- Однако

- HPC

- HTML

- HTTP

- HTTPS

- идентифицированный

- Idle

- if

- иллюстрирует

- изображение

- реализация

- важную

- улучшать

- улучшение

- in

- включают

- В том числе

- Увеличение

- расширились

- Увеличивает

- все больше и больше

- info

- информация

- Инфраструктура

- Инновации

- размышления

- пример

- вместо

- интегрированный

- интеграций

- Интеллекта

- интерес

- в

- IT

- итерации

- ЕГО

- работа

- Джобс

- JPEG

- JPG

- JSON

- всего

- Основные

- Вид

- Kubeflow

- Этикетки

- язык

- большой

- крупномасштабный

- больше

- крупнейших

- Фамилия

- запуск

- лидер

- изучение

- Меньше

- позволяя

- уровень

- Библиотека

- легкий

- такое как

- нравится

- ограничение

- Ограниченный

- рамки

- линейный

- Список

- LLM

- расположенный

- журнал

- Войти

- посмотреть

- искать

- любит

- машина

- обучение с помощью машины

- Главная

- Создание

- управлять

- управляемый

- управляемого

- способ

- многих

- Март

- Март 2024

- максимизации

- Май..

- механизм

- Память

- Мета

- Метаданные

- Метрика

- смешанный

- ML

- модель

- Модели

- Модерн

- монитор

- БОЛЕЕ

- самых

- имя

- изначально

- натуральный

- Обработка естественного языка

- Возле

- Необходимость

- потребности

- сеть

- сетей

- Новые

- НЛП

- нет

- узел

- узлы

- номер

- Nvidia

- of

- предлагают

- Предложения

- on

- ONE

- постоянный

- только

- на

- открытый

- с открытым исходным кодом

- операция

- оператор

- оптимизация

- оптимизации

- Оптимизировать

- or

- оркестровка

- OS

- Другое

- наши

- внешний

- выходной

- общий

- Преодолеть

- накладные расходы

- собственный

- Темп

- Параллельные

- параметры

- часть

- участвующий

- партнер

- pass

- путь

- для

- производительность

- план

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Играть

- Популярное

- После

- мощностью

- мощный

- предшествующий

- предпосылки

- консервирование

- предыдущий

- Основной

- Предварительный

- процесс

- Процессы

- обработка

- процессор

- производит

- Произведенный

- Проект

- доказанный

- обеспечивать

- при условии

- тянущий

- цель

- Push

- pytorch

- ассортимент

- готовый

- снижает

- снижение

- относиться

- Рекомендации

- назвало

- область

- реестра

- Связанный

- надежность

- повторять

- ответ

- Запросы

- требовать

- Требования

- требуется

- исследованиям

- ресурс

- Полезные ресурсы

- результат

- Итоги

- повышение

- надежный

- Роли

- Run

- Бег

- Масштабируемость

- масштабируемые

- Шкала

- масштабирование

- скрипт

- скрипты

- легко

- Раздел

- разделах

- безопасность

- посмотреть

- выбранный

- выбор

- селективный

- Серии

- обслуживание

- Услуги

- набор

- несколько

- сегментированный

- Sharding

- она

- Оболочка

- должен

- показывать

- показанный

- Шоу

- существенно

- аналогичный

- просто

- простота

- упрощает

- одинарной

- Размер

- Размеры

- Ломтик

- меньше

- отрывок

- Software

- Решение

- Решения

- Решение

- некоторые

- Источник

- специалист

- специализируется

- указанный

- скорость

- шипы

- стек

- и политические лидеры

- Область

- Области

- статистика

- Статус:

- Шаги

- По-прежнему

- Stop

- стратегий

- потоковый

- такие

- Костюм

- поддержка

- Поддержанный

- поддержки

- Поддержка

- синхронизация

- SYS

- система

- взять

- с

- цель

- задачи

- команда

- Технический

- техника

- снижения вреда

- технологии

- шаблон

- Terraform

- текст

- который

- Ассоциация

- их

- Их

- тогда

- Там.

- Эти

- они

- этой

- те

- три

- Через

- пропускная способность

- время

- кропотливый

- в

- сегодня

- вместе

- Лексемы

- инструменты

- трек

- Train

- специалистов

- Обучение

- Переводы

- Триллион

- правда

- мелодия

- два

- напишите

- В конечном счете

- понимать

- На ходу

- us

- использование

- прецедент

- используемый

- использования

- через

- коммунальные услуги

- утилита

- использовать

- ценностное

- разнообразие

- различный

- Различная

- проверить

- версия

- очень

- с помощью

- Вид

- просмотр

- Виртуальный

- видимость

- видение

- визуализации

- тома

- прохождение

- хотеть

- законопроект

- we

- Web

- веб-сервисы

- ЧТО Ж

- были

- когда

- который

- в то время как

- КТО

- будете

- в

- Работа

- работник

- рабочие

- рабочий

- работает

- работает

- мире

- упаковка

- YAML

- лет

- Ты

- ВАШЕ

- зефирнет