Иногда может быть очень полезно использовать такие инструменты, как компиляторы, которые могут изменять и компилировать ваши модели для оптимальной производительности логического вывода. В этом посте мы исследуем TensorRT и способы его использования с Создатель мудреца Амазонки вывод с использованием Сервер вывода NVIDIA Triton. Мы изучаем, как работает TensorRT и как размещать и оптимизировать эти модели для повышения производительности и экономической эффективности в SageMaker. SageMaker предоставляет конечные точки одной модели (SME), которые позволяют развернуть единую модель машинного обучения, или мультимодельные конечные точки (MME), которые позволяют указать несколько моделей для размещения за логической конечной точкой для более эффективного использования ресурсов.

Чтобы обслуживать модели, Triton поддерживает различные серверные части в качестве механизмов для поддержки запуска и обслуживания различных моделей машинного обучения для логического вывода. Для любого развертывания Triton крайне важно знать, как поведение серверной части влияет на ваши рабочие нагрузки и чего ожидать, чтобы добиться успеха. В этом посте мы поможем вам понять Серверная часть TensorRT который поддерживается Triton в SageMaker, чтобы вы могли принимать обоснованные решения для своих рабочих нагрузок и получать отличные результаты.

Глубокое погружение в бэкэнд TensorRT

TensorRT позволяет оптимизировать вывод с помощью таких методов, как квантование, слияние слоев и тензоров, настройка ядра и другие на графических процессорах NVIDIA. Принимая и компилируя модели для использования TensorRT, вы можете оптимизировать производительность и использование для своих рабочих нагрузок логического вывода. В некоторых случаях приходится идти на компромиссы, типичные для таких методов, как квантование, но результаты могут быть впечатляющими в плане повышения производительности, сокращения задержек и количества транзакций, которые могут быть обработаны.

Серверная часть TensorRT используется для запуска моделей TensorRT. TensorRT — это SDK, разработанный NVIDIA, который предоставляет высокопроизводительную библиотеку логических выводов для глубокого обучения. Он оптимизирован для графических процессоров NVIDIA и позволяет ускорить получение логических выводов на основе глубокого обучения в производственных средах. TensorRT поддерживает основные фреймворки глубокого обучения и включает в себя высокопроизводительный оптимизатор логического вывода для глубокого обучения и среду выполнения, которая обеспечивает вывод с низкой задержкой и высокой пропускной способностью для приложений ИИ.

TensorRT может повысить производительность модели с помощью метода, называемого оптимизация графа для оптимизации графа вычислений, сгенерированного моделью глубокого обучения. Он оптимизирует граф, чтобы свести к минимуму объем памяти, освобождая ненужную память и эффективно повторно используя ее. Компиляция TensorRT объединяет разреженные операции внутри графа модели, чтобы сформировать более крупное ядро, чтобы избежать накладных расходов на несколько запусков небольшого ядра. Благодаря автонастройке ядра движок выбирает лучший алгоритм для целевого графического процессора, максимально увеличивая использование оборудования. Кроме того, TensorRT использует потоки CUDA для обеспечения параллельной обработки моделей, что еще больше улучшает использование графического процессора и производительность. Наконец, посредством квантования TensorRT может использовать ускорение ядер Tensor со смешанной точностью, что позволяет модели работать с точностью FP32, TF32, FP16 и INT8 для наилучшей производительности логического вывода. Однако, несмотря на то, что пониженная точность в целом может улучшить характеристики задержки, это может привести к возможной нестабильности и ухудшению точности модели. В целом, сочетание методов TensorRT приводит к более быстрому выводу и меньшей задержке по сравнению с другими механизмами вывода.

Серверная часть TensorRT для Triton Inference Server предназначена для использования преимуществ мощных возможностей логического вывода графических процессоров NVIDIA. Чтобы использовать TensorRT в качестве серверной части для Triton Inference Server, вам необходимо создать механизм TensorRT из обученной модели с помощью TensorRT API. Затем этот механизм загружается в Triton Inference Server и используется для выполнения логических выводов по входящим запросам. Ниже приведены основные шаги по использованию TensorRT в качестве серверной части для Triton Inference Server:

- Преобразуйте обученную модель в ОННКС формат. Triton Inference Server поддерживает ONNX в качестве формата модели. ONNX — это стандарт представления моделей глубокого обучения, позволяющий передавать их между платформами. Если ваша модель еще не находится в формате ONNX, вам необходимо преобразовать ее с помощью соответствующего инструмента для конкретной платформы. Например, в PyTorch это можно сделать с помощью

torch.onnx.exportметод. - Импортируйте модель ONNX в TensorRT и сгенерируйте механизм TensorRT. Для TensorRT существует несколько способов построить TensorRT из вашей модели ONNX. Для этого поста мы используем

trtexecинструмент командной строки.trtexec— это инструмент для быстрого использования TensorRT без необходимости разработки собственного приложения.trtexecинструмент имеет три основных назначения:- Сравнительный анализ сетей на случайных или предоставленных пользователем входных данных.

- Генерация сериализованных двигателей из моделей.

- Генерация сериализованного тайминга из компоновщика.

- Загрузите механизм TensorRT в Triton Inference Server. После создания механизма TensorRT его можно загрузить в Triton Inference Server, создав файл конфигурация модели файл. Конфигурация модели (

config.pbtxt) должен содержать путь к файлу движка TensorRT, а также входные и выходные формы модели.

Каждая модель в хранилище моделей должен включать конфигурацию модели, которая предоставляет необходимую и необязательную информацию о модели. Как правило, эта конфигурация предоставляется в config.pbtxt файл, указанный как Протобуф ModelConfig. В этом файле конфигурации следует отметить несколько ключевых моментов:

- имя – Это поле определяет имя модели и должно быть уникальным в репозитории моделей.

- Платформа — Это поле определяет тип модели: движок TensorRT, PyTorch или что-то другое.

- max_batch_size – Это указывает максимальный размер пакета, который может быть передан в эту модель. Если пакетное измерение модели является первым измерением, и все входы и выходы модели имеют это пакетное измерение, тогда Triton может использовать свое динамический дозатор or дозатор последовательности для автоматического использования пакетной обработки с моделью. В этом случае,

max_batch_sizeдолжно быть установлено значение, большее или равное 1, которое указывает максимальный размер пакета, который Triton должен использовать с моделью. Для моделей, не поддерживающих пакетную обработку или не поддерживающих пакетную обработку указанными выше способами,max_batch_sizeдолжен быть установлен на 0. - Ввод и вывод – Эти поля обязательны, поскольку NVIDIA Triton нужны метаданные о модели. По сути, для этого требуются имена входных и выходных слоев вашей сети, а также форма указанных входов и выходов.

- группа_экземпляра – Это определяет, сколько экземпляров этой модели будет создано и будут ли они использовать GPU или CPU.

- Dynamic_batching – Динамическое пакетирование — это функция Triton, которая позволяет серверу объединять запросы на вывод, чтобы пакет создавался динамически.

preferred_batch_sizeСвойство указывает размеры пакетов, которые должен попытаться создать динамический дозатор. Для большинства моделей,preferred_batch_sizeне следует указывать, как описано в Рекомендуемый процесс настройки. Исключением являются модели TensorRT, в которых указано несколько профилей оптимизации для разных размеров пакетов. В этом случае, поскольку некоторые профили оптимизации могут дать значительное улучшение производительности по сравнению с другими, может иметь смысл использоватьpreferred_batch_sizeдля размеров пакетов, поддерживаемых этими высокопроизводительными профилями оптимизации. Вы также можете указать размер пакета, который ранее использовался при запускеtrtexec. Вы также можете настроить время задержки, чтобы разрешить задержку запросов на ограниченное время в планировщике, чтобы позволить другим запросам присоединиться к динамическому пакету.

Серверная часть TensorRT улучшена, чтобы иметь значительно лучшую производительность. Улучшения включают в себя уменьшение конкуренции между потоками, использование закрепленной памяти для более быстрой передачи между ЦП и ГП, а также увеличение перекрытия вычислений и копий памяти на ГП. Это также во многих случаях снижает использование памяти моделями TensorRT за счет распределения весов между несколькими экземплярами модели. В целом, серверная часть TensorRT для Triton Inference Server обеспечивает мощный и гибкий способ обслуживания моделей глубокого обучения с оптимизированным выводом TensorRT. Настраивая параметры конфигурации, вы можете оптимизировать производительность и поведение управления в соответствии с вашим конкретным вариантом использования.

SageMaker предоставляет Triton через SME и MME

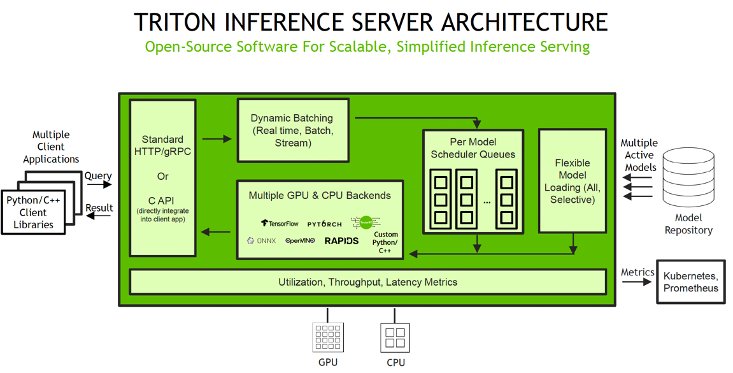

SageMaker позволяет развертывать изоферменты печени одинарной и мультимодель конечные точки с Triton Inference Server. Triton поддерживает гетерогенный кластер с графическими и центральными процессорами, что помогает стандартизировать вывод на разных платформах и динамически масштабируется до любого процессора или графического процессора для обработки пиковых нагрузок. Следующая диаграмма иллюстрирует архитектуру Triton Inference Server. Запросы на вывод поступают на сервер либо через HTTP / ОТДЫХ или по C API, а затем направляются в соответствующий планировщик для каждой модели. Тритон реализует несколько алгоритмов планирования и пакетной обработки которые можно настроить для каждой модели отдельно. Планировщик каждой модели дополнительно выполняет группирование запросов на вывод, а затем передает запросы в бэкэнда соответствующий типу модели. Серверная часть платформы выполняет вывод, используя входные данные, предоставленные в пакетных запросах, для получения запрошенных выходных данных. Затем выходные данные форматируются и возвращаются в ответе. хранилище моделей представляет собой репозиторий моделей на основе файловой системы, которые Triton сделает доступными для логического вывода.

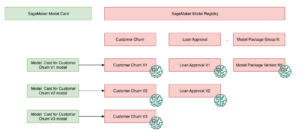

SageMaker позаботится о формировании трафика к конечной точке MME и поддерживает оптимальные копии моделей на инстансах GPU для наилучшего соотношения цены и качества. Он продолжает направлять трафик к экземпляру, в котором загружена модель. Если ресурсы экземпляра достигают предела из-за высокой загрузки, SageMaker выгружает наименее используемые модели из контейнера, чтобы освободить ресурсы для загрузки более часто используемых моделей. SageMaker MME предлагает возможности одновременного запуска нескольких моделей глубокого обучения или машинного обучения на графическом процессоре с Triton Inference Server, который был расширен для реализации Контракт API MME. MME позволяют совместно использовать экземпляры графического процессора за конечной точкой для нескольких моделей, а также динамически загружать и выгружать модели на основе входящего трафика. Благодаря этому вы можете легко достичь оптимального соотношения цены и качества.

Когда SageMaker MME получает HTTP-запрос на вызов конкретной модели, используя TargetModel в запросе вместе с полезной нагрузкой он направляет трафик к нужному экземпляру за конечной точкой, где загружена целевая модель. SageMaker берет на себя управление моделью за конечной точкой. Он динамически загружает модели из Простой сервис хранения Amazon (Amazon S3) в том хранилища экземпляра, если вызываемая модель недоступна в томе хранилища экземпляра. Затем SageMaker загружает модель в память контейнера NVIDIA Triton на экземпляре с ускорением на GPU и обслуживает запрос на вывод. Ядро графического процессора совместно используется всеми моделями экземпляра. Дополнительные сведения о MME SageMaker на графическом процессоре см. Запускайте несколько моделей глубокого обучения на графическом процессоре с помощью мультимодельных конечных точек Amazon SageMaker..

MME SageMaker могут горизонтально масштабироваться с помощью политики автоматического масштабирования и предоставлять дополнительные вычислительные экземпляры графического процессора на основе заданных показателей. При настройке групп автоматического масштабирования для конечных точек SageMaker вы можете рассмотреть SageMakerVariantInvocationsPerInstance в качестве основных критериев для определения характеристик масштабирования групп автоматического масштабирования. Кроме того, в зависимости от того, работают ли ваши модели на GPU или CPU, вы также можете рассмотреть возможность использования CPUUtilization or GPUUtilization как дополнительные критерии. Для конечных точек с одной моделью, поскольку все развернутые модели одинаковы, довольно просто установить правильные политики для соответствия вашим соглашениям об уровне обслуживания. Для конечных точек с несколькими моделями мы рекомендуем развертывать аналогичные модели за данной конечной точкой, чтобы обеспечить более стабильную и предсказуемую производительность. В случаях, когда используются модели разных размеров и требований, может потребоваться разделить эти рабочие нагрузки между несколькими конечными точками с несколькими моделями или потратить некоторое время на точную настройку групповой политики автоматического масштабирования, чтобы получить наилучший баланс затрат и производительности.

Обзор решения

Для NVIDIA Тритон контейнера в SageMaker, теперь вы можете использовать серверную часть Triton TensorRT, которая позволяет развертывать модели TensorRT. TensorRT_backend репо содержит документацию и исходный код для серверной части. В следующих разделах мы познакомим вас с пример тетради в котором показано, как использовать NVIDIA Triton Inference Server на SageMaker MME с функцией графического процессора для развертывания модели обработки естественного языка (NLP) BERT.

Настройте среду

Начнем с настройки необходимой среды. Мы устанавливаем зависимости, необходимые для упаковки конвейера нашей модели, и запускаем выводы с помощью Triton Inference Server. Мы также определяем Управление идентификацией и доступом AWS (IAM), которая дает SageMaker доступ к артефактам модели и NVIDIA Triton. Реестр Amazon Elastic Container (Amazon ECR) изображение. Вы можете использовать следующий пример кода для извлечения предварительно созданного изображения Triton ECR:

Добавьте служебные методы для подготовки полезной нагрузки запроса.

Мы создаем функции для преобразования образца текста, который мы используем для вывода, в полезную нагрузку, которую можно отправить для вывода на сервер Triton Inference Server. tritonclient Пакет, который был установлен в начале, предоставляет служебные методы для создания полезной нагрузки без необходимости знать детали спецификации. Мы используем созданные методы для преобразования нашего запроса на вывод в двоичный формат, который обеспечивает более низкие задержки для вывода. Эти функции используются на этапе вывода.

Подготовьте модель TensorRT

На этом шаге мы загружаем предварительно обученная модель BERT и преобразовать в представление ONNX с помощью экспортера факела ONNX и onnx_exporter.py сценарий. После создания модели ONNX мы используем TensorRT. trtexec Команда для создания плана модели, который будет размещаться в Triton. Это выполняется как часть generate_model.sh сценарий из следующей ячейки. Обратите внимание, что создание ячейки занимает около 30 минут.

Ожидая завершения выполнения команды, вы можете проверить сценарии, используемые на этом этапе. в onnx_exporter.py сценарий, мы используем torch.onnx.export функция для создания модели ONNX:

Командная строка в файле generate_model.sh создает план модели TensorRT. Для получения дополнительной информации см. инструмент командной строки trtexec.

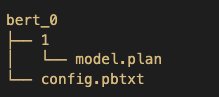

Создайте репозиторий модели TensorRT NLP BERT.

Использование Triton в SageMaker требует, чтобы мы сначала настроили хранилище моделей папка, содержащая модели, которые мы хотим обслуживать. Для каждой модели нам нужно создать каталог модели, состоящий из артефакта модели, и определить config.pbtxt файл, чтобы указать конфигурацию модели, которую Triton использует для загрузки и обслуживания модели. Чтобы узнать больше о настройках конфигурации, см. Конфигурация модели. Структура репозитория модели для модели BERT выглядит следующим образом:

Обратите внимание, что у Triton есть особые требования к компоновке репозитория моделей. В каталоге репозитория моделей верхнего уровня каждая модель имеет собственный подкаталог, содержащий информацию о соответствующей модели. Каждый каталог модели в Triton должен иметь по крайней мере один числовой подкаталог, представляющий версию модели. Здесь папка 1 представляет версию 1 модели BERT. Каждая модель управляется определенным бэкендом, поэтому в подкаталоге каждой версии должны быть артефакты модели, необходимые для этого бэкенда. Здесь мы используем серверную часть TensorRT, для которой требуется файл плана TensorRT, который используется для обслуживания (в этом примере model.plan). Если бы мы использовали серверную часть PyTorch, model.pt потребуется файл. Дополнительные сведения о правилах именования файлов моделей см. Файлы модели.

Каждая модель TensorRT должна предоставлять config.pbtxt файл, описывающий конфигурацию модели. Чтобы использовать этот бэкэнд, вы должны установить backend поле вашей модели config.pbtxt файл в tensorrt_plan. В следующем разделе кода показан пример того, как определить файл конфигурации для модели BERT, обслуживаемой через серверную часть Triton TensorRT:

SageMaker ожидает, что файл .tar.gz, содержащий репозиторий каждой модели Triton, будет размещен на конечной точке с несколькими моделями. Чтобы имитировать несколько похожих моделей, размещенных на хосте, вы можете подумать, что все, что нужно, это заархивировать уже созданный репозиторий моделей, а затем скопировать его с другими именами файлов. Однако Triton требует уникальных имен моделей. Поэтому мы сначала скопируем репозиторий модели N раз, изменив имена каталогов моделей и соответствующие им config.pbtxt файлы. Вы можете изменить количество N, чтобы иметь больше копий модели, которые можно динамически загружать в конечную точку хостинга для имитации действия загрузки/выгрузки модели, управляемого SageMaker. См. следующий код:

Создайте конечную точку SageMaker

Теперь, когда мы загрузили артефакты модели в Amazon S3, мы можем создать объект модели SageMaker, конфигурацию конечной точки и конечную точку.

Во-первых, нам нужно определить обслуживающий контейнер. В определении контейнера укажите ModelDataUrl чтобы указать каталог S3, содержащий все модели, которые мультимодельная конечная точка SageMaker будет использовать для загрузки и обслуживания прогнозов. Набор Mode в MultiModel чтобы указать, что SageMaker создаст конечную точку со спецификациями контейнера MME. См. следующий код:

Затем мы создаем объект модели SageMaker, используя create_model boto3 API, указав ModelName и определение контейнера:

Мы используем эту модель для создания конфигурация конечной точки где мы можем указать тип и количество экземпляров, которые мы хотим в конечной точке. Здесь мы развертываем экземпляр g5.xlarge NVIDIA GPU:

С этой конфигурацией конечной точки мы создаем новую конечную точку SageMaker и ждем завершения развертывания. Статус изменится на InService когда развертывание прошло успешно.

Вызовите свою модель, размещенную на конечной точке SageMaker.

Когда конечная точка работает, мы можем использовать некоторые образцы необработанных данных для выполнения вывода, используя либо JSON, либо двоичный файл + JSON в качестве формата полезной нагрузки. Для формата запроса на вывод Triton использует стандарт сообщества KFServing. протоколы вывода. Мы можем отправить запрос на вывод в конечную точку с несколькими моделями, используя invoke_enpoint API. Мы указываем TargetModel в вызове вызова и передать полезную нагрузку для каждого типа модели. Здесь мы вызываем конечную точку в цикле for, чтобы запросить конечную точку для динамически загружать или выгружать модели на основании запросов:

Вы можете отслеживать статус загрузки и выгрузки модели, используя Amazon CloudWatch метрики и журналы. Мультимодельные конечные точки SageMaker предоставляют метрики на уровне экземпляра для мониторинга; для получения более подробной информации см. Мониторинг Amazon SageMaker с помощью Amazon CloudWatch, LoadedModelCount Метрика показывает количество моделей, загруженных в контейнеры. ModelCacheHit Метрика показывает количество вызовов модели, которые уже загружены в контейнер, чтобы помочь вам получить информацию на уровне приглашения модели. Чтобы проверить, выгружаются ли модели из памяти, вы можете найти записи журнала об успешной выгрузке в журналах CloudWatch конечной точки.

Блокнот можно найти в Репозиторий GitHub.

Лучшие практики

Прежде чем начинать какие-либо усилия по оптимизации с помощью TensorRT, важно определить, что следует измерять. Без измерений невозможно добиться надежного прогресса или измерить, был ли достигнут успех. Вот несколько рекомендаций, которые следует учитывать при использовании бэкэнда TensorRT для Triton Inference Server:

- Оптимизируйте свою модель TensorRT – Перед развертыванием модели на Triton с помощью бэкэнда TensorRT обязательно оптимизируйте модель в соответствии с TensorRT. лучшие практики гид. Это поможет вам повысить производительность за счет сокращения времени логического вывода и потребления памяти.

- По возможности используйте TensorRT вместо других бэкэндов Triton. – TensorRT предназначен для оптимизации моделей глубокого обучения для развертывания на графических процессорах NVIDIA, поэтому его использование может значительно повысить производительность логических выводов по сравнению с использованием других поддерживаемых серверных частей Triton.

- Используйте правильную точность – TensorRT поддерживает различные точности (FP32, FP16, INT8), и выбор правильной точности для вашей модели может существенно повлиять на производительность. Рассмотрите возможность использования более низкой точности, когда это возможно.

- Используйте размеры пакетов, соответствующие вашему оборудованию – Обязательно выбирайте размеры пакетов, соответствующие памяти и вычислительным возможностям вашего графического процессора. Использование слишком больших или слишком малых размеров пакетов может отрицательно сказаться на производительности.

Заключение

В этом посте мы углубимся в бэкэнд TensorRT, который Triton Inference Server поддерживает в SageMaker. Этот бэкэнд обеспечивает ускорение ваших моделей TensorRT как на процессоре, так и на графическом процессоре. Существует множество вариантов, которые следует учитывать, чтобы получить наилучшую производительность для логических выводов, таких как размеры пакетов, форматы ввода данных и другие факторы, которые можно настроить в соответствии с вашими потребностями. SageMaker позволяет вам воспользоваться этой возможностью, используя конечные точки с одной моделью для гарантированной производительности и конечные точки с несколькими моделями для лучшего баланса производительности и экономии средств. Чтобы начать работу с поддержкой MME для GPU, см. Поддерживаемые алгоритмы, платформы и экземпляры.

Мы приглашаем вас попробовать контейнеры Triton Inference Server в SageMaker и поделиться своими отзывами и вопросами в комментариях.

Об авторах

Мелани Ли является старшим специалистом по искусственному интеллекту и машинному обучению в AWS в Сиднее, Австралия. Она помогает корпоративным клиентам создавать решения с использованием самых современных инструментов искусственного интеллекта и машинного обучения в AWS, а также предоставляет рекомендации по разработке и внедрению решений машинного обучения с учетом передового опыта. В свободное время она любит исследовать природу на свежем воздухе и проводить время с семьей и друзьями.

Мелани Ли является старшим специалистом по искусственному интеллекту и машинному обучению в AWS в Сиднее, Австралия. Она помогает корпоративным клиентам создавать решения с использованием самых современных инструментов искусственного интеллекта и машинного обучения в AWS, а также предоставляет рекомендации по разработке и внедрению решений машинного обучения с учетом передового опыта. В свободное время она любит исследовать природу на свежем воздухе и проводить время с семьей и друзьями.

Джеймс Парк работает архитектором решений в Amazon Web Services. Он работает с Amazon над проектированием, созданием и развертыванием технологических решений на AWS и проявляет особый интерес к искусственному интеллекту и машинному обучению. В свободное время он любит искать новые культуры, новый опыт и быть в курсе последних технологических тенденций.

Джеймс Парк работает архитектором решений в Amazon Web Services. Он работает с Amazon над проектированием, созданием и развертыванием технологических решений на AWS и проявляет особый интерес к искусственному интеллекту и машинному обучению. В свободное время он любит искать новые культуры, новый опыт и быть в курсе последних технологических тенденций.

Цзяхонг Лю является архитектором решений в команде поставщиков облачных услуг в NVIDIA. Он помогает клиентам внедрить решения для машинного обучения и искусственного интеллекта, которые используют ускоренные вычисления NVIDIA для решения их задач обучения и логических выводов. В свободное время он увлекается оригами, проектами «сделай сам» и играет в баскетбол.

Цзяхонг Лю является архитектором решений в команде поставщиков облачных услуг в NVIDIA. Он помогает клиентам внедрить решения для машинного обучения и искусственного интеллекта, которые используют ускоренные вычисления NVIDIA для решения их задач обучения и логических выводов. В свободное время он увлекается оригами, проектами «сделай сам» и играет в баскетбол.

Кшитиз Гупта является архитектором решений в NVIDIA. Ему нравится обучать клиентов облачных вычислений технологиям искусственного интеллекта на графических процессорах, которые NVIDIA может предложить, и помогать им в ускорении их приложений машинного и глубокого обучения. Вне работы он любит бегать, ходить в походы и наблюдать за дикой природой.

Кшитиз Гупта является архитектором решений в NVIDIA. Ему нравится обучать клиентов облачных вычислений технологиям искусственного интеллекта на графических процессорах, которые NVIDIA может предложить, и помогать им в ускорении их приложений машинного и глубокого обучения. Вне работы он любит бегать, ходить в походы и наблюдать за дикой природой.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- ПлатонАйСтрим. Анализ данных Web3. Расширение знаний. Доступ здесь.

- Чеканка будущего с Эдриенн Эшли. Доступ здесь.

- Покупайте и продавайте акции компаний PREIPO® с помощью PREIPO®. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/host-ml-models-on-amazon-sagemaker-using-triton-tensorrt-models/

- :имеет

- :является

- :нет

- :куда

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 23

- 30

- 7

- 8

- a

- в состоянии

- О нас

- ускорять

- ускоренный

- ускоряющий

- доступ

- точность

- Достигать

- достигнутый

- через

- Действие

- дополнение

- дополнительный

- Дополнительно

- адрес

- адресация

- Принятие

- плюс

- После

- AI

- AI / ML

- алгоритм

- алгоритмы

- Все

- позволять

- позволяет

- вдоль

- уже

- причислены

- Несмотря на то, что

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- an

- и

- любой

- API

- Применение

- Приложения

- соответствующий

- архитектура

- МЫ

- около

- AS

- помогает

- At

- Австралия

- автоматический

- автоматически

- доступен

- избежать

- AWS

- Backend

- Баланс

- Использование темпера с изогнутым основанием

- основанный

- основной

- основа

- Баскетбол

- BE

- , так как:

- было

- до

- начинать

- начало

- за

- не являетесь

- полезный

- пользу

- ЛУЧШЕЕ

- лучшие практики

- Лучшая

- между

- тело

- изоферменты печени

- строить

- строитель

- построенный

- но

- by

- Кэш

- призывают

- под названием

- CAN

- возможности

- Пропускная способность

- заботится

- случаев

- случаев

- проблемы

- изменение

- изменения

- характеристика

- проверка

- Выберите

- клиент

- клиентов

- облако

- Кластер

- код

- COM

- сочетание

- сочетании

- как

- Комментарии

- сообщество

- сравненный

- полный

- вычисление

- Вычисление

- вычисление

- Конфигурация

- Рассматривать

- Состоящий из

- потребление

- Container

- Контейнеры

- содержит

- продолжается

- контроль

- конвертировать

- Основные

- соответствующий

- Цена

- экономия на издержках

- Создайте

- создали

- создает

- Создающий

- создание

- Критерии

- решающее значение

- Клиенты

- данным

- Время

- решение

- глубоко

- глубокое обучение

- Определяет

- задерживать

- Задерживается

- обеспечивает

- демонстрирует

- развертывание

- развернуть

- развертывание

- развертывание

- описано

- Проект

- предназначенный

- подробнее

- Определять

- определяет

- развивать

- развитый

- различный

- Размеры

- Сделай сам

- документации

- сделанный

- Dont

- голубь

- загрузок

- драматично

- два

- в течение

- динамический

- динамично

- каждый

- легко

- Edge

- обучение

- затрат

- эффективно

- усилие

- или

- работает

- включить

- позволяет

- позволяет

- Конечная точка

- Двигатель

- Двигатели

- Предприятие

- Окружающая среда

- средах

- равный

- существенный

- по существу

- пример

- исключение

- ожидать

- надеется

- Впечатления

- Больше

- факторы

- достаточно

- семья

- быстрее

- Особенность

- Обратная связь

- поле

- Поля

- Файл

- Файлы

- плавник

- в заключение

- окончание

- Во-первых,

- соответствовать

- гибкого

- после

- следующим образом

- след

- Что касается

- форма

- формат

- найденный

- Рамки

- каркасы

- Бесплатно

- часто

- друзья

- от

- функция

- Функции

- далее

- слияние

- в общем

- порождать

- генерируется

- получить

- Дайте

- данный

- дает

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- график

- большой

- большой

- группы

- Группы

- гарантированный

- руководство

- инструкция

- обрабатывать

- Аппаратные средства

- Есть

- имеющий

- he

- помощь

- помогает

- ее

- здесь

- High

- высокая производительность

- высший

- его

- горизонтально

- кашель

- состоялся

- хостинг

- Как

- How To

- Однако

- HTML

- HTTP

- HTTPS

- i

- ID

- Личность

- if

- иллюстрирует

- изображение

- Влияние

- Воздействие

- осуществлять

- Осуществляющий

- инвентарь

- Импортировать

- что она

- улучшать

- улучшенный

- улучшение

- улучшение

- улучшение

- in

- включают

- включает в себя

- Входящий

- повышение

- увеличить

- указывать

- указывает

- информация

- сообщил

- вход

- затраты

- размышления

- нестабильность

- устанавливать

- установлен

- пример

- вместо

- интерес

- в

- приглашать

- вызывается

- IT

- ЕГО

- присоединиться

- JPG

- JSON

- Основные

- Вид

- Знать

- язык

- большой

- больше

- Задержка

- последний

- запускает

- слой

- слоев

- Планировка

- УЧИТЬСЯ

- изучение

- наименее

- Кредитное плечо

- Используя

- Библиотека

- Ограниченный

- линия

- загрузка

- погрузка

- грузы

- журнал

- логический

- посмотреть

- Низкий

- ниже

- машина

- обучение с помощью машины

- Главная

- поддерживает

- основной

- сделать

- управляемого

- управление

- многих

- Совпадение

- максимизации

- максимальный

- Май..

- проводить измерение

- размеры

- Встречайте

- Память

- Метаданные

- метод

- методы

- метрический

- Метрика

- может быть

- Минут

- ML

- режим

- модель

- Модели

- изменять

- монитор

- БОЛЕЕ

- самых

- Мультимодельная конечная точка

- с разными

- должен

- имя

- имена

- именования

- натуральный

- Обработка естественного языка

- природа

- Необходимость

- потребности

- отрицательно

- сетей

- Новые

- НЛП

- ноутбук

- сейчас

- номер

- Nvidia

- объект

- получать

- of

- предлагают

- on

- ONE

- открытый

- Операционный отдел

- оптимальный

- оптимизация

- Оптимизировать

- оптимизированный

- оптимизирует

- Опции

- or

- заказ

- OS

- Другое

- Другое

- наши

- внешний

- на открытом воздухе

- выходной

- внешнюю

- общий

- собственный

- пакет

- Параллельные

- часть

- особый

- pass

- Прошло

- проходит

- путь

- Вершина горы

- Выполнять

- производительность

- выполняет

- трубопровод

- план

- Платформа

- Платформы

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- игры

- пунктов

- сборах

- политика

- возможное

- После

- мощный

- практиками

- Точность

- предсказуемый

- Predictions

- подготовка

- предыдущий

- предварительно

- цена

- первичный

- Обработанный

- обработка

- производит

- Производство

- Профили

- Прогресс

- проектов

- правильный

- собственность

- Прото

- обеспечивать

- при условии

- Недвижимости

- приводит

- обеспечение

- целей

- pytorch

- Вопросы

- быстро

- повышение

- случайный

- Сырье

- достигать

- получает

- рекомендовать

- Цена снижена

- снижает

- снижение

- область

- складская

- хранилище

- представление

- представляющий

- представляет

- запросить

- Запросы

- обязательный

- Требования

- требуется

- ресурс

- Полезные ресурсы

- ответ

- Итоги

- Роли

- дорога

- маршруты

- rt

- Run

- Бег

- s

- sagemaker

- Сказал

- то же

- Сохранить

- экономия

- Шкала

- Весы

- масштабирование

- планирование

- скрипты

- SDK

- Раздел

- разделах

- посмотреть

- поиск

- выбор

- Отправить

- старший

- смысл

- отдельный

- служить

- служит

- обслуживание

- Провайдер услуг

- Услуги

- выступающей

- набор

- установка

- настройки

- несколько

- Форма

- формы

- формирование

- Поделиться

- общие

- разделение

- она

- должен

- Шоу

- значительный

- существенно

- аналогичный

- просто

- одинарной

- Размер

- Размеры

- небольшой

- МСП

- So

- Решение

- Решения

- некоторые

- удалось

- Источник

- специалист

- конкретный

- Спецификация

- спецификации

- указанный

- тратить

- стандарт

- и политические лидеры

- Начало

- современное состояние

- Статус:

- устойчивый

- Шаг

- Шаги

- диск

- простой

- потоки

- Структура

- успех

- успешный

- такие

- Костюм

- поддержка

- Поддержанный

- Поддержка

- Сидней

- взять

- принимает

- цель

- команда

- снижения вреда

- технологии

- Технологии

- чем

- который

- Ассоциация

- График

- информация

- их

- Их

- тогда

- Там.

- следовательно

- Эти

- они

- think

- этой

- те

- три

- Через

- время

- раз

- синхронизация

- в

- слишком

- инструментом

- инструменты

- верхний уровень

- факел

- трафик

- специалистов

- Обучение

- Сделки

- переданы

- переводы

- Transform

- трансформеры

- Тенденции

- Тритон

- напишите

- типичный

- типично

- понимать

- созданного

- загружено

- us

- Применение

- использование

- прецедент

- используемый

- через

- утилита

- использовать

- ценностное

- различный

- версия

- очень

- с помощью

- объем

- ждать

- Ожидание

- хотеть

- законопроект

- наблюдение

- Путь..

- способы

- we

- Web

- веб-сервисы

- были

- Что

- когда

- будь то

- , которые

- будете

- в

- без

- Работа

- работает

- бы

- Ты

- ВАШЕ

- зефирнет