Модерация контента играет ключевую роль в обеспечении онлайн-безопасности и поддержке ценностей и стандартов веб-сайтов и платформ социальных сетей. Его значение подчеркивается защитой, которую он обеспечивает пользователям от воздействия нежелательного контента, обеспечивая их благополучие в цифровых пространствах. Например, в рекламной индустрии модерация контента служит для защиты брендов от неблагоприятных ассоциаций, тем самым способствуя повышению престижа бренда и росту доходов. Рекламодатели отдают приоритет согласованию своего бренда с соответствующим контентом, чтобы поддержать свою репутацию и предотвратить негативную рекламу. Модерация контента также приобретает решающее значение в секторах финансов и здравоохранения, где она выполняет множество функций. Он играет важную роль в выявлении и защите конфиденциальной личной информации и медицинской информации (PII, PHI). Придерживаясь внутренних стандартов и практик, а также внешних правил, модерация контента повышает цифровую безопасность пользователей. Таким образом, это предотвращает непреднамеренный обмен конфиденциальными данными на общедоступных платформах, обеспечивая сохранение конфиденциальности пользователей и безопасности данных.

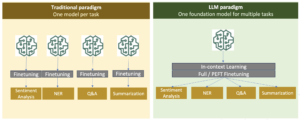

В этом посте мы представляем новый метод модерации контента для данных изображений с мультимодальным предварительным обучением и большой языковой моделью (LLM). Благодаря мультимодальному предварительному обучению мы можем напрямую запрашивать содержимое изображения на основе набора интересующих вопросов, и модель сможет ответить на эти вопросы. Это позволяет пользователям общаться с изображением в чате, чтобы убедиться, что оно содержит какой-либо неприемлемый контент, нарушающий политику организации. Мы используем мощные возможности LLM для принятия окончательного решения, включая маркировку безопасных/небезопасных товаров и тип категории. Кроме того, разработав приглашение, мы можем заставить LLM генерировать определенный выходной формат, например формат JSON. Разработанный шаблон запроса позволяет LLM определить, нарушает ли изображение политику модерации, определить категорию нарушения, объяснить причину и предоставить выходные данные в структурированном формате JSON.

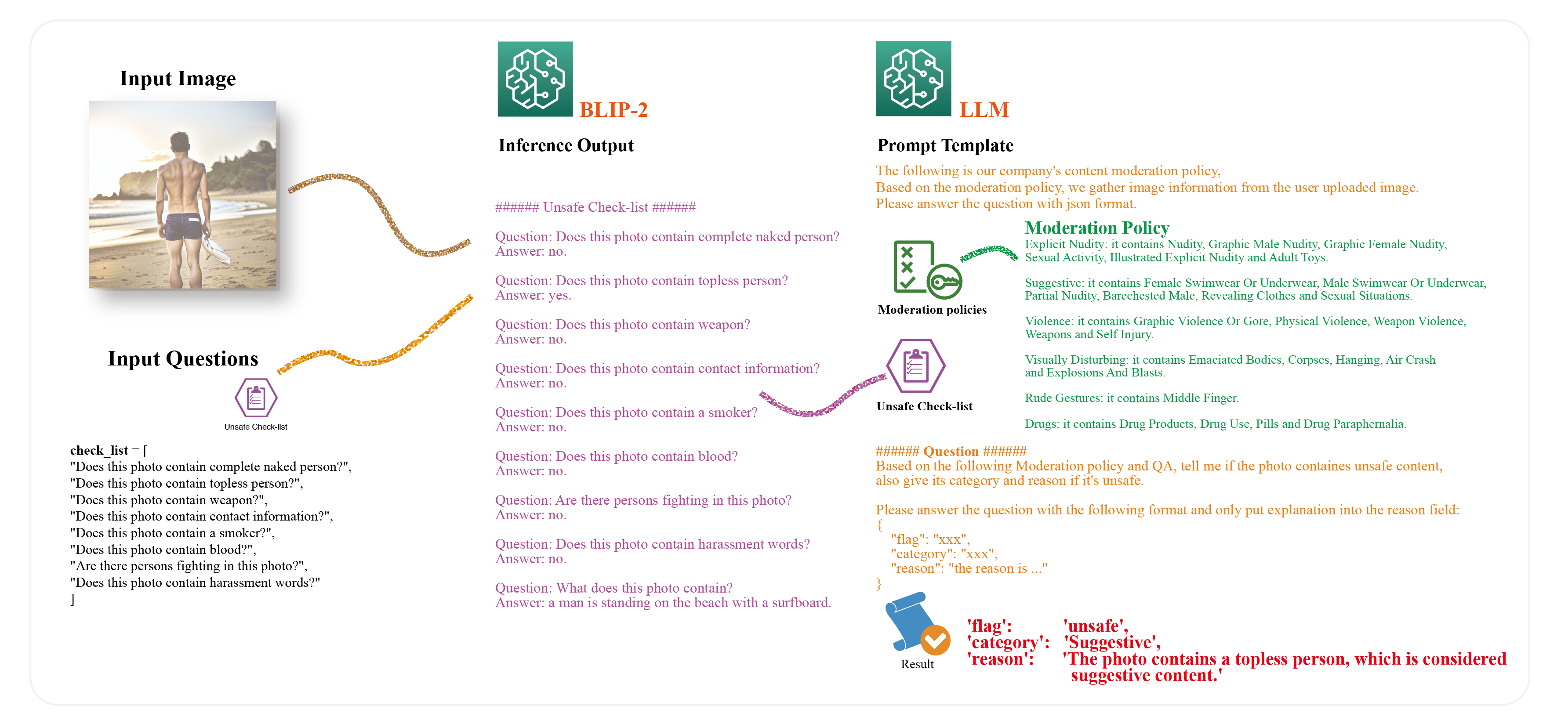

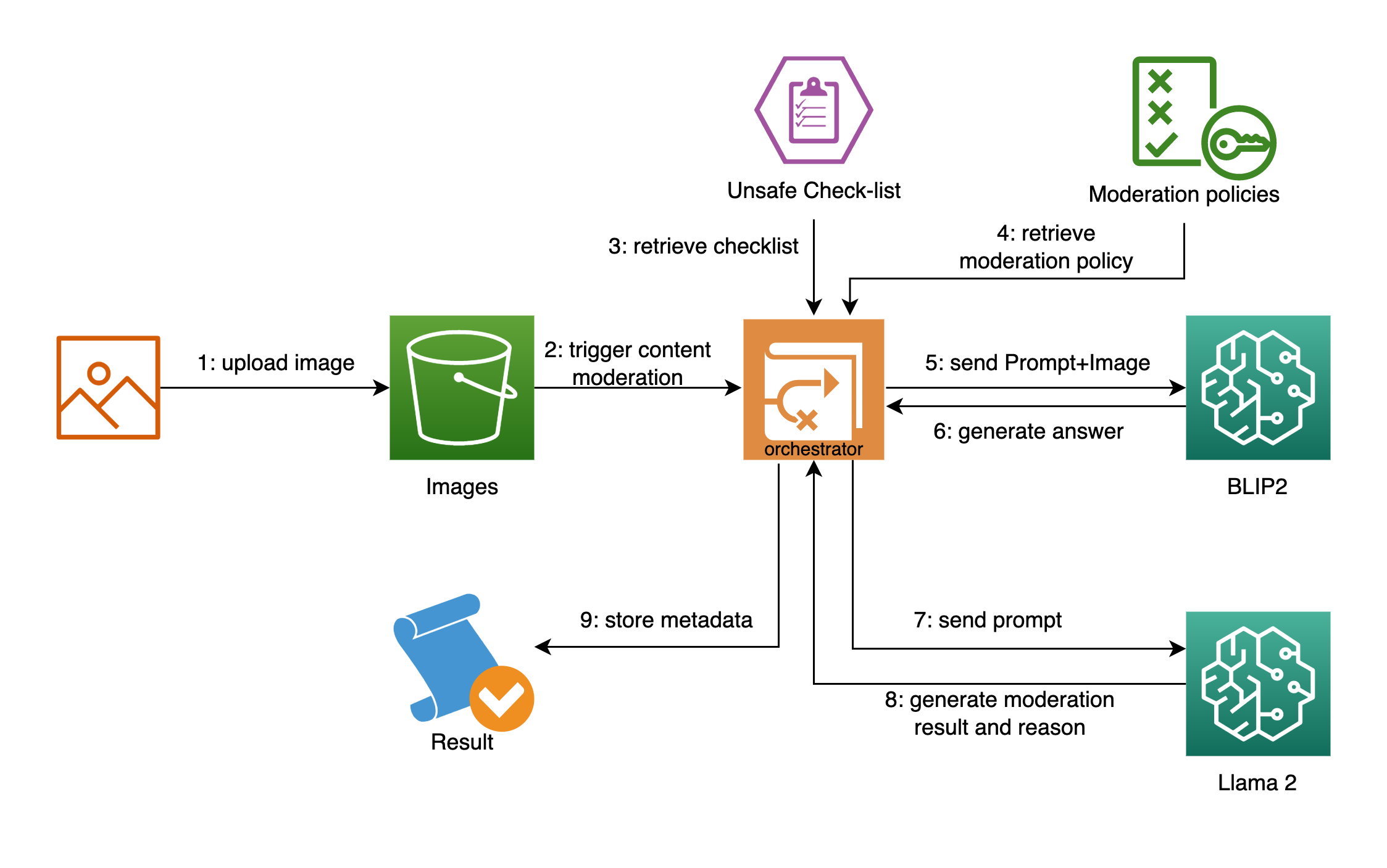

МЫ ИСПОЛЬЗУЕМ БЛИП-2 как мультимодальный метод предварительной подготовки. BLIP-2 — одна из самых современных моделей мультимодального предварительного обучения, превосходящая большинство существующих методов визуального ответа на вопросы, создания подписей к изображениям и поиска текста на изображениях. Для нашего LLM мы используем Llama 2, LLM следующего поколения с открытым исходным кодом, который превосходит существующие языковые модели с открытым исходным кодом по многим критериям, включая рассуждение, кодирование, проверку знаний и проверку знаний.. На следующей диаграмме показаны компоненты решения.

Проблемы с модерацией контента

Традиционные методы модерации контента, такие как модерация человеком, не могут справиться с растущим объемом пользовательского контента (UGC). По мере увеличения объема пользовательского контента модераторы-люди могут оказаться перегруженными и им будет сложно эффективно модерировать контент. Это приводит к плохому пользовательскому опыту, высоким затратам на модерацию и риску для бренда. Человеческая модерация также подвержена ошибкам, которые могут привести к непоследовательной модерации и предвзятым решениям. Решением этих проблем стала модерация контента на основе машинного обучения (ML). Алгоритмы ML могут анализировать большие объемы пользовательского контента и выявлять контент, нарушающий политику организации. Модели машинного обучения можно научить распознавать закономерности и выявлять проблемный контент, например разжигание ненависти, спам и неприемлемые материалы. Согласно исследованию Защитите своих пользователей, бренд и бюджет с помощью модерации контента на базе искусственного интеллекта.Модерация контента с помощью машинного обучения может помочь организациям сэкономить до 95 % времени, которое их команды тратят на модерацию контента вручную. Это позволяет организациям сосредоточить свои ресурсы на более стратегических задачах, таких как создание сообщества и создание контента. Модерация контента на основе машинного обучения также может снизить затраты на модерацию, поскольку она более эффективна, чем модерация, выполняемая человеком.

Несмотря на преимущества модерации контента на основе машинного обучения, у нее еще есть возможности для дальнейшего совершенствования. Эффективность алгоритмов ML во многом зависит от качества данных, на которых они обучаются. Когда модели обучаются с использованием предвзятых или неполных данных, они могут принимать ошибочные решения о модерации, подвергая организации риску бренда и потенциальной юридической ответственности. Внедрение подходов к модерации контента, основанных на машинном обучении, порождает ряд проблем, которые требуют тщательного рассмотрения. Эти проблемы включают в себя:

- Получение размеченных данных – Это может оказаться дорогостоящим процессом, особенно для сложных задач модерации контента, требующих обучения специалистов по маркировке. Эти затраты могут затруднить сбор достаточно больших наборов данных для легкого обучения модели машинного обучения с учителем. Кроме того, точность модели во многом зависит от качества обучающих данных, а необъективные или неполные данные могут привести к неверным решениям по модерации, что приведет к риску для бренда и юридической ответственности.

- Обобщение модели – Это имеет решающее значение для внедрения подходов, основанных на машинном обучении. Модель, обученная на одном наборе данных, может плохо обобщаться на другой набор данных, особенно если наборы данных имеют разные распределения. Поэтому важно убедиться, что модель обучена на разнообразном и репрезентативном наборе данных, чтобы она хорошо обобщалась на новые данные.

- Эксплуатационная эффективность – Это еще одна проблема при использовании традиционных подходов на основе машинного обучения для модерации контента. Постоянное добавление новых меток и переобучение модели при добавлении новых классов может занять много времени и средств. Кроме того, важно обеспечить регулярное обновление модели, чтобы успевать за изменениями модерируемого контента.

- Объяснимость – Конечные пользователи могут воспринимать платформу как предвзятую или несправедливую, если контент помечается или удаляется без обоснования, что приводит к ухудшению пользовательского опыта. Аналогичным образом, отсутствие четких объяснений может сделать процесс модерации контента неэффективным, трудоемким и дорогостоящим для модераторов.

- Состязательный характер – Состязательный характер модерации контента на основе изображений представляет собой уникальную проблему для традиционных подходов, основанных на машинном обучении. Злоумышленники могут попытаться обойти механизмы модерации контента, изменяя контент различными способами, например, используя синонимы изображений или встраивая их реальный контент в более крупный массив не оскорбительного контента. Это требует постоянного мониторинга и обновления модели для обнаружения и реагирования на такую враждебную тактику.

Мультимодальные рассуждения с BLIP-2

Мультимодальные модели машинного обучения относятся к моделям, которые могут обрабатывать и интегрировать данные из нескольких источников или модальностей, таких как изображения, текст, аудио, видео и другие формы структурированных или неструктурированных данных. Одной из популярных мультимодальных моделей являются модели визуального языка, такие как BLIP-2, которые сочетают в себе компьютерное зрение и обработку естественного языка (НЛП) для понимания и генерации как визуальной, так и текстовой информации. Эти модели позволяют компьютерам интерпретировать значение изображений и текста таким образом, чтобы имитировать человеческое понимание. Модели визуального языка могут решать различные задачи, включая подписи к изображениям, поиск текста изображения, визуальные ответы на вопросы и многое другое. Например, модель подписей к изображениям может генерировать описание изображения на естественном языке, а модель извлечения текста изображения может выполнять поиск изображений на основе текстового запроса. Визуальные модели ответов на вопросы могут отвечать на вопросы об изображениях на естественном языке, а мультимодальные чат-боты могут использовать визуальные и текстовые входные данные для генерации ответов. Что касается модерации контента, вы можете использовать эту возможность для запроса списка вопросов.

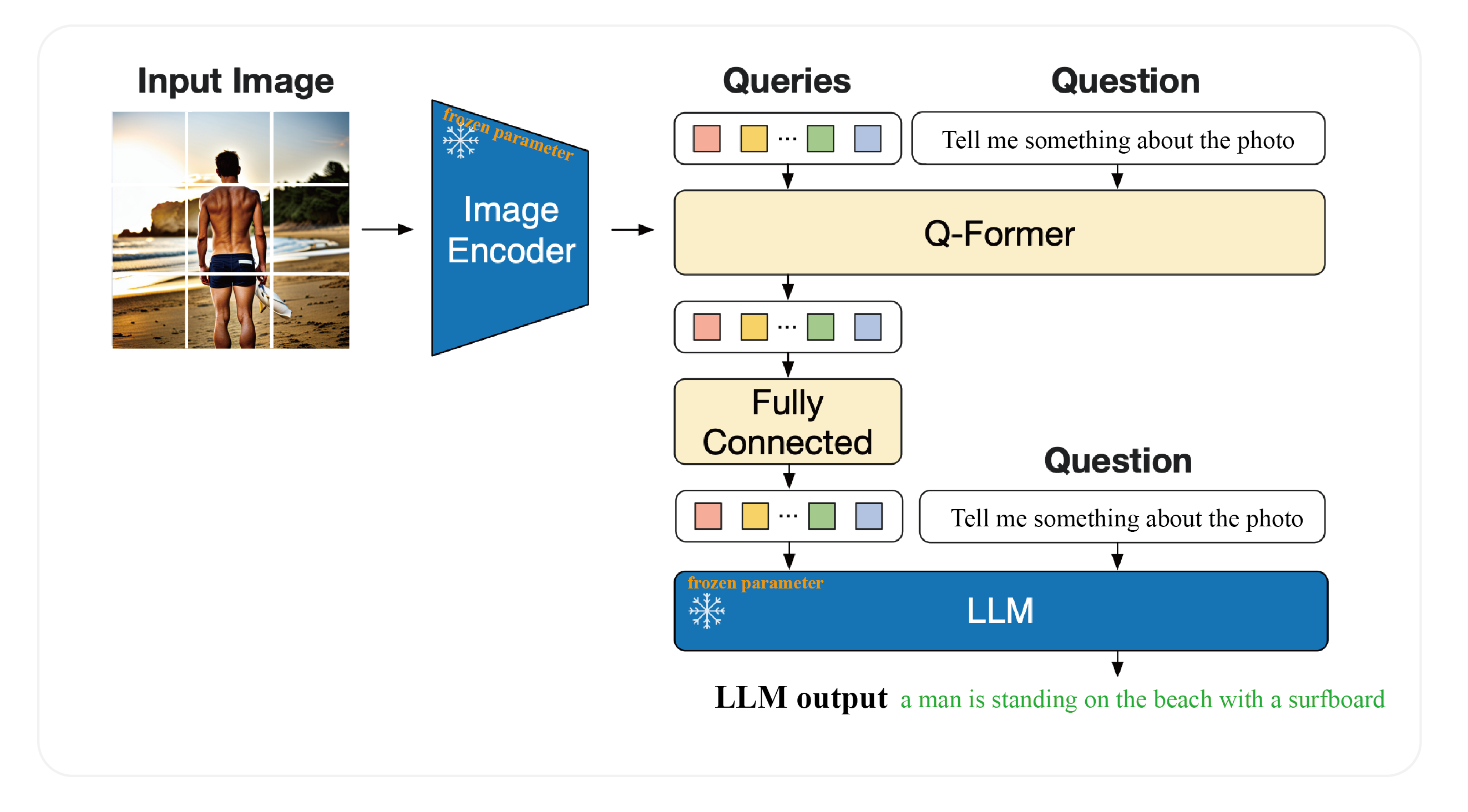

BLIP-2 состоит из трех частей. Первый компонент — это кодер стоп-кадра ViT-L/14 от CLIP, который принимает данные изображения в качестве входных данных. Второй компонент — это замороженный LLM, FlanT5, который выводит текст. Третий компонент — это обучаемый модуль под названием Q-Former, легкий преобразователь, который соединяет кодер замороженного изображения с замороженным LLM. Q-Former использует обучаемые векторы запросов для извлечения визуальных функций из кодера замороженных изображений и передает наиболее полезные визуальные функции в LLM для вывода желаемого текста.

Предварительная подготовка включает в себя два этапа. На первом этапе проводится обучение представлению визуального языка, чтобы научить Q-Former изучать наиболее подходящее визуальное представление текста. На втором этапе генеративное обучение преобразованию зрения в язык осуществляется путем подключения выходных данных Q-Former к замороженному LLM и обучения Q-Former выведению визуальных представлений, которые могут быть интерпретированы LLM.

BLIP-2 обеспечивает высочайшую производительность при решении различных задач, связанных с визуальным языком, несмотря на то, что у него значительно меньше обучаемых параметров, чем у существующих методов. Модель также демонстрирует новые возможности генерации изображений в текст с нулевым выстрелом, которые могут следовать инструкциям на естественном языке. Следующий рисунок изменен по сравнению с оригинальная исследовательская работа.

Обзор решения

Следующая диаграмма иллюстрирует архитектуру решения.

В следующих разделах мы покажем, как развернуть BLIP-2 на Создатель мудреца Амазонки конечную точку и используйте BLIP-2 и LLM для модерации контента.

Предпосылки

Вам нужна учетная запись AWS с Управление идентификацией и доступом AWS (IAM) с разрешениями на управление ресурсами, созданными в рамках решения. Для получения подробной информации см. Создайте отдельный аккаунт AWS..

Если вы впервые работаете с Студия Amazon SageMaker, сначала нужно создать Домен SageMaker. Кроме того, вам может потребоваться запросить увеличение квоты на обслуживание для соответствующих экземпляров хостинга SageMaker. Для модели BLIP-2 мы используем ml.g5.2xlarge Экземпляр хостинга SageMaker. Для модели Llama 2 13B мы используем ml.g5.12xlarge Экземпляр хостинга SageMaker.

Развертывание BLIP-2 на конечной точке SageMaker

Вы можете разместить LLM на SageMaker, используя Вывод большой модели (LMI), оптимизированный для размещения больших моделей с использованием DJLServing. DJLServing — это высокопроизводительное универсальное решение для обслуживания моделей, основанное на библиотеке Deep Java (DJL), не зависящей от языка программирования. Чтобы узнать больше о DJL и DJLServing, см. Развертывание больших моделей в Amazon SageMaker с использованием параллельного вывода моделей DJLServing и DeepSpeed.. С помощью контейнера LMI SageMaker модель BLIP-2 можно легко реализовать с помощью библиотеки Hugging Face и разместить на SageMaker. Вы можете запустить blip2-sagemaker.ipynb для этого шага.

Чтобы подготовить образ Docker и файл модели, вам необходимо получить образ Docker DJLServing, упаковать сценарий вывода и файлы конфигурации в виде файла. model.tar.gz файл и загрузите его в Простой сервис хранения Amazon (Amazon S3) ведро. Вы можете обратиться к сценарий вывода и файл конфигурации Больше подробностей.

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Когда образ Docker и файлы, связанные с выводом, готовы, вы создаете модель, конфигурацию для конечной точки и конечную точку:

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)Когда статус конечной точки перейдет в эксплуатацию, вы можете вызвать конечную точку для подписей к изображениям и выполнить указанную задачу создания нулевого изображения для преобразования изображения в язык. Для задачи подписи изображения вам нужно всего лишь передать изображение в конечную точку:

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)Для задачи создания инструктированного изображения с нулевым результатом, в дополнение к входному изображению, вам необходимо определить вопрос как подсказку:

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)Используйте BLIP-2 и LLM для модерации контента.

На этом этапе вы можете делать запросы к данному изображению и получать скрытую информацию. С помощью LLM вы организуете запросы и получаете информацию для генерации результата в формате JSON. Эту задачу можно грубо разделить на следующие две подзадачи:

- Извлеките информацию из изображения с помощью модели BLIP-2.

- Создайте окончательный результат и объяснение с помощью LLM.

Извлеките информацию из изображения с помощью модели BLIP-2.

Чтобы получить достаточно полезной скрытой информации из данного изображения, вам необходимо определить запросы. Поскольку каждый запрос вызывает конечную точку один раз, обработка многих запросов приведет к увеличению времени обработки. Поэтому мы предлагаем делать запросы качественными и охватывать все политики, но и без дублирования. В нашем примере кода мы определяем запросы следующим образом:

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]С помощью предыдущих запросов вызовите конечную точку BLIP-2 для получения информации с помощью следующего кода:

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """В дополнение к информации, полученной с помощью запросов, вы можете получить информацию с помощью задачи создания подписей к изображениям, вызвав конечную точку без prompt поле в полезной нагрузке:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')Вы можете объединить содержимое запросов и ответов с заголовком изображения и использовать эту полученную информацию для последующей задачи, описанной в следующем разделе ниже.

Создайте окончательный результат и объяснение с помощью LLM.

Большие языковые модели (LLM), такие как Llama 2, могут генерировать высококачественные результаты с помощью правильного шаблона подсказки. С использованием Amazon SageMaker JumpStartСпециалисты по ОД могут выбирать из широкого спектра общедоступных базовых моделей. Всего несколькими щелчками мыши в SageMaker Studio вы можете теперь обнаружить и развернуть Ламу 2.

Окончательные результаты зависят от LLM с конкретным шаблоном запроса. Такая подсказка состоит из: политики модерации, основанной на категориях неуместного или оскорбительного; категории модерации; информация изображения, извлеченная из BLIP-2; шаблон вопроса для LLM, в котором спрашивается, содержит ли фотография небезопасный контент, а также указывается его категория и причина, если она небезопасна; и инструкции по выводу результатов в формате JSON. Разработанный шаблон запроса позволяет LLM определить, нарушает ли изображение политику модерации, определить категорию нарушения, объяснить причину и предоставить выходные данные в структурированном формате JSON.

Основной исходный код выглядит следующим образом:

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]Вы можете настроить подсказку в соответствии со своим вариантом использования. Обратитесь к ноутбук Больше подробностей. Когда приглашение будет готово, вы можете вызвать конечную точку LLM для получения результатов:

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]Часть сгенерированного вывода выглядит следующим образом:

Иногда Лама 2 помимо ответа ассистента прилагает дополнительные пояснения. Вы можете использовать код синтаксического анализа для извлечения данных JSON из исходных сгенерированных результатов:

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

Преимущества генеративных подходов

В предыдущих разделах было показано, как реализовать основную часть вывода модели. В этом разделе мы рассмотрим различные аспекты генеративных подходов, включая сравнение с традиционными подходами и перспективами.

В следующей таблице сравниваются каждый подход.

| . | Генеративный подход | Классификационный подход |

| Получение размеченных данных | Предварительно обученная модель на большом количестве изображений, вывод с нулевым выстрелом | Требуются данные из всех типов категорий. |

| Обобщение модели | Предварительно обученная модель с различными типами изображений | Требуется большой объем данных, связанных с модерацией контента, для улучшения обобщения модели. |

| Эксплуатационная эффективность | Возможности нулевого выстрела | Требуется обучение модели распознаванию различных шаблонов и переобучение при добавлении меток. |

| Объяснимость | Рассуждение как текстовый вывод, отличный пользовательский опыт | Трудно добиться рассуждения, трудно объяснить и интерпретировать |

| Состязательный характер | крепкий | Высокочастотное переобучение |

Потенциальные варианты использования мультимодальных рассуждений помимо модерации контента

Модели BLIP-2 могут применяться для различных целей с точной настройкой или без нее, которая включает в себя следующее:

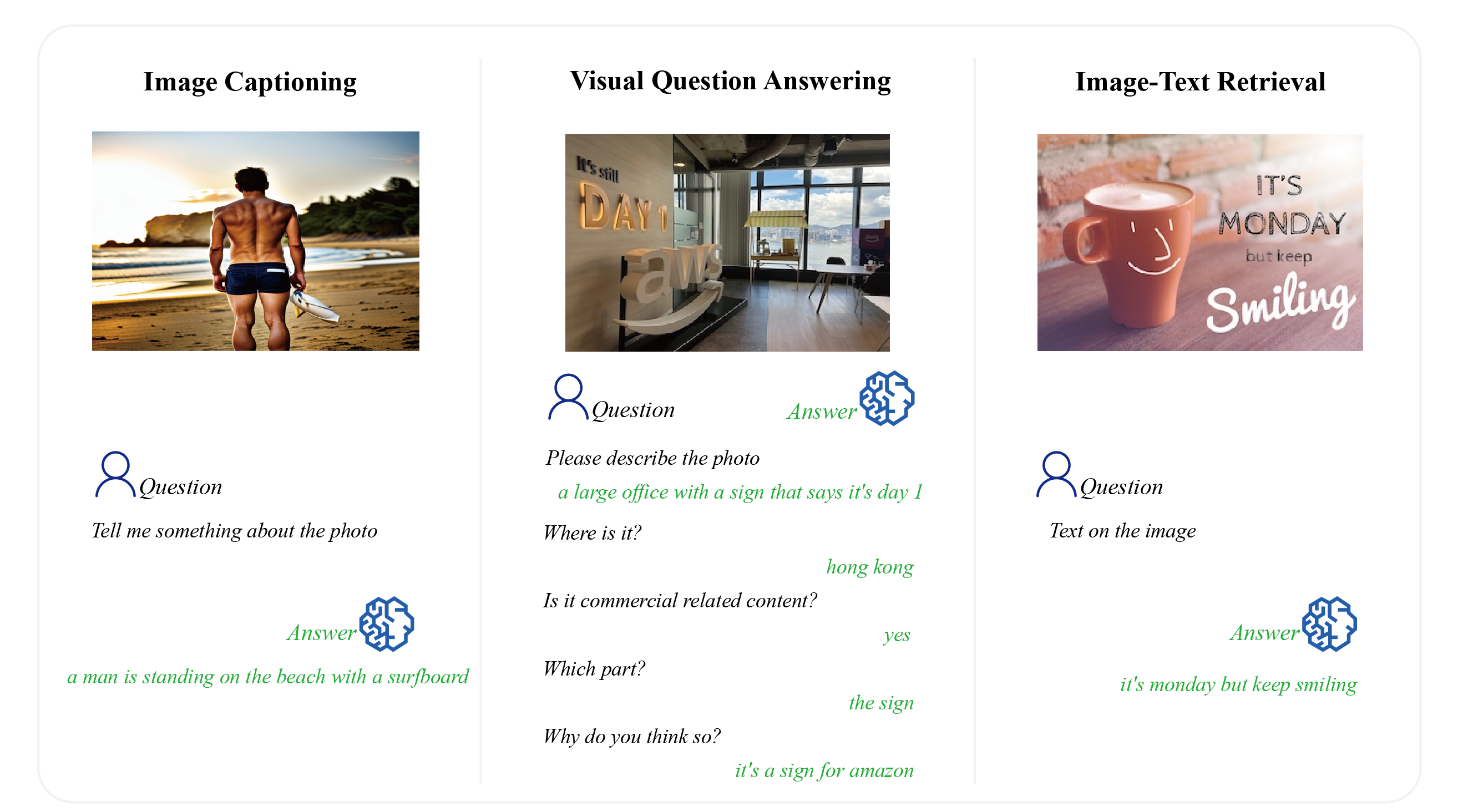

- Подписи к изображениям – Модель просит сгенерировать текстовое описание визуального содержимого изображения. Как показано на следующем примере изображения (слева), мы можем иметь «Мужчина стоит на пляже с доской для серфинга» как описание изображения.

- Визуальный ответ на вопрос – Как показывает пример изображения посередине, мы можем спросить «Это коммерческий контент?» и у нас есть "да" как ответ. Кроме того, BLIP-2 поддерживает многораундовый разговор и выводит следующий вопрос: "Почему ты так думаешь?" Основываясь на визуальных подсказках и возможностях LLM, BLIP-2 выводит «Это знак для Amazon».

- Получение текста изображения – Учитывая вопрос, как «Текст на изображении», мы можем извлечь текст изображения «сегодня понедельник, но продолжай улыбаться» как показано на изображении справа.

На следующих изображениях показаны примеры, демонстрирующие возможность простого преобразования изображения в текст при рассуждении визуальных знаний.

Как мы видим из различных приведенных выше примеров, мультимодальные модели открывают новые возможности для решения сложных проблем, с которыми традиционные одномодальные модели с трудом могли бы справиться.

Убирать

Чтобы избежать будущих расходов, удалите ресурсы, созданные в рамках этого сообщения. Вы можете сделать это, следуя инструкциям в разделе очистки записной книжки, или удалить созданные конечные точки через консоль SageMaker и ресурсы, хранящиеся в корзине S3.

Заключение

В этом посте мы обсудили важность модерации контента в цифровом мире и выделили связанные с этим проблемы. Мы предложили новый метод, который поможет улучшить модерацию контента с помощью данных изображений и отвечать на вопросы по изображениям для автоматического извлечения полезной информации. Мы также провели дальнейшее обсуждение преимуществ использования генеративного подхода на основе ИИ по сравнению с традиционным подходом, основанным на классификации. Наконец, мы проиллюстрировали потенциальные варианты использования моделей визуального языка помимо модерации контента.

Мы рекомендуем вам узнать больше, изучив SageMaker и создав решение, используя мультимодальное решение, представленное в этом посте, и набор данных, соответствующий вашему бизнесу.

Об авторах

Гордон Ван — старший специалист по AI/ML в AWS. Он поддерживает стратегических клиентов, используя лучшие практики искусственного интеллекта и машинного обучения во многих отраслях. Он увлечен компьютерным зрением, НЛП, генеративным искусственным интеллектом и MLOps. В свободное время он любит бегать и ходить в походы.

Гордон Ван — старший специалист по AI/ML в AWS. Он поддерживает стратегических клиентов, используя лучшие практики искусственного интеллекта и машинного обучения во многих отраслях. Он увлечен компьютерным зрением, НЛП, генеративным искусственным интеллектом и MLOps. В свободное время он любит бегать и ходить в походы.

Янвэй Цуй, доктор философии, старший специалист по архитектуре решений в области машинного обучения в AWS. Он начал исследования в области машинного обучения в IRISA (Научно-исследовательский институт компьютерных наук и случайных систем) и имеет несколько лет опыта создания промышленных приложений на базе искусственного интеллекта в области компьютерного зрения, обработки естественного языка и прогнозирования поведения пользователей в Интернете. В AWS он делится своим опытом в предметной области и помогает клиентам раскрыть бизнес-потенциал и добиться практических результатов с помощью машинного обучения в больших масштабах. Вне работы он любит читать и путешествовать.

Янвэй Цуй, доктор философии, старший специалист по архитектуре решений в области машинного обучения в AWS. Он начал исследования в области машинного обучения в IRISA (Научно-исследовательский институт компьютерных наук и случайных систем) и имеет несколько лет опыта создания промышленных приложений на базе искусственного интеллекта в области компьютерного зрения, обработки естественного языка и прогнозирования поведения пользователей в Интернете. В AWS он делится своим опытом в предметной области и помогает клиентам раскрыть бизнес-потенциал и добиться практических результатов с помощью машинного обучения в больших масштабах. Вне работы он любит читать и путешествовать.

Мелани Ли, доктор философии, является старшим специалистом по искусственному интеллекту и машинному обучению TAM в AWS, базирующейся в Сиднее, Австралия. Она помогает корпоративным клиентам создавать решения с использованием передовых инструментов искусственного интеллекта и машинного обучения в AWS, а также предоставляет рекомендации по разработке и внедрению решений машинного обучения с учетом передового опыта. В свободное время она любит исследовать природу и проводить время с семьей и друзьями.

Мелани Ли, доктор философии, является старшим специалистом по искусственному интеллекту и машинному обучению TAM в AWS, базирующейся в Сиднее, Австралия. Она помогает корпоративным клиентам создавать решения с использованием передовых инструментов искусственного интеллекта и машинного обучения в AWS, а также предоставляет рекомендации по разработке и внедрению решений машинного обучения с учетом передового опыта. В свободное время она любит исследовать природу и проводить время с семьей и друзьями.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Автомобили / электромобили, Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- ЧартПрайм. Улучшите свою торговую игру с ChartPrime. Доступ здесь.

- Смещения блоков. Модернизация права собственности на экологические компенсации. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :имеет

- :является

- :нет

- :куда

- $UP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95%

- a

- в состоянии

- О нас

- выше

- доступ

- По

- Учетная запись

- точность

- Достигать

- Достигает

- актеры

- фактического соединения

- добавленный

- добавить

- дополнение

- дополнительный

- Дополнительно

- адрес

- придерживаясь

- Принятие

- Принятие

- Преимущества

- состязательный

- Рекламодателям

- Реклама

- против

- AI

- Поддержка

- AI / ML

- алгоритмы

- выравнивание

- Все

- позволяет

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- анализировать

- и

- Другой

- ответ

- ответы

- любой

- Приложения

- прикладной

- подхода

- подходы

- соответствующий

- архитектура

- МЫ

- AS

- спросить

- аспекты

- помощник

- ассоциации

- предполагает,

- At

- аудио

- Австралия

- автоматически

- доступен

- избежать

- AWS

- Плохой

- основанный

- BE

- Beach

- , так как:

- становиться

- становится

- поведение

- не являетесь

- ниже

- тесты

- Кроме

- ЛУЧШЕЕ

- лучшие практики

- Beyond

- пристрастный

- кровь

- тело

- изоферменты печени

- марка

- брендов

- Приносит

- широкий

- бюджет

- строить

- Строительство

- бизнес

- но

- by

- под названием

- CAN

- Может получить

- возможности

- возможности

- тщательный

- случаев

- случаев

- категории

- Категории

- вызов

- проблемы

- сложные

- изменения

- расходы

- chatbots

- Выберите

- классов

- Очистить

- клиент

- одежда

- код

- Кодирование

- объединять

- комбинаты

- коммерческая

- сообщество

- общественное строительство

- Компания

- сравненный

- полный

- комплекс

- компонент

- компоненты

- компьютер

- Информатика

- Компьютерное зрение

- компьютеры

- Конфигурация

- подтвердить

- Соединительный

- подключает

- рассмотрение

- считается

- состоит

- Консоли

- постоянная

- постоянно

- обращайтесь

- содержать

- Container

- содержит

- содержание

- контентного создание

- содержание

- содействие

- обычный

- Разговор

- Беседы

- Основные

- соответствующий

- Цена

- дорогостоящий

- Расходы

- может

- чехол для варгана

- Создайте

- создали

- создание

- критической

- Пересекать

- Клиенты

- настроить

- данным

- безопасность данных

- Наборы данных

- решение

- решения

- глубоко

- определять

- определенный

- демонстрировать

- убивают

- демонстрирует

- развертывание

- описано

- описание

- предназначенный

- проектирование

- желанный

- Несмотря на

- подробнее

- обнаруживать

- Определять

- Диалог

- различный

- Интернет

- цифровой мир

- непосредственно

- обсуждается

- обсуждение

- распределения

- Разное

- do

- Docker

- приносит

- домен

- управлять

- каждый

- простота

- легко

- фактически

- эффективность

- эффективный

- вложения

- появившийся

- появление

- работает

- включить

- позволяет

- поощрять

- конец

- Конечная точка

- Усиливает

- достаточно

- обеспечивать

- обеспечение

- Предприятие

- ошибки

- особенно

- существенный

- пример

- Примеры

- существующий

- опыт

- опыта

- Объяснять

- объяснение

- Больше

- Исследование

- Экспозиция

- и, что лучший способ

- извлечение

- Face

- Водопад

- семья

- Особенность

- Особенности

- женский пол

- несколько

- меньше

- поле

- борьба

- Файл

- Файлы

- окончательный

- финансы

- Во-первых,

- Впервые

- соответствовать

- Помеченные

- Фокус

- следовать

- после

- следующим образом

- Что касается

- формат

- формы

- Год основания

- частота

- друзья

- от

- замороженные

- Функции

- далее

- будущее

- собирать

- порождать

- генерируется

- порождающий

- поколение

- генеративный

- Генеративный ИИ

- получить

- Дайте

- данный

- большой

- Рост

- Рост

- руководство

- обрабатывать

- произошло

- Жесткий

- Есть

- имеющий

- he

- Медицина

- информация о здоровье

- здравоохранение

- сильно

- помощь

- помогает

- ее

- Скрытый

- High

- высокая производительность

- высококачественный

- Выделенные

- его

- кашель

- состоялся

- хостинг

- Как

- How To

- HTML

- HTTP

- HTTPS

- человек

- определения

- идентифицирующий

- Личность

- if

- иллюстрирует

- изображение

- изображений

- осуществлять

- в XNUMX году

- Осуществляющий

- Импортировать

- значение

- важную

- улучшать

- улучшение

- in

- неточный

- включают

- включает в себя

- В том числе

- Увеличение

- Увеличивает

- промышленность

- промышленности

- промышленность

- неэффективное

- информация

- вход

- затраты

- пример

- Институт

- инструкции

- интегрировать

- интерес

- в нашей внутренней среде,

- в

- вводить

- IT

- ЕГО

- Java

- JPG

- JSON

- всего

- Сохранить

- знания

- Этикетки

- язык

- большой

- больше

- вести

- ведущий

- УЧИТЬСЯ

- изучение

- оставил

- Юр. Информация

- обязательства

- Библиотека

- легкий

- Список

- Лама

- LLM

- дольше

- любит

- машина

- обучение с помощью машины

- Сохранение

- сделать

- Создание

- человек

- управлять

- вручную

- многих

- материала

- Май..

- me

- смысл

- механизмы

- Медиа

- Мета

- метод

- методы

- средняя

- ML

- млн операций в секунду

- модель

- Модели

- умеренность

- модифицировало

- Модули

- понедельник

- Мониторинг

- БОЛЕЕ

- более эффективным

- самых

- с разными

- натуральный

- Обработка естественного языка

- природа

- Необходимость

- отрицательный

- Новые

- следующий

- НЛП

- ноутбук

- роман

- сейчас

- номер

- of

- наступление

- on

- консолидировать

- ONE

- онлайн

- только

- открытый

- с открытым исходным кодом

- Возможности

- оптимизированный

- or

- организации

- оригинал

- Другое

- наши

- Наша компания

- Результаты

- Превосходит

- выходной

- внешнюю

- перегружены

- собственный

- пакет

- Параллельные

- параметры

- часть

- особенно

- части

- pass

- страстный

- паттеранами

- Выполнять

- производительность

- выполнены

- Разрешения

- человек

- личного

- лиц

- перспективы

- кандидат наук

- Фото

- основной

- Платформа

- Платформы

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- играет

- пожалуйста

- сборах

- политика

- состояния потока

- Популярное

- После

- потенциал

- потенциалов

- Питание

- мощный

- практиками

- прогноз

- Подготовить

- разрабатывает

- сохранение

- предотвращает

- Расставляйте приоритеты

- политикой конфиденциальности.

- проблемам

- процесс

- обработка

- Программирование

- предложило

- защиту

- обеспечивать

- при условии

- приводит

- что такое варган?

- гласность

- публично

- целей

- положил

- Вопросы и ответы

- Запросы

- вопрос

- Вопросы

- случайный

- Reading

- готовый

- причина

- признавать

- признавая

- уменьшить

- регулярно

- правила

- Связанный

- соответствующие

- полагаться

- удален

- представление

- представитель

- репутация

- запросить

- требовать

- требуется

- исследованиям

- Полезные ресурсы

- Реагируйте

- ответ

- ответы

- результат

- в результате

- Итоги

- возвращают

- выявление

- доходы

- Рост выручки

- RGB

- правую

- Снижение

- рисках,

- Роли

- грубо

- Правило

- Run

- Бег

- s

- охрана

- Сохранность

- sagemaker

- Шкала

- Наука

- Поиск

- Во-вторых

- Раздел

- разделах

- Сектора юридического права

- безопасность

- посмотреть

- выбор

- старший

- чувствительный

- служит

- обслуживание

- Услуги

- выступающей

- набор

- несколько

- Сексуальный

- Акции

- разделение

- она

- Щит

- показывать

- показал

- Шоу

- подпись

- значение

- существенно

- Аналогичным образом

- просто

- обстоятельства

- So

- Соцсети

- социальные сети

- социальные медиа-платформы

- Решение

- Решения

- Решение

- Источник

- исходный код

- Источники

- Space

- пространства

- спам

- специалист

- конкретный

- речь

- тратить

- раскол

- Этап

- этапы

- автономные

- стандартов

- и политические лидеры

- современное состояние

- Области

- Статус:

- Шаг

- По-прежнему

- диск

- хранить

- Стратегический

- структурированный

- Бороться

- студия

- Кабинет

- такие

- предлагать

- Поддержка

- Сидней

- системы

- ТАБЛИЦЫ

- снасти

- тактика

- принимает

- Сложность задачи

- задачи

- команды

- сказать

- шаблон

- terms

- текст

- текстовый

- чем

- который

- Ассоциация

- информация

- их

- Там.

- тем самым

- следовательно

- Эти

- они

- think

- В третьих

- этой

- три

- время

- кропотливый

- в

- инструменты

- традиционный

- Train

- специалистов

- Обучение

- трансформатор

- Путешествие

- два

- напишите

- Типы

- под

- понимать

- понимание

- созданного

- Universal

- отпереть

- обновление

- обновление

- поддерживать

- загружено

- использование

- прецедент

- Информация о пользователе

- Пользовательский опыт

- конфиденциальность пользователей

- пользователей

- через

- Наши ценности

- разнообразие

- различный

- с помощью

- Видео

- НАРУШЕНИЕ

- видение

- объем

- тома

- Путь..

- способы

- we

- Web

- веб-сервисы

- веб-сайты

- ЧТО Ж

- Что

- когда

- , которые

- зачем

- будете

- в

- без

- слова

- Работа

- работает

- Мир

- бы

- лет

- Ты

- ВАШЕ

- зефирнет