Мошенничество в Интернете может стать намного опаснее благодаря тому, что мошенники имеют беспрепятственный доступ к ChatGPT, Techradar отчеты.

Широко популярный чат-бот ChatGPT на базе искусственного интеллекта постоянно попадает в заголовки. Благодаря своей способности писать все, от отладки кода iframe до сложного кода компьютерного программирования, ChatGPT сделал искусственный интеллект модным словечком года.

Несмотря на свою огромную популярность и вовлеченность, ChatGPT вызывает опасения по поводу этики и регулирования.

Читайте также: ИИ пользователей ChatGPT «побег из тюрьмы» и раскрытие альтер-эго Дэна

Недавнее отчету опубликованный исследователями кибербезопасности в Norton Labs, изложил три основных способа, которыми злоумышленники могут злоупотреблять ChatGPT. В отчете указывается, что ChatGPT можно использовать для более эффективного мошенничества в Интернете: путем создания глубоко поддельного контента, создания фишинга и создания вредоносных программ.

«Norton Labs ожидает, что мошенники также присматриваются к возможностям больших языковых моделей и тестируют способы улучшения своих киберпреступлений, чтобы сделать их более реалистичными и правдоподобными», — говорится в отчете.

Способность инструмента производить «высококачественную дезинформацию или дезинформацию в больших масштабах» может помочь ботоферм более эффективно усиливать разногласия. По словам Нортона, это может позволить злоумышленникам без особых усилий «внушать сомнения и манипулировать повествованиями на нескольких языках».

Очень убедительная «дезинформация»

Написание бизнес-планов, стратегий и описаний компаний в убедительной форме — это детская игра для ChatGPT. Однако этот потенциал также повышает риск дезинформации, которая может превратиться в мошенничество.

«Мало того, что контент, генерируемый ChatGPT, иногда непреднамеренно неправильный, но злоумышленник также может использовать эти инструменты для преднамеренного создания контента, который каким-либо образом вредит людям», — говорится в отчете.

Его способность генерировать «высококачественную дезинформацию или дезинформацию в масштабе может привести к недоверию и формированию нарративов на разных языках».

Написание отзывов о продуктах становится все проще благодаря ChatGPT, который невозможно отследить, поскольку он каждый раз генерирует отдельные ответы с одной и той же предоставленной информацией. Несмотря на свои возможности, он создает проблему «обнаружения поддельных отзывов и некачественных продуктов».

Вызывает беспокойство тот факт, что этот инструмент также может быть использован для издевательств.

«Использование этих инструментов в кампаниях по травле в социальных сетях, чтобы заставить людей замолчать или запугать их, также является возможным результатом, который окажет сдерживающий эффект на высказывания», — отмечается в отчете.

ChatGPT в фишинговых кампаниях

ChatGPT особенно хорошо умеет генерировать человеческий текст на разных языках, и читатели не задумываются о том, был ли текст создан искусственным интеллектом или человеком. Даже OpenAI, разработчик ChatGPT, не может определить, был ли текст написан ИИ, заявив, что «невозможно надежно определить весь текст, написанный ИИ».

Перспектива использования ChatGPT в фишинговых кампаниях вполне реальна.

«Злоумышленники могут использовать ChatGPT для создания фишинговых электронных писем или сообщений в социальных сетях, которые кажутся исходящими из законных источников, что затрудняет обнаружение и защиту от таких типов угроз», — говорится в отчете.

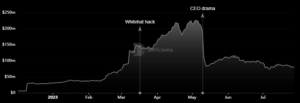

По мере роста его популярности вероятным следствием является увеличение количества «фишинговых кампаний и их изощренности».

В отчете говорится, что «злоумышленники могут скармливать ChatGPT реальные примеры невредоносных сообщений от компаний, которые они хотят выдать за себя, и приказывать ИИ создавать новые сообщения в том же стиле со злым умыслом».

Такие кампании могут оказаться весьма успешными в том, что касается обмана лиц, заставляющих их раскрывать личную информацию или отправлять деньги преступным организациям. Norton Labs посоветовала потребителям быть осторожными при «нажатии на ссылки или предоставлении личной информации».

ChatGPT может создавать вредоносное ПО

Генерация кода и адаптация различных языков программирования — это неотъемлемая часть услуг ChatGPT. Поэтому неудивительно, что мошенники используют его для создания вредоносных программ.

«С помощью подсказки начинающие авторы вредоносных программ могут описать, что они хотят сделать, и получить работающие фрагменты кода», — говорится в отчете. Это создает серьезную угрозу атак вредоносных программ, достаточно продвинутых, чтобы нанести ущерб.

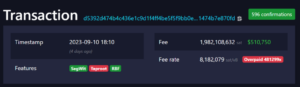

«Одним из примеров является генерация кода для обнаружения того, когда адрес биткойн-кошелька копируется в буфер обмена, чтобы его можно было заменить вредоносным адресом, контролируемым автором вредоносного ПО», — поясняется в отчете.

В результате доступность такого чат-бота вызовет рост сложности вредоносного ПО.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. Доступ здесь.

- Источник: https://metanews.com/chatgpt-is-being-used-to-make-quality-scams/

- :является

- 7

- 8

- a

- способность

- в состоянии

- О нас

- злоупотребление

- доступ

- По

- актеры

- адрес

- продвинутый

- против

- AI

- Поддержка

- помощь

- Все

- и

- предвидение

- появиться

- МЫ

- AS

- At

- нападки

- автор

- Авторы

- свободных мест

- Плохой

- основанный

- BE

- , так как:

- становиться

- не являетесь

- Bitcoin

- Bitcoin Wallet

- Бот

- издевательства

- бизнес

- by

- Кампании

- CAN

- не могу

- возможности

- Пропускная способность

- Вызывать

- осторожный

- вызов

- Chatbot

- ChatGPT

- код

- Компании

- Компания

- комплекс

- компьютер

- Обеспокоенность

- Потребители

- содержание

- Генерация контента

- непрерывно

- контроль

- может

- выработать

- Создайте

- создание

- Криминальное

- Информационная безопасность

- опасно

- описывать

- Застройщик

- различный

- трудный

- Раскрытие

- раздор

- дезинформация

- сомневаюсь

- каждый

- эффект

- Эффективный

- фактически

- Писем

- включить

- обязательство

- лиц

- установленный

- этика

- Даже

- многое

- пример

- Примеры

- объяснены

- не настоящие

- Фермы

- Что касается

- мошенники

- от

- порождать

- генерируется

- генерирует

- порождающий

- поколение

- получить

- хорошо

- Есть

- имеющий

- Последние новости

- очень

- Однако

- HTTPS

- огромный

- человек

- определения

- что она

- in

- Увеличение

- Увеличивает

- все больше и больше

- указанный

- individual

- лиц

- информация

- намерение

- намеренно

- Интернет

- IT

- ЕГО

- Основные

- Labs

- язык

- Языки

- большой

- вести

- ЖИЗНЬЮ

- связи

- мало

- серия

- сделать

- Создание

- вредоносных программ

- макс-ширина

- Медиа

- Сообщения

- может быть

- дезинформация

- недоверие

- Модели

- деньги

- БОЛЕЕ

- с разными

- повествовательный

- Новые

- Заметки

- новички

- номер

- of

- on

- ONE

- OpenAI

- заказ

- Результат

- часть

- особенно

- Люди

- личного

- фишинг

- Планы

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Играть

- Играть за

- Популярное

- популярность

- представляет

- возможное

- Блог

- потенциал

- производит

- Произведенный

- Продукция

- Программирование

- языки программирования

- перспектива

- Доказывать

- при условии

- обеспечение

- опубликованный

- Читать

- читатели

- реальные

- реальная жизнь

- реалистичный

- последний

- "Регулирование"

- заменить

- отчету

- исследователи

- результат

- Отзывы

- рисках,

- то же

- Шкала

- Мошенничество

- Мошенники

- мошенничество

- отправка

- серьезный

- Услуги

- Форма

- Молчание

- просто

- So

- Соцсети

- социальные сети

- Сообщения в социальных сетях

- некоторые

- Источники

- речь

- озлобленность

- заявил

- стратегий

- стиль

- успешный

- такие

- технологии

- Тестирование

- Спасибо

- который

- Ассоциация

- их

- Их

- Эти

- угроза

- актеры угрозы

- угрозы

- три

- Через

- время

- в

- инструментом

- инструменты

- ОЧЕРЕДЬ

- Типы

- развязать

- использование

- пользователей

- Кошелек

- Путь..

- способы

- Что

- будь то

- , которые

- широко

- будете

- работает

- бы

- записывать

- письменный

- зефирнет