Поддержание рабочих процессов машинного обучения (ML) в производстве — сложная задача, поскольку она требует создания конвейеров непрерывной интеграции и непрерывной доставки (CI/CD) для кода и моделей ML, управления версиями моделей, мониторинга отклонения данных и концепций, переобучения моделей и руководства. процесс утверждения, чтобы гарантировать, что новые версии модели удовлетворяют требованиям как к производительности, так и к соответствию.

В этом посте мы описываем, как создать рабочий процесс MLOps для пакетного вывода, который автоматизирует планирование заданий, мониторинг модели, переобучение и регистрацию, а также обработку ошибок и уведомление с помощью Создатель мудреца Амазонки, Amazon EventBridge, AWS Lambda, Amazon Простая служба уведомлений (Amazon SNS), HashiCorp Terraform и GitLab CI/CD. Представленный рабочий процесс MLOps предоставляет многократно используемый шаблон для управления жизненным циклом машинного обучения посредством автоматизации, мониторинга, аудита и масштабируемости, тем самым снижая сложности и затраты на поддержание рабочих нагрузок пакетного вывода в производстве.

Обзор решения

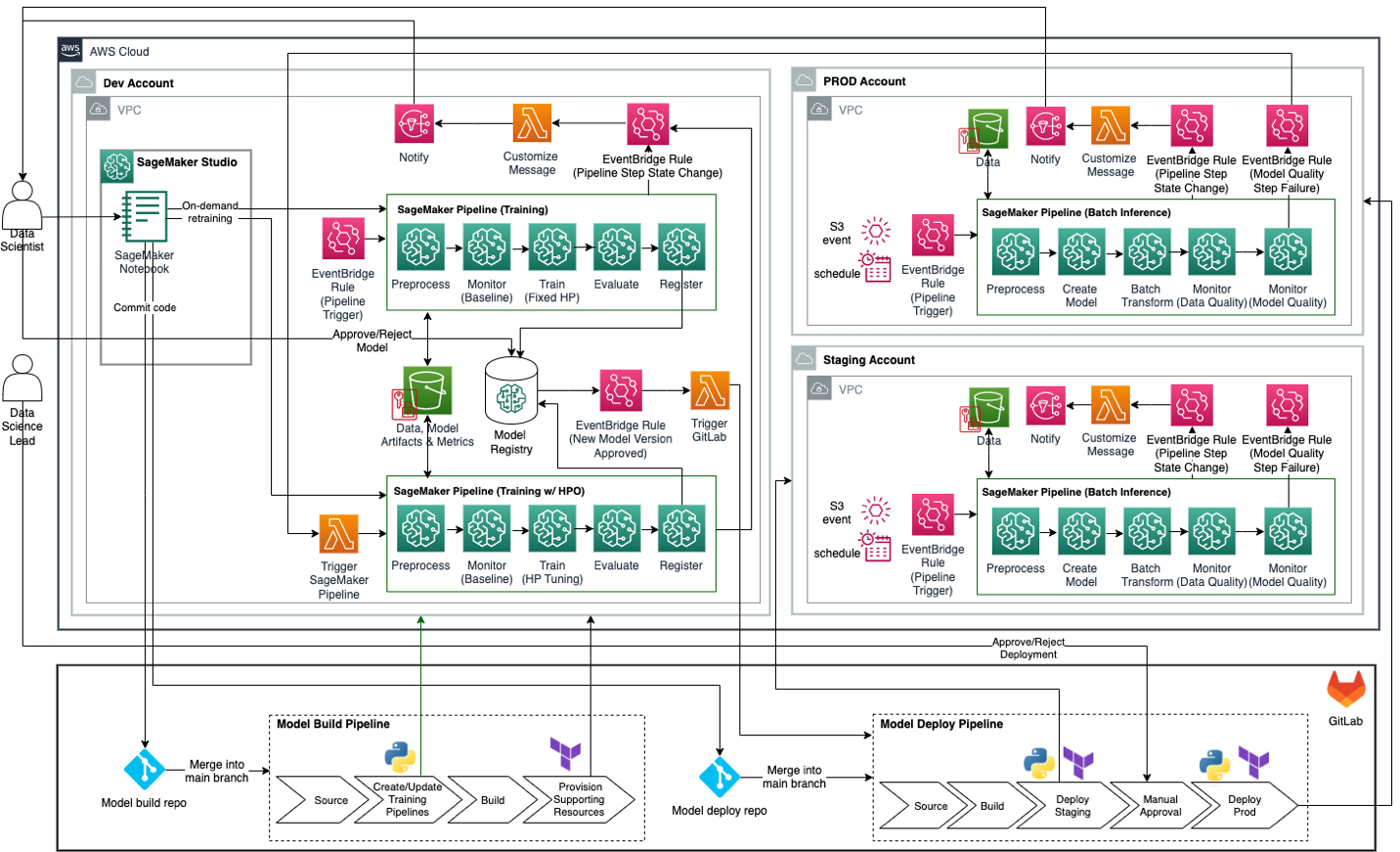

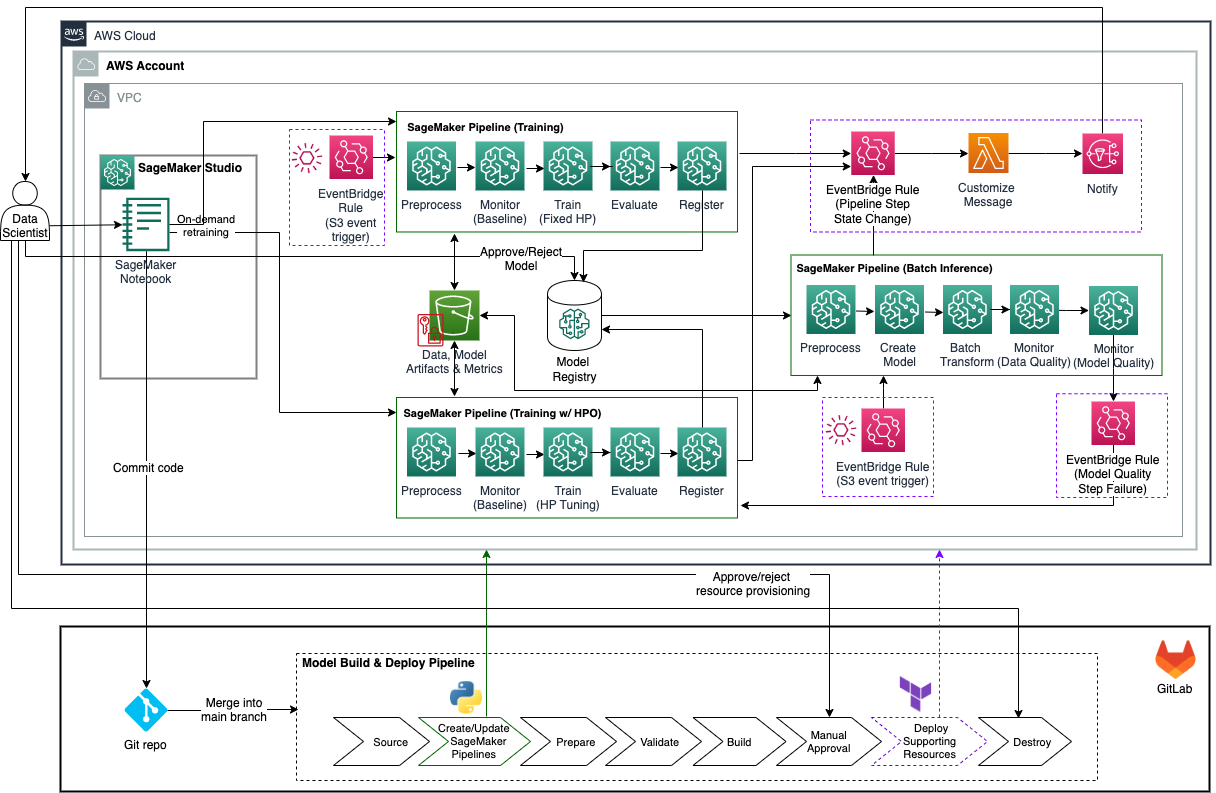

На следующем рисунке показана предлагаемая целевая архитектура MLOps для корпоративного пакетного вывода для организаций, которые используют GitLab CI/CD и инфраструктуру Terraform как код (IaC) в сочетании с инструментами и сервисами AWS. GitLab CI/CD выступает в роли макрооркестратора, координирующего model build и model deploy трубопроводы, которые включают в себя поиск, строительство и снабжение Конвейеры Amazon SageMaker и поддержка ресурсов с использованием SageMaker Python SDK и Terraform. SageMaker Python SDK используется для создания или обновления конвейеров SageMaker для обучения, обучения с оптимизацией гиперпараметров (HPO) и пакетного вывода. Terraform используется для создания дополнительных ресурсов, таких как правила EventBridge, функции Lambda и темы SNS для мониторинга конвейеров SageMaker и отправки уведомлений (например, при сбое или успехе этапа конвейера). SageMaker Pipelines выступает в качестве оркестратора для обучения моделей машинного обучения и рабочих процессов вывода.

Эта архитектура представляет собой стратегию с несколькими учетными записями, в которой модели машинного обучения создаются, обучаются и регистрируются в центральном реестре моделей в учетной записи разработки науки о данных (которая имеет больше элементов управления, чем обычная учетная запись разработки приложений). Затем конвейеры вывода развертываются в промежуточных и производственных учетных записях с использованием автоматизации с помощью инструментов DevOps, таких как GitLab CI/CD. Центральный реестр моделей также может быть дополнительно размещен в учетной записи общих служб. Ссылаться на Операционная модель лучшие практики в отношении стратегии использования нескольких учетных записей для ОД.

В следующих подразделах мы подробно обсудим различные аспекты проектирования архитектуры.

Инфраструктура как код

IaC предлагает способ управления ИТ-инфраструктурой с помощью машиночитаемых файлов, обеспечивая эффективный контроль версий. В этом посте и прилагаемом примере кода мы демонстрируем, как использовать ХашиКорп Терраформ с GitLab CI/CD для эффективного управления ресурсами AWS. Такой подход подчеркивает ключевое преимущество IaC, предлагая прозрачный и повторяемый процесс управления ИТ-инфраструктурой.

Обучение и переподготовка моделей

В этой схеме конвейер обучения SageMaker запускается по расписанию (через EventBridge) или на основе Простой сервис хранения Amazon (Amazon S3) триггер события (например, когда файл триггера или новые данные обучения, в случае одного объекта данных обучения, помещаются в Amazon S3) для регулярной повторной калибровки модели с использованием новых данных. Этот конвейер не вносит в модель структурные или существенные изменения, поскольку использует фиксированные гиперпараметры, утвержденные в процессе проверки модели предприятия.

Конвейер обучения регистрирует недавно обученную версию модели в Реестр моделей Amazon SageMaker если модель превышает предопределенный порог производительности модели (например, RMSE для регрессии и оценку F1 для классификации). Когда новая версия модели регистрируется в реестре моделей, ответственный специалист по данным получает уведомление через Amazon SNS. Затем специалисту по обработке данных необходимо просмотреть и вручную утвердить последнюю версию модели в Студия Amazon SageMaker пользовательского интерфейса или через вызов API с помощью Интерфейс командной строки AWS (AWS CLI) или AWS SDK для Python (Boto3), прежде чем новую версию модели можно будет использовать для вывода.

Конвейер обучения SageMaker и его вспомогательные ресурсы созданы GitLab. model build конвейер, либо посредством ручного запуска конвейера GitLab, либо автоматически при объединении кода в main Ветви model build Репозиторий Git.

Пакетный вывод

Конвейер пакетного вывода SageMaker запускается по расписанию (через EventBridge) или на основе триггера события S3. Конвейер пакетного вывода автоматически извлекает последнюю утвержденную версию модели из реестра модели и использует ее для вывода. Конвейер пакетного вывода включает в себя этапы проверки качества данных по сравнению с базовым уровнем, созданным конвейером обучения, а также качество модели (производительность модели), если доступны основные метки истинности.

Если конвейер пакетного вывода обнаружит проблемы с качеством данных, он уведомит ответственного специалиста по данным через Amazon SNS. Если он обнаружит проблемы с качеством модели (например, RMSE превышает заранее заданный порог), этап конвейера проверки качества модели завершится неудачей, что, в свою очередь, вызовет событие EventBridge для запуска обучения с помощью конвейера HPO.

Конвейер пакетного вывода SageMaker и его вспомогательные ресурсы созданы GitLab. model deploy конвейер, либо посредством ручного запуска конвейера GitLab, либо автоматически при объединении кода в main Ветви model deploy Репозиторий Git.

Настройка и перенастройка модели

Обучение SageMaker с помощью конвейера HPO запускается в случае сбоя на этапе проверки качества модели конвейера пакетного вывода. Проверка качества модели выполняется путем сравнения прогнозов модели с фактическими метками истинности. Если метрика качества модели (например, RMSE для регрессии и оценка F1 для классификации) не соответствует заранее заданному критерию, шаг проверки качества модели помечается как неудавшийся. Обучение SageMaker с помощью конвейера HPO также может быть запущено вручную (в пользовательском интерфейсе SageMaker Studio или через вызов API с использованием AWS CLI или SageMaker Python SDK) ответственным специалистом по данным, если это необходимо. Поскольку гиперпараметры модели меняются, ответственный специалист по данным должен получить одобрение совета по рассмотрению модели предприятия, прежде чем новая версия модели может быть одобрена в реестре моделей.

Обучение SageMaker с использованием конвейера HPO и его вспомогательные ресурсы созданы GitLab. model build конвейер, либо посредством ручного запуска конвейера GitLab, либо автоматически при объединении кода в main Ветви model build Репозиторий Git.

Мониторинг модели

Статистика данных и базовые ограничения ограничений генерируются в рамках обучения и обучения с помощью конвейеров HPO. Они сохраняются в Amazon S3, а также регистрируются вместе с обученной моделью в реестре моделей, если модель проходит оценку. Предлагаемая архитектура конвейера пакетного вывода использует Монитор моделей Amazon SageMaker для проверки качества данных при использовании пользовательских Обработка Amazon SageMaker этапы проверки качества модели. Такая конструкция отделяет проверки качества данных и модели, что, в свою очередь, позволяет отправлять предупреждающее уведомление только при обнаружении отклонения данных; и запускать обучение с помощью конвейера HPO при обнаружении нарушения качества модели.

Утверждение модели

После регистрации вновь обученной модели в реестре моделей ответственный специалист по обработке данных получает уведомление. Если модель прошла обучение с помощью конвейера обучения (повторная калибровка с использованием новых обучающих данных при фиксированных гиперпараметрах), нет необходимости в одобрении совета по рассмотрению модели предприятия. Специалист по данным может самостоятельно просмотреть и утвердить новую версию модели. С другой стороны, если модель прошла обучение с помощью конвейера HPO (перенастройка путем изменения гиперпараметров), новая версия модели должна пройти процесс проверки предприятия, прежде чем ее можно будет использовать для вывода в производстве. Когда процесс проверки завершен, специалист по данным может продолжить работу и утвердить новую версию модели в реестре моделей. Изменение статуса пакета модели на Approved запустит функцию Lambda через EventBridge, что, в свою очередь, запустит GitLab. model deploy конвейер через вызов API. Это автоматически обновит конвейер пакетного вывода SageMaker, чтобы использовать для вывода последнюю утвержденную версию модели.

Существует два основных способа утвердить или отклонить новую версию модели в реестре модели: с помощью AWS SDK для Python (Boto3) или из пользовательского интерфейса SageMaker Studio. По умолчанию и конвейер обучения, и обучение с использованием набора конвейеров HPO ModelApprovalStatus в PendingManualApproval. Ответственный специалист по данным может обновить статус утверждения модели, позвонив по телефону. update_model_package API от Boto3. Ссылаться на Обновить статус утверждения модели для получения подробной информации об обновлении статуса утверждения модели через пользовательский интерфейс SageMaker Studio.

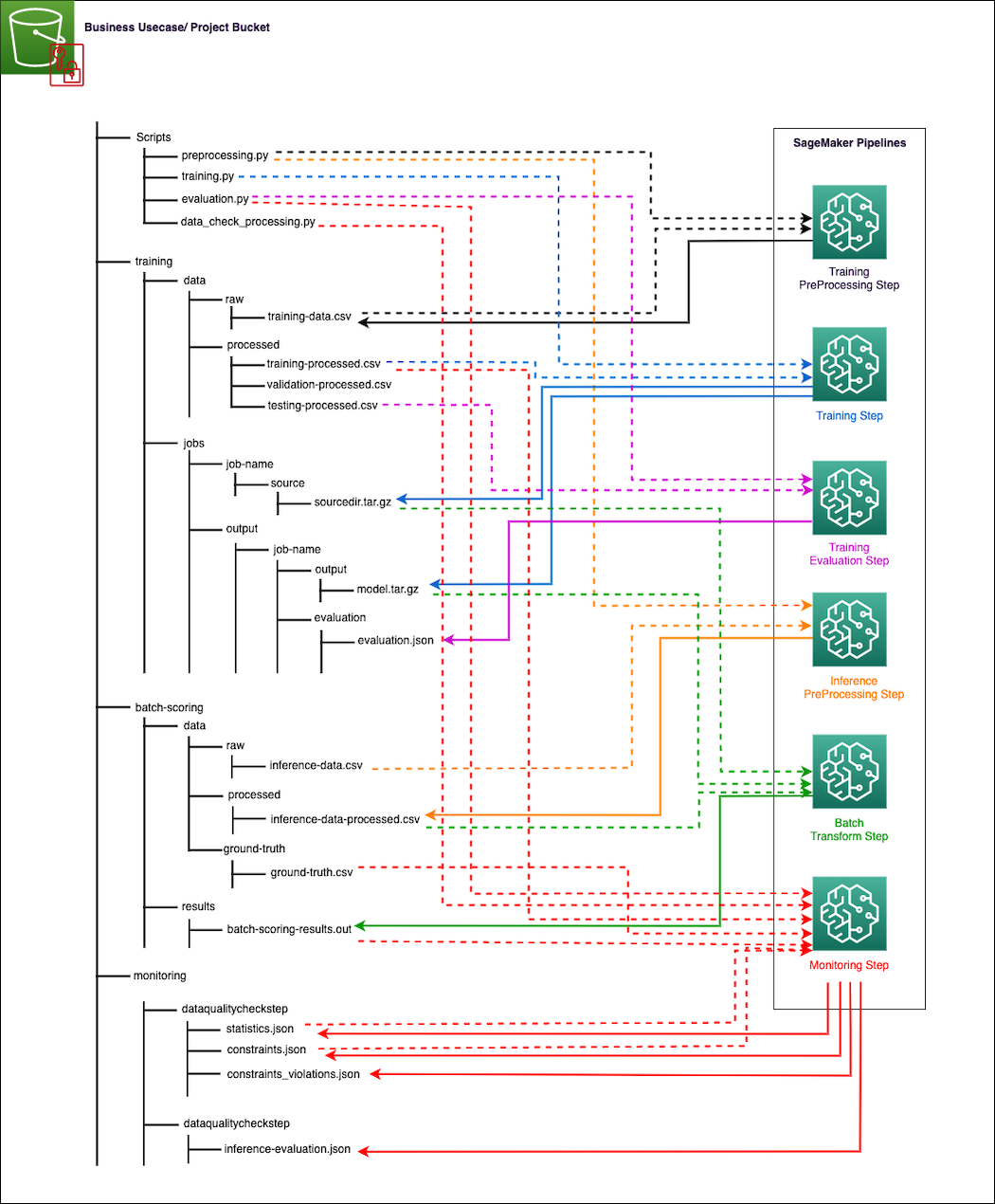

Проектирование ввода-вывода данных

SageMaker напрямую взаимодействует с Amazon S3 для чтения входных данных и хранения выходных данных отдельных шагов в конвейерах обучения и вывода. На следующей диаграмме показано, как различные сценарии Python, необработанные и обработанные данные обучения, необработанные и обработанные данные вывода, результаты вывода и основные метки истинности (если они доступны для мониторинга качества модели), артефакты модели, метрики оценки обучения и вывода (мониторинг качества модели), а также базовые показатели качества данных и отчеты о нарушениях (для мониторинга качества данных) могут быть организованы в корзине S3. Направление стрелок на диаграмме указывает, какие файлы являются входными или выходными для соответствующих этапов конвейеров SageMaker. Стрелки имеют цветовую маркировку в зависимости от типа шага конвейера, чтобы их было легче читать. Конвейер автоматически загрузит скрипты Python из репозитория GitLab и сохранит выходные файлы или артефакты модели каждого шага по соответствующему пути S3.

Дата-инженер несет ответственность за следующее:

- Загрузка помеченных обучающих данных по соответствующему пути в Amazon S3. Это включает в себя регулярное добавление новых данных обучения, чтобы гарантировать, что конвейер обучения и обучение с помощью конвейера HPO имеют доступ к последним данным обучения для переобучения и перенастройки модели соответственно.

- Загрузка входных данных для вывода по соответствующему пути в сегменте S3 перед запланированным запуском конвейера вывода.

- Загрузка меток достоверной информации в соответствующий путь S3 для мониторинга качества модели.

Специалист по данным несет ответственность за следующее:

- Подготовка меток достоверной информации и предоставление их команде разработки данных для загрузки на Amazon S3.

- Прохождение версий модели, прошедших обучение, с помощью конвейера HPO, через процесс проверки предприятия и получение необходимых разрешений.

- Ручное утверждение или отклонение новых версий обученной модели в реестре моделей.

- Утверждение производственных ворот для конвейера вывода и поддержка ресурсов, которые будут переведены в производство.

Образец кода

В этом разделе мы представляем пример кода для операций пакетного вывода с настройкой одной учетной записи, как показано на следующей схеме архитектуры. Пример кода можно найти в Репозиторий GitHubи может служить отправной точкой для пакетного вывода с мониторингом модели и автоматическим переобучением с использованием контрольных точек качества, часто необходимых предприятиям. Пример кода отличается от целевой архитектуры следующим образом:

- Он использует одну учетную запись AWS для создания и развертывания модели машинного обучения и поддержки ресурсов. Ссылаться на Организация среды AWS с использованием нескольких учетных записей инструкции по настройке нескольких учетных записей на AWS.

- Он использует один конвейер CI/CD GitLab для создания и развертывания модели машинного обучения и поддержки ресурсов.

- Когда новая версия модели обучена и одобрена, конвейер GitLab CI/CD не запускается автоматически, и ответственный специалист по данным должен запустить его вручную, чтобы обновить конвейер пакетного вывода SageMaker последней утвержденной версией модели.

- Он поддерживает только триггеры на основе событий S3 для запуска конвейеров обучения и вывода SageMaker.

Предпосылки

Перед развертыванием этого решения у вас должны быть следующие предварительные условия:

- Аккаунт AWS

- Студия SageMaker

- Роль исполнения SageMaker с возможностью чтения/записи Amazon S3 и Служба управления ключами AWS (AWS KMS) разрешения на шифрование/дешифрование

- Корзина S3 для хранения данных, скриптов и артефактов модели.

- Terraform версия 0.13.5 или выше

- GitLab с работающим Docker-раннером для запуска конвейеров

- Интерфейс командной строки AWS

- jq

- расстегнуть молнию

- Python3 (Python 3.7 или новее) и следующие пакеты Python:

- бото3

- sagemaker

- панд

- Pyyaml

Структура репозитория

Ассоциация Репозиторий GitHub содержит следующие каталоги и файлы:

/code/lambda_function/– Этот каталог содержит файл Python для функции Lambda, которая подготавливает и отправляет уведомления (через Amazon SNS) об изменениях состояния шагов конвейеров SageMaker./data/– Этот каталог содержит файлы необработанных данных (обучающие данные, выводы и достоверные данные)./env_files/– Этот каталог содержит файл входных переменных Terraform./pipeline_scripts/– Этот каталог содержит три сценария Python для создания и обновления обучения, вывода и обучения с помощью конвейеров HPO SageMaker, а также файлы конфигурации для указания параметров каждого конвейера./scripts/– Этот каталог содержит дополнительные сценарии Python (например, предварительную обработку и оценку), на которые ссылаются процессы обучения, вывода и обучения с помощью конвейеров HPO..gitlab-ci.yml– Этот файл определяет конфигурацию конвейера GitLab CI/CD./events.tf– Этот файл определяет ресурсы EventBridge./lambda.tf– Этот файл определяет функцию уведомления Lambda и связанные с ней Управление идентификацией и доступом AWS (ИАМ) ресурсы/main.tf– Этот файл определяет источники данных Terraform и локальные переменные./sns.tf– Этот файл определяет ресурсы Amazon SNS./tags.json– Этот файл JSON позволяет вам объявлять пары «ключ-значение» пользовательских тегов и добавлять их к вашим ресурсам Terraform с помощью локальной переменной./variables.tf– Этот файл объявляет все переменные Terraform.

Переменные и конфигурация

В следующей таблице показаны переменные, которые используются для параметризации этого решения. Обратитесь к ./env_files/dev_env.tfvars файл для более подробной информации.

| Имя | Описание |

bucket_name |

Корзина S3, которая используется для хранения данных, скриптов и артефактов модели. |

bucket_prefix |

Префикс S3 для проекта ML |

bucket_train_prefix |

Префикс S3 для обучающих данных |

bucket_inf_prefix |

Префикс S3 для данных вывода |

notification_function_name |

Имя функции Lambda, которая подготавливает и отправляет уведомления об изменениях состояния шагов конвейеров SageMaker. |

custom_notification_config |

Конфигурация для настройки сообщения уведомления для определенных шагов конвейера SageMaker при обнаружении определенного состояния запуска конвейера. |

email_recipient |

Список адресов электронной почты для получения уведомлений об изменении состояния этапов конвейеров SageMaker. |

pipeline_inf |

Имя конвейера вывода SageMaker |

pipeline_train |

Название конвейера обучения SageMaker |

pipeline_trainwhpo |

Название обучения SageMaker с конвейером HPO |

recreate_pipelines |

Если установлено на true, три существующих конвейера SageMaker (обучение, вывод, обучение с помощью HPO) будут удалены и будут созданы новые при запуске GitLab CI/CD. |

model_package_group_name |

Название группы пакетов модели |

accuracy_mse_threshold |

Максимальное значение MSE перед требованием обновления модели |

role_arn |

Роль IAM ARN роли выполнения конвейера SageMaker |

kms_key |

Ключ KMS ARN для шифрования Amazon S3 и SageMaker |

subnet_id |

Идентификатор подсети для сетевой конфигурации SageMaker |

sg_id |

Идентификатор группы безопасности для сетевой конфигурации SageMaker |

upload_training_data |

Если установлено на trueданные обучения будут загружены в Amazon S3, и эта операция загрузки инициирует запуск конвейера обучения. |

upload_inference_data |

Если установлено на true, данные вывода будут загружены в Amazon S3, и эта операция загрузки инициирует запуск конвейера вывода. |

user_id |

Идентификатор сотрудника пользователя SageMaker, который добавляется в качестве тега к ресурсам SageMaker. |

Разверните решение

Выполните следующие шаги, чтобы развернуть решение в своем аккаунте AWS:

- Клонируйте репозиторий GitHub в свой рабочий каталог.

- Просмотрите и измените конфигурацию конвейера GitLab CI/CD в соответствии с вашей средой. Конфигурация указана в

./gitlab-ci.yml. - Обратитесь к файлу README, чтобы обновить общие переменные решения в файле README.

./env_files/dev_env.tfvarsфайл. Этот файл содержит переменные как для сценариев Python, так и для автоматизации Terraform.- Проверьте дополнительные параметры SageMaker Pipelines, определенные в файлах YAML в разделе

./batch_scoring_pipeline/pipeline_scripts/. Просмотрите и при необходимости обновите параметры.

- Проверьте дополнительные параметры SageMaker Pipelines, определенные в файлах YAML в разделе

- Ознакомьтесь со сценариями создания конвейера SageMaker в

./pipeline_scripts/а также сценарии, на которые они ссылаются в./scripts/папка. Примеры сценариев, представленные в репозитории GitHub, основаны на Набор данных Abalone. Если вы собираетесь использовать другой набор данных, обязательно обновите сценарии в соответствии с вашей конкретной проблемой. - Поместите файлы данных в

./data/папку, используя следующее соглашение об именах. Если вы используете набор данных Abalone вместе с предоставленными примерами сценариев, убедитесь, что файлы данных не содержат заголовков, обучающие данные включают как независимые, так и целевые переменные с сохранением исходного порядка столбцов, данные вывода включают только независимые переменные и основную истину. файл включает только целевую переменную.training-data.csvinference-data.csvground-truth.csv

- Зафиксируйте и отправьте код в репозиторий, чтобы запустить конвейер GitLab CI/CD (первый запуск). Обратите внимание, что первый запуск конвейера завершится неудачей на

pipelineэтапе, поскольку еще нет утвержденной версии модели, которую можно было бы использовать в сценарии конвейера вывода. Просмотрите журнал шагов и проверьте новый конвейер SageMaker с именемTrainingPipelineбыл успешно создан.

-

- Откройте пользовательский интерфейс SageMaker Studio, затем просмотрите и запустите конвейер обучения.

- После успешного запуска конвейера обучения подтвердите зарегистрированную версию модели в реестре моделей, а затем повторно запустите весь конвейер GitLab CI/CD.

- Просмотрите выходные данные плана Terraform в

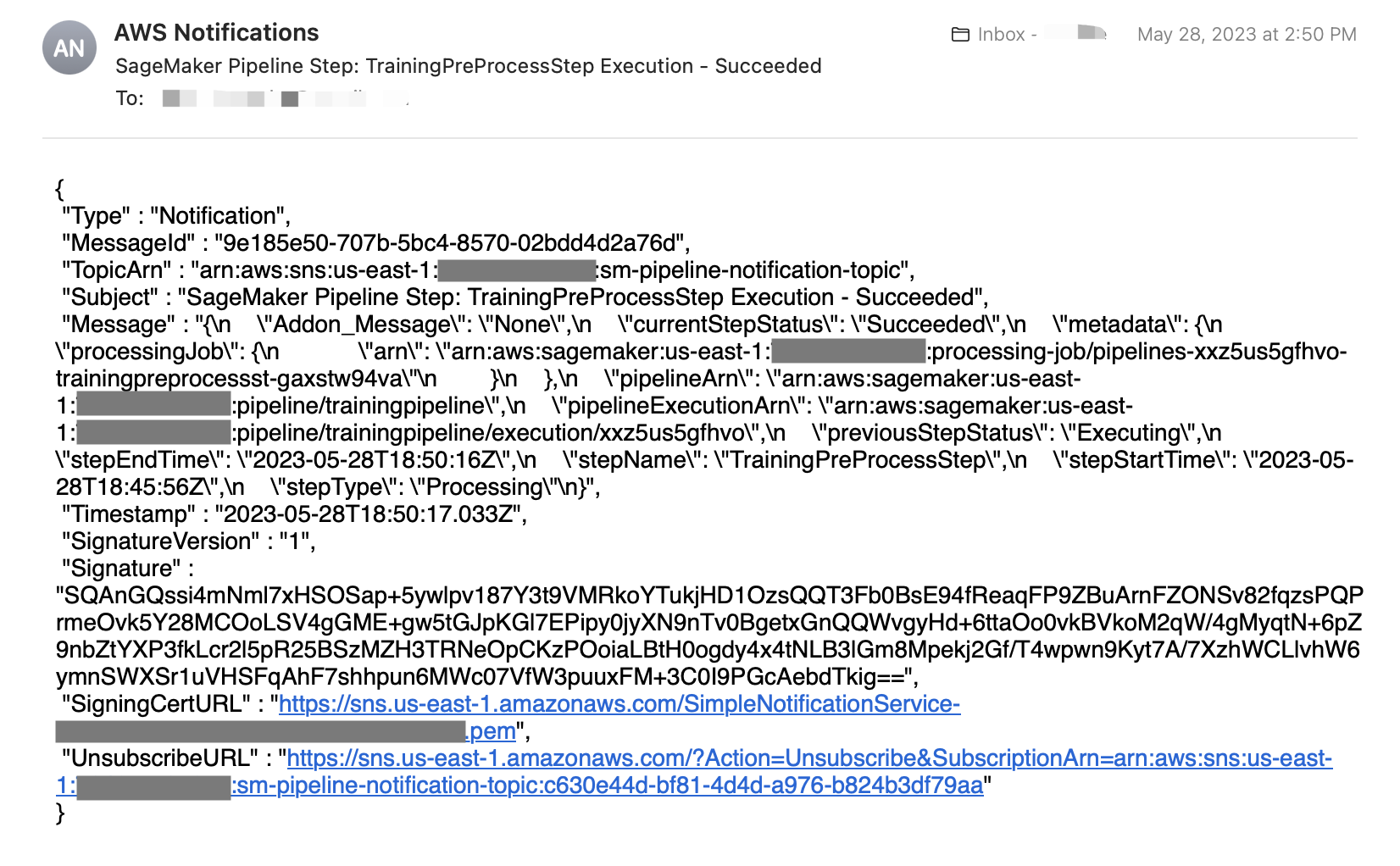

buildэтап. Утвердить руководствоapplyэтап в конвейере GitLab CI/CD, чтобы возобновить работу конвейера и разрешить Terraform создавать ресурсы мониторинга и уведомлений в вашей учетной записи AWS. - Наконец, просмотрите состояние запуска и выходные данные конвейеров SageMaker в пользовательском интерфейсе SageMaker Studio и проверьте свою электронную почту на наличие сообщений с уведомлениями, как показано на следующем снимке экрана. Тело сообщения по умолчанию имеет формат JSON.

Конвейеры SageMaker

В этом разделе мы описываем три конвейера SageMaker в рабочем процессе MLOps.

Учебный конвейер

Процесс обучения состоит из следующих этапов:

- Этап предварительной обработки, включая преобразование и кодирование объектов

- Этап проверки качества данных для создания статистики данных и базовой линии ограничений с использованием обучающих данных.

- Шаг обучения

- Этап оценки обучения

- Шаг условия, чтобы проверить, соответствует ли обученная модель заранее заданному порогу производительности.

- Шаг регистрации модели для регистрации вновь обученной модели в реестре моделей, если обученная модель соответствует требуемому порогу производительности.

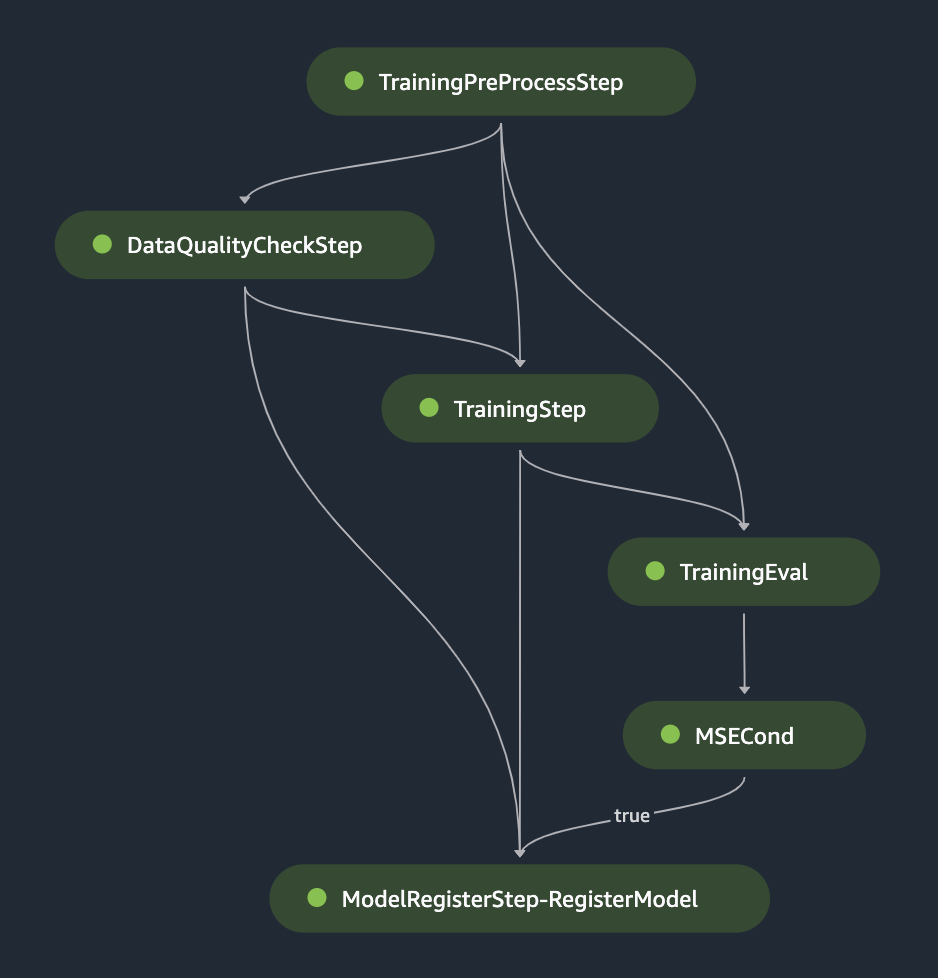

И skip_check_data_quality и register_new_baseline_data_quality параметры установлены на True в процессе обучения. Эти параметры предписывают конвейеру пропустить проверку качества данных и просто создать и зарегистрировать новую статистику данных или базовые уровни ограничений, используя обучающие данные. На следующем рисунке показан успешный запуск конвейера обучения.

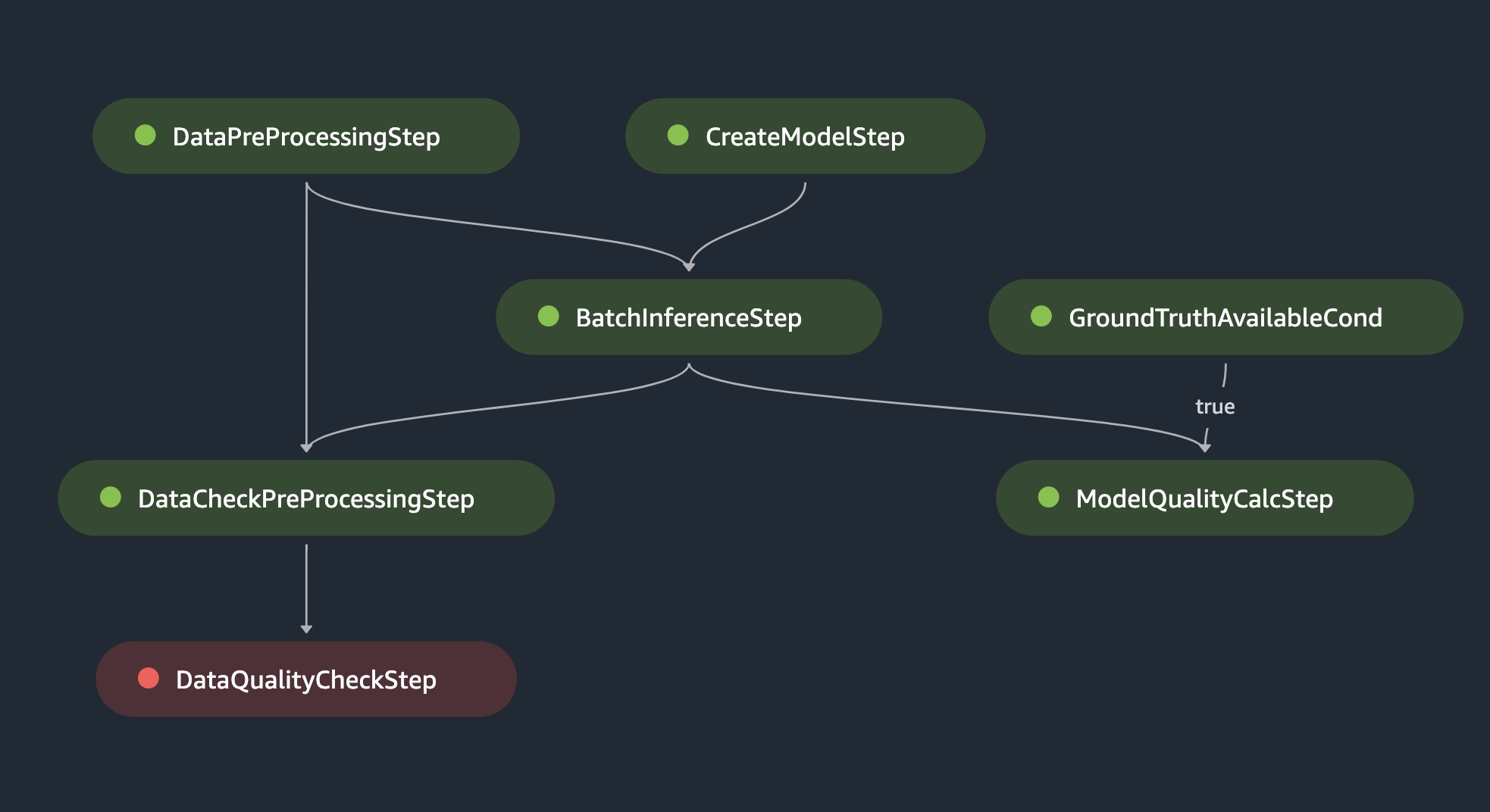

Конвейер пакетного вывода

Конвейер пакетного вывода состоит из следующих шагов:

- Создание модели из последней утвержденной версии модели в реестре моделей.

- Этап предварительной обработки, включая преобразование и кодирование объектов

- Шаг пакетного вывода

- Этап предварительной обработки проверки качества данных, на котором создается новый файл CSV, содержащий как входные данные, так и прогнозы модели, которые будут использоваться для проверки качества данных.

- Этап проверки качества данных, на котором входные данные сравниваются с базовой статистикой и ограничениями, связанными с зарегистрированной моделью.

- Условный шаг, чтобы проверить, доступны ли основные достоверные данные. Если доступны наземные данные, будет выполнен этап проверки качества модели.

- Этап расчета качества модели, на котором рассчитывается производительность модели на основе основных меток истинности.

И skip_check_data_quality и register_new_baseline_data_quality параметры установлены на False в конвейере вывода. Эти параметры предписывают конвейеру выполнить проверку качества данных с использованием статистики данных или базовой линии ограничений, связанной с зарегистрированной моделью (supplied_baseline_statistics_data_quality и supplied_baseline_constraints_data_quality) и пропустить создание или регистрацию новой статистики данных и базовых линий ограничений во время вывода. На следующем рисунке показан запуск конвейера пакетного вывода, при котором этап проверки качества данных не удался из-за низкой производительности модели на данных вывода. В этом конкретном случае обучение с помощью конвейера HPO будет запущено автоматически для точной настройки модели.

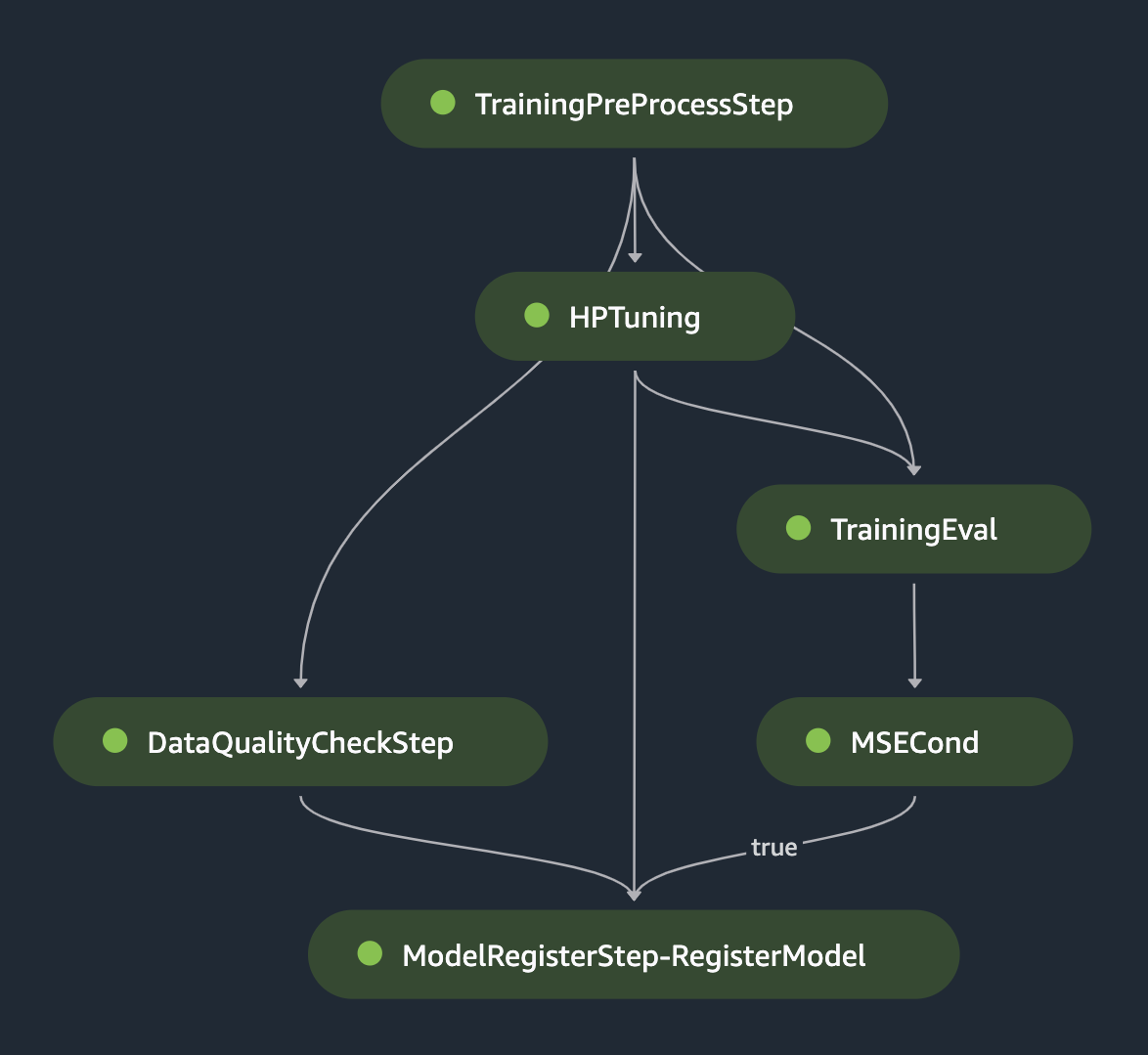

Обучение работе с HPO

Обучение работе с HPO Pipeline состоит из следующих этапов:

- Этап предварительной обработки (преобразование и кодирование признаков)

- Этап проверки качества данных для создания статистики данных и базовой линии ограничений с использованием обучающих данных.

- Шаг настройки гиперпараметра

- Этап оценки обучения

- Шаг условия, чтобы проверить, соответствует ли обученная модель заранее заданному порогу точности.

- Этап регистрации модели, если наиболее обученная модель соответствует требуемому порогу точности.

И skip_check_data_quality и register_new_baseline_data_quality параметры установлены на True в обучении работе с трубопроводом HPO. На следующем рисунке показан успешный запуск обучения с использованием конвейера HPO.

Убирать

Выполните следующие шаги, чтобы очистить ресурсы:

- Использовать

destroyэтап в конвейере GitLab CI/CD, чтобы исключить все ресурсы, предоставленные Terraform. - Используйте интерфейс командной строки AWS, чтобы список и удаление все оставшиеся конвейеры, созданные сценариями Python.

- При желании удалите другие ресурсы AWS, такие как корзина S3 или роль IAM, созданные вне конвейера CI/CD.

Заключение

В этом посте мы продемонстрировали, как предприятия могут создавать рабочие процессы MLOps для своих заданий пакетного вывода с помощью Amazon SageMaker, Amazon EventBridge, AWS Lambda, Amazon SNS, HashiCorp Terraform и GitLab CI/CD. Представленный рабочий процесс автоматизирует мониторинг данных и моделей, переобучение модели, а также выполнение пакетных заданий, управление версиями кода и предоставление инфраструктуры. Это может привести к значительному сокращению сложностей и затрат на поддержание заданий пакетного вывода в производстве. Дополнительные сведения о деталях реализации см. Репо GitHub.

Об авторах

Хасан Шоджаи является старшим специалистом по данным в компании AWS Professional Services, где он помогает клиентам из различных отраслей, таких как спорт, страхование и финансовые услуги, решать бизнес-задачи с помощью больших данных, машинного обучения и облачных технологий. До этой должности Хасан возглавлял множество инициатив по разработке новых методов моделирования на основе физики и данных для ведущих энергетических компаний. Помимо работы Хасан увлекается книгами, пешим туризмом, фотографией и историей.

Хасан Шоджаи является старшим специалистом по данным в компании AWS Professional Services, где он помогает клиентам из различных отраслей, таких как спорт, страхование и финансовые услуги, решать бизнес-задачи с помощью больших данных, машинного обучения и облачных технологий. До этой должности Хасан возглавлял множество инициатив по разработке новых методов моделирования на основе физики и данных для ведущих энергетических компаний. Помимо работы Хасан увлекается книгами, пешим туризмом, фотографией и историей.

Вэньсинь Лю — старший архитектор облачной инфраструктуры. Вэньсинь консультирует корпоративные компании по вопросам ускорения внедрения облачных технологий и поддерживает их инновации в облаке. Он любитель домашних животных, страстно любит сноуборд и путешествия.

Вэньсинь Лю — старший архитектор облачной инфраструктуры. Вэньсинь консультирует корпоративные компании по вопросам ускорения внедрения облачных технологий и поддерживает их инновации в облаке. Он любитель домашних животных, страстно любит сноуборд и путешествия.

Вивек Лакшманан — инженер по машинному обучению в Amazon. Он имеет степень магистра в области разработки программного обеспечения со специализацией в области науки о данных и несколько лет опыта работы в качестве MLE. Вивек с энтузиазмом применяет передовые технологии и создает решения AI/ML для клиентов в облаке. Он увлечен статистикой, НЛП и объяснимостью моделей в искусственном интеллекте и машинном обучении. В свободное время он любит играть в крикет и путешествовать.

Вивек Лакшманан — инженер по машинному обучению в Amazon. Он имеет степень магистра в области разработки программного обеспечения со специализацией в области науки о данных и несколько лет опыта работы в качестве MLE. Вивек с энтузиазмом применяет передовые технологии и создает решения AI/ML для клиентов в облаке. Он увлечен статистикой, НЛП и объяснимостью моделей в искусственном интеллекте и машинном обучении. В свободное время он любит играть в крикет и путешествовать.

Энди Крачкиоло — архитектор облачной инфраструктуры. Энди имеет более чем 15-летний опыт работы в ИТ-инфраструктуре и является опытным и ориентированным на результат ИТ-специалистом. Помимо оптимизации ИТ-инфраструктуры, операций и автоматизации, Энди имеет успешный опыт анализа ИТ-операций, выявления несоответствий и внедрения улучшений процессов, которые повышают эффективность, сокращают затраты и увеличивают прибыль.

Энди Крачкиоло — архитектор облачной инфраструктуры. Энди имеет более чем 15-летний опыт работы в ИТ-инфраструктуре и является опытным и ориентированным на результат ИТ-специалистом. Помимо оптимизации ИТ-инфраструктуры, операций и автоматизации, Энди имеет успешный опыт анализа ИТ-операций, выявления несоответствий и внедрения улучшений процессов, которые повышают эффективность, сокращают затраты и увеличивают прибыль.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Автомобили / электромобили, Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- ЧартПрайм. Улучшите свою торговую игру с ChartPrime. Доступ здесь.

- Смещения блоков. Модернизация права собственности на экологические компенсации. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/mlops-for-batch-inference-with-model-monitoring-and-retraining-using-amazon-sagemaker-hashicorp-terraform-and-gitlab-ci-cd/

- :имеет

- :является

- :нет

- :куда

- $UP

- 100

- 125

- 13

- 15 лет

- 15%

- 26%

- 29

- 500

- 7

- a

- О нас

- ускорять

- доступ

- выполнено

- Учетная запись

- Учетные записи

- точность

- через

- фактического соединения

- добавленный

- добавить

- дополнение

- дополнительный

- адрес

- Принятие

- против

- AI / ML

- Все

- позволяет

- вдоль

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- an

- анализ

- и

- и инфраструктура

- любой

- API

- Применение

- Разработка приложения

- Применение

- подхода

- соответствующий

- утверждение

- Сертификаты

- утвердить

- утвержденный

- архитектура

- МЫ

- AS

- аспекты

- связанный

- At

- проверяемость

- санкционировать

- автоматический

- автоматы

- Автоматический

- автоматически

- автоматизация

- доступен

- AWS

- AWS Lambda

- Профессиональные услуги AWS

- основанный

- Базовая линия

- BE

- , так как:

- было

- до

- польза

- ЛУЧШЕЕ

- лучшие практики

- большой

- Big Data

- доска

- тело

- Книги

- изоферменты печени

- Филиал

- Строительство

- построенный

- бизнес

- by

- исчисляет

- расчет

- призывают

- вызова

- CAN

- случаев

- центральный

- проблемы

- сложные

- изменение

- изменения

- изменения

- проверка

- контроль

- Проверки

- классификация

- облако

- принятие облака

- облачная инфраструктура

- код

- Колонки

- Компании

- сравнив

- полный

- сложности

- Соответствие закону

- состоящие

- сама концепция

- Конфигурация

- связь

- ограничения

- содержит

- (CIJ)

- контроль

- контрольная

- Соглашение

- Расходы

- может

- Создайте

- создали

- создает

- Создающий

- создание

- крикет

- изготовленный на заказ

- Клиенты

- передовой

- данным

- наука о данных

- ученый данных

- управляемых данными

- заявляет,

- По умолчанию

- определенный

- Определяет

- Степень

- поставка

- демонстрировать

- убивают

- развертывание

- развернуть

- развертывание

- описывать

- Проект

- подробность

- подробнее

- обнаруженный

- развивать

- Развитие

- различный

- направление

- непосредственно

- каталоги

- Обнаруживает

- обсуждать

- Docker

- приносит

- не

- два

- в течение

- каждый

- легче

- фактически

- затрат

- эффективный

- или

- ликвидировать

- Сотрудник

- энергетика

- инженер

- Проект и

- улучшения

- обеспечивать

- обеспечение

- Предприятие

- предприятий

- Весь

- Окружающая среда

- ошибка

- оценка

- События

- пример

- превышает

- возбужденный

- выполнение

- существующий

- опыт

- f1

- FAIL

- Oшибка

- не удается

- Особенность

- фигура

- Файл

- Файлы

- финансовый

- финансовые услуги

- Во-первых,

- фиксированной

- после

- Что касается

- формат

- найденный

- от

- функция

- Функции

- ворота

- Общие

- генерируется

- порождающий

- идти

- GitHub

- Go

- будет

- большой

- земля

- группы

- руководство

- рука

- Управляемость

- Есть

- he

- помогает

- его

- история

- Как

- How To

- HTML

- HTTP

- HTTPS

- Оптимизация гиперпараметра

- ID

- идентифицирующий

- Личность

- if

- иллюстрирует

- реализация

- Осуществляющий

- in

- включают

- включает в себя

- В том числе

- Увеличение

- независимые

- самостоятельно

- указывает

- individual

- промышленности

- информация

- Инфраструктура

- инициативы

- инновации

- вход

- затраты

- страхование

- интеграции.

- взаимодействует

- в

- вводить

- вопросы

- IT

- ЕГО

- работа

- Джобс

- JPG

- JSON

- всего

- Основные

- Этикетки

- последний

- вести

- изучение

- привело

- Жизненный цикл

- линия

- Список

- локальным

- журнал

- машина

- обучение с помощью машины

- Главная

- Сохранение

- сделать

- управлять

- управление

- управления

- руководство

- вручную

- с пометкой

- магистра

- материала

- Встречайте

- Соответствует

- сообщение

- Сообщения

- метрический

- Метрика

- ML

- млн операций в секунду

- модель

- моделирование

- Модели

- изменять

- Мониторинг

- БОЛЕЕ

- с разными

- Названный

- именования

- необходимо

- Необходимость

- необходимый

- потребности

- сетей

- Новые

- вновь

- НЛП

- нет

- уведомление

- Уведомления

- роман

- объект

- получать

- получение

- of

- предлагающий

- Предложения

- .

- on

- те,

- только

- операция

- Операционный отдел

- оптимизация

- оптимизирующий

- or

- заказ

- организации

- Организованный

- оригинал

- Другое

- выходной

- внешнюю

- пакет

- пакеты

- пар

- параметры

- часть

- особый

- проходит

- страстный

- путь

- Выполнять

- производительность

- выполнены

- фотография

- трубопровод

- план

- запланированный

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- игры

- Точка

- состояния потока

- После

- практиками

- Predictions

- Готовит

- предпосылки

- представить

- представлены

- Предварительный

- Проблема

- продолжить

- процесс

- Обработанный

- Производство

- профессиональный

- доходы

- Повышен

- предложило

- доказанный

- при условии

- приводит

- обеспечение

- Тянет

- Push

- Питон

- Сырье

- Читать

- Reading

- получает

- получение

- последний

- запись

- уменьшить

- снижение

- по

- зарегистрироваться

- зарегистрированный

- регистрирующий

- регистры

- Регистрация

- реестра

- регулярно

- осталось

- повторяемый

- Отчеты

- хранилище

- представляет

- обязательный

- Требования

- требуется

- Полезные ресурсы

- те

- соответственно

- ответственный

- Итоги

- продолжить

- многоразовый

- обзоре

- Дорога

- Роли

- условиями,

- Run

- бегун

- Бег

- работает

- sagemaker

- Вывод SageMaker

- Конвейеры SageMaker

- Масштабируемость

- график

- планирование

- Наука

- Ученый

- Гол

- скрипты

- SDK

- Раздел

- Отправить

- отправка

- посылает

- служить

- служит

- Услуги

- набор

- установка

- несколько

- общие

- должен

- показанный

- Шоу

- значительный

- просто

- одинарной

- Software

- разработка программного обеспечения

- Решение

- Решения

- РЕШАТЬ

- Источники

- Об

- конкретный

- указанный

- Спорт

- Этап

- инсценировка

- Начало

- Начало

- Область

- статистика

- Статус:

- Шаг

- Шаги

- диск

- магазин

- хранение

- Стратегия

- структурный

- студия

- успешный

- Успешно

- такие

- Костюм

- поддержки

- Поддержка

- ТАБЛИЦЫ

- TAG

- с

- цель

- Сложность задачи

- команда

- снижения вреда

- технологии

- шаблон

- Terraform

- чем

- который

- Ассоциация

- их

- Их

- тогда

- Там.

- тем самым

- Эти

- они

- этой

- три

- порог

- Через

- время

- в

- инструменты

- топ

- Темы

- трек

- Послужной

- специалистов

- Обучение

- трансформация

- прозрачный

- Путешествие

- вызвать

- срабатывает

- Правда

- ОЧЕРЕДЬ

- два

- напишите

- типичный

- ui

- под

- нижнее подчеркивание

- Обновление ПО

- обновление

- загружено

- Загрузка

- использование

- используемый

- Информация о пользователе

- использования

- через

- использовать

- использовать

- ценностное

- переменная

- проверить

- версия

- версии

- с помощью

- НАРУШЕНИЕ

- предупреждение

- Путь..

- способы

- we

- Web

- веб-сервисы

- ЧТО Ж

- когда

- будь то

- который

- в то время как

- КТО

- будете

- в

- Работа

- рабочий

- Рабочие процессы

- работает

- YAML

- лет

- еще

- Ты

- ВАШЕ

- зефирнет