Вы можете оказаться в хижине с дробовиком. И вы можете работать с GPT-4. И вы можете спросить себя: «Будет ли GPT-4 запускать Doom?» И вы можете спросить себя: «Прав ли я? Я ошибаюсь?"

Адриан де Винтер, главный ученый-прикладник Microsoft и исследователь Йоркского университета в Англии, задал эти вопросы в недавней исследовательской работе: «Будет ли GPT-4 запускать Doom?

Увы, GPT-4, большая языковая модель от OpenAI, поддерживаемая Microsoft, не имеет возможности напрямую выполнять исходный код Doom.

Но его мультимодальный вариант, GPT-4V, который может принимать изображения в качестве входных данных, а также текст, демонстрирует ту же привлекательную подкомпетенцию, играя Гибель как сложные текстовые модели, которые запустили бесчисленное количество стартапов в области искусственного интеллекта.

«Согласно статье, GPT-4 (и GPT-4 с видением, или GPT-4V) не может запускать Doom сам по себе, потому что он ограничен размером входных данных (и, очевидно, что он, вероятно, будет просто придумывать что-то новое). ; вы действительно не хотите, чтобы ваш компилятор галлюцинировал каждые пять минут)», — написал де Винтер в пояснительной записке. в своих размышлениях о его газете. «Тем не менее, он определенно может выступать в качестве прокси для движка, мало чем отличаясь от других «будет ли он запускать Doom?» реализации, такие как E. Coli or Блокнот".

То есть GPT-4V не будет запускать Doom. как трактор Джон Дир но он будет играть в Doom без специальной подготовки.

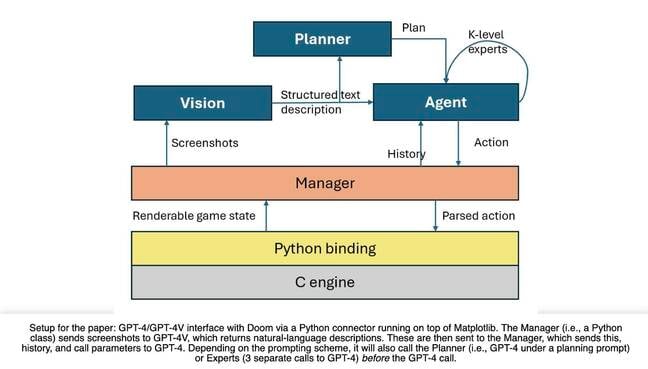

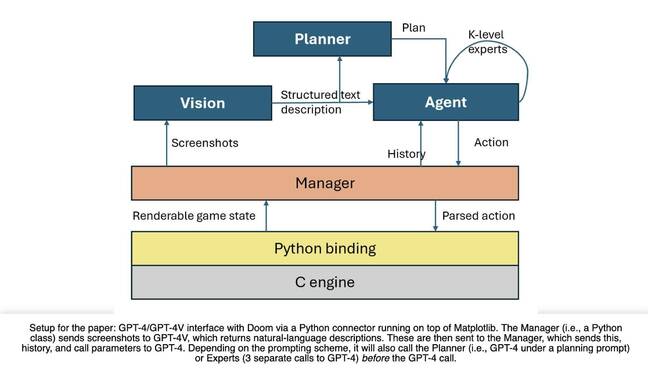

Чтобы справиться с этим, де Винтер разработал компонент Vision, который вызывает GPT-4V, который делает снимки экрана из игрового движка и возвращает описания структуры состояния игры. И он объединил это с моделью агента, которая вызывает GPT-4 для принятия решений на основе визуальных данных и предыдущей истории. Модель агента получила указание преобразовывать свои ответы в команды нажатия клавиш, которые имеют значение для игрового движка.

Взаимодействия обрабатываются через уровень менеджера, состоящий из привязки Python с открытым исходным кодом к C Doom-движок работает на Matplotlib.

Согласно статье, эта смесь моделей и кода искусственного интеллекта может открывать двери, сражаться с врагами и стрелять из оружия. И он может выполнять более широкий набор инструкций, например, прохождение уровня, чтобы улучшить свою производительность.

Основным недостатком этой системы на основе GPT-4V является отсутствие постоянства объектов — она забывает о внутриигровых зомби, когда они выходят за пределы экрана.

GPT-4 забывает о зомби и продолжает идти.

«Например, очень часто модель видит зомби на экране и начинает стрелять в него, пока тот не попадет в него (или не умрет)», — объясняет де Винтер. «Это ИИ, написанный для работы с оборудованием 1993 года, поэтому я предполагаю, что у него нет сверхглубокого дерева решений. Итак, зомби стреляет в вас, а затем начинает бегать по комнате.

«В чем здесь проблема? Ну, во-первых, зомби уходит из поля зрения. Хуже того, он все еще жив и в какой-то момент ударит вас. Так что ты должен пойти за этим, верно? В конце концов, в Doom важно либо ударить, либо быть убитым.

«Оказывается, GPT-4 забывает о зомби и просто продолжает идти. Примечание: подсказка явно сообщает модели, что делать, если она получает урон и не видит врага. А еще лучше, он просто отправляется в путь, застревает в углу и умирает. Пару раз он действительно развернулся, но примерно за 50-60 заездов я заметил это… два раза, я хочу сказать».

Кроме того, GPT-4 не умеет хорошо рассуждать. Когда его просили объяснить его действия, которые в целом были правильными в контексте, его объяснения были плохими и часто включали галлюцинации (то есть неверную информацию).

Тем не менее Де Винтер считает примечательным, что GPT-4 способен играть в Doom без предварительной подготовки.

В то же время его это беспокоит.

«В отделе этики меня очень беспокоит то, насколько легко мне было (а) написать код, позволяющий модели что-то снимать; и (б) чтобы модель точно стреляла, не угадывая инструкции», — написал он в своем итоговом посте.

«Итак, хотя это очень интересное исследование планирования и рассуждения, которое может найти применение в автоматизированном тестировании видеоигр, совершенно очевидно, что эта модель не осознает, что она делает. Я настоятельно призываю всех задуматься о том, что внедрение этих моделей [означает] для общества и их потенциальное неправильное использование».

И вы можете сказать себе: «Боже мой, что я наделал?®

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://go.theregister.com/feed/www.theregister.com/2024/03/11/gpt4_wont_run_doom/

- :имеет

- :является

- :нет

- $UP

- 369

- 7

- a

- О нас

- Принять

- По

- точно

- Действие (Act):

- действия

- на самом деле

- После

- Агент

- AI

- AI модели

- ака

- живой

- Все

- am

- an

- и

- Приложения

- прикладной

- МЫ

- около

- AS

- спросить

- At

- Автоматизированный

- знать

- основанный

- BE

- , так как:

- было

- Лучшая

- переплет

- шире

- строить

- но

- by

- Объявления

- CAN

- не могу

- способный

- Пропускная способность

- перехватывает

- График

- нажмите на

- CO

- код

- сочетании

- Общий

- компонент

- считает

- Состоящий из

- контекст

- Corner

- исправить

- может

- Пара

- повреждение

- de

- решение

- решения

- глубоко

- определенно

- Кафедра

- развертывание

- Проект

- предназначенный

- диаграмма

- DID

- умер

- непосредственно

- do

- Безразлично

- дело

- Дон

- сделанный

- гибель

- Двери

- легко

- Двигатель

- Англия

- этика

- Каждая

- все члены

- пример

- выполнять

- Экспонаты

- Объяснять

- Объясняет

- объяснениями

- эксплицитно

- исследование

- бороться

- Найдите

- находит

- Для пожарных

- стрельба

- Во-первых,

- 5

- Что касается

- чреват

- от

- игра

- в общем

- получить

- получает

- GitHub

- Go

- Бог

- идет

- будет

- догадываться

- Аппаратные средства

- Есть

- he

- здесь

- его

- история

- Удар

- Как

- HTML

- HTTPS

- i

- if

- изображений

- реализации

- улучшать

- in

- в игре

- включены

- неправильный

- информация

- вход

- инструкции

- интересный

- в

- вопрос

- IT

- ЕГО

- саму трезвость

- John

- JPG

- всего

- держит

- Отсутствие

- язык

- большой

- запустили

- слой

- уровень

- такое как

- Ограниченный

- жизнью

- Главная

- сделать

- управлять

- менеджер

- Matplotlib

- Май..

- me

- смысл

- Веселый

- Microsoft

- Минут

- злоупотреблять

- MIT

- смешивать

- модель

- Модели

- почти

- в своих размышлениях

- сейчас

- объект

- Очевидный

- of

- от

- .

- on

- открытый

- с открытым исходным кодом

- OpenAI

- or

- Другое

- внешний

- собственный

- бумага & картон

- производительность

- планирование

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Играть

- игры

- Точка

- состояния потока

- поставленный

- После

- потенциал

- предыдущий

- Основной

- Предварительный

- вероятно

- полномочие

- Питон

- Вопросы

- вполне

- на самом деле

- причина

- последний

- замечательный

- исследованиям

- исследователь

- ответы

- Возвращает

- правую

- Комната

- Run

- Бег

- работает

- s

- Сказал

- то же

- сообщили

- Ученый

- экран

- скриншоты

- посмотреть

- набор

- установка

- стрелять

- показ

- Размер

- So

- Общество

- некоторые

- удалось

- Источник

- исходный код

- конкретный

- Начало

- начинается

- Стартапы

- Область

- По-прежнему

- сильно

- Структура

- такие

- РЕЗЮМЕ

- супер

- система

- с

- говорит

- Тестирование

- текст

- который

- Ассоциация

- их

- тогда

- Эти

- они

- think

- этой

- Через

- время

- раз

- в

- заявил

- Обучение

- переведите

- дерево

- тревожный

- ОЧЕРЕДЬ

- Получается

- Дважды

- под

- Университет

- В отличие от

- до

- Вариант

- очень

- Видео

- видеоигра

- Вид

- видение

- визуальный

- прохождение

- хотеть

- законопроект

- Путь..

- Оружие

- ЧТО Ж

- были

- Что

- когда

- который

- в то время как

- будете

- без

- Выиграл

- Работа

- работает

- хуже

- бы

- письменный

- Неправильно

- писал

- еще

- йорк

- Ты

- ВАШЕ

- себя

- зефирнет

- о зомби