Согласно новому исследованию, опубликованному Pew Research Center, американцы опасаются растущего использования искусственного интеллекта (ИИ) при найме и оценке работников.

Pew Research опрошенных 11,004 2022 взрослых жителей США в середине декабря XNUMX года спрашивали у участников, что они думают о влиянии ИИ на рабочую силу. В то время как некоторые респонденты признали эффективность набора персонала с помощью ИИ, многие выразили опасения, что эта технология может нарушить конфиденциальность, повлиять на оценки и привести к потере работы.

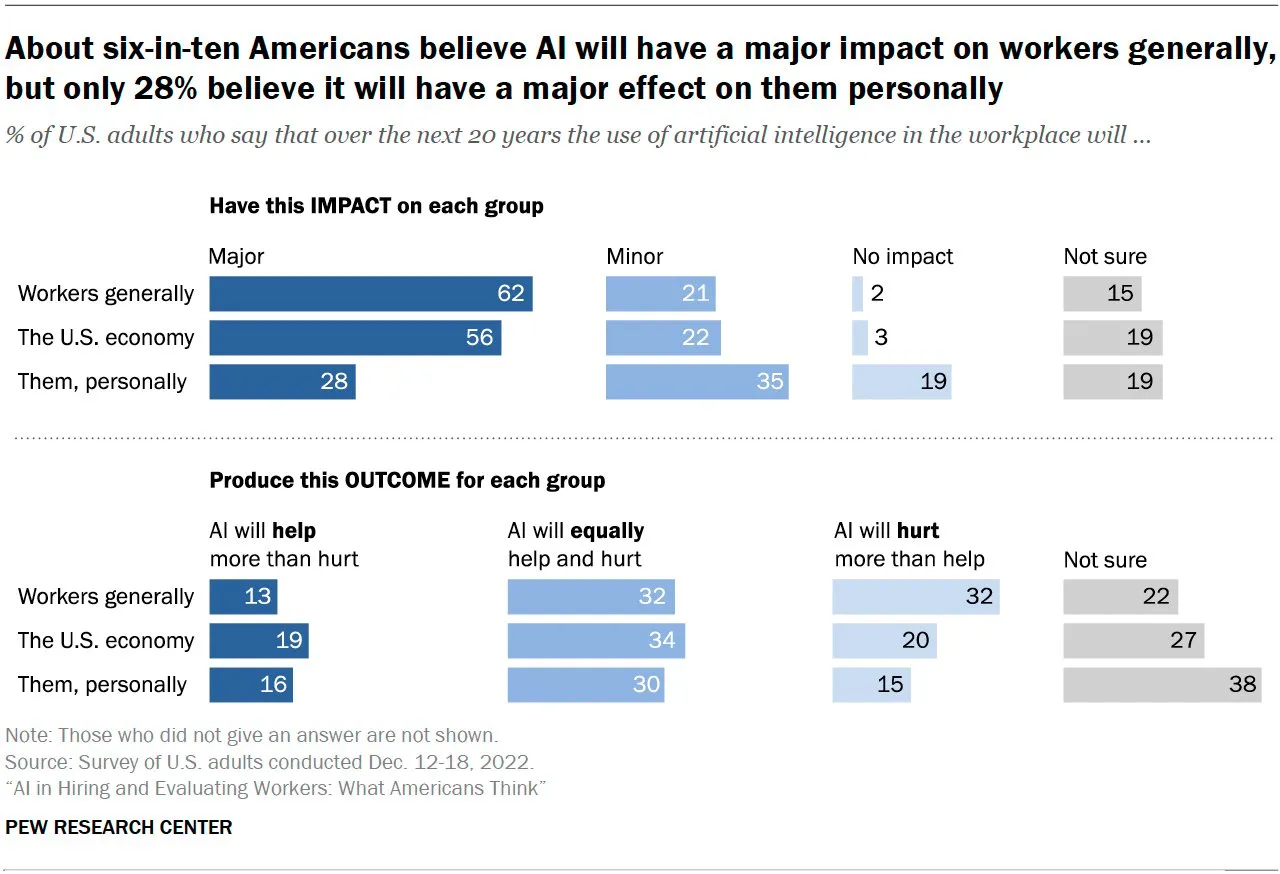

Согласно исследованию, опубликованному в четверг, 32% американцев считают, что ИИ при найме и оценке работников скорее навредит, чем поможет соискателям и сотрудникам.

Семьдесят один процент граждан США против идеи использования ИИ для принятия решения о том, нанимать или увольнять кого-либо. С другой стороны, исследование показало, что 40% американцев по-прежнему считают, что ИИ может приносить пользу соискателям и сотрудникам, ускоряя процессы найма, уменьшая количество человеческих ошибок и устраняя потенциальные предубеждения, присущие процессу принятия решений человеком. Некоторые респонденты также подчеркнули потенциал оценки производительности на основе ИИ для обеспечения более объективной и последовательной оценки навыков и производительности работников.

Исследование показывает, что 32% американцев считают, что в течение следующих 20 лет ИИ принесет больше вреда, чем пользы для рабочих, и только 13% выражают оптимистическую точку зрения, при этом почти две трети респондентов заявили, что не будут применять ИИ. на работу, если бы они знали, что их будет оценивать искусственный интеллект.

Эти опасения распространяются на различные аспекты процесса найма, от проверки резюме и оценки кандидатов до контроля эффективности и кадровых решений. В отчете подчеркивается, что большинство участников обеспокоены тем, что системы ИИ нарушат их конфиденциальность, собирая слишком много личной информации, такой как история просмотров или активность в социальных сетях. В исследовании говорится, что 84% работников высшего класса, 70% работников среднего класса и XNUMX% работников низшего класса обеспокоены тем, что за ними «ненадлежащим образом наблюдают, если ИИ использовался для сбора и анализа информации».

Решение проблем: политика, прозрачность и образование

Поскольку ИИ продолжает проникать в рабочую силу, лидеры технологической отрасли призывают политиков, предприятия и разработчиков решать проблемы общественности. В Европейском союзе, например, регулирующие органы пытались предотвратить возможное неправомерное использование, призывая прозрачность в системах ИИ, образование и обучение работников для адаптации к быстро меняющейся рабочей среде. Некоторые из самых известных умов в индустрии ИИ призвал к паузе в обучении более продвинутых моделей, чтобы решить эти проблемы, пока не стало слишком поздно.

Тем временем регуляторы начали обращать внимание на то, как обучаются эти модели искусственного интеллекта и как они могут повлиять на права граждан. Первый шаг был сделан Италией, когда она запретила использование ChatGPT в стране на том основании, что он может незаконно собирать данные от своих пользователей и подвергать несовершеннолетних ненадлежащему взаимодействию.

Другие европейские страны также выражали аналогичные опасения, особенно потому, что модели искусственного интеллекта особенно полезны, если они должным образом обучены, что требует больших объемов данных.

Растущая роль ИИ на рабочем месте представляет как преимущества, так и проблемы, такие как конфиденциальность, справедливость и дискриминация. Применяя упреждающий подход к политике, прозрачности и образованию, политики стремятся гарантировать, что ИИ служит силой добра — и сейчас они не думают о том, что модели ИИ будут хорошими начальниками.

Будьте в курсе крипто-новостей, получайте ежедневные обновления на свой почтовый ящик.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. Доступ здесь.

- Чеканка будущего с Эдриенн Эшли. Доступ здесь.

- Источник: https://decrypt.co/137421/ai-has-most-americans-scared-about-privacy-job-losses