Во многих отраслях очень важно своевременно извлекать пользовательские объекты из документов. Это может быть непросто. Страховые претензии, например, часто содержат десятки важных атрибутов (таких как даты, имена, места и отчеты), разбросанных по объемным и объемным документам. Сканирование и извлечение такой информации вручную может быть сопряжено с ошибками и отнимать много времени. Программное обеспечение, основанное на правилах, может помочь, но в конечном итоге оно слишком жесткое, чтобы адаптироваться ко множеству различных типов документов и макетов.

Чтобы автоматизировать и ускорить этот процесс, вы можете использовать Amazon Comprehend для быстрого и точного обнаружения пользовательских объектов с помощью машинного обучения (ML). Этот подход является гибким и точным, поскольку система может адаптироваться к новым документам, используя то, чему она научилась в прошлом. Однако до недавнего времени эту возможность можно было применять только к обычным текстовым документам, что означало, что информация о местоположении терялась при преобразовании документов из их исходного формата. Для решения этой проблемы было недавно объявила о что Amazon Comprehend может извлекать пользовательские объекты в форматах PDF, изображений и файлов Word.

В этом посте мы рассмотрим конкретный пример из страховой отрасли того, как вы можете создать собственный распознаватель с помощью аннотаций PDF.

Обзор решения

Мы проведем вас через следующие общие этапы:

- Создание аннотаций PDF.

- Используйте аннотации PDF для обучения пользовательской модели с помощью Python API.

- Получите метрики оценки из обученной модели.

- Выполните вывод по невидимому документу.

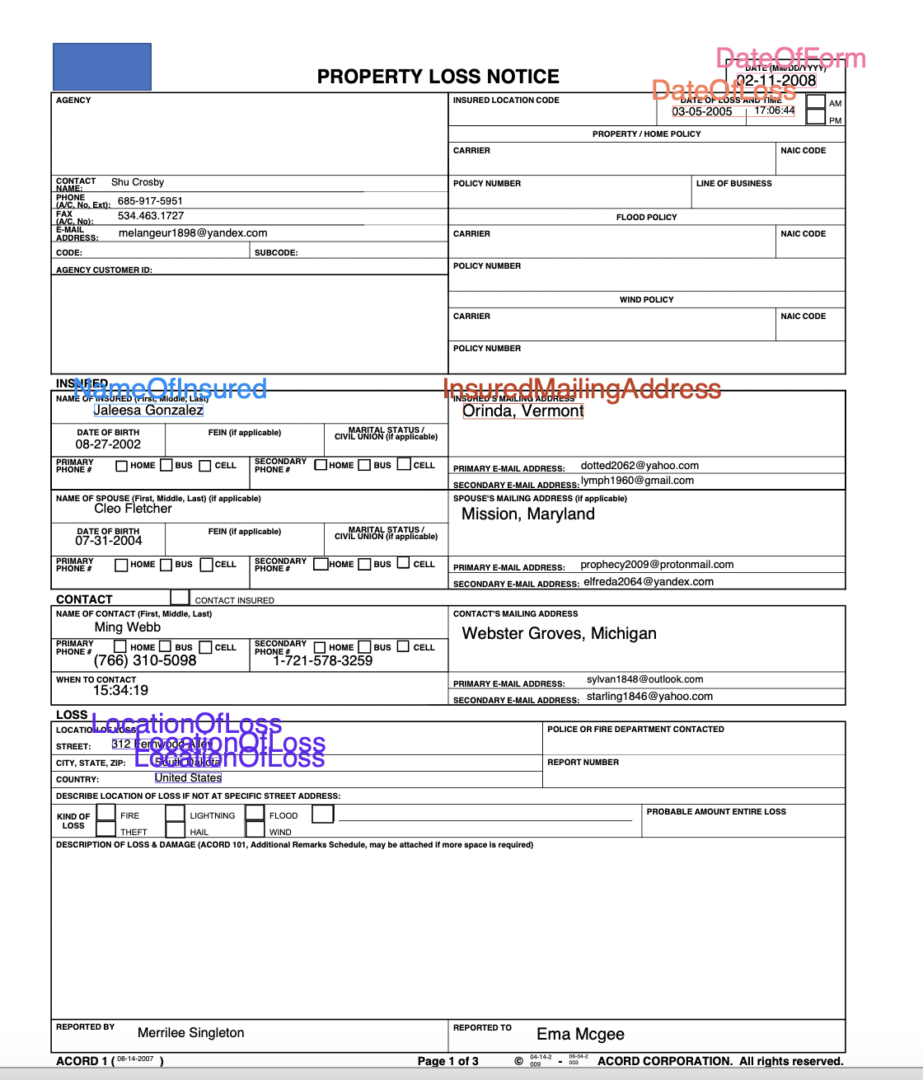

К концу этого поста мы хотим иметь возможность отправлять необработанный PDF-документ в нашу обученную модель и получать структурированный файл с информацией об интересующих нас метках. В частности, мы обучаем нашу модель обнаруживать следующие пять сущностей, которые мы выбрали из-за их отношения к страховым случаям: DateOfForm, DateOfLoss, NameOfInsured, LocationOfLossкачества InsuredMailingAddress. После прочтения структурированного вывода мы можем визуализировать информацию о этикетке непосредственно в документе PDF, как показано на следующем рисунке.

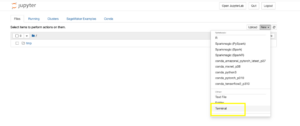

Этот пост сопровождается блокнотом Jupyter, который содержит те же шаги. Не стесняйтесь следовать за ним, выполняя шаги в этом ноутбук. Обратите внимание, что вам необходимо настроить Создатель мудреца Амазонки среды, чтобы Amazon Comprehend мог читать из Простой сервис хранения Amazon (Amazon S3), как описано в верхней части записной книжки.

Создание аннотаций PDF

Для создания аннотаций к документам PDF вы можете использовать Amazon SageMaker - основа правды, полностью управляемый сервис маркировки данных, который упрощает создание высокоточных обучающих наборов данных для машинного обучения.

Для этого урока мы уже аннотировали PDF-файлы в их исходной форме (без преобразования в обычный текст) с помощью Ground Truth. Задание Ground Truth генерирует три пути, которые нам нужны для обучения нашей пользовательской модели Amazon Comprehend:

- Источники – Путь к входным PDF-файлам.

- Аннотации – Путь к файлам аннотаций JSON, содержащим информацию о помеченных объектах.

- Манифест – Файл, указывающий на расположение аннотаций и исходных PDF-файлов. Этот файл используется для создания пользовательского задания обучения распознаванию сущностей Amazon Comprehend и обучения пользовательской модели.

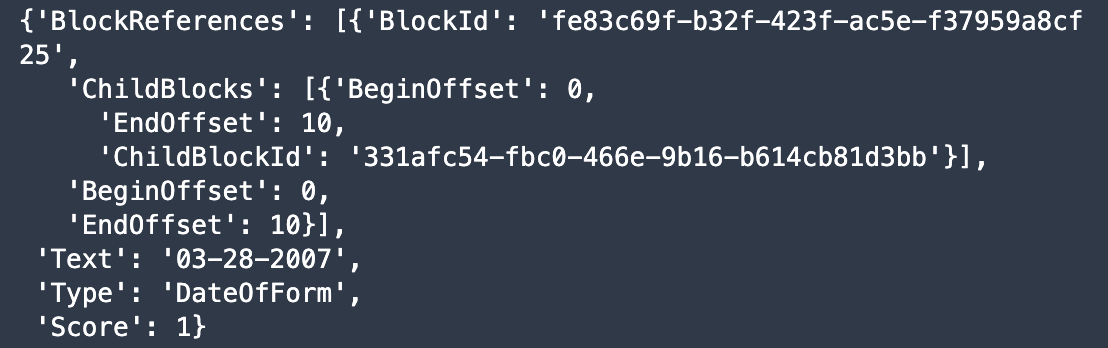

На следующем снимке экрана показан пример аннотации.

Настраиваемое задание Ground Truth создает аннотацию в формате PDF, которая фиксирует информацию об объекте на уровне блоков. Такая информация на уровне блоков предоставляет точные позиционные координаты объекта (с дочерними блоками, представляющими каждое слово в блоке объекта). Это отличается от стандартного задания Ground Truth, в котором данные в PDF сводятся к текстовому формату, а во время аннотации фиксируется только информация о смещении, но не информация о точных координатах. Богатая позиционная информация, которую мы получаем с помощью этой пользовательской парадигмы аннотаций, позволяет нам обучать более точную модель.

Манифест, созданный в результате этого типа задания, называется расширенным манифестом, в отличие от CSV-файла, который используется для стандартных аннотаций. Для получения дополнительной информации см. Аннотации.

Используйте аннотации PDF для обучения пользовательской модели с помощью API Python.

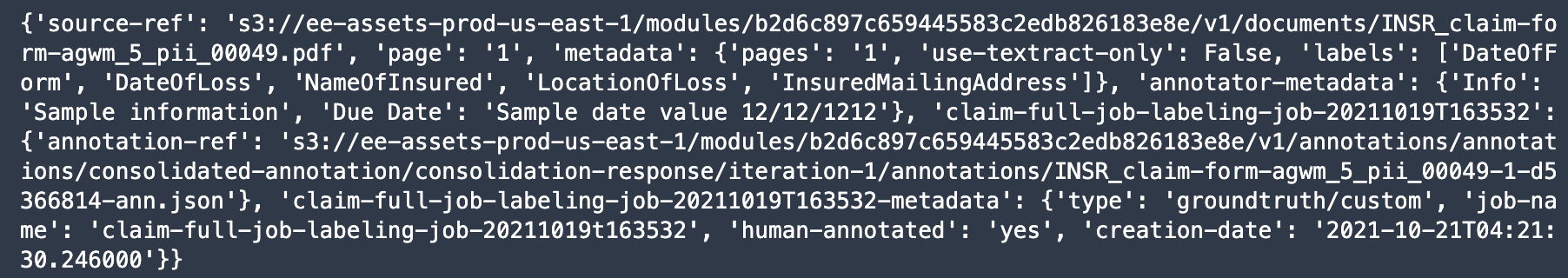

Расширенный файл манифеста должен быть отформатирован в формате JSON Lines. В формате JSON Lines каждая строка в файле представляет собой полный объект JSON, за которым следует разделитель новой строки.

Следующий код является записью в этом расширенном файле манифеста.

Несколько замечаний:

- С этим заданием связаны пять типов маркировки:

DateOfForm,DateOfLoss,NameOfInsured,LocationOfLossкачестваInsuredMailingAddress. - Файл манифеста ссылается как на исходный PDF-файл, так и на аннотацию.

- Сохраняются метаданные о задании аннотации (например, дата создания).

Use-textract-onlyнаFalse, что означает, что инструмент аннотации решает, использовать ли PDFPlumber (для собственного PDF) или Амазонка Текст (для отсканированного PDF). Если установленоtrue, Amazon Textract используется в любом случае (что более затратно, но потенциально более точно).

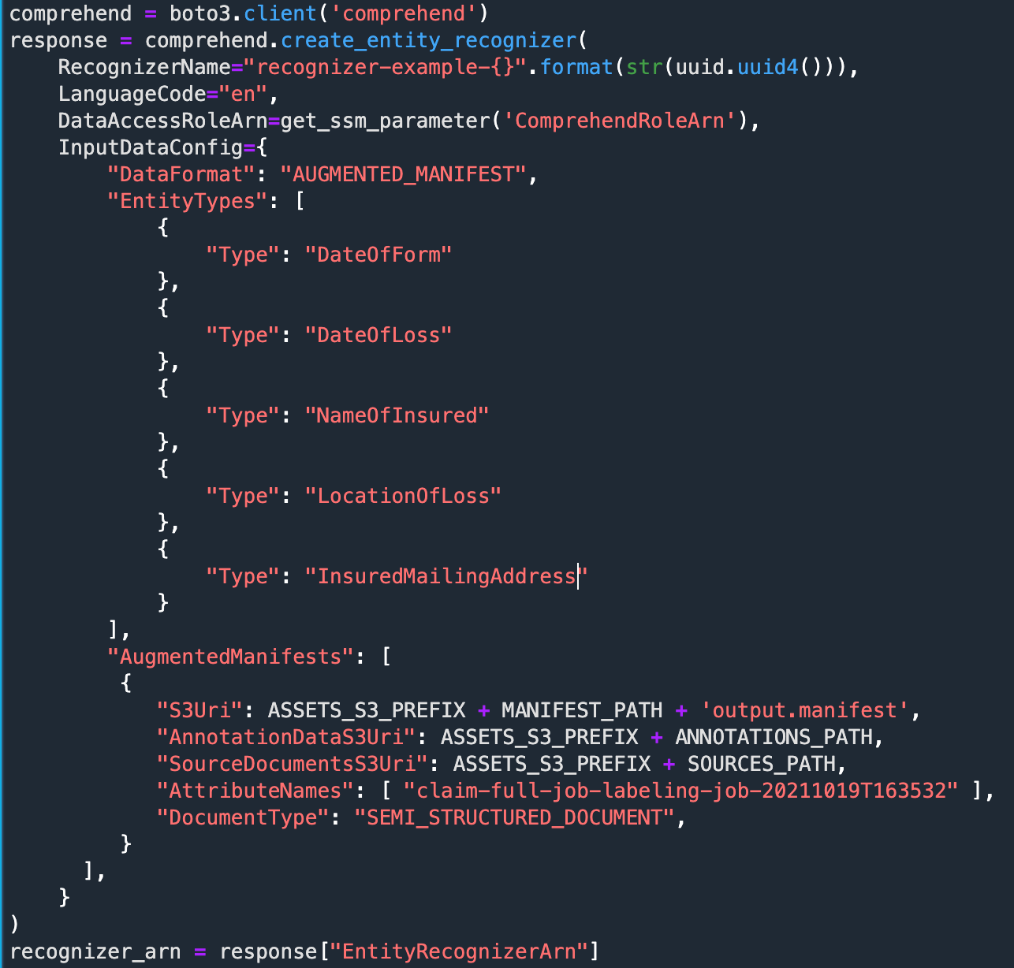

Теперь мы можем обучить распознаватель, как показано в следующем примере кода.

Мы создаем распознаватель для распознавания всех пяти типов сущностей. Мы могли бы использовать подмножество этих сущностей, если бы предпочли. Вы можете использовать до 25 объектов.

Подробную информацию о каждом параметре см. create_entity_recouncer.

В зависимости от размера тренировочного набора время обучения может варьироваться. Для этого набора данных обучение занимает примерно 1 час. Для отслеживания состояния задания обучения вы можете использовать describe_entity_recognizer API.

Получите метрики оценки из обученной модели

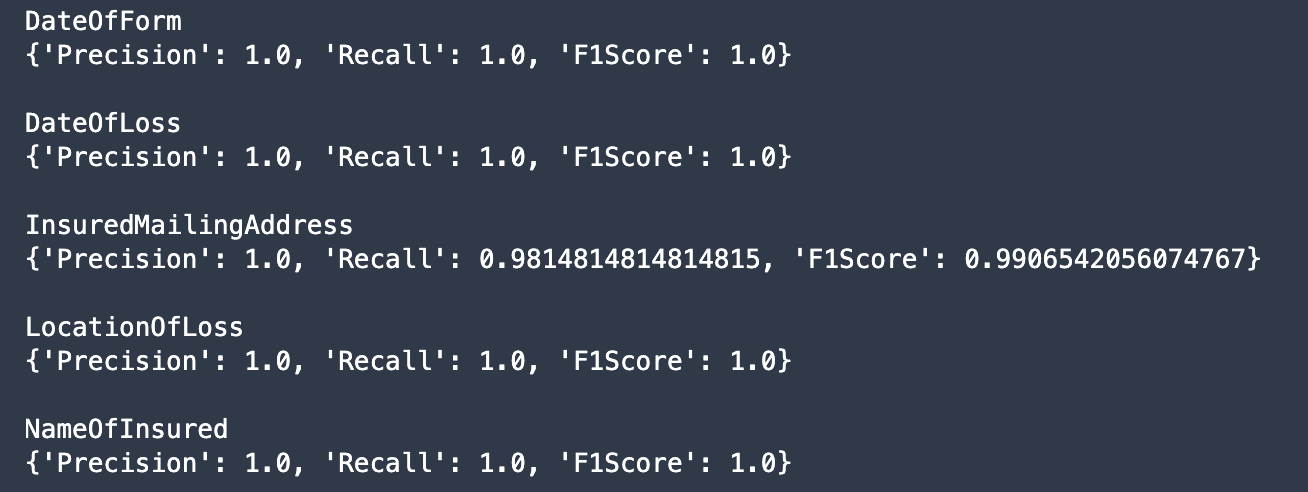

Amazon Comprehend предоставляет показатели производительности обученной модели, которые показывают, насколько хорошо обученная модель будет делать прогнозы, используя аналогичные входные данные. Мы можем получить как глобальные метрики точности и отзыва, так и метрики для каждого объекта. Точная модель имеет высокую точность и высокую полноту. Высокая точность означает, что модель обычно верна, когда она указывает конкретную метку; высокая полнота означает, что модель нашла большинство меток. F1 является составным показателем (средним гармоническим) этих показателей и, следовательно, является высоким, когда оба компонента высоки. Подробное описание показателей см. Пользовательские метрики Recognizer Entity.

Когда вы предоставляете документы для задания по обучению, Amazon Comprehend автоматически разделяет их на обучающий и тестовый наборы. Когда модель достигла TRAINED статус, вы можете использовать describe_entity_recognizer API еще раз, чтобы получить метрики оценки на тестовом наборе.

Ниже приведен пример глобальных показателей.

Ниже приведен пример метрик для отдельных объектов.

Высокие баллы указывают на то, что модель хорошо научилась обнаруживать эти объекты.

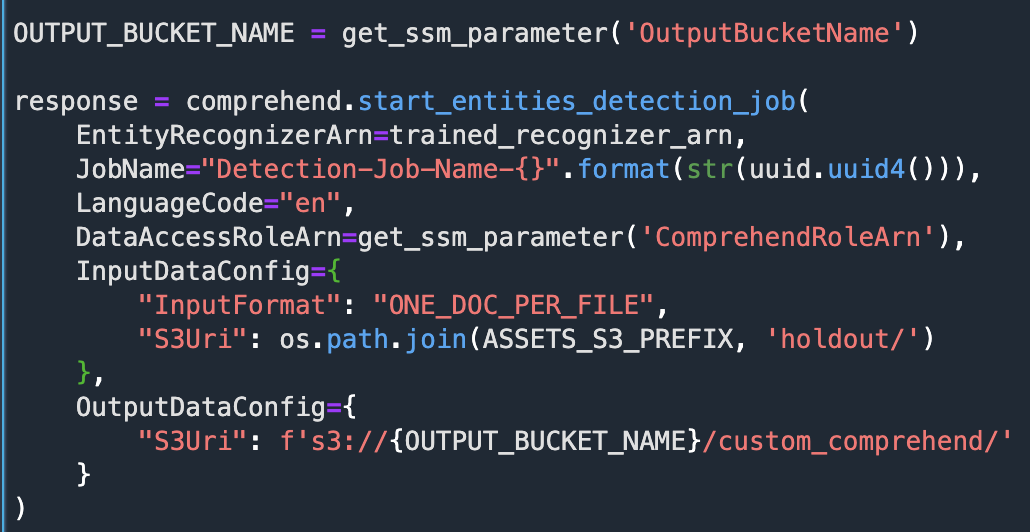

Выполнение вывода по невидимому документу

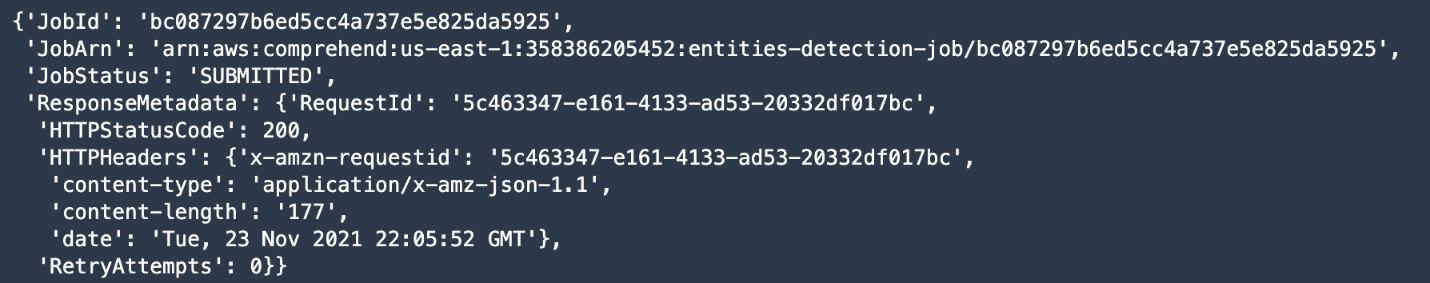

Давайте проведем вывод с нашей обученной моделью по документу, который не был частью процедуры обучения. Мы можем использовать этот асинхронный API для стандартной или пользовательской NER. Если вы используете его для пользовательского NER (как в этом посте), мы должны передать ARN обученной модели.

Мы можем просмотреть отправленное задание, распечатав ответ.

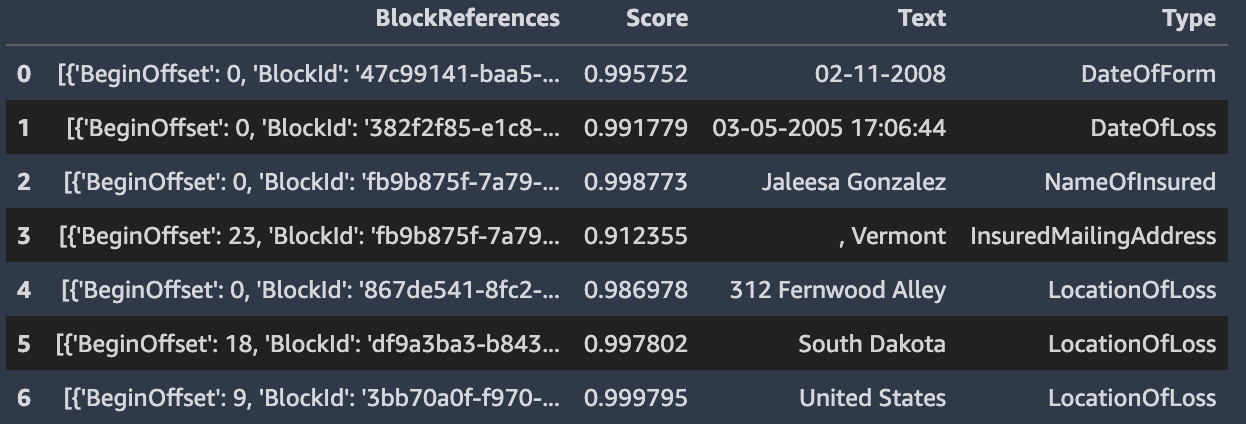

Мы можем отформатировать вывод задания обнаружения с помощью Pandas в таблицу. Score значение указывает уровень уверенности модели в отношении объекта.

Наконец, мы можем наложить прогнозы на невидимые документы, что дает результат, как показано в верхней части этого поста.

Заключение

В этом посте вы увидели, как извлекать пользовательские объекты в исходный формат PDF с помощью Amazon Comprehend. В качестве следующих шагов рассмотрите возможность более глубокого погружения:

- Тренируйте свой собственный распознаватель, используя прилагаемый блокнот здесь. Не забудьте удалить все ресурсы, когда закончите, чтобы избежать будущих расходов.

- Настройте собственное пользовательское задание аннотаций, чтобы собирать аннотации PDF для интересующих вас объектов. Для получения дополнительной информации см. Настраиваемая аннотация документа для извлечения именованных сущностей в документах с помощью Amazon Comprehend.

- Обучите пользовательскую модель NER на консоли Amazon Comprehend. Для получения дополнительной информации см. Извлечение пользовательских объектов из документов в их исходном формате с помощью Amazon Comprehend.

Об авторах

Джошуа Леви является старшим научным сотрудником в лаборатории Amazon Machine Learning Solutions, где он помогает клиентам разрабатывать и создавать решения AI/ML для решения ключевых бизнес-задач.

Джошуа Леви является старшим научным сотрудником в лаборатории Amazon Machine Learning Solutions, где он помогает клиентам разрабатывать и создавать решения AI/ML для решения ключевых бизнес-задач.

Эндрю Анг — инженер по машинному обучению в лаборатории Amazon Machine Learning Solutions Lab, где он помогает клиентам из самых разных отраслей находить и создавать решения AI/ML для решения самых насущных бизнес-задач. Вне работы он любит смотреть влоги о путешествиях и еде.

Эндрю Анг — инженер по машинному обучению в лаборатории Amazon Machine Learning Solutions Lab, где он помогает клиентам из самых разных отраслей находить и создавать решения AI/ML для решения самых насущных бизнес-задач. Вне работы он любит смотреть влоги о путешествиях и еде.

Алекс Чираят — инженер-программист в лаборатории Amazon Machine Learning Solutions Lab, специализирующейся на создании решений на основе сценариев использования, которые показывают клиентам, как раскрыть потенциал сервисов AWS AI/ML для решения реальных бизнес-задач.

Алекс Чираят — инженер-программист в лаборатории Amazon Machine Learning Solutions Lab, специализирующейся на создании решений на основе сценариев использования, которые показывают клиентам, как раскрыть потенциал сервисов AWS AI/ML для решения реальных бизнес-задач.

Дженнифер Чжу — ученый-прикладник из лаборатории решений для машинного обучения Amazon AI. Она работает с клиентами AWS, создавая решения AI/ML для их приоритетных бизнес-потребностей.

Дженнифер Чжу — ученый-прикладник из лаборатории решений для машинного обучения Amazon AI. Она работает с клиентами AWS, создавая решения AI/ML для их приоритетных бизнес-потребностей.

Нихарика Джаянти работает интерфейсным инженером в лаборатории решений для машинного обучения Amazon — команда Human in the Loop. Она помогает создавать пользовательские решения для клиентов Amazon SageMaker Ground Truth.

Нихарика Джаянти работает интерфейсным инженером в лаборатории решений для машинного обучения Amazon — команда Human in the Loop. Она помогает создавать пользовательские решения для клиентов Amazon SageMaker Ground Truth.

Борис Арончик является менеджером в лаборатории решений для машинного обучения Amazon AI, где он возглавляет группу ученых и инженеров по машинному обучению, которые помогают клиентам AWS достигать бизнес-целей, используя решения AI/ML.

Борис Арончик является менеджером в лаборатории решений для машинного обучения Amazon AI, где он возглавляет группу ученых и инженеров по машинному обучению, которые помогают клиентам AWS достигать бизнес-целей, используя решения AI/ML.

- Коинсмарт. Лучшая в Европе биржа биткойнов и криптовалют.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. БЕСПЛАТНЫЙ ДОСТУП.

- КриптоХок. Альткоин Радар. Бесплатная пробная версия.

- Источник: https://aws.amazon.com/blogs/machine-learning/build-a-custom-entity-recognizer-for-pdf-documents-using-amazon-comprehend/

- "

- &

- 100

- О нас

- точный

- через

- адрес

- AI

- Все

- уже

- Amazon

- API

- подхода

- примерно

- Атрибуты

- дополненная

- автоматизировать

- AWS

- Заблокировать

- строить

- Строительство

- бизнес

- сложные

- расходы

- ребенок

- требования

- код

- собирать

- доверие

- Консоли

- содержит

- координировать

- может

- создание

- критической

- изготовленный на заказ

- Клиенты

- данным

- Финики

- более глубокий

- Проект

- обнаружение

- непосредственно

- Документация

- инженер

- Инженеры

- лиц

- Окружающая среда

- пример

- ожидаемый

- опыт

- гибкого

- следовать

- после

- питание

- форма

- формат

- найденный

- Бесплатно

- будущее

- Глобальный

- Цели

- помощь

- помогает

- High

- очень

- Как

- How To

- HTTPS

- человек

- определения

- изображение

- важную

- промышленности

- промышленность

- информация

- вход

- страхование

- интерес

- IT

- работа

- Основные

- лаборатория

- маркировка

- Этикетки

- Лиды

- узнали

- изучение

- уровень

- Используя

- линия

- расположение

- места

- машина

- обучение с помощью машины

- ДЕЛАЕТ

- управляемого

- менеджер

- способ

- вручную

- смысл

- Метрика

- ML

- модель

- монитор

- БОЛЕЕ

- самых

- имена

- ноутбук

- смещение

- собственный

- парадигма

- производительность

- мощностью

- Predictions

- проблемам

- процесс

- обеспечивать

- приводит

- быстро

- Сырье

- Reading

- реальный мир

- реализовать

- признавать

- Отчеты

- Полезные ресурсы

- ответ

- обзоре

- Run

- Бег

- сканирование

- Ученый

- Ученые

- обслуживание

- Услуги

- набор

- аналогичный

- просто

- Размер

- Software

- Инженер-программист

- Решения

- РЕШАТЬ

- скорость

- стандарт

- Статус:

- диск

- структурированный

- представленный

- система

- команда

- тестXNUMX

- Источник

- Через

- время

- кропотливый

- инструментом

- топ

- Обучение

- путешествовать

- отпереть

- us

- использование

- обычно

- ценностное

- Что

- будь то

- в то время как

- в

- без

- Работа

- работает

- Мир