В этом посте мы покажем, как настроить новую функцию аутентификации на основе OAuth для использования Снежинка in Обработчик данных Amazon SageMaker. Snowflake — это облачная платформа данных, которая предоставляет решения для хранения данных для науки о данных. Снежинка – это Партнер AWS с несколькими аккредитациями AWS, включая компетенции AWS в области машинного обучения (ML), розничной торговли, данных и аналитики.

Data Wrangler упрощает подготовку данных и процесс проектирования функций, сокращая время, необходимое с недель до минут, предоставляя специалистам по данным единый визуальный интерфейс для выбора и очистки данных, создания функций и автоматизации подготовки данных в рабочих процессах ML без написания кода. Вы можете импортировать данные из нескольких источников данных, таких как Простой сервис хранения Amazon (Амазон С3), Амазонка Афина, Амазонка Redshift, Амазонка ЭМИ, и Снежинка. Благодаря этой новой функции вы можете использовать своего собственного поставщика удостоверений (IdP), например Okta, Azure ADили Федеративный пинг для подключения к Snowflake через Data Wrangler.

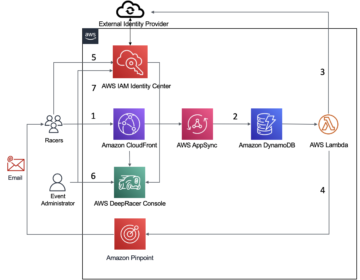

Обзор решения

В следующих разделах мы предоставим администратору инструкции по настройке IdP, Snowflake и Studio. Мы также подробно описываем шаги, которые специалисты по данным могут предпринять для настройки потока данных, анализа качества данных и добавления преобразований данных. Наконец, мы покажем, как экспортировать поток данных и обучить модель, используя Автопилот SageMaker.

Предпосылки

Для этого прохождения у вас должны быть следующие предпосылки:

- Для администратора:

- Пользователь Snowflake с разрешениями на создание интеграций хранилища и интеграций безопасности в Snowflake.

- Учетная запись AWS с разрешениями на создание Управление идентификацией и доступом AWS (IAM) политики и роли.

- Доступ и разрешения для настройки IDP для регистрации приложения Data Wrangler и настройки сервера авторизации или API.

- Для специалиста по данным:

Настройка администратора

Вместо того, чтобы ваши пользователи напрямую вводили свои учетные данные Snowflake в Data Wrangler, вы можете предложить им использовать IdP для доступа к Snowflake.

Чтобы включить OAuth-доступ Data Wrangler к Snowflake, необходимо выполнить следующие действия:

- Настройте поставщика удостоверений.

- Настроить Снежинку.

- Настройте SageMaker Studio.

Настройка поставщика идентификационной информации

Чтобы настроить поставщика удостоверений, необходимо зарегистрировать приложение Data Wrangler и настроить сервер авторизации или API.

Зарегистрируйте приложение Data Wrangler в IdP.

См. следующую документацию для IdP, поддерживаемых Data Wrangler:

Используйте документацию, предоставленную вашим IdP, для регистрации приложения Data Wrangler. Информация и процедуры в этом разделе помогут вам понять, как правильно использовать документацию, предоставленную вашим IdP.

Конкретные настройки в дополнение к шагам в соответствующих руководствах указаны в подразделах.

- Выберите конфигурацию, которая запускает процесс регистрации Data Wrangler в качестве приложения.

- Предоставьте пользователям IdP доступ к Data Wrangler.

- Включите аутентификацию клиента OAuth, сохранив учетные данные клиента в качестве секрета Secrets Manager.

- Укажите URL-адрес перенаправления, используя следующий формат:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Вы указываете идентификатор домена SageMaker и регион AWS, который используете для запуска Data Wrangler. Вы должны зарегистрировать URL-адрес для каждого домена и региона, где вы используете Data Wrangler. Пользователи из домена и региона, для которых не настроены URL-адреса перенаправления, не смогут пройти аутентификацию с помощью IdP для доступа к соединению Snowflake.

- Убедитесь, что код авторизации и типы предоставления токена обновления разрешены для вашего приложения Data Wrangler.

Настройте сервер авторизации или API в IdP

В вашем IdP вы должны настроить сервер авторизации или интерфейс прикладного программирования (API). Для каждого пользователя сервер авторизации или API отправляет токены в Data Wrangler со Snowflake в качестве аудитории.

Снежинка использует концепцию роли которые отличаются от ролей IAM, используемых в AWS. Вы должны настроить IdP для использования ЛЮБОЙ роли, чтобы использовать роль по умолчанию, связанную с учетной записью Snowflake. Например, если у пользователя systems administrator в качестве роли по умолчанию в своем профиле Snowflake соединение Data Wrangler со Snowflake использует systems administrator как роль.

Используйте следующую процедуру для настройки сервера авторизации или API в вашем IdP:

- От вашего IdP начните процесс настройки сервера или API.

- Настройте сервер авторизации для использования кода авторизации и типов предоставления токена обновления.

- Укажите время жизни токена доступа.

- Установите тайм-аут простоя токена обновления.

Тайм-аут простоя — это время, в течение которого истечет срок действия токена обновления, если он не используется. Если вы планируете задания в Data Wrangler, мы рекомендуем сделать время простоя больше, чем частота задания обработки. В противном случае некоторые задания обработки могут завершиться ошибкой, так как срок действия маркера обновления истек до того, как они смогли запуститься. Когда срок действия токена обновления истекает, пользователь должен повторно пройти аутентификацию, получив доступ к подключению, которое он установил к Snowflake через Data Wrangler.

Обратите внимание, что Data Wrangler не поддерживает чередующиеся токены обновления. Использование чередующихся токенов обновления может привести к сбоям доступа или необходимости частого входа пользователей в систему.

Если срок действия маркера обновления истек, ваши пользователи должны повторно пройти аутентификацию, получив доступ к подключению, которое они установили к Snowflake через Data Wrangler.

- Указывать

session:role-anyкак новый объем.

Для Azure AD необходимо также указать уникальный идентификатор области.

После настройки поставщика OAuth вы предоставляете Data Wrangler информацию, необходимую для подключения к поставщику. Вы можете использовать документацию вашего поставщика удостоверений, чтобы получить значения для следующих полей:

- URL токена – URL-адрес токена, который IdP отправляет в Data Wrangler.

- URL авторизации – URL-адрес сервера авторизации IdP

- идентификатор клиента – идентификатор IdP

- Секрет клиента – Секрет, который распознает только сервер авторизации или API

- Область действия OAuth – Это только для Azure AD

Настроить Снежинку

Чтобы настроить Snowflake, выполните инструкции в Импорт данных из Snowflake.

Используйте документацию Snowflake для вашего IdP, чтобы настроить внешнюю интеграцию OAuth в Snowflake. См. предыдущий раздел Зарегистрируйте приложение Data Wrangler в IdP. для получения дополнительной информации о том, как настроить внешнюю интеграцию OAuth.

Когда вы настраиваете интеграцию безопасности в Snowflake, убедитесь, что вы активировали external_oauth_any_role_mode.

Настройка SageMaker Studio

Вы сохраняете поля и значения в секрете диспетчера секретов и добавляете его в конфигурацию жизненного цикла Studio, которую используете для Data Wrangler. Конфигурация жизненного цикла — это сценарий оболочки, который автоматически загружает учетные данные, хранящиеся в секрете, когда пользователь входит в Studio. Сведения о создании секретов см. Переместите жестко запрограммированные секреты в AWS Secrets Manager. Сведения об использовании конфигураций жизненного цикла в Studio см. Используйте конфигурации жизненного цикла с Amazon SageMaker Studio.

Создайте секрет для учетных данных Snowflake

Чтобы создать секрет для учетных данных Snowflake, выполните следующие действия:

- На консоли диспетчера секретов выберите Храните новый секрет.

- Что касается Секретный тип, наведите на Другой тип секрета.

- Укажите детали вашего секрета в виде пар ключ-значение.

В именах ключей необходимо использовать строчные буквы из-за учета регистра. Data Wrangler выдает предупреждение, если вы введете какой-либо из них неправильно. Введите секретные значения в виде пар ключ-значение, если хотите, или используйте Простой текст опцию.

Ниже приведен формат секрета, используемого для Okta. Если вы используете Azure AD, вам необходимо добавить datasource_oauth_scope поле.

- Обновите предыдущие значения, указав выбранный вами IdP и информацию, полученную после регистрации приложения.

- Выберите Следующая.

- Что касается Секретное имя, добавьте префикс

AmazonSageMaker(например, наш секретAmazonSageMaker-DataWranglerSnowflakeCreds). - В Теги раздел, добавьте тег с ключом

SageMakerи значениеtrue. - Выберите Следующая.

- Остальные поля необязательны; выберите Следующая пока у вас не будет возможности выбрать Магазин хранить секрет.

После сохранения секрета вы вернетесь в консоль менеджера секретов.

- Выберите секрет, который вы только что создали, затем получите секретный ARN.

- Сохраните это в предпочитаемом вами текстовом редакторе, чтобы использовать его позже при создании источника данных Data Wrangler.

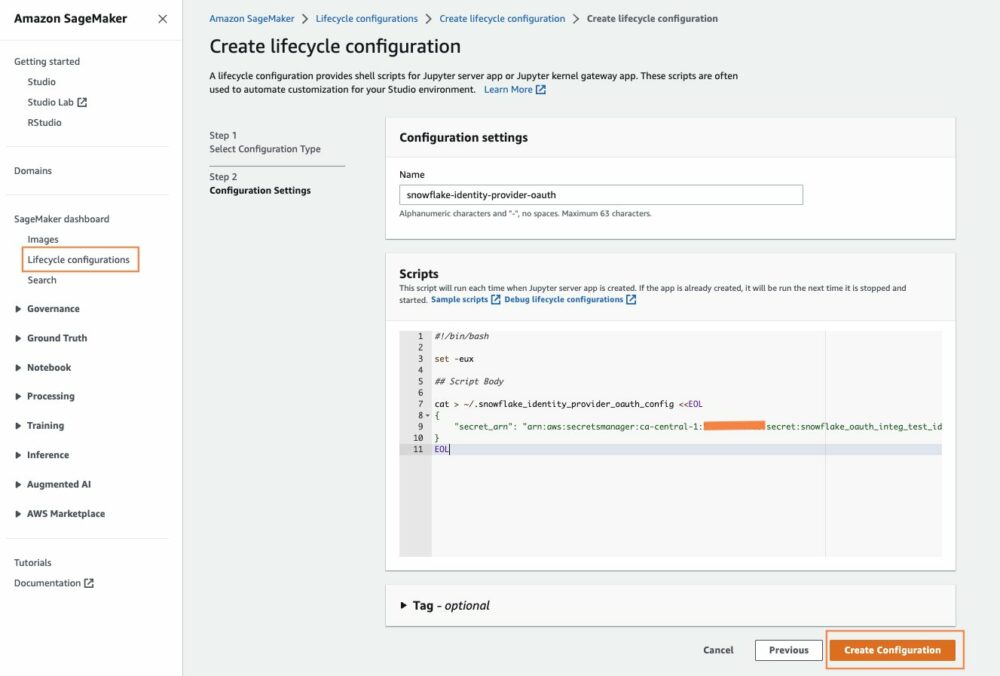

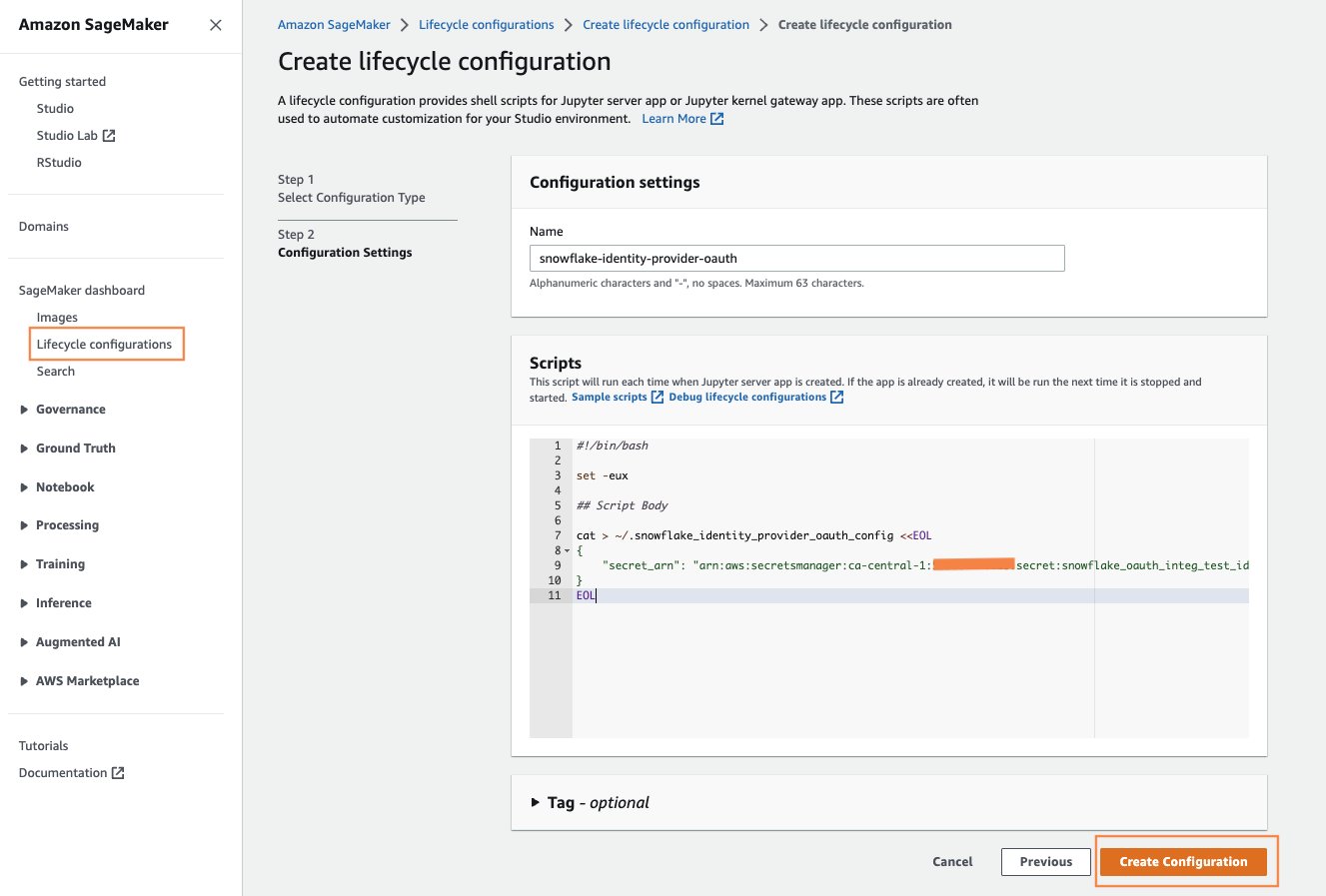

Создание конфигурации жизненного цикла Studio

Чтобы создать конфигурацию жизненного цикла в Studio, выполните следующие действия:

- На консоли SageMaker выберите Конфигурации жизненного цикла в навигационной панели.

- Выберите Создать конфигурацию.

- Выберите Серверное приложение Jupyter.

- Создайте новую конфигурацию жизненного цикла или дополните существующую со следующим содержимым:

Конфигурация создает файл с именем ".snowflake_identity_provider_oauth_config", содержащий секрет в домашней папке пользователя.

- Выберите Создать конфигурацию.

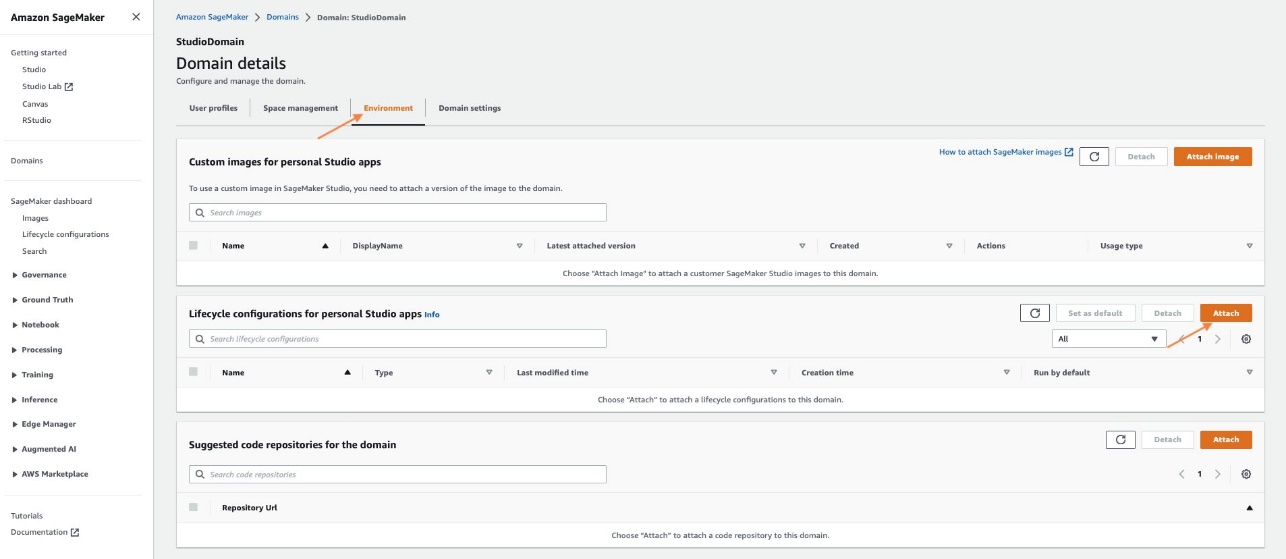

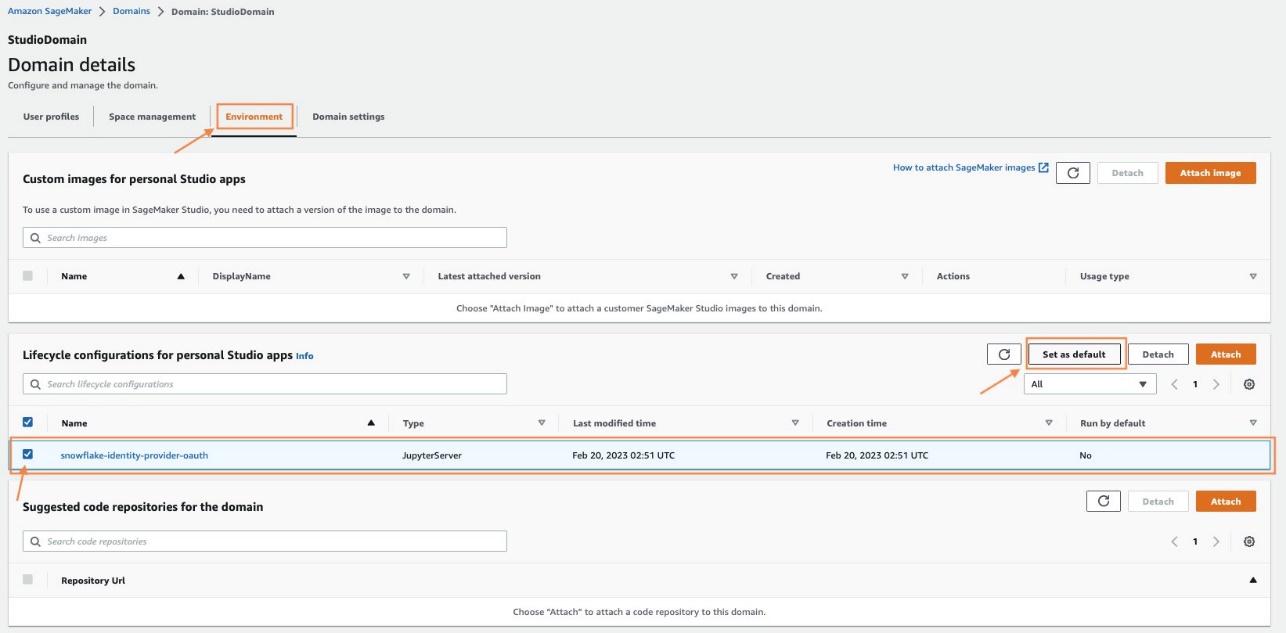

Установите конфигурацию жизненного цикла по умолчанию

Выполните следующие шаги, чтобы установить только что созданную конфигурацию жизненного цикла по умолчанию:

- На консоли SageMaker выберите Домены в навигационной панели.

- Выберите домен Studio, который вы будете использовать для этого примера.

- На Окружающая среда в Конфигурации жизненного цикла для личных приложений Studio раздел, выбрать Прикреплять.

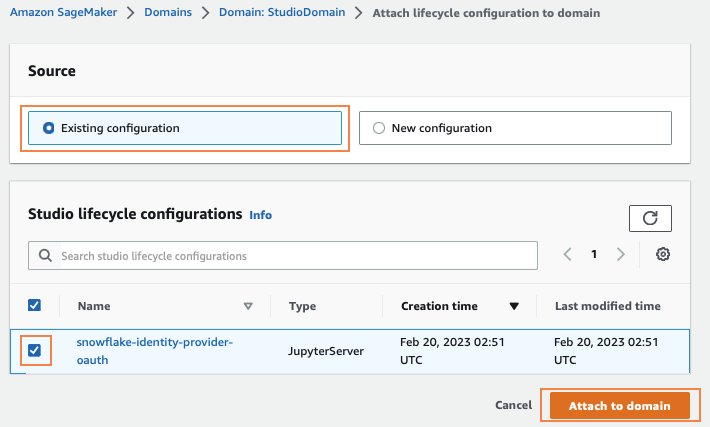

- Что касается Источник, наведите на Существующая конфигурация.

- Выберите конфигурацию, которую вы только что создали, затем выберите Прикрепить к домену.

- Выберите новую конфигурацию и выберите Установить по умолчанию, а затем выберите Установить по умолчанию снова во всплывающем сообщении.

Теперь ваши новые настройки должны быть видны под Конфигурации жизненного цикла для личных приложений Studio по умолчанию.

- Закройте приложение Studio и перезапустите его, чтобы изменения вступили в силу.

Опыт работы с данными

В этом разделе мы расскажем, как специалисты по данным могут подключиться к Snowflake в качестве источника данных в Data Wrangler и подготовить данные для машинного обучения.

Создать новый поток данных

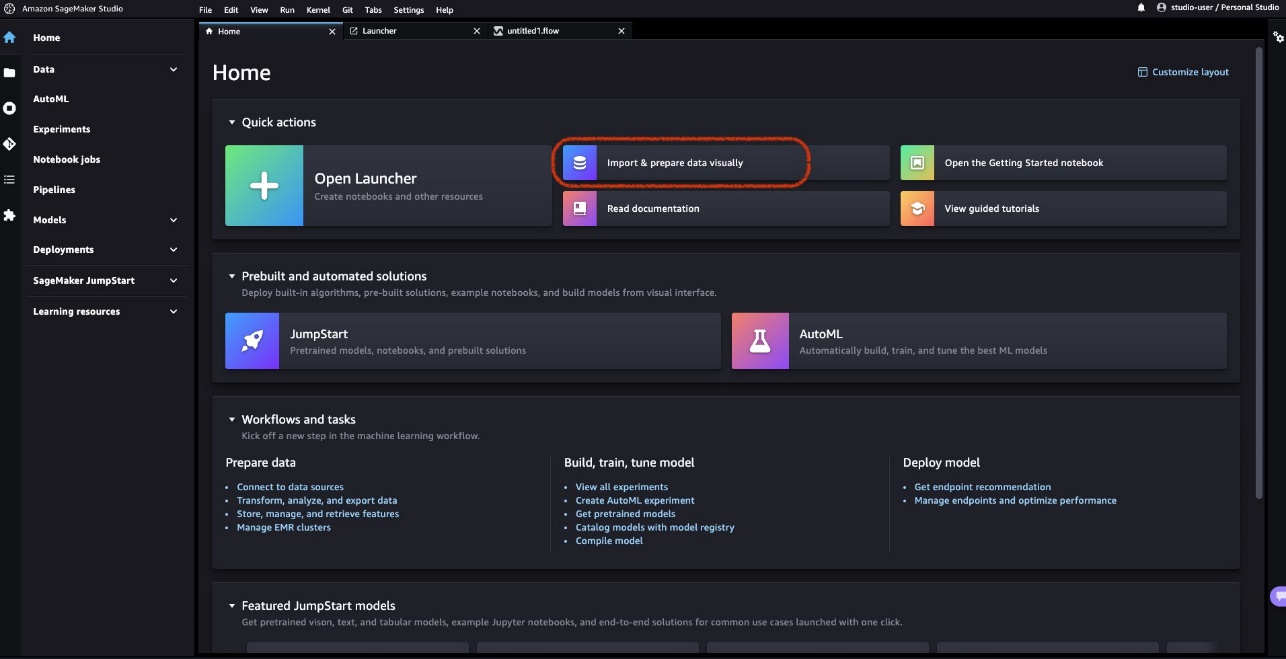

Чтобы создать поток данных, выполните следующие действия:

- На консоли SageMaker выберите Студия Amazon SageMaker в навигационной панели.

- Выберите Открытая студия.

- В студии Главная выберите страницу Импортируйте и подготовьте данные визуально. Как вариант, на Файл выпадающий, выберите Новые, а затем выберите Поток обработки SageMaker Data Wrangler.

Создание нового потока может занять несколько минут.

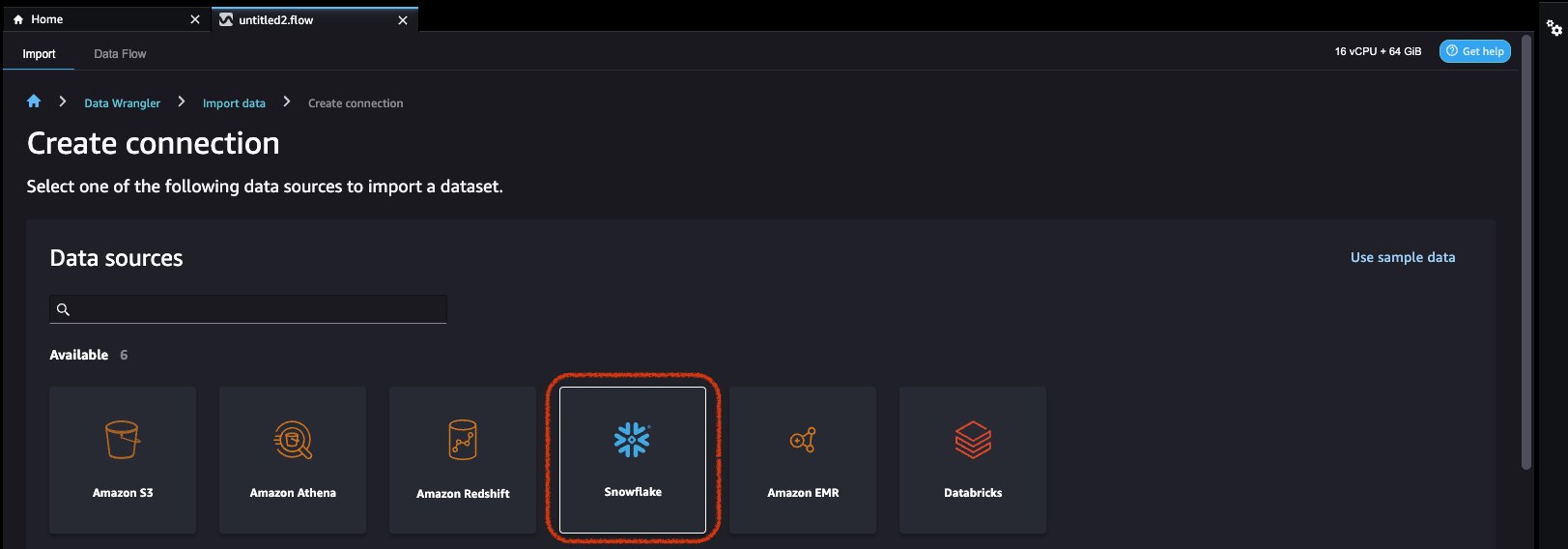

- На Даты импорта выберите страницу Создать соединение.

- Выберите Снежинка из списка источников данных.

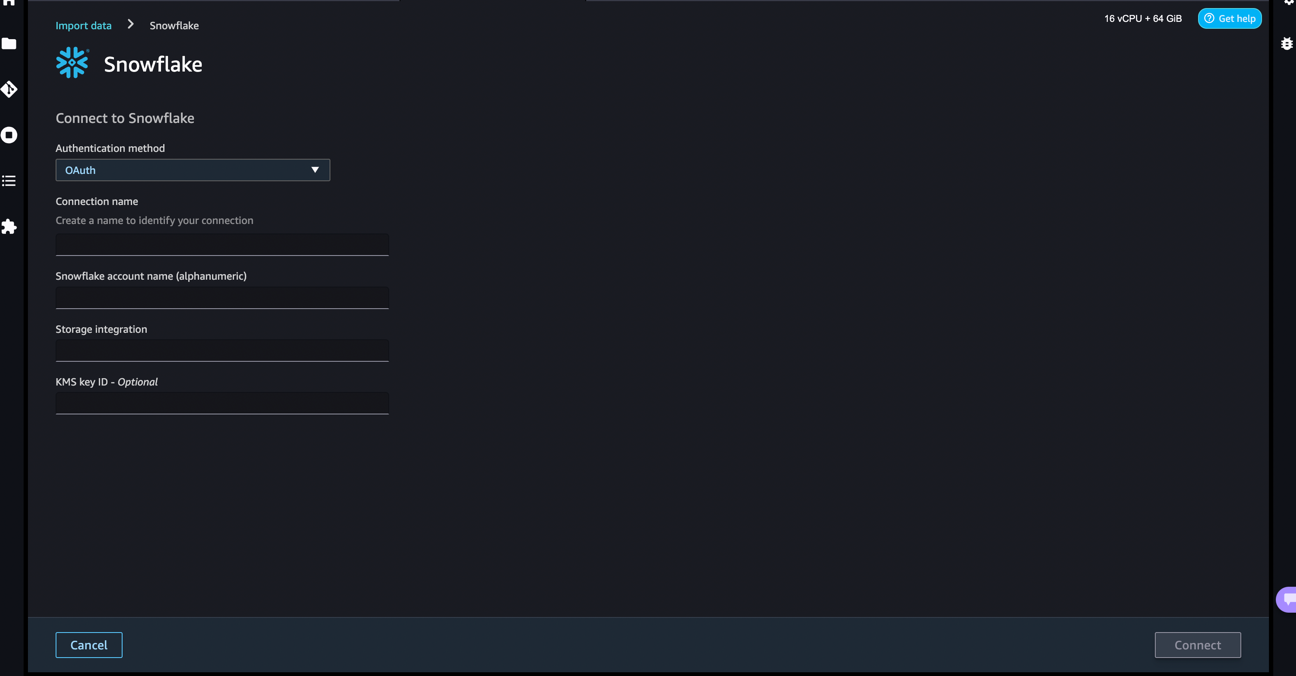

- Что касается Метод аутентификации, выберите OAuth.

Если вы не видите OAuth, проверьте предыдущие шаги настройки жизненного цикла.

- Введите данные для Имя учетной записи Снежинка и Интеграция с хранилищем.

- Введите имя соединения и выберите Свяжитесь.

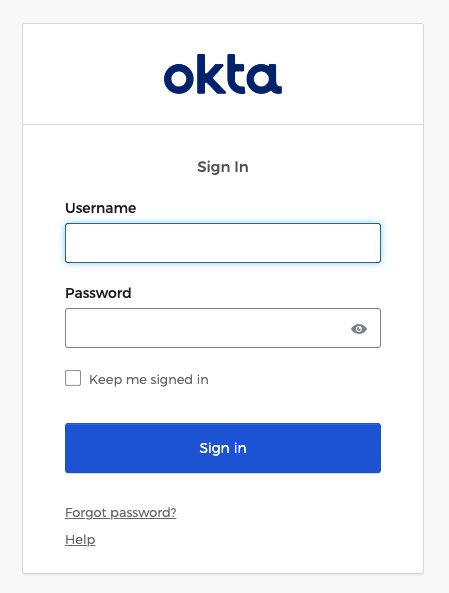

Вы будете перенаправлены на страницу аутентификации IdP. В этом примере мы используем Okta.

- Введите имя пользователя и пароль, затем выберите Вход.

После успешной аутентификации вы будете перенаправлены на страницу потока данных Studio.

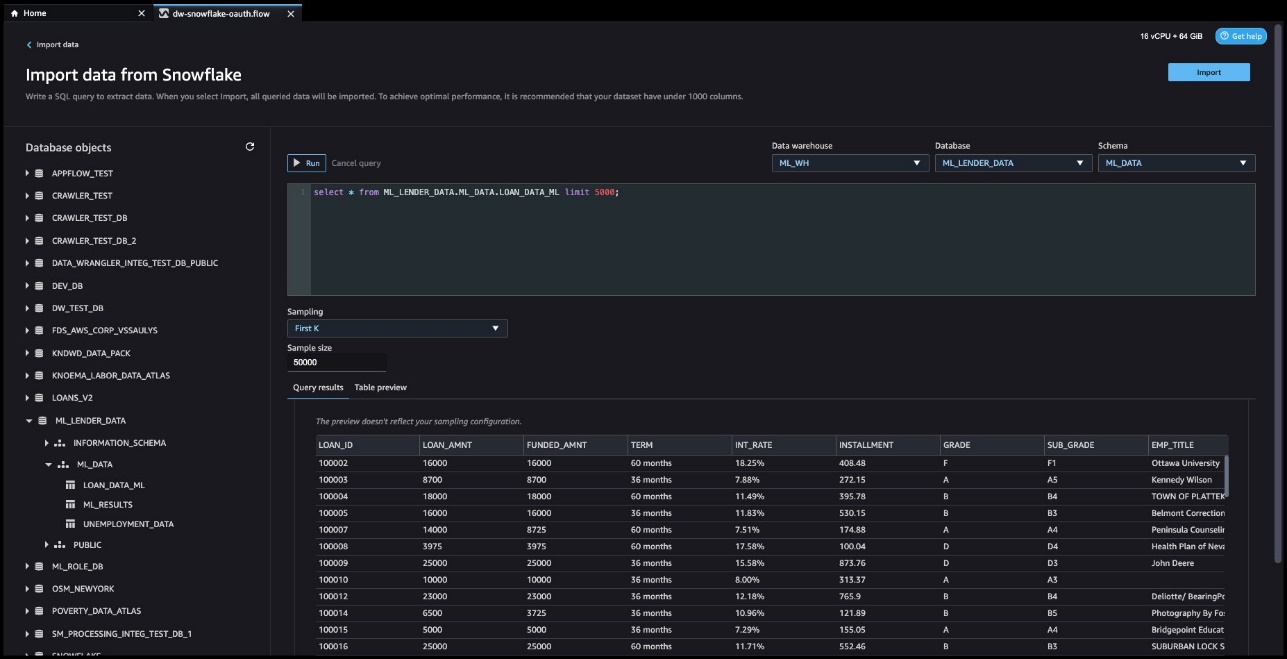

- На Импорт данных из Snowflake страницу, просмотрите объекты базы данных или выполните запрос для целевых данных.

- В редакторе запросов введите запрос и просмотрите результаты.

В следующем примере мы загружаем Данные кредита и получить все столбцы из 5,000 строк.

- Выберите Импортировать.

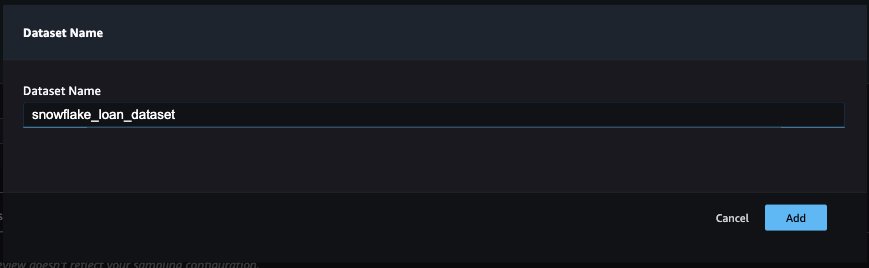

- Введите имя набора данных (для этого поста мы используем

snowflake_loan_dataset) и выберите Добавить.

Вы перенаправлены на Подготовить страница, на которой вы можете добавлять преобразования и анализ к данным.

Data Wrangler упрощает прием данных и выполнение задач по подготовке данных, таких как исследовательский анализ данных, выбор функций и проектирование функций. В этом посте о подготовке данных мы рассмотрели лишь некоторые возможности Data Wrangler; вы можете использовать Data Wrangler для более сложного анализа данных, таких как важность функций, целевая утечка и объяснимость модели, используя простой и интуитивно понятный пользовательский интерфейс.

Анализ качества данных

Использовать Отчет о качестве данных и аналитических данных для анализа данных, импортированных в Data Wrangler. Data Wrangler создает отчет на основе выборочных данных.

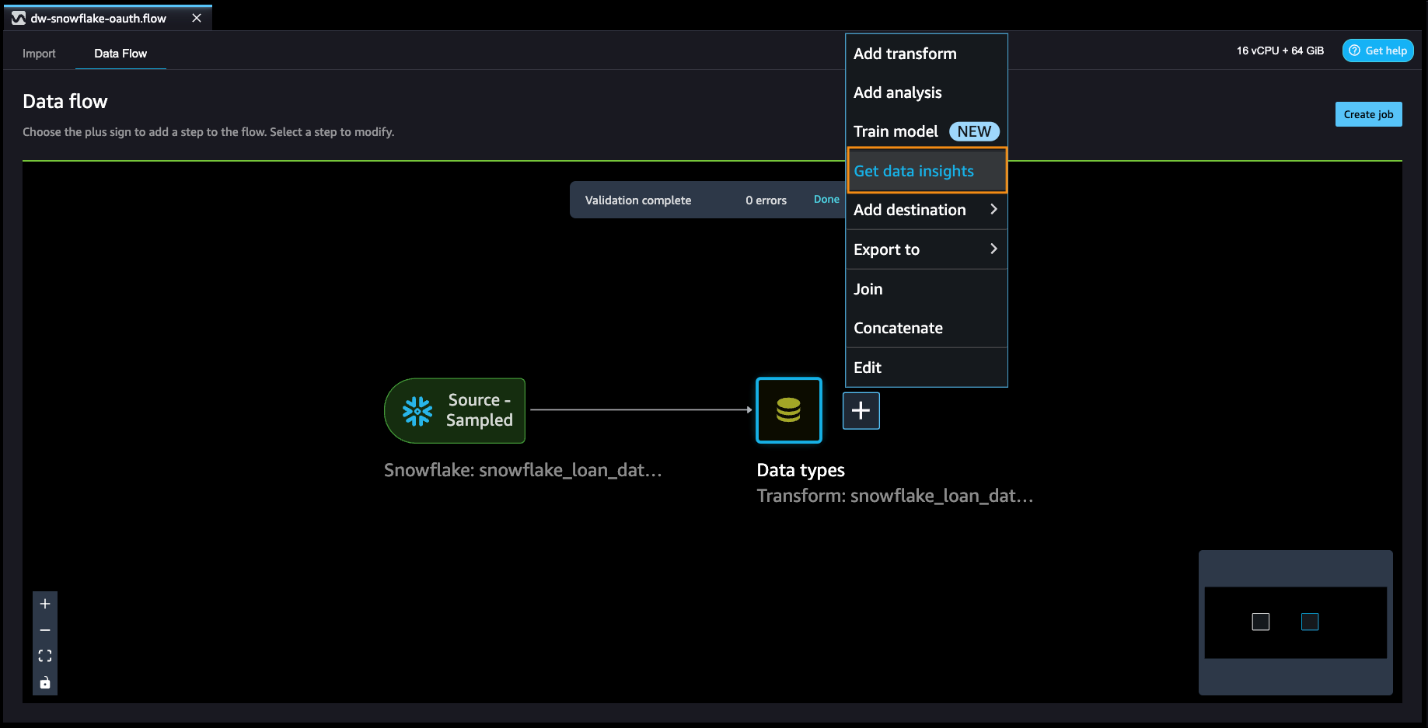

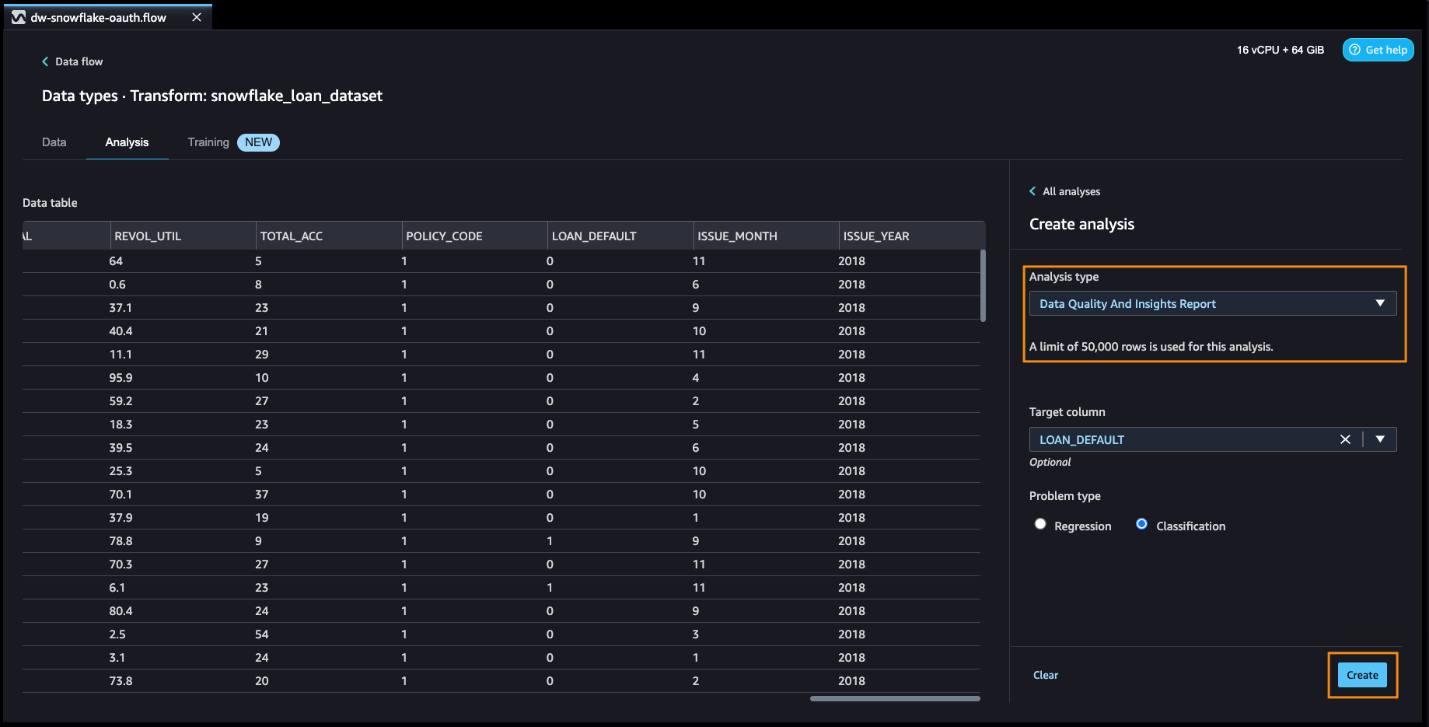

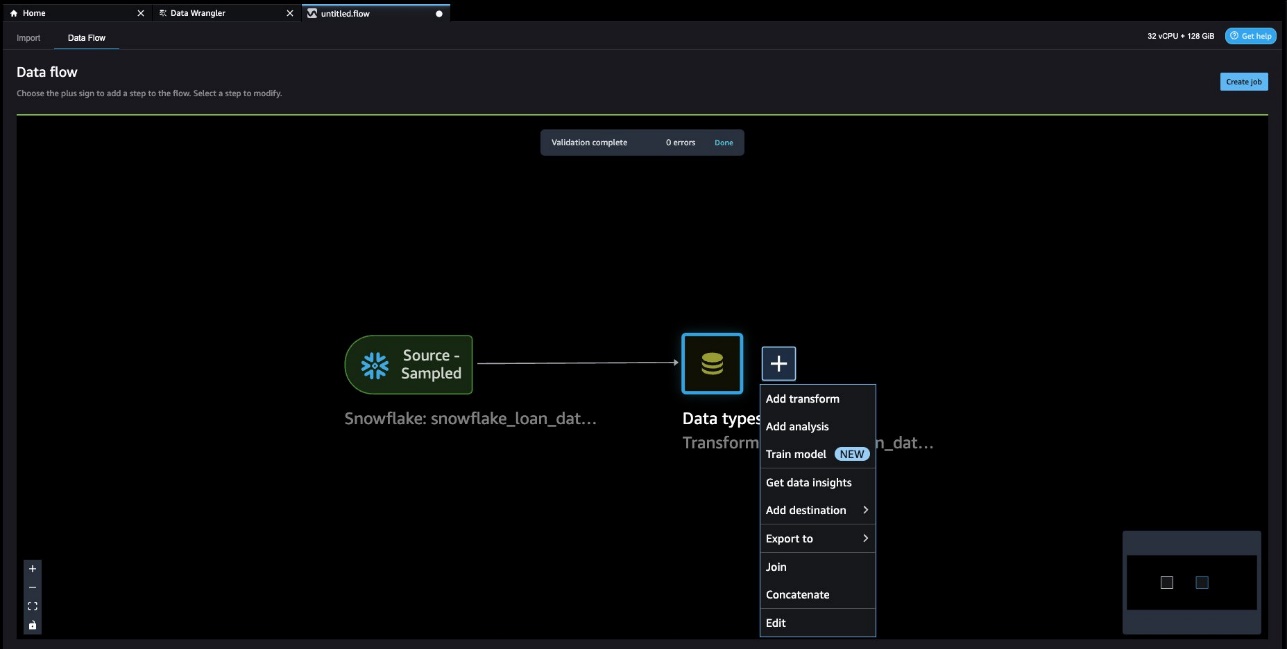

- На странице потока Data Wrangler выберите знак «плюс» рядом с Типы данных, а затем выберите Получите информацию о данных.

- Выберите Отчет о качестве данных и аналитических данных для Тип анализа.

- Что касается Целевой столбец, выберите целевой столбец.

- Что касается Тип проблемы, наведите на классификация.

- Выберите Создавай.

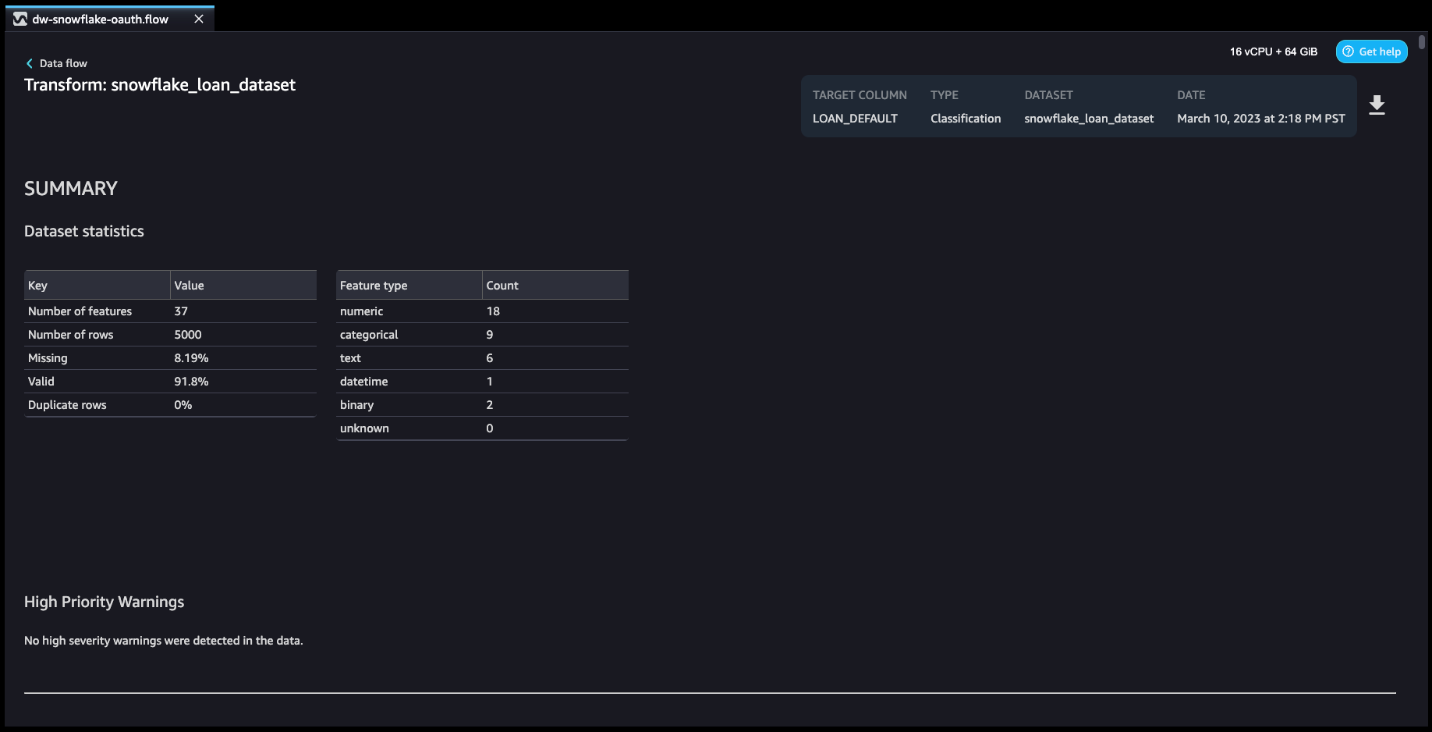

Отчет о аналитических данных содержит краткую сводку данных, которая включает в себя общую информацию, такую как отсутствующие значения, недопустимые значения, типы объектов, количество выбросов и многое другое. Вы можете скачать отчет или просмотреть его онлайн.

Добавить преобразования к данным

Data Wrangler имеет более 300 встроенных преобразований. В этом разделе мы используем некоторые из этих преобразований, чтобы подготовить набор данных для модели машинного обучения.

- На странице потока Data Wrangler выберите знак «плюс», затем выберите Добавить преобразование.

Если вы выполняете действия, описанные в сообщении, вы будете перенаправлены сюда автоматически после добавления набора данных.

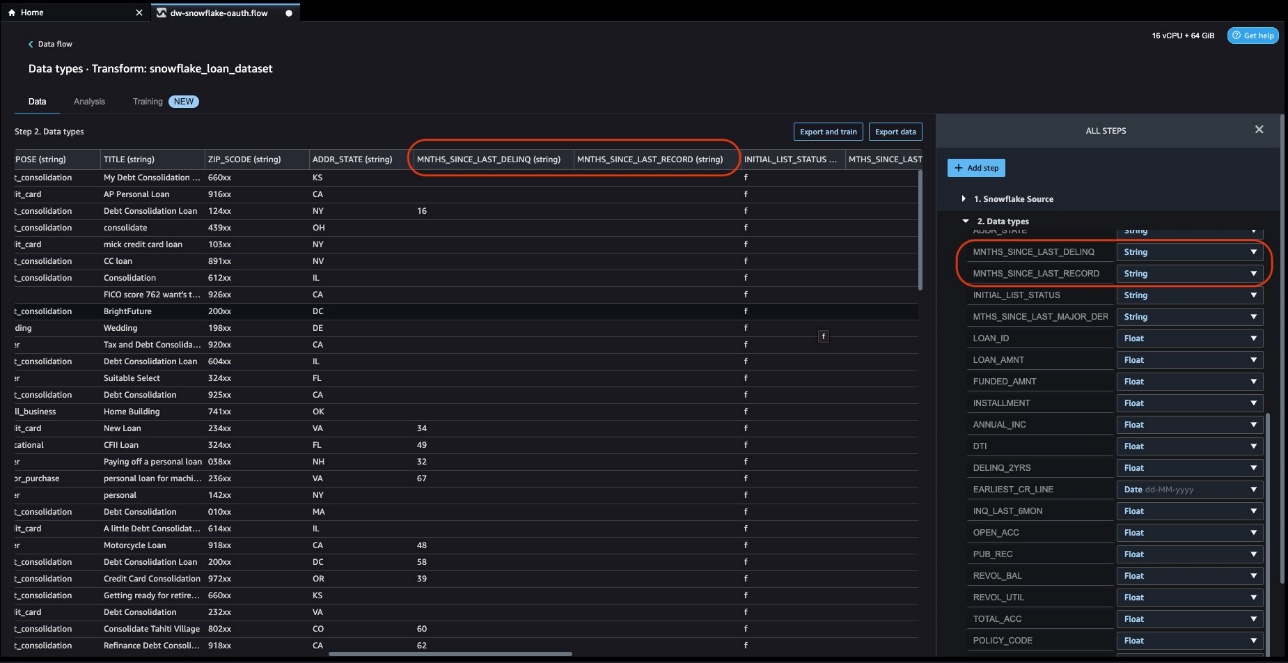

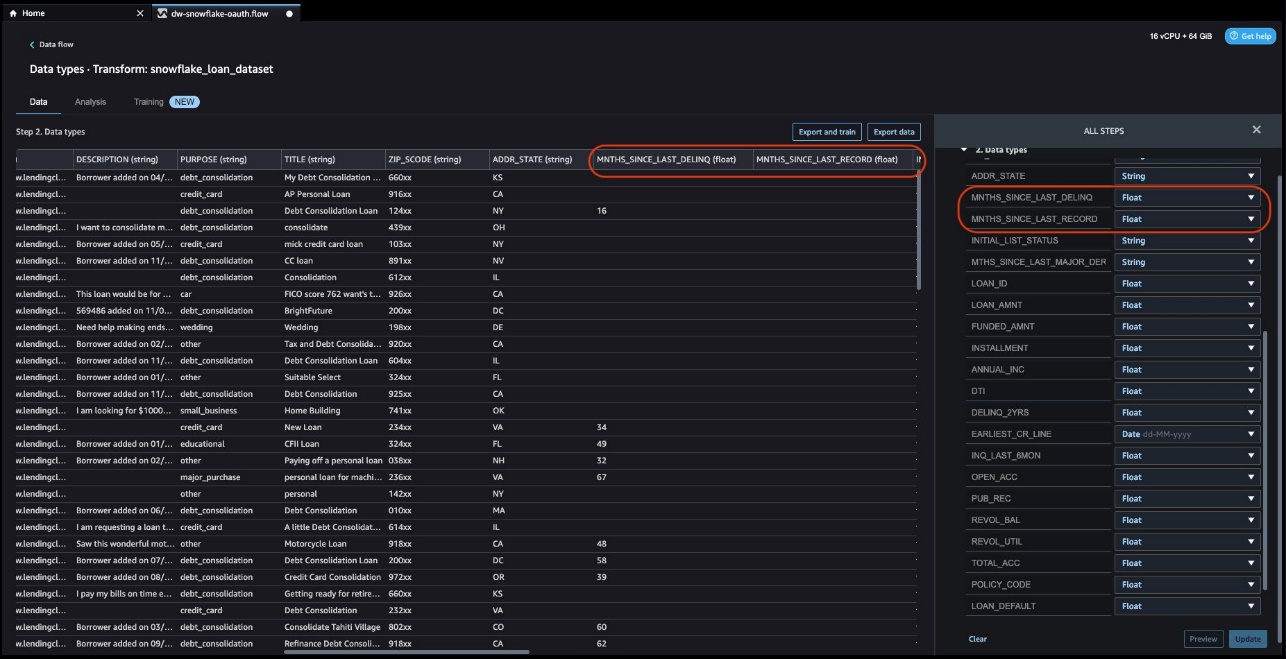

- Проверьте и измените тип данных столбцов.

Просматривая столбцы, мы определяем, что MNTHS_SINCE_LAST_DELINQ и MNTHS_SINCE_LAST_RECORD скорее всего, должен быть представлен как числовой тип, а не как строка.

- После применения изменений и добавления шага вы можете убедиться, что тип данных столбца изменен на плавающий.

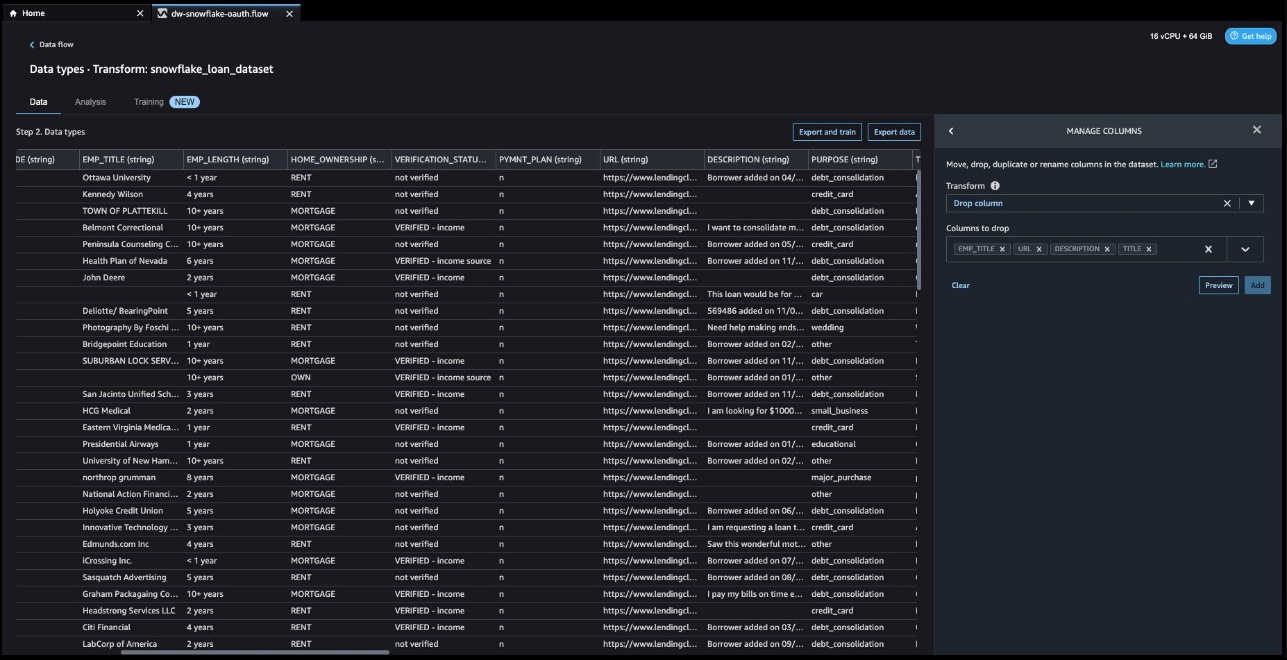

Просматривая данные, мы видим, что поля EMP_TITLE, URL, DESCRIPTIONи TITLE скорее всего, не будет представлять ценность для нашей модели в нашем случае использования, поэтому мы можем отказаться от них.

- Выберите Добавить шаг, а затем выберите Управление столбцами.

- Что касается Transform, выберите Удалить столбец.

- Что касается Столбец, который нужно опустить, указывать

EMP_TITLE,URL,DESCRIPTIONиTITLE. - Выберите предварительный просмотр и Добавить.

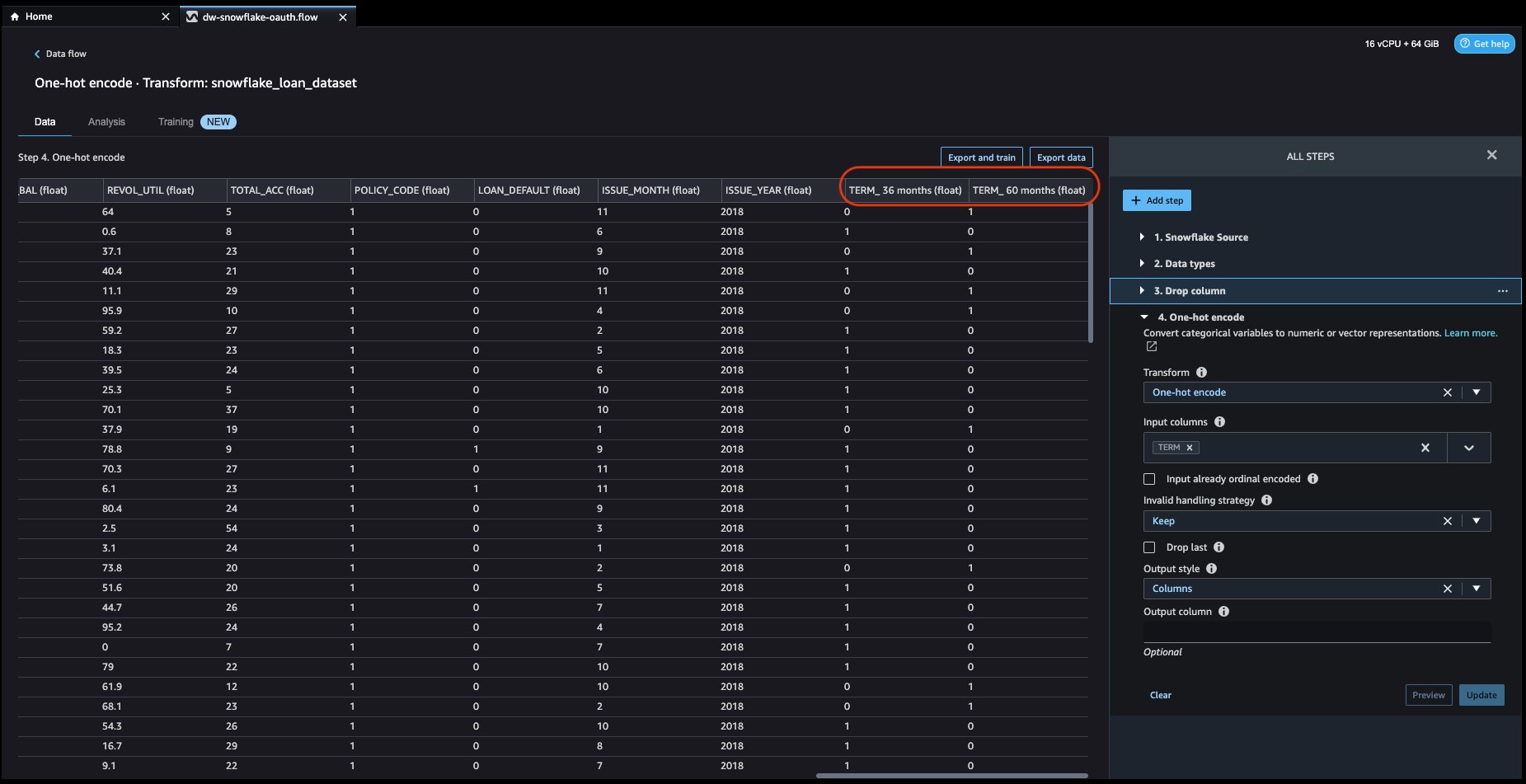

Затем мы хотим найти категориальные данные в нашем наборе данных. Data Wrangler имеет встроенную функциональность для кодирования категориальных данных с использованием как порядкового, так и быстрого кодирования. Глядя на наш набор данных, мы видим, что TERM, HOME_OWNERSHIPи PURPOSE все столбцы кажутся категоричными по своей природе.

- Добавьте еще один шаг и выберите Кодировать категориальный.

- Что касается Transform, выберите Одно горячее кодирование.

- Что касается Столбец ввода, выберите

TERM. - Что касается Стиль вывода, выберите Колонки.

- Оставьте все остальные настройки по умолчанию, затем выберите предварительный просмотр и Добавить.

Ассоциация HOME_OWNERSHIP столбец имеет четыре возможных значения: RENT, MORTGAGE, OWN, и другие.

- Повторите предыдущие шаги, чтобы применить к этим значениям метод однократного кодирования.

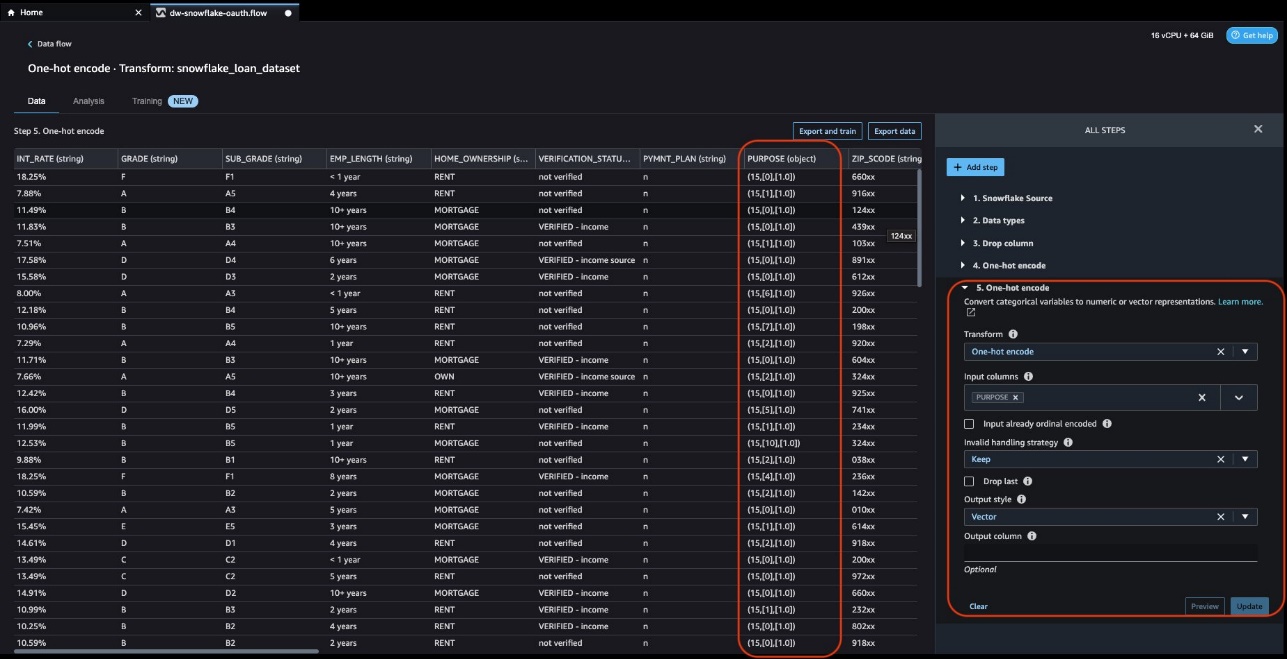

И, наконец, PURPOSE столбец имеет несколько возможных значений. Для этих данных мы также используем метод горячего кодирования, но мы устанавливаем вывод в виде вектора, а не столбца.

- Что касается Transform, выберите Одно горячее кодирование.

- Что касается Столбец ввода, выберите

PURPOSE. - Что касается Стиль вывода, выберите вектор.

- Что касается Выходной столбец, мы называем этот столбец

PURPOSE_VCTR.

Это сохраняет оригинал PURPOSE столбец, если мы решим использовать его позже.

- Оставьте все остальные настройки по умолчанию, затем выберите предварительный просмотр и Добавить.

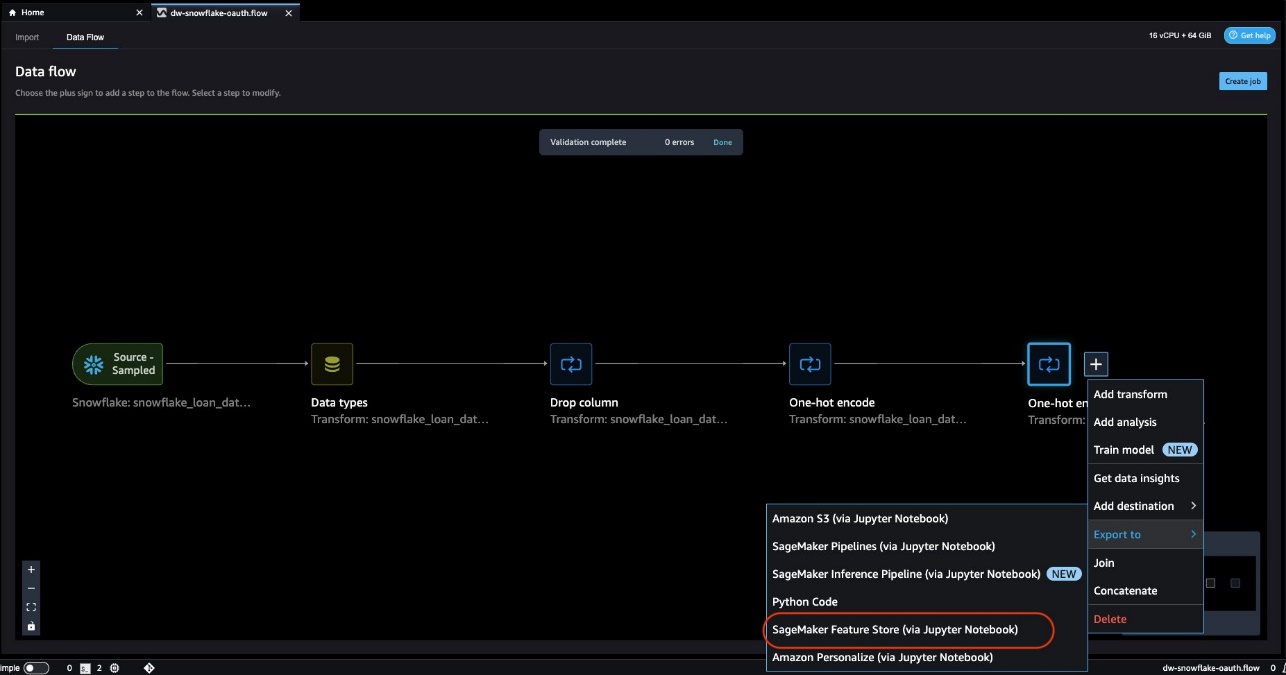

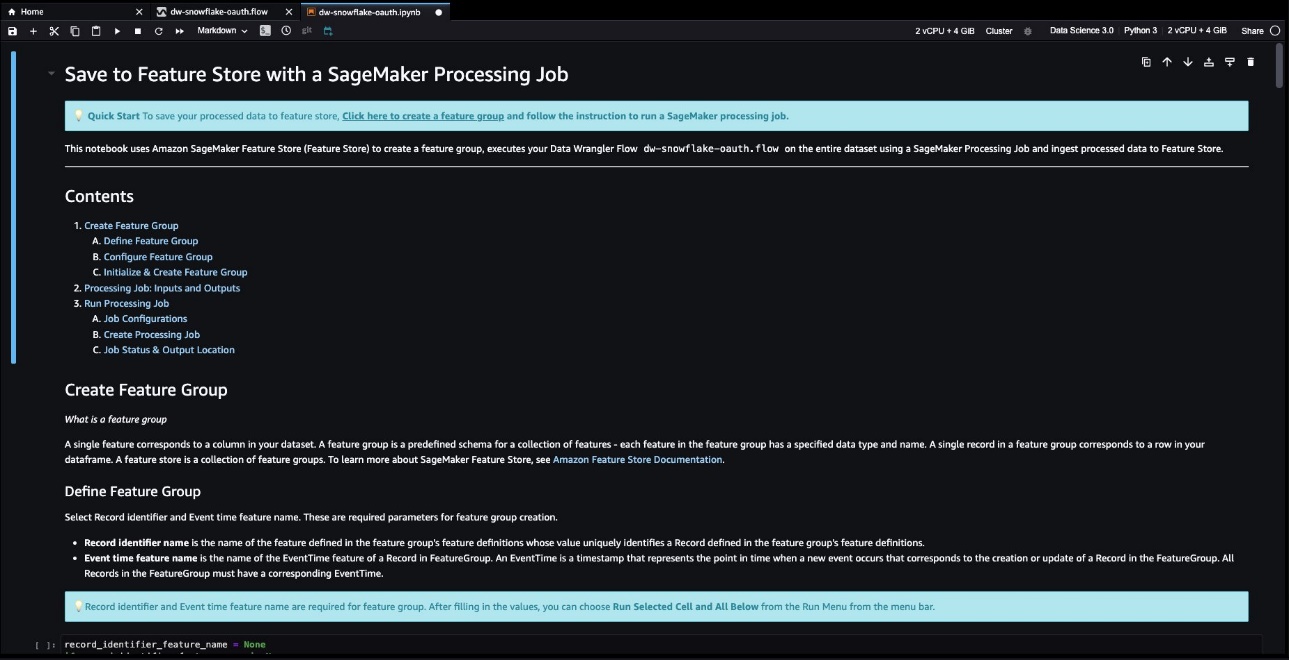

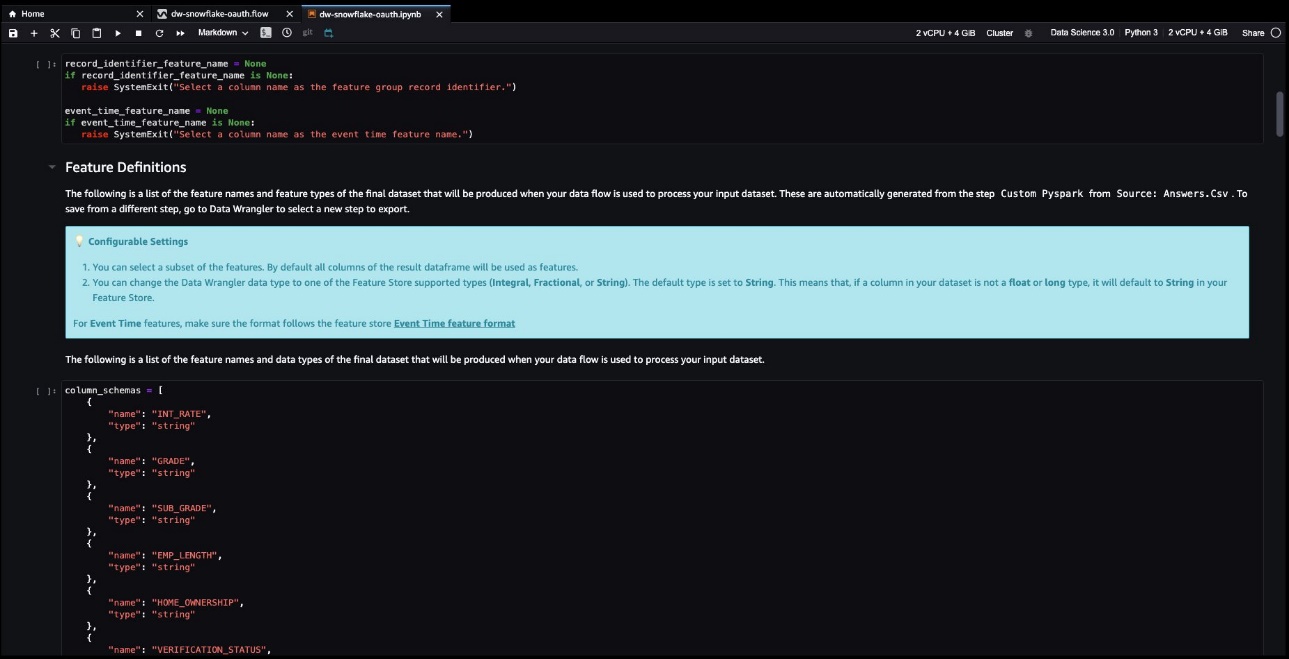

Экспорт потока данных

Наконец, мы экспортируем весь этот поток данных в хранилище функций с помощью задания обработки SageMaker, которое создает блокнот Jupyter с предварительно заполненным кодом.

- На странице потока данных выберите знак плюс и Экспорт в.

- Выберите, куда экспортировать. Для нашего варианта использования мы выбираем Магазин функций SageMaker.

Экспортированный блокнот теперь готов к запуску.

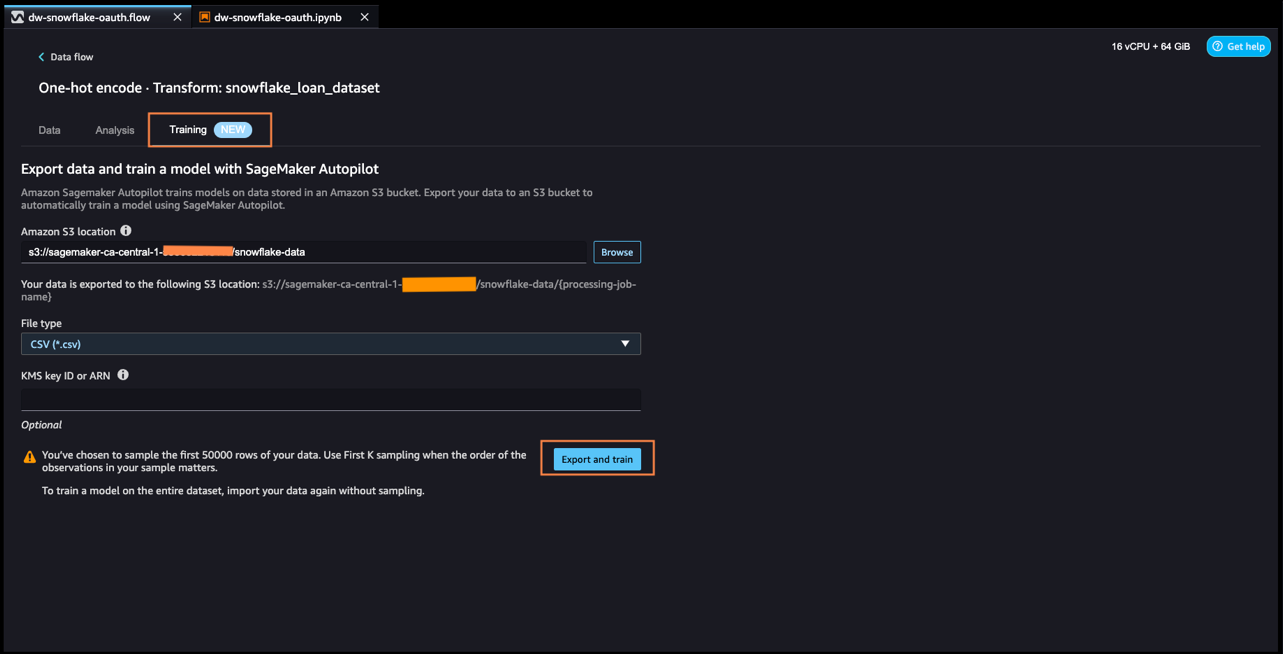

Экспорт данных и обучение модели с помощью автопилота

Теперь мы можем обучить модель, используя Amazon SageMaker Автопилот.

- На странице потока данных выберите Обучение меню.

- Что касается Местоположение Амазон S3, введите место для сохранения данных.

- Выберите Экспорт и обучение.

- Укажите параметры в Цель и особенности, Метод обучения, Развертывание и дополнительные настройкии Просмотрите и создайте раздел.

- Выберите Создать эксперимент чтобы найти лучшую модель для вашей проблемы.

Убирать

Если ваша работа с Data Wrangler завершена, выключите свой экземпляр Data Wrangler чтобы избежать дополнительных сборов.

Заключение

В этом посте мы продемонстрировали подключение Data Wrangler в Snowflake с использованием OAuth, преобразование и анализ набора данных и, наконец, экспорт его в поток данных, чтобы его можно было использовать в блокноте Jupyter. В частности, мы создали конвейер для подготовки данных без необходимости вообще писать код.

Чтобы начать работу с Data Wrangler, см. Подготовка данных машинного обучения с помощью Amazon SageMaker Data Wrangler.

Об авторах

Аджай Говиндарам является старшим архитектором решений в AWS. Он работает со стратегическими клиентами, которые используют AI/ML для решения сложных бизнес-задач. Его опыт заключается в обеспечении технического руководства, а также помощи в проектировании развертывания приложений AI/ML от скромных до крупномасштабных. Его знания варьируются от архитектуры приложений до больших данных, аналитики и машинного обучения. Ему нравится слушать музыку во время отдыха, отдыхать на свежем воздухе и проводить время со своими близкими.

Аджай Говиндарам является старшим архитектором решений в AWS. Он работает со стратегическими клиентами, которые используют AI/ML для решения сложных бизнес-задач. Его опыт заключается в обеспечении технического руководства, а также помощи в проектировании развертывания приложений AI/ML от скромных до крупномасштабных. Его знания варьируются от архитектуры приложений до больших данных, аналитики и машинного обучения. Ему нравится слушать музыку во время отдыха, отдыхать на свежем воздухе и проводить время со своими близкими.

Боско Альбукерке является старшим архитектором партнерских решений в AWS и имеет более чем 20-летний опыт работы с базами данных и аналитическими продуктами от поставщиков корпоративных баз данных и облачных провайдеров. Он помогал крупным технологическим компаниям разрабатывать решения для анализа данных и руководил инженерными группами по разработке и внедрению платформ и продуктов для анализа данных.

Боско Альбукерке является старшим архитектором партнерских решений в AWS и имеет более чем 20-летний опыт работы с базами данных и аналитическими продуктами от поставщиков корпоративных баз данных и облачных провайдеров. Он помогал крупным технологическим компаниям разрабатывать решения для анализа данных и руководил инженерными группами по разработке и внедрению платформ и продуктов для анализа данных.

Мэтт Марзилло является старшим инженером по продажам партнеров в Snowflake. Он имеет 10-летний опыт работы в области науки о данных и машинного обучения как в консалтинге, так и в отраслевых организациях. Мэтт имеет опыт разработки и развертывания моделей искусственного интеллекта и машинного обучения в различных организациях в таких областях, как маркетинг, продажи, операционная деятельность, клиническая практика и финансы, а также консультирование в качестве консультанта.

Мэтт Марзилло является старшим инженером по продажам партнеров в Snowflake. Он имеет 10-летний опыт работы в области науки о данных и машинного обучения как в консалтинге, так и в отраслевых организациях. Мэтт имеет опыт разработки и развертывания моделей искусственного интеллекта и машинного обучения в различных организациях в таких областях, как маркетинг, продажи, операционная деятельность, клиническая практика и финансы, а также консультирование в качестве консультанта.

Хуонг Нгуен является руководителем продукта Amazon SageMaker Data Wrangler в AWS. Она имеет 15-летний опыт создания продуктов, ориентированных на клиентов и ориентированных на данные, как для корпоративных, так и для потребительских пространств. В свободное время она любит аудиокниги, садоводство, походы и проводит время с семьей и друзьями.

Хуонг Нгуен является руководителем продукта Amazon SageMaker Data Wrangler в AWS. Она имеет 15-летний опыт создания продуктов, ориентированных на клиентов и ориентированных на данные, как для корпоративных, так и для потребительских пространств. В свободное время она любит аудиокниги, садоводство, походы и проводит время с семьей и друзьями.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :является

- $UP

- 000

- 10

- 100

- 15 лет

- 20 лет

- 7

- 8

- 9

- a

- в состоянии

- О нас

- доступ

- Доступ к данным

- доступа

- Учетная запись

- через

- Ad

- дополнение

- дополнительный

- Администратор

- продвижение

- продвинутый

- консультирование

- После

- AI

- AI / ML

- Все

- Amazon

- Создатель мудреца Амазонки

- Обработчик данных Amazon SageMaker

- Анализ

- анализ

- аналитика

- анализировать

- анализ

- и

- Другой

- API

- приложение

- появиться

- Применение

- Применить

- Применение

- подхода

- Программы

- архитектура

- МЫ

- области

- AS

- Помощь

- связанный

- At

- прикреплять

- аудитория

- аудио

- проверять подлинность

- Аутентификация

- разрешение

- автоматизировать

- автоматически

- AWS

- Лазурный

- BE

- , так как:

- до

- начинать

- ЛУЧШЕЕ

- большой

- Big Data

- тело

- Книги

- встроенный

- бизнес

- by

- призывают

- под названием

- CAN

- возможности

- случаев

- КПП

- изменения

- выбор

- Выберите

- клиент

- Клинический

- облако

- код

- Column

- Колонки

- Компании

- полный

- комплекс

- сама концепция

- Конфигурация

- Свяжитесь

- Соединительный

- связи

- Консоли

- консалтинг

- потребитель

- содержание

- может

- чехол для варгана

- покрытый

- Создайте

- создали

- создает

- Создающий

- Полномочия

- Клиенты

- данным

- анализ данных

- Анализ данных

- Платформа данных

- Подготовка данных

- наука о данных

- ученый данных

- управляемых данными

- База данных

- решать

- По умолчанию

- убивают

- развертывание

- развертывания

- Проект

- проектирование

- подробность

- подробнее

- развивающийся

- различный

- направление

- непосредственно

- отчетливый

- документации

- не

- домен

- Dont

- вниз

- скачать

- Падение

- каждый

- редактор

- эффект

- или

- включить

- инженер

- Проект и

- Enter

- Предприятие

- Окружающая среда

- пример

- существующий

- опыт

- испытывающих

- Исследовательский анализ данных

- экспорт

- и, что лучший способ

- FAIL

- семья

- Особенность

- Особенности

- Сборы

- несколько

- поле

- Поля

- Файл

- в заключение

- финансы

- Найдите

- Поплавок

- поток

- после

- Что касается

- формат

- частота

- часто

- друзья

- от

- функциональность

- Общие

- получить

- дает

- предоставлять

- большой

- Гиды

- Есть

- имеющий

- помощь

- помог

- здесь

- Главная

- Как

- How To

- HTML

- HTTP

- HTTPS

- ID

- идентификатор

- определения

- Личность

- Idle

- Осуществляющий

- Импортировать

- значение

- in

- включает в себя

- В том числе

- неверно

- промышленность

- информация

- вход

- понимание

- размышления

- инструкции

- интеграции.

- интеграций

- Интерфейс

- интуитивный

- вовлеченный

- IT

- работа

- Джобс

- JPG

- Основные

- знания

- большой

- крупномасштабный

- лидер

- изучение

- привело

- лежит

- Жизненный цикл

- продолжительность жизни

- такое как

- Вероятно

- Список

- Listening

- загрузка

- грузы

- расположение

- посмотреть

- искать

- любимый

- машина

- обучение с помощью машины

- сделанный

- сделать

- ДЕЛАЕТ

- Создание

- менеджер

- многих

- Маркетинг

- сообщение

- может быть

- Минут

- отсутствующий

- ML

- модель

- Модели

- изменять

- БОЛЕЕ

- самых

- с разными

- Музыка

- имя

- имена

- природа

- Навигация

- Необходимость

- нуждающихся

- потребности

- Новые

- следующий

- особенно

- ноутбук

- номер

- OAuth

- объекты

- of

- ОКТА

- on

- ONE

- онлайн

- Операционный отдел

- Опция

- организации

- оригинал

- Другое

- в противном случае

- на открытом воздухе

- выходной

- собственный

- страница

- пар

- хлеб

- партнер

- Пароль

- Выполнять

- Разрешения

- личного

- трубопровод

- Платформа

- Платформы

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- плюс

- сборах

- сообщения

- возможное

- После

- привилегированный

- Подготовить

- предпосылки

- предварительный просмотр

- предыдущий

- Проблема

- проблемам

- Процедуры

- процесс

- обработка

- Продукт

- Продукция

- Профиль

- Программирование

- должным образом

- обеспечивать

- при условии

- Недвижимости

- поставщики

- приводит

- обеспечение

- скорее

- готовый

- рекомендовать

- переориентировать

- снижение

- область

- зарегистрироваться

- регистрирующий

- Регистрация

- повторно запускать

- отчету

- представленный

- требовать

- те

- ОТДЫХ

- результат

- Итоги

- розничный

- Роли

- роли

- Run

- Бег

- sagemaker

- главная

- планирование

- Наука

- Ученый

- Ученые

- сфера

- Secret

- Раздел

- разделах

- безопасность

- выбор

- старший

- чувствительность

- набор

- установка

- настройки

- несколько

- Оболочка

- должен

- показывать

- подпись

- просто

- одинарной

- So

- Решения

- РЕШАТЬ

- некоторые

- Источник

- Источники

- пространства

- Расходы

- и политические лидеры

- начинается

- Шаг

- Шаги

- диск

- магазин

- хранить

- хранение

- Стратегический

- строка

- студия

- успешный

- такие

- РЕЗЮМЕ

- поддержка

- Поддержка

- TAG

- взять

- принимает

- цель

- целевое

- задачи

- команды

- Технический

- Технологии

- технологические компании

- который

- Ассоциация

- информация

- их

- Их

- Эти

- Через

- время

- в

- знак

- Лексемы

- Train

- Transform

- преобразований

- превращение

- Типы

- под

- понимать

- созданного

- Обновление ПО

- URL

- использование

- прецедент

- Информация о пользователе

- Пользовательский интерфейс

- пользователей

- ценностное

- Наши ценности

- поставщики

- проверить

- с помощью

- Вид

- видимый

- прохождение

- предупреждение

- Недели

- ЧТО Ж

- который

- в то время как

- КТО

- все

- будете

- в

- без

- Работа

- Рабочие процессы

- работает

- работает

- записывать

- письмо

- лет

- Ты

- ВАШЕ

- зефирнет