Классификация изображений — это метод машинного обучения (ML), основанный на компьютерном зрении, который позволяет классифицировать изображения. Некоторые хорошо известные примеры классификации изображений включают классификацию рукописных цифр, классификацию медицинских изображений и распознавание лиц. Классификация изображений — полезный метод для нескольких бизнес-приложений, но создание хорошей модели классификации изображений — нетривиальная задача.

Несколько соображений могут сыграть роль при оценке модели ML. Помимо точности модели, другими потенциальными важными показателями являются время обучения модели и время вывода. Учитывая итеративный характер разработки модели машинного обучения, сокращение времени обучения позволяет специалистам по данным быстро проверять различные гипотезы. Более быстрое формирование логических выводов может иметь решающее значение в приложениях реального времени.

Amazon SageMaker JumpStart обеспечивает тонкую настройку одним щелчком мыши и развертывание широкого спектра предварительно обученных моделей для популярных задач машинного обучения, а также выбор комплексных решений для решения общих бизнес-задач. Эти функции избавляют от тяжелой работы на каждом этапе процесса машинного обучения, упрощая разработку высококачественных моделей и сокращая время развертывания. API-интерфейсы JumpStart позволяют программно развертывать и настраивать широкий выбор предварительно обученных моделей, поддерживаемых JumpStart, в ваших собственных наборах данных.

Вы можете постепенно обучать и настраивать модели машинного обучения, предлагаемые в JumpStart, перед развертыванием. На момент написания статьи в JumpStart было доступно 87 моделей классификации изображений на основе глубокого обучения.

Но какая модель даст вам наилучшие результаты? В этом посте мы представляем методологию простого запуска нескольких моделей и сравнения их результатов по трем интересующим параметрам: точность модели, время обучения и время вывода.

Обзор решения

JumpStart позволяет обучать, настраивать и развертывать модели либо из консоли JumpStart, используя ее пользовательский интерфейс, либо ее API. В этом посте мы используем маршрут API и представляем блокнот с различными вспомогательными скриптами. Вы можете запустить эту записную книжку и получить результаты для простого сравнения этих моделей друг с другом, а затем выбрать модель, которая лучше всего соответствует потребностям вашего бизнеса с точки зрения точности модели, времени обучения и времени вывода.

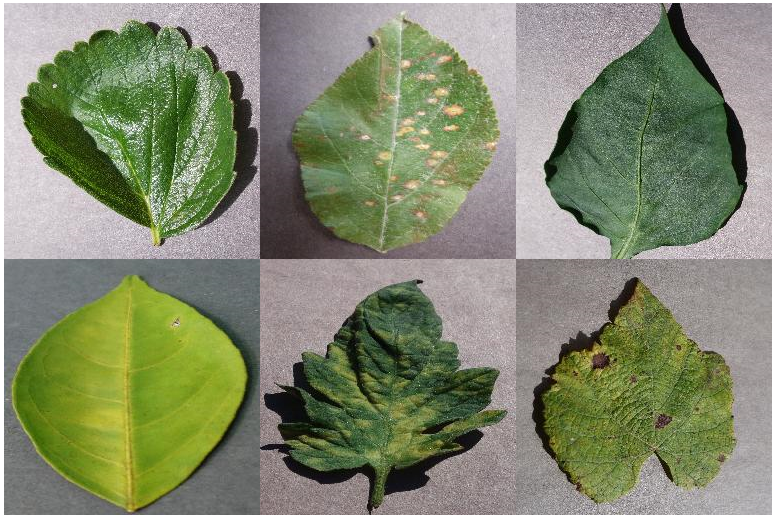

Ассоциация общедоступный набор данных используемый в этом посте, состоит из почти 55,000 0 изображений листьев больных и здоровых растений, собранных в контролируемых условиях, с метками классов от 38 до 44,000. Этот набор данных разделен на наборы данных для обучения и проверки, примерно 11,000 XNUMX изображений проходят обучение и XNUMX XNUMX изображений проходят проверку. Ниже приведены несколько примеров изображений.

Для этого упражнения мы выбрали модели из двух фреймворков — PyTorch и TensorFlow — предложенных JumpStart. Следующие 15 модельных алгоритмов охватывают широкий спектр популярных архитектур нейронных сетей из этих фреймворков:

pytorch-ic-alexnet-FTpytorch-ic-densenet121-FTpytorch-ic-densenet201-FTpytorch-ic-googlenet-FTpytorch-ic-mobilenet-v2-FTpytorch-ic-resnet152-FTpytorch-ic-resnet34-FTtensorflow-ic-bit-s-r101x1-ilsvrc2012-classification-1-FTtensorflow-ic-imagenet-inception-resnet-v2-classification 4-FTtensorflow-ic-imagenet-inception-v3-classification-4-FTtensorflow-ic-imagenet-mobilenet-v2-050-224-classification-4-FTtensorflow-ic-imagenet-mobilenet-v2-075-224-classification-4-FTtensorflow-ic-imagenet-mobilenet-v2-140-224-classification-4-FTtensorflow-ic-imagenet-resnet-v2-152-classification-4-FTtensorflow-ic-tf2-preview-mobilenet-v2-classification-4-FT

Мы используем модель tensorflow-ic-imagenet-inception-v3-classification-4-FT в качестве базы, с которой сравниваются результаты других моделей. Эта базовая модель была выбрана произвольно.

Код, используемый для запуска этого сравнения, доступен на Репозиторий AWS Samples на GitHub.

Итоги

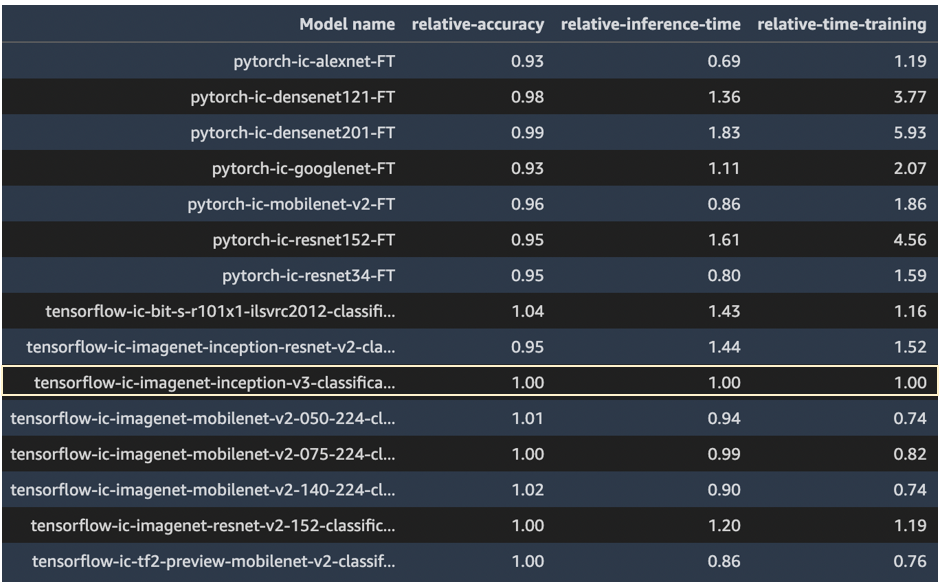

В этом разделе мы представляем результаты этих 15 прогонов. Для всех этих прогонов использовались гиперпараметры: эпохи = 5, скорость обучения = 0.001, размер партии = 16.

Точность модели, время обучения и время вывода из модели tensorflow-ic-imagenet-inception-v3-classification-4-FT были взяты за основу, и результаты всех остальных моделей представлены относительно этой базовой модели. Наша цель здесь не в том, чтобы показать, какая модель лучше, а в том, чтобы показать, как с помощью JumpStart API вы можете сравнивать результаты различных моделей, а затем выбирать модель, которая лучше всего подходит для вашего варианта использования.

На следующем снимке экрана показана базовая модель, с которой сравнивались все остальные модели.

На следующем графике показано подробное представление относительной точности по сравнению с относительным временем обучения. Модели PyTorch имеют красный цвет, а модели TensorFlow — синий.

Модели, выделенные зеленым эллипсом на предыдущем графике, имеют хорошее сочетание относительной точности и небольшого относительного времени обучения. В следующей таблице приведены дополнительные сведения об этих трех моделях.

| Название модели | Относительная точность | Относительное время обучения |

| tensorflow-ic-imagenet-mobilenet-v2-050-224-классификация-4-FT | 1.01 | 0.74 |

| tensorflow-ic-imagenet-mobilenet-v2-140-224-классификация-4-FT | 1.02 | 0.74 |

| тензорный поток-ic-бит-s-r101x1-ilsvrc2012-классификация-1-FT | 1.04 | 1.16 |

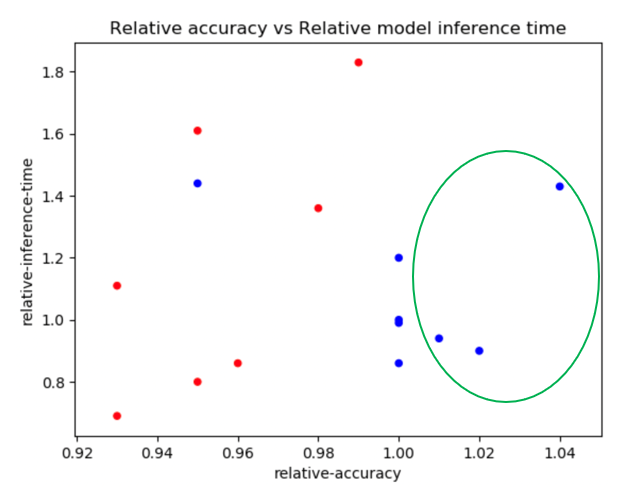

На следующем графике сравнивается относительная точность с относительным временем вывода. Модели PyTorch имеют красный цвет, а модели TensorFlow — синий.

В следующей таблице приведены сведения о трех моделях, отмеченных зеленым эллипсом.

| Название модели | Относительная точность | Относительное время вывода |

| tensorflow-ic-imagenet-mobilenet-v2-050-224-классификация-4-FT | 1.01 | 0.94 |

| tensorflow-ic-imagenet-mobilenet-v2-140-224-классификация-4-FT | 1.02 | 0.90 |

| тензорный поток-ic-бит-s-r101x1-ilsvrc2012-классификация-1-FT | 1.04 | 1.43 |

Два графика ясно демонстрируют, что некоторые алгоритмы модели работали лучше, чем другие, по трем выбранным измерениям. Гибкость, обеспечиваемая этим упражнением, может помочь вам выбрать правильный алгоритм, а с помощью прилагаемой записной книжки вы можете легко провести этот тип эксперимента на любой из 87 доступных моделей.

Заключение

В этом посте мы показали, как использовать JumpStart для создания высокопроизводительных моделей классификации изображений по нескольким интересующим параметрам, таким как точность модели, время обучения и задержка вывода. Мы также предоставили код для выполнения этого упражнения на вашем собственном наборе данных; вы можете выбрать любую интересующую вас модель из 87 моделей, которые в настоящее время доступны для классификации изображений в центре моделей JumpStart. Мы рекомендуем вам попробовать сегодня.

Дополнительные сведения о JumpStart см. SageMaker JumpStart.

Об авторах

Доктор Раджу Пенматча является специалистом по ИИ/МО, архитектором решений по платформам ИИ в AWS. Он получил докторскую степень в Стэнфордском университете. Он тесно сотрудничает с набором сервисов SageMaker, не требующим написания кода, которые помогают клиентам легко создавать и развертывать модели и решения машинного обучения. Когда он не помогает клиентам, ему нравится путешествовать по новым местам.

Доктор Раджу Пенматча является специалистом по ИИ/МО, архитектором решений по платформам ИИ в AWS. Он получил докторскую степень в Стэнфордском университете. Он тесно сотрудничает с набором сервисов SageMaker, не требующим написания кода, которые помогают клиентам легко создавать и развертывать модели и решения машинного обучения. Когда он не помогает клиентам, ему нравится путешествовать по новым местам.

Доктор Ашиш Хетан — старший научный сотрудник, работающий со встроенными алгоритмами Amazon SageMaker и помогающий разрабатывать алгоритмы машинного обучения. Он получил докторскую степень в Университете Иллинойса в Урбана-Шампейн. Он является активным исследователем в области машинного обучения и статистических выводов и опубликовал множество статей на конференциях NeurIPS, ICML, ICLR, JMLR, ACL и EMNLP.

Доктор Ашиш Хетан — старший научный сотрудник, работающий со встроенными алгоритмами Amazon SageMaker и помогающий разрабатывать алгоритмы машинного обучения. Он получил докторскую степень в Университете Иллинойса в Урбана-Шампейн. Он является активным исследователем в области машинного обучения и статистических выводов и опубликовал множество статей на конференциях NeurIPS, ICML, ICLR, JMLR, ACL и EMNLP.

- AI

- ай искусство

- генератор искусств ай

- искусственный интеллект

- Создатель мудреца Амазонки

- Amazon SageMaker JumpStart

- искусственный интеллект

- сертификация искусственного интеллекта

- искусственный интеллект в банковском деле

- робот с искусственным интеллектом

- роботы с искусственным интеллектом

- программное обеспечение искусственного интеллекта

- Машинное обучение AWS

- блокчейн

- конференция по блокчейну

- Coingenius

- разговорный искусственный интеллект

- криптоконференция ИИ

- дал-и

- глубокое обучение

- google ai

- Средний (200)

- обучение с помощью машины

- Платон

- Платон Ай

- Платон Интеллектуальные данные

- Платон игра

- ПлатонДанные

- платогейминг

- масштаб ай

- синтаксис

- зефирнет