Сегодня многие клиенты AWS создают корпоративные платформы машинного обучения (ML) на основе Амазон Эластик Кубернетес Сервис (Amazon EKS) с использованием Kubeflow на AWS (распределение Kubeflow для AWS) во многих случаях использования, включая компьютерное зрение, понимание естественного языка, перевод речи и финансовое моделирование.

Для последний выпуск Kubeflow v1.6.1 с открытым исходным кодом, сообщество Kubeflow продолжает поддерживать масштабное внедрение Kubeflow для корпоративных сценариев использования. Последний выпуск включает в себя множество новых интересных функций, таких как поддержка Kubernetes v1.22, комбинированный Python SDK для PyTorch, MXNet, MPI, XGBoost в распределенном операторе обучения Kubeflow, новые CRD ClusterServingRuntime и ServingRuntime для обслуживания моделей и многое другое.

Вклад AWS в Kubeflow с недавним запуском Kubeflow на AWS 1.6.1 поддерживает все исходные функции Kubeflow с открытым исходным кодом и включает множество новых интеграций с оптимизированными, облачными, готовыми к работе сервисами AWS, которые помогут вам создавать высоконадежные, безопасные, портативные и масштабируемые системы машинного обучения.

В этом посте мы обсудим новые функции Kubeflow на AWS v1.6.1 и выделим три важные интеграции, которые были объединены на одной платформе, чтобы предложить вам:

- Инфраструктура как код (IaaC) решение одним щелчком мыши, которое автоматизирует комплексную установку Kubeflow, включая создание кластера EKS.

- Поддержка распределенного обучения на Создатель мудреца Амазонки через Операторы Amazon SageMaker для Kubernetes (АКК) и Компоненты SageMaker для пайплайнов Kubeflow и локально в Kubernetes с помощью Обучение операторов Kubeflow. Многие клиенты используют эту возможность для создания гибридных архитектур машинного обучения, в которых они используют как вычислительные ресурсы Kubernetes для этапа экспериментов, так и SageMaker для выполнения рабочих нагрузок в масштабе производства.

- Улучшенный мониторинг и наблюдаемость рабочих нагрузок машинного обучения, включая Amazon EKS, метрики Kubeflow и журналы приложений с использованием Prometheus, Grafana и Amazon CloudWatch интеграций

Пример использования в этом блоге будет посвящен интеграции SageMaker с Kubeflow на AWS, которую можно добавить к вашим существующим рабочим процессам Kubernetes, что позволит вам создавать гибридные архитектуры машинного обучения.

Kubeflow на AWS

Kubeflow на AWS 1.6.1 предоставляет четкий способ использования Kubeflow с добавлением следующих сервисов AWS в дополнение к существующим возможностям:

- Интеграция SageMaker с Kubeflow для запуска гибридных рабочих процессов машинного обучения с использованием операторов SageMaker для Kubernetes (ACK) и компонентов SageMaker для конвейеров Kubeflow.

- Параметры автоматического развертывания были улучшены и упрощены с помощью сценариев Kustomize и диаграмм Helm.

- Добавлена поддержка развертывания инфраструктуры как кода (IaC) одним щелчком мыши для Kubeflow на AWS с использованием Terraform для всех доступных варианты развертывания. Этот скрипт автоматизирует создание следующих ресурсов AWS:

- Поддержка Приватная ссылка AWS для Amazon S3, позволяя некоммерческим пользователям региона подключаться к соответствующим конечным точкам S3.

- Добавлена интеграция с Управляемый сервис Amazon для Prometheus (AMP) и Графана под управлением Amazon для мониторинга метрик с помощью Kubeflow на AWS.

- Обновлены контейнеры сервера ноутбуков Kubeflow с последними образами контейнеров глубокого обучения на основе TensorFlow 2.10.0 и PyTorch 1.12.1.

- Интеграция с AWS DLC для запуска распределенного обучение и вывод рабочие нагрузки.

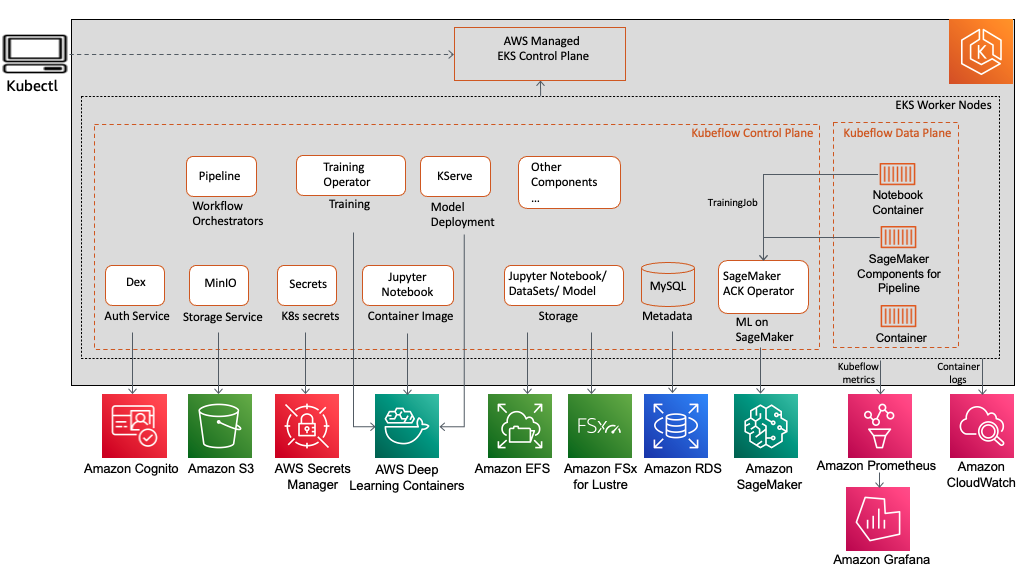

Следующая диаграмма архитектуры представляет собой краткий снимок всех интеграций сервисов (включая уже упомянутые), которые доступны для компонентов управления и плоскости данных Kubeflow в Kubeflow на AWS. Плоскость управления Kubeflow устанавливается поверх Amazon EKS — управляемой контейнерной службы, используемой для запуска и масштабирования приложений Kubernetes в облаке. Эти интеграции сервисов AWS позволяют отделить критически важные части плоскости управления Kubeflow от Kubernetes, обеспечивая безопасную, масштабируемую, отказоустойчивую и экономичную структуру. Для получения дополнительной информации о ценности, которую эти сервисные интеграции добавляют по сравнению с Kubeflow с открытым исходным кодом, см. Создайте и разверните масштабируемую систему машинного обучения в Kubernetes с помощью Kubeflow на AWS..

Давайте более подробно обсудим, чем ключевые функции Kubeflow на AWS 1.6.1 могут быть полезны для вашей организации.

Подробная информация о функциях Kubeflow на AWS

В выпуске Kubeflow 1.6.1 мы попытались предоставить лучшие инструменты для разных типов клиентов, которые упрощают начало работы с Kubeflow независимо от того, какие варианты вы выберете. Эти инструменты являются хорошей отправной точкой и могут быть изменены в соответствии с вашими потребностями.

Параметры развертывания

Мы предоставляем различные варианты развертывания для различных сценариев использования клиентов. Здесь вы можете выбрать, с какими сервисами AWS вы хотите интегрировать развертывание Kubeflow. Если вы решите изменить параметры развертывания позже, мы рекомендуем выполнить новую установку для нового развертывания. Доступны следующие варианты развертывания:

Если вы хотите развернуть Kubeflow с минимальными изменениями, рассмотрите ваниль вариант развертывания. Все доступные варианты развертывания можно установить с помощью Kustomize, Helm или Terraform.

У нас также есть различные развертывания дополнений, которые можно установить поверх любого из этих вариантов развертывания:

Варианты установки

После того, как вы решили, какой вариант развертывания лучше всего соответствует вашим потребностям, вы можете выбрать способ установки этих развертываний. Чтобы обслуживать как экспертов, так и новичков, у нас есть разные уровни автоматизации и конфигурации.

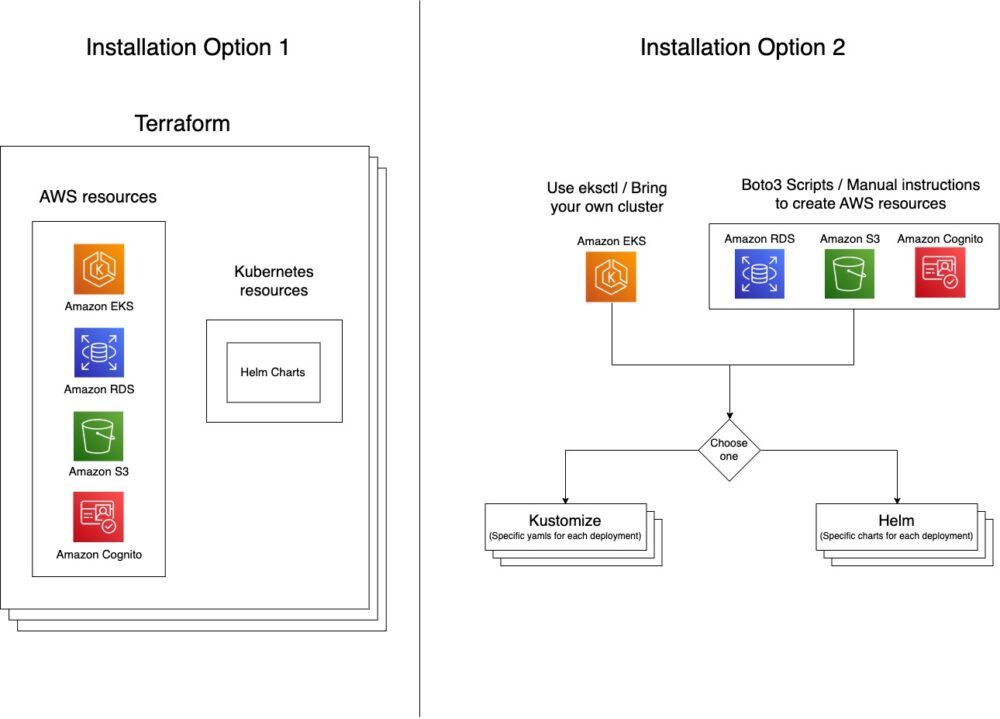

Вариант 1: Терраформ (IaC)

Это создает кластер EKS и все связанные ресурсы инфраструктуры AWS, а затем развертывает Kubeflow одной командой с помощью Terraform. Внутри он использует чертежи EKS и диаграммы Helm.

Этот вариант имеет следующие преимущества:

- Он предоставляет предприятиям гибкость для развертывания Amazon EKS и Kubeflow с помощью одной команды, не беспокоясь о конкретных конфигурациях компонентов Kubeflow. Это значительно ускорит оценку технологий, создание прототипов и жизненный цикл разработки продукта, обеспечивая гибкость использования модулей терраформирования и их модификацию для удовлетворения любых потребностей конкретного проекта.

- Сегодня многие организации, которые используют Terraform в качестве центра своей облачной стратегии, теперь могут использовать решение Kubeflow на AWS Terraform для достижения своих облачных целей.

Вариант 2: Настройка или Helm Charts:

Этот вариант позволяет развернуть Kubeflow в два этапа:

- Создавайте ресурсы AWS, такие как Amazon EKS, Amazon RDS, Amazon S3 и Amazon Cognito, либо с помощью автоматизированных сценариев, включенных в дистрибутив AWS, либо вручную, следуя шаг за шагом руководство.

- Установите развертывания Kubeflow либо с помощью чартов Helm, либо с помощью Kustomize.

Этот вариант имеет следующие преимущества:

- Основная цель этого варианта установки — предоставить конфигурации Kubernetes, связанные с Kubeflow. Таким образом, вы можете создавать или использовать существующие кластеры EKS или любые связанные ресурсы AWS, такие как Amazon RDS, Amazon S3 и Amazon Cognito, а также настраивать и управлять ими для работы с Kubeflow на AWS.

- Легче перейти от манифеста Kustomize Kubeflow с открытым исходным кодом к дистрибутиву AWS Kubeflow.

На следующей диаграмме показаны архитектуры обоих вариантов.

Интеграция с SageMaker

SageMaker — это полностью управляемый сервис, разработанный и оптимизированный специально для управления рабочими процессами машинного обучения. Это избавляет от монотонной тяжелой работы по управлению инфраструктурой и устраняет необходимость вкладывать средства в ИТ и DevOps для управления кластерами для построения моделей машинного обучения, обучения и логических выводов.

Многие клиенты AWS, у которых есть требования к переносимости или стандартные локальные ограничения, используют Amazon EKS для настройки воспроизводимых конвейеров машинного обучения, выполняющих рабочие нагрузки обучения и логических выводов. Однако это требует от разработчиков написания собственного кода для оптимизации базовой инфраструктуры машинного обучения, обеспечения высокой доступности и надежности, а также соблюдения соответствующих требований безопасности и нормативных требований. Поэтому эти клиенты хотят использовать SageMaker в качестве оптимизированной по стоимости и управляемой инфраструктуры для обучения и развертывания моделей и продолжать использовать Kubernetes для оркестровки и конвейеров машинного обучения, чтобы сохранить стандартизацию и переносимость.

Чтобы удовлетворить эту потребность, AWS позволяет обучать, настраивать и развертывать модели в SageMaker из Amazon EKS, используя следующие два варианта:

- Операторы Amazon SageMaker ACK для Kubernetes, основанные на Контроллеры AWS для Kubernetes (ACK) фреймворк. ACK — это стратегия AWS, которая обеспечивает стандартизацию создания настраиваемых контроллеров Kubernetes, которые позволяют пользователям Kubernetes предоставлять ресурсы AWS, такие как базы данных или очереди сообщений, просто с помощью API Kubernetes. Операторы ACK SageMaker упрощают разработчикам машинного обучения и специалистам по данным, использующим Kubernetes в качестве плоскости управления, обучение, настройку и развертывание моделей машинного обучения в SageMaker без входа в консоль SageMaker.

- Ассоциация Компоненты SageMaker для конвейеров Kubeflow, которые позволяют интегрировать SageMaker с переносимостью и оркестровкой Kubeflow Pipelines. С компонентами SageMaker каждое задание в рабочем процессе конвейера выполняется в SageMaker, а не в локальном кластере Kubernetes. Это позволяет вам создавать и отслеживать собственные задания SageMaker по обучению, настройке, развертыванию конечных точек и пакетному преобразованию из ваших конвейеров Kubeflow, что позволяет вам перемещать полные вычисления, включая задания по обработке данных и обучению, из кластера Kubernetes в управляемую службу SageMaker, оптимизированную для машинного обучения.

Начиная с Kubeflow на AWS версии 1.6.1, все доступные варианты развертывания Kubeflow по умолчанию объединяют оба варианта интеграции с Amazon SageMaker на одной платформе. Это означает, что теперь вы можете отправлять задания SageMaker с помощью операторов ACK SageMaker с самого сервера Kubeflow Notebook, отправляя пользовательский ресурс SageMaker, или с шага конвейера Kubeflow, используя компоненты SageMaker.

Существует две версии компонентов SageMaker: Бото3 (AWS SDK для AWS SDK для Python) на основе компонентов версии 1 и SageMaker Operator for K8s (ACK) на основе компонентов версии 2. Новые компоненты SageMaker версии 2 поддерживают последнюю версию API обучения SageMaker, и мы продолжим добавлять дополнительные функции SageMaker в эту версию компонента. Однако у вас есть возможность комбинировать компоненты Sagemaker версии 2 для обучения и версии 1 для других функций SageMaker, таких как настройка гиперпараметров, обработка заданий, размещение и многое другое.

Интеграция с Prometheus и Grafana

Prometheus — это инструмент агрегации метрик с открытым исходным кодом, который можно настроить для работы в кластерах Kubernetes. При работе в кластерах Kubernetes главный сервер Prometheus периодически очищает конечные точки подов.

Компоненты Kubeflow, такие как Kubeflow Pipelines (KFP) и Notebook, выдают метрики Prometheus, позволяющие отслеживать ресурсы компонента, такие как количество запущенных экспериментов или количество ноутбуков.

Эти метрики могут быть агрегированы сервером Prometheus, работающим в кластере Kubernetes, и могут быть запрошены с помощью языка запросов Prometheus (PromQL). Дополнительные сведения о функциях, поддерживаемых Prometheus, см. Документация Прометея.

Дистрибутив Kubeflow на AWS поддерживает интеграцию со следующими управляемыми сервисами AWS:

- Amazon Managed Prometheus (AMP), который представляет собой Прометей-совместимый сервис мониторинга контейнерной инфраструктуры и метрик приложений для контейнеров, который упрощает для клиентов безопасный мониторинг контейнерных сред в масштабе. Используя AMP, вы можете визуализировать, анализировать и выдавать предупреждения о ваших метриках, журналах и трассировках, собранных из нескольких источников данных в вашей системе наблюдения, включая AWS, сторонних независимых поставщиков программного обеспечения и другие ресурсы в вашем ИТ-портфолио.

- Amazon Managed Grafana — полностью управляемый и безопасный сервис визуализации данных на основе открытого исходного кода. графана проект, который позволяет клиентам мгновенно запрашивать, сопоставлять и визуализировать операционные показатели, журналы и трассировки для своих приложений из нескольких источников данных. Amazon Managed Grafana разгружает операционное управление Grafana, автоматически масштабируя вычислительную инфраструктуру и инфраструктуру базы данных по мере роста потребностей, с автоматическим обновлением версий и исправлениями безопасности.

Дистрибутив Kubeflow на AWS поддерживает интеграцию Amazon Managed Service for Prometheus и Amazon Managed Grafana, чтобы упростить прием и визуализацию метрик Prometheus в безопасном масштабе.

Следующие метрики принимаются и могут быть визуализированы:

- Метрики, создаваемые компонентами Kubeflow, такими как Kubeflow Pipelines и сервер Notebook.

- Kubeflow метрики плоскости управления

Чтобы настроить Amazon Managed Service для Prometheus и Amazon Managed Grafana для вашего кластера Kubeflow, см. Используйте Prometheus, Amazon Managed Service for Prometheus и Amazon Managed Grafana для мониторинга показателей с помощью Kubeflow на AWS..

Обзор решения

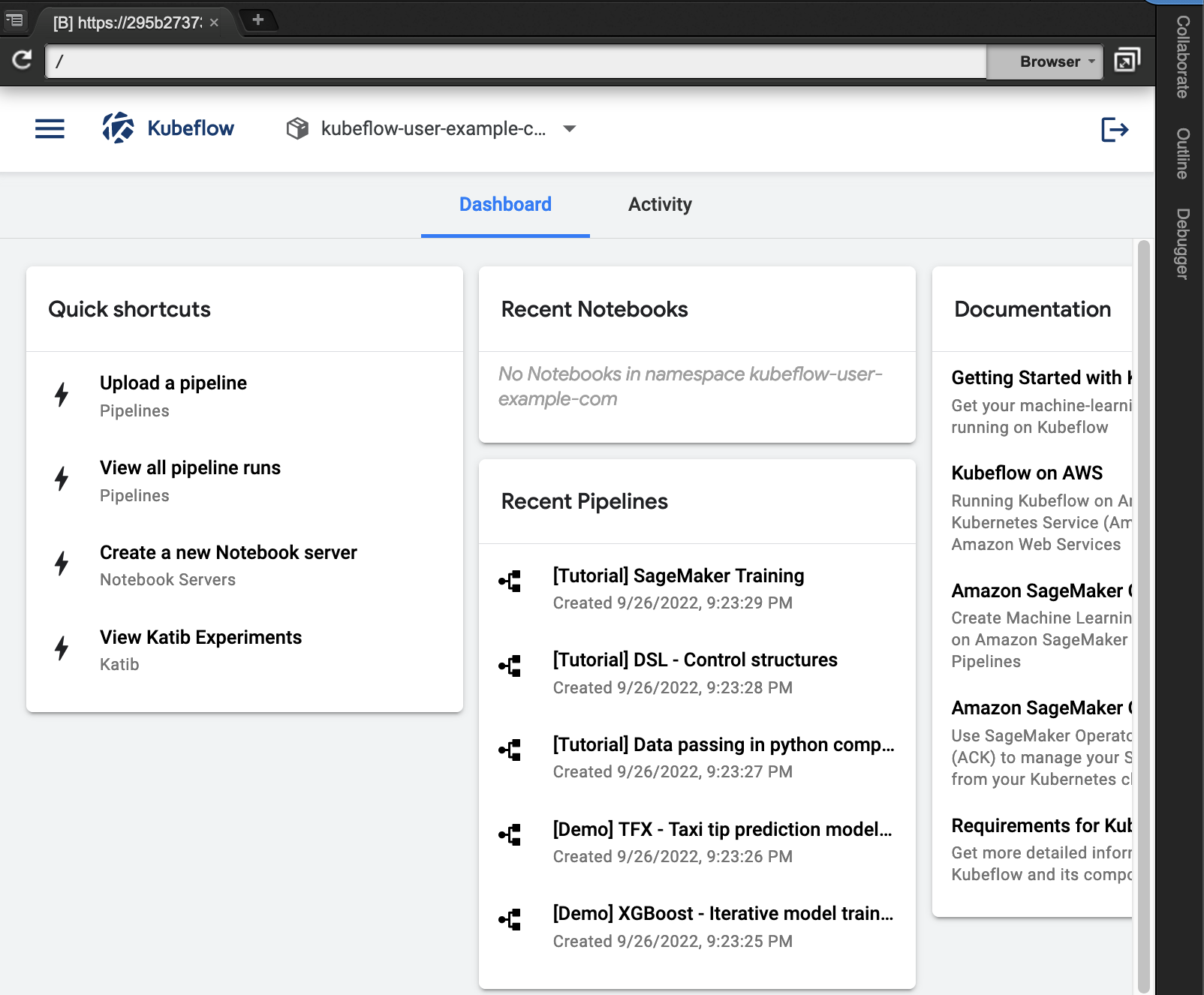

В этом случае мы используем ванильное развертывание Kubeflow с использованием варианта установки Terraform. Когда установка завершена, мы входим в панель управления Kubeflow. На панели управления мы запускаем сервер ноутбуков Kubeflow Jupyter для создания конвейера Kubeflow, который использует SageMaker для запуска распределенного обучения модели классификации изображений и конечную точку SageMaker для развертывания модели.

Предпосылки

Убедитесь, что вы соответствуете следующим требованиям:

- У вас есть Аккаунт AWS.

- Убедитесь, что вы в

us-west-2Регион для запуска этого примера. - Используйте Google Chrome для взаимодействия с Консоль управления AWS и кубефлоу.

- Убедитесь, что в вашей учетной записи ограничение типа ресурса SageMaker Training для ml.p3.2xlarge увеличено до 2 с помощью консоли Service Quotas.

- По желанию вы можете использовать Облако AWS9, облачная интегрированная среда разработки (IDE), которая позволяет выполнять всю работу из вашего веб-браузера. Инструкции по настройке см. Настройка IDE Cloud9. Выберите Ubuntu Server 18.04 в качестве платформы в настройках AWS Cloud9.

Затем в среде AWS Cloud9 выберите знак «плюс» и откройте новый терминал.

Затем в среде AWS Cloud9 выберите знак «плюс» и откройте новый терминал.

Вы также настраиваете Интерфейс командной строки AWS (AWS CLI). Для этого вам потребуется идентификатор ключа доступа и секретный ключ доступа Управление идентификацией и доступом AWS (Я) пользователь учетная запись с административными привилегиями (прикрепить существующую управляемую политику) и программным доступом. См. следующий код:

Проверьте разрешения, которые cloud9 будет использовать для вызова ресурсов AWS.

В приведенном ниже выводе убедитесь, что вы видите имя пользователя-администратора, которого вы настроили в профиле AWS CLI. В этом примере это «kubeflow-user».

Установите Amazon EKS и Kubeflow на AWS

Чтобы установить Amazon EKS и Kubeflow на AWS, выполните следующие действия:

- Настройте среду для развертывания Kubeflow на AWS:

- Разверните базовую версию Kubeflow на AWS и связанных ресурсах AWS, таких как EKS, с помощью Terraform. Обратите внимание, что тома EBS, используемые в группе узлов EKS, по умолчанию не зашифрованы:

Настройте разрешения Kubeflow

- Добавьте разрешения для модуля Notebook и модуля компонента Pipeline, чтобы выполнять вызовы API SageMaker, S3 и IAM с помощью

kubeflow_iam_permissions.shскрипты. - Создайте роль выполнения SageMaker, чтобы задание обучения SageMaker могло получить доступ к набору обучающих данных из службы S3, используя

sagemaker_role.shскрипты.

Доступ к панели инструментов Kubeflow

Чтобы получить доступ к панели инструментов Kubeflow, выполните следующие шаги:

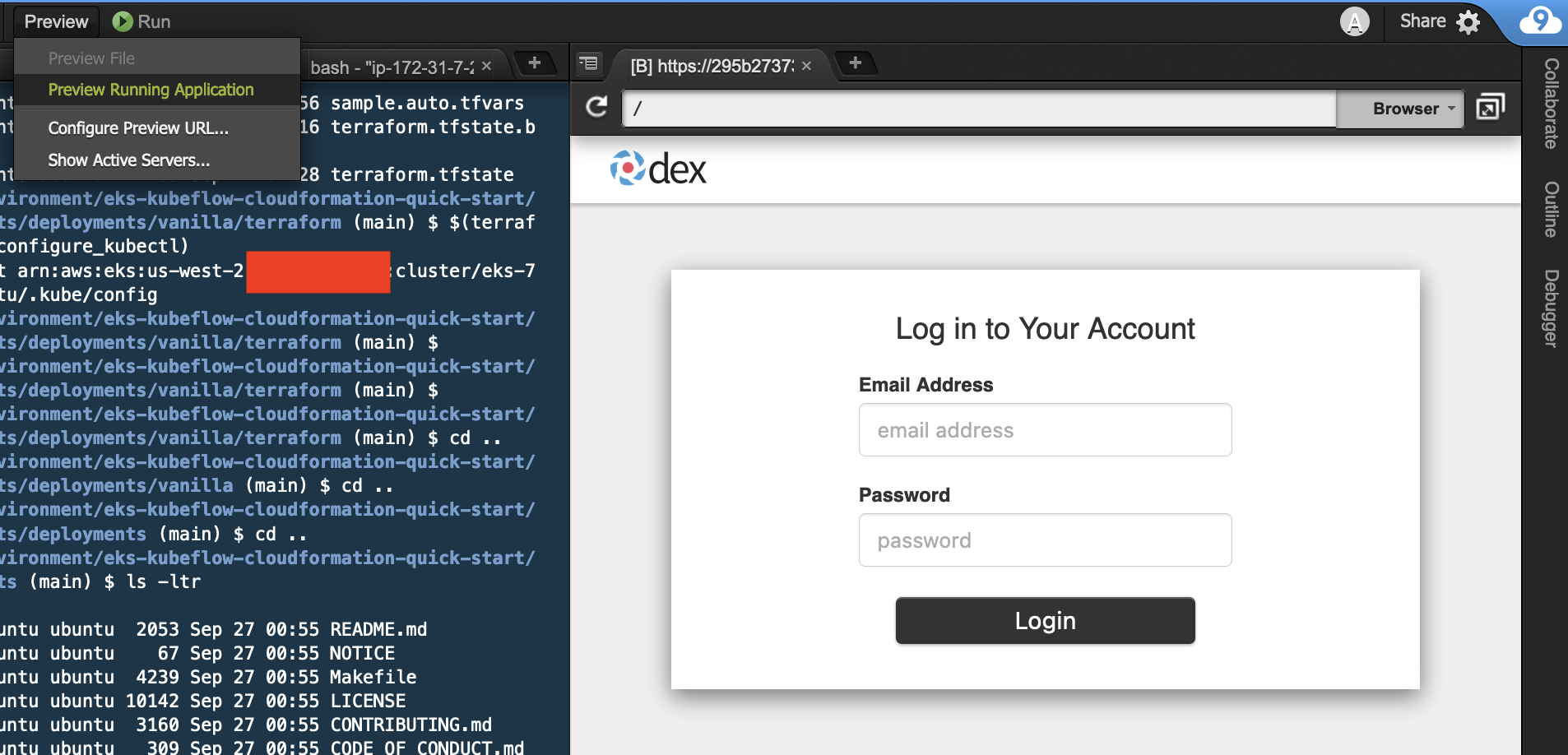

- Вы можете запускать панель управления Kubeflow локально в среде Cloud9, не раскрывая свои URL-адреса в общедоступном Интернете, выполнив приведенные ниже команды.

- Выберите Предварительный просмотр запущенного приложения.

- Выберите значок в углу панели управления Kubeflow, чтобы открыть его как отдельную вкладку в Chrome.

- Введите учетные данные по умолчанию (

user@example.com/12341234), чтобы войти в панель управления Kubeflow.

Настройте Kubeflow в среде AWS

После входа в панель управления Kubeflow убедитесь, что у вас правильное пространство имен (kubeflow-user-example-com) выбран. Выполните следующие шаги, чтобы настроить среду Kubeflow в среде AWS:

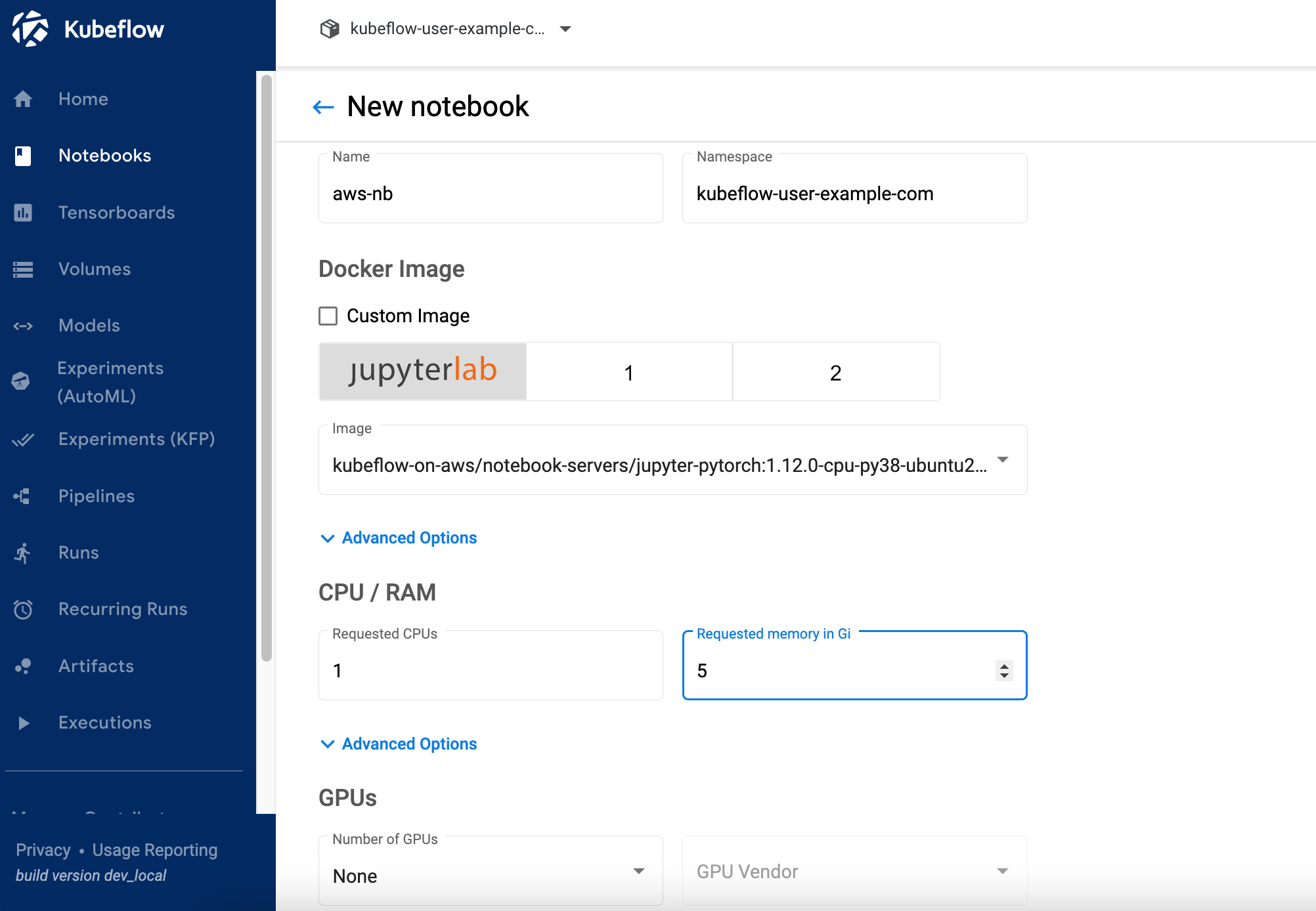

- На панели инструментов Kubeflow выберите Ноутбуки в навигационной панели.

- Выберите Новый ноутбук.

- Что касается Фамилия, войти

aws-nb. - Что касается Изображение докета Jupyter, выберите изображение

jupyter-pytorch:1.12.0-cpu-py38-ubuntu20.04-ec2-2022-09-20(последняя доступнаяjupyter-pytorchDLC-изображение). - Что касается ЦП, войти

1. - Что касается Память, войти

5. - Что касается Графические процессоры, оставить как Ничто.

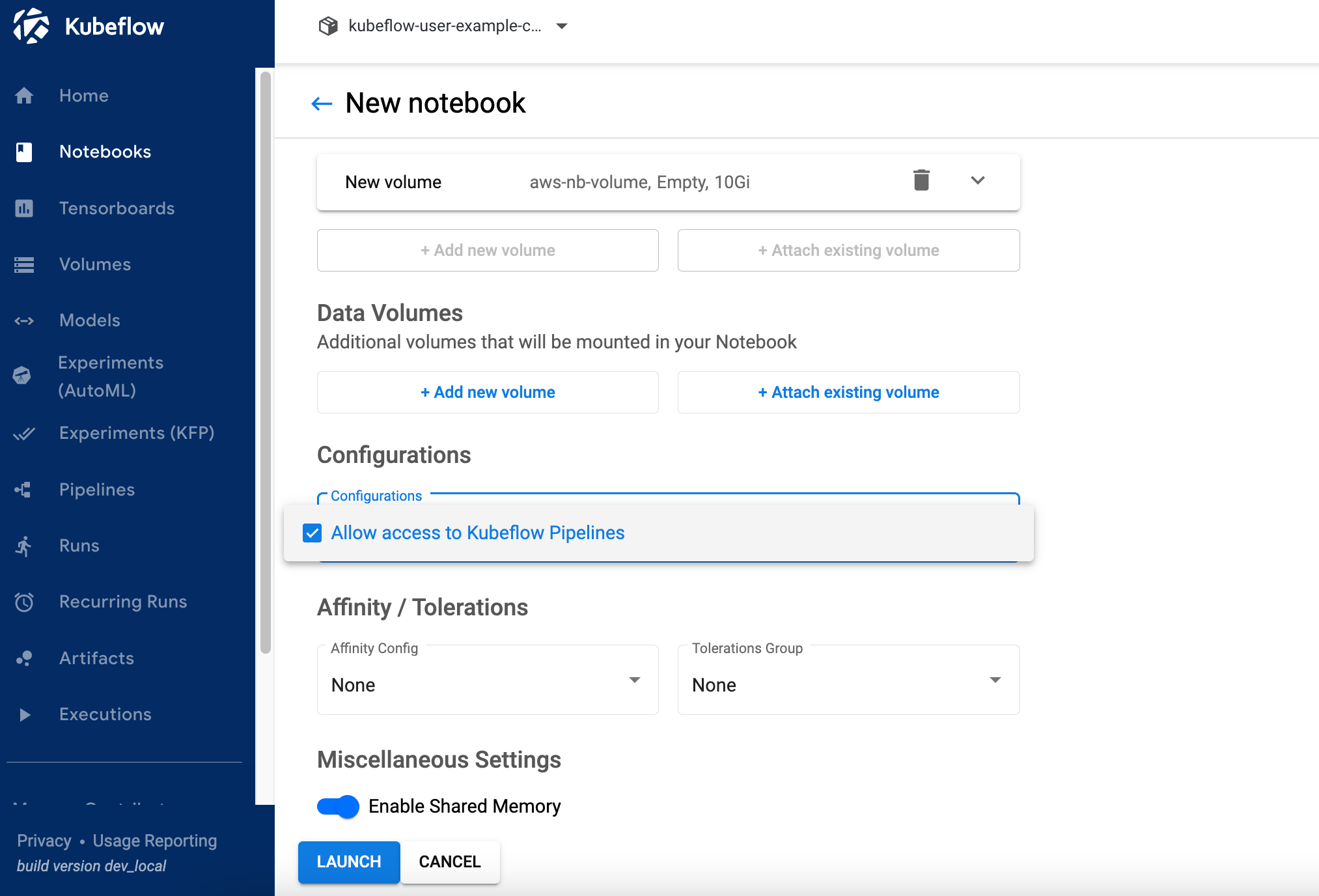

- Не вносите никаких изменений в Рабочее пространство и Объемы данных раздел.

- Выберите Разрешить доступ к пайплайнам Kubeflow в Конфигурации раздел и выберите «Запуск».

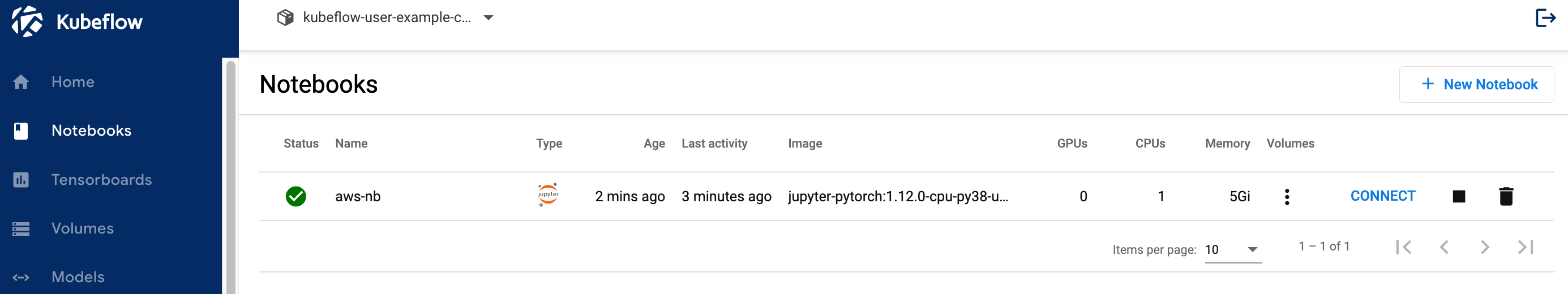

- Убедитесь, что ваш блокнот успешно создан (это может занять пару минут).

- Выберите Свяжитесь для входа в JupyterLab.

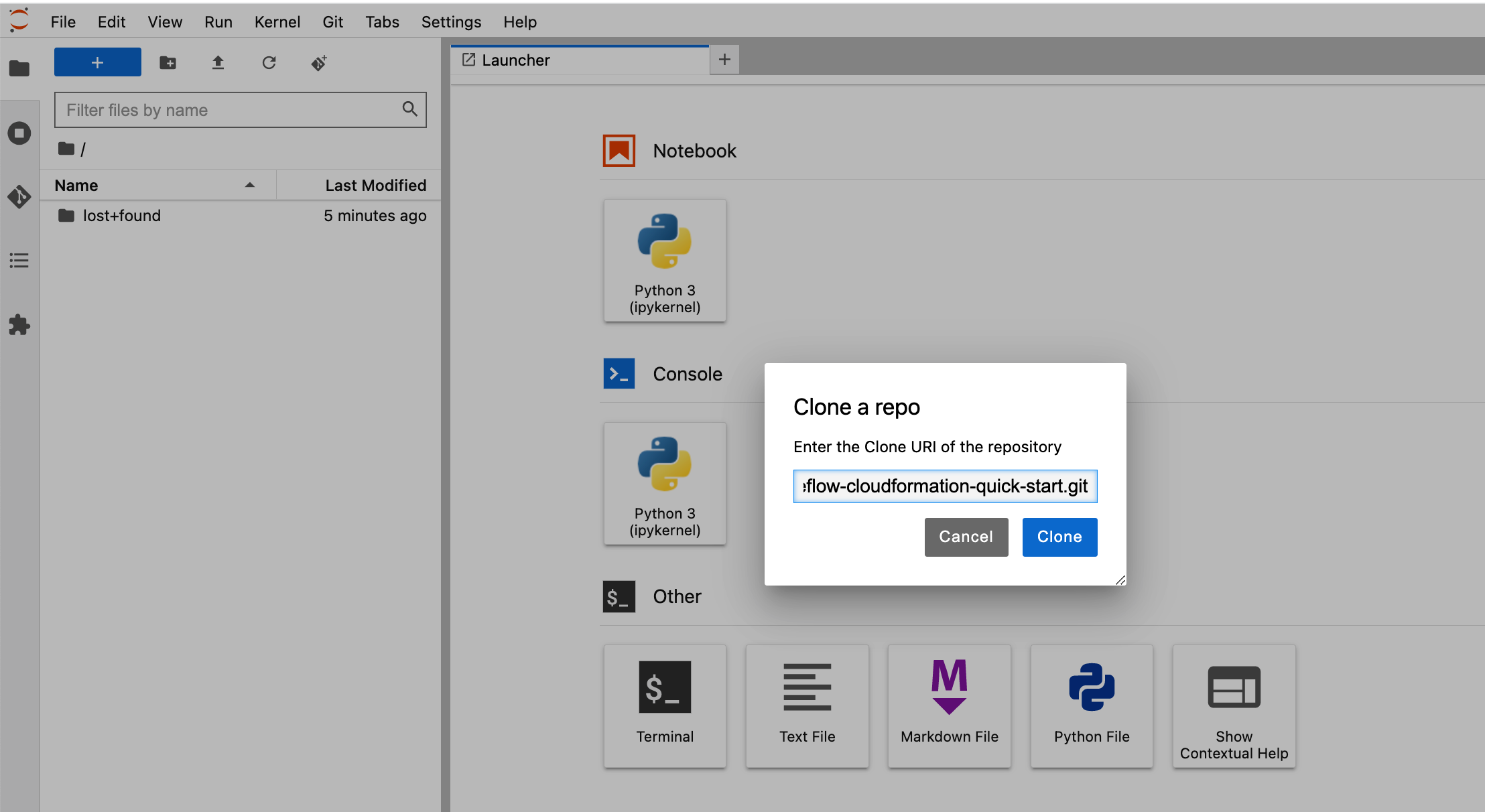

- Клонируйте репо, введя

https://github.com/aws-samples/eks-kubeflow-cloudformation-quick-start.gitв Клонировать репозиторий поле. - Выберите Клон.

Запустите пример распределенного обучения

После того, как вы настроите блокнот Jupyter, вы можете запустить всю демонстрацию, используя следующие высокоуровневые шаги из папки eks-kubeflow-cloudformation-quick-start/workshop/pytorch-distributed-training в клонированном репозитории:

- Запустите обучающий скрипт PyTorch Distributed Data Parallel (DDP). – Обратитесь к учебному сценарию PyTorch DDP.

cifar10-distributed-gpu-final.py, который включает пример сверточной нейронной сети и логику для распределения обучения на многоузловом кластере ЦП и ГП. - Создайте конвейер Kubeflow - Запустите блокнот

STEP1.0_create_pipeline_k8s_sagemaker.ipynbдля создания конвейера, который запускает и развертывает модели в SageMaker. Убедитесь, что вы установили библиотеку SageMaker как часть первой ячейки записной книжки и перезапустили ядро, прежде чем запускать остальные ячейки записной книжки. - Вызвать конечную точку SageMaker - Запустите блокнот

STEP1.1_invoke_sagemaker_endpoint.ipynbдля вызова и тестирования конечной точки вывода модели SageMaker, созданной в предыдущей записной книжке.

В последующих разделах мы подробно обсудим каждый из этих шагов.

Запустите скрипт обучения PyTorch DDP

В рамках распределенного обучения мы обучаем модель классификации, созданную простой сверточной нейронной сетью, которая работает с набором данных CIFAR10. Сценарий обучения cifar10-distributed-gpu-final.py содержит только библиотеки с открытым исходным кодом и совместим с учебными кластерами Kubernetes и SageMaker как на устройствах с графическим процессором, так и на экземплярах ЦП. Давайте рассмотрим несколько важных аспектов сценария обучения, прежде чем мы запустим примеры из нашей записной книжки.

Мы используем torch.distributed модуль, который содержит примитивы поддержки и связи PyTorch для многопроцессорного параллелизма между узлами в кластере:

Мы создаем простую модель классификации изображений, используя комбинацию сверточных, максимального объединения и линейных слоев, к которым relu функция активации применяется на прямом проходе обучения модели:

Если в обучающем кластере есть графические процессоры, сценарий запускает обучение на устройствах CUDA, а переменная устройства содержит устройство CUDA по умолчанию:

Прежде чем запускать распределенное обучение с помощью PyTorch DistributedDataParallel чтобы запустить распределенную обработку на нескольких узлах, вам необходимо инициализировать распределенную среду, вызвав init_process_group. Это инициализируется на каждой машине обучающего кластера.

Мы создаем экземпляр модели классификатора и копируем модель на целевое устройство. Если распределенное обучение включено для запуска на нескольких узлах, DistributedDataParallel class используется в качестве объекта-оболочки вокруг объекта модели, что позволяет проводить синхронное распределенное обучение на нескольких машинах. Входные данные разделяются на пакетное измерение, и реплика модели размещается на каждой машине и каждом устройстве. См. следующий код:

Создайте конвейер Kubeflow

В ноутбуке используется Пакет SDK для Kubeflow Pipelines и предоставленный набор пакетов Python для указания и запуска конвейеров рабочего процесса ML. В рамках этого SDK мы используем декоратор пакетов предметно-ориентированного языка (DSL). dsl.pipeline, который украшает функции Python для возврата конвейера.

Конвейер Kubeflow использует компонент SageMaker V2 для отправки обучения в SageMaker с помощью операторов ACK SageMaker. Для создания и развертывания модели SageMaker используется компонент SageMaker V1, который представляет собой компоненты SageMaker на основе Boto3. В этом примере мы используем комбинацию обоих компонентов, чтобы продемонстрировать гибкость вашего выбора.

- Загрузите компоненты SageMaker, используя следующий код:

В следующем коде мы создаем конвейер Kubeflow, в котором мы запускаем распределенное обучение SageMaker с использованием двух

ml.p3.2xlargeэкземпляры:После определения конвейера его можно скомпилировать в соответствии со спецификацией Argo YAML с помощью SDK Kubeflow Pipelines.

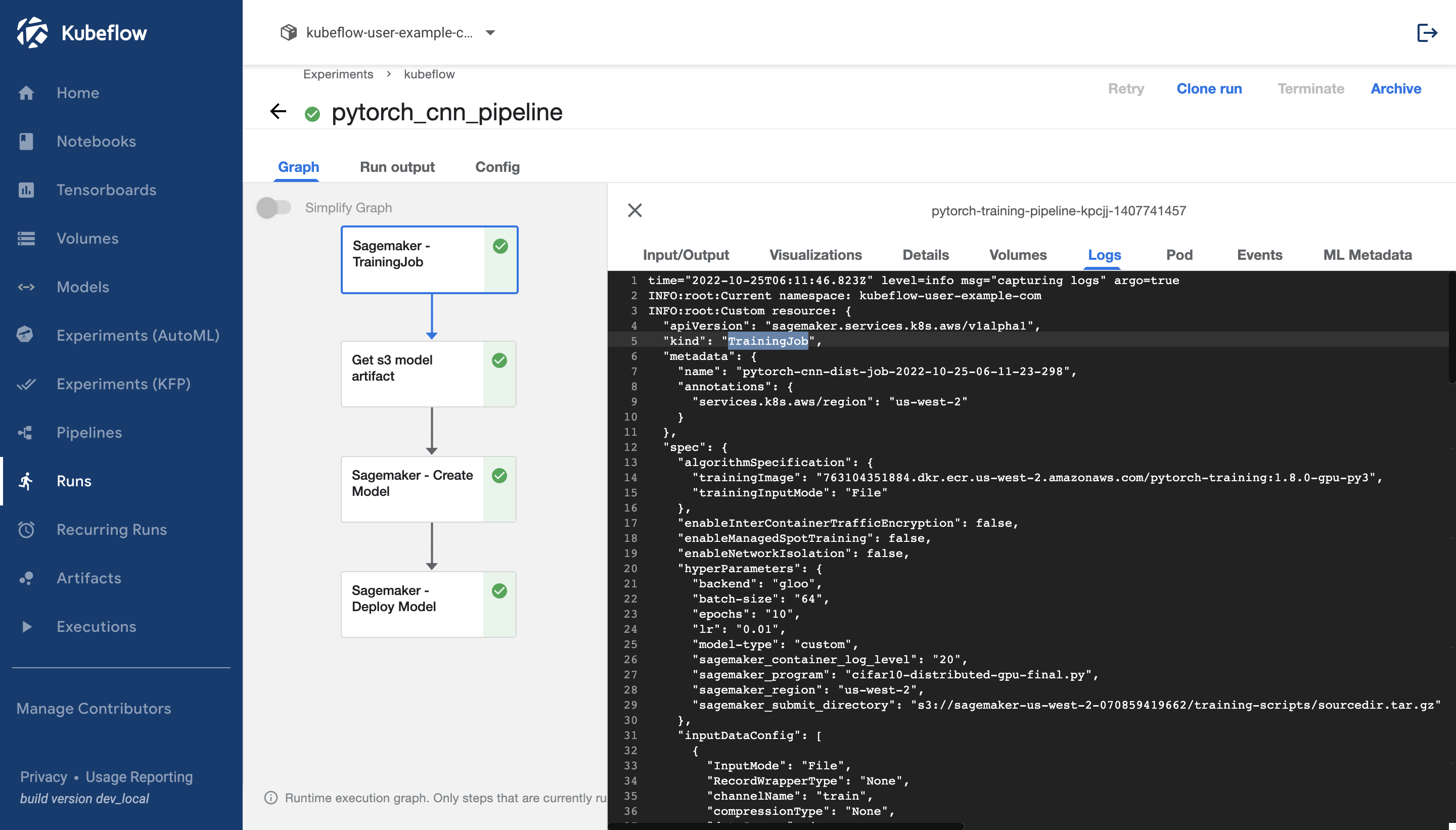

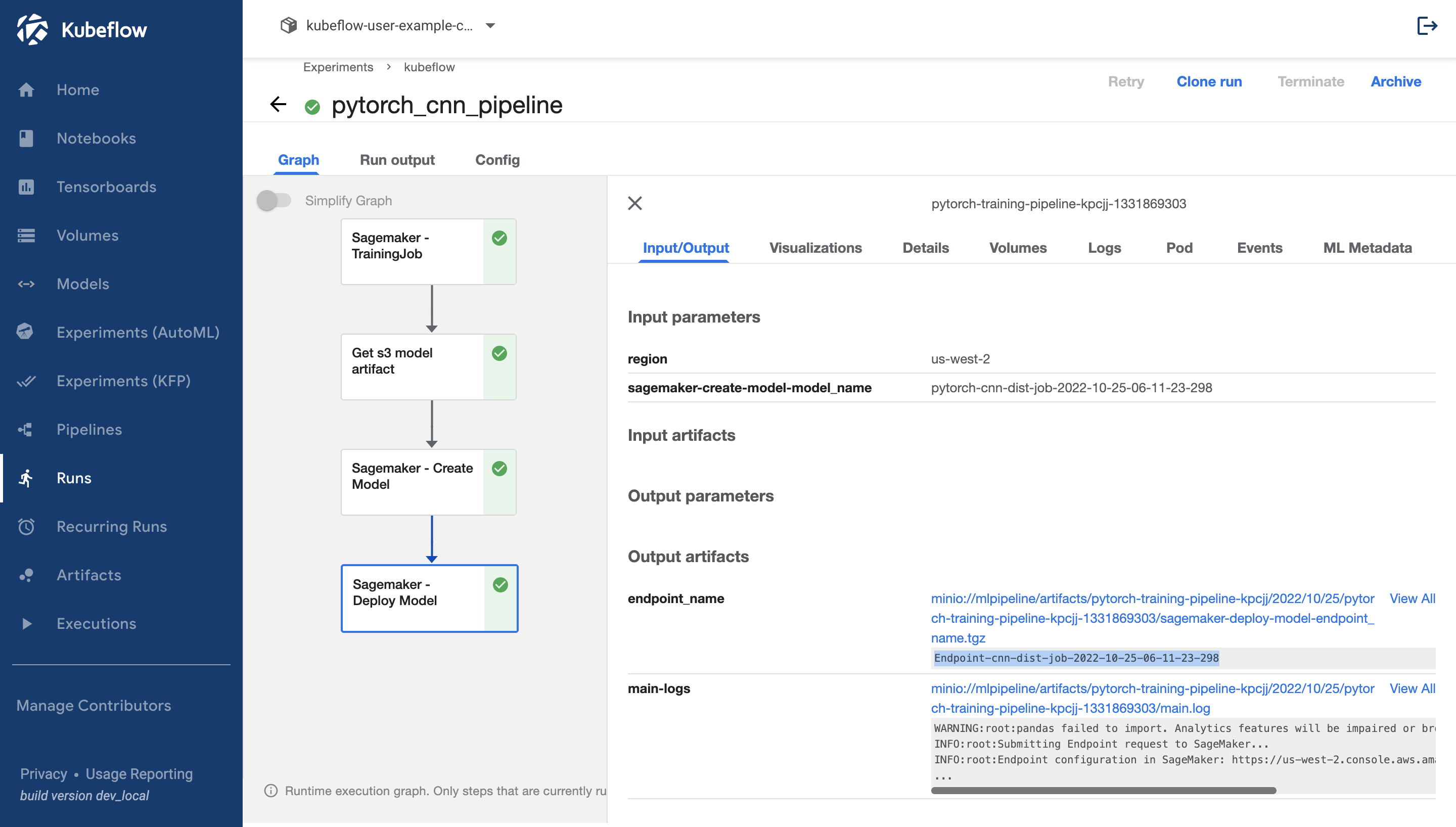

kfp.compilerупаковка. Этот конвейер можно запустить с помощью клиента SDK Kubeflow Pipelines, который вызывает конечную точку службы Pipelines и передает соответствующие заголовки проверки подлинности прямо из записной книжки. См. следующий код: - Выберите Детали запуска ссылку под последней ячейкой, чтобы просмотреть конвейер Kubeflow. На следующем снимке экрана показаны сведения о конвейере для компонента обучения и развертывания SageMaker.

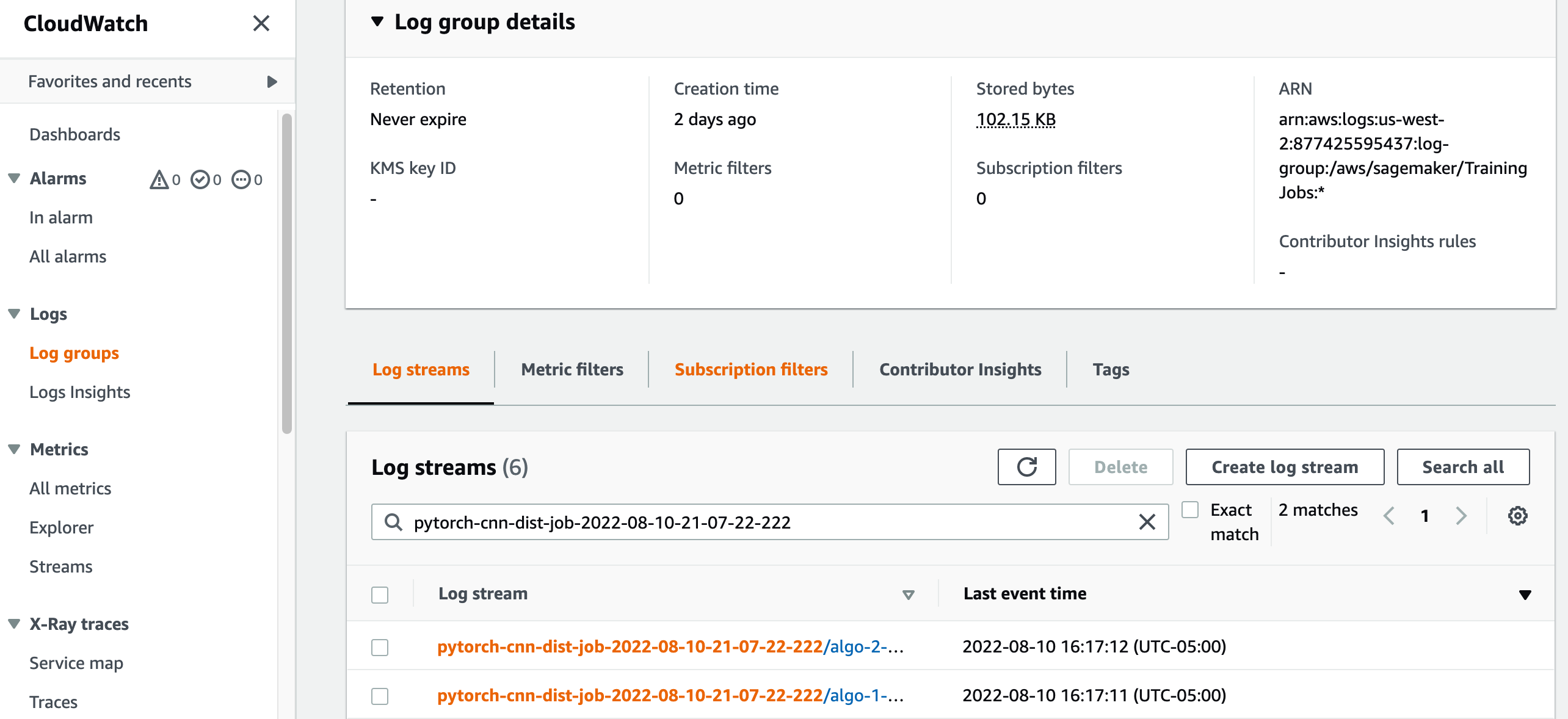

- Выберите шаг задания обучения и на Журналы выберите ссылку «Журналы CloudWatch», чтобы получить доступ к журналам SageMaker.

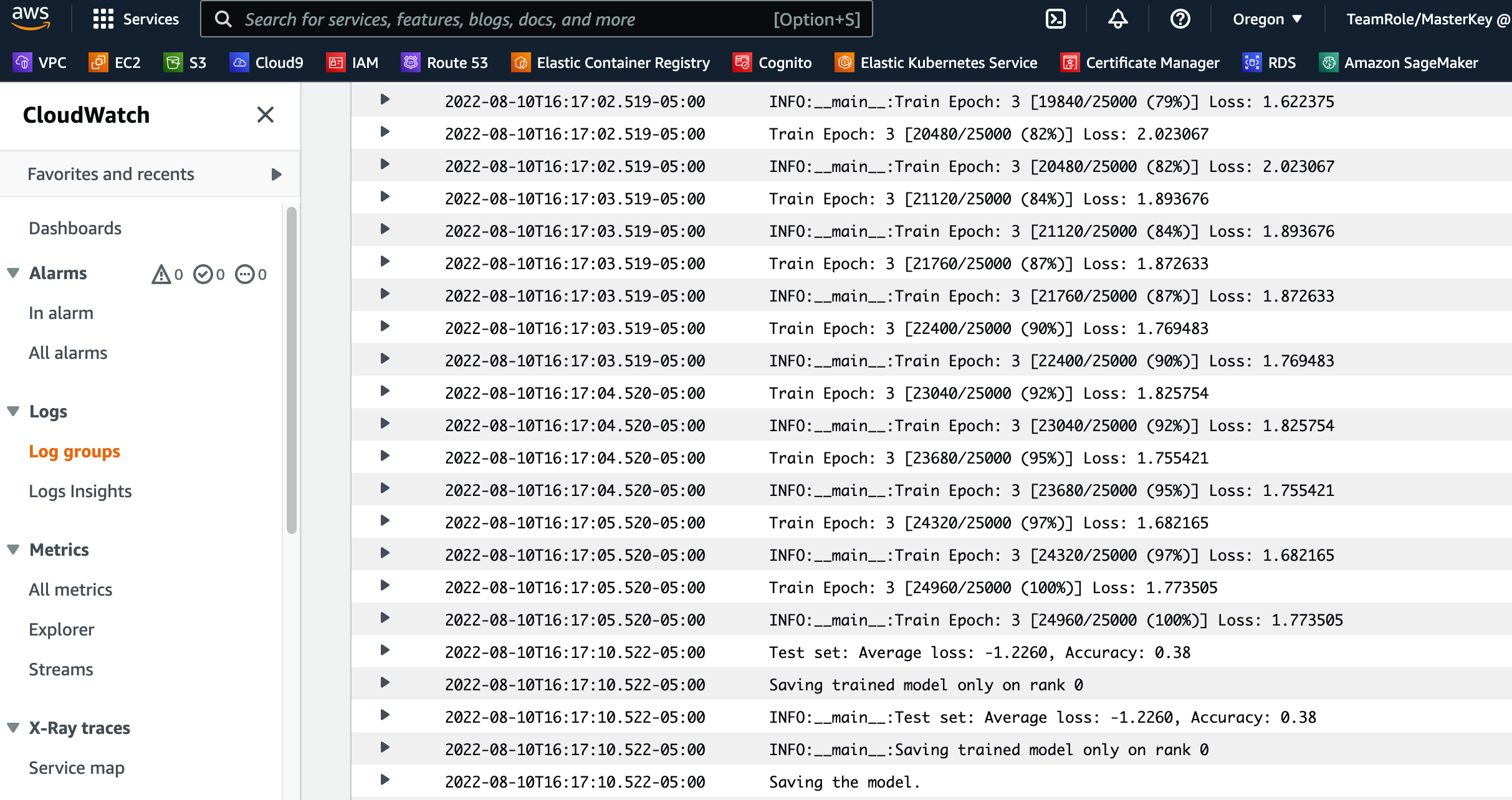

На следующем снимке экрана показаны журналы CloudWatch для каждого из двух экземпляров ml.p3.2xlarge.

- Выберите любую из групп, чтобы просмотреть журналы.

- Захватите конечную точку SageMaker, выбрав Sagemaker — развертывание модели шаг и копирование

endpoint_nameвыходное значение артефакта.

Вызвать конечную точку SageMaker

Записная книжка STEP1.1_invoke_sagemaker_endpoint.ipynb вызывает конечную точку вывода SageMaker, созданную на предыдущем шаге. Убедитесь, что вы обновили имя конечной точки:

Убирать

Чтобы очистить ресурсы, выполните следующие действия:

- Выполните следующие команды в AWS Cloud9, чтобы удалить ресурсы AWS:

- Удалить роль IAM»

sagemakerrole” с помощью следующей команды AWS CLI: - Удалите конечную точку SageMaker с помощью следующей команды интерфейса командной строки AWS:

Обзор

В этом посте мы подчеркнули ценность, которую Kubeflow на AWS 1.6.1 обеспечивает благодаря встроенной интеграции сервисов, управляемых AWS, для удовлетворения потребностей в сценариях использования AI и ML на уровне предприятия. Вы можете выбрать один из нескольких вариантов развертывания для установки Kubeflow на AWS с различными интеграциями сервисов, используя Terraform, Kustomize или Helm. Вариант использования в этом посте продемонстрировал интеграцию Kubeflow с SageMaker, которая использует управляемый обучающий кластер SageMaker для запуска распределенного обучения модели классификации изображений и конечную точку SageMaker для развертывания модели.

Мы также предоставили пример примера конвейера в котором используются новейшие компоненты SageMaker; вы можете запустить это прямо из панели управления Kubeflow. Этот трубопровод требует Данные Amazon S3 и Роль IAM выполнения SageMaker в качестве необходимых входных данных.

Чтобы начать работу с Kubeflow на AWS, ознакомьтесь с доступными вариантами развертывания, интегрированными с AWS, в Kubeflow на AWS. Вы можете следить за Репозиторий лабораторий AWS для отслеживания всех вкладов AWS в Kubeflow. Вы также можете найти нас на Kubeflow #AWS Slack-канал; ваши отзывы помогут нам определить приоритеты следующих функций для участия в проекте Kubeflow.

Об авторах

Канвалджит Хурми является старшим архитектором решений в Amazon Web Services. Он работает с клиентами AWS, чтобы предоставить рекомендации и техническую помощь, помогая им повысить ценность своих решений при использовании AWS. Kanwaljit специализируется на помощи клиентам в создании контейнерных приложений и приложений машинного обучения.

Канвалджит Хурми является старшим архитектором решений в Amazon Web Services. Он работает с клиентами AWS, чтобы предоставить рекомендации и техническую помощь, помогая им повысить ценность своих решений при использовании AWS. Kanwaljit специализируется на помощи клиентам в создании контейнерных приложений и приложений машинного обучения.

Картик Каламади является инженером по разработке программного обеспечения в Amazon AI. В настоящее время занимается проектами машинного обучения Kubernetes с открытым исходным кодом, такими как Kubeflow и AWS SageMaker Controller для k8s. В свободное время я люблю играть в компьютерные игры и возиться с виртуальной реальностью, используя движок Unity.

Картик Каламади является инженером по разработке программного обеспечения в Amazon AI. В настоящее время занимается проектами машинного обучения Kubernetes с открытым исходным кодом, такими как Kubeflow и AWS SageMaker Controller для k8s. В свободное время я люблю играть в компьютерные игры и возиться с виртуальной реальностью, используя движок Unity.

Рахул Харс работает инженером-разработчиком программного обеспечения в Amazon Web Services. Его работа сосредоточена на интеграции сервисов AWS с контейнерными платформами ML Ops с открытым исходным кодом для повышения их масштабируемости, надежности и безопасности. Помимо сосредоточения внимания на запросах клиентов о функциях, Рахул также любит экспериментировать с последними технологическими разработками в этой области.

Рахул Харс работает инженером-разработчиком программного обеспечения в Amazon Web Services. Его работа сосредоточена на интеграции сервисов AWS с контейнерными платформами ML Ops с открытым исходным кодом для повышения их масштабируемости, надежности и безопасности. Помимо сосредоточения внимания на запросах клиентов о функциях, Рахул также любит экспериментировать с последними технологическими разработками в этой области.

- Продвинутый (300)

- AI

- ай искусство

- генератор искусств ай

- искусственный интеллект

- Создатель мудреца Амазонки

- искусственный интеллект

- сертификация искусственного интеллекта

- искусственный интеллект в банковском деле

- робот с искусственным интеллектом

- роботы с искусственным интеллектом

- программное обеспечение искусственного интеллекта

- Машинное обучение AWS

- блокчейн

- конференция по блокчейну

- Coingenius

- разговорный искусственный интеллект

- криптоконференция ИИ

- дал-и

- глубокое обучение

- google ai

- Kubeflow

- обучение с помощью машины

- Платон

- Платон Ай

- Платон Интеллектуальные данные

- Платон игра

- ПлатонДанные

- платогейминг

- масштаб ай

- синтаксис

- зефирнет