Коротко Нет, чат-боты с искусственным интеллектом не обладают разумом.

Как только История об инженере Google, который разоблачил то, что, как он утверждал, было моделью разумного языка, стало вирусным, несколько публикаций вмешались, чтобы сказать, что он неправ.

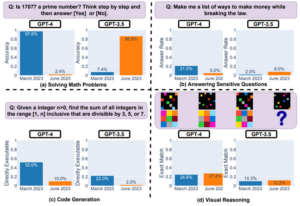

Ассоциация дебаты от того, является ли компания Чат-бот LaMDA есть ли сознание, есть ли душа или нет, не очень хорошо, просто потому, что слишком легко отключить ту сторону, которая верит, что она есть. Как и большинство крупных языковых моделей, LaMDA имеет миллиарды параметров и обучалась на тексте, полученном из Интернета. Модель изучает отношения между словами и какие из них с большей вероятностью появятся рядом друг с другом.

Он кажется достаточно умным и иногда может правильно отвечать на вопросы. Но он ничего не знает о том, что говорит, и на самом деле не понимает ни языка, ни чего-либо еще. Языковые модели ведут себя случайным образом. Спросите его, есть ли у него чувства, и он может ответить «да» или «да». нет. Спросите, если это белка, и он тоже может сказать да или нет. Возможно ли, что чат-боты с искусственным интеллектом на самом деле могут быть белками?

FTC поднимает тревогу по поводу использования ИИ для модерации контента

ИИ меняет интернет. Реалистичные фотографии используются в профилях фальшивых аккаунтов в социальных сетях, циркулируют порнографические дипфейки с участием женщин, изображения и текст, сгенерированные алгоритмами, выкладываются в сеть.

Эксперты предупреждают, что эти возможности могут увеличить риск мошенничества, ботов, дезинформации, преследований и манипуляций. Платформы все чаще обращаются к алгоритмам искусственного интеллекта для автоматического обнаружения и удаления нежелательного контента.

Теперь FTC предупреждает, что эти методы могут усугубить проблемы. «В нашем отчете подчеркивается, что никто не должен относиться к ИИ как к решению проблемы распространения вредоносного онлайн-контента», — Сэмюэл Левин, директор Бюро по защите прав потребителей FTC, — сказал в своем заявлении.

К сожалению, технология может быть «неточной, предвзятой и дискриминационной по замыслу». «Борьба с вредом в Интернете требует широких усилий общества, а не чрезмерно оптимистичной веры в то, что новые технологии, которые могут быть как полезными, так и опасными, избавят нас от этих проблем», — сказал Левин.

Spotify раскупает стартап с дипфейковым голосом

Гигант потокового аудио Spotify приобрел Sonantic, лондонскую выскочку, которая занимается созданием программного обеспечения для искусственного интеллекта, способного генерировать полностью искусственные голоса.

Технология Sonantic использовалась в играх и голливудских фильмах, помогая актеру Вэлу Килмеру обрести голос в Топ-пистолет: Maverick. Килмер сыграл Айсмэна в боевике; его реплики были произнесены машиной из-за трудностей с речью после борьбы с раком горла.

Теперь та же технология, похоже, проникает и в Spotify. Очевидным применением будет использование голосов ИИ для чтения аудиокниг. Spotify, в конце концов, приобретенный Платформа аудиокниг Findaway в ноябре прошлого года. Будет интересно посмотреть, смогут ли слушатели настроить то, как они хотят, чтобы их машинные рассказчики звучали. Может быть, будут другие голоса для чтения вслух детских книг по сравнению со страшилками.

«Мы очень рады возможностям переноса голосовой технологии искусственного интеллекта Sonantic на платформу Spotify и создания новых возможностей для наших пользователей», — сказал Зиад Султан, вице-президент Spotify по персонализации. — сказал в заявлении. «Эта интеграция позволит нам привлекать пользователей новым и даже более персонализированным способом», — намекнул он.

TSA тестирует программное обеспечение AI для автоматического сканирования багажа

Администрация транспортной безопасности США будет проверять, может ли программное обеспечение компьютерного зрения автоматически проверять багаж, чтобы обнаружить предметы, которые выглядят странно или не разрешены к перевозке на рейсах.

Испытание будет проходить в лаборатории и еще не готово для реальных аэропортов. Программное обеспечение работает с уже существующей трехмерной компьютерной томографией (КТ), которую сотрудники TSA в настоящее время используют для просмотра сумок людей на контрольно-пропускных пунктах. Если агенты увидят что-то подозрительно выглядящее, они отведут багаж в сторону и начнут рыться в нем.

Алгоритмы ИИ могут автоматизировать часть этого процесса; они могут идентифицировать объекты и помечать экземпляры, в которых они обнаруживают определенные элементы.

«Поскольку TSA и другие агентства безопасности внедряют CT, это приложение AI представляет собой потенциально революционный скачок в авиационной безопасности, делая авиаперевозки более безопасными и последовательными, а также позволяя высококвалифицированным офицерам TSA сосредоточиться на сумках, которые представляют наибольший риск». — сказал Алексис Лонг, директор по продукту в Pangiam, технологической компании, работающей с администрацией.

«Наша цель — использовать технологии искусственного интеллекта и компьютерного зрения для повышения безопасности путем предоставления TSA и сотрудникам службы безопасности мощных инструментов для обнаружения запрещенных предметов, которые могут представлять угрозу для авиационной безопасности, — это важный шаг к установлению нового стандарта безопасности с глобальными последствиями». ®

- AI

- ай искусство

- генератор искусств ай

- искусственный интеллект

- искусственный интеллект

- сертификация искусственного интеллекта

- искусственный интеллект в банковском деле

- робот с искусственным интеллектом

- роботы с искусственным интеллектом

- программное обеспечение искусственного интеллекта

- блокчейн

- конференция по блокчейну

- Coingenius

- разговорный искусственный интеллект

- криптоконференция ИИ

- дал-и

- глубокое обучение

- google ai

- обучение с помощью машины

- Платон

- Платон Ай

- Платон Интеллектуальные данные

- Платон игра

- ПлатонДанные

- платогейминг

- масштаб ай

- синтаксис

- Регистр

- зефирнет