В сегодняшнюю информационную эпоху огромные объемы данных, хранящиеся в бесчисленных документах, представляют собой одновременно проблему и возможность для бизнеса. Традиционные методы обработки документов часто не обеспечивают эффективности и точности, оставляя место для инноваций, экономической эффективности и оптимизации. Обработка документов стала свидетелем значительных успехов с появлением интеллектуальной обработки документов (IDP). С помощью IDP компании могут преобразовывать неструктурированные данные из различных типов документов в структурированную, полезную информацию, что значительно повышает эффективность и сокращает объем ручного труда. Однако на этом потенциал не заканчивается. Интегрируя в этот процесс генеративный искусственный интеллект (ИИ), мы можем еще больше расширить возможности IDP. Генеративный ИИ не только расширяет возможности обработки документов, но и обеспечивает динамическую адаптируемость к изменяющимся шаблонам данных. В этом посте вы познакомитесь с синергией IDP и генеративного искусственного интеллекта, показав, как они представляют собой новый рубеж в обработке документов.

Мы подробно обсуждаем IDP в нашей серии статей «Интеллектуальная обработка документов с помощью сервисов AWS AI» (Часть 1 и Часть 2). В этом посте мы обсудим, как расширить новую или существующую архитектуру IDP с помощью больших языковых моделей (LLM). Более конкретно, мы обсуждаем, как мы можем интегрировать Амазонка Текст Лангчейн в качестве загрузчика документов и Коренная порода Амазонки извлекать данные из документов и использовать генеративные возможности искусственного интеллекта на различных этапах IDP.

Amazon Textract — это сервис машинного обучения (ML), который автоматически извлекает текст, рукописный текст и данные из отсканированных документов. Amazon Bedrock — это полностью управляемый сервис, предлагающий выбор высокопроизводительных базовых моделей (FM) через простые в использовании API.

На следующей диаграмме представлена эталонная архитектура высокого уровня, которая объясняет, как можно дополнительно улучшить рабочий процесс IDP с помощью базовых моделей. Вы можете использовать LLM на одном или на всех этапах IDP в зависимости от варианта использования и желаемого результата.

В следующих разделах мы подробно рассмотрим, как Amazon Textract интегрируется в рабочие процессы генеративного ИИ с использованием LangChain для обработки документов для каждой из этих конкретных задач. Представленные здесь блоки кода были сокращены для краткости. Обратитесь к нашему Репозиторий GitHub для получения подробных блокнотов Python и пошагового руководства.

Извлечение текста из документов является важным аспектом при обработке документов с помощью LLM. Amazon Textract можно использовать для извлечения неструктурированного необработанного текста из документов и сохранения исходных полуструктурированных или структурированных объектов, таких как пары «ключ-значение» и таблицы, присутствующие в документе. Пакеты документов, такие как медицинские и страховые претензии или ипотечные кредиты, состоят из сложных форм, которые содержат много информации в структурированных, полуструктурированных и неструктурированных форматах. Извлечение документов является здесь важным шагом, поскольку LLM извлекают выгоду из богатого контента, позволяя генерировать более точные и релевантные ответы, которые в противном случае могли бы повлиять на качество результатов LLM.

LangChain — это мощная платформа с открытым исходным кодом для интеграции с LLM. LLM в целом универсальны, но могут сталкиваться с задачами, специфичными для предметной области, где необходим более глубокий контекст и детальные ответы. В таких сценариях LangChain дает разработчикам возможность создавать агенты, которые могут разбивать сложные задачи на более мелкие подзадачи. Затем подзадачи могут добавлять контекст и память в LLM, соединяя и объединяя подсказки LLM.

Лангчейн предлагает загрузчики документов который может загружать и преобразовывать данные из документов. Вы можете использовать их для структурирования документов в предпочтительные форматы, которые могут обрабатываться LLM. AmazonTextPDFLoader — это тип загрузчика документов, который обеспечивает быстрый способ автоматизации обработки документов с помощью Amazon Textract в сочетании с LangChain. Для получения более подробной информации о AmazonTextractPDFLoaderобратитесь к Лангчейн документация. Чтобы использовать загрузчик документов Amazon Textract, вы начинаете с его импорта из библиотеки LangChain:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Вы также можете хранить документы в Amazon S3 и ссылаться на них, используя шаблон URL-адреса s3://, как описано в разделе Доступ к корзине с помощью S3://и передайте этот путь S3 загрузчику PDF-файлов Amazon Textract:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Многостраничный документ будет содержать несколько страниц текста, доступ к которым затем можно получить через объект документов, который представляет собой список страниц. Следующий код перебирает страницы объекта документов и печатает текст документа, доступный через page_content атрибут:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend и LLM можно эффективно использовать для классификации документов. Amazon Comprehend — это сервис обработки естественного языка (NLP), который использует машинное обучение для извлечения информации из текста. Amazon Comprehend также поддерживает обучение пользовательской модели классификации с учетом макета таких документов, как PDF-файлы, Word и форматы изображений. Дополнительную информацию об использовании классификатора документов Amazon Comprehend см. В классификатор документов Amazon Comprehend добавлена поддержка макета для повышения точности.

В сочетании с LLM классификация документов становится мощным подходом для управления большими объемами документов. LLM полезны при классификации документов, поскольку они могут анализировать текст, шаблоны и контекстуальные элементы в документе, используя понимание естественного языка. Вы также можете настроить их для определенных классов документов. Когда новый тип документа, введенный в конвейер IDP, требует классификации, LLM может обработать текст и классифицировать документ с учетом набора классов. Ниже приведен пример кода, который использует загрузчик документов LangChain на базе Amazon Textract для извлечения текста из документа и использования его для классификации документа. Мы используем Антропный Клод v2 модель через Amazon Bedrock для выполнения классификации.

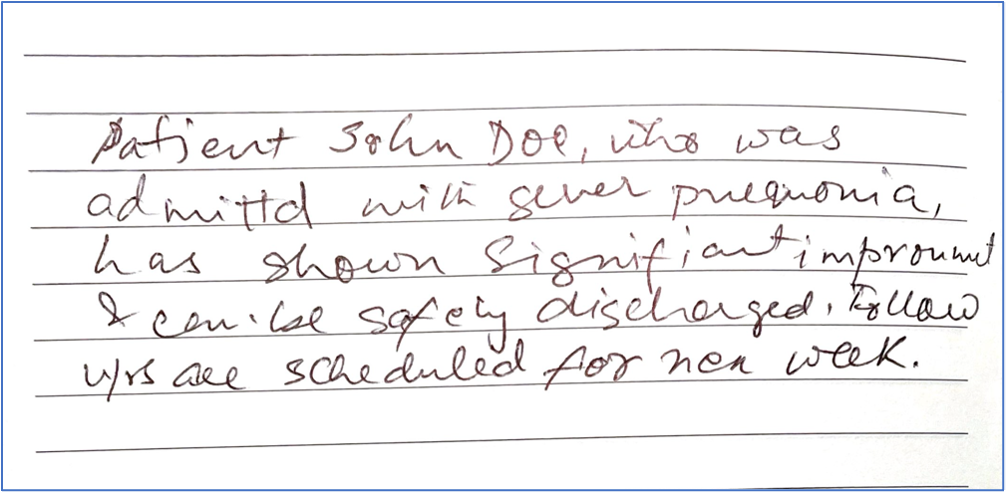

В следующем примере мы сначала извлекаем текст из отчета о выписке пациента и используем LLM для его классификации, учитывая список из трех различных типов документов:DISCHARGE_SUMMARY, RECEIPTи PRESCRIPTION. На следующем снимке экрана показан наш отчет.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Резюмирование предполагает сжатие данного текста или документа в более короткую версию с сохранением его ключевой информации. Этот метод полезен для эффективного поиска информации, что позволяет пользователям быстро понять ключевые моменты документа, не читая все содержимое. Хотя Amazon Textract не выполняет обобщение текста напрямую, он предоставляет базовые возможности извлечения всего текста из документов. Этот извлеченный текст служит входными данными для нашей модели LLM для выполнения задач по обобщению текста.

Используя тот же образец отчета о выписке, мы используем AmazonTextractPDFLoader для извлечения текста из этого документа. Как и раньше, мы используем модель Claude v2 через Amazon Bedrock и инициализируем ее с помощью подсказки, содержащей инструкции о том, что делать с текстом (в данном случае — обобщение). Наконец, мы запускаем цепочку LLM, передавая извлеченный текст из загрузчика документов. При этом выполняется действие вывода в LLM с приглашением, состоящим из инструкций по подведению итогов, и текста документа, отмеченного значком Document, Смотрите следующий код:

Код генерирует сводный отчет о выписке пациента:

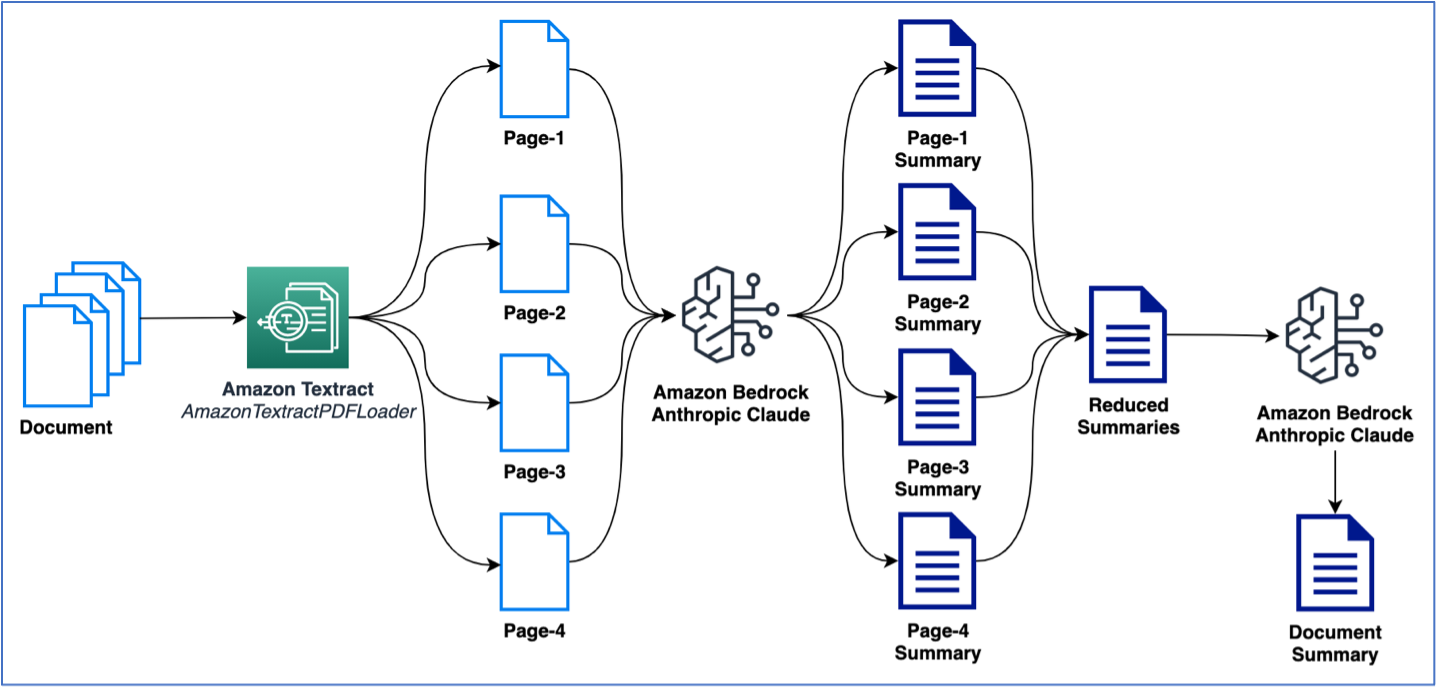

В предыдущем примере для суммирования использовался одностраничный документ. Однако вы, скорее всего, будете иметь дело с документами, содержащими несколько страниц, требующих обобщения. Распространенный способ суммирования на нескольких страницах — сначала создать сводки для небольших фрагментов текста, а затем объединить более мелкие сводки, чтобы получить окончательное резюме документа. Обратите внимание, что этот метод требует нескольких вызовов LLM. Логику для этого можно легко создать; однако LangChain предоставляет встроенную цепочку суммирования, которая может суммировать большие тексты (из многостраничных документов). Обобщение может происходить либо через map_reduce или с stuff параметры, которые доступны в качестве опций для управления несколькими вызовами LLM. В следующем примере мы используем map_reduce для обобщения многостраничного документа. Следующий рисунок иллюстрирует наш рабочий процесс.

Давайте сначала начнем с извлечения документа и посмотрим общее количество токенов на странице и общее количество страниц:

Далее мы используем встроенный LangChain load_summarize_chain подведем итог всему документу:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Стандартизация и вопросы и ответы

В этом разделе мы обсуждаем задачи по стандартизации и вопросам и ответам.

Стандартизация

Стандартизация вывода — это задача генерации текста, в которой LLM используются для обеспечения согласованного форматирования выходного текста. Эта задача особенно полезна для автоматизации извлечения ключевых объектов, требующего согласования выходных данных с желаемыми форматами. Например, мы можем следовать передовым инженерным практикам для точной настройки LLM для форматирования дат в формате ММ/ДД/ГГГГ, который может быть совместим со столбцом базы данных DATE. В следующем блоке кода показан пример того, как это делается с помощью LLM и оперативного проектирования. Мы не только стандартизируем формат вывода значений дат, но и предлагаем модели генерировать конечный результат в формате JSON, чтобы его можно было легко использовать в наших последующих приложениях. Мы используем Язык выражений LangChain (LCEL) для объединения двух действий. Первое действие побуждает LLM сгенерировать выходные данные в формате JSON, содержащие только даты из документа. Второе действие принимает выходные данные JSON и стандартизирует формат даты. Обратите внимание, что это двухэтапное действие также может быть выполнено за один шаг при правильном проектировании подсказок, как мы увидим в нормализации и создании шаблонов.

Выходные данные предыдущего примера кода представляют собой структуру JSON с датами 07 и 09, которые имеют формат ДД/ММ/ГГГГ и являются датами поступления и выписки пациента из больницы соответственно, согласно к сводному отчету о выписке.

Вопросы и ответы с поисковой дополненной генерацией

LLM, как известно, сохраняют фактическую информацию, которую часто называют мировоззрением или мировоззрением. При точной настройке они могут дать самые современные результаты. Однако существуют ограничения на то, насколько эффективно LLM может получить доступ к этим знаниям и манипулировать ими. В результате в задачах, которые в значительной степени зависят от конкретных знаний, их производительность может быть неоптимальной для определенных случаев использования. Например, в сценариях вопросов и ответов важно, чтобы модель строго придерживалась контекста, представленного в документе, не полагаясь исключительно на свои знания мира. Отклонение от этого может привести к искажению фактов, неточностям или даже неверным ответам. Наиболее часто используемый метод решения этой проблемы известен как Извлечение дополненной генерации (ТРЯПКА). Этот подход объединяет сильные стороны как поисковых, так и языковых моделей, повышая точность и качество генерируемых ответов.

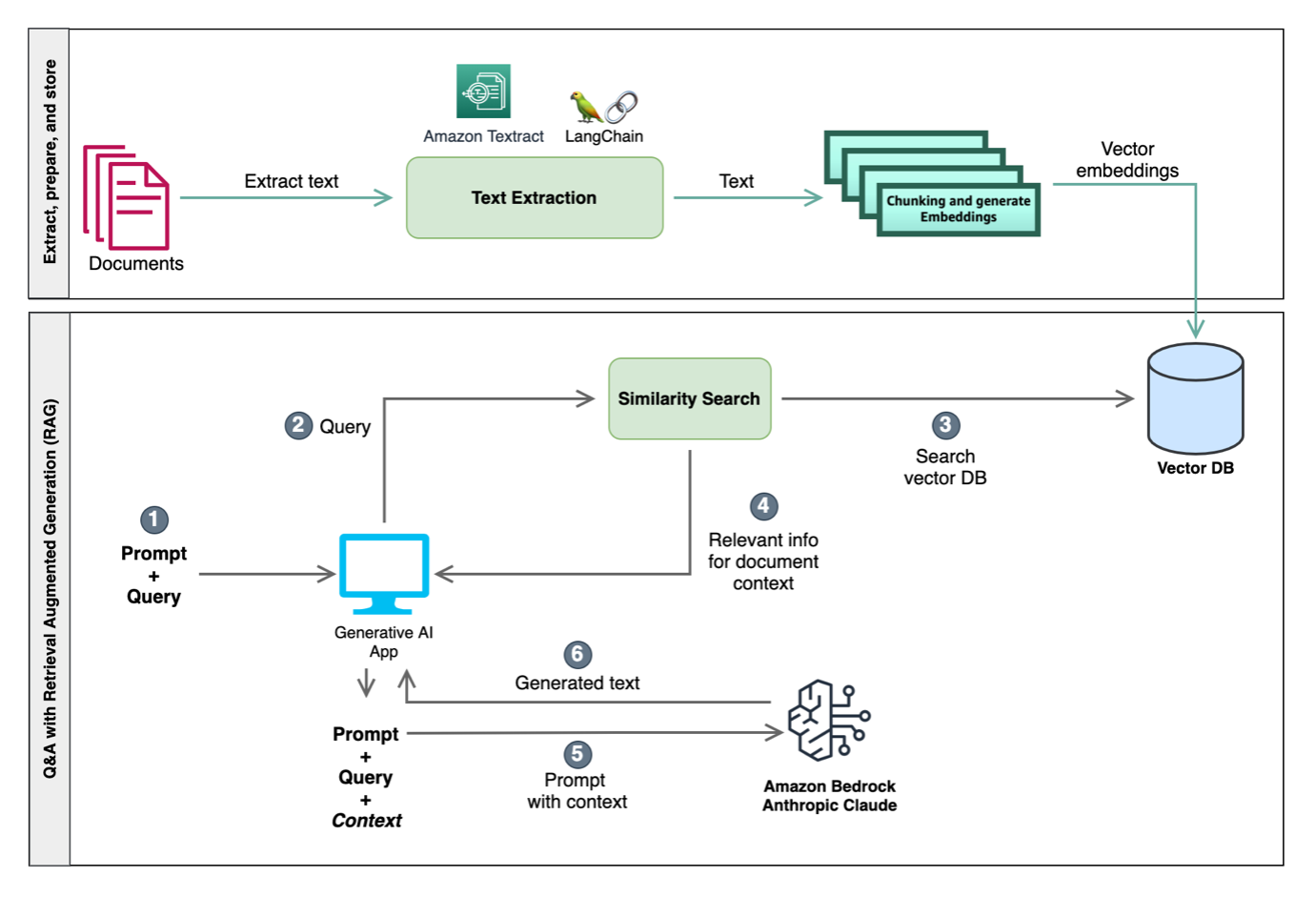

LLM также могут налагать ограничения на токены из-за ограничений памяти и ограничений оборудования, на котором они работают. Чтобы решить эту проблему, используются такие методы, как фрагментирование, для разделения больших документов на более мелкие части, которые укладываются в пределы токенов LLM. С другой стороны, встраивания используются в НЛП прежде всего для того, чтобы уловить семантическое значение слов и их отношения с другими словами в многомерном пространстве. Эти внедрения преобразуют слова в векторы, позволяя моделям эффективно обрабатывать и понимать текстовые данные. Понимая семантические нюансы между словами и фразами, встраивания позволяют LLM генерировать последовательные и контекстуально релевантные результаты. Обратите внимание на следующие ключевые термины:

- лязг – Этот процесс разбивает большие объемы текста из документов на более мелкие, значимые фрагменты текста.

- вложения – Это векторные преобразования фиксированной размерности каждого фрагмента, которые сохраняют семантическую информацию из фрагментов. Эти вложения впоследствии загружаются в базу данных векторов.

- База данных векторов – Это база данных вложений слов или векторов, которые представляют контекст слов. Он действует как источник знаний, помогающий решать задачи НЛП в конвейерах обработки документов. Преимущество базы данных векторов здесь заключается в том, что она позволяет предоставлять LLM только необходимый контекст во время генерации текста, как мы объясним в следующем разделе.

RAG использует возможности встраивания для понимания и извлечения соответствующих сегментов документа на этапе поиска. Таким образом, RAG может работать в рамках ограничений токенов LLM, гарантируя, что для генерации будет выбрана наиболее подходящая информация, что приведет к более точным и контекстуально релевантным результатам.

Следующая диаграмма иллюстрирует интеграцию этих методов для создания входных данных для LLM, улучшения их контекстуального понимания и обеспечения более релевантных контекстных ответов. Один из подходов включает поиск по сходству с использованием как векторной базы данных, так и фрагментации. В базе данных векторов хранятся внедрения, представляющие семантическую информацию, а фрагментирование делит текст на управляемые разделы. Используя этот контекст поиска по сходству, LLM могут выполнять такие задачи, как ответы на вопросы и специфичные для предметной области операции, такие как классификация и обогащение.

В этом посте мы используем подход на основе RAG для выполнения контекстных вопросов и ответов с документами. В следующем примере кода мы извлекаем текст из документа, а затем разбиваем документ на более мелкие фрагменты текста. Разделение на части необходимо, поскольку у нас могут быть большие многостраничные документы, а наши LLM могут иметь ограничения на токены. Эти фрагменты затем загружаются в базу данных векторов для выполнения поиска по сходству на последующих этапах. В следующем примере мы используем модель Amazon Titan Embed Text v1, которая выполняет векторное встраивание фрагментов документа:

Код создает соответствующий контекст для LLM, используя фрагменты текста, возвращаемые действием поиска по сходству из базы данных векторов. В этом примере мы используем открытый исходный код. Векторный магазин FAISS в качестве образца векторной базы данных для хранения векторных вложений каждого фрагмента текста. Затем мы определяем базу данных векторов как LangChain ретривер, который передается в RetrievalQA цепь. При этом внутри системы выполняется запрос на поиск сходства в базе данных векторов, который возвращает первые n (где в нашем примере n=3) фрагментов текста, имеющих отношение к вопросу. Наконец, цепочка LLM запускается с соответствующим контекстом (группой соответствующих фрагментов текста) и вопросом, на который LLM должен ответить. Пошаговое описание кода вопросов и ответов с помощью RAG см. в блокноте Python на странице GitHub.

В качестве альтернативы FAISS вы также можете использовать Возможности векторной базы данных Amazon OpenSearch Service, Сервис реляционных баз данных Amazon (Amazon RDS) для PostgreSQL с pgvector расширение в виде векторных баз данных или базы данных Chroma с открытым исходным кодом.

Вопросы и ответы с табличными данными

Табличные данные в документах могут быть сложными для обработки LLM из-за их структурной сложности. Amazon Textract можно дополнить LLM, поскольку он позволяет извлекать таблицы из документов во вложенном формате таких элементов, как страница, таблица и ячейки. Выполнение вопросов и ответов с табличными данными представляет собой многоэтапный процесс и может быть достигнуто с помощью самозапрос. Ниже приводится обзор шагов:

- Извлекайте таблицы из документов с помощью Amazon Textract. С помощью Amazon Textract из документа можно извлечь табличную структуру (строки, столбцы, заголовки).

- Сохраните табличные данные в векторной базе данных вместе с информацией метаданных, такой как имена заголовков и описание каждого заголовка.

- Используйте подсказку для создания структурированного запроса с использованием LLM для получения данных из таблицы.

- Используйте запрос для извлечения соответствующих табличных данных из базы данных векторов.

Например, в выписке по счету с подсказкой «Каковы транзакции с депозитами на сумму более 1000 долларов США» LLM выполнит следующие шаги:

- Создайте запрос, например

“Query: transactions” , “filter: greater than (Deposit$)”. - Преобразуйте запрос в структурированный запрос.

- Примените структурированный запрос к векторной базе данных, где хранятся данные нашей таблицы.

Пошаговый пример кода вопросов и ответов с табличной формой см. в блокноте Python в разделе GitHub.

Шаблонизация и нормализация

В этом разделе мы рассмотрим, как использовать методы быстрого проектирования и встроенный механизм LangChain для генерации выходных данных с извлечениями из документа в указанной схеме. Мы также проводим некоторую стандартизацию извлеченных данных, используя методы, обсуждавшиеся ранее. Мы начинаем с определения шаблона для желаемого результата. Это будет служить схемой и инкапсулировать сведения о каждой сущности, которую мы хотим извлечь из текста документа.

Обратите внимание, что для каждого объекта мы используем описание, чтобы объяснить, что это за объект, чтобы помочь LLM извлечь значение из текста документа. В следующем примере кода мы используем этот шаблон для создания приглашения для LLM вместе с текстом, извлеченным из документа с помощью AmazonTextractPDFLoader и впоследствии выполнить вывод с моделью:

Как вы можете видеть, {keys} часть приглашения — это ключи из нашего шаблона, а {details} это ключи вместе с их описанием. В этом случае мы не запрашиваем модель явно с указанием формата вывода, кроме указания в инструкции создания вывода в формате JSON. По большей части это работает; однако, поскольку выходные данные LLM представляют собой недетерминированную генерацию текста, мы хотим явно указать формат как часть инструкции в приглашении. Чтобы решить эту проблему, мы можем использовать LangChain парсер структурированного вывода модуль, чтобы воспользоваться преимуществами автоматизированной разработки подсказок, которые помогают преобразовать наш шаблон в подсказку с инструкциями по форматированию. Мы используем шаблон, определенный ранее, для создания приглашения инструкции формата следующим образом:

Затем мы используем эту переменную в нашем исходном приглашении в качестве инструкции для LLM, чтобы он извлекал и форматировал выходные данные в желаемой схеме, внеся небольшую модификацию нашего приглашения:

До сих пор мы только извлекли данные из документа в желаемой схеме. Однако нам все еще необходимо провести некоторую стандартизацию. Например, мы хотим, чтобы дата поступления пациента и дата выписки были извлечены в формате ДД/ММ/ГГГГ. В этом случае мы дополняем description ключа с инструкцией по форматированию:

Обратитесь к блокноту Python в GitHub для полного пошагового руководства и объяснений.

Проверка орфографии и исправления

Магистр права продемонстрировал замечательные способности к пониманию и созданию текста, похожего на человеческий. Одним из менее обсуждаемых, но чрезвычайно полезных применений LLM является их потенциал для проверки грамматики и исправления предложений в документах. В отличие от традиционных программ проверки грамматики, которые полагаются на набор предопределенных правил, LLM используют шаблоны, которые они определили из огромных объемов текстовых данных, чтобы определить, что считать правильным или беглым языком. Это означает, что они могут обнаруживать нюансы, контекст и тонкости, которые системы, основанные на правилах, могут упустить.

Представьте себе текст, извлеченный из справки о выписке пациента, который гласит: «Пациент Джон Доу, госпитализированный с тяжелой пневмонией, продемонстрировал значительное улучшение и может быть благополучно выписан. Последующие наблюдения запланированы на следующую неделю». Традиционная программа проверки орфографии может распознать «admittd», «pneumonia», «improvement» и «nex» как ошибки. Однако контекст этих ошибок может привести к дальнейшим ошибкам или общим предложениям. Магистр права, прошедший обширную подготовку, может подсказать: «Пациент Джон Доу, госпитализированный с тяжелой пневмонией, продемонстрировал значительное улучшение и может быть благополучно выписан. Последующие наблюдения запланированы на следующую неделю».

Ниже приведен образец документа, плохо написанного от руки, с тем же текстом, что объяснялся ранее.

Мы извлекаем документ с помощью загрузчика документов Amazon Textract, а затем поручаем LLM с помощью оперативного проектирования исправить извлеченный текст, чтобы исправить любые орфографические и/или грамматические ошибки:

Вывод предыдущего кода показывает исходный текст, извлеченный загрузчиком документов, за которым следует исправленный текст, сгенерированный LLM:

Имейте в виду, что какими бы мощными ни были программы LLM, важно рассматривать их предложения просто как предложения. Хотя они впечатляюще хорошо отражают тонкости языка, они не являются непогрешимыми. Некоторые предложения могут изменить предполагаемое значение или тон исходного текста. Поэтому для рецензентов крайне важно использовать исправления, сгенерированные LLM, в качестве руководства, а не абсолюта. Сотрудничество человеческой интуиции с возможностями LLM обещает будущее, в котором наше письменное общение будет не только безошибочным, но также более богатым и детальным.

Заключение

Генеративный искусственный интеллект меняет способы обработки документов с помощью IDP для получения ценной информации. В посте Улучшение интеллектуальной обработки документов AWS с помощью генеративного искусственного интеллекта, мы обсудили различные этапы конвейера и то, как клиент AWS Ricoh расширяет свой конвейер IDP с помощью LLM. В этом посте мы обсудили различные механизмы расширения рабочего процесса IDP с помощью LLM через Amazon Bedrock, Amazon Textract и популярную структуру LangChain. Вы можете начать работу с новым загрузчиком документов Amazon Textract с LangChain уже сегодня, используя образцы блокнотов, доступные в нашем Репозиторий GitHub. Дополнительную информацию о работе с генеративным искусственным интеллектом на AWS см. Анонс новых инструментов для разработки с помощью генеративного ИИ на AWS.

Об авторах

Сонали Саху руководит интеллектуальной обработкой документов вместе с группой сервисов AI/ML в AWS. Она писатель, идейный лидер и страстный технолог. Ее основная сфера деятельности — искусственный интеллект и машинное обучение, и она часто выступает на конференциях и встречах по искусственному интеллекту и машинному обучению по всему миру. Она обладает как обширным, так и глубоким опытом работы в области технологий и технологической отрасли, а также с отраслевым опытом в области здравоохранения, финансового сектора и страхования.

Сонали Саху руководит интеллектуальной обработкой документов вместе с группой сервисов AI/ML в AWS. Она писатель, идейный лидер и страстный технолог. Ее основная сфера деятельности — искусственный интеллект и машинное обучение, и она часто выступает на конференциях и встречах по искусственному интеллекту и машинному обучению по всему миру. Она обладает как обширным, так и глубоким опытом работы в области технологий и технологической отрасли, а также с отраслевым опытом в области здравоохранения, финансового сектора и страхования.

Анжан Бисвас является старшим архитектором решений AI Services, специализирующимся на AI/ML и аналитике данных. Анджан является частью всемирной группы по обслуживанию ИИ и работает с клиентами, помогая им понять и разработать решения бизнес-проблем с помощью ИИ и машинного обучения. Анджан имеет более чем 14-летний опыт работы с глобальными цепочками поставок, производственными и розничными организациями и активно помогает клиентам начать работу с сервисами AWS AI и масштабировать их.

Анжан Бисвас является старшим архитектором решений AI Services, специализирующимся на AI/ML и аналитике данных. Анджан является частью всемирной группы по обслуживанию ИИ и работает с клиентами, помогая им понять и разработать решения бизнес-проблем с помощью ИИ и машинного обучения. Анджан имеет более чем 14-летний опыт работы с глобальными цепочками поставок, производственными и розничными организациями и активно помогает клиентам начать работу с сервисами AWS AI и масштабировать их.

Чинмайи Ране — специалист по архитектуре решений искусственного интеллекта и машинного обучения в Amazon Web Services. Она увлечена прикладной математикой и машинным обучением. Она занимается разработкой интеллектуальной обработки документов и генеративных решений искусственного интеллекта для клиентов AWS. Вне работы она увлекается танцами сальсы и бачаты.

Чинмайи Ране — специалист по архитектуре решений искусственного интеллекта и машинного обучения в Amazon Web Services. Она увлечена прикладной математикой и машинным обучением. Она занимается разработкой интеллектуальной обработки документов и генеративных решений искусственного интеллекта для клиентов AWS. Вне работы она увлекается танцами сальсы и бачаты.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :имеет

- :является

- :нет

- :куда

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- способности

- О нас

- Absolute

- доступ

- Доступ

- По

- точность

- точный

- достигнутый

- через

- Действие

- действия

- активно

- деятельность

- акты

- Ad

- адрес

- Добавляет

- придерживаться

- признавать

- признал

- достижения

- плюс

- приход

- возраст

- агенты

- AI

- Услуги искусственного интеллекта

- AI / ML

- выровненный

- Все

- Позволяющий

- позволяет

- вдоль

- причислены

- альтернатива

- Несмотря на то, что

- Amazon

- Amazon Comprehend

- Амазон РДС

- Амазонка Текст

- Amazon Web Services

- суммы

- an

- аналитика

- анализировать

- и

- ответ

- Антропный

- любой

- API

- Приложения

- прикладной

- Назначения

- подхода

- архитектура

- МЫ

- ПЛОЩАДЬ

- около

- Искусство

- искусственный

- искусственный интеллект

- Искусственный интеллект (AI)

- AS

- внешний вид

- помощь

- помощник

- At

- увеличивать

- дополненная

- автор

- автоматизировать

- Автоматизированный

- автоматически

- автоматизация

- доступен

- осведомленность

- AWS

- Клиент AWS

- Банка

- BE

- , так как:

- становится

- было

- до

- полезный

- польза

- ЛУЧШЕЕ

- лучшие практики

- между

- Заблокировать

- Блоки

- изоферменты печени

- ширина

- Ломать

- брейки

- строить

- Строительство

- встроенный

- бизнес

- бизнес

- но

- by

- Объявления

- CAN

- Может получить

- возможности

- захватить

- случаев

- случаев

- Клетки

- определенный

- цепь

- цепи

- вызов

- сложные

- изменение

- изменения

- изменения

- Проверки

- выбор

- требования

- класс

- классов

- классификация

- классифицировать

- код

- ПОСЛЕДОВАТЕЛЬНЫЙ

- сотрудничество

- Column

- Колонки

- сочетание

- объединять

- выходит

- Общий

- обычно

- Связь

- совместим

- полный

- комплекс

- сложность

- постигать

- краткий

- конференции

- Соединительный

- последовательный

- состоит

- ограничения

- строить

- содержать

- содержащегося

- содержит

- содержание

- контекст

- контекстной

- конвертировать

- Основные

- исправить

- исправленный

- исправления

- может

- выработать

- проработаны

- создает

- решающее значение

- изготовленный на заказ

- клиент

- Клиенты

- танцы

- данным

- Анализ данных

- База данных

- базы данных

- Время

- Финики

- сделка

- глубоко

- более глубокий

- определять

- определенный

- определяющий

- убивают

- в зависимости

- депозиты

- глубина

- описано

- описание

- проектирование

- желанный

- подробность

- подробный

- подробнее

- обнаруживать

- Определять

- развивать

- застройщиков

- Диета

- различный

- непосредственно

- обсуждать

- обсуждается

- погружение

- делить

- водоразделы

- do

- врач

- документ

- документации

- Документация

- лань

- не

- дело

- Дон

- сделанный

- Dont

- вниз

- драматично

- два

- в течение

- динамический

- e

- каждый

- Ранее

- легко

- Простой в использовании

- фактически

- затрат

- эффективный

- эффективно

- усилия

- или

- элементы

- вставлять

- занятых

- Наделяет

- включить

- позволяет

- позволяет

- конец

- Проект и

- повышать

- расширение

- повышение

- обеспечивать

- обеспечение

- Весь

- лиц

- организация

- оборудованный

- ошибки

- существенный

- Даже

- пример

- Кроме

- исключение

- существующий

- опыт

- опыта

- Объяснять

- объяснены

- Объясняет

- объяснение

- эксплицитно

- выражение

- продлить

- расширение

- обширный

- извлечение

- добыча

- Экстракты

- Осень

- ложный

- далеко

- усталость

- Поля

- фигура

- окончательный

- в заключение

- финансовый

- Финансовый сектор

- Во-первых,

- соответствовать

- Фокус

- фокусируется

- следовать

- следует

- после

- следующим образом

- Что касается

- формат

- формы

- найденный

- Год основания

- Рамки

- Бесплатно

- часто

- от

- Граница

- полный

- полностью

- далее

- будущее

- Общие

- порождать

- генерируется

- генерирует

- порождающий

- поколение

- генеративный

- Генеративный ИИ

- получить

- Дайте

- данный

- Глобальный

- грамматика

- схватывание

- большой

- группы

- инструкция

- рука

- обрабатывать

- происходить

- Случай

- Аппаратные средства

- Есть

- Заголовки

- здравоохранение

- сильно

- помощь

- полезный

- помощь

- помогает

- ее

- здесь

- на высшем уровне

- высокопроизводительный

- высший

- имеет

- больница

- Как

- How To

- Однако

- HTML

- HTTPS

- человек

- i

- ID

- идентифицированный

- if

- иллюстрирует

- изображение

- очень

- Влияние

- Импортировать

- важную

- импортирующий

- наложенный

- улучшение

- in

- В том числе

- индекс

- промышленность

- информация

- Возраст информации

- Инновации

- вход

- размышления

- пример

- инструкции

- страхование

- интегрировать

- интегрированный

- Интегрируя

- интеграции.

- Интеллекта

- Умный

- Интеллектуальная обработка документов

- предназначенных

- внутренне

- в

- тонкости

- вводить

- выпустили

- Представляет

- IT

- ЕГО

- Джексон

- John

- ДЖОН ДОУ

- джон

- JPG

- JSON

- всего

- Основные

- ключи

- Знать

- знания

- известный

- язык

- большой

- Планировка

- вести

- лидер

- ведущий

- изучение

- уход

- Библиотека

- такое как

- Вероятно

- недостатки

- рамки

- Список

- LLM

- загрузка

- загрузчик

- логика

- посмотреть

- серия

- машина

- обучение с помощью машины

- Создание

- управлять

- управляемый

- управляемого

- управления

- руководство

- производство

- с пометкой

- математика

- Май..

- me

- смысл

- значимым

- означает

- механизм

- механизмы

- Meetups

- Память

- Мета

- Метаданные

- метод

- методы

- может быть

- против

- скучать

- ошибки

- ML

- модель

- Модели

- Модули

- БОЛЕЕ

- Ипотека

- самых

- с разными

- имя

- имена

- натуральный

- Обработка естественного языка

- необходимо

- Необходимость

- необходимый

- потребности

- Новые

- следующий

- Следующая неделя

- НЛП

- ноутбук

- сейчас

- нюансы

- номер

- объект

- объекты

- of

- Предложения

- .

- on

- ONE

- только

- с открытым исходным кодом

- Операционный отдел

- Возможность

- оптимальный

- Опции

- or

- организации

- оригинал

- Другое

- в противном случае

- наши

- внешний

- Результат

- выходной

- выходы

- внешнюю

- за

- обзор

- пакеты

- страница

- страниц

- боль

- в паре

- пар

- часть

- особенно

- pass

- Прошло

- Прохождение

- страстный

- путь

- пациент

- шаблон

- паттеранами

- для

- Выполнять

- производительность

- выполнены

- выполнения

- выполняет

- фаза

- кандидат наук

- фразы

- трубопровод

- план

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- пожалуйста

- пневмония

- пунктов

- Популярное

- возможное

- После

- потенциал

- мощностью

- Питание

- мощный

- практиками

- Точно

- Точность

- привилегированный

- представить

- предварительно

- в первую очередь

- Печать / PDF

- печать

- Проблема

- проблемам

- процесс

- Обработанный

- обработка

- производит

- Обещает

- правильный

- обеспечивать

- при условии

- Недвижимости

- приводит

- Питон

- Вопросы и ответы

- вопрос

- САЙТ

- быстро

- Сырье

- Reading

- признавать

- снижение

- относиться

- ссылка

- назвало

- Отношения

- соответствующие

- полагаться

- опираясь

- замечательный

- отчету

- представлять

- представляющий

- обязательный

- требуется

- соответственно

- ответы

- Ограничения

- результат

- в результате

- Итоги

- розничный

- сохранять

- удерживающий

- Возвращает

- Богатые

- Комната

- условиями,

- Run

- работает

- s

- безопасно

- то же

- сообщили

- Шкала

- Сценарии

- считаться

- Поиск

- Во-вторых

- Раздел

- разделах

- сектор

- посмотреть

- сегментами

- выбранный

- старший

- предложение

- Серии

- служить

- служит

- обслуживание

- Услуги

- набор

- тяжелый

- она

- Короткое

- должен

- показанный

- Шоу

- значительный

- одинарной

- небольшой

- меньше

- отрывок

- So

- только

- Решения

- РЕШАТЬ

- некоторые

- Источник

- Space

- Говорит

- специалист

- конкретный

- конкретно

- указанный

- орфография

- раскол

- этапы

- стандартизация

- Начало

- и политические лидеры

- современное состояние

- заявление

- Шаг

- Шаги

- По-прежнему

- магазин

- хранить

- магазины

- сильные

- строка

- структурный

- Структура

- структурированный

- Бороться

- последующее

- впоследствии

- такие

- предлагать

- суммировать

- РЕЗЮМЕ

- поставка

- цепочками поставок

- поддержка

- Поддержка

- взаимодействие

- системы

- ТАБЛИЦЫ

- взять

- принимает

- Сложность задачи

- задачи

- команда

- техника

- снижения вреда

- технолог

- Технологии

- шаблон

- terms

- текст

- текстовый

- чем

- который

- Ассоциация

- мир

- их

- Их

- тогда

- Там.

- следовательно

- Эти

- они

- этой

- мысль

- три

- Через

- исполин

- в

- сегодня

- Сегодняшних

- вместе

- знак

- Лексемы

- TONE

- инструменты

- топ

- Всего

- традиционный

- Трейлинг

- Обучение

- Сделки

- Transform

- преобразований

- правда

- стараться

- два

- напишите

- Типы

- понимать

- понимание

- В отличие от

- обнародование

- URL

- использование

- прецедент

- используемый

- пользователей

- использования

- через

- использовать

- Использующий

- v1

- ценностное

- Наши ценности

- переменная

- различный

- Огромная

- разносторонний

- версия

- с помощью

- Вид

- тома

- прохождение

- хотеть

- законопроект

- Путь..

- we

- Web

- веб-сервисы

- неделя

- ЧТО Ж

- Что

- когда

- , которые

- в то время как

- КТО

- будете

- в

- без

- свидетелем

- Word

- слова

- Работа

- рабочий

- Рабочие процессы

- работает

- работает

- Мир

- бы

- письменный

- X

- лет

- Ты

- зефирнет