Развертывание мощных систем искусственного интеллекта обогатило наше понимание безопасности и неправомерного использования гораздо больше, чем это было бы возможно только благодаря исследованиям. В частности:

- Неправильное использование языковой модели на основе API часто проявляется в иных формах, чем мы опасались больше всего.

- Мы выявили ограничения в существующих оценках языковых моделей, которые мы устраняем с помощью новых тестов и классификаторов.

- Фундаментальные исследования безопасности предлагают значительные преимущества для коммерческого использования систем ИИ.

Здесь мы описываем наши последние идеи в надежде помочь другим разработчикам ИИ решить проблемы безопасности и неправильного использования развернутых моделей.

Oза последние два года, мы многое узнали о том, как можно использовать языковые модели и злоупотреблять ими, — понимание, которое мы не смогли бы получить без опыта реального развертывания. В июне 2020 года мы начали предоставлять разработчикам и исследователям доступ к API OpenAI, интерфейс для доступа и создания приложений на основе новых моделей ИИ, разработанных OpenAI. Развертывание GPT-3, Codex и других моделей таким образом, чтобы снизить риски причинения вреда, вызвало различные технические и политические проблемы.

Обзор нашего подхода к развертыванию модели

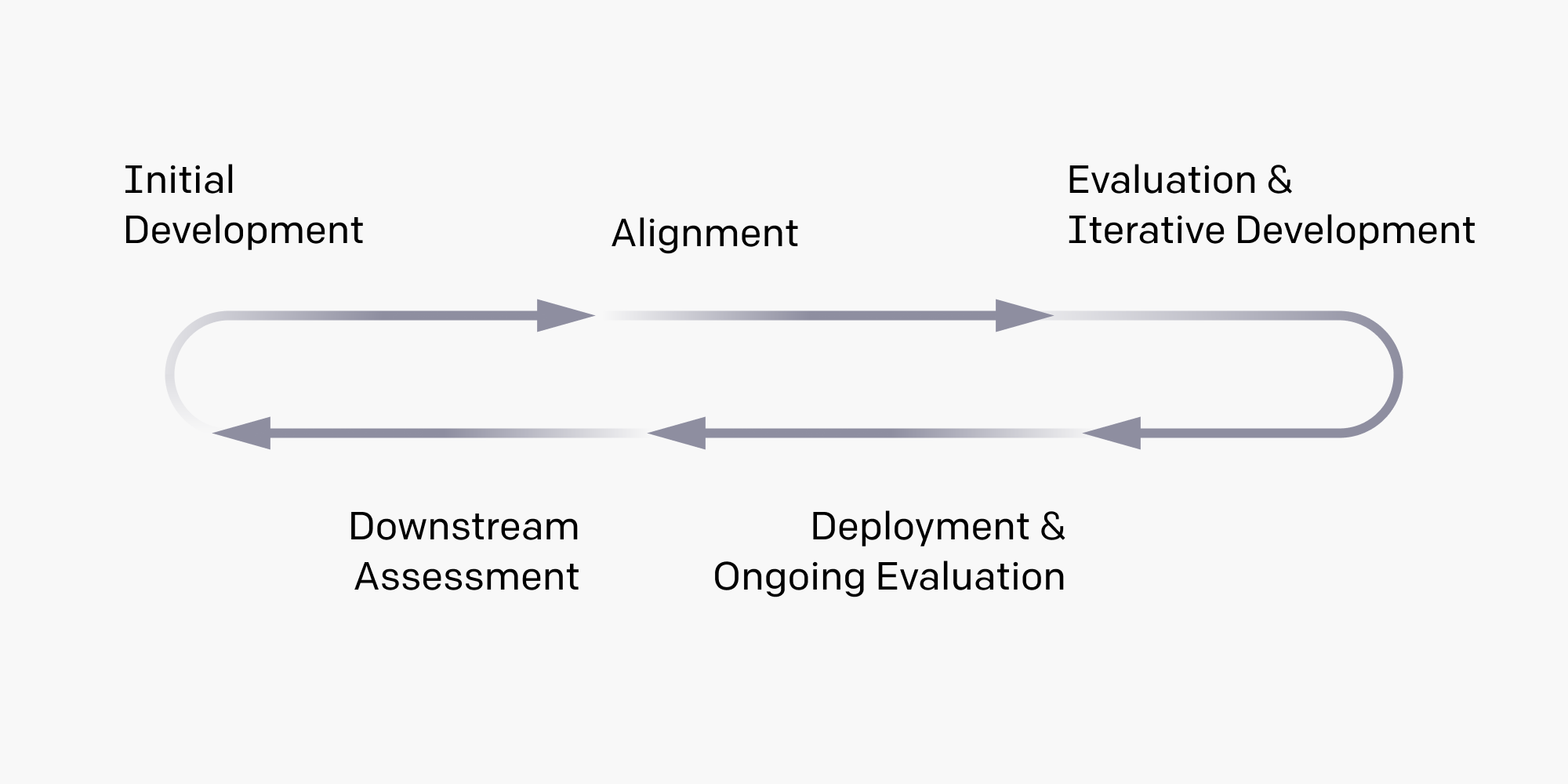

Большие языковые модели теперь способны выполнять очень широкий спектр задач, часто из коробки. Их профили риска, потенциальное применение и более широкое влияние на общество оставаться плохо понимать. В результате наш подход к развертыванию делает упор на непрерывную итерацию и использует следующие стратегии, направленные на максимизацию преимуществ развертывания при одновременном снижении связанных рисков:

- Анализ рисков перед развертыванием с использованием растущего набора оценок безопасности и инструментов Red Teaming (например, мы проверили InstructGPT на предмет ухудшения безопасности, используя оценки обсуждается ниже)

- Начиная с небольшой базы пользователей (например, как GPT-3, так и наша ИнструктироватьGPT серия началась как частные бета-версии)

- Изучение результатов пилотных проектов новых вариантов использования (например, изучение условий, при которых мы могли бы безопасно включить генерацию длинного контента, работая с небольшим числом клиентов).

- Внедрение процессов, которые помогают держать руку на пульсе использования (например, обзор вариантов использования, квоты токенов и ограничения скорости).

- Проведение подробных ретроспективных обзоров (например, инцидентов, связанных с безопасностью, и крупных развертываний)

Обратите внимание, что эта диаграмма предназначена для того, чтобы наглядно передать потребность в петлях обратной связи в непрерывном процессе разработки и развертывания модели, а также тот факт, что безопасность должна быть интегрирована на каждом этапе. Он не предназначен для передачи полной или идеальной картины процесса нашей или любой другой организации.

Не существует серебряной пули для ответственного развертывания, поэтому мы пытаемся изучить и устранить ограничения наших моделей, а также потенциальные возможности для неправильного использования на каждом этапе разработки и развертывания. Этот подход позволяет нам узнать как можно больше о вопросах безопасности и политик в небольших масштабах и использовать эти знания перед запуском более масштабных развертываний.

Хотя это и не исчерпывающий список, некоторые области, в которые мы уже инвестировали, включают[1]:

- Предварительная подготовка данным курирование и фильтрация

- Тонкая настройка модели лучше следовать инструкциям

- Анализ рисков потенциальных развертываний

- Предоставление подробного пользователя документации

- Строительство инструменты для скрининга вредных выходных данных модели

- Рассмотрение вариантов использования в сравнении с нашими сборах

- Мониторинг признаков злоупотреблять

- Изучая влияние наших моделей

Поскольку каждый этап вмешательства имеет ограничения, необходим целостный подход.

Есть области, в которых мы могли бы сделать больше и где еще есть возможности для улучшения. Например, когда мы впервые работали над GPT-3, мы рассматривали его как внутренний исследовательский артефакт, а не производственную систему, и не были столь агрессивны в отфильтровывании токсичных обучающих данных, как могли бы в противном случае. Мы вложили больше средств в исследование и удаление такого материала для последующих моделей. Нам потребовалось больше времени, чтобы устранить некоторые случаи неправомерного использования в тех случаях, когда у нас не было четких политик по этому вопросу, и мы стали лучше повторять эти политики. И мы продолжаем работать над пакетом требований безопасности, который максимально эффективен для устранения рисков, а также четко доводится до сведения разработчиков и минимизирует чрезмерные трения.

Тем не менее, мы считаем, что наш подход позволил нам измерить и уменьшить различные виды вреда от использования языковой модели по сравнению с более невмешательным подходом, и в то же время обеспечить широкий спектр научных, художественных и коммерческих приложений нашего подхода. модели.[2]

Множество форм и размеров неправильного использования языковых моделей

OpenAI активно изучает риски неправильного использования ИИ с момента нашей ранней работы над злонамеренное использование ИИ В 2018 и на ГПТ-2 в 2019 году, и мы уделили особое внимание системам искусственного интеллекта, расширяющим возможности операций влияния. У нас есть работал с внешние эксперты для разработки доказательства концепции и повышен тщательный анализ таких рисков третьими лицами. Мы по-прежнему привержены устранению рисков, связанных с операциями влияния с использованием языковых моделей, и недавно совместно организовали семинар по этому вопросу.[3]

Тем не менее, мы обнаружили и остановили сотни субъектов, пытающихся неправомерно использовать GPT-3 для гораздо более широкого круга целей, чем создание дезинформации для операций влияния, в том числе способами, которые мы либо не ожидали, либо ожидали, но не ожидали. так распространено.[4] Наши рекомендации по вариантам использования, правила содержания, а внутренняя инфраструктура обнаружения и реагирования изначально была ориентирована на риски, которые мы ожидали на основе внутренних и внешних исследований, таких как создание вводящего в заблуждение политического контента с помощью GPT-3 или создание вредоносного ПО с помощью Codex. Наши усилия по обнаружению и реагированию развивались с течением времени в ответ на реальные случаи неправомерного использования, обнаруженные «в дикой природе», которые не фигурировали так заметно, как операции влияния в наших первоначальных оценках рисков. Примеры включают спам-рекламу сомнительных медицинских товаров и ролевые игры расистских фантазий.

Чтобы поддержать изучение неправомерного использования языковых моделей и смягчение их последствий, мы активно изучаем возможности обмена статистикой инцидентов, связанных с безопасностью, в этом году, чтобы конкретизировать обсуждения неправильного использования языковых моделей.

Сложность измерения риска и воздействия

Многие аспекты рисков и воздействия языковых моделей по-прежнему трудно измерить и, следовательно, трудно отслеживать, сводить к минимуму и раскрывать подотчетным образом. Мы активно использовали существующие академические эталонные тесты для оценки языковых моделей и стремимся продолжить работу со стороны, но мы также обнаружили, что существующие наборы эталонных данных часто не отражают риски безопасности и неправильного использования, которые мы наблюдаем на практике.[5]

Такие ограничения отражают тот факт, что академические наборы данных редко создаются с явной целью информирования об использовании языковых моделей в производстве и не используют опыт, полученный при масштабном развертывании таких моделей. В результате мы разрабатываем новые оценочные наборы данных и платформы для измерения безопасности наших моделей, которые мы планируем выпустить в ближайшее время. В частности, мы разработали новые оценочные показатели для измерения токсичности в выходных данных модели, а также разработали собственные классификаторы для обнаружения контента, нарушающего наши правила. контентная политика, такие как эротический контент, разжигание ненависти, насилие, домогательства и членовредительство. Оба они, в свою очередь, также были использованы для улучшения наших данных перед обучением.[6]— в частности, с помощью классификаторов для фильтрации контента и показателей оценки для измерения результатов вмешательств в набор данных.

Надежно классифицировать выходные данные отдельных моделей по различным параметрам сложно, а измерить их социальное влияние в масштабе API OpenAI еще сложнее. Мы провели несколько внутренних исследований, чтобы нарастить институциональную мощь для таких измерений, но зачастую они вызывали больше вопросов, чем ответов.

Мы особенно заинтересованы в лучшем понимании экономического воздействия наших моделей и распределения этого воздействия. У нас есть веские основания полагать, что влияние развертывания текущих моделей на рынок труда уже может быть значительным в абсолютном выражении и что оно будет расти по мере роста возможностей и охвата наших моделей. На сегодняшний день мы узнали о множестве локальных эффектов, в том числе о значительном повышении производительности существующих задач, выполняемых отдельными лицами, таких как копирайтинг и обобщение (иногда способствующих перемещению и созданию рабочих мест), а также о случаях, когда API открывал новые приложения, которые ранее были невозможны. , Такие как синтез крупномасштабной качественной обратной связи. Но нам не хватает хорошего понимания чистых эффектов.

Мы считаем, что для тех, кто разрабатывает и внедряет мощные технологии искусственного интеллекта, важно учитывать как положительные, так и отрицательные последствия своей работы. Мы обсудим некоторые шаги в этом направлении в заключительном разделе этого поста.

Взаимосвязь между безопасностью и полезностью систем ИИ

В нашей , согласно Хартии Канады, опубликованном в 2018 году, мы говорим, что «обеспокоены тем, что разработка AGI на поздних стадиях превращается в конкурентную гонку без времени на адекватные меры предосторожности». Мы тогда опубликованный подробный анализ конкурентного развития ИИ, и мы внимательно следили последующее исследование. В то же время развертывание систем ИИ через API OpenAI также углубило наше понимание синергии между безопасностью и полезностью.

Например, разработчики в подавляющем большинстве предпочитают наши модели InstructGPT, которые точно настроены в соответствии с намерениями пользователей.[7]— над базовыми моделями ГПТ-3. Примечательно, однако, что модели InstructGPT изначально не были мотивированы коммерческими соображениями, а скорее были нацелены на достижение прогресса в долгосрочной перспективе. проблемы выравнивания. С практической точки зрения это означает, что клиенты, что неудивительно, предпочитают модели, которые не отвлекаются от задачи и понимают намерения пользователя, а также модели, которые с меньшей вероятностью будут давать вредные или неверные результаты.[8] Другие фундаментальные исследования, такие как наша работа по использование информации полученные из Интернета, чтобы более правдиво отвечать на вопросы, также может повысить коммерческую полезность систем ИИ.[9]

Эти синергии не всегда будут иметь место. Например, более мощные системы часто требуют больше времени для эффективной оценки и согласования, что исключает немедленные возможности для получения прибыли. И полезность для пользователя и для общества могут не совпадать из-за негативных внешних факторов — рассмотрим полностью автоматизированный копирайтинг, который может быть полезен для создателей контента, но вреден для информационной экосистемы в целом.

Обнадеживает наличие сильной синергии между безопасностью и полезностью, но мы стремимся инвестировать в исследования в области безопасности и политики, даже если они идут на компромисс с коммерческой полезностью.

Способы вовлечения

Каждый из приведенных выше уроков поднимает новые вопросы. Какие виды инцидентов, связанных с безопасностью, мы все еще не можем обнаружить и предвидеть? Как мы можем лучше измерить риски и воздействия? Как мы можем продолжать улучшать как безопасность, так и полезность наших моделей, и находить компромиссы между этими двумя, когда они возникают?

Мы активно обсуждаем многие из этих вопросов с другими компаниями, внедряющими языковые модели. Но мы также знаем, что ни у одной организации или группы организаций нет ответов на все вопросы, и мы хотели бы выделить несколько способов, с помощью которых читатели могут более активно участвовать в понимании и формировании нашего развертывания современных систем искусственного интеллекта.

Во-первых, получение личного опыта взаимодействия с современными системами искусственного интеллекта имеет неоценимое значение для понимания их возможностей и последствий. Недавно мы закрыли список ожидания API после того, как укрепили уверенность в нашей способности эффективно обнаруживать и реагировать на неправомерное использование. лица в поддерживаемые страны и территории можно быстро получить доступ к OpenAI API, зарегистрировавшись здесь.

Во-вторых, исследователи, работающие над темами, представляющими особый интерес для нас, такими как предвзятость и неправомерное использование, и которым была бы выгодна финансовая поддержка, могут подать заявку на субсидированные кредиты API, используя эта форма. Внешнее исследование жизненно важно для информирования как нашего понимания этих многогранных систем, так и более широкой общественности.

Наконец, сегодня мы публикуем программа исследований изучение воздействия на рынок труда, связанное с нашим семейством моделей Кодекса, и призыв к внешним сотрудникам для проведения этого исследования. Мы рады работать с независимыми исследователями для изучения эффектов наших технологий, чтобы информировать о соответствующих политических вмешательствах и в конечном итоге расширить наше мышление от генерации кода до других модальностей.

Если вы заинтересованы в ответственном развертывании передовых технологий искусственного интеллекта, подать заявление работать в OpenAI!

- 2019

- 2020

- 7

- 9

- О нас

- Absolute

- доступ

- активный

- адрес

- адресация

- Преимущества

- AI

- Все

- уже

- усиливающий

- анализ

- API

- отношение

- Применение

- Приложения

- подхода

- Искусство

- Автоматизированный

- не являетесь

- эталонный тест

- Преимущества

- Беркли

- Коробка

- строить

- Строительство

- призывают

- Кембридж

- Может получить

- возможности

- проведение

- случаев

- вызов

- проблемы

- код

- коммерческая

- Компании

- сравненный

- компонент

- доверие

- Container

- содержание

- продолжать

- контроль

- Расходы

- может

- страны

- Создатели

- кредиты

- Текущий

- Клиенты

- передовой

- данным

- развертывание

- развертывание

- развертывание

- обнаруженный

- обнаружение

- развивать

- развитый

- Застройщик

- застройщиков

- развивающийся

- Разработка

- DID

- отличаться

- различный

- Размеры

- обсуждать

- распределение

- Рано

- Экономические

- Экономическое влияние

- экосистема

- эффект

- Эффективный

- эффекты

- расширение прав и возможностей

- позволяет

- поощрение

- обязательство

- обогащенный

- пример

- Расширьте

- ожидать

- расходы

- опыт

- эксперты

- Ошибка

- семья

- Особенность

- Обратная связь

- финансовый

- First

- Фокус

- внимание

- следовать

- после

- форма

- формы

- найденный

- полный

- пол

- Отдаете

- хорошо

- Расти

- Рост

- Медицина

- помощь

- полезный

- Выделите

- Как

- How To

- HTTPS

- Сотни

- Влияние

- важную

- улучшать

- включают

- включены

- В том числе

- individual

- повлиять

- информация

- Инфраструктура

- размышления

- Институциональная

- интегрированный

- намерение

- интерес

- Интерфейс

- Интернет

- инвестирование

- вовлеченный

- вопросы

- IT

- работа

- маркировка

- труд

- язык

- последний

- запуск

- УЧИТЬСЯ

- узнали

- Уроки, извлеченные

- мало

- локальным

- Длинное

- основной

- Создание

- вредоносных программ

- вручную

- рынок

- массивный

- проводить измерение

- основным медицинским

- Психическое здоровье

- Метрика

- модель

- Модели

- самых

- сеть

- Предложения

- открытый

- с открытым исходным кодом

- Операционный отдел

- Возможности

- заказ

- организация

- организации

- Другие контрактные услуги

- в противном случае

- выплачен

- Люди

- возможно

- перспектива

- картина

- пилот

- сборах

- политика

- политический

- возможное

- мощный

- частная

- процесс

- Процессы

- производит

- Производство

- производительность

- Продукция

- Профили

- Прибыль

- что такое варган?

- Издательство

- цель

- целей

- быстро

- Гонки

- повышения

- ассортимент

- RE

- читатели

- уменьшить

- снижение

- отражать

- отношения

- освободить

- Требования

- исследованиям

- ответ

- ответственный

- Ограничения

- Итоги

- обзоре

- Отзывы

- Снижение

- рисках,

- Сохранность

- экономия

- Шкала

- экран

- поиск

- Серии

- набор

- формы

- Поделиться

- значительный

- Признаки

- Серебро

- небольшой

- So

- Соцсети

- Общество

- Space

- спам

- конкретно

- Этап

- Область

- статистика

- оставаться

- стратегий

- сильный

- исследования

- Кабинет

- стиль

- поддержка

- система

- системы

- задачи

- Технический

- технологии

- мышление

- третье лицо

- Через

- время

- сегодня

- знак

- инструменты

- топ

- Темы

- торговать

- Обучение

- Transform

- понимать

- us

- использование

- пользователей

- утилита

- Что

- КТО

- без

- Работа

- работавший

- работает

- письмо

- год