Генеративный искусственный интеллект (генеративный ИИ) модели продемонстрировали впечатляющие возможности создания высококачественного текста, изображений и другого контента. Однако для полной реализации своего потенциала этим моделям требуются огромные объемы чистых, структурированных обучающих данных. Большинство реальных данных существует в неструктурированных форматах, таких как PDF-файлы, которые требуют предварительной обработки, прежде чем их можно будет эффективно использовать.

По IDCСегодня неструктурированные данные составляют более 80% всех бизнес-данных. Сюда входят такие форматы, как электронные письма, PDF-файлы, отсканированные документы, изображения, аудио, видео и многое другое. Хотя эти данные содержат ценную информацию, их неструктурированный характер затрудняет их интерпретацию и обучение алгоритмам ИИ. Согласно Опрос Deloitte 2019 г., только 18% предприятий сообщили, что могут воспользоваться преимуществами неструктурированных данных.

Поскольку внедрение ИИ продолжает ускоряться, разработка эффективных механизмов обработки и обучения на основе неструктурированных данных станет еще более важной в будущем. Это может включать в себя более совершенные инструменты предварительной обработки, методы полуконтролируемого обучения и достижения в области обработки естественного языка. Компании, которые наиболее эффективно используют свои неструктурированные данные, получат значительные конкурентные преимущества от ИИ. Чистые данные важны для хорошей производительности модели. Извлеченные тексты по-прежнему содержат большое количество тарабарщины и шаблонного текста (например, чтение HTML). Данные, полученные из Интернета, часто содержат множество дубликатов. Данные из социальных сетей, обзоров или любого пользовательского контента также могут содержать токсичный и предвзятый контент, и вам может потребоваться отфильтровать их с помощью некоторых этапов предварительной обработки. Также может быть много некачественного контента или текстов, созданных ботами, которые можно отфильтровать с помощью сопутствующих метаданных (например, отфильтровать ответы службы поддержки клиентов, получившие низкие оценки клиентов).

Подготовка данных важна на нескольких этапах поисковой дополненной генерации (КГР) модели. Документы-источники знаний нуждаются в предварительной обработке, такой как очистка текста и создание семантических вложений, чтобы их можно было эффективно индексировать и извлекать. Запрос пользователя на естественном языке также требует предварительной обработки, поэтому его можно закодировать в вектор и сравнить с внедрениями документа. После получения соответствующих контекстов им может потребоваться дополнительная предварительная обработка, например усечение, прежде чем они будут объединены с запросом пользователя для создания окончательного запроса для базовой модели. Холст Amazon SageMaker теперь поддерживает комплексные возможности подготовки данных на базе Обработчик данных Amazon SageMaker. Благодаря этой интеграции SageMaker Canvas предоставляет клиентам комплексное рабочее пространство без программирования для подготовки данных, построения и использования моделей машинного обучения и базовых моделей, чтобы ускорить переход от данных к бизнес-аналитике. Теперь вы можете легко находить и агрегировать данные из более чем 50 источников данных, а также исследовать и готовить данные с помощью более 300 встроенных методов анализа и преобразований в визуальном интерфейсе SageMaker Canvas.

Обзор решения

В этом посте мы работаем с набором данных документации PDF —Коренная порода Амазонки гид пользователя. Далее мы покажем, как предварительно обработать набор данных для RAG. В частности, мы очищаем данные и создаем артефакты RAG, чтобы ответить на вопросы о содержимом набора данных. Рассмотрим следующую проблему машинного обучения (ML): пользователь задает вопрос о большой языковой модели (LLM): «Как фильтровать и искать модели в Amazon Bedrock?». LLM не видел документацию на этапе обучения или тонкой настройки, поэтому не сможет ответить на вопрос и, скорее всего, у него будут галлюцинации. Наша цель в этом посте — найти соответствующий фрагмент текста в PDF-файле (например, RAG) и прикрепить его к подсказке, что позволит LLM ответить на вопросы, относящиеся к этому документу.

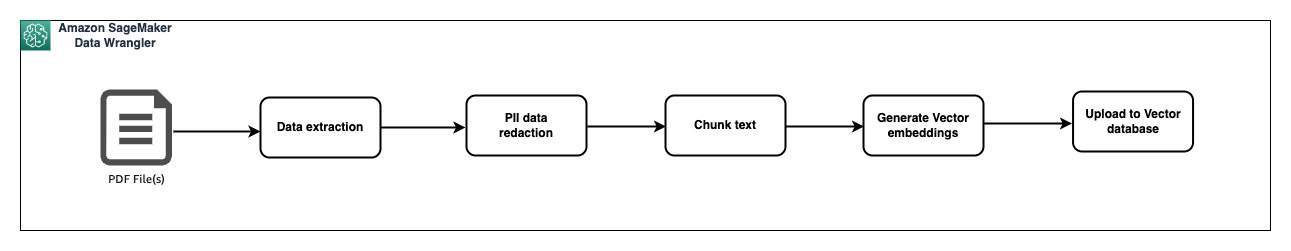

Ниже мы покажем, как можно выполнить все эти основные этапы предварительной обработки из Холст Amazon SageMaker (питание от Обработчик данных Amazon SageMaker):

- Извлечение текста из PDF-документа (на базе Textract)

- Удаление конфиденциальной информации (при поддержке Comprehend)

- Разбивайте текст на части.

- Создавайте вложения для каждой части (при поддержке Bedrock).

- Загрузить встраивание в векторную базу данных (на базе OpenSearch)

Предпосылки

Для этого пошагового руководства у вас должно быть следующее:

Внимание: Создайте домены OpenSearch Service, следуя инструкциям. здесь. Для простоты давайте выберем вариант с главным именем пользователя и паролем для детального контроля доступа. После создания домена создайте векторный индекс со следующими сопоставлениями, и векторное измерение 1536 будет согласовано с встраиваниями Amazon Titan:

Прохождение

Создайте поток данных

В этом разделе мы расскажем, как построить поток данных для извлечения текста и метаданных из PDF-файлов, очистки и обработки данных, создания вложений с помощью Amazon Bedrock и индексирования данных в Amazon OpenSearch.

Запустите холст SageMaker

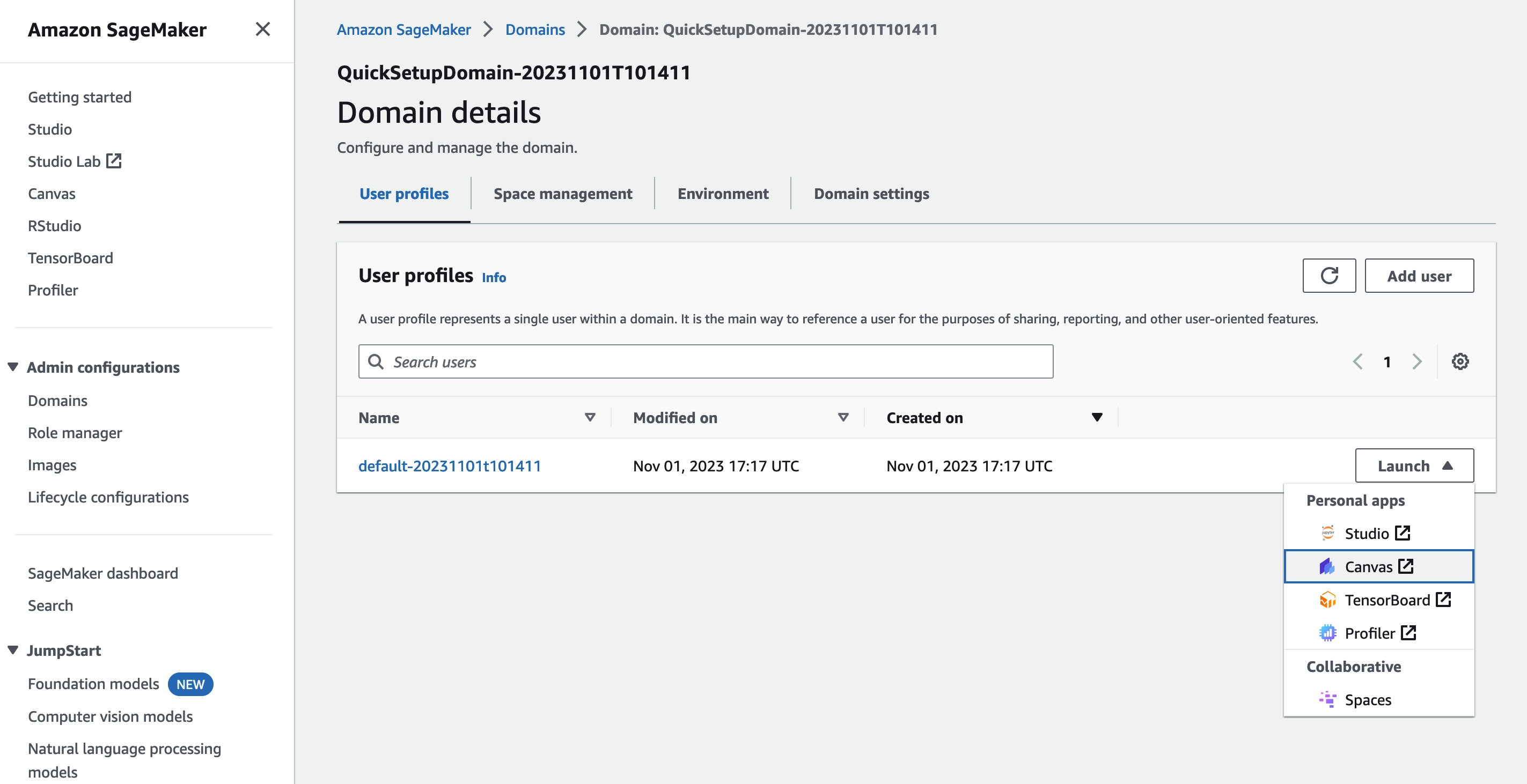

Чтобы запустить SageMaker Canvas, выполните следующие действия:

- На Амазонке Консоль SageMaker, выберите Домены в навигационной панели.

- Выберите свой домен.

- В меню запуска выберите холст.

Создать поток данных

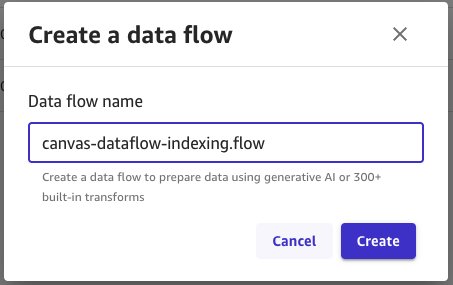

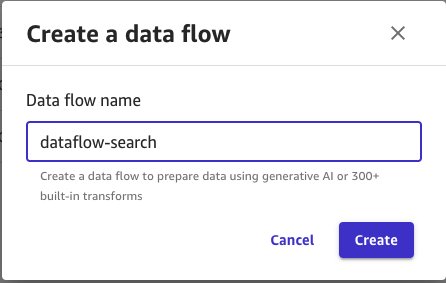

Выполните следующие шаги, чтобы создать поток данных в SageMaker Canvas:

- На домашней странице SageMaker Canvas выберите Обработчик данных.

- Выберите Создавай в правой части страницы, затем укажите имя потока данных и выберите Создавай.

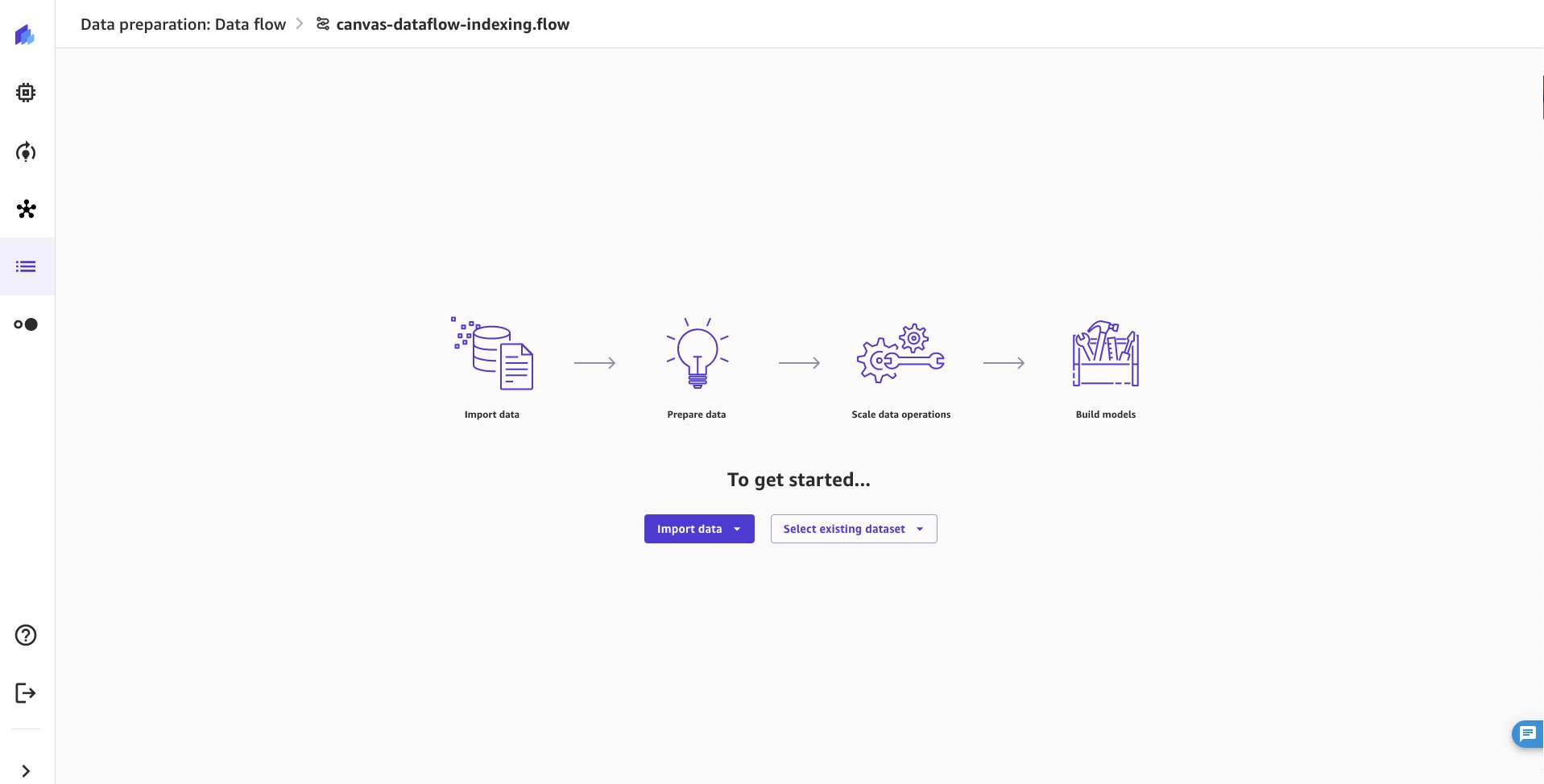

- Это попадет на страницу потока данных.

- Выберите Даты импорта, выберите табличные данные.

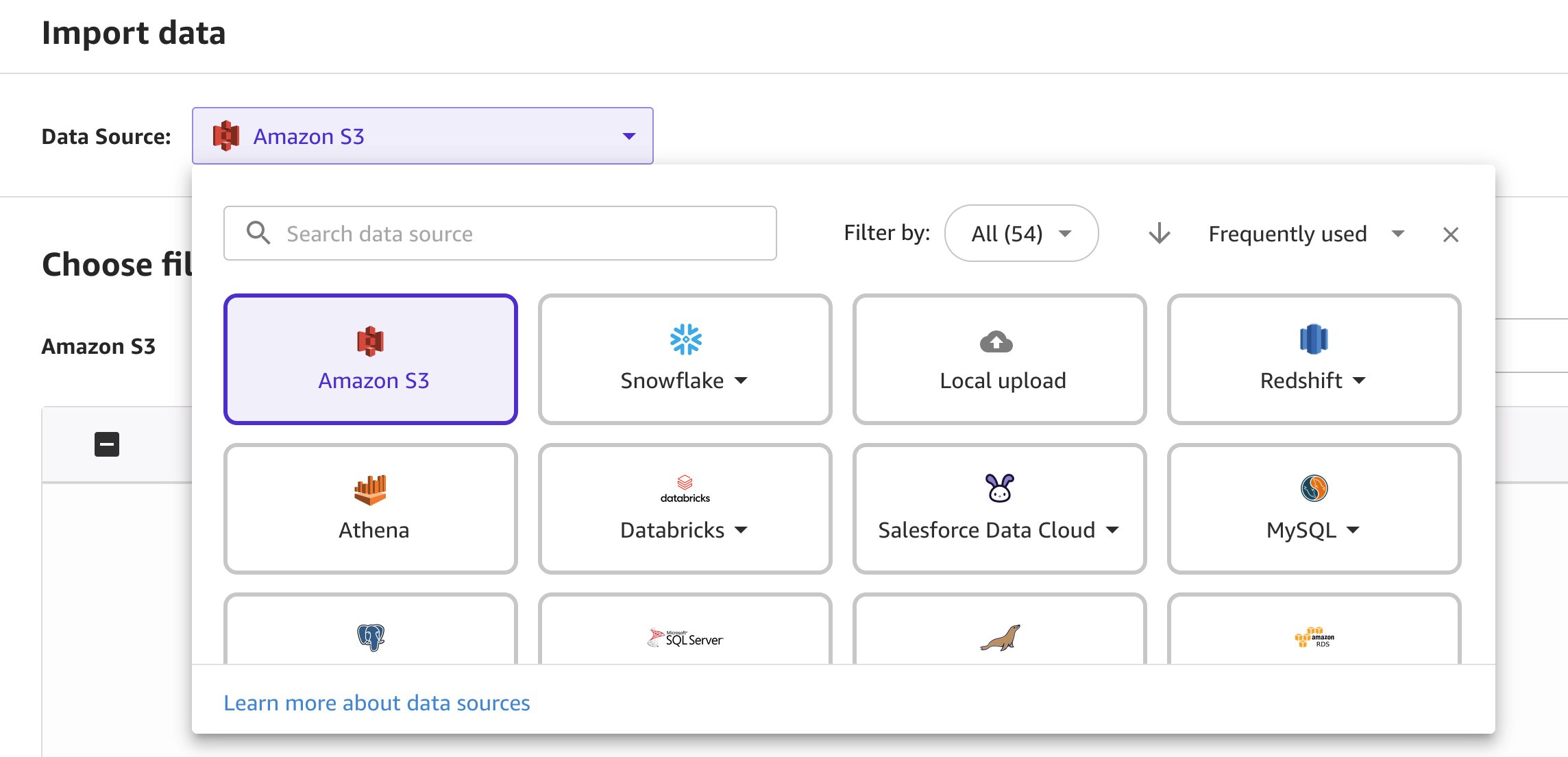

Теперь давайте импортируем данные из корзины Amazon S3:

- Выберите Даты импорта и табличный из раскрывающегося списка.

- Источник данных и Amazon S3 из раскрывающегося списка.

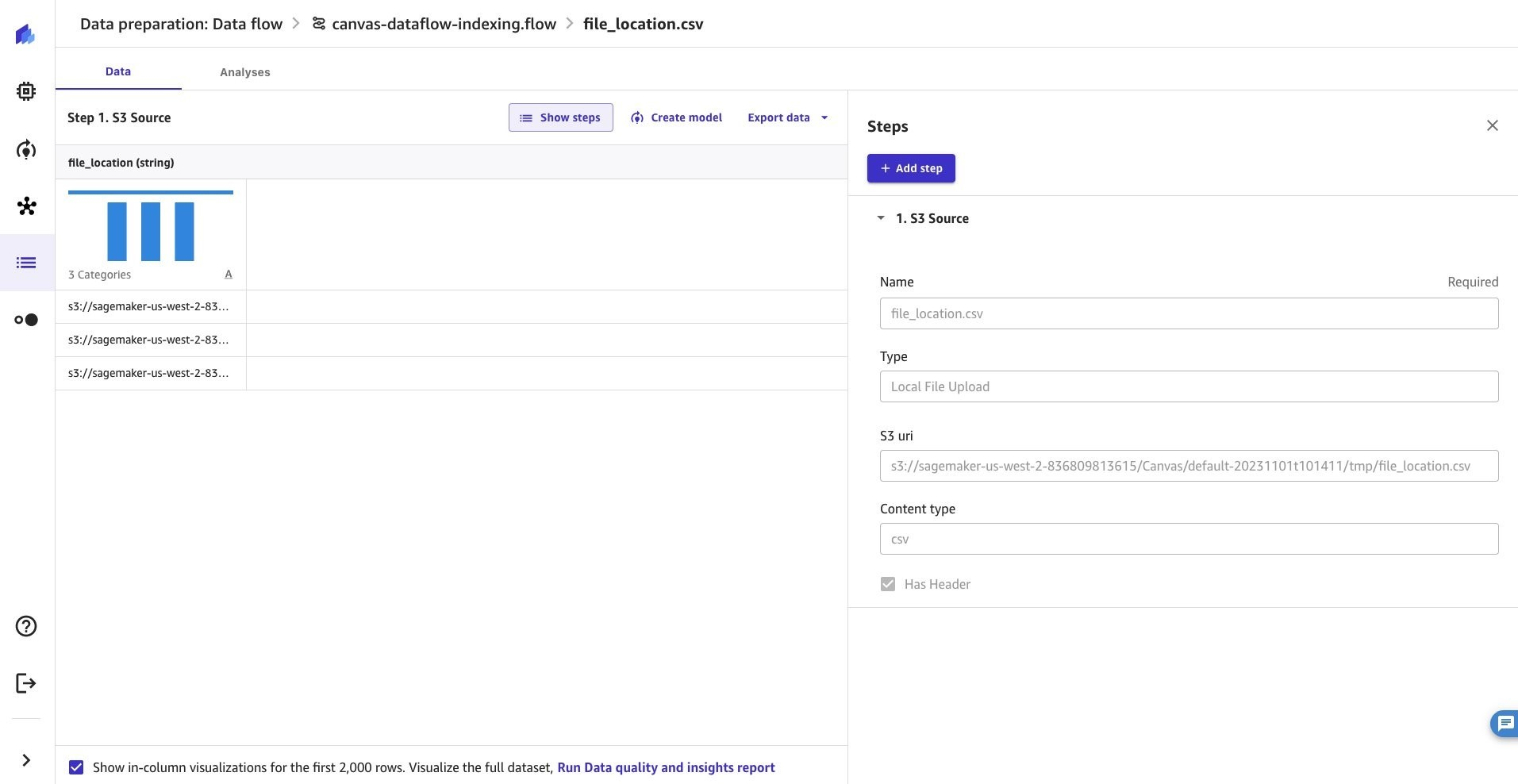

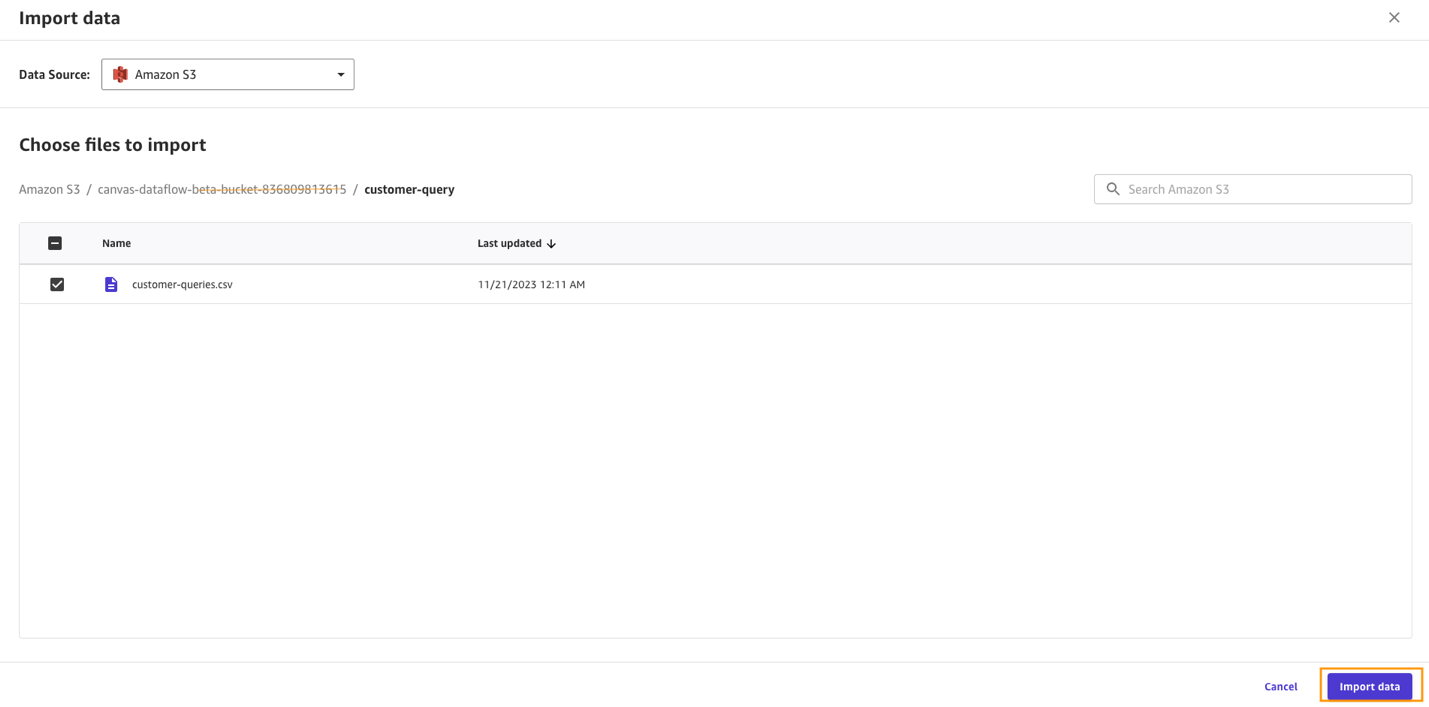

- Перейдите к файлу метаданных с расположением файлов PDF и выберите файл.

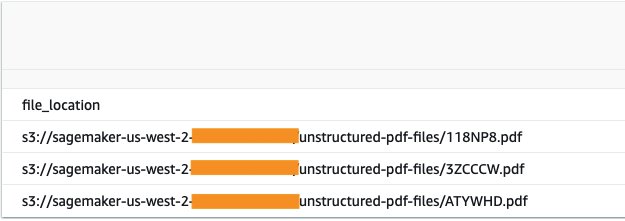

- Теперь файл метаданных загружается в поток данных для подготовки данных, и мы можем приступить к добавлению следующих шагов по преобразованию данных и индекса в Amazon. Открытый поиск. В этом случае файл имеет следующие метаданные с указанием местоположения каждого файла в каталоге Amazon S3.

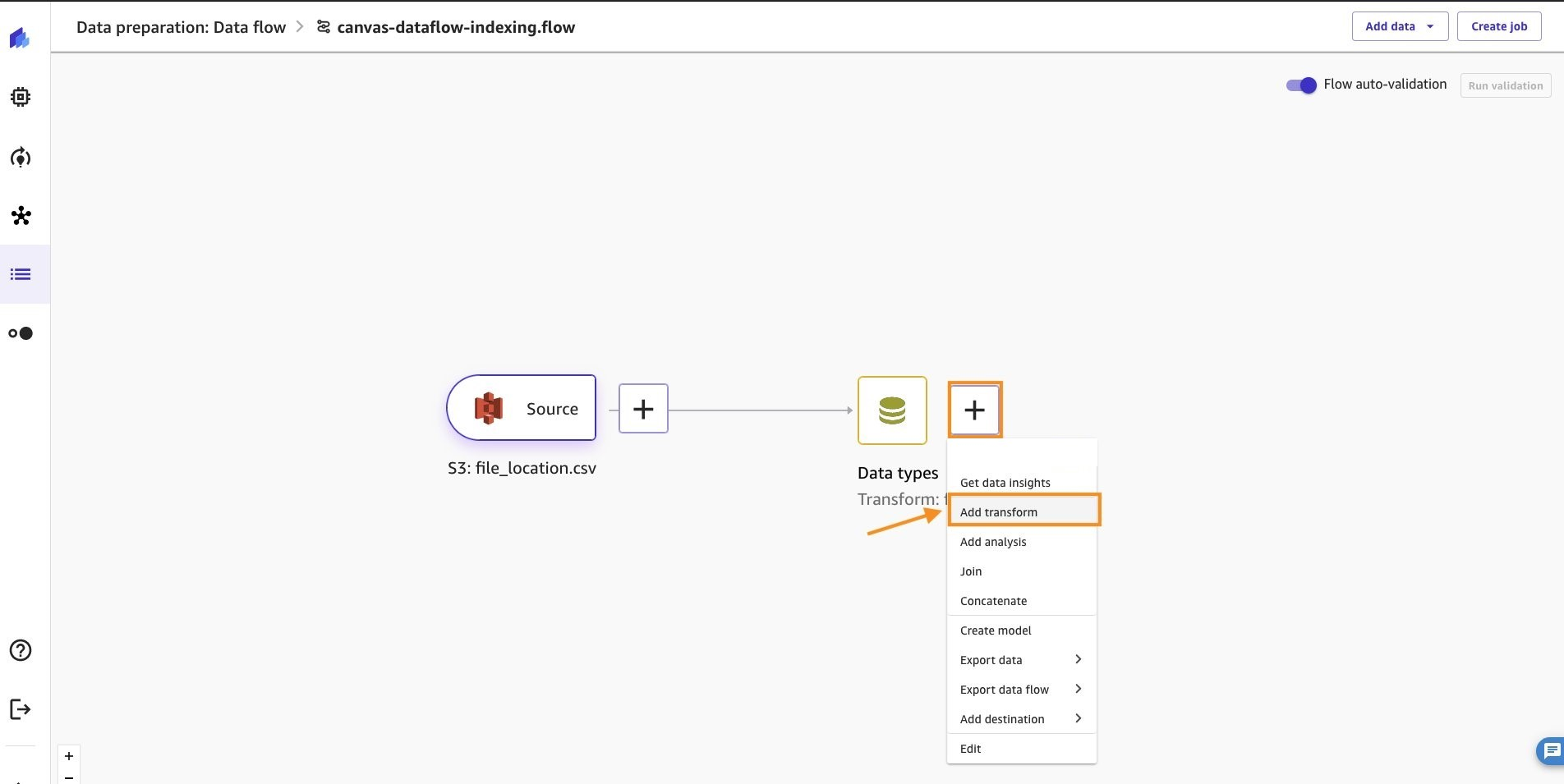

Чтобы добавить новое преобразование, выполните следующие шаги:

- Нажми плюсик и выбери Добавить преобразование.

- Выберите Добавить шаг , а затем выбрать Пользовательское преобразование.

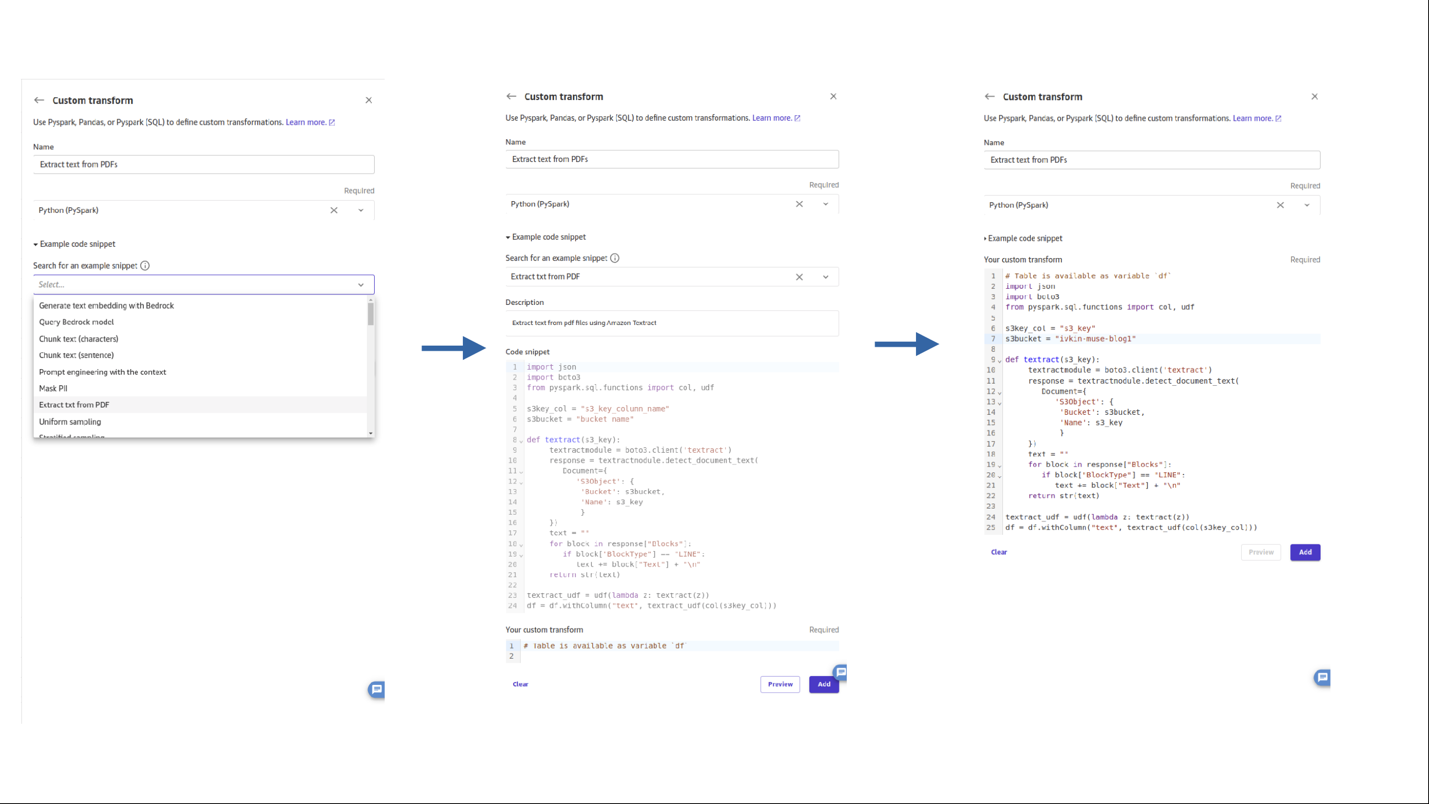

- Вы можете создать собственное преобразование, используя Pandas, PySpark, пользовательские функции Python и SQL PySpark. Выбирать Питон (PySpark) для этого варианта использования.

- Введите имя для шага. В примерах фрагментов кода просмотрите и выберите извлечь текст из пдф. Внесите необходимые изменения во фрагмент кода и выберите Добавить.

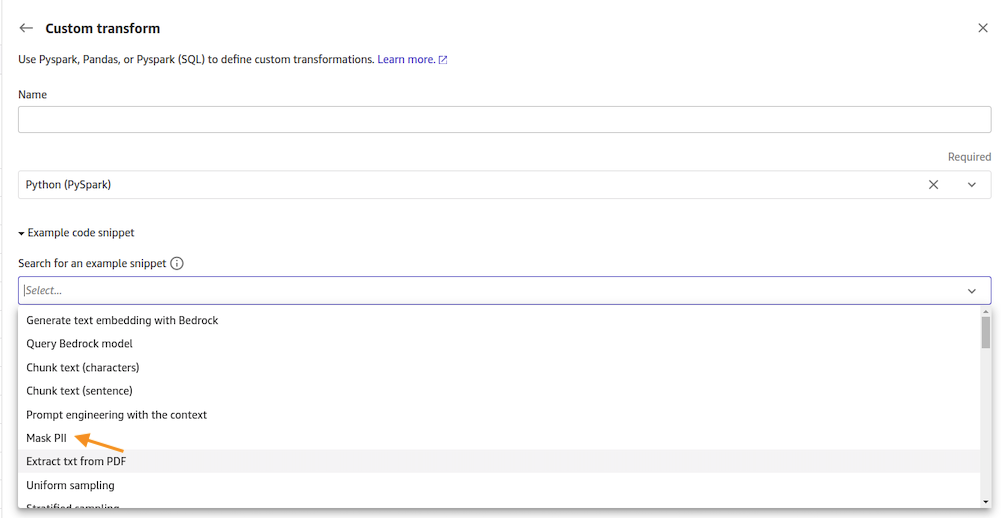

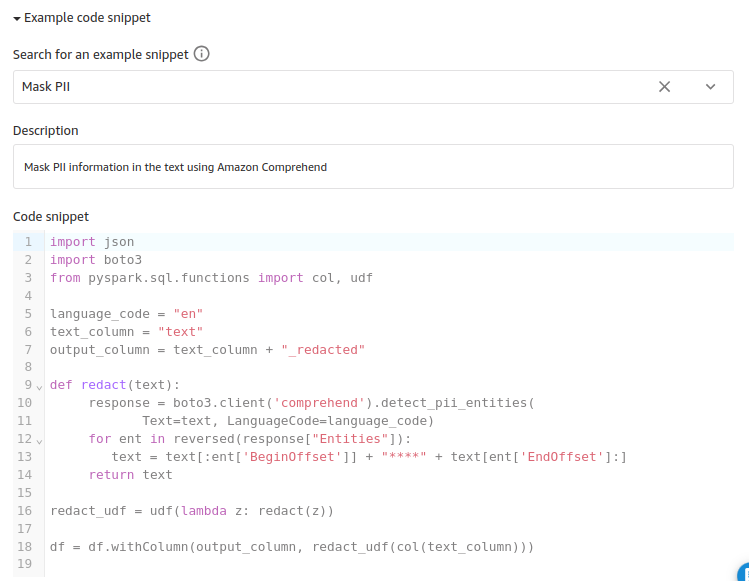

- Давайте добавим шаг для удаления данных личной информации (PII) из извлеченных данных, используя Amazon Comprehend. Выберите Добавить шаг , а затем выбрать Пользовательское преобразование, И выберите Питон (PySpark).

В примерах фрагментов кода просмотрите и выберите маска PII. Внесите необходимые изменения во фрагмент кода и выберите Добавить.

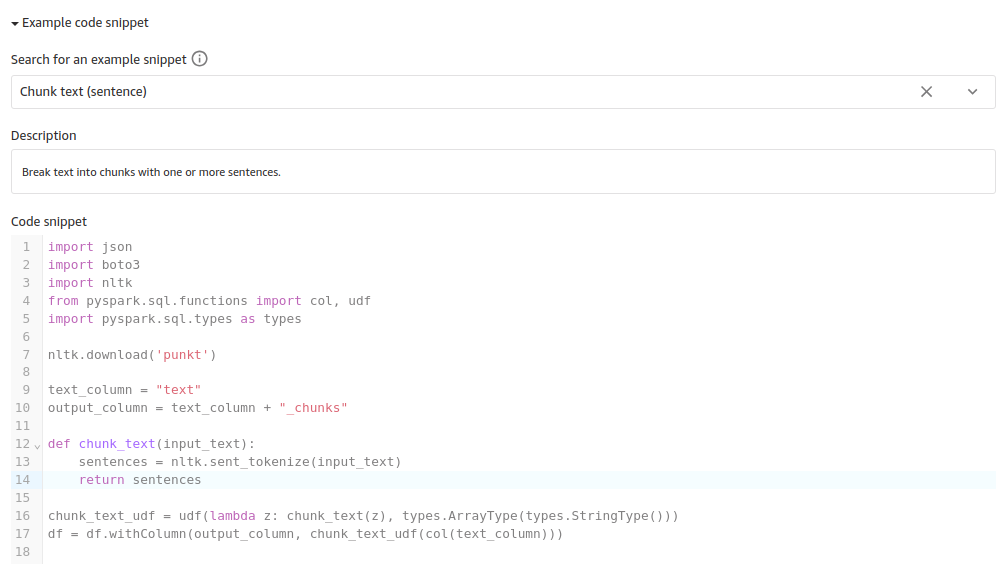

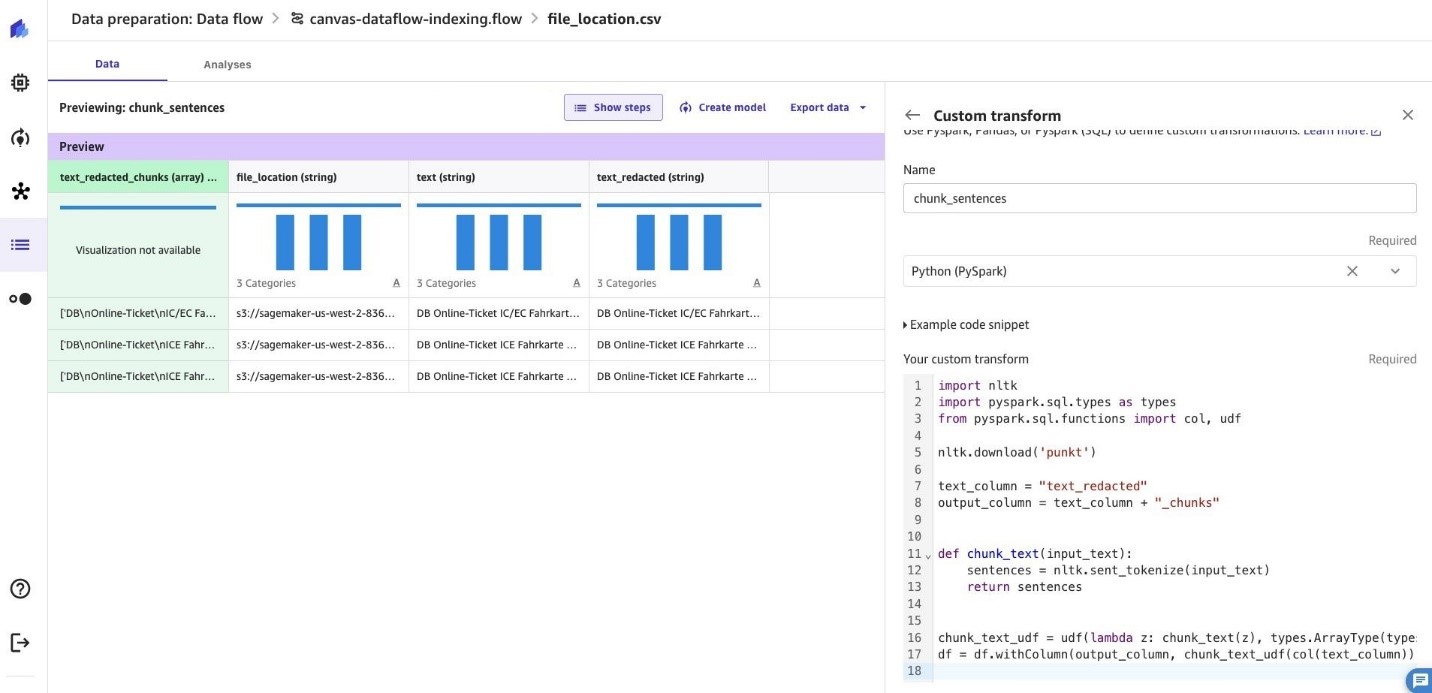

- Следующий шаг — разбить текстовое содержимое на части. Выбирать Добавить шаг , а затем выбрать Пользовательское преобразование, И выберите Питон (PySpark).

В примерах фрагментов кода просмотрите и выберите Кусочек текста. Внесите необходимые изменения во фрагмент кода и выберите Добавить.

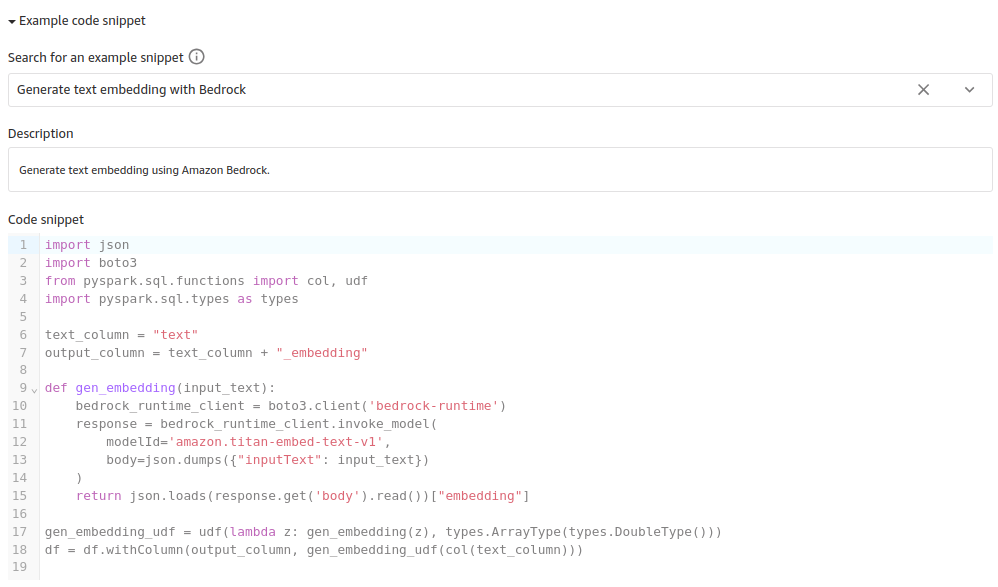

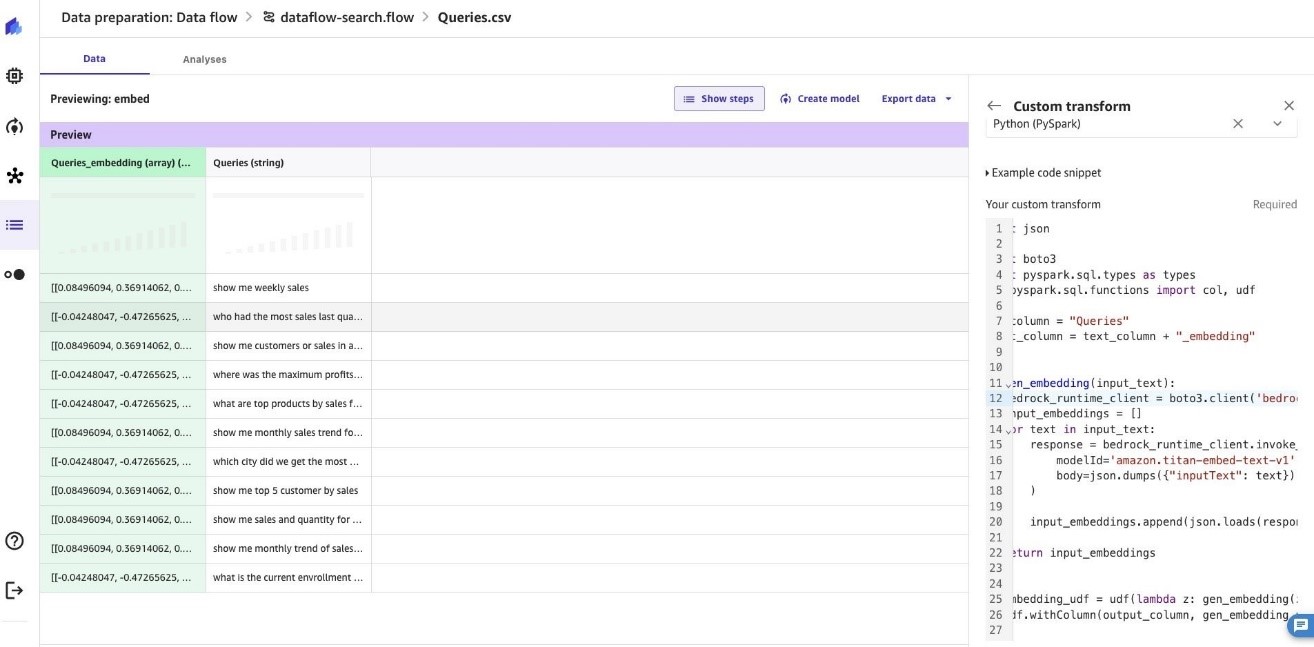

- Давайте преобразуем текстовое содержимое в векторные представления, используя Коренная порода Амазонки Модель Titan Embeddings. Выбирать Добавить шаг , а затем выбрать Пользовательское преобразование, И выберите Питон (PySpark).

В примерах фрагментов кода просмотрите и выберите Создайте встраивание текста с помощью Bedrock. Внесите необходимые изменения во фрагмент кода и выберите Добавить.

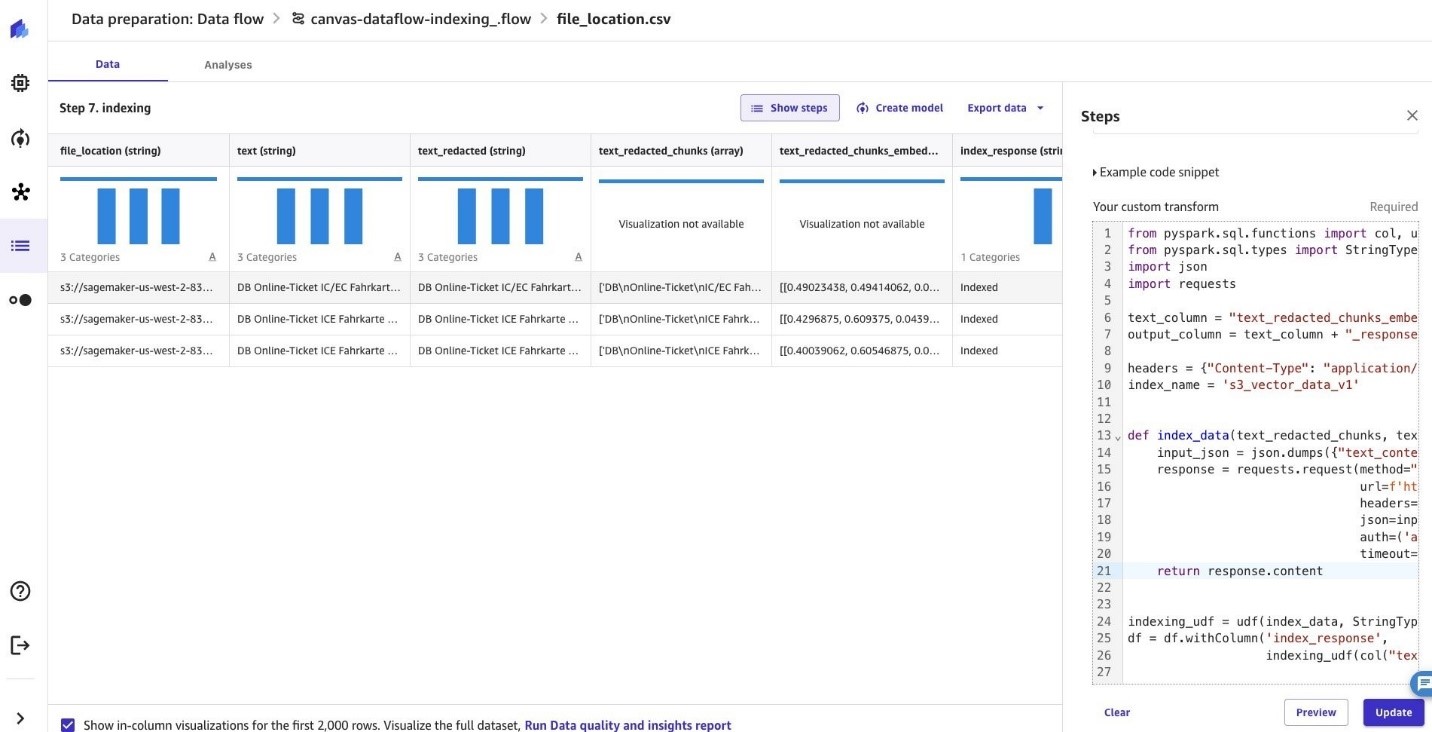

- Теперь у нас есть векторные вложения для содержимого PDF-файла. Давайте продолжим и проиндексируем данные в Amazon OpenSearch. Выбирать Добавить шаг , а затем выбрать Пользовательское преобразование, И выберите Питон (PySpark). Вы можете переписать следующий код, чтобы использовать предпочитаемую вами векторную базу данных. Для простоты мы используем главное имя пользователя и пароль для доступа к API OpenSearch. Для производственных рабочих нагрузок выберите вариант в соответствии с политикой вашей организации.

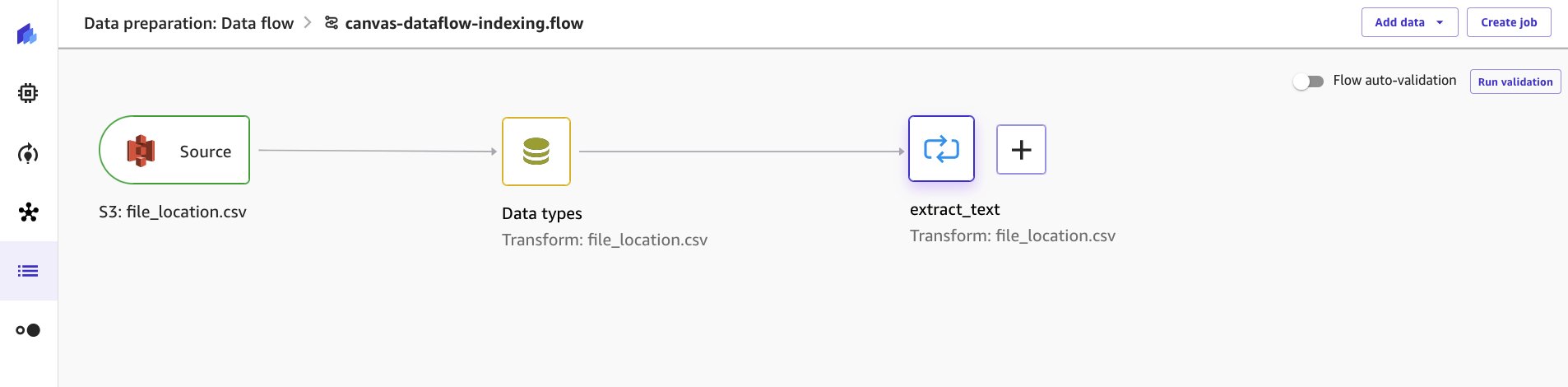

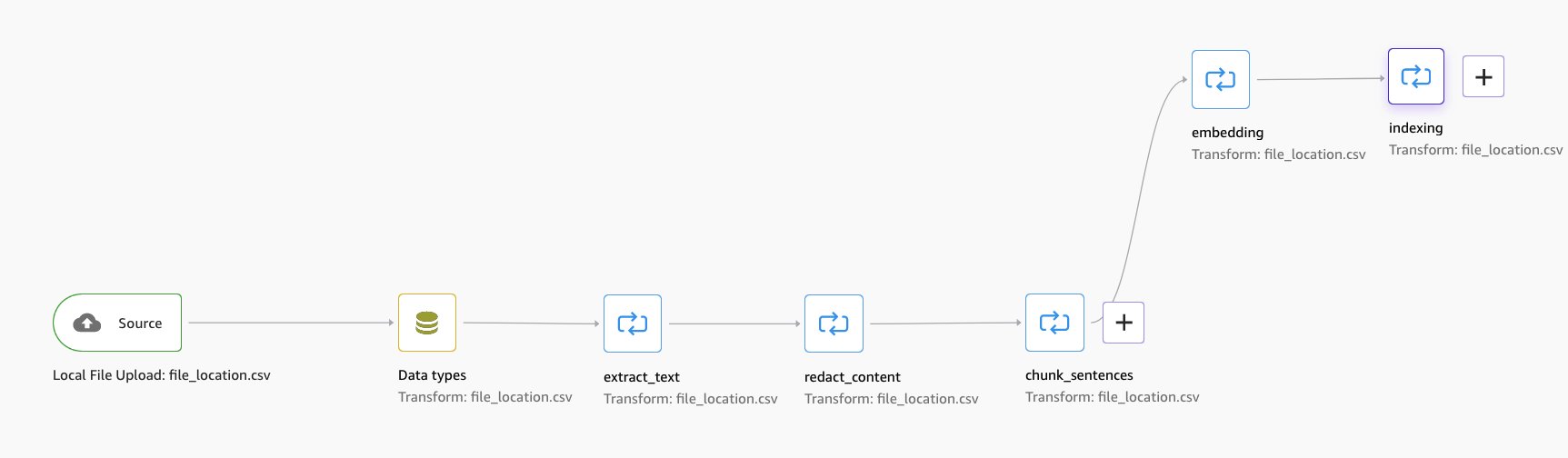

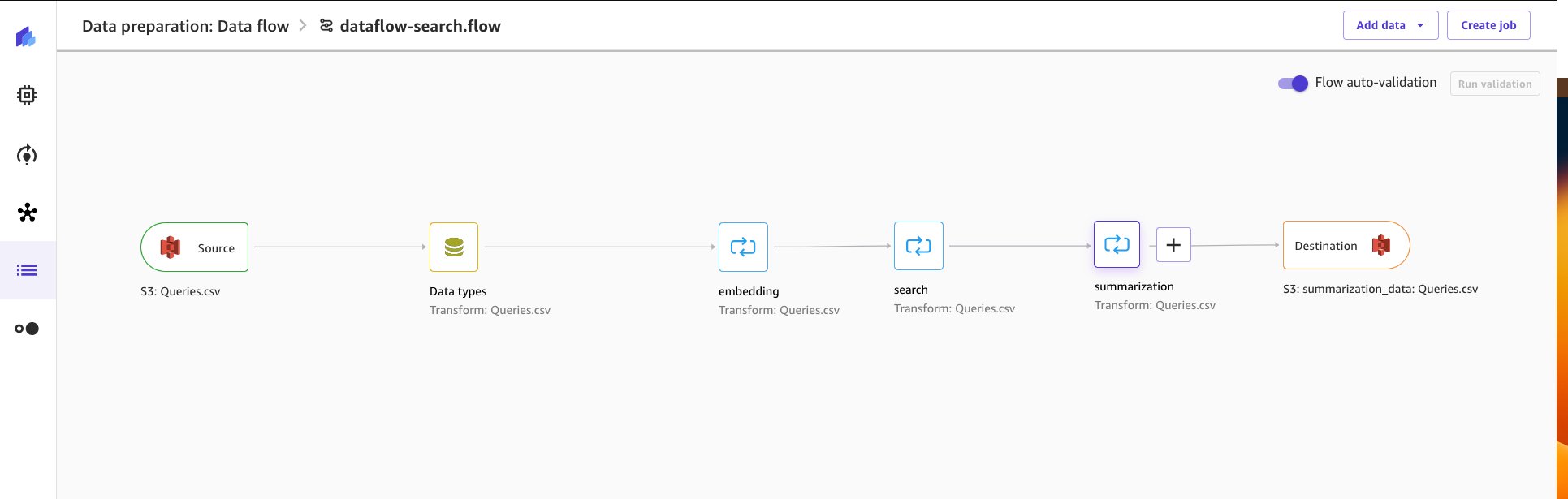

Наконец, созданный поток данных будет следующим:

С помощью этого потока данных данные из PDF-файла считываются и индексируются с помощью векторных вложений в Amazon OpenSearch. Теперь пришло время создать файл с запросами для запроса индексированных данных и сохранить его в хранилище Amazon S3. Мы направим наш поток данных поиска на файл и выведем файл с соответствующими результатами в новом файле в расположении Amazon S3.

Подготовка приглашения

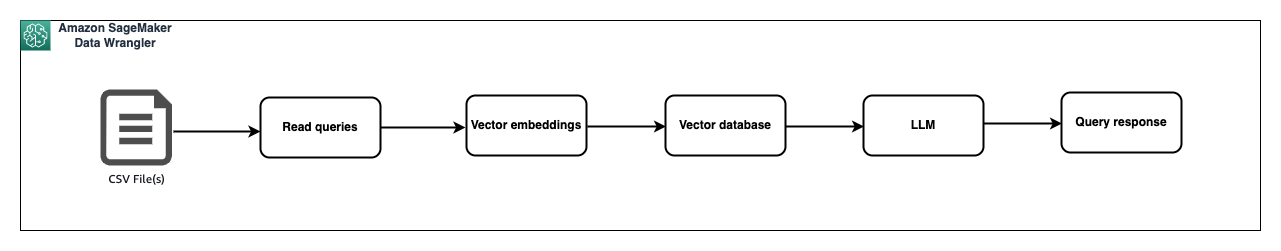

После того, как мы создадим базу знаний из нашего PDF-файла, мы можем протестировать ее, выполнив поиск в базе знаний по нескольким примерным запросам. Мы будем обрабатывать каждый запрос следующим образом:

- Создание встраивания для запроса (на базе Amazon Bedrock)

- База данных векторов запросов для контекста ближайшего соседа (на базе Amazon OpenSearch)

- Объедините запрос и контекст в подсказку.

- Запрос LLM с помощью подсказки (на базе Amazon Bedrock)

- На домашней странице SageMaker Canvas выберите Подготовка данных.

- Выберите Создавай в правой части страницы, затем укажите имя потока данных и выберите Создавай.

Теперь давайте загрузим вопросы пользователя, а затем создадим подсказку, объединив вопрос и аналогичные документы. Это приглашение предоставляется LLM для генерации ответа на вопрос пользователя.

- Давайте загрузим CSV-файл с вопросами пользователей. Выбирать Импортировать данные и табличный из раскрывающегося списка.

- Источник данных, и Amazon S3 из раскрывающегося списка. Альтернативно вы можете загрузить файл с запросами пользователей.

- Давайте добавим пользовательское преобразование для преобразования данных в векторные внедрения с последующим поиском связанных внедрений из Amazon OpenSearch перед отправкой запроса в Amazon Bedrock с запросом и контекстом из базы знаний. Чтобы создать внедрения для запроса, вы можете использовать тот же фрагмент кода примера. Создание встраивания текста с помощью Bedrock упомянуто в шаге №7 выше.

Давайте вызовем API Amazon OpenSearch для поиска соответствующих документов на предмет сгенерированных векторных вложений. Добавьте собственное преобразование с помощью Python (PySpark).

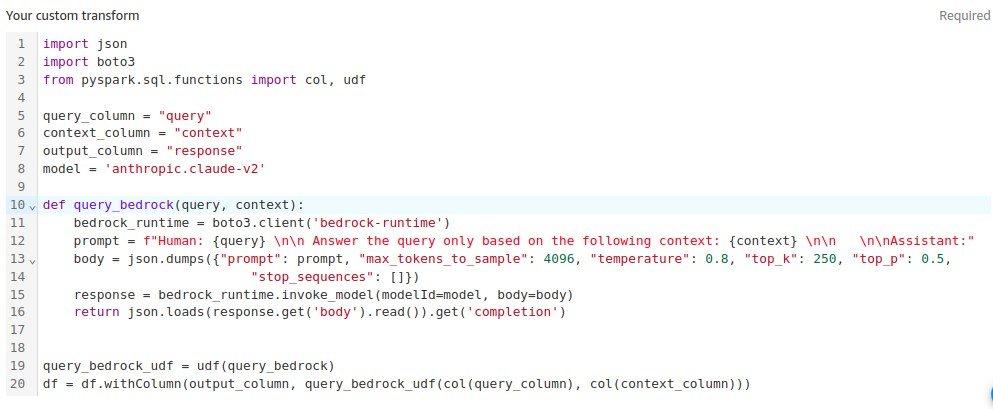

Давайте добавим пользовательское преобразование для вызова API Amazon Bedrock для ответа на запрос, передавая документы из базы знаний Amazon OpenSearch. В примерах фрагментов кода просмотрите и выберите Запрос Bedrock с контекстом. Внесите необходимые изменения во фрагмент кода и выберите Добавить.

Вкратце, поток данных ответов на вопросы на основе RAG выглядит следующим образом:

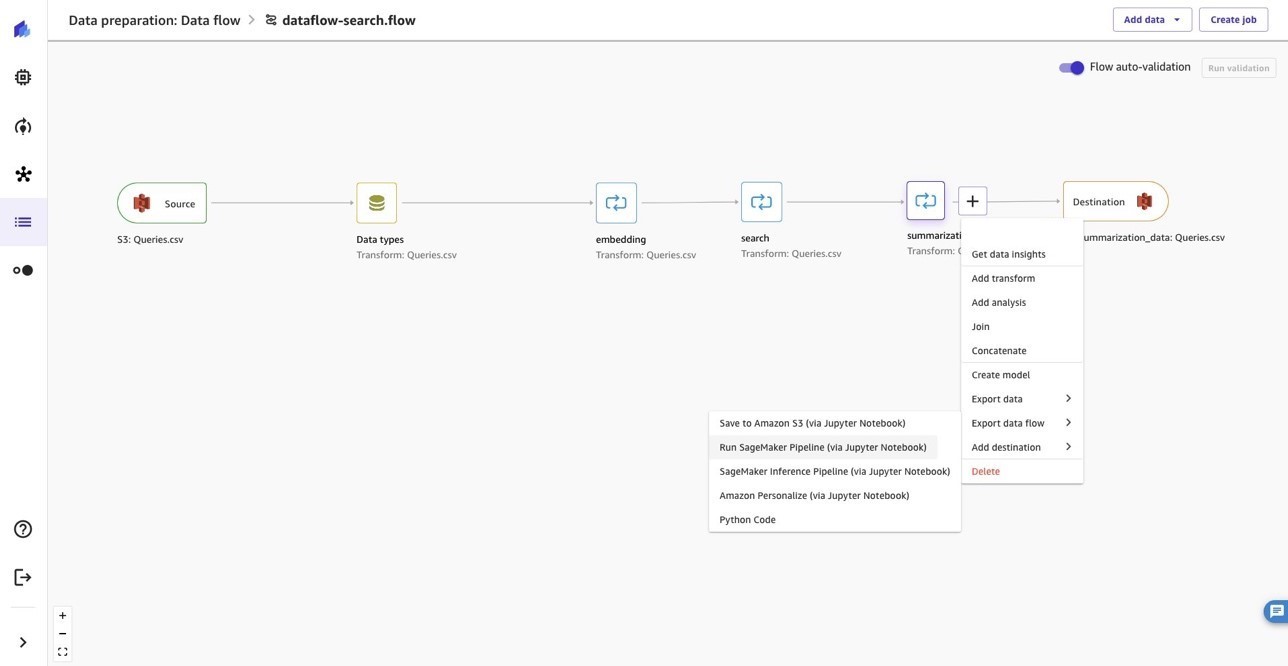

Специалисты по машинному обучению тратят много времени на разработку кода проектирования функций, применение его к своим исходным наборам данных, обучение моделей на основе спроектированных наборов данных и оценку точности модели. Учитывая экспериментальный характер этой работы, даже самый маленький проект приводит к множеству итераций. Один и тот же код разработки функций часто запускается снова и снова, тратя время и вычислительные ресурсы на повторение одних и тех же операций. В крупных организациях это может привести к еще большей потере производительности, поскольку разные команды часто выполняют одинаковые задания или даже пишут дублирующийся код разработки функций, поскольку у них нет знаний о предыдущей работе. Чтобы избежать повторной обработки функций, мы экспортируем наш поток данных на Amazon. Конвейер SageMaker. Давайте выберем Кнопка + справа от запроса. Выберите поток данных экспорта и выберите Запуск конвейера SageMaker (через блокнот Jupyter).

Убираться

Чтобы избежать будущих расходов, удалите или закройте ресурсы, созданные вами во время подписки на этот пост. Ссылаться на Выход из Amazon SageMaker Canvas Больше подробностей.

Заключение

В этом посте мы показали вам, как можно использовать комплексные возможности Amazon SageMaker Canvas, взяв на себя роль специалиста по обработке данных, готовящего данные для LLM. Интерактивная подготовка данных позволила быстро очистить, преобразовать и проанализировать данные для разработки информативных функций. Устранив сложности кодирования, SageMaker Canvas позволил быстро выполнить итерацию для создания высококачественного набора обучающих данных. Этот ускоренный рабочий процесс привел непосредственно к созданию, обучению и развертыванию эффективной модели машинного обучения для повышения эффективности бизнеса. Благодаря комплексной подготовке данных и унифицированному опыту от данных до аналитики, SageMaker Canvas дает пользователям возможность улучшить результаты машинного обучения.

Мы рекомендуем вам узнать больше, изучив Обработчик данных Amazon SageMaker, Холст Amazon SageMaker, Амазонка Титан модели, Коренная порода Амазонки, и Amazon Служба открытого поиска чтобы создать решение, используя пример реализации, представленный в этом посте, и набор данных, соответствующий вашему бизнесу. Если у вас есть вопросы или предложения, пожалуйста, оставьте комментарий.

Об авторах

Аджай Говиндарам является старшим архитектором решений в AWS. Он работает со стратегическими клиентами, которые используют AI/ML для решения сложных бизнес-задач. Его опыт заключается в обеспечении технического руководства, а также помощи в проектировании развертывания приложений AI/ML от скромных до крупномасштабных. Его знания варьируются от архитектуры приложений до больших данных, аналитики и машинного обучения. Ему нравится слушать музыку во время отдыха, отдыхать на свежем воздухе и проводить время со своими близкими.

Аджай Говиндарам является старшим архитектором решений в AWS. Он работает со стратегическими клиентами, которые используют AI/ML для решения сложных бизнес-задач. Его опыт заключается в обеспечении технического руководства, а также помощи в проектировании развертывания приложений AI/ML от скромных до крупномасштабных. Его знания варьируются от архитектуры приложений до больших данных, аналитики и машинного обучения. Ему нравится слушать музыку во время отдыха, отдыхать на свежем воздухе и проводить время со своими близкими.

Никита Ивкин является старшим научным сотрудником в Amazon SageMaker Data Wrangler и интересуется машинным обучением и алгоритмами очистки данных.

Никита Ивкин является старшим научным сотрудником в Amazon SageMaker Data Wrangler и интересуется машинным обучением и алгоритмами очистки данных.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :имеет

- :является

- :нет

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- в состоянии

- О нас

- выше

- ускорять

- ускоренный

- доступ

- По

- Учетные записи

- точность

- Добавить

- дополнительный

- Принятие

- авансы

- плюс

- Преимущества

- После

- снова

- совокупный

- впереди

- AI

- AI / ML

- алгоритмы

- Выравнивает

- Все

- разрешено

- причислены

- Amazon

- Создатель мудреца Амазонки

- Обработчик данных Amazon SageMaker

- Amazon Web Services

- суммы

- an

- Анализ

- аналитика

- анализ

- и

- ответ

- любой

- API

- Применение

- прикладной

- Применение

- архитектура

- МЫ

- искусственный

- искусственный интеллект

- AS

- Помощь

- At

- прикреплять

- аудио

- дополненная

- доступен

- избежать

- AWS

- Использование темпера с изогнутым основанием

- основанный

- BE

- , так как:

- становится

- было

- до

- не являетесь

- Лучшая

- пристрастный

- большой

- Big Data

- строить

- Строительство

- встроенный

- бизнес

- бизнес

- кнопка

- by

- призывают

- CAN

- холст

- возможности

- случаев

- Вызывать

- изменения

- расходы

- Выберите

- чистым

- Уборка

- код

- Кодирование

- комбинируя

- комментарий

- Компании

- сравненный

- конкурентоспособный

- полный

- комплекс

- сложности

- постигать

- комплексный

- Вычисление

- Рассматривать

- Консоли

- содержать

- содержит

- содержание

- содержание

- контекст

- контексты

- продолжается

- контроль

- конвертировать

- соответствующий

- может

- чехол для варгана

- Создайте

- создали

- критической

- изготовленный на заказ

- клиент

- Служба поддержки игроков

- Клиенты

- данным

- Подготовка данных

- База данных

- Наборы данных

- Делойта

- убивают

- развертывание

- развертывания

- Проект

- подробнее

- развивающийся

- различный

- трудный

- Размеры

- направление

- непосредственно

- обнаружить

- do

- документ

- документации

- Документация

- домен

- доменов

- вниз

- в течение

- e

- каждый

- легко

- фактически

- эффективный

- эффективно

- Писем

- вложения

- Наделяет

- включен

- позволяет

- поощрять

- впритык

- инженер

- инженерии

- Проект и

- оценки

- Даже

- пример

- существует

- опыт

- испытывающих

- экспериментальный

- Больше

- Исследование

- экспорт

- извлечение

- Особенность

- Особенности

- несколько

- Поля

- Файл

- фильтр

- окончательный

- Найдите

- поток

- следует

- после

- следующим образом

- Что касается

- Forbes

- Год основания

- Устои

- Бесплатно

- от

- полный

- Функции

- далее

- будущее

- Gain

- порождать

- генерируется

- порождающий

- поколение

- генеративный

- Генеративный ИИ

- получить

- Дайте

- данный

- Глобальный

- Go

- цель

- хорошо

- большой

- Есть

- he

- Заголовки

- высококачественный

- его

- имеет

- Главная

- Как

- How To

- Однако

- HTML

- HTTPS

- i

- идентичный

- if

- изображений

- Влияние

- реализация

- Импортировать

- важную

- впечатляющий

- улучшать

- in

- включает в себя

- индекс

- индексированный

- информация

- информативный

- начальный

- размышления

- инструкции

- интеграции.

- Интеллекта

- интерактивный

- интересы

- Интерфейс

- Интернет

- в

- включать в себя

- IT

- итерация

- итерации

- ЕГО

- Джобс

- JPG

- JSON

- знания

- Земля

- язык

- большой

- крупномасштабный

- запуск

- Лиды

- УЧИТЬСЯ

- изучение

- Оставлять

- привело

- Используя

- лежит

- такое как

- Список

- Listening

- LLM

- загрузка

- расположение

- места

- от

- серия

- любимый

- Низкий

- машина

- обучение с помощью машины

- Главная

- сделать

- ДЕЛАЕТ

- маска

- массивный

- мастер

- Май..

- механизмы

- Медиа

- Меню

- Мета

- Метаданные

- ML

- модель

- Модели

- скромный

- БОЛЕЕ

- самых

- с разными

- Музыка

- имя

- натуральный

- Обработка естественного языка

- природа

- Навигация

- необходимо

- Необходимость

- Новые

- следующий

- нет

- ноутбук

- сейчас

- of

- .

- on

- консолидировать

- те,

- только

- Операционный отдел

- Опция

- or

- организация

- организации

- Другое

- наши

- внешний

- Результаты

- на открытом воздухе

- выходной

- за

- страница

- панд

- хлеб

- Прохождение

- Пароль

- производительность

- личного

- выбирать

- кусок

- штук

- трубопровод

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- пожалуйста

- плюс

- Точка

- сборах

- После

- потенциал

- Питание

- привилегированный

- подготовка

- Подготовить

- подготовка

- Предварительный

- вероятно

- Проблема

- проблемам

- продолжить

- процесс

- обработка

- Производство

- производительность

- профессиональный

- Проект

- свойства

- при условии

- приводит

- обеспечение

- Питон

- Запросы

- вопрос

- Вопросы

- быстро

- диапазоны

- быстро

- рейтинги

- достигать

- Читать

- реальный мир

- получила

- относиться

- Связанный

- соответствующие

- удаление

- Сообщается

- Запросы

- требовать

- требуется

- Полезные ресурсы

- ответ

- ответы

- отдыха

- Итоги

- возвращают

- Отзывы

- правую

- Роли

- Run

- sagemaker

- то же

- Сохранить

- Ученый

- Поиск

- поиск

- Раздел

- видел

- выберите

- отправка

- старший

- чувствительный

- обслуживание

- Услуги

- настройки

- должен

- показывать

- показал

- закрывать

- выключать

- сторона

- подпись

- значительный

- аналогичный

- простота

- упростить

- Размер

- отрывок

- So

- Соцсети

- социальные сети

- Решение

- Решения

- РЕШАТЬ

- некоторые

- Источник

- Источники

- конкретный

- конкретно

- тратить

- Расходы

- Этап

- этапы

- Шаг

- Шаги

- По-прежнему

- Стратегический

- структурированный

- РЕЗЮМЕ

- Поддержка

- Опрос

- взять

- команды

- Технический

- снижения вреда

- тестXNUMX

- текст

- который

- Ассоциация

- Будущее

- их

- Их

- тогда

- Там.

- Эти

- они

- этой

- Таким образом

- время

- исполин

- в

- сегодня

- инструменты

- Обучение

- Transform

- трансформация

- преобразований

- превращение

- правда

- сокращение

- напишите

- Типы

- унифицированный

- us

- использование

- используемый

- Информация о пользователе

- пользователей

- через

- ценный

- с помощью

- Видео

- визуальный

- прохождение

- we

- Web

- веб-сервисы

- ЧТО Ж

- который

- в то время как

- КТО

- будете

- Работа

- рабочий

- работает

- бы

- записывать

- Ты

- ВАШЕ

- зефирнет