ЗОО Цифровой предоставляет комплексные услуги локализации и мультимедиа для адаптации оригинального телевизионного и киноконтента к различным языкам, регионам и культурам. Это облегчает глобализацию для лучших в мире создателей контента. ZOO Digital, которому доверяют крупнейшие компании в сфере развлечений, предоставляет высококачественную локализацию и медиа-услуги в любом масштабе, включая дублирование, создание субтитров, создание сценариев и соблюдение нормативных требований.

Типичные рабочие процессы локализации требуют ручной диаризации говорящего, при которой аудиопоток сегментируется на основе личности говорящего. Этот трудоемкий процесс необходимо завершить, прежде чем контент можно будет дублировать на другой язык. При использовании ручных методов локализация 30-минутного эпизода может занять от 1 до 3 часов. Благодаря автоматизации ZOO Digital стремится добиться локализации менее чем за 30 минут.

В этом посте мы обсуждаем развертывание масштабируемых моделей машинного обучения (ML) для ведения дневника медиаконтента с использованием Создатель мудреца Амазонки, с акцентом на ШепотX модели.

проверка данных

Цель ZOO Digital — обеспечить более быструю обработку локализованного контента. Достижение этой цели затруднено из-за интенсивного ручного труда, который усугубляется небольшим штатом квалифицированных специалистов, которые могут локализовать контент вручную. ZOO Digital работает с более чем 11,000 600 фрилансеров и только за 2022 год локализовал более XNUMX миллионов слов. Однако растущий спрос на контент опережает предложение квалифицированных специалистов, что требует автоматизации для облегчения рабочих процессов локализации.

Стремясь ускорить локализацию рабочих процессов с контентом посредством машинного обучения, ZOO Digital задействовала AWS Prototyping, инвестиционную программу AWS для совместной разработки рабочих нагрузок с клиентами. Целью сотрудничества было предоставление функционального решения для процесса локализации, а также практическое обучение разработчиков ZOO Digital работе с SageMaker. Amazon транскрибироватьи Amazon Translate.

Задача клиента

После расшифровки названия (фильма или эпизода телесериала) каждому сегменту речи необходимо назначить говорящих, чтобы их можно было правильно назначить исполнителям озвучивания, которые будут играть персонажей. Этот процесс называется диаризацией спикеров. ZOO Digital сталкивается с проблемой масштабного дневникирования контента, оставаясь при этом экономически жизнеспособным.

Обзор решения

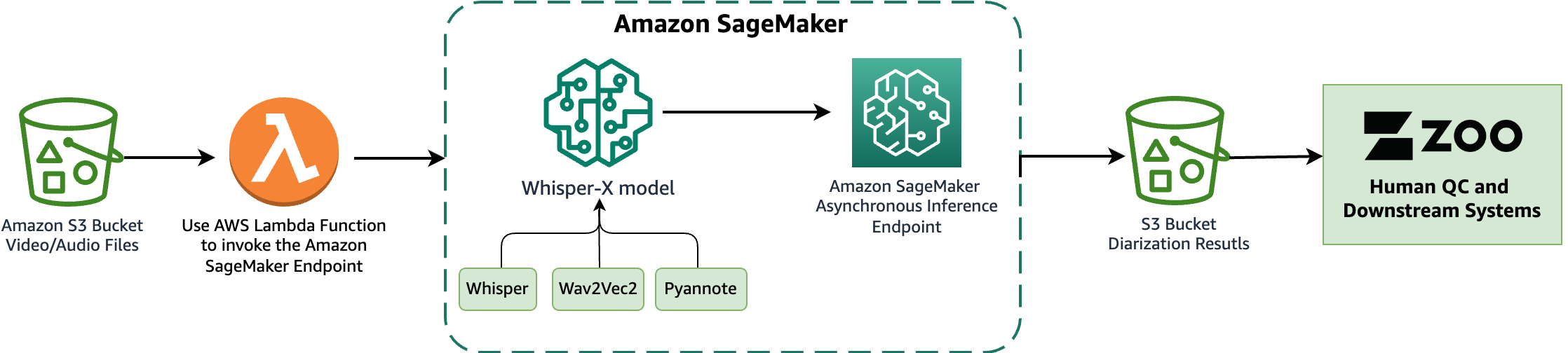

В этом прототипе мы сохранили исходные медиафайлы в указанном Простой сервис хранения Amazon (Amazon S3) ведро. Эта корзина S3 была настроена на отправку события при обнаружении в ней новых файлов, вызывая AWS Lambda функция. Инструкции по настройке этого триггера см. в руководстве. Использование триггера Amazon S3 для вызова функции Lambda. Впоследствии функция Lambda вызвала конечную точку SageMaker для вывода, используя метод Клиент времени выполнения Boto3 SageMaker.

Ассоциация ШепотX модель, основанная на Шепот OpenAI, выполняет транскрипцию и дневникизацию медиа-активов. Он построен на Быстрый шепот повторная реализация, обеспечивающая до четырех раз более быструю транскрипцию с улучшенным выравниванием временных меток на уровне слов по сравнению с Whisper. Кроме того, он вводит диаризацию говорящего, отсутствующую в исходной модели Whisper. WhisperX использует модель Whisper для транскрипции, Wav2Vec2 модель для улучшения выравнивания временных меток (обеспечивающая синхронизацию расшифрованного текста с временными метками аудио), а также пианнота модель для дневникизации. FFmpeg используется для загрузки аудио с исходного носителя, поддерживая различные медиаформаты. Прозрачная и модульная архитектура модели обеспечивает гибкость, поскольку каждый компонент модели можно заменять по мере необходимости в будущем. Однако важно отметить, что WhisperX не имеет полных функций управления и не является продуктом корпоративного уровня. Без обслуживания и поддержки он может оказаться непригодным для промышленного развертывания.

В рамках этого сотрудничества мы развернули и оценили WhisperX на SageMaker, используя конечная точка асинхронного вывода для размещения модели. Асинхронные конечные точки SageMaker поддерживают размеры загрузки до 1 ГБ и включают функции автоматического масштабирования, которые эффективно смягчают всплески трафика и сокращают расходы в непиковое время. Асинхронные конечные точки особенно хорошо подходят для обработки больших файлов, таких как фильмы и сериалы в нашем случае.

Следующая диаграмма иллюстрирует основные элементы экспериментов, которые мы провели в рамках этого сотрудничества.

В следующих разделах мы углубимся в детали развертывания модели WhisperX в SageMaker и оценим производительность диаризации.

Скачать модель и ее компоненты

WhisperX — это система, которая включает в себя несколько моделей транскрипции, принудительного выравнивания и диаризации. Для бесперебойной работы SageMaker без необходимости получения артефактов модели во время вывода важно предварительно загрузить все артефакты модели. Эти артефакты затем загружаются в обслуживающий контейнер SageMaker во время инициализации. Поскольку эти модели недоступны напрямую, мы предлагаем описания и примеры кода из источника WhisperX, а также инструкции по загрузке модели и ее компонентов.

WhisperX использует шесть моделей:

Большинство этих моделей можно получить на сайте Обнимая лицо используя библиотекуhuggingface_hub. Мы используем следующие download_hf_model() функция для получения этих артефактов модели. Требуется токен доступа от Hugging Face, созданный после принятия пользовательских соглашений для следующих моделей pyannote:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

Модель VAD извлекается из Amazon S3, а модель Wav2Vec2 — из модуля torchaudio.pipelines. Основываясь на следующем коде, мы можем получить все артефакты моделей, в том числе из Hugging Face, и сохранить их в указанном локальном каталоге модели:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

Выберите подходящий контейнер AWS Deep Learning для обслуживания модели.

После сохранения артефактов модели с использованием предыдущего примера кода вы можете выбрать предварительно созданные Контейнеры глубокого обучения AWS (DLC) из следующих Репо GitHub. При выборе образа Docker учитывайте следующие параметры: платформа (Hugging Face), задача (вывод), версия Python и оборудование (например, графический процессор). Мы рекомендуем использовать следующее изображение: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 В этом образе предустановлены все необходимые системные пакеты, например ffmpeg. Не забудьте заменить [REGION] на регион AWS, который вы используете.

Для других необходимых пакетов Python создайте requirements.txt файл со списком пакетов и их версий. Эти пакеты будут установлены при сборке AWS DLC. Ниже приведены дополнительные пакеты, необходимые для размещения модели WhisperX в SageMaker:

Создайте сценарий вывода для загрузки моделей и выполнения вывода.

Далее мы создаем индивидуальный inference.py сценарий, описывающий, как модель WhisperX и ее компоненты загружаются в контейнер и как следует запускать процесс вывода. Скрипт содержит две функции: model_fn и transform_fn, model_fn Функция вызывается для загрузки моделей из соответствующих мест. Впоследствии эти модели передаются в transform_fn функционируют во время вывода, где выполняются процессы транскрипции, выравнивания и диаризации. Ниже приведен пример кода для inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

В каталоге модели рядом с requirements.txt файл, убедитесь в наличии inference.py в подкаталоге кода. models каталог должен выглядеть следующим образом:

Создайте архив моделей

После создания моделей и каталогов кода вы можете использовать следующие командные строки, чтобы сжать модель в tar-архив (файл .tar.gz) и загрузить его на Amazon S3. На момент написания статьи при использовании модели Large V2 с более быстрым шепотом размер результирующего архива, представляющего модель SageMaker, составлял 3 ГБ. Для получения дополнительной информации см. Шаблоны размещения моделей в Amazon SageMaker, часть 2. Начало работы с развертыванием моделей реального времени в SageMaker.

Создайте модель SageMaker и разверните конечную точку с асинхронным предиктором.

Теперь вы можете создать модель SageMaker, конфигурацию конечной точки и асинхронную конечную точку с помощью Асинхронный предиктор используя архив модели, созданный на предыдущем шаге. Инструкции см. Создайте конечную точку асинхронного вывода.

Оцените эффективность диаризации

Чтобы оценить эффективность диаризации модели WhisperX в различных сценариях, мы выбрали по три эпизода из двух английских названий: одно драматическое название, состоящее из 30-минутных эпизодов, и одно документальное название, состоящее из 45-минутных эпизодов. Мы использовали набор инструментов для измерения показателей Pyannote, pyannote.metrics, чтобы вычислить коэффициент ошибок диаризизации (DER). При оценке достоверной информацией послужили расшифрованные вручную и дневниковые стенограммы, предоставленные ZOO.

Мы определили DER следующим образом:

Всего это продолжительность видео с основной информацией. FA (Ложная тревога) — это длина сегментов, которые считаются речью в прогнозах, но не в реальных условиях. скучать — это длина сегментов, которые считаются речью в истинном понимании, но не в предсказании. Ошибка, Которая также называется неразбериха, — это длина сегментов, которые назначаются разным говорящим в предсказании и основной истине. Все единицы измерения измеряются в секундах. Типичные значения DER могут варьироваться в зависимости от конкретного приложения, набора данных и качества системы диаризации. Обратите внимание, что DER может быть больше 1.0. Чем ниже DER, тем лучше.

Чтобы иметь возможность рассчитать DER для части медиа, требуется достоверная диаризация, а также расшифрованные и диаризированные результаты WhisperX. Их необходимо проанализировать и получить в результате списки кортежей, содержащие метку говорящего, время начала речевого сегмента и время окончания речевого сегмента для каждого сегмента речи в носителе. Ярлыки говорящих не обязательно должны совпадать между WhisperX и диаризацией основной истины. Результаты основаны главным образом на времени сегментов. pyannote.metrics принимает эти кортежи достоверных и выходных диаризаций (в документации pyannote.metrics они называются ссылка и гипотеза) для расчета МЭД. В следующей таблице суммированы наши результаты.

| Тип видео | ТАМ | Верный | скучать | Ошибка | Ложная тревога |

| Драма | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| Документальный фильм | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| Средняя | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

Эти результаты показывают значительную разницу в производительности между драматическими и документальными названиями, причем модель достигает заметно лучших результатов (с использованием DER в качестве совокупного показателя) для эпизодов драмы по сравнению с названием документального фильма. Более тщательный анализ названий дает представление о потенциальных факторах, способствующих этому разрыву в производительности. Одним из ключевых факторов может быть частое присутствие фоновой музыки, перекрывающей речь в названии документального фильма. Хотя предварительная обработка мультимедиа для повышения точности диаризации, такая как удаление фонового шума для изоляции речи, выходит за рамки этого прототипа, она открывает возможности для будущей работы, которая потенциально может повысить производительность WhisperX.

Заключение

В этом посте мы рассмотрели совместное партнерство между AWS и ZOO Digital, используя методы машинного обучения с SageMaker и модель WhisperX для улучшения рабочего процесса дневникирования. Команда AWS сыграла ключевую роль, помогая ZOO в создании прототипов, оценке и понимании эффективного развертывания пользовательских моделей машинного обучения, специально разработанных для ведения дневников. Это включало в себя автоматическое масштабирование для обеспечения масштабируемости с помощью SageMaker.

Использование ИИ для диаризации приведет к существенной экономии средств и времени при создании локализованного контента для ZOO. Помогая транскрибаторам быстро и точно создавать и идентифицировать говорящих, эта технология решает традиционно трудоемкую и подверженную ошибкам природу задачи. Традиционный процесс часто включает несколько проходов видео и дополнительные этапы контроля качества для минимизации ошибок. Использование искусственного интеллекта для дневникирования обеспечивает более целенаправленный и эффективный подход, тем самым повышая производительность в более короткие сроки.

Мы изложили ключевые шаги по развертыванию модели WhisperX на асинхронной конечной точке SageMaker и рекомендуем вам попробовать ее самостоятельно, используя предоставленный код. Для получения дополнительной информации об услугах и технологиях ZOO Digital посетите Официальный сайт ZOO Digital. Подробную информацию о развертывании модели OpenAI Whisper в SageMaker и различных вариантах вывода см. Разместите модель Whisper на Amazon SageMaker: изучаем варианты вывода. Не стесняйтесь поделиться своими мыслями в комментариях.

Об авторах

Ин Хоу, доктор философии— архитектор прототипов машинного обучения в AWS. Ее основные области интересов включают глубокое обучение с упором на GenAI, компьютерное зрение, НЛП и прогнозирование данных временных рядов. В свободное время она любит проводить приятные моменты со своей семьей, погружаясь в романы и совершая пешие прогулки по национальным паркам Великобритании.

Ин Хоу, доктор философии— архитектор прототипов машинного обучения в AWS. Ее основные области интересов включают глубокое обучение с упором на GenAI, компьютерное зрение, НЛП и прогнозирование данных временных рядов. В свободное время она любит проводить приятные моменты со своей семьей, погружаясь в романы и совершая пешие прогулки по национальным паркам Великобритании.

Итан Камберленд — инженер-исследователь искусственного интеллекта в ZOO Digital, где он работает над использованием искусственного интеллекта и машинного обучения в качестве вспомогательных технологий для улучшения рабочих процессов в области речи, языка и локализации. Он имеет опыт разработки программного обеспечения и исследований в области безопасности и контроля, уделяя особое внимание извлечению структурированной информации из Интернета и использованию моделей машинного обучения с открытым исходным кодом для анализа и обогащения собранных данных.

Итан Камберленд — инженер-исследователь искусственного интеллекта в ZOO Digital, где он работает над использованием искусственного интеллекта и машинного обучения в качестве вспомогательных технологий для улучшения рабочих процессов в области речи, языка и локализации. Он имеет опыт разработки программного обеспечения и исследований в области безопасности и контроля, уделяя особое внимание извлечению структурированной информации из Интернета и использованию моделей машинного обучения с открытым исходным кодом для анализа и обогащения собранных данных.

Гаурав Кайла возглавляет группу AWS по прототипированию в Великобритании и Ирландии. Его команда работает с клиентами из различных отраслей, разрабатывая и совместно разрабатывая критически важные для бизнеса рабочие нагрузки, стремясь ускорить внедрение сервисов AWS.

Гаурав Кайла возглавляет группу AWS по прототипированию в Великобритании и Ирландии. Его команда работает с клиентами из различных отраслей, разрабатывая и совместно разрабатывая критически важные для бизнеса рабочие нагрузки, стремясь ускорить внедрение сервисов AWS.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :имеет

- :является

- :нет

- :куда

- $UP

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- в состоянии

- ускорять

- принимающий

- доступ

- доступной

- точность

- Достигать

- достижение

- через

- приспосабливать

- дополнительный

- Дополнительно

- адреса

- Принятие

- После

- совокупный

- соглашения

- AI

- ай исследование

- цель

- Цель

- Часы работы

- выравнивать

- выравнивание

- выравнивание

- Все

- позволяет

- в одиночестве

- рядом

- причислены

- Несмотря на то, что

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- an

- Анализ

- анализ

- и

- Другой

- Применение

- подхода

- соответствующий

- архитектура

- МЫ

- области

- Специалисты ELAN

- AS

- оценить

- Активы

- назначенный

- помощь

- содействие

- At

- аудио

- уполномоченный

- автоматический

- автоматизация

- проспекты

- AWS

- фон

- основанный

- BE

- , так как:

- было

- до

- не являетесь

- ЛУЧШЕЕ

- Лучшая

- между

- Beyond

- Крупнейшая

- BIN

- изоферменты печени

- построенный

- бизнес

- но

- by

- вычислять

- под названием

- CAN

- случаев

- вызов

- символы

- Выберите

- ближе

- код

- сотрудничество

- совместный

- Комментарии

- сравненный

- Заполненная

- Соответствие закону

- компонент

- компоненты

- усугубляются

- компьютер

- Компьютерное зрение

- проводятся

- настроить

- настройка

- Рассматривать

- считается

- Состоящий из

- Container

- содержит

- содержание

- создатели контента

- содействие

- контроль

- обычный

- Основные

- правильно

- Цена

- Расходы

- может

- Создайте

- создали

- Создающий

- Создатели

- критической

- культуры

- изготовленный на заказ

- Клиенты

- данным

- глубоко

- глубокое обучение

- определенный

- доставки

- обеспечивает

- копаться

- Спрос

- в зависимости

- развертывание

- развернуть

- развертывание

- развертывание

- предназначенный

- подробнее

- обнаруженный

- застройщиков

- устройство

- диаграмма

- ДИКТ

- разница

- различный

- Интернет

- Digitals

- непосредственно

- каталоги

- каталог

- обсуждать

- Разное

- Docker

- документальный фильм

- документации

- домен

- Dont

- скачать

- загрузка

- Драма

- дублированный

- в течение

- каждый

- легче

- Эффективный

- эффективный

- эффективно

- элементы

- еще

- вложения

- используя

- позволяет

- охватывала

- поощрять

- конец

- впритык

- Конечная точка

- занятый

- обязательство

- инженер

- Проект и

- Английский

- повышать

- обогащение

- обеспечивать

- обеспечение

- корпоративного уровня

- Развлечения

- эпизод

- ошибка

- ошибки

- существенный

- оценивать

- оценивается

- оценки

- оценка

- События

- Каждая

- пример

- Упражнение

- Эксперименты

- Разведанный

- Исследование

- Face

- лица

- фактор

- факторы

- ложный

- семья

- быстрее

- Особенности

- чувствовать

- Получено

- Файл

- Файлы

- Трансформируемость

- Фокус

- внимание

- фокусировка

- после

- следующим образом

- Что касается

- принудительный

- 4

- Рамки

- Бесплатно

- частое

- от

- полный

- функция

- функциональная

- Функции

- далее

- будущее

- разрыв

- Genai

- генерируется

- порождающий

- получающий

- GitHub

- глобализация

- цель

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- земля

- практический

- Аппаратные средства

- he

- ее

- высококачественный

- его

- кашель

- хостинг

- ЧАСЫ

- Как

- Однако

- HTML

- HTTP

- HTTPS

- ОбниматьЛицо

- идентифицирующий

- Личность

- if

- иллюстрирует

- изображение

- Импортировать

- улучшать

- улучшенный

- in

- включены

- включает в себя

- В том числе

- включать

- включения

- повышение

- промышленности

- информация

- инициирование

- размышления

- установлен

- инструкции

- интерес

- в

- Представляет

- инвестиций

- вызывается

- включает в себя

- Ирландия

- IT

- ЕГО

- JPG

- JSON

- Основные

- ключевой фактор

- этикетка

- Этикетки

- язык

- Языки

- большой

- больше

- вести

- Лиды

- изучение

- Длина

- Используя

- Библиотека

- линий

- Список

- Списки

- загрузка

- погрузка

- локальным

- Локализация

- в местном масштабе

- места

- журнал

- каротаж

- Длинное

- ниже

- машина

- обучение с помощью машины

- техническое обслуживание

- ДЕЛАЕТ

- управление

- Мандат

- руководство

- вручную

- Совпадение

- Май..

- Медиа

- Метаданные

- методы

- метрический

- Метрика

- миллиона

- минимизировать

- Минут

- смягчать

- ML

- модель

- Модели

- модульный

- Модули

- Моменты

- БОЛЕЕ

- в основном

- кино

- Кино

- с разными

- Музыка

- должен

- имя

- имена

- национальный

- природа

- необходимо

- Необходимость

- необходимый

- Новые

- НЛП

- Шум

- особенно

- в своих размышлениях

- полученный

- of

- предлагают

- предлагающий

- Официальный представитель в Грузии

- .

- on

- ONE

- с открытым исходным кодом

- OpenAI

- Откроется

- операция

- Опции

- or

- оригинал

- OS

- Другое

- наши

- внешний

- контур

- изложенные

- выходной

- выходы

- за

- пакеты

- часть

- особенно

- Партнерство

- Прошло

- проходит

- путь

- пути

- паттеранами

- Люди

- Выполнять

- производительность

- выполнены

- выполняет

- кусок

- трубопровод

- основной

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Играть

- играл

- полицейская

- После

- потенциал

- потенциально

- предшествующий

- Точно

- прогноз

- Predictions

- присутствие

- представить

- предыдущий

- первичный

- процесс

- Процессы

- обработка

- Продукт

- Производство

- производительность

- FitPartner™

- прототип

- макетирования

- обеспечивать

- при условии

- приводит

- обеспечение

- Питон

- R

- Обменный курс

- Читать

- реальные

- реального времени

- рекомендовать

- относиться

- назвало

- область

- районы

- помнить

- удаление

- замещать

- представляющий

- запросить

- требовать

- обязательный

- Требования

- исследованиям

- те

- результат

- в результате

- Итоги

- возвращают

- Возвращает

- показывать

- Роли

- Run

- Бег

- время выполнения

- s

- sagemaker

- образец

- Сохранить

- сохраняются

- экономия

- Масштабируемость

- масштабируемые

- Шкала

- масштабирование

- Сценарии

- сфера

- скрипт

- секунды

- разделах

- безопасность

- сегмент

- сегментация

- сегментами

- выбранный

- выбор

- Серии

- служил

- Услуги

- выступающей

- настройки

- Поделиться

- она

- должен

- значительный

- просто

- ШЕСТЬ

- Размер

- Размеры

- квалифицированный

- небольшой

- сгладить

- So

- Software

- разработка программного обеспечения

- Решение

- Источник

- Динамик

- динамики

- конкретный

- конкретно

- указанный

- речь

- Расходы

- шипы

- Начало

- и политические лидеры

- Шаг

- Шаги

- диск

- хранить

- История

- поток

- упорядочить

- структурированный

- впоследствии

- существенный

- такие

- подходящее

- поставка

- поддержка

- поддержки

- поменять местами

- быстро

- синхронизация

- система

- ТАБЛИЦЫ

- взять

- принимает

- целевое

- Сложность задачи

- команда

- снижения вреда

- технологии

- Технологии

- временный

- текст

- чем

- который

- Ассоциация

- Будущее

- Великобритании

- их

- Их

- тогда

- тем самым

- Эти

- они

- этой

- те

- три

- Через

- время

- Временные ряды

- кропотливый

- сроки

- раз

- отметка времени

- тайминги

- Название

- позиций

- в

- знак

- приняли

- Инструментарий

- факел

- Традиционно

- трафик

- Обучение

- прозрачный

- вызвать

- срабатывание

- надежных

- Правда

- стараться

- учебник

- tv

- два

- типичный

- Uk

- под

- в 30

- понимание

- единиц

- Обновление ПО

- на

- использование

- прецедент

- используемый

- Информация о пользователе

- использования

- через

- использовать

- использует

- Наши ценности

- различный

- меняться

- версия

- версии

- жизнеспособный

- Видео

- видение

- Войти

- Режимы

- W

- законопроект

- we

- Web

- веб-сервисы

- ЧТО Ж

- когда

- в то время как

- Whisper

- будете

- в

- без

- слова

- Работа

- рабочий

- Рабочие процессы

- Трудовые ресурсы

- работает

- мире

- письмо

- YAML

- Ты

- ВАШЕ

- себя

- зефирнет

- ZOO