Индустрия моды – это очень прибыльный бизнес, с оценочной стоимостью в 2.1 триллиона долларов к 2025 году, по данным Всемирного банка. Эта область охватывает широкий спектр сегментов, таких как создание, производство, распространение и продажа одежды, обуви и аксессуаров. Индустрия находится в состоянии постоянных изменений, часто появляются новые стили и тенденции. Поэтому фэшн-компании должны быть гибкими и уметь адаптироваться, чтобы сохранить свою актуальность и добиться успеха на рынке.

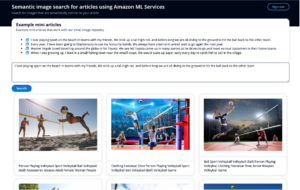

Генеративный искусственный интеллект (ИИ) относится к алгоритмам ИИ, предназначенным для создания нового контента, такого как изображения, текст, аудио или видео, на основе набора изученных шаблонов и данных. Его можно использовать для создания новых и инновационных дизайнов одежды, предлагая улучшенную персонализацию и экономическую эффективность. Инструменты дизайна на основе ИИ могут создавать уникальные дизайны одежды на основе входных параметров или стилей, указанных потенциальными клиентами с помощью текстовых подсказок. Кроме того, ИИ можно использовать для персонализации дизайна в соответствии с предпочтениями клиента. Например, клиент может выбирать из множества цветов, узоров и стилей, а модели ИИ будут генерировать уникальный дизайн на основе этих вариантов. Внедрение ИИ в индустрию моды в настоящее время сдерживается различными техническими проблемами, проблемами осуществимости и затратами. Однако теперь эти препятствия можно устранить, используя передовые методы генеративного искусственного интеллекта, такие как семантическая сегментация изображений на основе естественного языка и распространение для виртуального стиля.

В этом сообщении блога подробно описывается реализация генеративного онлайн-моделирования с помощью искусственного интеллекта с использованием текстовых подсказок. Инженеры по машинному обучению (ML) могут точно настраивать и развертывать модели преобразования текста в семантическую сегментацию и отрисовки на основе предварительно обученных CLIPSeq и Stable Diffusion с помощью Создатель мудреца Амазонки. Это позволяет модельерам и потребителям создавать виртуальные моделирующие изображения на основе текстовых подсказок и выбирать предпочтительные стили.

Генеративные ИИ-решения

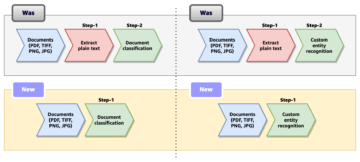

Ассоциация CLIPSeg Модель представила новый метод семантической сегментации изображений, позволяющий легко идентифицировать модные предметы на изображениях с помощью простых текстовых команд. Он использует текстовую подсказку или кодировщик изображений для кодирования текстовой и визуальной информации в мультимодальное пространство встраивания, обеспечивая высокоточную сегментацию целевых объектов на основе подсказки. Модель была обучена на огромном количестве данных с использованием таких методов, как перенос с нуля, контроль естественного языка и мультимодальное контрастивное обучение с самоконтролем. Это означает, что вы можете использовать предварительно обученную модель, которая находится в открытом доступе. Тимо Люддеке и др. без необходимости настройки.

CLIPSeg — это модель, использующая кодировщик текста и изображений для кодирования текстовой и визуальной информации в мультимодальное пространство встраивания для выполнения семантической сегментации на основе текстовой подсказки. Архитектура CLIPSeg состоит из двух основных компонентов: кодировщик текста и кодировщик изображений. Кодировщик текста принимает текстовое приглашение и преобразует его во встраивание текста, а кодировщик изображения принимает изображение и преобразует его во встраивание изображения. Затем оба вложения объединяются и проходят через полностью связанный слой для создания окончательной маски сегментации.

С точки зрения потока данных модель обучается на наборе данных изображений и соответствующих текстовых подсказках, где текстовые подсказки описывают сегментируемый целевой объект. В процессе обучения кодировщик текста и кодировщик изображений оптимизируются для изучения соответствия между текстовыми подсказками и изображением для создания окончательной маски сегментации. После того, как модель обучена, она может принять новую текстовую подсказку и изображение и создать маску сегментации для объекта, описанного в подсказке.

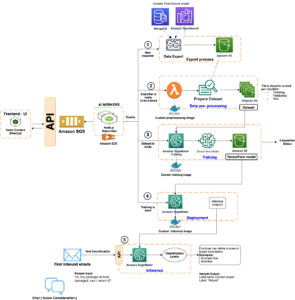

Стабильная диффузия — это метод, который позволяет модельерам создавать высокореалистичные изображения в больших количествах исключительно на основе текстовых описаний без необходимости длительной и дорогостоящей настройки. Это выгодно дизайнерам, которые хотят быстро создавать модные стили, и производителям, которые хотят производить персонализированные продукты по более низкой цене.

Следующая диаграмма иллюстрирует архитектуру Stable Diffusion и поток данных.

По сравнению с традиционными методами на основе GAN, Stable Diffusion — это генеративный ИИ, способный создавать более стабильные и фотореалистичные изображения, соответствующие распределению исходного изображения. Модель может быть обусловлена широким спектром целей, таких как текст для преобразования текста в изображение, ограничительные рамки для создания макета в изображение, маскированные изображения для рисования и изображения с более низким разрешением для сверхвысокого разрешения. Диффузионные модели имеют широкий спектр бизнес-приложений, и их практическое использование продолжает развиваться. Эти модели принесут большую пользу различным отраслям, таким как мода, розничная торговля и электронная коммерция, развлечения, социальные сети, маркетинг и многое другое.

Создание масок из текстовых подсказок с помощью CLIPSeg

Vogue Online Styling — это сервис, который позволяет клиентам получать советы и рекомендации по моде от ИИ через онлайн-платформу. Он делает это, выбирая одежду и аксессуары, которые дополняют внешний вид клиента, вписываются в его бюджет и соответствуют его личным предпочтениям. Благодаря использованию генеративного ИИ задачи могут выполняться с большей легкостью, что приводит к повышению удовлетворенности клиентов и снижению расходов.

Решение может быть развернуто на Облако Amazon Elastic Compute (EC2) экземпляр p3.2xlarge, который имеет один единственный графический процессор V100 с памятью 16 ГБ. Было использовано несколько методов для повышения производительности и уменьшения использования памяти графического процессора, что привело к более быстрому созданию изображений. К ним относятся использование fp16 и включение эффективного внимания памяти для уменьшения пропускной способности в блоке внимания.

Мы начали с того, что пользователь загрузил модное изображение, а затем загрузил и извлек предварительно обученную модель из CLIPSeq. Затем изображение нормализуется и изменяется в соответствии с ограничением размера. Stable Diffusion V2 поддерживает разрешение изображения до 768×768, а V1 — до 512×512. См. следующий код:

from models.clipseg import CLIPDensePredT # The original image

image = download_image(img_url).resize((768, 768)) # Download pre-trained CLIPSeq model and unzip the pkg

! wget https://owncloud.gwdg.de/index.php/s/ioHbRzFx6th32hn/download -O weights.zip

! unzip -d weights -j weights.zip # Load CLIP model. Available models = ['RN50', 'RN101', 'RN50x4', # 'RN50x16', 'RN50x64', 'ViT-B/32', 'ViT-B/16', 'ViT-L/14', 'ViT-L/14@336px']

model = CLIPDensePredT(version='ViT-B/16', reduce_dim=64)

model.eval() # non-strict, because we only stored decoder weights (not CLIP weights)

model.load_state_dict(torch.load('weights/rd64-uni.pth', map_location=torch.device('cuda')), strict=False) # Image normalization and resizing

transform = transforms.Compose([ transforms.ToTensor(), transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]), transforms.Resize((768, 768)),

])

img = transform(image).unsqueeze(0)С помощью предварительно обученной модели CLIPSeq мы можем извлечь целевой объект из изображения с помощью текстовой подсказки. Это делается путем ввода текстовой подсказки в текстовый кодировщик, который преобразует ее во встраивание текста. Затем изображение вводится в кодировщик изображений, который преобразует его во встраивание изображения. Затем оба вложения объединяются и проходят через полностью связанный слой для создания окончательной маски сегментации, которая выделяет целевой объект, описанный в текстовой подсказке. См. следующий код:

# Text prompt

prompt = 'Get the dress only.' # predict

mask_image_filename = 'the_mask_image.png'

with torch.no_grad(): preds = model(img.repeat(4,1,1,1), prompt)[0] # save the mask image after computing the area under the standard # Gaussian probability density function and calculates the cumulative # distribution function of the normal distribution with ndtr. plt.imsave(mask_image_filename,torch.special.ndtr(preds[0][0]))С точным изображением маски из семантической сегментации мы можем использовать отрисовку для замены контента. In-painting — это процесс использования обученной генеративной модели для заполнения недостающих частей изображения. Используя изображение маски для идентификации целевого объекта, мы можем применить технику рисования, чтобы заменить целевой объект чем-то другим, например другим предметом одежды или аксессуаром. Для этой цели можно использовать модель Stable Diffusion V2, поскольку она способна создавать фотореалистичные изображения с высоким разрешением, которые соответствуют распределению исходного изображения.

Тонкая настройка предварительно обученных моделей с использованием DreamBooth

Тонкая настройка — это процесс глубокого обучения, при котором предварительно обученная модель дополнительно обучается новой задаче с использованием небольшого количества размеченных данных. Вместо обучения с нуля идея состоит в том, чтобы взять сеть, которая уже была обучена на большом наборе данных для аналогичной задачи, и дополнительно обучить ее на новом наборе данных, чтобы сделать ее более специализированной для этой конкретной задачи.

Модельеры также могут использовать предметно-ориентированную, точно настроенную модель Stable Diffusion для создания определенного класса стиля, например повседневных длинных женских юбок. Для этого первым шагом является предоставление набора образцов изображений в целевом домене, примерно около 1 дюжины, с соответствующими текстовыми метками, такими как следующие, и привязкой их к уникальному идентификатору, который ссылается на дизайн, стиль, цвет и ткань. . Метка в тексте играет решающую роль в определении результатов точной настройки модели. Существует несколько способов улучшить точную настройку с помощью эффективных быстрый инжиниринг и вот несколько примеров.

Sample text prompts to descibe some of the most common design elements of casual long skirts for ladies: Design Style: A-line, wrap, maxi, mini, and pleated skirts are some of the most popular styles for casual wear. A-line skirts are fitted at the waist and flare out at the hem, creating a flattering silhouette. Wrap skirts have a wrap closure and can be tied at the waist for a customizable fit. Maxi skirts are long and flowy, while mini skirts are short and flirty. Pleated skirts have folds that add texture and movement to the garment.

Pattern: Casual skirts can feature a variety of patterns, including stripes, florals, polka dots, and solids. These patterns can range from bold and graphic to subtle and understated.

Colors: Casual skirts come in a range of colors, including neutral shades likeblack, white, and gray, as well as brighter hues like pink, red, and blue. Some skirts may also feature multiple colors in a single garment, such asa skirt with a bold pattern that incorporates several shades.

Fabrics: Common fabrics used in casual skirts include cotton, denim, linen, and rayon. These materials offer different levels of comfort and durability, making it easy to find a skirt that suits your personal style and needs.

Использование небольшого набора изображений для точной настройки стабильной диффузии может привести к переоснащению модели. DreamBooth [5] решает эту проблему, используя потерю предварительного сохранения для конкретного класса. Он учится связывать уникальный идентификатор с этим конкретным субъектом в два этапа. Во-первых, он настраивает модель с низким разрешением с входными изображениями в паре с текстовой подсказкой, содержащей уникальный идентификатор и имя класса, к которому принадлежит объект, например «юбка». На практике это означает, что модель соответствует изображениям и изображениям, выбранным из визуального априора не точно настроенного класса одновременно. Эти предварительно сохраненные изображения выбираются и помечаются с помощью подсказки «класс существительное». Во-вторых, он будет точно настраивать компоненты сверхвысокого разрешения путем объединения изображений с низким и высоким разрешением из набора входных изображений, что позволяет выходным данным точно настроенной модели поддерживать точность мелких деталей.

Для точной настройки предварительно обученного кодировщика текста в процессе рисования с помощью UNet для изображений с разрешением 512 × 512 требуется примерно 22 ГБ видеопамяти или больше для разрешения 768 × 768. В идеале образцы с точной настройкой должны быть изменены в размере, чтобы соответствовать желаемому разрешению выходного изображения, чтобы избежать снижения производительности. Кодировщик текста создает более точные детали, такие как лица моделей. Одним из вариантов является запуск на одном инстансе AWS EC2 g5.2xlarge, который теперь доступен в восемь регионов или используйте Hugging Face Accelerate для запуска точно настроенного кода в распределенной конфигурации. Для дополнительной экономии памяти вы можете выбрать нарезанную версию внимания, которая выполняет вычисления поэтапно, а не все сразу, просто изменив обучающий сценарий DreamBooth train_dreambooth_inpaint.py, добавив конвейерную функцию enable_attention_slicing().

Accelerate — это библиотека, которая позволяет запускать один код тонкой настройки в любой распределенной конфигурации. Представлены Hugging Face и Amazon Контейнеры глубокого обучения (DLC) Hugging Face для масштабирования задач тонкой настройки на нескольких графических процессорах и узлах. Вы можете настроить конфигурацию запуска для Amazon SageMaker с помощью одной команды интерфейса командной строки.

# From your aws account, install the sagemaker sdk for Accelerate

pip install "accelerate[sagemaker]" --upgrade # Configure the launch configuration for Amazon SageMaker accelerate config # List and verify Accelerate configuration

accelerate env # Make necessary modification of the training script as the following to save # output on S3, if needed

# - torch.save('/opt/ml/model`)

# + accelerator.save('/opt/ml/model')Чтобы запустить задание тонкой настройки, проверьте конфигурацию Accelerate, используя CLI и предоставьте необходимые обучающие аргументы, затем используйте следующий сценарий оболочки.

# Instance images — Custom images that represents the specific # concept for dreambooth training. You should collect # high #quality images based on your use cases.

# Class images — Regularization images for prior-preservation # loss to prevent overfitting. You should generate these # images directly from the base pre-trained model. # You can choose to generate them on your own or generate # them on the fly when running the training script.

# # You can access train_dreambooth_inpaint.py from huggingface/diffuser export MODEL_NAME="stabilityai/stable-diffusion-2-inpainting"

export INSTANCE_DIR="/data/fashion/gowns/highres/"

export CLASS_DIR="/opt/data/fashion/generated_gowns/imgs"

export OUTPUT_DIR="/opt/model/diffuser/outputs/inpainting/" accelerate launch train_dreambooth_inpaint.py --pretrained_model_name_or_path=$MODEL_NAME --train_text_encoder --instance_data_dir=$INSTANCE_DIR --class_data_dir=$CLASS_DIR --output_dir=$OUTPUT_DIR --with_prior_preservation --prior_loss_weight=1.0 --instance_prompt="A supermodel poses in long summer travel skirt, photorealistic" --class_prompt="A supermodel poses in skirt, photorealistic" --resolution=512 --train_batch_size=1 --use_8bit_adam --gradient_checkpointing --learning_rate=2e-6 --lr_scheduler="constant" --lr_warmup_steps=0 --num_class_images=200 --max_train_steps=800Точно настроенная модель рисования позволяет генерировать более конкретные изображения для класса моды, описанного в текстовой подсказке. Поскольку она была настроена с помощью набора изображений с высоким разрешением и текстовых подсказок, модель может генерировать изображения, более подходящие для класса, например вечерние платья. Важно отметить, что чем конкретнее класс и чем больше данных используется для тонкой настройки, тем более точными и реалистичными будут выходные изображения.

%tree -d ./finetuned-stable-diffusion-v2-1-inpainting

finetuned-stable-diffusion-v2-1-inpainting

├── 512-inpainting-ema.ckpt

├── feature_extractor

├── code

│ └──inference.py

│ ├──requirements.txt

├── scheduler

├── text_encoder ├── tokenizer

├── unet

└── vae

Разверните точно настроенную модель рисования с помощью SageMaker для логического вывода.

С помощью Amazon SageMaker вы можете развернуть точно настроенные модели Stable Diffusion для получения логических выводов в реальном времени. Чтобы загрузить модель в Сервис Amazon Simple Storage (S3) для развертывания необходимо создать tar-архив model.tar.gz. Убедитесь, что в архив включены все файлы, а не папка, в которой они содержатся. Папка архива тонкой настройки DreamBooth должна выглядеть следующим образом после устранения прерывистых контрольных точек:

Начальный шаг в создании нашего обработчика вывода включает создание файла inference.py. Этот файл служит центральным концентратором для загрузки модели и обработки всех входящих запросов на вывод. После загрузки модели выполняется функция model_fn(). Когда возникает необходимость сделать вывод, вызывается функция predict_fn(). Кроме того, функция decode_base64() используется для преобразования строки JSON, содержащейся в полезной нагрузке, в тип данных изображения PIL.

%%writefile code/inference.py

import base64

import torch

from PIL import Image

from io import BytesIO

from diffusers import EulerDiscreteScheduler, StableDiffusionInpaintPipeline def decode_base64(base64_string): decoded_string = BytesIO(base64.b64decode(base64_string)) img = Image.open(decoded_string) return img def model_fn(model_dir): # Load stable diffusion and move it to the GPU scheduler = EulerDiscreteScheduler.from_pretrained(model_dir, subfolder="scheduler") pipe = StableDiffusionInpaintPipeline.from_pretrained(model_dir, scheduler=scheduler, revision="fp16", torch_dtype=torch.float16) pipe = pipe.to("cuda") pipe.enable_xformers_memory_efficient_attention() #pipe.enable_attention_slicing() return pipe def predict_fn(data, pipe): # get prompt & parameters prompt = data.pop("inputs", data) # Require json string input. Inference to convert imge to string. input_img = data.pop("input_img", data) mask_img = data.pop("mask_img", data) # set valid HP for stable diffusion num_inference_steps = data.pop("num_inference_steps", 25) guidance_scale = data.pop("guidance_scale", 6.5) num_images_per_prompt = data.pop("num_images_per_prompt", 2) image_length = data.pop("image_length", 512) # run generation with parameters generated_images = pipe( prompt, image = decode_base64(input_img), mask_image = decode_base64(mask_img), num_inference_steps=num_inference_steps, guidance_scale=guidance_scale, num_images_per_prompt=num_images_per_prompt, height=image_length, width=image_length, #)["images"] # for Stabel Diffusion v1.x ).images # create response encoded_images = [] for image in generated_images: buffered = BytesIO() image.save(buffered, format="JPEG") encoded_images.append(base64.b64encode(buffered.getvalue()).decode()) return {"generated_images": encoded_images}

Чтобы загрузить модель в корзину Amazon S3, необходимо сначала создать архив model.tar.gz. Важно отметить, что архив должен состоять непосредственно из файлов, а не из папки, в которой они хранятся. Например, файл должен выглядеть следующим образом:

import tarfile

import os # helper to create the model.tar.gz

def compress(tar_dir=None,output_file="model.tar.gz"): parent_dir=os.getcwd() os.chdir(tar_dir) with tarfile.open(os.path.join(parent_dir, output_file), "w:gz") as tar: for item in os.listdir('.'): print(item) tar.add(item, arcname=item) os.chdir(parent_dir) compress(str(model_tar)) # After we created the model.tar.gz archive we can upload it to Amazon S3. We will # use the sagemaker SDK to upload the model to our sagemaker session bucket.

from sagemaker.s3 import S3Uploader # upload model.tar.gz to s3

s3_model_uri=S3Uploader.upload(local_path="model.tar.gz", desired_s3_uri=f"s3://{sess.default_bucket()}/finetuned-stable-diffusion-v2-1-inpainting")После загрузки архива модели мы можем развернуть его в Amazon SageMaker, используя HuggingfaceModel для логического вывода в реальном времени. Вы можете разместить конечную точку, используя экземпляр g4dn.xlarge, который оснащен одним графическим процессором NVIDIA Tesla T4 с 16 ГБ видеопамяти. Автомасштабирование можно активировать для обработки различных требований к трафику. Сведения о включении автоматического масштабирования в вашу конечную точку см. Идет производство: автоматическое масштабирование трансформеров с обнимающими лицами с помощью Amazon SageMaker.

from sagemaker.huggingface.model import HuggingFaceModel # create Hugging Face Model Class

huggingface_model = HuggingFaceModel( model_data=s3_model_uri, # path to your model and script role=role, # iam role with permissions to create an Endpoint transformers_version="4.17", # transformers version used pytorch_version="1.10", # pytorch version used py_version='py38', # python version used

) # deploy the endpoint endpoint

predictor = huggingface_model.deploy( initial_instance_count=1, instance_type="ml.g4dn.xlarge" )Метод Huggingface_model.deploy() возвращает объект HuggingFacePredictor, который можно использовать для запроса вывода. Для конечной точки требуется JSON с ключом inputs, который представляет запрос ввода для модели для создания изображения. Вы также можете управлять генерацией с помощью таких параметров, как num_inference_steps, guide_scale и «num_images_per_prompt». Функция Predictor.predict() возвращает JSON с ключом «generated_images», который содержит четыре сгенерированных изображения в виде строк в кодировке base64. Мы добавили две вспомогательные функции, decode_base64_to_image и display_images, для декодирования ответа и отображения изображений соответственно. Первый декодирует строку в кодировке base64 и возвращает объект PIL.Image, а второй отображает список объектов PIL.Image. См. следующий код:

import PIL

from io import BytesIO

from IPython.display import display

import base64

import matplotlib.pyplot as plt

import json # Encoder to convert an image to json string

def encode_base64(file_name): with open(file_name, "rb") as image: image_string = base64.b64encode(bytearray(image.read())).decode() return image_string # Decode to to convert a json str to an image def decode_base64_image(base64_string): decoded_string = BytesIO(base64.b64decode(base64_string)) img = PIL.Image.open(decoded_string) return img # display PIL images as grid

def display_images(images=None,columns=3, width=100, height=100): plt.figure(figsize=(width, height)) for i, image in enumerate(images): plt.subplot(int(len(images) / columns + 1), columns, i + 1) plt.axis('off') plt.imshow(image) # Display images in a row/col grid

def image_grid(imgs, rows, cols): assert len(imgs) == rows*cols w, h = imgs[0].size grid = PIL.Image.new('RGB', size=(cols*w, rows*h)) grid_w, grid_h = grid.size for i, img in enumerate(imgs): grid.paste(img, box=(i%cols*w, i//cols*h)) return gridДавайте перейдем к задаче рисования. Было подсчитано, что для создания трех изображений потребуется примерно 15 секунд, учитывая входное изображение и маску, созданную с помощью CLIPSeg с текстовым приглашением, которое обсуждалось ранее. См. следующий код:

num_images_per_prompt = 3

prompt = "A female super-model poses in a casual long vacation skirt, with full body length, bright colors, photorealistic, high quality, highly detailed, elegant, sharp focus" # Convert image to string

input_image_filename = "./imgs/skirt-model-2.jpg"

encoded_input_image = encode_base64(input_image_filename)

encoded_mask_image = encode_base64("./imgs/skirt-model-2-mask.jpg") # Set in-painint parameters

guidance_scale = 6.7

num_inference_steps = 45 # run prediction

response = predictor.predict(data={ "inputs": prompt, "input_img": encoded_input_image, "mask_img": encoded_mask_image, "num_images_per_prompt" : num_images_per_prompt, "image_length": 768 }

) # decode images

decoded_images = [decode_base64_image(image) for image in response["generated_images"]] # visualize generation

display_images(decoded_images, columns=num_images_per_prompt, width=100, height=100) # insert initial image in the list so we can compare side by side

image = PIL.Image.open(input_image_filename).convert("RGB")

decoded_images.insert(0, image) # Display inpainting images in grid

image_grid(decoded_images, 1, num_images_per_prompt + 1)

Нарисованные изображения могут отображаться вместе с исходным изображением для визуального сравнения. Кроме того, процесс отрисовки можно ограничить с помощью различных параметров, таких как Guidance_scale, который управляет интенсивностью направляющего изображения во время процесса отрисовки. Это позволяет пользователю настроить выходное изображение и добиться желаемых результатов.

Быстрый запуск Amazon SageMaker предлагает шаблоны Stable Diffusion для различных моделей, включая преобразование текста в изображение и масштабирование. Для получения дополнительной информации см. SageMaker JumpStart теперь предоставляет модели Stable Diffusion и Bloom.. Дополнительные шаблоны Jumpstart будут доступны в ближайшем будущем.

ограничения

Хотя CLIPSeg обычно хорошо справляется с распознаванием обычных объектов, он не справляется с более абстрактными или систематическими задачами, такими как подсчет количества объектов на изображении, и с более сложными задачами, такими как предсказание того, насколько близко на фотографии находится ближайший объект, такой как сумочка. Zero-shot CLIPSeq также борется по сравнению с моделями для конкретных задач в очень тонкой классификации, например, в определении разницы между двумя неопределенными дизайнами, вариантами одежды или классификацией стиля. CLIPSeq также по-прежнему плохо обобщает изображения, не включенные в его набор данных для предварительной подготовки. Наконец, было замечено, что классификаторы нулевого выстрела CLIP могут быть чувствительны к формулировкам или формулировкам и иногда требуют проб и ошибок «быстрого проектирования» для хорошей работы. Переключение на другую модель семантической сегментации для магистрали CLIPSeq, такую как БЭИТ, который может похвастаться 62.8% mIOU в наборе данных ADE20K, потенциально может улучшить результаты.

Было обнаружено, что модные дизайны, созданные с использованием стабильной диффузии, ограничены частями одежды, которые, по крайней мере, предсказуемо расположены в более широком контексте модных моделей и которые соответствуют высокоуровневым вложениям, которые вы могли бы разумно ожидать найти в модели. гипермасштабный набор данных, используемый во время обучения предварительно обученной модели. Реальный предел генеративного ИИ заключается в том, что модель в конечном итоге будет производить полностью воображаемые и менее аутентичные результаты. Следовательно, модные дизайны, созданные ИИ, могут быть не такими разнообразными или уникальными, как те, которые созданы дизайнерами-людьми.

Заключение

Генеративный ИИ предоставляет индустрии моды возможность трансформировать свою практику за счет улучшения пользовательского опыта и экономичных бизнес-стратегий. В этом посте мы покажем, как использовать генеративный ИИ, чтобы модельеры и потребители могли создавать персонализированные стили одежды с помощью виртуального моделирования. С помощью существующих и будущих шаблонов Amazon SageMaker Jumpstart пользователи могут быстро освоить эти передовые методы, не нуждаясь в глубоких технических знаниях, сохраняя при этом универсальность и снижая расходы.

Эта инновационная технология открывает новые возможности для компаний и специалистов, занимающихся созданием контента в различных отраслях. Генеративный ИИ предоставляет широкие возможности для улучшения и создания контента. Попробуйте последние дополнения к шаблонам Jumpstart в своем Студия SageMaker, такие как тонкая настройка преобразования текста в изображение и масштабирование.

Мы хотели бы поблагодарить Li Zhang, Karl Albertsen, Kristine Pearce, Nikhil Velpanur, Aaron Sengstacken, James Wu и Neelam Koshiya за их поддержку и ценный вклад, который помог улучшить эту работу.

Об авторах

Альфред Шен является старшим специалистом по AI/ML в AWS. Он работал в Силиконовой долине, занимая технические и управленческие должности в различных секторах, включая здравоохранение, финансы и высокие технологии. Он преданный делу прикладной исследователь AI/ML, специализирующийся на CV, NLP и мультимодальности. Его работа была представлена в таких изданиях, как EMNLP, ICLR и Public Health.

Альфред Шен является старшим специалистом по AI/ML в AWS. Он работал в Силиконовой долине, занимая технические и управленческие должности в различных секторах, включая здравоохранение, финансы и высокие технологии. Он преданный делу прикладной исследователь AI/ML, специализирующийся на CV, NLP и мультимодальности. Его работа была представлена в таких изданиях, как EMNLP, ICLR и Public Health.

Доктор Вивек Мадан — ученый-прикладник в команде Amazon SageMaker JumpStart. Он получил докторскую степень в Университете Иллинойса в Урбана-Шампейн и был постдокторантом в Технологическом институте Джорджии. Он является активным исследователем в области машинного обучения и разработки алгоритмов и опубликовал статьи на конференциях EMNLP, ICLR, COLT, FOCS и SODA.

Доктор Вивек Мадан — ученый-прикладник в команде Amazon SageMaker JumpStart. Он получил докторскую степень в Университете Иллинойса в Урбана-Шампейн и был постдокторантом в Технологическом институте Джорджии. Он является активным исследователем в области машинного обучения и разработки алгоритмов и опубликовал статьи на конференциях EMNLP, ICLR, COLT, FOCS и SODA.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/virtual-fashion-styling-with-generative-ai-using-amazon-sagemaker/

- 1

- 10

- 100

- 7

- a

- Аарон

- в состоянии

- О нас

- АБСТРАКТ НАЯ

- ускорять

- ускоритель

- доступ

- Аксессуары

- выполнено

- Учетная запись

- точный

- Достигать

- через

- активный

- приспосабливать

- добавленный

- дополнительный

- Дополнительно

- дополнениями

- адреса

- Принятие

- продвинутый

- совет

- После

- AI

- AI / ML

- алгоритм

- алгоритмы

- Все

- Позволяющий

- позволяет

- уже

- Amazon

- Создатель мудреца Амазонки

- Amazon SageMaker JumpStart

- количество

- и

- одежда

- появиться

- Приложения

- прикладной

- Применить

- примерно

- архитектура

- архив

- ПЛОЩАДЬ

- Аргументы

- искусственный

- искусственный интеллект

- ASA

- Помощь

- внимание

- аудио

- аутентичный

- доступен

- AWS

- Позвоночник

- Пропускная способность

- Банка

- Использование темпера с изогнутым основанием

- основанный

- , так как:

- начал

- полезный

- польза

- Лучшая

- между

- связывать

- переплет

- Заблокировать

- Блог

- Цвести

- Синии

- хвастается

- тело

- булавка

- коробки

- Яркие

- ярче

- бюджет

- бизнес

- Бизнес-приложения

- исчисляет

- под названием

- возможности

- способный

- случаев

- казуальная

- центральный

- проблемы

- шансы

- изменение

- Выберите

- класс

- классификация

- Закрыть

- закрытие

- Одежда

- облако

- код

- собирать

- цвет

- Колонки

- как

- комфорт

- Общий

- Компании

- сравнить

- сравненный

- сравнение

- комплемент

- комплекс

- компоненты

- вычисление

- Вычисление

- вычисление

- сама концепция

- Конфигурация

- подключенный

- постоянная

- Потребители

- Контейнеры

- содержит

- содержание

- Генерация контента

- контекст

- продолжать

- контроль

- контрольная

- конвертировать

- соответствующий

- Цена

- может

- покрытый

- Создайте

- создали

- Создающий

- создание

- критической

- решающее значение

- В настоящее время

- изготовленный на заказ

- клиент

- Удовлетворенность клиентов

- Клиенты

- настраиваемый

- настройка

- данным

- снижение

- преданный

- глубоко

- глубокое обучение

- запросы

- джинсовая ткань

- развертывание

- развернуть

- развертывание

- описывать

- описано

- Проект

- предназначенный

- дизайнеры

- конструкций

- желанный

- подробный

- подробнее

- определения

- разница

- различный

- Вещание

- непосредственно

- обсуждается

- Дисплей

- дисплеев

- распределенный

- распределение

- Разное

- домен

- скачать

- множество

- долговечность

- в течение

- электронная коммерция

- легко

- Эффективный

- эффективный

- элементы

- уничтожение

- обниматься

- включить

- позволяет

- позволяет

- охватывает

- Конечная точка

- Инженеры

- повышение

- обеспечивать

- Развлечения

- оборудованный

- ошибка

- к XNUMX году

- вечер

- со временем

- развивается

- пример

- Примеры

- существующий

- ожидать

- расходы

- дорогим

- Впечатления

- опыта

- экспорт

- извлечение

- ткань

- ткань

- Face

- лица

- Фэшн

- быстрее

- Особенность

- женский пол

- несколько

- верность

- поле

- Файл

- Файлы

- заполнять

- окончательный

- в заключение

- финансы

- Найдите

- конец

- Во-первых,

- соответствовать

- вспышка

- гибкого

- поток

- Фокус

- следует

- после

- следующим образом

- формальный

- Бывший

- вперед

- найденный

- часто

- от

- полный

- полностью

- функция

- Функции

- далее

- Более того

- будущее

- одежда

- порождать

- генерируется

- поколение

- генеративный

- Генеративный ИИ

- ГРУЗИИ

- получить

- данный

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- графический

- серый

- большой

- значительно

- сетка

- обрабатывать

- Управляемость

- упряжь

- имеющий

- Медицина

- здравоохранение

- высота

- помог

- здесь

- High

- на высшем уровне

- высокое разрешение

- высший

- основной момент

- очень

- проведение

- имеет

- кашель

- Как

- How To

- Однако

- HTML

- HTTPS

- хаб

- ОбниматьЛицо

- человек

- идея

- идентификатор

- определения

- Иллинойс

- изображение

- изображений

- воображаемый

- реализация

- Импортировать

- важную

- улучшать

- улучшенный

- in

- углубленный

- включают

- включает в себя

- В том числе

- Входящий

- включения

- расширились

- промышленности

- промышленность

- информация

- начальный

- инновационный

- вход

- устанавливать

- пример

- вместо

- Интеллекта

- выпустили

- вовлеченный

- IT

- пункты

- работа

- JSON

- Основные

- этикетка

- Этикетки

- язык

- большой

- запуск

- слой

- ведущий

- УЧИТЬСЯ

- узнали

- изучение

- Длина

- уровни

- Li

- Библиотека

- ОГРАНИЧЕНИЯ

- Ограниченный

- Список

- загрузка

- погрузка

- Длинное

- от

- Снижение

- прибыльный

- машина

- обучение с помощью машины

- Главная

- поддерживать

- Сохранение

- сделать

- Создание

- управленческий

- Производители

- отображение

- рынок

- Маркетинг

- маска

- Маски

- Совпадение

- материалы

- Matplotlib

- означает

- Медиа

- Память

- метод

- методы

- отсутствующий

- ML

- модель

- Модели

- БОЛЕЕ

- самых

- двигаться

- движение

- с разными

- имя

- натуральный

- Возле

- необходимо

- Необходимость

- нуждающихся

- потребности

- сеть

- Нейтральные

- Новые

- НЛП

- узлы

- "обычные"

- роман

- номер

- Nvidia

- объект

- объекты

- препятствиями

- предлагают

- предлагающий

- Предложения

- ONE

- Единственный в своем роде

- онлайн

- Возможность

- оптимизированный

- Опция

- заказ

- оригинал

- OS

- собственный

- в паре

- спаривание

- бумага

- параметры

- особый

- части

- Прошло

- путь

- шаблон

- паттеранами

- Выполнять

- производительность

- выполняет

- Разрешения

- личного

- воплощение

- Олицетворять

- Персонализированные

- Фотореалистичная

- Картинки

- труба

- трубопровод

- Платформа

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- пожалуйста

- состояния потока

- Популярное

- представляет

- позиции

- После

- потенциал

- потенциально

- практическое

- практика

- практиками

- предсказывать

- прогнозирования

- прогноз

- Predictor

- предпочтения

- привилегированный

- разрабатывает

- предотвращать

- предварительно

- Предварительный

- процесс

- производит

- Производство

- Продукция

- профессионалы

- правильный

- обеспечивать

- приводит

- что такое варган?

- здравоохранение

- публикациям

- публично

- опубликованный

- чисто

- цель

- целей

- Питон

- pytorch

- быстро

- ассортимент

- реальные

- реального времени

- реалистичный

- Получать

- последний

- рекомендаций

- Red

- уменьшить

- Цена снижена

- Рекомендации

- понимается

- актуальность

- Сообщается

- представляет

- запросить

- Запросы

- требовать

- требуется

- исследователь

- Постановления

- ответ

- результат

- в результате

- Итоги

- розничный

- возвращают

- Возвращает

- RGB

- Роли

- грубо

- Run

- Бег

- sagemaker

- главная

- удовлетворение

- Сохранить

- экономия

- Шкала

- Ученый

- SDK

- Во-вторых

- секунды

- сектор

- Сектора юридического права

- сегментация

- сегментами

- выбор

- старший

- чувствительный

- служит

- обслуживание

- Сессия

- набор

- несколько

- острый

- Оболочка

- Короткое

- должен

- демонстрации

- сторона

- кремний

- Кремниевая долина

- аналогичный

- просто

- просто

- одновременно

- одинарной

- Размер

- небольшой

- So

- Соцсети

- социальные сети

- Решение

- некоторые

- удалось

- Space

- особый

- специалист

- специализированный

- конкретный

- указанный

- стабильный

- стандарт

- Область

- Шаг

- Шаги

- По-прежнему

- диск

- хранить

- стратегий

- прочность

- полосы

- Схватки

- стиль

- предмет

- успех

- такие

- лето

- Супермодель

- надзор

- Поддержка

- с учетом

- взять

- принимает

- цель

- Сложность задачи

- задачи

- команда

- технологии

- Технический

- снижения вреда

- Технологии

- шаблоны

- terms

- Tesla

- Ассоциация

- Местоположение

- мир

- их

- следовательно

- три

- Через

- Связанный

- в

- инструменты

- факел

- ПОЛНОСТЬЮ

- традиционный

- трафик

- Train

- специалистов

- Обучение

- перевод

- Transform

- трансформеры

- путешествовать

- Тенденции

- суд

- Триллион

- под

- созданного

- Университет

- загружено

- Применение

- использование

- Информация о пользователе

- пользователей

- обычно

- использовать

- использовать

- использует

- Использующий

- отпуск

- Долина

- ценный

- ценностное

- разнообразие

- различный

- Огромная

- проверить

- версия

- Видео

- Виртуальный

- W

- способы

- , которые

- в то время как

- белый

- КТО

- широкий

- Широкий диапазон

- Шире

- ширина

- будете

- в

- без

- формулировка

- Работа

- работавший

- Мир

- Всемирный банк

- бы

- заворачивать

- wu

- X

- Ты

- ВАШЕ

- зефирнет

- ZIP