V današnjem hitro razvijajočem se zdravstvenem okolju se zdravniki soočajo z ogromnimi količinami kliničnih podatkov iz različnih virov, kot so beležke negovalcev, elektronski zdravstveni zapisi in poročila o slikanju. To bogastvo informacij, čeprav je bistvenega pomena za oskrbo pacientov, je lahko tudi ogromno in dolgotrajno za medicinske strokovnjake, da jih pregledajo in analizirajo. Učinkovito povzemanje in pridobivanje vpogledov iz teh podatkov je ključnega pomena za boljšo oskrbo bolnikov in sprejemanje odločitev. Povzetek informacij o pacientih je lahko koristen za številne nadaljnje postopke, kot je združevanje podatkov, učinkovito kodiranje pacientov ali združevanje pacientov s podobnimi diagnozami za pregled.

Modeli umetne inteligence (AI) in strojnega učenja (ML) so veliko obetali pri reševanju teh izzivov. Modele je mogoče usposobiti za analizo in interpretacijo velikih količin besedilnih podatkov, pri čemer učinkovito strne informacije v jedrnate povzetke. Z avtomatizacijo postopka povzemanja lahko zdravniki hitro pridobijo dostop do ustreznih informacij, kar jim omogoča, da se osredotočijo na oskrbo pacientov in sprejemajo bolj informirane odločitve. Glej naslednje diplomsko delo če želite izvedeti več o primeru uporabe v resničnem svetu.

Amazon SageMaker, popolnoma upravljana storitev ML, zagotavlja idealno platformo za gostovanje in izvajanje različnih modelov in pristopov povzemanja, ki temeljijo na AI/ML. V tej objavi raziskujemo različne možnosti za izvajanje tehnik povzemanja na SageMaker, vključno z uporabo Amazon SageMaker JumpStart temeljnih modelov, natančnega prilagajanja predhodno usposobljenih modelov iz Hugging Face in gradnje modelov povzemanja po meri. Razpravljamo tudi o prednostih in slabostih vsakega pristopa, kar zdravstvenim delavcem omogoča, da izberejo najprimernejšo rešitev za ustvarjanje jedrnatih in natančnih povzetkov kompleksnih kliničnih podatkov.

Dva pomembna izraza, ki ju moramo vedeti, preden začnemo: predhodno usposobljeni in fina nastavitev. Vnaprej usposobljen ali temeljni model je tisti, ki je bil zgrajen in usposobljen na velikem korpusu podatkov, običajno za splošno znanje jezika. Natančno uravnavanje je postopek, s katerim se predhodno usposobljenemu modelu dodeli drug nabor podatkov, bolj specifičen za domeno, da se izboljša njegova učinkovitost pri določeni nalogi. V zdravstvenem okolju bi to pomenilo, da bi modelu dali nekaj podatkov, vključno s frazami in terminologijo, ki se posebej nanašajo na oskrbo bolnikov.

Zgradite modele povzemanja po meri na SageMakerju

Čeprav je to najbolj naporen pristop, bodo nekatere organizacije morda raje iz nič zgradile modele povzemanja po meri na SageMakerju. Ta pristop zahteva bolj poglobljeno znanje o modelih AI/ML in lahko vključuje ustvarjanje arhitekture modela iz nič ali prilagajanje obstoječih modelov, da ustrezajo posebnim potrebam. Gradnja modelov po meri lahko nudi večjo prilagodljivost in nadzor nad postopkom povzemanja, vendar zahteva tudi več časa in virov v primerjavi s pristopi, ki izhajajo iz vnaprej pripravljenih modelov. Bistveno je, da pred nadaljevanjem skrbno pretehtate prednosti in slabosti te možnosti, ker morda ni primerna za vse primere uporabe.

Modeli temeljev SageMaker JumpStart

Odlična možnost za izvajanje povzemanja na SageMakerju je uporaba modelov temeljev JumpStart. Ti modeli, ki so jih razvile vodilne raziskovalne organizacije AI, ponujajo vrsto vnaprej usposobljenih jezikovnih modelov, optimiziranih za različne naloge, vključno s povzemanjem besedila. SageMaker JumpStart nudi dve vrsti temeljnih modelov: lastniške modele in odprtokodne modele. SageMaker JumpStart zagotavlja tudi upravičenost do HIPAA, zaradi česar je uporaben za zdravstvene obremenitve. Stranka mora na koncu zagotoviti skladnost, zato ne pozabite sprejeti ustreznih korakov. glej Arhitektura za varnost in skladnost HIPAA v spletnih storitvah Amazon Za več podrobnosti.

Lastniški modeli temeljev

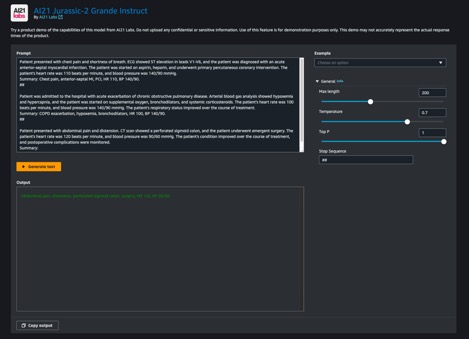

Lastniške modele, kot so modeli Jurassic iz AI21 in model Cohere Generate iz Cohere, je mogoče odkriti prek SageMaker JumpStart na Konzola za upravljanje AWS in so trenutno v predogledu. Uporaba lastniških modelov za povzemanje je idealna, ko vam ni treba natančno prilagoditi svojega modela na podatkih po meri. To ponuja rešitev, ki je enostavna za uporabo, že pripravljena in lahko izpolni vaše zahteve po povzemanju z minimalno konfiguracijo. Z uporabo zmogljivosti teh vnaprej usposobljenih modelov lahko prihranite čas in sredstva, ki bi jih sicer porabili za usposabljanje in natančno nastavitev modela po meri. Poleg tega so lastniški modeli običajno opremljeni z uporabnikom prijaznimi API-ji in SDK-ji, ki poenostavljajo proces integracije z vašimi obstoječimi sistemi in aplikacijami. Če lahko vaše potrebe po povzemanju izpolnijo vnaprej pripravljeni lastniški modeli, ne da bi zahtevali posebno prilagajanje ali natančno prilagajanje, ponujajo priročno, stroškovno učinkovito in učinkovito rešitev za vaše naloge povzemanja besedila. Ker ti modeli niso usposobljeni posebej za primere uporabe v zdravstvu, ni mogoče zagotoviti kakovosti za medicinski jezik brez natančnega prilagajanja.

Jurassic-2 Grande Instruct je velik jezikovni model (LLM) podjetja AI21 Labs, optimiziran za navodila v naravnem jeziku in uporaben za različne jezikovne naloge. Ponuja API, ki je enostaven za uporabo, in SDK za Python ter uravnava kakovost in cenovno dostopnost. Priljubljene uporabe vključujejo ustvarjanje marketinških kopij, poganjanje klepetalnih robotov in povzemanje besedila.

Na konzoli SageMaker se pomaknite do SageMaker JumpStart, poiščite model AI21 Jurassic-2 Grande Instruct in izberite Preizkusite model.

Če želite razmestiti model v končno točko SageMaker, ki jo upravljate, lahko sledite korakom v tem vzorcu prenosnik, ki vam pokaže, kako razmestiti Jurassic-2 Large s pomočjo SageMakerja.

Odprtokodni modeli temeljev

Odprtokodni modeli vključujejo modele FLAN T5, Bloom in GPT-2, ki jih je mogoče odkriti prek SageMaker JumpStart v Amazon SageMaker Studio UI, SageMaker JumpStart na konzoli SageMaker in API-ji SageMaker JumpStart. Te modele je mogoče natančno nastaviti in razmestiti na končne točke pod vašim računom AWS, kar vam daje popolno lastništvo uteži modelov in skriptnih kod.

Flan-T5 XL je močan in vsestranski model, zasnovan za širok spekter jezikovnih nalog. Z natančno nastavitvijo modela s podatki, specifičnimi za vašo domeno, lahko optimizirate njegovo delovanje za vaš poseben primer uporabe, kot je povzemanje besedila ali katera koli druga naloga NLP. Za podrobnosti o tem, kako natančno nastaviti Flan-T5 XL z uporabniškim vmesnikom SageMaker Studio, glejte Natančna nastavitev navodil za FLAN T5 XL z Amazon SageMaker Jumpstart.

Natančno prilagajanje vnaprej usposobljenih modelov z objemajočim obrazom na SageMakerju

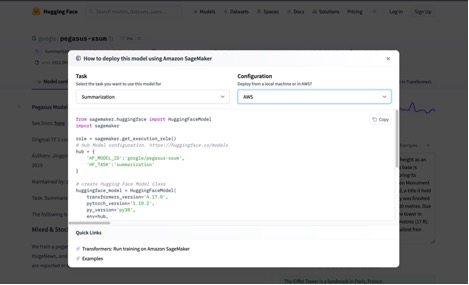

Ena izmed najbolj priljubljenih možnosti za izvajanje povzemanja v SageMakerju je fina nastavitev vnaprej usposobljenih modelov z uporabo Hugging Face transformatorji knjižnica. Hugging Face ponuja široko paleto vnaprej pripravljenih transformatorskih modelov, posebej zasnovanih za različne naloge obdelave naravnega jezika (NLP), vključno s povzemanjem besedila. S knjižnico Hugging Face Transformers lahko te vnaprej usposobljene modele preprosto natančno prilagodite na podatke, specifične za vašo domeno, s pomočjo SageMakerja. Ta pristop ima številne prednosti, kot so hitrejši časi usposabljanja, boljša zmogljivost na določenih domenah ter lažje pakiranje in uvajanje modela z uporabo vgrajenih orodij in storitev SageMaker. Če v SageMaker JumpStart ne najdete primernega modela, lahko izberete kateri koli model, ki ga ponuja Hugging Face, in ga natančno prilagodite s SageMakerjem.

Če želite začeti delati z modelom in spoznati zmožnosti ML, morate samo odpreti SageMaker Studio, poiskati predhodno usposobljen model, ki ga želite uporabiti v Hugging Face Model Hubin izberite SageMaker kot način uvajanja. Hugging Face vam bo dal kodo, ki jo lahko kopirate, prilepite in zaženete v svojem zvezku. Tako preprosto je! Inženirske izkušnje ML niso potrebne.

Knjižnica Hugging Face Transformers graditeljem omogoča, da delajo na vnaprej usposobljenih modelih in opravljajo napredne naloge, kot je fino prilagajanje, ki ga raziskujemo v naslednjih razdelkih.

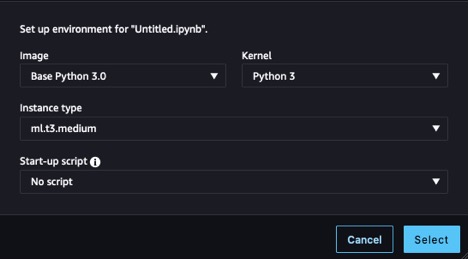

Sredstva za zagotavljanje

Preden lahko začnemo, moramo pripraviti zvezek. Za navodila glejte 1. in 2. korak v Lokalno zgradite in usposobite model strojnega učenja. Za ta primer smo uporabili nastavitve, prikazane na naslednjem posnetku zaslona.

Prav tako moramo ustvariti Preprosta storitev shranjevanja Amazon (Amazon S3) vedro za shranjevanje podatkov o vadbi in artefaktov vadbe. Za navodila glejte Ustvarjanje vedra.

Pripravite nabor podatkov

Za natančno nastavitev našega modela za boljše poznavanje domene moramo pridobiti podatke, primerne za nalogo. Pri usposabljanju za primer uporabe v podjetju boste morali opraviti številne naloge podatkovnega inženiringa, da pripravite lastne podatke, da bodo pripravljeni na usposabljanje. Te naloge so izven obsega te objave. Za ta primer smo ustvarili nekaj sintetičnih podatkov za posnemanje negovalnih zapiskov in jih shranili v Amazon S3. Shranjevanje naših podatkov v Amazon S3 nam omogoča oblikovati naše delovne obremenitve za skladnost s HIPAA. Začnemo tako, da pridobimo te zapiske in jih naložimo v primerek, kjer se izvaja naš prenosnik:

Opombe so sestavljene iz stolpca, ki vsebuje celoten vnos, opombo, in stolpca, ki vsebuje skrajšano različico, ki ponazarja, kakšen bi moral biti naš želeni rezultat, povzetek. Namen uporabe tega nabora podatkov je izboljšati biološki in medicinski besednjak našega modela, tako da je bolj prilagojen povzemanju v kontekstu zdravstvenega varstva, imenovanem natančna nastavitev domene, in pokažite našemu modelu, kako strukturirati njegov povzetek. V nekaterih primerih povzemanja bomo morda želeli ustvariti izvleček iz članka ali enovrstični sinopsis ocene, vendar v tem primeru poskušamo doseči, da naš model izpiše skrajšano različico simptomov in izvedenih ukrepov za dosedanjega bolnika.

Naložite model

Model, ki ga uporabljamo kot temelj, je različica Googlovega Pegasusa, ki je na voljo v središču Hugging Face Hub, imenovanem pegasus-xsum. Je že vnaprej usposobljen za povzemanje, tako da se lahko naš postopek natančnega prilagajanja osredotoči na razširitev znanja o njegovi domeni. Spreminjanje naloge, ki jo izvaja naš model, je drugačna vrsta natančnega prilagajanja, ki ni zajeto v tej objavi. Knjižnica Transformer nam daje razred za nalaganje definicije modela iz našega model_checkpoint: google/pegasus-xsum. To bo naložilo model iz zvezdišča in ga postavilo v naš prenosnik, da ga bomo lahko uporabili pozneje. Ker pegasus-xsum je model od zaporedja do zaporedja, želimo uporabiti vrsto Seq2Seq AutoModel razred:

Zdaj, ko imamo svoj model, je čas, da usmerimo pozornost na druge komponente, ki nam bodo omogočile izvajanje naše vadbene zanke.

Ustvarite tokenizer

Prva od teh komponent je tokenizer. Tokenizacija je proces, s katerim se besede iz vhodnih podatkov pretvorijo v numerične predstavitve, ki jih naš model lahko razume. Spet nam knjižnica Transformer nudi razred za nalaganje definicije tokenizerja iz iste kontrolne točke, ki smo jo uporabili za instanciranje modela:

S tem objektom tokenizerja lahko ustvarimo funkcijo predprocesiranja in jo preslikamo v naš nabor podatkov, da nam da žetone, pripravljene za vnos v model. Nazadnje formatiramo tokeniziran izhod in odstranimo stolpce, ki vsebujejo naše izvirno besedilo, ker jih model ne bo mogel interpretirati. Zdaj nam ostane žetoniziran vnos, pripravljen za vnos v model. Oglejte si naslednjo kodo:

Z našimi podatki tokeniziranimi in našim modelom instanciranim, smo skoraj pripravljeni za izvajanje učne zanke. Naslednji komponenti, ki ju želimo ustvariti, sta zbiralnik podatkov in optimizator. Primerjevalnik podatkov je še en razred, ki ga zagotavlja Hugging Face prek knjižnice Transformers, ki ga uporabljamo za ustvarjanje paketov naših tokeniziranih podatkov za usposabljanje. To lahko preprosto zgradimo z uporabo tokenizerja in objektov modela, ki jih že imamo, tako da poiščemo ustrezen tip razreda, ki smo ga prej uporabili za naš model (Seq2Seq) za razred zbiralnika. Funkcija optimizatorja je vzdrževati stanje vadbe in posodabljati parametre glede na našo izgubo vadbe med delom skozi zanko. Če želite ustvariti optimizator, lahko uvozimo optimalno paket iz modula torch, kjer so na voljo številni optimizacijski algoritmi. Nekateri pogosti, s katerimi ste se morda že srečali, so stohastični gradientni spust in Adam, slednje od tega se uporablja v našem primeru. Adamov konstruktor prevzame parametre modela in parametrizirano stopnjo učenja za dano vadbo. Oglejte si naslednjo kodo:

Zadnji koraki, preden lahko začnemo z usposabljanjem, so izdelava pospeševalnika in načrtovalca hitrosti učenja. Pospeševalec prihaja iz druge knjižnice (predvsem smo uporabljali Transformers), ki jo je izdelal Hugging Face, primerno poimenovan Accelerate, in bo abstrahoval logiko, potrebno za upravljanje naprav med usposabljanjem (na primer z uporabo več grafičnih procesorjev). Za zadnjo komponento si ponovno ogledamo vedno uporabno knjižnico Transformers, da implementiramo naš urnik hitrosti učenja. Z določitvijo vrste razporejevalnika, skupnega števila korakov usposabljanja v naši zanki in predhodno ustvarjenega optimizatorja get_scheduler funkcija vrne objekt, ki nam omogoča prilagajanje naše začetne stopnje učenja skozi celoten proces usposabljanja:

Zdaj smo popolnoma pripravljeni za trening! Postavimo nalogo za usposabljanje, začnimo z instanciacijo training_args z uporabo knjižnice Transformers in izbiro vrednosti parametrov. Te lahko skupaj z našimi drugimi pripravljenimi komponentami in naborom podatkov posredujemo neposredno v trener in začnite z usposabljanjem, kot je prikazano v naslednji kodi. Odvisno od velikosti nabora podatkov in izbranih parametrov lahko to traja precej časa.

Zapakirajte model za sklepanje

Po opravljenem usposabljanju je modelni objekt pripravljen za uporabo za sklepanje. Najboljša praksa je, da svoje delo shranimo za prihodnjo uporabo. Ustvariti moramo artefakte našega modela, jih stisniti skupaj in naložiti naš arhiv v Amazon S3 za shranjevanje. Da pripravimo naš model za stiskanje, moramo odviti zdaj natančno nastavljen model, nato pa shraniti binarno datoteko modela in povezane konfiguracijske datoteke. Prav tako moramo shraniti naš tokenizer v isti imenik, v katerega smo shranili naše artefakte modela, tako da je na voljo, ko uporabimo model za sklepanje. Naš model_dir mapa bi morala zdaj videti nekako takole kot naslednja koda:

Vse kar je ostalo je, da zaženete ukaz tar, da stisnete naš imenik in naložite datoteko tar.gz v Amazon S3:

Naš na novo natančno nastavljen model je zdaj pripravljen in na voljo za uporabo za sklepanje.

Izvedite sklepanje

Če želite za sklepanje uporabiti ta artefakt modela, odprite novo datoteko in uporabite naslednjo kodo ter spremenite model_data parameter, ki ustreza vaši lokaciji shranjevanja artefakta v Amazon S3. The HuggingFaceModel konstruktor bo ponovno zgradil naš model iz kontrolne točke, na katero smo shranili model.tar.gz, ki jih lahko nato razmestimo za sklepanje z uporabo metode razmestitve. Namestitev končne točke bo trajala nekaj minut.

Ko je končna točka uvedena, lahko za njeno testiranje uporabimo napovedovalec, ki smo ga ustvarili. Predaj predict uporabite podatkovno obremenitev in zaženite celico, pa boste prejeli odgovor svojega natančno nastavljenega modela:

Če želite videti prednosti natančnega prilagajanja modela, naredimo hiter preizkus. Naslednja tabela vključuje poziv in rezultate posredovanja tega poziva modelu pred in po natančnem uravnavanju.

| Poziv | Odziv brez natančnega prilagajanja | Odziv s fino nastavitvijo |

| Povzemite simptome, ki jih ima bolnik. Bolnik je 45-letni moški s pritožbami zaradi substernalne bolečine v prsnem košu, ki seva v levo roko. Bolečina se pojavi nenadoma, ko je delal na dvorišču, povezana z blago zasoplostjo in diaforezo. Srčni utrip bolnika je bil ob prihodu 120, dihanje 24, krvni tlak 170/95. Ob prihodu na urgentni oddelek je bil opravljen elektrokardiogram z 12 elektronami in trikratni podjezični nitroglicerin brez olajšanja bolečine v prsih. Elektrokardiogram kaže elevacijo ST v sprednjih odvodih, kar kaže na akutni anteriorni miokardni infarkt. Povezali smo se z laboratorijem za kateterizacijo srca in se pripravljamo na kateterizacijo srca s strani kardiologa. | Predstavljamo primer akutnega miokardnega infarkta. | Bolečina v prsih, sprednji MI, PCI. |

Kot lahko vidite, naš natančno nastavljeni model uporablja zdravstveno terminologijo drugače in lahko smo spremenili strukturo odziva, da bo ustrezal našim namenom. Upoštevajte, da so rezultati odvisni od vašega nabora podatkov in izbir oblikovanja med usposabljanjem. Vaša različica modela bi lahko ponudila zelo različne rezultate.

Čiščenje

Ko končate s svojim prenosnikom SageMaker, ga ne pozabite izklopiti, da se izognete stroškom zaradi dolgotrajnih virov. Upoštevajte, da boste z zaustavitvijo primerka izgubili vse podatke, shranjene v kratkotrajnem pomnilniku primerka, zato morate vse svoje delo pred čiščenjem shraniti v trajno shrambo. Prav tako boste morali iti na Končne točke na konzoli SageMaker in izbrišite vse končne točke, nameščene za sklepanje. Če želite odstraniti vse artefakte, morate iti tudi na konzolo Amazon S3 in izbrisati datoteke, naložene v vaše vedro.

zaključek

V tej objavi smo raziskali različne možnosti za izvajanje tehnik povzemanja besedila na SageMakerju, da bi zdravstvenim delavcem pomagali pri učinkoviti obdelavi in pridobivanju vpogledov iz ogromnih količin kliničnih podatkov. Razpravljali smo o uporabi temeljnih modelov SageMaker Jumpstart, natančnem prilagajanju predhodno usposobljenih modelov iz Hugging Face in gradnji modelov povzemanja po meri. Vsak pristop ima svoje prednosti in slabosti, ki ustrezajo različnim potrebam in zahtevam.

Gradnja modelov povzemanja po meri na SageMakerju omogoča veliko prilagodljivosti in nadzora, vendar zahteva več časa in virov kot uporaba vnaprej usposobljenih modelov. Modeli temeljev SageMaker Jumpstart nudijo preprosto in stroškovno učinkovito rešitev za organizacije, ki ne potrebujejo posebnega prilagajanja ali natančnega prilagajanja, kot tudi nekaj možnosti za poenostavljeno natančno prilagajanje. Natančna nastavitev vnaprej pripravljenih modelov iz Hugging Face ponuja hitrejše čase usposabljanja, boljšo zmogljivost, specifično za domeno, in brezhibno integracijo z orodji in storitvami SageMaker v širokem katalogu modelov, vendar zahteva nekaj truda pri implementaciji. V času pisanja te objave je Amazon napovedal še eno možnost, Amazon Bedrock, ki bo ponujal zmožnosti povzemanja v še bolj upravljanem okolju.

Z razumevanjem prednosti in slabosti vsakega pristopa lahko zdravstveni delavci in organizacije sprejemajo informirane odločitve o najprimernejši rešitvi za ustvarjanje jedrnatih in natančnih povzetkov zapletenih kliničnih podatkov. Konec koncev lahko uporaba povzemajočih modelov, ki temeljijo na AI/ML, v SageMakerju znatno izboljša oskrbo pacientov in sprejemanje odločitev, tako da zdravstvenim delavcem omogoči hiter dostop do ustreznih informacij in se osredotoči na zagotavljanje kakovostne oskrbe.

viri

Za celoten skript, obravnavan v tej objavi, in nekaj vzorčnih podatkov glejte GitHub repo. Za več informacij o izvajanju delovnih obremenitev ML na AWS si oglejte naslednje vire:

O avtorjih

Cody Collins je newyorški arhitekt rešitev pri Amazon Web Services. Sodeluje s strankami ISV pri gradnji vodilnih rešitev v oblaku. Uspešno je izvajal kompleksne projekte za različne industrije, optimiziral učinkovitost in razširljivost. V prostem času rad bere, potuje in trenira jiu jitsu.

Cody Collins je newyorški arhitekt rešitev pri Amazon Web Services. Sodeluje s strankami ISV pri gradnji vodilnih rešitev v oblaku. Uspešno je izvajal kompleksne projekte za različne industrije, optimiziral učinkovitost in razširljivost. V prostem času rad bere, potuje in trenira jiu jitsu.

Ameer Hakme je arhitekt rešitev AWS, ki živi v Pensilvaniji. Njegova poklicna osredotočenost vključuje sodelovanje z neodvisnimi prodajalci programske opreme na severovzhodu, ki jih vodi pri načrtovanju in izdelavi razširljivih, najsodobnejših platform v oblaku AWS.

Ameer Hakme je arhitekt rešitev AWS, ki živi v Pensilvaniji. Njegova poklicna osredotočenost vključuje sodelovanje z neodvisnimi prodajalci programske opreme na severovzhodu, ki jih vodi pri načrtovanju in izdelavi razširljivih, najsodobnejših platform v oblaku AWS.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Avtomobili/EV, Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- BlockOffsets. Posodobitev okoljskega offset lastništva. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :ima

- : je

- :ne

- :kje

- $GOR

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Sposobna

- O meni

- POVZETEK

- pospeši

- plin

- dostop

- Račun

- natančna

- čez

- dejavnosti

- Adam

- naslavljanje

- zdravilo

- napredno

- Prednosti

- po

- spet

- združevanje

- AI

- ai raziskave

- AI / ML

- algoritmi

- vsi

- Dovoli

- omogoča

- skupaj

- že

- Prav tako

- Amazon

- Amazon SageMaker

- Amazon Web Services

- znesek

- zneski

- an

- analizirati

- in

- razglasitve

- Še ena

- kaj

- API

- API-ji

- primerno

- aplikacije

- uporabna

- pristop

- pristopi

- primerno

- Arhitektura

- SE

- ARM

- Prihod

- članek

- AS

- povezan

- At

- pozornosti

- avtomatizacija

- Na voljo

- izogniti

- stran

- AWS

- uravnoteženje

- temeljijo

- BE

- ker

- bilo

- pred

- začetek

- koristi

- Prednosti

- BEST

- Boljše

- BIN

- kri

- Krvni tlak

- Bloom

- Pasovi

- Dih

- široka

- izgradnjo

- gradbeniki

- Building

- zgrajena

- vgrajeno

- vendar

- by

- klic

- se imenuje

- CAN

- Zmogljivosti

- ki

- previdno

- primeru

- primeri

- Katalog

- Vzrok

- izzivi

- spremenite

- klepetalnice

- možnosti

- Izberite

- izbiri

- izbran

- razred

- klinični

- Cloud

- Koda

- Kode

- Kodiranje

- sodelovati

- Stolpec

- Stolpci

- kako

- prihaja

- Skupno

- v primerjavi z letom

- Pritožbe

- kompleksna

- skladnost

- komponenta

- deli

- sestavljajo

- zgoščeno

- konfiguracija

- Proti

- Konzole

- gradnjo

- ozadje

- nadzor

- Priročen

- Ustrezno

- stroškovno učinkovito

- stroški

- bi

- zajeti

- ustvarjajo

- ustvaril

- Ustvarjanje

- ključnega pomena

- Trenutno

- po meri

- stranka

- Stranke, ki so

- customization

- datum

- nabor podatkov

- Odločanje

- odločitve

- opredelitev

- dostavi

- dokazuje

- Oddelek

- odvisno

- Odvisno

- razporedi

- razporejeni

- uvajanja

- uvajanje

- Oblikovanje

- zasnovan

- oblikovanje

- želeno

- Podrobnosti

- razvili

- naprave

- drugačen

- neposredno

- odkril

- razpravlja

- razpravljali

- razne

- do

- Zdravniki

- tem

- domena

- domen

- opravljeno

- dont

- navzdol

- pomanjkljivosti

- med

- vsak

- lažje

- enostavno

- lahka

- enostaven za uporabo

- učinkovito

- učinkovitosti

- učinkovite

- učinkovito

- prizadevanje

- Electronic

- Elektronski zdravstveni zapisi

- upravičenost

- v sili

- omogočajo

- omogoča

- omogočanje

- Končna točka

- Inženiring

- okrepi

- zagotovitev

- Podjetje

- Vpis

- okolje

- epoha

- bistvena

- Tudi

- razvija

- Primer

- obstoječih

- izkušnje

- doživlja

- raziskuje

- Raziskano

- Raziskovati

- razširitev

- ekstrakt

- Obraz

- soočen

- daleč

- hitreje

- Fed

- Nekaj

- file

- datoteke

- končna

- končno

- Najdi

- iskanje

- prva

- fit

- prilagodljivost

- Osredotočite

- sledi

- po

- za

- format

- Fundacija

- iz

- polno

- v celoti

- funkcija

- Poleg tega

- Prihodnost

- Gain

- splošno

- ustvarjajo

- ustvarila

- ustvarjajo

- dobili

- pridobivanje

- Daj

- dana

- Giving

- Go

- Googlova

- Grafične kartice

- veliko

- več

- zagotovljena

- Imajo

- he

- Zdravje

- zdravstveno varstvo

- Srce

- pomoč

- njegov

- gostovanje

- Kako

- Kako

- HTML

- http

- HTTPS

- Hub

- HuggingFace

- idealen

- if

- slikanje

- izvajati

- Izvajanje

- izvajanja

- uvoz

- Pomembno

- izboljšanje

- in

- Poglobljena

- vključujejo

- vključuje

- Vključno

- Neodvisni

- industrij

- Industrija

- Podatki

- obvestila

- začetna

- vhod

- vhodi

- vpogledi

- primer

- Navodila

- integracija

- Intelligence

- v

- vključujejo

- IT

- ITS

- Job

- json

- samo

- Vedite

- znanje

- lab

- Labs

- Pokrajina

- jezik

- velika

- Zadnja

- pozneje

- vodi

- vodi

- Interesenti

- UČITE

- učenje

- levo

- Knjižnica

- kot

- LLM

- obremenitev

- nalaganje

- kraj aktivnosti

- Logika

- Poglej

- izgubiti

- off

- stroj

- strojno učenje

- je

- vzdrževati

- Znamka

- Izdelava

- upravljanje

- upravlja

- upravljanje

- map

- Trženje

- Maj ..

- pomeni

- medicinski

- Srečati

- Spomin

- pol

- Metoda

- morda

- minimalna

- Minute

- ML

- Model

- modeli

- Moduli

- več

- Najbolj

- Najbolj popularni

- več

- Imenovan

- naravna

- Obdelava Natural Language

- Krmarjenje

- Nimate

- potrebe

- Novo

- NY

- na novo

- Naslednja

- nlp

- št

- prenosnik

- Opombe

- zdaj

- Številka

- predmet

- predmeti

- of

- ponudba

- ponujen

- Ponudbe

- Staro

- on

- ONE

- tiste

- začetku

- na

- odprite

- open source

- deluje

- optimizacija

- Optimizirajte

- optimizirana

- optimizacijo

- Možnost

- možnosti

- or

- Da

- organizacije

- izvirno

- Ostalo

- drugače

- naši

- ven

- izhod

- zunaj

- več

- lastne

- lastništvo

- paket

- embalaža

- Stran

- bolečina

- parameter

- parametri

- zlasti

- mimo

- Podaje

- Bolnik

- bolniki

- Pegasus

- Pennsylvania

- performance

- ki se nanašajo

- stavki

- platforma

- Platforme

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Točka

- Popular

- Prispevek

- močan

- Napajanje

- praksa

- Predictor

- raje

- Pripravimo

- pripravljeni

- predstaviti

- tlak

- predogled

- prej

- v prvi vrsti

- Postopek

- Procesi

- obravnavati

- Proizvedeno

- strokovni

- strokovnjaki

- projekti

- Obljuba

- lastniško

- PROS

- zagotavljajo

- če

- zagotavlja

- zagotavljanje

- zagotavljanje

- Namen

- namene

- dal

- Python

- kakovost

- Hitri

- hitro

- območje

- hitro

- Oceniti

- reading

- pripravljen

- resnični svet

- evidence

- pomembno

- Oprostitev

- odstrani

- Poročila

- zahteva

- obvezna

- Zahteve

- zahteva

- Raziskave

- viri

- Odgovor

- Rezultati

- vrne

- pregleda

- vloga

- Run

- tek

- deluje

- sagemaker

- Enako

- Shrani

- Prilagodljivost

- razširljive

- Obseg

- praska

- SDK

- sdks

- brezšivne

- oddelki

- varnost

- glej

- ločena

- Storitev

- Storitve

- nastavite

- nastavitev

- nastavitve

- več

- skrajšana

- shouldnt

- Prikaži

- pokazale

- Razstave

- ugašati

- Presejati

- pomemben

- bistveno

- Podoben

- Enostavno

- poenostavljeno

- Velikosti

- So

- doslej

- Software

- Rešitev

- rešitve

- nekaj

- Nekaj

- Viri

- specifična

- posebej

- porabljen

- Začetek

- Začetek

- Država

- state-of-the-art

- Koraki

- shranjevanje

- trgovina

- shranjeni

- shranjevanje

- racionalizacijo

- Struktura

- studio

- podjezična

- Uspešno

- taka

- nenadoma

- Suit

- primerna

- POVZETEK

- Preverite

- Simptomi

- sinopsis

- sintetična

- sintetični podatki

- sistemi

- miza

- Bodite

- sprejeti

- meni

- Naloga

- Naloge

- tehnike

- terminologija

- Pogoji

- Test

- kot

- da

- O

- pesto

- Njih

- POTEM

- te

- jih

- ta

- tisti,

- 3

- skozi

- vsej

- čas

- zamudno

- krat

- do

- današnje

- skupaj

- tokenizirano

- Boni

- orodja

- baklo

- Skupaj za plačilo

- Vlak

- usposobljeni

- usposabljanje

- preoblikovati

- transformator

- transformatorji

- Potovanje

- dva

- tip

- Vrste

- tipično

- ui

- Konec koncev

- ne morem

- pod

- razumeli

- razumevanje

- Nadgradnja

- naložili

- us

- uporaba

- primeru uporabe

- Rabljeni

- Uporabniku prijazen

- uporablja

- uporabo

- Uporaben

- potrjevanje

- Vrednote

- različnih

- Popravljeno

- prodajalci

- vsestranski

- različica

- zelo

- prostornine

- želeli

- je

- we

- Wealth

- web

- spletne storitve

- tehta

- Dobro

- Kaj

- kdaj

- ki

- medtem

- široka

- Širok spekter

- bo

- z

- brez

- besede

- delo

- deluje

- deluje

- bi

- pisanje

- leto

- york

- Vi

- Vaša rutina za

- zefirnet

- Zip