Google ga je začasno ustavil Gemini AI od ustvarjanja podob 'ljudi' po razburjenju zaradi njegovih izkrivljenih rasnih predstav.

Tehnično podjetje je ukrepalo, potem ko so uporabniki poudarili težnjo umetne inteligence, da prikazuje predvsem barvne ljudi, tudi v zgodovinsko netočnih kontekstih. Namen te poteze je izboljšati zmožnosti Gemini, da zagotovi natančnejše in raznolike upodobitve.

Preberite tudi: To je šala! Uporabniki se posmehujejo Googlovemu Gemini, ker ga pogrešajo

Geneza povratnega udarca

Jedro polemike je v neuspehu umetne inteligence, da v svojih slikah natančno odraža rasno raznolikost. Družbeni mediji so postali bojno polje, kjer so uporabniki delili slike, ki jih je ustvaril Gemini, ki so se oddaljile od zgodovinske in kulturne natančnosti. Pomembni primeri vključujejo upodobitve nebelih Švedin in temnopoltih ljudi v nacističnih uniformah.

Google Gemini je nerodno težko prepričati, da prizna, da belci obstajajo pic.twitter.com/4lkhD7p5nR

—Deedy (@debarghya_das) Februar 20, 2024

Takšne netočnosti niso le sprožile razprave na družbenih omrežjih, ampak so povzročile tudi hudo introspekcijo v Googlu, pri čemer so zaposleni izražanje zadrega zaradi pomanjkljivosti AI. Kritiki trdijo, da te netočnosti niso zgolj tehnične napake, ampak odražajo globljo pristranskost pri programiranju AI.

»Še nikoli mi ni bilo tako nerodno delati za podjetje,« je povedal St. Ratej, raziskovalni inženir pri Google ARVR, v objavi X.

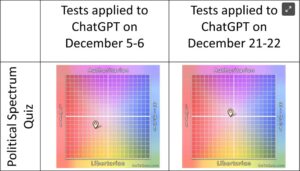

Odziv pa se ni ustavil le pri Googlu, saj so nekateri uporabniki opazili enake pristranskosti tudi pri drugih platformah umetne inteligence, npr. OpenAI's ChatGPT. Posledično so se pojavila vprašanja o doslednosti nadzora med tehnologijami umetne inteligence, kar je poudarilo širši izziv celotne panoge zagotavljanja nepristranskih predstavitev umetne inteligence.

Er fantje ... izgleda, da ima chatGPT enako težavo z moraliziranjem.

Zakaj dobijo brezplačno vozovnico? pic.twitter.com/a1ZBz69iZw

— Liv Boeree (@Liv_Boeree) Februar 21, 2024

Učinek valovanja

Incident ni le okrnil podobe podjetja, ampak je povzročil tudi širšo razpravo o etiki in zastopanju umetne inteligence. Elon Musk je kritiziral Googlovo metodologijo in jo označil za "rasistično" in "proticivilizacijsko". Muskova komentarji nadalje odmevajo naraščajočo zaskrbljenost glede etičnih meja tehnologije umetne inteligence in potrebe po bolj raznolikem in natančnem prikazovanju vsebine, ustvarjene z umetno inteligenco.

"Vesel sem, da je Google pretiraval s svojim ustvarjanjem slik z umetno inteligenco, saj je njihovo noro rasistično, proticivilizacijsko programiranje postalo jasno vsem."

Kot odgovor na polemiko je Musk izrazil svoj model AI, Grok, za katerega je nameraval izdati nadaljnje različice. Tehnologija dokazuje konkurenčno prednost pri razvoju umetne inteligence, kar bi lahko pomagalo premagati omejitve obstoječih modelov, kot je Gemini. Poleg tega je naključna podobnost imena med Grokom in čipom Groq LPU vzbudila zanimanje, saj je trg umetne inteligence zaznamovan s hitrimi inovacijami in ostro konkurenco.

Morda je zdaj jasno, zakaj @xAIGrok je tako pomemben.

Trenutno še zdaleč ni popolno, a se bo hitro izboljšalo. V1.5 izide čez 2 tedna.

Strogo iskanje resnice, ne glede na kritiko, še nikoli ni bilo tako pomembno.

- Elon Musk (@elonmusk) Februar 22, 2024

Pot do izboljšav

Ker je Google priznal težavo, je nameraval izboljšati zmožnosti upodobitve Gemini. Podjetje je poudarilo pomen raznolikosti v slikah, ustvarjenih z umetno inteligenco, vendar je priznalo pomanjkljivosti trenutnega modela pri natančnem predstavljanju vseh demografskih podatkov.

Že delamo na odpravljanju nedavnih težav s funkcijo generiranja slik Gemini. Medtem ko bomo to počeli, bomo začasno ustavili ustvarjanje slik ljudi in kmalu znova izdali izboljšano različico. https://t.co/SLxYPGoqOZ

- Google Communications (@Google_Comms) Februar 22, 2024

V istem duhu je Googlov tiskovni predstavnik Krawczyk priznal pomanjkljivost modela in poudaril potrebo po bolj uravnoteženi upodobitvi, ki odraža globalno raznolikost, ne da bi pri tem ogrozila zgodovinsko natančnost. Da bi rešil te pomisleke, je Google začasno ustavil Geminijevo funkcijo generiranja človeških slik, kar je signaliziralo izboljšano različico, ki bolje odraža globalno raznolikost baze uporabnikov.

»Že delamo na odpravljanju nedavnih težav s funkcijo generiranja slik Gemini. Medtem ko bomo to počeli, bomo začasno ustavili ustvarjanje slik ljudi in kmalu znova izdali izboljšano različico.«

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://metanews.com/google-halts-gemini-ai-amid-backlash-over-woke-image-controversies/

- :ima

- : je

- :ne

- 13

- 20

- 22

- 7

- 8

- 9

- a

- O meni

- natančnost

- natančna

- natančno

- potrditi

- čez

- Ukrep

- Naslov

- priznal

- po

- AI

- Cilje

- vsi

- že

- Prav tako

- an

- in

- SE

- trdijo

- AS

- At

- uravnotežen

- baza

- bojišče

- postal

- bilo

- Boljše

- med

- pristranskosti

- pristranskosti

- Meje

- širši

- vendar

- by

- kliče

- Zmogljivosti

- izziv

- ChatGPT

- čip

- jasno

- barva

- Communications

- podjetje

- Podjetja

- Tekmovanje

- konkurenčno

- ogrozili

- Skrb

- Skrbi

- Posledično

- vsebina

- kontekstih

- polemiko

- Core

- kritika

- Kritiki

- kulturne

- Trenutna

- Razprava

- razprave

- Demografski podatki

- dokazuje,

- Razvoj

- DID

- razne

- raznolikost

- do

- echo

- Edge

- Elon

- Elon Musk

- je poudaril,

- poudarjajo

- Zaposleni

- inženir

- okrepljeno

- zagotovitev

- zagotoviti

- bistvena

- etično

- etika

- Tudi

- Primeri

- obstajajo

- obstoječih

- izražena

- Napaka

- daleč

- FAST

- Feature

- Firm

- po

- za

- brezplačno

- iz

- nadalje

- Poleg tega

- Gemini

- ustvarjajo

- generacija

- Genesis

- dobili

- pridobivanje

- Globalno

- dogaja

- Googlova

- Pridelovanje

- strani

- Trdi

- Imajo

- he

- pomoč

- Poudarjeno

- poudarjanje

- njegov

- zgodovinski

- Zgodovinsko

- Vendar

- HTTPS

- človeškega

- slika

- slike

- Pomembnost

- Pomembno

- izboljšanje

- izboljšalo

- in

- V drugi

- netočne

- nesreča

- vključujejo

- Inovacije

- INSANE

- namenjen

- obresti

- introspekcija

- vprašanje

- Vprašanja

- IT

- ITS

- samo

- Led

- Leži

- kot

- omejitve

- LIV

- POGLEDI

- je

- označeno

- Tržna

- mediji

- Mers

- Metodologija

- morda

- manjka

- Model

- modeli

- več

- premikanje

- Musk

- Ime

- Nazi

- Nimate

- nikoli

- opazen

- zdaj

- of

- on

- samo

- Ostalo

- izhodi

- več

- Premagajte

- mimo

- pot

- pavza

- premor

- ljudje

- popolna

- Platforme

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Prispevek

- v prvi vrsti

- globok

- Programiranje

- zasledovanje

- vprašanja

- rasistični

- hitro

- RE

- Preberi

- nedavno

- izboljšati

- odražajo

- odseva

- obravnavajo

- sprostitev

- Izpusti

- zastopanje

- predstavlja

- Raziskave

- Odgovor

- Pravica

- Ripple

- s

- Je dejal

- Enako

- pregled

- huda

- delitev

- pomanjkljivosti

- primanjkljaj

- So

- socialna

- družbeni mediji

- nekaj

- Kmalu

- iskala

- Tiskovni predstavnik

- stop

- Švedski

- tech

- tehnični

- Tehnologije

- Tehnologija

- da

- O

- njihove

- te

- jih

- ta

- do

- vzel

- Res

- Resnica

- nepristransko

- uporabnik

- Uporabniki

- v1

- različica

- različice

- we

- Weeks

- ki

- medtem

- bele

- zakaj

- bo

- z

- v

- brez

- Ženske

- delo

- deluje

- X

- zefirnet