V dinamičnem svetu pretakanja naprej Amazon Music, vsako iskanje pesmi, poddaje ali seznama predvajanja vsebuje zgodbo, razpoloženje ali poplavo čustev, ki čakajo, da jih razkrijete. Ta iskanja služijo kot prehod do novih odkritij, cenjenih izkušenj in trajnih spominov. Iskalna vrstica ni samo iskanje pesmi; gre za milijone aktivnih uporabnikov, ki začnejo svojo osebno pot v bogat in raznolik svet, ki ga ponuja Amazon Music.

Za zagotavljanje vrhunske uporabniške izkušnje za takojšnje iskanje glasbe, ki jo uporabniki iščejo, je potrebna platforma, ki je hkrati pametna in odzivna. Amazon Music uporablja moč umetne inteligence, da to doseže. Vendar je optimizacija uporabniške izkušnje ob upravljanju stroškov usposabljanja in sklepanja modelov umetne inteligence, ki poganjajo zmogljivosti iskalne vrstice, kot sta preverjanje črkovanja in vektorsko iskanje v realnem času, težavna v času prometnih konic.

Amazon SageMaker zagotavlja nabor storitev od konca do konca, ki Amazon Music omogoča gradnjo, usposabljanje in uvajanje v oblaku AWS z minimalnim naporom. S skrbjo za nediferencirano dvigovanje težkih predmetov vam SageMaker omogoča, da se osredotočite na delo na svojih modelih strojnega učenja (ML) in ne skrbite za stvari, kot je infrastruktura. Kot del modela deljene odgovornosti SageMaker zagotavlja, da so storitve, ki jih ponuja, zanesljive, zmogljive in razširljive, medtem ko vi poskrbite, da uporaba modelov ML kar najbolje izkoristi zmogljivosti, ki jih ponuja SageMaker.

V tej objavi se sprehodimo po poti, ki jo je opravila Amazon Music, da bi optimizirala zmogljivost in stroške z uporabo SageMaker in NVIDIA Triton Inference Server ter TensorRT. Poglobili smo se v prikaz delovanja te navidezno preproste, a zapletene vrstice za iskanje, ki zagotavlja neprekinjeno potovanje v vesolje Amazon Music z malo do nič frustrirajočimi zamudami pri tipkanju in ustreznimi rezultati iskanja v realnem času.

Amazon SageMaker in NVIDIA: Zagotavljanje hitrega in natančnega vektorskega iskanja in zmožnosti preverjanja črkovanja

Amazon Music ponuja obsežno knjižnico z več kot 100 milijoni pesmi in milijoni epizod podcastov. Vendar pa je iskanje prave pesmi ali poddaje lahko izziv, zlasti če ne poznate točnega naslova, izvajalca ali imena albuma ali če je iskalna poizvedba zelo široka, na primer »novice podcasti«.

Amazon Music je ubral dvostranski pristop za izboljšanje postopka iskanja in priklica. Prvi korak je uvedba vektorskega iskanja (znanega tudi kot iskanje na podlagi vdelave), tehnike ML, ki lahko uporabnikom pomaga najti najbolj ustrezno vsebino, ki jo iščejo, z uporabo semantike vsebine. Drugi korak vključuje uvedbo modela popravljanja črkovanja, ki temelji na transformatorju, v iskalni sklad. To je lahko še posebej koristno pri iskanju glasbe, saj uporabniki morda ne vedo vedno točnega črkovanja naslova pesmi ali imena izvajalca. Popravek črkovanja lahko uporabnikom pomaga najti glasbo, ki jo iščejo, tudi če v iskalni poizvedbi naredijo črkovalno napako.

Uvedba transformatorskih modelov v cevovod za iskanje in pridobivanje (v generiranju vdelave poizvedbe, potrebnem za vektorsko iskanje, in generativnem transformatorskem modelu Seq2Seq v popravljanju črkovanja) lahko povzroči znatno povečanje splošne zakasnitve, kar negativno vpliva na uporabniško izkušnjo. Zato je za nas postala glavna prednostna naloga optimizacija zakasnitve sklepanja v realnem času za modele vektorskega iskanja in popravljanja črkovanja.

Amazon Music in NVIDIA sta se združila, da bi v iskalno vrstico prinesla najboljšo možno uporabniško izkušnjo, s pomočjo SageMakerja za implementacijo hitrih in natančnih zmožnosti preverjanja črkovanja ter semantičnih iskalnih predlogov v realnem času z uporabo tehnik, ki temeljijo na vektorskem iskanju. Rešitev vključuje uporabo gostovanja SageMaker, ki ga poganjajo instance G5, ki uporabljajo grafične procesorje NVIDIA A10G Tensor Core, vsebnik NVIDIA Triton Inference Server Container, ki ga podpira SageMaker, in NVIDIA TensorRT format modela. Z zmanjšanjem zakasnitve sklepanja modela preverjanja črkovanja na 25 milisekund pri največjem prometu in zmanjšanjem zakasnitve generiranja vdelave iskalne poizvedbe za povprečno 63 % in stroškov za 73 % v primerjavi s sklepanjem, ki temelji na procesorju, je Amazon Music izboljšal zmogljivost iskalne vrstice.

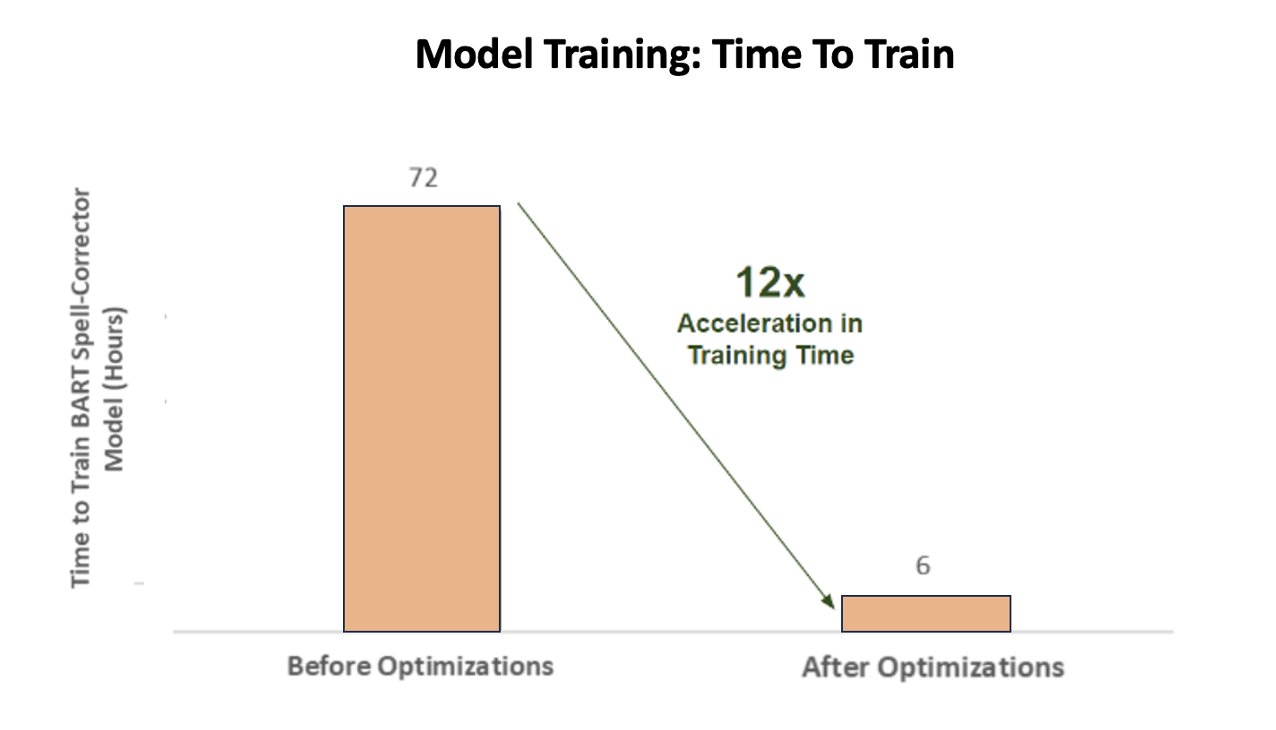

Poleg tega je Amazon Music pri usposabljanju modela umetne inteligence za zagotavljanje natančnih rezultatov dosegel neverjeten 12-kratni pospešek v času usposabljanja za svoj model pretvornika črkovalcev korektorja črkovanja BART, s čimer je prihranil tako čas kot denar z optimizacijo izkoriščenosti GPE.

Amazon Music je sodeloval z NVIDIA, da bi dal prednost izkušnji iskanja strank in oblikoval iskalno vrstico z dobro optimiziranimi funkcijami preverjanja črkovanja in vektorskega iskanja. V naslednjih razdelkih delimo več o tem, kako so bile te optimizacije orkestrirane.

Optimizacija usposabljanja z grafičnimi procesorji NVIDIA Tensor Core

Pridobitev dostopa do grafičnega procesorja NVIDIA Tensor Core za usposabljanje velikih jezikovnih modelov ni dovolj, da bi zajeli njegov resnični potencial. Obstajajo ključni koraki optimizacije, ki se morajo izvesti med usposabljanjem, da bi v celoti povečali izkoristek GPE. Vendar pa bo premalo izkoriščen GPE nedvomno povzročil neučinkovito uporabo virov, podaljšano trajanje usposabljanja in povečane operativne stroške.

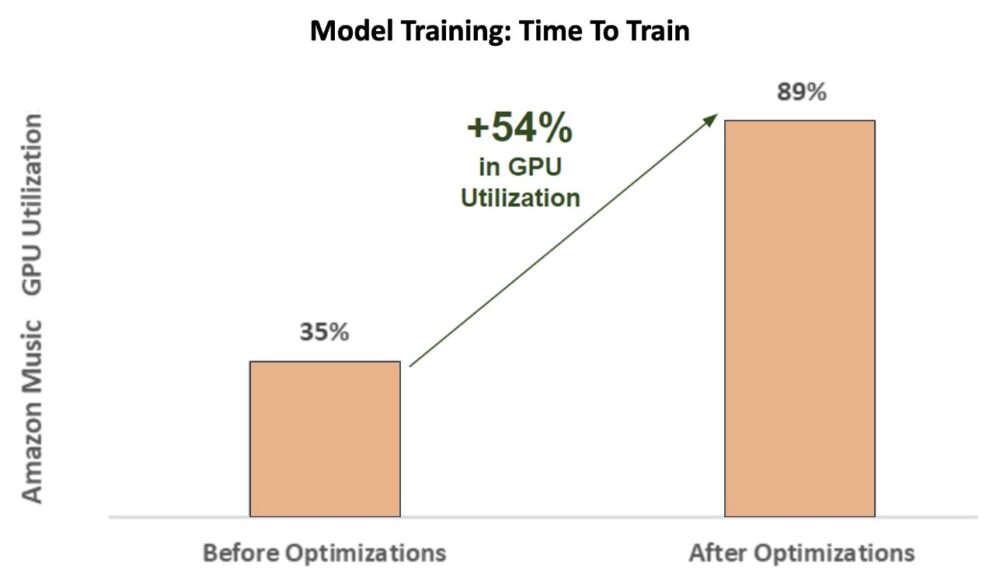

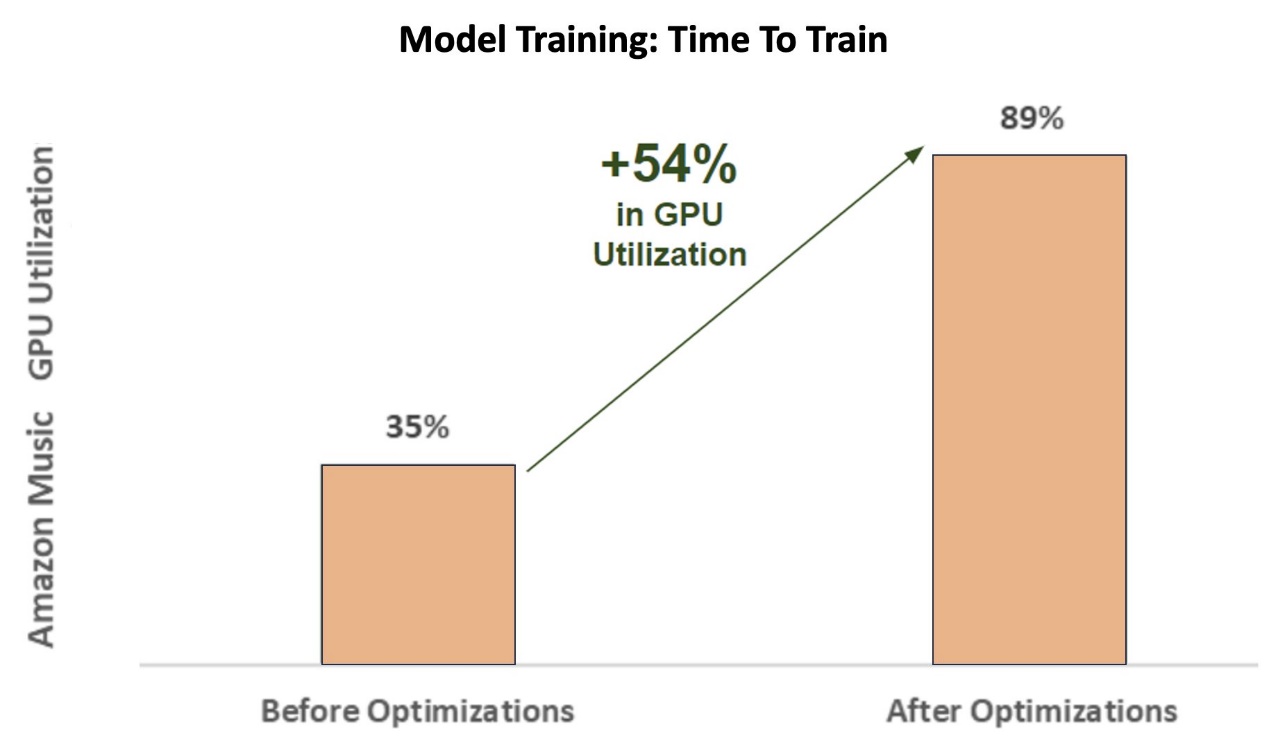

V začetnih fazah usposabljanja se uporablja korektor črkovanja BART (bart-osnova) model transformatorja na primerku SageMaker ml.p3.24xlarge (8 grafičnih procesorjev NVIDIA V100 Tensor Core), je bila izkoriščenost grafičnih procesorjev Amazon Music okoli 35 %. Da bi povečali prednosti usposabljanja, pospešenega z GPU NVIDIA, so arhitekti rešitev AWS in NVIDIA podprli Amazon Music pri prepoznavanju področij za optimizacije, zlasti okoli velikosti serije in parametrov natančnosti. Ta dva ključna parametra vplivata na učinkovitost, hitrost in natančnost usposabljanja modelov globokega učenja.

Posledične optimizacije so prinesle novo in izboljšano izkoriščenost grafičnega procesorja V100, enakomerno na približno 89 %, kar je drastično skrajšalo čas usposabljanja Amazon Music s 3 dni na 5–6 ur. S preklopom velikosti serije iz 32 na 256 in uporabo optimizacijskih tehnik, kot je tek avtomatski mešani trening natančnosti namesto samo z natančnostjo FP32 je Amazon Music lahko prihranil čas in denar.

Naslednji grafikon prikazuje 54-odstotno povečanje izkoriščenosti GPE po optimizacijah.

Naslednja slika prikazuje pospešek v času vadbe.

To povečanje velikosti paketa je omogočilo grafičnemu procesorju NVIDIA, da sočasno obdela bistveno več podatkov v več tenzorskih jedrih, kar je povzročilo pospešen čas usposabljanja. Vendar je pomembno ohraniti občutljivo ravnovesje s pomnilnikom, saj večje velikosti paketov zahtevajo več pomnilnika. Tako povečanje velikosti serije kot uporaba mešane natančnosti sta lahko ključnega pomena pri sprostitvi moči grafičnih procesorjev NVIDIA Tensor Core.

Ko je bil model usposobljen za konvergenco, je prišel čas za optimizacijo za uvajanje sklepanja v iskalni vrstici Amazon Music.

Popravek črkovanja: sklepanje po modelu BART

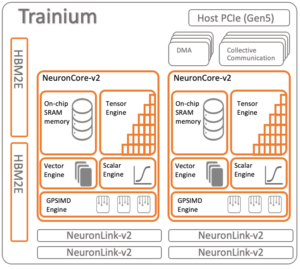

S pomočjo instanc SageMaker G5 in strežnika NVIDIA Triton Inference Server (odprtokodna programska oprema za streženje sklepanja) ter NVIDIA TensorRT, SDK za visoko zmogljivo sklepanje poglobljenega učenja, ki vključuje optimizator sklepanja in izvajalno okolje, Amazon Music omejuje njihovo preverjanje črkovanja BART (bart-osnova) modelira zakasnitev sklepanja strežnika na samo 25 milisekund pri največjem prometu. To vključuje režijske stroške, kot so izravnava obremenitve, predprocesiranje, sklepanje modela in časi naknadne obdelave.

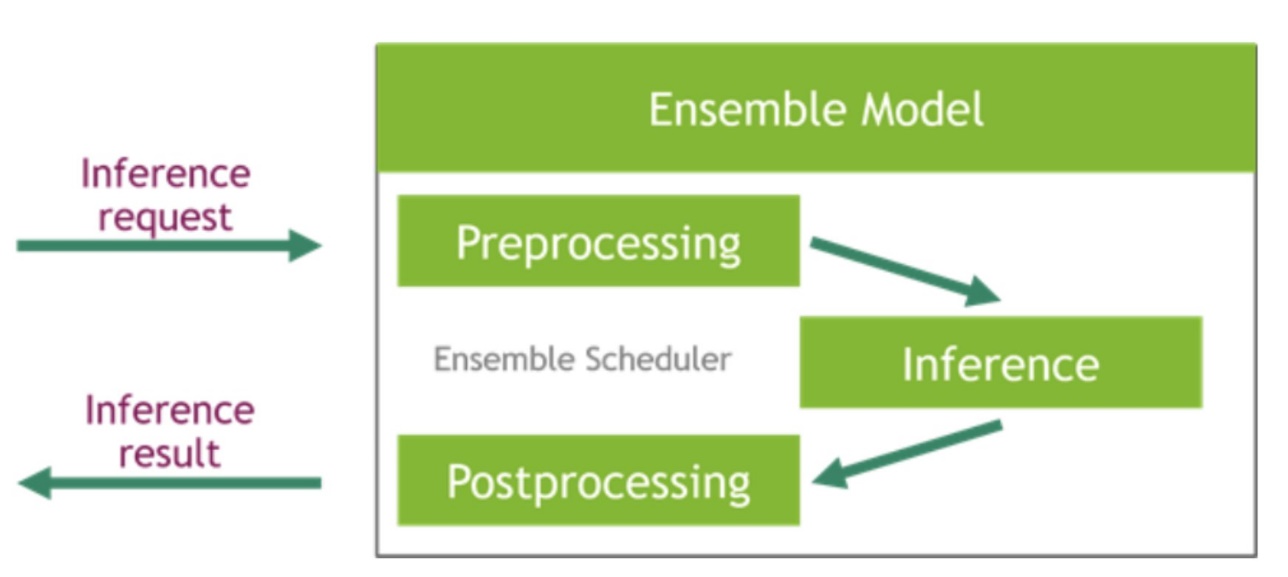

NVIDIA Triton Inference Server ponuja dve različni vrsti zaledja: eno za gostovanje modelov na GPE in zaledje Python, kamor lahko prinesete svojo lastno kodo po meri, ki se uporablja v korakih predprocesiranja in naknadne obdelave. Naslednja slika prikazuje shema modelnega ansambla.

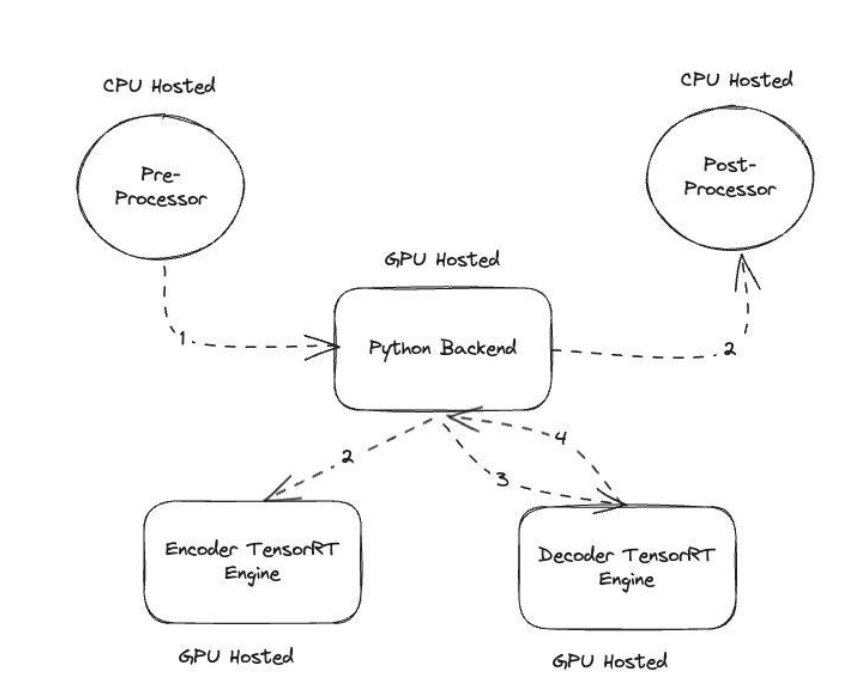

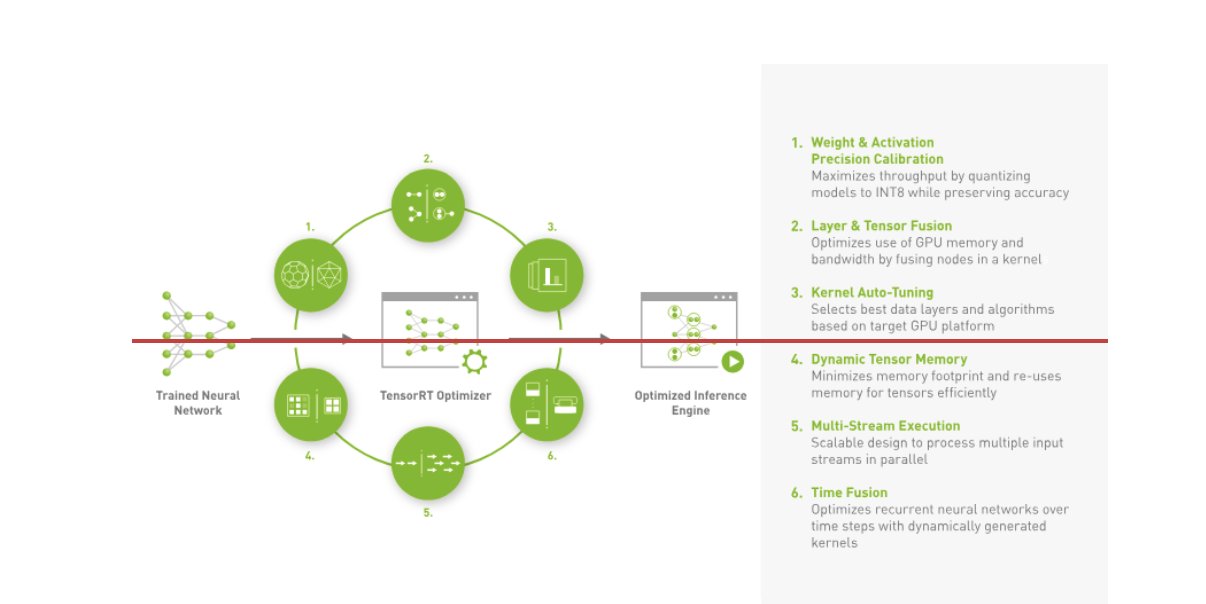

Amazon Music je zgradil svoj BART sklepni cevovod z izvajanjem korakov predprocesiranja (tokenizacija besedila) in naknadne obdelave (žetoni v besedilo) na CPE-jih, medtem ko se korak izvajanja modela izvaja na GPU NVIDIA A10G Tensor Core. Zaledje Python se nahaja na sredini korakov predprocesiranja in naknadnega procesiranja in je odgovorno za komunikacijo z modeli BART, pretvorjenimi s TensorRT, ter omrežji kodirnikov/dekodirnikov. TensorRT povečuje zmogljivost sklepanja z natančno kalibracijo, zlivanjem slojev in tenzorjev, samodejnim prilagajanjem jedra, dinamičnim pomnilnikom tenzorjev, izvajanjem več tokov in združevanjem časa.

Naslednja slika ponazarja visokonivojsko zasnovo ključnih modulov, ki sestavljajo cevovod sklepanja modela korektorja črkovanja BART.

Iskanje vektorjev: stavek za ustvarjanje vdelave poizvedbe BERT model inferencing

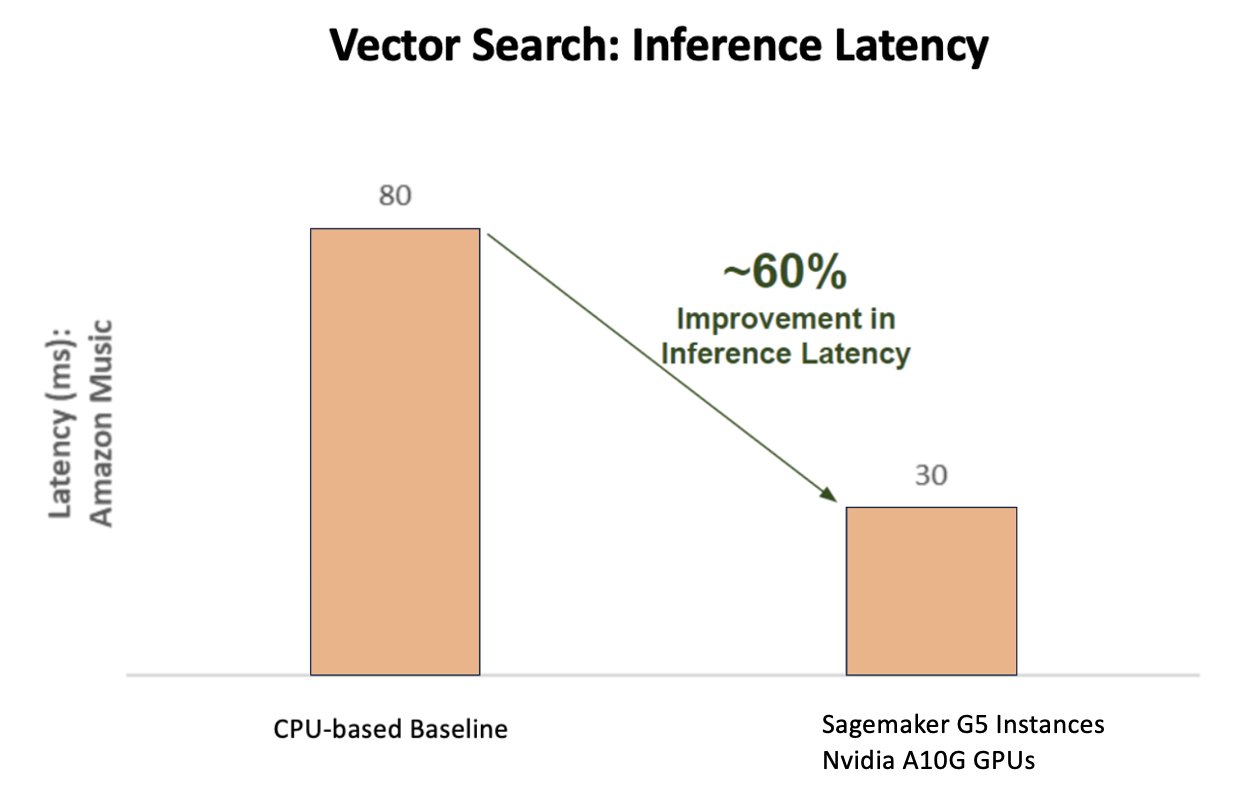

Naslednja tabela ponazarja 60-odstotno izboljšanje zakasnitve (servira p90 800–900 TPS) pri uporabi platforme NVIDIA AI Inference Platform v primerjavi z osnovno linijo, ki temelji na CPE.

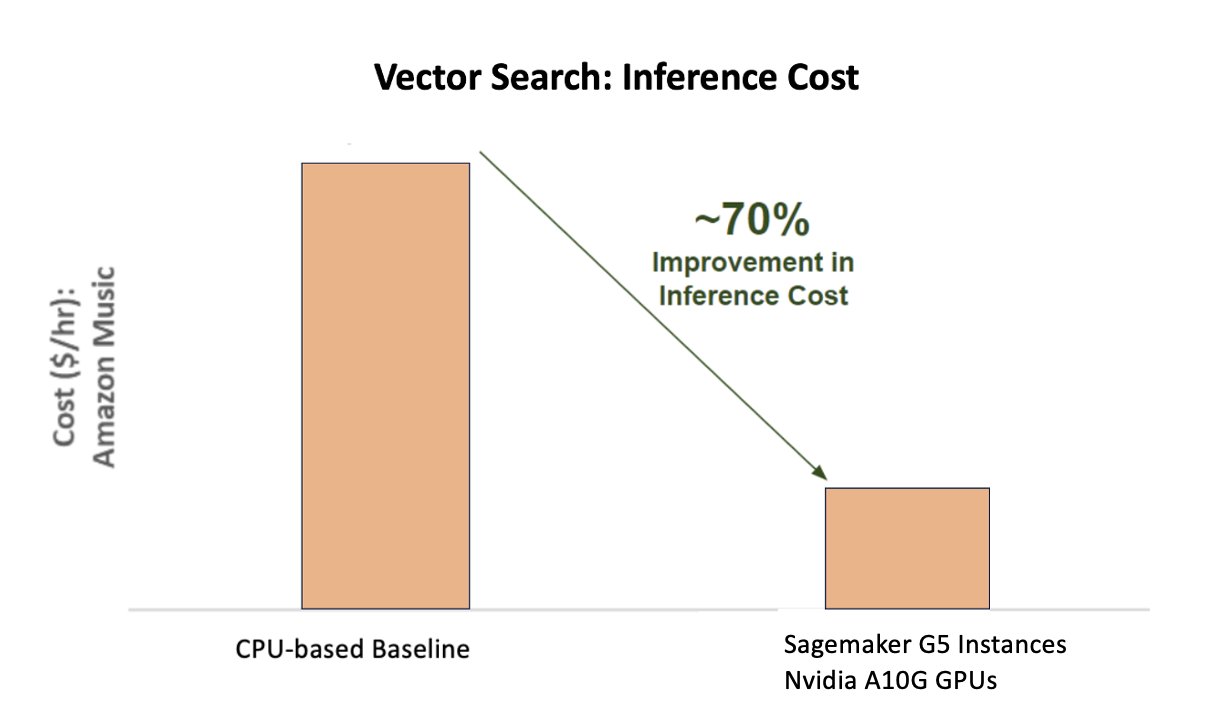

Naslednji grafikon prikazuje 70-odstotno izboljšanje stroškov pri uporabi NVIDIA AI Inference Platform v primerjavi z osnovno linijo, ki temelji na CPE.

Naslednja slika prikazuje SDK za visoko zmogljivo sklepanje poglobljenega učenja. Vključuje optimizator sklepanja za globoko učenje in čas izvajanja, ki zagotavlja nizko zakasnitev in visoko prepustnost za aplikacije sklepanja.

Da bi dosegli te rezultate, je Amazon Music eksperimentiral z več različnimi parametri uvajanja Triton z uporabo Triton Model Analyzer, orodje, ki pomaga najti najboljšo konfiguracijo modela NVIDIA Triton za uvedbo učinkovitega sklepanja. Za optimizacijo sklepanja o modelu Triton ponuja funkcije, kot sta dinamično serijsko združevanje in sočasno izvajanje modela, ter ima ogrodje za podporo drugih zmožnosti prilagodljivosti. Dinamično serijsko zbiranje zahtevkov za sklepanje, ki jih brezhibno združuje v kohorte, da bi povečali prepustnost, hkrati pa zagotavlja odzive v realnem času za uporabnike Amazon Music. Zmožnost sočasnega izvajanja modela dodatno izboljša zmogljivost sklepanja z gostovanjem več kopij modela na istem GPE. Končno z uporabo Triton Model Analyzer, Amazon Music je lahko skrbno natančno nastavil parametre gostovanja dinamičnega združevanja in sklepanja sočasnih modelov, da bi našel optimalne nastavitve, ki povečajo zmogljivost sklepanja z uporabo simuliranega prometa.

zaključek

Optimizacija konfiguracij s Triton Inference Server in TensorRT na SageMakerju je Amazon Music omogočila doseganje izjemnih rezultatov tako za usposabljanje kot za sklepanje. Platforma SageMaker je odprta platforma od konca do konca za proizvodno umetno inteligenco, ki zagotavlja hiter čas za pridobitev vrednosti in vsestranskost za podporo vseh večjih primerov uporabe umetne inteligence v strojni in programski opremi. Z optimizacijo izkoriščenosti GPU V100 za usposabljanje in preklapljanje s procesorjev na primerke G5 z uporabo grafičnih procesorjev NVIDIA A10G Tensor Core ter z uporabo optimizirane programske opreme NVIDIA, kot sta Triton Inference Server in TensorRT, lahko podjetja, kot je Amazon Music, prihranijo čas in denar ter hkrati povečajo zmogljivost v obeh usposabljanje in sklepanje, kar neposredno pomeni boljšo uporabniško izkušnjo in nižje operativne stroške.

SageMaker se ukvarja z nediferenciranim težkim delom za usposabljanje in gostovanje ML, kar Amazon Music omogoča zagotavljanje zanesljivih, razširljivih operacij ML v strojni in programski opremi.

Priporočamo vam, da preverite, ali so vaše delovne obremenitve optimizirane z uporabo SageMakerja, tako da vedno ocenite svojo izbiro strojne in programske opreme, da vidite, ali obstajajo načini, kako lahko dosežete boljšo zmogljivost z nižjimi stroški.

Če želite izvedeti več o NVIDIA AI v AWS, glejte naslednje:

O avtorjih

Siddharth Sharma je tehnični vodja strojnega učenja pri skupini Science & Modeling pri Amazon Music. Specializiran je za probleme modeliranja, povezane z iskanjem, iskanjem, rangiranjem in NLP. Siddharth ima bogato ozadje pri delu z obsežnimi težavami strojnega učenja, ki so občutljive na zakasnitve, npr. ciljanje oglasov, večmodalno iskanje, razumevanje iskalnih poizvedb itd. Preden je delal pri Amazon Music, je Siddharth delal v podjetjih, kot so Meta, Walmart Labs, Rakuten o težavah ML, osredotočenih na e-trgovino. Siddharth je zgodnji del svoje kariere preživel v delu z zagonskimi oglaševalskimi tehnološkimi podjetji.

Siddharth Sharma je tehnični vodja strojnega učenja pri skupini Science & Modeling pri Amazon Music. Specializiran je za probleme modeliranja, povezane z iskanjem, iskanjem, rangiranjem in NLP. Siddharth ima bogato ozadje pri delu z obsežnimi težavami strojnega učenja, ki so občutljive na zakasnitve, npr. ciljanje oglasov, večmodalno iskanje, razumevanje iskalnih poizvedb itd. Preden je delal pri Amazon Music, je Siddharth delal v podjetjih, kot so Meta, Walmart Labs, Rakuten o težavah ML, osredotočenih na e-trgovino. Siddharth je zgodnji del svoje kariere preživel v delu z zagonskimi oglaševalskimi tehnološkimi podjetji.

Tarun Sharma je vodja razvoja programske opreme, ki vodi Amazon Music Search Relevance. Njegova ekipa znanstvenikov in inženirjev ML je odgovorna za zagotavljanje kontekstualno ustreznih in prilagojenih rezultatov iskanja strankam Amazon Music.

Tarun Sharma je vodja razvoja programske opreme, ki vodi Amazon Music Search Relevance. Njegova ekipa znanstvenikov in inženirjev ML je odgovorna za zagotavljanje kontekstualno ustreznih in prilagojenih rezultatov iskanja strankam Amazon Music.

James Park je arhitekt rešitev pri Amazon Web Services. Sodeluje z Amazon.com pri oblikovanju, gradnji in uvajanju tehnoloških rešitev na AWS, posebej pa ga zanimata umetna inteligenca in strojno učenje. V h je prosti čas, rad išče nove kulture, nove izkušnje in je na tekočem z najnovejšimi tehnološkimi trendi. Najdete ga na LinkedIn.

James Park je arhitekt rešitev pri Amazon Web Services. Sodeluje z Amazon.com pri oblikovanju, gradnji in uvajanju tehnoloških rešitev na AWS, posebej pa ga zanimata umetna inteligenca in strojno učenje. V h je prosti čas, rad išče nove kulture, nove izkušnje in je na tekočem z najnovejšimi tehnološkimi trendi. Najdete ga na LinkedIn.

Kshitiz Gupta je arhitekt rešitev pri NVIDIA. Uživa v izobraževanju strank v oblaku o tehnologijah GPU AI, ki jih ponuja NVIDIA, in jim pomaga pri pospeševanju njihovih aplikacij za strojno učenje in globoko učenje. Zunaj dela uživa v teku, pohodništvu in opazovanju divjih živali.

Kshitiz Gupta je arhitekt rešitev pri NVIDIA. Uživa v izobraževanju strank v oblaku o tehnologijah GPU AI, ki jih ponuja NVIDIA, in jim pomaga pri pospeševanju njihovih aplikacij za strojno učenje in globoko učenje. Zunaj dela uživa v teku, pohodništvu in opazovanju divjih živali.

Jiahong Liu je arhitekt rešitve v skupini ponudnikov storitev v oblaku pri NVIDIA. Strankam pomaga pri sprejemanju rešitev strojnega učenja in umetne inteligence, ki izkoriščajo pospešeno računalništvo NVIDIA za reševanje njihovih izzivov pri usposabljanju in sklepanju. V prostem času uživa v origamiju, DIY projektih in igra košarko.

Jiahong Liu je arhitekt rešitve v skupini ponudnikov storitev v oblaku pri NVIDIA. Strankam pomaga pri sprejemanju rešitev strojnega učenja in umetne inteligence, ki izkoriščajo pospešeno računalništvo NVIDIA za reševanje njihovih izzivov pri usposabljanju in sklepanju. V prostem času uživa v origamiju, DIY projektih in igra košarko.

Tugrul Konuk je višji arhitekt rešitev pri NVIDIA, specializiran za obsežno usposabljanje, večmodalno globoko učenje in visoko zmogljivo znanstveno računalništvo. Pred NVIDIO je delal v energetski industriji in se osredotočal na razvoj algoritmov za računalniško slikanje. Kot del svojega doktorata se je ukvarjal s poglobljenim učenjem na osnovi fizike za numerične simulacije v velikem obsegu. V prostem času rada bere, igra kitaro in klavir.

Tugrul Konuk je višji arhitekt rešitev pri NVIDIA, specializiran za obsežno usposabljanje, večmodalno globoko učenje in visoko zmogljivo znanstveno računalništvo. Pred NVIDIO je delal v energetski industriji in se osredotočal na razvoj algoritmov za računalniško slikanje. Kot del svojega doktorata se je ukvarjal s poglobljenim učenjem na osnovi fizike za numerične simulacije v velikem obsegu. V prostem času rada bere, igra kitaro in klavir.

Rohil Bhargava je vodja trženja izdelkov pri NVIDIA, osredotočen na uvajanje ogrodij aplikacij NVIDIA in SDK-jev na specifičnih platformah CSP.

Rohil Bhargava je vodja trženja izdelkov pri NVIDIA, osredotočen na uvajanje ogrodij aplikacij NVIDIA in SDK-jev na specifičnih platformah CSP.

Eliuth Triana Isaza je vodja odnosov z razvijalci pri NVIDIA, ki krepi Amazonove AI MLOps, DevOps, znanstvenike in tehnične strokovnjake AWS, da obvladajo računalniški sklad NVIDIA za pospeševanje in optimizacijo modelov Generative AI Foundation, ki obsegajo kuriranje podatkov, usposabljanje GPU, sklepanje o modelih in uvajanje proizvodnje na instancah GPU AWS . Poleg tega je Eliuth strasten gorski kolesar, smučar, igralec tenisa in pokra.

Eliuth Triana Isaza je vodja odnosov z razvijalci pri NVIDIA, ki krepi Amazonove AI MLOps, DevOps, znanstvenike in tehnične strokovnjake AWS, da obvladajo računalniški sklad NVIDIA za pospeševanje in optimizacijo modelov Generative AI Foundation, ki obsegajo kuriranje podatkov, usposabljanje GPU, sklepanje o modelih in uvajanje proizvodnje na instancah GPU AWS . Poleg tega je Eliuth strasten gorski kolesar, smučar, igralec tenisa in pokra.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/how-amazon-music-uses-sagemaker-with-nvidia-to-optimize-ml-training-and-inference-performance-and-cost/

- :ima

- : je

- :ne

- :kje

- $GOR

- 100

- 12

- 25

- 32

- 35%

- 7

- 8

- a

- Sposobna

- O meni

- pospešeno

- pospeševanje

- pospešek

- dostop

- doseganje

- natančnost

- natančna

- Doseči

- doseže

- čez

- aktivna

- Poleg tega

- Naslov

- Sprejem

- oglasi

- vplivajo

- po

- AI

- AI modeli

- primeri uporabe ai

- album

- algoritmi

- vsi

- omogočajo

- dovoljene

- Dovoli

- omogoča

- Prav tako

- vedno

- Amazon

- Amazon Web Services

- Amazon.com

- an

- in

- uporaba

- aplikacije

- pristop

- arhitekti

- SE

- OBMOČJE

- območja

- okoli

- umetnik

- AS

- pomoč

- pomaga

- At

- povprečno

- AWS

- Backend

- Ravnovesje

- uravnoteženje

- bar

- temeljijo

- Izhodišče

- Košarka

- zaliv

- BE

- postal

- ker

- Prednosti

- BEST

- Boljše

- povečanje

- povečuje

- tako

- prinašajo

- široka

- izgradnjo

- zgrajena

- by

- CAN

- Zmogljivosti

- zmožnost

- zajemanje

- ki

- Kariera

- previdno

- primeri

- izzivi

- izziv

- Graf

- preveriti

- negovano

- možnosti

- stranke

- Cloud

- Koda

- COM

- kako

- komuniciranje

- Podjetja

- v primerjavi z letom

- računalniški

- računalništvo

- sočasno

- konfiguracija

- Posoda

- vsebina

- Konvergenca

- Core

- strošek

- stroški

- obrti

- kritično

- ključnega pomena

- CSP

- kuracija

- po meri

- stranka

- Izkušnje s strankami

- Stranke, ki so

- datum

- Datum

- Dnevi

- zmanjšala

- globoko

- globoko učenje

- zamude

- poda

- dostavo

- daje

- Povpraševanje

- razporedi

- uvajanja

- uvajanje

- Oblikovanje

- Razvojni

- razvoju

- Razvoj

- drugačen

- težko

- neposredno

- potop

- razne

- Naredi sam

- dont

- drastično

- med

- dinamično

- e

- e-trgovina

- Zgodnje

- izobraževanje

- učinkovitosti

- učinkovite

- prizadevanje

- povišana

- vdelava

- čustva

- zaposlovanja

- pooblastitvi

- omogočena

- spodbujanje

- konec koncev

- energija

- Inženirji

- Izboljša

- dovolj

- zagotoviti

- zlasti

- itd

- ocenjevanje

- Tudi

- Tudi vsak

- izvedba

- izkušnje

- Doživetja

- Strokovnjaki

- FAST

- Lastnosti

- Slika

- končno

- Najdi

- iskanje

- prva

- prilagodljivost

- poplav

- Osredotočite

- osredotočena

- osredotoča

- po

- za

- format

- Fundacija

- Okvirni

- okviri

- iz

- frustrirajoče

- v celoti

- funkcionalnosti

- nadalje

- fuzija

- Prehod

- generacija

- generativno

- Generativna AI

- GPU

- Grafične kartice

- Ročaji

- se zgodi

- strojna oprema

- Imajo

- he

- težka

- težko dvigovanje

- pomoč

- pomoč

- Pomaga

- visoka

- na visoki ravni

- visokozmogljivo

- ga

- njegov

- drži

- gostovanje

- URE

- Kako

- Vendar

- HTML

- HTTPS

- identifikacijo

- if

- ponazarja

- slikanje

- izvajati

- Pomembno

- izboljšanje

- izboljšalo

- Izboljšanje

- in

- vključuje

- Povečajte

- povečal

- narašča

- Industrija

- neučinkovit

- vplivajo

- Infrastruktura

- začetna

- primer

- takoj

- Namesto

- obresti

- v

- uvesti

- Predstavljamo

- IT

- ITS

- Potovanje

- jpg

- samo

- Ključne

- Otrok

- Vedite

- znano

- Labs

- jezik

- velika

- obsežne

- večja

- trajno

- Latenca

- Zadnji

- plast

- vodi

- vodi

- UČITE

- učenje

- Vzvod

- Knjižnica

- dviganje

- kot

- Meje

- obremenitev

- si

- nizka

- nižje

- stroj

- strojno učenje

- vzdrževati

- velika

- Znamka

- IZDELA

- upravitelj

- upravljanje

- Trženje

- mojster

- Povečajte

- Maj ..

- spomini

- Spomin

- Meta

- Bližnji

- milijonov

- milijoni

- milisekund

- minimalna

- napaka

- mešano

- ML

- MLOps

- Model

- modeliranje

- modeli

- Moduli

- Denar

- več

- Najbolj

- Mountain

- več

- več

- Glasba

- morajo

- Ime

- potrebna

- negativno

- omrežij

- Novo

- nlp

- Nvidia

- of

- ponudba

- Ponudbe

- on

- ONE

- samo

- odprite

- open source

- deluje

- operativno

- operacije

- optimalna

- optimizacija

- Optimizirajte

- optimizirana

- optimizacijo

- or

- orkestrirana

- Da

- Ostalo

- ven

- zunaj

- Neporavnani

- več

- Splošni

- lastne

- parametri

- del

- zlasti

- zlasti

- partnerja

- strastno

- Peak

- odstotek

- performance

- Osebni

- Prilagojene

- Dr.

- plinovod

- platforma

- Platforme

- platon

- Platonova podatkovna inteligenca

- PlatoData

- predvajalnik

- igranje

- Podcast

- Poddaje

- Točka

- poker

- mogoče

- Prispevek

- potencial

- moč

- poganja

- Precision

- Predhodna

- Prednost

- prednostna naloga

- Težave

- Postopek

- Izdelek

- proizvodnja

- projekti

- zagotavljajo

- Ponudnik

- zagotavlja

- zagotavljanje

- Python

- Hitri

- Lestvica

- reading

- v realnem času

- zmanjšanje

- glejte

- povezane

- Odnosi

- ustreznost

- pomembno

- zanesljiv

- zahteva

- zahteva

- viri

- odgovorov

- Odgovornost

- odgovorna

- odziven

- rezultat

- Rezultati

- Rich

- Pravica

- tek

- deluje

- runtime

- sagemaker

- Enako

- Shrani

- shranjevanje

- razširljive

- Lestvica

- Znanost

- znanstveno

- Znanstveniki

- SDK

- sdks

- brez težav

- Iskalnik

- iskanja

- iskanje

- drugi

- oddelki

- glej

- iskanju

- na videz

- semantika

- višji

- občutljiva

- stavek

- služijo

- strežnik

- Storitev

- Ponudnik storitev

- Storitve

- služijo

- nastavite

- nastavitve

- več

- Delite s prijatelji, znanci, družino in partnerji :-)

- deli

- Razstave

- pomemben

- bistveno

- Enostavno

- sedi

- Velikosti

- velikosti

- pametna

- Software

- Razvoj programske opreme

- Rešitev

- rešitve

- pesem

- vir

- napetost

- specializirano

- specializacijo

- specifična

- hitrost

- ČAROV

- črkovanje

- porabljen

- sveženj

- Začetek

- Ustanavljanjem

- ostati

- dinamičnega ravnovesja

- Korak

- Koraki

- Zgodba

- pretakanje

- taka

- superior

- podpora

- Podprti

- Preverite

- sprejeti

- ob

- ciljanje

- skupina

- tech

- tehnični

- tehnika

- tehnike

- Tehnologije

- Tehnologija

- besedilo

- da

- O

- njihove

- Njih

- Tukaj.

- zato

- te

- jih

- stvari

- ta

- skozi

- pretočnost

- čas

- krat

- Naslov

- do

- skupaj

- Tokenizacija

- Boni

- vzel

- orodje

- vrh

- tps

- Prometa

- Vlak

- usposobljeni

- usposabljanje

- transformator

- Trends

- Triton

- Res

- dva

- razumevanje

- nedvomno

- Vesolje

- odklepanje

- predstavil

- us

- uporaba

- Rabljeni

- Uporabniki

- uporablja

- uporabo

- Uporaben

- vrednost

- Popravljeno

- vsestranskost

- zelo

- Čakam

- sprehod

- Walmart

- je

- gledanju

- načini

- we

- web

- spletne storitve

- Dobro

- so bili

- kdaj

- medtem ko

- medtem

- bo

- z

- delo

- delal

- deluje

- deluje

- svet

- skrbi

- še

- pridobil

- Vi

- Vaša rutina za

- zefirnet