Organizacije v panogah, kot so trgovina na drobno, bančništvo, finance, zdravstvo, proizvodnja in posojanje, se morajo pogosto soočiti z ogromnimi količinami nestrukturiranih besedilnih dokumentov, ki prihajajo iz različnih virov, kot so novice, spletni dnevniki, ocene izdelkov, kanali za podporo strankam in družbeni mediji. Ti dokumenti vsebujejo ključne informacije, ki so ključne za sprejemanje pomembnih poslovnih odločitev. Ko organizacija raste, postane izziv pridobiti ključne informacije iz teh dokumentov. Z napredkom tehnik obdelave naravnega jezika (NLP) in strojnega učenja (ML) lahko hitro in z visoko natančnostjo odkrijemo dragocene vpoglede in povezave iz teh besedilnih dokumentov, s čimer podjetjem pomagamo pravočasno sprejemati kakovostne poslovne odločitve. Popolnoma upravljane storitve NLP so prav tako pospešile sprejemanje NLP. Amazonsko razumevanje je v celoti upravljana storitev, ki vam omogoča izdelavo modelov NLP po meri, ki ustrezajo vašim zahtevam, ne da bi potrebovali kakršno koli strokovno znanje o ML.

V tem prispevku prikazujemo, kako uporabiti najsodobnejše tehnike ML za reševanje petih različnih nalog NLP: povzemanje dokumenta, klasifikacija besedila, odgovarjanje na vprašanja, prepoznavanje imenovanih entitet in ekstrakcija razmerja. Za vsako od teh NLP nalog pokažemo, kako uporabljati Amazon SageMaker za izvedbo naslednjih dejanj:

- Razmestite in zaženite sklepanje na predhodno usposobljenem modelu

- Natančno prilagodite vnaprej usposobljeni model na novem naboru podatkov po meri

- Nadalje izboljšajte zmogljivost natančne nastavitve z Samodejno prilagajanje modela SageMaker

- Ocenite zmogljivost modela na podatkih o vzdržljivem testu z različnimi metrikami vrednotenja

Čeprav v tem prispevku pokrivamo pet specifičnih nalog NLP, lahko to rešitev uporabite kot predlogo za posploševanje natančnega prilagajanja predhodno usposobljenih modelov z lastnim naborom podatkov in nato zaženete optimizacijo hiperparametrov za izboljšanje natančnosti.

Predloge rešitev JumpStart

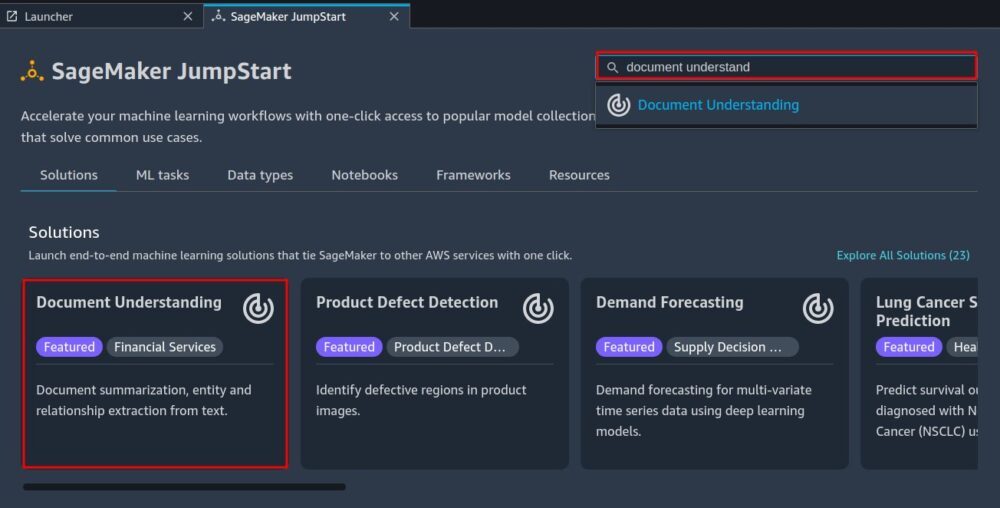

Amazon SageMaker JumpStart ponuja rešitve od konca do konca z enim klikom za številne pogoste primere uporabe ML. Za več informacij o razpoložljivih predlogah rešitev raziščite naslednje primere uporabe:

Predloge rešitev JumpStart pokrivajo različne primere uporabe, v okviru katerih je na voljo več različnih predlog rešitev (ta rešitev za razumevanje dokumenta je v primeru uporabe »Izvleček in analiza podatkov iz dokumentov«).

Na ciljni strani JumpStart izberite predlogo rešitve, ki najbolj ustreza vašemu primeru uporabe. Za več informacij o posebnih rešitvah za vsak primer uporabe in o tem, kako zagnati rešitev JumpStart, glejte Predloge rešitev.

Pregled rešitev

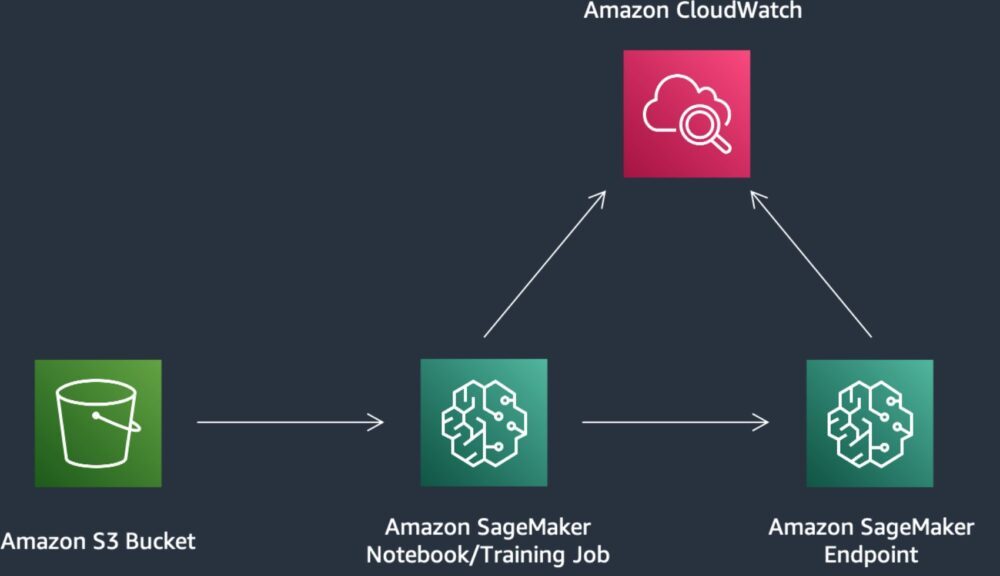

Naslednja slika prikazuje, kako lahko uporabite to rešitev s komponentami SageMaker. Učna opravila SageMaker se uporabljajo za usposabljanje različnih modelov NLP, končne točke SageMaker pa se uporabljajo za uvajanje modelov v vsaki fazi. Uporabljamo Preprosta storitev shranjevanja Amazon (Amazon S3) skupaj s SageMakerjem za shranjevanje podatkov o usposabljanju in artefaktov modela ter amazoncloudwatch za beleženje izhodov usposabljanja in končne točke.

Odprite rešitev Razumevanje dokumenta

Pomaknite se do rešitve Razumevanje dokumenta v JumpStartu.

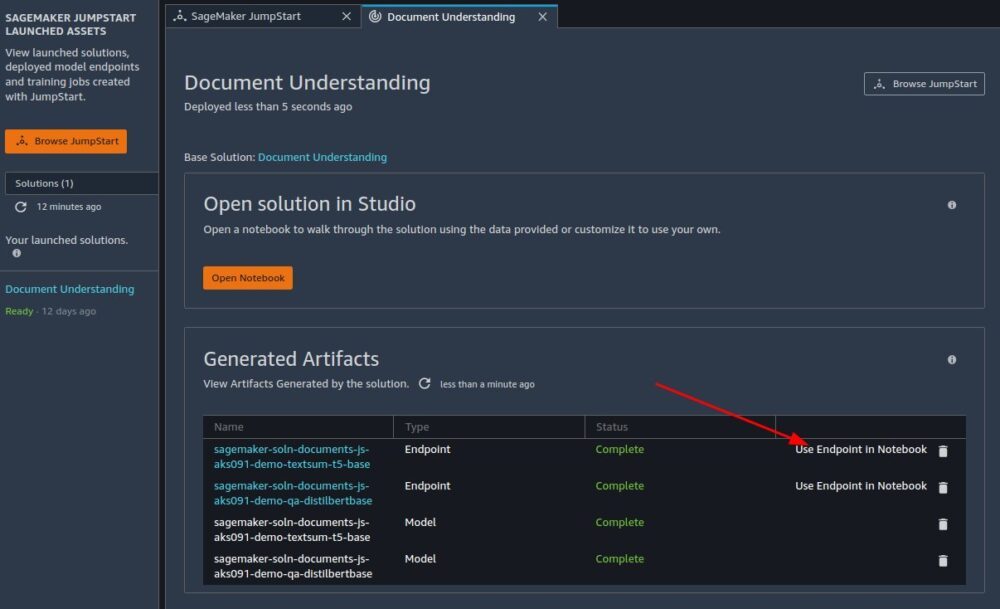

Zdaj si lahko podrobneje ogledamo nekatera sredstva, ki so vključena v to rešitev, začenši s predstavitvenim prenosnikom.

Demo zvezek

Predstavitveni zvezek lahko uporabite za pošiljanje primerov podatkov na že razporejene končne točke modela za naloge povzemanja dokumenta in odgovarjanja na vprašanja. Predstavitveni zvezek vam hitro omogoča, da pridobite praktične izkušnje s poizvedovanjem po vzorčnih podatkih.

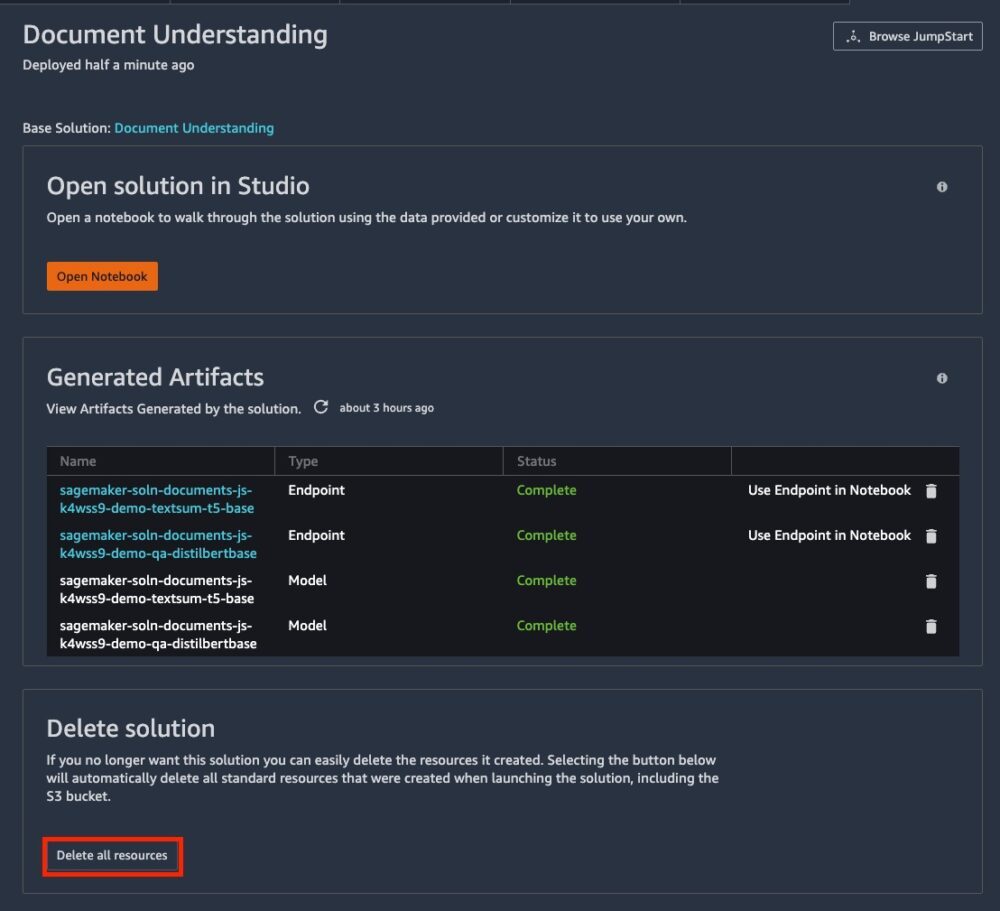

Ko zaženete rešitev Document Understanding, odprite predstavitveni zvezek tako, da izberete Uporabite končno točko v beležnici.

Poglobimo se v vsakega od petih glavnih prenosnikov za to rešitev.

Predpogoji

In Amazon SageMaker Studio, se prepričajte, da uporabljate PyTorch 1.10 Python 3.8 CPU Optimized sliko/jedro, da odprete zvezke. Usposabljanje uporablja pet primerkov ml.g4dn.2xlarge, zato morate dvigniti a zahteva za povečanje omejitve storitve če vaš račun zahteva povečane omejitve za to vrsto.

Razvrstitev besedila

Razvrščanje besedila se nanaša na razvrščanje vhodnega stavka v eno od oznak razreda nabora podatkov o usposabljanju. Ta zvezek prikazuje, kako uporabljati JumpStart API za razvrstitev besedila.

Razmestite in zaženite sklepanje na predhodno usposobljenem modelu

Model klasifikacije besedila, ki smo ga izbrali za uporabo, temelji na vdelavi besedila (tensorflow-tc-bert-en-uncased-L-12-H-768-A-12-2) model iz Središče TensorFlow, ki je vnaprej usposobljen za podatkovne nize Wikipedia in BookCorpus.

Model, ki je na voljo za uvedbo, je ustvarjen tako, da se izhodu modela za vdelavo besedila pripne binarna klasifikacijska plast in nato natančno nastavi celoten model na SST-2 nabor podatkov, ki je sestavljen iz pozitivnih in negativnih ocen filmov.

Za izvajanje sklepanja na tem modelu moramo najprej prenesti vsebnik sklepanja (deploy_image_uri), sklepni skript (deploy_source_uri) in predhodno usposobljen model (base_model_uri). Nato jih posredujemo kot parametre za instanciranje objekta modela SageMaker, ki ga lahko nato razmestimo:

Naslednja koda prikazuje naše odgovore:

Natančno prilagodite vnaprej usposobljen model na naboru podatkov po meri

Pravkar smo se sprehodili skozi sklepanje o teku na predhodno usposobljenem modelu BERT, ki je bil natančno nastavljen na SST-2 nabor podatkov.

Nato razpravljamo o tem, kako natančno prilagoditi model na naboru podatkov po meri s poljubnim številom razredov. Nabor podatkov, ki ga uporabljamo za fino uravnavanje, je še vedno SST-2 nabor podatkov. Ta nabor podatkov lahko zamenjate s katerim koli naborom podatkov, ki vas zanima.

Pridobimo vsebnik Docker za usposabljanje, vir algoritma za usposabljanje in vnaprej usposobljen model:

Za hiperparametre, specifične za algoritem, začnemo s pridobivanjem slovarja Python hiperparametrov za usposabljanje, ki jih algoritem sprejme z njihovimi privzetimi vrednostmi. Lahko jih preglasite z vrednostmi po meri, kot je prikazano v naslednji kodi:

Nabor podatkov (SST-2) je razdeljen na nize za usposabljanje, validacijo in teste, kjer se niz za usposabljanje uporablja za prilagajanje modelu, niz za preverjanje se uporablja za izračun meritev vrednotenja, ki se lahko uporabijo za HPO, in testni niz se uporablja kot zadržani podatki za ocenjevanje delovanja modela. Nato se nabor podatkov o usposabljanju in validaciji naloži v Amazon S3 in uporabi za zagon opravila usposabljanja za natančno nastavitev:

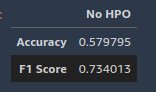

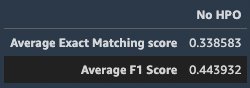

Ko je delo natančnega prilagajanja končano, uvedemo model, zaženemo sklepanje na naboru podatkov o vzdržljivem testu in izračunamo metrike vrednotenja. Ker gre za nalogo binarne klasifikacije, uporabljamo ocena točnosti in Ocena F1 kot metrika vrednotenja. Večja vrednost pomeni boljše delovanje. Naslednji posnetek zaslona prikazuje naše rezultate.

Nadalje izboljšajte zmogljivost natančnega prilagajanja s samodejnim prilagajanjem modela SageMaker

V tem koraku prikazujemo, kako lahko dodatno izboljšate zmogljivost modela s fino nastavitvijo modela s samodejnim prilagajanjem modela SageMaker. Samodejna prilagoditev modela, znana tudi kot optimizacija hiperparametrov (HPO), poišče najboljšo različico modela z izvajanjem več učnih opravil na vašem naboru podatkov z vrsto hiperparametrov, ki jih določite. Nato izbere vrednosti hiperparametrov, ki povzročijo model, ki deluje najbolje, kot je izmerjeno z metriko, ki jo izberete, v naboru podatkov za preverjanje veljavnosti.

Najprej smo postavili cilj kot oceno točnosti validacijskih podatkov (val_accuracy) in definiral metrike za opravilo naravnavanja s podajanjem imena ciljne metrike in regularnega izraza (regex). Regularni izraz se uporablja za ujemanje z izhodom dnevnika algoritma in zajemanje številskih vrednosti meritev. Nato določimo obsege hiperparametrov, iz katerih izberemo najboljše vrednosti hiperparametrov. Skupno število uglaševalnih opravil določimo na šest in ta opravila razdelimo na tri različne Amazonski elastični računalniški oblak (Amazon EC2) primerki za izvajanje vzporednih nastavitev. Oglejte si naslednjo kodo:

Te vrednosti posredujemo, da instanciramo objekt SageMaker Estimator, podobno kot v prejšnjem koraku natančnega prilagajanja. Namesto da bi poklicali fit funkcija Estimator predmet, mimo Estimator predmet kot parameter za HyperparameterTuner konstruktor in pokličite fit njegova funkcija za zagon nastavitev:

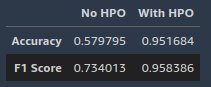

Ko so opravila prilagajanja končana, uvedemo model, ki daje najboljšo oceno metrike ocenjevanja na naboru podatkov o validaciji, izvedemo sklepanje na istem naboru podatkov o vzdržljivem testu, kot smo ga izvedli v prejšnjem razdelku, in izračunamo metrike ocenjevanja.

Rezultati kažejo, da model, izbran s samodejnim uravnavanjem modela, znatno prekaša model, ki je bil natančno nastavljen v prejšnjem razdelku, na naboru podatkov o vzdržljivem testu.

Priznavanje imenovanega subjekta

Prepoznavanje poimenovanih entitet (NER) je postopek odkrivanja in razvrščanja poimenovanih entitet v vnaprej določene kategorije, kot so imena oseb, organizacij, lokacij in količine. Obstaja veliko primerov uporabe v resničnem svetu za NER, kot so mehanizmi za priporočila, kategorizacija in dodeljevanje vstopnic za podporo strankam pravemu oddelku, pridobivanje bistvenih informacij iz poročil bolnikov v zdravstvu ter razvrščanje vsebine iz novic in blogov.

Razmestite in zaženite sklepanje na predhodno usposobljenem modelu

Razporedimo En_core_web_md model iz prostoren knjižnica. spaCy je odprtokodna knjižnica NLP, ki se lahko uporablja za različne naloge in ima vgrajene metode za NER. Uporabljamo AWS PyTorch Deep Learning Container (DLC) s skriptnim načinom in namestimo knjižnico spaCy kot odvisnost na vrhu vsebnika.

Nato vstopna točka za skript (argument entry_point.py), ki vsebuje vso kodo za prenos in nalaganje En_core_web_md modelira in izvede sklepanje o podatkih, ki so poslani končni točki. Končno moramo še zagotoviti model_data kot vnaprej usposobljen model za sklepanje. Ker predhodno usposobljeni En_core_web_md model prenesemo sproti, kar je določeno v vnosni skripti, posredujemo prazno arhivsko datoteko. Ko je končna točka uvedena, jo lahko prikličete neposredno iz prenosnega računalnika z uporabo SDK-ja SageMaker Python Predictor. Glej naslednjo kodo:

Vhodni podatek za model je besedilni dokument. Model poimenovane entitete izvleče dele samostalnikov in poimenovane entitete v besedilnem dokumentu in jih razvrsti v več različnih vrst (kot so ljudje, kraji in organizacije). Primer vnosa in izhoda sta prikazana v naslednji kodi. The start_char parameter označuje odmik znaka za začetek razpona in end_char označuje konec razpona.

Natančno prilagodite vnaprej usposobljen model na naboru podatkov po meri

V tem koraku prikazujemo, kako natančno prilagoditi vnaprej usposobljene jezikovne modele za NER na svojem naboru podatkov. Korak natančnega prilagajanja posodobi parametre modela, da zajame značilnosti vaših lastnih podatkov in izboljša natančnost. Uporabljamo WikiANN (PAN-X) nabor podatkov za natančno nastavitev DistilBERT-osnova-neobložena Model transformator iz Hugging Face.

Nabor podatkov je razdeljen na nize za usposabljanje, validacijo in teste.

Nato določimo hiperparametre modela in uporabimo DLC AWS Hugging Face s skriptnim načinom (argument entry_point), da sprožite opravilo natančnega prilagajanja:

Ko je opravilo natančnega prilagajanja končano, uvedemo končno točko in povprašamo po tej končni točki s podatki o čakanju. Za poizvedbo po končni točki je treba vsak besedilni niz tokenizirati v enega ali več žetonov in poslati modelu transformatorja. Vsak žeton dobi predvideno poimenovano oznako entitete. Ker je vsak besedilni niz mogoče tokenizirati v enega ali več žetonov, moramo podvojiti osnovno resnično oznako entitete niza v vse žetone, ki so z njim povezani. Priloženi zvezek vas vodi skozi korake, kako to doseči.

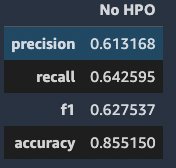

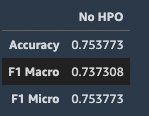

Nazadnje uporabljamo vgrajeno metriko vrednotenja Hugging Face nadaljevanje za izračun ocenjevalnih rezultatov na podatkih o vzdržljivem testu. Uporabljene metrike vrednotenja so splošna natančnost, splošen priklic, splošna F1 in natančnost. Naslednji posnetek zaslona prikazuje naše rezultate.

Nadalje izboljšajte zmogljivost natančnega prilagajanja s samodejnim prilagajanjem modela SageMaker

Podobno kot pri klasifikaciji besedila prikazujemo, kako lahko dodatno izboljšate zmogljivost modela s fino nastavitvijo modela s samodejnim prilagajanjem modela SageMaker. Če želite zagnati opravilo prilagajanja, moramo definirati objektivno metriko, ki jo želimo uporabiti za ocenjevanje uspešnosti modela na naboru podatkov o validaciji (rezultat F1 v tem primeru), obsege hiperparametrov, iz katerih lahko izberemo najboljše vrednosti hiperparametrov, kot tudi konfiguracije opravila prilagajanja, kot je npr. največje število opravil prilagajanja in število vzporednih opravil za zagon hkrati:

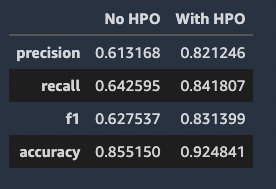

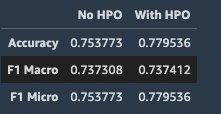

Ko so opravila prilagajanja končana, uvedemo model, ki daje najboljšo oceno metrike ocenjevanja na naboru podatkov o validaciji, izvedemo sklepanje na istem naboru podatkov o vzdržljivem testu, kot smo ga izvedli v prejšnjem razdelku, in izračunamo metrike ocenjevanja.

Vidimo lahko, da model s HPO dosega bistveno boljšo zmogljivost po vseh metrikah.

Odgovarjanje na vprašanje

Odgovarjanje na vprašanja je uporabno, če želite poizvedovati po veliki količini besedila za določene informacije. Uporabniku omogoča, da izrazi vprašanje v naravnem jeziku in prejme takojšen in kratek odgovor. Sisteme za odgovarjanje na vprašanja, ki jih poganja NLP, je mogoče uporabiti v iskalnikih in telefonskih pogovornih vmesnikih.

Razmestite in zaženite sklepanje na predhodno usposobljenem modelu

Naš predhodno usposobljeni model je model ekstrakcijskega odgovarjanja na vprašanja (EQA). bert-large-uncased-whole-word-masking-finetuned-squad zgrajen na modelu Transformer iz Hugging Face. Uporabljamo DLC AWS PyTorch s skriptnim načinom in namestimo transformatorji knjižnica kot odvisnost na vrhu vsebnika. Podobno kot pri nalogi NER nudimo prazno arhivsko datoteko v argumentu model_data ker se vnaprej pripravljeni model prenese sproti. Ko je končna točka uvedena, jo lahko prikličete neposredno iz prenosnega računalnika z uporabo SDK-ja SageMaker Python Predictor. Glej naslednjo kodo:

Vse kar moramo storiti je, da sestavimo slovarski objekt z dvema ključema. context je besedilo, iz katerega želimo pridobiti informacije. question je poizvedba v naravnem jeziku, ki določa, katere informacije želimo pridobiti. Mi kličemo predict na našem napovedovalcu in od končne točke bi morali dobiti odgovor, ki vsebuje najverjetnejše odgovore:

Imamo odgovor in lahko natisnemo najverjetnejše odgovore, ki smo jih izluščili iz prejšnjega besedila. Vsak odgovor ima rezultat zaupanja, ki se uporablja za razvrščanje (vendar tega rezultata ne bi smeli razlagati kot resnično verjetnost). Poleg dobesednega odgovora dobite tudi začetni in končni indeks znakov odgovora iz izvirnega konteksta:

Zdaj ta model natančno prilagodimo z lastnim naborom podatkov po meri, da dobimo boljše rezultate.

Natančno prilagodite vnaprej usposobljen model na naboru podatkov po meri

V tem koraku prikazujemo, kako natančno prilagoditi vnaprej usposobljene jezikovne modele za EQA na svojem naboru podatkov. Korak natančnega prilagajanja posodobi parametre modela, da zajame značilnosti vaših lastnih podatkov in izboljša natančnost. Uporabljamo SQuAD2.0 nabor podatkov za natančno nastavitev modela vdelave besedila bert-base-uncased od Hugging Face. Model, ki je na voljo za natančno nastavitev, pripne plast za ekstrahiranje odgovora na model za vdelavo besedila in inicializira parametre plasti na naključne vrednosti. Korak natančne nastavitve natančno prilagodi vse parametre modela, da zmanjša napako napovedi vhodnih podatkov in vrne natančno nastavljen model.

Podobno kot naloga klasifikacije besedila je nabor podatkov (SQuAD2.0) razdeljen na niz za usposabljanje, preverjanje veljavnosti in test.

Nato določimo hiperparametre modela in uporabimo JumpStart API za sprožitev opravila natančnega prilagajanja:

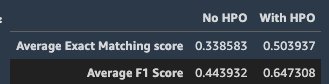

Ko je delo natančnega prilagajanja končano, uvedemo model, zaženemo sklepanje na naboru podatkov o vzdržljivem testu in izračunamo metrike vrednotenja. Uporabljeni meritvi ocenjevanja sta povprečni rezultat natančnega ujemanja in povprečni rezultat F1. Naslednji posnetek zaslona prikazuje rezultate.

Nadalje izboljšajte zmogljivost natančnega prilagajanja s samodejnim prilagajanjem modela SageMaker

Podobno kot v prejšnjih razdelkih uporabljamo a HyperparameterTuner objekt za zagon opravil za nastavitev:

Ko so opravila prilagajanja končana, uvedemo model, ki daje najboljšo oceno metrike ocenjevanja na naboru podatkov o validaciji, izvedemo sklepanje na istem naboru podatkov o vzdržljivem testu, kot smo ga izvedli v prejšnjem razdelku, in izračunamo metrike ocenjevanja.

Vidimo lahko, da model s HPO kaže bistveno boljšo zmogljivost na podatkih testa hold-out.

Ekstrakcija razmerja

Ekstrakcija odnosov je naloga pridobivanja semantičnih odnosov iz besedila, ki se običajno pojavijo med dvema ali več entitetami. Ekstrakcija razmerij ima pomembno vlogo pri ekstrakciji strukturiranih informacij iz nestrukturiranih virov, kot je neobdelano besedilo. V tem zvezku prikazujemo dva primera uporabe ekstrakcije razmerij.

Natančno prilagodite vnaprej usposobljen model na naboru podatkov po meri

Uporabljamo model ekstrakcije razmerij, zgrajen na a BERT-osnova-neohišje model z uporabo transformatorjev iz Objemni obrazni transformatorji knjižnica. Model za fino uravnavanje pripne linearno klasifikacijsko plast, ki sprejme par vdelav žetonov, ki jih izpiše model za vdelavo besedila, in inicializira parametre plasti na naključne vrednosti. Korak natančne nastavitve natančno prilagodi vse parametre modela, da zmanjša napako napovedi vhodnih podatkov in vrne natančno nastavljen model.

Nabor podatkov, ki ga natančno prilagodimo modelu, je SemEval-2010 Naloga 8. Model, vrnjen s fino nastavitvijo, je mogoče nadalje uporabiti za sklepanje.

Nabor podatkov vsebuje nize za usposabljanje, validacijo in teste.

Uporabljamo DLC AWS PyTorch s skriptnim načinom iz SDK-ja SageMaker Python, kjer transformers knjižnica je nameščena kot odvisnost na vrhu vsebnika. Definiramo SageMaker PyTorch ocenjevalec in nabor hiperparametrov, kot so vnaprej usposobljeni model, stopnja učenja in številke epoh za izvedbo natančnega prilagajanja. Koda za natančno nastavitev modela ekstrakcije razmerja je definirana v entry_point.py. Glej naslednjo kodo:

Nadalje izboljšajte zmogljivost natančnega prilagajanja s samodejnim prilagajanjem modela SageMaker

Podobno kot v prejšnjih razdelkih uporabljamo a HyperparameterTuner predmet za interakcijo z API-ji za nastavitev hiperparametrov SageMaker. Nastavitev hiperparametrov lahko začnemo s klicem fit metoda:

Ko je opravilo prilagajanja hiperparametrov končano, izvedemo sklepanje in preverimo oceno ocene.

Vidimo lahko, da model s HPO kaže boljšo zmogljivost na podatkih testa zadrževanja.

Povzetek dokumenta

Povzemanje dokumenta ali besedila je naloga strnjevanja velikih količin besedilnih podatkov v manjšo podmnožico smiselnih stavkov, ki predstavljajo najpomembnejše ali ustrezne informacije znotraj izvirne vsebine. Povzetek dokumenta je uporabna tehnika za razdelitev pomembnih informacij iz velikih količin besedilnih podatkov v nekaj stavkov. Povzemanje besedila se uporablja v številnih primerih uporabe, kot je obdelava dokumentov in pridobivanje informacij iz spletnih dnevnikov, člankov in novic.

Ta zvezek prikazuje uvajanje modela povzemanja dokumenta T5-osnova Iz Objemni obrazni transformatorji knjižnica. Prav tako testiramo razporejene končne točke z uporabo besedilnega članka in ocenjujemo rezultate z uporabo vgrajene metrike ocenjevanja Hugging Face RED.

Podobno kot zvezke za odgovarjanje na vprašanja in NER uporabljamo zvezke PyTorchModel iz SDK-ja SageMaker Python skupaj z entry_point.py skript za nalaganje osnovnega modela T5 v končno točko HTTPS. Ko je končna točka uspešno uvedena, lahko končni točki pošljemo besedilni članek, da prejmemo napovedni odgovor:

Nato ocenimo in primerjamo besedilni članek in rezultat povzemanja z metriko ROUGE. Izračunane so tri metrike vrednotenja: rougeN, rougeLin rougeLsum. rougeN meri število ujemanja n-grams med modelom generiranim besedilom (rezultat povzemanja) in a reference (vnos besedila). Meritve rougeL in rougeLsum izmerite najdaljša ujemajoča se zaporedja besed tako, da poiščete najdaljše skupne podnize v ustvarjenih in referenčnih povzetkih. Za vsako metriko se izračunajo intervali zaupanja za natančnost, priklic in rezultat F1. Glejte naslednjo kodo:

Čiščenje

Vire, ustvarjene za to rešitev, je mogoče izbrisati z uporabo Izbriši vse vire v SageMaker Studio IDE. Vsak prenosnik ponuja tudi razdelek za čiščenje s kodo za brisanje končnih točk.

zaključek

V tej objavi smo pokazali, kako uporabiti najsodobnejše tehnike ML za reševanje petih različnih nalog NLP: povzemanje dokumentov, klasifikacija besedila, vprašanja in odgovori, prepoznavanje poimenovane entitete in ekstrakcija odnosa z uporabo Jumpstarta. Začnite uporabljati Jumpstart zdaj!

O avtorjih

dr. Xin Huang je uporabni znanstvenik za vgrajene algoritme Amazon SageMaker JumpStart in Amazon SageMaker. Osredotoča se na razvoj razširljivih algoritmov strojnega učenja. Njegovi raziskovalni interesi so na področju obdelave naravnega jezika, razložljivega globokega učenja na tabelarnih podatkih in robustne analize neparametričnega prostorsko-časovnega združevanja. Objavil je številne prispevke na konferencah ACL, ICDM, KDD in v reviji Royal Statistical Society: Series A.

dr. Xin Huang je uporabni znanstvenik za vgrajene algoritme Amazon SageMaker JumpStart in Amazon SageMaker. Osredotoča se na razvoj razširljivih algoritmov strojnega učenja. Njegovi raziskovalni interesi so na področju obdelave naravnega jezika, razložljivega globokega učenja na tabelarnih podatkih in robustne analize neparametričnega prostorsko-časovnega združevanja. Objavil je številne prispevke na konferencah ACL, ICDM, KDD in v reviji Royal Statistical Society: Series A.

Vivek Gangasani je višji arhitekt rešitev za strojno učenje pri Amazon Web Services. Startupom pomaga graditi in operacionalizirati aplikacije AI/ML. Trenutno je osredotočen na združevanje svojega znanja na področju vsebnikov in strojnega učenja za zagotavljanje rešitev na področju MLOps, ML Inference in ML z nizko kodo. V prostem času rad preizkuša nove restavracije in raziskuje nastajajoče trende na področju umetne inteligence in poglobljenega učenja.

Vivek Gangasani je višji arhitekt rešitev za strojno učenje pri Amazon Web Services. Startupom pomaga graditi in operacionalizirati aplikacije AI/ML. Trenutno je osredotočen na združevanje svojega znanja na področju vsebnikov in strojnega učenja za zagotavljanje rešitev na področju MLOps, ML Inference in ML z nizko kodo. V prostem času rad preizkuša nove restavracije in raziskuje nastajajoče trende na področju umetne inteligence in poglobljenega učenja.

Geremy Cohen je arhitekt rešitev z AWS, kjer strankam pomaga pri izdelavi vrhunskih rešitev v oblaku. V prostem času uživa v kratkih sprehodih po plaži, z družino raziskuje območje zaliva, popravlja stvari po hiši, lomi okoli hiše in žari na žaru.

Geremy Cohen je arhitekt rešitev z AWS, kjer strankam pomaga pri izdelavi vrhunskih rešitev v oblaku. V prostem času uživa v kratkih sprehodih po plaži, z družino raziskuje območje zaliva, popravlja stvari po hiši, lomi okoli hiše in žari na žaru.

Neelam Koshiya je arhitekt za poslovne rešitve pri AWS. Trenutno se osredotoča na pomoč podjetniškim strankam na njihovi poti sprejemanja oblaka za strateške poslovne rezultate. V prostem času rada bere in je na prostem.

Neelam Koshiya je arhitekt za poslovne rešitve pri AWS. Trenutno se osredotoča na pomoč podjetniškim strankam na njihovi poti sprejemanja oblaka za strateške poslovne rezultate. V prostem času rada bere in je na prostem.

- Napredno (300)

- AI

- ai art

- ai art generator

- imajo robota

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Umetna inteligenca

- certificiranje umetne inteligence

- umetna inteligenca v bančništvu

- robot z umetno inteligenco

- roboti z umetno inteligenco

- programska oprema za umetno inteligenco

- Strojno učenje AWS

- blockchain

- blockchain konferenca ai

- coingenius

- pogovorna umetna inteligenca

- kripto konferenca ai

- dall's

- globoko učenje

- strokovnjak (400)

- strojno učenje

- platon

- platon ai

- Platonova podatkovna inteligenca

- Igra Platon

- PlatoData

- platogaming

- lestvica ai

- sintaksa

- zefirnet