V današnji informacijski dobi ogromne količine podatkov, shranjenih v neštetih dokumentih, predstavljajo hkrati izziv in priložnost za podjetja. Tradicionalne metode obdelave dokumentov pogosto niso učinkovite in točne, kar pušča prostor za inovacije, stroškovno učinkovitost in optimizacije. Obdelava dokumentov je s prihodom inteligentne obdelave dokumentov (IDP) doživela pomemben napredek. Z IDP lahko podjetja pretvorijo nestrukturirane podatke iz različnih vrst dokumentov v strukturirane, uporabne vpoglede, kar dramatično poveča učinkovitost in zmanjša ročno delo. Vendar pa se potencial ne konča tam. Z integracijo generativne umetne inteligence (AI) v proces lahko dodatno izboljšamo zmogljivosti IDP. Generativni AI ne uvaja samo izboljšanih zmogljivosti pri obdelavi dokumentov, temveč tudi dinamično prilagodljivost spreminjajočim se vzorcem podatkov. Ta objava vas popelje skozi sinergijo IDP in generativne umetne inteligence ter razkrije, kako predstavljata naslednjo mejo pri obdelavi dokumentov.

IDP podrobno obravnavamo v naši seriji Inteligentna obdelava dokumentov s storitvami umetne inteligence AWS (Del 1 in Del 2). V tej objavi razpravljamo o tem, kako razširiti novo ali obstoječo arhitekturo IDP z velikimi jezikovnimi modeli (LLM). Natančneje, razpravljamo o tem, kako se lahko integriramo Amazonovo besedilo z LangChain kot nalagalnik dokumentov in Amazon Bedrock za pridobivanje podatkov iz dokumentov in uporabo generativnih zmogljivosti AI v različnih fazah IDP.

Amazon Texttract je storitev strojnega učenja (ML), ki samodejno izvleče besedilo, rokopis in podatke iz skeniranih dokumentov. Amazon Bedrock je popolnoma upravljana storitev, ki ponuja izbiro visoko zmogljivih temeljnih modelov (FM) prek API-jev, ki so enostavni za uporabo.

Naslednji diagram je referenčna arhitektura na visoki ravni, ki pojasnjuje, kako lahko dodatno izboljšate potek dela IDP z osnovnimi modeli. LLM lahko uporabljate v eni ali vseh fazah IDP, odvisno od primera uporabe in želenega rezultata.

V naslednjih razdelkih se poglobimo v to, kako je Amazon Texttract integriran v generativne poteke dela AI z uporabo LangChaina za obdelavo dokumentov za vsako od teh posebnih nalog. Tukaj navedeni bloki kode so bili zaradi jedrnatosti okrnjeni. Oglejte si naše GitHub repozitorij za podrobne zvezke Python in navodila po korakih.

Izvleček besedila iz dokumentov je ključen vidik pri obdelavi dokumentov z LLM. Amazon Texttract lahko uporabite za ekstrahiranje nestrukturiranega neobdelanega besedila iz dokumentov in ohranitev izvirnih polstrukturiranih ali strukturiranih predmetov, kot so pari ključ-vrednost in tabele, prisotne v dokumentu. Paketi dokumentov, kot so zdravstvene in zavarovalniške terjatve ali hipoteke, so sestavljeni iz zapletenih obrazcev, ki vsebujejo veliko informacij v strukturiranih, polstrukturiranih in nestrukturiranih formatih. Ekstrakcija dokumentov je tukaj pomemben korak, saj LLM koristi bogata vsebina za ustvarjanje natančnejših in ustreznih odgovorov, kar bi sicer lahko vplivalo na kakovost rezultatov LLM.

LangChain je zmogljivo odprtokodno ogrodje za integracijo z LLM. LLM so na splošno vsestranski, vendar se lahko spopadejo z nalogami, specifičnimi za področje, kjer so potrebni globlji kontekst in niansirani odgovori. LangChain omogoča razvijalcem v takšnih scenarijih, da zgradijo agente, ki lahko kompleksne naloge razdelijo na manjše podnaloge. Podnaloge lahko nato uvedejo kontekst in pomnilnik v LLM s povezovanjem in veriženjem pozivov LLM.

LangChain ponuja nakladalniki dokumentov ki lahko nalaga in preoblikuje podatke iz dokumentov. Uporabite jih lahko za strukturiranje dokumentov v želene formate, ki jih lahko obdelujejo LLM-ji. The AmazonTextractPFLoader je vrsta nalagalnika storitev za nalaganje dokumentov, ki omogoča hiter način avtomatizacije obdelave dokumentov z uporabo Amazon Texttract v kombinaciji z LangChain. Za več podrobnosti o AmazonTextractPDFLoader, glejte LangChain dokumentacijo. Če želite uporabiti nalagalnik dokumentov Amazon Texttract, ga začnete uvoziti iz knjižnice LangChain:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Prav tako lahko shranite dokumente v Amazon S3 in se nanje sklicujete z uporabo vzorca URL s3://, kot je razloženo v Dostop do vedra z uporabo S3://, in posredujte to pot S3 nalagalniku PDF Amazon Texttract:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Večstranski dokument bo vseboval več strani besedila, do katerih je nato mogoče dostopati prek objekta dokumentov, ki je seznam strani. Naslednja koda se premika po straneh v objektu dokumentov in natisne besedilo dokumenta, ki je na voljo prek page_content atribut:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend in LLM je mogoče učinkovito uporabiti za klasifikacijo dokumentov. Amazon Comprehend je storitev za obdelavo naravnega jezika (NLP), ki uporablja ML za pridobivanje vpogledov iz besedila. Amazon Comprehend podpira tudi usposabljanje za model klasifikacije po meri z zavedanjem o postavitvi dokumentov, kot so PDF-ji, Word in slikovni formati. Za več informacij o uporabi klasifikatorja dokumentov Amazon Comprehend glejte Klasifikator dokumentov Amazon Comprehend doda podporo za postavitev za večjo natančnost.

V povezavi z LLM postane klasifikacija dokumentov močan pristop za upravljanje velikih količin dokumentov. LLM so v pomoč pri klasifikaciji dokumentov, ker lahko analizirajo besedilo, vzorce in kontekstualne elemente v dokumentu z razumevanjem naravnega jezika. Lahko jih tudi natančno prilagodite za določene razrede dokumentov. Ko nova vrsta dokumenta, uvedena v cevovod IDP, potrebuje klasifikacijo, lahko LLM obdela besedilo in kategorizira dokument glede na nabor razredov. Sledi vzorčna koda, ki uporablja nalagalnik dokumentov LangChain, ki ga poganja Amazon Texttract, da izvleče besedilo iz dokumenta in ga uporabi za razvrščanje dokumenta. Uporabljamo Antropični Claude v2 model prek Amazon Bedrock za izvedbo klasifikacije.

V naslednjem primeru najprej izvlečemo besedilo iz poročila o odpustu bolnika in uporabimo LLM, da ga razvrstimo glede na seznam treh različnih vrst dokumentov –DISCHARGE_SUMMARY, RECEIPTin PRESCRIPTION. Naslednji posnetek zaslona prikazuje naše poročilo.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Povzemanje vključuje strnitev danega besedila ali dokumenta v krajšo različico, pri čemer se ohranijo ključne informacije. Ta tehnika je koristna za učinkovito iskanje informacij, ki uporabnikom omogoča hitro razumevanje ključnih točk dokumenta, ne da bi prebrali celotno vsebino. Čeprav Amazon Texttract neposredno ne izvaja povzemanja besedila, zagotavlja temeljne zmožnosti pridobivanja celotnega besedila iz dokumentov. To ekstrahirano besedilo služi kot vhod v naš model LLM za izvajanje nalog povzemanja besedila.

Z istim vzorcem poročila o razrešnici, ki ga uporabljamo AmazonTextractPDFLoader za ekstrahiranje besedila iz tega dokumenta. Kot prej uporabljamo model Claude v2 preko Amazon Bedrock in ga inicializiramo s pozivom, ki vsebuje navodila, kaj narediti z besedilom (v tem primeru povzemanje). Na koncu zaženemo verigo LLM tako, da posredujemo ekstrahirano besedilo iz nalagalnika dokumentov. To zažene dejanje sklepanja na LLM s pozivom, ki je sestavljen iz navodil za povzetek, in besedila dokumenta, označenega z Document. Glej naslednjo kodo:

Koda ustvari povzetek poročila o povzetku odpusta bolnika:

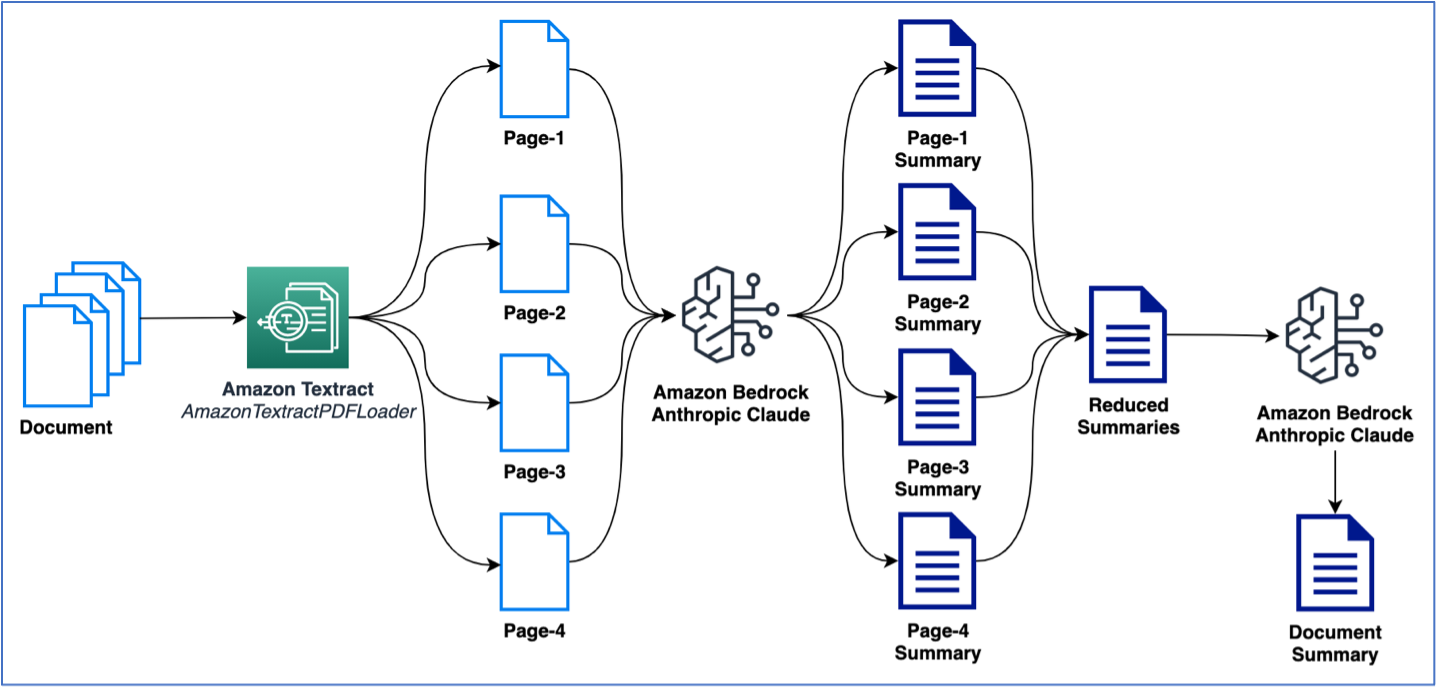

Prejšnji primer je za izvedbo povzemanja uporabil enostranski dokument. Vendar pa boste verjetno imeli opravka z dokumenti, ki vsebujejo več strani, ki jih je treba povzeti. Pogost način izvajanja povzemanja na več straneh je, da najprej ustvarite povzetke na manjših delih besedila in nato združite manjše povzetke, da dobite končni povzetek dokumenta. Upoštevajte, da ta metoda zahteva več klicev LLM. Logiko za to je mogoče zlahka oblikovati; vendar LangChain ponuja vgrajeno verigo povzemanja, ki lahko povzema velika besedila (iz dokumentov z več stranmi). Povzemanje se lahko zgodi prek map_reduce ali stuff možnosti, ki so na voljo kot možnosti za upravljanje več klicev LLM. V naslednjem primeru uporabljamo map_reduce za povzetek večstranskega dokumenta. Naslednja slika ponazarja naš potek dela.

Najprej začnimo z ekstrahiranjem dokumenta in si oglejmo skupno število žetonov na stran in skupno število strani:

Nato uporabimo vgrajeni LangChain load_summarize_chain če povzamem celoten dokument:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Standardizacija in vprašanja in odgovori

V tem razdelku obravnavamo naloge standardizacije in vprašanj in odgovorov.

Standardizacija

Standardizacija izhoda je naloga generiranja besedila, kjer se LLM uporabljajo za zagotavljanje doslednega oblikovanja izhodnega besedila. Ta naloga je še posebej uporabna za avtomatizacijo ekstrakcije ključnih entitet, ki zahteva, da je izhod usklajen z želenimi formati. Na primer, lahko sledimo takojšnjim najboljšim inženirskim praksam za natančno nastavitev LLM za formatiranje datumov v obliki zapisa MM/DD/LLLL, ki je morda združljiva s stolpcem DATUMA baze podatkov. Naslednji blok kode prikazuje primer, kako se to izvede z uporabo LLM in hitrega inženiringa. Ne samo, da standardiziramo izhodni format za datumske vrednosti, model tudi pozovemo, da ustvari končni izhod v formatu JSON, tako da ga je enostavno uporabiti v naših nadaljnjih aplikacijah. Uporabljamo Izrazni jezik LangChain (LCEL) za povezovanje dveh dejanj. Prvo dejanje pozove LLM, da ustvari izhod v formatu JSON samo z datumi iz dokumenta. Drugo dejanje sprejme izhod JSON in standardizira obliko datuma. Upoštevajte, da je to dejanje v dveh korakih mogoče izvesti tudi v enem samem koraku z ustreznim hitrim inženiringom, kot bomo videli pri normalizaciji in oblikovanju predlog.

Rezultat prejšnjega vzorca kode je struktura JSON z datumoma 07/09/2020 in 08/09/2020, ki sta v obliki zapisa DD/MM/LLLL in sta datuma sprejema bolnika oziroma datuma odpusta iz bolnišnice v skladu z na zbirno poročilo o razrešnici.

Vprašanja in odgovori z generiranjem razširjenega pridobivanja

LLM-ji so znani po tem, da obdržijo dejanske informacije, ki se pogosto imenujejo njihovo poznavanje sveta ali pogled na svet. Ko so natančno nastavljeni, lahko ustvarijo najsodobnejše rezultate. Vendar pa obstajajo omejitve glede tega, kako učinkovito lahko LLM dostopa do tega znanja in ga manipulira. Posledično pri nalogah, ki so močno odvisne od specifičnega znanja, njihova zmogljivost morda ne bo optimalna za določene primere uporabe. Na primer, v scenarijih vprašanj in odgovorov je bistveno, da se model strogo drži konteksta, podanega v dokumentu, ne da bi se zanašal samo na svoje poznavanje sveta. Odstopanje od tega lahko vodi do napačnih navedb, netočnosti ali celo napačnih odgovorov. Najpogosteje uporabljena metoda za reševanje te težave je znana kot Povečana generacija pridobivanja (RAG). Ta pristop sinergizira prednosti tako modelov iskanja kot jezikovnih modelov, kar povečuje natančnost in kakovost ustvarjenih odgovorov.

LLM-ji lahko naložijo tudi omejitve žetonov zaradi svojih pomnilniških omejitev in omejitev strojne opreme, na kateri delujejo. Za reševanje te težave se uporabljajo tehnike, kot je razrezovanje, za razdelitev velikih dokumentov na manjše dele, ki ustrezajo omejitvam žetonov LLM. Po drugi strani pa se vdelave v NLP uporabljajo predvsem za zajemanje semantičnega pomena besed in njihovih odnosov z drugimi besedami v visokodimenzionalnem prostoru. Te vdelave pretvorijo besede v vektorje, kar omogoča modelom učinkovito obdelavo in razumevanje besedilnih podatkov. Z razumevanjem pomenskih nians med besedami in besednimi zvezami vdelave omogočajo LLM-jem ustvarjanje koherentnih in kontekstualno ustreznih rezultatov. Upoštevajte naslednje ključne izraze:

- Čunkanje – Ta postopek razdeli velike količine besedila iz dokumentov na manjše, smiselne dele besedila.

- Vdelave – To so vektorske transformacije s fiksno dimenzijo vsakega kosa, ki ohranjajo semantične informacije iz kosov. Te vdelave se nato naložijo v vektorsko bazo podatkov.

- Vektorska baza podatkov – To je zbirka podatkov o vdelanih besedah ali vektorjih, ki predstavljajo kontekst besed. Deluje kot vir znanja, ki pomaga NLP nalogam pri obdelavi dokumentov. Prednost vektorske podatkovne baze tukaj je, da omogoča le potreben kontekst, ki se zagotovi študentom LLM med ustvarjanjem besedila, kot pojasnjujemo v naslednjem razdelku.

RAG uporablja moč vdelav za razumevanje in pridobivanje ustreznih segmentov dokumenta med fazo iskanja. S tem lahko RAG deluje v okviru omejitev žetonov LLM-jev, kar zagotavlja, da so za generiranje izbrane najustreznejše informacije, kar ima za posledico natančnejše in kontekstualno ustrezne rezultate.

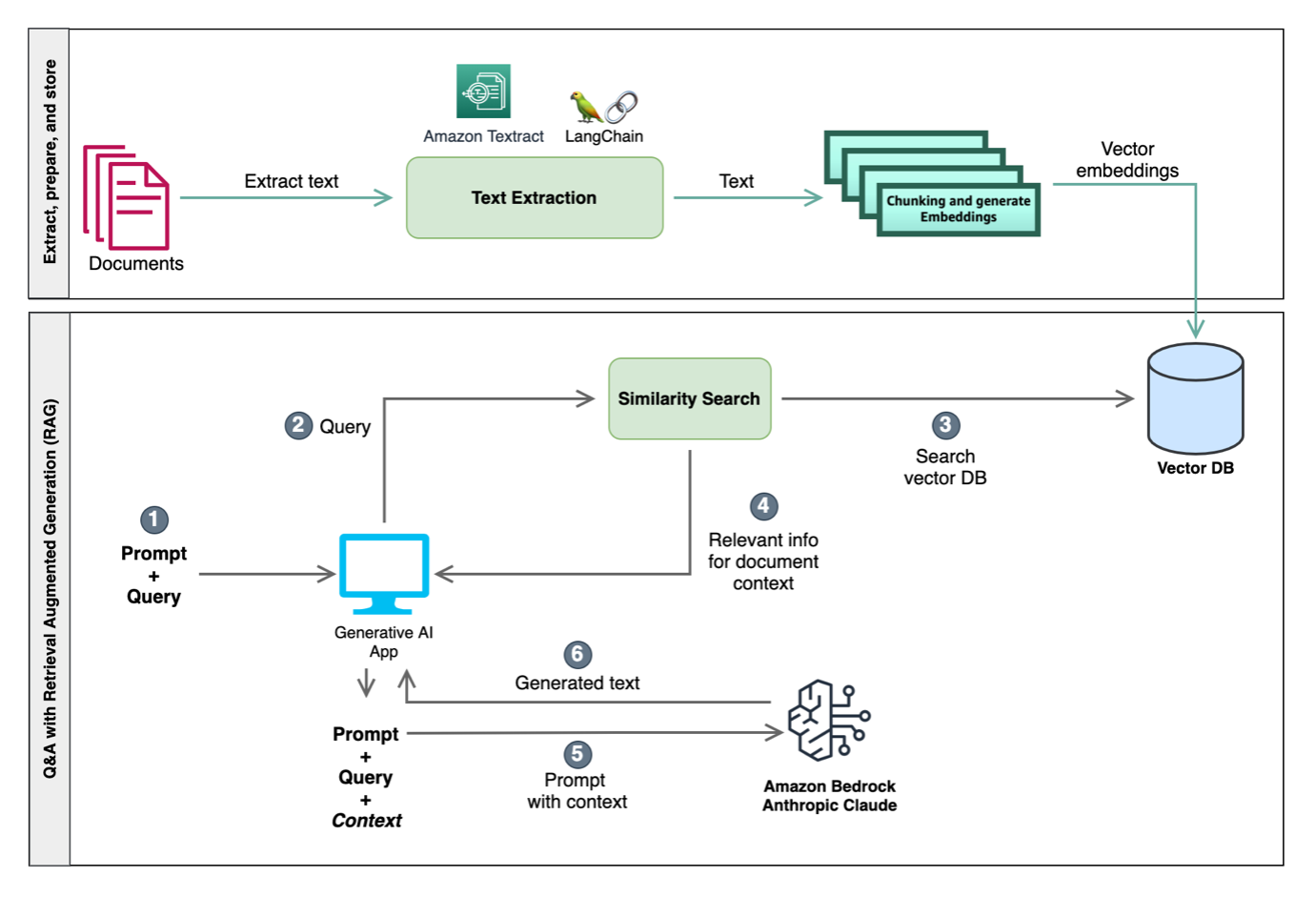

Naslednji diagram ponazarja integracijo teh tehnik za oblikovanje vhodnih podatkov za LLM, izboljšanje njihovega kontekstualnega razumevanja in omogočanje ustreznejših odzivov v kontekstu. En pristop vključuje iskanje podobnosti z uporabo vektorske podatkovne baze in razčlenjevanja. Vektorska baza podatkov shranjuje vdelave, ki predstavljajo semantične informacije, razčlenjevanje pa razdeli besedilo na obvladljive odseke. Z uporabo tega konteksta iz iskanja podobnosti lahko LLM izvajajo naloge, kot je odgovarjanje na vprašanja in domensko specifične operacije, kot sta klasifikacija in obogatitev.

Za to objavo uporabljamo pristop, ki temelji na RAG, za izvajanje vprašanj in odgovorov v kontekstu z dokumenti. V naslednjem vzorcu kode izvlečemo besedilo iz dokumenta in nato dokument razdelimo na manjše dele besedila. Razdelitev je potrebna, ker imamo morda velike večstranske dokumente in imajo naši LLM morda omejitve žetonov. Ti kosi se nato naložijo v vektorsko bazo podatkov za izvajanje iskanja podobnosti v naslednjih korakih. V naslednjem primeru uporabljamo model Amazon Titan Embed Text v1, ki izvaja vektorske vdelave delov dokumenta:

Koda ustvari ustrezen kontekst za LLM z uporabo kosov besedila, ki jih vrne dejanje iskanja podobnosti iz vektorske baze podatkov. Za ta primer uporabljamo odprtokodno Vektorska trgovina FAISS kot vzorčno vektorsko bazo podatkov za shranjevanje vektorskih vdelav vsakega dela besedila. Vektorsko bazo podatkov nato definiramo kot a LangChain prinašalec, ki se prenese v RetrievalQA veriga. To interno zažene iskalno poizvedbo o podobnosti v vektorski bazi podatkov, ki vrne zgornjih n (kjer je n=3 v našem primeru) kosov besedila, ki so pomembni za vprašanje. Nazadnje se veriga LLM izvaja z ustreznim kontekstom (skupino ustreznih delov besedila) in vprašanjem, na katerega mora LLM odgovoriti. Za postopno predstavitev kode vprašanj in odgovorov z RAG si oglejte prenosni računalnik Python na GitHub.

Kot alternativo FAISS lahko uporabite tudi Zmogljivosti vektorske baze podatkov Amazon OpenSearch Service, Amazon Relational Database Service (Amazon RDS) za PostgreSQL s pgvector razširitev kot vektorske baze podatkov ali odprtokodna baza podatkov Chroma.

Vprašanja in odgovori s tabelarnimi podatki

Tabelarni podatki v dokumentih so lahko za LLM-je zahtevni za obdelavo zaradi njihove strukturne kompleksnosti. Amazon Texttract je mogoče nadgraditi z LLM-ji, ker omogoča ekstrahiranje tabel iz dokumentov v ugnezdeni obliki elementov, kot so stran, tabela in celice. Izvajanje vprašanj in odgovorov s tabelarnimi podatki je postopek v več korakih in ga je mogoče doseči prek samospraševanje. Sledi pregled korakov:

- Ekstrahirajte tabele iz dokumentov z uporabo Amazon Texttract. Z Amazon Texttract lahko tabelarično strukturo (vrstice, stolpce, glave) izvlečete iz dokumenta.

- Shranite tabelarične podatke v vektorsko zbirko podatkov skupaj z informacijami o metapodatkih, kot so imena glav in opis vsake glave.

- Uporabite poziv za sestavo strukturirane poizvedbe z uporabo LLM, da pridobite podatke iz tabele.

- Uporabite poizvedbo za ekstrahiranje ustreznih podatkov tabele iz vektorske baze podatkov.

Na primer, v bančnem izpisku, glede na poziv »Kakšne so transakcije z več kot 1000 $ depozitov,« bi LLM dokončal naslednje korake:

- Ustvarite poizvedbo, kot npr

“Query: transactions” , “filter: greater than (Deposit$)”. - Pretvorite poizvedbo v strukturirano poizvedbo.

- Uporabite strukturirano poizvedbo v vektorski bazi podatkov, kjer so shranjeni podatki naše tabele.

Za korak za korakom pregled vzorčne kode vprašanj in odgovorov s tabelarno si oglejte prenosni računalnik Python v GitHub.

Predloge in normalizacije

V tem razdelku si ogledamo, kako uporabiti tehnike hitrega inženiringa in vgrajeni mehanizem LangChain za ustvarjanje izhoda z izvlečki iz dokumenta v določeni shemi. Izvedemo tudi nekaj standardizacije ekstrahiranih podatkov z uporabo tehnik, ki smo jih obravnavali prej. Začnemo z definiranjem predloge za želeni rezultat. To bo služilo kot shema in zajemalo podrobnosti o vsaki entiteti, ki jo želimo izvleči iz besedila dokumenta.

Upoštevajte, da za vsako od entitet uporabljamo opis, da pojasnimo, kaj ta entiteta je, da pomagamo LLM pri pridobivanju vrednosti iz besedila dokumenta. V naslednji vzorčni kodi uporabljamo to predlogo za izdelavo našega poziva za LLM skupaj z besedilom, ekstrahiranim iz dokumenta z uporabo AmazonTextractPDFLoader in nato izvede sklepanje z modelom:

Kot lahko vidite, je {keys} del poziva so ključi iz naše predloge in {details} so ključi skupaj z njihovim opisom. V tem primeru modelu izrecno ne ponudimo oblike izhoda, razen če v navodilih navedemo, da se izhod ustvari v obliki zapisa JSON. To večinoma deluje; ker pa je izhod iz LLM-jev nedeterministično generiranje besedila, želimo obliko izrecno podati kot del navodil v pozivu. Za rešitev tega lahko uporabimo LangChain razčlenjevalnik strukturiranih izhodov modul za izkoriščanje prednosti avtomatiziranega inženiringa pozivov, ki pomaga pretvoriti našo predlogo v poziv z navodili za obliko. Uporabimo predlogo, definirano prej, da ustvarimo poziv za navodila za oblikovanje, kot sledi:

Nato uporabimo to spremenljivko znotraj prvotnega poziva kot navodilo za LLM, tako da izvleče in oblikuje izhod v želeni shemi tako, da naredi majhno spremembo našega poziva:

Doslej smo iz dokumenta samo ekstrahirali podatke v želeni shemi. Vendar pa moramo še vedno izvesti nekaj standardizacije. Na primer, želimo, da se pacientov datum sprejema in datum odpusta izvlečeta v obliki DD/MM/LLLL. V tem primeru povečamo description ključa z navodili za oblikovanje:

Oglejte si zvezek Python v GitHub za popolno predstavitev in razlago po korakih.

Preverjanje črkovanja in popravki

LLM-ji so pokazali izjemne sposobnosti razumevanja in ustvarjanja besedila, podobnega človeku. Ena od manj razpravljanih, a izjemno uporabnih aplikacij LLM je njihov potencial pri slovničnih preverjanjih in popravljanju stavkov v dokumentih. Za razliko od tradicionalnih pregledovalnikov slovnice, ki se zanašajo na nabor vnaprej določenih pravil, LLM uporabljajo vzorce, ki so jih identificirali iz ogromnih količin besedilnih podatkov, da določijo, kaj pomeni pravilen ali tekoč jezik. To pomeni, da lahko zaznajo nianse, kontekst in podrobnosti, ki bi jih sistemi na podlagi pravil morda spregledali.

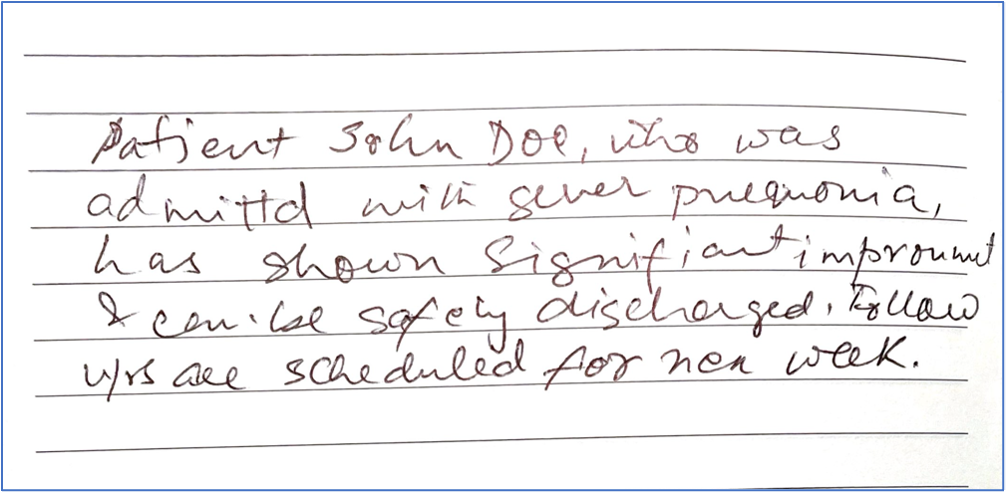

Predstavljajte si besedilo, izvlečeno iz povzetka o odpustu bolnika, ki se glasi: »Pacient Jon Doe, ki je bil sprejet zaradi hude pljučnice, je pokazal znatno izboljšanje in ga je mogoče varno odpustiti. Nadaljevanje je predvideno za naslednji teden.” Tradicionalni črkovalnik lahko prepozna »admittd«, »pneumonia«, »improvement« in »nex« kot napake. Vendar lahko kontekst teh napak vodi do nadaljnjih napak ali splošnih predlogov. LLM, opremljen s svojim obsežnim usposabljanjem, bi lahko predlagal: »Bolnik John Doe, ki je bil sprejet s hudo pljučnico, je pokazal znatno izboljšanje in ga je mogoče varno odpustiti. Nadaljnji pregledi so predvideni za naslednji teden.”

Sledi slabo ročno napisan vzorec dokumenta z enakim besedilom, kot je bilo razloženo prej.

Dokument ekstrahiramo z nalagalnikom dokumentov Amazon Texttract in nato prek hitrega inženiringa naročimo LLM, naj popravi ekstrahirano besedilo, da popravi morebitne črkovalne in/ali slovnične napake:

Izhod prejšnje kode prikazuje izvirno besedilo, ki ga izvleče nalagalnik dokumentov, ki mu sledi popravljeno besedilo, ki ga ustvari LLM:

Upoštevajte, da je ne glede na to, kako močni so LLM-ji, bistveno, da na njihove predloge gledate samo kot na predloge. Čeprav osupljivo dobro ujamejo zapletenost jezika, niso nezmotljivi. Nekateri predlogi lahko spremenijo predvideni pomen ali ton izvirnega besedila. Zato je ključnega pomena, da človeški pregledovalci uporabljajo popravke, ustvarjene z LLM, kot vodilo, ne absolutno. Sodelovanje človeške intuicije z zmožnostmi LLM obljublja prihodnost, v kateri naša pisna komunikacija ni samo brez napak, ampak tudi bogatejša in bolj niansirana.

zaključek

Generativna umetna inteligenca spreminja način obdelave dokumentov z IDP za pridobivanje vpogledov. V postu Izboljšanje inteligentne obdelave dokumentov AWS z generativnim AI, smo razpravljali o različnih stopnjah cevovoda in o tem, kako stranka AWS Ricoh izboljšuje svoj cevovod IDP z LLM-ji. V tej objavi smo razpravljali o različnih mehanizmih povečanja poteka dela IDP z LLM prek Amazon Bedrock, Amazon Texttract in priljubljenega ogrodja LangChain. Z novim nalagalnikom dokumentov Amazon Texttract z LangChain lahko začnete že danes z uporabo vzorčnih zvezkov, ki so na voljo v GitHub repozitorij. Za več informacij o delu z generativnim AI na AWS glejte Napovedujemo nova orodja za gradnjo z Generative AI na AWS.

O avtorjih

Sonali Sahu vodi inteligentno obdelavo dokumentov z ekipo storitev AI/ML v AWS. Je avtorica, vodja misli in strastna tehnologinja. Njeno osrednje področje osredotočanja je AI in ML in pogosto govori na konferencah in srečanjih AI in ML po vsem svetu. Ima širino in globino izkušenj s tehnologijo in tehnološko industrijo, s strokovnim znanjem v zdravstveni oskrbi, finančnem sektorju in zavarovalništvu.

Sonali Sahu vodi inteligentno obdelavo dokumentov z ekipo storitev AI/ML v AWS. Je avtorica, vodja misli in strastna tehnologinja. Njeno osrednje področje osredotočanja je AI in ML in pogosto govori na konferencah in srečanjih AI in ML po vsem svetu. Ima širino in globino izkušenj s tehnologijo in tehnološko industrijo, s strokovnim znanjem v zdravstveni oskrbi, finančnem sektorju in zavarovalništvu.

Anjan Biswas je višji arhitekt rešitev za storitve AI s poudarkom na AI/ML in podatkovni analitiki. Anjan je del svetovne ekipe za storitve AI in sodeluje s strankami, da bi jim pomagal razumeti in razviti rešitve za poslovne težave z AI in ML. Anjan ima več kot 14 let izkušenj pri delu z globalno dobavno verigo, proizvodnjo in maloprodajnimi organizacijami ter strankam dejavno pomaga pri začetku in širitvi storitev umetne inteligence AWS.

Anjan Biswas je višji arhitekt rešitev za storitve AI s poudarkom na AI/ML in podatkovni analitiki. Anjan je del svetovne ekipe za storitve AI in sodeluje s strankami, da bi jim pomagal razumeti in razviti rešitve za poslovne težave z AI in ML. Anjan ima več kot 14 let izkušenj pri delu z globalno dobavno verigo, proizvodnjo in maloprodajnimi organizacijami ter strankam dejavno pomaga pri začetku in širitvi storitev umetne inteligence AWS.

Chinmayee Rane je specialist za rešitve AI/ML pri Amazon Web Services. Navdušena je nad uporabno matematiko in strojnim učenjem. Osredotoča se na oblikovanje inteligentne obdelave dokumentov in generativnih rešitev AI za stranke AWS. Zunaj službe uživa v plesu salse in bachate.

Chinmayee Rane je specialist za rešitve AI/ML pri Amazon Web Services. Navdušena je nad uporabno matematiko in strojnim učenjem. Osredotoča se na oblikovanje inteligentne obdelave dokumentov in generativnih rešitev AI za stranke AWS. Zunaj službe uživa v plesu salse in bachate.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :ima

- : je

- :ne

- :kje

- .priloga

- $1000

- $GOR

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- sposobnosti

- O meni

- absolutna

- dostop

- dostopna

- Po

- natančnost

- natančna

- doseže

- čez

- Ukrep

- dejavnosti

- aktivno

- dejavnost

- aktov

- Ad

- Naslov

- Dodaja

- držijo

- priznati

- priznal

- napredek

- Prednost

- prihod

- starost

- agenti

- AI

- Storitve AI

- AI / ML

- poravnano

- vsi

- Dovoli

- omogoča

- skupaj

- Prav tako

- alternativa

- Čeprav

- Amazon

- Amazonsko razumevanje

- Amazon RDS

- Amazonovo besedilo

- Amazon Web Services

- zneski

- an

- analitika

- analizirati

- in

- odgovor

- Antropično

- kaj

- API-ji

- aplikacije

- uporabna

- imenovanja

- pristop

- Arhitektura

- SE

- OBMOČJE

- okoli

- Umetnost

- umetni

- Umetna inteligenca

- Umetna inteligenca (AI)

- AS

- vidik

- pomoč

- Pomočnik

- At

- povečanje

- Povečana

- Avtor

- avtomatizirati

- Avtomatizirano

- samodejno

- Avtomatizacija

- Na voljo

- zavest

- AWS

- Stranka AWS

- Banka

- BE

- ker

- postane

- bilo

- pred

- koristno

- koristi

- BEST

- najboljše prakse

- med

- Block

- Bloki

- tako

- širina

- Break

- odmori

- izgradnjo

- Building

- vgrajeno

- poslovni

- podjetja

- vendar

- by

- poziva

- CAN

- Lahko dobiš

- Zmogljivosti

- zajemanje

- primeru

- primeri

- Celice

- nekatere

- verige

- verige

- izziv

- izziv

- spremenite

- Spremembe

- spreminjanje

- Pregledi

- izbira

- terjatve

- razred

- razredi

- Razvrstitev

- Razvrsti

- Koda

- KOHERENTNO

- sodelovanje

- Stolpec

- Stolpci

- kombinacija

- združujejo

- prihaja

- Skupno

- pogosto

- Komunikacija

- združljiv

- dokončanje

- kompleksna

- kompleksnost

- razumeti

- zgoščeno

- konference

- Povezovanje

- dosledno

- vsebuje

- omejitve

- gradnjo

- vsebujejo

- vseboval

- Vsebuje

- vsebina

- ozadje

- kontekstualno

- pretvorbo

- Core

- popravi

- popravljen

- Popravki

- bi

- obrti

- izdelana

- ustvari

- ključnega pomena

- po meri

- stranka

- Stranke, ki so

- ples

- datum

- Podatkovna analiza

- Baze podatkov

- baze podatkov

- Datum

- Termini

- ponudba

- globoko

- globlje

- opredeliti

- opredeljen

- definiranje

- Dokazano

- Odvisno

- vloge

- globina

- opisano

- opis

- oblikovanje

- želeno

- Podatki

- podrobno

- Podrobnosti

- odkrivanje

- Ugotovite,

- Razvoj

- Razvijalci

- Prehrana

- drugačen

- neposredno

- razpravlja

- razpravljali

- potop

- razdeli

- deli

- do

- Zdravnik

- dokument

- Dokumentacija

- Dokumenti

- srno

- Ne

- tem

- don

- opravljeno

- dont

- navzdol

- dramatično

- 2

- med

- dinamično

- e

- vsak

- prej

- enostavno

- enostaven za uporabo

- učinkovito

- učinkovitosti

- učinkovite

- učinkovito

- prizadevanja

- bodisi

- elementi

- Embed

- zaposleni

- pooblašča

- omogočajo

- omogoča

- omogočanje

- konec

- Inženiring

- okrepi

- okrepljeno

- izboljšanje

- zagotovitev

- zagotoviti

- Celotna

- subjekti

- entiteta

- opremljena

- napake

- bistvena

- Tudi

- Primer

- Razen

- izjema

- obstoječih

- izkušnje

- strokovno znanje

- Pojasnite

- razložiti

- Pojasni

- Razlaga

- izrecno

- izraz

- razširiti

- razširitev

- obsežen

- ekstrakt

- pridobivanje

- Izvlečki

- Padec

- false

- daleč

- utrujenost

- Področja

- Slika

- končna

- končno

- finančna

- Finančni sektor

- prva

- fit

- Osredotočite

- Osredotoča

- sledi

- sledili

- po

- sledi

- za

- format

- Obrazci

- je pokazala,

- Fundacija

- Okvirni

- brezplačno

- pogosto

- iz

- Frontier

- polno

- v celoti

- nadalje

- Prihodnost

- splošno

- ustvarjajo

- ustvarila

- ustvarja

- ustvarjajo

- generacija

- generativno

- Generativna AI

- dobili

- Daj

- dana

- Globalno

- slovnica

- prijem

- več

- skupina

- vodi

- strani

- ročaj

- se zgodi

- Zgodi se

- strojna oprema

- Imajo

- Glave

- zdravstveno varstvo

- močno

- pomoč

- pomoč

- pomoč

- Pomaga

- jo

- tukaj

- na visoki ravni

- visoko zmogljiv

- več

- drži

- Bolnišnica

- Kako

- Kako

- Vendar

- HTML

- HTTPS

- človeškega

- i

- ID

- identificirati

- if

- ponazarja

- slika

- neznansko

- vpliv

- uvoz

- Pomembno

- uvoz

- naložila

- Izboljšanje

- in

- Vključno

- Indeks

- Industrija

- Podatki

- Informacijska doba

- Inovacije

- vhod

- vpogledi

- primer

- Navodila

- zavarovanje

- integrirati

- integrirana

- Povezovanje

- integracija

- Intelligence

- Inteligentna

- Inteligentna obdelava dokumentov

- namenjen

- interno

- v

- zapletenosti

- uvesti

- Uvedeno

- Predstavlja

- IT

- ITS

- Jackson

- John

- JOHN DOE

- Jon

- jpg

- json

- samo

- Ključne

- tipke

- Vedite

- znanje

- znano

- jezik

- velika

- postavitev

- vodi

- Vodja

- vodi

- učenje

- odhodu

- Knjižnica

- kot

- Verjeten

- omejitve

- Meje

- Seznam

- LLM

- obremenitev

- nakladač

- Logika

- Poglej

- Sklop

- stroj

- strojno učenje

- Izdelava

- upravljanje

- obvladljiv

- upravlja

- upravljanje

- Navodilo

- proizvodnja

- označeno

- matematika

- Maj ..

- me

- kar pomeni,

- smiselna

- pomeni

- Mehanizem

- Mehanizmi

- Meetups

- Spomin

- Meta

- metapodatki

- Metoda

- Metode

- morda

- moti

- pogrešam

- napake

- ML

- Model

- modeli

- Moduli

- več

- hipoteke

- Najbolj

- več

- Ime

- Imena

- naravna

- Obdelava Natural Language

- potrebno

- Nimate

- potrebna

- potrebe

- Novo

- Naslednja

- naslednji teden

- nlp

- prenosnik

- zdaj

- senčenje

- Številka

- predmet

- predmeti

- of

- Ponudbe

- pogosto

- on

- ONE

- samo

- open source

- operacije

- Priložnost

- optimalna

- možnosti

- or

- organizacije

- izvirno

- Ostalo

- drugače

- naši

- ven

- Rezultat

- izhod

- izhodi

- zunaj

- več

- pregled

- pakete

- Stran

- strani

- bolečina

- seznanjeni

- parov

- del

- zlasti

- mimo

- opravil

- Podaje

- strastno

- pot

- Bolnik

- Vzorec

- vzorci

- za

- Izvedite

- performance

- opravljeno

- izvajati

- opravlja

- faza

- Dr.

- stavki

- plinovod

- Načrt

- platon

- Platonova podatkovna inteligenca

- PlatoData

- prosim

- pljučnica

- točke

- Popular

- mogoče

- Prispevek

- potencial

- moč

- poganja

- močan

- vaje

- Ravno

- Precision

- prednostno

- predstaviti

- prej

- v prvi vrsti

- Tiskanje

- printi

- problem

- Težave

- Postopek

- Predelano

- obravnavati

- proizvodnjo

- Obljublja

- pravilno

- zagotavljajo

- če

- Ponudnik

- zagotavlja

- Python

- Vprašanja in odgovori

- kakovost

- vprašanje

- Hitri

- hitro

- Surovi

- reading

- priznajo

- zmanjšanje

- glejte

- reference

- besedilu

- Razmerja

- pomembno

- zanašajo

- zanašanje

- izjemno

- poročilo

- predstavljajo

- predstavlja

- obvezna

- zahteva

- oziroma

- odgovorov

- Omejitve

- povzroči

- rezultat

- Rezultati

- Trgovina na drobno

- ohranijo

- ohranitev

- vrne

- Rich

- soba

- pravila

- Run

- deluje

- s

- varno

- Enako

- pravijo,

- Lestvica

- scenariji

- načrtovano

- Iskalnik

- drugi

- Oddelek

- oddelki

- sektor

- glej

- segmentih

- izbran

- višji

- stavek

- Serija

- služijo

- služi

- Storitev

- Storitve

- nastavite

- huda

- je

- Kratke Hlače

- shouldnt

- pokazale

- Razstave

- pomemben

- sam

- majhna

- manj

- delček

- So

- Izključno

- rešitve

- SOLVE

- nekaj

- vir

- Vesolje

- Govori

- specialist

- specifična

- posebej

- določeno

- črkovanje

- po delih

- postopka

- standardizacijo

- Začetek

- začel

- state-of-the-art

- Izjava

- Korak

- Koraki

- Še vedno

- trgovina

- shranjeni

- trgovine

- prednosti

- String

- strukturno

- Struktura

- strukturirano

- Boj

- kasneje

- Kasneje

- taka

- predlagajte

- Povzamemo

- POVZETEK

- dobavi

- dobavne verige

- podpora

- Podpira

- sinergija

- sistemi

- miza

- Bodite

- meni

- Naloga

- Naloge

- skupina

- tehnika

- tehnike

- tehnolog

- Tehnologija

- Predloga

- Pogoji

- besedilo

- besedilno

- kot

- da

- O

- svet

- njihove

- Njih

- POTEM

- Tukaj.

- zato

- te

- jih

- ta

- mislil

- 3

- skozi

- titan

- do

- danes

- današnje

- skupaj

- žeton

- Boni

- TONE

- orodja

- vrh

- Skupaj za plačilo

- tradicionalna

- Zamujala

- usposabljanje

- Transakcije

- Transform

- transformacije

- Res

- poskusite

- dva

- tip

- Vrste

- razumeli

- razumevanje

- za razliko od

- razkrivanje

- URL

- uporaba

- primeru uporabe

- Rabljeni

- Uporabniki

- uporablja

- uporabo

- uporablja

- Uporaben

- v1

- vrednost

- Vrednote

- spremenljivka

- različnih

- Popravljeno

- vsestranski

- različica

- preko

- Poglej

- prostornine

- walkthrough

- želeli

- je

- način..

- we

- web

- spletne storitve

- teden

- Dobro

- Kaj

- kdaj

- ki

- medtem

- WHO

- bo

- z

- v

- brez

- priča

- beseda

- besede

- delo

- potek dela

- delovnih tokov

- deluje

- deluje

- svet

- bi

- pisni

- X

- let

- Vi

- zefirnet