Eden najbolj uporabnih aplikacijskih vzorcev za generativne delovne obremenitve umetne inteligence je Retrieval Augmented Generation (RAG). V vzorcu RAG najdemo dele referenčne vsebine, povezane z vnosnim pozivom, z izvajanjem iskanja podobnosti na vdelavah. Vdelave zajamejo informacijsko vsebino v telesih besedila, kar omogoča modelom obdelave naravnega jezika (NLP) delo z jezikom v numerični obliki. Vdelave so samo vektorji števil s plavajočo vejico, zato jih lahko analiziramo, da bi odgovorili na tri pomembna vprašanja: Ali se naši referenčni podatki spreminjajo skozi čas? Ali se vprašanja, ki jih postavljajo uporabniki, sčasoma spreminjajo? In končno, kako dobro naši referenčni podatki pokrivajo zastavljena vprašanja?

V tej objavi boste spoznali nekaj premislekov o vdelani vektorski analizi in zaznavanju signalov zanašanja vdelave. Ker so vdelave pomemben vir podatkov za modele NLP na splošno in zlasti za generativne rešitve umetne inteligence, potrebujemo način za merjenje, ali se naše vdelave sčasoma spreminjajo (odnašajo). V tej objavi boste videli primer izvajanja zaznavanja odmika na vdelanih vektorjih z uporabo tehnike združevanja v gruče z velikimi jezikovnimi modeli (LLMS), razporejenimi iz Amazon SageMaker JumpStart. Te koncepte boste lahko raziskali tudi prek dveh ponujenih primerov, vključno z vzorčno aplikacijo od konca do konca ali, izbirno, podnaborom aplikacije.

Pregled RAG

O RAG vzorec vam omogoča pridobivanje znanja iz zunanjih virov, kot so dokumenti PDF, članki iz wikija ali prepisi klicev, in nato to znanje uporabite za razširitev poziva za navodila, poslanega LLM. To omogoča LLM, da se pri ustvarjanju odgovora sklicuje na ustreznejše informacije. Če na primer vprašate LLM, kako pripraviti čokoladne piškote, lahko vključuje informacije iz vaše knjižnice receptov. V tem vzorcu se besedilo recepta pretvori v vdelane vektorje z uporabo vdelanega modela in shrani v vektorsko bazo podatkov. Dohodna vprašanja se pretvorijo v vdelave, nato pa vektorska baza podatkov izvede iskanje podobnosti, da najde sorodno vsebino. Vprašanje in referenčni podatki gredo nato v poziv za LLM.

Oglejmo si podrobneje ustvarjene vdelane vektorje in kako izvesti analizo drifta na teh vektorjih.

Analiza vdelanih vektorjev

Vdelani vektorji so numerične predstavitve naših podatkov, tako da lahko analiza teh vektorjev zagotovi vpogled v naše referenčne podatke, ki jih je mogoče kasneje uporabiti za odkrivanje morebitnih signalov odnašanja. Vdelani vektorji predstavljajo element v n-dimenzionalnem prostoru, kjer je n pogosto velik. Na primer, model GPT-J 6B, uporabljen v tej objavi, ustvari vektorje velikosti 4096. Za merjenje odmika predpostavimo, da naša aplikacija zajame vdelane vektorje za referenčne podatke in dohodne pozive.

Začnemo z zmanjšanjem dimenzij z uporabo analize glavnih komponent (PCA). PCA poskuša zmanjšati število dimenzij, hkrati pa ohraniti večino variance v podatkih. V tem primeru skušamo najti število dimenzij, ki ohranijo 95 % variance, ki naj zajame karkoli znotraj dveh standardnih odklonov.

Nato uporabimo K-Means za identifikacijo nabora centrov gruč. K-Means poskuša združiti točke v skupine tako, da je vsaka skupina relativno kompaktna in so skupine čim bolj oddaljene druga od druge.

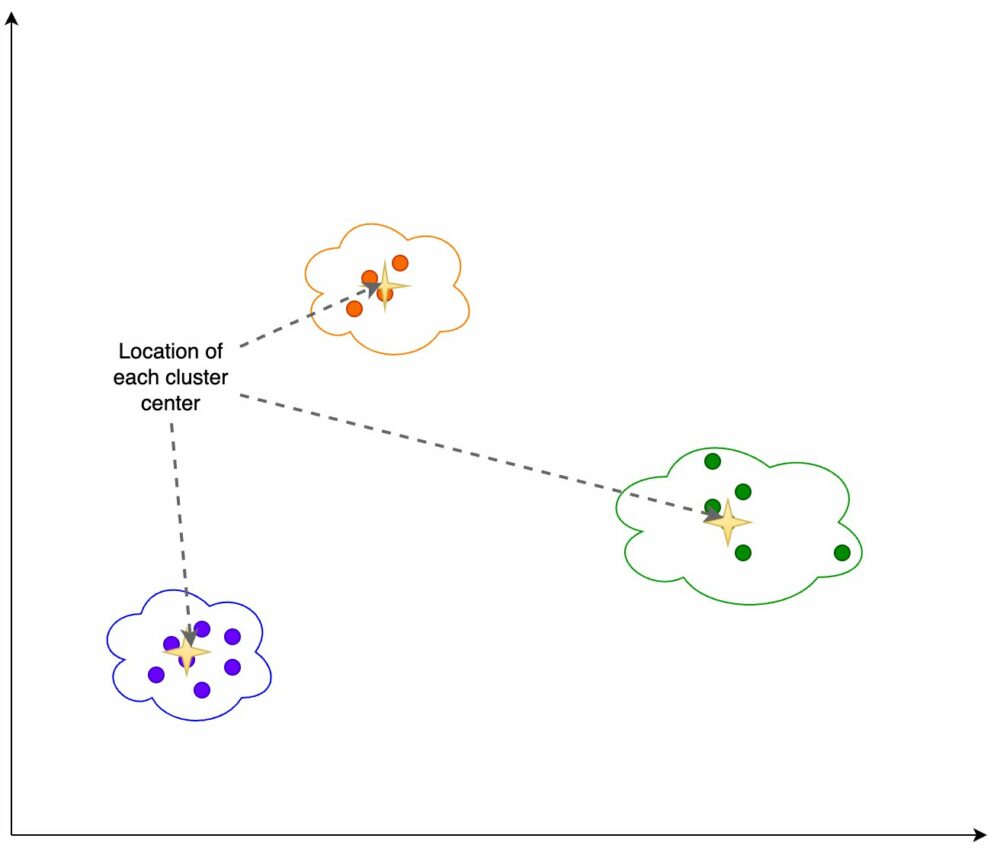

Naslednje informacije izračunamo na podlagi izhoda gručenja, prikazanega na naslednji sliki:

- Število dimenzij v PCA, ki pojasnjujejo 95 % variance

- Lokacija vsakega središča gruče ali centroida

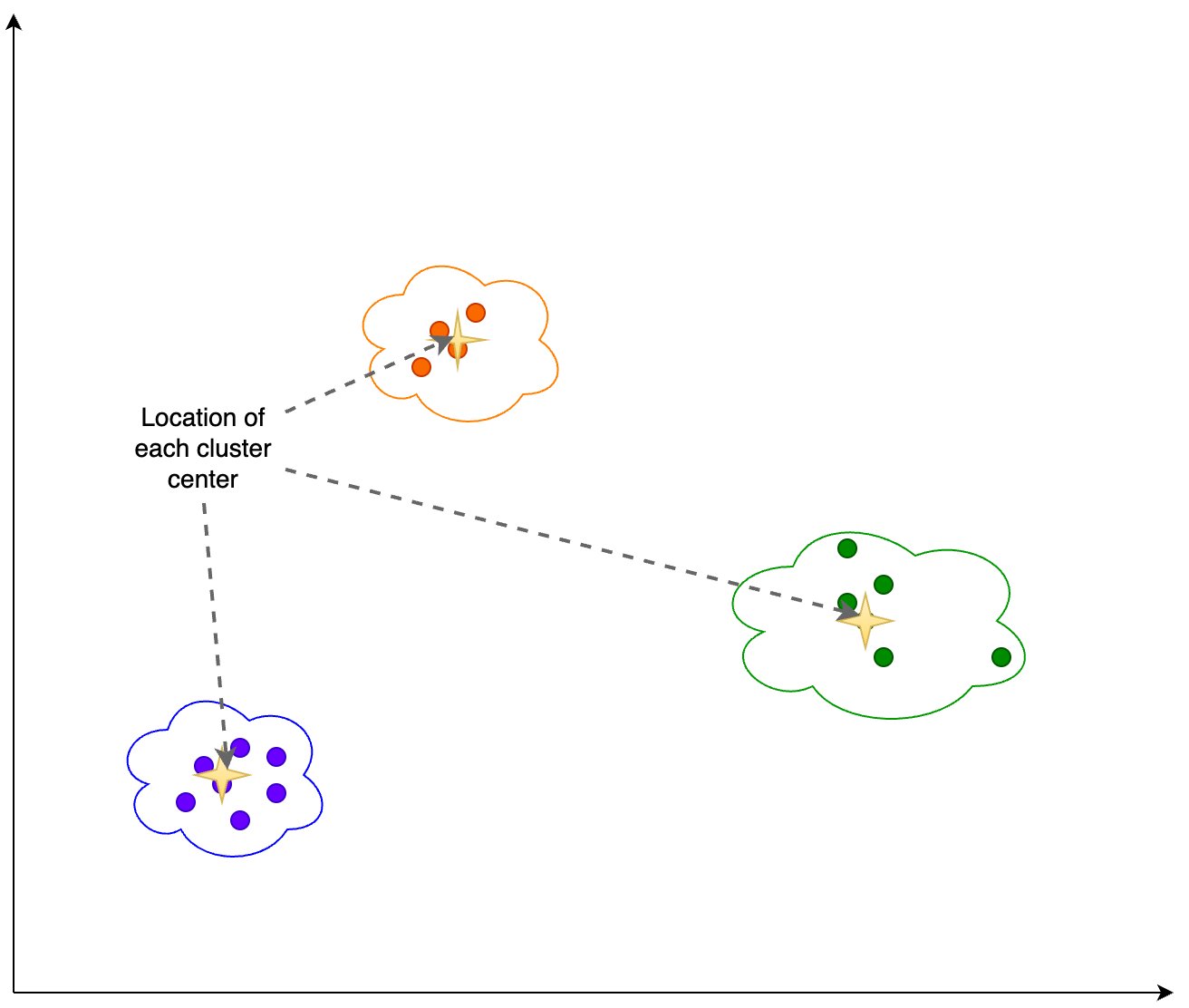

Poleg tega si ogledamo delež (višji ali nižji) vzorcev v vsaki skupini, kot je prikazano na naslednji sliki.

Končno to analizo uporabimo za izračun naslednjega:

- Vztrajnost – Vztrajnost je vsota kvadratov razdalj do centroidov gruče, ki meri, kako dobro so bili podatki združeni v gruče z uporabo K-Means.

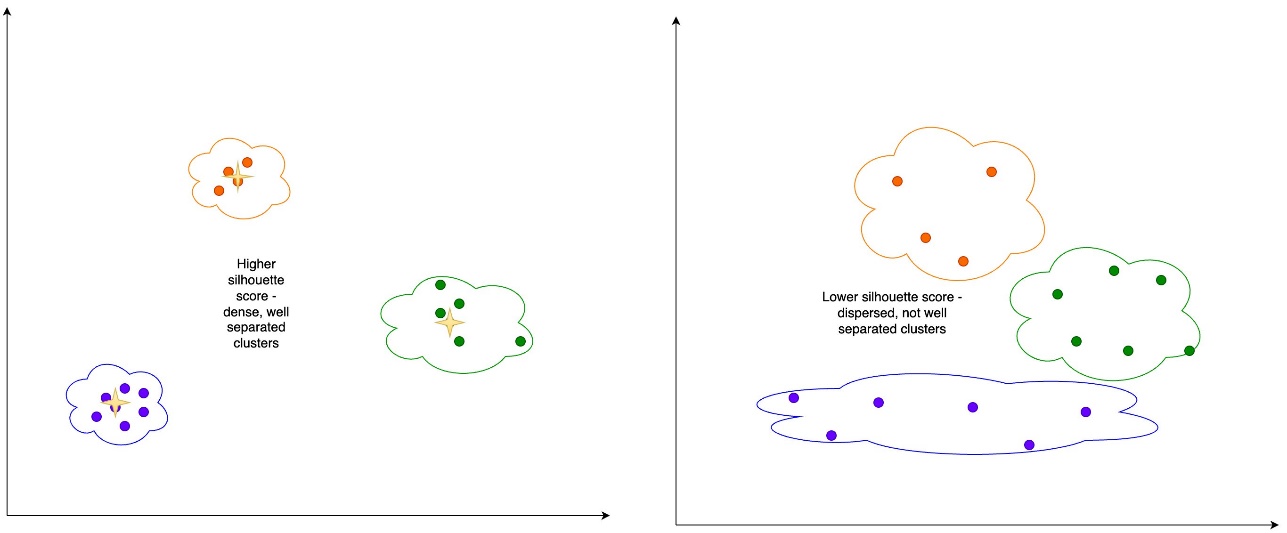

- Partitura silhuet – Ocena silhuete je merilo za potrjevanje konsistentnosti znotraj grozdov in se giblje od -1 do 1. Vrednost blizu 1 pomeni, da so točke v gruči blizu drugih točk v isti gruči in daleč od točke drugih grozdov. Vizualna predstavitev rezultata silhuete je vidna na naslednji sliki.

Te informacije lahko občasno zajamemo za posnetke vdelav tako za izvorne referenčne podatke kot za pozive. Zajem teh podatkov nam omogoča analizo morebitnih signalov odnašanja vdelave.

Zaznavanje odmika vdelave

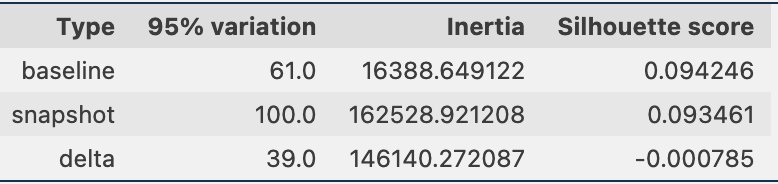

Občasno lahko primerjamo informacije o gručenju prek posnetkov podatkov, ki vključujejo vdelave referenčnih podatkov in takojšnje vdelave. Prvič, primerjamo lahko število dimenzij, ki so potrebne za razlago 95 % variacije v vdelanih podatkih, vztrajnosti in rezultatu silhuet iz posla združevanja v gruče. Kot lahko vidite v naslednji tabeli, najnovejši posnetek vdelav v primerjavi z izhodiščem zahteva 39 dodatnih dimenzij za razlago variance, kar kaže, da so naši podatki bolj razpršeni. Vztrajnost se je povečala, kar kaže, da so vzorci v agregatu dlje od svojih središč grozdov. Poleg tega se je rezultat silhuet znižal, kar kaže, da grozdi niso tako dobro definirani. Za hitre podatke lahko to pomeni, da vrste vprašanj, ki prihajajo v sistem, pokrivajo več tem.

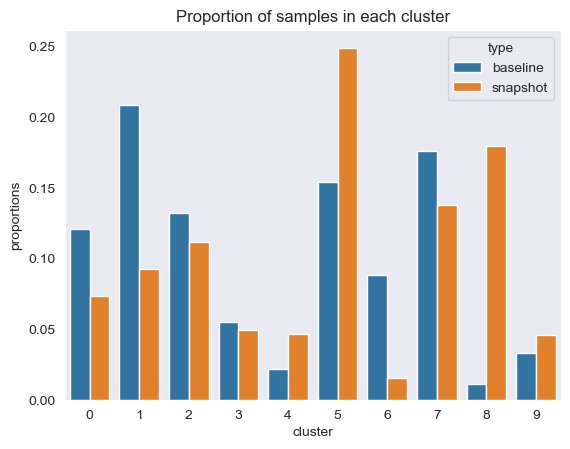

Nato lahko na naslednji sliki vidimo, kako se je delež vzorcev v vsaki skupini spreminjal skozi čas. To nam lahko pokaže, ali so naši novejši referenčni podatki na splošno podobni prejšnjemu nizu ali pokrivajo nova področja.

Končno lahko vidimo, ali se središča gruč premikajo, kar bi pokazalo premik informacij v gručah, kot je prikazano v naslednji tabeli.

Pokritost referenčnih podatkov za vhodna vprašanja

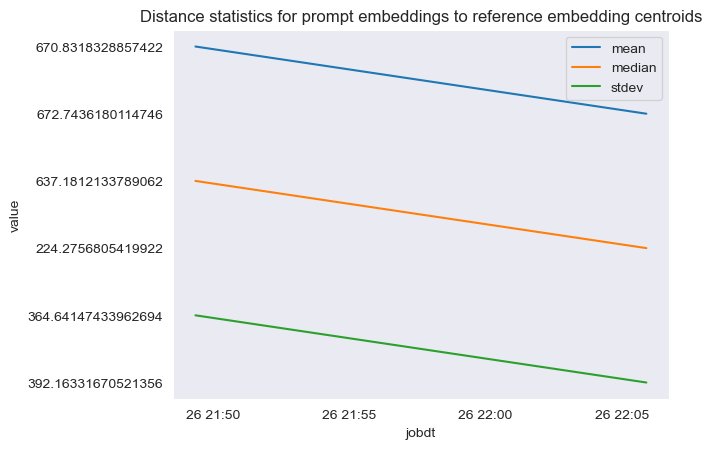

Prav tako lahko ocenimo, kako dobro se naši referenčni podatki ujemajo z vhodnimi vprašanji. Da bi to naredili, vsako vdelavo poziva dodelimo referenčni podatkovni gruči. Izračunamo razdaljo od vsakega poziva do njegovega ustreznega središča in pogledamo srednjo vrednost, mediano in standardni odklon teh razdalj. Te informacije lahko shranimo in vidimo, kako se spreminjajo skozi čas.

Naslednja slika prikazuje primer analize razdalje med takojšnjo vgradnjo in referenčnimi podatkovnimi centri skozi čas.

Kot lahko vidite, se povprečje, mediana in statistika razdalje standardnega odklona med takojšnjimi vdelavami in referenčnimi podatkovnimi centri zmanjšujejo med začetno osnovno linijo in zadnjim posnetkom. Čeprav je absolutno vrednost razdalje težko interpretirati, lahko uporabimo trende, da ugotovimo, ali se semantično prekrivanje med referenčnimi podatki in vhodnimi vprašanji sčasoma izboljšuje ali slabša.

Vzorčna prijava

Da bi zbrali eksperimentalne rezultate, obravnavane v prejšnjem razdelku, smo izdelali vzorčno aplikacijo, ki implementira vzorec RAG z uporabo modelov vdelave in generiranja, ki so nameščeni prek SageMaker JumpStart in gostujejo na Amazon SageMaker končne točke v realnem času.

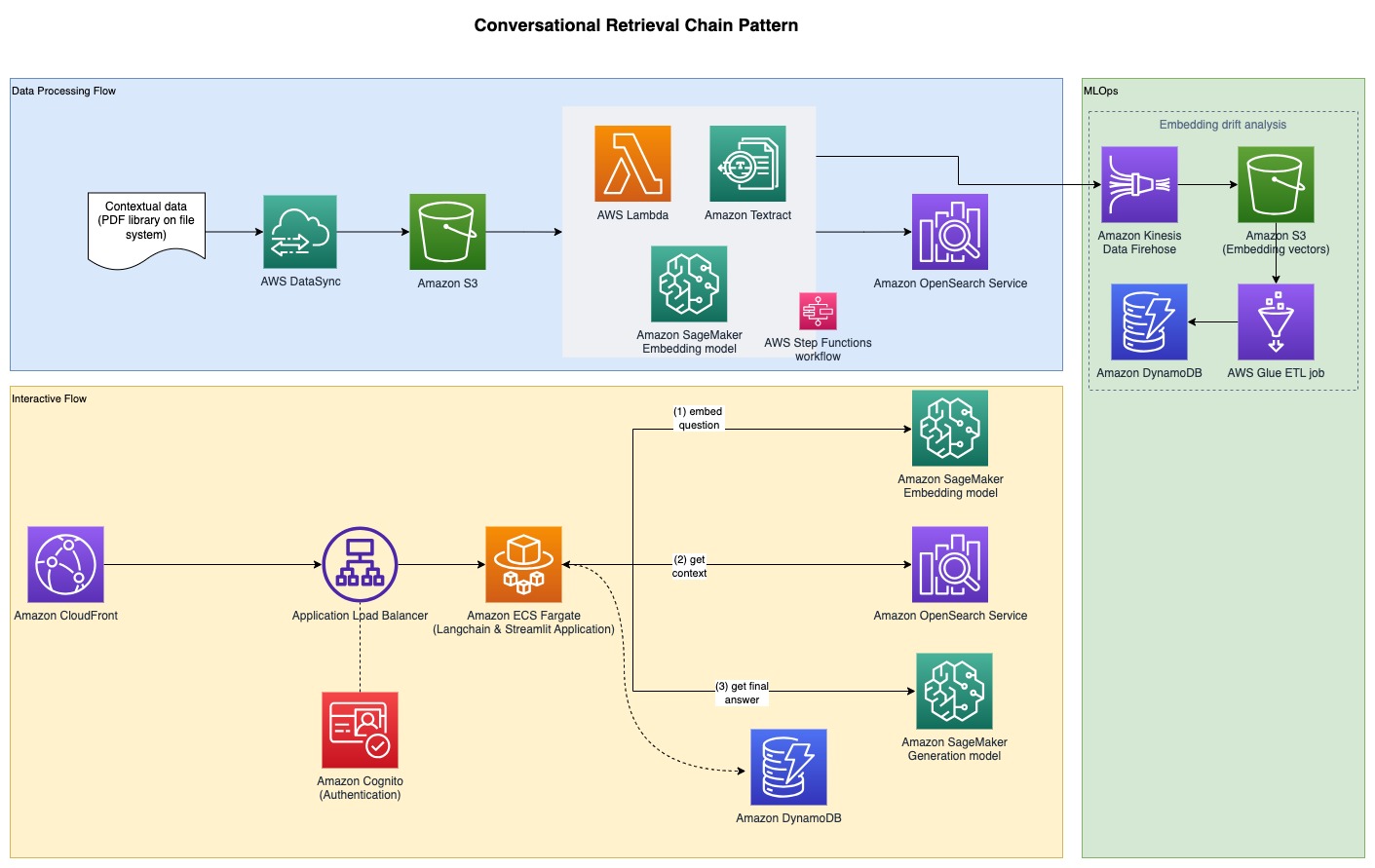

Aplikacija ima tri glavne komponente:

- Uporabljamo interaktivni tok, ki vključuje uporabniški vmesnik za zajem pozivov v kombinaciji s slojem orkestracije RAG z uporabo LangChaina.

- Tok obdelave podatkov izvleče podatke iz dokumentov PDF in ustvari vdelave, ki se shranijo v Storitev Amazon OpenSearch. Te uporabljamo tudi v končni komponenti aplikacije za analizo drifta vgradnje.

- Vdelave so zajete v Preprosta storitev shranjevanja Amazon (Amazon S3) prek Amazon Kinesis Data Firehose, in vodimo kombinacijo AWS lepilo opravila ekstrahiranja, preoblikovanja in nalaganja (ETL) in zvezke Jupyter za izvedbo analize vdelave.

Naslednji diagram ponazarja arhitekturo od konca do konca.

Celotna vzorčna koda je na voljo na GitHub. Priložena koda je na voljo v dveh različnih vzorcih:

- Primer aplikacije s polnim skladom s čelnim delom Streamlit – To zagotavlja aplikacijo od konca do konca, vključno z uporabniškim vmesnikom, ki uporablja Streamlit za zajem pozivov, v kombinaciji s plastjo orkestracije RAG, z uporabo LangChaina, ki deluje na Amazonska storitev za kontejnerje z elastiko (Amazon ECS) z AWS Fargate

- Zaledna aplikacija – Za tiste, ki ne želijo uvesti celotnega sklada aplikacij, se lahko izbirno odločite za uvedbo samo zaledja Komplet za razvoj oblaka AWS (AWS CDK) in nato uporabite priloženi prenosnik Jupyter za izvedbo orkestracije RAG z uporabo LangChain

Za ustvarjanje ponujenih vzorcev obstaja več predpogojev, ki so podrobno opisani v naslednjih razdelkih, začenši z uvedbo generativnih modelov in modelov za vdelavo besedila, nato pa do dodatnih predpogojev.

Razmestite modele prek SageMaker JumpStart

Oba vzorca predpostavljata uporabo modela vdelave in generativnega modela. Za to boste uvedli dva modela iz SageMaker JumpStart. Prvi model, GPT-J 6B, se uporablja kot model za vdelavo, drugi model, Falcon-40b, pa se uporablja za generiranje besedila.

Vsakega od teh modelov lahko uvedete prek SageMaker JumpStart iz Konzola za upravljanje AWS, Amazon SageMaker Studio, ali programsko. Za več informacij glejte Kako uporabljati modele temeljev JumpStart. Za poenostavitev uvajanja lahko uporabite priložen zvezek izpeljano iz zvezkov, ki jih samodejno ustvari SageMaker JumpStart. Ta prenosni računalnik črpa modele iz središča SageMaker JumpStart ML in jih razmesti v dve ločeni končni točki SageMaker v realnem času.

Vzorčni zvezek ima tudi razdelek za čiščenje. Tega razdelka še ne zaženite, ker bo izbrisal pravkar nameščene končne točke. Čiščenje boste dokončali na koncu vodstva.

Ko potrdite uspešno uvedbo končnih točk, ste pripravljeni na uvedbo celotne vzorčne aplikacije. Če pa vas bolj zanima samo raziskovanje zalednih in analitičnih zvezkov, lahko izbirno uvedete samo to, kar je zajeto v naslednjem razdelku.

1. možnost: Razmestite samo zaledno aplikacijo

Ta vzorec vam omogoča samo uvedbo zaledne rešitve in interakcijo z rešitvijo z uporabo prenosnega računalnika Jupyter. Uporabite ta vzorec, če ne želite zgraditi celotnega sprednjega vmesnika.

Predpogoji

Morali bi imeti naslednje predpogoje:

- Razmeščena končna točka modela SageMaker JumpStart – Razmestite modele v končne točke SageMaker v realnem času z uporabo SageMaker JumpStart, kot je bilo opisano prej

- Parametri uvajanja – Zabeležite naslednje:

- Besedilo ime končne točke modela – Ime končne točke modela generiranja besedila, razporejenega s SageMaker JumpStart

- Ime končne točke modela vdelav – Ime končne točke modela vdelave, uvedenega s SageMaker JumpStart

Razmestite vire z uporabo AWS CDK

Za uvedbo sklada AWS CDK uporabite parametre uvajanja, navedene v prejšnjem razdelku. Za več informacij o namestitvi AWS CDK glejte Začetek uporabe AWS CDK.

Prepričajte se, da je Docker nameščen in deluje na delovni postaji, ki bo uporabljena za uvajanje AWS CDK. Nanašati se na Pridobite Docker za dodatna navodila.

Druga možnost je, da vnesete kontekstne vrednosti v datoteko, imenovano cdk.context.json v pattern1-rag/cdk imenik in zaženite cdk deploy BackendStack --exclusively.

Razmestitev bo natisnila izhode, od katerih bodo nekateri potrebni za delovanje prenosnega računalnika. Preden lahko začnete spraševati in odgovarjati, vdelajte referenčne dokumente, kot je prikazano v naslednjem razdelku.

Vdelajte referenčne dokumente

Pri tem pristopu RAG so referenčni dokumenti najprej vdelani z modelom za vdelavo besedila in shranjeni v vektorski bazi podatkov. V tej rešitvi je bil zgrajen cevovod za vnos, ki sprejema dokumente PDF.

An Amazonski elastični računalniški oblak (Amazon EC2) primerek je bil ustvarjen za vnos dokumenta PDF in an Elastični datotečni sistem Amazon (Amazon EFS) datotečni sistem je nameščen na primerku EC2 za shranjevanje dokumentov PDF. An AWS DataSync Naloga se izvaja vsako uro, da pridobi dokumente PDF, najdene na poti datotečnega sistema EFS, in jih naloži v vedro S3, da se začne postopek vdelave besedila. Ta postopek vdela referenčne dokumente in shrani vdelave v storitvi OpenSearch. Prav tako shrani arhiv vdelave v vedro S3 prek Kinesis Data Firehose za poznejšo analizo.

Če želite zaužiti referenčne dokumente, izvedite naslednje korake:

- Pridobite vzorčni ID primerka EC2, ki je bil ustvarjen (glejte izhod AWS CDK

JumpHostId) in se povežite z Upravljalec zvez, zmožnost Upravitelj sistemov AWS. Za navodila glejte Povežite se s svojim primerkom Linuxa z upraviteljem sej AWS Systems Manager. - Pojdite v imenik

/mnt/efs/fs1, kjer je nameščen datotečni sistem EFS, in ustvarite mapo z imenomingest: - Dodajte svoje referenčne dokumente PDF v

ingestimenik.

Naloga DataSync je konfigurirana za nalaganje vseh datotek, najdenih v tem imeniku, v Amazon S3 za začetek postopka vdelave.

Naloga DataSync se izvaja po urnem urniku; po želji lahko nalogo zaženete ročno, da takoj začnete postopek vdelave za dokumente PDF, ki ste jih dodali.

- Če želite začeti opravilo, poiščite ID opravila v izhodu AWS CDK

DataSyncTaskIDin začeti nalogo s privzetimi vrednostmi.

Ko so vdelave ustvarjene, lahko začnete z vprašanjem RAG in odgovarjanjem v Jupyterjevem zvezku, kot je prikazano v naslednjem razdelku.

Vprašanje in odgovarjanje z uporabo zvezka Jupyter

Izvedite naslednje korake:

- Pridobite ime primerka prenosnika SageMaker iz izhoda AWS CDK

NotebookInstanceNamein se povežite z JupyterLab s konzole SageMaker. - Pojdite v imenik

fmops/full-stack/pattern1-rag/notebooks/. - Odprite in zaženite zvezek

query-llm.ipynbv primerku zvezka za izvajanje vprašanj in odgovarjanja z uporabo RAG.

Ne pozabite uporabiti conda_python3 jedro za prenosni računalnik.

Ta vzorec je uporaben za raziskovanje zaledne rešitve, ne da bi bilo treba zagotoviti dodatne predpogoje, ki so potrebni za aplikacijo s polnim skladom. Naslednji razdelek pokriva implementacijo aplikacije s polnim skladom, vključno s sprednjimi in zalednimi komponentami, da se zagotovi uporabniški vmesnik za interakcijo z vašo generativno aplikacijo AI.

2. možnost: Razmestite vzorčno aplikacijo s polnim skladom s čelnim vmesnikom Streamlit

Ta vzorec vam omogoča uvedbo rešitve z uporabniškim čelnim vmesnikom za vprašanja in odgovore.

Predpogoji

Za uvedbo vzorčne aplikacije morate imeti naslednje predpogoje:

- Končna točka modela SageMaker JumpStart je nameščena – Razmestite modele v vaše končne točke SageMaker v realnem času z uporabo SageMaker JumpStart, kot je opisano v prejšnjem razdelku, z uporabo priloženih zvezkov.

- Območje gostovanja Amazon Route 53 - Ustvari Amazonska pot 53 javno gostujoče območje uporabiti za to rešitev. Uporabite lahko tudi obstoječe javno gostujoče območje Route 53, kot je npr

example.com. - Certifikat upravitelja potrdil AWS – Določba an Upravitelj potrdil AWS (ACM) TLS potrdilo za ime domene območja gostovanja Route 53 in njegove veljavne poddomene, kot je npr.

example.comin*.example.comza vse poddomene. Za navodila glejte Zahteva za javno potrdilo. To potrdilo se uporablja za konfiguracijo HTTPS Amazon CloudFront in izvorni izravnalnik obremenitve. - Parametri uvajanja – Zabeležite naslednje:

- Ime domene po meri aplikacije frontend – Ime domene po meri, ki se uporablja za dostop do čelne vzorčne aplikacije. Navedeno ime domene se uporablja za ustvarjanje zapisa DNS Route 53, ki kaže na frontend distribucijo CloudFront; na primer,

app.example.com. - Ime domene po meri izvora izravnalnika obremenitve – Ime domene po meri, ki se uporablja za izvor distribucijskega izravnalnika obremenitve CloudFront. Navedeno ime domene se uporablja za ustvarjanje zapisa DNS Route 53, ki kaže na izvorni izravnalnik obremenitve; na primer,

app-lb.example.com. - ID območja, ki ga gosti Route 53 – ID območja, ki ga gosti Route 53 za gostovanje navedenih imen domen po meri; na primer,

ZXXXXXXXXYYYYYYYYY. - Ime območja gostovanja Route 53 – Ime gostujoče cone Route 53 za gostovanje navedenih domenskih imen po meri; na primer,

example.com. - ACM potrdilo ARN – ARN potrdila ACM, ki bo uporabljen z zagotovljeno domeno po meri.

- Besedilo ime končne točke modela – Ime končne točke modela generiranja besedila, razporejenega s SageMaker JumpStart.

- Ime končne točke modela vdelav – Ime končne točke modela vdelave, uvedenega s SageMaker JumpStart.

- Ime domene po meri aplikacije frontend – Ime domene po meri, ki se uporablja za dostop do čelne vzorčne aplikacije. Navedeno ime domene se uporablja za ustvarjanje zapisa DNS Route 53, ki kaže na frontend distribucijo CloudFront; na primer,

Razmestite vire z uporabo AWS CDK

Za uvedbo sklada AWS CDK uporabite parametre uvajanja, ki ste jih zabeležili v predpogojih. Za več informacij glejte Začetek uporabe AWS CDK.

Prepričajte se, da je Docker nameščen in deluje na delovni postaji, ki bo uporabljena za uvedbo AWS CDK.

V prejšnji kodi -c predstavlja kontekstno vrednost v obliki zahtevanih predpogojev, ki so zagotovljeni ob vnosu. Druga možnost je, da vnesete kontekstne vrednosti v datoteko, imenovano cdk.context.json v pattern1-rag/cdk imenik in zaženite cdk deploy --all.

Upoštevajte, da v datoteki določimo regijo bin/cdk.ts. Konfiguriranje dnevnikov dostopa do ALB zahteva določeno regijo. To regijo lahko spremenite pred uvedbo.

Uvedba bo natisnila URL za dostop do aplikacije Streamlit. Preden lahko začnete spraševati in odgovarjati, morate vdelati referenčne dokumente, kot je prikazano v naslednjem razdelku.

Vdelajte referenčne dokumente

Pri pristopu RAG so referenčni dokumenti najprej vdelani z modelom za vdelavo besedila in shranjeni v vektorski bazi podatkov. V tej rešitvi je bil zgrajen cevovod za vnos, ki sprejema dokumente PDF.

Kot smo razpravljali v prvi možnosti uvedbe, je bil ustvarjen primer primerka EC2 za vnos dokumenta PDF in datotečni sistem EFS je nameščen na primerek EC2 za shranjevanje dokumentov PDF. Naloga DataSync se zažene vsako uro, da pridobi dokumente PDF, najdene na poti datotečnega sistema EFS, in jih naloži v vedro S3, da se začne postopek vdelave besedila. Ta postopek vdela referenčne dokumente in shrani vdelave v storitvi OpenSearch. Prav tako shrani arhiv vdelave v vedro S3 prek Kinesis Data Firehose za poznejšo analizo.

Če želite zaužiti referenčne dokumente, izvedite naslednje korake:

- Pridobite vzorčni ID primerka EC2, ki je bil ustvarjen (glejte izhod AWS CDK

JumpHostId) in se povežite z upraviteljem sej. - Pojdite v imenik

/mnt/efs/fs1, kjer je nameščen datotečni sistem EFS, in ustvarite mapo z imenomingest: - Dodajte svoje referenčne dokumente PDF v

ingestimenik.

Naloga DataSync je konfigurirana za nalaganje vseh datotek, najdenih v tem imeniku, v Amazon S3 za začetek postopka vdelave.

Naloga DataSync se izvaja po urnem urniku. Po želji lahko nalogo zaženete ročno, da takoj začnete postopek vdelave za dokumente PDF, ki ste jih dodali.

- Če želite začeti opravilo, poiščite ID opravila v izhodu AWS CDK

DataSyncTaskIDin začeti nalogo s privzetimi vrednostmi.

Vprašanje in odgovor

Ko so referenčni dokumenti vdelani, lahko začnete z vprašanjem RAG in odgovarjanjem tako, da obiščete URL za dostop do aplikacije Streamlit. An Amazon Cognito se uporablja sloj za preverjanje pristnosti, zato je za prvi dostop do aplikacije potrebno ustvariti uporabniški račun v skupini uporabnikov Amazon Cognito, ki je nameščen prek AWS CDK (glejte izhod AWS CDK za ime skupine uporabnikov). Za navodila o ustvarjanju uporabnika Amazon Cognito glejte Ustvarjanje novega uporabnika v upravljalni konzoli AWS.

Vdelajte analizo premika

V tem razdelku vam pokažemo, kako izvedete analizo premika tako, da najprej ustvarite osnovno linijo vdelav referenčnih podatkov in takojšnjih vdelav, nato pa ustvarite posnetek vdelav skozi čas. To vam omogoča primerjavo osnovnih vdelav z vdelavami posnetkov.

Ustvarite osnovo za vdelavo za referenčne podatke in poziv

Če želite ustvariti osnovno črto vdelave referenčnih podatkov, odprite konzolo AWS Glue in izberite opravilo ETL embedding-drift-analysis. Nastavite parametre za opravilo ETL na naslednji način in zaženite opravilo:

- Kompleti

--job_typedoBASELINE. - Kompleti

--out_tablek Amazon DynamoDB tabela za referenčne podatke o vdelavi. (Oglejte si izhod AWS CDKDriftTableReferenceza ime tabele.) - Kompleti

--centroid_tablev tabelo DynamoDB za referenčne podatke težišča. (Oglejte si izhod AWS CDKCentroidTableReferenceza ime tabele.) - Kompleti

--data_pathna vedro S3 s predpono; na primer,s3:///embeddingarchive/. (Oglejte si izhod AWS CDKBucketNameza ime vedra.)

Podobno z uporabo ETL opravila embedding-drift-analysis, ustvarite osnovo za vdelavo pozivov. Nastavite parametre za opravilo ETL na naslednji način in zaženite opravilo:

- Kompleti

--job_typedoBASELINE - Kompleti

--out_tablev tabelo DynamoDB za hitro vdelavo podatkov. (Oglejte si izhod AWS CDKDriftTablePromptsNameza ime tabele.) - Kompleti

--centroid_tablev tabelo DynamoDB za takojšnje podatke o centroidu. (Oglejte si izhod AWS CDKCentroidTablePromptsza ime tabele.) - Kompleti

--data_pathna vedro S3 s predpono; na primer,s3:///promptarchive/. (Oglejte si izhod AWS CDKBucketNameza ime vedra.)

Ustvarite vdelani posnetek za referenčne podatke in poziv

Ko vnesete dodatne informacije v storitev OpenSearch, zaženite opravilo ETL embedding-drift-analysis ponovno za posnetek vdelav referenčnih podatkov. Parametri bodo enaki kot opravilo ETL, ki ste ga zagnali, da ustvarite osnovo za vdelavo referenčnih podatkov, kot je prikazano v prejšnjem razdelku, z izjemo nastavitve --job_type parameter v SNAPSHOT.

Podobno zaženite opravilo ETL, če želite narediti posnetek vdelav pozivov embedding-drift-analysis ponovno. Parametri bodo enaki kot opravilo ETL, ki ste ga zagnali, da ustvarite osnovo za vdelavo za pozive, kot je prikazano v prejšnjem razdelku, z izjemo nastavitve --job_type parameter v SNAPSHOT.

Primerjajte osnovno črto s posnetkom

Če želite primerjati osnovno linijo vdelave in posnetek za referenčne podatke in pozive, uporabite priloženi zvezek pattern1-rag/notebooks/drift-analysis.ipynb.

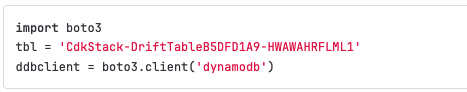

Če si želite ogledati primerjavo vdelave za referenčne podatke ali pozive, spremenite spremenljivke imena tabele DynamoDB (tbl in c_tbl) v zvezku v ustrezno tabelo DynamoDB za vsako izvedbo zvezka.

Spremenljivka zvezka tbl je treba spremeniti v ustrezno ime tabele odmika. Sledi primer, kje konfigurirati spremenljivko v zvezku.

Imena tabel je mogoče pridobiti na naslednji način:

- Za podatke o referenčni vdelavi pridobite ime tabele odmika iz izhoda AWS CDK

DriftTableReference - Za hitro vdelavo podatkov pridobite ime tabele odmika iz izhoda AWS CDK

DriftTablePromptsName

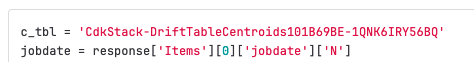

Poleg tega spremenljivka notebook c_tbl je treba spremeniti v ustrezno ime centroidne tabele. Sledi primer, kje konfigurirati spremenljivko v zvezku.

Imena tabel je mogoče pridobiti na naslednji način:

- Za podatke o referenčni vdelavi pridobite ime centroidne tabele iz izhoda AWS CDK

CentroidTableReference - Za hitro vdelavo podatkov pridobite ime centroidne tabele iz izhoda AWS CDK

CentroidTablePrompts

Analizirajte takojšnjo razdaljo od referenčnih podatkov

Najprej zaženite opravilo AWS Glue embedding-distance-analysis. To opravilo bo na podlagi ocene K-Means vdelav referenčnih podatkov ugotovilo, kateri gruči pripada vsak poziv. Nato izračuna srednjo vrednost, mediano in standardni odklon razdalje od vsakega poziva do središča ustrezne gruče.

Lahko zaženete zvezek pattern1-rag/notebooks/distance-analysis.ipynb da vidite trende meritev razdalje skozi čas. To vam bo dalo občutek splošnega trenda v porazdelitvi razdalj takojšnje vgradnje.

Zvezek pattern1-rag/notebooks/prompt-distance-outliers.ipynb je beležnica AWS Glue, ki išče izstopajoče vrednosti, kar vam lahko pomaga ugotoviti, ali prejemate več pozivov, ki niso povezani z referenčnimi podatki.

Spremljajte rezultate podobnosti

Vsi rezultati podobnosti iz storitve OpenSearch so prijavljeni amazoncloudwatch pod rag imenski prostor. Armaturna plošča RAG_Scores prikazuje povprečno oceno in skupno število zaužitih točk.

Čiščenje

Da se izognete prihodnjim stroškom, izbrišite vse vire, ki ste jih ustvarili.

Izbrišite nameščene modele SageMaker

Glejte razdelek o čiščenju v podan primer zvezka da izbrišete razporejene modele SageMaker JumpStart, lahko pa tudi izbrišite modele na konzoli SageMaker.

Izbrišite vire AWS CDK

Če ste svoje parametre vnesli v a cdk.context.json datoteko, očistite na naslednji način:

Če ste svoje parametre vnesli v ukazno vrstico in samo razmestili zaledno aplikacijo (zaledni sklad AWS CDK), počistite na naslednji način:

Če ste svoje parametre vnesli v ukazno vrstico in razmestili celotno rešitev (skladi CDK sprednjega in zadnjega dela AWS), počistite na naslednji način:

zaključek

V tej objavi smo zagotovili delujoč primer aplikacije, ki zajema vdelane vektorje za referenčne podatke in pozive v vzorcu RAG za generativni AI. Pokazali smo, kako izvesti analizo združevanja v gruče, da ugotovimo, ali se referenčni ali hitri podatki spreminjajo skozi čas, in kako dobro referenčni podatki pokrivajo vrste vprašanj, ki jih postavljajo uporabniki. Če zaznate odmik, lahko zagotovi signal, da se je okolje spremenilo in vaš model dobiva nove vnose, za katere morda ni optimiziran. To omogoča proaktivno vrednotenje trenutnega modela glede na spreminjajoče se vnose.

O avtorjih

Abdullahi Olaoye je višji arhitekt rešitev pri Amazon Web Services (AWS). Abdullahi ima magisterij iz računalniških omrežij z univerze Wichita State in je objavljen avtor, ki je imel vloge na različnih tehnoloških področjih, kot so DevOps, posodobitev infrastrukture in umetna inteligenca. Trenutno je osredotočen na Generative AI in ima ključno vlogo pri pomoči podjetjem pri arhitekturi in izgradnji vrhunskih rešitev, ki jih poganja Generative AI. Onkraj področja tehnologije najde veselje v umetnosti raziskovanja. Ko ne izdeluje rešitev AI, z družino rad potuje in raziskuje nove kraje.

Abdullahi Olaoye je višji arhitekt rešitev pri Amazon Web Services (AWS). Abdullahi ima magisterij iz računalniških omrežij z univerze Wichita State in je objavljen avtor, ki je imel vloge na različnih tehnoloških področjih, kot so DevOps, posodobitev infrastrukture in umetna inteligenca. Trenutno je osredotočen na Generative AI in ima ključno vlogo pri pomoči podjetjem pri arhitekturi in izgradnji vrhunskih rešitev, ki jih poganja Generative AI. Onkraj področja tehnologije najde veselje v umetnosti raziskovanja. Ko ne izdeluje rešitev AI, z družino rad potuje in raziskuje nove kraje.

Randy DeFauw je višji glavni arhitekt rešitev pri AWS. Ima MSEE z Univerze v Michiganu, kjer je delal na računalniškem vidu za avtonomna vozila. Ima tudi MBA z univerze Colorado State University. Randy je zasedal različne položaje v tehnološkem prostoru, od razvoja programske opreme do upravljanja izdelkov. V prostor velikih podatkov je vstopil leta 2013 in še naprej raziskuje to področje. Aktivno dela na projektih v prostoru ML in je predstavil na številnih konferencah, vključno s Strata in GlueCon.

Randy DeFauw je višji glavni arhitekt rešitev pri AWS. Ima MSEE z Univerze v Michiganu, kjer je delal na računalniškem vidu za avtonomna vozila. Ima tudi MBA z univerze Colorado State University. Randy je zasedal različne položaje v tehnološkem prostoru, od razvoja programske opreme do upravljanja izdelkov. V prostor velikih podatkov je vstopil leta 2013 in še naprej raziskuje to področje. Aktivno dela na projektih v prostoru ML in je predstavil na številnih konferencah, vključno s Strata in GlueCon.

Shelbee Eigenbrode je glavni arhitekt za rešitve strokovnjaka za umetno inteligenco in strojno učenje pri Amazon Web Services (AWS). V tehnologiji je že 24 let in obsega več panog, tehnologij in vlog. Trenutno se osredotoča na združevanje svojega znanja DevOps in ML v domeno MLOps, da bi strankam pomagala dostaviti in upravljati delovne obremenitve ML v velikem obsegu. Z več kot 35 patenti, podeljenimi na različnih tehnoloških področjih, ima strast do nenehnih inovacij in uporabe podatkov za spodbujanje poslovnih rezultatov. Shelbee je soustvarjalec in inštruktor specializacije Practical Data Science na Courseri. Je tudi sodirektorica Women In Big Data (WiBD), Denver Chapter. V prostem času se rada druži z družino, prijatelji in preaktivnimi psi.

Shelbee Eigenbrode je glavni arhitekt za rešitve strokovnjaka za umetno inteligenco in strojno učenje pri Amazon Web Services (AWS). V tehnologiji je že 24 let in obsega več panog, tehnologij in vlog. Trenutno se osredotoča na združevanje svojega znanja DevOps in ML v domeno MLOps, da bi strankam pomagala dostaviti in upravljati delovne obremenitve ML v velikem obsegu. Z več kot 35 patenti, podeljenimi na različnih tehnoloških področjih, ima strast do nenehnih inovacij in uporabe podatkov za spodbujanje poslovnih rezultatov. Shelbee je soustvarjalec in inštruktor specializacije Practical Data Science na Courseri. Je tudi sodirektorica Women In Big Data (WiBD), Denver Chapter. V prostem času se rada druži z družino, prijatelji in preaktivnimi psi.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/monitor-embedding-drift-for-llms-deployed-from-amazon-sagemaker-jumpstart/

- :ima

- : je

- :ne

- :kje

- $GOR

- 1

- 10

- 100

- 2013

- 24

- 35%

- 39

- 7

- 9

- 95%

- a

- Sposobna

- O meni

- absolutna

- dostop

- Račun

- ACM

- čez

- aktivno

- dodano

- Poleg tega

- Dodatne

- Dodatne informacije

- Poleg tega

- spet

- proti

- agregat

- AI

- Poravnava

- vsi

- Dovoli

- omogoča

- Prav tako

- Čeprav

- Amazon

- Amazon Cognito

- Amazon EC2

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amazonske spletne storitve (AWS)

- an

- Analiza

- analizirati

- analiziranje

- in

- odgovor

- odgovor

- karkoli

- primerno

- uporaba

- pristop

- primerno

- Arhitektura

- Arhiv

- SE

- OBMOČJE

- območja

- Umetnost

- članki

- AS

- vprašati

- sprašuje

- pomoč

- domnevati

- At

- povečanje

- Povečana

- Preverjanje pristnosti

- Avtor

- samodejno

- avtonomno

- avtonomna vozila

- Na voljo

- povprečno

- izogniti

- stran

- AWS

- AWS lepilo

- Backend

- ozadje

- gugalnica

- temeljijo

- Izhodišče

- BE

- ker

- bilo

- pred

- počutje

- pripada

- Boljše

- med

- Poleg

- Big

- Big Podatki

- Organi

- tako

- splošno

- izgradnjo

- zgrajena

- poslovni

- by

- izračun

- izračuna

- klic

- se imenuje

- CAN

- zmožnost

- zajemanje

- Zajeto

- ujame

- Zajemanje

- primeru

- CD

- center

- centri

- potrdilo

- spremenite

- spremenilo

- Spremembe

- spreminjanje

- Poglavje

- Stroški

- čip

- čokolada

- Izberite

- čiščenje

- Zapri

- bližje

- Cloud

- Grozd

- grozdenje

- Koda

- Colorado

- kombinacija

- kombinirani

- združevanje

- prihajajo

- kompaktna

- primerjate

- v primerjavi z letom

- Primerjava

- dokončanje

- komponenta

- deli

- Izračunajte

- računalnik

- Računalniška vizija

- koncepti

- konference

- konfigurirano

- konfiguriranje

- Connect

- premislekov

- Konzole

- Posoda

- vsebina

- ozadje

- se nadaljuje

- neprekinjeno

- pretvori

- piškotki

- Core

- Ustrezno

- pokritost

- zajeti

- kritje

- Ovitki

- ustvarjajo

- ustvaril

- ustvari

- Ustvarjanje

- Trenutna

- Trenutno

- po meri

- Stranke, ki so

- vrhunsko

- Armaturna plošča

- datum

- Centri podatki

- obdelava podatkov

- znanost o podatkih

- Baze podatkov

- privzeto

- opredeljen

- poda

- Denver

- razporedi

- razporejeni

- uvajanja

- uvajanje

- razpolaga

- Izpeljano

- uniči

- podrobno

- odkrivanje

- Odkrivanje

- Ugotovite,

- Razvoj

- odstopanje

- diagram

- drugačen

- težko

- Dimenzije

- dimenzije

- razpravljali

- razpršen

- razdalja

- oddaljeni

- distribucija

- dns

- do

- Lučki delavec

- dokument

- Dokumenti

- domena

- Ime domene

- IMENA DOMEN

- domen

- dont

- navzdol

- pogon

- vsak

- Embed

- vgrajeni

- vdelava

- konec

- konec koncev

- Končna točka

- Inženiring

- Vnesite

- vneseno

- podjetja

- okolje

- oceniti

- Ocena

- Tudi vsak

- Primer

- Primeri

- izjema

- obstoječih

- eksperimentalni

- Pojasnite

- raziskovanje

- raziskuje

- Raziskovati

- zunanja

- ekstrakt

- Izvlečki

- družina

- daleč

- Slika

- file

- datoteke

- končna

- končno

- Najdi

- najdbe

- prva

- plavajoči

- Pretok

- osredotočena

- osredotoča

- po

- sledi

- za

- obrazec

- je pokazala,

- Fundacija

- prijatelji

- iz

- začelje

- polno

- Prihodnost

- zbiranje

- splošno

- ustvarjajo

- generacija

- generativno

- Generativna AI

- dobili

- pridobivanje

- Daj

- Go

- več

- odobreno

- skupina

- Navodila

- ročaj

- Imajo

- he

- Hero

- pomoč

- jo

- več

- njegov

- drži

- gostitelj

- gostila

- uro

- Kako

- Kako

- Vendar

- HTML

- http

- HTTPS

- Hub

- ID

- identificirati

- if

- ponazarja

- takoj

- Izvajanje

- izvedbe

- Pomembno

- in

- vključujejo

- vključuje

- Vključno

- Dohodni

- Navedite

- industrij

- vztrajnost

- Podatki

- Infrastruktura

- začetna

- Inovacije

- vhod

- vhodi

- vpogled

- namestitev

- nameščen

- primer

- Navodila

- interakcijo

- medsebojno delovanje

- interaktivno

- zainteresirani

- vmesnik

- v

- IT

- ITS

- Job

- Delovna mesta

- veselje

- jpg

- samo

- Ključne

- Kinesis Data FireHose

- znanje

- jezik

- velika

- pozneje

- Zadnji

- plast

- UČITE

- učenje

- Lets

- Knjižnica

- všeč mi je

- vrstica

- linux

- LLM

- obremenitev

- kraj aktivnosti

- prijavljen

- Poglej

- POGLEDI

- nižje

- stroj

- strojno učenje

- Znamka

- upravljanje

- upravljanje

- upravitelj

- ročno

- Maj ..

- pomeni

- pomeni

- merjenje

- ukrepe

- Meritve

- Michigan

- morda

- ML

- MLOps

- Model

- modeli

- monitor

- več

- Najbolj

- premikanje

- več

- morajo

- Ime

- Imena

- naravna

- Obdelava Natural Language

- Nimate

- potrebna

- potrebujejo

- mreženje

- Novo

- novejši

- Naslednja

- nlp

- prenosnik

- opozoriti

- Številka

- številke

- številne

- of

- pogosto

- on

- samo

- odprite

- optimizirana

- Možnost

- or

- orkestracijo

- Da

- poreklo

- Ostalo

- naši

- ven

- rezultatov

- opisano

- izhod

- izhodi

- več

- Splošni

- prekrivajo

- lastne

- parameter

- parametri

- zlasti

- strast

- Patenti

- pot

- Vzorec

- vzorci

- Izvedite

- izvajati

- kosov

- plinovod

- Mesta

- platon

- Platonova podatkovna inteligenca

- PlatoData

- igra

- Točka

- točke

- bazen

- pozicije

- mogoče

- Prispevek

- potencial

- poganja

- Praktično

- pred

- predpogoji

- predstavljeni

- ohranjanje

- prejšnja

- prej

- , ravnateljica

- Tiskanje

- Proaktivna

- Postopek

- obravnavati

- Izdelek

- upravljanje izdelkov

- projekti

- pozove

- Delež

- zagotavljajo

- če

- zagotavlja

- zagotavljanje

- javnega

- objavljeno

- Potegne

- vprašanje

- vprašanja

- krpa

- območja

- obsegu

- pripravljen

- v realnem času

- kraljestvo

- Recept

- zapis

- zmanjša

- Zmanjšanje

- glejte

- reference

- okolica

- povezane

- relativno

- pomembno

- predstavljajo

- zastopanje

- predstavlja

- obvezna

- zahteva

- viri

- Odgovor

- Rezultati

- iskanje

- vloga

- vloge

- Pot

- Run

- tek

- deluje

- sagemaker

- Enako

- Shrani

- Lestvica

- urnik

- Znanost

- rezultat

- Iskalnik

- iskanja

- drugi

- Oddelek

- oddelki

- glej

- videl

- izberite

- pomensko

- višji

- Občutek

- poslan

- ločena

- Storitev

- Storitve

- Zasedanje

- nastavite

- nastavitev

- več

- je

- shouldnt

- Prikaži

- je pokazala,

- pokazale

- Razstave

- Signal

- signali

- Podoben

- Enostavno

- poenostavitev

- Velikosti

- Posnetek

- So

- Software

- inženiring programske opreme

- Rešitev

- rešitve

- nekaj

- vir

- Viri

- Vesolje

- napetost

- specialist

- določeno

- preživeti

- Na kvadrat

- sveženj

- Skladovnice

- standardna

- Začetek

- začel

- Začetek

- Država

- Statistika

- Koraki

- shranjevanje

- trgovina

- shranjeni

- uspešno

- taka

- Preverite

- sistem

- sistemi

- miza

- Bodite

- Naloga

- tehnika

- Tehnologije

- Tehnologija

- besedilo

- da

- O

- informacije

- Vir

- njihove

- Njih

- POTEM

- Tukaj.

- te

- ta

- tisti,

- 3

- skozi

- čas

- do

- skupaj

- Teme

- Skupaj za plačilo

- Transform

- Potovanje

- Trend

- Trends

- poskusite

- dva

- Vrste

- pod

- univerza

- URL

- us

- uporaba

- Rabljeni

- koristno

- uporabnik

- Uporabniški vmesnik

- Uporabniki

- uporabo

- potrjevanje

- vrednost

- Vrednote

- spremenljivka

- raznolikost

- različnih

- Vozila

- preko

- Vizija

- vizualna

- walkthrough

- želeli

- je

- način..

- we

- web

- spletne storitve

- Dobro

- kdaj

- ali

- ki

- medtem

- bo

- z

- v

- brez

- Ženske

- delo

- delal

- deluje

- delovno mesto

- slabše

- bi

- let

- še

- Vi

- Vaša rutina za

- zefirnet

- cona