Prevare na internetu lahko zdaj postanejo veliko bolj nevarne, zahvaljujoč goljufom, ki imajo neoviran dostop do ChatGPT, Techradar Poročila.

Široko priljubljen chatbot, ki ga poganja umetna inteligenca, ChatGPT, nenehno prihaja na naslovnice. S svojo zmožnostjo pisanja vsega, od odpravljanja napak kode iframe do zapletene kode za računalniško programiranje, je ChatGPT uveljavil AI kot tehnološko modno besedo leta.

Kljub veliki priljubljenosti in angažiranosti je ChatGPT povzročil pomisleke glede etike in predpisov.

Preberite tudi: Uporabniki ChatGPT 'Jailbreak' AI, sprostite Dan Alter Ego

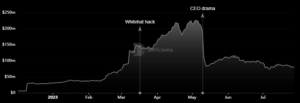

Nedavna poročilo ki so jih objavili raziskovalci kibernetske varnosti pri Norton Labs, so predstavili tri ključne načine, kako lahko akterji groženj zlorabijo ChatGPT. Poročilo navaja, da bi lahko ChatGPT zlorabili za učinkovitejše internetne prevare: z ustvarjanjem globoko ponarejene vsebine, ustvarjanjem lažnega predstavljanja in ustvarjanjem zlonamerne programske opreme.

»Norton Labs predvideva, da prevaranti opazujejo tudi zmogljivosti velikih jezikovnih modelov in preizkušajo načine za izboljšanje svojih kibernetskih zločinov, da bi bili bolj realistični in verodostojni,« je navedeno v poročilu.

Zmogljivost orodja za ustvarjanje »visokokakovostnih dezinformacij ali dezinformacij v velikem obsegu« bi lahko farmam botov pomagala pri učinkovitejšem povečevanju razdora. To bi lahko zlonamernim akterjem omogočilo, da brez truda "vzbudijo dvom in manipulirajo s pripovedmi v več jezikih", pravi Norton.

Zelo prepričljiva 'dezinformacija'

Pisanje poslovnih načrtov, strategij in opisov podjetij na prepričljiv način je za ChatGPT otročja igra. Vendar ta možnost povečuje tudi tveganje napačnih informacij, ki se lahko spremenijo v prevaro.

"Ne samo, da je vsebina, ki jo ustvari ChatGPT, včasih nenamerno napačna, ampak lahko slab igralec ta orodja uporabi tudi za namerno ustvarjanje vsebine, ki se uporablja za škodovanje ljudem na nek način," je navedeno v poročilu.

Njegova sposobnost ustvarjanja »visokokakovostnih dezinformacij ali dezinformacij v velikem obsegu bi lahko povzročila nezaupanje in oblikovala pripovedi v različnih jezikih«.

Pisanje mnenj o izdelkih je postalo vse lažje s ChatGPT, ki mu ni mogoče slediti, ker ustvari posamezne odgovore z vsakič enakimi informacijami. Kljub svoji zmožnosti predstavlja izziv »odkrivanje lažnih ocen in slabih izdelkov«.

Skrb vzbujajoče je, da se orodje lahko uporablja tudi za ustrahovanje.

"Uporaba teh orodij v kampanjah nadlegovanja na družbenih medijih za utišanje ali ustrahovanje ljudi je prav tako možen rezultat, ki bi imel srhljiv učinek na govor," ugotavlja poročilo.

ChatGPT v lažnih kampanjah

ChatGPT je še posebej dober pri ustvarjanju človeško zvenečega besedila v različnih jezikih, pri čemer bralci ne vedo, ali je besedilo ustvaril AI ali človek. Tudi OpenAI, razvijalec ChatGPT, ne more ugotoviti, ali je besedilo napisal umetna inteligenca, in trdi, da "je nemogoče zanesljivo zaznati vse besedilo, napisano z umetno inteligenco."

Možnost uporabe ChatGPT v lažnih kampanjah je realna.

»Zlonamerni akterji lahko uporabijo ChatGPT za ustvarjanje lažnih e-poštnih sporočil ali objav v družabnih medijih, za katere se zdi, da izvirajo iz zakonitih virov, zaradi česar je težje odkriti tovrstne grožnje in se braniti pred njimi,« je navedeno v poročilu.

Ker se njegova priljubljenost povečuje, je verjetna posledica povečanje števila »lažnega predstavljanja in njihove prefinjenosti«.

Poročilo predlaga, da "lahko zlonamerni akterji ChatGPT nahranijo z resničnimi primeri nezlonamernih sporočil podjetij, za katera se želijo predstavljati, in umetni inteligenci naročijo, naj ustvari nova na podlagi istega sloga z zlonamernimi nameni."

Takšne kampanje bi se lahko izkazale za zelo uspešne pri zavajanju posameznikov v razkritje osebnih podatkov ali pošiljanje denarja kriminalnim subjektom. Norton Labs je potrošnikom svetoval, naj bodo previdni pri "klikanju na povezave ali posredovanju osebnih podatkov".

ChatGPT lahko ustvari zlonamerno programsko opremo

Ustvarjanje kode in prilagajanje različnih programskih jezikov je preprosto sestavni del storitev ChatGPT. Zato ni čudno, da ga goljufi uporabljajo za ustvarjanje zlonamerne programske opreme.

"S pravim pozivom lahko začetniki avtorji zlonamerne programske opreme opišejo, kaj želijo narediti, in dobijo delujoče delčke kode," je navedeno v poročilu. To predstavlja resno grožnjo napadov zlonamerne programske opreme, ki so dovolj napredni, da povzročijo opustošenje.

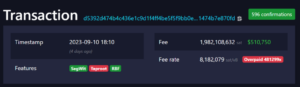

"Eden od primerov je ustvarjanje kode za zaznavanje, kdaj je naslov denarnice bitcoin kopiran v odložišče, tako da ga je mogoče nadomestiti z zlonamernim naslovom, ki ga nadzira avtor zlonamerne programske opreme," je pojasnjeno v poročilu.

Posledično bo razpoložljivost takšnega chatbota povzročila povečanje prefinjenosti zlonamerne programske opreme.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- Platoblockchain. Web3 Metaverse Intelligence. Razširjeno znanje. Dostopite tukaj.

- vir: https://metanews.com/chatgpt-is-being-used-to-make-quality-scams/

- : je

- 7

- 8

- a

- sposobnost

- Sposobna

- O meni

- zloraba

- dostop

- Po

- akterji

- Naslov

- napredno

- proti

- AI

- Z AI napajanjem

- Pomoč

- vsi

- in

- predvidevanje

- zdi

- SE

- AS

- At

- Napadi

- Avtor

- Avtorji

- razpoložljivost

- Slab

- temeljijo

- BE

- ker

- postanejo

- počutje

- Bitcoin

- Bitcoin denarnica

- Bot

- ustrahovanje

- poslovni

- by

- Kampanje

- CAN

- ne more

- Zmogljivosti

- kapaciteta

- Vzrok

- previden

- izziv

- chatbot

- ChatGPT

- Koda

- Podjetja

- podjetje

- kompleksna

- računalnik

- Skrbi

- Potrošniki

- vsebina

- Ustvarjanje vsebine

- stalno

- nadzorom

- bi

- obrti

- ustvarjajo

- Oblikovanje

- kazenska

- Cybersecurity

- Nevarno

- opisati

- Razvojni

- drugačen

- težko

- Razkritje

- neskladje

- dezinformacija

- dvomim

- vsak

- učinek

- Učinkovito

- učinkovito

- e-pošta

- omogočajo

- sodelovanje

- subjekti

- ustanovljena

- etika

- Tudi

- vse

- Primer

- Primeri

- razložiti

- ponaredek

- Kmetije

- za

- goljufi

- iz

- ustvarjajo

- ustvarila

- ustvarja

- ustvarjajo

- generacija

- dobili

- dobro

- Imajo

- ob

- Naslovi

- zelo

- Vendar

- HTTPS

- velika

- človeškega

- identificirati

- nemogoče

- in

- Povečajte

- Poveča

- vedno

- naveden

- individualna

- posamezniki

- Podatki

- namen

- namerno

- Internet

- IT

- ITS

- Ključne

- Labs

- jezik

- jeziki

- velika

- vodi

- življenje

- Povezave

- malo

- Sklop

- Znamka

- Izdelava

- zlonamerna programska oprema

- max širine

- mediji

- sporočil

- morda

- Dezinformacije

- Nezaupanje

- modeli

- Denar

- več

- več

- narative

- Novo

- Opombe

- Novice

- Številka

- of

- on

- ONE

- OpenAI

- Da

- Rezultat

- del

- zlasti

- ljudje

- Osebni

- Ribarjenje

- načrti

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Predvajaj

- Igraj za

- Popular

- Priljubljenost

- pozira

- mogoče

- Prispevkov

- potencial

- proizvodnjo

- Proizvedeno

- Izdelki

- Programiranje

- programskih jezikov

- možnosti

- Dokaži

- če

- zagotavljanje

- objavljeno

- Preberi

- bralci

- pravo

- resnično življenje

- realistična

- nedavno

- Uredba

- nadomesti

- poročilo

- raziskovalci

- povzroči

- Mnenja

- tveganja

- Enako

- Lestvica

- Prevara

- Scammers

- prevare

- pošiljanja

- resno

- Storitve

- Oblikujte

- Tišina

- preprosto

- So

- socialna

- družbeni mediji

- Objave v družabnih medijih

- nekaj

- Viri

- govor

- Zloben

- navedla

- strategije

- slog

- uspešno

- taka

- tech

- Testiranje

- Hvala

- da

- O

- njihove

- Njih

- te

- Grožnja

- akterji groženj

- grožnje

- 3

- skozi

- čas

- do

- orodje

- orodja

- OBRAT

- Vrste

- sprostiti

- uporaba

- Uporabniki

- denarnica

- način..

- načini

- Kaj

- ali

- ki

- pogosto

- bo

- z

- deluje

- bi

- pisati

- pisni

- zefirnet