To je gostujoča objava, ki je bila napisana skupaj z Metino ekipo PyTorch in je nadaljevanje Del 1 te serije, kjer prikazujemo zmogljivost in enostavnost izvajanja PyTorch 2.0 na AWS.

Raziskava strojnega učenja (ML) je dokazala, da veliki jezikovni modeli (LLM), usposobljeni s precej velikimi nabori podatkov, povzročijo boljšo kakovost modela. V zadnjih nekaj letih se je velikost modelov trenutne generacije znatno povečala in zahtevajo sodobna orodja in infrastrukturo za učinkovito in obsežno usposabljanje. PyTorch Distributed Data Parallelism (DDP) pomaga pri obdelavi podatkov v velikem obsegu na preprost in robusten način, vendar zahteva, da se model prilega eni GPE. Knjižnica PyTorch Fully Sharded Data Parallel (FSDP) premaga to oviro tako, da omogoči razdeljevanje modelov za usposabljanje velikih modelov med vzporednimi delavci podatkov.

Usposabljanje porazdeljenega modela zahteva gručo delovnih vozlišč, ki se lahko spreminjajo. Amazonski elastični kubernetes storitev (Amazon EKS) je priljubljena storitev, skladna s sistemom Kubernetes, ki močno poenostavi postopek izvajanja delovnih obremenitev AI/ML, zaradi česar je bolj obvladljiv in manj zamuden.

V tej objavi v spletnem dnevniku AWS sodeluje z Metino ekipo PyTorch, da bi razpravljali o tem, kako uporabiti knjižnico PyTorch FSDP za doseganje linearnega skaliranja modelov globokega učenja na AWS brez težav z uporabo Amazon EKS in AWS posode za globoko učenje (DLC-ji). To prikazujemo s postopnim izvajanjem usposabljanja modelov 7B, 13B in 70B Llama2 z uporabo Amazon EKS s 16 Amazonski elastični računalniški oblak (Amazon EC2) p4de.24xlarge primerki (vsak z 8 grafičnimi procesorji NVIDIA A100 Tensor Core in vsak grafični procesor z 80 GB pomnilnika HBM2e) ali 16 EC2 p5.48 večji primerki (vsaka z 8 grafičnimi procesorji NVIDIA H100 Tensor Core in vsaka grafična enota z 80 GB pomnilnika HBM3), dosegajo skoraj linearno skaliranje prepustnosti in na koncu omogočajo hitrejši čas usposabljanja.

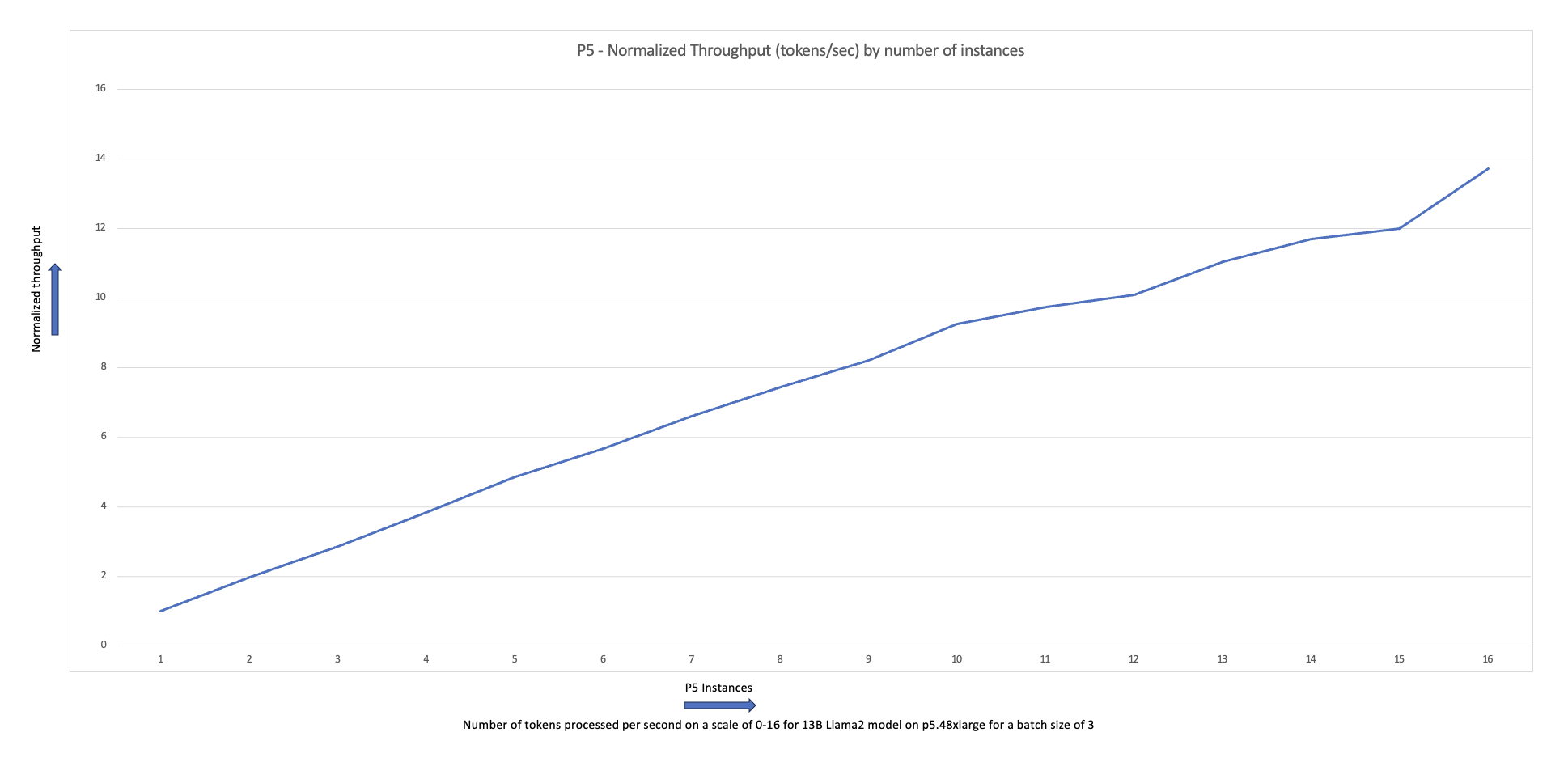

Naslednji grafikon skaliranja kaže, da primerki p5.48xlarge ponujajo 87-odstotno učinkovitost skaliranja s fino nastavitvijo FSDP Llama2 v konfiguraciji gruče s 16 vozlišči.

Izzivi usposabljanja LLM

Podjetja vedno pogosteje sprejemajo programe LLM za vrsto nalog, vključno z virtualnimi pomočniki, prevajanjem, ustvarjanjem vsebine in računalniškim vidom, da bi povečali učinkovitost in natančnost v različnih aplikacijah.

Vendar usposabljanje ali natančno prilagajanje teh velikih modelov za primer uporabe po meri zahteva veliko količino podatkov in računalniško moč, kar prispeva k splošni inženirski kompleksnosti sklada ML. To je tudi posledica omejenega pomnilnika, ki je na voljo na eni GPE, kar omejuje velikost modela, ki ga je mogoče učiti, in omejuje tudi velikost serije na GPE, uporabljeno med usposabljanjem.

Za reševanje tega izziva so bile uporabljene različne tehnike paralelizma modelov, kot je npr DeepSpeed ZeRO in PyTorch FSDP so bili ustvarjeni, da bi vam omogočili premagati to oviro omejenega pomnilnika GPU. To se naredi s sprejetjem vzporedne tehnike razdrobljenih podatkov, kjer ima vsak pospeševalnik samo rezino (a ostriž) replike modela namesto celotne replike modela, kar dramatično zmanjša pomnilniški odtis opravila usposabljanja.

Ta objava prikazuje, kako lahko uporabite PyTorch FSDP za natančno nastavitev modela Llama2 z uporabo Amazon EKS. To dosežemo s skaliranjem računske zmogljivosti in zmogljivosti GPE za izpolnjevanje zahtev modela.

Pregled FSDP

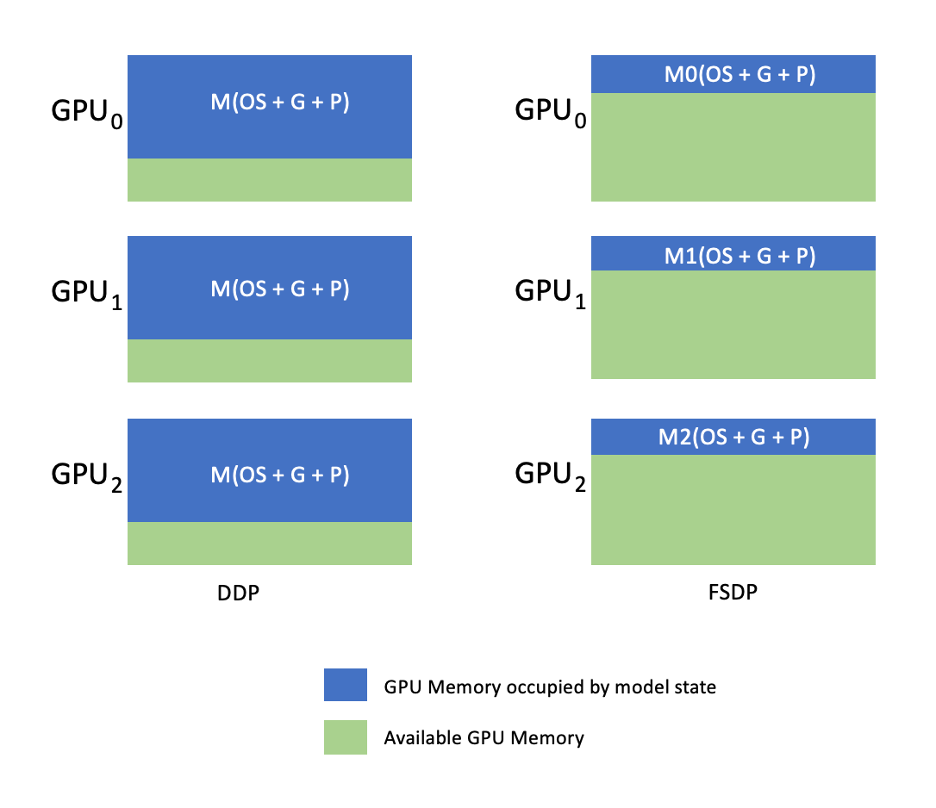

Pri usposabljanju PyTorch DDP je vsak GPE (imenovan a delavec v kontekstu PyTorch) vsebuje popolno kopijo modela, vključno z utežmi modela, prelivi in stanji optimizatorja. Vsak delavec obdela paket podatkov in na koncu povratnega prehoda uporabi an vse-zmanjšati delovanje za sinhronizacijo gradientov med različnimi delavci.

Imeti repliko modela na vsaki grafični procesorji omejuje velikost modela, ki ga je mogoče prilagoditi delovnemu toku DDP. FSDP pomaga premagati to omejitev z razdelitvijo parametrov modela, stanj optimizatorja in gradientov med vzporednimi delavci podatkov, hkrati pa ohranja preprostost paralelizma podatkov.

To je prikazano v naslednjem diagramu, kjer ima v primeru DDP vsak GPU popolno kopijo stanja modela, vključno s stanjem optimizatorja (OS), prelivi (G) in parametri (P): M(OS + G). + P). V FSDP ima vsaka GPU samo del stanja modela, vključno s stanjem optimizatorja (OS), prelivi (G) in parametri (P): M (OS + G + P). Rezultat uporabe FSDP je znatno manjši odtis pomnilnika GPE v primerjavi z DDP za vse delavce, kar omogoča usposabljanje zelo velikih modelov ali uporabo večjih velikosti paketov za usposabljanje.

To pa pride za ceno povečanih stroškov komunikacije, ki se zmanjšajo z optimizacijami FSDP, kot so prekrivanje komunikacijskih in računskih procesov s funkcijami, kot je predhodno pridobivanje. Za podrobnejše informacije glejte Kako začeti s popolnoma razdeljenimi vzporednimi podatki (FSDP).

FSDP ponuja različne parametre, ki vam omogočajo prilagajanje uspešnosti in učinkovitosti vaših izobraževalnih nalog. Nekatere ključne značilnosti in zmogljivosti FSDP vključujejo:

- Politika ovijanja transformatorjev

- Prilagodljiva mešana natančnost

- Aktivacijska kontrolna točka

- Različne strategije razčlenjevanja, ki ustrezajo različnim hitrostim omrežja in topologijam gruče:

- FULL_SHARD – Parametri modela Shard, gradienti in stanja optimizatorja

- HYBRID_SHARD – Celoten drobec znotraj vozlišča DDP čez vozlišča; podpira prilagodljivo skupino razdeljevanja za popolno repliko modela (HSDP)

- SHARD_GRAD_OP – Razdelite samo prelive in stanja optimizatorja

- NO_SHARD – Podobno kot DDP

Za več informacij o FSDP glejte Učinkovito usposabljanje velikega obsega s Pytorch FSDP in AWS.

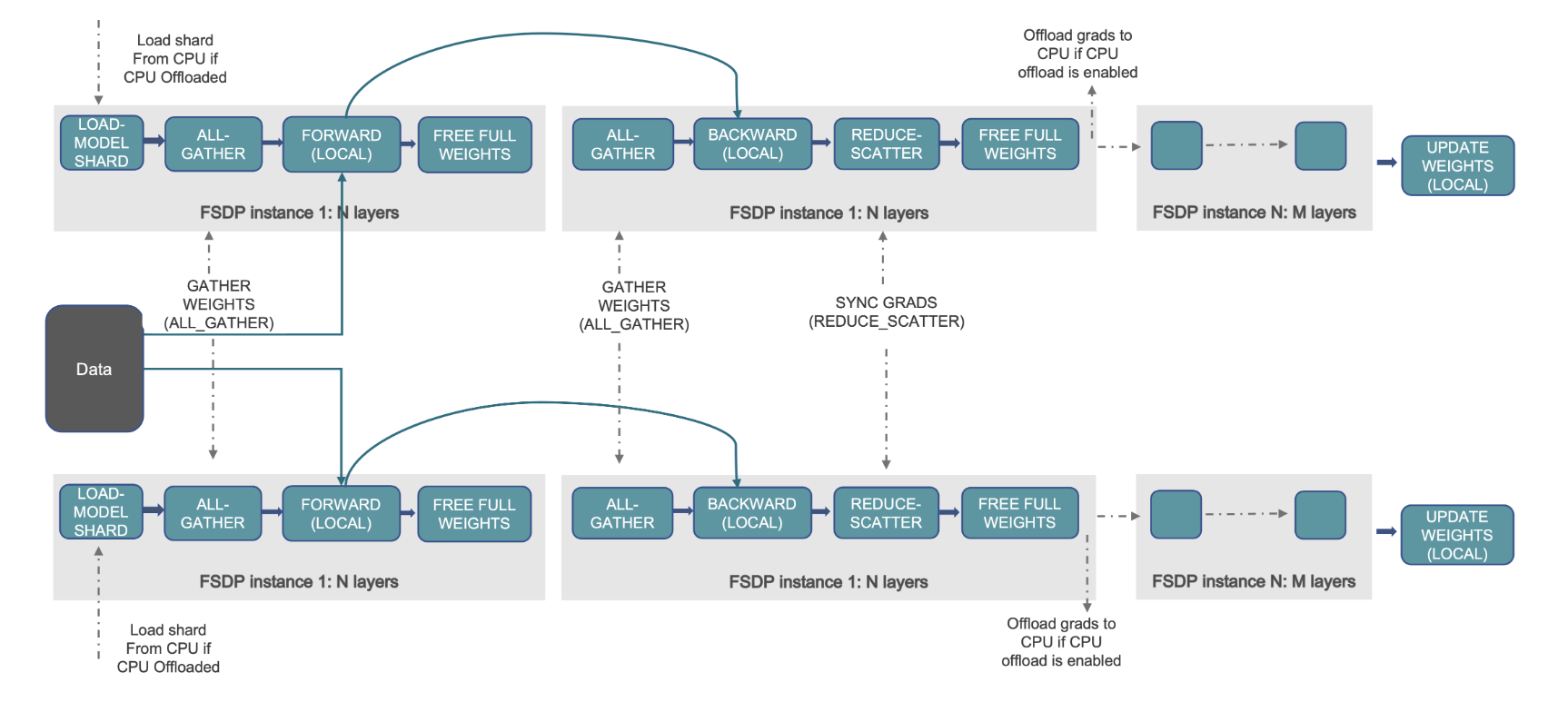

Naslednja slika prikazuje, kako FSDP deluje za dva podatkovna vzporedna procesa.

Pregled rešitev

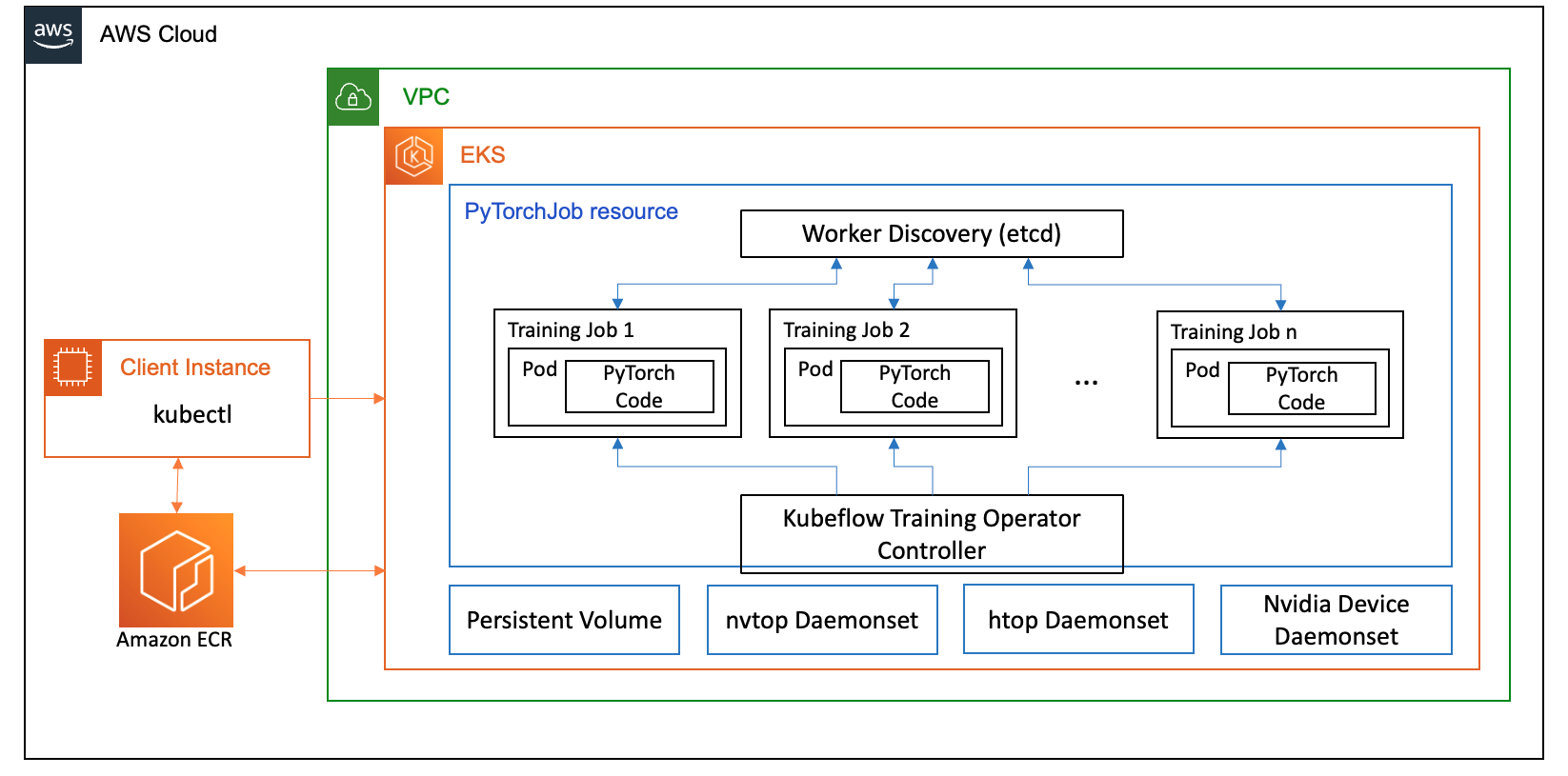

V tej objavi smo vzpostavili računalniško gručo z uporabo Amazon EKS, ki je upravljana storitev za zagon Kubernetesa v oblaku AWS in lokalnih podatkovnih centrih. Številne stranke sprejemajo Amazon EKS za izvajanje delovnih obremenitev AI/ML, ki temeljijo na Kubernetesu, pri čemer izkoriščajo njegovo zmogljivost, razširljivost, zanesljivost in razpoložljivost ter njegove integracije z omrežnimi, varnostnimi in drugimi storitvami AWS.

Za naš primer uporabe FSDP uporabljamo Operater za usposabljanje Kubeflow na Amazon EKS, ki je izvirni projekt Kubernetes, ki omogoča fino nastavitev in razširljivo porazdeljeno usposabljanje za modele ML. Podpira različna ogrodja ML, vključno s PyTorch, ki ga lahko uporabite za uvajanje in upravljanje izobraževalnih nalog PyTorch v velikem obsegu.

Z uporabo vira po meri PyTorchJob operaterja usposabljanja Kubeflow izvajamo opravila usposabljanja v Kubernetesu z nastavljivim številom replik delavcev, kar nam omogoča optimizacijo uporabe virov.

Sledi nekaj komponent operaterja za usposabljanje, ki igrajo vlogo v našem primeru uporabe natančne nastavitve Llama2:

- Centraliziran krmilnik Kubernetes, ki upravlja porazdeljena usposabljanja za PyTorch.

- PyTorchJob, vir Kubernetes po meri za PyTorch, ki ga zagotavlja operater usposabljanja Kubeflow, za definiranje in uvajanje opravil usposabljanja Llama2 v Kubernetes.

- etcd, ki je povezan z implementacijo mehanizma srečanja za usklajevanje porazdeljenega usposabljanja modelov PyTorch. to

etcdstrežnik kot del procesa srečanja omogoča koordinacijo in sinhronizacijo sodelujočih delavcev med porazdeljenim usposabljanjem.

Naslednji diagram prikazuje arhitekturo rešitev.

Večino podrobnosti bodo povzeli avtomatizacijski skripti, ki jih uporabljamo za izvajanje primera Llama2.

V tem primeru uporabe uporabljamo naslednje reference kode:

Kaj je Llama2?

Llama2 je LLM, predhodno usposobljen za 2 bilijona žetonov besedila in kode. Je eden največjih in najmočnejših LLM-jev, ki so danes na voljo. Llama2 lahko uporabljate za različne naloge, vključno z obdelavo naravnega jezika (NLP), ustvarjanjem besedila in prevajanjem. Za več informacij glejte Začetek z Llamo.

Llama2 je na voljo v treh različnih velikostih modelov:

- Lama2-70b – To je največji model Llama2 s 70 milijardami parametrov. Je najmočnejši model Llama2 in se lahko uporablja za najzahtevnejše naloge.

- Lama2-13b – To je srednje velik model Llama2 s 13 milijardami parametrov. Je dobro ravnovesje med zmogljivostjo in učinkovitostjo in se lahko uporablja za različne naloge.

- Lama2-7b – To je najmanjši model Llama2 s 7 milijardami parametrov. Je najučinkovitejši model Llama2 in se lahko uporablja za naloge, ki ne zahtevajo najvišje stopnje zmogljivosti.

Ta objava vam omogoča natančno nastavitev vseh teh modelov na Amazon EKS. Da bi zagotovili preprosto in ponovljivo izkušnjo ustvarjanja gruče EKS in izvajanja opravil FSDP na njej, uporabljamo aws-do-eks projekt. Primer bo deloval tudi z že obstoječo gručo EKS.

Skriptni vodnik je na voljo na GitHub za prvotno izkušnjo. V naslednjih razdelkih podrobneje razložimo postopek od konca do konca.

Zagotavljanje infrastrukture rešitve

Za poskuse, opisane v tej objavi, uporabljamo gruče z vozlišči p4de (A100 GPU) in p5 (H100 GPU).

Gruča z vozlišči p4de.24xlarge

Za našo gručo z vozlišči p4de uporabljamo naslednje eks-gpu-p4de-odcr.yaml skript:

Uporaba eksctl in prejšnji manifest gruče ustvarimo gručo z vozlišči p4de:

Gruča z velikimi vozlišči p5.48x

Predloga teraforme za gručo EKS z vozlišči P5 se nahaja spodaj GitHub repo.

Gručo lahko prilagodite prek spremenljivke.tf datoteko in jo nato ustvarite prek Terraform CLI:

Razpoložljivost gruče lahko preverite tako, da zaženete preprost ukaz kubectl:

Gruča je zdrava, če rezultat tega ukaza prikazuje pričakovano število vozlišč v stanju pripravljenosti.

Razmestite predpogoje

Za izvajanje FSDP na Amazon EKS uporabljamo PyTorchJob vir po meri. Zahteva itdd in Operater za usposabljanje Kubeflow kot predpogoje.

Namestite etcd z naslednjo kodo:

Razmestite Kubeflow Training Operator z naslednjo kodo:

Zgradite in potisnite sliko vsebnika FSDP v Amazon ECR

Uporabite naslednjo kodo za izdelavo slike vsebnika FSDP in jo potisnite Registar elastičnih zabojnikov Amazon (Amazon ECR):

Ustvarite manifest FSDP PyTorchJob

Vstavite Žeton objemnega obraza v naslednjem izrezku, preden ga zaženete:

Konfigurirajte svoj PyTorchJob z .env datoteko ali neposredno v spremenljivkah vašega okolja, kot je prikazano spodaj:

Ustvarite manifest PyTorchJob z uporabo predloga fsdp in generiraj.sh ali ga ustvarite neposredno s spodnjim skriptom:

Zaženite PyTorchJob

Zaženite PyTorchJob z naslednjo kodo:

Videli boste določeno število ustvarjenih delovnih sklopov FDSP in po vlečenju slike bodo prešli v stanje izvajanja.

Če si želite ogledati status PyTorchJob, uporabite to kodo:

Če želite ustaviti PyTorchJob, uporabite naslednjo kodo:

Ko je opravilo končano, ga je treba izbrisati, preden se začne nov zagon. Opazili smo tudi, da brisanjeetcdpod in pustite, da se znova zažene pred začetkom novega opravila, pomaga preprečiti a RendezvousClosedError.

Povečajte gručo

Ponovite lahko prejšnje korake ustvarjanja in izvajanja opravil, medtem ko spreminjate število in tip primerka delovnih vozlišč v gruči. To vam omogoča izdelavo skalirnih grafikonov, kot je prikazan prej. Na splošno bi morali opaziti zmanjšanje odtisa pomnilnika GPU, zmanjšanje časa epohe in povečanje prepustnosti, ko je v gručo dodanih več vozlišč. Prejšnji grafikon je bil izdelan z izvedbo več poskusov z uporabo skupine vozlišč p5, ki se razlikuje po velikosti od 1 do 16 vozlišč.

Upoštevajte delovno obremenitev usposabljanja FSDP

Opazljivost delovnih obremenitev generativne umetne inteligence je pomembna za omogočanje vpogleda v vaša tekoča opravila in pomoč pri maksimiranju uporabe vaših računalniških virov. V tej objavi za ta namen uporabljamo nekaj izvornih in odprtokodnih orodij za opazovanje Kubernetes. Ta orodja vam omogočajo sledenje napakam, statističnim podatkom in vedenju modela, zaradi česar postane opazovanje AI ključni del vsakega primera poslovne uporabe. V tem razdelku prikazujemo različne pristope za opazovanje delovnih mest za usposabljanje FSDP.

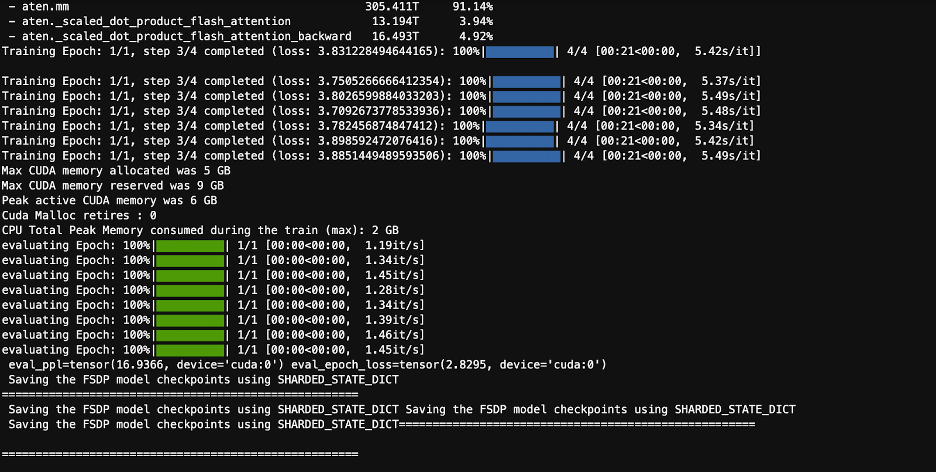

Dnevniki delavca

Na najbolj osnovni ravni morate imeti možnost videti dnevnike svojih vadbenih enot. To lahko preprosto storite z uporabo izvornih ukazov Kubernetes.

Najprej pridobite seznam podov in poiščite ime tistega, za katerega želite videti dnevnike:

Nato si oglejte dnevnike za izbrani pod:

Samo en dnevnik delavca (izvoljenega vodje) bo vseboval celotno statistiko dela. Ime izvoljenega vodnega sklopa je na voljo na začetku vsakega dnevnika delavskega sklopa, označenega s ključem master_addr=.

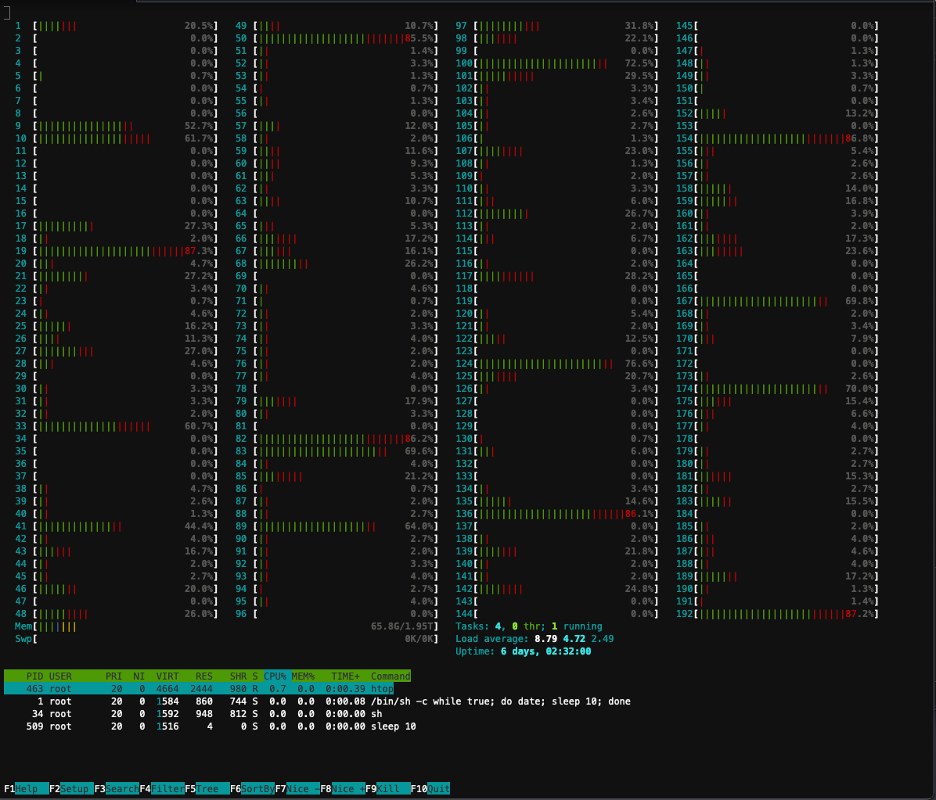

Izkoriščenost CPE

Porazdeljene vadbene delovne obremenitve zahtevajo tako sredstva CPE kot GPE. Za optimizacijo teh delovnih obremenitev je pomembno razumeti, kako se ti viri uporabljajo. Na srečo je na voljo nekaj odličnih odprtokodnih pripomočkov, ki pomagajo vizualizirati uporabo CPE in GPE. Za ogled izkoriščenosti procesorja lahko uporabitehtop. Če vaši delovni podi vsebujejo ta pripomoček, lahko uporabite spodnji ukaz, da odprete lupino v podu in nato zaženetehtop.

Druga možnost je, da namestite htopdaemonsetkot je naveden v nadaljevanju GitHub repo.

Odaemonsetbo zagnal lahek htop pod na vsakem vozlišču. Izvedete se lahko v katerega koli od teh sklopov in zaženetehtopukaz:

Naslednji posnetek zaslona prikazuje izkoriščenost procesorja na enem od vozlišč v gruči. V tem primeru gledamo primerek P5.48xlarge, ki ima 192 vCPE. Procesorska jedra so med prenosom uteži modela v mirovanju in opažamo naraščajočo izkoriščenost, medtem ko se uteži modela nalagajo v pomnilnik GPE.

Uporaba GPE

Čenvtoppripomoček je na voljo v vašem sklopu, lahko ga zaženete s spodnjim in nato zaženetenvtop.

Druga možnost je, da namestite nvtopdaemonsetkot je naveden v nadaljevanju GitHub repo.

To bo vodilo anvtoppod na vsakem vozlišču. Lahko se podate v katerega koli od teh podov in tečetenvtop:

Naslednji posnetek zaslona prikazuje uporabo GPE na enem od vozlišč v vadbeni gruči. V tem primeru gledamo primerek P5.48xlarge, ki ima 8 grafičnih procesorjev NVIDIA H100. GPU-ji so nedejavni, medtem ko se uteži modela prenašajo, nato pa se izkoriščenost pomnilnika GPE-ja poveča, ko se uteži modela naložijo na GPE, in izkoriščenost GPE-ja naraste na 100 %, medtem ko potekajo ponovitve usposabljanja.

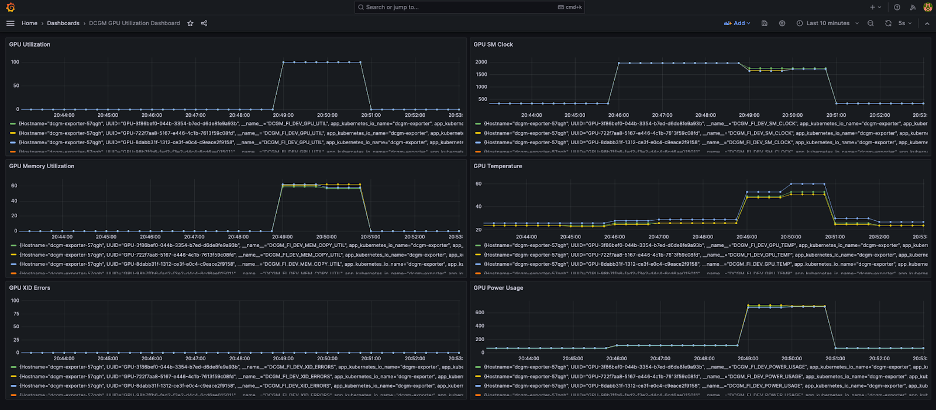

Grafana armaturna plošča

Zdaj, ko razumete, kako vaš sistem deluje na ravni sklopa in vozlišča, je pomembno pogledati tudi meritve na ravni gruče. NVIDIA DCGM Exporter in Prometheus lahko zbirata združene meritve uporabe in jih vizualizirata v Grafani.

Primer uvedbe Prometheus-Grafana je na voljo v nadaljevanju GitHub repo.

Primer razmestitve izvoznika DCGM je na voljo v nadaljevanju GitHub repo.

Preprosta nadzorna plošča Grafana je prikazana na naslednjem posnetku zaslona. Zgrajen je bil z izbiro naslednjih meritev DCGM: DCGM_FI_DEV_GPU_UTIL, DCGM_FI_MEM_COPY_UTIL, DCGM_FI_DEV_XID_ERRORS, DCGM_FI_DEV_SM_CLOCK, DCGM_FI_DEV_GPU_TEMPin DCGM_FI_DEV_POWER_USAGE. Nadzorno ploščo je mogoče uvoziti v Prometheus iz GitHub.

Naslednja armaturna plošča prikazuje eno izvedbo opravila usposabljanja za eno epoho Llama2 7b. Grafi kažejo, da se s povišanjem takta pretočnega večprocesorja (SM) povečata tudi poraba energije in temperatura GPE-jev, skupaj z uporabo GPE-ja in pomnilnika. Vidite lahko tudi, da ni bilo napak XID in da so bili grafični procesorji med tem zagonom zdravi.

Od marca 2024 je opazovanje GPE za EKS izvorno podprto v Vpogled v vsebnik CloudWatch. Če želite omogočiti to funkcijo, preprosto namestite dodatek za opazovanje CloudWatch v vaši gruči EKS. Nato boste lahko brskali po meritvah na ravni podov, vozlišč in gruče prek vnaprej konfiguriranih in prilagodljivih nadzornih plošč v Container Insights.

Čiščenje

Če ste svojo gručo ustvarili z uporabo primerov v tem blogu, lahko izvedete naslednjo kodo, da izbrišete gručo in vse vire, povezane z njo, vključno z VPC:

Za eksctl:

Za terraform:

Prihajajoče funkcije

Pričakuje se, da bo FSDP vključeval funkcijo razčlenjevanja na parameter, s čimer želi dodatno izboljšati svoj pomnilniški odtis na GPE. Poleg tega je cilj tekočega razvoja podpore FP8 izboljšati zmogljivost FSDP na grafičnih procesorjih H100. Končno, ko je FSDP integriran ztorch.compile, upamo, da bomo videli dodatne izboljšave delovanja in omogočili funkcije, kot je selektivno preverjanje aktivacije.

zaključek

V tej objavi smo razpravljali o tem, kako FSDP zmanjša pomnilniški odtis na vsaki grafični procesorji, kar omogoča učinkovitejše usposabljanje večjih modelov in doseganje skoraj linearnega skaliranja prepustnosti. To smo pokazali s postopno implementacijo usposabljanja modela Llama2 z uporabo Amazon EKS na instancah P4de in P5 ter uporabili orodja za opazovanje, kot so kubectl, htop, nvtop in dcgm, za spremljanje dnevnikov ter izkoriščenosti CPE in GPE.

Spodbujamo vas, da izkoristite PyTorch FSDP za lastna delovna mesta pri usposabljanju LLM. Začnite pri aws-do-fsdp.

O avtorjih

Kanwaljit Khurmi je glavni arhitekt rešitev AI/ML pri Amazon Web Services. Sodeluje s strankami AWS pri zagotavljanju navodil in tehnične pomoči ter jim pomaga izboljšati vrednost njihovih rešitev za strojno učenje v AWS. Kanwaljit je specializiran za pomoč strankam s kontejnerskimi, porazdeljenimi računalniškimi aplikacijami in aplikacijami za globoko učenje.

Kanwaljit Khurmi je glavni arhitekt rešitev AI/ML pri Amazon Web Services. Sodeluje s strankami AWS pri zagotavljanju navodil in tehnične pomoči ter jim pomaga izboljšati vrednost njihovih rešitev za strojno učenje v AWS. Kanwaljit je specializiran za pomoč strankam s kontejnerskimi, porazdeljenimi računalniškimi aplikacijami in aplikacijami za globoko učenje.

Alex Iankoulski je glavni arhitekt rešitev, samoupravljano strojno učenje pri AWS. On je inženir programske opreme in infrastrukture, ki rad opravlja poglobljeno in praktično delo. V svoji vlogi se osredotoča na pomoč strankam pri kontejnerizaciji in orkestraciji delovnih obremenitev ML in AI v storitvah AWS, ki jih poganja vsebnik. Je tudi avtor odprte kode narediti okvir in kapitan Dockerja, ki obožuje uporabo tehnologij vsebnikov za pospešitev hitrosti inovacij ob reševanju največjih izzivov na svetu.

Alex Iankoulski je glavni arhitekt rešitev, samoupravljano strojno učenje pri AWS. On je inženir programske opreme in infrastrukture, ki rad opravlja poglobljeno in praktično delo. V svoji vlogi se osredotoča na pomoč strankam pri kontejnerizaciji in orkestraciji delovnih obremenitev ML in AI v storitvah AWS, ki jih poganja vsebnik. Je tudi avtor odprte kode narediti okvir in kapitan Dockerja, ki obožuje uporabo tehnologij vsebnikov za pospešitev hitrosti inovacij ob reševanju največjih izzivov na svetu.

Ana Simoes je glavni specialist za strojno učenje, ML Frameworks pri AWS. Podpira stranke pri uvajanju AI, ML in generativne AI v velikem obsegu na infrastrukturo HPC v oblaku. Ana se osredotoča na podporo strankam pri doseganju cene in učinkovitosti za nove delovne obremenitve in primere uporabe za generativno umetno inteligenco in strojno učenje.

Ana Simoes je glavni specialist za strojno učenje, ML Frameworks pri AWS. Podpira stranke pri uvajanju AI, ML in generativne AI v velikem obsegu na infrastrukturo HPC v oblaku. Ana se osredotoča na podporo strankam pri doseganju cene in učinkovitosti za nove delovne obremenitve in primere uporabe za generativno umetno inteligenco in strojno učenje.

Hamid Šojanazeri je partnerski inženir pri PyTorchu, ki dela na odprtokodni, visoko zmogljivi optimizaciji modela, porazdeljenem usposabljanju (FSDP), in sklepanje. Je soustvarjalec lama-recept in prispeva k TorchServe. Njegov glavni interes je izboljšanje stroškovne učinkovitosti, zaradi česar bo AI bolj dostopen širši skupnosti.

Hamid Šojanazeri je partnerski inženir pri PyTorchu, ki dela na odprtokodni, visoko zmogljivi optimizaciji modela, porazdeljenem usposabljanju (FSDP), in sklepanje. Je soustvarjalec lama-recept in prispeva k TorchServe. Njegov glavni interes je izboljšanje stroškovne učinkovitosti, zaradi česar bo AI bolj dostopen širši skupnosti.

Manj Wright je AI/partner inženir v PyTorchu. Dela na jedrih Triton/CUDA (Pospeševanje razgradnje dela Dequant s SplitK); stranski, pretočni in kvantizirani optimizatorji; in PyTorch Distributed (PyTorch FSDP).

Manj Wright je AI/partner inženir v PyTorchu. Dela na jedrih Triton/CUDA (Pospeševanje razgradnje dela Dequant s SplitK); stranski, pretočni in kvantizirani optimizatorji; in PyTorch Distributed (PyTorch FSDP).

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/scale-llms-with-pytorch-2-0-fsdp-on-amazon-eks-part-2/

- :ima

- : je

- :kje

- ][str

- $GOR

- 1

- 10

- 100

- 12

- 13

- 16

- 2024

- 28

- 500

- 7

- 70

- 8

- 80

- 800

- a

- Sposobna

- O meni

- abstrahirano

- pospeši

- plin

- dostopen

- Račun

- natančnost

- Doseči

- doseganju

- čez

- Aktiviranje

- Add-on

- dodano

- Dodatne

- Poleg tega

- Naslov

- Dodaja

- Sprejem

- Prednost

- po

- združeno

- AI

- AI / ML

- Pomoč

- Usmerjanje

- Cilje

- vsi

- omogočajo

- omogoča

- Prav tako

- vedno

- Amazon

- Amazon EC2

- Amazon Web Services

- znesek

- an

- Ana

- in

- in infrastrukturo

- kaj

- aplikacija

- aplikacije

- Uporabi

- Uporaba

- pristopi

- Arhitektura

- SE

- umetni

- Umetna inteligenca

- AS

- pomoč

- pomočniki

- povezan

- At

- Avtor

- Avtomatizacija

- razpoložljivost

- Na voljo

- izogniti

- AWS

- Ravnovesje

- ovira

- bash

- Osnovni

- BE

- pred

- Začetek

- vedenje

- počutje

- spodaj

- Boljše

- med

- največji

- Billion

- Blog

- tako

- odmori

- širši

- izgradnjo

- zgrajena

- poslovni

- vendar

- by

- CAN

- Zmogljivosti

- kapaciteta

- primeru

- primeri

- CAT

- centri

- centralizirano

- izziv

- izzivi

- Graf

- Charts

- cli

- Ure

- Cloud

- Grozd

- Koda

- sodeluje

- prihaja

- Komunikacija

- skupnost

- v primerjavi z letom

- dokončanje

- kompleksnost

- deli

- računanje

- Izračunajte

- računalnik

- Računalniška vizija

- računalništvo

- vodenje

- konfiguracija

- vsebujejo

- Posoda

- Zabojniki

- vsebina

- ustvarjanje vsebine

- ozadje

- nadaljevanje

- prispeva

- krmilnik

- usklajevanje

- usklajevanje

- copy

- Core

- strošek

- ustvarjajo

- ustvaril

- Ustvarjanje

- Oblikovanje

- ključnega pomena

- Trenutna

- po meri

- Stranke, ki so

- prilagodljiv

- prilagodite

- Armaturna plošča

- nadzorne plošče

- datum

- Centri podatki

- nabor podatkov

- DDP

- globoko

- globoko učenje

- opredeliti

- zahtevno

- izkazati

- Dokazano

- dokazuje,

- razporedi

- uvajanja

- uvajanje

- opisati

- opisano

- Podatki

- podrobno

- Podrobnosti

- Razvoj

- diagram

- drugačen

- neposredno

- razpravlja

- razpravljali

- porazdeljena

- porazdeljeno računalništvo

- razdeljeno usposabljanje

- do

- Lučki delavec

- opravljeno

- dont

- prenesi

- prenesli

- dramatično

- pripravi

- 2

- med

- vsak

- prej

- enostavnost

- enostavno

- učinkovitosti

- učinkovite

- učinkovito

- izvoljeni

- objame

- omogočajo

- omogočanje

- omogoča

- omogočanje

- spodbujanje

- konec

- konec koncev

- inženir

- Inženiring

- okrepi

- Vnesite

- Celotna

- okolje

- epoha

- napake

- Primer

- Primeri

- izvršiti

- Pričakuje

- izkušnje

- Poskusi

- Pojasnite

- Obraz

- olajša

- hitreje

- Feature

- Lastnosti

- Nekaj

- Slika

- file

- končno

- fit

- prilagodljiv

- Osredotoča

- po

- Odtis

- za

- Na srečo

- okviri

- iz

- polno

- v celoti

- funkcionalnost

- nadalje

- splošno

- generacija

- generativno

- Generativna AI

- dobili

- GitHub

- dobro

- GPU

- Grafične kartice

- gradienti

- grafi

- veliko

- zelo

- skupina

- Gost

- Gost Prispevek

- Navodila

- hands-on

- he

- zdravo

- pomoč

- pomoč

- Pomaga

- visokozmogljivo

- najvišja

- njegov

- drži

- upam,

- Kako

- Kako

- Vendar

- hpc

- HTML

- http

- HTTPS

- identificirati

- Mirovanje

- if

- ponazarja

- slika

- Izvajanje

- Pomembno

- izboljšanje

- Izboljšave

- in

- vključujejo

- Vključno

- Povečajte

- povečal

- Poveča

- vedno

- info

- Podatki

- Infrastruktura

- Inovacije

- vpogledi

- primer

- Namesto

- integrirana

- integracije

- Intelligence

- obresti

- v

- IT

- ponovitve

- ITS

- Job

- Delovna mesta

- jpeg

- jpg

- json

- samo

- Ključne

- Otrok

- KubeFlow

- Oznake

- jezik

- velika

- obsežne

- večja

- Največji

- Zadnja

- začetek

- Vodja

- učenje

- manj

- najem

- Stopnja

- Knjižnica

- lahek

- kot

- všeč mi je

- Omejitev

- Limited

- Meje

- linearna

- Seznam

- LLM

- nahaja

- prijavi

- prijava

- Poglej

- si

- ljubi

- stroj

- strojno učenje

- Glavne

- Izdelava

- upravljanje

- obvladljiv

- upravlja

- Način

- več

- marec

- marec 2024

- maksimiranje

- Maj ..

- Mehanizem

- Spomin

- Meta

- metapodatki

- Meritve

- mešano

- ML

- Model

- modeli

- sodobna

- monitor

- več

- Najbolj

- Ime

- izvirno

- naravna

- Obdelava Natural Language

- Blizu

- Nimate

- potrebe

- mreža

- mreženje

- Novo

- nlp

- št

- Vozel

- vozlišča

- Številka

- Nvidia

- of

- ponudba

- Ponudbe

- on

- ONE

- v teku

- samo

- na

- odprite

- open source

- Delovanje

- operater

- optimizacija

- optimizacije

- Optimizirajte

- or

- orkestracijo

- OS

- Ostalo

- naši

- ven

- izhod

- Splošni

- Premagajte

- režijske

- lastne

- Pace

- vzporedno

- parametri

- del

- sodelujejo

- partner

- mimo

- pot

- za

- performance

- Načrt

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Predvajaj

- Popular

- Prispevek

- moč

- močan

- pred

- predpogoji

- ohranjanje

- prejšnja

- , ravnateljica

- Predhodna

- Postopek

- Procesi

- obravnavati

- Procesor

- proizvodnjo

- Proizvedeno

- Projekt

- dokazano

- zagotavljajo

- če

- vlečenje

- Namen

- Push

- pitorha

- kakovost

- območje

- pripravljen

- zmanjšuje

- Zmanjšanje

- glejte

- reference

- besedilu

- okolica

- registra

- povezane

- zanesljivost

- ponovite

- odgovori

- zahteva

- zahteva

- Zahteve

- zahteva

- Raziskave

- vir

- viri

- povzroči

- Rezultati

- narašča

- robusten

- vloga

- Run

- tek

- Prilagodljivost

- razširljive

- Lestvica

- skaliranje

- script

- skripte

- brez težav

- Oddelek

- oddelki

- varnost

- glej

- izbran

- izbiranje

- selektivno

- Serija

- Storitev

- Storitve

- nastavite

- več

- ostro

- brušenje

- je

- Shell

- shouldnt

- Prikaži

- pokazale

- Razstave

- bistveno

- Podoben

- Enostavno

- preprostost

- poenostavlja

- sam

- Velikosti

- velikosti

- Slice

- manj

- delček

- Software

- Rešitev

- rešitve

- Reševanje

- nekaj

- vir

- specialist

- specializirano

- določeno

- hitrosti

- konice

- sveženj

- začel

- Država

- Države

- Statistika

- Status

- Koraki

- Še vedno

- stop

- strategije

- pretakanje

- taka

- Suit

- podpora

- Podprti

- Podpora

- Podpira

- Sinhronizacija

- SYS

- sistem

- Bodite

- ob

- ciljna

- Naloge

- skupina

- tehnični

- tehnika

- tehnike

- Tehnologije

- Predloga

- Terraform

- besedilo

- da

- O

- njihove

- Njih

- POTEM

- Tukaj.

- te

- jih

- ta

- tisti,

- 3

- skozi

- pretočnost

- čas

- zamudno

- do

- danes

- skupaj

- Boni

- orodja

- sledenje

- Vlak

- usposobljeni

- usposabljanje

- prevod

- Bilijona

- Res

- melodija

- dva

- tip

- Konec koncev

- razumeli

- V teku

- us

- uporaba

- primeru uporabe

- Rabljeni

- uporablja

- uporabo

- javne gospodarske službe

- pripomoček

- uporablja

- vrednost

- raznolikost

- različnih

- različno

- preverjanje

- različica

- zelo

- preko

- Poglej

- ogled

- Virtual

- vidljivost

- Vizija

- vizualizirati

- prostornine

- walkthrough

- želeli

- je

- we

- web

- spletne storitve

- Dobro

- so bili

- kdaj

- ki

- medtem

- WHO

- bo

- z

- v

- delo

- delavec

- delavci

- potek dela

- deluje

- deluje

- svetu

- zavijanje

- yaml

- let

- Vi

- Vaša rutina za

- zefirnet