Posameznikovo zdravje je izjemno osebna tema in obisk zdravnika je lahko zastrašujoča in stresna izkušnja. To še posebej velja za ljudi, ki so del skupin, ki jih je zdravstveni sistem zgodovinsko zatajil. Ta strukturna vprašanja v sistemu zdravstvenega varstva so prežela algoritme, ki se vedno pogosteje uporabljajo pri diagnosticiranju in zdravljenju bolnikov. CCC je organiziral panel "Health Equity: Kako lahko algoritmi in podatki ublažijo, ne poslabšajo škode?" ki je obravnaval ta vprašanja. Panelisti so bili dr. Amaka Eneanya (Fresenius Medical Care), dr. Mona Singh (Univerza Princeton), dr. Melanie Moses (Univerza v Novi Mehiki) in dr. Katie Siek (Univerza Indiana).

Posameznikovo zdravje je izjemno osebna tema in obisk zdravnika je lahko zastrašujoča in stresna izkušnja. To še posebej velja za ljudi, ki so del skupin, ki jih je zdravstveni sistem zgodovinsko zatajil. Ta strukturna vprašanja v sistemu zdravstvenega varstva so prežela algoritme, ki se vedno pogosteje uporabljajo pri diagnosticiranju in zdravljenju bolnikov. CCC je organiziral panel "Health Equity: Kako lahko algoritmi in podatki ublažijo, ne poslabšajo škode?" ki je obravnaval ta vprašanja. Panelisti so bili dr. Amaka Eneanya (Fresenius Medical Care), dr. Mona Singh (Univerza Princeton), dr. Melanie Moses (Univerza v Novi Mehiki) in dr. Katie Siek (Univerza Indiana).

Dr. Eneanya je panel začel z razpravo o tem, kako enačba sistematično podcenjuje ledvično bolezense v črnih Američanih že desetletja. Pojasnila je, da v ZDA vse bolnike z boleznijo ledvic vpišejo v register. Razširjenost bolezni se je v zadnjih desetletjih na splošno povečala, pri črncih pa je še bolj razširjena in hujša.

Dr. Eneanya je orisal te rasne/etnične razlike v dejavnikih tveganja za kronično ledvično bolezen (CKD) in rezultatih (Eneanya ND et al. Narava Rev Neph. 2021, sistem podatkov o ledvicah Združenih držav.):

- Razširjenost sladkorne bolezni je največja med črnci v primerjavi z drugimi rasnimi skupinami

- Pri temnopoltih in latinoameriških posameznikih se diagnoza diagnosticira v mlajših letih v primerjavi z belci

- Temnopolti posamezniki imajo bistveno večjo stopnjo hipertenzije v primerjavi z belci

- Nadzor nad hipertenzijo je med temnopoltimi in latinskoameriškimi posamezniki slabši v primerjavi z belci

- Pri temnopoltih je manj verjetno, da bodo pred začetkom dialize prejeli nefrološko oskrbo v primerjavi z drugimi rasnimi skupinami

- Tveganje za razvoj odpovedi ledvic, ki zahteva dializo ali presaditev ledvice

- 4-krat večja pri črnih v primerjavi z belimi posamezniki

- 1.3-krat večja pri španskih v primerjavi z belci

- Temnopolti posamezniki imajo manj možnosti za presaditev ledvic v primerjavi z drugimi rasnimi skupinami

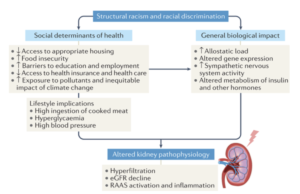

Strukturni rasizem prispeva k slabim zdravstvenim izidom zaradi bolezni, povezanih z ledvicami, je pojasnil dr. Eneanya (Eneanya ND et al. Narava Rev Neph. 2021.):

Kakšne življenjske navade si lahko privoščite – na primer, kaj jeste, in biološki vplivi, kot sta stres zaradi rasizma in diskriminacije, vodijo do presnovnih sprememb v telesu, kar lahko povzroči zmanjšano delovanje ledvic.

Dr. Eneanya se je obrnil na primer, kako ima algoritem, ki ga trenutno uporabljajo kliniki, posledice v resničnem svetu. Enačba eGFR je algoritem, ki se uporablja za določanje, kako močno je bolnikovo delovanje ledvic. Višji eGFR predstavlja boljše delovanje ledvic. Pacientova raven eGFR določa, ali so upravičeni do določenih zdravljenj in, kar je morda najbolj ključno, do presaditve ledvice. Vendar pa algoritem pokaže, da imata temnopolta in ne-temnopolta oseba, ki sta enake starosti, spola in imata enako vrednost kreatinina (krvni test, ki meri delovanje ledvic), različne ravni eGFR. Algoritem izračuna, da ima temnopolta oseba višji eGFR, domnevno boljše delovanje ledvic, kot nečrna oseba. To omejuje zdravljenje, do katerega so upravičeni, in pomeni, da morajo biti bolj bolni, da prejmejo pomoč, do katere bi morali biti upravičeni.

Dr. Eneanya je razložil zgodovino algoritma, ki razkriva, zakaj izračunava na ta napačno usmerjen način: študija iz leta 1999 je temnopoltim posameznikom pripisala višji serumski kreatinin zaradi napačne predpostavke, da imajo večjo mišično maso. Študija je razvila prvo enačbo eGFR, uporabljeno v Združenih državah, in vključila multiplikacijski faktor »črne rase«, ki povzroča višji eGFR med temnopoltimi posamezniki. Uporaba eGFR je problematična, ker so kliniki prepuščeni presoji rase nekoga na podlagi videza ali zdravstvene kartoteke (ki je morda navedena kot preostala predpostavka prejšnjega klinika). Prav tako ni razlikovanja med posamezniki mešane rase ali metode za njihovo razvrstitev.

Dr. Eneanya je bil avtor članka, ki je spremenil način izračuna eGFR v zdravstvu, tako da je zagovarjal enačbo, ki v ocenjevanje ne vključuje rase (Inker LA, Eneanya ND, et al. NEJM 2021, Delgado C, et al. JASN 2021). Dr. Eneanya in njeni kolegi so se vrnili k prvotni študiji iz leta 1999 in odstranili raso iz enačbe ter jo ponovno opremili z drugimi vložki. Danes ⅓ bolnišnic in klinik v ZDA uporablja novo enačbo, Združeno omrežje za izmenjavo organov (UNOS) pa je junija 2022 vsem transplantacijskim centrom omejilo uporabo enačbe na podlagi rase. Januarja so naredili še korak dlje. 2023 in izjavil, da morajo vsi transplantacijski centri v ZDA pregledati vse temnopolte bolnike na čakalnem seznamu za presaditev ledvice in spremeniti čas njihovega čakalnega seznama, če je nanj vplivala enačba eGFR, ki temelji na rasi. Dr. Eneanya je pojasnil, da čeprav je UNOS del zvezne vlade, vlada ni bila neposredno vpletena v odločitev o prepovedi uporabe enačbe na podlagi rase.

Razen splošnega sprejetja nove enačbe eGFR je dr. Eneanya imela še nekaj prihodnjih pristopov, ki jih vidi kot ključne za pravičen dostop do zdravljenja bolezni ledvic:

- Razviti politike in postopke za izboljšanje dostopa do preventivne oskrbe kronične ledvične bolezni

- Razviti politike za povečanje dostopa do presaditve ledvic

- Raziščite vplive okolja (npr. stres, diskriminacija) na delovanje ledvic in napredovanje bolezni

- Preglednost pri razpravljanju o določanju delovanja ledvic z bolniki (vključno z omejitvami enačb eGFR)

Dr. Eneanya je pojasnil, da se razbijanje stereotipov o črni rasi zmanjša na odpravo zmot in lažnih novic, ki nimajo znanstvene podlage. Na primer, učni načrti medicinskih šol se spreminjajo, da bi pokazali, da ni antropološke podlage, da je mišična masa pri eni rasi večja kot pri drugi. Mediji so dobro razkrili tudi ta razbit mit in dr. Eneanya se je celo posvetoval o epizodi Grey's Anatomy, ki je poudarila uničujoče učinke enačbe eGFR za temnopolte bolnike, ki potrebujejo presaditev ledvice.

Dr. Singh je nadaljeval pogovor o zdravstvenih razlikah s pojasnilom, da imajo v ZDA temnopolti posamezniki višjo stopnjo umrljivosti zaradi raka v primerjavi z belci. To dejstvo ponazarja, da obstaja veliko izzivov, s katerimi se morajo soočiti zdravstveni delavci in računalniški raziskovalci, obstaja pa tudi veliko priložnosti za razvoj metod, ki ne povečujejo obstoječih razlik.

Dr. Singh je najprej razložil biologijo raka: »Rak je bolezen, pri kateri naše celice pridobijo mutacije, ki jim omogočajo nenadzorovano rast. Torej, če želimo razumeti molekularne temelje raka pri katerem koli posamezniku, lahko pogledamo genome njegovih ali njenih rakavih celic in njegovih nerakavih celic ter zaporedje. Ko sekvenciramo normalne in rakave celice, lahko primerjamo genome in odkrijemo, katere mutacije smo pridobili v rakavih celicah, kar nam lahko da namig o tem, katere spremembe so lahko tiste, ki so pomembne za raka pri tem posamezniku. Točno to je bilo storjeno v zadnjih 15 ali več letih, ko so bili sekvencirani tumorji več deset tisoč posameznikov in identificirane mutacije v njih.

Skoraj vsi poznajo nekoga, ki je zbolel za rakom, univerzalnega zdravila pa ni. Vendar pa je dr. Singh nato razpravljal o obljubi natančne onkologije, kjer znanstvenik določi sekvence pacientovega tumorja, identificira njegove mutacije DNK in izvede računalniško analizo, da ugotovi, na katere spremembe je mogoče ciljati. Imunoterapija je pristop k izkoriščanju lastnega imunskega sistema nekoga, da cilja na njegove tumorje. Obetavna in prihajajoča imunoterapija je oblikovanje cepiv, ki so prilagojena vsakemu posamezniku in ta cepiva izzovejo imunski odziv na njihove tumorje.

Dr. Singh pojasnjuje, kako to deluje tako, da ima vsak naš imunski sistem 6 različnih kopij genov razreda I klasičnega glavnega kompleksa histokompatibilnosti (MHC). Obstaja več kot 13,000 različnih različic MHC teh genov, tako da ima vsaka oseba drugačen sklop genov MHC. Nekatere mutacije znotraj rakavih celic povzročijo "tuje" beljakovine in nekatere od teh lahko vežejo MHC posameznika. Te komplekse MHC, vezane na fragment proteina, pridobljenega iz raka, prepoznajo imunske celice in lahko aktivirajo imunski odziv. To je zelo personalizirano, saj ima lahko tumor vsakega posameznika različne mutacije in vsak posameznik ima različne MHC. Znanstveniki uporabljajo strojno učenje, da bi napovedali, katere različice MHC vežejo katere peptide, kar bo, upajmo, povečalo učinkovitost imunoterapije in na koncu pripeljalo do oblikovanja prilagojenih neoantigenskih cepiv.

Raznolikost genov MHC se po vsem svetu zelo razlikuje, pojasnjuje dr. Singh. Večina alelov MHC nima veznih podatkov, povezanih z njimi, in tisti, ki imajo podatke o njihovi vezavi, so pristranski v korist nekaterih rasnih skupin. Pri testiranju nabora podatkov je pomembno, da se ne osredotočite samo na celotno uspešnost, temveč upoštevate tudi podpopulacije podatkov, tako da imajo vsi enak dostop do možnih koristi te raziskave.

Nabor za usposabljanje je treba pred uporabo analizirati glede pristranskosti. Poleg tega lahko metode za ocenjevanje uspešnosti na nevidnih podatkih razkrijejo pristranskost v podatkih, na podlagi katerih je bil usposobljen. Zbiranje podatkov na nepristranski način je bistvenega pomena za omejitev možnosti za pristranskost pri kasnejši uporabi algoritma. Področja za prihodnje delo na to temo se osredotočajo na alternativne postopke usposabljanja in algoritemske strategije za ciljno zbiranje podatkov. Na splošno je ključnega pomena dati prednost razvoju poštenih pristopov natančne medicine, tako da so terapije in raziskave na koncu verige pravične.

Dr. Moses je nato spregovorila in kontekstualizirala, kako se algoritma za vezavo eGFR in MHC-peptida prilegata širšemu ekosistemu, kako medicinski algoritmi vplivajo na družbene rezultate. Pojasnjuje, da znanstveniki uporabljajo algoritme in umetno inteligenco za napovedovanje rezultatov, ki so nam pomembni, na podlagi približkov, ki jih je mogoče enostavno izmeriti, ti približki pa so lahko netočni. Da bi bili medicinski algoritmi še bolj zapleteni, nenehno medsebojno vplivajo na nepredvidljive načine, tako da je celoten obseg algoritmov pri diagnozi bolnika običajno nejasen. Zato je ključnega pomena, da algoritme uporabljamo previdno, še posebej zato, ker lahko algoritmi, ko odpovejo, najbolj škodijo najbolj ranljivim.

Ugotavljanje, na koga algoritem vpliva in zakaj, je pomemben del medicinske pravičnosti. Dr. Moses naredi korak nazaj in definira pravičnost. Skupna grafika uporablja se za razlikovanje med pravičnostjo in enakostjo, s posamezniki s tremi različnimi višinami, ki se trudijo videti bejzbolsko igro in na različne načine, kako jih podpreti, je napačna celo na tretji sliki, ki odstrani oviro, ker nakazuje, da je nekaj neločljivo povezanega z osebo zakaj potrebujejo podporo namesto socialnih razlogov, ki so morda sploh povzročili neenakost.

Dr. Moses je pokazal alternativno grafiko, da bi opredelil, kako izgleda pravičnost v družbi s sistemskimi krivicami (Copyright 2020 Nicolás E. Barceló in Sonya Shadravan (Artist: Aria Ghalili)):

Ta slika razkriva, da vsi ne morejo imeti koristi samo od odstranitve ovire, ampak obstajajo globoko zakoreninjene težave, ki jih je treba rešiti, da bi dosegli pravičnost.

Računalniški znanstveniki bi morali vedno imeti v mislih ta pomemben kontekst, trdi dr. Moses. Pogosto je težko prepoznati predpostavke, ki so bile prisotne pri ustvarjanju algoritmov, tudi pri najbolj enostavnih algoritmih. Prav tako je enostavno uporabiti statistično korelacijo za napovedovanje izida in domnevati, da je korelacija enaka vzročni zvezi, vendar je to zmota.

Dr. Moses nadaljuje s konkretnimi primeri nepravičnih algoritmov, ki se danes uporabljajo v družbi na drugih področjih. Na primer algoritmi v kazenskopravnem sistemu, ki nadomestijo denarno varščino za pripor pred sojenjem. Namen je, da je postopek nepristranska metoda, ki temelji na podatkih, za pridržanje tistih, za katere obstaja veliko tveganje ali nevarnost, da ne pridejo na sojenje. Vendar imajo algoritmi veliko pomanjkljivosti tako v zmožnosti algoritma, da daje poštene in natančne napovedi, kot v pristranskosti sistema, katerega del je algoritem, vključno s pristranskimi vhodi in pristranskimi interpretacijami izhodov. Še en primer, kako algoritmi ohranjajo rasno pristranskost v sistemu kazenskega pravosodja, je programska oprema za prepoznavanje obraza. Medtem ko se je izkazalo, da je prepoznavanje obrazov najmanj natančno pri prepoznavanju temnopoltih ženskih obrazov, so temnopolti moški obrazi ti algoritmi najpogosteje napačno identificirani, kar vodi do lažnih aretacij. To dokazuje, kako lahko pristranskost, ki najbolj prizadene eno skupino (temnopolte ženske) v smislu natančne klasifikacije, najbolj vpliva na drugo skupino (temnopolte moške) zaradi pristranskosti v kazenskopravnem sistemu

Algoritmi lahko poslabšajo človeško pristranskost in jih je mogoče tudi zavrniti, če ne krepijo presoje, ki bi jo sprejeli brez posvetovanja z algoritmom. To velja tudi za pristranske algoritme v medicini. Na primer, pulzni oksimetri so manj natančni pri zaznavanju ravni kisika v temnejši koži, kar lahko povzroči premajhno diagnozo bolezni dihal, kot je huda COVID. Uporaba zneska denarja, porabljenega za zdravstveno varstvo, kot približka za to, kako zdrav je nekdo, je še en nepravičen ukrep. Primeri, ki sta jih opisala dr. Eneanya in dr. Singh, zmanjšana ledvična okvara eGFR pri Afroameričanih in genomski nabori podatkov, ki preveč predstavljajo evropske prednike, so drugi vidni primeri pristranskih algoritmov v medicini, ki imajo nevarne posledice za prizadete ljudi. Enačba eGFR je bila uporabljena za identifikacijo zapornikov, ki so bili dovolj bolni, da so bili izpuščeni iz zapora med COVID-om, zaradi česar je bila Afroameričanu zavrnjena izpustitev, ker je bila njegova ledvična funkcija precenjena.

Povratne informacije lahko izboljšajo algoritme ali povečajo njihovo škodo. Algoritmi niso enosmerna ulica, saj želijo napovedati vedenje na podlagi podatkov in napoved za eno leto vpliva na podatke za naslednje leto. Cilj algoritmov mora biti zmanjšanje pristranskosti skozi čas; na primer, zaslišanja ob varščini bi morala pomagati obtožencem, da se prikažejo na sojenju, namesto da bi napovedovala neuspehe; policija bi si morala prizadevati za zmanjšanje kriminala in lažnih aretacij. Algoritmi, ki se uporabljajo v različnih domenah, nikoli ne bi smeli biti vklesani v kamen, ker bodo obstajale povratne informacije med ljudmi, algoritmi in družbenim kontekstom.

Dr. Moses je predlagal tudi dodatne poti naprej: odstranitev pristranskosti iz naborov podatkov, dvomljive predpostavke, obrnite (ne okrepite) sistemsko pristranskost, ocenite z različnimi perspektivami, zahtevajte pregledne in razložljive algoritme ter uporabite postopne, prilagodljive uvedbe. Splošno mnenje je, da algoritmi nekako odstranijo pristranskost, v resnici pa pogosto kodificirajo pristranskost, zato moramo biti previdni glede algoritmov in njihovih rezultatov.

Zadnji del panela je bil Q&A. Moderator dr. Siek je sejo začel z vprašanjem: "Kako lahko algoritmi in podatki ne povečajo škode?"

- Dr. Eneanya: Če se raziskovalec pri iskanju diferenciatorjev v algoritmu ustavi z dirko, je to leno in znanstveno neveljavno. Genetski smo si ljudje med rasami bolj podobni kot znotraj. Bolj pomembno je razmišljati o bioloških značilnostih, ki dejansko vplivajo na človeški sistem, kot so ledvice. Na primer, pri testiranju pulznega oksimetra bi se morali raziskovalci posvetovati z dermatologom, da bi preizkusili in potrdili pulzne oksimetre na podlagi različnih odtenkov kože – namesto da bi uporabljali eno vrsto naprave za ljudi z različnimi odtenki kože.

- Dr. Moses: Enak pristop bi morali uporabiti pri potrjevanju algoritmov, potem ko so bili dani v uporabo. Prepoznavanje rase kot družbenega konstrukta omogoča opaziti vpliv rasno slepih študij. Pomembno je poiskati razlikovanje med skupinami, da prepoznamo morebitna neskladja, ki jih algoritem krepi. Ali morate oceniti, ali algoritem zmanjšuje težave ali jih izboljšuje?

- Dr. Singh: Rase nikoli ne bi smeli uporabljati kot vhodni podatek, lahko pa jo uporabimo za ovrednotenje rezultatov glede pristranskosti. Če ne bi razmišljali o rasi, sploh ne bi mogli reči, da obstajajo zdravstvene razlike. Zbiranje genomskih podatkov in kategorizacija po prednikih je tudi napačna metodologija. Zagotoviti moramo oceno, ali metode dobro delujejo med populacijami.

- Dr. Eneanya: Ko diverzificiramo študijsko populacijo, se moramo odmakniti od zgolj vključevanja skupin belcev ali črncev. Preučiti moramo več razlik znotraj teh skupin, kot so dejavniki, kot so družbeni status, spol, spolnost itd. Pogledati moramo celotno sliko in ne le naborov podatkov o raznolikosti na podlagi rase.

- Dr. Moses: Algoritmi so natanko tiste vrste orodij, ki bi nam morala pomagati pri tem, obstaja veliko potencialnih računalniških strategij, ki lahko pomagajo.

- Dr. Singh: Strinjam se, da imajo algoritmi tukaj veliko vlogo, kako torej dati prednost zbiranju podatkov? Zelo skrbno moramo premisliti, kako to narediti.

Član občinstva je nato vprašal: "Glede na veliko hitenje pri razvoju algoritmov, ki temeljijo na trenutnih naborih podatkov s pristranskostmi, ali obstajajo načini za preprečevanje pristranskosti v algoritmu, razen z odpravo pristranskosti v naboru podatkov?"

- Dr. Singh: Težko je premagati pristranskost v nizu podatkov; je aktivno področje raziskovanja. Enostavno je presežek ali podvzorčenje podatkov. Obstajajo različni načini za usposabljanje modelov ML, kjer je splošni cilj (običajno funkcija, ki jo poskušate minimizirati, običajno z uporabo celotnega nabora podatkov) to, kako mora izgledati optimizacija.

- Dr. Eneanya: Za veliko medicinskih algoritmov velja, da morajo vključiti raso, da bi bili natančnejši. Vendar pa morajo ljudje kritično preučiti, zakaj je bila rasa sploh uvedena? Odstranitev rase kot spremenljivke morda ne bo spremenila delovanja algoritma tako zelo, kot si mislite. Ali kaj pomeni (klinično), če se rezultati po odstranitvi spremenljivke, kot je rasa, spremenijo le za malenkost?

- Dr. Singh: Še posebej nič ne pomeni, če se vaš komplet za vadbo in komplet, na katerem ga uporabljate, zelo razlikujeta.

Dr. Siek je paneliste spodbudil k drugemu vprašanju: "Če bi lahko to storili znova, kaj bi naredili drugače?"

- Dr. Eneanya: Do prenehanja z raso pri ocenjevanju razlogov za razlike v zdravstvenih rezultatih se ne bi smelo zgoditi. Na primer glede ravni kreatinina bi morali pomisliti, kaj še lahko vpliva na kreatinin? Potrebujemo boljše nabore podatkov, kar zahteva krepitev zaupanja v skupnostih. To je lahko videti kot izboljšanje raznolikosti poskusnih populacij, ocenjevanje, kako izgleda vaše študijsko osebje itd. Dotacije Nacionalnega inštituta za zdravje vse pogosteje zahtevajo partnerje iz skupnosti in strokovnjake za enakost v zdravju kot del raziskovalne skupine. Moramo spremeniti stare sklope, vendar moramo v prihodnosti zgraditi tudi boljše sklope. Toliko lahko naredimo le s poskusi ponovne konfiguracije tega, kar je tam zunaj.

- Dr. Moses: Poleg tega, kaj bi lahko storili, če bi znova zagnali, rad razmišljam o algoritmih kot o ogledalih družbe. Trenirajo jih vsi na internetu. Če to uporabimo kot vhod v naslednjo raven algoritma, lahko ugotovimo, kje so pristranskosti, zakaj so tam in kakšen je prihodnji vpliv. Vprašati se moramo, kako uporabiti ta kvantitativna orodja, da bi ugotovili, kako te situacije popraviti, namesto da bi jih poslabšali.

- Dr. Singh: Veliko genomov, ki so bili zbrani, ne predstavlja celotne populacije. Začeti moramo z vključevanjem različnih skupin ljudi.

Zadnje vprašanje občinstva je bilo: »Dokler ne pridemo do točke, ko bomo imeli popolno genomsko sliko vseh ljudi, bo navdušenje nad uporabo strojnega jezika in algoritmov. Kaj so resnične stvari na ravni strokovnih pregledov, ki jih lahko naredimo zdaj, da nam jih ne bo treba popravljati čez 30 let?«

- Dr. Eneanya: Popolno je sovražnik dobrega. Potruditi se moramo po najboljših močeh. Lahko prepoznamo pristranskosti, nato pa naredimo vse, kar lahko, za naprej. Obstajajo ovire, ki nimajo nobene zveze s kliničnimi algoritmi. Samo popravljanje algoritma eGFR z odpravo rase ne bo rešilo razlik v bolezni ledvic. Veliko dela je treba opraviti na multivariabilnih vidikih represije.

- Dr. Moses: Vaše delo [dr. Eneanya] naredili za preoblikovanje algoritma za vse, kar je točno to, kako napredovati. Moramo popraviti sistem. Tudi z uporabo dejstva, da ga je bilo treba popraviti; zlahka je bilo videti pristranskost, zapisano v enačbi. Enačba ledvic služi kot ogledalo za družbo, ki je dovolila kodiranje rase na način, ki je desetletja prikrajšal Afroameričane. Pristranskost v tej enačbi je bila eksplicitna in namerna. V prihodnosti bo veliko težje prepoznati pristranskost v bolj zapletenih algoritmih.

Spremljajte še en povzetek panela AAAS 2023, ki ga sponzorira CCC!

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- Platoblockchain. Web3 Metaverse Intelligence. Razširjeno znanje. Dostopite tukaj.

- vir: https://feeds.feedblitz.com/~/733934357/0/cccblog~Health-Equity-How-Can-Algorithms-and-Data-Mitigate-Not-Exacerbate-Harms-AAAS-Panel-Recap/

- : je

- $GOR

- 000

- 1

- 1999

- 2020

- 2021

- 2022

- 2023

- 7

- a

- sposobnost

- Sposobna

- O meni

- dostop

- natančna

- Doseči

- pridobiti

- pridobljenih

- čez

- aktivna

- dejansko

- Dodatne

- Dodaja

- Sprejetje

- napredovanje

- zagovarjanje

- vplivajo

- Afriški

- po

- Vek

- AI

- AL

- algoritem

- algoritmični

- algoritmi

- vsi

- omogoča

- alternativa

- vedno

- Ameriška

- Američani

- med

- znesek

- Analiza

- anatomija

- in

- Še ena

- zdi

- uporabna

- pristop

- pristopi

- SE

- OBMOČJE

- območja

- Trdi

- zrak

- aretacije

- članek

- umetnik

- AS

- vidiki

- povezan

- predpostavka

- At

- Občinstvo

- Avtor

- nazaj

- zakup

- Ban

- ovira

- ovire

- Baseball

- temeljijo

- Osnova

- BE

- ker

- začel

- počutje

- koristi

- Prednosti

- BEST

- Boljše

- med

- Poleg

- pristranskosti

- vežejo

- zavezujoče

- biologija

- Bit

- črna

- kri

- telo

- Bound

- Predložitev

- izgradnjo

- Building

- by

- izračuna

- izračuna

- CAN

- rak

- Rakne celice

- ki

- previdno

- kategoriziranje

- povzročilo

- vzroki

- ccc

- Celice

- centri

- nekatere

- izzivi

- spremenite

- Spremembe

- spreminjanje

- lastnosti

- razred

- Razvrstitev

- Razvrsti

- klinični

- kliniki

- sodelavci

- Zbiranje

- zbirka

- prihajajo

- Skupno

- skupnosti

- Temelji na skupnosti

- primerjate

- v primerjavi z letom

- dokončanje

- kompleksna

- zapleten

- računalništvo

- Posledice

- Razmislite

- nenehno

- gradnjo

- svetovanje

- ozadje

- naprej

- se nadaljuje

- nadzor

- Pogovor

- avtorske pravice

- Korelacija

- bi

- Covidien

- Oblikovanje

- Kriminal

- kazenska

- ključnega pomena

- ključno

- pozdravi

- Trenutna

- Trenutno

- NEVARNOST

- Nevarno

- datum

- nabor podatkov

- nabori podatkov

- nabor podatkov

- desetletja

- Odločitev

- zmanjša

- globoko

- obtoženci

- Določa

- Povpraševanje

- dokazuje,

- razmestitve

- opisano

- Oblikovanje

- pripor

- odločnost

- Ugotovite,

- določa

- uničujoče

- Razvoj

- razvili

- razvoju

- Razvoj

- naprava

- Sladkorna bolezen

- razlike

- drugačen

- razlikovati

- težko

- neposredno

- diskontirani

- razpravljali

- razpravljali

- bolezen

- bolezni

- razne

- raznolikost

- DNK

- Zdravnik

- Ne

- domen

- dont

- navzdol

- vozi

- med

- e

- vsak

- enostavno

- jesti

- ekosistem

- Učinki

- izdelano

- upravičeni

- odstranjevanje

- dovolj

- vneseno

- navdušenje

- okolja

- enakost

- enako

- enačbe

- pravičnost

- zlasti

- bistvena

- oceniti

- itd

- Evropski

- oceniti

- ocenjevanje

- Tudi

- vsi

- točno

- Primer

- Primeri

- ponazarja

- obstoječih

- izkušnje

- razložiti

- pojasnjujejo

- Pojasni

- Obraz

- obrazi

- obraza

- prepoznavanje obraza

- dejavniki

- FAIL

- ni uspelo

- Napaka

- sejem

- ponaredek

- ponaredek novice

- prednost

- Zvezna

- Zvezna vlada

- povratne informacije

- ženska

- Nekaj

- Slika

- končna

- prva

- fit

- fiksna

- Všita

- pomanjkljiv

- Osredotočite

- osredotoča

- za

- Naprej

- iz

- polno

- funkcija

- nadalje

- Poleg tega

- Prihodnost

- igra

- Spol

- dobili

- pridobivanje

- Daj

- Giving

- globus

- Cilj

- dogaja

- dobro

- dobro delo

- vlada

- postopno

- nepovratna sredstva

- Grafično

- Največji

- skupina

- Skupine

- Grow

- se je zgodilo

- Trdi

- škodljiva

- škodljiv

- plezalni pas

- Imajo

- Zdravje

- zdravstvene štipendije

- zdravstveno varstvo

- zdravo

- višine

- pomoč

- tukaj

- visoko tveganje

- več

- najvišja

- Poudarjeno

- zelo

- Zgodovinsko

- zgodovina

- upajmo, da

- bolnišnice

- Kako

- Kako

- Vendar

- HTTPS

- velika

- človeškega

- Ljudje

- Hipertenzija

- i

- identificirati

- identificira

- identificirati

- identifikacijo

- slika

- Imunski sistem

- imunoterapija

- vpliv

- prizadeti

- Vplivi

- oslabitev

- Pomembno

- izboljšanje

- izboljšanju

- in

- V drugi

- netočne

- vključujejo

- Vključno

- Vključena

- Povečajte

- povečal

- vedno

- neverjetno

- individualna

- posamezniki

- inherentno

- vhod

- primer

- Inštitut

- namen

- medsebojno delovanje

- Internet

- zastrašujoče

- Uvedeno

- vključeni

- sodelovanje

- Vprašanja

- IT

- januar

- Job

- Sodnik

- Justice

- Imejte

- Ključne

- ledvice

- velika

- večja

- vodi

- vodi

- učenje

- Levo

- Stopnja

- ravni

- način življenja

- kot

- Verjeten

- LIMIT

- omejitve

- Meje

- Navedeno

- Poglej

- izgleda kot

- si

- POGLEDI

- Sklop

- stroj

- strojno učenje

- je

- velika

- Znamka

- Izdelava

- moški

- Način

- več

- Masa

- max širine

- pomeni

- merjenje

- ukrepe

- mediji

- medicinski

- zdravstvena oskrba

- zdravila

- član

- Moški

- Metoda

- Metodologija

- Metode

- Mexico

- morda

- moti

- minimiziranje

- ogledalo

- Omiliti

- mešano

- ML

- modeli

- spremenite

- molekularno

- Denarno

- Denar

- več

- Najbolj

- premikanje

- premikaj se naprej

- premikanje

- nacionalni

- Narava

- Nimate

- potrebujejo

- potrebe

- mreža

- Novo

- novice

- Naslednja

- normalno

- predvsem

- of

- velikokrat

- Staro

- on

- ONE

- Priložnosti

- Priložnost

- optimizacija

- Da

- Organizirano

- izvirno

- Ostalo

- Rezultat

- opisano

- Splošni

- Premagajte

- lastne

- Kisik

- plošča

- del

- partnerji

- preteklosti

- Bolnik

- bolniki

- peer

- ljudje

- Dojemanje

- popolna

- performance

- opravlja

- mogoče

- oseba

- Osebni

- Prilagojene

- perspektive

- slika

- Kraj

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Predvajaj

- Točka

- politike

- policija

- slaba

- prebivalstvo

- prebivalstva

- potencial

- natančna

- Ravno

- Precision

- napovedati

- napoved

- Napovedi

- predstaviti

- prevladujoč

- prejšnja

- Predhodna

- Prednost

- zapor

- zaporniki

- Težave

- Postopki

- Postopek

- Procesi

- strokovnjaki

- ugledni

- Obljuba

- obetaven

- predlagano

- Beljakovine

- Beljakovine

- proxy

- impulz

- dal

- Vprašanja in odgovori

- količinsko

- vprašanje

- Dirka

- rasne pristranskosti

- rasizem

- Cene

- precej

- pravo

- resnični svet

- Reality

- Razlogi

- Rekapitulacija

- prejeti

- nedavno

- Priznanje

- priznana

- evidence

- zmanjša

- registra

- okrepi

- sprostitev

- sprosti

- pomembno

- odstrani

- Odstranjeno

- odstranjevanje

- zamenjajte

- predstavljajo

- predstavlja

- obvezna

- zahteva

- Raziskave

- raziskovalec

- raziskovalci

- Odgovor

- ponovno zagnan

- omejeno

- povzroči

- Rezultati

- razkrivajo

- Razkrije

- nazaj

- pregleda

- znebi

- Tveganje

- dejavniki tveganja

- vloga

- hiteti

- Enako

- <span style="color: #f7f7f7;">Šola</span>

- znanstveno

- Znanstvenik

- Znanstveniki

- vidi

- Zaporedje

- Serum

- služi

- Zasedanje

- nastavite

- Kompleti

- huda

- delitev

- shouldnt

- Prikaži

- pokazale

- Razstave

- bistveno

- Podoben

- situacije

- Skin

- So

- socialna

- Društvo

- Software

- SOLVE

- nekaj

- nekdo

- Nekaj

- strokovnjaki

- določeno

- porabljen

- Osebje

- Začetek

- Začetek

- Države

- Statistično

- Status

- Korak

- STONE

- ustavljanje

- naravnost

- strategije

- ulica

- stres

- močna

- strukturno

- Boriti se

- Študije

- študija

- predmet

- taka

- Predlaga

- superior

- podpora

- sistem

- sistemsko

- sistemi

- Bodite

- meni

- ciljna

- ciljno

- skupina

- Pogoji

- Test

- Testiranje

- da

- O

- Prihodnost

- njihove

- Njih

- zato

- te

- stvari

- tisoče

- čas

- do

- danes

- tudi

- orodja

- temo

- Vlak

- usposobljeni

- usposabljanje

- pregleden

- Zdravljenje

- sojenje

- Res

- Zaupajte

- Vrste

- tipično

- Konec koncev

- odkrijte

- pod

- podlage

- razumeli

- Velika

- Združene države Amerike

- Universal

- univerza

- nepredvidljivo

- us

- Uporaba

- uporaba

- navadno

- POTRDI

- raznolikost

- Proti

- Ranljivi

- način..

- načini

- Dobro

- Kaj

- Kaj je

- ki

- medtem

- bele

- WHO

- celoti

- bo

- z

- v

- brez

- Ženske

- delo

- deluje

- bi

- pisni

- let

- Vi

- Mlajši

- Vaša rutina za

- zefirnet