Hitro inženirstvo je postalo bistvena veščina za vsakogar, ki dela z velikimi jezikovnimi modeli (LLM) za ustvarjanje visokokakovostnih in ustreznih besedil. Čeprav se o inženiringu besedilnih pozivov na veliko razpravlja, je inženiring vizualnih pozivov nastajajoče področje, ki zahteva pozornost. Vizualni pozivi lahko vključujejo omejevalne okvirje ali maske, ki vodijo modele vida pri ustvarjanju ustreznih in natančnih rezultatov. V tej objavi raziskujemo osnove inženiringa vizualnih pozivov, njegove prednosti in kako ga je mogoče uporabiti za rešitev specifičnega primera uporabe: segmentacija slike za avtonomno vožnjo.

V zadnjih letih je področje računalniškega vida priča pomembnemu napredku na področju segmentacije slike. Eden takih prebojev je Model karkoli segmenta (SAM) Meta AI, ki ima potencial za revolucijo segmentacije na ravni objekta z urjenjem z nič ali nekaj posnetki. V tej objavi uporabljamo model SAM kot primer temeljnega modela vizije in raziskujemo njegovo uporabo na Nabor podatkov BDD100K, raznolik nabor podatkov o avtonomni vožnji za heterogeno večopravilno učenje. Z združevanjem prednosti SAM z bogatimi podatki, ki jih zagotavlja BDD100K, prikazujemo potencial vizualnega hitrega inženiringa z različnimi različicami SAM. Po navdihu LangChain okvir za jezikovne modele, predlagamo vizualno verigo za izvajanje vizualnih pozivov s kombiniranjem modelov zaznavanja objektov s SAM.

Čeprav se ta objava osredotoča na avtonomno vožnjo, so obravnavani koncepti široko uporabni na področjih, ki imajo bogate aplikacije, ki temeljijo na viziji, kot so zdravstvo in znanosti o življenju ter mediji in zabava. Začnimo z učenjem nekaj več o tem, kaj je pod pokrovom temeljnega modela vizije, kot je SAM. Smo uporabili Amazon SageMaker Studio na primerku ml.g5.16xlarge za to objavo.

Model karkoli segmenta (SAM)

Temeljni modeli so veliki modeli strojnega učenja (ML), ki so usposobljeni za ogromno količino podatkov in jih je mogoče pozvati ali natančno nastaviti za primere uporabe, specifične za nalogo. Tukaj raziskujemo model Segment Anything Model (SAM), ki je temeljni model za vizijo, zlasti segmentacijo slike. Vnaprej je usposobljen za ogromen nabor podatkov z 11 milijoni slik in 1.1 milijarde mask, zaradi česar je v času pisanja največji nabor podatkov o segmentaciji. Ta obsežen nabor podatkov pokriva široko paleto objektov in kategorij, s čimer SAM zagotavlja raznolik in obsežen vir podatkov za usposabljanje.

Model SAM je usposobljen za razumevanje predmetov in lahko izpiše segmentacijske maske za kateri koli predmet v slikah ali video okvirjih. Model omogoča vizualni hitri inženiring, ki vam omogoča, da zagotovite vnose, kot so besedilo, točke, omejevalni okvirji ali maske za ustvarjanje nalepk brez spreminjanja izvirne slike. SAM je na voljo v treh velikostih: osnovni (ViT-B, 91 milijonov parametrov), veliki (ViT-L, 308 milijonov parametrov) in ogromni (ViT-H, 636 milijonov parametrov), ki ustrezajo različnim računalniškim zahtevam in primerom uporabe.

Primarna motivacija za SAM je izboljšanje segmentacije na ravni objekta z minimalnimi vzorci usposabljanja in epohami za vse zanimive objekte. Moč SAM je v njegovi zmožnosti prilagajanja novim distribucijam slik in nalogam brez predhodnega znanja, funkcija, znana kot prenos zero-shot. Ta prilagodljivost je dosežena z usposabljanjem na obsežnem naboru podatkov SA-1B, ki je pokazal impresivno zmogljivost brez strela in je presegel številne predhodne popolnoma nadzorovane rezultate.

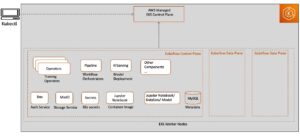

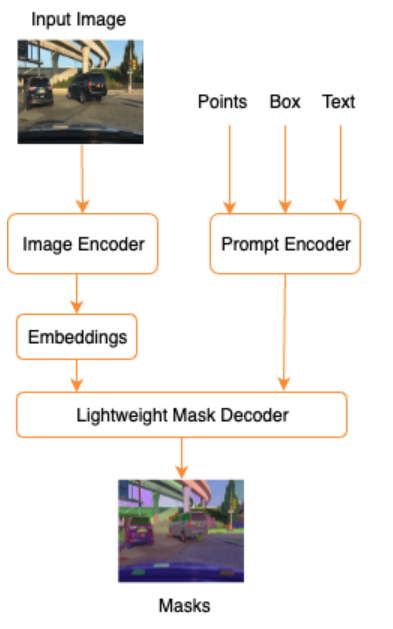

Kot je prikazano v naslednji arhitekturi za SAM, postopek generiranja segmentacijskih mask vključuje tri korake:

- Kodirnik slike ustvari enkratno vdelavo slike.

- Kodirnik pozivov pretvori kateri koli poziv v vdelani vektor za poziv.

- Lahki dekoder združuje informacije iz kodirnika slike in kodirnika pozivov za predvidevanje segmentacijskih mask.

Kot primer lahko zagotovimo vhod s sliko in omejevalnim poljem okoli predmeta, ki nas zanima na tej sliki (npr. srebrni avto ali vozni pas), model SAM pa bi izdelal segmentacijske maske za ta predmet.

Vizualni hitri inženiring

Hitro inženirstvo se nanaša na strukturiranje vhodnih podatkov v model, zaradi česar model razume namen in ustvari želeni rezultat. Z inženiringom besedilnih pozivov lahko strukturirate vhodno besedilo s spremembami, kot so izbira besed, oblikovanje, vrstni red in drugo, da dobite želeni rezultat. Vizualni hitri inženiring predpostavlja, da uporabnik dela v vizualni modalnosti (slika ali video), in zagotavlja vnose. Sledi neizčrpen seznam možnih načinov za zagotavljanje vnosa v generativni model AI v vizualni domeni:

- Točka – singularna (x, y) koordinatna točka v slikovni ravnini

- Točke – več (x, y) koordinatnih točk, ki niso nujno povezane med seboj

- Omejevalni okvir – niz štirih vrednosti (x, y, w, h), ki določajo pravokotno območje v slikovni ravnini

- Kontura – niz (x, y) koordinatnih točk v slikovni ravnini, ki tvorijo zaprto obliko

- Maska – Niz enake velikosti kot slika z delno masko predmeta zanimanja

Raziščimo, kako se to lahko uporabi za vnaprej pripravljen model SAM, z upoštevanjem tehnik vizualnega hitrega inženiringa. Uporabili smo osnovno različico vnaprej usposobljenega modela.

Poziv brez strela z vnaprej pripravljenim modelom SAM

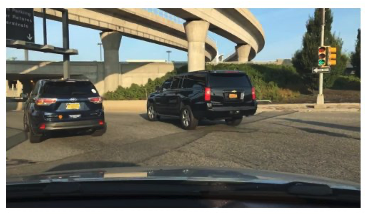

Za začetek raziščimo pristop zero-shot. Sledi vzorčna slika iz nabora podatkov o usposabljanju, posneta s sprednjo kamero vozila.

Segmentacijske maske za vse predmete iz slike lahko dobimo brez eksplicitnega vizualnega poziva samodejno generiranje mask samo z vhodno sliko. Na naslednji sliki vidimo segmentirane dele avtomobila, ceste, prometnega znaka, registrske tablice, nadvoza, stebričkov, znakov in drugega.

Vendar ta rezultat ni takoj uporaben zaradi naslednjih razlogov:

- Avtomobili niso segmentirani kot celota, ampak po delih. Za večino modelov zaznavanja, na primer, nas pravzaprav ne zanima, ali ima vsaka pnevmatika ločeno izhodno masko. To velja tudi pri iskanju drugih znanih zanimivih predmetov, kot so cesta, rastlinje, znaki itd.

- Deli slike, ki so uporabni za opravila v smeri toka, kot je vozno območje, so razdeljeni brez pojasnila. Po drugi strani pa so podobni primerki identificirani ločeno in morda nas zanima združevanje podobnih objektov (panoptično v primerjavi s segmentacijo primerkov).

Vizualni hitri inženiring z vnaprej usposobljenim modelom SAM

Na srečo SAM podpira zagotavljanje pozivov za vnos in kot vhode lahko uporabimo točke, nize točk in omejevalne okvirje. S temi posebnimi navodili pričakujemo, da bo SAM bolje deloval s segmentacijami, ki se osredotočajo na določene točke ali področja. To lahko primerjamo s predlogo jezikovnega poziva"What is a good name for a company that makes {product}?"

kjer je vnos skupaj s to predlogo poziva uporabnika {product}. {product} je vhodna reža. Pri vizualnem pozivu so omejevalna polja, točke ali maske vhodne reže.

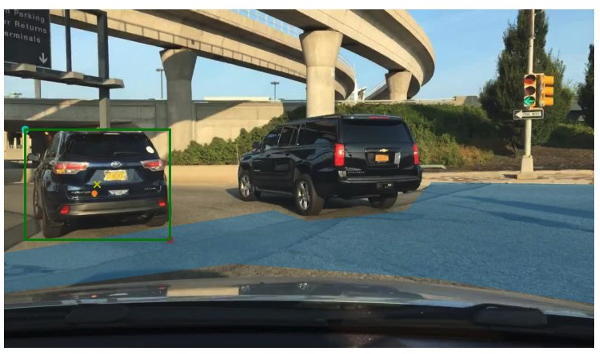

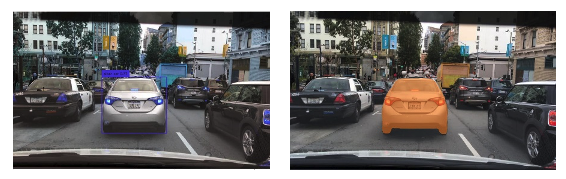

Naslednja slika prikazuje izvirno omejevalno polje resnice o tleh okoli vozil in zaplato voznega območja iz podatkov o resnici o tleh BDD100K. Na sliki je prikazana tudi vnosna točka (rumeni X) na sredini zelenega omejevalnega polja, na katero se bomo sklicevali v naslednjih nekaj razdelkih.

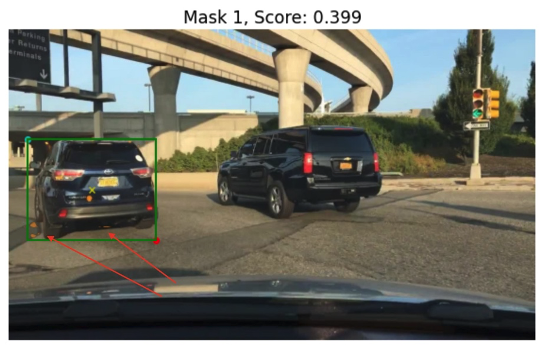

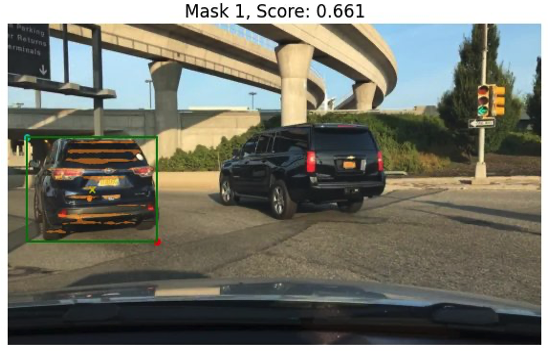

Poskusimo ustvariti masko za avto na levi z zelenim omejevalnim poljem kot vhodom v SAM. Kot je prikazano v naslednjem primeru, osnovni model SAM v resnici ne najde ničesar. To je razvidno tudi iz nizke ocene segmentacije. Ko podrobneje pogledamo segmentacijske maske, vidimo, da so majhne regije, vrnjene kot maske (usmerjene z rdečimi puščicami), ki v resnici niso uporabne za nobeno nadaljnjo aplikacijo.

Poskusimo kombinacijo omejevalnega polja in točke kot vhodnega vizualnega poziva. Rumeni križ na prejšnji sliki je središče omejevalnega polja. Če kot poziv navedemo koordinate (x,y) te točke skupaj z omejitvijo omejevalnega polja, dobimo naslednjo masko in nekoliko višji rezultat. To še vedno ni uporabno na noben način.

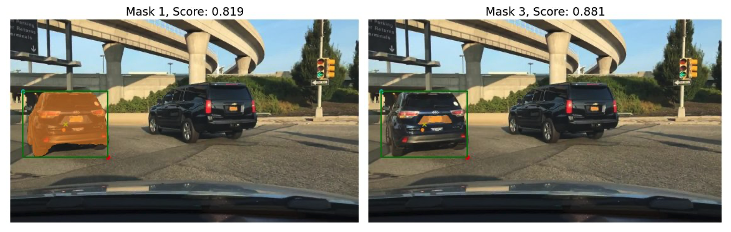

Končno lahko z osnovnim vnaprej usposobljenim modelom zagotovimo samo vhodno točko kot poziv (brez omejevalnega polja). Naslednje slike prikazujejo dve od treh najboljših mask, ki so se nam zdele zanimive.

Maska 1 segmentira celoten avto, medtem ko maska 3 segmentira območje, ki drži registrsko tablico avtomobila blizu rumenega križa (poziv za vnos). Maska 1 še vedno ni tesna, čista maska okoli avtomobila; to kaže na kakovost modela, za katero lahko domnevamo, da narašča z velikostjo modela.

Z istim pozivom za vnos lahko poskusimo večje vnaprej pripravljene modele. Naslednje slike prikazujejo naše rezultate. Pri uporabi ogromnega predhodno usposobljenega modela SAM je maska 3 celoten avto, medtem ko lahko masko 1 in 2 uporabite za ekstrakcijo registrske tablice.

Velika različica modela SAM prav tako zagotavlja podobne rezultate.

Postopek, skozi katerega smo šli tukaj, je podoben ročnemu načrtovanju pozivov za besedilne pozive, ki jih morda že poznate. Upoštevajte, da nedavna izboljšava modela SAM za visoko kakovostno segmentiranje zagotavlja veliko boljše izhode, specifične za objekte in kontekst. V našem primeru ugotovimo, da zero-shot pozivi z besedilnimi in vizualnimi pozivi (point, box, in point and box vnosi) ne izboljšajo drastično rezultatov, kot smo videli zgoraj.

Pozivne predloge in vizualne verige

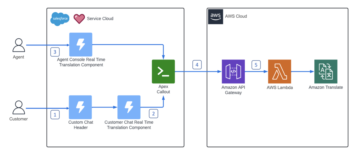

Kot lahko vidimo iz prejšnjih primerov zero-shot, se SAM trudi identificirati vse predmete v prizoru. To je dober primer, kako lahko izkoristimo prednosti hitrih predlog in vizualnih verig. Vizualna veriga se zgleduje po konceptu verige v priljubljenem ogrodju LangChain za jezikovne aplikacije. Pomaga verižiti vire podatkov in LLM za ustvarjanje rezultatov. Na primer, lahko uporabimo verigo API, da pokličemo API in prikličemo LLM, da odgovori na vprašanje na podlagi odgovora API.

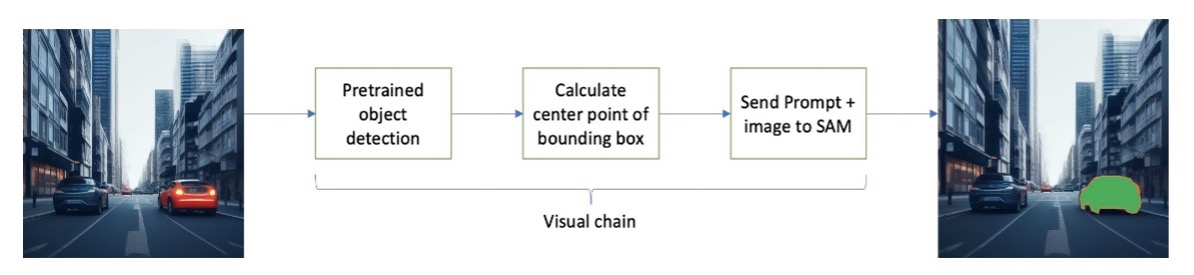

Po navdihu LangChaina predlagamo zaporedno vizualno verigo, ki je videti kot naslednja slika. Uporabljamo orodje (kot je vnaprej usposobljen model za zaznavanje objektov), da dobimo začetne omejevalne okvirje, izračunamo točko v središču omejevalnega okvirja in to uporabimo za prikaz modela SAM z vhodno sliko.

Naslednja slika na primer prikazuje segmentacijske maske kot rezultat izvajanja te verige.

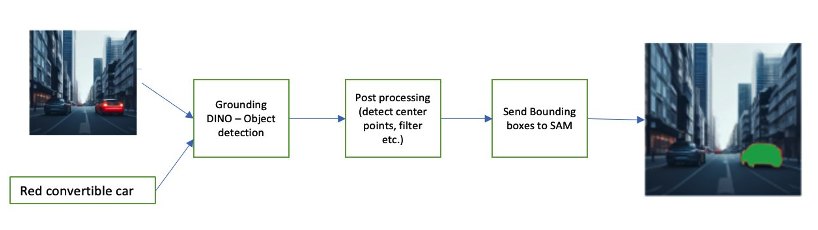

Drug primer verige lahko vključuje vnos besedila predmeta, ki ga uporabnik želi identificirati. Za izvedbo tega smo zgradili cevovod z uporabo Ozemljitev DINO, model zaznavanja objektov, ki poziva SAM k segmentaciji.

Grounding DINO je model zero-shot zaznavanja objektov, ki lahko izvaja zaznavanje objektov z besedilom, ki vsebuje imena kategorij (kot je »semafor« ali »tovornjak«) in izraze (kot je »rumeni tovornjak«). Sprejema pare besedila in slike za izvedbo zaznavanja predmeta. Temelji na transformatorski arhitekturi in omogoča navzkrižne modalitete z besedilnimi in slikovnimi podatki. Če želite izvedeti več o ozemljitvi DINO, glejte Ozemljitev DINO: Poročite se z DINO z ozemljenim predhodnim usposabljanjem za zaznavanje odprtih predmetov. To ustvari omejevalne okvire in oznake ter jih je mogoče nadalje obdelati za ustvarjanje središčnih točk, filtriranje na podlagi oznak, pragov in več. To se uporablja (polja ali točke) kot poziv SAM za segmentacijo, ki izpiše maske.

Sledi nekaj primerov, ki prikazujejo vhodno besedilo, izhod DINO (omejitveni okvirji) in končni izhod SAM (maske segmentacije).

Naslednje slike prikazujejo rezultat za »rumeni tovornjak«.

Naslednje slike prikazujejo rezultat za »srebrni avto«.

Naslednja slika prikazuje rezultat za »vozni pas«.

Ta cevovod lahko uporabimo za gradnjo vizualne verige. Naslednji delček kode pojasnjuje ta koncept:

pipeline = [object_predictor, segment_predictor]

image_chain = ImageChain.from_visual_pipeline(pipeline, image_store, verbose=True)

image_chain.run('All silver cars', image_id='5X3349')Čeprav je to preprost primer, je ta koncept mogoče razširiti na obdelavo virov iz kamer na vozilih za izvajanje sledenja predmetom, redigiranje podatkov osebnih podatkov (PII) in več. Omejitvene okvirje lahko dobimo tudi iz manjših modelov ali v nekaterih primerih z uporabo standardnih orodij za računalniški vid. Precej enostavno je uporabiti predhodno usposobljen model ali storitev, kot je Amazon Rekognition, da dobite začetne (vizualne) oznake za svoj poziv. V času pisanja je na Amazon SageMaker Jumpstart na voljo več kot 70 modelov za zaznavanje predmetov in Amazonsko ponovno vžiganje že identificira več uporabnih kategorij predmetov na slikah, vključno z avtomobili, pešci in drugimi vozili.

Nato si ogledamo nekaj kvantitativnih rezultatov, povezanih z zmogljivostjo modelov SAM s podnaborom podatkov BDD100K.

Kvantitativni rezultati

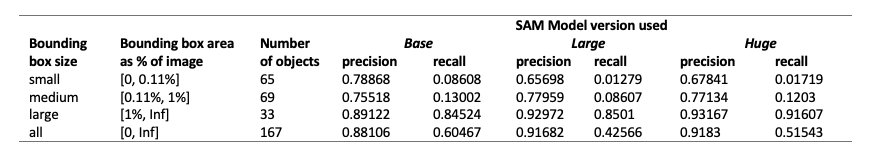

Naš cilj je primerjati delovanje treh vnaprej pripravljenih modelov, ko dobimo enak vizualni poziv. V tem primeru kot vizualni vhod uporabimo središčno točko lokacije objekta. Učinkovitost primerjamo glede na velikost predmeta (sorazmerno z velikostjo slike) — majhen (površina <0.11 %), srednji (0.11 % < površina < 1 %) in velik (površina > 1 %). Pragove območja omejevalnega okvirja določa skupni predmeti v kontekstu (COCO). meritve vrednotenja [Lin et al., 2014].

Ocena je na ravni slikovnih pik in uporabljamo naslednje metrike ocenjevanja:

- Natančnost = (število ustreznih in pridobljenih primerkov) / (skupno število pridobljenih primerkov)

- Priklic = (število ustreznih in pridobljenih primerkov) / (skupno število ustreznih primerkov)

- Primeri tukaj so vsaka slikovna pika znotraj omejevalnega polja predmeta zanimanja

Naslednja tabela poroča o zmogljivosti treh različnih različic modela SAM (osnovna, velika in velika). Te različice imajo tri različne kodirnike: ViT-B (osnovni), ViT-L (velik), ViT-H (velik). Kodirniki imajo različna števila parametrov, pri čemer ima osnovni model manj parametrov kot velik, velik pa je manjši od ogromnega. Čeprav povečanje števila parametrov kaže izboljšano zmogljivost pri večjih objektih, to ne velja za manjše objekte.

Natančna nastavitev SAM za vaš primer uporabe

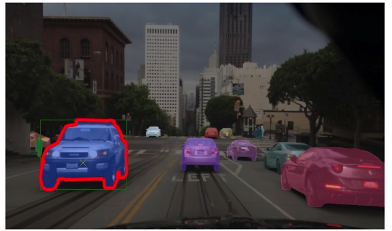

V mnogih primerih neposredna uporaba predhodno usposobljenega modela SAM morda ne bo zelo uporabna. Na primer, poglejmo tipičen prizor v prometu – naslednja slika je izhod iz modela SAM z naključno vzorčenimi točkami poziva kot vhodom na levi in dejanskimi oznakami iz naloge semantične segmentacije iz BDD100K na desni. Ti so očitno zelo različni.

Zaznavni nizi v AV-jih lahko zlahka uporabljajo drugo sliko, ne pa tudi prve. Po drugi strani pa obstaja nekaj uporabnih izhodov iz prve slike, ki jih je mogoče uporabiti, in da model ni bil izrecno učen na primer o oznakah voznih pasov, segmentaciji pločnikov, maskah registrskih tablic itd. Model SAM lahko natančno prilagodimo, da izboljšamo rezultate segmentacije. Za izvedbo te natančne nastavitve smo ustvarili nabor podatkov za usposabljanje z uporabo podnabora segmentacije primerkov (500 slik) iz nabora podatkov BDD10K. To je zelo majhna podmnožica slik, vendar je naš namen dokazati, da se lahko osnovni modeli vizije (podobno kot LLM) dobro obnesejo za vaš primer uporabe s presenetljivo majhnim številom slik. Naslednja slika prikazuje vhodno sliko, izhodno masko (v modri barvi, z rdečo obrobo za avto na levi) in možne pozive (omejevalni okvir v zeleni in sredinska točka X v rumeni).

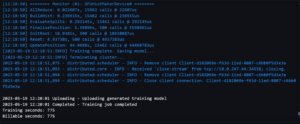

Izvedli smo natančno nastavitev s knjižnico Hugging Face na Amazon SageMaker Studio. Uporabili smo primerek ml.g4dn.xlarge za preizkuse osnovnega modela SAM in ml.g4dn.2xlarge za preizkuse ogromnega modela SAM. V naših začetnih poskusih smo opazili, da fina nastavitev osnovnega modela z omejevalnimi okvirji ni bila uspešna. Natančno nastavljeni in vnaprej usposobljeni modeli se iz prvotnih naborov podatkov niso mogli naučiti mask resnice na tleh, specifičnih za avtomobil. Dodajanje poizvedovalnih točk v natančno nastavitev prav tako ni izboljšalo usposabljanja.

Nato lahko poskusimo natančno prilagoditi ogromen model SAM za 30 epoh z zelo majhnim naborom podatkov (500 slik). Izvirna zemeljska maska resnice je videti kot naslednja slika za oznako tipa avtomobil.

Kot je prikazano na naslednjih slikah, prvotna vnaprej usposobljena različica ogromnega modela s posebnim pozivom za omejevalni okvir (zeleno) ne daje rezultatov, medtem ko natančno nastavljena različica daje rezultate (še vedno ni natančen, vendar je bila fina nastavitev odrezana izklop po 40 epohah in z zelo majhnim naborom podatkov za usposabljanje 500 slik). Prvotni, vnaprej usposobljeni ogromen model ni mogel predvideti mask za nobeno od slik, ki smo jih testirali. Kot primer nadaljnje aplikacije je mogoče natančno nastavljen model uporabiti v potekih dela pred označevanjem, kot je opisan v Modul za samodejno označevanje za napredne sisteme za pomoč voznikom, ki temeljijo na globokem učenju, na AWS.

zaključek

V tem prispevku smo razpravljali o temeljnem modelu vizije, znanem kot Segment Anything Model (SAM) in njegovi arhitekturi. Model SAM smo uporabili za razpravo o vizualnem sumplingu in različnih vložkih v inženiring vizualnega sumplinga. Raziskali smo, kako delujejo različni vizualni pozivi in njihove omejitve. Opisali smo tudi, kako vizualne verige povečajo zmogljivost z uporabo samo enega poziva, podobno kot API LangChain. Nato smo podali kvantitativno oceno treh vnaprej pripravljenih modelov. Nazadnje smo razpravljali o natančno nastavljenem modelu SAM in njegovih rezultatih v primerjavi z izvirnim osnovnim modelom. Natančna nastavitev temeljnih modelov pomaga izboljšati zmogljivost modela za posebne naloge, kot je segmentacija. Opozoriti je treba, da model SAM zaradi zahtev po virih omejuje uporabo za primere uporabe v realnem času in sklepanje na robu v trenutnem stanju. Upamo, da bi s prihodnjimi ponovitvami in izboljšanimi tehnikami zmanjšali računalniške zahteve in izboljšali zakasnitev.

Upamo, da vas bo ta objava spodbudila k raziskovanju vizualnih pozivov za vaše primere uporabe. Ker je to še vedno nastajajoča oblika hitrega inženiringa, je treba veliko odkriti v smislu vizualnih pozivov, vizualnih verig in delovanja teh orodij. Amazon SageMaker je popolnoma upravljana platforma ML, ki razvijalcem omogoča raziskovanje velikih jezikovnih in vizualnih modelov ter izdelavo generativnih aplikacij AI. Začnite graditi prihodnost z AWS že danes.

O avtorjih

Gopi Krishnamurthy je višji arhitekt rešitev AI/ML pri Amazon Web Services s sedežem v New Yorku. Sodeluje z velikimi strankami v avtomobilski industriji kot njihov zaupanja vreden svetovalec za preoblikovanje njihovih delovnih obremenitev strojnega učenja in selitev v oblak. Njegovi glavni interesi vključujejo globoko učenje in brezstrežniške tehnologije. Izven službe rad preživlja čas z družino in raziskuje širok spekter glasbe.

Gopi Krishnamurthy je višji arhitekt rešitev AI/ML pri Amazon Web Services s sedežem v New Yorku. Sodeluje z velikimi strankami v avtomobilski industriji kot njihov zaupanja vreden svetovalec za preoblikovanje njihovih delovnih obremenitev strojnega učenja in selitev v oblak. Njegovi glavni interesi vključujejo globoko učenje in brezstrežniške tehnologije. Izven službe rad preživlja čas z družino in raziskuje širok spekter glasbe.

Shreyas Subramanian je glavni specialist za AI/ML Solutions Architect in strankam pomaga z uporabo strojnega učenja pri reševanju njihovih poslovnih izzivov s platformo AWS. Shreyas ima izkušnje z optimizacijo velikega obsega in strojnim učenjem ter z uporabo strojnega učenja in učenja s krepitvijo za pospeševanje optimizacijskih nalog.

Shreyas Subramanian je glavni specialist za AI/ML Solutions Architect in strankam pomaga z uporabo strojnega učenja pri reševanju njihovih poslovnih izzivov s platformo AWS. Shreyas ima izkušnje z optimizacijo velikega obsega in strojnim učenjem ter z uporabo strojnega učenja in učenja s krepitvijo za pospeševanje optimizacijskih nalog.

Sujitha Martin je uporabni znanstvenik v Generative AI Innovation Center (GAIIC). Njeno strokovno znanje je na področju gradnje rešitev za strojno učenje, ki vključujejo računalniški vid in obdelavo naravnega jezika za različne industrijske vertikale. Zlasti ima bogate izkušnje z delom na področju zavedanja situacije, osredotočenega na človeka, in učenja, ki temelji na znanju, za zelo avtonomne sisteme.

Sujitha Martin je uporabni znanstvenik v Generative AI Innovation Center (GAIIC). Njeno strokovno znanje je na področju gradnje rešitev za strojno učenje, ki vključujejo računalniški vid in obdelavo naravnega jezika za različne industrijske vertikale. Zlasti ima bogate izkušnje z delom na področju zavedanja situacije, osredotočenega na človeka, in učenja, ki temelji na znanju, za zelo avtonomne sisteme.

Francisco Calderon je podatkovni znanstvenik v Generative AI Innovation Center (GAIIC). Kot član GAIIC pomaga odkrivati umetnost mogočega s strankami AWS, ki uporabljajo tehnologije Generative AI. V prostem času Francisco rad igra glasbo in kitaro, igra nogomet s svojima hčerkama in uživa v času s svojo družino.

Francisco Calderon je podatkovni znanstvenik v Generative AI Innovation Center (GAIIC). Kot član GAIIC pomaga odkrivati umetnost mogočega s strankami AWS, ki uporabljajo tehnologije Generative AI. V prostem času Francisco rad igra glasbo in kitaro, igra nogomet s svojima hčerkama in uživa v času s svojo družino.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/foundational-vision-models-and-visual-prompt-engineering-for-autonomous-driving-applications/

- :ima

- : je

- :ne

- :kje

- $GOR

- 1

- 100

- 11

- 179

- 2014

- 214

- 225

- 30

- 40

- 500

- 7

- 70

- 804

- 91

- 97

- a

- sposobnost

- Sposobna

- O meni

- nad

- pospeševanje

- Sprejema

- natančna

- doseže

- dejanska

- prilagodijo

- dodajanje

- napredno

- napredek

- Prednost

- svetovalec

- po

- AI

- AI / ML

- AL

- vsi

- omogoča

- skupaj

- že

- Prav tako

- Čeprav

- Amazon

- Amazonsko ponovno vžiganje

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- in

- odgovor

- kaj

- kdo

- karkoli

- API

- primerno

- uporaba

- aplikacije

- uporabna

- pristop

- Arhitektura

- SE

- OBMOČJE

- območja

- okoli

- Array

- Umetnost

- AS

- pomoč

- domnevati

- predpostavlja

- At

- pozornosti

- avtomobilska

- avtonomno

- Na voljo

- zavest

- AWS

- ozadje

- baza

- temeljijo

- Osnove

- BE

- ker

- postanejo

- bilo

- začetek

- zadaj

- Prednosti

- Boljše

- Billion

- Modra

- meja

- Pasovi

- škatle

- preboj

- splošno

- izgradnjo

- gradbeniki

- Building

- zgrajena

- poslovni

- vendar

- by

- izračun

- klic

- kamera

- kamere

- CAN

- Lahko dobiš

- voziček

- ki

- avtomobili

- primeru

- primeri

- kategorije

- Kategorija

- gostinstvo

- center

- verige

- verige

- izzivi

- izbira

- mesto

- čiščenje

- Zapri

- zaprto

- tesno

- Cloud

- koko

- Koda

- kombinacija

- združuje

- združevanje

- Skupno

- podjetje

- primerjate

- v primerjavi z letom

- računalniški

- Izračunajte

- računalnik

- Računalniška vizija

- Koncept

- koncepti

- ozadje

- koordinate

- Core

- Ovitki

- ustvaril

- Cross

- Trenutna

- Trenutno stanje

- Stranke, ki so

- Cut

- datum

- podatkovni znanstvenik

- nabor podatkov

- globoko

- globoko učenje

- opredeliti

- opredeljen

- Dokazano

- opisano

- želeno

- Odkrivanje

- drugačen

- Dino

- neposredno

- odkriti

- razpravlja

- razpravljali

- Distribucije

- razne

- do

- Ne

- domena

- domen

- dont

- drastično

- voznik

- vožnjo

- 2

- e

- E&T

- vsak

- enostavno

- Edge

- vdelava

- smirkovim

- omogoča

- omogočanje

- spodbuja

- Inženiring

- Zabava

- Celotna

- epohe

- bistvena

- Ocena

- Primer

- Primeri

- ekspanziven

- pričakovati

- izkušnje

- Poskusi

- strokovno znanje

- Pojasni

- Razlaga

- izrecno

- raziskuje

- Raziskano

- izrazi

- obsežen

- Obširne izkušnje

- ekstrakt

- Obraz

- pošteno

- seznanjeni

- družina

- Feature

- Nekaj

- Polje

- Slika

- filter

- končna

- Najdi

- prva

- Osredotoča

- osredotoča

- po

- za

- obrazec

- Fundacija

- temeljno

- štiri

- Okvirni

- Francisco

- iz

- spredaj

- polno

- v celoti

- nadalje

- Prihodnost

- ustvarjajo

- ustvarja

- ustvarjajo

- generativno

- Generativna AI

- dobili

- dana

- daje

- dobro

- Zelen

- Igrišče

- vodi

- strani

- Imajo

- ob

- he

- zdravstveno varstvo

- Pomaga

- jo

- tukaj

- visoka

- visoka kvaliteta

- več

- zelo

- njegov

- drži

- napa

- upam,

- Kako

- HTML

- HTTPS

- velika

- identificirati

- identificira

- identificirati

- identifikacijo

- slika

- slike

- takoj

- izvajati

- Impresivno

- izboljšanje

- izboljšalo

- Izboljšanje

- in

- vključujejo

- Vključno

- Povečajte

- Poveča

- narašča

- Industrija

- Podatki

- infused

- začetna

- Inovacije

- vhod

- vhodi

- navdih

- primer

- Segmentacija primerka

- Navodila

- namen

- obresti

- zainteresirani

- Zanimivo

- interesi

- v

- vključujejo

- vključujejo

- IT

- ponovitve

- ITS

- jpg

- samo

- samo en

- znanje

- znano

- label

- Oznake

- Lane

- jezik

- velika

- obsežne

- večja

- Največji

- nazadnje

- Latenca

- UČITE

- učenje

- levo

- manj

- Stopnja

- Knjižnica

- Licenca

- Leži

- življenje

- Life Sciences

- lahek

- kot

- všeč mi je

- omejitve

- Meje

- lin

- Seznam

- malo

- LLM

- kraj aktivnosti

- Poglej

- si

- POGLEDI

- nizka

- stroj

- strojno učenje

- IZDELA

- Izdelava

- upravlja

- Navodilo

- več

- poročen

- Maska

- Maske

- ogromen

- Maj ..

- pomeni

- mediji

- srednje

- član

- Meta

- Meritve

- selitev

- milijonov

- moti

- minimalna

- ML

- Model

- modeli

- spremembe

- Moduli

- več

- Najbolj

- Motivacija

- veliko

- več

- Glasba

- Ime

- Imena

- naravna

- Obdelava Natural Language

- nujno

- Novo

- NY

- New York City

- Naslednja

- št

- opozoriti

- Številka

- predmet

- Zaznavanje objektov

- Cilj

- predmeti

- of

- off

- on

- ONE

- optimizacija

- or

- izvirno

- Ostalo

- naši

- ven

- Rezultat

- izhod

- izhodi

- zunaj

- več

- parov

- parameter

- parametri

- zlasti

- deli

- Patch

- Dojemanje

- Izvedite

- performance

- opravljeno

- Osebno

- slika

- stebri

- plinovod

- pixel

- letalo

- platforma

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Predvajaj

- igranje

- Točka

- točke

- Popular

- mogoče

- Prispevek

- potencial

- moč

- napovedati

- primarni

- , ravnateljica

- Predhodna

- Postopek

- Predelano

- obravnavati

- proizvodnjo

- proizvaja

- Delež

- predlaga

- Dokaži

- zagotavljajo

- če

- zagotavlja

- zagotavljanje

- Namen

- kakovost

- količinsko

- Količina

- vprašanje

- območje

- v realnem času

- res

- Razlogi

- nedavno

- Rdeča

- zmanjša

- glejte

- nanaša

- okolica

- regije

- povezane

- pomembno

- Poročila

- Zahteve

- zahteva

- vir

- spoštovanje

- Odgovor

- povzroči

- Rezultati

- revolucijo

- Rich

- Pravica

- cesta

- tek

- sagemaker

- sam

- Enako

- Videl

- Lestvica

- Prizor

- ZNANOSTI

- Znanstvenik

- rezultat

- drugi

- oddelki

- glej

- videl

- Segment

- segmentacija

- segmentih

- višji

- ločena

- Brez strežnika

- Storitev

- Storitve

- nastavite

- več

- je

- shouldnt

- Prikaži

- predstavitev

- pokazale

- Razstave

- podpisati

- pomemben

- Znaki

- Silver

- Podoben

- Enostavno

- ednina

- Velikosti

- velikosti

- spretnost

- reža

- reže

- majhna

- manj

- delček

- So

- Soccer

- rešitve

- SOLVE

- nekaj

- vir

- Viri

- specialist

- specifična

- posebej

- preživeti

- po delih

- Skladovnice

- standardna

- Začetek

- Država

- Koraki

- Še vedno

- naravnost

- prednosti

- Struktura

- strukturiranje

- Borbe

- uspešno

- taka

- Podpira

- presegajo

- sistemi

- miza

- Bodite

- sprejeti

- Naloga

- Naloge

- tehnike

- Tehnologije

- Predloga

- predloge

- Pogoji

- Testiran

- testi

- besedilo

- besedilno

- kot

- da

- O

- Območje

- Osnove

- Prihodnost

- informacije

- njihove

- Tukaj.

- te

- ta

- mislil

- 3

- skozi

- čas

- Pnevmatike

- do

- danes

- orodje

- orodja

- vrh

- Skupaj za plačilo

- Sledenje

- Prometa

- usposobljeni

- usposabljanje

- Transform

- transformator

- tovornjak

- Res

- zaupa

- Resnica

- poskusite

- dva

- tip

- tipičen

- pod

- razumeli

- us

- uporabno

- Uporaba

- uporaba

- primeru uporabe

- primeri uporabe

- Rabljeni

- uporabnik

- uporabo

- Vrednote

- različnih

- Popravljeno

- vegetacijo

- Vozila

- različica

- različice

- vertikale

- zelo

- Video

- Vizija

- vizualna

- vs

- W

- je

- načini

- we

- web

- spletne storitve

- Dobro

- šla

- so bili

- Kaj

- Kaj je

- kdaj

- medtem ko

- ki

- celoti

- široka

- Širok spekter

- pogosto

- bo

- z

- v

- brez

- priča

- besede

- delo

- delovnih tokov

- deluje

- deluje

- bi

- pisanje

- X

- let

- york

- Vi

- Vaša rutina za

- zefirnet