Umetna inteligenca (AI) je postala pomembna in priljubljena tema v tehnološki skupnosti. Ko se je umetna inteligenca razvijala, smo videli, kako se pojavljajo različne vrste modelov strojnega učenja (ML). En pristop, znan kot ansambelsko modelarstvo, se hitro uveljavlja med podatkovnimi znanstveniki in praktiki. V tej objavi razpravljamo o tem, kaj so modeli ansambla in zakaj je njihova uporaba lahko koristna. Nato nudimo primer, kako lahko usposobite, optimizirate in uvedete svoje skupine po meri z uporabo Amazon SageMaker.

Skupinsko učenje se nanaša na uporabo več učnih modelov in algoritmov za pridobitev natančnejših napovedi kot kateri koli posamezen individualni učni algoritem. Dokazano je, da so učinkoviti v različnih aplikacijah in nastavitvah učenja, kot so kibernetska varnost [1] in odkrivanje goljufij, daljinsko zaznavanje, napovedovanje najboljših naslednjih korakov pri odločanju o financah, medicinska diagnoza in celo računalniški vid in obdelava naravnega jezika (NLP). naloge. Ponavadi kategoriziramo skupine glede na tehnike, ki jih uporabljamo za njihovo urjenje, njihovo sestavo in način, kako združujejo različne napovedi v en sam sklep. Te kategorije vključujejo:

- Povečanje – Zaporedno usposabljanje več šibkih učencev, kjer ima vsaka napačna napoved prejšnjih učencev v zaporedju večjo težo in vnos naslednjemu učencu, s čimer se ustvari močnejši učenec. Primeri vključujejo AdaBoost, Gradient Boosting in XGBoost.

- Bagging – Uporablja več modelov za zmanjšanje variance enega samega modela. Primeri vključujejo naključni gozd in dodatna drevesa.

- Zlaganje (mešanje) – Pogosto uporablja heterogene modele, kjer so napovedi vsakega posameznega ocenjevalca zložene skupaj in uporabljene kot vhodni podatki za končni ocenjevalec, ki obravnava napoved. Ta končni proces usposabljanja ocenjevalca pogosto uporablja navzkrižno preverjanje.

Obstaja več metod združevanja napovedi v eno samo, ki jo končno proizvede model, na primer uporaba metaocenjevalca, kot je linearni učenec, metoda glasovanja, ki uporablja več modelov za izdelavo napovedi na podlagi večinskega glasovanja za naloge klasifikacije, ali ansambelsko povprečenje za regresijo.

Čeprav številne knjižnice in ogrodja zagotavljajo implementacije modelov ansamblov, kot so XGBoost, CatBoost ali naključni gozd scikit-learn, se v tej objavi osredotočamo na ustvarjanje lastnih modelov in njihovo uporabo kot ansambel zlaganja. Vendar pa namesto uporabe namenskih virov za vsak model (namenska opravila usposabljanja in prilagajanja ter gostovanje končnih točk na model) usposabljamo, prilagajamo in uvajamo skupino po meri (več modelov) z uporabo enega samega opravila usposabljanja SageMaker in enega samega opravila prilagajanja ter uvesti na eno končno točko, s čimer se zmanjšajo možni stroški in operativni stroški.

Adijo: Pripeljite svoj ansambel

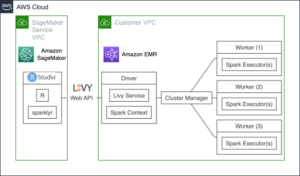

Obstaja več načinov za usposabljanje in uvajanje heterogenih modelov ansambla s SageMakerjem: vsak model lahko trenirate v ločeno usposabljanje in optimizirajte vsak model posebej z uporabo Samodejno prilagajanje modela Amazon SageMaker. Pri gostovanju teh modelov SageMaker ponuja različne stroškovno učinkovite načine za gostovanje več modelov na isti infrastrukturi najemnika. Podrobne vzorce uvajanja za tovrstne nastavitve lahko najdete v Modelni vzorci gostovanja v Amazon SageMaker, 1. del: Pogosti oblikovalski vzorci za izdelavo aplikacij ML na Amazon SageMaker. Ti vzorci vključujejo uporabo več končnih točk (za vsak usposobljen model) ali ene same končna točka več modelov, ali celo en sam končna točka z več vsebniki kjer je vsebnike mogoče klicati posamezno ali verižno v cevovodu. Vse te rešitve vključujejo metaocenjevalec (na primer v AWS Lambda funkcija), ki prikliče vsak model in izvaja funkcijo mešanja ali glasovanja.

Vendar pa lahko izvajanje več izobraževalnih del povzroči operativne in stroškovne stroške, zlasti če vaš ansambel zahteva usposabljanje na istih podatkih. Podobno gostovanje različnih modelov na ločenih končnih točkah ali vsebnikih in združevanje njihovih rezultatov napovedi za večjo natančnost zahteva večkratne klice in zato uvaja dodatna prizadevanja za upravljanje, stroške in spremljanje. Na primer, SageMaker podpira ansambelskih modelov ML z uporabo Triton Inference Server, vendar ta rešitev zahteva, da so modeli ali skupine modelov podprti z zaledjem Triton. Poleg tega so od stranke potrebna dodatna prizadevanja za nastavitev strežnika Triton in dodatno učenje za razumevanje delovanja različnih ozadij Triton. Zato imajo stranke raje enostavnejši način izvajanja rešitev, pri katerem morajo samo enkrat poslati poziv do končne točke in imeti možnost nadzora nad tem, kako se rezultati združujejo za ustvarjanje končnega rezultata.

Pregled rešitev

Da bi rešili te pomisleke, se sprehodimo skozi primer ansambelskega usposabljanja z uporabo enega samega opravila usposabljanja, optimizacijo hiperparametrov modela in njegovo uvedbo z uporabo enega vsebnika na končno točko brez strežnika. Za naš sklop ansamblov uporabljamo dva modela: CatBoost in XGBoost (oba sta ansambla za pospeševanje). Za naše podatke uporabljamo nabor podatkov o sladkorni bolezni [2] iz knjižnice scikit-learn: Sestavljen je iz 10 značilnosti (starost, spol, telesna masa, krvni tlak in šest meritev krvnega seruma), naš model pa napoveduje napredovanje bolezni 1 leto po tem, ko so bile zbrane osnovne značilnosti (regresija model).

Celotno skladišče kod lahko najdete na GitHub.

Usposobite več modelov v enem opravilu SageMaker

Za usposabljanje naših modelov uporabljamo učna opravila SageMaker v načinu skripta. Z načinom skripta lahko med uporabo vsebnikov ogrodja SageMaker pišete usposabljanje po meri (in pozneje sklepno kodo). Okvirni vsebniki vam omogočajo uporabo že pripravljenih okolij, ki jih upravlja AWS, ki vključujejo vse potrebne konfiguracije in module. Za prikaz, kako lahko prilagodite vsebnik ogrodja, kot primer uporabimo vnaprej pripravljen vsebnik SKLearn, ki ne vključuje paketov XGBoost in CatBoost. Obstajata dve možnosti za dodajanje teh paketov: bodisi razširite vgradno posodo za namestitev CatBoost in XGBoost (in nato razmestitev kot vsebnik po meri) ali uporabite funkcijo skriptnega načina opravila usposabljanja SageMaker, ki vam omogoča, da zagotovite requirements.txt pri izdelavi ocenjevalca usposabljanja. Učno opravilo SageMaker namesti navedene knjižnice v requirements.txt datoteko med izvajanjem. Na ta način vam ni treba upravljati lastnega repozitorija slik Docker in zagotavlja večjo prilagodljivost pri izvajanju skriptov za usposabljanje, ki potrebujejo dodatne pakete Python.

Naslednji blok kode prikazuje kodo, ki jo uporabljamo za začetek usposabljanja. The entry_point parameter kaže na naš skript usposabljanja. Uporabljamo tudi dve prepričljivi funkciji SDK API-ja SageMaker:

- Najprej določimo lokalno pot do izvornega imenika in odvisnosti v

source_dirindependenciesparametrov oz. SDK bo te imenike stisnil in naložil v Preprosta storitev shranjevanja Amazon (Amazon S3) in SageMaker jih bosta dala na voljo na izobraževalni instanci v delovnem imeniku/opt/ml/code. - Drugič, uporabljamo SDK

SKLearnestimator z našo prednostno različico Pythona in ogrodja, tako da bo SageMaker potegnil ustrezen vsebnik. Določili smo tudi metriko usposabljanja po meri 'validation:rmse', ki bo oddan v dnevnikih usposabljanja in zajet s SageMakerjem. Kasneje to metriko uporabimo kot ciljno metriko pri uglaševanju.

hyperparameters = {"num_round": 6, "max_depth": 5}

estimator_parameters = {

"entry_point": "multi_model_hpo.py",

"source_dir": "code",

"dependencies": ["my_custom_library"],

"instance_type": training_instance_type,

"instance_count": 1,

"hyperparameters": hyperparameters,

"role": role,

"base_job_name": "xgboost-model",

"framework_version": "1.0-1",

"keep_alive_period_in_seconds": 60,

"metric_definitions":[

{'Name': 'validation:rmse', 'Regex': 'validation-rmse:(.*?);'}

]

}

estimator = SKLearn(**estimator_parameters)Nato napišemo naš scenarij za usposabljanje (multi_model_hpo.py). Naš skript sledi preprostemu toku: zajem hiperparametrov s katerim je bilo delo konfigurirano in usposobite model CatBoost in Model XGBoost. Izvajamo tudi a k-kratni križ validacijsko funkcijo. Oglejte si naslednjo kodo:

if __name__ == "__main__":

parser = argparse.ArgumentParser() # Sagemaker specific arguments. Defaults are set in the environment variables.

parser.add_argument("--output-data-dir", type=str, default=os.environ["SM_OUTPUT_DATA_DIR"])

parser.add_argument("--model-dir", type=str, default=os.environ["SM_MODEL_DIR"])

parser.add_argument("--train", type=str, default=os.environ["SM_CHANNEL_TRAIN"])

parser.add_argument("--validation", type=str, default=os.environ["SM_CHANNEL_VALIDATION"])

.

.

.

"""

Train catboost

"""

K = args.k_fold

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}

rmse_list, model_catboost = cross_validation_catboost(train_df, K, catboost_hyperparameters)

.

.

.

"""

Train the XGBoost model

""" hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

"objective": args.objective,

"num_round": args.num_round,

} rmse_list, model_xgb = cross_validation(train_df, K, hyperparameters)Ko so modeli usposobljeni, izračunamo povprečje napovedi CatBoost in XGBoost. Rezultat, pred_mean, je zadnja napoved našega ansambla. Nato določimo mean_squared_error proti potrditvenemu nizu. val_rmse se uporablja za ocenjevanje celotne zasedbe med treningom. Upoštevajte, da natisnemo tudi vrednost RMSE v vzorcu, ki ustreza regularnemu izrazu, ki smo ga uporabili v metric_definitions. Pozneje bo SageMaker Automatic Model Tuning to uporabil za zajem ciljne metrike. Oglejte si naslednjo kodo:

pred_mean = np.mean(np.array([pred_catboost, pred_xgb]), axis=0)

val_rmse = mean_squared_error(y_validation, pred_mean, squared=False)

print(f"Final evaluation result: validation-rmse:{val_rmse}")Končno naš skript shrani oba artefakta modela v izhodno mapo, ki se nahaja na /opt/ml/model.

Ko je usposabljanje končano, SageMaker zapakira in kopira vsebino datoteke /opt/ml/model imenik kot en sam objekt v stisnjenem formatu TAR na lokacijo S3, ki ste jo podali v konfiguraciji opravila. V našem primeru SageMaker združi oba modela v datoteko TAR in jo naloži v Amazon S3 ob koncu usposabljanja. Oglejte si naslednjo kodo:

model_file_name = 'catboost-regressor-model.dump'

# Save CatBoost model

path = os.path.join(args.model_dir, model_file_name)

print('saving model file to {}'.format(path))

model.save_model(path)

.

.

.

# Save XGBoost model

model_location = args.model_dir + "/xgboost-model"

pickle.dump(model, open(model_location, "wb"))

logging.info("Stored trained model at {}".format(model_location))Če povzamemo, morate opaziti, da smo v tem postopku enkrat prenesli podatke in usposobili dva modela z enim učnim opravilom.

Samodejno uglaševanje modela ansambla

Ker gradimo zbirko modelov ML, je raziskovanje vseh možnih permutacij hiperparametrov nepraktično. SageMaker ponuja Samodejno prilagajanje modela (AMT), ki išče najboljše hiperparametre modela z osredotočanjem na najbolj obetavne kombinacije vrednosti znotraj obsegov, ki jih določite (na vas je, da določite prave obsege za raziskovanje). SageMaker podpira več načinov optimizacije za vas, da izberejo.

Začnemo z opredelitvijo dveh delov procesa optimizacije: objektivne metrike in hiperparametrov, ki jih želimo prilagoditi. V našem primeru uporabljamo validacijski RMSE kot ciljno metriko in prilagajamo eta in max_depth (za druge hiperparametre glejte XGBoost hiperparametri in Hiperparametri CatBoost):

from sagemaker.tuner import (

IntegerParameter,

ContinuousParameter,

HyperparameterTuner,

) hyperparameter_ranges = {

"eta": ContinuousParameter(0.2, 0.3),

"max_depth": IntegerParameter(3, 4)

}

metric_definitions = [{"Name": "validation:rmse", "Regex": "validation-rmse:([0-9.]+)"}]

objective_metric_name = "validation:rmse"Zagotoviti moramo tudi v scenarij usposabljanja da naši hiperparametri niso trdo kodirani in so potegnjeni iz argumentov izvajalnega okolja SageMaker:

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}SageMaker tudi zapiše hiperparametre v datoteko JSON in jih je mogoče prebrati /opt/ml/input/config/hyperparameters.json na izobraževalni instanci.

Tako kot CatBoost zajemamo tudi hiperparametre za model XGBoost (upoštevajte, da objective in num_round niso uglašeni):

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}Na koncu zaženemo opravilo za uravnavanje hiperparametrov s temi konfiguracijami:

tuner = HyperparameterTuner(

estimator,

objective_metric_name,

hyperparameter_ranges,

max_jobs=4,

max_parallel_jobs=2,

objective_type='Minimize'

)

tuner.fit({"train": train_location, "validation": validation_location}, include_cls_metadata=False)Ko je opravilo končano, lahko pridobite vrednosti za najboljše opravilo usposabljanja (z minimalnim RMSE):

job_name=tuner.latest_tuning_job.name

attached_tuner = HyperparameterTuner.attach(job_name)

attached_tuner.describe()["BestTrainingJob"]Za več informacij o AMT glejte Izvedite samodejno uravnavanje modela s programom SageMaker.

Deployment

Za uvedbo naše skupine po meri moramo zagotoviti skript za obdelavo zahteve za sklepanje in konfiguracijo gostovanja SageMaker. V tem primeru smo uporabili eno samo datoteko, ki vključuje kodo za usposabljanje in sklepanje (multi_model_hpo.py). SageMaker uporablja kodo pod if _ name _ == "_ main _" za usposabljanje in funkcije model_fn, input_fnin predict_fn pri uvajanju in serviranju modela.

Sklepna skripta

Tako kot pri usposabljanju uporabljamo okvirni vsebnik SageMaker SKLearn z lastnim sklepnim skriptom. Skript bo izvajal tri metode, ki jih zahteva SageMaker.

Prvič, model_fn metoda prebere naše shranjene datoteke artefaktov modela in jih naloži v pomnilnik. V našem primeru metoda vrne naš ansambel kot all_model, ki je seznam Python, vendar lahko kot ključe uporabite tudi slovar z imeni modelov.

def model_fn(model_dir):

catboost_model = CatBoostRegressor()

catboost_model.load_model(os.path.join(model_dir, model_file_name))

model_file = "xgboost-model"

model = pickle.load(open(os.path.join(model_dir, model_file), "rb"))

all_model = [catboost_model, model]

return all_modelDrugič, input_fn metoda deserializira vhodne podatke zahteve, ki se posredujejo našemu upravljavcu sklepanja. Za več informacij o obravnavalnikih vnosa glejte Prilagajanje lastnega vsebnika za sklepanje.

def input_fn(input_data, content_type):

dtype=None

payload = StringIO(input_data)

return np.genfromtxt(payload, dtype=dtype, delimiter=",")Tretjič, predict_fn metoda je odgovorna za pridobivanje napovedi iz modelov. Metoda vzame model in vrnjene podatke input_fn kot parametre in vrne končno napoved. V našem primeru dobimo rezultat CatBoost od prvega člana seznama modelov (model[0]) in XGBoost od drugega člana (model[1]), uporabljamo pa funkcijo mešanja, ki vrne povprečje obeh napovedi:

def predict_fn(input_data, model):

predictions_catb = model[0].predict(input_data)

dtest = xgb.DMatrix(input_data)

predictions_xgb = model[1].predict(dtest,

ntree_limit=getattr(model, "best_ntree_limit", 0),

validate_features=False)

return np.mean(np.array([predictions_catb, predictions_xgb]), axis=0)Zdaj, ko imamo svoje usposobljene modele in skript za sklepanje, lahko konfiguriramo okolje za uvedbo našega ansambla.

Sklep brez strežnika SageMaker

Čeprav obstajajo številne možnosti gostovanja v SageMakerju, v tem primeru uporabljamo končno točko brez strežnika. Brezstrežniške končne točke samodejno zaženejo računalniške vire in jih povečajo glede na promet. To odvzame nediferencirano težko delo pri upravljanju strežnikov. Ta možnost je idealna za delovne obremenitve, ki imajo obdobja mirovanja med prometnimi sunki in lahko prenašajo hladne zagone.

Konfiguracija končne točke brez strežnika je enostavna, ker nam ni treba izbrati vrst primerkov ali upravljati pravilnikov o skaliranju. Zagotoviti moramo samo dva parametra: velikost pomnilnika in največjo sočasnost. Končna točka brez strežnika samodejno dodeli računalniške vire sorazmerno izbranemu pomnilniku. Če izberete večjo velikost pomnilnika, ima vaš vsebnik dostop do več vCPU-jev. Velikost pomnilnika vaše končne točke morate vedno izbrati glede na velikost vašega modela. Drugi parameter, ki ga moramo zagotoviti, je največja sočasnost. Za posamezno končno točko je ta parameter mogoče nastaviti na 200 (od tega pisanja je omejitev skupnega števila brezstrežniških končnih točk v regiji 50). Upoštevati morate, da največja sočasnost za posamezno končno točko preprečuje, da bi ta končna točka prevzela vse klice, ki so dovoljeni za vaš račun, ker so vsi klici končne točke, ki presegajo največjo dovoljeno vrednost, dušeni (za več informacij o skupni sočasnosti za vse brezstrežniške končne točke na regijo glejte do Končne točke in kvote Amazon SageMaker).

from sagemaker.serverless.serverless_inference_config import ServerlessInferenceConfig

serverless_config = ServerlessInferenceConfig(

memory_size_in_mb=6144,

max_concurrency=1,

) Zdaj, ko smo konfigurirali končno točko, lahko končno uvedemo model, ki je bil izbran v našem opravilu optimizacije hiperparametrov:

estimator=attached_tuner.best_estimator()

predictor = estimator.deploy(serverless_inference_config=serverless_config)Čiščenje

Čeprav nimajo brezstrežniške končne točke nič stroškov, ko se ne uporabljajo, ko končate z zagonom tega primera, se prepričajte, da izbrišete končno točko:

predictor.delete_endpoint(predictor.endpoint)zaključek

V tej objavi smo obravnavali en pristop k usposabljanju, optimizaciji in uvajanju skupine po meri. Podrobno smo opisali postopek uporabe enega samega učnega opravila za usposabljanje več modelov, kako uporabiti samodejno uravnavanje modela za optimizacijo hiperparametrov ansambla in kako razmestiti eno končno točko brez strežnika, ki združuje sklepe iz več modelov.

Uporaba te metode rešuje morebitne stroškovne in operativne težave. Stroški usposabljanja temeljijo na virih, ki jih uporabljate med trajanjem uporabe. S samo enkratnim prenosom podatkov za usposabljanje obeh modelov smo za polovico zmanjšali fazo prenosa podatkov opravila in uporabljeni volumen, ki shranjuje podatke, s čimer smo zmanjšali skupne stroške usposabljanja. Poleg tega je delo AMT vodilo štiri izobraževalna opravila, vsako z zgoraj omenjenim skrajšanim časom in shranjevanjem, tako da to predstavlja 4-kratni prihranek stroškov! V zvezi z uvedbo modela na končni točki brez strežnika, ker plačate tudi za količino obdelanih podatkov, s priklicem končne točke samo enkrat za dva modela plačate polovico stroškov V/I podatkov.

Čeprav je ta objava pokazala le prednosti z dvema modeloma, lahko to metodo uporabite za usposabljanje, uglaševanje in uvajanje številnih skupnih modelov, da boste videli še večji učinek.

Reference

[1] Raj Kumar, P. Arun; Selvakumar, S. (2011). »Porazdeljeno odkrivanje napadov z zavrnitvijo storitve z uporabo ansambla nevronskih klasifikatorjev«. Računalniške komunikacije. 34 (11): 1328–1341. doi:10.1016/j.comcom.2011.01.012.

[2] Bradley Efron, Trevor Hastie, Iain Johnstone in Robert Tibshirani (2004) »Regresija najmanjšega kota«, Annals of Statistics (z razpravo), 407-499. (https://web.stanford.edu/~hastie/Papers/LARS/LeastAngle_2002.pdf)

O avtorjih

Melanie Li, dr, je višji strokovnjak za AI/ML TAM pri AWS s sedežem v Sydneyju v Avstraliji. Pomaga podjetniškim strankam zgraditi rešitve, ki izkoriščajo najsodobnejša orodja AI/ML na AWS, in zagotavlja smernice za arhitekturo in implementacijo rešitev strojnega učenja z najboljšimi praksami. V prostem času rada raziskuje naravo na prostem in preživlja čas z družino in prijatelji.

Melanie Li, dr, je višji strokovnjak za AI/ML TAM pri AWS s sedežem v Sydneyju v Avstraliji. Pomaga podjetniškim strankam zgraditi rešitve, ki izkoriščajo najsodobnejša orodja AI/ML na AWS, in zagotavlja smernice za arhitekturo in implementacijo rešitev strojnega učenja z najboljšimi praksami. V prostem času rada raziskuje naravo na prostem in preživlja čas z družino in prijatelji.

Uri Rosenberg je strokovni vodja za AI & ML za Evropo, Bližnji vzhod in Afriko. Uri s sedežem v Izraelu si prizadeva opolnomočiti poslovne stranke za načrtovanje, gradnjo in upravljanje delovnih obremenitev ML v velikem obsegu. V prostem času uživa v kolesarjenju, pohodništvu in minimiziranju RMSE.

Uri Rosenberg je strokovni vodja za AI & ML za Evropo, Bližnji vzhod in Afriko. Uri s sedežem v Izraelu si prizadeva opolnomočiti poslovne stranke za načrtovanje, gradnjo in upravljanje delovnih obremenitev ML v velikem obsegu. V prostem času uživa v kolesarjenju, pohodništvu in minimiziranju RMSE.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Avtomobili/EV, Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- BlockOffsets. Posodobitev okoljskega offset lastništva. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/efficiently-train-tune-and-deploy-custom-ensembles-using-amazon-sagemaker/

- :ima

- : je

- :ne

- :kje

- ][str

- $GOR

- 1

- 10

- 100

- 11

- 200

- 2011

- 50

- 60

- 7

- a

- O meni

- dostop

- Po

- Račun

- natančnost

- natančna

- dodajte

- Dodatne

- Poleg tega

- Naslov

- Afrika

- po

- proti

- starost

- AI

- AI / ML

- algoritem

- algoritmi

- vsi

- dovoljene

- omogoča

- Prav tako

- vedno

- Amazon

- Amazon SageMaker

- Amazon Web Services

- med

- znesek

- an

- in

- kaj

- aplikacije

- pristop

- SE

- Argumenti

- AS

- At

- napad

- Avstralija

- Samodejno

- samodejno

- Na voljo

- povprečenje

- stran

- AWS

- Backend

- temeljijo

- Izhodišče

- BE

- ker

- postanejo

- bilo

- počutje

- koristno

- Prednosti

- BEST

- najboljše prakse

- Boljše

- med

- Poleg

- mešanje

- mešanice

- Block

- kri

- Krvni tlak

- telo

- povečanje

- tako

- prinašajo

- Predložitev

- izgradnjo

- Building

- vgrajeno

- svežnji

- vendar

- by

- izračun

- CAN

- zajemanje

- Zajeto

- primeru

- kategorije

- verige

- Stroški

- Izberite

- Razvrstitev

- Koda

- hladno

- zbirka

- kombinacije

- združevanje

- Skupno

- Communications

- skupnost

- prepričljiv

- dokončanje

- Izračunajte

- računalnik

- Računalniška vizija

- Skrbi

- konfiguracija

- konfigurirano

- vsebuje

- Posoda

- Zabojniki

- vsebina

- nadzor

- Ustrezno

- strošek

- stroškovno učinkovito

- zajeti

- Ustvarjanje

- po meri

- stranka

- Stranke, ki so

- prilagodite

- Cybersecurity

- datum

- Odločanje

- namenjen

- privzeto

- opredeliti

- opredeljen

- definiranje

- izkazati

- Denial of Service

- Odvisno

- razporedi

- uvajanja

- uvajanje

- Oblikovanje

- oblikovalski vzorci

- podrobno

- Odkrivanje

- Ugotovite,

- drugačen

- imeniki

- razpravlja

- Razprava

- bolezen

- razne

- Lučki delavec

- Ne

- dont

- prenesi

- smetišče

- trajanje

- med

- vsak

- East

- učinek

- učinkovite

- učinkovito

- prizadevanja

- bodisi

- pojavljajo

- opolnomočiti

- omogočajo

- konec

- Končna točka

- zagotovitev

- Podjetje

- okolje

- okolja

- zlasti

- Evropa

- Ocena

- Tudi

- razvil

- Primer

- Primeri

- raziskuje

- Raziskovati

- dodatna

- družina

- Feature

- Lastnosti

- file

- datoteke

- končna

- končno

- finančna

- prva

- prilagodljivost

- Pretok

- Osredotočite

- osredotoča

- po

- sledi

- za

- gozd

- format

- je pokazala,

- štiri

- Okvirni

- okviri

- goljufija

- odkrivanje goljufij

- prijatelji

- iz

- polno

- funkcija

- funkcije

- Poleg tega

- Gain

- pridobivanje

- ustvarjajo

- dobili

- pridobivanje

- dana

- več

- Navodila

- Pol

- ročaj

- Ročaji

- Imajo

- he

- težka

- težko dvigovanje

- Pomaga

- jo

- več

- njegov

- gostitelj

- gostovanje

- Kako

- Kako

- Vendar

- HTML

- http

- HTTPS

- Optimizacija hiperparametra

- Uglaševanje hiperparametrov

- idealen

- Mirovanje

- if

- slika

- izvajati

- izvajanja

- izvedbe

- Pomembno

- in

- vključujejo

- vključuje

- individualna

- Posamezno

- Podatki

- Infrastruktura

- vhod

- namestitev

- primer

- Namesto

- Intelligence

- v

- uvesti

- Predstavlja

- sklican

- prikliče

- Izrael

- Vprašanja

- IT

- Job

- Delovna mesta

- jpg

- json

- tipke

- Otrok

- znano

- jezik

- večja

- pozneje

- kosilo

- učenje

- vzvod

- Li

- knjižnice

- Knjižnica

- dviganje

- LIMIT

- Seznam

- Navedeno

- obremenitve

- lokalna

- nahaja

- kraj aktivnosti

- sečnja

- POGLEDI

- ljubi

- stroj

- strojno učenje

- Glavne

- Večina

- Znamka

- upravljanje

- upravlja

- upravljanje

- upravitelj

- upravljanje

- Masa

- največja

- pomeni

- meritve

- medicinski

- član

- Spomin

- Spoji

- Metoda

- Metode

- meritev

- Bližnji

- srednji vzhod

- morda

- minimalna

- minimiziranje

- ML

- način

- Model

- modeli

- Moduli

- spremljanje

- več

- Najbolj

- več

- Ime

- Imena

- naravna

- Obdelava Natural Language

- Narava

- potrebno

- Nimate

- Naslednja

- nlp

- Opaziti..

- Številka

- številne

- predmet

- Cilj

- of

- Ponudbe

- pogosto

- on

- enkrat

- ONE

- samo

- deluje

- operativno

- optimizacija

- Optimizirajte

- optimizacijo

- Možnost

- možnosti

- or

- OS

- Ostalo

- naši

- ven

- na prostem

- izhod

- Splošni

- lastne

- pakete

- parameter

- parametri

- del

- deli

- opravil

- pot

- Vzorec

- vzorci

- Plačajte

- za

- obdobja

- faza

- plinovod

- platon

- Platonova podatkovna inteligenca

- PlatoData

- točke

- politike

- Popular

- mogoče

- Prispevek

- potencial

- vaje

- napovedovanje

- napoved

- Napovedi

- Predictor

- Napovedi

- raje

- prednostno

- tlak

- preprečuje

- prejšnja

- Tiskanje

- postopek

- Postopek

- Predelano

- obravnavati

- proizvodnjo

- napredovanje

- obetaven

- dokazano

- zagotavljajo

- zagotavlja

- Python

- naključno

- hitro

- Preberi

- zmanjša

- Zmanjšana

- zmanjšanje

- nanaša

- obravnavajo

- regularni izraz

- okolica

- daljinsko

- Skladišče

- predstavljajo

- zahteva

- obvezna

- zahteva

- viri

- oziroma

- odgovorna

- povzroči

- Rezultati

- vrnitev

- vrne

- Pravica

- ROBERT

- vloga

- Run

- tek

- s

- sagemaker

- Samodejno prilagajanje modela SageMaker

- Enako

- Shrani

- shranjevanje

- Lestvica

- skaliranje

- Znanstveniki

- scikit-učiti

- skripte

- SDK

- drugi

- glej

- videl

- izbran

- pošljite

- višji

- ločena

- Zaporedje

- Serum

- Brez strežnika

- Strežniki

- Storitev

- Storitve

- služijo

- nastavite

- nastavitve

- več

- Seks

- je

- shouldnt

- je pokazala,

- Razstave

- podobno

- Enostavno

- sam

- SIX

- Velikosti

- So

- Rešitev

- rešitve

- Rešuje

- vir

- specialist

- specifična

- določeno

- preživeti

- sveženj

- zloženi

- zlaganje

- Stanford

- Začetek

- začne

- state-of-the-art

- Statistika

- Koraki

- shranjevanje

- shranjeni

- trgovine

- naravnost

- močnejši

- taka

- POVZETEK

- Podprti

- Podpira

- Preverite

- sydney

- meni

- ob

- ciljna

- Naloge

- tehnični

- tehnike

- Tehnologija

- najemnik

- kot

- da

- O

- njihove

- Njih

- POTEM

- Tukaj.

- s tem

- zato

- te

- jih

- ta

- tisti,

- čeprav?

- 3

- skozi

- čas

- krat

- do

- skupaj

- orodja

- temo

- Skupaj za plačilo

- vleko

- Prometa

- Vlak

- usposobljeni

- usposabljanje

- Drevesa

- Trevor

- Triton

- dva

- Vrste

- pod

- razumeli

- Uporaba

- uporaba

- Rabljeni

- uporablja

- uporabo

- potrjevanje

- vrednost

- Vrednote

- različnih

- različica

- Vizija

- Obseg

- Glasovanje

- želeli

- je

- način..

- načini

- we

- web

- spletne storitve

- teža

- so bili

- Kaj

- kdaj

- ki

- medtem

- celoti

- zakaj

- bo

- z

- v

- delo

- deluje

- deluje

- pisati

- pisanje

- XGBoost

- leto

- Vi

- Vaša rutina za

- zefirnet

- nič