Odklepanje natančnih in pronicljivih odgovorov iz ogromnih količin besedila je vznemirljiva zmožnost, ki jo omogočajo veliki jezikovni modeli (LLM). Pri izdelavi aplikacij LLM je pogosto treba povezati zunanje vire podatkov in poizvedovati po njih, da zagotovimo ustrezen kontekst za model. Eden od priljubljenih pristopov je uporaba RAG (Retrieval Augmented Generation) za ustvarjanje sistemov vprašanj in odgovorov, ki razumejo kompleksne informacije in zagotavljajo naravne odgovore na poizvedbe. RAG omogoča modelom, da izkoristijo obsežne baze znanja in zagotovijo človeški dialog za aplikacije, kot so chatboti in pomočniki za iskanje v podjetjih.

V tej objavi raziskujemo, kako izkoristiti moč CallIndex, Llama 2-70B-Klepetin LangChain za izdelavo zmogljivih aplikacij za vprašanja in odgovore. S temi najsodobnejšimi tehnologijami lahko zaužijete korpuse besedil, indeksirate kritično znanje in ustvarite besedilo, ki natančno in jasno odgovarja na vprašanja uporabnikov.

Llama 2-70B-Klepet

Llama 2-70B-Chat je močan LLM, ki tekmuje z vodilnimi modeli. Vnaprej je usposobljen na dveh bilijonih besedilnih žetonov, Meta pa ga je namenila za pomoč uporabnikom v klepetu. Podatki pred usposabljanjem izvirajo iz javno dostopnih podatkov in se zaključijo s septembrom 2022, podatki o natančnem uravnavanju pa se zaključijo z julijem 2023. Za več podrobnosti o procesu usposabljanja modela, varnostnih vidikih, učenju in predvideni uporabi glejte dokument Llama 2: Open Foundation in natančno nastavljeni modeli klepeta. Modeli Llama 2 so na voljo na Amazon SageMaker JumpStart za hitro in preprosto uvajanje.

CallIndex

CallIndex je podatkovno ogrodje, ki omogoča gradnjo LLM aplikacij. Zagotavlja orodja, ki ponujajo povezovalnike podatkov za vnos vaših obstoječih podatkov v različne vire in formate (PDF-ji, dokumenti, API-ji, SQL in več). Ne glede na to, ali imate podatke shranjene v zbirkah podatkov ali v PDF-jih, LlamaIndex omogoča preprosto uporabo teh podatkov za LLM. Kot prikazujemo v tej objavi, API-ji LlamaIndex olajšajo dostop do podatkov in vam omogočajo ustvarjanje zmogljivih aplikacij LLM po meri in delovnih tokov.

Če eksperimentirate in gradite z LLM, verjetno poznate LangChain, ki ponuja robusten okvir, ki poenostavlja razvoj in uvajanje aplikacij, ki jih poganja LLM. Podobno kot LangChain, LlamaIndex ponuja številna orodja, vključno s podatkovnimi konektorji, podatkovnimi indeksi, motorji in podatkovnimi agenti, kot tudi integracije aplikacij, kot so orodja in opazljivost, sledenje in vrednotenje. LlamaIndex se osredotoča na premostitev vrzeli med podatki in zmogljivimi LLM-ji, pri čemer racionalizira podatkovne naloge z uporabniku prijaznimi funkcijami. LlamaIndex je posebej zasnovan in optimiziran za ustvarjanje aplikacij za iskanje in pridobivanje, kot je RAG, ker zagotavlja preprost vmesnik za poizvedovanje LLM in pridobivanje ustreznih dokumentov.

Pregled rešitev

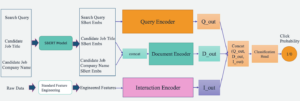

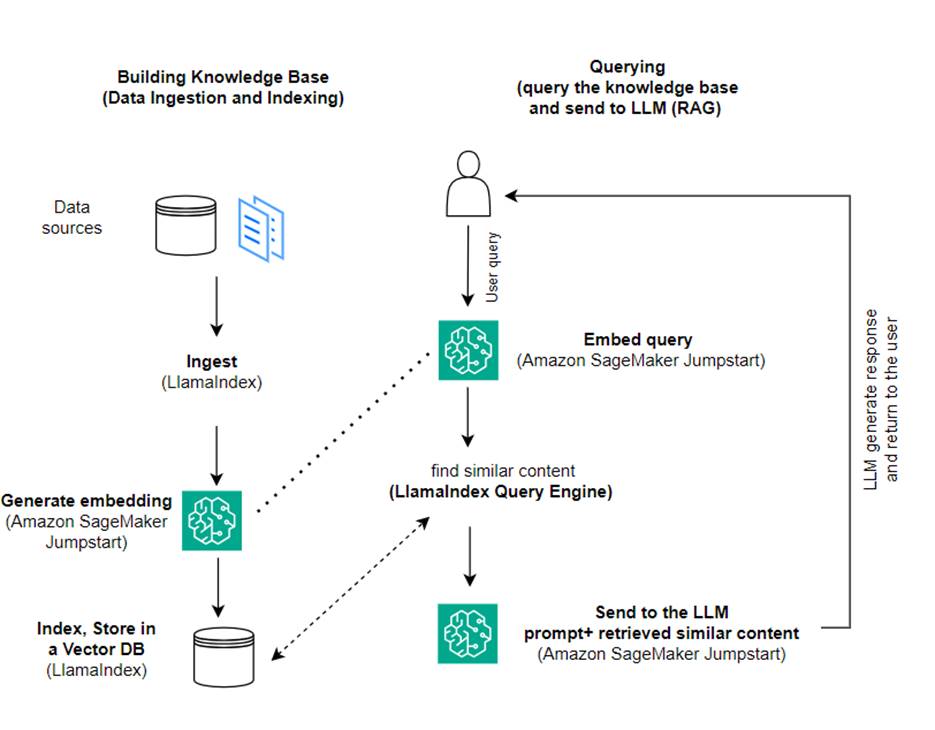

V tej objavi prikazujemo, kako ustvariti aplikacijo, ki temelji na RAG, z uporabo LlamaIndex in LLM. Naslednji diagram prikazuje arhitekturo te rešitve korak za korakom, opisano v naslednjih razdelkih.

RAG združuje iskanje informacij z ustvarjanjem naravnega jezika za ustvarjanje bolj pronicljivih odgovorov. Ob pozivu RAG najprej preišče besedilne korpuse, da pridobi najbolj ustrezne primere za vnos. Med ustvarjanjem odziva model upošteva te primere, da bi povečal svoje zmogljivosti. Z vključitvijo ustreznih pridobljenih odlomkov so odgovori RAG bolj dejanski, koherentni in skladni s kontekstom v primerjavi z osnovnimi generativnimi modeli. Ta okvir za pridobivanje in generiranje izkorišča prednosti tako pridobivanja kot generiranja in pomaga pri reševanju težav, kot sta ponavljanje in pomanjkanje konteksta, ki lahko izhajajo iz čistih avtoregresivnih pogovornih modelov. RAG uvaja učinkovit pristop za ustvarjanje pogovornih agentov in pomočnikov AI s kontekstualiziranimi, visokokakovostnimi odzivi.

Gradnja rešitve je sestavljena iz naslednjih korakov:

- Nastavitev Amazon SageMaker Studio kot razvojno okolje in namestite zahtevane odvisnosti.

- Razmestite model vdelave iz središča Amazon SageMaker JumpStart.

- Prenesite sporočila za javnost, da jih uporabite kot našo zunanjo bazo znanja.

- Sestavite kazalo iz sporočil za javnost, da boste lahko poizvedovali in pozivu dodali dodaten kontekst.

- Poizvedujte po bazi znanja.

- Zgradite aplikacijo za vprašanja in odgovore z uporabo agentov LlamaIndex in LangChain.

Vsa koda v tej objavi je na voljo v GitHub repo.

Predpogoji

Za ta primer potrebujete račun AWS z domeno SageMaker in ustrezno AWS upravljanje identitete in dostopa (IAM) dovoljenja. Za navodila za nastavitev računa glejte Ustvarite račun AWS. Če še nimate domene SageMaker, si oglejte Domena Amazon SageMaker pregled, da ga ustvarite. V tej objavi uporabljamo AmazonSageMakerFullAccess vlogo. Ni priporočljivo, da te poverilnice uporabljate v produkcijskem okolju. Namesto tega bi morali ustvariti in uporabljati vlogo z dovoljenji najmanj privilegijev. Raziščete lahko tudi, kako lahko uporabite Upravitelj vlog Amazon SageMaker za ustvarjanje in upravljanje vlog IAM, ki temeljijo na osebah, za običajne potrebe strojnega učenja neposredno prek konzole SageMaker.

Poleg tega potrebujete dostop do najmanj naslednjih velikosti primerkov:

- ml.g5.2xvelik za uporabo končne točke pri uvajanju Objemni obraz GPT-J model vdelave besedila

- ml.g5.48xvelik za uporabo končne točke pri uvajanju končne točke modela Llama 2-Chat

Če želite povečati svojo kvoto, glejte Zahteva za povečanje kvote.

Razmestite model vdelave GPT-J s pomočjo SageMaker JumpStart

Ta razdelek ponuja dve možnosti pri uvajanju modelov SageMaker JumpStart. Uporabite lahko kodno uvedbo s priloženo kodo ali uporabite uporabniški vmesnik (UI) SageMaker JumpStart.

Namestite s SDK SageMaker Python

S SDK za Python lahko uporabite SageMaker za uvajanje LLM-jev, kot je prikazano v Koda na voljo v skladišču. Izvedite naslednje korake:

- Nastavite velikost primerka, ki bo uporabljen za uvajanje modela vdelav z uporabo

instance_type = "ml.g5.2xlarge" - Poiščite ID modela, ki ga želite uporabiti za vdelave. V SageMaker JumpStart je označen kot

model_id = "huggingface-textembedding-gpt-j-6b-fp16" - Pridobite vsebnik vnaprej usposobljenega modela in ga razporedite za sklepanje.

SageMaker bo vrnil ime končne točke modela in naslednje sporočilo, ko bo model vdelave uspešno uveden:

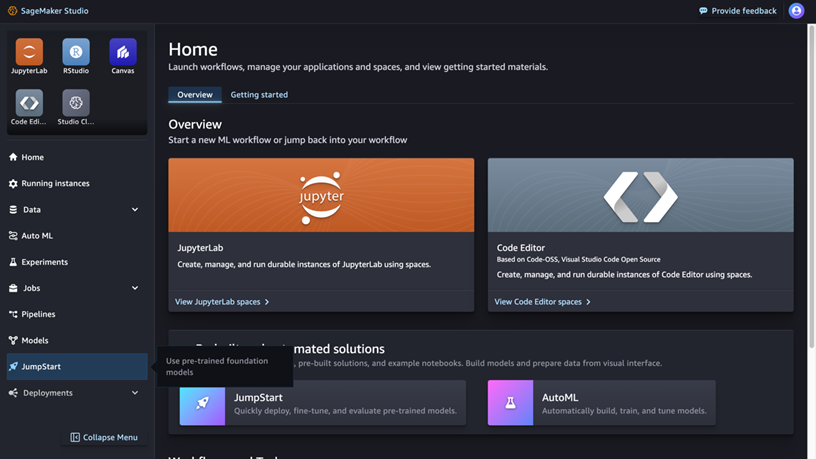

Razmestite s SageMaker JumpStart v SageMaker Studio

Če želite razmestiti model s SageMaker JumpStart v Studiu, dokončajte naslednje korake:

- Na konzoli SageMaker Studio v navigacijskem podoknu izberite JumpStart.

- Poiščite in izberite model GPT-J 6B Embedding FP16.

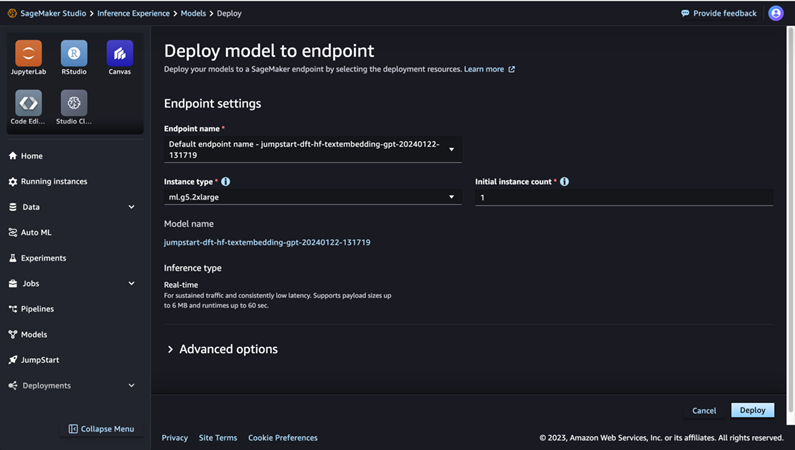

- Izberite Razmesti in prilagodite konfiguracijo razmestitve.

- Za ta primer potrebujemo primerek ml.g5.2xlarge, ki je privzeti primerek, ki ga predlaga SageMaker JumpStart.

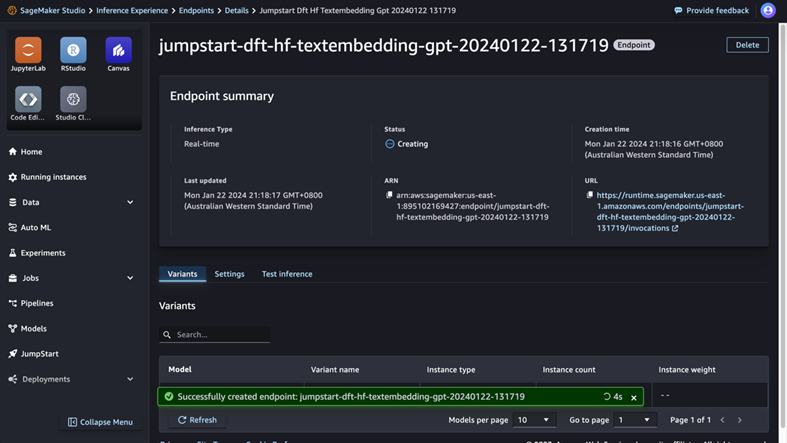

- Znova izberite Razmesti, da ustvarite končno točko.

Končna točka bo delovala približno 5–10 minut.

Ko ste uvedli model vdelav, morate za uporabo integracije LangChain z API-ji SageMaker ustvariti funkcijo za obravnavanje vnosov (neobdelano besedilo) in njihovo pretvorbo v vdelave z uporabo modela. To storite tako, da ustvarite razred, imenovan ContentHandler, ki sprejme JSON vhodnih podatkov in vrne JSON vdelanih besedil: class ContentHandler(EmbeddingsContentHandler).

Posredujte ime končne točke modela v ContentHandler funkcija za pretvorbo besedila in vrnitev vdelav:

Ime končne točke lahko poiščete v izhodu SDK ali v podrobnostih o uvedbi v uporabniškem vmesniku SageMaker JumpStart.

To lahko preizkusite ContentHandler funkcija in končna točka delujeta po pričakovanjih z vnosom neobdelanega besedila in izvajanjem embeddings.embed_query(text) funkcijo. Uporabite lahko navedeni primer text = "Hi! It's time for the beach" ali poskusite svoje besedilo.

Namestite in preizkusite Llama 2-Chat z uporabo SageMaker JumpStart

Zdaj lahko uvedete model, ki je sposoben imeti interaktivne pogovore z vašimi uporabniki. V tem primeru izberemo enega od modelov klepeta Llama 2, ki je identificiran prek

Model je treba razmestiti na končno točko v realnem času z uporabo predictor = my_model.deploy(). SageMaker bo vrnil ime končne točke modela, ki ga lahko uporabite za endpoint_name spremenljivko za kasnejšo referenco.

Vi definirate a print_dialogue funkcijo za pošiljanje vnosa v model klepeta in prejemanje njegovega izhodnega odgovora. Obremenitev vključuje hiperparametre za model, vključno z naslednjim:

- max_new_tokens – Nanaša se na največje število žetonov, ki jih lahko model ustvari v svojih izhodih.

- top_p – Nanaša se na kumulativno verjetnost žetonov, ki jih lahko obdrži model pri ustvarjanju svojih rezultatov

- temperatura – Nanaša se na naključnost rezultatov, ki jih ustvari model. Temperatura, višja od 0 ali enaka 1, poveča stopnjo naključnosti, medtem ko bo temperatura 0 ustvarila najverjetnejše žetone.

Svoje hiperparametre morate izbrati glede na vaš primer uporabe in jih ustrezno preizkusiti. Modeli, kot je družina Llama, zahtevajo, da vključite dodaten parameter, ki nakazuje, da ste prebrali in sprejeli licenčno pogodbo za končnega uporabnika (EULA):

Če želite preizkusiti model, zamenjajte razdelek vsebine vhodnega koristnega tovora: "content": "what is the recipe of mayonnaise?". Uporabite lahko lastne besedilne vrednosti in posodobite hiperparametre, da jih boste bolje razumeli.

Podobno kot pri uvajanju modela vdelav, lahko Llama-70B-Chat uvedete z uporabniškim vmesnikom SageMaker JumpStart:

- Na konzoli SageMaker Studio izberite jumpstart v navigacijskem podoknu

- Poiščite in izberite

Llama-2-70b-Chat model - Sprejmite EULA in izberite uvajanje, ponovno z uporabo privzetega primerka

Podobno kot pri modelu vdelave lahko uporabite integracijo LangChain tako, da ustvarite predlogo za obravnavo vsebine za vhode in izhode vašega modela klepeta. V tem primeru definirate vnose kot tiste, ki prihajajo od uporabnika, in označite, da jih ureja system prompt. system prompt obvešča model o njegovi vlogi pri pomoči uporabniku za določen primer uporabe.

Ta upravljalnik vsebine se nato posreduje ob priklicu modela poleg prej omenjenih hiperparametrov in atributov po meri (sprejemanje EULA). Vse te atribute razčlenite z naslednjo kodo:

Ko je končna točka na voljo, lahko preizkusite, ali deluje po pričakovanjih. Lahko posodobite llm("what is amazon sagemaker?") z lastnim besedilom. Določiti morate tudi specifično ContentHandler da prikličete LLM z uporabo LangChain, kot je prikazano v Koda in naslednji delček kode:

Za izdelavo RAG uporabite LlamaIndex

Če želite nadaljevati, namestite LlamaIndex, da ustvarite aplikacijo RAG. LlamaIndex lahko namestite s pipom: pip install llama_index

Najprej morate naložiti svoje podatke (bazo znanja) na LlamaIndex za indeksiranje. To vključuje nekaj korakov:

- Izberite nalagalnik podatkov:

LlamaIndex ponuja številne podatkovne priključke, ki so na voljo na LlamaHub za pogoste tipe podatkov, kot so JSON, CSV in besedilne datoteke, ter druge vire podatkov, kar vam omogoča vnos različnih naborov podatkov. V tej objavi uporabljamo SimpleDirectoryReader za vnos nekaj datotek PDF, kot je prikazano v kodi. Naš vzorec podatkov sta dve Amazonovi izjavi za javnost v različici PDF v sporočila za javnost mapo v našem skladišču kode. Ko naložite PDF-je, lahko vidite, da so bili pretvorjeni v seznam 11 elementov.

Namesto da dokumente naložite neposredno, jih lahko tudi prikrijete Document predmet v Node predmetov, preden jih pošljete v indeks. Izbira med pošiljanjem celotne Document predmet v kazalo ali pretvorbo dokumenta v Node predmetov pred indeksiranjem je odvisno od vašega specifičnega primera uporabe in strukture vaših podatkov. Pristop z vozlišči je na splošno dobra izbira za dolge dokumente, kjer želite prekiniti in pridobiti določene dele dokumenta in ne celotnega dokumenta. Za več informacij glejte Dokumenti / vozlišča.

- Instanciirajte nalagalnik in naložite dokumente:

Ta korak inicializira razred nalagalnika in vse potrebne konfiguracije, na primer, ali naj se skrite datoteke prezrejo. Za več podrobnosti glejte SimpleDirectoryReader.

- Pokliči nakladalca

load_datametoda za razčlenitev izvornih datotek in podatkov ter njihovo pretvorbo v objekte dokumenta LlamaIndex, pripravljene za indeksiranje in poizvedovanje. Z naslednjo kodo lahko dokončate vnos podatkov in pripravo za iskanje po celotnem besedilu z uporabo zmožnosti indeksiranja in iskanja LlamaIndex:

- Zgradite indeks:

Ključna lastnost LlamaIndex je njegova zmožnost konstruiranja organiziranih indeksov nad podatki, ki so predstavljeni kot dokumenti ali vozlišča. Indeksiranje omogoča učinkovito poizvedovanje po podatkih. Naš indeks ustvarimo s privzeto vektorsko shrambo v pomnilniku in z našo definirano konfiguracijo nastavitev. LlamaIndex Nastavitve je konfiguracijski objekt, ki zagotavlja pogosto uporabljene vire in nastavitve za operacije indeksiranja in poizvedovanja v aplikaciji LlamaIndex. Deluje kot enojni objekt, tako da vam omogoča nastavitev globalnih konfiguracij, hkrati pa vam omogoča, da lokalne komponente preglasite tako, da jih posredujete neposredno v vmesnike (kot so LLM-ji, modeli za vdelavo), ki jih uporabljajo. Če določena komponenta ni izrecno podana, se ogrodje LlamaIndex vrne na nastavitve, določene v Settings objekt kot globalno privzeto. Za uporabo naših modelov vdelave in LLM z LangChain in konfiguracijo Settings moramo namestiti llama_index.embeddings.langchain in llama_index.llms.langchain. Lahko konfiguriramo Settings objekt kot v naslednji kodi:

Privzeto, VectorStoreIndex uporablja v pomnilniku SimpleVectorStore ki je inicializiran kot del privzetega konteksta shranjevanja. V resničnih primerih uporabe se morate pogosto povezati z zunanjimi vektorskimi trgovinami, kot je npr Storitev Amazon OpenSearch. Za več podrobnosti glejte Vektorski mehanizem za Amazon OpenSearch Serverless.

Zdaj lahko zaženete vprašanja in odgovore nad svojimi dokumenti z uporabo query_engine iz LlamaIndex. Če želite to narediti, posredujte indeks, ki ste ga prej ustvarili za poizvedbe, in postavite svoje vprašanje. Poizvedovalni mehanizem je generični vmesnik za poizvedovanje po podatkih. Kot vhod vzame poizvedbo v naravnem jeziku in vrne obogateni odgovor. Mehanizem poizvedb je običajno zgrajen na vrhu enega ali več indekse uporabo prinašalci.

Vidite lahko, da je rešitev RAG sposobna pridobiti pravilen odgovor iz predloženih dokumentov:

Uporabite orodja in agente LangChain

Loader razred. Nalagalnik je zasnovan za nalaganje podatkov v LlamaIndex ali pozneje kot orodje v a LangChain agent. To vam daje več moči in prilagodljivosti za uporabo tega kot dela vaše aplikacije. Začnete z opredelitvijo svojega orodje iz razreda agentov LangChain. Funkcija, ki jo posredujete svojemu orodju, poizveduje po indeksu, ki ste ga zgradili nad svojimi dokumenti z uporabo LlamaIndex.

Nato izberete pravi tip posrednika, ki ga želite uporabiti za svojo implementacijo RAG. V tem primeru uporabite chat-zero-shot-react-description agent. S tem agentom bo LLM uporabil razpoložljivo orodje (v tem scenariju RAG prek baze znanja), da zagotovi odgovor. Nato inicializirate agenta tako, da posredujete svoje orodje, LLM in vrsto agenta:

Lahko vidite agenta, ki gre skozi thoughts, actionsin observation , uporabite orodje (v tem scenariju poizvedovanje po vaših indeksiranih dokumentih); in vrni rezultat:

Kodo implementacije od konca do konca najdete v priloženem GitHub repo.

Čiščenje

Da bi se izognili nepotrebnim stroškom, lahko počistite svoje vire, bodisi prek naslednjih izrezkov kode ali uporabniškega vmesnika Amazon JumpStart.

Če želite uporabiti Boto3 SDK, uporabite naslednjo kodo za brisanje končne točke modela za vdelavo besedila in končne točke modela za generiranje besedila ter konfiguracije končne točke:

Za uporabo konzole SageMaker izvedite naslednje korake:

- Na konzoli SageMaker pod Inference v navigacijskem podoknu izberite Endpoints

- Poiščite končne točke vdelave in generiranja besedila.

- Na strani s podrobnostmi o končni točki izberite Izbriši.

- Za potrditev znova izberite Izbriši.

zaključek

Za primere uporabe, osredotočene na iskanje in iskanje, LlamaIndex zagotavlja prilagodljive zmogljivosti. Odličen je pri indeksiranju in iskanju za LLM, zaradi česar je močno orodje za poglobljeno raziskovanje podatkov. LlamaIndex vam omogoča ustvarjanje organiziranih podatkovnih indeksov, uporabo različnih LLM-jev, dopolnjevanje podatkov za boljšo učinkovitost LLM-ja in poizvedovanje po podatkih z naravnim jezikom.

Ta objava je prikazala nekaj ključnih konceptov in zmožnosti LlamaIndex. Uporabili smo GPT-J za vdelavo in Llama 2-Chat kot LLM za izdelavo aplikacije RAG, vendar lahko namesto tega uporabite kateri koli primeren model. Raziskujete lahko obsežno ponudbo modelov, ki so na voljo na SageMaker JumpStart.

Pokazali smo tudi, kako lahko LlamaIndex zagotovi močna, prilagodljiva orodja za povezovanje, indeksiranje, pridobivanje in integracijo podatkov z drugimi ogrodji, kot je LangChain. Z integracijami LlamaIndex in LangChain lahko zgradite zmogljivejše, vsestranske in pronicljive LLM aplikacije.

O avtorjih

Romina Sharifpour je višji arhitekt za rešitve strojnega učenja in umetne inteligence pri Amazon Web Services (AWS). Več kot 10 let je vodila načrtovanje in implementacijo inovativnih rešitev od konca do konca, ki jih omogoča napredek v strojnem strojenju in umetni inteligenci. Področja Romina zanimanja so obdelava naravnega jezika, veliki jezikovni modeli in MLOps.

Romina Sharifpour je višji arhitekt za rešitve strojnega učenja in umetne inteligence pri Amazon Web Services (AWS). Več kot 10 let je vodila načrtovanje in implementacijo inovativnih rešitev od konca do konca, ki jih omogoča napredek v strojnem strojenju in umetni inteligenci. Področja Romina zanimanja so obdelava naravnega jezika, veliki jezikovni modeli in MLOps.

Nicole Pinto je specialist za rešitve AI/ML s sedežem v Sydneyju v Avstraliji. Njeno ozadje v zdravstvu in finančnih storitvah ji daje edinstven pogled na reševanje težav strank. Navdušena je nad omogočanjem strankam s strojnim učenjem in opolnomočenjem naslednje generacije žensk v STEM.

Nicole Pinto je specialist za rešitve AI/ML s sedežem v Sydneyju v Avstraliji. Njeno ozadje v zdravstvu in finančnih storitvah ji daje edinstven pogled na reševanje težav strank. Navdušena je nad omogočanjem strankam s strojnim učenjem in opolnomočenjem naslednje generacije žensk v STEM.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/build-knowledge-powered-conversational-applications-using-llamaindex-and-llama-2-chat/

- :ima

- : je

- :ne

- :kje

- $GOR

- 1

- 10

- 100

- 11

- 13

- 14

- 15%

- 16

- 2022

- 2023

- 22

- 500

- 7

- 8

- 9

- a

- sposobnost

- Sposobna

- O meni

- sprejem

- sprejeta

- Sprejema

- dostop

- Po

- Račun

- natančna

- aktov

- dodajte

- Poleg tega

- Dodatne

- Naslov

- napredek

- Prednost

- po

- spet

- Agent

- agenti

- Sporazum

- AI

- ai raziskave

- AI / ML

- vsi

- Dovoli

- omogoča

- že

- Prav tako

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amazonske spletne storitve (AWS)

- zneski

- an

- in

- odgovor

- odgovor

- odgovori

- kaj

- API-ji

- uporaba

- aplikacije

- pristop

- primerno

- ustrezno

- približno

- Arhitektura

- SE

- območja

- pojavijo

- umetni

- Umetna inteligenca

- AS

- vprašati

- pomoč

- pomočniki

- pomoč

- At

- lastnosti

- povečanje

- Povečana

- Avstralija

- Na voljo

- izogniti

- AWS

- nazaj

- ozadje

- baza

- temeljijo

- Osnovni

- BE

- Beach

- ker

- bilo

- pred

- Boljše

- med

- tako

- Break

- premostitev

- prinašajo

- izgradnjo

- Building

- zgrajena

- vendar

- by

- se imenuje

- CAN

- Zmogljivosti

- zmožnost

- primeru

- primeri

- klepet

- klepetalnice

- izbira

- Izberite

- razred

- čiščenje

- jasno

- stranke

- Koda

- KOHERENTNO

- združuje

- prihajajo

- Skupno

- pogosto

- podjetje

- v primerjavi z letom

- tekmuje

- dokončanje

- kompleksna

- komponenta

- deli

- razumeti

- celovito

- koncepti

- zaključuje

- konfiguracija

- konfiguriranje

- Potrdi

- Connect

- priključki

- premislekov

- meni

- dosledno

- vsebuje

- Konzole

- gradnjo

- Posoda

- vsebina

- ozadje

- naprej

- pogovorni

- pogovorov

- pretvorbo

- pretvori

- pretvorbo

- popravi

- strošek

- prihranki pri stroških

- stroški

- bi

- ustvarjajo

- ustvaril

- Ustvarjanje

- POVERILNICA

- kritično

- po meri

- stranka

- Stranke, ki so

- prilagodite

- Cut

- datum

- dostop do podatkov

- baze podatkov

- nabor podatkov

- globoko

- privzeto

- opredeliti

- opredeljen

- definiranje

- poda

- izkazati

- Dokazano

- odvisnosti

- odvisno

- razporedi

- razporejeni

- uvajanja

- uvajanje

- Oblikovanje

- zasnovan

- Podrobnosti

- Razvoj

- diagram

- Dialog

- DICT

- neposredno

- razne

- do

- docs

- dokument

- Dokumenti

- domena

- dont

- vozi

- med

- prej

- Učinkovito

- učinkovite

- brez napora

- bodisi

- elementi

- vdelava

- pooblastitvi

- omogočena

- omogoča

- omogočanje

- konec

- konec koncev

- Končna točka

- Motor

- Motorji

- Podjetje

- Celotna

- okolje

- enako

- Ocena

- Primer

- Primeri

- zanimivo

- obstoječih

- Pričakuje

- eksperimentiranje

- izrecno

- raziskovanje

- raziskuje

- zunanja

- Obraz

- olajša

- Falls

- seznanjeni

- družina

- Feature

- Lastnosti

- Nekaj

- datoteke

- finančna

- finančne storitve

- Najdi

- prva

- prilagodljivost

- prilagodljiv

- osredotočena

- Osredotoča

- po

- za

- Fundacija

- Okvirni

- okviri

- iz

- funkcija

- vrzel

- splošno

- ustvarjajo

- ustvarila

- ustvarjajo

- generacija

- generativno

- daje

- Globalno

- dogaja

- dobro

- urejeno

- več

- ročaj

- plezalni pas

- Imajo

- zdravstveno varstvo

- pomoč

- jo

- skrita

- visoka kvaliteta

- Kako

- Kako

- Vendar

- HTML

- HTTPS

- Hub

- ID

- identificirati

- identiteta

- if

- ignorirati

- Izvajanje

- Izboljšave

- in

- vključujejo

- vključuje

- Vključno

- vključujoč

- Povečajte

- Poveča

- Indeks

- indeksirane

- indekse

- Navedite

- označuje

- Podatki

- obvešča

- Infrastruktura

- Inovacije

- inovativne

- vhod

- vhodi

- vnašanje

- pronicljiv

- namestitev

- primer

- Namesto

- Navodila

- integrirati

- integracija

- integracije

- Intelligence

- namenjen

- interaktivno

- obresti

- vmesnik

- vmesniki

- v

- Predstavlja

- vključuje

- Vprašanja

- IT

- ITS

- jpg

- json

- julij

- Ključne

- znanje

- Pomanjkanje

- jezik

- velika

- pozneje

- vodi

- učenje

- Stopnja

- Licenca

- kot

- Verjeten

- Seznam

- Llama

- LLM

- obremenitev

- nakladač

- nalaganje

- lokalno

- Long

- stroj

- strojno učenje

- Znamka

- IZDELA

- Izdelava

- upravljanje

- največja

- Maj ..

- omenjeno

- Sporočilo

- Meta

- Metoda

- selitev

- migracije

- minimalna

- Minute

- ML

- MLOps

- Model

- modeli

- več

- Najbolj

- veliko

- Ime

- naravna

- Obdelava Natural Language

- ostalo

- potrebno

- Nimate

- potrebna

- potrebe

- Naslednja

- vozlišča

- Številka

- predmet

- predmeti

- of

- ponudba

- Ponudbe

- pogosto

- on

- ONE

- samo

- na

- odprite

- operativno

- operacije

- optimizirana

- možnosti

- or

- Da

- Organizirano

- Ostalo

- naši

- ven

- opisano

- izhod

- izhodi

- več

- preglasijo

- pregled

- lastne

- Stran

- podokno

- Papir

- parameter

- parametri

- del

- zlasti

- deli

- mimo

- odlomki

- opravil

- Podaje

- strastno

- performance

- Dovoljenja

- perspektiva

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Popular

- Prispevek

- moč

- močan

- Ravno

- Predictor

- Priprava

- pritisnite

- Sporočilo za javnost

- Sporočila za javnost

- Težave

- Postopek

- obravnavati

- proizvodnjo

- proizvodnja

- zagotavljajo

- če

- zagotavlja

- javno

- čista

- Python

- Vprašanja in odgovori

- poizvedbe

- poizvedba

- vprašanje

- vprašanja

- Hitri

- krpa

- naključnost

- območje

- precej

- Surovi

- Preberi

- pripravljen

- v realnem času

- prejeti

- Recept

- priporočeno

- Zmanjšana

- glejte

- reference

- nanaša

- reinvestirati

- sprostitev

- Izpusti

- pomembno

- zamenjajte

- Skladišče

- zastopan

- zahteva

- obvezna

- Raziskave

- raziskave in razvoj

- viri

- Odgovor

- odgovorov

- povzroči

- iskanje

- vrnitev

- vrne

- Rich

- Pravica

- robusten

- vloga

- vloge

- Run

- tek

- s

- Varnost

- sagemaker

- Vzorec

- Prihranki

- Scenarij

- SDK

- Iskalnik

- iskanja

- Oddelek

- oddelki

- glej

- izberite

- SAMO

- pošljite

- pošiljanja

- višji

- september

- Storitev

- Storitve

- nastavite

- nastavitev

- nastavitve

- nastavitev

- je

- shouldnt

- je pokazala,

- pokazale

- Razstave

- Podoben

- Enostavno

- poenostavitev

- saj

- Velikosti

- velikosti

- delček

- So

- Rešitev

- rešitve

- Reševanje

- nekaj

- vir

- vir

- Viri

- specialist

- specifična

- posebej

- porabljen

- Začetek

- state-of-the-art

- Države

- Stem

- Korak

- Koraki

- shranjevanje

- trgovina

- shranjeni

- trgovine

- naravnost

- racionalizacijo

- prednosti

- Struktura

- studio

- Kasneje

- Uspešno

- taka

- primerna

- sydney

- sistem

- sistemi

- Bodite

- meni

- Dotaknite

- Naloge

- Tehnologije

- Predloga

- nagiba

- Test

- besedilo

- kot

- da

- O

- Njih

- POTEM

- te

- jih

- ta

- tisti,

- skozi

- čas

- do

- Boni

- orodje

- orodja

- vrh

- Sledenje

- usposabljanje

- Transform

- Bilijona

- poskusite

- dva

- tip

- Vrste

- tipično

- ui

- pod

- razumeli

- edinstven

- nepotrebna

- Nadgradnja

- Uporaba

- uporaba

- primeru uporabe

- Rabljeni

- koristno

- uporabnik

- Uporabniški vmesnik

- Uporabniku prijazen

- Uporabniki

- uporablja

- uporabo

- Vrednote

- spremenljivka

- raznolikost

- različnih

- Popravljeno

- vsestranski

- različica

- preko

- želeli

- we

- web

- spletne storitve

- Dobro

- Kaj

- Kaj je

- kdaj

- medtem ko

- ali

- ki

- medtem

- bo

- z

- Ženske

- delovnih tokov

- deluje

- bi

- let

- Vi

- Vaša rutina za

- zefirnet