Amazon SageMaker ponuja široko izbiro infrastrukture strojnega učenja (ML) in možnosti uvajanja modelov, ki pomagajo zadovoljiti vaše potrebe po sklepanju ML. To je popolnoma upravljana storitev in se integrira z orodji MLOps, tako da lahko delate na obsegu uvajanja modela, zmanjšate stroške sklepanja, učinkoviteje upravljate modele v proizvodnji in zmanjšate operativno breme. SageMaker ponuja več možnosti sklepanja tako da lahko izberete možnost, ki najbolj ustreza vaši delovni obremenitvi.

Nove generacije procesorjev ponujajo znatno izboljšanje zmogljivosti pri sklepanju ML zaradi specializiranih vgrajenih navodil. V tej objavi se osredotočamo na to, kako lahko izkoristite AWS Graviton3temelječ Amazon Elastic Compute Cloud (EC2) Primerki C7g pomaga zmanjšati stroške sklepanja do 50 % v primerjavi s primerljivimi primerki EC2 za sklepanje v realnem času na Amazon SageMaker. Pokažemo, kako lahko ocenite zmogljivost sklepanja in preklopite svoje delovne obremenitve ML na instance AWS Graviton v samo nekaj korakih.

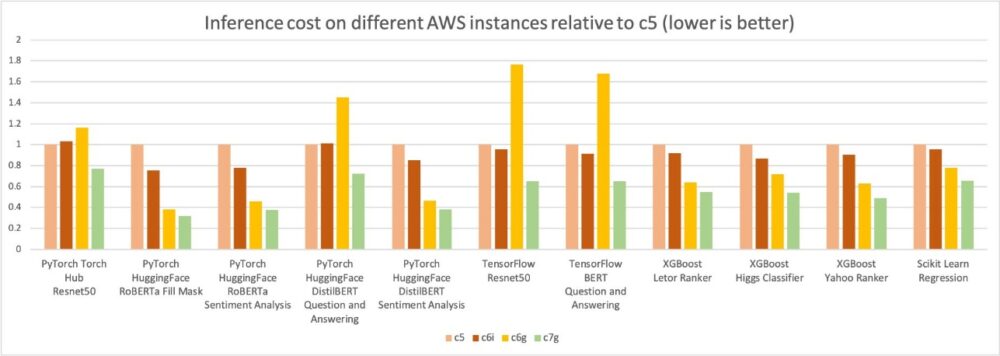

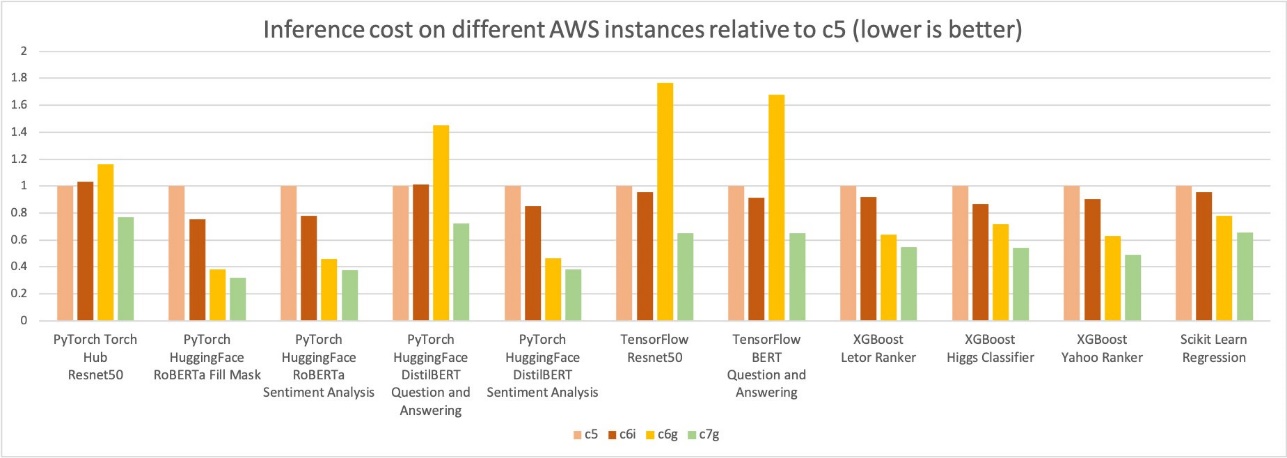

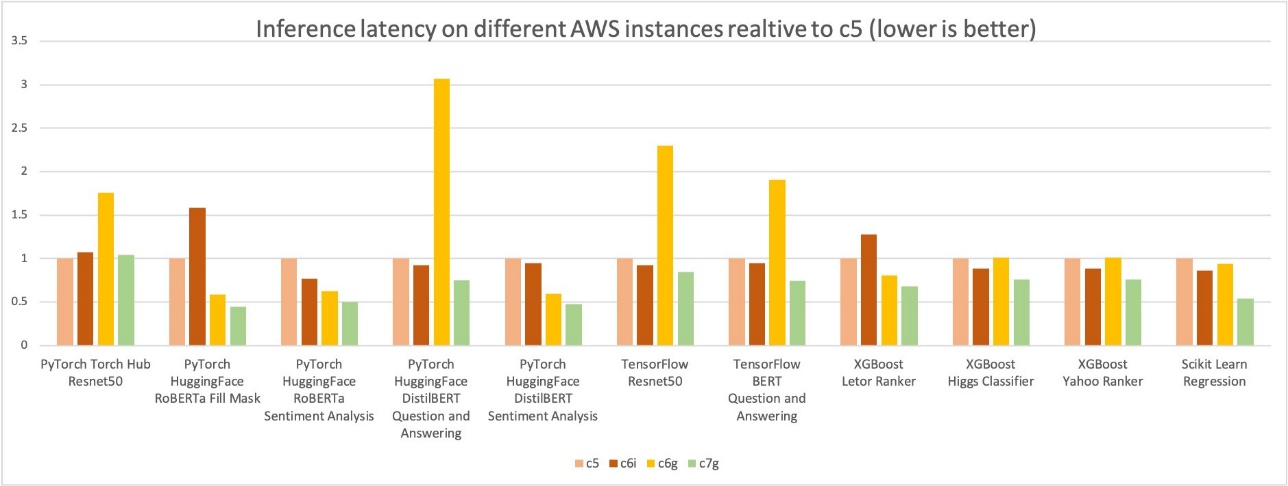

Da bi zajeli priljubljen in širok nabor uporabniških aplikacij, v tej objavi razpravljamo o uspešnosti sklepanja ogrodij PyTorch, TensorFlow, XGBoost in scikit-learn. Pokrivamo računalniški vid (CV), obdelavo naravnega jezika (NLP), klasifikacijo in scenarije razvrščanja za modele ter primerke ml.c6g, ml.c7g, ml.c5 in ml.c6i SageMaker za primerjalno analizo.

Rezultati primerjalne analize

AWS je izmeril do 50-odstotni prihranek stroškov za PyTorch, TensorFlow, XGBoost in sklepanje o modelu scikit-learn z instancami EC3 C2g, ki temeljijo na AWS Graviton7, v primerjavi s primerljivimi instancami EC2 na Amazon SageMaker. Hkrati se zmanjša tudi zakasnitev sklepanja.

Za primerjavo smo uporabili štiri različne vrste primerkov:

Vsi štirje primerki imajo 16 vCPE in 32 GiB pomnilnika.

V naslednjem grafu smo izmerili ceno na milijon sklepanja za štiri vrste instanc. Dodatno smo normalizirali ceno na milijon rezultatov sklepanja na primer c5.4xlarge, ki je izmerjen kot 1 na osi Y grafikona. Vidite lahko, da je za modele XGBoost sklep o ceni na milijon za c7g.4xlarge (AWS Graviton3) približno 50 % c5.4xlarge in 40 % c6i.4xlarge; za modele PyTorch NLP je prihranek stroškov približno 30–50 % v primerjavi s primerki c5 in c6i.4xlarge. Za druge modele in okvire smo izmerili vsaj 30-odstotni prihranek stroškov v primerjavi s primerki c5 in c6i.4xlarge.

Podobno kot prejšnji graf primerjave stroškov sklepanja, naslednji graf prikazuje zakasnitev modela p90 za iste štiri vrste primerkov. Nadalje smo normalizirali rezultate zakasnitve na primer c5.4xlarge, ki je izmerjen kot 1 na osi Y grafikona. Zakasnitev sklepanja modela c7g.4xlarge (AWS Graviton3) je do 50 % boljša od zakasnitev, izmerjenih na c5.4xlarge in c6i.4xlarge.

Preselite se na primerke AWS Graviton

Če želite razmestiti svoje modele v primerke AWS Graviton, lahko uporabite bodisi AWS posode za globoko učenje (DLC-ji) oz prinesite svoje posode ki so združljivi z arhitekturo ARMv8.2.

Selitev (ali nova uvedba) vaših modelov v instance AWS Graviton je enostavna, ker AWS ne samo zagotavlja vsebnike za gostovanje modelov s PyTorch, TensorFlow, scikit-learn in XGBoost, ampak so modeli tudi arhitekturno agnostični. Prinesete lahko tudi svoje lastne knjižnice, vendar se prepričajte, da je vaš vsebnik zgrajen z okoljem, ki podpira arhitekturo ARMv8.2. Za več informacij glejte Izdelava lastnega vsebnika algoritmov.

Za uvedbo modela boste morali dokončati tri korake:

- Ustvarite model SageMaker. To bo med drugimi parametri vsebovalo informacije o lokaciji datoteke modela, vsebniku, ki bo uporabljen za razmestitev, in lokaciji sklepnega skripta. (Če imate obstoječi model že razporejen v primerku sklepanja, optimiziranega za izračune, lahko ta korak preskočite.)

- Ustvarite konfiguracijo končne točke. To bo vsebovalo informacije o vrsti primerka, ki ga želite za končno točko (na primer ml.c7g.xlarge za AWS Graviton3), ime modela, ki ste ga ustvarili v prejšnjem koraku, in število primerkov na končno točko.

- Zaženite končno točko s konfiguracijo končne točke, ustvarjeno v prejšnjem koraku.

Za podrobna navodila glejte Zaženite delovne obremenitve sklepanja strojnega učenja na instancah, ki temeljijo na AWS Graviton, z Amazon SageMaker

Metodologija primerjalne analize

Uporabili smo Amazon SageMaker Inference Recommender za avtomatizacijo primerjalne analize uspešnosti v različnih primerih. Ta storitev primerja zmogljivost vašega modela ML v smislu zakasnitve in stroškov na različnih instancah ter priporoči instanco in konfiguracijo, ki zagotavlja najboljšo zmogljivost za najnižje stroške. Zgoraj omenjene podatke o uspešnosti smo zbrali s pomočjo Inference Recommender. Za več podrobnosti glejte GitHub repo.

Lahko uporabite vzorec zvezka za izvajanje meril uspešnosti in reprodukcijo rezultatov. Za primerjalno analizo smo uporabili naslednje modele:

zaključek

AWS je izmeril do 50-odstotni prihranek stroškov za PyTorch, TensorFlow, XGBoost in sklepanje o modelu scikit-learn z instancami EC3 C2g, ki temeljijo na AWS Graviton7, v primerjavi s primerljivimi instancami EC2 na Amazon SageMaker. Svoje obstoječe primere uporabe sklepanja lahko preselite ali uvedete nove modele ML na AWS Graviton tako, da sledite korakom v tej objavi. Lahko se sklicujete tudi na Tehnični priročnik za AWS Graviton, ki ponuja seznam optimiziranih knjižnic in najboljših praks, ki vam bodo pomagali doseči stroškovne ugodnosti z instancami AWS Graviton pri različnih delovnih obremenitvah.

Če najdete primere uporabe, kjer na AWS Graviton ni opaziti podobnih izboljšav zmogljivosti, se obrnite na nas. Še naprej bomo dodajali več izboljšav zmogljivosti, da bo AWS Graviton najbolj stroškovno učinkovit in učinkovit procesor za splošne namene za sklepanje ML.

O avtorjih

Sunita Nadampalli je vodja razvoja programske opreme pri AWS. Vodi optimizacije delovanja programske opreme Graviton za strojno učenje, HPC in multimedijske delovne obremenitve. Navdušena je nad odprtokodnim razvojem in zagotavljanjem stroškovno učinkovitih programskih rešitev z Arm SoC.

Sunita Nadampalli je vodja razvoja programske opreme pri AWS. Vodi optimizacije delovanja programske opreme Graviton za strojno učenje, HPC in multimedijske delovne obremenitve. Navdušena je nad odprtokodnim razvojem in zagotavljanjem stroškovno učinkovitih programskih rešitev z Arm SoC.

Jaymin Desai je inženir za razvoj programske opreme pri skupini Amazon SageMaker Inference. Strastno se zavzema za prenos umetne inteligence v množice in izboljšanje uporabnosti najsodobnejših sredstev umetne inteligence tako, da jih pretvori v funkcije in storitve. V prostem času uživa v raziskovanju glasbe in potovanjih.

Jaymin Desai je inženir za razvoj programske opreme pri skupini Amazon SageMaker Inference. Strastno se zavzema za prenos umetne inteligence v množice in izboljšanje uporabnosti najsodobnejših sredstev umetne inteligence tako, da jih pretvori v funkcije in storitve. V prostem času uživa v raziskovanju glasbe in potovanjih.

Mike Schneider je sistemski razvijalec s sedežem v Phoenixu AZ. Je član vsebnikov Deep Learning, ki podpira različne slike vsebnikov Framework, vključno z Graviton Inference. Predan je učinkovitosti in stabilnosti infrastrukture.

Mike Schneider je sistemski razvijalec s sedežem v Phoenixu AZ. Je član vsebnikov Deep Learning, ki podpira različne slike vsebnikov Framework, vključno z Graviton Inference. Predan je učinkovitosti in stabilnosti infrastrukture.

Mohan Gandhi je višji programski inženir pri AWS. Z AWS je zaposlen zadnjih 10 let in je delal na različnih storitvah AWS, kot so EMR, EFA in RDS. Trenutno je osredotočen na izboljšanje SageMaker Inference Experience. V prostem času se ukvarja s pohodništvom in maratoni.

Mohan Gandhi je višji programski inženir pri AWS. Z AWS je zaposlen zadnjih 10 let in je delal na različnih storitvah AWS, kot so EMR, EFA in RDS. Trenutno je osredotočen na izboljšanje SageMaker Inference Experience. V prostem času se ukvarja s pohodništvom in maratoni.

Qingwei Li je strokovnjak za strojno učenje pri Amazon Web Services. Dobil je doktorat. v operativni raziskavi, potem ko je zlomil račun svojega svetovalca za raziskovalno podporo in ni prejel nobelove nagrade, ki jo je obljubil. Trenutno pomaga strankam v finančni službi in zavarovalniški industriji pri gradnji rešitev za strojno učenje na AWS. V prostem času rad bere in poučuje.

Qingwei Li je strokovnjak za strojno učenje pri Amazon Web Services. Dobil je doktorat. v operativni raziskavi, potem ko je zlomil račun svojega svetovalca za raziskovalno podporo in ni prejel nobelove nagrade, ki jo je obljubil. Trenutno pomaga strankam v finančni službi in zavarovalniški industriji pri gradnji rešitev za strojno učenje na AWS. V prostem času rad bere in poučuje.

Wayne Toh je specializiran arhitekt za rešitve za Graviton pri AWS. Osredotoča se na pomoč strankam, da sprejmejo arhitekturo ARM za velike vsebniške delovne obremenitve. Preden se je pridružil AWS, je Wayne delal za več velikih prodajalcev programske opreme, vključno z IBM in Red Hat.

Wayne Toh je specializiran arhitekt za rešitve za Graviton pri AWS. Osredotoča se na pomoč strankam, da sprejmejo arhitekturo ARM za velike vsebniške delovne obremenitve. Preden se je pridružil AWS, je Wayne delal za več velikih prodajalcev programske opreme, vključno z IBM in Red Hat.

Lauren Mullennex je arhitektka rešitev s sedežem v Denverju, CO. Sodeluje s strankami, da jim pomaga pri načrtovanju rešitev na AWS. V prostem času uživa v pohodništvu in kuhanju havajske kuhinje.

Lauren Mullennex je arhitektka rešitev s sedežem v Denverju, CO. Sodeluje s strankami, da jim pomaga pri načrtovanju rešitev na AWS. V prostem času uživa v pohodništvu in kuhanju havajske kuhinje.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoAiStream. Podatkovna inteligenca Web3. Razširjeno znanje. Dostopite tukaj.

- Kovanje prihodnosti z Adryenn Ashley. Dostopite tukaj.

- Kupujte in prodajajte delnice podjetij pred IPO s PREIPO®. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :ima

- : je

- :ne

- :kje

- $GOR

- 1

- 10

- 100

- 7

- 98

- a

- O meni

- Račun

- Doseči

- čez

- dodajte

- sprejme

- Prednost

- po

- AI

- algoritem

- že

- Prav tako

- Amazon

- Amazon SageMaker

- Amazon Web Services

- med

- an

- in

- aplikacije

- Arhitektura

- SE

- ARM

- AS

- Sredstva

- At

- avtomatizirati

- AWS

- temeljijo

- BE

- ker

- bilo

- primerjalna analiza

- meril

- Prednosti

- BEST

- najboljše prakse

- Boljše

- prinašajo

- široka

- broke

- izgradnjo

- zgrajena

- vgrajeno

- obremenitev

- vendar

- by

- CAN

- primeri

- Graf

- Razvrstitev

- Cloud

- CO

- primerljiva

- v primerjavi z letom

- Primerjava

- združljiv

- dokončanje

- Izračunajte

- računalnik

- Računalniška vizija

- konfiguracija

- vsebujejo

- Posoda

- Zabojniki

- naprej

- strošek

- prihranki pri stroških

- stroškovno učinkovito

- stroški

- pokrov

- ustvaril

- Trenutno

- stranka

- Stranke, ki so

- datum

- namenjen

- globoko

- globoko učenje

- poda

- dostavo

- Denver

- razporedi

- razporejeni

- uvajanje

- podrobno

- Podrobnosti

- Razvojni

- Razvoj

- drugačen

- razpravlja

- ne

- 2

- učinkovito

- učinkovitosti

- učinkovite

- bodisi

- Končna točka

- inženir

- okolje

- oceniti

- Primer

- obstoječih

- izkušnje

- Raziskovati

- ni uspelo

- Lastnosti

- Nekaj

- file

- finančna

- finančne storitve

- Najdi

- Osredotočite

- osredotočena

- Osredotoča

- po

- za

- štiri

- Okvirni

- okviri

- brezplačno

- nadalje

- zaslužek

- glavni namen

- generacije

- daje

- odobri

- graf

- klobuk

- Imajo

- he

- pomoč

- pomoč

- Pomaga

- jo

- njegov

- gostitelj

- Kako

- hpc

- HTML

- HTTPS

- IBM

- if

- slike

- Izboljšanje

- Izboljšave

- izboljšanju

- in

- vključujejo

- Vključno

- Industrija

- Podatki

- Infrastruktura

- primer

- Navodila

- zavarovanje

- Integrira

- v

- pridružil

- jpg

- samo

- jezik

- velika

- Zadnja

- Latenca

- Interesenti

- učenje

- vsaj

- knjižnice

- kot

- všeč mi je

- Seznam

- kraj aktivnosti

- najnižja

- stroj

- strojno učenje

- Znamka

- upravljanje

- upravitelj

- mase

- Srečati

- član

- Spomin

- selitev

- migracije

- milijonov

- ML

- MLOps

- Model

- modeli

- več

- Najbolj

- multimedia

- več

- Glasba

- Ime

- naravna

- Obdelava Natural Language

- Nimate

- potrebe

- Novo

- nlp

- Nobelova nagrada

- Številka

- of

- ponudba

- on

- samo

- open source

- operativno

- operacije

- optimizirana

- Možnost

- možnosti

- or

- Da

- Ostalo

- ven

- lastne

- parametri

- strastno

- performance

- phoenix

- kramp

- platon

- Platonova podatkovna inteligenca

- PlatoData

- prosim

- Popular

- Prispevek

- vaje

- prejšnja

- Predhodna

- Nagrada

- obravnavati

- Procesor

- proizvodnja

- obljubil

- zagotavljajo

- če

- zagotavlja

- pitorha

- območje

- Lestvica

- dosežejo

- reading

- prejetih

- priporoča

- Rdeča

- Red Hat

- zmanjša

- Zmanjšana

- Raziskave

- Rezultati

- Run

- sagemaker

- Sklep SageMaker

- Enako

- Prihranki

- Lestvica

- scenariji

- scikit-učiti

- glej

- izbor

- višji

- Storitev

- Storitve

- več

- je

- Prikaži

- Razstave

- pomemben

- Podoben

- So

- Software

- Razvoj programske opreme

- Software Engineer

- rešitve

- specialist

- specializirani

- Stabilnost

- state-of-the-art

- Korak

- Koraki

- naravnost

- Podpora

- Podpira

- Preklop

- sistemi

- Bodite

- ob

- poučevanje

- skupina

- tehnični

- tensorflo

- Pogoji

- kot

- da

- O

- informacije

- Njih

- ta

- 3

- čas

- do

- orodja

- Potovanje

- tip

- Vrste

- us

- uporabnost

- uporaba

- Rabljeni

- uporabo

- različnih

- prodajalci

- Vizija

- želeli

- we

- web

- spletne storitve

- Dobro

- ki

- bo

- z

- delo

- delal

- deluje

- XGBoost

- let

- Vi

- Vaša rutina za

- zefirnet