Fröet till ett paradigmskifte för maskininlärning (ML) har funnits i årtionden, men med den lätta tillgången på skalbar beräkningskapacitet, en enorm spridning av data och den snabba utvecklingen av ML-tekniker, förändrar kunder inom olika branscher sina verksamheter. Nyligen har generativa AI-applikationer som ChatGPT fångat stor uppmärksamhet och fantasi. Vi befinner oss verkligen vid en spännande brytpunkt i den utbredda användningen av ML, och vi tror att de flesta kundupplevelser och applikationer kommer att återuppfinnas med generativ AI.

AI och ML har varit ett fokus för Amazon i över 20 år, och många av de funktioner som kunder använder med Amazon drivs av ML. Vår motor för e-handelsrekommendationer drivs av ML; vägarna som optimerar robotplockningsrutter i våra uppfyllnadscenter drivs av ML; och vår leveranskedja, prognoser och kapacitetsplanering informeras av ML. Prime Air (våra drönare) och datorseendeteknologin i Amazon Go (vår fysiska detaljhandelsupplevelse som låter konsumenter välja varor från en hylla och lämna butiken utan att formellt behöva checka ut) använder djupinlärning. Alexa, som drivs av mer än 30 olika ML-system, hjälper kunder miljarder gånger varje vecka att hantera smarta hem, shoppa, få information och underhållning och mer. Vi har tusentals ingenjörer på Amazon som är engagerade i ML, och det är en stor del av vårt arv, nuvarande etos och framtid.

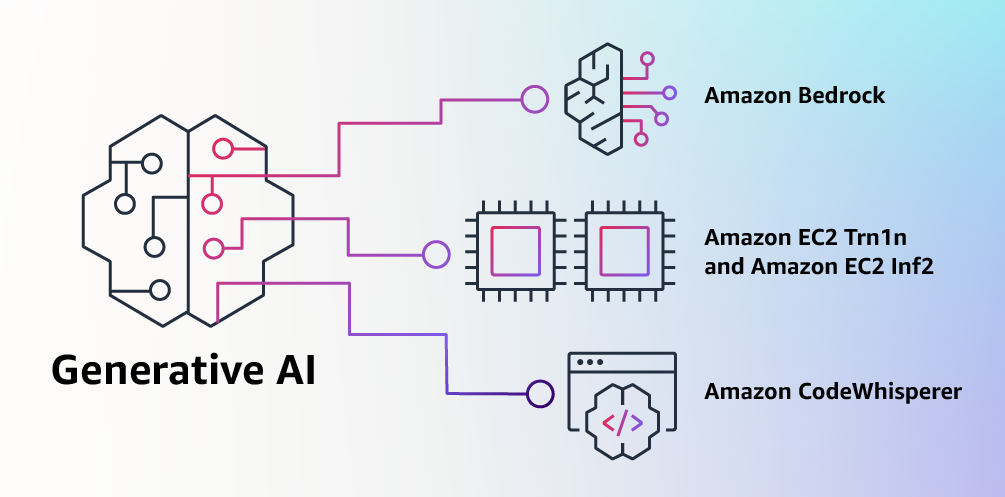

På AWS har vi spelat en nyckelroll i att demokratisera ML och göra det tillgängligt för alla som vill använda det, inklusive mer än 100,000 3 kunder i alla storlekar och branscher. AWS har den bredaste och djupaste portföljen av AI- och ML-tjänster på alla tre lager i stacken. Vi har investerat och förnyat för att erbjuda den mest effektiva, skalbara infrastrukturen för kostnadseffektiv ML-utbildning och slutledning; utvecklat Amazon SageMaker, vilket är det enklaste sättet för alla utvecklare att bygga, träna och distribuera modeller; och lanserade ett brett utbud av tjänster som tillåter kunder att lägga till AI-funktioner som bildigenkänning, prognoser och intelligent sökning till applikationer med ett enkelt API-anrop. Det är därför kunder som Intuit, Thomson Reuters, AstraZeneca, Ferrari, Bundesliga, XNUMXM och BMW, såväl som tusentals startups och statliga myndigheter runt om i världen, förändrar sig själva, sina industrier och sina uppdrag med ML. Vi tar samma demokratiserande inställning till generativ AI: vi arbetar för att ta dessa teknologier ur forsknings- och experimentområdet och utöka deras tillgänglighet långt bortom en handfull nystartade företag och stora, välfinansierade teknikföretag. Det är därför jag idag är glad att kunna presentera flera nya innovationer som kommer att göra det enkelt och praktiskt för våra kunder att använda generativ AI i sina verksamheter.

Bygga med generativ AI på AWS

Generativa AI och grundmodeller

Generativ AI är en typ av AI som kan skapa nytt innehåll och nya idéer, inklusive konversationer, berättelser, bilder, videor och musik. Liksom all AI drivs generativ AI av ML-modeller – mycket stora modeller som är förtränade på stora mängder data och som vanligtvis kallas grundmodeller (FM). De senaste framstegen inom ML (särskilt uppfinningen av den transformatorbaserade neurala nätverksarkitekturen) har lett till framväxten av modeller som innehåller miljarder parametrar eller variabler. För att ge en känsla för skalförändringen var den största förtränade modellen 2019 330 miljoner parametrar. Nu är de största modellerna mer än 500B parametrar – en 1,600 3.5 gånger större storlek på bara några år. Dagens FM:er, som de stora språkmodellerna (LLM) GPTXNUMX eller BLOOM, och text-till-bild-modellen Stable Diffusion from Stability AI, kan utföra ett brett utbud av uppgifter som spänner över flera domäner, som att skriva blogginlägg, generera bilder, lösa matematiska problem, engagera sig i dialog och svara på frågor baserade på ett dokument. Storleken och den allmänna karaktären hos FM:er skiljer dem från traditionella ML-modeller, som vanligtvis utför specifika uppgifter, som att analysera text för känslor, klassificera bilder och prognostisera trender.

FM:er kan utföra så många fler uppgifter eftersom de innehåller ett så stort antal parametrar som gör dem kapabla att lära sig komplexa begrepp. Och genom sin exponering före utbildning för data i internetskala i alla dess olika former och myriad av mönster, lär sig FM:er att tillämpa sin kunskap inom ett brett spektrum av sammanhang. Även om kapaciteten och de resulterande möjligheterna hos en förtränad FM är fantastiska, blir kunderna riktigt exalterade eftersom dessa generellt kapabla modeller också kan anpassas för att utföra domänspecifika funktioner som skiljer sig åt för deras verksamheter, genom att bara använda en liten del av data och beräkning som krävs för att träna en modell från grunden. De skräddarsydda FM:erna kan skapa en unik kundupplevelse, som förkroppsligar företagets röst, stil och tjänster inom en mängd olika konsumentbranscher, som bank, resor och hälsovård. Till exempel kan ett finansföretag som behöver automatiskt generera en daglig aktivitetsrapport för intern cirkulation med alla relevanta transaktioner anpassa modellen med egen data, som kommer att inkludera tidigare rapporter, så att FM lär sig hur dessa rapporter ska läsas och vad data användes för att generera dem.

FMs potential är otroligt spännande. Men vi är fortfarande i de allra första dagarna. Även om ChatGPT har varit den första breda generativa AI-upplevelsen för att fånga kundernas uppmärksamhet, har de flesta som studerar generativ AI snabbt insett att flera företag har arbetat med FM i flera år, och det finns flera olika FM:er tillgängliga – alla med unika styrkor och egenskaper. Som vi har sett under åren med snabbrörliga teknologier, och i utvecklingen av ML, förändras saker snabbt. Vi förväntar oss att nya arkitekturer kommer att uppstå i framtiden, och denna mångfald av FM kommer att starta en våg av innovation. Vi ser redan nya applikationsupplevelser som vi aldrig sett förut. AWS-kunder har frågat oss hur de snabbt kan dra nytta av det som finns där ute idag (och vad som troligen kommer imorgon) och snabbt börja använda FM:er och generativ AI inom sina företag och organisationer för att driva nya nivåer av produktivitet och förvandla sina erbjudanden.

Tillkännage Amazon Bedrock och Amazon Titan-modeller, det enklaste sättet att bygga och skala generativa AI-applikationer med FMs

Kunder har berättat att det är några stora saker som står i vägen idag. För det första behöver de ett enkelt sätt att hitta och komma åt högpresterande FM:er som ger enastående resultat och är bäst lämpade för deras syften. För det andra vill kunderna att integrationen i applikationer ska vara sömlös, utan att behöva hantera stora kluster av infrastruktur eller ådra sig stora kostnader. Slutligen vill kunderna att det ska vara enkelt att ta basen FM och bygga differentierade appar med hjälp av sin egen data (lite data eller mycket). Eftersom den data som kunderna vill använda för anpassning är otroligt värdefull IP behöver de att den förblir helt skyddad, säker och privat under den processen, och de vill ha kontroll över hur deras data delas och används.

Vi tog emot all feedback från kunderna och idag är vi glada att kunna meddela Amazonas berggrund, en ny tjänst som gör FM:er från AI21 Labs, Anthropic, Stability AI och Amazon tillgängliga via ett API. Berggrund är det enklaste sättet för kunder att bygga och skala generativa AI-baserade applikationer med hjälp av FM, vilket demokratiserar åtkomst för alla byggare. Bedrock kommer att erbjuda möjligheten att få tillgång till en rad kraftfulla FM-apparater för text och bilder – inklusive Amazons Titan FMs, som består av två nya LLM:er som vi också tillkännager idag— genom en skalbar, pålitlig och säker AWS-hanterad tjänst. Med Bedrocks serverlösa upplevelse kan kunder enkelt hitta rätt modell för det de försöker få gjort, komma igång snabbt, privatanpassa FM:s med sina egna data och enkelt integrera och distribuera dem i sina applikationer med hjälp av AWS-verktygen och funktionerna de är bekanta med (inklusive integrationer med Amazon SageMaker ML-funktioner som Experiment för att testa olika modeller och Pipelines för att hantera sina FMs i stor skala) utan att behöva hantera någon infrastruktur.

Berggrundskunder kan välja bland några av de mest avancerade FM-apparaterna som finns tillgängliga idag. Detta inkluderar Jurassic-2-familjen av flerspråkiga LLM från AI21 Labs, som följer instruktioner på naturliga språk för att generera text på spanska, franska, tyska, portugisiska, italienska och holländska. Claude, Anthropics LLM, kan utföra en mängd olika samtals- och textbearbetningsuppgifter och är baserad på Anthropics omfattande forskning om att träna ärliga och ansvarsfulla AI-system. Bedrock gör det också enkelt att komma åt Stability AI:s svit av text-till-bild-grundmodeller, inklusive Stable Diffusion (den mest populära i sitt slag), som kan generera unika, realistiska bilder av hög kvalitet, konst, logotyper och mönster.

En av de viktigaste egenskaperna hos Bedrock är hur lätt det är att skräddarsy en modell. Kunder pekar helt enkelt Bedrock på några märkta exempel i Amazon S3, och tjänsten kan finjustera modellen för en viss uppgift utan att behöva kommentera stora datamängder (så få som 20 exempel räcker). Föreställ dig en innehållsmarknadsföringschef som arbetar på en ledande modeåterförsäljare och behöver utveckla fräscha, riktade annons- och kampanjtexter för en kommande ny linje av handväskor. För att göra detta ger de Bedrock några märkta exempel på deras bäst presterande taglines från tidigare kampanjer, tillsammans med tillhörande produktbeskrivningar, och Bedrock kommer automatiskt att börja generera effektiva sociala medier, visningsannonser och webbkopior för de nya handväskorna. Ingen av kundens data används för att träna de underliggande modellerna, och eftersom all data är krypterad och inte lämnar en kunds Virtual Private Cloud (VPC), kan kunderna lita på att deras data förblir privat och konfidentiell.

Bedrock är nu i begränsad förhandsvisning, och kunderna gillar Coda är exalterade över hur snabbt deras utvecklingsteam har kommit igång. Shishir Mehrotra, medgrundare och VD för Coda, säger: "Som en långvarig nöjd AWS-kund är vi exalterade över hur Amazon Bedrock kan tillföra kvalitet, skalbarhet och prestanda till Coda AI. Eftersom all vår data redan finns på AWS kan vi snabbt införliva generativ AI med Bedrock, med all säkerhet och integritet vi behöver för att skydda vår data inbyggd. Med över tiotusentals team som kör på Coda, inklusive stora team som Uber, New York Times och Square, är tillförlitlighet och skalbarhet verkligen viktigt.”

Vi har förhandsgranskat Amazons nya Titan FM med några kunder innan vi gör dem tillgängliga mer allmänt under de kommande månaderna. Vi kommer initialt att ha två Titan-modeller. Den första är en generativ LLM för uppgifter som sammanfattning, textgenerering (till exempel skapa ett blogginlägg), klassificering, öppna frågor och svar och informationsextraktion. Den andra är en inbäddad LLM som översätter textinmatningar (ord, fraser eller möjligen stora enheter av text) till numeriska representationer (känd som inbäddningar) som innehåller textens semantiska betydelse. Även om denna LLM inte genererar text, är den användbar för applikationer som personalisering och sökning eftersom modellen genom att jämföra inbäddningar producerar mer relevanta och kontextuella svar än ordmatchning. Faktum är att Amazon.coms produktsökningsfunktion använder en liknande inbäddningsmodell bland annat för att hjälpa kunderna att hitta de produkter de letar efter. För att fortsätta stödja bästa praxis för ansvarsfull användning av AI, är Titan FMs byggda för att upptäcka och ta bort skadligt innehåll i data, avvisa olämpligt innehåll i användarinmatningen och filtrera modellernas utdata som innehåller olämpligt innehåll (som hatretorik, svordomar och våld).

Bedrock gör kraften hos FM:er tillgänglig för företag av alla storlekar så att de kan påskynda användningen av ML över sina organisationer och bygga sina egna generativa AI-applikationer eftersom det kommer att vara enkelt för alla utvecklare. Vi tror att Bedrock kommer att vara ett enormt steg framåt för att demokratisera FMs, och våra partners som Accenture, Deloitte, Infosys och Slalom bygger praxis för att hjälpa företag att gå snabbare med generativ AI. Independent Software Vendors (ISVs) gillar C3 AI och Pega är glada över att kunna utnyttja Bedrock för enkel tillgång till dess stora urval av FM-apparater med all den säkerhet, integritet och tillförlitlighet de förväntar sig av AWS.

Tillkännage den allmänna tillgängligheten av Amazon EC2 Trn1n-instanser som drivs av AWS Trainium och Amazon EC2 Inf2-instanser som drivs av AWS Inferentia2, den mest kostnadseffektiva molninfrastrukturen för generativ AI

Vad kunderna än försöker göra med FM:er – att köra dem, bygga dem, anpassa dem – behöver de den mest presterande, kostnadseffektiva infrastrukturen som är specialbyggd för ML. Under de senaste fem åren har AWS investerat i vårt eget kisel för att driva på prestanda och prisprestanda för krävande arbetsbelastningar som ML-träning och Inferens, och våra AWS Trainium- och AWS Inferentia-chips erbjuder den lägsta kostnaden för träningsmodeller och löpningslutningar. i molnet. Denna förmåga att maximera prestanda och kontrollera kostnader genom att välja den optimala ML-infrastrukturen är anledningen till att ledande AI-startups, som AI21 Labs, Anthropic, Cohere, Grammarly, Hugging Face, Runway och Stability AI körs på AWS.

Trn1-instanser, som drivs av Trainium, kan ge upp till 50 % besparingar på utbildningskostnader jämfört med alla andra EC2-instanser, och är optimerade för att distribuera utbildning över flera servrar anslutna med 800 Gbps andra generationens Elastic Fabric Adapter (EFA) nätverk. Kunder kan distribuera Trn1-instanser i UltraClusters som kan skala upp till 30,000 6 Trainium-chips (mer än 1 exaflops of compute) som finns i samma AWS-tillgänglighetszon med petabit-skala nätverk. Många AWS-kunder, inklusive Helixon, Money Forward och Amazon Search-teamet, använder Trn800-instanser för att hjälpa till att minska den tid som krävs för att träna de storskaliga djupinlärningsmodellerna från månader till veckor eller till och med dagar samtidigt som de sänker kostnaderna. XNUMX Gbps är mycket bandbredd, men vi har fortsatt att förnya oss för att leverera mer, och idag tillkännager vi allmän tillgänglighet av nya, nätverksoptimerade Trnln instanser, som erbjuder 1600 Gbps nätverksbandbredd och är designade för att leverera 20 % högre prestanda över Trn1 för stora, nätverksintensiva modeller.

Idag går det mesta av tiden och pengarna som spenderas på FM till att träna dem. Detta beror på att många kunder bara har börjat distribuera FM-apparater i produktion. Men i framtiden, när FM:er distribueras i stor skala, kommer de flesta kostnaderna att vara förknippade med att köra modellerna och göra slutsatser. Medan du vanligtvis tränar en modell med jämna mellanrum, kan en produktionsapplikation ständigt generera förutsägelser, kända som slutsatser, och potentiellt generera miljoner per timme. Och dessa förutsägelser måste ske i realtid, vilket kräver nätverk med mycket låg latens och hög genomströmning. Alexa är ett bra exempel med miljontals förfrågningar som kommer in varje minut, vilket står för 40 % av alla beräkningskostnader.

Eftersom vi visste att det mesta av framtida ML-kostnader skulle komma från att köra slutsatser, prioriterade vi slutledningsoptimerat kisel när vi började investera i nya chips för några år sedan. Under 2018 tillkännagav vi Inferentia, det första specialbyggda chippet för slutledning. Varje år hjälper Inferentia Amazon att köra biljoner slutsatser och har redan sparat företag som Amazon över hundra miljoner dollar i kapitalkostnader. Resultaten är imponerande, och vi ser många möjligheter att fortsätta förnya eftersom arbetsbelastningen bara kommer att öka i storlek och komplexitet när fler kunder integrerar generativ AI i sina applikationer.

Det är därför vi tillkännager idag allmän tillgång till INF2 instanser som drivs av AWS Inferentia2, som är optimerade specifikt för storskaliga generativa AI-applikationer med modeller som innehåller hundratals miljarder parametrar. Inf2-instanser levererar upp till 4x högre genomströmning och upp till 10x lägre latens jämfört med den tidigare generationens Inferentia-baserade instanser. De har också ultrahöghastighetsanslutning mellan acceleratorer för att stödja storskalig distribuerad slutledning. Dessa funktioner ger upp till 40 % bättre slutsatsprisprestanda än andra jämförbara Amazon EC2-instanser och den lägsta kostnaden för slutledning i molnet. Kunder som Runway ser upp till 2 gånger högre genomströmning med Inf2 än jämförbara Amazon EC2-instanser för vissa av sina modeller. Denna högpresterande och billiga slutledning kommer att göra det möjligt för Runway att introducera fler funktioner, distribuera mer komplexa modeller och i slutändan leverera en bättre upplevelse för de miljontals skapare som använder Runway.

Tillkännage den allmänna tillgängligheten av Amazon CodeWhisperer, gratis för enskilda utvecklare

Vi vet att att bygga med rätt FM och köra generativa AI-applikationer i stor skala på den mest presterande molninfrastrukturen kommer att vara transformerande för kunderna. Den nya vågen av upplevelser kommer också att vara transformerande för användarna. Med generativ AI inbyggd kommer användare att kunna ha mer naturliga och sömlösa interaktioner med applikationer och system. Tänk på hur vi kan låsa upp våra mobiltelefoner bara genom att titta på dem, utan att behöva veta något om de kraftfulla ML-modellerna som gör den här funktionen möjlig.

Ett område där vi förutser att användningen av generativ AI växer snabbt är kodning. Mjukvaruutvecklare spenderar idag en betydande del av sin tid på att skriva kod som är ganska enkel och odifferentierad. De spenderar också mycket tid på att försöka hänga med i ett komplext och ständigt föränderligt verktyg och tekniklandskap. Allt detta ger utvecklare mindre tid att utveckla nya, innovativa funktioner och tjänster. Utvecklare försöker övervinna detta genom att kopiera och ändra kodavsnitt från webben, vilket kan resultera i oavsiktlig kopiering av kod som inte fungerar, innehåller säkerhetsbrister eller som inte spårar användning av programvara med öppen källkod. Och i slutändan tar sökning och kopiering fortfarande tid från det som är bra.

Generativ AI kan ta detta tunga lyft ur ekvationen genom att "skriva" mycket av den odifferentierade koden, vilket gör det möjligt för utvecklare att bygga snabbare samtidigt som de frigör dem för att fokusera på de mer kreativa aspekterna av kodning. Det är därför vi förra året tillkännagav förhandsvisningen av Amazon Code Whisperer, en AI-kodningskompanjon som använder en FM under huven för att radikalt förbättra utvecklarens produktivitet genom att generera kodförslag i realtid baserat på utvecklarnas kommentarer på naturligt språk och tidigare kod i deras Integrated Development Environment (IDE). Utvecklare kan helt enkelt säga åt CodeWhisperer att göra en uppgift, som att "tolka en CSV-sträng med låtar" och be den att returnera en strukturerad lista baserad på värden som artist, titel och högsta listrankning. CodeWhisperer ger en produktivitetsökning genom att generera en hel funktion som analyserar strängen och returnerar listan som specificerats. Utvecklares svar på förhandsvisningen har varit överväldigande positiva, och vi fortsätter att tro att det att hjälpa utvecklarkod kan bli en av de mest kraftfulla användningarna av generativ AI som vi kommer att se under de kommande åren. Under förhandsgranskningen körde vi en produktivitetsutmaning, och deltagare som använde CodeWhisperer slutförde uppgifter 57 % snabbare i genomsnitt och var 27 % mer benägna att slutföra dem framgångsrikt än de som inte använde CodeWhisperer. Det här är ett stort steg framåt när det gäller utvecklarproduktivitet, och vi tror att detta bara är början.

Idag är vi glada att kunna meddela allmän tillgänglighet för Amazon CodeWhisperer för Python, Java, JavaScript, TypeScript och C# – plus tio nya språk, inklusive Go, Kotlin, Rust, PHP och SQL. CodeWhisperer kan nås från IDEs som VS Code, IntelliJ IDEA, AWS Cloud9 och många fler via AWS Toolkit IDE-tillägg. CodeWhisperer finns även i AWS Lambda-konsolen. Förutom att lära sig av miljarder rader med allmänt tillgänglig kod, har CodeWhisperer tränats på Amazon-kod. Vi tror att CodeWhisperer nu är det mest exakta, snabbaste och säkraste sättet att generera kod för AWS-tjänster, inklusive Amazon EC2, AWS Lambda och Amazon S3.

Utvecklare kommer inte riktigt att bli mer produktiva om kod som föreslås av deras generativa AI-verktyg innehåller dolda säkerhetsbrister eller inte hanterar öppen källkod på ett ansvarsfullt sätt. CodeWhisperer är den enda AI-kodningskompanjonen med inbyggd säkerhetsskanning (driven av automatiserad resonemang) för att hitta och föreslå åtgärder för svårupptäckta sårbarheter, till exempel de i topp tio Open Worldwide Application Security Project (OWASP), de som uppfyller inte kryptobibliotekets bästa praxis och andra. För att hjälpa utvecklare att koda ansvarsfullt filtrerar CodeWhisperer bort kodförslag som kan anses vara partiska eller orättvisa, och CodeWhisperer är den enda kodningskompanjonen som kan filtrera och flagga kodförslag som liknar öppen källkod som kunder kan vilja referera till eller licensiera för användning.

Vi vet att generativ AI kommer att förändra spelet för utvecklare, och vi vill att det ska vara användbart för så många som möjligt. Det är därför CodeWhisperer är gratis för alla individuella användare utan några kvalifikationer eller tidsgränser för att generera kod! Vem som helst kan registrera sig för CodeWhisperer med bara ett e-postkonto och bli mer produktiv inom några minuter. Du behöver inte ens ha ett AWS-konto. För företagsanvändare erbjuder vi en CodeWhisperer Professional Tier som inkluderar administrationsfunktioner som enkel inloggning (SSO) med AWS Identity and Access Management (IAM) integration, samt högre gränser för säkerhetsskanning.

Att bygga kraftfulla applikationer som CodeWhisperer är transformerande för utvecklare och alla våra kunder. Vi har mycket mer på gång och vi är spända på vad du kommer att bygga med generativ AI på AWS. Vårt uppdrag är att göra det möjligt för utvecklare på alla kompetensnivåer och för organisationer av alla storlekar att förnya sig med hjälp av generativ AI. Detta är bara början på vad vi tror kommer att bli nästa våg av ML som ger dig nya möjligheter.

Resurser

Kolla in följande resurser för att lära dig mer om generativ AI på AWS och dessa tillkännagivanden:

Om författaren

Swami Sivasubramanian är vice vd för data- och maskininlärning på AWS. I denna roll övervakar Swami alla AWS-databas-, analys- och AI- och maskininlärningstjänster. Hans teams uppdrag är att hjälpa organisationer att få sin data att fungera med en komplett, end-to-end datalösning för att lagra, komma åt, analysera och visualisera och förutsäga.

Swami Sivasubramanian är vice vd för data- och maskininlärning på AWS. I denna roll övervakar Swami alla AWS-databas-, analys- och AI- och maskininlärningstjänster. Hans teams uppdrag är att hjälpa organisationer att få sin data att fungera med en komplett, end-to-end datalösning för att lagra, komma åt, analysera och visualisera och förutsäga.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-for-building-with-generative-ai-on-aws/

- :är

- $UPP

- 000

- 000 kunder

- 1

- 100

- 20 år

- 2018

- 2019

- 7

- a

- förmåga

- Able

- Om oss

- accelerera

- acceleratorer

- Accenture

- tillgång

- Accessed

- tillgänglig

- Konto

- konton

- exakt

- tvärs

- aktivitet

- Ad

- Dessutom

- administrering

- Antagande

- befordran

- framsteg

- Fördel

- byråer

- AI

- AI och maskininlärning

- LUFT

- alexa

- Alla

- tillåta

- redan

- fantastiska

- amason

- Amazon Code Whisperer

- Amazon EC2

- Amazon SageMaker

- bland

- mängd

- mängder

- analytics

- analysera

- analys

- och

- Meddela

- meddelade

- Meddelanden

- Vi presenterar

- någon

- api

- Ansökan

- applikationssäkerhet

- tillämpningar

- Ansök

- tillvägagångssätt

- appar

- arkitektur

- ÄR

- OMRÅDE

- runt

- Konst

- konstnär

- AS

- aspekter

- associerad

- At

- uppmärksamhet

- Automatiserad

- automatiskt

- tillgänglighet

- tillgänglig

- genomsnitt

- AWS

- AWS Cloud9

- AWS kund

- AWS Identity and Access Management (IAM)

- AWS slutledning

- AWS Lambda

- Bandbredd

- Banking

- bas

- baserat

- BE

- därför att

- blir

- innan

- börja

- Börjar

- Där vi får lov att vara utan att konstant prestera,

- tro

- BÄST

- bästa praxis

- Bättre

- mellan

- Bortom

- Stor

- miljarder

- Blogg

- Blogginlägg

- Bloom

- BMW

- lyft

- föra

- bred

- brett

- SLUTRESULTAT

- byggare

- Byggnad

- byggt

- inbyggd

- företag

- företag

- by

- Ring

- Kampanj

- Kampanjer

- KAN

- kapacitet

- kapabel

- Kapacitet

- kapital

- brottning

- Centers

- VD

- kedja

- utmanar

- byta

- egenskaper

- Diagram

- ChatGPT

- ta

- chip

- Pommes frites

- Välja

- välja

- Cirkulation

- klassificering

- cloud

- molninfrastruktur

- Cloud9

- Medgrundare

- koda

- Kodning

- komma

- kommande

- kommentarer

- engagerad

- vanligen

- Företag

- Företagets

- jämförbar

- jämfört

- jämförande

- fullborda

- Avslutade

- fullständigt

- komplex

- Komplexiteten

- Compute

- dator

- Datorsyn

- Begreppen

- anslutna

- Anslutningar

- anses

- Konsol

- ständigt

- Konsumenten

- konsumenter

- innehålla

- innehåller

- innehåll

- Content Marketing

- kontexter

- kontextuella

- fortsätta

- fortsatte

- kontroll

- konversera

- konversationer

- kopiering

- Pris

- kostnadseffektiv

- Kostar

- kunde

- skapa

- Skapa

- Kreativ

- skaparna

- crypto

- Aktuella

- kund

- kundupplevelse

- Kunder

- anpassning

- skräddarsy

- kundanpassad

- allra senaste

- dagligen

- datum

- Databas

- Dagar

- årtionden

- djup

- djupt lärande

- djupaste

- leverera

- deloitte

- krävande

- demokrati

- distribuera

- utplacerade

- utformade

- mönster

- utveckla

- utvecklade

- Utvecklare

- utvecklare

- Utveckling

- dialogruta

- olika

- differentierad

- Diffusion

- Visa

- distribuera

- distribueras

- Mångfald

- dokumentera

- inte

- gör

- dollar

- domäner

- inte

- driv

- driven

- Drönare

- under

- Dutch

- e-handel

- varje

- Tidig

- enklaste

- lätt

- Effektiv

- möjliggöra

- krypterad

- början till slut

- engagerande

- Motor

- Ingenjörer

- tillräckligt

- företag

- Underhållning

- Hela

- Miljö

- Livssyn

- Även

- ständigt föränderliga

- Varje

- Utvecklingen

- exempel

- exempel

- exciterade

- spännande

- förvänta

- erfarenhet

- Erfarenheter

- Exponering

- förlänga

- förlängningar

- omfattande

- tyg

- Ansikte

- misslyckas

- bekant

- familj

- Mode

- SNABB

- snabbrörlig

- snabbare

- snabbast

- Leverans

- Funktioner

- återkoppling

- Ferrari

- få

- filtrera

- filter

- Slutligen

- finansiella

- hitta

- finna

- Firm

- Förnamn

- Fokus

- följer

- efter

- För

- Formellt

- former

- Framåt

- fundament

- fraktion

- Fri

- franska

- färsk

- från

- fungera

- funktioner

- framtida

- lek

- Allmänt

- generell mening

- allmänhet

- generera

- generera

- generering

- generativ

- Generativ AI

- tyska

- skaffa sig

- jätte

- Ge

- Go

- Går

- kommer

- god

- Regeringen

- stor

- Odling

- näve

- hantera

- hända

- lyckligt

- skadliga

- Har

- har

- hälso-och sjukvård

- tung

- tunga lyft

- hjälpa

- hjälpa

- hjälper

- kulturarv

- dold

- högpresterande

- högpresterande

- hög kvalitet

- högre

- högsta

- Bostäder

- huva

- Hur ser din drömresa ut

- Men

- HTTPS

- stor

- Hundratals

- Tanken

- idéer

- Identitet

- bild

- Bildigenkänning

- bilder

- fantasi

- med Esport

- imponerande

- förbättra

- in

- innefattar

- innefattar

- Inklusive

- införliva

- Öka

- oerhört

- oberoende

- individuellt

- industrier

- Böjpunkt

- informationen

- information utvinning

- informeras

- Infosys

- Infrastruktur

- initialt

- förnya

- nyskapande

- Innovation

- innovationer

- innovativa

- ingång

- exempel

- instruktioner

- integrera

- integrerade

- integrering

- integrationer

- Intelligent

- interaktioner

- inre

- införa

- Intuit

- uppfinning

- investerat

- investera

- IP

- IT

- artikel

- DESS

- java

- JavaScript

- Ha kvar

- Nyckel

- Snäll

- Vet

- kunskap

- känd

- Labs

- liggande

- språk

- Språk

- Large

- storskalig

- största

- Efternamn

- Förra året

- Latens

- lanserades

- skikt

- ledande

- Språng

- LÄRA SIG

- inlärning

- Lämna

- Led

- Lets

- nivåer

- Hävstång

- Bibliotek

- Licens

- lyft

- tycka om

- sannolikt

- Begränsad

- gränser

- linje

- rader

- Lista

- liten

- LLM

- belägen

- du letar

- Lot

- låg kostnad

- sänkning

- Maskinen

- maskininlärning

- göra

- GÖR

- Framställning

- hantera

- förvaltade

- ledning

- chef

- många

- Marknadsföring

- massiv

- matchande

- matte

- Maximera

- Maj..

- betyder

- Media

- Möt

- kanske

- miljon

- miljoner dollar

- miljoner

- minut

- minuter

- Mission

- uppdrag

- ML

- Mobil

- mobiltelefoner

- modell

- modeller

- pengar

- månader

- mer

- mest

- Mest populär

- multipel

- Musik

- Natural

- Natur

- Behöver

- behöver

- behov

- nät

- nätverk

- neurala nätverk

- Nya

- New York

- New York Times

- Nästa

- antal

- of

- erbjudanden

- erbjuda

- offer~~POS=TRUNC

- on

- ONE

- öppet

- öppen källkod

- möjligheter

- optimala

- Optimera

- optimerad

- organisationer

- Övriga

- Övrigt

- utestående

- Övervinna

- egen

- paradigmet

- parametrar

- del

- deltagare

- särskilt

- partner

- Tidigare

- mönster

- Utföra

- prestanda

- utför

- personalisering

- telefoner

- PHP

- fraser

- fysisk

- planering

- plato

- Platon Data Intelligence

- PlatonData

- spelat

- Punkt

- Populära

- portfölj

- portugisiska

- positiv

- Möjligheterna

- möjlig

- Inlägg

- inlägg

- potentiell

- potentiellt

- kraft

- drivs

- den mäktigaste

- Strömförsörjning

- Praktisk

- praxis

- förutse

- Förutsägelser

- VD

- pretty

- Förhandsvisning

- pris

- Prime

- Innan

- prioriteras

- privatpolicy

- privat

- problem

- process

- bearbetning

- producera

- Produkt

- Produktion

- produktiv

- produktivitet

- Produkter

- HÄDELSER

- professionell

- projektet

- proprietary

- skydda

- skyddad

- ge

- ger

- publicly

- syfte

- Tryck

- sätta

- Python

- Frågor och svar

- kvalifikationer

- kvalitet

- frågor

- snabbt

- radikalt

- område

- snabb

- snabbt

- Läsa

- redo

- realtid

- realistisk

- inser

- rike

- senaste

- nyligen

- erkännande

- rekommendationer

- minska

- avses

- relevanta

- tillförlitlighet

- pålitlig

- förblir

- ta bort

- rapport

- Rapport

- förfrågningar

- Obligatorisk

- Kräver

- forskning

- Resurser

- respons

- ansvarig

- resultera

- resulterande

- Resultat

- detaljhandeln

- återförsäljare

- avkastning

- återgår

- Reuters

- Rise

- Roll

- rutter

- Körning

- rinnande

- bana

- Rust

- sagemaker

- Samma

- Besparingar

- säger

- skalbarhet

- skalbar

- Skala

- scanning

- sömlös

- Sök

- söka

- Andra

- säkra

- säkerhet

- frön

- se

- Val

- känsla

- känsla

- Server

- Servrar

- service

- Tjänster

- in

- flera

- delas

- Hylla

- skifta

- Butik

- skall

- signera

- signifikant

- Kisel

- liknande

- Enkelt

- helt enkelt

- eftersom

- enda

- Storlek

- storlekar

- skicklighet

- Small

- smarta

- So

- Social hållbarhet

- sociala medier

- Mjukvara

- Programutvecklare

- lösning

- Lösa

- några

- Källa

- källkod

- span

- spanska

- specifik

- specifikt

- specificerade

- tal

- spendera

- spent

- kvadrat

- Stabilitet

- stabil

- stapel

- starta

- igång

- Starta

- Startups

- bo

- Steg

- Fortfarande

- lagra

- Upplevelser för livet

- okomplicerad

- styrkor

- Sträng

- strukturerade

- Studerar

- stil

- Framgångsrikt

- sådana

- svit

- leverera

- leveranskedjan

- stödja

- Stödjande

- System

- Ta

- tar

- riktade

- uppgift

- uppgifter

- grupp

- lag

- tech

- Tech företag

- Tekniken

- Teknologi

- tio

- testa

- den där

- Smakämnen

- Framtiden

- The New York Times

- världen

- deras

- Dem

- sig själva

- Dessa

- saker

- Thomson Reuters

- tusentals

- tre

- Genom

- genomströmning

- djur

- tid

- gånger

- titan

- Titel

- till

- i dag

- dagens

- i morgon

- verktyg

- toolkit

- verktyg

- topp

- Topp tio

- spår

- traditionell

- Tåg

- tränad

- Utbildning

- Transaktioner

- Förvandla

- transformativ

- omvandla

- färdas

- Trender

- biljoner

- Litar

- skrivmaskin

- typiskt

- Uber

- Ytterst

- under

- underliggande

- unika

- enheter

- låsa

- kommande

- us

- Användning

- användning

- Användare

- användare

- Värdefulla

- Värden

- mängd

- olika

- Omfattande

- försäljare

- via

- Vice President

- Video

- Våld

- Virtuell

- syn

- Röst

- volymer

- vs

- kontra kod

- sårbarheter

- Våg

- Sätt..

- webb

- vecka

- veckor

- VÄL

- Vad

- Vad är

- som

- medan

- VEM

- bred

- Brett utbud

- utbredd

- kommer

- med

- inom

- utan

- ord

- ord

- Arbete

- arbetssätt

- fungerar

- världen

- inom hela sverige

- skulle

- skrivning

- år

- år

- Om er

- zephyrnet