Kunder inom hälsovård och biovetenskap (HCLS) använder generativ AI som ett verktyg för att få ut mer av sin data. Användningsfall inkluderar dokumentsammanfattningar för att hjälpa läsarna att fokusera på viktiga punkter i ett dokument och omvandla ostrukturerad text till standardiserade format för att framhäva viktiga attribut. Med unika dataformat och strikta regulatoriska krav letar kunderna efter val för att välja den mest prestanda och kostnadseffektiva modellen, samt möjligheten att utföra nödvändig anpassning (finjustering) för att passa deras affärsanvändning. I det här inlägget går vi igenom hur du implementerar en Falcon Large Language Model (LLM) med hjälp av Amazon SageMaker JumpStart och använda modellen för att sammanfatta långa dokument med LangChain och Python.

Lösningsöversikt

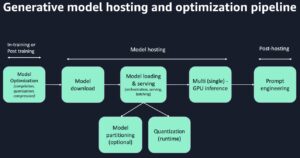

Amazon SageMaker bygger på Amazons två decenniers erfarenhet av att utveckla verkliga ML-applikationer, inklusive produktrekommendationer, personalisering, intelligent shopping, robotteknik och röstassisterade enheter. SageMaker är en HIPAA-godkänd hanterad tjänst som tillhandahåller verktyg som gör det möjligt för datavetare, ML-ingenjörer och affärsanalytiker att förnya med ML. Inom SageMaker är Amazon SageMaker Studio, en integrerad utvecklingsmiljö (IDE) specialbyggd för kollaborativa ML-arbetsflöden, som i sin tur innehåller ett brett utbud av snabbstartslösningar och förutbildade ML-modeller i en integrerad hubb som heter SageMaker JumpStart. Med SageMaker JumpStart kan du använda förtränade modeller, som Falcon LLM, med förbyggda exempel på bärbara datorer och SDK-stöd för att experimentera med och distribuera dessa kraftfulla transformatormodeller. Du kan använda SageMaker Studio och SageMaker JumpStart för att distribuera och fråga efter din egen generativa modell i ditt AWS-konto.

Du kan också se till att slutsatsens nyttolastdata inte lämnar din VPC. Du kan tillhandahålla modeller som slutpunkter för en enda klient och distribuera dem med nätverksisolering. Dessutom kan du kurera och hantera den utvalda uppsättningen modeller som uppfyller dina egna säkerhetskrav genom att använda den privata modellhubbens kapacitet inom SageMaker JumpStart och lagra de godkända modellerna där. SageMaker är i utrymme för HIPAA BAA, SOC123och HITRUST CSF.

Smakämnen Falcon LLM är en stor språkmodell, utbildad av forskare vid Technology Innovation Institute (TII) på över 1 biljon tokens med hjälp av AWS. Falcon har många olika varianter, med sina två huvudbeståndsdelar Falcon 40B och Falcon 7B, bestående av 40 miljarder respektive 7 miljarder parametrar, med finjusterade versioner tränade för specifika uppgifter, som att följa instruktioner. Falcon presterar bra på en mängd olika uppgifter, inklusive textsammanfattning, sentimentanalys, svar på frågor och konversation. Det här inlägget ger en genomgång som du kan följa för att distribuera Falcon LLM till ditt AWS-konto, med hjälp av en hanterad anteckningsbok-instans via SageMaker JumpStart för att experimentera med textsammanfattning.

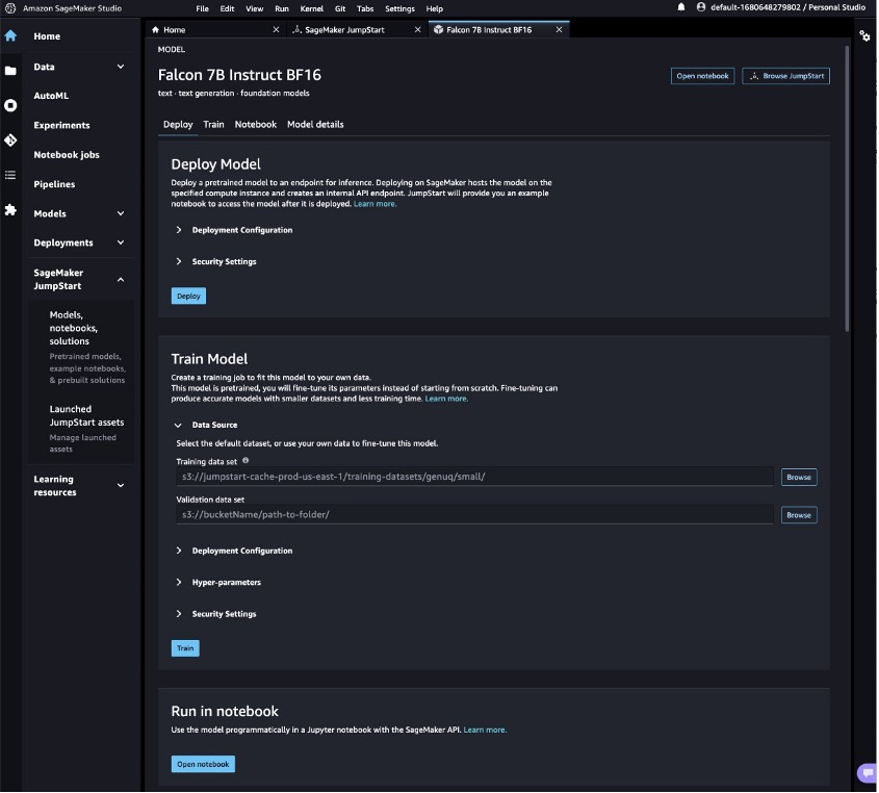

SageMaker JumpStart modellnavet innehåller kompletta bärbara datorer för att distribuera och fråga varje modell. När detta skrivs finns det sex versioner av Falcon tillgängliga i SageMaker JumpStart modellnavet: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 och Falcon 7B B. Det här inlägget använder Falcon 16B Instruct-modellen.

I följande avsnitt visar vi hur du kommer igång med dokumentsammanfattning genom att distribuera Falcon 7B på SageMaker Jumpstart.

Förutsättningar

För den här handledningen behöver du ett AWS-konto med en SageMaker-domän. Om du inte redan har en SageMaker-domän, se Ombord på Amazon SageMaker Domain att skapa en.

Distribuera Falcon 7B med SageMaker JumpStart

Utför följande steg för att distribuera din modell:

- Navigera till din SageMaker Studio-miljö från SageMaker-konsolen.

- Inom IDE, under SageMaker JumpStart välj i navigeringsfönstret Modeller, anteckningsböcker, lösningar.

- Distribuera Falcon 7B Instruct-modellen till en slutpunkt för slutledning.

Detta öppnar modellkortet för Falcon 7B Instruct BF16-modellen. På den här sidan kan du hitta Distribuera or Tåg alternativ samt länkar för att öppna provanteckningsböckerna i SageMaker Studio. Det här inlägget kommer att använda exempelanteckningsboken från SageMaker JumpStart för att distribuera modellen.

- Välja Öppna anteckningsboken.

- Kör de första fyra cellerna i notebook-datorn för att distribuera Falcon 7B Instruct-slutpunkten.

Du kan se dina utplacerade JumpStart-modeller på Lanserade JumpStart-tillgångar sida.

- I navigeringsfönstret, under SageMaker Jumpstartväljer Lanserade JumpStart-tillgångar.

- Välj Modellens slutpunkter fliken för att se status för din slutpunkt.

Med Falcon LLM-slutpunkten utplacerad är du redo att fråga efter modellen.

Kör din första fråga

Utför följande steg för att köra en fråga:

- På Fil meny, välj Nya och Notebook för att öppna en ny anteckningsbok.

Du kan också ladda ner den färdiga anteckningsboken här..

- Välj bild, kärna och instanstyp när du uppmanas. För det här inlägget väljer vi Data Science 3.0-bilden, Python 3-kärnan och ml.t3.medium-instansen.

- Importera Boto3- och JSON-modulerna genom att ange följande två rader i den första cellen:

- Presse Skift + Ange att köra cellen.

- Därefter kan du definiera en funktion som anropar din slutpunkt. Den här funktionen tar en ordboknyttolast och använder den för att anropa SageMaker runtime-klient. Sedan deserialiserar den svaret och skriver ut inmatningen och den genererade texten.

Nyttolasten inkluderar prompten som indata, tillsammans med inferensparametrarna som kommer att skickas till modellen.

- Du kan använda dessa parametrar med uppmaningen för att ställa in modellens utdata för ditt användningsfall:

Fråga med en summeringsuppmaning

Det här inlägget använder ett exempel på forskningsrapport för att visa sammanfattning. Exempeltextfilen handlar om automatisk textsammanfattning i biomedicinsk litteratur. Slutför följande steg:

- Download PDF-filen och kopiera texten till en fil med namnet

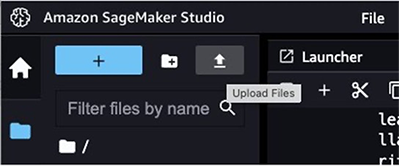

document.txt. - I SageMaker Studio, välj uppladdningsikonen och ladda upp filen till din SageMaker Studio-instans.

Out of the box ger Falcon LLM stöd för textsammanfattning.

- Låt oss skapa en funktion som använder snabba ingenjörstekniker för att sammanfatta

document.txt:

Du kommer att märka att för längre dokument visas ett fel—Falcon har, tillsammans med alla andra LLM:er, en gräns för antalet tokens som skickas som indata. Vi kan komma runt denna gräns genom att använda LangChains förbättrade sammanfattningsmöjligheter, vilket gör att en mycket större input kan skickas till LLM.

Importera och kör en sammanfattningskedja

LangChain är ett mjukvarubibliotek med öppen källkod som gör det möjligt för utvecklare och datavetare att snabbt bygga, ställa in och distribuera anpassade generativa applikationer utan att hantera komplexa ML-interaktioner, som vanligtvis används för att abstrahera många av de vanliga användningsfallen för generativa AI-språkmodeller på bara ett fåtal kodrader. LangChains stöd för AWS-tjänster inkluderar stöd för SageMaker-ändpunkter.

LangChain tillhandahåller ett tillgängligt gränssnitt för LLM:er. Dess funktioner inkluderar verktyg för snabb mallbildning och snabbkedja. Dessa kedjor kan användas för att sammanfatta textdokument som är längre än vad språkmodellen stödjer i ett enda samtal. Du kan använda en kartreduceringsstrategi för att sammanfatta långa dokument genom att dela upp dem i hanterbara bitar, sammanfatta dem och kombinera dem (och sammanfatta igen om det behövs).

- Låt oss installera LangChain för att börja:

- Importera relevanta moduler och dela upp det långa dokumentet i bitar:

- För att få LangChain att fungera effektivt med Falcon måste du definiera standardinnehållshanterarklasserna för giltig input och output:

- Du kan definiera anpassade uppmaningar som

PromptTemplateobjekt, det huvudsakliga verktyget för prompt med LangChain, för kartreducerande sammanfattningsmetod. Det här är ett valfritt steg eftersom mappnings- och kombinationsuppmaningar tillhandahålls som standard om parametrarna i anropet för att ladda summeringskedjan (load_summarize_chain) är odefinierade.

- LangChain stöder LLM:er som finns på SageMaker slutpunkter, så istället för att använda AWS Python SDK kan du initiera anslutningen via LangChain för större tillgänglighet:

- Slutligen kan du ladda i en sammanfattningskedja och köra en sammanfattning på inmatningsdokumenten med hjälp av följande kod:

Eftersom den verbose parameter är inställd på True, kommer du att se alla mellanliggande utgångar för kartreduceringsmetoden. Detta är användbart för att följa händelseförloppet för att komma fram till en slutlig sammanfattning. Med denna kartminskningsmetod kan du effektivt sammanfatta dokument mycket längre än vad som normalt tillåts av modellens maximala indatatokengräns.

Städa upp

När du har slutat använda slutpunktens slutpunkt är det viktigt att ta bort den för att undvika onödiga kostnader genom följande kodrader:

Använder andra grundmodeller i SageMaker JumpStart

Att använda andra grundmodeller som finns tillgängliga i SageMaker JumpStart för dokumentsammanfattning kräver minimala kostnader för att installera och distribuera. LLM:er varierar ibland med strukturen för inmatnings- och utdataformat, och eftersom nya modeller och färdiga lösningar läggs till i SageMaker JumpStart, beroende på uppgiftsimplementeringen, kan du behöva göra följande kodändringar:

- Om du utför en sammanfattning via

summarize()metod (metoden utan att använda LangChain), kan du behöva ändra JSON-strukturen förpayloadparameter, samt hanteringen av svarsvariabeln iquery_endpoint()fungera - Om du utför summering via LangChain's

load_summarize_chain()metod kan du behöva ändraContentHandlerTextSummarizationklass, närmare bestämttransform_input()ochtransform_output()funktioner, för att korrekt hantera nyttolasten som LLM förväntar sig och utdata som LLM returnerar

Grundmodeller varierar inte bara i faktorer som slutledningshastighet och kvalitet, utan även inmatnings- och utdataformat. Se LLM:s relevanta informationssida om förväntad input och output.

Slutsats

Falcon 7B Instruct-modellen är tillgänglig på SageMaker JumpStart modellnavet och fungerar på ett antal användningsfall. Det här inlägget visade hur du kan distribuera din egen Falcon LLM-slutpunkt i din miljö med SageMaker JumpStart och göra dina första experiment från SageMaker Studio, så att du snabbt kan prototyper av dina modeller och sömlöst gå över till en produktionsmiljö. Med Falcon och LangChain kan du effektivt sammanfatta långformade vård- och biovetenskapsdokument i stor skala.

För mer information om att arbeta med generativ AI på AWS, se Tillkännager nya verktyg för att bygga med generativ AI på AWS. Du kan börja experimentera och bygga dokumentsammanfattningsbevis för dina sjukvårds- och biovetenskapsorienterade GenAI-applikationer med den metod som beskrivs i det här inlägget. När Amazonas berggrund är allmänt tillgänglig kommer vi att publicera ett uppföljningsinlägg som visar hur du kan implementera dokumentsammanfattning med Amazon Bedrock och LangChain.

Om författarna

John Kitaoka är en lösningsarkitekt på Amazon Web Services. John hjälper kunder att designa och optimera AI/ML-arbetsbelastningar på AWS för att hjälpa dem att nå sina affärsmål.

John Kitaoka är en lösningsarkitekt på Amazon Web Services. John hjälper kunder att designa och optimera AI/ML-arbetsbelastningar på AWS för att hjälpa dem att nå sina affärsmål.

Josh Famestad är en lösningsarkitekt på Amazon Web Services. Josh arbetar med kunder i den offentliga sektorn för att bygga och utföra molnbaserade tillvägagångssätt för att uppnå affärsprioriteringar.

Josh Famestad är en lösningsarkitekt på Amazon Web Services. Josh arbetar med kunder i den offentliga sektorn för att bygga och utföra molnbaserade tillvägagångssätt för att uppnå affärsprioriteringar.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- : har

- :är

- :inte

- $UPP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- förmåga

- SAMMANDRAG

- accepterar

- tillgänglighet

- tillgänglig

- Konto

- Uppnå

- lagt till

- Anta

- igen

- AI

- AI / ML

- Alla

- tillåts

- tillåta

- tillåter

- vid sidan av

- redan

- också

- amason

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analys

- analytiker

- och

- djur

- djur

- Ansökan

- tillämpningar

- tillvägagångssätt

- tillvägagångssätt

- godkänd

- ÄR

- runt

- AS

- At

- attribut

- Automat

- tillgänglig

- undvika

- AWS

- baserat

- BE

- därför att

- börja

- tror

- Miljarder

- biomedicinsk

- kropp

- nål

- Box

- Ha sönder

- Breaking

- SLUTRESULTAT

- Byggnad

- byggt

- företag

- men

- by

- Ring

- kallas

- KAN

- Kan få

- kapacitet

- kapacitet

- kortet

- Vid

- fall

- Celler

- kedja

- kedjor

- byta

- Förändringar

- val

- Välja

- välja

- klass

- klasser

- klient

- cloud

- koda

- samarbete

- kombinera

- kombinera

- Gemensam

- vanligen

- jämfört

- fullborda

- Avslutade

- komplex

- Består

- begrepp

- koncis

- anslutning

- Konsol

- innehålla

- innehåll

- kostnadseffektiv

- Kostar

- skapa

- beställnings

- Kunder

- anpassning

- datum

- datavetenskap

- årtionden

- Standard

- definiera

- leverera

- demonstrera

- demonstreras

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- Designa

- utvecklare

- utveckla

- Utveckling

- enheter

- olika

- do

- dokumentera

- dokument

- inte

- domän

- inte

- ner

- ladda ner

- varje

- jord

- effektivt

- möjliggöra

- Slutpunkt

- Teknik

- Ingenjörer

- förbättrad

- säkerställa

- in

- Miljö

- fel

- händelser

- exempel

- exekvera

- förväntat

- förväntar

- erfarenhet

- experimentera

- experiment

- Ansikte

- faktorer

- falsk

- Funktioner

- få

- Fil

- slutlig

- hitta

- Förnamn

- passa

- Fokus

- följer

- efter

- För

- fundament

- fyra

- från

- fungera

- funktioner

- Vidare

- allmänhet

- generera

- genereras

- generativ

- Generativ AI

- skaffa sig

- Mål

- större

- hantera

- Arbetsmiljö

- Har

- hälso-och sjukvård

- hjälpa

- hjälper

- Markera

- värd

- Hur ser din drömresa ut

- How To

- html

- HTTPS

- Nav

- IKON

- if

- bild

- genomföra

- genomförande

- importera

- med Esport

- in

- innefattar

- innefattar

- Inklusive

- informationen

- förnya

- Innovation

- ingång

- ingångar

- installera

- exempel

- istället

- Institute

- instruktioner

- integrerade

- Intelligent

- interaktioner

- Gränssnitt

- in

- isolering

- IT

- DESS

- John

- json

- bara

- Nyckel

- språk

- Large

- större

- lanserades

- Lämna

- Bibliotek

- livet

- Life Sciences

- BEGRÄNSA

- rader

- länkar

- litteraturen

- LLM

- läsa in

- Lång

- längre

- du letar

- Huvudsida

- göra

- hantera

- hanterlig

- förvaltade

- hantera

- många

- kartläggning

- maximal

- Maj..

- Medium

- Meny

- metod

- minimum

- ML

- modell

- modeller

- modifiera

- Moduler

- mer

- mest

- mycket

- Navigering

- nödvändigt för

- Behöver

- behövs

- nät

- Nya

- NIH

- normalt

- anteckningsbok

- Lägga märke till..

- antal

- objekt

- of

- on

- ONE

- endast

- öppet

- öppen källkod

- Programvara med öppen källkod

- Optimera

- Tillbehör

- Övriga

- skisse

- produktion

- över

- egen

- sida

- panelen

- Papper

- parameter

- parametrar

- Godkänd

- Utföra

- utför

- utför

- personalisering

- plato

- Platon Data Intelligence

- PlatonData

- poäng

- Inlägg

- den mäktigaste

- Skriva ut

- utskrifter

- privat

- process

- Produkt

- Produktion

- korrektur

- Prototypen

- ge

- förutsatt

- ger

- tillhandahållande

- allmän

- publicera

- Python

- kvalitet

- fråga

- snabbt

- snabbt

- läsare

- redo

- verkliga världen

- rekommendationer

- hänvisa

- regulatorer

- relevanta

- Krav

- Kräver

- forskning

- forskare

- respektive

- respons

- avkastning

- robotik

- Körning

- sagemaker

- SageMaker Inference

- Skala

- Vetenskap

- VETENSKAPER

- vetenskapsmän

- omfattning

- sDK

- sömlöst

- sektioner

- sektor

- säkerhet

- se

- vald

- SJÄLV

- känsla

- Sekvens

- service

- Tjänster

- in

- inställning

- Gå och Handla

- Kort

- show

- enda

- SEX

- So

- Mjukvara

- Lösningar

- specifik

- specifikt

- fart

- starta

- igång

- status

- Steg

- Steg

- misslyckande

- Strategi

- Strikt

- struktur

- studio

- sådana

- sammanfatta

- SAMMANFATTNING

- stödja

- Stöder

- tar

- uppgift

- uppgifter

- tekniker

- Teknologi

- Teknisk innovation

- text

- än

- den där

- Smakämnen

- deras

- Dem

- sedan

- Där.

- Dessa

- detta

- Genom

- till

- tillsammans

- token

- tokens

- verktyg

- verktyg

- tränad

- transformator

- omvandla

- övergång

- Biljon

- sann

- SVÄNG

- handledning

- två

- Typ

- odefinierad

- unika

- onödig

- uppladdning

- användning

- användningsfall

- Begagnade

- användningar

- med hjälp av

- variabel

- mängd

- vehikel

- versioner

- via

- utsikt

- gå

- genomgång

- we

- webb

- webbservice

- VÄL

- Vad

- när

- som

- bred

- kommer

- med

- inom

- utan

- Arbete

- arbetsflöden

- arbetssätt

- fungerar

- skriva

- skrivning

- Om er

- Din

- zephyrnet