I februari 2022 lades Amazon Web Services till stöd för NVIDIA GPU-mått i Amazon CloudWatch, vilket gör det möjligt att pusha mätvärden från Amazon CloudWatch Agent till amazoncloudwatch och övervaka din kod för optimalt GPU-utnyttjande. Sedan dess har den här funktionen integrerats i många av våra hanterade Amazon Machine Images (AMI), såsom Deep Learning AMI och AWS ParallelCluster AMI. För att få mätvärden på instansnivå för GPU-användning kan du använda Packer eller Amazon ImageBuilder för att starta upp din egen anpassade AMI och använda den i olika hanterade tjänsteerbjudanden som AWS-batch, Amazon Elastic Container Service (Amazon ECS), eller Amazon Elastic Kubernetes-tjänst (Amazon EKS). För många containerbaserade tjänsteerbjudanden och arbetsbelastningar är det dock idealiskt att fånga användningsstatistik på container-, pod- eller namnområdesnivå.

Det här inlägget beskriver hur man ställer in containerbaserade GPU-mått och ger ett exempel på hur man samlar in dessa mätvärden från EKS-poddar.

Lösningsöversikt

För att demonstrera containerbaserad GPU-statistik skapar vi ett EKS-kluster med g5.2xlarge instanser; detta kommer dock att fungera med alla NVIDIA accelererade instansfamiljer som stöds.

Vi distribuerar NVIDIA GPU-operatören för att möjliggöra användning av GPU-resurser och NVIDIA DCGM-exportör för att aktivera insamling av GPU-statistik. Sedan utforskar vi två arkitekturer. Den första ansluter mätvärdena från NVIDIA DCGM Exporter till CloudWatch via en CloudWatch-agent, som visas i följande diagram.

Den andra arkitekturen (se följande diagram) kopplar måtten från DCGM Exporter till Prometheus, då använder vi en grafana instrumentpanel för att visualisera dessa mätvärden.

Förutsättningar

För att förenkla reproduktionen av hela stacken från det här inlägget använder vi en behållare som har alla nödvändiga verktyg (aws cli, eksctl, rod, etc.) redan installerade. För att klona containerprojekt från GitHub, du kommer behöva gå. För att bygga och köra containern behöver du Hamnarbetare. För att distribuera arkitekturen behöver du AWS-uppgifter. För att möjliggöra åtkomst till Kubernetes-tjänster med portvidarebefordran behöver du också kubectl.

Dessa förutsättningar kan installeras på din lokala dator, EC2-instans med SNYGGT DCV, eller AWS Cloud9. I det här inlägget kommer vi att använda en c5.2xlarge Cloud9-instans med en 40GB lokal lagringsvolym. När du använder Cloud9, vänligen inaktivera AWS-hanterade tillfälliga autentiseringsuppgifter genom att besöka Cloud9->Preferences->AWS Settings som visas på skärmdumpen nedan.

Bygg och kör aws-do-eks-behållaren

Öppna ett terminalskal i din föredragna miljö och kör följande kommandon:

git clone https://github.com/aws-samples/aws-do-eks

cd aws-do-eks

./build.sh

./run.sh

./exec.sh

Resultatet är som följer:

Du har nu ett skal i en containermiljö som har alla verktyg som behövs för att slutföra uppgifterna nedan. Vi kommer att hänvisa till det som "aws-do-eks shell". Du kommer att köra kommandona i följande avsnitt i det här skalet, om inte annat specifikt instrueras.

Skapa ett EKS-kluster med en nodgrupp

Denna grupp inkluderar en GPU-instansfamilj som du väljer; i det här exemplet använder vi g5.2xlarge instanstyp.

Smakämnen aws-do-eks projekt levereras med en samling klusterkonfigurationer. Du kan ställa in önskad klusterkonfiguration med en enda konfigurationsändring.

- Kör i behållarskalet

./env-config.sh och ställ sedan in CONF=conf/eksctl/yaml/eks-gpu-g5.yaml

- Kör för att verifiera klusterkonfigurationen

./eks-config.sh

Du bör se följande klustermanifest:

apiVersion: eksctl.io/v1alpha5

kind: ClusterConfig

metadata: name: do-eks-yaml-g5 version: "1.25" region: us-east-1

availabilityZones: - us-east-1a - us-east-1b - us-east-1c - us-east-1d

managedNodeGroups: - name: sys instanceType: m5.xlarge desiredCapacity: 1 iam: withAddonPolicies: autoScaler: true cloudWatch: true - name: g5 instanceType: g5.2xlarge instancePrefix: g5-2xl privateNetworking: true efaEnabled: false minSize: 0 desiredCapacity: 1 maxSize: 10 volumeSize: 80 iam: withAddonPolicies: cloudWatch: true

iam: withOIDC: true

- För att skapa klustret, kör följande kommando i behållaren

Utgången är som följer:

root@e5ecb162812f:/eks# ./eks-create.sh /eks/impl/eksctl/yaml /eks ./eks-create.sh Mon May 22 20:50:59 UTC 2023

Creating cluster using /eks/conf/eksctl/yaml/eks-gpu-g5.yaml ... eksctl create cluster -f /eks/conf/eksctl/yaml/eks-gpu-g5.yaml 2023-05-22 20:50:59 [ℹ] eksctl version 0.133.0

2023-05-22 20:50:59 [ℹ] using region us-east-1

2023-05-22 20:50:59 [ℹ] subnets for us-east-1a - public:192.168.0.0/19 private:192.168.128.0/19

2023-05-22 20:50:59 [ℹ] subnets for us-east-1b - public:192.168.32.0/19 private:192.168.160.0/19

2023-05-22 20:50:59 [ℹ] subnets for us-east-1c - public:192.168.64.0/19 private:192.168.192.0/19

2023-05-22 20:50:59 [ℹ] subnets for us-east-1d - public:192.168.96.0/19 private:192.168.224.0/19

2023-05-22 20:50:59 [ℹ] nodegroup "sys" will use "" [AmazonLinux2/1.25]

2023-05-22 20:50:59 [ℹ] nodegroup "g5" will use "" [AmazonLinux2/1.25]

2023-05-22 20:50:59 [ℹ] using Kubernetes version 1.25

2023-05-22 20:50:59 [ℹ] creating EKS cluster "do-eks-yaml-g5" in "us-east-1" region with managed nodes

2023-05-22 20:50:59 [ℹ] 2 nodegroups (g5, sys) were included (based on the include/exclude rules)

2023-05-22 20:50:59 [ℹ] will create a CloudFormation stack for cluster itself and 0 nodegroup stack(s)

2023-05-22 20:50:59 [ℹ] will create a CloudFormation stack for cluster itself and 2 managed nodegroup stack(s)

2023-05-22 20:50:59 [ℹ] if you encounter any issues, check CloudFormation console or try 'eksctl utils describe-stacks --region=us-east-1 --cluster=do-eks-yaml-g5'

2023-05-22 20:50:59 [ℹ] Kubernetes API endpoint access will use default of {publicAccess=true, privateAccess=false} for cluster "do-eks-yaml-g5" in "us-east-1"

2023-05-22 20:50:59 [ℹ] CloudWatch logging will not be enabled for cluster "do-eks-yaml-g5" in "us-east-1"

2023-05-22 20:50:59 [ℹ] you can enable it with 'eksctl utils update-cluster-logging --enable-types={SPECIFY-YOUR-LOG-TYPES-HERE (e.g. all)} --region=us-east-1 --cluster=do-eks-yaml-g5'

2023-05-22 20:50:59 [ℹ] 2 sequential tasks: { create cluster control plane "do-eks-yaml-g5", 2 sequential sub-tasks: { 4 sequential sub-tasks: { wait for control plane to become ready, associate IAM OIDC provider, 2 sequential sub-tasks: { create IAM role for serviceaccount "kube-system/aws-node", create serviceaccount "kube-system/aws-node", }, restart daemonset "kube-system/aws-node", }, 2 parallel sub-tasks: { create managed nodegroup "sys", create managed nodegroup "g5", }, } }

2023-05-22 20:50:59 [ℹ] building cluster stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:51:00 [ℹ] deploying stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:51:30 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:52:00 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:53:01 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:54:01 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:55:01 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:56:02 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:57:02 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:58:02 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 20:59:02 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 21:00:03 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 21:01:03 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 21:02:03 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 21:03:04 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-cluster"

2023-05-22 21:05:07 [ℹ] building iamserviceaccount stack "eksctl-do-eks-yaml-g5-addon-iamserviceaccount-kube-system-aws-node"

2023-05-22 21:05:10 [ℹ] deploying stack "eksctl-do-eks-yaml-g5-addon-iamserviceaccount-kube-system-aws-node"

2023-05-22 21:05:10 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-addon-iamserviceaccount-kube-system-aws-node"

2023-05-22 21:05:40 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-addon-iamserviceaccount-kube-system-aws-node"

2023-05-22 21:05:40 [ℹ] serviceaccount "kube-system/aws-node" already exists

2023-05-22 21:05:41 [ℹ] updated serviceaccount "kube-system/aws-node"

2023-05-22 21:05:41 [ℹ] daemonset "kube-system/aws-node" restarted

2023-05-22 21:05:41 [ℹ] building managed nodegroup stack "eksctl-do-eks-yaml-g5-nodegroup-sys"

2023-05-22 21:05:41 [ℹ] building managed nodegroup stack "eksctl-do-eks-yaml-g5-nodegroup-g5"

2023-05-22 21:05:42 [ℹ] deploying stack "eksctl-do-eks-yaml-g5-nodegroup-sys"

2023-05-22 21:05:42 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-sys"

2023-05-22 21:05:42 [ℹ] deploying stack "eksctl-do-eks-yaml-g5-nodegroup-g5"

2023-05-22 21:05:42 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-g5"

2023-05-22 21:06:12 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-sys"

2023-05-22 21:06:12 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-g5"

2023-05-22 21:06:55 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-sys"

2023-05-22 21:07:11 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-g5"

2023-05-22 21:08:29 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-g5"

2023-05-22 21:08:45 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-sys"

2023-05-22 21:09:52 [ℹ] waiting for CloudFormation stack "eksctl-do-eks-yaml-g5-nodegroup-g5"

2023-05-22 21:09:53 [ℹ] waiting for the control plane to become ready

2023-05-22 21:09:53 [✔] saved kubeconfig as "/root/.kube/config"

2023-05-22 21:09:53 [ℹ] 1 task: { install Nvidia device plugin }

W0522 21:09:54.155837 1668 warnings.go:70] spec.template.metadata.annotations[scheduler.alpha.kubernetes.io/critical-pod]: non-functional in v1.16+; use the "priorityClassName" field instead

2023-05-22 21:09:54 [ℹ] created "kube-system:DaemonSet.apps/nvidia-device-plugin-daemonset"

2023-05-22 21:09:54 [ℹ] as you are using the EKS-Optimized Accelerated AMI with a GPU-enabled instance type, the Nvidia Kubernetes device plugin was automatically installed. to skip installing it, use --install-nvidia-plugin=false.

2023-05-22 21:09:54 [✔] all EKS cluster resources for "do-eks-yaml-g5" have been created

2023-05-22 21:09:54 [ℹ] nodegroup "sys" has 1 node(s)

2023-05-22 21:09:54 [ℹ] node "ip-192-168-18-137.ec2.internal" is ready

2023-05-22 21:09:54 [ℹ] waiting for at least 1 node(s) to become ready in "sys"

2023-05-22 21:09:54 [ℹ] nodegroup "sys" has 1 node(s)

2023-05-22 21:09:54 [ℹ] node "ip-192-168-18-137.ec2.internal" is ready

2023-05-22 21:09:55 [ℹ] kubectl command should work with "/root/.kube/config", try 'kubectl get nodes'

2023-05-22 21:09:55 [✔] EKS cluster "do-eks-yaml-g5" in "us-east-1" region is ready Mon May 22 21:09:55 UTC 2023

Done creating cluster using /eks/conf/eksctl/yaml/eks-gpu-g5.yaml /eks

- För att verifiera att ditt kluster har skapats framgångsrikt, kör följande kommando

kubectl get nodes -L node.kubernetes.io/instance-type

Utgången liknar följande:

NAME STATUS ROLES AGE VERSION INSTANCE_TYPE

ip-192-168-18-137.ec2.internal Ready <none> 47m v1.25.9-eks-0a21954 m5.xlarge

ip-192-168-214-241.ec2.internal Ready <none> 46m v1.25.9-eks-0a21954 g5.2xlarge

I det här exemplet har vi en m5.xlarge- och en g5.2xlarge-instans i vårt kluster; därför ser vi två noder listade i föregående utdata.

Under processen att skapa kluster kommer NVIDIA-enhetsplugin att installeras. Du måste ta bort den efter att du har skapat klustret eftersom vi kommer att använda NVIDIA GPU-operatör istället.

- Ta bort plugin-programmet med följande kommando

kubectl -n kube-system delete daemonset nvidia-device-plugin-daemonset

Vi får följande utdata:

daemonset.apps "nvidia-device-plugin-daemonset" deleted

Installera NVIDIA Helm-repo

Installera NVIDIA Helm-repo med följande kommando:

helm repo add nvidia https://helm.ngc.nvidia.com/nvidia && helm repo update

Distribuera DCGM-exportören med NVIDIA GPU-operatören

Utför följande steg för att distribuera DCGM-exportören:

- Förbered DCGM-exportörens GPU-statistikkonfiguration

curl https://raw.githubusercontent.com/NVIDIA/dcgm-exporter/main/etc/dcp-metrics-included.csv > dcgm-metrics.csv

Du har möjlighet att redigera dcgm-metrics.csv fil. Du kan lägga till eller ta bort alla mätvärden efter behov.

- Skapa namnutrymmet för gpu-operatören och DCGM-exportören ConfigMap

kubectl create namespace gpu-operator && /

kubectl create configmap metrics-config -n gpu-operator --from-file=dcgm-metrics.csv

Utgången är som följer:

namespace/gpu-operator created

configmap/metrics-config created

- Använd GPU-operatören på EKS-klustret

helm install --wait --generate-name -n gpu-operator --create-namespace nvidia/gpu-operator --set dcgmExporter.config.name=metrics-config --set dcgmExporter.env[0].name=DCGM_EXPORTER_COLLECTORS --set dcgmExporter.env[0].value=/etc/dcgm-exporter/dcgm-metrics.csv --set toolkit.enabled=false

Utgången är som följer:

NAME: gpu-operator-1684795140

LAST DEPLOYED: Day Month Date HH:mm:ss YYYY

NAMESPACE: gpu-operator

STATUS: deployed

REVISION: 1

TEST SUITE: None

- Bekräfta att DCGM exporter pod körs

kubectl -n gpu-operator get pods | grep dcgm

Utgången är som följer:

nvidia-dcgm-exporter-lkmfr 1/1 Running 0 1m

Om du inspekterar loggarna bör du se “Starting webserver” meddelande:

kubectl -n gpu-operator logs -f $(kubectl -n gpu-operator get pods | grep dcgm | cut -d ' ' -f 1)

Utgången är som följer:

Defaulted container "nvidia-dcgm-exporter" out of: nvidia-dcgm-exporter, toolkit-validation (init)

time="2023-05-22T22:40:08Z" level=info msg="Starting dcgm-exporter"

time="2023-05-22T22:40:08Z" level=info msg="DCGM successfully initialized!"

time="2023-05-22T22:40:08Z" level=info msg="Collecting DCP Metrics"

time="2023-05-22T22:40:08Z" level=info msg="No configmap data specified, falling back to metric file /etc/dcgm-exporter/dcgm-metrics.csv"

time="2023-05-22T22:40:08Z" level=info msg="Initializing system entities of type: GPU"

time="2023-05-22T22:40:09Z" level=info msg="Initializing system entities of type: NvSwitch"

time="2023-05-22T22:40:09Z" level=info msg="Not collecting switch metrics: no switches to monitor"

time="2023-05-22T22:40:09Z" level=info msg="Initializing system entities of type: NvLink"

time="2023-05-22T22:40:09Z" level=info msg="Not collecting link metrics: no switches to monitor"

time="2023-05-22T22:40:09Z" level=info msg="Kubernetes metrics collection enabled!"

time="2023-05-22T22:40:09Z" level=info msg="Pipeline starting"

time="2023-05-22T22:40:09Z" level=info msg="Starting webserver"

NVIDIA DCGM Exporter avslöjar en Prometheus-måttslutpunkt, som kan tas in av CloudWatch-agenten. För att se slutpunkten, använd följande kommando:

kubectl -n gpu-operator get services | grep dcgm

Vi får följande utdata:

nvidia-dcgm-exporter ClusterIP 10.100.183.207 <none> 9400/TCP 10m

- För att generera lite GPU-användning distribuerar vi en pod som kör gpu-bränna binär

kubectl apply -f https://raw.githubusercontent.com/aws-samples/aws-do-eks/main/Container-Root/eks/deployment/gpu-metrics/gpu-burn-deployment.yaml

Utgången är som följer:

deployment.apps/gpu-burn created

Denna distribution använder en enda GPU för att producera ett kontinuerligt mönster av 100 % utnyttjande i 20 sekunder följt av 0 % utnyttjande i 20 sekunder.

- För att säkerställa att slutpunkten fungerar kan du köra en tillfällig behållare som använder curl för att läsa innehållet i

http://nvidia-dcgm-exporter:9400/metrics

kubectl -n gpu-operator run -it --rm curl --restart='Never' --image=curlimages/curl --command -- curl http://nvidia-dcgm-exporter:9400/metrics

Vi får följande utdata:

# HELP DCGM_FI_DEV_SM_CLOCK SM clock frequency (in MHz).

# TYPE DCGM_FI_DEV_SM_CLOCK gauge

DCGM_FI_DEV_SM_CLOCK{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 1455

# HELP DCGM_FI_DEV_MEM_CLOCK Memory clock frequency (in MHz).

# TYPE DCGM_FI_DEV_MEM_CLOCK gauge

DCGM_FI_DEV_MEM_CLOCK{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 6250

# HELP DCGM_FI_DEV_GPU_TEMP GPU temperature (in C).

# TYPE DCGM_FI_DEV_GPU_TEMP gauge

DCGM_FI_DEV_GPU_TEMP{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 65

# HELP DCGM_FI_DEV_POWER_USAGE Power draw (in W).

# TYPE DCGM_FI_DEV_POWER_USAGE gauge

DCGM_FI_DEV_POWER_USAGE{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 299.437000

# HELP DCGM_FI_DEV_TOTAL_ENERGY_CONSUMPTION Total energy consumption since boot (in mJ).

# TYPE DCGM_FI_DEV_TOTAL_ENERGY_CONSUMPTION counter

DCGM_FI_DEV_TOTAL_ENERGY_CONSUMPTION{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 15782796862

# HELP DCGM_FI_DEV_PCIE_REPLAY_COUNTER Total number of PCIe retries.

# TYPE DCGM_FI_DEV_PCIE_REPLAY_COUNTER counter

DCGM_FI_DEV_PCIE_REPLAY_COUNTER{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_GPU_UTIL GPU utilization (in %).

# TYPE DCGM_FI_DEV_GPU_UTIL gauge

DCGM_FI_DEV_GPU_UTIL{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 100

# HELP DCGM_FI_DEV_MEM_COPY_UTIL Memory utilization (in %).

# TYPE DCGM_FI_DEV_MEM_COPY_UTIL gauge

DCGM_FI_DEV_MEM_COPY_UTIL{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 38

# HELP DCGM_FI_DEV_ENC_UTIL Encoder utilization (in %).

# TYPE DCGM_FI_DEV_ENC_UTIL gauge

DCGM_FI_DEV_ENC_UTIL{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_DEC_UTIL Decoder utilization (in %).

# TYPE DCGM_FI_DEV_DEC_UTIL gauge

DCGM_FI_DEV_DEC_UTIL{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_XID_ERRORS Value of the last XID error encountered.

# TYPE DCGM_FI_DEV_XID_ERRORS gauge

DCGM_FI_DEV_XID_ERRORS{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_FB_FREE Framebuffer memory free (in MiB).

# TYPE DCGM_FI_DEV_FB_FREE gauge

DCGM_FI_DEV_FB_FREE{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 2230

# HELP DCGM_FI_DEV_FB_USED Framebuffer memory used (in MiB).

# TYPE DCGM_FI_DEV_FB_USED gauge

DCGM_FI_DEV_FB_USED{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 20501

# HELP DCGM_FI_DEV_NVLINK_BANDWIDTH_TOTAL Total number of NVLink bandwidth counters for all lanes.

# TYPE DCGM_FI_DEV_NVLINK_BANDWIDTH_TOTAL counter

DCGM_FI_DEV_NVLINK_BANDWIDTH_TOTAL{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_VGPU_LICENSE_STATUS vGPU License status

# TYPE DCGM_FI_DEV_VGPU_LICENSE_STATUS gauge

DCGM_FI_DEV_VGPU_LICENSE_STATUS{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_UNCORRECTABLE_REMAPPED_ROWS Number of remapped rows for uncorrectable errors

# TYPE DCGM_FI_DEV_UNCORRECTABLE_REMAPPED_ROWS counter

DCGM_FI_DEV_UNCORRECTABLE_REMAPPED_ROWS{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_CORRECTABLE_REMAPPED_ROWS Number of remapped rows for correctable errors

# TYPE DCGM_FI_DEV_CORRECTABLE_REMAPPED_ROWS counter

DCGM_FI_DEV_CORRECTABLE_REMAPPED_ROWS{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_DEV_ROW_REMAP_FAILURE Whether remapping of rows has failed

# TYPE DCGM_FI_DEV_ROW_REMAP_FAILURE gauge

DCGM_FI_DEV_ROW_REMAP_FAILURE{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0

# HELP DCGM_FI_PROF_GR_ENGINE_ACTIVE Ratio of time the graphics engine is active (in %).

# TYPE DCGM_FI_PROF_GR_ENGINE_ACTIVE gauge

DCGM_FI_PROF_GR_ENGINE_ACTIVE{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0.808369

# HELP DCGM_FI_PROF_PIPE_TENSOR_ACTIVE Ratio of cycles the tensor (HMMA) pipe is active (in %).

# TYPE DCGM_FI_PROF_PIPE_TENSOR_ACTIVE gauge

DCGM_FI_PROF_PIPE_TENSOR_ACTIVE{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0.000000

# HELP DCGM_FI_PROF_DRAM_ACTIVE Ratio of cycles the device memory interface is active sending or receiving data (in %).

# TYPE DCGM_FI_PROF_DRAM_ACTIVE gauge

DCGM_FI_PROF_DRAM_ACTIVE{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 0.315787

# HELP DCGM_FI_PROF_PCIE_TX_BYTES The rate of data transmitted over the PCIe bus - including both protocol headers and data payloads - in bytes per second.

# TYPE DCGM_FI_PROF_PCIE_TX_BYTES gauge

DCGM_FI_PROF_PCIE_TX_BYTES{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 3985328

# HELP DCGM_FI_PROF_PCIE_RX_BYTES The rate of data received over the PCIe bus - including both protocol headers and data payloads - in bytes per second.

# TYPE DCGM_FI_PROF_PCIE_RX_BYTES gauge

DCGM_FI_PROF_PCIE_RX_BYTES{gpu="0",UUID="GPU-ff76466b-22fc-f7a9-abe2-ce3ac453b8b3",device="nvidia0",modelName="NVIDIA A10G",Hostname="nvidia-dcgm-exporter-48cwd",DCGM_FI_DRIVER_VERSION="470.182.03",container="main",namespace="kube-system",pod="gpu-burn-c68d8c774-ltg9s"} 21715174

pod "curl" deleted

Konfigurera och distribuera CloudWatch-agenten

För att konfigurera och distribuera CloudWatch-agenten, utför följande steg:

- Ladda ner YAML-filen och redigera den

curl -O https://raw.githubusercontent.com/aws-samples/amazon-cloudwatch-container-insights/k8s/1.3.15/k8s-deployment-manifest-templates/deployment-mode/service/cwagent-prometheus/prometheus-eks.yaml

Filen innehåller en cwagent configmap och en prometheus configmap. För det här inlägget redigerar vi båda.

- Redigera

prometheus-eks.yaml fil

Öppna prometheus-eks.yaml fil i din favoritredigerare och ersätt cwagentconfig.json avsnitt med följande innehåll:

apiVersion: v1

data: # cwagent json config cwagentconfig.json: | { "logs": { "metrics_collected": { "prometheus": { "prometheus_config_path": "/etc/prometheusconfig/prometheus.yaml", "emf_processor": { "metric_declaration": [ { "source_labels": ["Service"], "label_matcher": ".*dcgm.*", "dimensions": [["Service","Namespace","ClusterName","job","pod"]], "metric_selectors": [ "^DCGM_FI_DEV_GPU_UTIL$", "^DCGM_FI_DEV_DEC_UTIL$", "^DCGM_FI_DEV_ENC_UTIL$", "^DCGM_FI_DEV_MEM_CLOCK$", "^DCGM_FI_DEV_MEM_COPY_UTIL$", "^DCGM_FI_DEV_POWER_USAGE$", "^DCGM_FI_DEV_ROW_REMAP_FAILURE$", "^DCGM_FI_DEV_SM_CLOCK$", "^DCGM_FI_DEV_XID_ERRORS$", "^DCGM_FI_PROF_DRAM_ACTIVE$", "^DCGM_FI_PROF_GR_ENGINE_ACTIVE$", "^DCGM_FI_PROF_PCIE_RX_BYTES$", "^DCGM_FI_PROF_PCIE_TX_BYTES$", "^DCGM_FI_PROF_PIPE_TENSOR_ACTIVE$" ] } ] } } }, "force_flush_interval": 5 } }

- I

prometheus config-avsnittet, lägg till följande jobbdefinition för DCGM-exportören

- job_name: 'kubernetes-pod-dcgm-exporter' sample_limit: 10000 metrics_path: /api/v1/metrics/prometheus kubernetes_sd_configs: - role: pod relabel_configs: - source_labels: [__meta_kubernetes_pod_container_name] action: keep regex: '^DCGM.*$' - source_labels: [__address__] action: replace regex: ([^:]+)(?::d+)? replacement: ${1}:9400 target_label: __address__ - action: labelmap regex: __meta_kubernetes_pod_label_(.+) - action: replace source_labels: - __meta_kubernetes_namespace target_label: Namespace - source_labels: [__meta_kubernetes_pod] action: replace target_label: pod - action: replace source_labels: - __meta_kubernetes_pod_container_name target_label: container_name - action: replace source_labels: - __meta_kubernetes_pod_controller_name target_label: pod_controller_name - action: replace source_labels: - __meta_kubernetes_pod_controller_kind target_label: pod_controller_kind - action: replace source_labels: - __meta_kubernetes_pod_phase target_label: pod_phase - action: replace source_labels: - __meta_kubernetes_pod_node_name target_label: NodeName

- Spara filen och tillämpa

cwagent-dcgm konfiguration till ditt kluster

kubectl apply -f ./prometheus-eks.yaml

Vi får följande utdata:

namespace/amazon-cloudwatch created

configmap/prometheus-cwagentconfig created

configmap/prometheus-config created

serviceaccount/cwagent-prometheus created

clusterrole.rbac.authorization.k8s.io/cwagent-prometheus-role created

clusterrolebinding.rbac.authorization.k8s.io/cwagent-prometheus-role-binding created

deployment.apps/cwagent-prometheus created

- Bekräfta att CloudWatch-agentpodden körs

kubectl -n amazon-cloudwatch get pods

Vi får följande utdata:

NAME READY STATUS RESTARTS AGE

cwagent-prometheus-7dfd69cc46-s4cx7 1/1 Running 0 15m

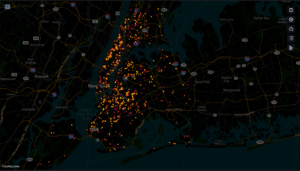

Visualisera mätvärden på CloudWatch-konsolen

För att visualisera mätvärdena i CloudWatch, slutför följande steg:

- På CloudWatch-konsolen, under Metrics välj i navigeringsfönstret Alla mätvärden

- I Anpassade namnutrymmen sektion, välj den nya posten för ContainerInsights/Prometheus

För mer information om ContainerInsights/Prometheus namnutrymme, se Skrapa ytterligare Prometheus-källor och importera dessa mätvärden.

- Gå ner till metriska namn och välj

DCGM_FI_DEV_GPU_UTIL

- På Grafiska mått flik, uppsättning Period till 5 sekunder

- Ställ in uppdateringsintervallet till 10 sekunder

Du kommer att se mätvärdena som samlats in från DCGM-exportören som visualiserar gpu-burn mönster på och av var 20:e sekund.

På Bläddra fliken kan du se data, inklusive podnamnet för varje mätvärde.

EKS API-metadata har kombinerats med DCGM-statistikdata, vilket resulterar i den tillhandahållna pod-baserade GPU-statistiken.

Detta avslutar den första metoden att exportera DCGM-statistik till CloudWatch via CloudWatch-agenten.

I nästa avsnitt konfigurerar vi den andra arkitekturen, som exporterar DCGM-måtten till Prometheus, och vi visualiserar dem med Grafana.

Använd Prometheus och Grafana för att visualisera GPU-statistik från DCGM

Följ följande steg:

- Lägg till Prometheus community rod diagram

helm repo add prometheus-community https://prometheus-community.github.io/helm-charts

Detta diagram distribuerar både Prometheus och Grafana. Vi måste göra några ändringar i diagrammet innan vi kör installationskommandot.

- Spara diagramkonfigurationsvärdena till en fil i

/tmp

helm inspect values prometheus-community/kube-prometheus-stack > /tmp/kube-prometheus-stack.values

- Redigera char-konfigurationsfilen

Redigera den sparade filen (/tmp/kube-prometheus-stack.values) och ställ in följande alternativ genom att leta efter inställningens namn och ställa in värdet:

prometheus.prometheusSpec.serviceMonitorSelectorNilUsesHelmValues=false

- Lägg till följande ConfigMap till

additionalScrapeConfigs avsnitt

additionalScrapeConfigs:

- job_name: gpu-metrics scrape_interval: 1s metrics_path: /metrics scheme: http kubernetes_sd_configs: - role: endpoints namespaces: names: - gpu-operator relabel_configs: - source_labels: [__meta_kubernetes_pod_node_name] action: replace target_label: kubernetes_node

- Distribuera Prometheus-stacken med de uppdaterade värdena

helm install prometheus-community/kube-prometheus-stack

--create-namespace --namespace prometheus

--generate-name

--values /tmp/kube-prometheus-stack.values

Vi får följande utdata:

NAME: kube-prometheus-stack-1684965548

LAST DEPLOYED: Wed May 24 21:59:14 2023

NAMESPACE: prometheus

STATUS: deployed

REVISION: 1

NOTES:

kube-prometheus-stack has been installed. Check its status by running: kubectl --namespace prometheus get pods -l "release=kube-prometheus-stack-1684965548" Visit https://github.com/prometheus-operator/kube-prometheus for instructions on how to create & configure Alertmanager and Prometheus instances using the Operator.

- Bekräfta att Prometheus-kapslarna körs

kubectl get pods -n prometheus

Vi får följande utdata:

NAME READY STATUS RESTARTS AGE

alertmanager-kube-prometheus-stack-1684-alertmanager-0 2/2 Running 0 6m55s

kube-prometheus-stack-1684-operator-6c87649878-j7v55 1/1 Running 0 6m58s

kube-prometheus-stack-1684965548-grafana-dcd7b4c96-bzm8p 3/3 Running 0 6m58s

kube-prometheus-stack-1684965548-kube-state-metrics-7d856dptlj5 1/1 Running 0 6m58s

kube-prometheus-stack-1684965548-prometheus-node-exporter-2fbl5 1/1 Running 0 6m58s

kube-prometheus-stack-1684965548-prometheus-node-exporter-m7zmv 1/1 Running 0 6m58s

prometheus-kube-prometheus-stack-1684-prometheus-0 2/2 Running 0 6m55s

Prometheus och Grafana baljor finns i Running tillstånd.

Därefter validerar vi att DCGM-mått flödar in i Prometheus.

- Portforward Prometheus UI

Det finns olika sätt att exponera Prometheus UI som körs i EKS för förfrågningar som kommer utanför klustret. Vi kommer använda kubectl port-forwarding. Hittills har vi kört kommandon inuti aws-do-eks behållare. För att komma åt Prometheus-tjänsten som körs i klustret skapar vi en tunnel från värden. Här aws-do-eks container körs genom att utföra följande kommando utanför containern, i ett nytt terminalskal på värden. Vi kommer att kalla detta "värdskal".

kubectl -n prometheus port-forward svc/$(kubectl -n prometheus get svc | grep prometheus | grep -v alertmanager | grep -v operator | grep -v grafana | grep -v metrics | grep -v exporter | grep -v operated | cut -d ' ' -f 1) 8080:9090 &

Medan portvidarebefordransprocessen körs kan vi komma åt Prometheus UI från värden enligt beskrivningen nedan.

- Öppna Prometheus UI

- Om du använder Cloud9, vänligen navigera till

Preview->Preview Running Application för att öppna Prometheus UI på en flik inuti Cloud9 IDE, klicka sedan på  ikonen i det övre högra hörnet av fliken för att dyka upp i ett nytt fönster.

ikonen i det övre högra hörnet av fliken för att dyka upp i ett nytt fönster.

- Om du är på din lokala värd eller ansluten till en EC2-instans via fjärrskrivbord, öppna en webbläsare och besök URL:en

http://localhost:8080.

- ange

DCGM för att se DCGM-måtten som flödar in i Prometheus

- Välja

DCGM_FI_DEV_GPU_UTILväljer Utförande, och navigera sedan till Diagrammet fliken för att se det förväntade GPU-användningsmönstret

- Stoppa Prometheus port-vidarebefordran

Kör följande kommandorad i ditt värdskal:

kill -9 $(ps -aef | grep port-forward | grep -v grep | grep prometheus | awk '{print $2}')

Nu kan vi visualisera DCGM-måtten via Grafana Dashboard.

- Hämta lösenordet för att logga in på Grafana UI

kubectl -n prometheus get secret $(kubectl -n prometheus get secrets | grep grafana | cut -d ' ' -f 1) -o jsonpath="{.data.admin-password}" | base64 --decode ; echo

- Hamn-forward Grafana tjänsten

Kör följande kommandorad i ditt värdskal:

kubectl port-forward -n prometheus svc/$(kubectl -n prometheus get svc | grep grafana | cut -d ' ' -f 1) 8080:80 &

- Logga in på Grafana UI

Öppna inloggningsskärmen för Grafana UI på samma sätt som du öppnade Prometheus UI tidigare. Om du använder Cloud9, välj Preview->Preview Running Application, och dyker sedan upp i ett nytt fönster. Om du använder din lokala värd eller en EC2-instans med fjärrskrivbord besök URL http://localhost:8080. Logga in med användarnamnet admin och lösenordet du hämtade tidigare.

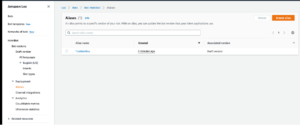

- Välj i navigeringsfönstret Instrumentpaneler

- Välja Nya och Importera

Vi kommer att importera standard DCGM Grafana-instrumentpanelen som beskrivs i NVIDIA DCGM-exportinstrumentpanel.

- På fältet

import via grafana.com, stiga på 12239 Och välj Ladda

- Välja Prometheus som datakälla

- Välja Importera

Du kommer att se en instrumentpanel som liknar den i följande skärmdump.

För att visa att dessa mätvärden är pod-baserade kommer vi att modifiera GPU-användning rutan i den här instrumentpanelen.

- Välj rutan och alternativmenyn (tre punkter)

- Expandera Tillbehör avsnitt och redigera Förklaring fält

- Ersätt värdet där med

Pod {{pod}}Och välj sedan Save

Legenden visar nu gpu-burn podnamn som är kopplat till den visade GPU-användningen.

- Sluta vidarebefordra Grafana UI-tjänsten

Kör följande i ditt värdskal:

kill -9 $(ps -aef | grep port-forward | grep -v grep | grep prometheus | awk '{print $2}')

I det här inlägget demonstrerade vi användning av öppen källkod Prometheus och Grafana distribuerade till EKS-klustret. Om så önskas kan denna distribution ersättas med Amazon Managed Service för Prometheus och Amazon Managed Grafana.

Städa upp

För att rensa upp resurserna du skapade, kör följande skript från aws-do-eks containerskal:

Slutsats

I det här inlägget använde vi NVIDIA DCGM Exporter för att samla in GPU-statistik och visualisera dem med antingen CloudWatch eller Prometheus och Grafana. Vi inbjuder dig att använda arkitekturerna som visas här för att möjliggöra övervakning av GPU-användning med NVIDIA DCGM i din egen AWS-miljö.

Ytterligare resurser

Om författarna

Amr Ragab är en före detta Principal Solutions Architect, EC2 Accelerated Computing på AWS. Han är hängiven att hjälpa kunder att köra beräkningsarbete i stor skala. På fritiden gillar han att resa och att hitta nya sätt att integrera teknik i vardagen.

Amr Ragab är en före detta Principal Solutions Architect, EC2 Accelerated Computing på AWS. Han är hängiven att hjälpa kunder att köra beräkningsarbete i stor skala. På fritiden gillar han att resa och att hitta nya sätt att integrera teknik i vardagen.

Alex Iankoulski är en Principal Solutions Architect, Self-managed Machine Learning på AWS. Han är en full-stack mjukvaru- och infrastrukturingenjör som gillar att göra djupgående, praktiskt arbete. I sin roll fokuserar han på att hjälpa kunder med containerisering och orkestrering av ML- och AI-arbetsbelastningar på containerdrivna AWS-tjänster. Han är också författare till öppen källkod göra ramverk och en Docker-kapten som älskar att använda containerteknologier för att påskynda innovationstakten och samtidigt lösa världens största utmaningar. Under de senaste 10 åren har Alex arbetat med att demokratisera AI och ML, bekämpa klimatförändringar och göra resor säkrare, hälsovården bättre och energismartare.

Alex Iankoulski är en Principal Solutions Architect, Self-managed Machine Learning på AWS. Han är en full-stack mjukvaru- och infrastrukturingenjör som gillar att göra djupgående, praktiskt arbete. I sin roll fokuserar han på att hjälpa kunder med containerisering och orkestrering av ML- och AI-arbetsbelastningar på containerdrivna AWS-tjänster. Han är också författare till öppen källkod göra ramverk och en Docker-kapten som älskar att använda containerteknologier för att påskynda innovationstakten och samtidigt lösa världens största utmaningar. Under de senaste 10 åren har Alex arbetat med att demokratisera AI och ML, bekämpa klimatförändringar och göra resor säkrare, hälsovården bättre och energismartare.

Keita Watanabe är Senior Solutions Architect of Frameworks ML Solutions på Amazon Web Services där han hjälper till att utveckla branschens bästa molnbaserade Self-managed Machine Learning-lösningar. Hans bakgrund är inom forskning och utveckling inom maskininlärning. Innan han började på AWS arbetade Keita i e-handelsbranschen. Keita har en Ph.D. i vetenskap från University of Tokyo.

Keita Watanabe är Senior Solutions Architect of Frameworks ML Solutions på Amazon Web Services där han hjälper till att utveckla branschens bästa molnbaserade Self-managed Machine Learning-lösningar. Hans bakgrund är inom forskning och utveckling inom maskininlärning. Innan han började på AWS arbetade Keita i e-handelsbranschen. Keita har en Ph.D. i vetenskap från University of Tokyo.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Fordon / elbilar, Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- ChartPrime. Höj ditt handelsspel med ChartPrime. Tillgång här.

- BlockOffsets. Modernisera miljökompensation ägande. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/enable-pod-based-gpu-metrics-in-amazon-cloudwatch/

ikonen i det övre högra hörnet av fliken för att dyka upp i ett nytt fönster.

ikonen i det övre högra hörnet av fliken för att dyka upp i ett nytt fönster.

Amr Ragab är en före detta Principal Solutions Architect, EC2 Accelerated Computing på AWS. Han är hängiven att hjälpa kunder att köra beräkningsarbete i stor skala. På fritiden gillar han att resa och att hitta nya sätt att integrera teknik i vardagen.

Amr Ragab är en före detta Principal Solutions Architect, EC2 Accelerated Computing på AWS. Han är hängiven att hjälpa kunder att köra beräkningsarbete i stor skala. På fritiden gillar han att resa och att hitta nya sätt att integrera teknik i vardagen. Alex Iankoulski är en Principal Solutions Architect, Self-managed Machine Learning på AWS. Han är en full-stack mjukvaru- och infrastrukturingenjör som gillar att göra djupgående, praktiskt arbete. I sin roll fokuserar han på att hjälpa kunder med containerisering och orkestrering av ML- och AI-arbetsbelastningar på containerdrivna AWS-tjänster. Han är också författare till öppen källkod göra ramverk och en Docker-kapten som älskar att använda containerteknologier för att påskynda innovationstakten och samtidigt lösa världens största utmaningar. Under de senaste 10 åren har Alex arbetat med att demokratisera AI och ML, bekämpa klimatförändringar och göra resor säkrare, hälsovården bättre och energismartare.

Alex Iankoulski är en Principal Solutions Architect, Self-managed Machine Learning på AWS. Han är en full-stack mjukvaru- och infrastrukturingenjör som gillar att göra djupgående, praktiskt arbete. I sin roll fokuserar han på att hjälpa kunder med containerisering och orkestrering av ML- och AI-arbetsbelastningar på containerdrivna AWS-tjänster. Han är också författare till öppen källkod göra ramverk och en Docker-kapten som älskar att använda containerteknologier för att påskynda innovationstakten och samtidigt lösa världens största utmaningar. Under de senaste 10 åren har Alex arbetat med att demokratisera AI och ML, bekämpa klimatförändringar och göra resor säkrare, hälsovården bättre och energismartare. Keita Watanabe är Senior Solutions Architect of Frameworks ML Solutions på Amazon Web Services där han hjälper till att utveckla branschens bästa molnbaserade Self-managed Machine Learning-lösningar. Hans bakgrund är inom forskning och utveckling inom maskininlärning. Innan han började på AWS arbetade Keita i e-handelsbranschen. Keita har en Ph.D. i vetenskap från University of Tokyo.

Keita Watanabe är Senior Solutions Architect of Frameworks ML Solutions på Amazon Web Services där han hjälper till att utveckla branschens bästa molnbaserade Self-managed Machine Learning-lösningar. Hans bakgrund är inom forskning och utveckling inom maskininlärning. Innan han började på AWS arbetade Keita i e-handelsbranschen. Keita har en Ph.D. i vetenskap från University of Tokyo.