I dagens snabbt utvecklande hälsovårdslandskap står läkare inför stora mängder kliniska data från olika källor, såsom anteckningar från vårdgivare, elektroniska journaler och bildrapporter. Denna mängd information, även om den är väsentlig för patientvård, kan också vara överväldigande och tidskrävande för medicinsk personal att sålla igenom och analysera. Att effektivt sammanfatta och extrahera insikter från dessa data är avgörande för bättre patientvård och beslutsfattande. Sammanfattad patientinformation kan vara användbar för ett antal nedströmsprocesser som dataaggregation, effektiv kodning av patienter eller gruppering av patienter med liknande diagnoser för granskning.

Modeller för artificiell intelligens (AI) och maskininlärning (ML) har visat sig lovande när det gäller att ta itu med dessa utmaningar. Modeller kan tränas för att analysera och tolka stora volymer textdata och effektivt kondensera information till koncisa sammanfattningar. Genom att automatisera sammanfattningsprocessen kan läkare snabbt få tillgång till relevant information, vilket gör att de kan fokusera på patientvård och fatta mer välgrundade beslut. Se följande fallstudie för att lära dig mer om ett verkligt användningsfall.

Amazon SageMaker, en helt hanterad ML-tjänst, ger en idealisk plattform för att vara värd och implementera olika AI/ML-baserade sammanfattningsmodeller och tillvägagångssätt. I det här inlägget utforskar vi olika alternativ för att implementera summeringstekniker på SageMaker, inklusive att använda Amazon SageMaker JumpStart grundmodeller, finjustera förtränade modeller från Hugging Face och bygga anpassade sammanfattningsmodeller. Vi diskuterar också för- och nackdelar med varje tillvägagångssätt, vilket gör det möjligt för vårdpersonal att välja den lämpligaste lösningen för att generera kortfattade och korrekta sammanfattningar av komplexa kliniska data.

Två viktiga termer att känna till innan vi börjar: förutbildad och finjustering. En förtränad eller grundmodell är en som har byggts och tränats på en stor mängd data, vanligtvis för allmänna språkkunskaper. Finjustering är den process genom vilken en förtränad modell ges en annan mer domänspecifik datauppsättning för att förbättra dess prestanda på en specifik uppgift. I en hälsovårdsmiljö skulle detta innebära att ge modellen vissa data inklusive fraser och terminologi som hänför sig specifikt till patientvård.

Bygg anpassade sammanfattningsmodeller på SageMaker

Även om det är den mest ansträngda metoden, kanske vissa organisationer föredrar att bygga anpassade sammanfattningsmodeller på SageMaker från grunden. Detta tillvägagångssätt kräver mer djupgående kunskap om AI/ML-modeller och kan innebära att skapa en modellarkitektur från grunden eller anpassa befintliga modeller för att passa specifika behov. Att bygga anpassade modeller kan erbjuda större flexibilitet och kontroll över sammanfattningsprocessen, men kräver också mer tid och resurser jämfört med tillvägagångssätt som utgår från förutbildade modeller. Det är viktigt att noga väga fördelarna och nackdelarna med detta alternativ innan du fortsätter, eftersom det kanske inte är lämpligt för alla användningsfall.

SageMaker JumpStart foundation modeller

Ett bra alternativ för att implementera summering på SageMaker är att använda JumpStart-grundmodeller. Dessa modeller, utvecklade av ledande AI-forskningsorganisationer, erbjuder en rad förutbildade språkmodeller optimerade för olika uppgifter, inklusive textsammanfattning. SageMaker JumpStart tillhandahåller två typer av grundmodeller: proprietära modeller och modeller med öppen källkod. SageMaker JumpStart ger också HIPAA-berättigande, vilket gör det användbart för sjukvårdsbelastningar. Det är i slutändan upp till kunden att säkerställa efterlevnaden, så se till att vidta lämpliga åtgärder. Ser Arkitektering för HIPAA säkerhet och efterlevnad på Amazon Web Services för mer detaljer.

Egenutvecklade grundmodeller

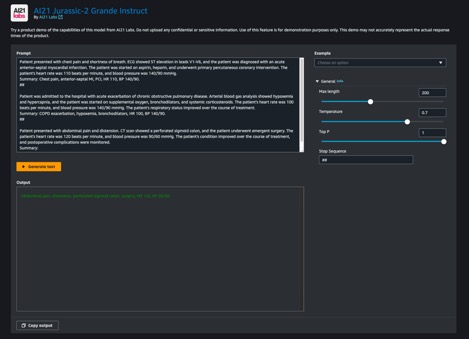

Proprietära modeller, såsom Jurassic-modeller från AI21 och Cohere Generate-modellen från Cohere, kan upptäckas genom SageMaker JumpStart på AWS Management Console och är för närvarande under förhandsvisning. Att använda egna modeller för sammanfattning är idealiskt när du inte behöver finjustera din modell på anpassade data. Detta erbjuder en lättanvänd, färdig lösning som kan uppfylla dina sammanfattningskrav med minimal konfiguration. Genom att använda funktionerna hos dessa förtränade modeller kan du spara tid och resurser som annars skulle läggas på att träna och finjustera en anpassad modell. Dessutom kommer proprietära modeller vanligtvis med användarvänliga API:er och SDK:er, vilket effektiviserar integrationsprocessen med dina befintliga system och applikationer. Om dina sammanfattningsbehov kan tillgodoses av förutbildade proprietära modeller utan att kräva specifik anpassning eller finjustering, erbjuder de en bekväm, kostnadseffektiv och effektiv lösning för dina textsammanfattningsuppgifter. Eftersom dessa modeller inte är utbildade specifikt för användningsfall inom sjukvården, kan kvaliteten inte garanteras för medicinskt språk direkt utan finjustering.

Jurassic-2 Grande Instruct är en stor språkmodell (LLM) av AI21 Labs, optimerad för naturliga språkinstruktioner och tillämpbar för olika språkuppgifter. Den erbjuder ett lättanvänt API och Python SDK, som balanserar kvalitet och prisvärdhet. Populära användningsområden inkluderar att skapa marknadsföringsexemplar, driva chatbots och textsammanfattningar.

På SageMaker-konsolen, navigera till SageMaker JumpStart, hitta AI21 Jurassic-2 Grande Instruct-modellen och välj Prova modellen.

Om du vill distribuera modellen till en SageMaker-slutpunkt som du hanterar kan du följa stegen i detta exempel anteckningsbok, som visar hur du distribuerar Jurassic-2 Large med SageMaker.

Grundmodeller med öppen källkod

Modeller med öppen källkod inkluderar FLAN T5-, Bloom- och GPT-2-modeller som kan upptäckas genom SageMaker JumpStart i Amazon SageMaker Studio UI, SageMaker JumpStart på SageMaker-konsolen och SageMaker JumpStart API:er. Dessa modeller kan finjusteras och distribueras till slutpunkter under ditt AWS-konto, vilket ger dig full äganderätt till modellvikter och skriptkoder.

Flan-T5 XL är en kraftfull och mångsidig modell designad för ett brett utbud av språkuppgifter. Genom att finjustera modellen med dina domänspecifika data kan du optimera dess prestanda för ditt specifika användningsfall, såsom textsammanfattning eller någon annan NLP-uppgift. För detaljer om hur du finjusterar Flan-T5 XL med SageMaker Studio UI, se Instruktionsfinjustering för FLAN T5 XL med Amazon SageMaker Jumpstart.

Finjustera förtränade modeller med Hugging Face på SageMaker

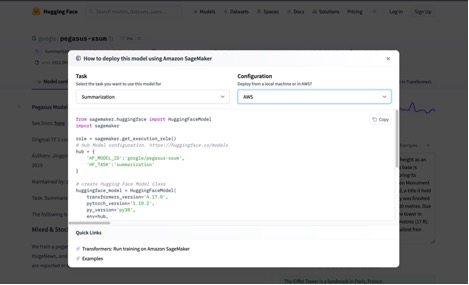

Ett av de mest populära alternativen för att implementera sammanfattning på SageMaker är att finjustera förtränade modeller med Hugging Face Transformatorer bibliotek. Hugging Face tillhandahåller ett brett utbud av förtränade transformatormodeller som är speciellt designade för olika NLP-uppgifter (natural language processing), inklusive textsammanfattning. Med Hugging Face Transformers-biblioteket kan du enkelt finjustera dessa förtränade modeller på din domänspecifika data med SageMaker. Det här tillvägagångssättet har flera fördelar, såsom snabbare träningstider, bättre prestanda på specifika domäner och enklare modellpaketering och distribution med hjälp av inbyggda SageMaker-verktyg och tjänster. Om du inte kan hitta en lämplig modell i SageMaker JumpStart kan du välja vilken modell som helst som erbjuds av Hugging Face och finjustera den med SageMaker.

För att börja arbeta med en modell för att lära dig om funktionerna i ML behöver du bara öppna SageMaker Studio, hitta en förutbildad modell som du vill använda i Hugging Face Model Hub, och välj SageMaker som din distributionsmetod. Hugging Face ger dig koden för att kopiera, klistra in och köra i din anteckningsbok. Så enkelt är det! Ingen ML ingenjörserfarenhet krävs.

Hugging Face Transformers-biblioteket gör det möjligt för byggare att arbeta på de förutbildade modellerna och utföra avancerade uppgifter som finjustering, som vi utforskar i följande avsnitt.

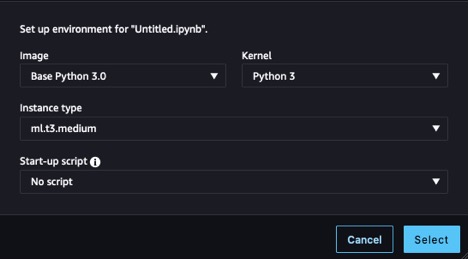

Tillhandahållande resurser

Innan vi kan börja måste vi tillhandahålla en anteckningsbok. För instruktioner, se steg 1 och 2 i Bygg och träna en maskininlärningsmodell lokalt. För det här exemplet använde vi inställningarna som visas i följande skärmdump.

Vi måste också skapa en Amazon enkel lagringstjänst (Amazon S3) hink för att lagra träningsdata och träningsartefakter. För instruktioner, se Skapa en hink.

Förbered datasetet

För att finjustera vår modell för att ha bättre domänkunskap behöver vi få data som passar uppgiften. När du tränar för ett företagsanvändningsfall måste du gå igenom ett antal datateknikuppgifter för att förbereda din egen data för att vara redo för utbildning. Dessa uppgifter ligger utanför ramen för detta inlägg. För det här exemplet har vi genererat några syntetiska data för att efterlikna sjuksköterskeanteckningar och lagrat dem i Amazon S3. Att lagra våra data i Amazon S3 gör det möjligt för oss utforma vår arbetsbelastning för HIPAA-efterlevnad. Vi börjar med att hämta dessa anteckningar och ladda dem på den instans där vår anteckningsbok körs:

Anteckningarna är sammansatta av en kolumn som innehåller hela posten, anteckning och en kolumn som innehåller en förkortad version som exemplifierar vad vårt önskade resultat ska vara, sammanfattning. Syftet med att använda denna datauppsättning är att förbättra vår modells biologiska och medicinska vokabulär så att den är mer anpassad till att sammanfatta i hälsovårdssammanhang, kallad domänfinjustering, och visa vår modell hur man strukturerar dess sammanfattade produktion. I vissa sammanfattningsfall kanske vi vill skapa ett sammandrag av en artikel eller en sammanfattning av en recension på en rad, men i det här fallet försöker vi få vår modell att visa en förkortad version av symptomen och åtgärder som vidtagits för en patient hittills.

Ladda modellen

Modellen vi använder som grund är en version av Googles Pegasus, tillgänglig i Hugging Face Hub, kallad pegasus-xsum. Den är redan förutbildad för sammanfattning, så vår finjusteringsprocess kan fokusera på att utöka sin domänkunskap. Att ändra uppgiften som vår modell kör är en annan typ av finjustering som inte tas upp i det här inlägget. Transformer-biblioteket förser oss med en klass för att ladda modelldefinitionen från vår model_checkpoint: google/pegasus-xsum. Detta kommer att ladda modellen från navet och instansiera den i vår anteckningsbok så att vi kan använda den senare. Därför att pegasus-xsum är en sekvens-till-sekvens-modell, vi vill använda Seq2Seq-typen av Automodell klass:

Nu när vi har vår modell är det dags att uppmärksamma de andra komponenterna som gör det möjligt för oss att köra vår träningsslinga.

Skapa en tokenizer

Den första av dessa komponenter är tokenizern. tokenization är den process genom vilken ord från indata omvandlas till numeriska representationer som vår modell kan förstå. Återigen, Transformer-biblioteket tillhandahåller en klass för oss att ladda en tokenizerdefinition från samma kontrollpunkt som vi använde för att instansiera modellen:

Med detta tokenizer-objekt kan vi skapa en förbearbetningsfunktion och mappa den till vår datauppsättning för att ge oss tokens redo att matas in i modellen. Slutligen formaterar vi den tokeniserade utdatan och tar bort kolumnerna som innehåller vår ursprungliga text, eftersom modellen inte kommer att kunna tolka dem. Nu har vi en tokeniserad ingång redo att matas in i modellen. Se följande kod:

Med vår datatokeniserade och vår modell instansierad är vi nästan redo att köra en träningsloop. Nästa komponenter vi vill skapa är datainsamlaren och optimeraren. Datainsamlaren är en annan klass som tillhandahålls av Hugging Face genom Transformers-biblioteket, som vi använder för att skapa partier av våra tokeniserade data för träning. Vi kan enkelt bygga detta med hjälp av tokenizer och modellobjekt vi redan har bara genom att hitta motsvarande klasstyp som vi tidigare använt för vår modell (Seq2Seq) för kollatorklassen. Optimizerns funktion är att bibehålla träningstillståndet och uppdatera parametrarna baserat på vår träningsförlust när vi arbetar genom slingan. För att skapa en optimerare kan vi importera jag öppnar paket från ficklampsmodulen, där ett antal optimeringsalgoritmer finns tillgängliga. Några vanliga du kanske har stött på tidigare är Stokastisk Gradient Descent och Adam, den senare av de som tillämpas i vårt exempel. Adams konstruktör tar in modellparametrarna och den parametriserade inlärningshastigheten för den givna träningskörningen. Se följande kod:

De sista stegen innan vi kan börja träna är att bygga acceleratorn och inlärningshastighetsschemaläggaren. Acceleratorn kommer från ett annat bibliotek (vi har främst använt Transformers) producerat av Hugging Face, passande namnet Accelerate, och kommer att abstrahera bort logik som krävs för att hantera enheter under träning (till exempel genom att använda flera GPU: er). För den sista komponenten besöker vi det ständigt användbara Transformers-biblioteket för att implementera vår inlärningshastighetsschemaläggare. Genom att specificera schemaläggningstypen, det totala antalet träningssteg i vår loop och den tidigare skapade optimeraren, get_scheduler funktion returnerar ett objekt som gör det möjligt för oss att justera vår initiala inlärningshastighet under hela träningsprocessen:

Nu är vi redo för träning! Låt oss skapa ett träningsjobb, börja med att instansiera training_args använda Transformers-biblioteket och välja parametervärden. Vi kan skicka dessa, tillsammans med våra andra förberedda komponenter och datauppsättning, direkt till tränare och börja träna, som visas i följande kod. Beroende på storleken på din datauppsättning och valda parametrar kan detta ta en betydande tid.

Paketera modellen för slutledning

Efter att träningen har körts är modellobjektet redo att användas för slutledning. Som en bästa praxis, låt oss spara vårt arbete för framtida bruk. Vi måste skapa våra modellartefakter, zippa ihop dem och ladda upp vår tarball till Amazon S3 för lagring. För att förbereda vår modell för zippa måste vi packa upp den nu finjusterade modellen och sedan spara modellens binära och tillhörande konfigurationsfiler. Vi måste också spara vår tokenizer i samma katalog som vi sparade våra modellartefakter till så att den är tillgänglig när vi använder modellen för slutledning. Vår model_dir mappen ska nu se ut ungefär som följande kod:

Allt som återstår är att köra ett tar-kommando för att zippa upp vår katalog och ladda upp filen tar.gz till Amazon S3:

Vår nyligen finjusterade modell är nu klar och tillgänglig för att användas för slutledning.

Utför slutledning

För att använda denna modellartefakt för slutledning öppnar du en ny fil och använder följande kod och ändrar model_data parameter för att passa din artefaktsparplats i Amazon S3. De HuggingFaceModel constructor kommer att bygga om vår modell från kontrollpunkten vi sparade till model.tar.gz, som vi sedan kan distribuera för slutledning med hjälp av distributionsmetoden. Det tar några minuter att distribuera slutpunkten.

När slutpunkten har distribuerats kan vi använda prediktorn vi har skapat för att testa den. Skicka predict använd en datanyttolast och kör cellen, så får du svaret från din finjusterade modell:

För att se fördelen med att finjustera en modell, låt oss göra ett snabbtest. Följande tabell innehåller en uppmaning och resultaten av att skicka den uppmaningen till modellen före och efter finjustering.

| Prompt | Svar utan finjustering | Svar med Fine-Tuning |

| Sammanfatta symtomen som patienten upplever. Patienten är en 45-årig man med besvär av substernal bröstsmärta som strålar ut till vänster arm. Smärta uppstår plötsligt när han utförde trädgårdsarbete, förknippad med lätt andnöd och diafores. Vid ankomsten var patientens hjärtfrekvens 120, andningsfrekvens 24, blodtryck 170/95. Elektrokardiogram med 12 avledningar gjordes vid ankomst till akutmottagningen och tre sublinguala nitroglycerin administrerade utan lindring av bröstsmärtor. Elektrokardiogram visar ST-förhöjning i främre elektroder som visar akut främre hjärtinfarkt. Vi har kontaktat hjärtkateteriseringslabb och förbereder för hjärtkateterisering av kardiolog. | Vi presenterar ett fall av akut hjärtinfarkt. | Bröstsmärta, främre MI, PCI. |

Som du kan se använder vår finjusterade modell hälsoterminologi på olika sätt, och vi har kunnat ändra strukturen på svaret för att passa våra syften. Observera att resultaten är beroende av din datauppsättning och de designval som gjorts under utbildningen. Din version av modellen kan ge mycket olika resultat.

Städa upp

När du är klar med din SageMaker-anteckningsbok, se till att stänga av den för att undvika kostnader från långvariga resurser. Observera att om du stänger av instansen kommer du att förlora all data som är lagrad i instansens tillfälliga minne, så du bör spara allt ditt arbete till beständig lagring innan du städar. Du måste också gå till endpoints sida på SageMaker-konsolen och ta bort eventuella slutpunkter som distribueras för slutledning. För att ta bort alla artefakter måste du också gå till Amazon S3-konsolen för att radera filer som laddats upp till din hink.

Slutsats

I det här inlägget undersökte vi olika alternativ för att implementera textsammanfattningstekniker på SageMaker för att hjälpa vårdpersonal att effektivt bearbeta och extrahera insikter från stora mängder klinisk data. Vi diskuterade att använda SageMaker Jumpstart-grundmodeller, finjustera förtränade modeller från Hugging Face och bygga anpassade sammanfattningsmodeller. Varje tillvägagångssätt har sina egna fördelar och nackdelar, som tillgodoser olika behov och krav.

Att bygga anpassade sammanfattningsmodeller på SageMaker ger mycket flexibilitet och kontroll men kräver mer tid och resurser än att använda förutbildade modeller. SageMaker Jumpstart grundmodeller ger en lättanvänd och kostnadseffektiv lösning för organisationer som inte kräver specifik anpassning eller finjustering, samt några alternativ för förenklad finjustering. Finjustering av förtränade modeller från Hugging Face erbjuder snabbare träningstider, bättre domänspecifik prestanda och sömlös integration med SageMaker-verktyg och tjänster över en bred katalog av modeller, men det kräver en viss implementeringsansträngning. När detta inlägg skrevs har Amazon meddelat ett annat alternativ, Amazonas berggrund, som kommer att erbjuda sammanfattningsmöjligheter i en ännu mer hanterad miljö.

Genom att förstå för- och nackdelarna med varje tillvägagångssätt kan vårdpersonal och organisationer fatta välgrundade beslut om den mest lämpliga lösningen för att generera kortfattade och korrekta sammanfattningar av komplexa kliniska data. I slutändan kan användning av AI/ML-baserade sammanfattningsmodeller på SageMaker förbättra patientvården och beslutsfattandet avsevärt genom att göra det möjligt för medicinsk personal att snabbt få tillgång till relevant information och fokusera på att tillhandahålla kvalitetsvård.

Resurser

För hela manuset som diskuteras i det här inlägget och några exempeldata, se GitHub repo. Mer information om hur du kör ML-arbetsbelastningar på AWS finns i följande resurser:

Om författarna

Cody Collins är en New York-baserad lösningsarkitekt på Amazon Web Services. Han arbetar med ISV-kunder för att bygga branschledande lösningar i molnet. Han har framgångsrikt levererat komplexa projekt för olika branscher, optimerat effektivitet och skalbarhet. På fritiden tycker han om att läsa, resa och träna jiu jitsu.

Cody Collins är en New York-baserad lösningsarkitekt på Amazon Web Services. Han arbetar med ISV-kunder för att bygga branschledande lösningar i molnet. Han har framgångsrikt levererat komplexa projekt för olika branscher, optimerat effektivitet och skalbarhet. På fritiden tycker han om att läsa, resa och träna jiu jitsu.

Ameer Hakme är en AWS Solutions Architect bosatt i Pennsylvania. Hans professionella fokus innebär att samarbeta med oberoende mjukvaruleverantörer i hela nordöstra delen av nordöstra, att vägleda dem i att designa och konstruera skalbara, toppmoderna plattformar på AWS-molnet.

Ameer Hakme är en AWS Solutions Architect bosatt i Pennsylvania. Hans professionella fokus innebär att samarbeta med oberoende mjukvaruleverantörer i hela nordöstra delen av nordöstra, att vägleda dem i att designa och konstruera skalbara, toppmoderna plattformar på AWS-molnet.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Fordon / elbilar, Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- BlockOffsets. Modernisera miljökompensation ägande. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Able

- Om Oss

- SAMMANDRAG

- accelerera

- accelerator

- tillgång

- Konto

- exakt

- tvärs

- åtgärder

- Adam

- adresse

- administreras

- avancerat

- fördelar

- Efter

- igen

- aggregation

- AI

- ai forskning

- AI / ML

- algoritmer

- Alla

- tillåta

- tillåter

- längs

- redan

- också

- amason

- Amazon SageMaker

- Amazon Web Services

- mängd

- mängder

- an

- analysera

- och

- meddelade

- Annan

- vilken som helst

- api

- API: er

- tillämplig

- tillämpningar

- tillämpas

- tillvägagångssätt

- tillvägagångssätt

- lämpligt

- arkitektur

- ÄR

- ARM

- ankomst

- Artikeln

- AS

- associerad

- At

- uppmärksamhet

- automatisera

- tillgänglig

- undvika

- bort

- AWS

- balansering

- baserat

- BE

- därför att

- varit

- innan

- börja

- fördel

- Fördelarna

- BÄST

- Bättre

- SOPTUNNA

- blod

- Blood Pressure

- Bloom

- Box

- Breath

- bred

- SLUTRESULTAT

- byggare

- Byggnad

- byggt

- inbyggd

- men

- by

- Ring

- kallas

- KAN

- kapacitet

- vilken

- försiktigt

- Vid

- fall

- katalog

- Orsak

- utmaningar

- byta

- chatbots

- val

- Välja

- välja

- valda

- klass

- Klinisk

- cloud

- koda

- koder

- Kodning

- samarbeta

- Kolumn

- Kolonner

- komma

- kommer

- Gemensam

- jämfört

- klagomål

- komplex

- Efterlevnad

- komponent

- komponenter

- sammansatt

- koncis

- konfiguration

- Nackdelar

- Konsol

- konstruera

- sammanhang

- kontroll

- Bekväm

- Motsvarande

- kostnadseffektiv

- Kostar

- kunde

- omfattas

- skapa

- skapas

- Skapa

- avgörande

- För närvarande

- beställnings

- kund

- Kunder

- anpassning

- datum

- datauppsättningar

- Beslutsfattande

- beslut

- definition

- levereras

- demonstrera

- Avdelning

- beroende

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- Designa

- utformade

- design

- önskas

- detaljer

- utvecklade

- enheter

- olika

- direkt

- upptäckt

- diskutera

- diskuteras

- flera

- do

- Läkare

- gör

- domän

- domäner

- gjort

- inte

- ner

- nackdelar

- under

- varje

- lättare

- lätt

- lätt

- LÄTTANVÄND

- effektivt

- effektivitet

- effektiv

- effektivt

- ansträngning

- Elektronisk

- Elektroniska hälsoregister

- berättigande

- nödsituation

- möjliggöra

- möjliggör

- möjliggör

- Slutpunkt

- Teknik

- förbättra

- säkerställa

- Företag

- inträde

- Miljö

- epok

- väsentlig

- Även

- utvecklas

- exempel

- befintliga

- erfarenhet

- upplever

- utforska

- utforskas

- Utforska

- sträcker

- extrahera

- Ansikte

- inför

- långt

- snabbare

- Fed

- få

- Fil

- Filer

- slutlig

- Slutligen

- hitta

- finna

- Förnamn

- passa

- Flexibilitet

- Fokus

- följer

- efter

- För

- format

- fundament

- från

- full

- fullständigt

- fungera

- Vidare

- framtida

- Få

- Allmänt

- generera

- genereras

- generera

- skaffa sig

- få

- Ge

- ges

- Ge

- Go

- Googles

- GPUs

- stor

- större

- garanterat

- Har

- he

- Hälsa

- hälso-och sjukvård

- Hjärta

- hjälpa

- hans

- värd

- Hur ser din drömresa ut

- How To

- html

- http

- HTTPS

- Nav

- Kramar ansikte

- idealisk

- if

- Imaging

- genomföra

- genomförande

- genomföra

- importera

- med Esport

- förbättra

- in

- djupgående

- innefattar

- innefattar

- Inklusive

- oberoende

- industrier

- industrin

- informationen

- informeras

- inledande

- ingång

- ingångar

- insikter

- exempel

- instruktioner

- integrering

- Intelligens

- in

- engagera

- IT

- DESS

- Jobb

- json

- bara

- Vet

- kunskap

- lab

- Labs

- liggande

- språk

- Large

- Efternamn

- senare

- leda

- ledande

- Leads

- LÄRA SIG

- inlärning

- vänster

- Bibliotek

- tycka om

- LLM

- läsa in

- läser in

- läge

- Logiken

- se

- förlorar

- förlust

- Maskinen

- maskininlärning

- gjord

- bibehålla

- göra

- Framställning

- hantera

- förvaltade

- ledning

- karta

- Marknadsföring

- Maj..

- betyda

- medicinsk

- Möt

- Minne

- träffade

- metod

- kanske

- minimum

- minuter

- ML

- modell

- modeller

- Modulerna

- mer

- mest

- Mest populär

- multipel

- Som heter

- Natural

- Naturlig språkbehandling

- Navigera

- Behöver

- behov

- Nya

- New York

- nytt

- Nästa

- nlp

- Nej

- anteckningsbok

- Anmärkningar

- nu

- antal

- objektet

- objekt

- of

- erbjudanden

- erbjuds

- Erbjudanden

- Gamla

- on

- ONE

- ettor

- början

- till

- öppet

- öppen källkod

- driva

- optimering

- Optimera

- optimerad

- optimera

- Alternativet

- Tillbehör

- or

- beställa

- organisationer

- ursprungliga

- Övriga

- annat

- vår

- ut

- produktion

- utanför

- över

- egen

- ägande

- paket

- förpackning

- sida

- Smärta

- parameter

- parametrar

- särskilt

- passera

- Förbi

- Patienten

- patienter

- Pegasus

- Pennsylvania sylvania~~POS=HEADCOMP

- prestanda

- tillhörande

- fraser

- plattform

- Plattformar

- plato

- Platon Data Intelligence

- PlatonData

- Punkt

- Populära

- Inlägg

- den mäktigaste

- Strömförsörjning

- praktiken

- Predictor

- föredra

- Förbered

- beredd

- presentera

- tryck

- Förhandsvisning

- tidigare

- primärt

- process

- processer

- bearbetning

- producerad

- professionell

- yrkesmän/kvinnor

- projekt

- löfte

- proprietary

- PROS

- ge

- förutsatt

- ger

- tillhandahålla

- tillhandahållande

- Syftet

- syfte

- sätta

- Python

- kvalitet

- Snabbt

- snabbt

- område

- snabbt

- Betygsätta

- Läsning

- redo

- verkliga världen

- register

- relevanta

- lindring

- ta bort

- Rapport

- kräver

- Obligatorisk

- Krav

- Kräver

- forskning

- Resurser

- respons

- Resultat

- återgår

- översyn

- Roll

- Körning

- rinnande

- kör

- sagemaker

- Samma

- Save

- skalbarhet

- skalbar

- omfattning

- repa

- sDK

- sdks

- sömlös

- sektioner

- säkerhet

- se

- separat

- service

- Tjänster

- in

- inställning

- inställningar

- flera

- förkortas

- skall

- show

- visas

- Visar

- stänga

- Sålla

- signifikant

- signifikant

- liknande

- Enkelt

- förenklade

- Storlek

- So

- än så länge

- Mjukvara

- lösning

- Lösningar

- några

- något

- Källor

- specifik

- specifikt

- spent

- starta

- Starta

- Ange

- state-of-the-art

- Steg

- förvaring

- lagra

- lagras

- misslyckande

- rationalisering

- struktur

- studio

- sublingual

- Framgångsrikt

- sådana

- plötslig

- följer

- lämplig

- SAMMANFATTNING

- säker

- Symptom

- synopsis

- syntetisk

- syntetiska data

- System

- bord

- Ta

- tagen

- tar

- uppgift

- uppgifter

- tekniker

- terminologi

- villkor

- testa

- än

- den där

- Smakämnen

- navet

- Dem

- sedan

- Dessa

- de

- detta

- de

- tre

- Genom

- hela

- tid

- tidskrävande

- gånger

- till

- dagens

- tillsammans

- befogenhetsbeskrivas

- tokens

- verktyg

- brännaren

- Totalt

- Tåg

- tränad

- Utbildning

- transformerad

- transformator

- transformatorer

- Traveling

- två

- Typ

- typer

- typiskt

- ui

- Ytterst

- oförmögen

- under

- förstå

- förståelse

- Uppdatering

- uppladdad

- us

- användning

- användningsfall

- Begagnade

- användarvänligt

- användningar

- med hjälp av

- Använda

- godkännande

- Värden

- olika

- Omfattande

- försäljare

- mångsidig

- version

- mycket

- volymer

- vill

- var

- we

- Rikedom

- webb

- webbservice

- väga

- VÄL

- Vad

- när

- som

- medan

- bred

- Brett utbud

- kommer

- med

- utan

- ord

- Arbete

- arbetssätt

- fungerar

- skulle

- skrivning

- år

- york

- Om er

- Din

- zephyrnet

- Postnummer