Kunder inom branscher som konsumentförpackade varor, tillverkning och detaljhandel letar alltid efter sätt att stärka sina operativa processer genom att berika dem med insikter och analyser som genereras från data. Uppgifter som försäljningsprognoser påverkar direkt verksamhet såsom råvaruplanering, inköp, tillverkning, distribution och inkommande/utgående logistik, och det kan ha många nivåer av påverkan, från ett enda lager hela vägen till storskaliga produktionsanläggningar.

Säljare och chefer använder historisk försäljningsdata för att göra välgrundade förutsägelser om framtida försäljningstrender. Kunder använder SAP ERP Central Component (ECC) för att hantera planering för tillverkning, försäljning och distribution av varor. Försäljnings- och distributionsmodulen (SD) inom SAP ECC hjälper till att hantera försäljningsorder. SAP-system är den primära källan till historiska försäljningsdata.

Säljare och chefer har domänkunskapen och en djup förståelse av sina försäljningsdata. De saknar dock datavetenskap och programmeringskunskaper för att skapa modeller för maskininlärning (ML) som kan generera försäljningsprognoser. De söker intuitiva, enkla att använda verktyg för att skapa ML-modeller utan att skriva en enda rad kod.

För att hjälpa organisationer att uppnå den smidighet och effektivitet som affärsanalytiker eftersträvar, har vi introducerade Amazon SageMaker Canvas, en kodfri ML-lösning som hjälper dig att påskynda leveransen av ML-lösningar ner till timmar eller dagar. Canvas gör det möjligt för analytiker att enkelt använda tillgänglig data i datasjöar, datalager och operativa datalager; bygga ML-modeller; och använd dem för att göra förutsägelser interaktivt och för batchpoäng på bulkdatauppsättningar – allt utan att skriva en enda rad kod.

I det här inlägget visar vi hur man hämtar försäljningsorderdata från SAP ECC för att generera försäljningsprognoser med hjälp av en ML-modell byggd med Canvas.

Lösningsöversikt

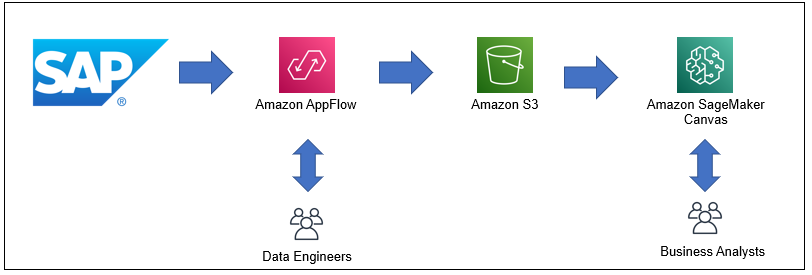

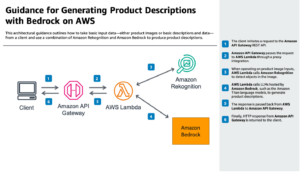

För att generera försäljningsprognoser med hjälp av SAP-försäljningsdata behöver vi samarbete mellan två personer: dataingenjörer och affärsanalytiker (säljare och chefer). Dataingenjörer ansvarar för att konfigurera dataexporten från SAP-systemet till Amazon enkel lagringstjänst (Amazon S3) använder Amazon App Flow, vilka affärsanalytiker sedan kan köra antingen on-demand eller automatiskt (schemabaserat) för att uppdatera SAP-data i S3-bucket. Affärsanalytiker är sedan ansvariga för att generera prognoser med den exporterade datan med Canvas. Följande diagram illustrerar detta arbetsflöde.

För det här inlägget använder vi SAP NetWeaver Enterprise Procurement Model (EPM) för exempeldata. EPM används vanligtvis för demonstrations- och teständamål i SAP. Den använder en gemensam affärsprocessmodell och följer affärsobjektets (BO) paradigm för att stödja en väldefinierad affärslogik. Vi använde SAP-transaktionen SEPM_DG (datagenerator) för att generera cirka 80,000 XNUMX historiska försäljningsorder och skapade en HANA CDS-vy för att aggregera data efter produkt-ID, försäljningsdatum och stad, som visas i följande kod:

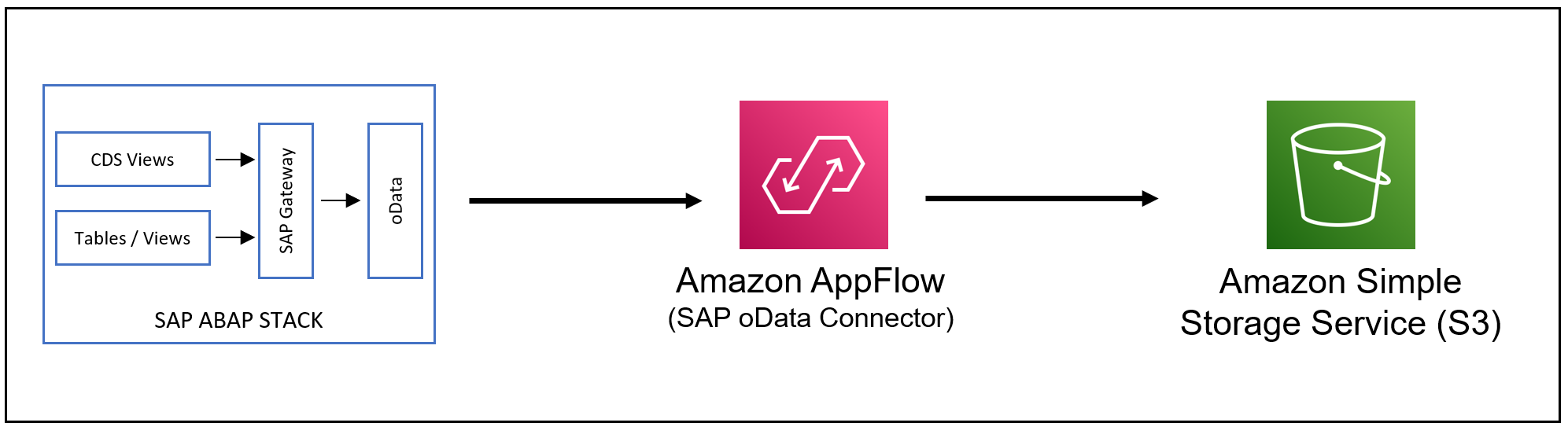

I nästa avsnitt exponerar vi denna vy med hjälp av SAP OData-tjänster som ABAP-struktur, vilket gör att vi kan extrahera data med Amazon AppFlow.

Följande tabell visar representativa historiska försäljningsdata från SAP, som vi använder i det här inlägget.

| Serienummer | försäljningsdatum | stad | total rea |

| P-4 | 2013-01-02 00:00:00 | Quito | 1922.00 |

| P-5 | 2013-01-02 00:00:00 | Santo Domingo | 1903.00 |

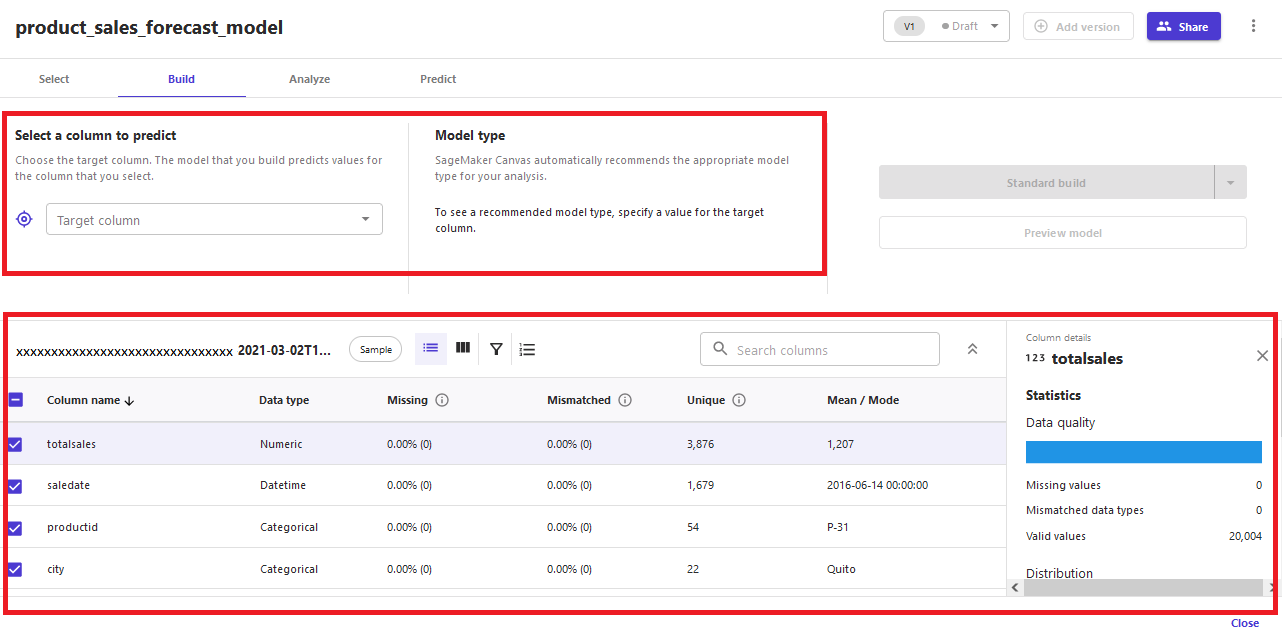

Datafilen är historisk data för daglig frekvens. Den har fyra kolumner (productid, saledate, cityoch totalsales). Vi använder Canvas för att bygga en ML-modell som används för att prognostisera totalsales för productid i en viss stad.

Det här inlägget har organiserats för att visa aktiviteterna och ansvaret för både dataingenjörer och affärsanalytiker för att generera produktförsäljningsprognoser.

Dataingenjör: Extrahera, transformera och ladda datauppsättningen från SAP till Amazon S3 med Amazon AppFlow

Den första uppgiften du utför som dataingenjör är att köra ett extrahera, transformera och ladda (ETL) jobb på historisk försäljningsdata från SAP ECC till en S3-bucket, som affärsanalytikern använder som källdatauppsättning för sin prognosmodell. För detta använder vi Amazon AppFlow, eftersom det ger en out-of-the-box SAP OData Connector för ETL (som visas i följande diagram), med ett enkelt användargränssnitt för att ställa in allt som behövs för att konfigurera anslutningen från SAP ECC till S3-skopan.

Förutsättningar

Följande är krav för att integrera Amazon AppFlow med SAP:

- SAP NetWeaver Stack version 7.40 SP02 eller högre

- Katalogtjänst (OData v2.0/v2.0) aktiverad i SAP Gateway för tjänstupptäckt

- Stöd för paginering och frågealternativ på klientsidan för SAP OData Service

- HTTPS-aktiverad anslutning till SAP

Autentisering

Amazon AppFlow stöder två autentiseringsmekanismer för att ansluta till SAP:

- Grundläggande – Autentiserar med SAP OData användarnamn och lösenord.

- OAuth 2.0 – Använder OAuth 2.0-konfiguration med en identitetsleverantör. OAuth 2.0 måste vara aktiverat för OData v2.0/v2.0-tjänster.

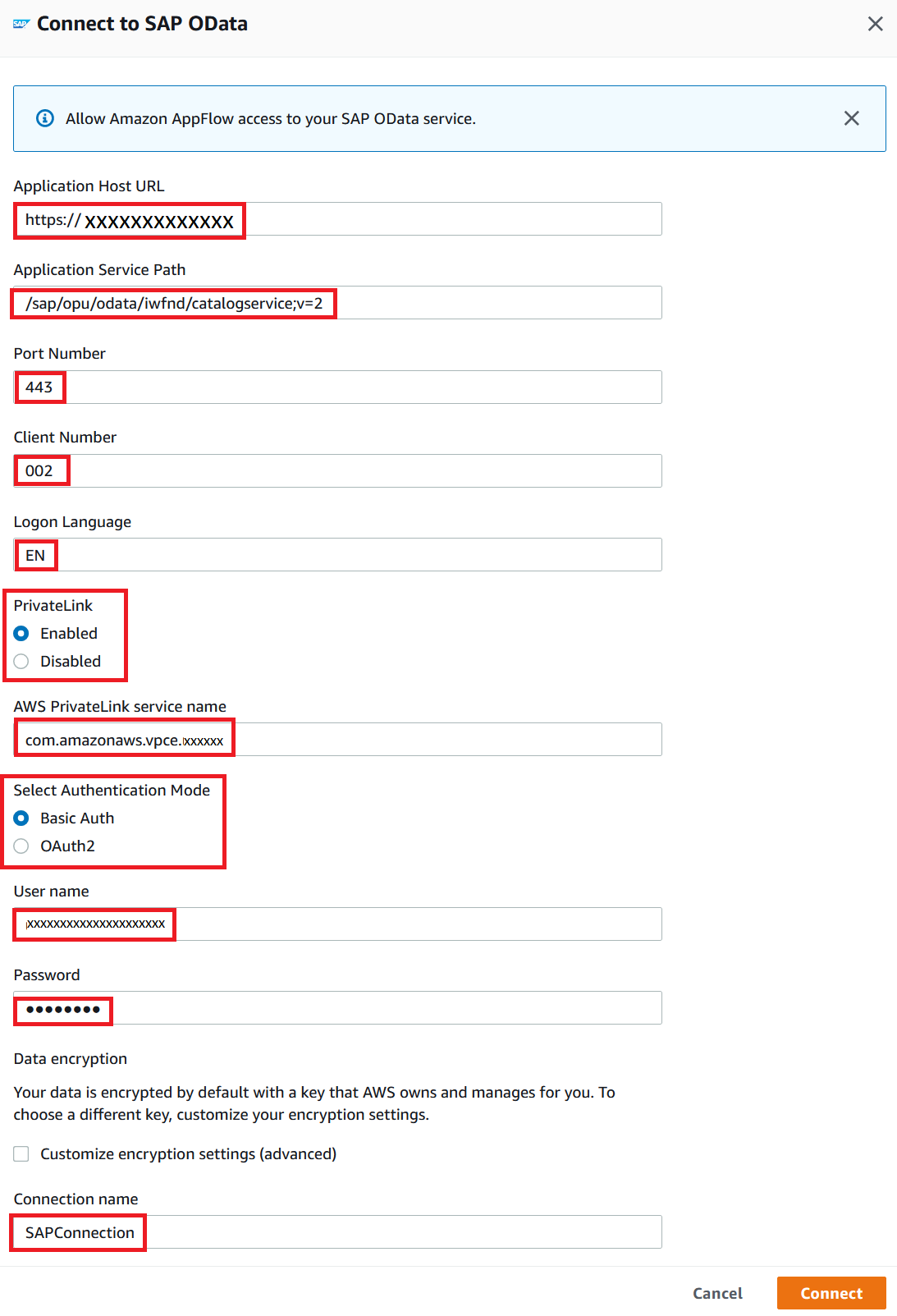

förbindelse

Amazon AppFlow kan ansluta till SAP ECC med ett offentligt SAP OData-gränssnitt eller en privat anslutning. En privat anslutning förbättrar datasekretess och säkerhet genom att överföra data via det privata AWS-nätverket istället för det offentliga internet. En privat anslutning använder VPC-slutpunktstjänsten för SAP OData-instansen som körs i en VPC. VPC-slutpunktstjänsten måste ha Amazon AppFlow-tjänstens principal appflow.amazonaws.com som en tillåten huvudman och måste vara tillgänglig i minst mer än 50 % av tillgänglighetszonerna i en AWS-region.

Ställ in ett flöde i Amazon AppFlow

Vi konfigurerar ett nytt flöde i Amazon AppFlow för att köra ett ETL-jobb på data från SAP till en S3-bucket. Detta flöde möjliggör konfiguration av SAP OData Connector som källa, S3-bucket som destination, OData-objektval, datamappning, datavalidering och datafiltrering.

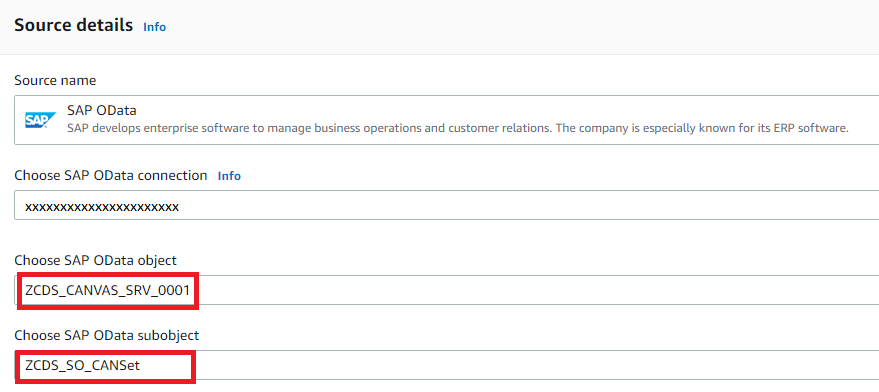

- Konfigurera SAP OData Connector som en datakälla genom att tillhandahålla följande information:

- När du har konfigurerat källan väljer du OData-objektet och underobjektet för försäljningsorder.

I allmänhet exporteras försäljningsdata från SAP med en viss frekvens, till exempel månadsvis eller kvartalsvis för full storlek. För det här inlägget väljer du alternativet underobjekt för export i full storlek.

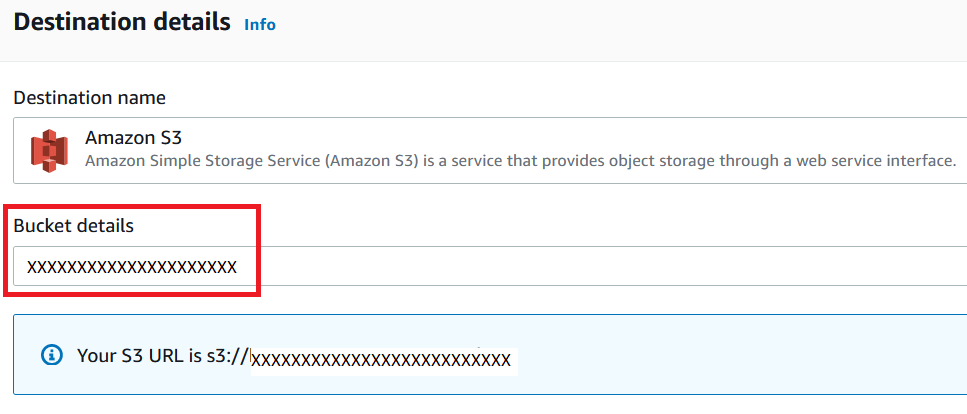

- Välj S3-skopan som destination.

Flödet exporterar data till denna bucket.

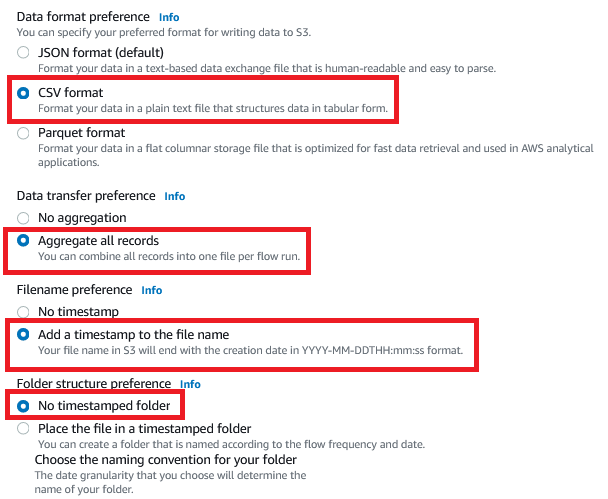

- För Preferens för dataformat, Välj CSV-format.

- För Preferens för dataöverföring, Välj Aggregera alla poster.

- För Filnamnsinställning, Välj Lägg till en tidsstämpel till filnamnet.

- För Mappstruktur preferens, Välj Ingen tidsstämplad mapp.

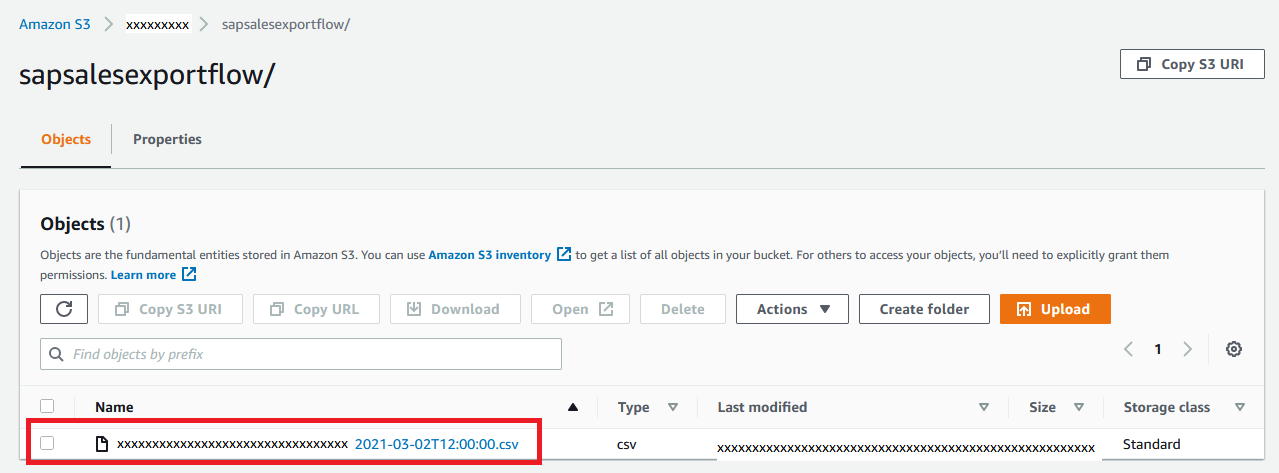

Konfigurationen för postaggregering exporterar försäljningsdata i full storlek från SAP kombinerade i en enda fil. Filnamnet slutar med en tidsstämpel i formatet ÅÅÅÅ-MM-DDTHH:mm:ss i en enda mapp (flödesnamn) i S3-hinken. Canvas importerar data från denna enda fil för modellträning och prognoser.

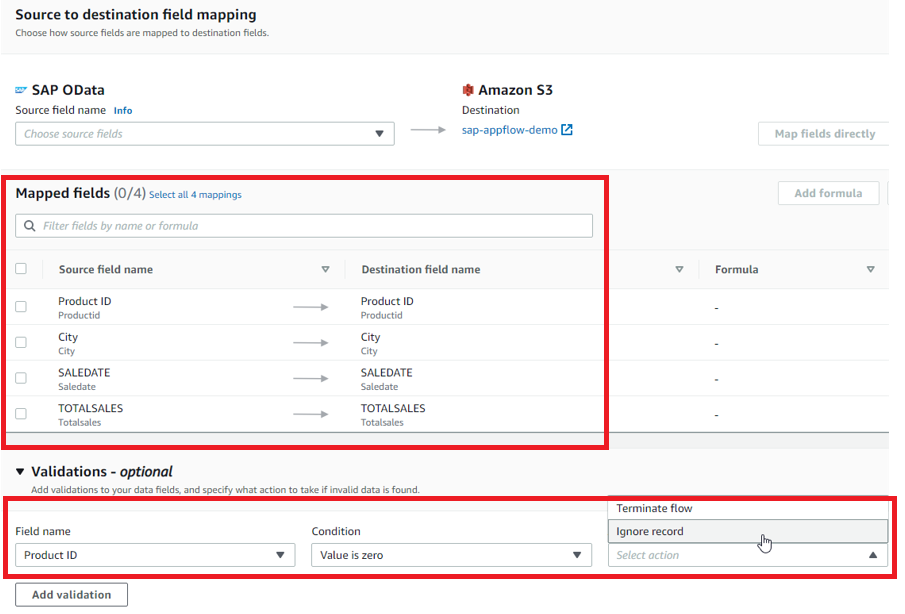

- Konfigurera datamappning och valideringar för att mappa källdatafälten till destinationsdatafält och aktivera regler för datavalidering efter behov.

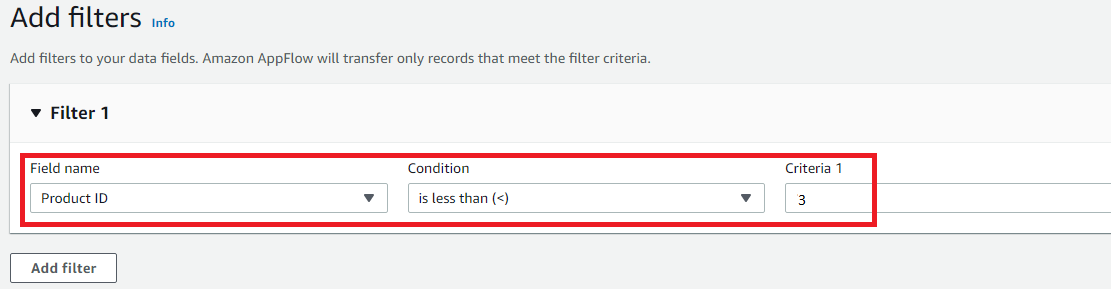

- Du konfigurerar också datafiltreringsvillkor för att filtrera bort specifika poster om dina krav kräver det.

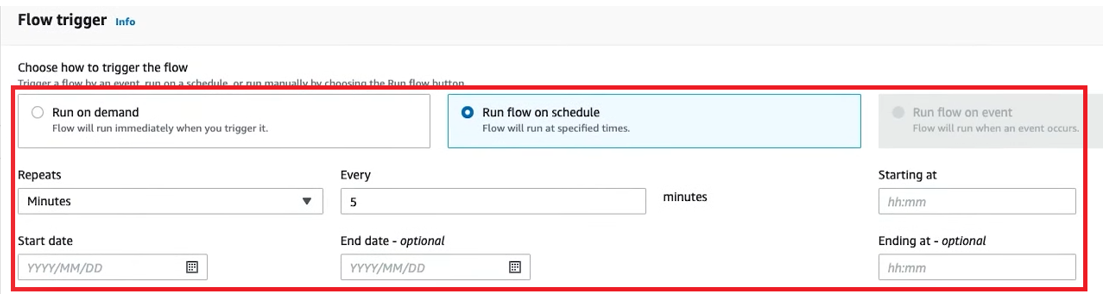

- Konfigurera din flödestrigger för att bestämma om flödet körs manuellt på begäran eller automatiskt baserat på ett schema.

När den är konfigurerad för ett schema baseras frekvensen på hur ofta prognosen behöver genereras (vanligtvis månadsvis, kvartalsvis eller halvårsvis).

Efter att flödet har konfigurerats kan affärsanalytikerna köra det på begäran eller baserat på schemat för att utföra ett ETL-jobb på försäljningsorderdata från SAP till en S3-bucket.

Efter att flödet har konfigurerats kan affärsanalytikerna köra det på begäran eller baserat på schemat för att utföra ett ETL-jobb på försäljningsorderdata från SAP till en S3-bucket. - Förutom Amazon AppFlow-konfigurationen måste dataingenjörerna också konfigurera en AWS identitets- och åtkomsthantering (IAM) roll för Canvas så att den kan komma åt andra AWS-tjänster. För instruktioner, se Ge dina användare behörighet att utföra tidsserieprognoser.

Affärsanalytiker: Använd historiska försäljningsdata för att träna en prognosmodell

Låt oss byta växel och gå över till affärsanalytikersidan. Som affärsanalytiker letar vi efter en visuell, peka-och-klicka-tjänst som gör det enkelt att bygga ML-modeller och generera korrekta förutsägelser utan att skriva en enda kodrad eller ha ML-expertis. Canvas passar kravet som no-code ML-lösning.

Se först till att din IAM-roll är konfigurerad på ett sådant sätt att Canvas kan komma åt andra AWS-tjänster. För mer information, se Ge dina användare behörighet att utföra tidsserieprognoser, eller så kan du be om hjälp till ditt Cloud Engineering-team.

När dataingenjören är klar med att konfigurera den Amazon AppFlow-baserade ETL-konfigurationen, är den historiska försäljningsdatan tillgänglig för dig i en S3-hink.

Du är nu redo att träna en modell med Canvas! Detta involverar vanligtvis fyra steg: importera data till tjänsten, konfigurera modellträningen genom att välja lämplig modelltyp, träna modellen och slutligen generera prognoser med hjälp av modellen.

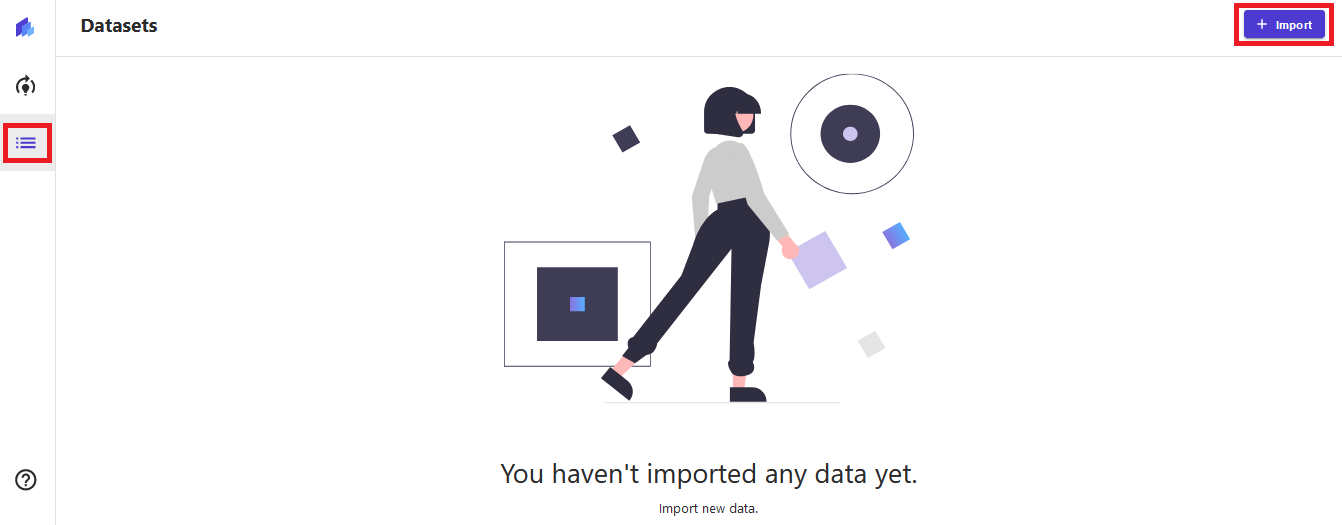

Importera data i Canvas

Starta först Canvas-appen från Amazon SageMaker konsolen eller från din enkel inloggningsåtkomst. Om du inte vet hur du gör det, kontakta din administratör så att de kan guida dig genom processen att ställa in Canvas. Se till att du kommer åt tjänsten i samma region som S3-bucketen som innehåller den historiska datamängden från SAP. Du bör se en skärm som följande.

Gör sedan följande steg:

- Välj i Canvas dataset i navigeringsfönstret.

- Välja Importera för att börja importera data från S3-hinken.

- På importskärmen väljer du datafilen eller objektet från S3-skopan för att importera träningsdata.

Du kan importera flera datamängder i Canvas. Det stöder också att skapa kopplingar mellan datamängderna genom att välja Gå med i data, vilket är särskilt användbart när träningsdata är spridda över flera filer.

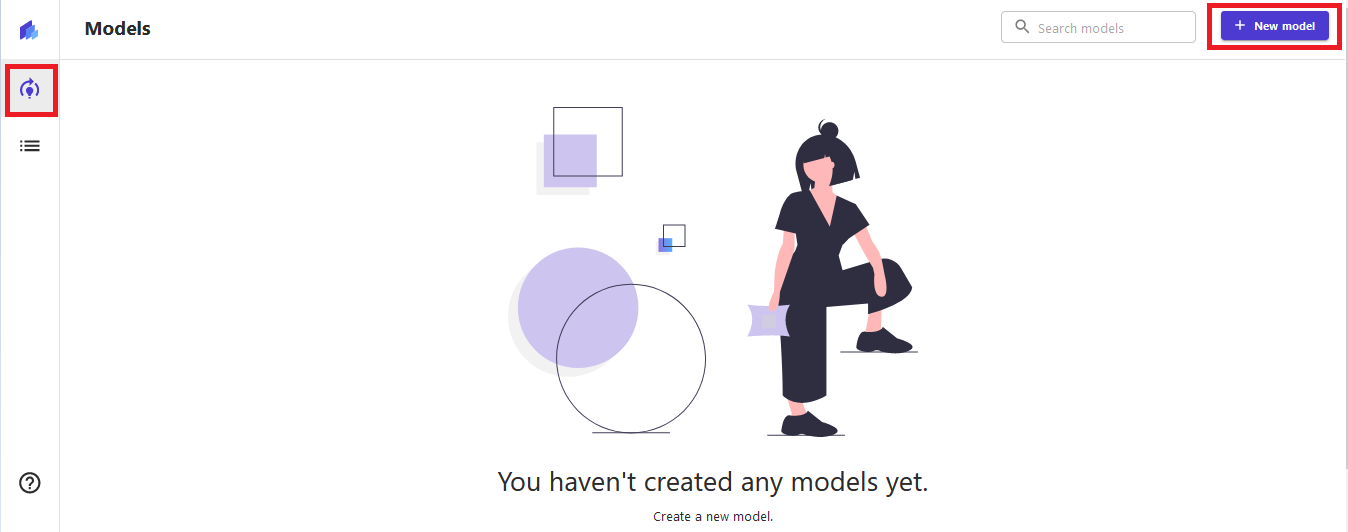

Konfigurera och träna modellen

När du har importerat data, slutför du följande steg:

- Välja Modeller i navigeringsfönstret.

- Välja Ny modell för att starta konfigurationen för att träna prognosmodellen.

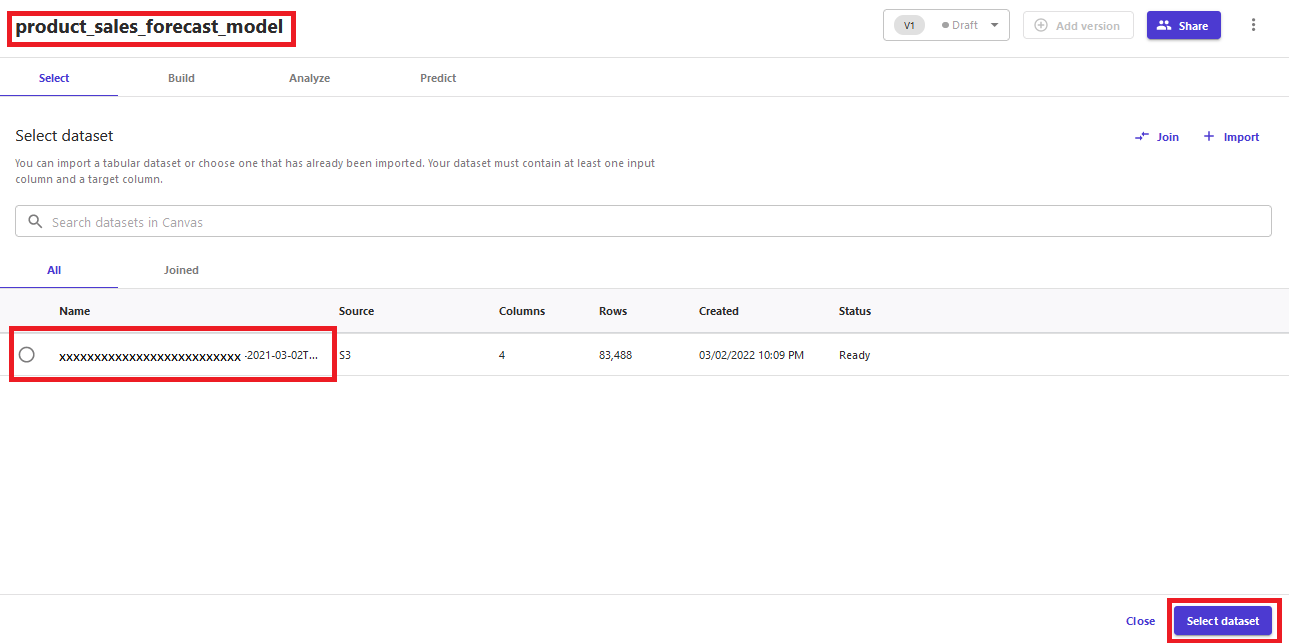

- För den nya modellen, ge den ett passande namn, som t.ex

product_sales_forecast_model. - Välj försäljningsdataset och välj Välj dataset.

När datasetet har valts kan du se datastatistik och konfigurera modellträningen på fliken Bygg.

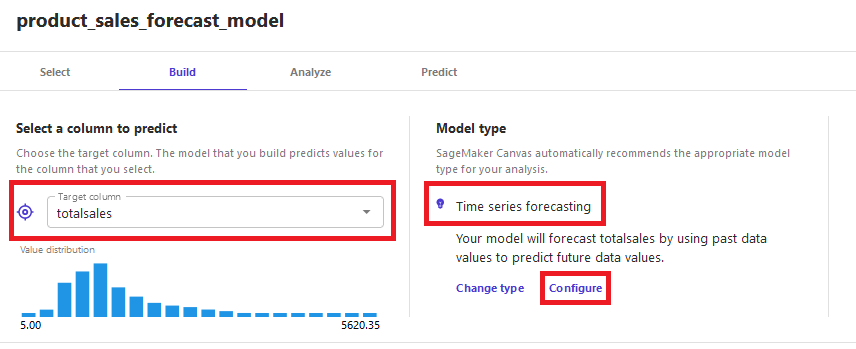

- Välja total rea som målkolumn för förutsägelsen.

Du kan se Tidsserieprognos väljs automatiskt som modelltyp. - Välja Inställd.

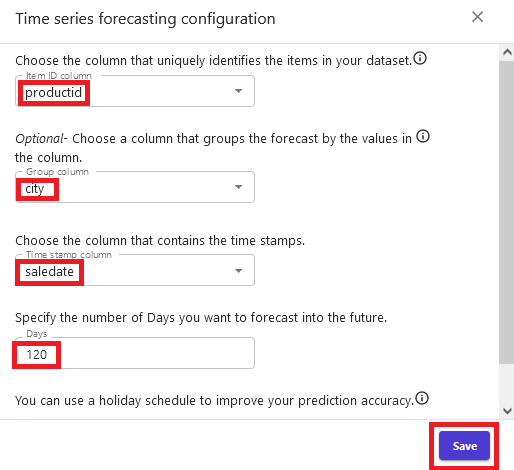

- I Tidsserieprognoskonfiguration avsnitt väljer Serienummer för Kolumnen Artikel-ID.

- Välja stad för Gruppkolumn.

- Välja försäljningsdatum för Tidsstämpel kolumn.

- För Dagar, stiga på

120. - Välja Save.

Detta konfigurerar modellen att göra prognoser förtotalsalesi 120 dagars användningsaledatebaserat på historiska data som man kan fråga efterproductidochcity.

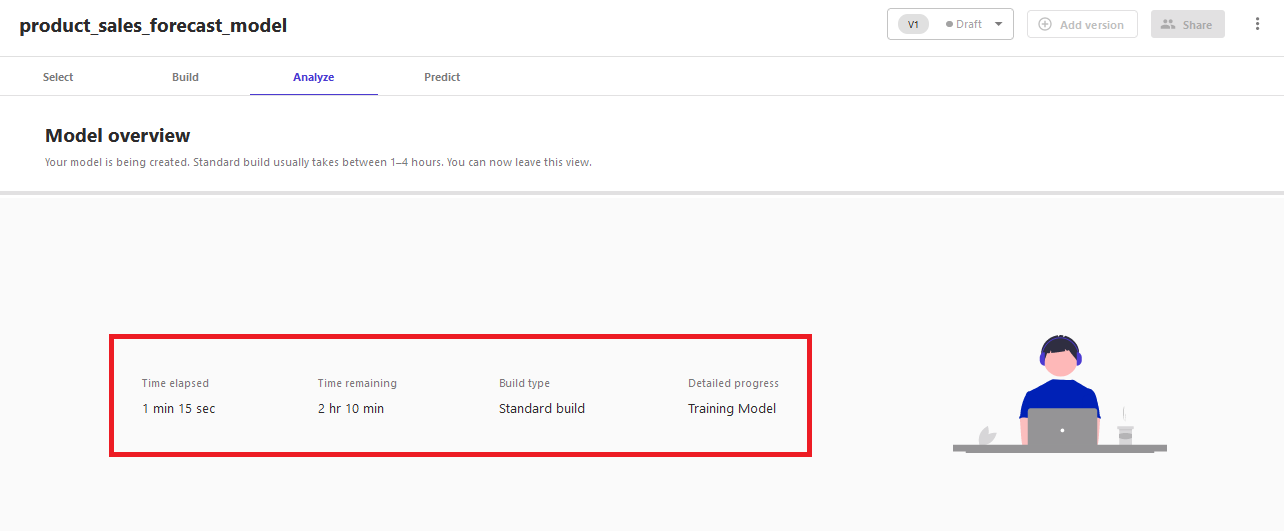

- När modellträningskonfigurationen är klar, välj Standardbyggnad för att starta modellutbildningen.

Smakämnen Förhandsgranska modell alternativet är inte tillgängligt för modelltyp för tidsserieprognos. Du kan granska den beräknade tiden för modellutbildningen på Analysera fliken.

Modellträning kan ta 1–4 timmar att slutföra, beroende på datastorleken. När modellen är klar kan du använda den för att generera prognosen.

Skapa en prognos

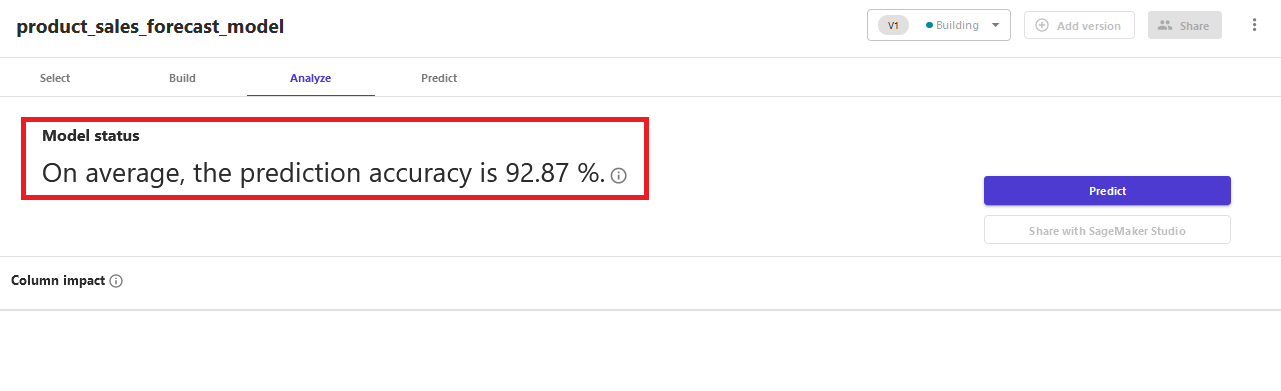

När modellutbildningen är klar visar den prediktionsnoggrannheten för modellen på Analysera flik. Till exempel, i det här exemplet visar den prediktionsnoggrannheten som 92.87 %.

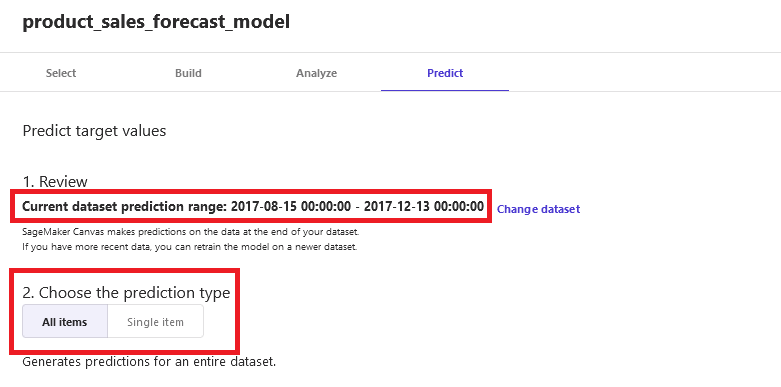

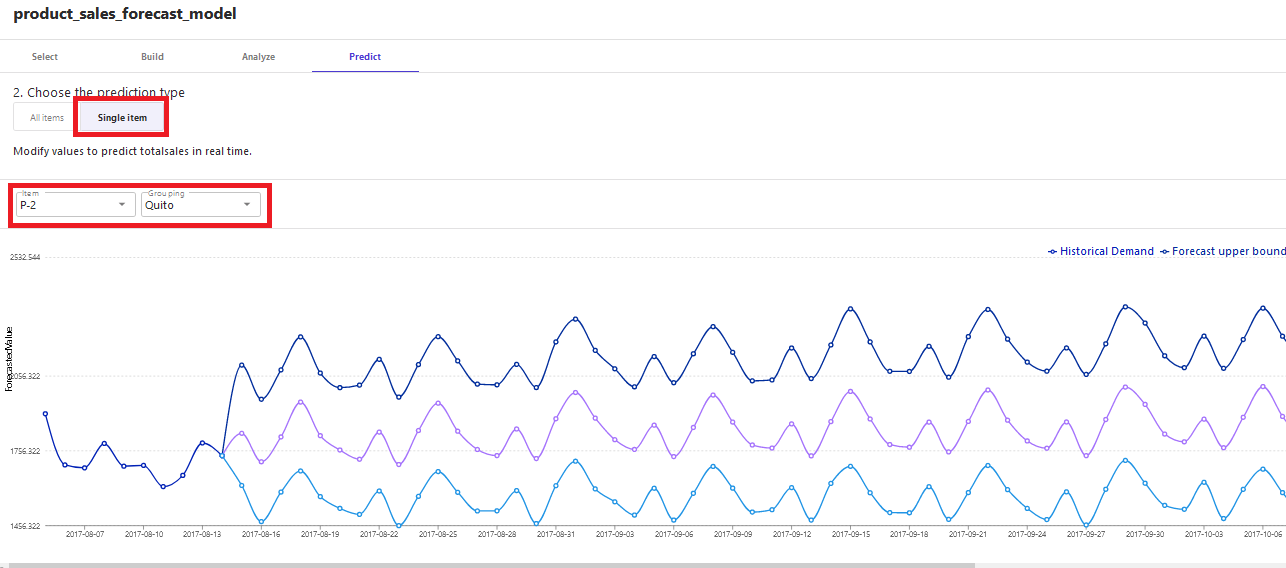

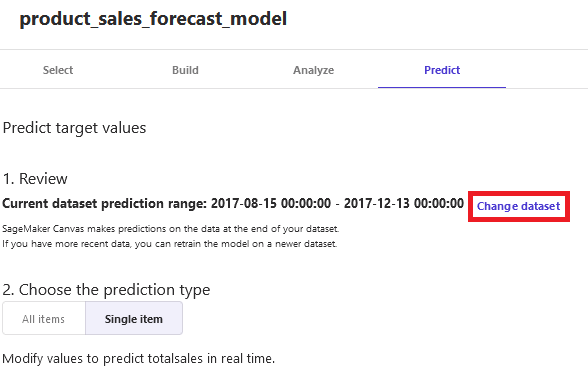

Prognosen genereras på förutsäga flik. Du kan generera prognoser för alla objekt eller en vald enstaka objekt. Den visar också datumintervallet för vilket prognosen kan genereras.

Som ett exempel, välj enstaka objekt alternativ. Välj P-2 för Artikel och Quito för Grupp för att generera en förutsägelse för produkt P-2 för staden Quito för datumintervallet 2017-08-15 00:00:00 till 2017-12-13 00:00:00.

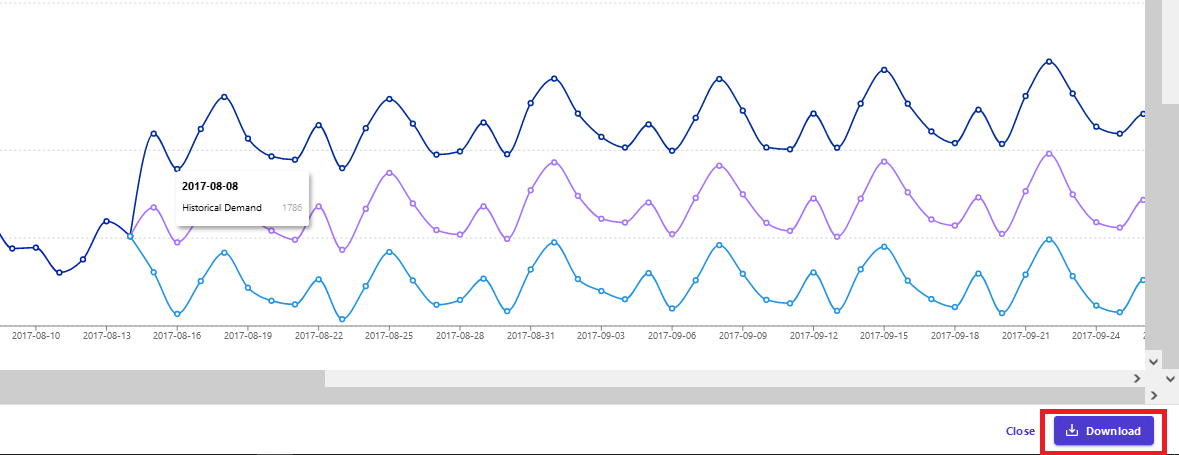

Den genererade prognosen visar den genomsnittliga prognosen samt den övre och nedre gränsen för prognosen. Prognosgränserna hjälper till att konfigurera ett aggressivt eller balanserat tillvägagångssätt för prognoshanteringen.

Du kan också ladda ner den genererade prognosen som en CSV-fil eller bild. Den genererade prognos-CSV-filen används vanligtvis för att arbeta offline med prognosdata.

Prognosen genereras nu för tidsseriedata. När en ny baslinje med data blir tillgänglig för prognosen kan du ändra datasetet i Canvas för att träna om prognosmodellen med den nya baslinjen.

Du kan träna om modellen flera gånger när och när träningsdata ändras.

Slutsats

I det här inlägget lärde du dig hur Amazon AppFlow SAP OData Connector exporterar försäljningsorderdata från SAP-systemet till en S3-hink och sedan hur du använder Canvas för att bygga en modell för prognoser.

Du kan använda Canvas för alla SAP-tidsseriedatascenarier, till exempel kostnads- eller intäktsprognoser. Hela prognosgenereringsprocessen är konfigurationsdriven. Säljchefer och representanter kan generera försäljningsprognoser upprepade gånger per månad eller kvartal med en uppdaterad uppsättning data på ett snabbt, enkelt och intuitivt sätt utan att skriva en enda rad kod. Detta hjälper till att förbättra produktiviteten och möjliggör snabb planering och beslut.

För att komma igång, läs mer om Canvas och Amazon AppFlow med hjälp av följande resurser:

- Amazon SageMaker Canvas Developer Guide

- Tillkännager Amazon SageMaker Canvas – en visuell maskininlärningsförmåga utan kod för affärsanalytiker

- Extrahera data från SAP ERP och BW med Amazon AppFlow

- SAP OData Connector-konfiguration

Om författarna

Brajendra Singh är lösningsarkitekt inom Amazon Web Services och arbetar med företagskunder. Han har en stark utvecklarbakgrund och är en ivrig entusiast för data- och maskininlärningslösningar.

Brajendra Singh är lösningsarkitekt inom Amazon Web Services och arbetar med företagskunder. Han har en stark utvecklarbakgrund och är en ivrig entusiast för data- och maskininlärningslösningar.

Davide Gallitelli är en specialistlösningsarkitekt för AI/ML i EMEA-regionen. Han är baserad i Bryssel och har ett nära samarbete med kunder i hela Benelux. Han har varit utvecklare sedan han var väldigt ung, började koda vid 7 års ålder. Han började lära sig AI/ML på universitetet och har blivit kär i det sedan dess.

Davide Gallitelli är en specialistlösningsarkitekt för AI/ML i EMEA-regionen. Han är baserad i Bryssel och har ett nära samarbete med kunder i hela Benelux. Han har varit utvecklare sedan han var väldigt ung, började koda vid 7 års ålder. Han började lära sig AI/ML på universitetet och har blivit kär i det sedan dess.

- Myntsmart. Europas bästa bitcoin- och kryptobörs.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. FRI TILLGÅNG.

- CryptoHawk. Altcoin radar. Gratis provperiod.

- Källa: https://aws.amazon.com/blogs/machine-learning/extract-insights-from-sap-erp-with-no-code-ml-solutions-with-amazon-appflow-and-amazon-sagemaker- duk/

- '

- "

- 000

- 100

- 7

- a

- Om oss

- accelerera

- tillgång

- exakt

- Uppnå

- tvärs

- aktiviteter

- Dessutom

- påverka

- Alla

- tillåter

- alltid

- amason

- Amazon Web Services

- analytiker

- analytics

- app

- tillvägagångssätt

- lämpligt

- runt

- verifierar

- Autentisering

- automatiskt

- tillgänglighet

- tillgänglig

- genomsnitt

- AWS

- bakgrund

- Baslinje

- därför att

- mellan

- gränsen

- föra

- bryssel

- SLUTRESULTAT

- företag

- canvas

- centrala

- vissa

- byta

- Välja

- Stad

- cloud

- koda

- samverkan

- Kolumn

- kombinerad

- Gemensam

- fullborda

- komponent

- villkor

- konfiguration

- Kontakta

- anslutning

- Konsol

- Konsumenten

- kontakta

- skapa

- skapas

- Skapa

- Kunder

- dagligen

- datum

- dataintegritet

- Datas integritet och säkerhet

- datavetenskap

- beslut

- leverans

- Efterfrågan

- krav

- beroende

- destination

- Utvecklare

- direkt

- fördelning

- domän

- ner

- ladda ner

- driven

- lätt

- effektivitet

- ge

- möjliggöra

- möjliggör

- Slutpunkt

- slutar

- ingenjör

- Teknik

- Ingenjörer

- ange

- Företag

- beräknad

- allt

- exempel

- expertis

- SNABB

- Fält

- filtrering

- Slutligen

- Förnamn

- flöda

- efter

- följer

- format

- från

- full

- framtida

- nätbryggan

- allmänhet

- generera

- generera

- generering

- Generatorn

- varor

- Grupp

- styra

- Arbetsmiljö

- har

- höjd

- hjälpa

- hjälper

- historisk

- Hur ser din drömresa ut

- How To

- Men

- HTTPS

- Identitet

- bild

- Inverkan

- importera

- förbättra

- industrier

- informationen

- informeras

- insikter

- exempel

- integrera

- Gränssnitt

- Internet

- intuitiv

- IT

- Jobb

- delta

- Fogar

- Nyckel

- Vet

- kunskap

- etikett

- lansera

- LÄRA SIG

- lärt

- inlärning

- nivåer

- linje

- LINK

- läsa in

- logistik

- du letar

- älskar

- Maskinen

- maskininlärning

- göra

- GÖR

- hantera

- chefer

- manuellt

- Produktion

- karta

- kartläggning

- Materialet

- kanske

- ML

- modell

- modeller

- Månad

- månad

- mer

- flytta

- multipel

- Navigering

- behov

- nät

- offline

- Verksamhet

- Alternativet

- Tillbehör

- beställa

- ordrar

- organisationer

- Organiserad

- Övriga

- paradigmet

- särskilt

- särskilt

- Lösenord

- planering

- förutsägelse

- Förutsägelser

- Förhandsvisning

- primär

- Principal

- privatpolicy

- Integritet och säkerhet

- privat

- process

- processer

- Produkt

- Produktion

- produktivitet

- Programmering

- leverantör

- ger

- tillhandahålla

- allmän

- publicera

- syfte

- Kvartal

- Snabbt

- område

- Raw

- post

- register

- region

- representativ

- Obligatorisk

- Krav

- Resurser

- ansvar

- ansvarig

- detaljhandeln

- intäkter

- översyn

- Roll

- regler

- Körning

- rinnande

- Till Salu

- försäljning

- Samma

- SAP

- Vetenskap

- poäng

- screen

- säkerhet

- vald

- Val

- Serier

- service

- Tjänster

- in

- inställning

- visas

- Enkelt

- eftersom

- enda

- Storlek

- färdigheter

- So

- fast

- lösning

- Lösningar

- specialist

- specifik

- spridning

- stapel

- starta

- igång

- statistik

- förvaring

- lagrar

- stark

- stödja

- Stöder

- Växla

- system

- System

- Målet

- uppgifter

- grupp

- Testning

- Smakämnen

- källan

- Genom

- hela

- tid

- gånger

- verktyg

- Utbildning

- transaktion

- överföring

- Överföra

- Förvandla

- Trender

- typiskt

- ui

- förståelse

- universitet

- us

- användning

- användare

- godkännande

- version

- utsikt

- sätt

- webb

- webbservice

- väldefinierad

- om

- inom

- utan

- Arbete

- arbetssätt

- fungerar

- skrivning

- ung

- Din