Idag är vi glada att kunna meddela att Gemma modell är nu tillgänglig för kunder som använder Amazon SageMaker JumpStart. Gemma är en familj av språkmodeller baserat på Googles Gemini-modeller, tränade på upp till 6 biljoner tokens text. Gemma-familjen består av två storlekar: en 7 miljarder parametermodell och en 2 miljarder parametermodell. Nu kan du använda Gemma 2B och Gemma 7B förtränade och instruktionsjusterade modeller inom SageMaker JumpStart. JumpStart är maskininlärningsnavet (ML) i SageMaker som ger tillgång till grundmodeller utöver inbyggda algoritmer och helhetslösningsmallar för att hjälpa dig att snabbt komma igång med ML.

I det här inlägget går vi igenom hur du distribuerar Gemma-modellen och finjusterar den för dina användningsfall i SageMaker JumpStart. Hela anteckningsboken finns tillgänglig på GitHub.

Gemma modell

Gemma är en familj av lätta, toppmoderna modeller byggd från samma forskning och teknik som användes för att skapa tvillingarna modeller. Gemma har utvecklats av Google DeepMind och andra team på Google och är inspirerad av Gemini. Gemma uppvisar starka generalistiska förmågor inom textdomäner och state-of-the-art förståelse och resonemang i stor skala. Den uppnår bättre prestanda jämfört med andra allmänt tillgängliga modeller av liknande eller större skalor över olika domäner, inklusive svar på frågor, sunt förnuft, matematik och vetenskap och kodning. Gemma släppte modellvikterna för att stödja utvecklarinnovation med hjälp av Gemma-modeller. Gemma lanserades med en ny Ansvarig Generativ AI Toolkit som ger vägledning och viktiga verktyg för att skapa säkrare AI-applikationer med Gemma.

Grundmodeller i SageMaker

JumpStart ger tillgång till en rad modeller från populära modellhubbar inklusive Hugging Face, PyTorch Hub och TensorFlow Hub, som du kan använda i ditt ML-utvecklingsarbetsflöde i SageMaker. De senaste framstegen inom ML har gett upphov till en ny klass av modeller som kallas grundmodeller, som vanligtvis tränas på miljarder parametrar och kan anpassas till en bred kategori av användningsfall, såsom textsammanfattning, generering av digital konst och språköversättning. Eftersom dessa modeller är dyra att träna vill kunderna använda befintliga förutbildade grundmodeller och finjustera dem efter behov, snarare än att träna dessa modeller själva. SageMaker tillhandahåller en utvald lista över modeller som du kan välja mellan på SageMaker-konsolen.

Du kan nu hitta grundmodeller från olika modellleverantörer inom JumpStart, vilket gör att du snabbt kan komma igång med grundmodeller. Du kan hitta grundmodeller baserade på olika uppgifter eller modellleverantörer och granska modellens egenskaper och användningsvillkor. Du kan också prova dessa modeller med en test-UI-widget. När du vill använda en grundmodell i stor skala kan du göra det utan att lämna SageMaker genom att använda förbyggda bärbara datorer från modellleverantörer. Eftersom modellerna är värd och distribueras på AWS, delas din data, oavsett om den används för att utvärdera modellen eller använder den i stor skala, aldrig med tredje part.

Låt oss utforska hur du kan använda Llama Guard-modellen i JumpStart.

Utforska Gemma-modellen i Jumpstart

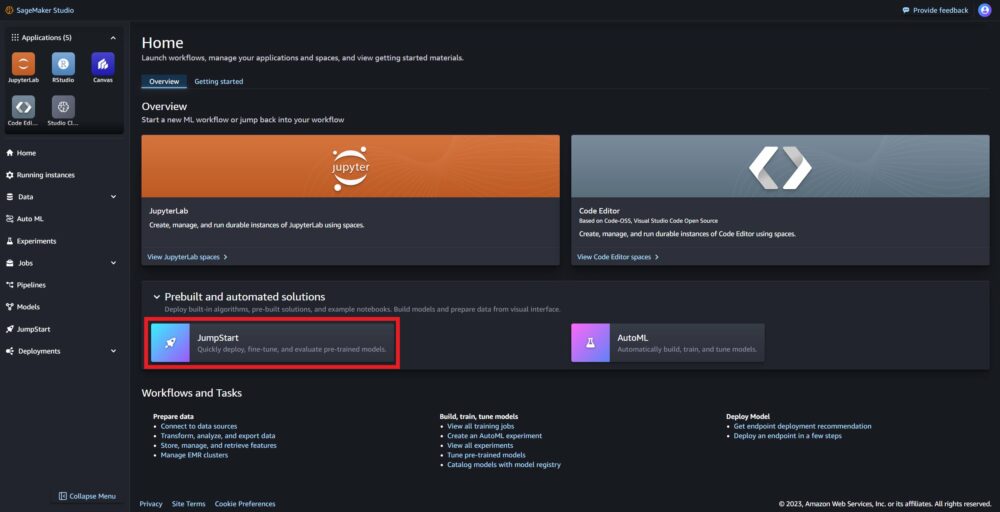

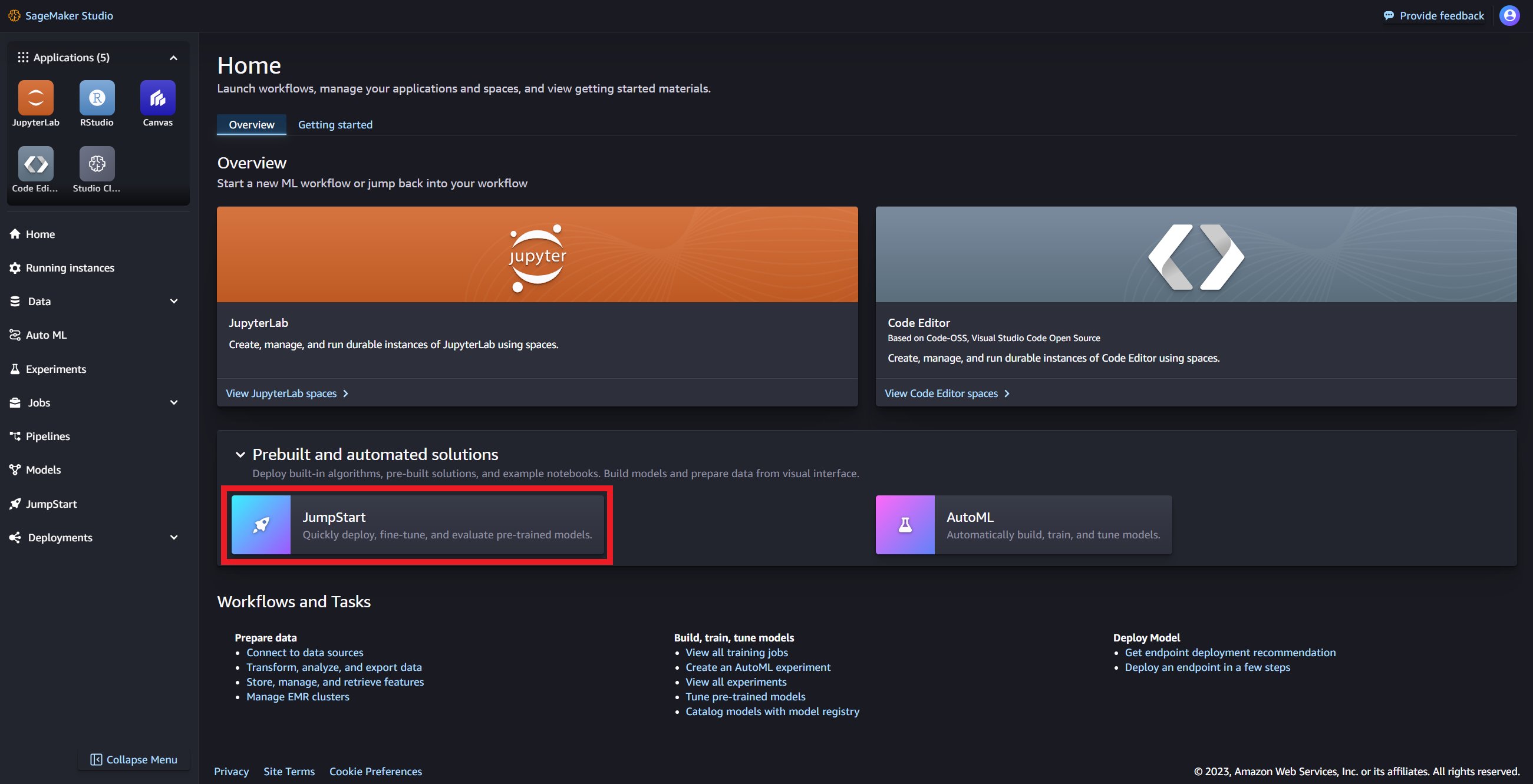

Du kan komma åt Gemmas grundmodeller genom SageMaker JumpStart i SageMaker Studio UI och SageMaker Python SDK. I det här avsnittet går vi igenom hur du upptäcker modellerna i SageMaker Studio.

SageMaker Studio är en integrerad utvecklingsmiljö (IDE) som tillhandahåller ett enda webbaserat visuellt gränssnitt där du kan komma åt specialbyggda verktyg för att utföra alla ML-utvecklingssteg, från att förbereda data till att bygga, träna och distribuera dina ML-modeller. För mer information om hur du kommer igång och konfigurerar SageMaker Studio, se Amazon SageMaker Studio.

I AWS Management Console för SageMaker Studio, gå till SageMaker JumpStart under Förbyggda och automatiserade lösningar. Jumpstart innehåller förutbildade modeller, bärbara datorer och förbyggda lösningar.

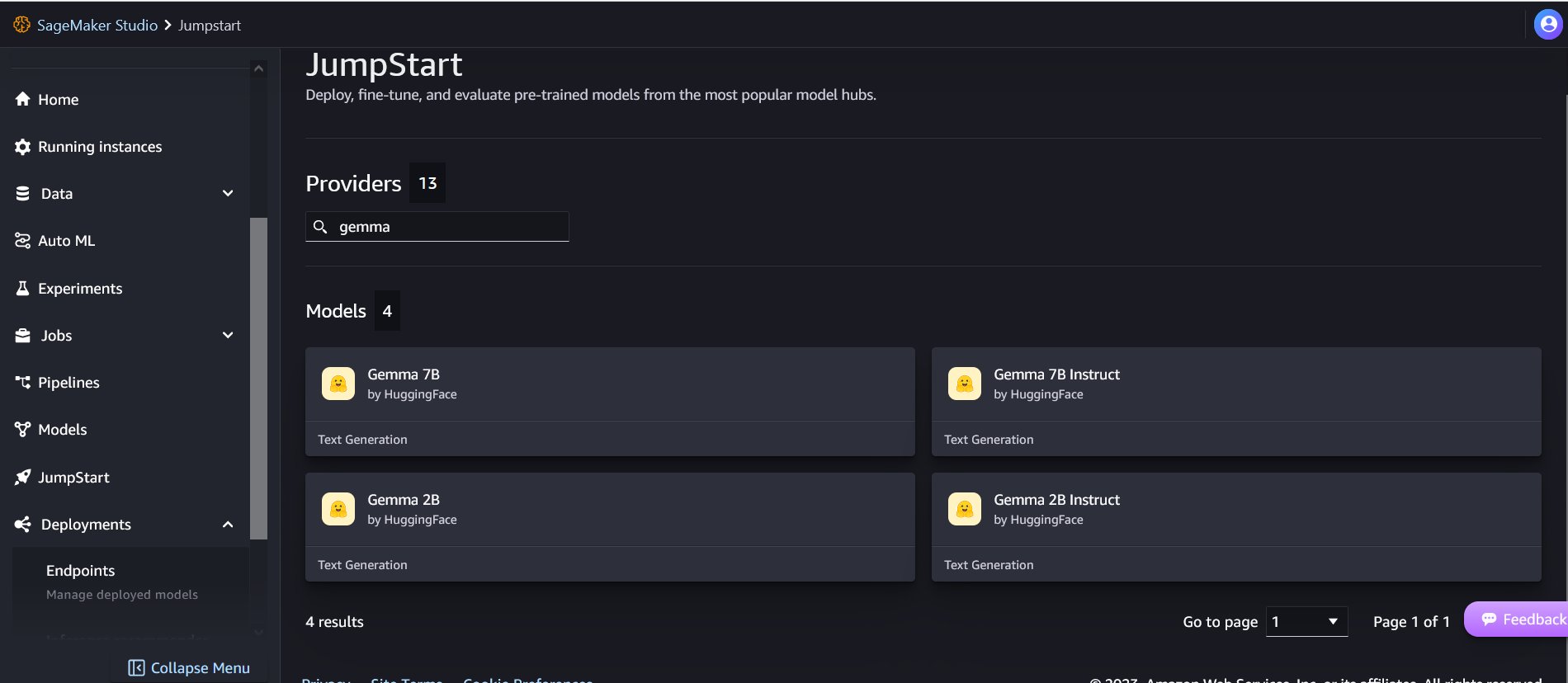

På SageMaker JumpStarts målsida kan du hitta Gemma-modellen genom att söka efter Gemma.

Du kan sedan välja från en mängd olika Gemma-modellvarianter, inklusive Gemma 2B, Gemma 7B, Gemma 2B instruct och Gemma 7B instruct.

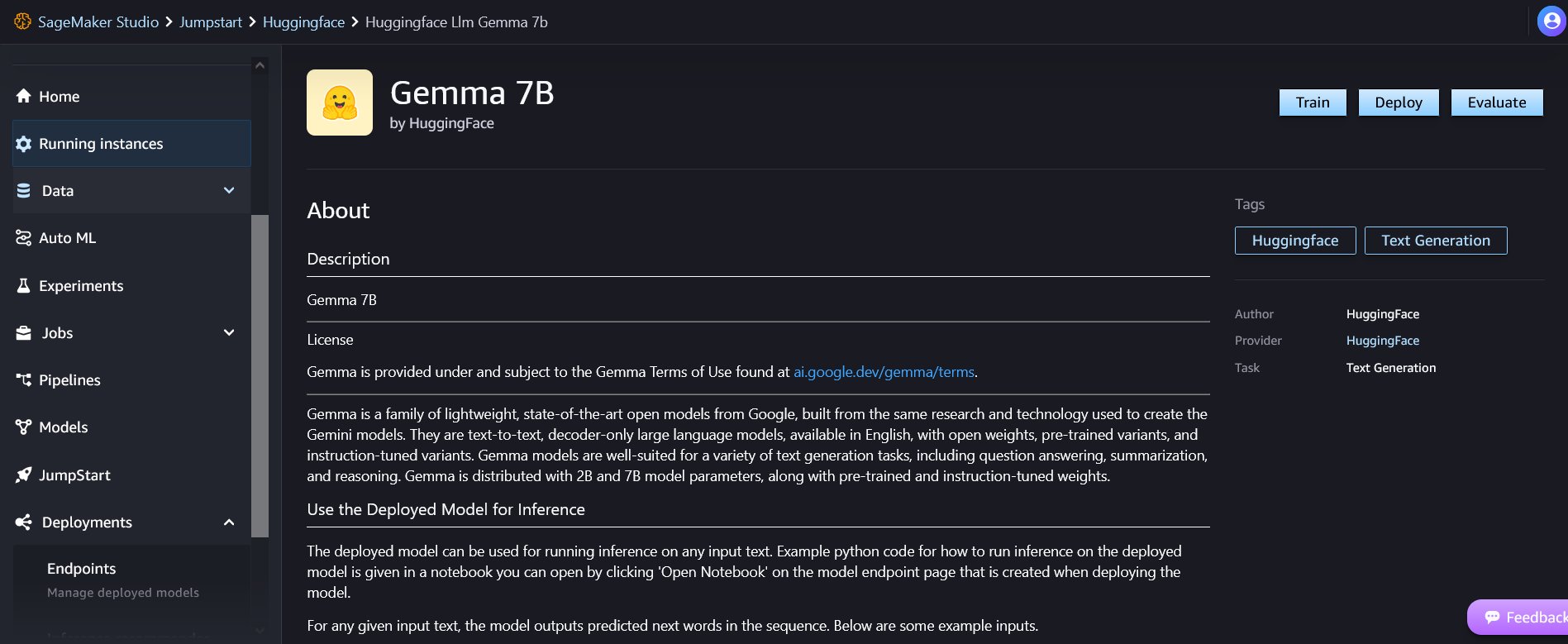

Välj modellkortet för att se detaljer om modellen såsom licensen, data som används för att träna och hur du använder modellen. Du hittar också en Distribuera knappen, som tar dig till en målsida där du kan testa slutledning med ett exempel på nyttolast.

Distribuera Gemma med SageMaker Python SDK

Du kan hitta koden som visar implementeringen av Gemma på JumpStart och ett exempel på hur man använder den utplacerade modellen i denna GitHub-anteckningsbok.

Börja med att välja SageMaker Model Hub-modell-ID och modellversion som ska användas när Gemma distribueras.

Välj ett modell-ID från följande tabell, som beskriver standardkonfigurationsalternativen för JumpStart-distributionen. På grund av den stora vokabulärstorleken på 256 tusen tokens, kan Gemma 7B bara passa på en enda A10G GPU när den stöder en 1-kontextlängd. Av denna anledning använder JumpStart en större standardinstans för Gemma 7B.

| Modell-ID | Standardinferensinstans | Tensor parallell grad | Kontextlängd som stöds |

| huggingface-llm-gemma-2b | ml.g5.xlarge | 1 | 8k |

| huggingface-llm-gemma-2b-instruktion | ml.g5.xlarge | 1 | 8k |

| huggingface-llm-gemma-7b | ml.g5.12xlarge | 4 | 8k |

| huggingface-llm-gemma-7b-instruktion | ml.g5.12xlarge | 4 | 8k |

Du kan nu distribuera modellen med SageMaker JumpStart. Följande kod använder standardinstansen ml.g5.12xlarge för slutpunktens slutpunkt Du kan distribuera modellen på andra instanstyper genom att passera instance_type i JumpStartModel klass. Implementeringen kan ta 5-10 minuter.

För framgångsrik distribution måste du ändra manuellt accept_eula argument i modellens distributionsmetod för att True. Denna modell distribueras med hjälp av text-generation-inference (TGI) djupinlärningsbehållare.

Anropa slutpunkt

Du kan programmatiskt hämta exempelnyttolaster från JumpStartModel objekt. Detta hjälper dig att komma igång genom att observera förformaterade instruktionsmeddelanden som Gemma kan äta.

Innan vi tittar på specifika uppmaningar, låt oss överväga chattmallen för Gemma Instruct-modeller.

Här placerar du din prompt i [USER_PROMPT] plats. Det finns inget stöd för en systeminstruktion; istället kan du lägga till den önskade instruktionen till användarprompten. Dessutom, om du har en konversation med flera svängar, kan modelluppmaningen växla mellan användare och assistent efter behov.

Tänk nu på några instruktionsexempel. Här ber du Gemma att skriva ett Hello World-program.

Följande är den förväntade produktionen:

Därefter åkallar du Gemma för den kreativa uppgiften att skriva en dikt.

Följande är utgången:

Det här ser ganska bra ut!

Låt oss nu titta på benchmarking för latens- och genomströmningsprestanda för modellbetjäning med den förinställda JumpStart-distributionskonfigurationen. Här visar vi hur modellprestanda kan skilja sig åt för din typiska slutpunktsarbetsbelastning. I följande tabeller kan du observera att små frågor (256 ingångsord och 256 utdatatoken) är ganska presterande under ett stort antal samtidiga användare, och når tokengenomströmning i storleksordningen tusen till två tusen tokens per sekund. Men när antalet inmatningsord närmar sig Gemmas maximala stödda kontextlängd på åtta tusen tokens, mättar slutpunkten sin batchkapacitet – antalet samtidiga förfrågningar som tillåts behandlas samtidigt – på grund av minnesbundna begränsningar för instanser.

För mer information om hur du överväger denna information och justerar distributionskonfigurationer för ditt specifika användningsfall, se Benchmark och optimera slutpunktsdistribution i Amazon SageMaker JumpStart.

| . | Genomströmning (tokens/s) | ||||||||||

| Samtidiga användare | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modell | Instans typ | Mata in ord | Utdatapolletter | . | . | . | . | . | . | . | . |

| gemma-2b-instruktion | ml.g5.xlarge | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | - | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | - | - | ||

| gemma-7b-instruktion | ml.g5.12xlarge | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | - | - | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | - | - | - | ||

| . | P50 latens (ms/token) | ||||||||||

| Samtidiga användare | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modell | Instans typ | Mata in ord | Utdatapolletter | . | . | . | . | . | . | . | . |

| gemma-2b-instruktion | ml.g5.xlarge | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | - | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | - | - | ||

| Gemma-7b-instruktion | ml.g5.12xlarge | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | - | - | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | - | - | - | ||

Finjustera Gemma med SageMaker Python SDK

Därefter visar vi dig hur du finjusterar Gemma 7B-instruktionsmodellen på en konversationsformaterad datauppsättning med hjälp av QLoRA Metod. Som nämnts tidigare, på grund av den stora vokabulärstorleken på 256 tusen och 8 tusen kontextlängden, erbjuder JumpStart följande standardkonfigurationer för QLoRA-finjustering.

| Modell-ID | Standard träningsinstans | Maximal ingångssekvenslängd | Per enhet utbildning batchstorlek | Gradientackumuleringssteg |

| huggingface-llm-gemma-2b | ml.g5.2xlarge | 1024 | 1 | 4 |

| huggingface-llm-gemma-2b-instruktion | ml.g5.2xlarge | 1024 | 1 | 4 |

| huggingface-llm-gemma-7b | ml.g5.12xlarge | 2048 | 1 | 4 |

| huggingface-llm-gemma-7b-instruktion | ml.g5.12xlarge | 2048 | 1 | 4 |

Låt oss ladda och bearbeta datamängden i konversationsformat. Exempeldatauppsättningen för denna demonstration är OpenAssistants TOP-1 konversationstrådar.

Träningsdata bör formuleras i JSON-rader (.jsonl) format, där varje rad är en ordbok som representerar en uppsättning konversationer. Ett exempel i JSON-linjefilen visas nedan. För detaljer om hur man bearbetar datasetet, se anteckningsboken i GitHub.

Under träningsskripten använder JumpStart HuggingFace SFTränare med QLoRA och FlashAttention. Flash Attention möjliggör skalningseffektivitet, vilket leder till snabbare träning och slutledning. Förutom chattbaserad finjustering, stöder JumpStart även finjustering av instruktion och domänanpassning med QLoRA. För detaljer, se anteckningsboken i GitHub.

Efter finjusteringen kan du distribuera den finjusterade modellen till en SageMaker-slutpunkt.

Du kan välja att distribuera modellen finjusterad på konversationsdata i SageMaker endpoint med HuggingFace messages API-funktion som ett alternativt tillvägagångssätt. Fördelen med att använda Message API-funktionen är att den tillåter användare att skicka frågeexemplen i råformat som visas i följande tabell och chat_template inom slutpunkten kommer att konvertera frågeexemplen till rätt format innan de skickas till modellen. För detaljer, se distributionsavsnittet efter finjustering i anteckningsbok.

Efter att ha distribuerat den finjusterade modellen i en slutpunkt kan du jämföra utdatasvar från förtränade och finjusterade Gemma-modeller. Exemplen är insamlade från testdata, som är en uppsättning från träningsdata. Inferensparametrarna är max_tokens som 512 XNUMX, top_p som 0.9 XNUMX, temperature som 0.4, och top_k som 50.

Som du kan se med finjusteringsresultaten är agentens svar mer exakta.

För att ytterligare utvärdera dina finjusterade modeller kan du utforska FM-utvärdering med Amazon SageMaker Clarify för att se hur din finjusterade modell presterar i jämförelse med basmodellen.

| ingångar | Grundsanning | Svar från bas modell | Svar från finjusterad modell | |

| 1 |

Användare: Jag vill arbeta med mitt ordförråd, kan du ge mig några enkla sätt som jag kan hitta nya ord att använda för att öka mångfalden i mina meningar? Assistent: Visst! Att förbättra ditt ordförråd är en pågående process, men här är några enkla sätt att hitta nya ord och öka mångfalden av dina meningar: 1. Läs mycket: Att läsa böcker, artiklar och bloggar från olika genrer och ämnen utsätter dig för nya ord och fraser. Notera alla okända ord du stöter på och slå upp deras betydelser. 2. Använd en synonymordbok: När du skriver eller läser, använd en synonymordbok för att hitta synonymer för vanliga ord. Detta hjälper dig inte bara att lära dig nya ord utan förbättrar också din förståelse för deras subtila betydelseskillnader. 3. Ord-om-dagen-kalendrar eller appar: Prenumerera på ett ord-om-dagen-e-postmeddelande eller ladda ner en app för att bygga ordförråd. Dessa verktyg introducerar dig till ett nytt ord varje dag, tillsammans med dess betydelse, uttal och användningsexempel. 4. Gå med i en bokklubb eller diskussionsgrupp: Att delta i samtal och diskussioner om böcker, artiklar eller något annat ämne exponerar dig för olika perspektiv och nya ordförråd. Lyssna uppmärksamt på andra och försök använda nya ord i sitt sammanhang. 5. Spela ordspel: Spel som Scrabble, Boggle och korsord utmanar dina ordförråd och hjälper dig att lära dig nya ord på ett roligt sätt. 6. Titta på filmer, TV-program eller dokumentärer: Visuella medier använder ofta olika språk, slang och jargong. Att titta på filmer, tv-program eller dokumentärer med undertexter kan hjälpa dig att bättre förstå och komma ihåg nya ord. 7. Öva på att skriva: Att regelbundet skriva berättelser, uppsatser eller journalanteckningar uppmuntrar dig att använda nya ord och fraser. Experimentera med olika skrivstilar och genrer för att utöka ditt ordförråd. 8. Lär dig ett nytt ords etymologi: Att förstå ett ords ursprung och historia kan göra det lättare att komma ihåg och använda korrekt. Att undersöka etymologin utsätter dig också för relaterade ord och begrepp. 9. Använd flashcards eller program för upprepning med mellanrum: Skapa flashkort med nya ord, deras betydelser och exempelmeningar. Granska dem regelbundet eller använd program för upprepning med avstånd från varandra som Anki för att optimera din inlärning. 10. Sätt personliga mål: Sätt upp nåbara mål, som att lära dig fem nya ord per vecka. Håll koll på dina framsteg och belöna dig själv för att du når dina mål. Genom att konsekvent införliva dessa strategier i din dagliga rutin kommer du gradvis att bygga upp ett mångsidigt och robust ordförråd. Användare: Hm, jag gillar verkligen tanken på att läsa. Kan du rekommendera mig en cool science-fiction-thriller som jag kan läsa? |

Assistent: Visst! Här är några rekommendationer för science-fiction-thriller som du kan njuta av: 1. "The Three-Body Problem" av Liu Cixin – Denna prisbelönta roman utforskar den första kontakten mellan mänskligheten och en främmande civilisation, och de politiska och personliga konsekvenserna som blir följden. Det är en gripande och tankeväckande läsning som fördjupar sig i djupa frågor om tillvarons och universums natur. 2. "Annihilation" av Jeff Vandermeer - Den här romanen följer en grupp forskare när de ger sig in i ett mystiskt område känt som "Area X", där de möter konstiga och oroande fenomen. När de gräver djupare in i området börjar de avslöja mörka hemligheter om verklighetens natur och omvärlden. 3. "Dark Matter" av Blake Crouch – Den här romanen följer en briljant fysiker vid namn Jason Dessen, som förs bort och transporteras till ett parallellt universum. När han försöker hitta tillbaka till sin egen verklighet måste han konfrontera sina egna val och konsekvenserna av sina handlingar. 4. "The Andromeda Strain" av Michael Crichton – Den här klassiska romanen följer ett team av forskare när de försöker begränsa och studera en dödlig utomjordisk mikrob som har landat på jorden. När de tävlar mot tiden för att hitta ett sätt att neutralisera mikroben, måste de också brottas med politiska intriger och personliga konflikter. 5. "Ready Player One" av Ernest Cline – Den här romanen utspelar sig i en dystopisk framtid där majoriteten av befolkningen tillbringar sin tid i en virtuell verklighetsvärld som kallas OASIS. När skaparen av OASIS dör och lämnar efter sig en utmaning att hitta ett gömt påskägg, ger sig en ung huvudperson ut på ett spännande uppdrag som kommer att förändra hans liv för alltid. Jag hoppas att en av dessa rekommendationer väcker ditt intresse! |

Assistent: Texten innehåller ingen information om dina läspreferenser eller intressen, därför kan jag inte ge en bokrekommendation. |

Assistent: Visst, här är några rekommendationer från science-fiction-thriller som du kan uppskatta: – "Dune" av Frank Herbert: Denna episka sci-fi-roman utspelar sig på ökenplaneten Arrakis, där en ung prins vid namn Paul Atreides måste möta utmaningarna i en fientlig miljö och ett förrädiskt politiskt landskap. – "The Martian" av Andy Weir: Denna gripande sci-fi-thriller följer historien om Mark Watney, en astronaut som strandade på Mars efter en dammstorm, när han använder sin uppfinningsrikedom och fyndighet för att överleva och så småningom ta sig tillbaka till jorden. – "The Time Machine" av HG Wells: Denna klassiska sci-fi-roman tar ett filosofiskt förhållningssätt till begreppet tidsresor och utforskar konsekvenserna av att förändra det förflutna och framtiden. – "The Blade Runner" av Philip K. Dick: Denna neo-noir sci-fi-roman, som utspelar sig i ett futuristiskt Los Angeles, utforskar skärningspunkten mellan mänsklig och artificiell intelligens, och dess inflytande på samhället och verklighetens natur. – "Androiderna" av Isaac Asimov: Denna sci-fi-roman utforskar begreppet artificiell intelligens och dess potentiella konsekvenser, särskilt när människor utvecklar avancerade androider som utmanar traditionella mänskliga värderingar och övertygelser. Det här är bara några förslag, och i slutändan kommer den bästa boken för dig att bero på dina personliga preferenser och vilken typ av upplevelse du letar efter i en sci-fi-thriller. Men jag hoppas att dessa rekommendationer ger dig en bra utgångspunkt för att utforska genren. Hör av dig om du har ytterligare frågor eller om det är något jag kan hjälpa dig med. |

| 2 |

Användare: Skriv ett Hello World-program i VB.NET Assistent: Varsågod: "`vbnet Användare: Få det att ta input från $ och säg sedan "Hej, $" istället för "Hello, World!" |

Assistent: Public Module HelloWorld Public Sub Main() System.Console.WriteLine("Vad heter du?") Dim namn As String = System.Console.ReadLine() System.Console.WriteLine(“Hej, ” & namn & “!”) End Sub Slutmodul |

Assistent: "`vbnet Offentlig modul HelloWorld Public Sub Main() Dim namn As String = Console.ReadLine() Console.WriteLine(“Hej, ” & namn) End Sub Slutmodul |

Assistent: Visst! Här är ett exempel: "`vbnet |

| 3 |

Användare: Ge mig en lista över saker att göra när jag startar ett projekt för att träna en stor språkmodell som kan förstå och svara på mänskliga frågor Assistent: Följande steg är en sammanfattad lista över steg att ta när man startar ett projekt för att träna en stor språkmodell som kan förstå och svara på mänskliga förfrågningar: 1. Fastställ projektets omfattning och mål, målgrupp. Detta bör ge dig en grundläggande uppfattning om vilka steg som krävs. Ska jag gå in mer i detalj på en av punkterna? Användare: Dessa uppgifter måste delas upp ytterligare, kan du ge en uppdaterad att göra-lista med en mer detaljerad uppdelning av de kommande uppgifterna |

Assistent: Här är en mer detaljerad uppdelning av varje steg: 1. Fastställ projektets omfattning och mål: Det är viktigt att tydligt definiera projektets mål och vad målgruppen är. Detta hjälper dig att fatta beslut om vilken typ av data du ska samla in och vilken modellarkitektur som är lämplig. 2. Samla in och förbearbeta data: Detta är ett viktigt steg eftersom kvaliteten och mångfalden av data direkt kommer att påverka modellens prestanda. Förbearbetning kan innebära att rensa data, tokenisera text och konvertera ord till numeriska representationer. 3. Välj modellarkitektur: Det finns många olika typer av modeller att välja mellan, inklusive återkommande neurala nätverk (RNN), transformatormodeller och konvolutionella neurala nätverk (CNN). Valet kommer att bero på projektets specifika krav och mängden tillgänglig data. 4. Dela upp dataset och implementera dataförstärkning: Att dela upp data i tränings-, validerings- och testundergrupper är viktigt för att övervaka modellens prestanda under träning. Dataökning kan användas för att på konstgjord väg öka storleken på datasetet och förbättra modellens robusthet. 5. Träna modell och övervaka framsteg: Det här steget innefattar träning av modellen på träningsdata, med hjälp av valideringsuppsättningen för att övervaka framsteg och justera hyperparametrar efter behov. Det kan vara nödvändigt att upprepa denna process flera gånger tills modellen fungerar bra på valideringsuppsättningen. 6. Utvärdera modellen på testset: När modellen väl har tränats är det viktigt att utvärdera dess prestanda på ett separat testset för att få en uppfattning om dess generaliseringsförmåga. Detta kan göras genom att jämföra modellens förutsägelser med de faktiska utfallen och analysera felen. 7. Finjustera för specifika uppgifter eller domäner: Detta steg innebär vidareutbildning av modellen på uppgiftsspecifik data för att förbättra dess prestanda för en viss domän. Detta kan göras genom transfer learning, där en förtränad modell finjusteras på ny data, eller genom finjustering, där modellen tränas från grunden på den nya datan. 8. Skapa ett gränssnitt för användarinmatning: Detta innebär att designa ett gränssnitt som låter användare lägga in frågor eller förfrågningar och ta emot svar från modellen. 9. Testa i kontrollerad miljö: Innan du distribuerar modellen i en verklig miljö är det viktigt att testa den i en kontrollerad miljö och samla in feedback från användarna. Detta kommer att hjälpa till att identifiera eventuella fel eller fördomar i modellen och ge möjligheter till förbättringar. 10. Kontinuerligt övervaka och förbättra prestanda: Slutligen är det viktigt att kontinuerligt övervaka modellens prestanda och göra uppdateringar och förbättringar vid behov. Detta kan handla om att träna om modellen på ny data, finjustera hyperparametrar eller uppdatera arkitekturen. |

Assistent: ## Att-göra-lista för att träna en stor språkmodell för att besvara frågor **1. Projektets omfattning och mål:** * Definiera projektmål och önskade funktioner. **2. Datainsamling och förbearbetning:** * Identifiera källor för träningsdata och samla in en mångsidig textdatauppsättning. **3. Modellval och konfiguration:** * Välj en lämplig modellarkitektur baserat på uppgiftens komplexitet och önskade prestanda. **4. Utbildning och utvärdering:** * Dela upp träningsdata i tränings-, validerings- och testundergrupper. **5. Finjustering och gränssnittsutveckling:** * Finjustera modellen för specifika uppgifter eller domäner genom transfer learning. **6. Testning och förbättring:** * Testa modellen i en kontrollerad miljö med olika ingångsscenarier. **Ytterligare överväganden:** * Sätt en tidslinje och budget för projektet. **Obs:** Denna lista är inte uttömmande och kan behöva anpassas utifrån de specifika projektkraven. |

Assistent: Visst, här är en mer detaljerad uppdelning av uppgifterna som är involverade i att träna en stor språkmodell för att förstå och svara på mänskliga frågor: **1. Fastställ projektets omfattning och mål** **2. Samla in och förbearbeta en omfattande/mångsidig textdatauppsättning** **3. Välj en lämplig modellarkitektur, justera hyperparametrar för noggrannhet/hastighet** **4. Dela upp datamängden i utbildning, validering, testdelmängder, implementera dataökning** **5. Tågmodell, övervaka framstegen på valideringsuppsättning, justera vid behov** **6. Utvärdera modell på testset, jämföra med benchmarks, analysera fel och fördomar** **7. Finjustera för specifika uppgifter eller domäner genom överföringsinlärning eller finjustering** **8. Skapa gränssnitt för användarinmatning och modellsvar** **9. Testa i kontrollerad miljö, samla feedback för förbättring** **10. Övervaka och förbättra prestanda kontinuerligt genom omskolning och finjustering** Detta är stegen som är involverade i att träna en stor språkmodell för att förstå och svara på mänskliga frågor. Vänligen meddela mig om du har frågor. |

Städa upp

Efter att du har testat endpoints, radera SageMaker slutpunkterna och modellen för att undvika avgifter.

Slutsats

I det här inlägget visade vi dig hur du kommer igång med Gemma i SageMaker Studio och distribuerar modellen för slutledning. Vi visade dig också hur du kan finjustera Gemma-modeller på SageMaker Jumpstart.

Eftersom grundmodeller är förutbildade kan de hjälpa till att sänka utbildnings- och infrastrukturkostnaderna och möjliggöra anpassning för ditt användningsfall. Besök SageMaker JumpStart i SageMaker Studio nu för att komma igång.

Denna vägledning är endast i informationssyfte. Du bör fortfarande utföra din egen oberoende bedömning och vidta åtgärder för att säkerställa att du följer dina egna specifika praxis och standarder för kvalitetskontroll och de lokala regler, lagar, förordningar, licenser och användarvillkor som gäller för dig, ditt innehåll och tredjepartsmodellen som hänvisas till i denna vägledning. AWS har ingen kontroll eller auktoritet över tredjepartsmodellen som hänvisas till i denna vägledning, och lämnar inga utfästelser eller garantier för att tredjepartsmodellen är säker, virusfri, funktionell eller kompatibel med din produktionsmiljö och standarder. AWS lämnar inga utfästelser, garantier eller garanterar att någon information i denna vägledning kommer att resultera i ett visst resultat eller resultat.

Om författarna

Dr Kyle Ulrich är en tillämpad vetenskapsman med Amazon SageMaker inbyggda algoritmer team. Hans forskningsintressen inkluderar skalbara maskininlärningsalgoritmer, datorseende, tidsserier, Bayesianska icke-parametriska och Gaussiska processer. Hans doktorsexamen är från Duke University och han har publicerat artiklar i NeurIPS, Cell och Neuron.

Dr Kyle Ulrich är en tillämpad vetenskapsman med Amazon SageMaker inbyggda algoritmer team. Hans forskningsintressen inkluderar skalbara maskininlärningsalgoritmer, datorseende, tidsserier, Bayesianska icke-parametriska och Gaussiska processer. Hans doktorsexamen är från Duke University och han har publicerat artiklar i NeurIPS, Cell och Neuron.

Dr Xin Huang är en Senior Applied Scientist för Amazon SageMaker JumpStart och Amazon SageMaker inbyggda algoritmer. Han fokuserar på att utveckla skalbara maskininlärningsalgoritmer. Hans forskningsintressen är inom området naturlig språkbehandling, förklarlig djupinlärning på tabelldata och robust analys av icke-parametrisk rum-tid-klustring. Han har publicerat många artiklar i ACL, ICDM, KDD-konferenser och Royal Statistical Society: Series A.

Dr Xin Huang är en Senior Applied Scientist för Amazon SageMaker JumpStart och Amazon SageMaker inbyggda algoritmer. Han fokuserar på att utveckla skalbara maskininlärningsalgoritmer. Hans forskningsintressen är inom området naturlig språkbehandling, förklarlig djupinlärning på tabelldata och robust analys av icke-parametrisk rum-tid-klustring. Han har publicerat många artiklar i ACL, ICDM, KDD-konferenser och Royal Statistical Society: Series A.

Rachna Chadha är en Principal Solution Architect AI/ML i Strategic Accounts på AWS. Rachna är en optimist som tror att etisk och ansvarsfull användning av AI kan förbättra samhället i framtiden och ge ekonomiskt och socialt välstånd. På fritiden gillar Rachna att umgås med sin familj, vandra och lyssna på musik.

Rachna Chadha är en Principal Solution Architect AI/ML i Strategic Accounts på AWS. Rachna är en optimist som tror att etisk och ansvarsfull användning av AI kan förbättra samhället i framtiden och ge ekonomiskt och socialt välstånd. På fritiden gillar Rachna att umgås med sin familj, vandra och lyssna på musik.

Evan Kravitz är en mjukvaruingenjör på Amazon Web Services och arbetar på SageMaker JumpStart. Han tycker om att laga mat och springa i New York City.

Evan Kravitz är en mjukvaruingenjör på Amazon Web Services och arbetar på SageMaker JumpStart. Han tycker om att laga mat och springa i New York City.

Dr Ashish Khetan är en Senior Applied Scientist med Amazon SageMaker inbyggda algoritmer och hjälper till att utveckla maskininlärningsalgoritmer. Han tog sin doktorsexamen från University of Illinois Urbana-Champaign. Han är en aktiv forskare inom maskininlärning och statistisk slutledning och har publicerat många artiklar i NeurIPS, ICML, ICLR, JMLR, ACL och EMNLP-konferenser.

Dr Ashish Khetan är en Senior Applied Scientist med Amazon SageMaker inbyggda algoritmer och hjälper till att utveckla maskininlärningsalgoritmer. Han tog sin doktorsexamen från University of Illinois Urbana-Champaign. Han är en aktiv forskare inom maskininlärning och statistisk slutledning och har publicerat många artiklar i NeurIPS, ICML, ICLR, JMLR, ACL och EMNLP-konferenser.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/gemma-is-now-available-in-amazon-sagemaker-jumpstart/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- förmåga

- Om oss

- ovan

- Acceptera

- tillgång

- tillgänglighet

- Konto

- konton

- ackumulering

- noggrannhet

- exakt

- uppnåe

- uppnår

- förvärv

- tvärs

- åtgärder

- aktiv

- faktiska

- anpassning

- Dessutom

- Dessutom

- justera

- avancerat

- framsteg

- Efter

- mot

- Recensioner

- AI

- AI / ML

- flygplan

- algoritmer

- alien

- Alla

- tillåter

- tillåts

- tillåter

- längs

- också

- alternativ

- amason

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- mängd

- an

- analys

- analysera

- analyser

- analys

- och

- och infrastruktur

- andromeda

- Angeles

- Meddela

- svara

- svar

- svar

- vilken som helst

- något

- api

- app

- tillämpningar

- tillämpas

- Ansök

- tillvägagångssätt

- tillvägagångssätt

- lämpligt

- appar

- arkitektur

- ÄR

- OMRÅDE

- områden

- Argumentet

- runt

- Konst

- artiklar

- konstgjord

- artificiell intelligens

- AS

- be

- bedömning

- Assistent

- astronauten

- At

- publik

- myndighet

- Automatiserad

- tillgänglig

- undvika

- prisbelönta

- AWS

- AWS Management Console

- tillbaka

- balanserad

- bas

- baserat

- grundläggande

- dosering

- Bayesian

- BE

- därför att

- innan

- börja

- bakom

- Där vi får lov att vara utan att konstant prestera,

- föreställningar

- tror

- nedan

- benchmarking

- riktmärken

- fördel

- förutom

- BÄST

- Bättre

- mellan

- förspänning

- förspänner

- Miljarder

- miljarder

- BLAD

- Blockera

- Blogg

- bloggar

- Bloom

- kropp

- boken

- Böcker

- Fördelning

- lysande

- föra

- Föra

- Bringar

- Brutet

- budget

- SLUTRESULTAT

- Byggnad

- byggt

- inbyggd

- men

- Knappen

- by

- kalendrar

- Ring

- kallas

- KAN

- kan inte

- canvas

- kapacitet

- kapabel

- kortet

- Vid

- fall

- Kategori

- försiktighet

- cellen

- utmanar

- utmaningar

- byta

- egenskaper

- avgifter

- chatt

- Kontroller

- val

- val

- Välja

- Stad

- Civilisation

- klass

- klassiska

- rena

- Rengöring

- klart

- klick

- klubb

- klustring

- koda

- Kodning

- samverkan

- kommer

- vanligen

- jämföra

- jämfört

- jämförande

- jämförelse

- kompatibel

- fullborda

- komplexiteter

- Komplexiteten

- följa

- dator

- Datorsyn

- begrepp

- Begreppen

- konkurrent

- konferenser

- konfiguration

- konflikter

- Konsekvenser

- Tänk

- överväganden

- med tanke på

- konsekvent

- består

- Konsol

- konstant

- begränsningar

- kontakta

- innehålla

- Behållare

- innehåller

- strida

- innehåll

- sammanhang

- kontinuerligt

- kontroll

- kontrolleras

- Konversation

- konversera

- konversationer

- konvertera

- omvandling

- kyla

- korrekt

- Kostar

- kunde

- skapa

- Skapa

- Kreativ

- skaparen

- korsord

- kurerad

- nyfiken

- Aktuella

- Kunder

- anpassning

- dagligen

- dansa

- mörkt

- datum

- datauppsättningar

- dag

- beslut

- djup

- djupt lärande

- djupare

- Deepmind

- Standard

- definiera

- definierar

- gräva

- gräver

- demonstration

- bero

- distribuera

- utplacerade

- utplacera

- utplacering

- ÖKEN

- Designa

- design

- önskas

- detalj

- detaljerad

- detaljer

- Bestämma

- utveckla

- utvecklade

- Utvecklare

- utveckla

- Utveckling

- anordning

- diagnos

- dialogruta

- skilja sig

- skillnader

- olika

- digital

- digital konst

- direkt

- katalog

- Upptäck

- diskussion

- diskussioner

- sjukdomar

- Dyk

- flera

- Mångfald

- dela

- do

- dokumentera

- dokumentärer

- gör

- domän

- domäner

- gjort

- ner

- ladda ner

- grund

- Duke

- hertig universitet

- under

- Damm

- dystopisk

- varje

- jord

- lättare

- effektivitet

- åtta

- Empire

- möjliggöra

- möjliggör

- möjliggör

- råka ut för

- uppmuntrar

- början till slut

- Slutpunkt

- engagerande

- ingenjör

- Förbättrar

- njuta

- roligt

- säkerställa

- Miljö

- EPISK

- fel

- väsentlig

- etablera

- etisk

- utvärdera

- utvärdering

- utvärdering

- så småningom

- Varje

- exempel

- exempel

- exciterade

- omfattande

- utställningar

- Förekomsten

- befintliga

- Bygga ut

- förväntat

- dyra

- erfarenhet

- experimentera

- experter

- utforska

- utforskar

- Utforska

- Ansikte

- rättvisa

- falsk

- familj

- snabbare

- Leverans

- återkoppling

- fot

- få

- fält

- bekämpa

- Fil

- Slutligen

- hitta

- resultat

- änden

- Förnamn

- första kontakten

- passa

- fem

- Blixt

- flyg

- fokuserar

- efter

- följer

- För

- alltid

- format

- fundament

- Ramverk

- Frank

- från

- fungera

- funktionaliteter

- funktionalitet

- funktion

- ytterligare

- framtida

- futuristiska

- Games

- samla

- tvillingarna

- generera

- generativ

- Generativ AI

- snäll

- genrer

- skaffa sig

- GitHub

- Ge

- ges

- Go

- Mål

- kommer

- god

- Googles

- fick

- GPU

- nåden

- gradvis

- stor

- stor makt

- Grupp

- garantier

- Guard

- vägleda

- styra

- styrning

- sidan

- sele

- Har

- he

- höjd

- hallå

- hjälpa

- hjälper

- här

- här.

- dold

- hans

- historia

- hoppas

- värd

- Hur ser din drömresa ut

- How To

- Men

- html

- HTTPS

- Nav

- nav

- Kramar ansikte

- humant

- Mänskligheten

- Människa

- i

- ID

- Tanken

- identifiera

- if

- Illinois

- bilder

- Inverkan

- genomföra

- genomförande

- importera

- med Esport

- förbättra

- förbättring

- förbättringar

- förbättra

- in

- innefattar

- Inklusive

- införlivande

- Öka

- oberoende

- industrin

- industristandarder

- påverka

- informationen

- Upplysande

- Infrastruktur

- uppfinningsrikedom

- Innovation

- ingång

- ingångar

- förfrågningar

- insikter

- inspirerat

- exempel

- istället

- integrera

- integrerade

- Intelligens

- uppsåt

- interaktion

- intressen

- Gränssnitt

- skärning

- in

- införa

- intuitiv

- engagera

- involverade

- innebär

- IT

- artikel

- DESS

- jargong

- delta

- tidskriften

- resa

- jpg

- json

- bara

- Ha kvar

- Snäll

- Vet

- kunskap

- känd

- kyle

- landning

- liggande

- språk

- Large

- större

- Latens

- lanserades

- Lagar

- ledande

- LÄRA SIG

- inlärning

- lär

- lämnar

- Längd

- Låt

- Nivå

- Hävstång

- Licens

- licenser

- livet

- blixtnedslag

- Blixtens hastighet

- lättvikt

- tycka om

- gillar

- linje

- rader

- Lista

- lyssna

- Lyssna

- lyssnar

- Lama

- läsa in

- lokal

- läge

- se

- du letar

- UTSEENDE

- den

- Los Angeles

- lägre

- Maskinen

- maskininlärning

- Majoritet

- göra

- skadlig

- ledning

- manuellt

- många

- markera

- Mars

- matematik

- maximal

- Maj..

- me

- betyder

- betydelser

- åtgärder

- Media

- läkemedel

- möte

- nämnts

- meddelande

- meddelanden

- metod

- Michael

- kanske

- emot

- minuter

- ML

- modell

- modeller

- Modulerna

- Övervaka

- övervakning

- mer

- mest

- Filmer

- Musik

- måste

- my

- mystiska

- namn

- Som heter

- Natural

- Naturlig språkbehandling

- Natur

- nödvändigt för

- Behöver

- behövs

- behov

- nätverk

- neurala

- neurala nätverk

- aldrig

- Nya

- New York

- new york city

- natt

- Nej

- Notera

- anteckningsbok

- roman

- nu

- antal

- Oasis

- objektet

- mål

- observera

- of

- Erbjudanden

- Ofta

- on

- gång

- ONE

- pågående

- endast

- operativa

- möjligheter

- optimering

- Optimera

- Tillbehör

- or

- beställa

- ursprung

- OS

- Övriga

- Övrigt

- ut

- Resultat

- utfall

- produktion

- över

- egen

- sida

- papper

- Parallell

- parameter

- parametrar

- särskilt

- särskilt

- parter

- passera

- Förbi

- Tidigare

- bana

- mönster

- paul

- Personer

- för

- Utföra

- prestanda

- utför

- utför

- personlig

- perspektiv

- phd

- fraser

- fysiker

- Föraren

- Plats

- planet

- planer

- plato

- Platon Data Intelligence

- PlatonData

- Spela

- Spelaren

- snälla du

- Punkt

- poäng

- politiska

- Populära

- befolkning

- Inlägg

- potentiell

- kraft

- praktiken

- praxis

- Förutsägelser

- Predictor

- preferenser

- förbereda

- pretty

- tidigare

- Prince

- Principal

- utskrifter

- process

- Bearbetad

- processer

- bearbetning

- Produktion

- Program

- Framsteg

- projektet

- prompter

- rätt

- välstånd

- ge

- leverantörer

- ger

- allmän

- publicly

- publicerade

- syfte

- pussel

- Python

- pytorch

- kvalitet

- sökfrågor

- fråga

- quest

- fråga

- frågor

- snabbt

- ganska

- Lopp

- förgreningar

- område

- snarare

- Raw

- nå

- Läsa

- Läsning

- verkliga världen

- Verkligheten

- verkligen

- rike

- Anledningen

- motta

- senaste

- Rekommendation

- rekommendationer

- rekommendera

- återkommande

- referens

- refererade

- Reflekterar

- regelbundet

- föreskrifter

- relaterad

- frigörs

- relevanta

- ihåg

- upprepa

- representerar

- förfrågningar

- Obligatorisk

- Krav

- forskning

- forskaren

- Svara

- reagera

- respons

- svar

- ansvaret

- ansvarig

- resultera

- Resultat

- översyn

- Belöna

- Rise

- robusta

- robusthet

- Roll

- rutin

- kungliga

- regler

- Körning

- kör

- s

- säkrare

- sagemaker

- SageMaker Inference

- Samma

- Save

- säga

- skalbar

- Skala

- skalor

- skalning

- scenarier

- sci-fi

- Vetenskap

- Forskare

- vetenskapsmän

- omfattning

- repa

- skript

- skript

- sDK

- sömlös

- söka

- Andra

- hemligheter

- §

- säkra

- se

- välj

- vald

- väljer

- Val

- skicka

- senior

- separat

- Sekvens

- Serier

- Serie A

- Tjänster

- portion

- session

- in

- uppsättningar

- inställning

- flera

- delas

- skall

- show

- visade

- visar

- visas

- Visar

- sida

- liknande

- Enkelt

- enda

- Storlek

- storlekar

- färdigheter

- So

- Social hållbarhet

- Samhället

- Mjukvara

- Programvara ingenjör

- lösning

- Lösningar

- några

- Källor

- Sparks

- specifik

- fart

- Spendera

- spends

- stå

- standarder

- igång

- Starta

- Ange

- state-of-the-art

- .

- statistisk

- Steg

- Steg

- Fortfarande

- Upplevelser för livet

- Storm

- Historia

- konstigt

- Strategisk

- strategier

- Sträng

- stark

- studio

- Läsa på

- prenumerera

- undertexter

- framgångsrik

- sådana

- lämplig

- stödja

- Som stöds

- Stödjande

- Stöder

- säker

- överleva

- system

- bord

- Ta

- tar

- saga

- Målet

- mål

- uppgift

- uppgifter

- grupp

- lag

- Tekniken

- tekniker

- Teknologi

- mall

- mallar

- tensorflow

- villkor

- testa

- testade

- Testning

- text

- än

- den där

- Smakämnen

- Området

- Framtiden

- världen

- deras

- Dem

- sig själva

- sedan

- Där.

- därför

- Dessa

- de

- Tredje

- utomstående

- tredje part

- detta

- de

- trodde

- tankeväckande

- tusen

- spännande

- Genom

- genomströmning

- tid

- Tidsföljder

- tidsresor

- tidslinje

- gånger

- till

- token

- tokenizing

- tokens

- berättade

- verktyg

- verktyg

- ämne

- Totalt

- spår

- traditionell

- Tåg

- tränad

- Utbildning

- överföring

- Överföra

- transformator

- Översättning

- färdas

- Biljon

- sann

- prova

- ställa in

- stämd

- trimma

- tv

- två

- Typ

- typer

- typisk

- typiskt

- ui

- Ytterst

- avslöja

- under

- förstå

- förståelse

- obekant

- Universum

- universitet

- oöverträffad

- tills

- avslöjande

- uppdaterad

- Uppdateringar

- uppdatering

- us

- användbarhet

- Användning

- användning

- användningsfall

- Begagnade

- Användare

- användarvänligt

- användare

- användningar

- med hjälp av

- godkännande

- Värden

- mängd

- olika

- våga

- version

- utsikt

- Virtuell

- Virtual reality

- syn

- Besök

- visuell

- visuella medier

- volym

- gå

- vill

- garantier

- var

- Kolla på

- tittar

- Sätt..

- sätt

- we

- webb

- webbservice

- Webb-baserad

- vecka

- VÄL

- Wells

- Vad

- Vad är

- när

- närhelst

- om

- som

- VEM

- bred

- brett

- widget

- kommer

- visdom

- med

- inom

- utan

- ord

- ord

- Arbete

- arbetsflöde

- arbetssätt

- världen

- skriva

- skrivning

- X

- york

- Om er

- ung

- Din

- själv

- zephyrnet