Falska nyheter, definierade som nyheter som förmedlar eller innehåller falsk, fabricerad eller medvetet vilseledande information, har funnits så tidigt som tryckpressens framväxt. Den snabba spridningen av falska nyheter och desinformation på nätet är inte bara vilseledande för allmänheten, utan kan också ha en djupgående inverkan på samhället, politiken, ekonomin och kulturen. Exempel inkluderar:

- Odla misstroende i media

- Undergräver den demokratiska processen

- Sprider falsk eller misskrediterad vetenskap (till exempel anti-vax-rörelsen)

Framsteg inom artificiell intelligens (AI) och maskininlärning (ML) har gjort det ännu lättare att utveckla verktyg för att skapa och dela falska nyheter. Tidiga exempel inkluderar avancerade sociala bots och automatiserade konton som överdriver det inledande skedet av spridning av falska nyheter. I allmänhet är det inte trivialt för allmänheten att avgöra om sådana konton är personer eller bots. Dessutom är sociala bots inte olagliga verktyg, och många företag köper dem lagligt som en del av sin marknadsföringsstrategi. Därför är det inte lätt att systematiskt begränsa användningen av sociala bots.

Nya upptäckter inom området generativ AI gör det möjligt att producera textinnehåll i en aldrig tidigare skådad takt med hjälp av stora språkmodeller (LLM). LLM:er är generativa AI-textmodeller med över 1 miljard parametrar, och de underlättas i syntesen av högkvalitativ text.

I det här inlägget utforskar vi hur du kan använda LLM:er för att ta itu med det vanliga problemet med att upptäcka falska nyheter. Vi föreslår att LLM:er är tillräckligt avancerade för denna uppgift, särskilt om förbättrade snabbtekniker som t.ex Chain-of-Thought och Reagera används i samband med verktyg för informationssökning.

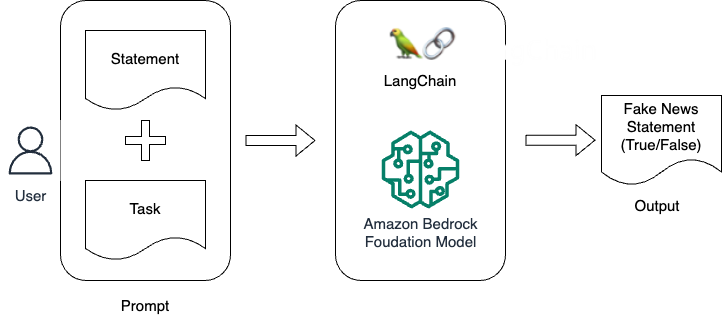

Vi illustrerar detta genom att skapa en Langkedja applikation som, givet en nyhet, informerar användaren om artikeln är sann eller falsk med naturligt språk. Lösningen använder också Amazonas berggrund, en helt hanterad tjänst som gör grundmodeller (FM) från Amazon och tredjepartsmodellleverantörer tillgängliga via AWS Management Console och API:er.

LLM och falska nyheter

Fenomenet med falska nyheter började utvecklas snabbt i och med internet och mer specifikt sociala medier (Nielsen et al., 2017). På sociala medier kan falska nyheter snabbt delas i en användares nätverk, vilket leder till att allmänheten bildar sig en felaktig kollektiv åsikt. Dessutom sprider människor ofta falska nyheter impulsivt och ignorerar innehållets fakta om nyheterna resonerar med deras personliga normer (Tsipursky et al. 2018). Forskning inom samhällsvetenskap har föreslagit att kognitiv bias (bekräftelsebias, bandwagon-effekt och valstödjande bias) är en av de mest avgörande faktorerna för att fatta irrationella beslut när det gäller både skapande och konsumtion av falska nyheter (Kim et al., 2021). Detta innebär också att nyhetskonsumenter delar och konsumerar information endast i riktning mot att stärka sin tro.

Kraften hos generativ AI för att producera textuellt och rikt innehåll i en aldrig tidigare skådad takt förvärrar problemet med falska nyheter. Ett exempel som är värt att nämna är deepfake-teknik – att kombinera olika bilder på en originalvideo och skapa en annan video. Förutom den desinformationsuppsåt som mänskliga aktörer ger till mixen, lägger LLM:er till en helt ny uppsättning utmaningar:

- Faktafel – LLM har en ökad risk att innehålla faktafel på grund av deras utbildning och förmåga att vara kreativ samtidigt som de genererar nästa ord i en mening. LLM-utbildning bygger på att upprepade gånger presentera en modell med ofullständig input, sedan använda ML-träningstekniker tills den korrekt fyller i luckorna, och därigenom lära sig språkstruktur och en språkbaserad världsmodell. Följaktligen, även om LLM:er är fantastiska mönstermatchare och re-combiners ("stokastiska papegojor"), misslyckas de med ett antal enkla uppgifter som kräver logiska resonemang eller matematisk deduktion, och kan hallucinera svar. Dessutom är temperatur en av LLM-ingångsparametrarna som styr modellens beteende när nästa ord genereras i en mening. Genom att välja en högre temperatur kommer modellen att använda ett ord med lägre sannolikhet, vilket ger ett mer slumpmässigt svar.

- Långvarig – Genererade texter tenderar att vara långa och sakna en tydligt definierad granularitet för enskilda fakta.

- Brist på faktagranskning – Det finns inga standardiserade verktyg för faktakontroll under textgenereringsprocessen.

Sammantaget har kombinationen av mänsklig psykologi och begränsningar av AI-system skapat en perfekt storm för spridningen av falska nyheter och desinformation online.

Lösningsöversikt

LLM:er visar enastående förmåga i språkgenerering, förståelse och inlärning av få skott. De är utbildade på en stor korpus av text från internet, där kvaliteten och noggrannheten hos det extraherade naturliga språket kanske inte kan garanteras.

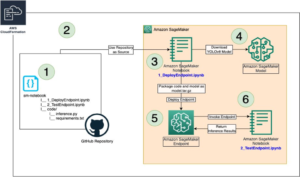

I det här inlägget tillhandahåller vi en lösning för att upptäcka falska nyheter baserad både på Chain-of-Thought och Re-Act (Reasoning and Acting) snabba tillvägagångssätt. Först diskuterar vi dessa två snabba ingenjörstekniker, sedan visar vi deras implementering med LangChain och Amazon Bedrock.

Följande arkitekturdiagram beskriver lösningen för vår falska nyhetsdetektor.

Arkitekturdiagram för upptäckt av falska nyheter.

Vi använder en delmängd av FEVER dataset som innehåller ett påstående och grundsanningen om påståendet som indikerar falska, sanna eller okontrollerbara påståenden (Thorne J. et al., 2018).

Arbetsflödet kan delas upp i följande steg:

- Användaren väljer ett av påståendena för att kontrollera om det är falskt eller sant.

- Uttalandet och uppgiften för upptäckt av falska nyheter är inkorporerade i prompten.

- Uppmaningen skickas till LangChain, som anropar FM i Amazon Bedrock.

- Amazon Bedrock returnerar ett svar på användarens begäran med påståendet True or False.

I det här inlägget använder vi Claude v2-modellen från Anthrophic (anthropic.claude-v2). Claude är en generativ LLM baserad på Anthropics forskning om att skapa pålitliga, tolkningsbara och styrbara AI-system. Skapad med tekniker som konstitutionell AI och ofarlighetsträning, utmärker Claude sig på genomtänkt dialog, skapande av innehåll, komplexa resonemang, kreativitet och kodning. Men genom att använda Amazon Bedrock och vår lösningsarkitektur har vi också flexibiliteten att välja bland andra FM-apparater som tillhandahålls av amason, AI21labs, Hänga ihopoch Stabilitet ai.

Du kan hitta implementeringsdetaljerna i följande avsnitt. Källkoden finns tillgänglig i GitHub-förrådet.

Förutsättningar

För den här handledningen behöver du en bash-terminal med Python 3.9 eller högre installerad på antingen Linux, Mac eller ett Windows-undersystem för Linux och ett AWS-konto.

Vi rekommenderar också att du använder antingen en Amazon SageMaker Studio anteckningsbok, en AWS Cloud9 instans, eller en Amazon Elastic Compute Cloud (Amazon EC2) instans.

Distribuera upptäckt av falska nyheter med Amazon Bedrock API

Lösningen använder Amazon Bedrock API, som kan nås med hjälp av AWS-kommandoradsgränssnitt (AWS CLI), den AWS SDK för Python (Boto3), eller en Amazon SageMaker anteckningsbok. Referera till Amazon Bedrock användarguide för mer information. För det här inlägget använder vi Amazon Bedrock API via AWS SDK för Python.

Konfigurera Amazon Bedrock API-miljö

För att konfigurera din Amazon Bedrock API-miljö, utför följande steg:

- Ladda ner den senaste Boto3 eller uppgradera den:

- Se till att du konfigurerar AWS-referenserna med hjälp av

aws configurekommando eller skicka dem till Boto3-klienten. - Installera den senaste versionen av Langkedja:

Du kan nu testa din installation med följande Python-skalskript. Skriptet instansierar Amazon Bedrock-klienten med Boto3. Därefter kallar vi list_foundation_models API för att få listan över grundmodeller som är tillgängliga för användning.

Efter att ha kört föregående kommando bör du få listan över FM:er från Amazon Bedrock.

LangChain som en snabb kedjelösning

För att upptäcka falska nyheter för en given mening följer vi noll-shot Chain-of-Thought-resonemangsprocessen (Wei J. et al., 2022), som består av följande steg:

- Inledningsvis försöker modellen skapa ett uttalande om nyheten.

- Modellen skapar en punktlista med påståenden.

- För varje påstående avgör modellen om påståendet är sant eller falskt. Observera att med denna metod förlitar sig modellen uteslutande på sin interna kunskap (vikter beräknade i förträningsfasen) för att nå en dom. Informationen verifieras inte mot någon extern data vid denna tidpunkt.

- Givet fakta svarar modellen SANT eller FALSKT för det givna påståendet i prompten.

För att uppnå dessa steg använder vi LangChain, ett ramverk för att utveckla applikationer som drivs av språkmodeller. Detta ramverk tillåter oss att utöka FM:erna genom att kedja ihop olika komponenter för att skapa avancerade användningsfall. I denna lösning använder vi den inbyggda SimpleSequentialChain i LangChain för att skapa en enkel sekventiell kedja. Detta är mycket användbart, eftersom vi kan ta utdata från en kedja och använda den som input till en annan.

Amazon Bedrock är integrerat med LangChain, så du behöver bara instansiera det genom att passera model_id när man instansierar Amazon Bedrock-objektet. Om det behövs kan modellinferensparametrarna tillhandahållas via model_kwargs argument, som:

- maxTokenCount – Det maximala antalet tokens i det genererade svaret

- stopSequences – Stoppsekvensen som används av modellen

- temperatur – Ett värde som sträcker sig mellan 0–1, där 0 är det mest deterministiska och 1 är det mest kreativa

- topp – Ett värde som sträcker sig mellan 0–1 och används för att styra tokens val baserat på sannolikheten för de potentiella valen

Om det här är första gången du använder en grundmodell från Amazon Bedrock, se till att du begär åtkomst till modellen genom att välja från listan över modeller på Modellåtkomst sida på Amazon Bedrock-konsolen, som i vårt fall är claude-v2 från Anthropic.

Följande funktion definierar Chain-of-Thought-promptkedjan som vi nämnde tidigare för att upptäcka falska nyheter. Funktionen tar Amazon Bedrock-objektet (llm) och användarprompten (q) som argument. LangChain's PromptMall funktionalitet används här för att fördefiniera ett recept för att generera prompter.

Följande kod anropar funktionen vi definierade tidigare och ger svaret. Uttalandet är TRUE or FALSE. TRUE innebär att det lämnade påståendet innehåller korrekta fakta, och FALSE innebär att påståendet innehåller minst ett felaktigt faktum.

Ett exempel på ett uttalande och modellsvar finns i följande utdata:

ReAct och verktyg

I det föregående exemplet identifierade modellen korrekt att påståendet är falskt. Men att skicka in frågan igen visar modellens oförmåga att urskilja riktigheten av fakta. Modellen har inte verktygen för att verifiera sanningshalten i påståenden bortom sitt eget träningsminne, så efterföljande körningar av samma prompt kan leda till att den felmärker falska påståenden som sanna. I följande kod har du en annan körning av samma exempel:

En teknik för att garantera sanningsenlighet är ReAct. Reagera (Yao S. et al., 2023) är en snabbteknik som utökar grundmodellen med en agents handlingsutrymme. I det här inlägget, såväl som i ReAct-dokumentet, implementerar handlingsutrymmet informationshämtning med hjälp av sök-, uppslags- och slutåtgärder från ett enkelt Wikipedia-webb-API.

Anledningen till att använda ReAct i jämförelse med Chain-of-Thought är att använda extern kunskapsinhämtning för att utöka grundmodellen för att upptäcka om en given nyhet är falsk eller sann.

I det här inlägget använder vi LangChains implementering av ReAct genom agenten ZERO_SHOT_REACT_DESCRIPTION. Vi modifierar den tidigare funktionen för att implementera ReAct och använda Wikipedia genom att använda load_tools-funktionen från langchain.agents.

Vi behöver också installera Wikipedia-paketet:

!pip install Wikipedia

Nedan är den nya koden:

Följande är resultatet av föregående funktion med samma sats som tidigare:

Städa upp

För att spara kostnader, ta bort alla resurser du distribuerade som en del av handledningen. Om du startade AWS Cloud9 eller en EC2-instans kan du ta bort den via konsolen eller med AWS CLI. På samma sätt kan du ta bort SageMaker-anteckningsboken som du kan ha skapat via SageMaker-konsolen.

Begränsningar och relaterat arbete

Området för upptäckt av falska nyheter forskas aktivt i det vetenskapliga samfundet. I det här inlägget använde vi Chain-of-Thought och ReAct-tekniker och i utvärderingen av teknikerna fokuserade vi bara på noggrannheten i klassificeringen av prompttekniken (om ett givet påstående är sant eller falskt). Därför har vi inte övervägt andra viktiga aspekter som svarshastighet, och inte heller utökat lösningen till ytterligare kunskapsbaskällor förutom Wikipedia.

Även om det här inlägget fokuserade på två tekniker, Chain-of-Thought och ReAct, har ett omfattande arbete undersökt hur LLM:er kan upptäcka, eliminera eller mildra falska nyheter. Lee et al. har föreslagit användningen av en kodare-avkodarmodell som använder NER (namngiven enhetsigenkänning) för att maskera de namngivna enheterna för att säkerställa att den maskerade token faktiskt använder kunskapen som kodas i språkmodellen. Chern et al. utvecklat FacTool, som använder Chain-of-Thought-principer för att extrahera anspråk från prompten och följaktligen samla in relevanta bevis för påståendena. LLM bedömer sedan påståendets fakta utifrån den hämtade listan med bevis. Du E. et al. presenterar ett kompletterande tillvägagångssätt där flera LLM:er föreslår och debatterar sina individuella svar och resonemangsprocesser under flera omgångar för att komma fram till ett gemensamt slutligt svar.

Baserat på litteraturen ser vi att effektiviteten hos LLM:er när det gäller att upptäcka falska nyheter ökar när LLM:erna utökas med extern kunskap och multi-agent konversationskapacitet. Dessa tillvägagångssätt är dock mer beräkningsmässigt komplexa eftersom de kräver flera modellanrop och interaktioner, längre uppmaningar och långa nätverkslagersamtal. I slutändan leder denna komplexitet till en ökad total kostnad. Vi rekommenderar att man utvärderar förhållandet mellan kostnad och prestanda innan liknande lösningar implementeras i produktionen.

Slutsats

I det här inlägget fördjupade vi oss i hur man använder LLM:er för att ta itu med det vanliga problemet med falska nyheter, som är en av de största utmaningarna i vårt samhälle nuförtiden. Vi började med att beskriva utmaningarna med falska nyheter, med betoning på dess potential att påverka allmänhetens känslor och orsaka samhällsstörningar.

Vi introducerade sedan konceptet LLMs som avancerade AI-modeller som tränas på en betydande mängd data. På grund av denna omfattande utbildning har dessa modeller en imponerande språkförståelse, vilket gör det möjligt för dem att producera människoliknande text. Med denna kapacitet visade vi hur LLM:er kan utnyttjas i kampen mot falska nyheter genom att använda två olika snabbtekniker, Chain-of-Thought och ReAct.

Vi underströk hur LLM:er kan underlätta faktakontrolltjänster i en oöverträffad skala, med tanke på deras förmåga att snabbt bearbeta och analysera stora mängder text. Denna potential för realtidsanalys kan leda till tidig upptäckt och inneslutning av falska nyheter. Vi illustrerade detta genom att skapa ett Python-skript som, givet ett uttalande, framhäver för användaren om artikeln är sann eller falsk med naturligt språk.

Vi avslutade med att understryka begränsningarna i det nuvarande tillvägagångssättet och avslutade med en hoppfull ton, och betonade att LLM:er med korrekta skyddsåtgärder och kontinuerliga förbättringar kan bli oumbärliga verktyg i kampen mot falska nyheter.

Vi skulle älska att höra från dig. Låt oss veta vad du tycker i kommentarsektionen, eller använd problemforumet i GitHub-förrådet.

Friskrivningsklausul: Koden i detta inlägg är endast avsedd för utbildnings- och experimentändamål. Man bör inte lita på den för att upptäcka falska nyheter eller felaktig information i verkliga produktionssystem. Inga garantier lämnas om riktigheten eller fullständigheten av upptäckt av falska nyheter med denna kod. Användare bör iaktta försiktighet och utföra due diligence innan de använder dessa tekniker i känsliga applikationer.

För att komma igång med Amazon Bedrock, besök Amazon Bedrock-konsol.

Om författarna

Anamaria Todor är en Principal Solutions Architect baserad i Köpenhamn, Danmark. Hon såg sin första dator när hon var 4 år gammal och släppte aldrig datavetenskap, videospel och ingenjörskonst sedan dess. Hon har arbetat i olika tekniska roller, från frilansare, full-stack-utvecklare, till dataingenjör, teknisk ledare och CTO, på olika företag i Danmark, med fokus på spel- och reklambranschen. Hon har varit på AWS i över 3 år, arbetat som Principal Solutions Architect, med fokus främst på life science och AI/ML. Anamaria har en kandidatexamen i tillämpad teknik och datavetenskap, en magisterexamen i datavetenskap och över 10 års AWS-erfarenhet. När hon inte arbetar eller spelar tv-spel, coachar hon tjejer och kvinnliga proffs i att förstå och hitta sin väg genom tekniken.

Anamaria Todor är en Principal Solutions Architect baserad i Köpenhamn, Danmark. Hon såg sin första dator när hon var 4 år gammal och släppte aldrig datavetenskap, videospel och ingenjörskonst sedan dess. Hon har arbetat i olika tekniska roller, från frilansare, full-stack-utvecklare, till dataingenjör, teknisk ledare och CTO, på olika företag i Danmark, med fokus på spel- och reklambranschen. Hon har varit på AWS i över 3 år, arbetat som Principal Solutions Architect, med fokus främst på life science och AI/ML. Anamaria har en kandidatexamen i tillämpad teknik och datavetenskap, en magisterexamen i datavetenskap och över 10 års AWS-erfarenhet. När hon inte arbetar eller spelar tv-spel, coachar hon tjejer och kvinnliga proffs i att förstå och hitta sin väg genom tekniken.

Marcel Castro är en senior lösningsarkitekt baserad i Oslo, Norge. I sin roll hjälper Marcel kunder med arkitektur, design och utveckling av molnoptimerad infrastruktur. Han är medlem i AWS Generative AI Ambassador-teamet med målet att driva och stödja EMEA-kunder på deras generativa AI-resa. Han har en doktorsexamen i datavetenskap från Sverige och en magister- och kandidatexamen i elektroteknik och telekommunikation från Brasilien.

Marcel Castro är en senior lösningsarkitekt baserad i Oslo, Norge. I sin roll hjälper Marcel kunder med arkitektur, design och utveckling av molnoptimerad infrastruktur. Han är medlem i AWS Generative AI Ambassador-teamet med målet att driva och stödja EMEA-kunder på deras generativa AI-resa. Han har en doktorsexamen i datavetenskap från Sverige och en magister- och kandidatexamen i elektroteknik och telekommunikation från Brasilien.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- : har

- :är

- :inte

- :var

- $ 100 miljoner

- $UPP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- förmåga

- Om oss

- ovan

- AC

- akademiska

- akademisk forskning

- Academy

- tillgång

- Accessed

- tillgänglig

- Konto

- konton

- noggrannhet

- Uppnå

- resultat

- tvärs

- verkande

- Handling

- åtgärder

- aktivt

- aktörer

- faktiskt

- lägga till

- Dessutom

- Annat

- avancerat

- första advent

- reklam

- igen

- mot

- Recensioner

- medel

- AI

- AI-modeller

- AI-system

- AI / ML

- AL

- Alla

- tillåter

- ensam

- också

- Även

- amason

- Amazon EC2

- Amazon Web Services

- Ambassadör

- amerikan

- bland

- mängder

- an

- analys

- analysera

- Ancient

- och

- Årligen

- Annan

- svara

- svar

- Antropisk

- vilken som helst

- api

- API: er

- visas

- Ansökan

- tillämpningar

- tillämpas

- utsedd

- tillvägagångssätt

- tillvägagångssätt

- cirka

- arkitektur

- ÄR

- Argumentet

- argument

- runt

- Artikeln

- konstgjord

- artificiell intelligens

- Konstgjord intelligens (AI)

- konst

- AS

- aspekter

- bedöma

- bedömningar

- antaganden

- säker

- astronomi

- At

- Försök

- förstärka

- augmented

- Augments

- Automatiserad

- tillgänglig

- tilldelas

- AWS

- AWS Cloud9

- bas

- baserat

- bash

- Slaget

- BE

- därför att

- blir

- passande

- varit

- innan

- beteende

- bakom

- Där vi får lov att vara utan att konstant prestera,

- föreställningar

- förutom

- mellan

- Bortom

- förspänning

- Miljarder

- biologi

- biomedicinsk

- kropp

- båda

- botar

- Brasilien

- föra

- Brutet

- inbyggd

- affärsman

- men

- by

- Ring

- Samtal

- KAN

- kapacitet

- kapacitet

- Kapacitet

- Vid

- fall

- Orsak

- försiktighet

- Århundrade

- kedja

- kedjor

- utmaningar

- chang

- ta

- kemi

- kinesisk

- val

- Välja

- patentkrav

- hävdar

- klass

- klassificering

- klart

- klient

- Stäng

- Cloud9

- coaching

- koda

- Kodning

- kognitiv

- samla

- Kollektiv

- College

- COLUMBIA

- kombination

- kommentarer

- Gemensam

- vanligen

- samfundet

- Företag

- jämförelse

- komplementär

- fullborda

- komplex

- Komplexiteten

- komponenter

- sammansatt

- Compute

- dator

- Datavetenskap

- begrepp

- ingås

- Bekräfta

- bekräftelse

- förening

- Följaktligen

- anses

- konsekvent

- består

- Konsol

- konsumera

- konsumenter

- konsumtion

- inneslutning

- innehåller

- innehåll

- innehållsskapande

- kontinuerlig

- bidrag

- kontroll

- kontroller

- Konversation

- korrekt

- korrekt

- Pris

- Kostar

- kunde

- länder

- land

- skapa

- skapas

- skapar

- Skapa

- skapande

- Kreativ

- kreativitet

- referenser

- CTO

- kultur

- bromsa

- Aktuella

- Kunder

- datum

- diskussion

- beslut

- definierade

- definierar

- Examen

- demokratiska

- demonstreras

- demonstrerar

- demonstrera

- Danmark

- Avdelning

- utplacerade

- utplacera

- Designa

- detaljer

- upptäcka

- Detektering

- Bestämma

- bestämd

- utvecklade

- Utvecklare

- utveckla

- Utveckling

- utvecklingen

- dialog

- olika

- flit

- riktning

- diskutera

- desinformation

- Visa

- störningar

- skilja på

- misstro

- läkare

- gör

- inte

- ner

- dr

- driv

- grund

- under

- e

- E&T

- varje

- Tidigare

- Tidig

- tjänar

- intjänade

- jord

- lättare

- lätt

- Ekonomi

- ekonomi

- pedagogiska

- lärare

- effekt

- effektivitet

- antingen

- eliminera

- annorstädes

- EMEA

- uppkomst

- vikt

- möjliggör

- avslutades

- ingenjör

- Teknik

- förbättringar

- säkerställa

- in

- enheter

- enhet

- Miljö

- jämlikhet

- fel

- speciellt

- etablerade

- utvärdering

- Även

- händelser

- utvecklas

- exempel

- exempel

- uteslutande

- Motionera

- erfarenhet

- Förklara

- utforska

- utforskas

- omfattande

- extern

- extrahera

- främja

- underlättas

- Faktum

- faktorer

- fakta

- MISSLYCKAS

- fejka

- falska nyheter

- falsk

- kända

- kvinna

- fält

- bekämpa

- fyllningar

- slutlig

- finansiella

- hitta

- finna

- slut

- Förnamn

- första gången

- Flexibilitet

- fokuserade

- fokuserar

- fokusering

- följer

- efter

- För

- formen

- formell

- Forum

- fundament

- grundläggande

- Grundad

- Ramverk

- från

- fu

- fullständigt

- fungera

- funktionalitet

- Games

- Gaming

- luckor

- Kön

- Jämställdhet

- Allmänt

- generera

- genereras

- generera

- generering

- generativ

- Generativ AI

- skaffa sig

- flickor

- GitHub

- ges

- Go

- Målet

- stor

- Marken

- garantier

- hade

- sele

- Har

- he

- höra

- hjälpa

- hjälper

- här

- här.

- hög kvalitet

- högre

- höjdpunkter

- höggradigt

- hans

- historia

- innehar

- ära

- hoppingivande

- bostäder

- Hur ser din drömresa ut

- How To

- Men

- html

- http

- HTTPS

- humant

- i

- IBM

- identifierade

- if

- Olaglig

- illustrera

- bilder

- Inverkan

- genomföra

- genomförande

- redskap

- importera

- med Esport

- imponerande

- förbättras

- in

- Oförmågan

- innefattar

- innefattar

- Inklusive

- Inkorporerad

- inkorporerar

- ökat

- Ökar

- pekar på

- individuellt

- industrier

- informationen

- informerar

- Infrastruktur

- inledande

- ingång

- inuti

- installera

- installerad

- exempel

- Institute

- institutioner

- integrerade

- Intelligens

- uppsåt

- interaktioner

- inre

- Internet

- in

- introducerade

- anropar

- involverade

- fråga

- problem

- IT

- DESS

- resa

- jpg

- json

- Domarna

- kenneth

- Vet

- kunskap

- känd

- Brist

- språk

- Large

- Sent

- senaste

- latin

- lanserades

- lager

- leda

- ledande

- inlärning

- t minst

- lagligt

- Låt

- livet

- Life Sciences

- tycka om

- begränsningar

- linje

- länkar

- linux

- Lista

- Noterade

- litteraturen

- LLM

- logisk

- längre

- slå upp

- älskar

- mac

- Maskinen

- maskininlärning

- gjord

- huvudsakligen

- upprätthåller

- större

- göra

- GÖR

- Framställning

- förvaltade

- ledning

- många

- Marknadsföring

- mask

- master

- matematisk

- matematik

- maximal

- Maj..

- betyder

- menas

- Media

- medicinsk

- läkemedel

- medlem

- Medlemmar

- Minne

- nämnts

- Metodik

- Michigan

- miljon

- minor

- desinformation

- vilseledande

- MIT

- Mildra

- Blanda

- ML

- modell

- modeller

- modifiera

- mer

- mest

- rörelse

- multipel

- my

- Som heter

- Nasa

- nationell

- Natural

- Natur

- Behöver

- behövs

- nät

- aldrig

- Nya

- nyheter

- Nästa

- Nej

- Nobelpristagare

- normer

- Norge

- anmärkningsvärd

- anteckningsbok

- nu

- antal

- objektet

- observationen

- oktober

- of

- erbjuds

- Ofta

- Gamla

- on

- ONE

- nätet

- endast

- Verksamhet

- Yttrande

- or

- beställa

- ursprungliga

- Övriga

- annat

- vår

- konturer

- Disposition

- produktion

- utestående

- över

- övergripande

- egen

- ägd

- Fred

- paket

- sida

- sidor

- Papper

- parametrar

- del

- passera

- Godkänd

- Förbi

- Patent

- bana

- Mönster

- Personer

- perfekt

- Utföra

- personlig

- fas

- phd

- Fenomenet

- Filosofin

- Fysik

- bit

- svängbara

- plato

- Platon Data Intelligence

- PlatonData

- i

- Punkt

- politiska

- möjlig

- Inlägg

- potentiell

- kraft

- drivs

- presenteras

- presenterar

- tryck

- förhärskande

- föregående

- tidigare

- primärt

- Principal

- Principerna

- tryckning

- Tryckpress

- Innan

- priser

- Problem

- process

- processer

- producera

- Produktion

- yrkesmän/kvinnor

- djupgående

- Program

- föreslå

- föreslagen

- ge

- förutsatt

- leverantörer

- ger

- tillhandahålla

- Psykologi

- allmän

- inköp

- syfte

- Python

- kvalitet

- mängd

- snabbt

- radio

- slumpmässig

- intervall

- rankad

- snabb

- snabbt

- ratio

- nå

- Reagera

- verkliga världen

- realtid

- Anledningen

- motta

- mottagna

- Receptet

- erkännande

- rekommenderar

- hänvisa

- hänvisar

- relaterad

- relativt

- relevanta

- pålitlig

- UPPREPAT

- Repository

- begära

- kräver

- Obligatorisk

- forskning

- resonerar

- Resurser

- Svara

- respons

- svar

- ansvarig

- avkastning

- återgår

- Rik

- Risk

- Roll

- roller

- omgångar

- Körning

- rinnande

- kör

- s

- skyddsåtgärder

- sagemaker

- Samma

- Save

- såg

- Skala

- Skola

- Institutionen för teknik

- Vetenskap

- VETENSKAPER

- vetenskaplig

- vetenskapsmän

- skript

- sDK

- Sök

- §

- sektioner

- se

- väljer

- senior

- känslig

- mening

- känsla

- Sekvens

- service

- Tjänster

- in

- inställning

- Dela

- delas

- aktier

- delning

- hon

- Shell

- skall

- show

- liknande

- Liknande

- Enkelt

- eftersom

- syster

- So

- Social hållbarhet

- sociala medier

- samhällelig

- Samhället

- lösning

- Lösningar

- några

- Källa

- källkod

- Källor

- Utrymme

- spänning

- specifikt

- fart

- spridning

- Spridning

- Etapp

- standard

- stanford

- Stanford University

- igång

- .

- uttalanden

- Stater

- Steg

- Sluta

- Storm

- Strategi

- förstärkning

- struktur

- Studenter

- Läsa på

- senare

- väsentlig

- Framgångsrikt

- sådana

- föreslå

- SAMMANFATTNING

- Superladdning

- stödja

- säker

- Vingla

- Sverige

- snabbt

- syntes

- System

- tackla

- Ta

- tar

- uppgift

- uppgifter

- grupp

- Teknisk

- Tekniken

- tekniker

- teknisk

- Teknologi

- telekommunikationer

- mall

- terminal

- villkor

- testa

- text

- text-

- den där

- Smakämnen

- den information

- källan

- världen

- deras

- Dem

- sedan

- Där.

- vari

- därför

- Dessa

- de

- tror

- tredje part

- detta

- de

- trodde

- Genom

- hela

- SLIPS

- tid

- tidslinje

- till

- tillsammans

- token

- tokens

- verktyg

- tränad

- Utbildning

- sann

- sanningen

- handledning

- två

- Ytterst

- understrukna

- förståelse

- United

- USA

- Universitet

- universitet

- enastående

- utan motstycke

- tills

- uppgradera

- på

- us

- användning

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- Använda

- värde

- olika

- Omfattande

- Slutsats

- verifierade

- verifiera

- version

- mycket

- via

- Video

- videospel

- Besök

- var

- we

- webb

- webbservice

- VÄL

- Vad

- när

- om

- som

- medan

- VEM

- Hela

- varför

- wikipedia

- kommer

- fönster

- med

- inom

- kvinna

- Kvinnor

- Vann

- ord

- ord

- Arbete

- arbetade

- arbetsflöde

- arbetssätt

- världen

- värt

- Fel

- år

- Om er

- Din

- zephyrnet