Stora språkmodeller (LLM) med sin breda kunskap kan generera människoliknande text om nästan vilket ämne som helst. Men deras utbildning i massiva datamängder begränsar också deras användbarhet för specialiserade uppgifter. Utan fortsatt lärande förblir dessa modeller omedvetna om nya data och trender som dyker upp efter deras första utbildning. Dessutom kan kostnaden för att utbilda nya LLM:er visa sig vara oöverkomlig för många företagsinställningar. Det är dock möjligt att korsreferera ett modellsvar med det ursprungliga specialiserade innehållet, och därigenom undvika behovet av att träna en ny LLM-modell med hjälp av Retrieval-Augmented Generation (RAG).

RAG stärker LLM:er genom att ge dem möjligheten att hämta och införliva extern kunskap. Istället för att enbart förlita sig på sin förutbildade kunskap tillåter RAG modeller att hämta data från dokument, databaser och mer. Modellen integrerar sedan skickligt denna externa information i sin genererade text. Genom att hämta kontextrelevant data kan modellen ge informerade, uppdaterade svar skräddarsydda för ditt användningsfall. Kunskapsförstärkningen minskar också sannolikheten för hallucinationer och felaktig eller meningslös text. Med RAG blir grundmodeller anpassningsbara experter som utvecklas i takt med att din kunskapsbas växer.

Idag är vi glada över att kunna presentera tre generativa AI-demos, licensierade under MIT-0-licens:

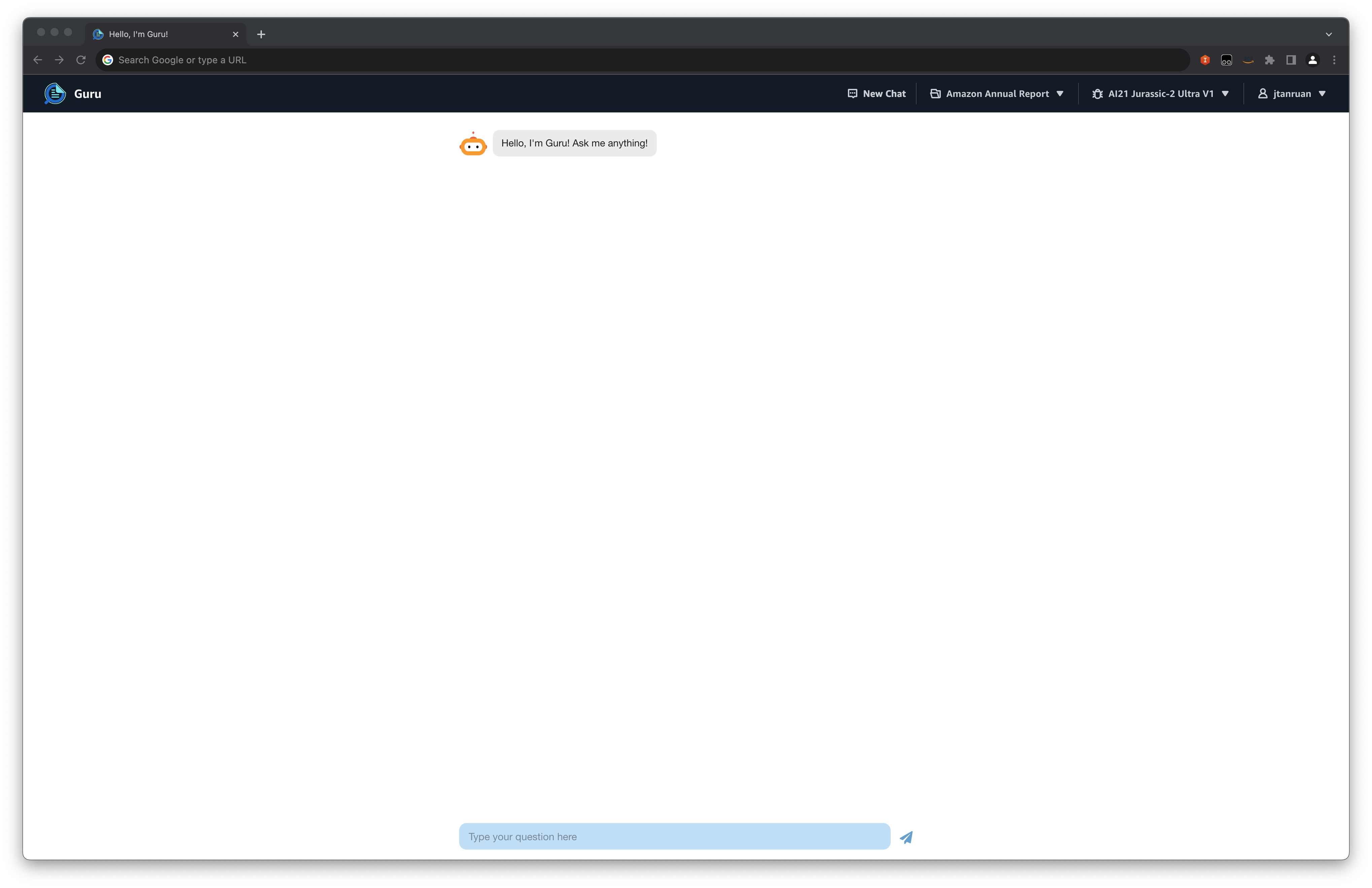

- Amazon Kendra med grundläggande LLM – Använder djupsökningsfunktionerna hos Amazon Kendra kombinerat med den omfattande kunskapen om LLM. Denna integration ger exakta och sammanhangsmedvetna svar på komplexa frågor genom att hämta från en mängd olika källor.

- Inbäddningsmodell med grundläggande LLM – Slår samman kraften hos inbäddningar – en teknik för att fånga semantiska betydelser av ord och fraser – med den stora kunskapsbasen av LLM. Denna synergi möjliggör mer exakt ämnesmodellering, innehållsrekommendationer och semantiska sökmöjligheter.

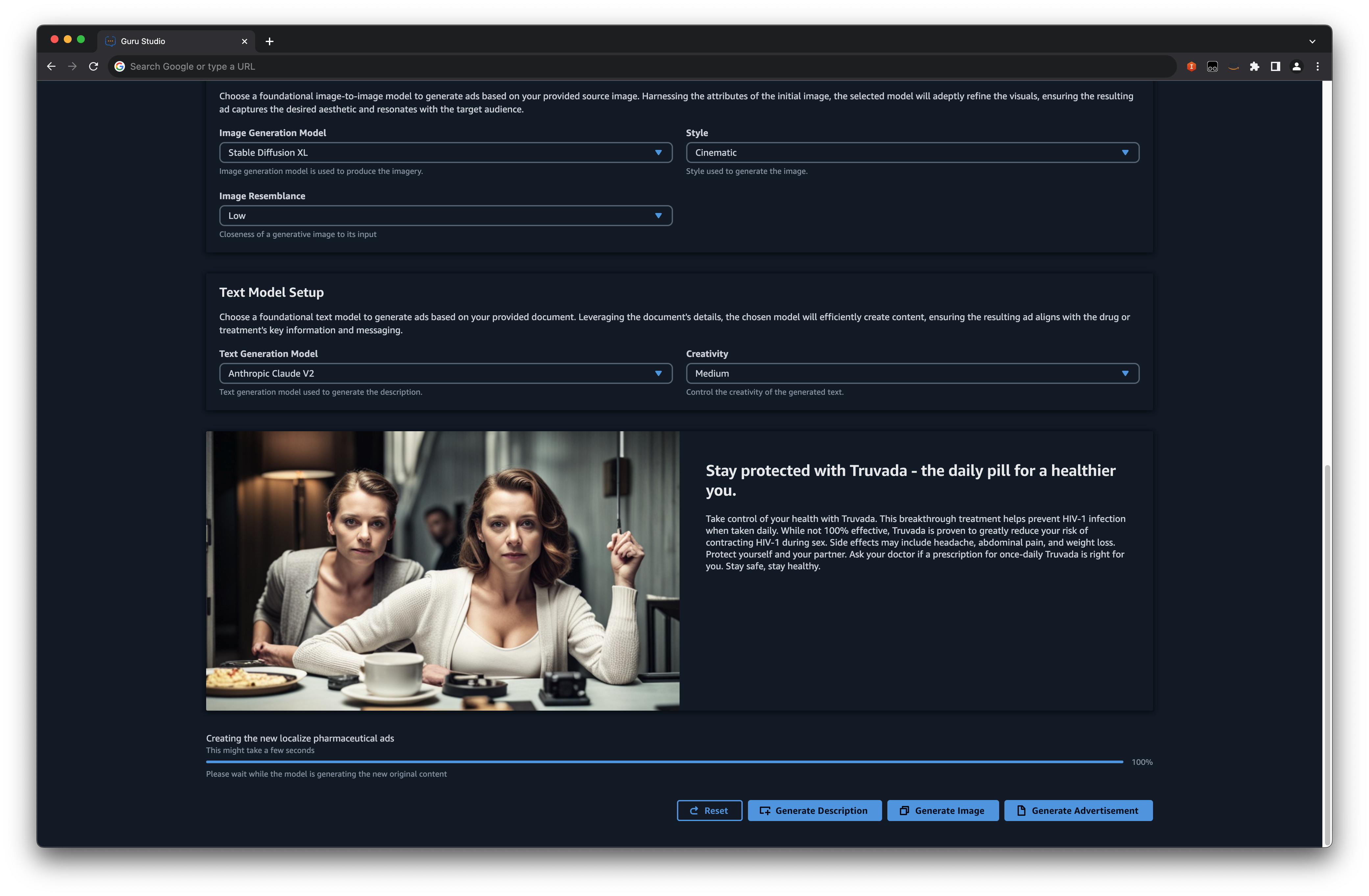

- Foundation Models Pharma Ad Generator – En specialiserad applikation skräddarsydd för läkemedelsindustrin. Genom att utnyttja grundmodellernas generativa kapacitet skapar detta verktyg övertygande och kompatibla läkemedelsannonser, vilket säkerställer att innehållet följer branschstandarder och föreskrifter.

Dessa demos kan sömlöst distribueras i ditt AWS-konto, och erbjuder grundläggande insikter och vägledning om hur du använder AWS-tjänster för att skapa en toppmodern LLM-generativ AI-fråga och -svar-bot och innehållsgenerering.

I det här inlägget undersöker vi hur RAG i kombination med Amazon Kendra eller anpassade inbäddningar kan övervinna dessa utmaningar och ge raffinerade svar på naturliga språkfrågor.

Lösningsöversikt

Genom att använda den här lösningen kan du få följande fördelar:

- Förbättrad informationsåtkomst – RAG tillåter modeller att hämta information från stora externa källor, vilket kan vara särskilt användbart när den förutbildade modellens kunskap är föråldrad eller ofullständig.

- skalbarhet – Istället för att träna en modell på all tillgänglig data, tillåter RAG modellerna att hämta relevant information i farten. Detta innebär att när ny data blir tillgänglig kan den läggas till i hämtningsdatabasen utan att behöva träna om hela modellen.

- Minneseffektivitet – LLM kräver betydande minne för att lagra parametrar. Med RAG kan modellen vara mindre eftersom den inte behöver memorera alla detaljer; den kan hämta dem när det behövs.

- Dynamisk kunskapsuppdatering – Till skillnad från konventionella modeller med en fast kunskapsändpunkt kan RAG:s externa databas genomgå regelbundna uppdateringar, vilket ger modellen tillgång till aktuell information. Hämtningsfunktionen kan finjusteras för distinkta uppgifter. Till exempel kan en medicinsk diagnostisk uppgift hämta data från medicinska tidskrifter, vilket säkerställer att modellen får experter och relevanta insikter.

- Biasreducering – Möjligheten att dra från en välutvecklad databas erbjuder potentialen att minimera fördomar genom att säkerställa balanserade och opartiska externa källor.

Innan du dyker in i integrationen av Amazon Kendra med grundläggande LLM:er är det avgörande att utrusta dig själv med de nödvändiga verktygen och systemkraven. Att ha rätt inställning på plats är det första steget mot en sömlös distribution av demos.

Förutsättningar

Du måste ha följande förutsättningar:

Även om det är möjligt att konfigurera och distribuera infrastrukturen som beskrivs i denna handledning från din lokala dator, AWS Cloud9 erbjuder ett bekvämt alternativ. Förutrustad med verktyg som AWS CLI, AWS CDK och Docker, kan AWS Cloud9 fungera som din distributionsarbetsstation. För att använda denna tjänst, helt enkelt skapa miljön via AWS Cloud9-konsol.

Med förutsättningarna ur vägen, låt oss dyka in i funktionerna och kapaciteterna hos Amazon Kendra med grundläggande LLM:er.

Amazon Kendra med grundläggande LLM

Amazon Kendra är en avancerad söktjänst för företag som förbättras av maskininlärning (ML) som tillhandahåller semantiska sökfunktioner direkt. Genom att använda naturlig språkbehandling (NLP), förstår Amazon Kendra både innehållet i dokument och den underliggande avsikten med användarfrågor, och positionerar det som ett verktyg för innehållshämtning för RAG-baserade lösningar. Genom att använda sökinnehållet från Kendra med hög precision som en RAG-nyttolast kan du få bättre LLM-svar. Användningen av Amazon Kendra i den här lösningen möjliggör också personlig sökning genom att filtrera svar enligt slutanvändarnas behörigheter för innehållsåtkomst.

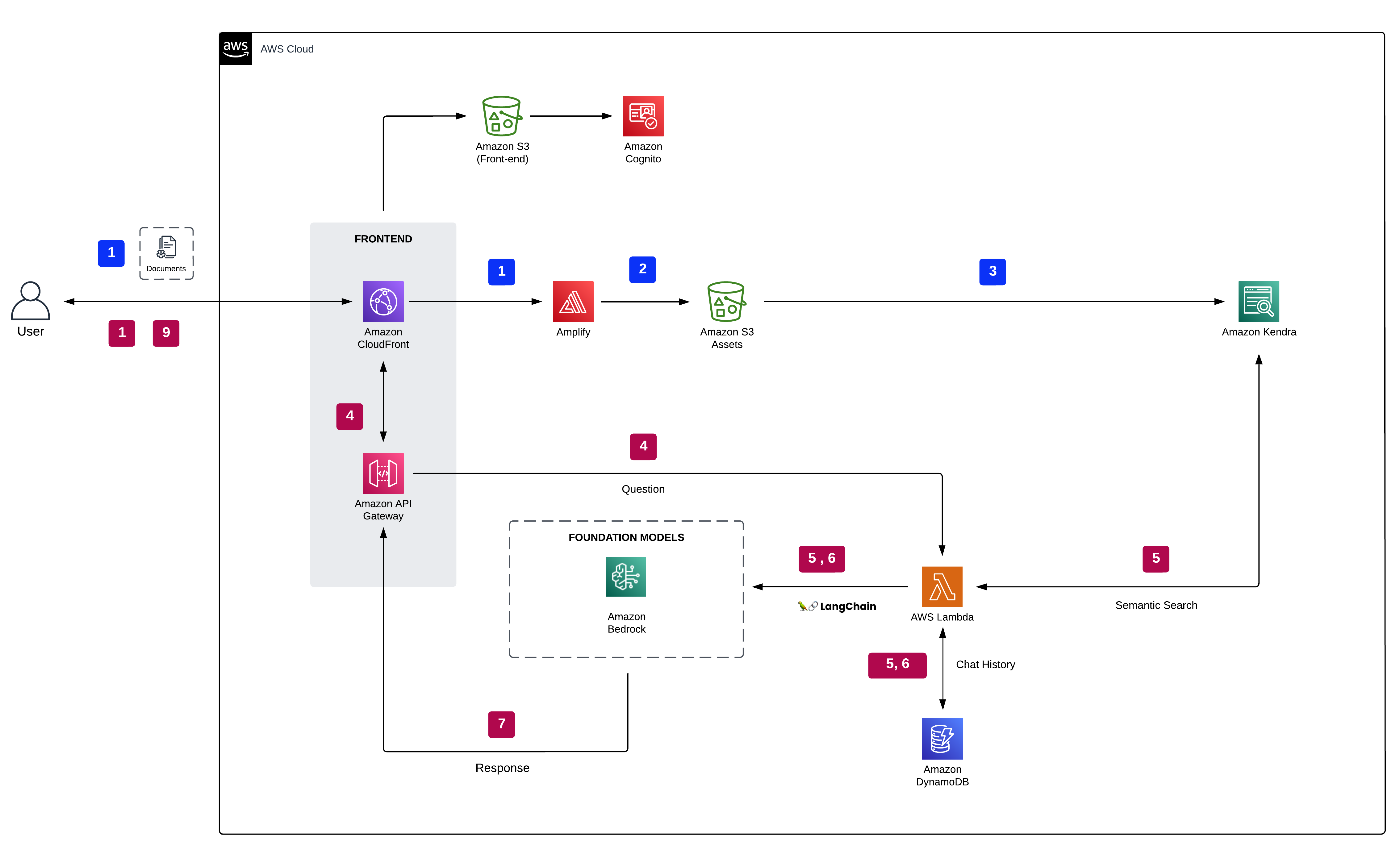

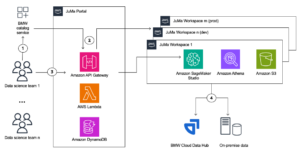

Följande diagram visar arkitekturen för en generativ AI-applikation som använder RAG-metoden.

Dokument bearbetas och indexeras av Amazon Kendra genom Amazon Simple Storage Service (Amazon S3) kontakt. Kundförfrågningar och kontextuell data från Amazon Kendra riktas till en Amazonas berggrund grundmodell. Demot låter dig välja mellan Amazons Titan, AI21s Jurassic och Anthropics Claude-modeller som stöds av Amazon Bedrock. Konversationshistoriken sparas i Amazon DynamoDB, som erbjuder extra sammanhang för LLM att generera svar.

Vi har tillhandahållit denna demo i GitHub repo. Se installationsinstruktionerna i readme-filen för att distribuera den till ditt AWS-konto.

Följande steg beskriver processen när en användare interagerar med den generativa AI-appen:

- Användaren loggar in på webbappen som autentiserats av Amazon Cognito.

- Användaren laddar upp ett eller flera dokument till Amazon S3.

- Användaren kör ett Amazon Kendra-synkroniseringsjobb för att mata in S3-dokument i Amazon Kendra-index.

- Användarens fråga dirigeras genom ett säkert WebSocket API som finns på Amazon API Gateway stöds av en AWS Lambda funktion.

- Lambdafunktionen, bemyndigad av Langkedja framework – ett mångsidigt verktyg designat för att skapa applikationer som drivs av AI-språkmodeller – ansluter till Amazon Bedrock-slutpunkten för att omformulera användarens fråga baserat på chatthistorik. Efter omformulering skickas frågan vidare till Amazon Kendra med hjälp av Retrieve API. Som svar visar Amazon Kendra-index sökresultat och ger utdrag från relevanta dokument som kommer från företagets intagna data.

- Användarens fråga tillsammans med data som hämtas från indexet skickas som ett sammanhang i LLM-prompten. Svaret från LLM lagras som chatthistorik i DynamoDB.

- Slutligen skickas svaret från LLM tillbaka till användaren.

Arbetsflöde för dokumentindexering

Följande är proceduren för bearbetning och indexering av dokument:

- Användare skickar in dokument via användargränssnittet (UI).

- Dokument överförs till en S3-hink med hjälp av AWS förstärka API.

- Amazon Kendra indexerar nya dokument i S3-hinken genom Amazon Kendra S3-kontakten.

Fördelar

Följande lista visar fördelarna med denna lösning:

- Hämtning på företagsnivå – Amazon Kendra är designad för företagssökning, vilket gör den lämplig för organisationer med stora mängder strukturerad och ostrukturerad data.

- Semantisk förståelse – ML-funktionerna hos Amazon Kendra säkerställer att hämtning baseras på djup semantisk förståelse och inte bara sökordsmatchningar.

- skalbarhet – Amazon Kendra kan hantera storskaliga datakällor och ger snabba och relevanta sökresultat.

- Flexibilitet – Grundmodellen kan generera svar baserade på ett brett spektrum av sammanhang, vilket säkerställer att systemet förblir mångsidigt.

- Integrationsmöjligheter – Amazon Kendra kan integreras med olika AWS-tjänster och datakällor, vilket gör den anpassningsbar för olika organisationsbehov.

Inbäddningsmodell med grundläggande LLM

An inbäddning är en numerisk vektor som representerar kärnan i olika datatyper, inklusive text, bilder, ljud och dokument. Denna representation fångar inte bara datas inneboende betydelse, utan anpassar den också för ett brett spektrum av praktiska tillämpningar. Inbäddningsmodeller, en gren av ML, omvandlar komplexa data, såsom ord eller fraser, till kontinuerliga vektorrum. Dessa vektorer förstår i sig de semantiska sambanden mellan data, vilket möjliggör djupare och mer insiktsfulla jämförelser.

RAG kombinerar sömlöst styrkorna hos grundläggande modeller, som transformatorer, med precisionen hos inbäddningar för att sålla genom stora databaser för relevant information. Vid mottagande av en förfrågan använder systemet inbäddningar för att identifiera och extrahera relevanta avsnitt från en omfattande mängd data. Grundmodellen formulerar sedan ett kontextuellt exakt svar baserat på denna extraherade information. Denna perfekta synergi mellan datahämtning och svarsgenerering gör att systemet kan ge grundliga svar, med hjälp av den enorma kunskap som finns lagrad i expansiva databaser.

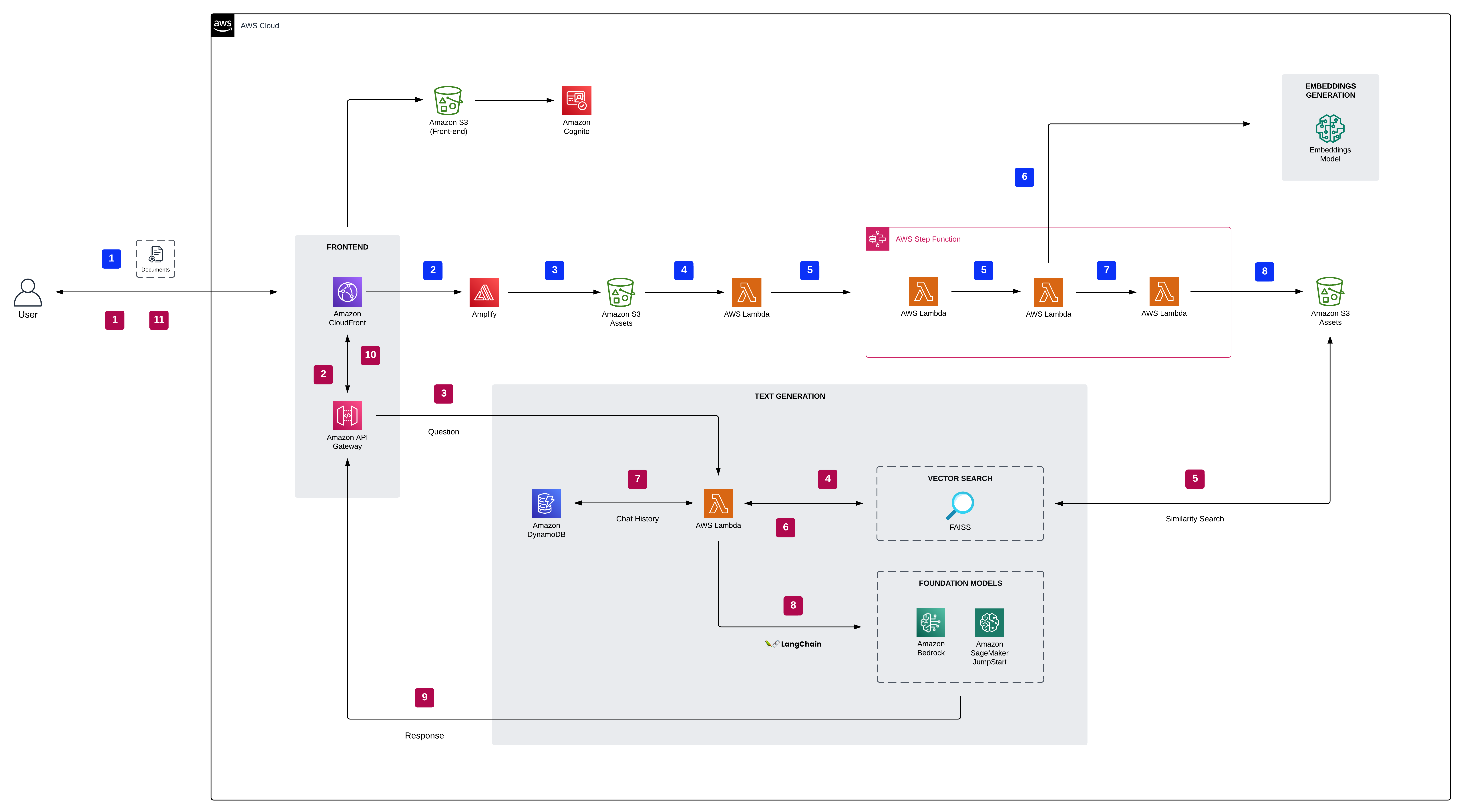

I den arkitektoniska layouten, baserat på deras UI-val, guidas användarna till antingen Amazonas berggrund eller Amazon SageMaker JumpStart grundmodeller. Dokument genomgår bearbetning och vektorinbäddningar produceras av inbäddningsmodellen. Dessa inbäddningar indexeras sedan med hjälp av FAISS för att möjliggöra effektiv semantisk sökning. Konversationshistorik bevaras i DynamoDB, vilket berikar sammanhanget för LLM för att skapa svar.

Följande diagram illustrerar lösningsarkitekturen och arbetsflödet.

Vi har tillhandahållit denna demo i GitHub repo. Se installationsinstruktionerna i readme-filen för att distribuera den till ditt AWS-konto.

Inbäddningsmodell

Ansvaret för inbäddningsmodellen är följande:

- Denna modell är ansvarig för att konvertera text (som dokument eller passager) till täta vektorrepresentationer, vanligtvis känd som inbäddningar.

- Dessa inbäddningar fångar textens semantiska betydelse, vilket möjliggör effektiva och semantiskt meningsfulla jämförelser mellan olika textstycken.

- Inbäddningsmodellen kan tränas på samma stora korpus som grundmodellen eller kan vara specialiserad för specifika domäner.

Frågor och svar arbetsflöde

Följande steg beskriver arbetsflödet för frågans svar över dokument:

- Användaren loggar in på webbappen som är autentiserad av Amazon Cognito.

- Användaren laddar upp ett eller flera dokument till Amazon S3.

- Vid dokumentöverföring utlöser ett S3-händelsemeddelande en Lambda-funktion, som sedan anropar SageMaker inbäddningsmodellens slutpunkt för att generera inbäddningar för det nya dokumentet. Inbäddningsmodellen omvandlar frågan till en tät vektorrepresentation (inbäddning). Den resulterande vektorfilen förvaras säkert i S3-hinken.

- FAISS retriever jämför denna fråga inbäddning med inbäddning av alla dokument eller passager i databasen för att hitta de mest relevanta passagerna.

- Passagen, tillsammans med användarens fråga, tillhandahålls som sammanhang till grundmodellen. Lambda-funktionen använder LangChain-biblioteket och ansluter till Amazon Bedrock eller SageMaker JumpStart-slutpunkten med en kontextfylld fråga.

- Svaret från LLM lagras i DynamoDB tillsammans med användarens fråga, tidsstämpeln, en unik identifierare och andra godtyckliga identifierare för objektet såsom frågekategori. Genom att lagra frågan och svaret som diskreta objekt kan Lambda-funktionen enkelt återskapa en användares konversationshistorik baserat på den tidpunkt då frågorna ställdes.

- Slutligen skickas svaret tillbaka till användaren via en HTTPs-begäran via API Gateway WebSocket API-integreringssvaret.

Fördelar

Följande lista beskriver fördelarna med denna lösning:

- Semantisk förståelse – Inbäddningsmodellen säkerställer att retrievern väljer passager baserat på djup semantisk förståelse, inte bara sökordsmatchningar.

- skalbarhet – Inbäddningar möjliggör effektiva likhetsjämförelser, vilket gör det möjligt att snabbt söka igenom stora databaser med dokument.

- Flexibilitet – Grundmodellen kan generera svar baserade på ett brett spektrum av sammanhang, vilket säkerställer att systemet förblir mångsidigt.

- Domänanpassningsförmåga – Inbäddningsmodellen kan tränas eller finjusteras för specifika domäner, vilket gör att systemet kan anpassas för olika applikationer.

Foundation Models Pharma Ad Generator

I dagens snabba läkemedelsindustri är effektiv och lokaliserad reklam mer avgörande än någonsin. Det är här en innovativ lösning kommer in i bilden som använder kraften hos generativ AI för att skapa lokaliserade läkemedelsannonser från källbilder och PDF-filer. Förutom att bara påskynda annonsgenereringsprocessen, effektiviserar detta tillvägagångssätt den medicinska juridiska granskningen (MLR). MLR är en rigorös granskningsmekanism där medicinska, juridiska och regulatoriska team noggrant utvärderar reklammaterial för att garantera deras noggrannhet, vetenskapliga stöd och regelefterlevnad. Traditionella metoder för att skapa innehåll kan vara besvärliga och kräver ofta manuella justeringar och omfattande granskningar för att säkerställa anpassning till regional efterlevnad och relevans. Men med intåget av generativ AI kan vi nu automatisera framställningen av annonser som verkligen resonerar med lokal publik, samtidigt som vi upprätthåller stränga standarder och riktlinjer.

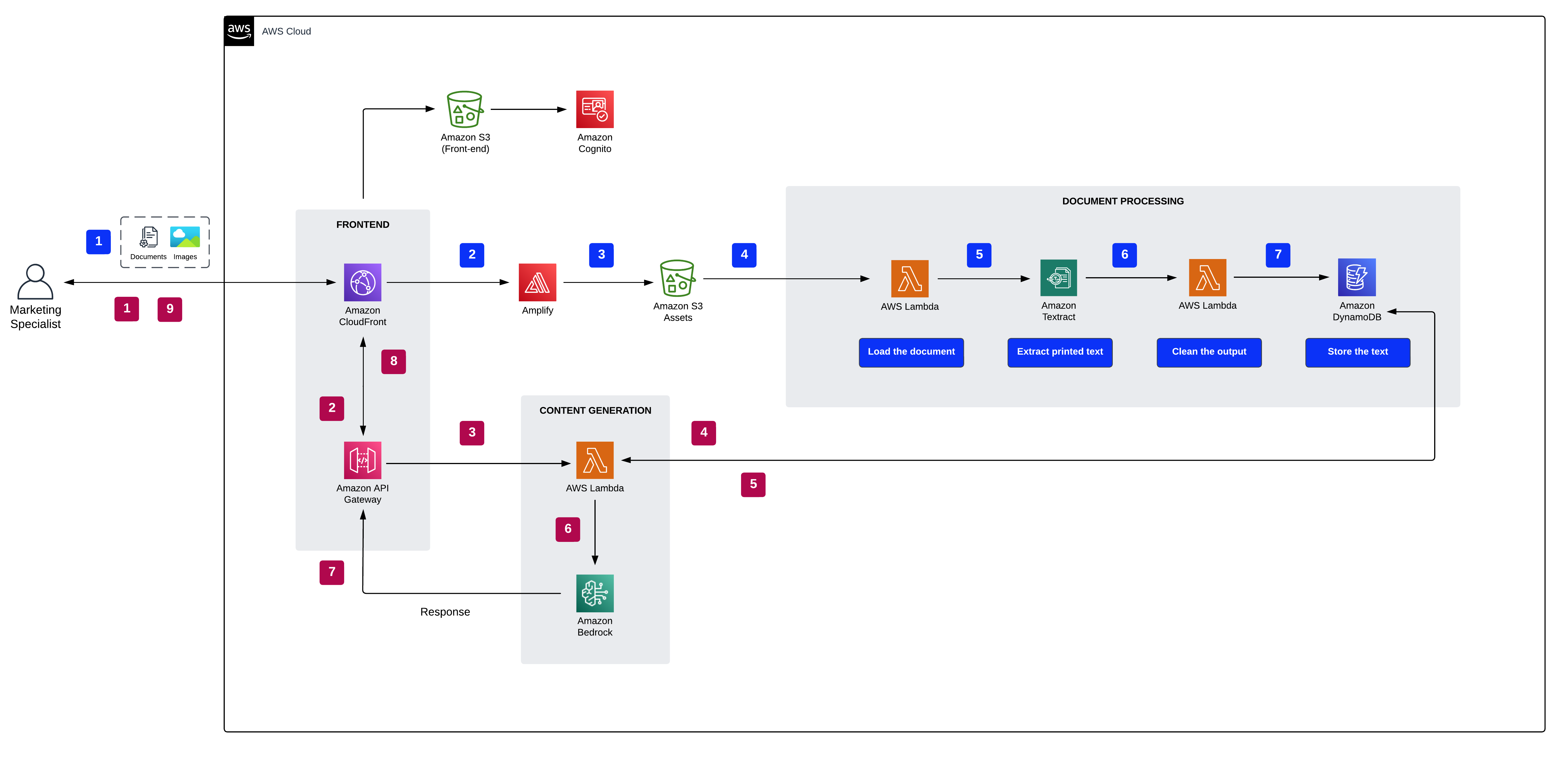

Följande diagram illustrerar lösningsarkitekturen.

I den arkitektoniska layouten, baserat på deras valda modell och annonspreferenser, guidas användare sömlöst till Amazon Bedrock-fundamentmodellerna. Detta strömlinjeformade tillvägagångssätt säkerställer att nya annonser genereras exakt enligt den önskade konfigurationen. Som en del av processen hanteras dokument effektivt av amazontext, med den resulterande texten säkert lagrad i DynamoDB. En utmärkande funktion är den modulära designen för bild- och textgenerering, vilket ger dig flexibiliteten att självständigt regenerera vilken komponent som helst efter behov.

Vi har tillhandahållit denna demo i GitHub repo. Se installationsinstruktionerna i readme-filen för att distribuera den till ditt AWS-konto.

Arbetsflöde för innehållsgenerering

Följande steg beskriver processen för innehållsgenerering:

- Användaren väljer sitt dokument, källbild, annonsplacering, språk och bildstil.

- Säker åtkomst till webbapplikationen säkerställs genom Amazon Cognito-autentisering.

- Webbapplikationens frontend är värd via Amplify.

- En WebSocket API, som hanteras av API Gateway, underlättar användarförfrågningar. Dessa förfrågningar är autentiserade genom AWS identitets- och åtkomsthantering (JAG ÄR).

- Integration med Amazon Bedrock inkluderar följande steg:

- En Lambda-funktion använder LangChain-biblioteket för att ansluta till Amazon Bedrock-slutpunkten med hjälp av en kontextrik fråga.

- Grundmodellen text-till-text skapar en kontextuellt lämplig annons baserat på det givna sammanhanget och inställningarna.

- Grundmodellen text-till-bild skapar en skräddarsydd bild, påverkad av källbilden, vald stil och plats.

- Användaren tar emot svaret via en HTTPS-förfrågan via den integrerade API Gateway WebSocket API.

Arbetsflöde för dokument- och bildbehandling

Följande är proceduren för att behandla dokument och bilder:

- Användaren laddar upp tillgångar via det angivna användargränssnittet.

- Amplify API överför dokumenten till en S3-hink.

- Efter att tillgången har överförts till Amazon S3 sker en av följande åtgärder:

- Om det är ett dokument använder en Lambda-funktion Amazon Textract för att bearbeta och extrahera text för annonsgenerering.

- Om det är en bild konverterar Lambda-funktionen den till base64-format, lämpligt för stabil diffusionsmodell för att skapa en ny bild från källan.

- Den extraherade texten eller base64-bildsträngen sparas säkert i DynamoDB.

Fördelar

Följande lista beskriver fördelarna med denna lösning:

- Effektivitet (CT-värde) – Användningen av generativ AI påskyndar avsevärt annonsgenereringsprocessen, vilket eliminerar behovet av manuella justeringar.

- Efterlevnad av efterlevnad – Lösningen säkerställer att genererade annonser följer specifika riktlinjer och regler, såsom FDA:s riktlinjer för marknadsföring.

- Kostnadseffektiv – Genom att automatisera skapandet av skräddarsydda annonser kan företag avsevärt minska kostnaderna i samband med annonsproduktion och revisioner.

- Effektiviserad MLR-process – Lösningen förenklar MLR-processen, minskar friktionspunkter och säkerställer smidigare granskningar.

- Lokaliserad resonans – Generativ AI producerar annonser som resonerar med lokal publik, vilket säkerställer relevans och genomslag i olika regioner.

- Standardisering – Lösningen upprätthåller nödvändiga standarder och riktlinjer, vilket säkerställer konsekvens över alla genererade annonser.

- skalbarhet – Det AI-drivna tillvägagångssättet kan hantera stora databaser med källbilder och PDF-filer, vilket gör det möjligt för storskalig annonsgenerering.

- Minskat manuellt ingrepp – Automatiseringen minskar behovet av mänskligt ingripande, minimerar fel och säkerställer konsekvens.

Du kan distribuera infrastrukturen i den här handledningen från din lokala dator eller så kan du använda AWS Cloud9 som din distributionsarbetsstation. AWS Cloud9 kommer förinstallerat med AWS CLI, AWS CDK och Docker. Om du väljer AWS Cloud9, skapa miljön från AWS Cloud9-konsol.

Städa upp

För att undvika onödiga kostnader, rensa upp all infrastruktur som skapats via AWS CloudFormation-konsolen eller genom att köra följande kommando på din arbetsstation:

Kom dessutom ihåg att stoppa alla SageMaker-slutpunkter som du initierade via SageMaker-konsolen. Kom ihåg, att ta bort ett Amazon Kendra-index tar inte bort originaldokumenten från din lagring.

Slutsats

Generativ AI, symboliserad av LLM:er, förebådar ett paradigmskifte i hur vi får tillgång till och genererar information. Även om dessa modeller är kraftfulla, är de ofta begränsade av deras träningsdata. RAG tar sig an denna utmaning och säkerställer att den stora kunskapen inom dessa modeller konsekvent fylls på med relevanta, aktuella insikter.

Våra RAG-baserade demos ger ett konkret bevis på detta. De visar upp den sömlösa synergin mellan Amazon Kendra, vektorinbäddningar och LLMs, vilket skapar ett system där informationen inte bara är omfattande utan också korrekt och aktuell. När du dyker in i dessa demos kommer du att utforska transformationspotentialen i att slå samman förutbildad kunskap med RAGs dynamiska kapacitet, vilket resulterar i resultat som är både pålitliga och skräddarsydda för företagsinnehåll.

Även om generativ AI som drivs av LLM:er öppnar upp ett nytt sätt att få informationsinsikter, måste dessa insikter vara pålitliga och begränsas till företagsinnehåll med RAG-metoden. Dessa RAG-baserade demos gör att du kan utrustas med insikter som är korrekta och uppdaterade. Kvaliteten på dessa insikter är beroende av semantisk relevans, vilket möjliggörs genom att använda Amazon Kendra och vektorinbäddningar.

Om du är redo att ytterligare utforska och utnyttja kraften i generativ AI, här är dina nästa steg:

- Engagera dig med våra demos – Den praktiska erfarenheten är ovärderlig. Utforska funktionerna, förstå integrationerna och bekanta dig med gränssnittet.

- Fördjupa dina kunskaper – Dra nytta av de resurser som finns. AWS erbjuder djupgående dokumentation, tutorials och communitysupport för att underlätta din AI-resa.

- Inleda ett pilotprojekt – Överväg att börja med en småskalig implementering av generativ AI i ditt företag. Detta kommer att ge insikter i systemets praktiska funktion och anpassningsförmåga inom ditt specifika sammanhang.

För mer information om generativa AI-applikationer på AWS, se följande:

Kom ihåg att AI-landskapet ständigt utvecklas. Håll dig uppdaterad, förbli nyfiken och var alltid redo att anpassa och förnya dig.

Om Författarna

Jin Tan Ruan är en Prototyping-utvecklare inom AWS Industries Prototyping and Customer Engineering (PACE) team, specialiserad på NLP och generativ AI. Med en bakgrund inom mjukvaruutveckling och nio AWS-certifieringar tar Jin med sig en mängd erfarenhet för att hjälpa AWS-kunder att materialisera sina AI/ML och generativa AI-visioner med hjälp av AWS-plattformen. Han har en magisterexamen i datavetenskap och mjukvaruteknik från University of Syracuse. Utanför jobbet tycker Jin om att spela tv-spel och fördjupa sig i skräckfilmernas spännande värld.

Jin Tan Ruan är en Prototyping-utvecklare inom AWS Industries Prototyping and Customer Engineering (PACE) team, specialiserad på NLP och generativ AI. Med en bakgrund inom mjukvaruutveckling och nio AWS-certifieringar tar Jin med sig en mängd erfarenhet för att hjälpa AWS-kunder att materialisera sina AI/ML och generativa AI-visioner med hjälp av AWS-plattformen. Han har en magisterexamen i datavetenskap och mjukvaruteknik från University of Syracuse. Utanför jobbet tycker Jin om att spela tv-spel och fördjupa sig i skräckfilmernas spännande värld.

Aravind Kodandaramaiah är en Senior Prototyping full stack-lösningsbyggare inom AWS Industries Prototyping and Customer Engineering (PACE) team. Han fokuserar på att hjälpa AWS-kunder att omvandla innovativa idéer till lösningar med mätbara och förtjusande resultat. Han brinner för en rad ämnen, inklusive molnsäkerhet, DevOps och AI/ML, och kan vanligtvis hittas mixtra med dessa tekniker.

Aravind Kodandaramaiah är en Senior Prototyping full stack-lösningsbyggare inom AWS Industries Prototyping and Customer Engineering (PACE) team. Han fokuserar på att hjälpa AWS-kunder att omvandla innovativa idéer till lösningar med mätbara och förtjusande resultat. Han brinner för en rad ämnen, inklusive molnsäkerhet, DevOps och AI/ML, och kan vanligtvis hittas mixtra med dessa tekniker.

Arjun Shakdher är en utvecklare på AWS Industries Prototyping-teamet (PACE) som brinner för att blanda in teknologi i livets struktur. Med en magisterexamen från Purdue University, kretsar Arjuns nuvarande roll kring arkitektur och konstruktion av banbrytande prototyper som spänner över en rad olika domäner, för närvarande med en framträdande roll inom AI/ML och IoT. När du inte är nedsänkt i kod och digitala landskap, kommer du att se Arjun hänge sig åt kaffevärlden, utforska den invecklade mekaniken i horologin eller frossa i bilarnas konstnärskap.

Arjun Shakdher är en utvecklare på AWS Industries Prototyping-teamet (PACE) som brinner för att blanda in teknologi i livets struktur. Med en magisterexamen från Purdue University, kretsar Arjuns nuvarande roll kring arkitektur och konstruktion av banbrytande prototyper som spänner över en rad olika domäner, för närvarande med en framträdande roll inom AI/ML och IoT. När du inte är nedsänkt i kod och digitala landskap, kommer du att se Arjun hänge sig åt kaffevärlden, utforska den invecklade mekaniken i horologin eller frossa i bilarnas konstnärskap.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :är

- :inte

- :var

- $UPP

- 100

- 150

- 7

- a

- förmåga

- Om oss

- accelererar

- tillgång

- Enligt

- Konto

- noggrannhet

- exakt

- tvärs

- åtgärder

- Ad

- anpassa

- anpassar sig

- lagt till

- adresser

- anslutit sig

- justeringar

- Anta

- annonser

- avancerat

- Fördel

- fördelar

- första advent

- reklam

- Efter

- AI

- AI / ML

- Stöd

- uppriktning

- Alla

- tillåter

- tillåta

- tillåter

- nästan

- längs

- också

- alternativ

- alltid

- amason

- Amazon Cognito

- Amazon Kendra

- amazontext

- Amazon Web Services

- mängder

- förstärka

- an

- och

- svara

- svar

- vilken som helst

- api

- app

- Ansökan

- tillämpningar

- tillvägagångssätt

- lämpligt

- arkitektoniska

- arkitektur

- ÄR

- runt

- array

- artisteri

- AS

- tillgång

- Tillgångar

- bistå

- associerad

- målgrupper

- audio

- authenticated

- Autentisering

- automatisera

- automatisera

- Automation

- tillgänglig

- undvika

- undvika

- AWS

- AWS Cloud9

- AWS molnformation

- tillbaka

- dragen tillbaka

- bakgrund

- stöd

- bas

- baserat

- BE

- därför att

- blir

- blir

- Fördelarna

- Bättre

- mellan

- Bortom

- förspänner

- blandning

- kropp

- Bot

- båda

- Branch

- Bringar

- bred

- byggare

- Byggnad

- men

- by

- Samtal

- KAN

- Kan få

- kapacitet

- fånga

- fångar

- Vid

- Kategori

- certifieringar

- utmanar

- utmaningar

- Välja

- valda

- rena

- cloud

- Cloud Security

- Cloud9

- koda

- Kaffe

- kombinerad

- kombinerar

- kommer

- vanligen

- samfundet

- Företag

- jämförelser

- komplex

- Efterlevnad

- kompatibel

- komponent

- förstår

- dator

- Datavetenskap

- konfiguration

- Kontakta

- Anslutningar

- ansluter

- Tänk

- konsekvent

- Konsol

- ständigt

- innehåll

- Innehållsgenerering

- innehållsskapande

- sammanhang

- kontexter

- kontextuella

- fortsatte

- kontinuerlig

- Bekväm

- konventionell

- Konversation

- omvandling

- Kärna

- Pris

- Kostar

- farkoster

- skapa

- skapas

- skapar

- Skapa

- skapande

- avgörande

- besvärlig

- nyfiken

- Aktuella

- beställnings

- kund

- Kunder

- allra senaste

- datum

- Databas

- databaser

- datauppsättningar

- Datum

- djup

- djupare

- Examen

- förtjusande

- demo

- demos

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- beskriva

- Designa

- utformade

- önskas

- förstöra

- detaljerad

- detaljer

- Utvecklare

- Utveckling

- diagnostik

- olika

- Diffusion

- digital

- riktad

- displayer

- distinkt

- Dyk

- flera

- dykning

- Hamnarbetare

- dokumentera

- dokumentation

- dokument

- inte

- domäner

- dra

- ritning

- driven

- dynamisk

- lätt

- effektivitet

- effektiv

- effektivt

- antingen

- eliminera

- inbäddning

- framträda

- sysselsätter

- befogenhet

- bemyndigar

- möjliggöra

- aktiverad

- möjliggör

- möjliggör

- änden

- Slutpunkt

- Teknik

- förbättrad

- berikande

- säkerställa

- säker

- säkerställer

- säkerställa

- Företag

- Hela

- utrustad

- fel

- speciellt

- huvudsak

- utvärdera

- händelse

- NÅGONSIN

- utvecklas

- utvecklas

- exempel

- exciterade

- expansiv

- erfarenhet

- expert

- experter

- utforska

- Utforska

- omfattande

- extern

- extrahera

- tyg

- underlättar

- Bekanta

- snabb

- FB

- möjlig

- Leverans

- Funktioner

- Med

- Fil

- filtrering

- hitta

- Förnamn

- Flexibilitet

- fokuserar

- efter

- följer

- För

- format

- hittade

- fundament

- friktion

- från

- främre

- främre ände

- full

- Full stack

- fungera

- funktionaliteter

- ytterligare

- Vidare

- Få

- få

- Games

- nätbryggan

- generera

- genereras

- generering

- generativ

- Generativ AI

- Generatorn

- skaffa sig

- ges

- Ge

- beviljande

- grepp

- Växer

- garanti

- vägleda

- guidad

- riktlinjer

- hantera

- praktisk

- sele

- Utnyttja

- Har

- har

- he

- hjälpa

- förebådar

- här.

- höjdpunkter

- han själv

- historier

- historia

- innehav

- innehar

- fasa

- värd

- Hur ser din drömresa ut

- Men

- html

- http

- HTTPS

- humant

- idéer

- identifierare

- identifierare

- identifiera

- Identitet

- if

- illustrerar

- bild

- bilder

- nedsänkt

- Inverkan

- genomförande

- in

- djupgående

- felaktig

- innefattar

- Inklusive

- införliva

- oberoende av

- index

- indexeras

- index

- industrier

- industrin

- industristandarder

- påverkas

- informationen

- informeras

- Infrastruktur

- inneboende

- inledande

- initieras

- förnya

- innovativa

- insiktsfull

- insikter

- istället

- instruktioner

- integrerade

- integrerar

- integrering

- integrationer

- uppsåt

- interagerar

- Gränssnitt

- ingripande

- in

- inneboende

- ovärderlig

- iot

- IT

- artikel

- DESS

- Jobb

- resa

- jpg

- bara

- kunskap

- känd

- liggande

- språk

- Large

- storskalig

- Layout

- inlärning

- Adress

- Lets

- Bibliotek

- Licensierade

- livet

- tycka om

- sannolikhet

- Begränsad

- gränser

- Lista

- LLM

- lokal

- läge

- Maskinen

- maskininlärning

- upprätthåller

- Framställning

- förvaltade

- manuell

- många

- Marknadsföring

- massiv

- master

- tändstickor

- material

- betyder

- meningsfull

- betydelser

- betyder

- mekanik

- mekanism

- medicinsk

- Minne

- endast

- går samman

- sammanslagning

- metoder

- noggrant

- minimerande

- begränsning

- ML

- modell

- modellering

- modeller

- modulära

- mer

- mest

- Filmer

- måste

- Natural

- Naturlig språkbehandling

- nödvändigt för

- Behöver

- behövs

- behöver

- behov

- Nya

- Nästa

- nio

- nlp

- anmälan

- nu

- of

- erbjuda

- Erbjudanden

- Ofta

- on

- ONE

- endast

- öppnas

- or

- organisatoriska

- organisationer

- ursprungliga

- Övriga

- vår

- ut

- utfall

- översikt

- utgångar

- utanför

- över

- Övervinna

- Fred

- paradigmet

- parametrar

- del

- brinner

- perfekt

- behörigheter

- personlig

- Pharma

- Läkemedelsindustrin

- fraser

- bitar

- Föraren

- pilotprojekt

- Plats

- placering

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Spela

- i

- poäng

- positionering

- möjlig

- Inlägg

- potentiell

- kraft

- drivs

- den mäktigaste

- Praktisk

- exakt

- exakt

- Precision

- preferenser

- förutsättningar

- nuvarande

- förfaranden

- process

- Bearbetad

- bearbetning

- producerad

- producerar

- Produktion

- projektet

- PR

- prototyper

- prototyping

- Bevisa

- ge

- förutsatt

- ger

- tillhandahålla

- kvalitet

- sökfrågor

- fråga

- frågor

- Snabbt

- snabbt

- område

- redo

- sfärer

- erhåller

- mottagande

- Rekommendation

- minska

- minskar

- reducerande

- hänvisa

- raffinerade

- regionala

- regioner

- regelbunden

- föreskrifter

- regulatorer

- Regelefterlevnad

- relevans

- relevanta

- förlita

- förblir

- resterna

- ihåg

- ta bort

- omformulering

- representation

- representerar

- begära

- förfrågningar

- kräver

- Obligatorisk

- Krav

- resonans

- Resurser

- respons

- svar

- ansvar

- ansvarig

- resulterande

- resulterande

- Resultat

- översyn

- Omdömen

- revideringar

- kretsar

- höger

- rigorös

- Roll

- rinnande

- kör

- sagemaker

- Samma

- sparade

- Vetenskap

- vetenskaplig

- sömlös

- sömlöst

- Sök

- sektioner

- säkra

- säkert

- säkerhet

- vald

- Val

- senior

- skickas

- service

- Tjänster

- in

- inställningar

- inställning

- skifta

- visa

- Visar

- Sålla

- signifikant

- signifikant

- Enkelt

- helt enkelt

- mindre

- mjukare

- Mjukvara

- mjukvaruutveckling

- mjukvaruutveckling

- enbart

- lösning

- Lösningar

- Källa

- kommer från

- Källor

- Sourcing

- utrymmen

- span

- specialiserad

- specialiserat

- specifik

- specificerade

- stabil

- stapel

- standarder

- Starta

- state-of-the-art

- bo

- Steg

- Steg

- Sluta

- förvaring

- lagra

- lagras

- misslyckande

- strömlinjeformad

- styrkor

- Sträng

- stränga

- strukturerade

- stil

- skicka

- sådana

- lämplig

- stödja

- Som stöds

- synergi

- system

- skräddarsydd

- Ta

- tar

- påtaglig

- uppgift

- uppgifter

- grupp

- lag

- Tekniken

- Tekniken

- Teknologi

- testament

- text

- än

- den där

- Smakämnen

- Landskapet

- källan

- världen

- deras

- Dem

- sedan

- vari

- Dessa

- de

- detta

- tre

- spännande

- Genom

- tid

- tid

- tidsstämpel

- titan

- till

- dagens

- verktyg

- verktyg

- ämne

- ämnen

- mot

- traditionell

- Tåg

- tränad

- Utbildning

- överföring

- överförd

- överföringar

- Förvandla

- transformerande

- transformatorer

- Trender

- verkligen

- trovärdig

- SVÄNG

- handledning

- självstudiekurser

- typer

- ui

- genomgå

- underliggande

- förstå

- förståelse

- unika

- universitet

- till skillnad från

- onödig

- avtäcka

- TIDSENLIG

- Uppdatering

- uppdaterad

- Uppdateringar

- upprätthållande

- på

- användning

- användningsfall

- Användare

- Användargränssnitt

- användare

- användningar

- med hjälp av

- vanligen

- Återvinnare

- Använda

- olika

- Omfattande

- mångsidig

- via

- Video

- videospel

- syner

- Sätt..

- we

- Rikedom

- webb

- webbapplikation

- webbservice

- WebSocket

- były

- när

- som

- medan

- VEM

- bred

- Brett utbud

- kommer

- med

- inom

- utan

- ord

- Arbete

- arbetsflöde

- arbetsstation

- världen

- Om er

- Din

- själv

- zephyrnet