Att extrahera text från en bild kan vara en besvärlig process. De flesta knappar manuellt in texten/data från bilden; men detta är både tidskrävande och ineffektivt när du har många bilder att ta itu med.

Bild till text omvandlare erbjuder ett snyggt sätt att extrahera text från bilder.

Även om sådana verktyg gör ett bra jobb, presenteras den extraherade texten/datan ofta på ett ostrukturerat sätt som resulterar i mycket efterbearbetning.

An AI-driven OCR som Nanonets kan dra text från bilder och presentera extraherade data på ett snyggt, organiserat och strukturerat sätt.

Nanonets extraherar data från bilder exakt, i skala och på flera språk. Nanonets är den enda textigenkännings-OCR som presenterar extraherad text i snyggt strukturerade format som är helt anpassningsbara. Insamlad data kan presenteras som tabeller, rader eller något annat format.

- Klicka för att ladda upp din bild nedan

- Nanonets OCR känner automatiskt igen innehållet i din fil och konverterar det till text

- Ladda ner den extraherade texten som en råtextfil eller integrera via API

Innehållsförteckning

Här är tre avancerade metoder där du kan använda Nanonets OCR för att upptäcka och extrahera text från bilder, extrahera text från PDFs, extrahera data från PDFs eller analysera PDF-filer och andra dokumenttyper:

Behöver en gratis online OCR för bild till text, PDF till tabell, PDF till text, eller Utdrag av PDF-data? Kolla in Nanonets online OCR API i aktion och börja bygga anpassade OCR-modeller gratis!

Nanonets har förutbildade OCR-modeller för de specifika bildtyperna nedan. Varje förtränad OCR-modell är tränad att korrekt relatera text i bildtypen till ett lämpligt fält som namn, adress, datum, utgångsdatum etc. och presentera den extraherade texten på ett snyggt och organiserat sätt.

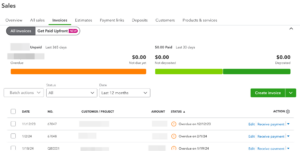

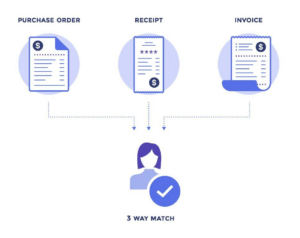

- Fakturor

- Kvitton

- Körkort (USA)

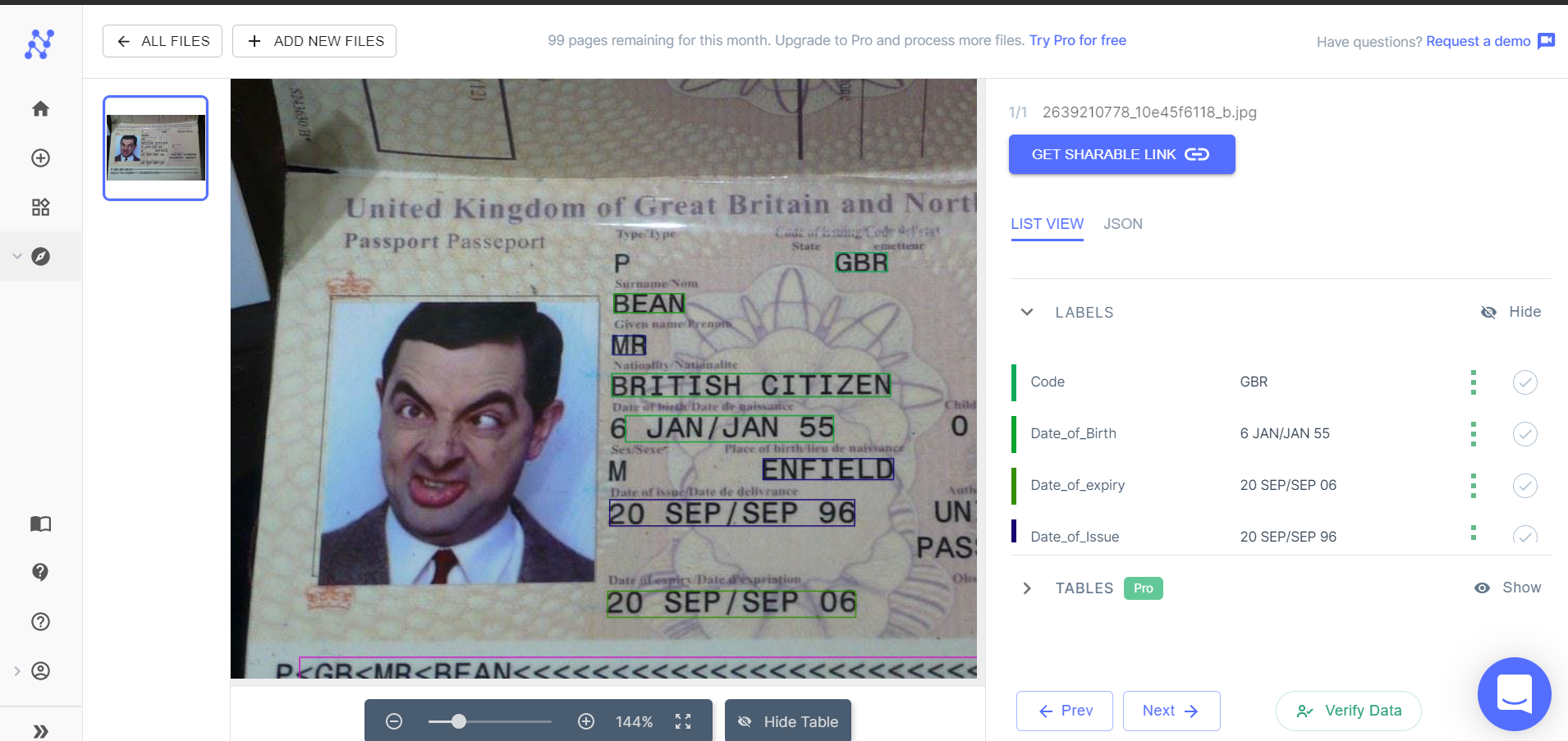

- Pass

Nanonetter online OCR & OCR API har många intressanta använd fall.

Steg 1: Välj en lämplig OCR-modell

Logga in till Nanonets och välj en OCR-modell som är lämplig för bilden som du vill extrahera text och data från. Om ingen av de förutbildade OCR-modellerna passar dina krav, kan du hoppa vidare för att ta reda på hur du skapar en anpassad OCR-modell.

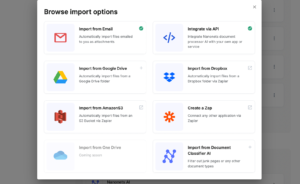

Steg 2: Lägg till filer

Lägg till filerna/bilderna som du vill extrahera text från. Du kan lägga till så många bilder du vill.

Steg 3: Test

Låt modellen köra några sekunder och extrahera text från bilden.

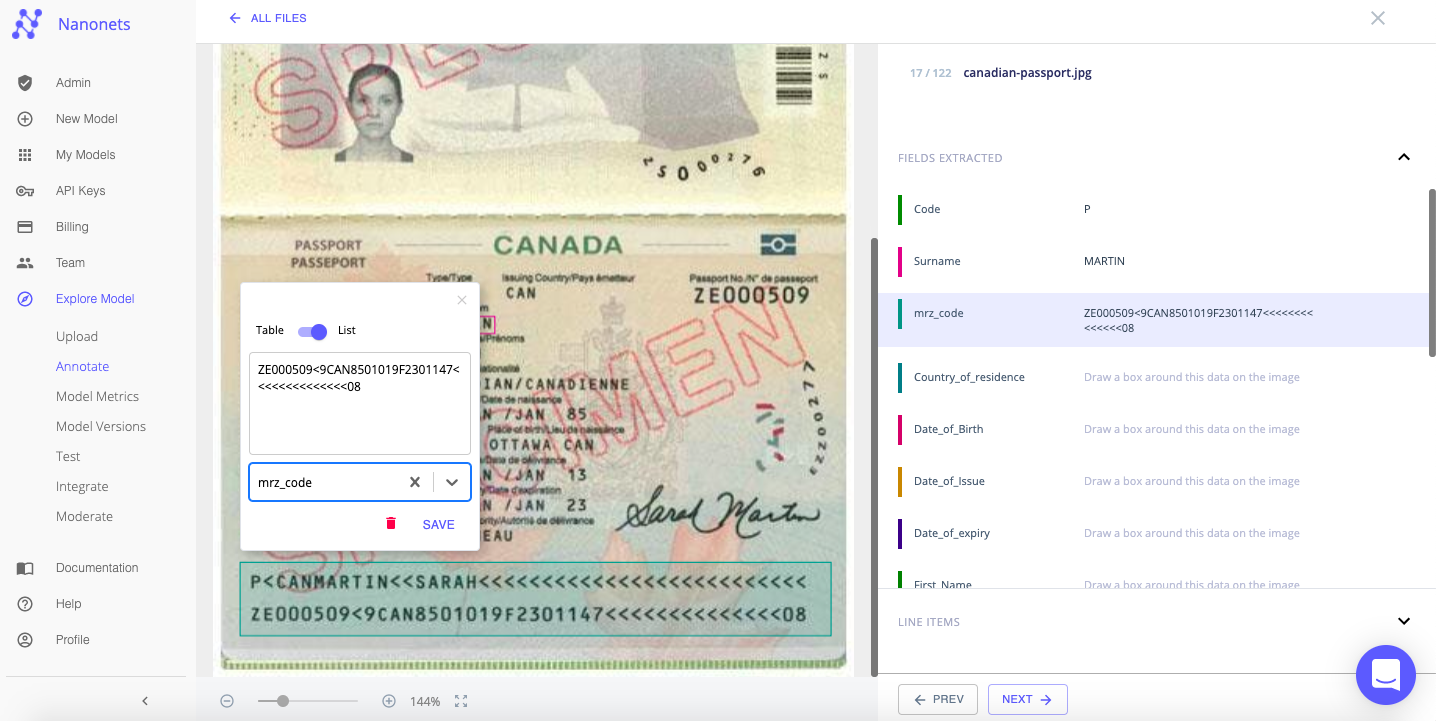

Steg 4: Kontrollera

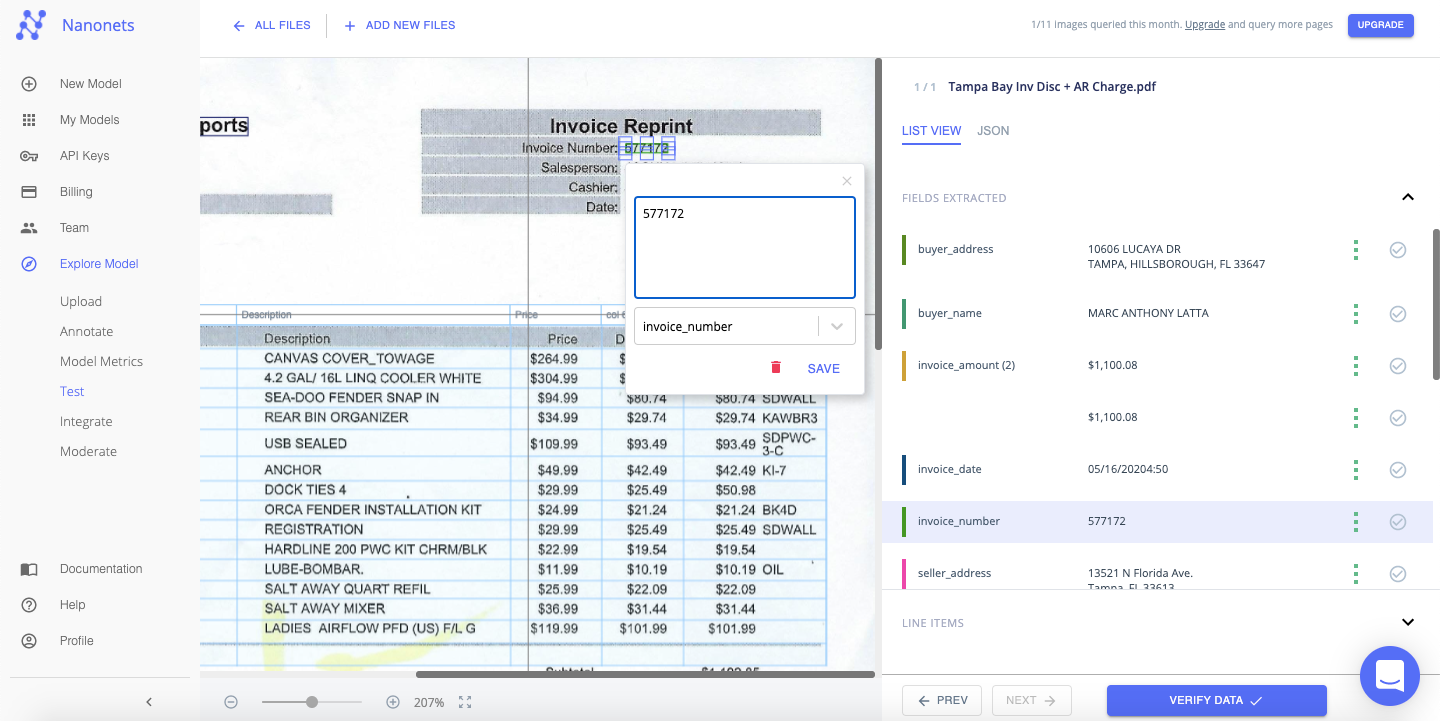

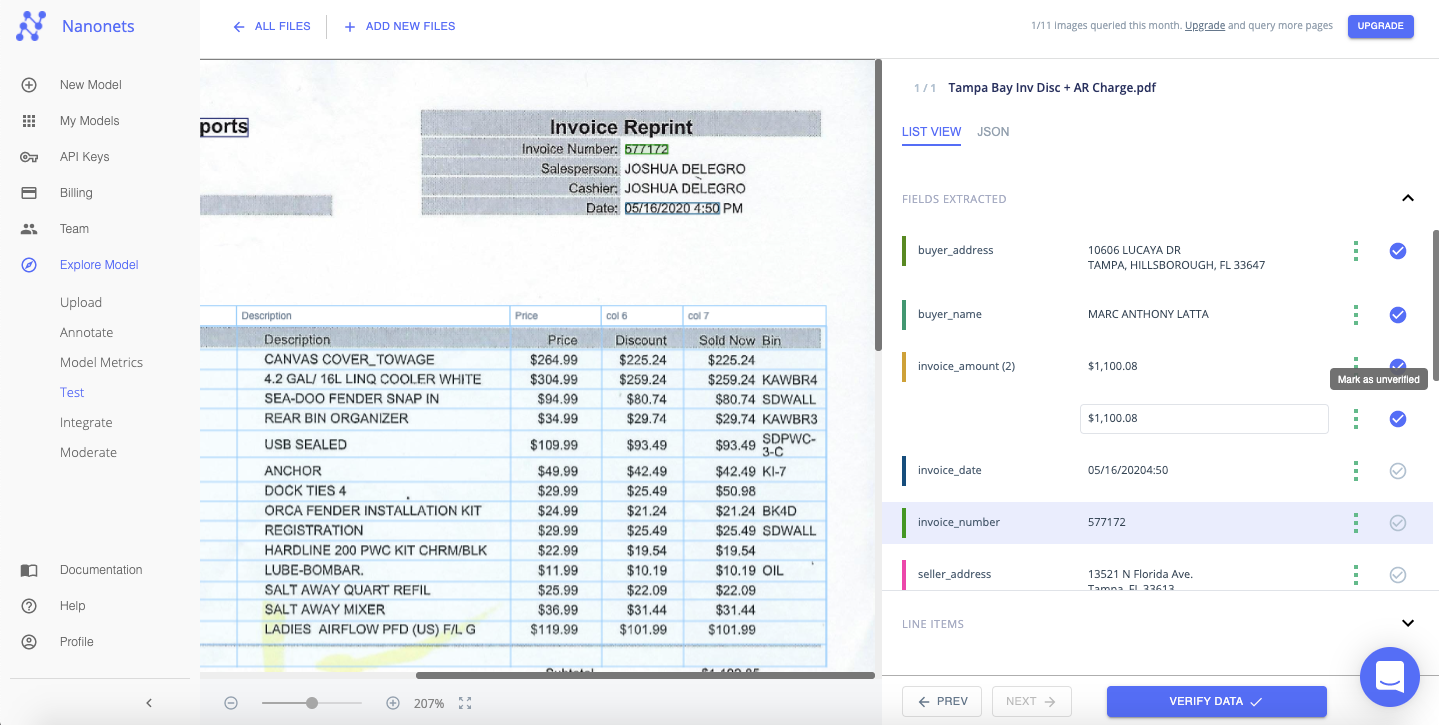

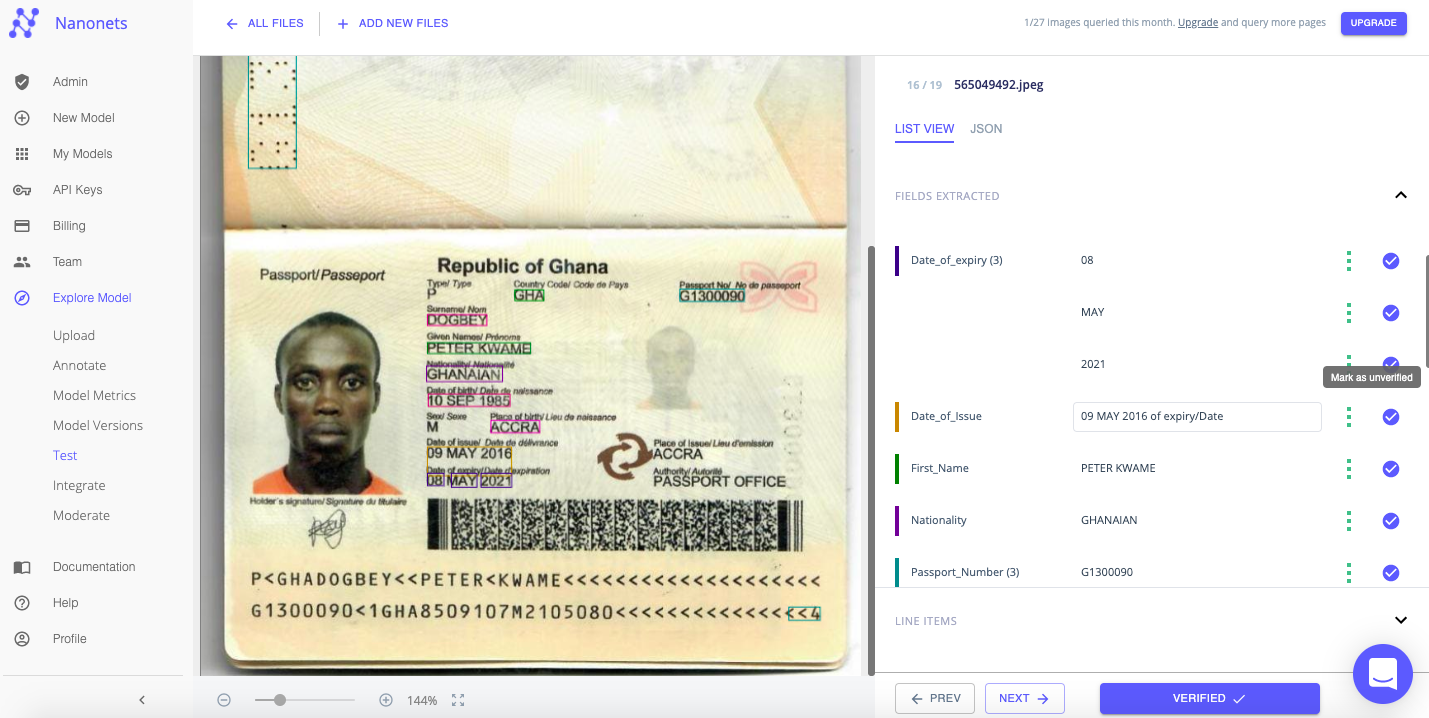

Verifiera snabbt texten som extraherats från varje fil genom att kontrollera tabellvyn till höger. Du kan enkelt dubbelkolla om texten har blivit korrekt igenkänd och matchad med ett lämpligt fält eller tagg.

Du kan till och med välja att redigera/korrigera fältvärdena och etiketterna i detta skede. Nanonets är inte bundna av mallen för bilden.

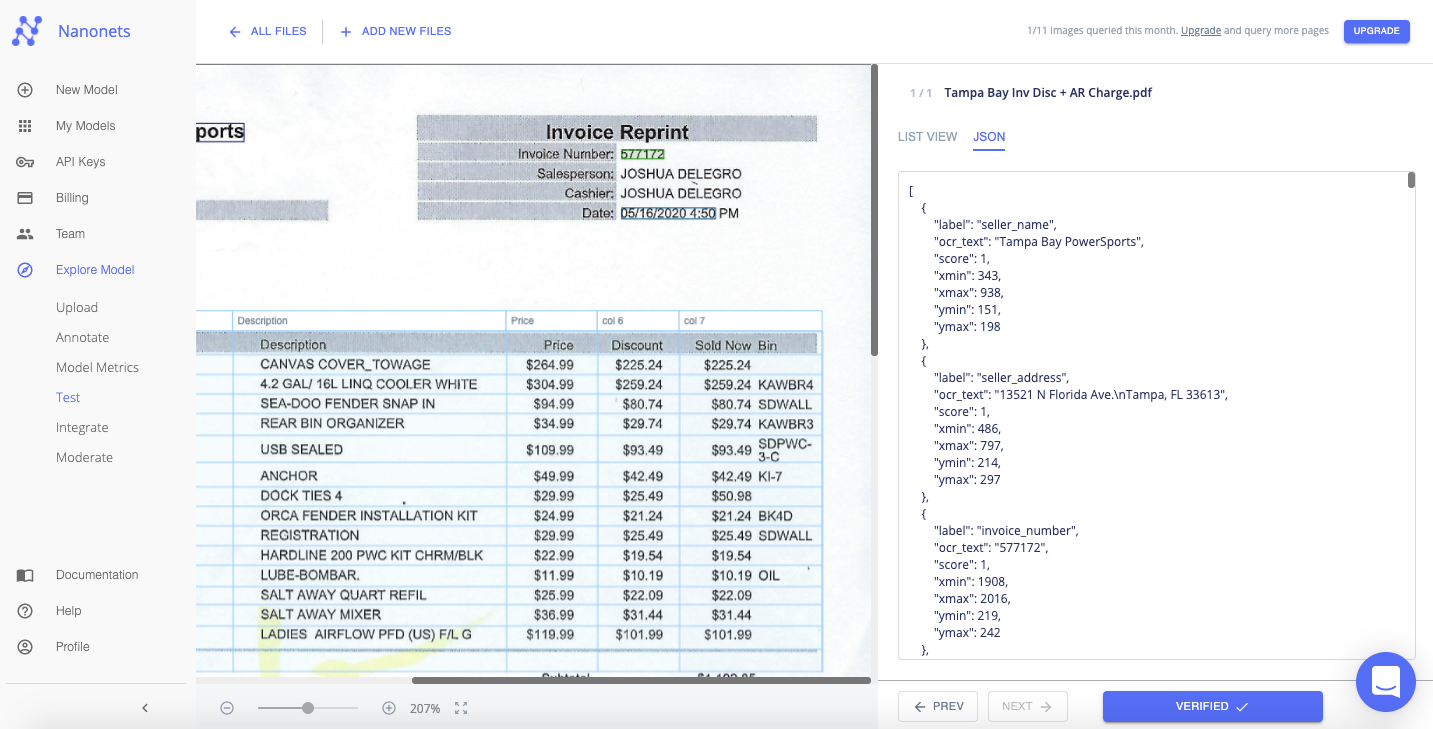

De extraherade uppgifterna kan visas i formatet “Listvy” eller “JSON”.

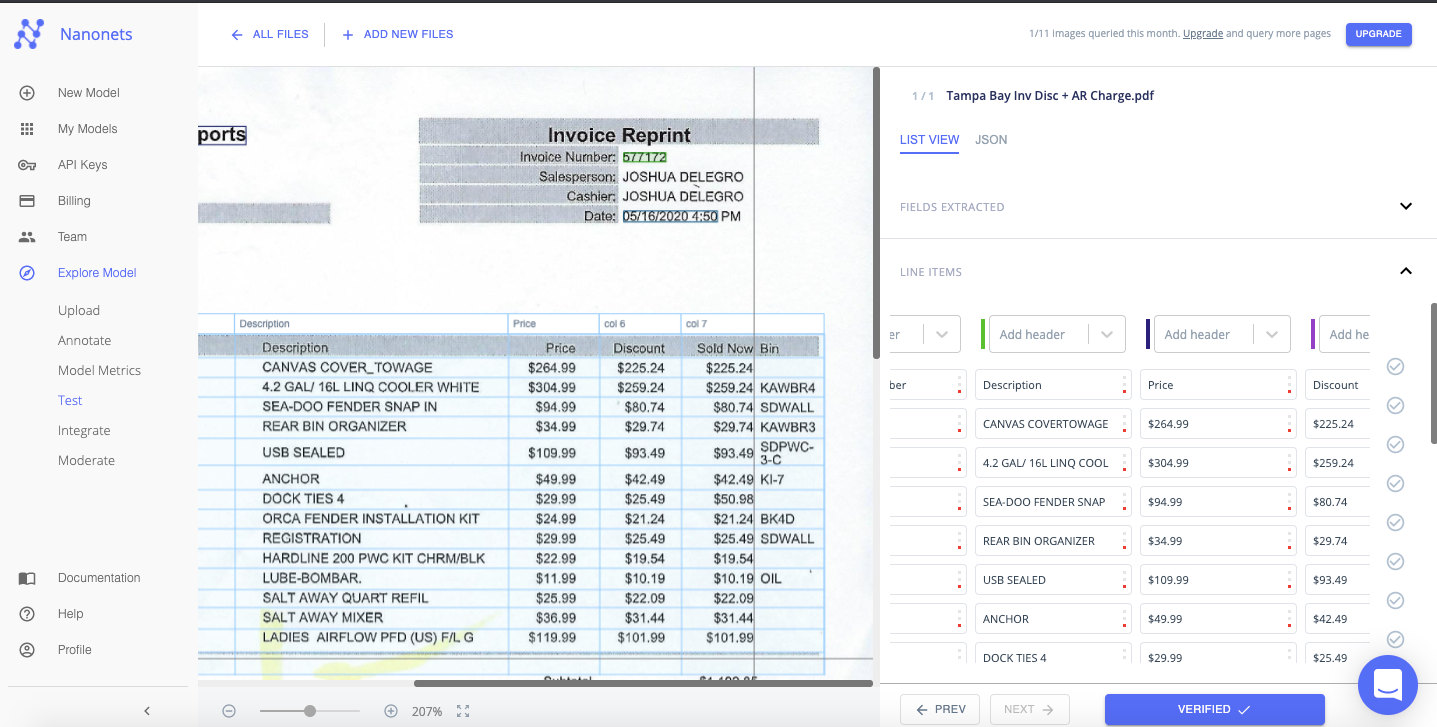

Du kan markera kryssrutan bredvid varje värde eller fält du bekräftar eller klicka på "Verifiera data" för att fortsätta direkt.

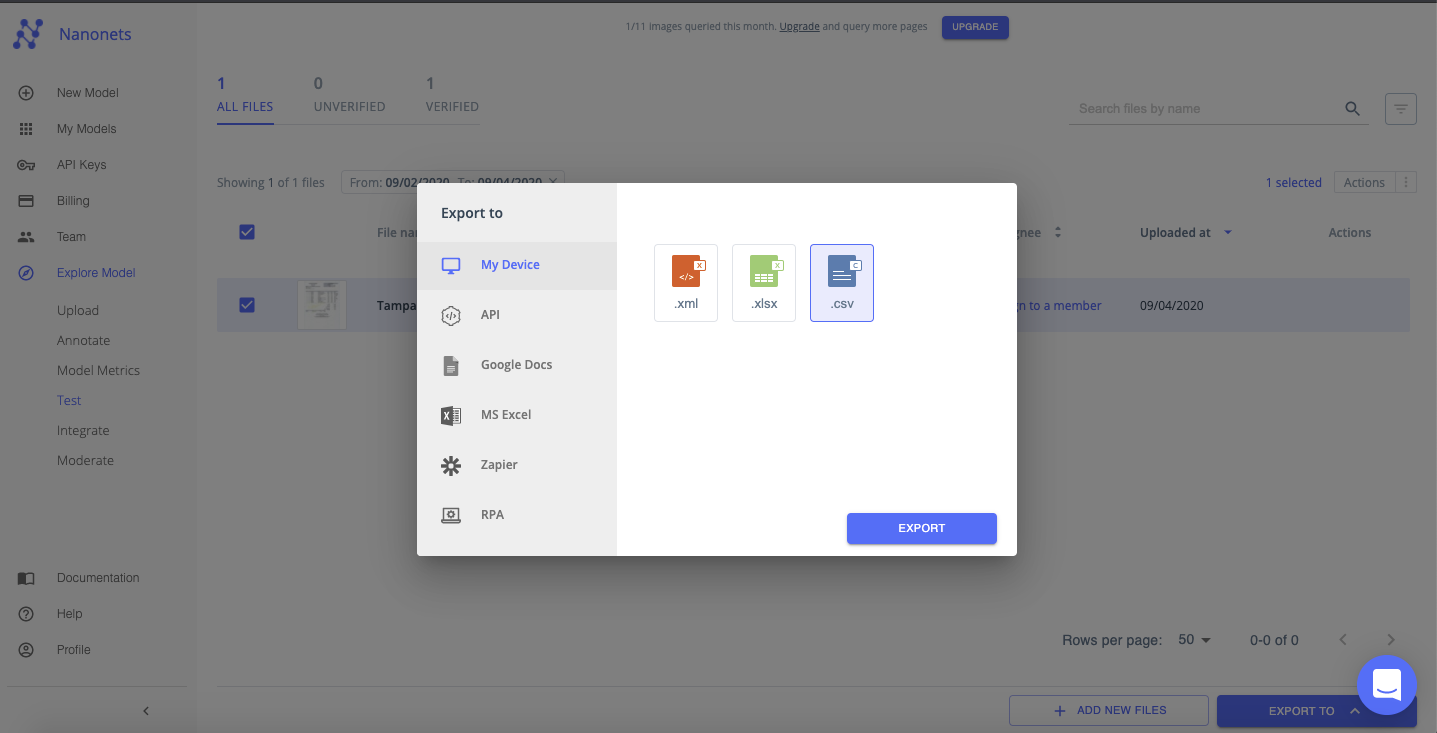

Steg 5: Exportera

När alla filer har verifierats. Du kan exportera de snyggt organiserade data som en xml-, xlsx- eller csv-fil.

Nanonets har intressant använd fall och unik kunders framgångshistorier. Ta reda på hur Nanonets kan göra ditt företag mer produktivt.

Det är enkelt att bygga en anpassad OCR-modell med Nanonets. Du kan vanligtvis bygga, träna och distribuera en modell för vilken bild- eller dokumenttyp som helst, på vilket språk som helst, allt på under 25 minuter (beroende på antalet filer som används för att träna modellen).

Titta på videon nedan för att följa de första 4 stegen i denna metod:

Steg 1: Skapa din egen OCR-modell

Logga in till Nanonets och klicka på “Skapa din egen OCR-modell”.

Steg 2: Ladda upp träningsfiler / bilder

Ladda upp exempelfiler som kommer att användas för att träna OCR-modellerna. OCR-modellens noggrannhet beror till stor del på kvaliteten och kvantiteten på de filer / bilder som laddas upp i detta skede

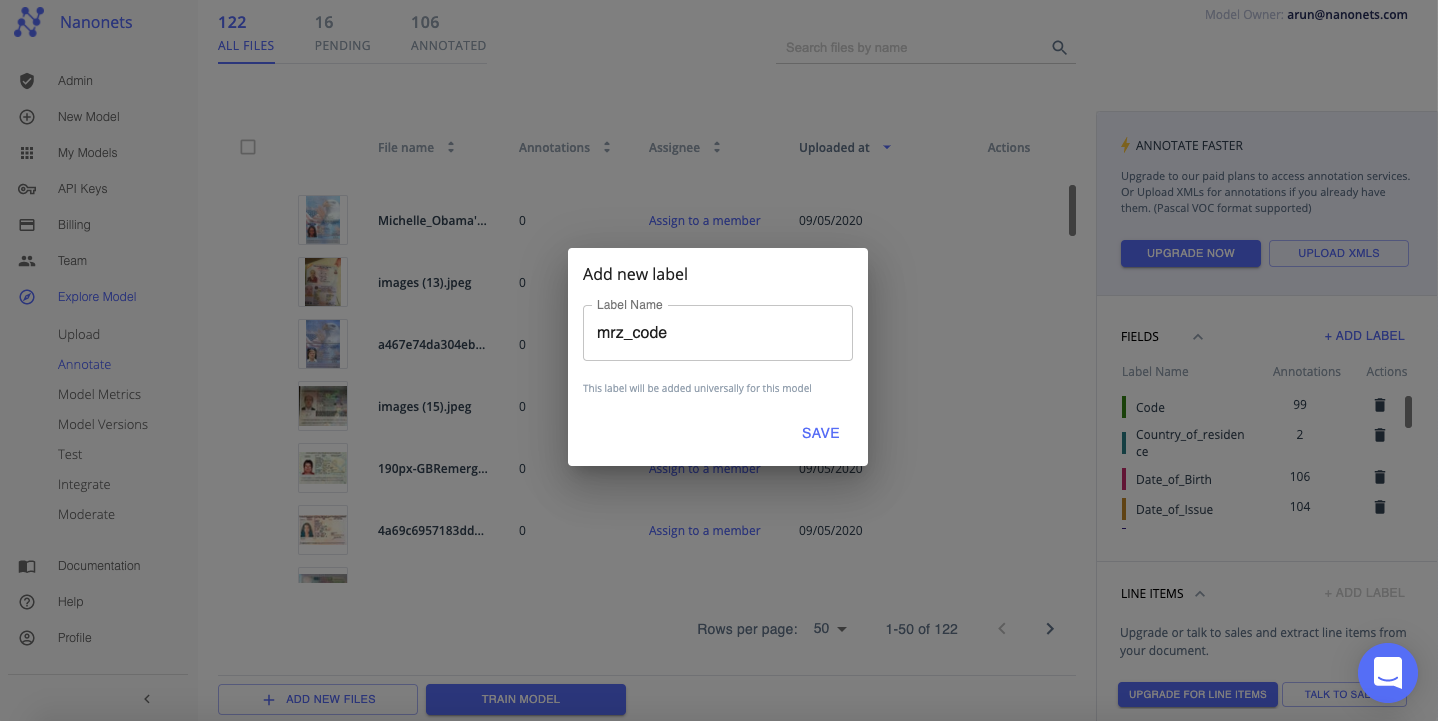

Steg 3: Kommentera text på filerna / bilderna

Anmärka nu varje bit text eller data med ett lämpligt fält eller etikett. Detta viktiga steg kommer att lära din OCR-modell att extrahera lämplig text från bilder och associera den med anpassade fält som är relevanta för dina behov.

Du kan också lägga till en ny etikett för att kommentera texten eller data. Kom ihåg att Nanonets inte är bunden av bildens mall!

Steg 4: Träna den anpassade OCR-modellen

När anteckningen är klar för alla träningsfiler / bilder klickar du på "Train Model". Träning tar vanligtvis mellan 20 minuter och 2 timmar beroende på antalet filer och modeller i kö för träning. Du kan uppgradera till en betald plan för att få snabbare resultat i detta skede (vanligtvis under 20 minuter).

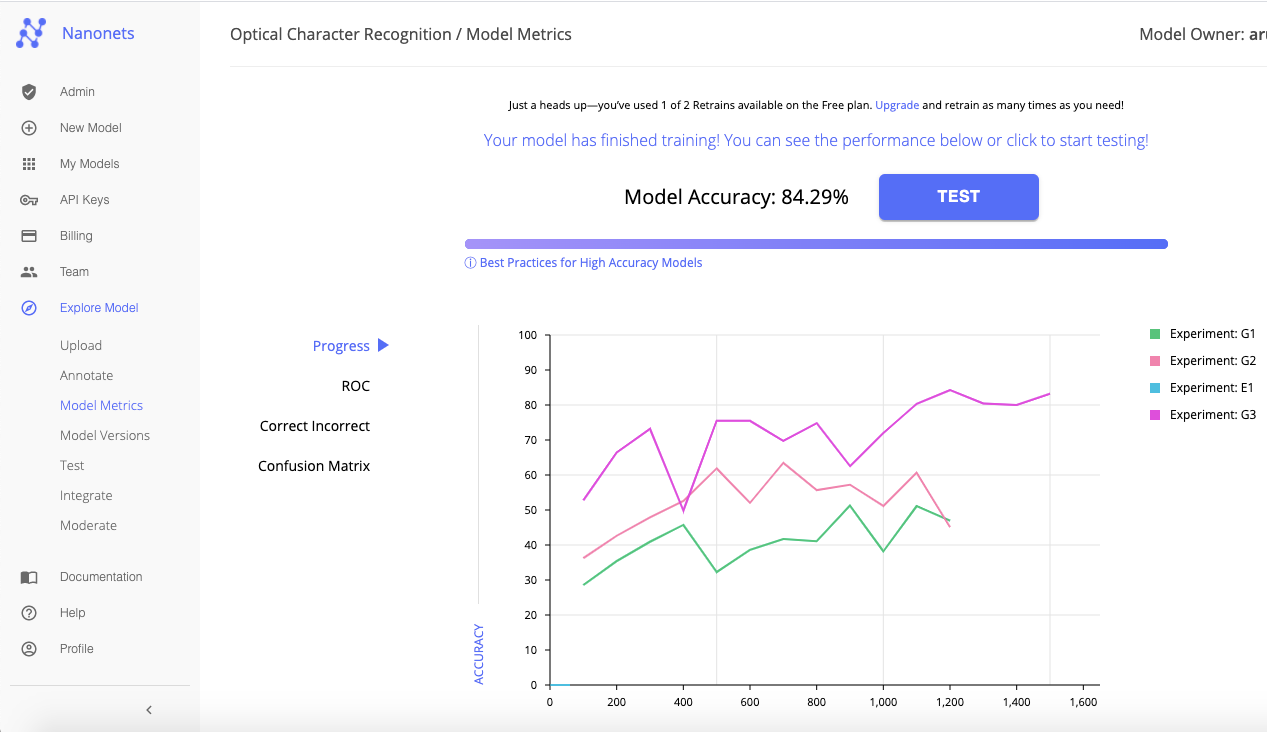

Nanonets utnyttjar djupinlärning för att bygga olika OCR-modeller och testar dem mot varandra för noggrannhet. Nanonets väljer sedan ut den bästa OCR-modellen (baserat på dina indata och noggrannhetsnivåer).

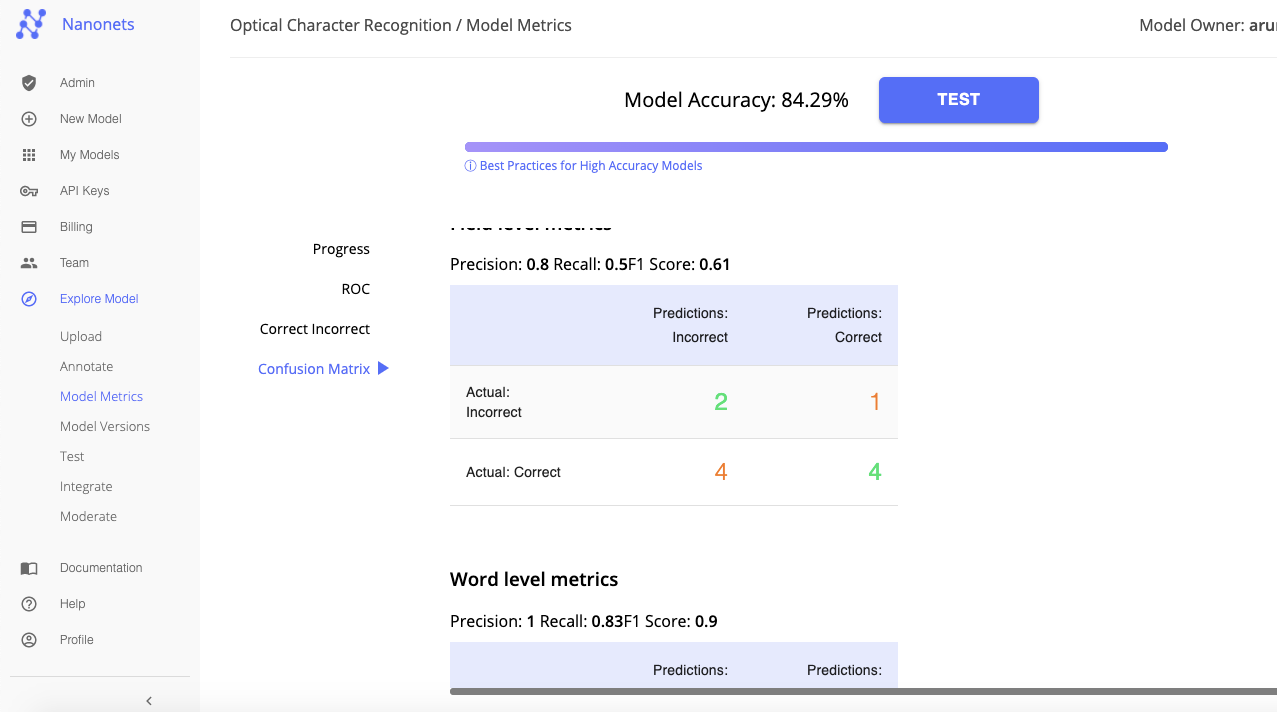

Fliken "Model Metrics" visar de olika mätningarna och jämförande analyserna som gjorde det möjligt för Nanonets att välja den bästa OCR-modellen bland alla byggda. Du kan omskola modellen (genom att tillhandahålla ett bredare utbud av träningsbilder och bättre anteckningar) för att uppnå högre nivåer av noggrannhet.

Eller, om du är nöjd med noggrannheten, klicka på “Test” för att testa och verifiera om den här anpassade OCR-modellen fungerar som förväntat på ett urval av bilder eller filer från vilka text / data behöver extraheras.

Steg 5: Testa och verifiera data

Lägg till ett par exempel på bilder för att testa och verifiera den anpassade OCR-modellen.

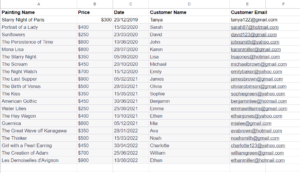

Om texten har identifierats, extraherats och presenterats på lämpligt sätt, exportera sedan filen. Som du kan se nedan har de extraherade uppgifterna organiserats och presenterats i ett snyggt format.

Grattis, du har nu byggt och tränat en anpassad OCR-modell för att extrahera text från vissa typer av bilder!

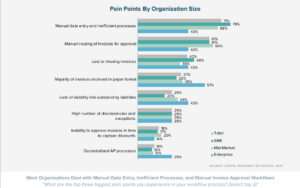

Hanterar ditt företag textigenkänning i digitala dokument, bilder eller PDF-filer? Har du undrat hur man extraherar text från bilder korrekt?

Träna dina egna OCR-modeller med NanoNets API

Här är en detaljerad guide för träning dina egna OCR-modeller med hjälp av Nanonets API. I dokumentation, hittar du redo att avfyra kodprover i Python, Shell, Ruby, Golang, Java och C#, samt detaljerade API -specifikationer för olika slutpunkter.

Här är en steg-för-steg-guide för att träna din egen modell med hjälp av Nanonets API:

Steg 1: Klona Repo

git clone https://github.com/NanoNets/nanonets-ocr-sample-python

cd nanonets-ocr-sample-python

sudo pip install requests

sudo pip install tqdmSteg 2: Få din gratis API-nyckel

Hämta din gratis API-nyckel från https://app.nanonets.com/#/keys

Steg 3: Ställ in API-nyckeln som en miljövariabel

export NANONETS_API_KEY=YOUR_API_KEY_GOES_HERE

Steg 4: Skapa en ny modell

python ./code/create-model.py

Obs: Detta genererar ett MODEL_ID som du behöver för nästa steg

Steg 5: Lägg till modell-id som miljövariabel

export NANONETS_MODEL_ID=YOUR_MODEL_ID

Steg 6: Ladda upp träningsdata

Samla bilderna på objektet du vill upptäcka. När du har en dataset klar i mappen images (bildfiler), börja ladda upp datasetet.

python ./code/upload-training.py

Steg 7: Tågmodell

När bilderna har laddats upp börjar du utbilda modellen

python ./code/train-model.py

Steg 8: Hämta modelltillstånd

Modellen tar ~ 30 minuter att träna. Du får ett mejl när modellen är utbildad. Under tiden kontrollerar du modellens tillstånd

watch -n 100 python ./code/model-state.py

Steg 9: Gör förutsägelse

När modellen tränas. Du kan göra förutsägelser med hjälp av modellen

python ./code/prediction.py PATH_TO_YOUR_IMAGE.jpgFördelarna med att använda Nanonets framför andra OCR API:er går utöver bara bättre noggrannhet när det gäller att extrahera text från bilder. Här är 7 skäl till varför du bör överväga att använda Nanonets OCR för textigenkänning istället:

1. Arbeta med anpassade data

De flesta OCR-programvara är ganska stela när det gäller vilken typ av data de kan arbeta med. Att träna en OCR-modell för ett användningsfall kräver en stor grad av flexibilitet med avseende på dess krav och specifikationer; en OCR för fakturahantering kommer att skilja sig mycket från en OCR för pass! Nanoneter är inte bundna av sådana stela begränsningar. Nanonets använder din egen data för att träna OCR-modeller som är bäst lämpade för att möta ditt företags särskilda behov.

2. Arbeta med icke-engelska eller flera språk

Eftersom Nanonets fokuserar på träning med anpassade data, är det unikt placerat för att bygga en enda OCR-modell som kan extrahera text från bilder på vilket språk som helst eller flera språk samtidigt.

3. Kräver ingen efterbearbetning

Text som extraheras med OCR-modeller måste vara intelligent strukturerad och presenterad i ett begripligt format; annars går det åt mycket tid och resurser för att omorganisera data till meningsfull information. Medan de flesta OCR-verktyg helt enkelt tar och dumpar data från bilder, extraherar Nanonets endast relevant data och sorterar dem automatiskt i intelligent strukturerade fält som gör det lättare att se och förstå.

4. Lär sig kontinuerligt

Företag står ofta inför dynamiskt föränderliga krav och behov. För att övervinna potentiella vägspärrar låter Nanonets dig enkelt träna om dina modeller med ny data. Detta gör att din OCR-modell kan anpassa sig till oförutsedda förändringar.

5. Hanterar vanliga databegränsningar med lätthet

Nanonets utnyttjar AI, ML och Deep Learning-tekniker för att övervinna vanliga databegränsningar som i hög grad påverkar textigenkänning och extrahering. Nanonets OCR kan känna igen och hantera handskriven text, bilder av text på flera språk samtidigt, bilder med låg upplösning, bilder med nya eller kursiva teckensnitt och varierande storlekar, bilder med skuggtext, lutad text, slumpmässig ostrukturerad text, bildbrus, suddiga bilder och mer. Traditionella OCR API:er är helt enkelt inte utrustade för att fungera under sådana begränsningar; de kräver data på en mycket hög nivå av trohet vilket inte är normen i verkliga scenarier.

6. Kräver inget internt team av utvecklare

Du behöver inte oroa dig för att anställa utvecklare och skaffa talang för att anpassa Nanonets API för dina affärsbehov. Nanonets byggdes för problemfri integration. Du kan också enkelt integrera Nanonets med de flesta CRM-, ERP- eller RPA-programvara.

7. Anpassa, anpassa, anpassa

Du kan fånga så många text-/datafält du vill med Nanonets OCR. Du kan till och med bygga anpassade valideringsregler som fungerar för dina specifika krav för textigenkänning och textextraktion. Nanonets är inte alls bundna av mallen för ditt dokument. Du kan fånga data i tabeller eller rader eller något annat format!

Nanonets har många användningsfall som kan optimera dina affärsresultat, spara kostnader och öka tillväxten. Ta reda på hur Nanonets användningsfall kan tillämpas på din produkt.

Eller kolla in Nanonetter OCR API i aktion och börja bygga anpassning OCR modeller gratis!

Uppdatering Juli 2022: det här inlägget publicerades ursprungligen i oktober 2020 och har sedan dess uppdaterats regelbundet.

Här är en bild sammanfattar resultaten i den här artikeln. Här är en alternativ version av detta inlägg.

- AI

- AI och maskininlärning

- ai konst

- ai art generator

- har robot

- artificiell intelligens

- artificiell intelligenscertifiering

- artificiell intelligens inom bankväsendet

- artificiell intelligens robot

- robotar med artificiell intelligens

- programvara för artificiell intelligens

- blockchain

- blockchain konferens ai

- coingenius

- konversationskonstnärlig intelligens

- kryptokonferens ai

- dalls

- djupt lärande

- du har google

- maskininlärning

- OCR

- plato

- plato ai

- Platon Data Intelligence

- Platon spel

- PlatonData

- platogaming

- skala ai

- syntax

- Textigenkänning

- zephyrnet